Материалы по тегу: облако

|

03.03.2026 [16:05], Руслан Авдеев

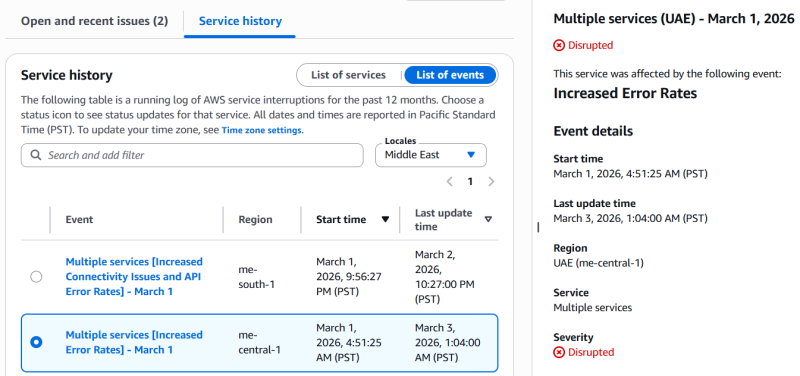

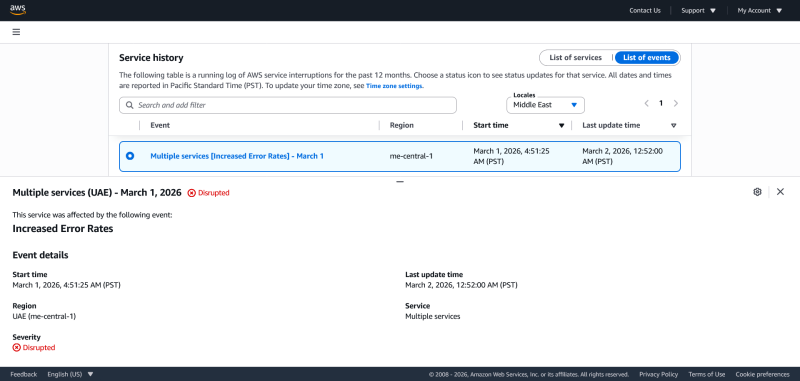

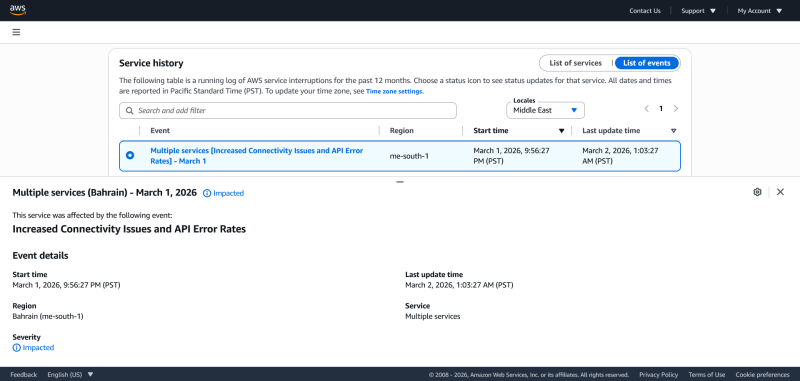

Иранские дроны повредили два дата-центра Amazon в ОАЭ и «зацепили» ещё один в БахрейнеВ результате ударов беспилотников на Ближнем Востоке пострадали три дата-центра Amazon. Компания отказалась от корпоративных эвфемизмов о попадании неких «объектов», которые вызвали «искрение и возгорание», и прямо заявила, что дроны попали в два ЦОД в ОАЭ, обслуживающие зоны доступности mec1-az2 и mec1-az3 региона ME-CENTRAL-1. Третий ЦОД в Бахрейне (mes1-az2 в ME-SOUTH-1) пострадал от удара в «непосредственной близости» от него. Хотя прямо Amazon об этом не говорит, очевидно, что беспилотники были иранские. Как заявила AWS, удары нанесли «структурный урон», нарушили подачу электроэнергии объектам компании, а в некоторых случаях потребовалось тушение пожаров, что причинило дополнительный ущерб, на этот раз от воды. По словам компании, организовано тесное сотрудничество с местными властями, а первостепенное внимание уделяется безопасности персонала. Зоны mec1-az2 и mec1-az3 региона ME-CENTRAL-1 по-прежнему работают с перебоями, третья зона — mec1-az1 продолжает функционировать в обычном режиме, хотя затронуты некоторые сервисы az1, зависевшие и от работы других зон. В регионе ME-SOUTH-1, расположенном в Бахрейне, пострадал один объект. Впрочем, как в Бахрейне, так и в ОАЭ клиенты продолжают сталкиваться ошибками и проблемами доступности ряда сервисов. В компании предполагают, что инфраструктуру ожидает длительный процесс восстановления с учётом «характера причинённого физического ущерба». С учётом ситуации на Ближнем Востоке AWS рекомендует клиентам создавать резервные копии информации и оценить, насколько возможен перенос рабочих нагрузок в другие облачные регионы Amazon.

02.03.2026 [13:00], Руслан Авдеев

Облако AWS пострадало от «удара объектов по ЦОД» в ОАЭ, приведшего к пожаруЗоны доступности mec1-az2 и mec1-az3 в регионе AWS ME-CENTRAL-1 в ОАЭ прекратили работу после того, как по дата-центру ударили «объекты». По данным AWS, объекты вызвали «искры и возгорание». Пожарные отключили сетевое электропитание и генераторы объекта для того, чтобы без помех погасить огонь. Сервисы EC2 и S3 отключены полностью, ещё 84 сервиса подвержены различным проблемам. Зона mec1-az1 не пострадала. Тем, кто не использовал резервирование в нескольких зонах, компания рекомендует развернуть нагрузки из последних бэкапов в незатронутых зонах или регионах. Сообщается, что компания всё ещё ждёт разрешения для того, чтобы вновь подать питание, и как только получит его, будет обеспечено безопасное восстановление работы и связи. Одновременно пострадала и зона доступности mes1-az2 региона ME-SOUTH-1 в Бахрейне. Компания сообщает о проблемах с питанием и сетевым подключением, но не уточняет причины сбоя. Всего проблемы затронули 66 сервисов. Остальные зоны региона не пострадали.

02.03.2026 [09:56], Руслан Авдеев

И не звони мне больше: Microsoft представила по-настоящему автономное частное облако Azure Local

azure stack

microsoft

microsoft azure

software

евросоюз

информационная безопасность

конфиденциальность

облако

частное облако

Microsoft улучшила автономность решения Azure Local, позволяющего теперь создавать полностью «карманные» облака без подключения к интернету. На фоне политических трений между руководством США и Евросоюза всё больше европейских клиентов желают обеспечить себе цифровой суверенитет, сообщает The Register. Как и конкуренты из числа американских гиперскейлеров, Microsoft представила для Европы инициативы, призванные устранить сомнения местных заказчиков в безопасности их данных, включая возможность блокировки доступа к ним или получение доступа к информации американскими властями в рамках закона US CLOUD Act. В марте 2025 года Microsoft завершила формирование сервиса EU Data Boundary, а в ноябре добавила новые функции, призванные дополнительно укрепить уверенность европейских клиентов. Тем не менее всё больше организаций в Европе требуют полного контроля над своими данными, чего сервис обеспечить не может, поскольку Microsoft подчиняется американским законам. Компания даже пообещала судиться с правительством США, если то попытается лишить европейских клиентов её продуктов. Azure Local (Azure Stack HCI) — ответ Microsoft на опасения Европы. Azure Local и ранее позволял работать на собственных мощностях, но требовал подключение к «большому» облаку хотя бы раз в 30 дней для обновлений, мониторинга и проверки лицензий, в противном случае функциональность ограничивалась. Теперь же в Azure Local доступны полностью изолированные от публичных облаков операции. Другими словами, связь с «метрополией» больше не нужна. Кроме того, компания обеспечила локальный доступ к Microsoft 365 Local (в частности, Exchange Server, SharePoint Server и Skype for Business Server), а также анонсировала Foundry Local для «квалифицированных клиентов». Заверения Microsoft могут быть восприняты с недоверием — особенно с учётом того, что в 2025 году компания признала во Франции, что буквально не имеет возможности обеспечить данным полный суверенитет — если с требованием предоставить доступ к данным выступят американские власти. Возможность работать полностью независимо от Сети должна убедить клиентов в привлекательности работы с IT-гигантом, даже с учётом того, что ПО разрабатывается за океаном. По словам представителя ассоциации европейских облачных провайдеров CISPE, суверенитет всё более становится обязательным требованием, поэтому инструменты, позволяющие работать на локальных облачных платформах, приветствуются. Ассоциация намерена оценить новое предложения на предмет гарантий суверенитета и надёжности в рамках программы CISPE Sovereign Cloud Services Framework. CISPE и Microsoft достигли в 2024 году соглашения, в соответствии с которым IT-гигант обещал разработать версию Azure Local для европейских провайдеров и хорошо заплатить, а CISPE обязалась отказаться от обвинений компании в неконкурентных практиках. Правда, Microsoft уже пропустила оговоренные сроки. Microsft — не единственный техногигант, работающий над обеспечением суверенитета для своих клиентов. Amazon Web Services (AWS) предложила всеобщий доступ к своему суверенному облаку European Sovereign Cloud, а Google продаёт клиентам множество суверенных решений, включая Google Cloud Airgapped — сервис работает на серверах, полностью отключенных от интернета. Впрочем, Google в основном предпочитает совместные партнёрские решения с европейскими компаниями. Удовлетворит ли новое решение клиентов Microsoft, покажет практика его применения и то, каким будет определение «суверенитета». Возможность полного отключения от Сети удовлетворит некоторых клиентов, хотя некоторых по-прежнему может беспокоить то, что программное обеспечение может оставаться под контролем Microsoft. И даже если внутренние данные никуда не «утекут», всё равно остаётся вероятность того, что компания сможет тем или иным образом отключить сервисы Azure Local. Корпоративные клиенты уже ищут альтернативные предложения от локальных облачных провайдеров. В конце 2025 года немецкая SAP объявила, что инвестирует более €20 млрд ($23,3 млрд) в расширение суверенного облачного сервиса в Европе. Правда, глава SAP Кристиан Кляйн (Christian Klein) ранее заявлял, что не видит смысла в построении в Европе собственной облачной инфраструктуры в противовес уже созданной здесь американцами. Кроме того, у компании весьма тесные отношения с Azure. Доля же истинно европейских облаков годами остаётся низкой, поэтому отказаться от услуг заокеанских компаний практически невозможно, а open source в обозримом будущем вряд ли поможет.

27.02.2026 [22:55], Владимир Мироненко

Amazon вложит в OpenAI $50 млрд, OpenAI в ответ потратит $100 млрд на 2 ГВт мощностей TrainiumOpenAI и Amazon объявили о заключении соглашения о стратегическом партнёрстве с целью ускорения инноваций в области ИИ для предприятий, стартапов и конечных потребителей по всему миру. В рамках многолетнего соглашения Amazon инвестирует в OpenAI $50 млрд — $15 млрд первым траншем, а затем еще $35 млрд в ближайшие месяцы при выполнении определённых условий. AWS и OpenAI совместно создадут среду выполнения с сохранением состояния (Stateful Runtime Environment) на базе моделей OpenAI, которая будет доступна в Amazon Bedrock для создания приложений и агентов генеративного ИИ. Подобное окружение позволяет разработчикам сохранять контекст, запоминать предыдущую работу, работать с различными программными инструментами и источниками данных, а также получать доступ к вычислительным ресурсам. Новинка будет интегрирована с Amazon Bedrock AgentCore и инфраструктурными сервисами, чтобы приложения и ИИ-агенты клиентов работали согласованно с остальными приложениями инфраструктуры, работающими в AWS. AWS также станет эксклюзивным сторонним поставщиком облачных услуг для платформы OpenAI Frontier, позволяющей компаниям создавать, развёртывать и управлять командами ИИ-агентов, работающих в реальных бизнес-системах с общим контекстом. По мере перехода компаний от экспериментов к внедрению ИИ в производство, Frontier упрощает быструю, безопасную и глобальную интеграцию ИИ-технологий в существующие рабочие процессы. Кроме того, OpenAI и Amazon будут сотрудничать в разработке пользовательских моделей для работы с приложениями Amazon, ориентированными на клиентов. AWS и OpenAI также сообщили о расширении ещё на $100 млрд более раннего соглашения о многолетнем стратегическом партнёрстве стоимостью $38 млрд, в рамках которого AWS обязалась предоставлять OpenAI в течение семи лет доступ к ускорителям NVIDIA. Расширенное соглашение со сроком действия 8 лет включает в себя обязательство OpenAI использовать около 2 ГВт мощностей на базе ускорителей Trainium, чтобы поддерживать спрос на Stateful Runtime, Frontier и другие рабочие нагрузки. Это обязательство распространяется как на чипы Trainium3, так и на чипы следующего поколения Trainium4, которые появятся в 2027 году и получат технологию NVIDIA NVLink. Сегодняшний день оказался богатым на события для OpenAI. Компания объявила о привлечении $110 млрд инвестиций в рамках раунда финансирования с предварительной оценкой её рыночной стоимости в $730 млрд, что значительно больше оценки в $500 млрд в октябре 2025 года. Лидером раунда стала Amazon с инвестициями в $50 млрд, за ней следуют NVIDIA и SoftBank, инвестировавшие по $30 млрд. Компания заявила, что ожидает, что к раунду присоединятся и другие инвесторы. Ранее Anthropic, ключевой конкурент OpenAI, закрыл раунд финансирования на $30 млрд, подняв капитализацию до $380 млрд. У компании долгие и тесные отношения с AWS, которая развернула для стартапа один из крупнейших в мире ИИ-кластеров Project Rainier. Впрочем, Anthropic тоже старается диверсифицировать поставки вычислительных мощностей — она заключила контракты с Microsoft (на чипы NVIDIA), а также с Google (на TPU).

27.02.2026 [15:30], Руслан Авдеев

Шутки в сторону: 1 апреля провайдер Hetzner резко поднимет цены — до +50 %Один из крупнейших европейских хостинг-провайдеров и операторов ЦОД — компания Hetzner предупредила клиентов, что рост цен на её услуги составит до 50 %. Это касается как имеющихся пользователей, так и будущих — в Германии, Финляндии, США и Сингапуре, сообщает The Register. Hetzner известна (пока) недорогими сервисами, в первую очередь IaaS, для разработчиков и корпоративных клиентов. Компания сообщила, что причиной изменений стоимости её продуктов стал рост цен в разных сферах рынка IT. Компания пожаловалась, что выросла стоимость эксплуатации инфраструктуры и нового оборудования, а попытка оптимизации расходов не принесла желаемого эффекта. Список ценовых изменений свидетельствует, что многие услуги действительно значительно подорожают, многие на 30 %, а некоторые даже на 50 %, что может серьёзно сказаться на небогатых клиентах. Стремительное развитие ИИ-индустрии стало одним из факторов, определивших движение рынка инфраструктуры в непредсказуемых направлениях на фоне спроса на всё большие вычислительные мощности. Гиперскейлеры не могут приобрести достаточно HBM, RAM и флеш-памяти, а также ИИ-ускорителей, особенно производства NVIDIA. Ожидается, что цены на DRAM- и NAND-модули в текущем квартале удвоятся, а некоторые серверные CPU уже в дефиците и скоро подорожают. Производители HDD жалуются, что распродали столько жёстких дисков, сколько собирались выпустить за весь год.

Источник изображения: Jon Del Rivero/unspalsh.com В Omdia отметили, что Hetzner фактически является провайдером облачной инфраструктуры, поэтому в подорожании сервисов даже на 50 % нет ничего удивительного — это всего лишь отражение текущей реальности. В Omdia считают, что пользователи могут ожидать повышения цен и со стороны других провайдеров. Наибольшему давлению подверглись компании-операторы второго эшелона, они в более невыгодном положении в сравнении с гиперскейлерами. Эксперты Omdia отмечают, что рынок облачных сервисов ожидает некоторый раскол — гиперскейлеры уровня AWS, Microsoft и Google имеют долгосрочные прямые соглашения напрямую с поставщиками «железа», защищающие их от немедленного ценового шока. Тем временем средние и малые компании, не обладающие гигантской покупательной способности, в том числеHetzner и OVHcloud (тоже анонсировавшей рост цен), не имеют выбора, перекладывая издержки на пользователей. К несчастью для компаний, рассчитывающих на бюджетный облачный хостинг, инфраструктурные издержки взлетят. Рынку необходимо, чтобы компании уровня Hetzner продолжали работать и сохраняли прибыльность. Реакция онлайн-сообщества оказалась смешанной. Одни пользователи говорят, что рост цен непосильный, поэтому им придётся искать возможные альтернативы. У некоторых небольших провайдеров действительно пока что более привлекательные цены в сравнении с Hetzner. Среди плюсов называется относительно недорогая стоимость ухода от к конкурентам. Другие же пользователи пишут, что реакция компании предсказуема. В противном случае пришлось бы вообще отказаться от облачных серверов. Отмечается, что у Hetzner всё ещё лучшее соотношение цены/производительности в сравнении с конкурентами. Стоит отметить, что некоторые компании довольно спорно обосновывают ценообразование. Например, не так давно сообщалось, что Cisco нашла оправдание повышению цен на свои продукты, несмотря на рекордную выручку во II четверти текущего финансового года.

23.02.2026 [20:40], Владимир Мироненко

Вовремя сбежавший в Исландию вице-президент NetApp отвертелся от суда в СШАФедеральный окружной суд США по Среднему округу Флориды отклонил «без ущерба для дальнейшего разбирательства» (without prejudice) из-за вопросов по поводу юрисдикции иск NetApp с обвинением бывшего технического директора и старшего вице-президента Йона Торгримура Стефанссона (Jón Thorgrímur Stefánsson), неожиданно скрывшегося в Исландии, в нарушении контракта и незаконном присвоении коммерческой тайны. NetApp уже подала апелляцию, уведомив об этом на прошлой неделе, сообщил ресурс Blocks & Files. История берёт начало в августе 2017 года, когда NetApp приобрела исландскую компанию Greenqloud и её ПО Qstack для оркестрации и управления облачными сервисами в гибридных облачных средах за $51 млн. Генеральный директор Greenqloud Стефанссон вместе с командой присоединился к NetApp. В июне 2025 года Стефанссон и ещё пять сотрудников Greenqloud покинули NetApp и основали Red Stapler. Через два месяца компания VAST Data приобрела этот стартап. Стефанссон стал генеральным директором по облачным технологиям в VAST Data, а пять его коллег заняли должности архитекторов и инженеров ПО. По мнению NetApp, все они фактически участвовали в разработке VAST AI OS, которая получила сходную с ONTAP Data Fabric функциональность в части работы с облаками. Причём, как считает NetApp разработать эти функции за десять недель между созданием и продажей Red Stapler никак не могла, т.е. дорогостоящие наработки были украдены у NetApp и переданы VAST Data, а Red Stapler была создана лишь для прикрытия. Стефанссон заявил, что не передавал никакую интеллектуальную собственность NetApp конкурентам, в то время как NetApp утверждала, что приобретение Red Stapler «было лишь средством конкурента для найма Стефанссона и его команды». Отметим, что сама VAST Data не указана в качестве ответчика в иске NetApp. В постановлении суда говорится, что есть два трудовых договора между Стефанссоном и NetApp, подписанных примерно в одно и то же время. Когда Стефанссон присоединился к NetApp в 2017 году, он проживал в Исландии, где отсутствует закон о неконкуренции (non-compete law). Он подписал трудовой договор и «Соглашение о конфиденциальной информации, изобретениях и неразглашении» (PIIA), которое обязывало Стефанссона передавать NetApp «любые изобретения, разработанные во время его работы, уведомлять компанию о любых изобретениях, разработанных им в течение шести месяцев после увольнения, воздерживаться от незаконного присвоения конфиденциальной и коммерческой информации NetApp и воздерживаться от переманивания сотрудников и деловых партнёров NetApp». Трудовой договор «подлежал исключительной юрисдикции судов Исландии», что было указано в пункте о выборе подсудности. При этом и соглашение PIIA также подлежало исландской юрисдикции, если оно было включено в трудовой договор. В январе 2023 года Стефанссон переехал в Орландо (Orlando, шт. Флорида) по трёхлетней визе, официально став старшим вице-президентом NetApp, в результате чего прошлый трудовой договор был расторгнут. Позже он переехал в Исландию, но затем «вернулся во Флориду, чтобы собрать вещи, подготовить дом к продаже и уладить все дела». В это время NetApp подала на него в суд, ссылаясь на соглашение PIIA, но не на трудовой договор. В итоге спор свёлся к вопросу юрисдикции. Адвокаты Стефанссона заявили, что спор должен рассматриваться в исландском суде, поскольку Флорида не обладает юрисдикцией в этом деле. Юристы настаивали на том, чтобы дело было прекращено, поскольку в трудовом договоре было указано, что юридические вопросы, касающиеся этого дела, должны решаться в исландском суде. Адвокаты также утверждали, что соглашение о предоставлении юридической помощи (PIIA) фактически объединено с трудовым договором в одном документе, что означает, что Исландия обладает общей юридической юрисдикцией. NetApp заявила, что надлежащим местом рассмотрения дела является суд Флориды, поскольку Стефанссон работал во Флориде и «ему лично вручили судебные документы, когда он добровольно находился в этом штате». Также компания утверждала, что «пункт о выборе подсудности в трудовом договоре Стефанссона неприменим к этому спору, поскольку она подала иск против Стефанссона исключительно на основании соглашения PIIA, которое имеет свои собственные положения о выборе права и подсудности». Окружной судья Джули Снид (Julie Sneed) не согласилась с аргументами NetApp, указав в постановлении, что «NetApp не доказала, что это исключительный случай, когда факторы общественного интереса в подавляющем большинстве случаев не позволяют применять пункт о выборе подсудности сторон». Она удовлетворила ходатайство Стефанссона об отклонении иска, но без ущерба для дальнейшего разбирательства в соответствии с доктриной forum non conveniens. Это означает, что суд счёл, что для рассмотрения этого вопроса есть более подходящий суд и юрисдикция. Компания NetApp заявила: «Флоридский суд отклонил иск без ущерба для дальнейшего рассмотрения исключительно по причине несоответствия подсудности, не рассматривая дело по существу. NetApp уже обжаловала это решение и предпринимает отдельные юридические действия в Исландии, чтобы обеспечить прямое и решительное рассмотрение этих вопросов».

20.02.2026 [15:23], Владимир Мироненко

Anthropic планирует увеличить к 2029 году расходы на облака до $80 млрдК 2029 году затраты на облачные сервисы ИИ-стартапа Anthropic, согласно его собственным прогнозам, достигнут $80 млрд, сообщил ресурс The Information со ссылкой на свои источники. Расходы будут распределены между Google, Microsoft и Amazon. Помимо оплаты аренды серверов для моделей Claude, Anthropic также делится с облачными провайдерами частью прибыли от продаж своих ИИ-сервисов на их платформах. The Information сообщил со ссылкой на данные стартапа, что в 2024 году эта сумма составила $1,3 млн, и, согласно «самым оптимистичным прогнозам» ресурса, в 2025 году она составила $360 млн, в 2026 году вырастет до $1,9 млрд, а в 2027 году — до $6,4 млрд. Также, по словам источника, Anthropic отчисляет клиентам до 50 % своей валовой прибыли от продаж ИИ-решений на AWS, рассчитываемой на основе выручки за вычетом расходов на облачные ресурсы. Для сравнения, Google обычно получает от 20 % до 30 % чистой выручки после вычета затрат на инфраструктуру от перепродажи ПО своих партнёров. Как утверждает генеральный директор Anthropic Дарио Амодеи (Dario Amodei), компания тратит меньше средств на вычислительные мощности ЦОД по сравнению с другими компаниями в сфере ИИ. Он отметил, что чрезмерные расходы могут быть «разорительными» в случае, когда выручка не гарантирована. Anthropic давно пользуется услугами Google Cloud, и в октябре прошлого года заключила сделку, обеспечивающую ей доступ к облачным ресурсам провайдера мощностью более 1 ГВт с возможностью использования до 1 млн TPU от Google. С этим проектом может быть связана сделка Anthropic по поводу $50 млрд инвестиций в вычислительную инфраструктуру в США в сотрудничестве с Fluidstack. Кроме того, у Anthropic очень тесные отношения с AWS, которая много инвестировала в стартап и развернула для него один из крупнейших в мире ИИ-кластеров Project Rainier. Наконец, в прошлом году компания подписала крупное соглашение с Microsoft Azure.

18.02.2026 [11:29], Сергей Карасёв

AWS внедрила вложенную виртуализацию для инстансов EC2Облачная платформа AWS сообщила о том, что некоторые её инстансы EC2 получили поддержку вложенной виртуализации (Nested Virtualization). Это позволяет решать определённые специфичные задачи, например, работать с эмуляторами мобильных приложений или выполнять моделирование автомобильного оборудования. Вложенная виртуализация даёт возможность запускать гипервизор внутри виртуальной машины, которая сама работает на другом гипервизоре. Иными словами, формируется виртуальная машина внутри виртуальной машины. Такой подход ориентирован на разработку и тестирование различных программных решений без использования физических серверов. Метод может быть полезен в производственной среде для контейнеризированных рабочих нагрузок, где часто применяются инструменты вроде Kubernetes и Docker.

Источник изображения: AWS AWS внедрила поддержку вложенной виртуализации в инстансы EC2 C8i, M8i и R8i. Все они базируются на платформе Intel Xeon 6 в кастомном исполнении. В этих процессорах реализована усовершенствованная технология Trust Domain Extensions (TDX), которая обеспечивает улучшенную изоляцию между гостевой ОС и гипервизором. Все экземпляры EC2 работают под управлением собственного гипервизора Amazon Nitro. В целом, архитектура вложенной виртуализации состоит из трех уровней. Это физическая инфраструктура AWS и гипервизор Nitro, формирующие нулевой уровень (L0). На первом уровне (L1) функционирует клиентский экземпляр EC2 с гипервизором. Второй уровень (L2) состоит из одной или нескольких виртуальных машин, созданных в инстансе EC2. В качестве гипервизоров уровня L1 в настоящее время могут использоваться Microsoft Hyper-V и KVM. Вложенная виртуализация доступна во всех регионах присутствия AWS.

17.02.2026 [19:40], Владимир Мироненко

Российский бизнес распробовал ИИ от Яндекса — потребление токенов за год выросло всемеро«Яндекс» сообщила неаудированные финансовые результаты за IV квартал и весь 2025 год, завершившийся 31 декабря 2025 года. Выручка компании выросла за IV квартал год к году на 28 % до 436,0 млрд руб. и на 32 % за весь год до 1441,1 млрд руб. Скорректированная чистая прибыль составила за квартал 53,5 млрд руб., увеличившись на 70 % год к году, и 141,4 млрд руб. за 2025 год (рост — 40 %). Скорректированный показатель EBITDA вырос в IV квартале год к году на 80 % до 87,8 млрд руб., за 2025 год рост составил 49 % — до 280,8 млрд руб. Выручка сегмента «Б2Б Тех» выросла за квартал год к году на 42 % до 13,9 млрд руб., за 2025 год — на 48 % — до 48,2 млрд руб. Скорректированный показатель EBITDA за IV квартал составил 2,9 млрд руб., увеличившись на 95 %, за 2025 год рост показателя составил 141 % — до 9,4 млрд руб. Рентабельность скорректированного показателя EBITDA увеличилась за отчётный квартал на 5,7 п.п. до 20,9 %, за 2025 год — на 7,6 п.п. до 19,6 %. В 2026 году компания ожидает рост выручки порядка 20 % год к году и скорректированный показатель EBITDA около 350 млрд руб. Компания отметила, что по темпам роста «Б2Б Тех» в IV квартале по-прежнему существенно опережал российский рынок корпоративных IT-решений — в 1,9 раза. Основная часть клиентов Yandex Cloud — внешние, на них приходится 93 % выручки направления. Количество клиентов выросло на 17 % год к году до почти 51 тыс. Львиную долю выручки (54 %) приносят крупные компании. Доля выручки от ИИ- и ИБ-сервисов, выросла почти в два раза до около 9 % от общей выручки Yandex Cloud. Сервисами безопасности пользовался каждый четвёртый коммерческий клиент. За 2025 год выручка ИБ-сервисов выросла в 2,3 раза год к году. Решения on-premise, которые помогают привлекать крупный бизнес, принесли в 2025 году 3,4 % от выручки Yandex Cloud. Отдельно отмечается, что темп роста корпоративных ИИ-сервисов значительно опережает рыночный. Так, квартальная выручка Yandex AI Studio выросла почти вдвое, до 2 млрд руб. Потребление токенов посредством API выросло примерно всемеро — 234 млрд токенов за весь 2025 год, из них более 150 млрд пришлось на IV квартал. Сервисами Яндекс 360 пользуются более 170 тыс. компаний, а их ежемесячная аудитория превышает 102 млн пользователей. На конец 2025 года общее количество платных учётных записей Яндекс 360 составило 8,1 млн, при этом свыше 2,2 млн приходится на крупные организации. Ежемесячная аудитория облачного сервиса «Яндекс Диск» составляет 61,5 млн человек. Также сообщается, что запущено тестирование «Яндекс Документов» и «Яндекс Диска» в варианте on-premise. До конца 2026 года в формате on-premise станут доступны в общей сложности 11 сервисов Яндекс 360.

17.02.2026 [15:33], Руслан Авдеев

Индийская Neysa привлечёт $1,2 млрд для расширения ИИ-облакаИндийский облачный стартап Neysa Networks Pvt. Ltd. Объявил о намерении привлечь до $1,2 млрд для расширения своей инфраструктуры дата-центров, сообщает Silicon Angle. Возглавляемый Blackstone консорциум обеспечит до половины суммы в виде акционерного финансирования, что обеспечит группе инвесторов мажоритарную долю в Neysa. Ещё $600 млн придётся на долговое финансирование. Компания рассчитывает, что привлечённые средства помогут утроить выручку в следующие несколько лет. Как заявляет Blackstone, инвестиции позволят Neysa сыграть важную роль в развитии ИИ-инфраструктуры в Индии и дают возможность компаниям и государственным структурам эффективнее и быстрее внедрять ИИ-технологии. Сейчас Neysa управляет публичной облачной платформой, оптимизированной для ИИ-задач, которая, по слухам, основана на около 2 тыс. ИИ-ускорителей, наиболее передовыми из которых являются NVIDIA H200. Также платформа оснащена чипами более общего назначения NVIDIA L40S. Предлагаются и классические CPU-инстансы. Neysa планирует увеличить количество используемых ИИ-ускорителей приблизительно в десять раз, до 20 тыс. По оценкам Blackstone, это примерно треть от всех ИИ-ускорителей, развёрнутых сейчас в индийских ЦОД. Впрочем, Neysa, вероятно захочет приобрести более современные решения, включая Vera Rubin. По-видимому, как минимум часть из них будет развёрнута в дата-центре в Хайдарабаде, о котором сообщалось в апреле 2025 года. Объект стоит как раз $1,2 млрд и вместит до 25 тыс. ИИ-ускорителей.

Источник изображения: Prashanth Pinha/unsplash.com Помимо набора программных инструментов, компания предлагает и инфраструктурные сервисы. Платформа Neysa позволяет клиентам дообучать открытые ИИ-модели под конкретные задачи. Кроме того, разработчики могут создать несколько вариантов той или иной модели, чтобы выбрать наилучший при помощи инструментов Nesya, которые также помогают отслеживать эффективность использования таких кастомных моделей и обеспечивают средства безопасности и контроля доступа. Также компания намерена улучшить наблюдаемость и управляемость нагрузок. |

|