Материалы по тегу: ии

|

15.05.2026 [18:22], Руслан Авдеев

Уж лучше АЭС за домом, чем ЦОД: американцам разонравились дата-центрыИсследование Gallup свидетельствует, что большинство американцев выступают против строительства ЦОД в своих регионах. При этом многие — категорически против, и это является серьёзной проблемой для застройщиков, сообщает The Register. 71 % опрошенных не согласны на ИИ ЦОД в своём районе, из них 48 % — решительно не согласны, и лишь 27 % высказались за строительство. Фактически дата-центры стали в США политически токсичными объектами, особенно с учётом их влияния на цены на электричество, доступность питьевой воды, чистоту воздуха и уровень шума. Примечательно, что против строительства АЭС рядом с их домом высказались лишь 53 %. Помимо вышеназванных причин неприятия ЦОД есть и другие. Так, о том, что кампусы займут земли сельхозназначения и повлияют на природу, беспокоятся всего 7 % опрошенных (в сельской местности показатели могут быть выше). Около 25 % опрошенных обеспокоены возможным ухудшением качества жизни — увеличением транспортного потока и др., около 20 % боятся увеличения коммунальных платежей. Немало респондентов опасаются, что ИИ заменит работников-людей, подчёркивая, что отрасль нуждается в регулировании. Что касается сторонников ЦОД, то они ссылаются на экономические выгоды — 55 % упомянули увеличение количества рабочих мест, а 13 % говорят об увеличении налоговых поступлений. Впрочем, на деле дата-центры после окончания строительства требуют для обслуживани очень небольшой штат, а вместо налоговых поступлений ЦОД часто добиваются больших субсидий, которые некоторым штатам обходятся в $1 млрд недополученного дохода ежегодно. Бывают и казусы — ЦОД JPMorgan Chase получил налоговые льготы на $77 млн в обмен на создание ровно одного постоянного рабочего места. По политическим предпочтениям голоса тоже разделились. 56 % сторонников Демократической партии выступают решительно против строительства дата-центров в своих регионах. Правда, против и 39 % сторонников республиканцев. По данным Gallup, для наращивания использования ИИ в США необходимо всё больше дата-центров, но большинство жителей страны, похоже, относятся к ЦОД негативно, и ситуация только ухудшается, что признают и гиперскейлеры. Ещё в прошлом году представитель CyrusOne подчеркнула, что люди не связывают цифровые услуги, от которых они зависят, с необходимостью вычислительной инфраструктуры. Впрочем, как отмечает Digital Infrastructure Ireland, большинство людей боится ИИ, словно речь идёт о кормлении монстра. Поэтому, пытаться убедить их, что ЦОД нужны как раз для ИИ — не самая лучшая стратегия. Тем временем в США разворачивается нешуточная борьба против ЦОД и их сторонников. В Индианаполисе дом чиновника, способствовавшего постройке крупного ЦОД, расстреляли, а в Миссури жители городка свергли местные власти после одобрения строительства ЦОД, сместив половину городского совета и пообещав отстранить от работы оставшихся, с мэром во главе.

15.05.2026 [17:28], Сергей Карасёв

Доля контрафактных комплектующих для зарубежного инфраструктурного оборудования в России приблизилась к 20 %В России наблюдается увеличение доли контрафактных комплектующих для зарубежного инфраструктурного оборудования, включая системы хранения данных (СХД). Об этом говорят результаты исследования, проведённого специалистами центра экспертизы по комплексному сервису компании «К2Тех». Представленные данные базируются на тестировании 2,5 тыс. компонентов, проведенном в собственных демо-лабораториях «К2Тех» в 2024–2025 гг. Изучались комплектующие для СХД, модули оперативной памяти, накопители, батареи и другие элементы. Спрос на подобные изделия растёт, поскольку инфраструктура российских компаний до сих пор почти на 70 % состоит из зарубежного оборудования. В процессе эксплуатации этим системам требуется обслуживание и ремонт, однако с поставками необходимых компонентов могут возникать сложности. Как отмечает руководитель направления сервиса вычислительной инфраструктуры «К2Тех», после ухода иностранных компаний в 2022 году привычная структура поставок запчастей рухнула, а объём поддельной продукции резко вырос. По данным исследования, чаще всего контрафакт выявляется в запчастях для хранилищ Dell EMC — в 22 % случаев. На втором месте в этом антирейтинге находятся компоненты Lenovo (21 %), на третьем — Cisco (19 %). В пятерку по объёму подделок также вошли Hitachi Vantara (16 %) и Dell Technologies (13 %). В среднем доля контрафакта в комплектующих зарубежных инфраструктурных решений достигает 18,2 %. Выделяются три основных типа подделок. Один из них — визуальная имитация: отличить такие изделия от оригинальных запчастей можно по нестандартному шрифту на наклейках, ошибках в наименованиях, нелогичной маркировке и по другим признакам. Следующий вид контрафакта — это продукты сторонних производителей: визуально копия неотличима от оригинала, но в её конструкции используются компоненты без оригинальных идентификаторов и микрокодов поставщика. В результате в процессе работы могут возникать сбои и конфликты, наблюдаться нестабильность и пр. Третий тип подделок включает не только имитацию внешнего вида, но и перепрошивку устройств: таким способом могут имитироваться накопители для СХД. Однако из-за специфических требований к прошивкам ведущих поставщиков подобные диски либо не работают с самого начала, либо выходят из строя спустя короткое время.

15.05.2026 [14:33], Андрей Крупин

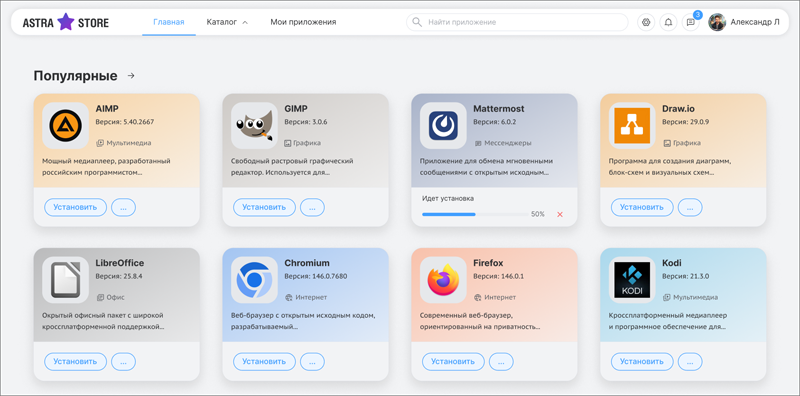

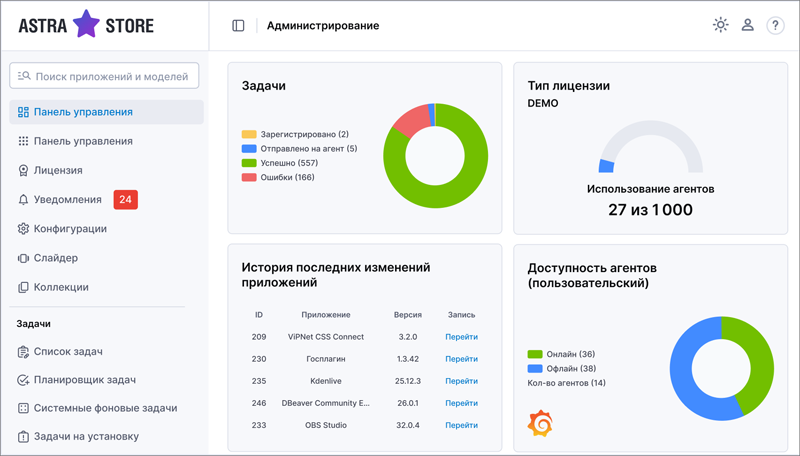

«Группа Астра» запустила магазин приложений Astra Store для корпоративного рынка«Группа Астра» объявила о коммерческом релизе Astra Store — корпоративного магазина приложений для работы с Linux-софтом на базе операционной системы Astra Linux. Платформа предназначена для предприятий, государственных структур и образовательных учреждений, которые находятся в процессе миграции на отечественное программное обеспечение или уже работают в экосистеме Astra Linux. Astra Store представляет собой централизованное решение для управления жизненным циклом ПО в корпоративной среде. Платформа объединяет витрину самообслуживания для сотрудников, инструменты администрирования для IT-служб и встроенный конвейер проверки безопасности приложений. Магазин поддерживает установку Linux-приложений в форматах .deb, .flatpak и shell-скриптов. Каталог включает open source и вендорский софт, а также продукты экосистемы «Группы Астра». Все программные решения проходят многоуровневую проверку: тестирование на вирусы, угрозы, контроль целостности пакетов и проверку на уязвимости по CVE-базам.

Магазин приложений Astra Store (источник изображения: «Группа Астра» / astra.ru) Платформа Astra Store позволяет администраторам централизованно управлять доступом к ПО: формировать профили пользователей, подготавливать коллекции приложений, разграничивать права на установку, контролировать используемое в организации программное обеспечение и планировать свою работу на основе аналитических данных и телеметрии с рабочих мест сотрудников. Магазин приложений совместим с корпоративными каталогами AD, ALD PRO, FreeIPA и другими решениями через LDAP и Kerberos, поддерживает сквозную SSO-авторизацию и инструменты автоматизации, подключение собственных репозиториев заказчика, а также интеграцию с ITSM- и SCCM- системами через API.

Магазин приложений Astra Store (источник изображения: «Группа Астра» / astra.ru) В настоящий момент витрина приложений Astra Store включает широкий набор программных продуктов для построения корпоративного цифрового ландшафта. В магазине представлены браузеры, офисные пакеты, средства для коммуникаций и работы с медиафайлами, графические редакторы, инструменты для защиты данных и обеспечения безопасности, а также специализированный софт. Магазин приложений Astra Store совместим со всеми версиями Astra Linux и поддерживает развёртывание на рабочих станциях, ноутбуках, VDI-терминалах и мобильных устройствах.

15.05.2026 [10:57], Сергей Карасёв

Мини-ПК DX-AIPlayer получил ИИ-ускоритель DX-M1 с производительностью 25 ТопсЮжнокорейский стартап Deepx, по сообщению ресурса CNX Software, выпустил компьютер DX-AIPlayer небольшого форм-фактора, предназначенный для решения ИИ-задач на периферии. В устройстве соседствуют процессор Intel поколения Alder Lake-N и фирменный ускоритель DX-M1. Новинка заключена в корпус с габаритами 95 × 95 × 55 мм, а масса составляет около 450 г. Установлен чип Intel Processor N97 с четырьмя ядрами (без многопоточности), работающими на частоте до 3,6 ГГц (TDP — 12 Вт). Объём оперативной памяти LPDDR5 составляет 8 Гбайт с возможностью расширения до 16 Гбайт. Вместимость флеш-накопителя eMMC — 64 или 128 Гбайт. Упомянутый ускоритель Deepx DX-M1 выполнен в виде модуля M.2 2280 M-Key с интерфейсом PCIe 3.0 x4. Он располагает 4 Гбайт памяти LPDDR5 и чипом QSPI NAND на 1 Гбит, а TDP составляет 5 Вт. Заявленная ИИ-производительность достигает 25 TOPS в режиме INT8. В оснащение мини-компьютера входит двухпортовый 1GbE-контроллер; опционально может быть добавлен комбинированный адаптер Wi-Fi/Bluetooth (M.2 2230 E-key). Есть интерфейсы HDMI 2.0b и DisplayPort 1.2 для вывода изображения, три порта USB 3.1 Type-A, два гнезда RJ45 для сетевых кабелей, два последовательных порта (RS-232/422/485), а также 3,5-мм аудиогнёзда. Питание (12 В) подаётся через DC-разъём. Возможен монтаж на стену или монитор посредством крепления VESA. Диапазон рабочих температур — от 0 до +60 °C. Говорится о поддержке ОС Windows 10/11, Ubuntu (20.04/22.04/24.04 LTS) и Yocto Project (v5.1), а также популярных фреймворков, включая PyTorch, TensorFlow, ONNX, Keras и Ultralytics YOLO. Цена составляет $995 за версию с 8 Гбайт ОЗУ.

15.05.2026 [09:34], Владимир Мироненко

Вот это разворот: SAP всё же предоставит ИИ-агентов для локальных ECC и S4/HANA, но при обещании переехать в облакоSAP совершила резкий разворот в своей стратегии внедрения ИИ, пишет The Register. Ранее немецкая компания утверждала об отсутствии планов внедрять «инновации», такие как ИИ, в системы on-premise, включая устаревшую ERP-платформу ECC, вызывав возмущение у некоторых пользователей. В июле 2023 года генеральный директор Кристиан Кляйн (Christian Klein) заявил, что «новейшие инновации и возможности» SAP будут предоставляться только в публичном или частном облаке с использованием RISE with SAP — программы переноса и трансформации, которую компания запустила совместно с партнёрами и облачными провайдерами в начале 2021 года. «Наши новые инновации не будут доступны для клиентов, использующих локальные или размещённые на локальных серверах ERP-системы крупных облачных провайдеров», — отметил он тогда. Но сейчас SAP утверждает обратное. На этой неделе на конференции SAP Sapphire Кляйн заявил, что «никакой путаницы нет». По его словам, новые технологии, такие как ИИ-агенты, созданные на платформе SAP Joule, будут доступны клиентам, использующим локальные решения, при условии, что они «зарегистрировались для перехода в облако», уточнил он. Кляйн добавил, что большинство ИИ-помощников и агентов Joule будут доступны on-premise в качестве временного решения в ECC и S/4HANA клиентов, которые уже вложили значительные силы в процесс миграции, чтобы они могли воспользоваться преимуществами ИИ во время модернизации. «Это абсолютно правильное решение, и я рад видеть, как клиенты воспользуются этой возможностью», — добавил он. Мухаммад Алам (Muhammad Alam), член исполнительного совета по продуктам и разработке, заявил на конференции, что SAP предоставит «значительную часть ИИ-помощников и агентов Joule для работы в гибридных средах с возможностью подключения к локальной среде S/4 и ECC». Он тоже отметил, что предложение будет доступно «клиентам, которые начали модернизацию на платформе RISE with SAP».

Источник изображения: SAP Новая возможность включена в пакет услуг под новым брендом Business AI Platform, сказал Алам: «Мы сделали это для того, чтобы вы могли начать получать выгоду от ИИ уже сегодня на платформе SAP Business AI Platform, пока вы модернизируете свою инфраструктуру». Опцией смогут воспользоваться только подписчики тарифного плана Max Success Plan. Согласно заявлению компании, этот план позволит клиентам ускорить активацию помощников и агентов, а также «внедрять ИИ, включая облачные и подходящие локальные системы, в удобном для них темпе по мере перехода в облако». Планируется, что предложение станет доступно уже в этом месяце.

15.05.2026 [08:38], Сергей Карасёв

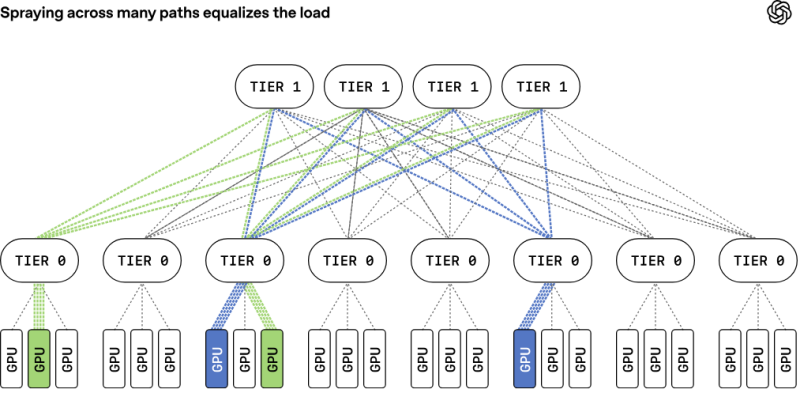

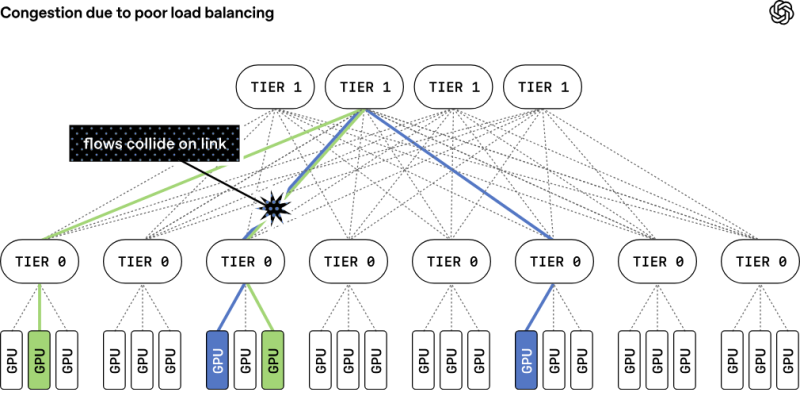

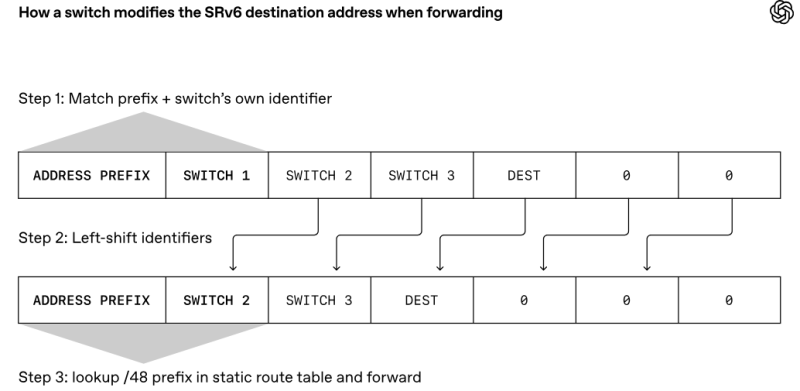

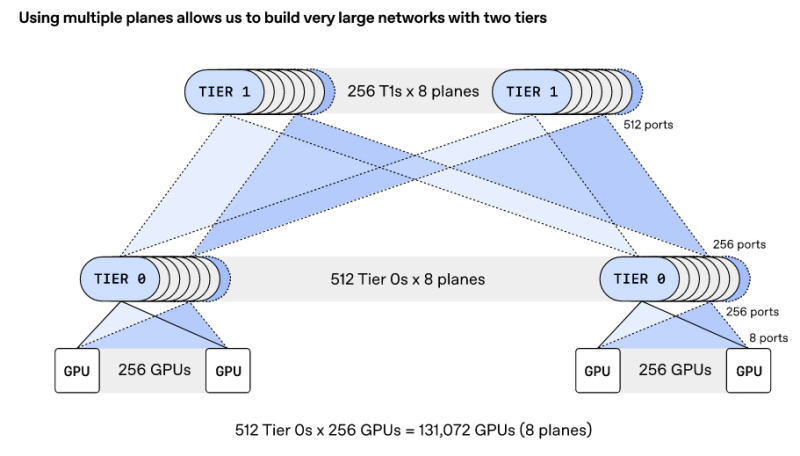

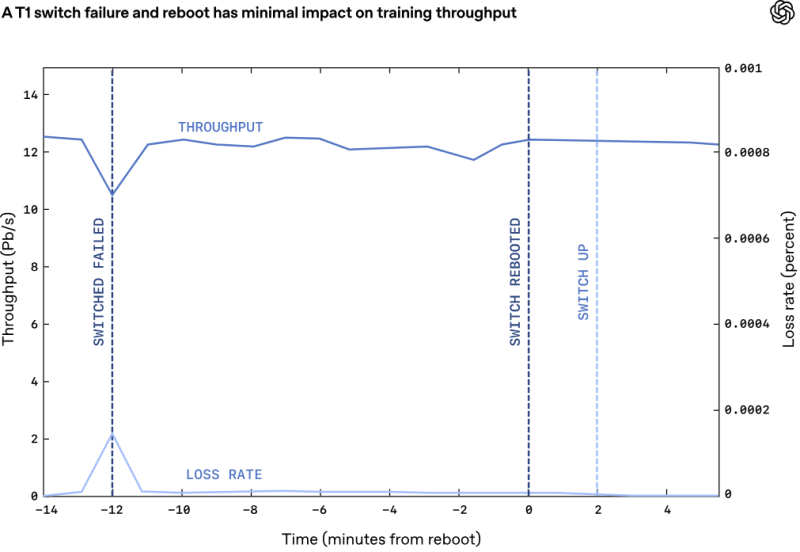

Сетевой протокол Multipath Reliable Connection (MRC) улучшит производительность и надёжность ИИ-кластеровOpenAI в партнёрстве с AMD, Broadcom, Intel, Microsoft и NVIDIA анонсировала технологию Multipath Reliable Connection (MRC) — сетевой протокол, призванный повысить производительность и отказоустойчивость масштабных GPU-кластеров, ориентированных на ресурсоёмкие задачи ИИ. MRC уже используется во всех крупных кластерах OpenAI c NVIDIA GB200, в том числе в первом ЦОД Stargate, а также в ЦОД Microsoft по проекту Fairwater. Отмечается, что при обучении больших языковых моделей (LLM) каждый этап предполагает огромное количество пересылок данных между узлами в кластере. При этом единственная задержка при подобных транзакциях может повлиять на весь процесс, потенциально провоцируя простои тысяч ИИ-ускорителей. Такие прерывания приводят к снижению эффективности использования имеющихся вычислительных мощностей и к увеличению временных затрат. Наиболее распространёнными причинами задержек и нестабильности при передаче данных являются перегрузка сети, сбои в работе каналов связи и коммутационных устройств. Причём по мере увеличения масштабов кластеров проблемы усугубляются: неполадки возникают всё чаще, а их устранение становится более затруднительным. Протокол MRC, как утверждается, устраняет ряд ключевых недостатков сетей Ethernet применительно к инфраструктурам ИИ. В частности, вводятся такие механизмы, как адаптивная многопутевая передача данных, многоканальные перекрёстные Ethernet-фабрики, «распыление» пакетов, быстрое восстановление после сбоев и пр. MRC коренным образом меняет способ передачи трафика по сети. Традиционные платформы RoCE обычно привязывают поток данных к одному сетевому пути, что может снижать эффективность при возникновении неполадок. MRC же распределяет пакеты из одной серии одновременно по сотням путей и нескольким физическим сетевым каналам. В пакетах содержатся сведения об их конечном назначении, что позволяет ускорителям размещать данные в нужной последовательности, даже если пакеты поступают не по порядку. MRC хранит информацию о состоянии множества используемых путей: если обнаруживается перегрузка какого-либо из них, выбирается альтернативный маршрут, что позволяет оперативно перераспределить нагрузку по всей сети. Ещё одной важной особенностью MRC является многоуровневая архитектура, которая изменяет саму физическую концепцию построения интерконнекта. Так, например, сетевой интерфейс 800GbE может быть разделён на 100GbE-каналы, связанные с восемью различными коммутаторами отдельными каналами. В результате можно построить восемь отдельных параллельных сетей. Такой подход оказывает значительное влияние на структуру кластера. В частности, коммутатор c 64 портами 800GbE можно использовать в конфигурации на 512 × 100GbE. И это позволяет построить сеть, объединяющую около 131 тыс. GPU, используя всего два уровня коммутации, против традиционных трёх- или четырёхуровневых топологий. В протоколе MRC также используется новый способ обработки перегрузок и потери пакетов в сетях Ethernet. Обычно применяется технология PFC (Priority Flow Control) — управление потоками на основе приоритетов: этот механизм предполагает приостановку передачи данных для конкретных классов трафика, а не для всего порта целиком. В случае MRC задействован иной подход, основанный на выборочных подтверждениях, явных запросах на повторную передачу и обрезке пакетов. Так, когда коммутатор сталкивается с перегрузкой, он может отрезать полезную нагрузку и переслать в пункт назначения только заголовок пакета, что позволяет получателю быстро идентифицировать отсутствующие данные и запросить повторную передачу. Утверждается, что это даёт возможность восстанавливаться после сбоев и перегрузок в течение микросекунд, что на порядки быстрее по сравнению с обычными архитектурами. С внедрением MRC сокращается необходимость в динамической маршрутизации. Если пакеты теряются на каком-либо пути, система на основе MRC просто перестаёт использовать этот путь. Вместо динамической маршрутизации применяется так называемая сегментная маршрутизация IPv6 (IPv6 Segment Routing, SRv6), которая позволяет отправителю напрямую задать путь прохождения пакета, прописав последовательность идентификаторов коммутаторов. При пересылке данных коммутатор проверяет наличие собственного идентификатора. Если он присутствует, он удаляет из пакета свой идентификатор и ищет следующий за ним идентификатор в статической таблице маршрутизации, которая указывает, куда необходимо отправить пакет данных. В отличие от динамической маршрутизации, такая статическая таблица формируется при первой настройке коммутатора и в дальнейшем не изменяется. MRC использует SRv6 для передачи пакетов по всем физическим каналам и уровням, а также по множеству путей в каждом из них. Если какой-либо путь становится недоступен, система игнорирует его. При этом коммутаторам не нужно пересчитывать маршруты или выполнять другие действия, кроме как строго следовать статическим маршрутам, заложенным в таблице. Протокол MRC выпущен в рамках проекта OCP. В целом, как отмечается, MRC обеспечивает три ключевых преимущества перед стандартными Ethernet-сетями для кластеров ИИ. Во-первых, MRC позволяет создавать многоуровневые высокоскоростные инфраструктуры для платформ с более чем 131 072 конечных точек, используя всего два уровня коммутаторов. Во-вторых, адаптивное распределение пакетов обеспечивает эффективную балансировку нагрузки, благодаря чему практически отсутствуют перегрузки в ядре сети. В-третьих, применение SRv6 обеспечивает быстрый обход сбоев и отправку пакетов только по работающим путям. Компания Broadcom заявила, что её сетевые адаптеры Thor Ultra, а также коммутаторы Tomahawk 5 и Tomahawk 6 изначально поддерживают функциональность MRC. В частности, Thor Ultra позволяет использовать 2, 4 или 8 параллельных сетей на одном порту и распределять трафик одновременно по 128 каналам. При этом Tomahawk 5 обеспечивает коммутационную способность до 51,2 Тбит/с, а Tomahawk 6 — до 102,4 Тбит/с. В свою очередь, NVIDIA отмечает, что протокол MRC, будучи расширением RoCE, совместим с решениями Spectrum-X Ethernet. OpenAI уже использовала MRC при обучении нескольких ИИ-моделей, задействовав коммутаторы Broadcom и NVIDIA. Конкуренцию MRC составляет схожий во многих аспектах Ultra Ethernet.

15.05.2026 [00:29], Владимир Мироненко

США разрешили покупку NVIDIA H200 десяти китайским компаниям, но сделки застопорилисьВ преддверии визита президента США Дональда Трампа (Donald Trump) в Китай правительство страны разрешило десятку китайских компаний приобрести ИИ-ускорители NVIDIA H200, но их поставки пока так и не начались, сообщили источники агентства Reuters, знакомые с ситуацией. Как сообщается, глава NVIDIA Дженсен Хуанг (Jensen Huang) присоединился к американской делегации, и, как ожидается, предпримет усилия, чтобы разрешить зашедшую в тупик ситуацию с поставками. До ужесточения экспортных ограничений США компания NVIDIA контролировала около 95 % китайского рынка передовых чипов и на Китай приходилось 13 % её выручки. После ввода ограничений поставки чипов NVIDIA в Поднебесную практически сошли на нет. По оценкам Хуанга, объём ИИ-рынка в стране в этом году составит $50 млрд. Согласно данным источников, в число компаний, получивших разрешение на покупку H200, вошли Alibaba, Tencent, ByteDance и JD.com. Также добро получили несколько дистрибьюторов, включая Lenovo и Foxconn. Покупателям разрешено приобретать чипы либо напрямую у NVIDIA, либо через избранных посредников, и каждый получивший одобрение клиент может приобрести до 75 тыс. чипов в соответствии с условиями лицензирования США. Из всех названных компаний лишь Lenovo подтвердила Reuters факт получения лицензии на покупку американских чипов, остальные оставили без ответа запрос о комментариях.

Источник изображения: NVIDIA По словам источников, несмотря на одобрение США, поставки H200 застопорились из-за отказа китайских фирм от сотрудничества после указания властей КНР. Это подтвердил министр торговли Говард Лютник (Howard Lutnick), заявивший на слушаниях в Сенате в прошлом месяце, что правительство Китая пока не позволяет компаниям покупать чипы, стремясь сосредоточить инвестиции на отечественной промышленности. Хотя китайские ИИ-чипы уступают решениям той же NVIDIA, китайские компании, как, например, DeepSeek, всё чаще полагаются на отечественные чипы, включая разработанные Huawei. Их переход на чипы Huawei подчёркивает шаткое положение NVIDIA в Китае. Хуанг неоднократно говорил, что экспортный контроль США подрывает позиции компании на местном рынке. При этом, по оценкам некоторых экспертов, у NVIDIA уже скопился запас из примерно 700 тыс. нереализованных H200. Следует отметить, что осуществление поставок H200 затруднено множеством требований с обеих сторон. В частности, США в январе одобрили правила, согласно которым от китайских покупателей требуется продемонстрировать наличие «достаточных мер безопасности» и подтвердить отказ от использования чипов в военных целях. NVIDIA также должна подтвердить наличие достаточных запасов чипов для американских клиентов. В свою очередь, Государственный совет КНР недавно издал два постановления о безопасности цепочек поставок, что побудило правительство заняться выявлением и устранением потенциальной зависимости от иностранных технологий в КИИ.

14.05.2026 [18:02], Владимир Мироненко

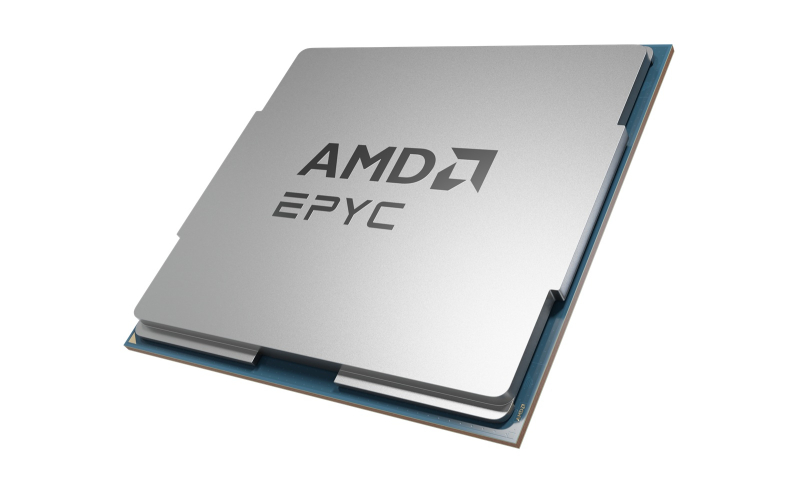

Благодаря спросу на ИИ AMD нарастила долю на рынке серверных CPU, а Intel потихоньку теснит ArmAMD добилась значительных успехов в сегменте серверных процессоров в I квартале 2026 года. По оценкам Mercury Research, на EPYC пришлось 46,2 % рынка серверных процессоров в денежном выражении, что стало новым историческим максимумом у компании в этой категории продукции. При этом в количественном выражении доля AMD EPYC в общем объёме продаж в сегменте гораздо меньше — 27,4 % (последовательный рост на 230 базисных пунктов), что указывает на их гораздо более высокую среднюю цену продажи (ASP) по сравнению с конкурентами. Общий объём поставок серверных процессоров увеличился примерно на 6 % последовательно и примерно на 19 % год к году. Больше половины рынка серверных чипов в количественном выражении (54,9 %, снижение на 370 базисных пунктов по сравнению с предыдущим кварталом) принадлежит Intel. И судя по её доле рынка в денежном выражении в размере 53,8 % и доле в количественном выражении, можно с уверенностью предположить, что средняя цена серверных процессоров Intel Xeon ниже, чем у AMD EPYC. По данным Mercury Research, на Arm-процессоры для ЦОД приходится около 17,7 % (последовательный рост на 140 базисных пунктов), что составляет почти пятую часть от общего объёма поставок в I квартале 2026 года. Вместе с тем, не уточняется, идёт ли речь о продукции Ampere и других производителей Arm-процессоров, или же о собственных разработках таких компаний, как Google, AWS или Microsoft. В 2026 году ключевым трендом на рынке ИИ стало активное внедрение ИИ-агентов и мультиагентных систем, что обусловило высокий спрос на процессоры и успех AMD. При развёртывании агентного ИИ растёт роль CPU, что привело к изменению конфигурации вычислительных систем от традиционного соотношения, когда один процессор работает в паре с четырьмя или даже восемью ускорителями, в сторону соотношения один к одному. Благодаря возросшему спросу AMD сейчас продаёт каждый произведённый процессор, а Intel реализует заинтересованным клиентам даже то, что ранее списывалось как брак. Вместе с тем в настоящее время AMD удаётся добиваться более высоких средних цен на свою продукцию.

14.05.2026 [16:47], Владимир Мироненко

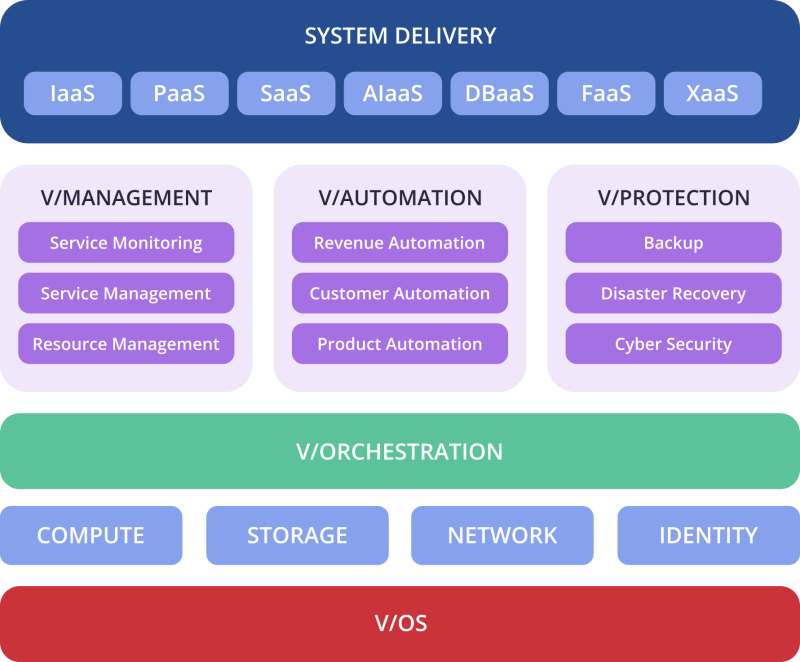

Virtuozzo предложила инфраструктурную систему V/IS для ИИ, которая поможет справиться с ростом цен на ПО VMwareКомпания Virtuozzo, специализирующаяся в области разработки ПО для инфраструктурных систем, представила своё видение эффективной ИИ-инфраструктуры, «созданной с помощью ИИ и использующей ИИ для обработки ИИ-нагрузок». V/IS представляет собой гиперконвергентную систему, объединяющую в единой архитектуре вычислительные ресурсы, хранилище данных и сети, включая операционную систему нового поколения, а также функции оркестрации, управления, автоматизации и защиты. V/IS включает следующие компоненты:

Virtuozzo также позиционирует свою платформу как способ для поставщиков услуг быстро запускать услуги AIaaS (AI-as-a-Service) и GPUaaS (GPU-as-a-Service). Инфраструктура поддерживает как обучение ИИ, так и задачи инференса, а интегрированные инструменты учёта и выставления счетов призваны помочь поставщикам быстрее монетизировать ресурсы GPU. В последней версии продукта Virtuozzo в панель администратора были добавлены функции учёта и управления GPU. Компания заявила, что повышение эффективности использования GPU и инфраструктуры поможет организациям справиться с ростом цен на продукты VMware после приобретения VMware компанией Broadcom. Как сообщает Blocks & Files, штат Virtuozzo насчитывает более 250 сотрудников. Компания работает в более чем в 80 странах и имеет около 550 партнёров MSP и партнёров по каналам продаж.

14.05.2026 [15:33], Руслан Авдеев

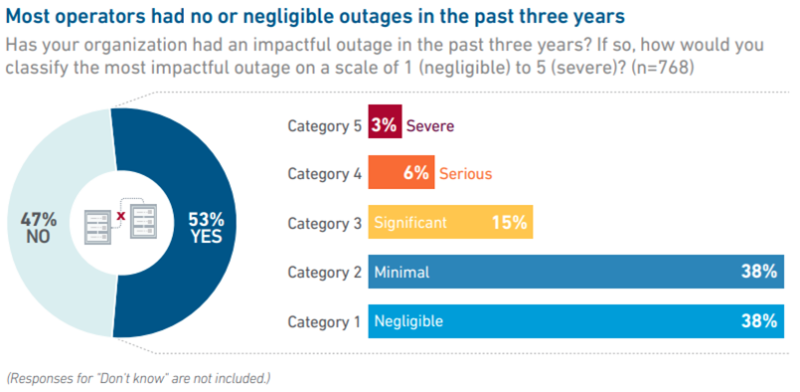

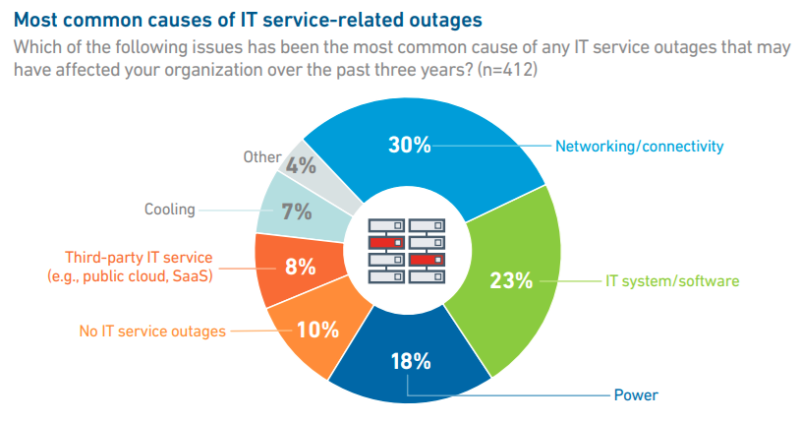

Uptime Institute: сбои в дата-центрах стали реже, но значительнееСогласно новому отчёту Uptime Institute, за последнюю пятилетку отказоустойчивость ЦОД значительно выросла. При этом сбои в работе дата-центров по-прежнему происходят, а устранение их обходится всё дороже и времени на это уходит в среднем всё больше, сообщает The Register. Согласно докладу, половина опрошенных представителей операторов ЦОД за последние три года отметили значительные или масштабные сбои. Это наиболее низкий уровень с 2020 года, т.е. инфраструктура становится всё надёжнее. При этом операторам ЦОД всё сложнее повышать прописанный в SLA уровень надёжности — хотя отказы случаются реже, дальнейшее улучшение показателей требует всё больших усилий. Усилия по повышению времени безотказной работы отчасти сводятся на нет усложнением систем и условий эксплуатации, вызванными повсеместным внедрением ресурсоёмкой инфраструктуры для обучения и инференса ИИ. Повышенная плотность размещения оборудования в стойках, перепады нагрузок и другие факторы способны увеличить вероятность каскадных отказов. Кроме того, нехватка генераторов, распределительных устройств, трансформаторов, систем охлаждения и др. заставляет операторов ЦОД иногда использовать б/у или непроверенное оборудование. Предполагается, что именно это могло привести к сбоям в некоторых ЦОД.

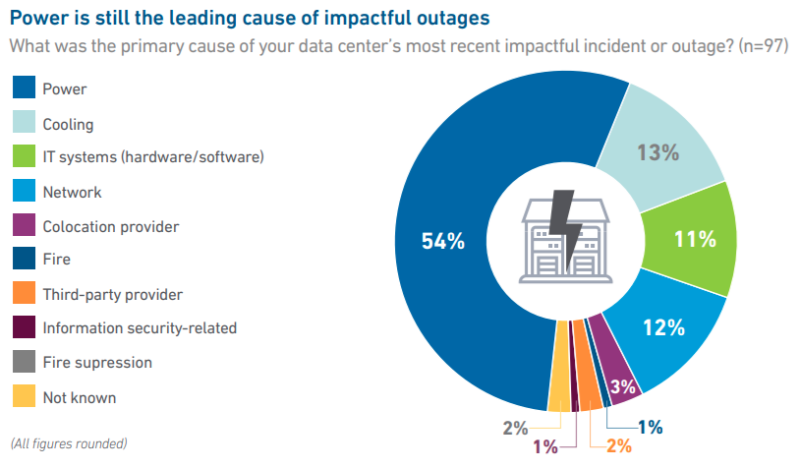

Источник изображения: Uptime Institute Основной причиной критических неполадок называются сбои электроснабжения, хотя в этом отношении наметились определённые улучшения — если в 2024 году на проблемы с электроснабжением приходилось 54 % самых серьёзных отключений, то в 2025 году речь шла уже о 45 %. При этом ситуация может измениться, поскольку электросети на местах испытывают всё большую нагрузку из-за ввода в эксплуатацию новых ЦОД. Хотя сбои энергосетей не станут главной причиной отключений в будущем, они скажутся на доступности локальной генерации — при сбоях сети ЦОД не всегда успевают переключиться на ДГУ и иные резервные источники питания.

Источник изображения: Uptime Institute В поле зрения экспертов Uptime попадает не только перегрузка электросетей. По словам экспертов, многие сбои ЦОД связаны с обрывами оптоволокна и другими неполадками. Поскольку инфраструктура ЦОД становится всё более распределённой, сбои за пределами дата-центров играют всё большую роль. Даже если сам ЦОД работает корректно, неправильная сетевая конфигурация, например, может привести к перебоям с предоставлением услуг клиентам. SDN и автоматическое перераспределение трафика позволяет снизить риски, и всё больше компаний не сталкиваются с простоями вообще. Около 20 % опрошенных не регистрировали в последние три года сбоев IT-сервисов, что значительно лучше, чем годом ранее.

Источник изображения: Uptime Institute Обеспечение устойчивости на уровне ПО помогает смягчить эффекты от локальных инцидентов, включая обрывы оптоволоконных кабелей, за счёт распределения рабочих нагрузок между рядом связанных площадок. Впрочем, такие системы довольно сложны сами по себе. Более того, на примере ударов беспилотниками по ЦОД в ОАЭ и Бахрейне можно увидеть, что распределение нагрузок имеет малую эффективность, если сбой касается сразу нескольких площадок. Хотя в 2025 году Uptime Institute зарегистрировала меньше сбоев, чем годом ранее, в отчёте полагают, что сбои могут длиться в целом дольше. 55 % инцидентов, информация о которых сообщалось публично, разрешаются в течение 12 часов, но доля инцидентов продолжительностью более 48 часов увеличивается вот уже второй год подряд. При этом многие из них связаны с теми же повреждениями ВОЛС. По информации Uptime, в отчётный период это происходило более чем вдвое чаще, чем ранее. При этом по мере роста длительности простоя растут и убытки от инцидентов, особенно в случае с ИИ-инфраструктурой. По данным Uptime, в настоящее время 20 % простоев обходится дороже $1 млн. Ожидается, что соответствующий показатель в ближайшие годы будет только увеличиваться. |

|