Материалы по тегу: ии

|

19.05.2026 [12:49], Руслан Авдеев

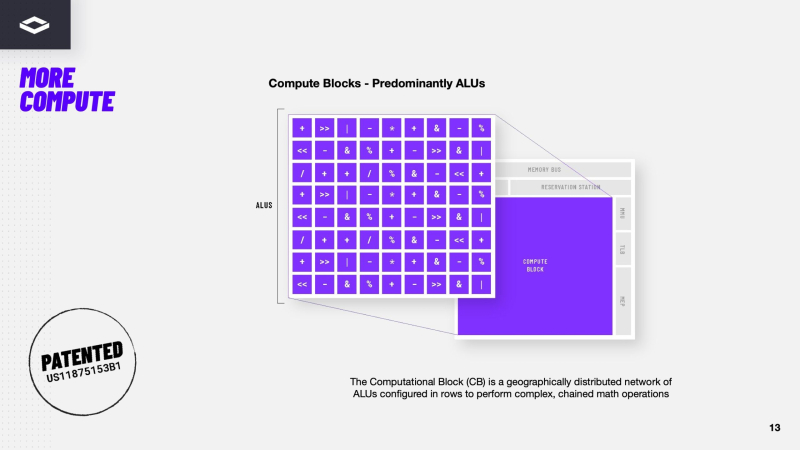

AMD и NVIDIA свернули не туда: следующий крупный американский суперкомпьютер может получить HPC-чипы NextSiliconБольшая часть самых мощнейших суперкомпьютеров мира в рейтинге TOP500 полагаются на ускорители на основе GPU, однако Национальные лаборатории США начали искать новые архитектуры чипов, обеспечивающие высокую производительность в FP64-расчётах, востребованных для симуляций Министерства энергетики США (DoE). Последнее занимается не только вопросами энергетиками, но и управляет одними из мощнейших суперкомпьютеров мира, в т.ч. для моделирования физики ядерного оружия, виртуальных экспериментов, касающихся биологического оружия, а также решения задач обеспечения общественного здоровья и безопасности, сообщает The Register. С запуска суперкомпьютера Titan в 2012 году всё больше систем стали использовать ускорители NVIDIA, а впоследствии и чипы AMD. Однако новый суперкомпьютер Spectra Сандийских национальных лабораторий (SNL), созданный Penguin Solutions и NextSilicon, использует другие решения. В сравнении с экзафлопсными системами уровня Frontier или El Capitan он занимает относительно мало места и состоит всего из 64 узлов. Spectra используют в качестве тестовой площадки для чипов Maverick-2, успешно прошедших все приёмочные испытания. Это открывает возможность их использования в боле крупных системах. Maverick-2 используют перенастраиваемую потоковую (dataflow) архитектуру. Фактически внутри чипа находится сеть связанных вычислительных блоков, работающих не по жёстко заданной схеме, а как узлы графа. В ходе выполнения задачи каждый блок можно настроить под отдельную задачу — сложение, умножение и т.п., благодаря чему происходит адаптация под разные типы вычислений с более эффективной обработкой потоков данных. Главная особенность — возможность одновременных вычислений и передачи данных. В NextSilicon утверждают, что это значительно повышает производительность и энергоэффективность в реальных задачах. Groq, Cerebras и SambaNova и ранее предлагали чипы на «потоковых» архитектурах, но все они были ориентированы на обучение и инференс ИИ, тогда как NextSilicon ориентируется именно на HPC. Подобные архитектуры очень сложны для программирования, поэтому разработчики обычно предлагают готовые сервисы, а не просто продают серверы на их основе. NextSilicon пытается решить подобную проблему, предложив собственный компилятор, позволяющий использовать имеющиеся программы на C, Python, Fortran и CUDA без серьёзной доработки. В Сандийских лабораториях уже проверили технологию на важных HPC-нагрузках, включая HPCG, LAMMPS и Sparta, подтвердив пригодность системы для научных вычислений. Ставка разработчика на HPC контрастирует с вектором развития ИИ-ускорителей NVIDIA. В Rubin компания делает ставку на ИИ-вычисления, снижая «чистую» производительность FP64, полагаясь на эмуляцию посредством схемы Озаки. Если в некоторых HPC-задачах это работает, то в других эффективность подобных обходных решений весьма низкая. AMD помимо ориентированных на ИИ Instinct MI455X готовит и MI430X, где сохранены аппаратные HPC-блоки. Именно на подобные нагрузки ориентируется NextSilicon со своими наработками. Полных системных бенчмарков Maverick-2 и суперкомпьютера пока нет, но компания утверждает, что один такой ускоритель способен обеспечить порядка 600 Гфлопс в тесте HPCG (FP64). По данным стартапа, это сопоставимо по производительности с ведущими GPU, причём энергопотребление у новинки вдвое ниже. Для США главной проблемой может оказаться давление акционеров компаний, поставляющих чипы. Если ИИ сделал NVIDIA финансовым и технологическим гигантом, то рынок решений для HPC остаётся важным, но всё ещё нишевым направлением. Хотя стартапам вроде NextSilicon ещё предстоит доказать право своих продуктов на место под солнцем, Китай уже давно продемонстрировал, что GPU вовсе не обязательны для успешной конкуренции с лучшими суперкомпьютерами Запада. OceanLight и Tianhe-3 полагаются на кастомные процессоры и ускорители на базе DSP вроде Matrix 2000. Последние, по слухам, были созданы в ответ на запрет поставок Intel Xeon Phi в КНР. Также недавно появились данные о новом Arm-суперкомпьютере LineShine.

19.05.2026 [12:30], Сергей Карасёв

В России появится единая платформа управления IT-сервисами и инфраструктуройIT-сервис-провайдер полного цикла РТК-ЦОД, IT-экосистема для автоматизации бизнес-процессов «Лукоморье», производитель программного обеспечения для управления IT-инфраструктурой «Скайфолл Лабс» и разработчик платформы наблюдаемости бизнес-систем Proto в ходе конференции ЦИПР-2026 подписали соглашение о технологическом партнёрстве. Стороны займутся созданием первой в России единой платформы для управления IT-сервисами и инфраструктурой. В рамках проекта в одном цифровом контуре будут совмещены инструменты ITSM/ESM, ITAM, мониторинга, наблюдаемости, автоматизации и сервисного взаимодействия. Ядром платформы станет «Диво Сервис» — решение для автоматизации сервисных процессов и построения Service Desk на основе бизнес-логики компании. Данная система позволит управлять IT-процессами через единую точку входа и обеспечит пространство взаимодействия для пользователей и специалистов. В число других компонентов платформы войдут система самообслуживания в формате одного окна «Диво Портал», инструмент аналитики и визуализации данных «Диво Мера», лингвистический модуль на базе ИИ для обработки обращений и поиска услуг «Диво Лингво», а также модуль для создания интеллектуальных цифровых помощников и чат-ботов «Диво Бот». Кроме того, в составе платформы планируется использование решений, разработанных участниками соглашения. В частности, продукт РТК-ЦОД под названием Smart Control будет интегрирован в систему как «Диво Контроль»: этот модуль представляет собой центр управления IT-инфраструктурой, обеспечивающий автоматизацию процессов эксплуатации, удалённое администрирование, инвентаризацию, обнаружение инфраструктуры и комплексный мониторинг. В свою очередь, «Скайфолл Лабс» предоставит решение SkyV ITAM, которое в рамках проекта получит название «Диво Свод»: модуль позволит формировать и поддерживать актуальную модель IT-инфраструктуры с консолидацией технических и финансовых данных обо всех IT-активах в единой системе без дублирования и противоречий. Наконец, «ПротоСервисез» интегрирует свое решение Proto Observability в виде модуля «Диво Прото»: это система full-stack мониторинга приложений, пользовательского опыта, инфраструктуры и Kubernetes. Она позволит отслеживать состояние сложных распределённых систем и бизнес-процессов в режиме реального времени, а также прогнозировать и предотвращать возможные инциденты. Партнёры выделяют ряд преимуществ единой платформы. Это возможность эволюционной миграции с постепенной заменой элементов существующей IT-инфраструктуры, простая интеграция со сторонними системами через открытые API, безопасное хранение данных на стороне заказчика и возможность администрирования модулей без необходимости программирования. Все компоненты включены в реестр отечественного ПО. Платформа получит функции предиктивного мониторинга, автоматического обнаружения проблем и удалённого устранения неполадок. Упомянут инструмент для сопоставления технических метрик с финансовыми и бизнес-показателями. Среди прочего выделяются централизованное управление учётными записями, сервисами и IT-инфраструктурой, безопасный доступ к ресурсам компании, комплексный мониторинг бизнес-систем и автоматическое обновление данных об активах в режиме реального времени.

19.05.2026 [09:23], Руслан Авдеев

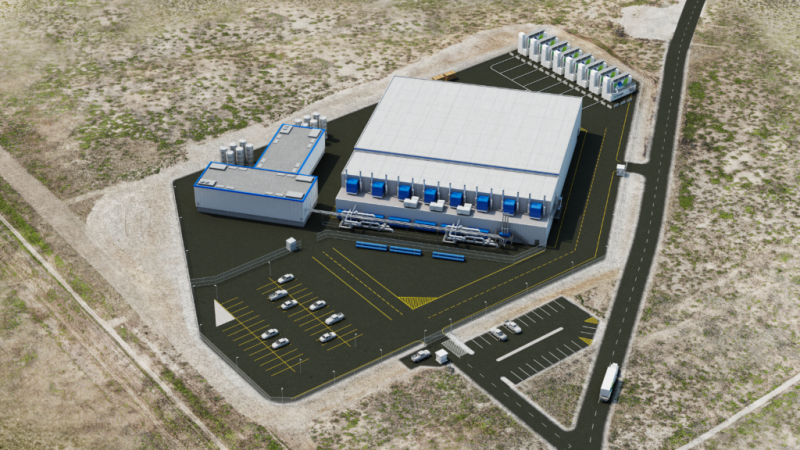

Энергия как услуга: Hitachi и X LABS займутся созданием гигаваттных энергетических парков для ИИ ЦОДКомпании Hitachi и американская X LABS объявили о готовности совместно строить в Северной Америке энергетические парки гигаваттного уровня, предназначенные для ИИ ЦОД. Они помогут решить одну из ключевых проблем подобных объектов — дефицит надёжного электроснабжения. В рамках совместного проекта будет предоставляться сервис «энергия как услуга» (Energy as a Service, EaaS). Он будет доступен при посредничестве специализированных проектных компаний (SPV), которые займутся финансированием и строительством таких парков, будут владеть ими и эксплуатировать их для автономного питания кампусов ЦОД без подключения к магистральным энергосетям. В предлагаемых энергетических парках энергия будет как генерироваться, так и храниться с помощью аккумуляторных систем (BESS). Там же будет присутствовать инфраструктура для передачи и распределения энергии — всё это будет объединяться в специализированные энергохабы, специально разработанные для крупных вычислительных ИИ-кластеров. В отличие от традиционных вариантов микросетей мегаваттного класса речь идёт о проектах именно гигаваттного масштаба, способных поддерживать кластеры гиперскейлеров для для крупномасштабных обучения и инференса ИИ. Hitachi объявила, что подобная архитектура даёт возможность операторам избежать длительного ожидания модернизации ЛЭП и присоединения к энергосети (если последняя вообще может дать нужные мощности). При этом обеспечиваются более предсказуемые поставки и качество питания, достаточные для современных рабочих нагрузок в ИИ-секторе. X LABS будет отвечать за управление финансированием проекта, выбором площадок, курированием SPV, закупками и общим развитием. Hitachi же обеспечит высоковольтные системы передачи и распределения электроэнергии, предоставит технологии стабилизации сетей и платформы управления энергопотреблением. Дополнительно Hitachi намерена интегрировать в проекты ИИ-платформу оптимизации энергопотребления HMAX Energy. Компании объявили, что рассчитывают завершить развёртывание первого энергетического парка в начале 2030-х гг. В сентябре 2025 годла сообщалось, что Hitachi Energy вложит $1 млрд в выпуск энергооборудования для ИИ ЦОД в США, а месяцем позже появилась информация, OpenAI оснастит дата-центры энергетическим оборудованием Hitachi.

19.05.2026 [09:00], Сергей Карасёв

«Базис» впервые стал лауреатом премии «ЦИПР Диджитал» за проект в теплоэнергетикеКрупнейший российский разработчик ПО управления динамической ИТ-инфраструктурой «Базис» взял золото премии «ЦИПР Диджитал-2026» в номинации «Цифровая энергия». Победу компании принёс проект перевода ИТ-инфраструктуры крупнейшего теплоснабжающего предприятия Санкт-Петербурга АО «ТЭК СПб» с зарубежного ПО на российскую платформу виртуализации Basis Dynamix. Специалисты «Базиса» развернули платформу в собственных ЦОД АО «ТЭК СПб», охватив 16 серверных систем и систем хранения данных. Аппаратной базой для ИТ-ландшафта выступило российское оборудование YADRO, что обеспечило полную независимость от иностранных технологий. Внедренное ПО взяло на себя централизованное управление виртуальными машинами и балансировку нагрузок, обеспечив необходимую отказоустойчивость инфраструктуры. Бесперебойную работу критически важных объектов поддерживают встроенные инструменты резервного копирования, восстановления и автоматизации процессов. По итогам проекта заказчик получил готовую технологическую основу для дальнейшей цифровой трансформации, включая виртуализацию рабочих мест и масштабирование серверных ресурсов. «Ошибки в энергетической отрасли недопустимы, так как они напрямую влияют на подачу тепла в жилые дома и социальные объекты. Поэтому при переходе с иностранных решений заказчику требовалась не просто оперативная миграция, а ювелирная замена ядра инфраструктуры без многолетних пилотных тестирований. Мы успешно перевели ИТ-ландшафт компании на платформу Basis Dynamix и сделали это без простоев. Высокая оценка жюри премии — это лучшее подтверждение того, что наши ИТ-продукты отвечают самым строгим отраслевым стандартам», — прокомментировал Давид Мартиросов, генеральный директор компании «Базис». Премия «ЦИПР Диджитал-2026» — шестая ежегодная деловая премия в области цифровых технологий. Премия нацелена на популяризацию российских проектов и разработок в области экономики данных. Награждение традиционно проходит в рамках конференции «Цифровая индустрия промышленной России» (ЦИПР). Инфраструктура АО «ТЭК СПб» включает 256 котельных, 234 центральных тепловых пункта и почти 5 тыс. километров тепловых сетей. Предприятие снабжает теплом больницы, школы, промышленные объекты и жилые дома. Бесперебойная работа этих систем критически важна для жизнеобеспечения Санкт-Петербурга.

18.05.2026 [23:01], Владимир Мироненко

Western Digital выпустила жёсткий диск с постквантовой криптографией для защиты ИИ-данных в будущемКомпания Western Digital (WD) анонсировала высокоёмкий жёсткий диск Ultrastar DC HC6100 UltraSMR с постквантовой криптографией (PQC), которая обеспечит защиту от атак с отложенной расшифровкой (HNDL), поскольку злоумышленники в настоящее время могут собирать зашифрованные данные, чтобы взломать их после того, как квантовые компьютеры достигнут зрелости. Таким образом, WD присоединилась к таким компаниям, как Cohesity, Commvault, NetApp и Quantum, которые уже выпустили хранилища с новыми алгоритмами шифрования PQC. Ultrastar DC HC6100 UltraSMR с поддержкой PQC в настоящее время проходит квалификацию у крупных компаний, и WD заявила, что со временем расширит возможности PQC на другие линейки корпоративных жёстких дисков. Реализация PQC от WD в новом накопителе разработана для защиты цепочек доверия устройств от производства до сервисного обслуживания. Основное внимание уделяется обеспечению доверия на уровне устройства, включая целостность прошивки и управление ключами, а не шифрованию данных в состоянии покоя (data at rest). Ключевые элементы реализации PQC от WD:

Технический директор и старший вице-президент WD, отметил, что по мере накопления данные, получаемые с помощью ИИ, становятся всё более ценными и долговечными, поэтому растёт актуальность их защиты в будущем. Технологии квантовых вычислений развиваются быстрее, чем ожидалось и архитектуры безопасности, которые защищали корпоративные хранилища более десяти лет, должны эволюционировать. «Интеграция постквантовой криптографии в Ultrastar является частью нашего обязательства помогать клиентам опережать угрозы, которые уже присутствуют в виде атак HNDL», — заявил он. «Соответствуя стандартам NIST и CNSA 2.0 уже сегодня, мы помогаем предприятиям создавать простой и удобный путь к инфраструктуре хранения данных, устойчивой к квантовым атакам», — добавил он.

18.05.2026 [20:00], Руслан Авдеев

NVIDIA представила платформу Fleet Intelligence для мониторинга парка ИИ-ускорителей

dcim

nvidia

software

ии

информационная безопасность

кластер

конфиденциальность

мониторинг

облако

оркестрация

телеметрия

цод

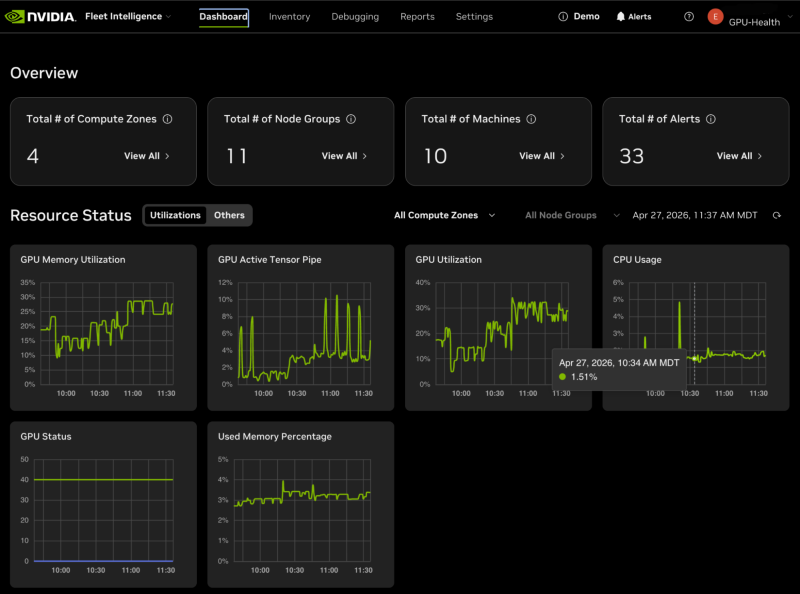

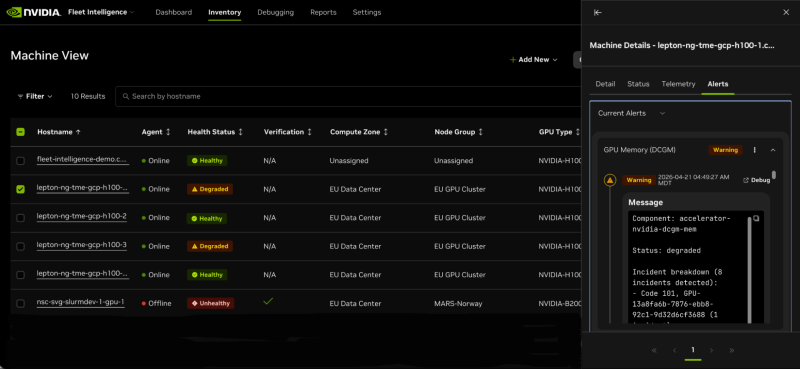

NVIDIA представила управляемую платформу Fleet Intelligence, предназначенную для мониторинга состояния крупных кластеров ускорителей, используемых в ИИ-инфраструктуре. Сервис уже доступен бесплатно для клиентов, использующих продукты NVIDIA на основе ускорителей семейств Hopper, Blackwell и Vera Rubin. NVIDIA позиционирует платформу как независимый слой телеметрии и мониторинга, позволяющий отслеживать работу с гетерогенными инфраструктурными средами, независимо от стека оркестрации или планировщика задач. Платформа применяет «лёгкий», интегрируемый в хост-систему агент, который передаёт телеметрию с ИИ-ускорителей в облачную службу Fleet Intelligence, работающую в экосистеме платформы NGC (NVIDIA GPU Cloud). Агент применяет несколько технологий NVIDIA, включая службу мониторинга ускорителей — GPUd, инструмент управления и диагностики чипов DCGM (NVIDIA Data Center GPU Manager) и средства проверки целостности оборудования и ПО NVIDIA Attestation SDK. Компания также выложила код агента Fleet Intelligence на GitHub, что позволит операторам ИИ-инфраструктуры самостоятельно оценить механизмы телеметрии. Fleet Intelligence ведёт сбор данных о степени загруженности ускорителей, пропускной способности памяти, энергопотреблении системы, состоянии интерконнектов NVLink, температуре системы, ошибках ECC, а также показателях состояния аппаратной составляющей. Это помогает операторам ЦОД организовать раннее выявление недоиспользованных ресурсов и ошибок и снизить простои крупных ИИ-кластеров. Одними из основных свойств платформы стали возможности проверки целостности и аттестации на основе технологий защищённых вычислений NVIDIA Confidential Computing. Fleet Intelligence проводит криптографическую валидацию прошивок ИИ-ускорителей и целостность среды выполнения с помощью корневых сертификатов доверия NVIDIA, а также сервиса удалённой проверки оборудования NRAS (NVIDIA Remote Attestation Service). Платформа может подтвердить, что ускорители используют утверждённую прошивку и использует манифесты целостности Reference Integrity Manifests, привязанные к определённым версиям vBIOS. По словам NVIDIA, при разработке Fleet Intelligence применяли опыт эксплуатации облачных платформ NVIDIA DGX Cloud, использовавших сотни тысяч ИИ-ускорителей. В числе корпоративных пользователей, получивших ранний доступ к платформе — Lambda и Iren, обе предоставляли обратную связь в ходе работ. Премьера Fleet Intelligence свидетельствует, что амбиции NVIDIA простираются далеко за пределы простой разработки ИИ-ускорителей, компания развивает ПО и инструменты управления для ИИ-фабрик. Это дополнение уже имеющегося стека компании, включающего системы DGX, интерконнекты NVLink, сетевые продукты Spectrum-X, платформу оркестрации Mission Control и решения для защищённых вычислений. Добавление масштабной телеметрии и предиктивной аналитики отражает растущий спрос гиперскейлеров и корпоративных клиентов на максимальное использование ресурсов ускорителей. Кроме того, премьера платформы является отражением роста конкуренции на рынке систем мониторинга и эксплуатации ИИ-инфраструктуры. Облачные операторы и другие компании, включая AMD, Intel и т.п., строят собственные платформы для телеметрии, диагностики и управления крупными ИИ-кластерами. Возможность NVIDIA интегрировать аппаратную телеметрию, проверку надёжности прошивок и операционную аналитику напрямую в инфраструктурный стек усиливает позиции компании в роли вертикально интегрированного поставщика ИИ-инфраструктуры.

18.05.2026 [19:29], Владимир Мироненко

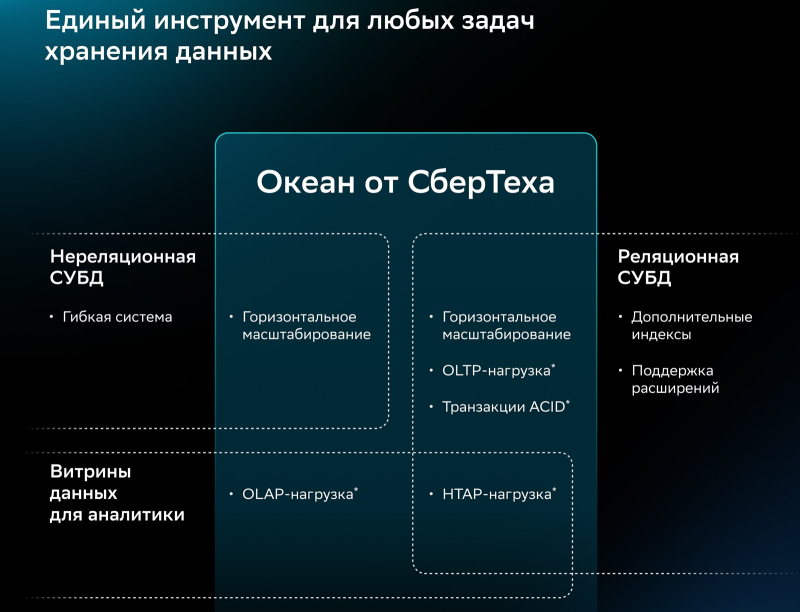

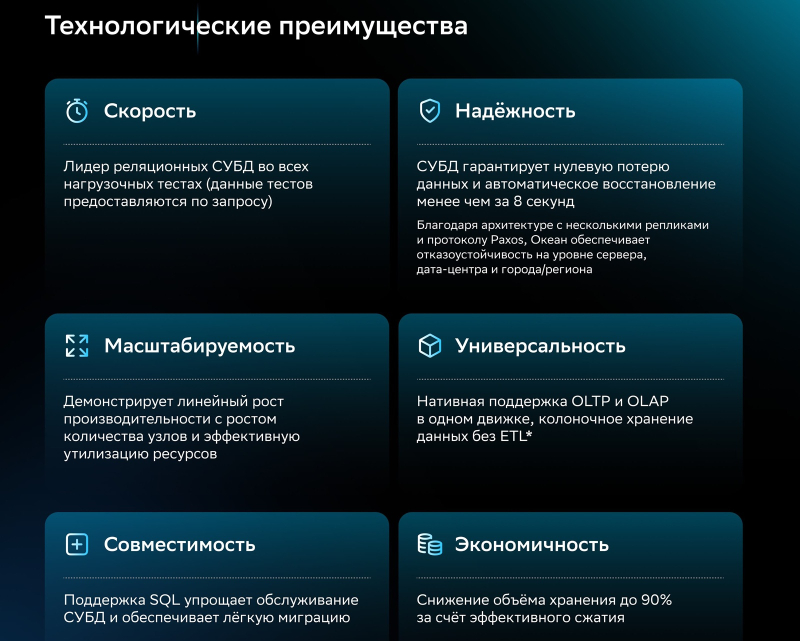

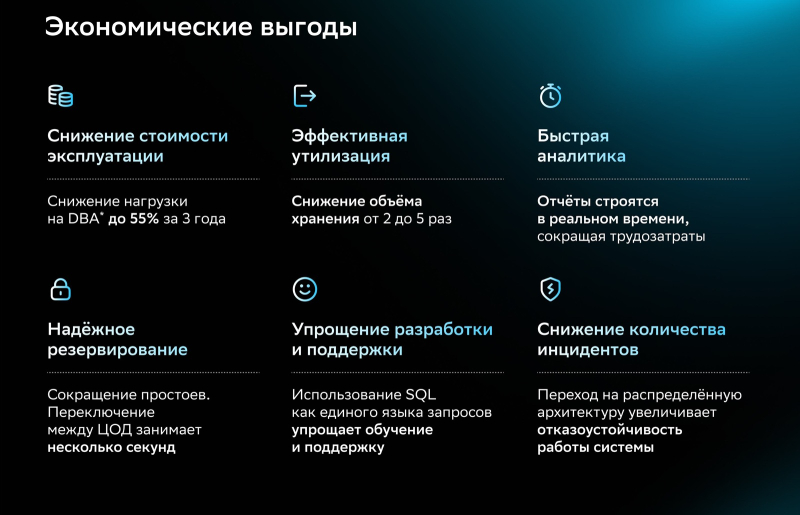

«СберТех» представил «бесконечную» СУБД О.К.Е.А.Н., универсальную и с неограниченной масштабируемостью«Сбер» представил на ЦИПР-2026 новую разработку «СберТеха» — СУБД корпоративного уровня О.К.Е.А.Н., способную выдержать самые экстремальные нагрузки. «Теперь крупный бизнес может мигрировать с иностранной СУБД на российскую без потери производительности, даже если речь идёт о десятках терабайтов данных», — отметила компания. В названии решения, как сообщается, заложены ключевые направления работы продукта: оптимизация объёмов хранения и совокупной стоимости владения (О), кластеризация и георезервирование (К), единый язык запросов SQL (Е), аналитика и транзакции в одной СУБД (А), а также надёжность и неограниченная масштабируемость (Н). Благодаря поддержке СУБД О.К.Е.А.Н. гибридной нагрузки, что позволяет выполнять транзакции и аналитику данных одновременно, компании смогут упростить ИТ-инфраструктуру, сократив количество систем. Новая СУБД позиционируется как оптимальное решение для финтеха, промышленности, ретейла, телекома и логистики. О.К.Е.А.Н. построена на открытом коде OceanBase — популярной корпоративной распределённой реляционной СУБД, совместимой с SQL и обеспечивающей хранение информации в виде связанных таблиц. Благодаря распределённой архитектуре О.К.Е.А.Н. обеспечивает горизонтальное масштабирование на сотни серверов без ограничений производительности. Как сообщает разработчик, система соответствует всем корпоративным стандартам безопасности и требованиям по доступности к программным решениям финансового класса, гарантируя нулевую потерю данных и восстановление работы менее чем за 8 с. О.К.Е.А.Н. работает на обычных серверах, не требует специального оборудования, масштабируется без остановок и изменений в коде приложений и эффективно сжимает данные, обеспечивая экономию площади до 70 %. Поддержка СУБД ретроспективных запросов позволяет обращаться к таблицам и данным, возвращая их к любому историческому моменту без резервных копий. Все эти возможности позволяют свести к минимуму стоимость владения ИТ-инфраструктурой. О.К.Е.А.Н. поставляется с круглосуточной поддержкой и архитектурным консалтингом.

18.05.2026 [10:38], Владимир Мироненко

Британский ИИ-стартап Fractile привлёк $220 млн на ускорение разработки ИИ-ускорителейБританский разработчик ИИ-чипов Fractile объявил о завершении раунда финансирования серии B, в рамках которого удалось привлечь $220 млн, что позволит ускорить разработку и коммерциализацию ИИ-ускорителей нового типа. Раунд возглавили компании Accel, Factorial Funds и Founders Fund бывшего гендиректора PayPal Питера Тиля (Peter Thiel) при участии Conviction, Gigascale, 01A, Felicis, Buckley Ventures и 8VC. Инвесторами стартапа также являются бывший руководитель Arm и Acorn Computers Стэн Боланд (Stan Boland), бывший глава Intel Пэт Гелсингер (Pat Gelsinger), компании Kindred Capital, NATO Innovation Fund, Oxford Science Enterprises и несколько бизнес-ангелов. Fractile была основана в 2022 году Уолтером Гудвином (Walter Goodwin) в бытность его аспирантом Института робототехники Оксфордского университета. Компания разрабатывает чипы, использующие вычисления в оперативной памяти. По словам Гудвин, этот подход позволит создать чипы, обеспечивающие более быструю и менее дорогую обработку данных в больших масштабах при более низком энергопотреблении. В феврале 2026 года стартап объявил о планах инвестировать в течение следующих трёх лет £100 млн ($135 млн) в развитие бизнеса в Великобритании. Финансирование будет направлено на рост существующих площадок в Лондоне (London) и Бристоле (Bristol), где также построят новый ЦОД. По данным издания The Information, компания Anthropic вела переговоры с Fractile о приобретении чипов для обработки данных, когда оборудование станет доступно в 2027 году. «С момента основания мы работаем над всем стеком технологий, от фундаментальных исследований в области ИИ до инноваций в производственных процессах и микроархитектуре чипов, активно стремясь к наиболее перспективным решениям и разрабатывая системы, которые преодолевают компромиссы, отвергают парето-границу затрат и задержки в обработке данных и прокладывают путь к изменению того, что мы можем делать с лучшими в мире моделями ИИ», — заявил Гудвин. Он добавил, что после успешного раунда финансирования стартап начал набор сотрудников в Великобритании (Лондон, Бристоль), США (Сан-Франциско) и на Тайване (Тайбэй).

18.05.2026 [09:53], Руслан Авдеев

VoltaGrid привлекла $1 млрд от Blackstone и Halliburton на развитие систем электрогенерации для ЦОД и купила PropellПроизводитель автономных сетей электроснабжения — компания VoltaGrid привлекла инвестиции в объёме $1 млрд от компаний Blackstone Tactical Opportunities и Halliburton. Дополнительно она приобрела своего ключевого производственного партнёра Propell Energy Technology, сообщает Datacenter Dynamics. Деньги направят на внедрение решений VoltaGrid для генерации электричества «за счётчиком» для ЦОД, микросетей и промышленности. Стратегические инвестиции в акционерный капитал компании включают первичное привлечение капитала на $775 млн, а также покупку акцией у действующих инвесторов на $225 млн. Инвестиции стали развитием партнёрства Haliburton и VoltaGrid. В октябре 2025 года компании разработали и внедрили модульные распределённые системы генерации электричества для ЦОД, первоначально уделив внимание Ближнему Востоку. В декабре партнёры получили производственные мощности для выпуска модульных газовых генераторов на 400 МВт, предназначенных для ЦОД Восточного полушария. Также было объявлено о покупке за неназванную сумму компании Propell, насчитывающей более 1 тыс. сотрудников в США и Канаде. Последняя является партнёром VoltaGrid в производстве модульных генерирующих систем QPac, предназначенных для ИИ ЦОД. Эта система на природном газе, включающая 20-МВт поршневые узлы, которые можно объединять для генерации до 200 МВт, причём с упрощённым получением экологических разрешений. Систему официально представили в январе 2025 года.

Источник изображения: VoltaGrid VoltaGrid приняла решение о переносе производства и проектирования своих систем на собственные мощности — для снижения рисков при выполнении заказов, портфолио которых уже составляет порядка 7,5 ГВт до 2030 года. Ожидается, что покупка Propell ускорит планы по строительству двух новых автоматизированных производств на уже имеющихся мощностях последней в Гранбери (Granbury, Техас). Общая мощность выпуска поршневых двигателей и турбин составит порядка 300 МВт ежемесячно. Предполагается, что все бюрократические формальности по сделкам будут улажены в середине 2026 года. Привлечение средств происходит на фоне того, что VoltaGrid расширяет клиентскую базу в сфере ЦОД, заключая всё новые соглашения о поставке электричества крупным облачным провайдерам и колокейшн-операторам. В рамках крупнейшей на сегодня сделки VoltaGrid и Oracle заключили соглашение на поставку 2,3 ГВт энергии для ИИ ЦОД последней. Также соглашение на поставку 1 ГВт заключили с Vantage Data Centers и на 35 МВт — с xAI.

15.05.2026 [19:50], Руслан Авдеев

Alibaba Cloud потребуется в 10 раз больше вычислительных мощностей, чем в 2022 году, а Tencent научилась обходиться малымПо словам генерального директора Alibaba Cloud Эдди Ву (Eddie Wu), компания намерена в 10 раз нарастить вычислительную мощность своих ЦОД в сравнении с 2022 годом. Такую информацию он озвучил в ходе отчёта за IV квартал 2026 финансового года, сообщает Datacenter Dynamics. За отчётный квартал выручка подразделения Cloud Intelligence Group составила $6,035 млрд (+ 38 % г/г), выручка от внешних клиентов увеличилась на 40 %. В частности, около $1,3 млрд принесли предложения Alibaba в сфере ИИ, речь идёт об одиннадцатом квартале подряд с трёхзначным ростом в годовом исчислении. Выручка составила 30 % от внешней выручки Cloud Intelligence Group. При этом ожидается, что в течение года показатель превысит 50 %, поэтому компания продолжает активные инвестиции в инфраструктуру. Чистые денежные средства по итогам квартала составили около $38 млрд, без учёта долгов со сроком погашения более пяти лет — около $59 млрд, поэтому инвестиции в рост продолжатся. По словам Ву, на порядок больше вычислительных мощностей в сравнении с 2022 годом компания намерена получить к 2033 году. Часть мощностей можно получить за счёт капитальных затрат, другую — за счёт операционных, сейчас много мощностей приобретается именно благодаря последним. По слухам, услугами заблокированного неооблака Megaspeed пользовалась как раз Alibaba. Глава компании также добавил, что Alibaba, используя подразделение T-Head, занимающееся производством чипов, могла бы продавать серверы на их основе другим операторам ЦОД, либо строить совместные вычислительные мощности. Ву заявил, что уже налажено массовое производство собственных ИИ-ускорителей Zhenwu, и 60 % вычислительных мощностей на их основе используются для обслуживания внешних клиентов, причём их всё равно не хватает. Alibaba назвали единственным в КНР поставщиком облачных ИИ-услуг с предоставлением ИИ-чипов собственной разработки. Компания обеспечила себе автономию в цепочке поставок вычислительных рпесурсов, что благоприятно сказывается на росте выручки и валовой прибыли. При этом отмечено, что, несмотря на все достижения Alibaba, стоимость развёртывания одного нового сервера в 2026 году вдвое выше, чем годом ранее. По словам Ву, в ближайшие два-три года можно ожидать значительного роста валовой прибыли Alibaba Cloud, эффект можно будет ощутить уже в следующие квартал-два.

Источник изображения: Alibaba В последнем квартале стратегии Alibaba и конкурента Tencent значительно отличались. Последняя объяснила, что предпочитают использовать собственный парк ИИ-ускорителей в пределах самой компании, отдав приоритет «множеству внутренних сервисов, а не Tencent Cloud», активной сдачей ускорителей в аренду компания не занималась. В компании намерены исправить ситуацию в оставшуюся часть года, по мере увеличения поставок ИИ-ускорителей китайского производства и расширения инфраструктуры Tencent Cloud. Ранее компания неоднократно говорила, что запасов ускорителей хватит для обучения новых и обновления существующих ИИ-моделей. Частично проблема заключалась в нехватке ИИ-ускорителей, что вынуждало Tencent отдавать приоритет внутренним проектам или внешней экспансии. Тем не менее теперь ситуация изменилась в сравнении с 2025 годом, когда капитальные затраты сокращались из-за дефицита чипов — ожидается, что теперь ASIC китайской разработки будут поставляться в течение всего года. Капитальные затраты за последний квартал составили $4,69 млрд, на 16 % больше г/г. Кроме того, компания намерена воспользоваться зарубежными мощностями. Важное отличие от Alibaba ещё и в том, что в сценариях Tencent ускорители окупают себя при обслуживании рекламных сервисов компании, передаёт The Register. Также компания по-прежнему делает ставку на базовую LLM Hunyuan. Общая выручка Tencent составила ¥196,5 млрд ($28,94 млрд), на 9 % больше, чем в I квартале 2025 года, а валовая прибыль — ¥111,3 млрд ($16,39 млрд). На 11 % больше г/г. На днях сообщалось, что США разрешили китайским компаниям, включая Alibaba и Tencent, покупать ускорители NVIDIA H200, но поставки пока не начались, по некоторым данным — китайский бизнес отказывается от зарубежных ускорителей в пользу местных продуктов под давлением властей КНР. |

|