Материалы по тегу: суперкомпьютер

|

19.06.2025 [16:13], Руслан Авдеев

Здесь ЦОД с ИИ, здесь Grok'ом пахнет: экоактивисты подали в суд на xAI за использование газовых турбин для суперкомпьютера ColossusОснованная Илоном Маском (Elon Musk) компания xAI столкнулась с судебным иском. Её обвиняют в нарушении «Закона о чистом воздухе» (US Clean Air Act) в Мемфисе. Именно там расположен ЦОД с ИИ-суперкомпьютером Colossus, для питания которого используются турбины на природном газе, сообщает Datacenter Dynamics. Истцами выступили НКО NAACP и SELC. Стартап обвиняют в незаконном использовании на объекте турбин, работающих на природном газе. Согласно иску, xAI не получала разрешений на эксплуатацию 26 турбин, установленных на объекте для обеспечения его электричеством. SELC ранее утверждала, что использование газовых турбин осуществлялось без оповещений местного населения и что оно наносит ему ущерб. В NCAAP заявили, что не могут позволить компаниям с оборотами в миллиарды долларов строить загрязняющие атмосферу производства без разрешений. Представители организации пообещали, что xAI не уйдёт от ответственности. В ответ компания заявляет, что имеют право на эксплуатацию турбин в течение 364 дней без отдельного разрешения, поэтому временные установки функционируют в соответствии с законами. Более того, компания намерена доработать турбины для сокращения выбросов в будущем. В SELC заявили, что для турбин таких временных исключений из правил не предусмотрено. Впрочем, срок в 364 дня уже всё равно истёк, а решение xAI установить и эксплуатировать десятки турбин, загрязняющих окружающую среду — явное нарушение Закона о чистом воздухе. В результате xAI можно привлечь к ответственности за незаконный отказ получать разрешения на газовые турбины.

Источник изображения: Call Me Fred/unsplash.com ЦОД, запущенный в июле 2024 года, имел начальную мощность 150 МВт. Объект подключили к электросети местной коммунальной службы TVA, но поначалу xAI выделили всего 8 МВт, поэтому компания развернула около ЦОД газовые турбины. В конце прошлого года подведённую мощность разрешили довести до 150 МВт. В апреле 2025 года выяснилось, что ЦОД увеличил количество число газовых турбин до 35 — это нарушение выданного разрешения на локальную генерацию, поскольку оно допускало использование только 15 турбин. Дополнительные установки обнаружили на аэрофотоснимках. Общая мощность агрегатов, по оценкам, составляет 422 МВт. После этого была продана жалоба в местный департамент здравоохранения, в которой заявлялось, что ЦОД из-за турбин стал крупнейшим промышленным источником азотных загрязнений NOx, формирующих смог в Мемфисе. С тех пор сообщалось, что xAI начала убирать некоторые турбины с площадки после ввода в эксплуатацию новой подстанции. Также было установлено 168 аккумуляторных хранилищ Tesla Megapack. Компания намерена построить в городе второй ЦОД и уже приобрела для этого участок площадью более 92 тыс. м2. Он расположен рядом с газовой электростанцией Southaven Combined Cycle, вырабатывающей 780 МВт электричества. Однако компании надо гораздо больше мощности и она, по-видимому, готова повторить тот же трюк, развернув десятки турбин суммарной мощностью 1,56 ГВт.

10.06.2025 [19:00], Игорь Осколков

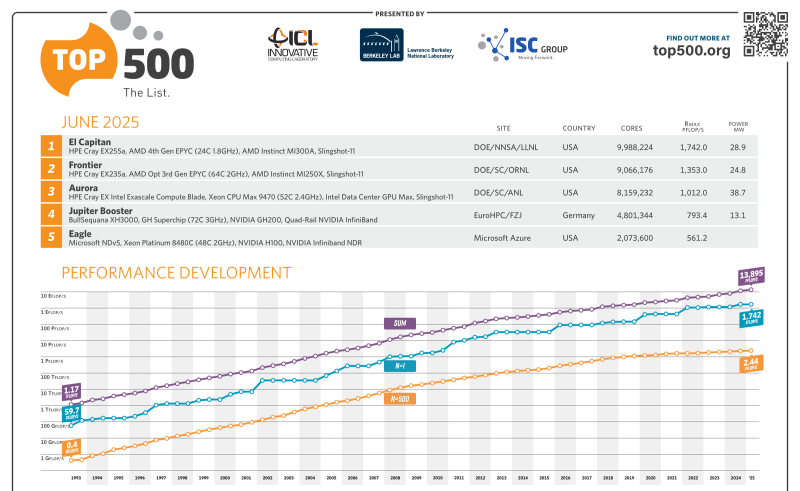

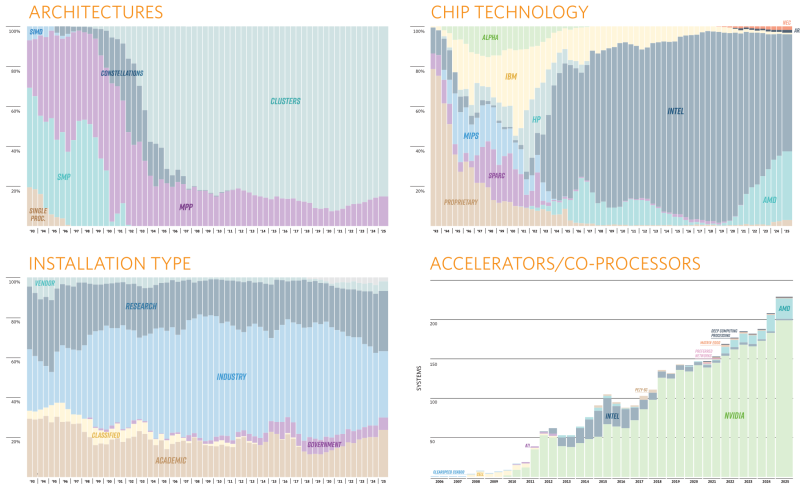

Июньский TOP500 суперкомпьютеров: без сюрпризов, но не безынтересно65-я редакция TOP500 самых мощных суперкомпьютеров мира никаких особенных сюрпризов не преподнесла, но кое-какие новые и интересные машины в него попали. Лидерами списка среди стран всё ещё являются США (175 систем) и Китай (47 систем), вот только вклад их совершенно разный. Тройка лидеров по-прежнему представлена экзафлопсными суперкомпьютерами El Capitan, Frontier и Aurora Министерства энергетики США (DoE). Китайских же систем такого класса в списке нет, хотя никто не сомневается в их существовании. Хуже того, от КНР в этот раз снова не было подано ни одной заявки. Теперь к Китаю по количеству позиций в TOP500 приближается Германия — 41 машина, причём одна из них взобралась на четвёртое место июньской редакции списка. Она же является и единственным новичком в первой десятке. Это JUPITER Booster, совместный проект EuroHPC и Юлихского суперкомпьютерного центра (Jülich Supercomputing Centre). JUPITER (JU Pioneer for Innovative and Transformative Exascale Research) станет первым европейским экзафлопсным суперкомпьютером. Причём это изначально модульная система, «кусочек» которой под названием JETI (JUPITER Exascale Transition Instrument) уже попал в прошлогодний TOP500.

Источник изображения: Forschungszentrum Jülich / Sascha Kreklau JUPITER Booster по-прежнему использует платформу Atos/Eviden BullSequana XH3000 с гибридными ускорителями NVIDIA Quad GH200 и интерконнектом InfiniBand NDR200. FP64-производительность представленного в TOP500 сегмента (это только часть всей машины) составила 793,4 Пфлопс при теоретическом пике в 930 Пфлопс. Энергопотребление составляет чуточку больше 13 МВт, но при этом в GREEN500 машина занимает только 21-е место. А на первом месте там… всё так же система JEDI на ровно той же аппаратной платформе, что неудивительно, ведь она тоже является «кусочком» JUPITER.

Источник изображения: Forschungszentrum Jülich / Sascha Kreklau На 11-ом месте оказался ещё один «сборный» суперкомпьютер — вторая фаза британского Isambard-AI на базе опять-таки NVIDIA GH200, которая добралась до отметки 216,5 Пфлопс (пик 278,6 Пфлопс). 13-е место досталось нидерландской системе ISEG2 от Nebius (когда-то Yandex) на базе Xeon Platinum 8468 (Sapphire Rapids), NVIDIA H200 (141 Гбайт) и InfiniBand NDR400. Неожиданностью можно назвать появление двух систем на базе векторных ускорителей SX-Aurora Type 10AE, разработку которых NEC уже забросила. Две безымянные машины на 113-м и 157-м местах принадлежат немецким метеорологам Deutscher Wetterdienst. Ближе к концу списка затесались ещё две любопытные системы из Норвегии, тоже безымянные. Интересны они тем, что сделаны xFusion (бывшее серверное подразделение Huawei, выделенное в проданную впоследствии независимую компанию), оснащены процессорами Intel Xeon 6900P (Granite Rapids-AP) и AMD EPYC 9005 (Turin), и… 100G-интерконнектом Intel Omni-Path. Буквально на днях Cornelis Networks догнала остальных разработчиков интерконнекта, представив, наконец, 400G-поколение CN5000. В целом же ситуация поменялась мало. На InfiniBand полагаются 54,2 % всех систем текущего списка, на Ethernet — суммарно по всем поколениям чуть больше трети. Но если считать по Флопсам, то 48,2 % приходится на Slingshot, т.е. практически целиком на системы HPE, производительность которых суммарно составляет 47,9 % от производительности всего списка TOP500. Второе место по этому показателю у Atos/Eviden. По количеству суперкомпьютеров в списке HPE при этом занимает лишь второе место, уступая Lenovo и обгоняя Dell. Иными словам, HPE и Atos/Eviden преимущественно занимаются крупными машинами, а Lenovo, Dell и даже сама NVIDIA берут скорее числом. В бенчмарке HPCG новым лидером стал El Capitan с показателем 17,407 Пфлопс, который сместил остальных участников на одну позицию вниз, отобрав первое место у Fugaku, которое она занимала несколько лет подряд. В бенчмарке HPL-MxP (HPL-AI) в расчётах смешанной точности первые места снова у El Capitan, Aurora и Frontier с показателями 16,7 Эфлопс, 11,6 Эфлопс и 11,4 Эфлопс соответственно. Интересно, что в нынешнем TOP500 так и осталась только одна машина с AMD Instinct MI300X, а среди новинок всё больше MI300A да NVIDIA GH200 (а также более традиционных H100/H200). Очевидно, что новейшие NVIDIA B300 и Instinct MI325X в рейтинг могли и не попасть, но не исключено, что и в будущем вендоры будут по-прежнему ставить устаревающие ускорители как минимум NVIDIA. Всё дело в том, что в новых поколениях чипов NVIDIA сделала ставку на ИИ-нагрузки — разница между GB200 и GB300 в FP64-расчётах почти тридцатикратная. AMD якобы готовит Instinct MI430X с поддержкой FP64 и MI450X без таковой. Уже в анонсах суперкомпьютеров следующего поколения на базе Vera Rubin сама NVIDIA аккуратно обходит стороной вопрос «чистой» производительности, говоря лишь о «научных результатах» в случае системы Doudna. А в случае Blue Lion компания говорит о «слиянии симуляций, данных и ИИ». Возможно, это не совсем то, чего ждут учёные.

10.06.2025 [18:55], Руслан Авдеев

Германия получит суперкомпьютер Blue Lion на новейших ускорителях NVIDIA Vera RubinНемецкий Суперкомпьютерный центр Лейбница (Leibniz Supercomputing Centre, LRZ), входящий в HPC-группу Gauss Centre for Supercomputing, получит в своё распоряжение суперкомпьютер Blue Lion на базе ускорителей Vera Rubin. Ожидается, что он будет приблизительно в 30 раз производительнее своего предшественника — SuperMUC-NG. Ожидается, что платформа NVIDIA нового поколения кардинально изменит подход к научным исследованиям, сообщается в блоге компании. Это второй анонс машины на базе Vera Rubin после американского суперкомпьютера Doudna. По словам NVIDIA, новая аппаратная платформа — это «слиянии симуляций, данных и ИИ в единый движок для науки с высокой пропускной способностью, низкой задержкой, когерентными вычислениями и общей памятью». Непосредственно суперкомпьютер будет использовать платформу HPE Cray нового поколения с СЖО с тёплой водой (до +40 °C) на входе и 100-% безвентиляторным дизайном. Тепло системы будет использоваться для отопления близлежащих зданий.

Источник изображения: NVIDIA Суперкомпьютер будет использоваться для исследований в областях климата, турбулентности, физики и машинного обучения — с комбинацией классических компьютерных симуляций и современного ИИ-моделирования. Также он станет помощником для реализации международных исследовательских проектов по всей Европе. Постройка новых компьютеров имеет важное значение, поскольку речь идёт о новой вехе в развитии суперкомпьютеров, которые теперь проектируются с прицелом на работу в реальном времени. ИИ более не является простым дополнением исследованиям, а данные постоянно находятся «в движении», поэтому стоящие за этим системы приходится постоянно поддерживать в актуальном состоянии, говорит NVIDIA.

10.06.2025 [12:15], Руслан Авдеев

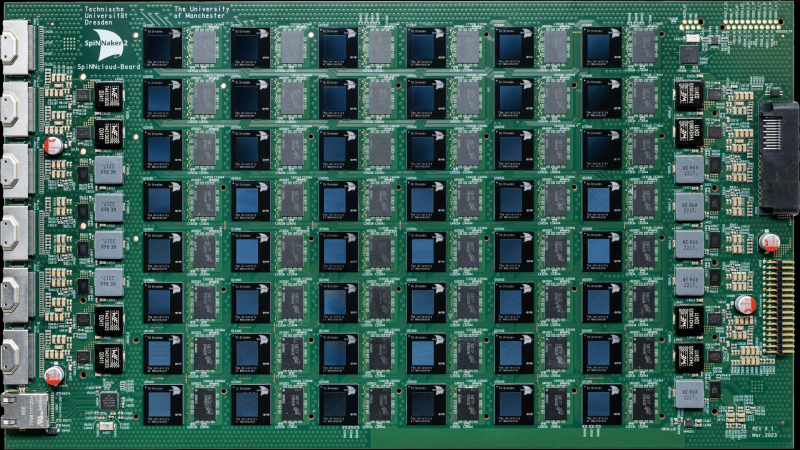

Нейроморфный суперкомпьютер SpiNNaker2, способный имитировать до 180 млн нейронов, прописался в Сандийских национальных лабораторияхНемецкая SpiNNcloud Systems, занимающаяся разработкой нейроморфных суперкомпьютеров, ввела в эксплуатацию в Сандийских национальных лабораториях (Sandia National Laboratories, SNL) суперкомпьютер SpiNNaker2, созданный по подобию человеческого мозга. Это имеет большое значение для развития вычислительной техники и выполнения задач, связанных с обеспечением национальной безопасности, сообщает Silicon Angle. SNL — это научно-исследовательский комплекс правительства США, занимающийся проектами в области национальной безопасности, энергетики и передовых технологических инноваций. Sandia управляется одним из специализированных подразделений Министерства энергетики США (DoE) и более всего известна проектами, связанными с ядерным арсеналом Соединённых Штатов и обеспечением его сохранности и эффективности. Суперкомпьютер SpiNNaker2 анонсировали в мае 2024 года. Он представляет собой высокопроизводительную нейроморфную компьютерную систему, основанную на принципах работы человеческого мозга. Платформа создана разработчиком архитектур Arm и SpiNNaker1 Стивом Фербером (Steve Furber) и использует множество чипов с низким энергопотреблением для ИИ-вычислений и выполнения других задач.

Источник изображения: SpiNNcloud Systems Как сообщает Datacenter Dynamics, система использует тысячи Arm-ядер для имитации работы нейронов мозга. В Sandia National Labs развёрнута одна из крупнейших в мире конфигураций SpiNNaker из 24 плат о 175 104 ядрами, способная моделировать 150–180 млн нейронов, что делает её одной из пяти самых мощных нейроморфных платформ в мире для исследований в области ИИ и нейротехнологий. Впрочем, от человеческого мозга со 100 млрд нейронов система, по данным Blocks & Files, пока ещё сильно отстаёт. SpiNNaker2 использует высокопараллельную архитектуру из 48 чипов SpiNNaker2 на плату, каждый из которых имеет по 152 ядра на основе Arm, 20 Мбайт SRAM и специализированные ускорители. Конструкция обеспечивает эффективные вычисления, позволяющие системе выполнять сложные симуляции с более низким энергопотреблением в сравнении с ИИ-ускорителями традиционного типа. Высокая эффективность SpiNNaker2 делает его особенно ценным для выполнения задач в сфере обеспечения национальной безопасности. Каждая плата оснащена 96 Гбайт оперативной памяти LPDDR4. В конфигурации с 90 платами система имеет 8640 Гбайт DRAM, а в максимальном варианте (1440 плат) — 138 240 Гбайт. Архитектура использует высокоскоростную межчиповую связь, что вообще исключает необходимость в централизованном хранилище данных, а огромный объём памяти позволяет эффективно моделировать крупномасштабные нейронные сети.

Источник изображения: SpiNNcloud Systems SpiNNaker2 интегрирован в существующие HPC-системы и работает без ОС или дисков, достигая высокой скорости работы за счет хранения данных в SRAM и DRAM. Система использует стандартные параллельные порты для загрузки и выгрузки данных, а её текущая максимальная конфигурация включает более 10,5 млн ядер, что позволяет моделировать нейронные сети в режиме «биологического реального времени». По словам представителя Sandia, хотя системы на базе классических ускорителей способны повысить эффективность суперкомпьютеров в сравнении с обычными CPU, системы на основе «архитектуры» человеческого мозга вроде SpiNNaker2 — ещё более привлекательная альтернатива. В SpiNNcloud заявляют, что система поддерживает и следующего поколения алгоритмов систем генеративного ИИ, обеспечивая значительно более эффективный путь развития машинного обучения с применением «динамической разреженности» (dynamic sparsity). По данным сайта SpiNNcloud, в скором будущем появится чип SpiNNext, в 78 раз более энергетически эффективный, чем традиционные ИИ-ускорители.

05.06.2025 [17:27], Руслан Авдеев

1 Тбит/с на 4,7 тыс. км: Nokia протестировала сверхбыструю квантово-защищённую сеть для ИИ-суперкомпьютеровNokia, финский центр CSC (Finnish IT Center for Science) и ассоциация образовательных и исследовательских учреждений Нидерландов SURF успешно испытали сверхбыструю (1,2 Тбит/с) квантово-безопасную магистраль передачи данных между Амстердамом и Каяани (Kajaani, Финляндия). Эксперимент направлен на подготовку инфраструктуры для HPC- и ИИ-систем, каналы связи которой защищены от взлома квантовыми компьютерами будущего, сообщает Converge. Испытание, проведённое в мае 2025 года, позволило установить связь по ВОЛС на расстоянии более 3,5 тыс. км, а длина одного из тестовых маршрутов через Норвегию составила 4,7 тыс. км (1 Тбит/с). Инициатива рассчитана на поддержку и развитие возможностей финского ИИ-суперкомпьютера LUMI-AI. Также речь идёт о поддержке будущих ИИ-фабрик (AI Factories), которым потребуются защищённые каналы со сверхвысокой пропускной способностью. Тестовый запуск включал передачу синтезированных и реальных исследовательских данных «с диска на диск» через пять исследовательских и образовательных сетей, включая SURF (Нидерланды), NORDUnet (преимущественно скандинавские страны), Sunet (Швеция), SIKT (Норвегия) и Funet (Финляндия). Эксперимент подтвердил возможность обработки огромных непрерывных потоков данных, необходимых для современных нагрузок, обучения и эксплуатации ИИ-моделей.

Источник изображения: LUMI В сети использовали маршрутизаторы Nokia IP/MPLS с поддержкой FlexE (Flexible Ethernet) для гибкого разделения физических интерфейсов на логические каналы с гарантированной пропускной способностью и квантово-защищённой передачу данных. Новая веха свидетельствует о готовности европейской инфраструктуры к интенсивному использованию данных, в том числе пакетов климатической информации петабайтных объёмов, информации для обучения ИИ-моделей и т.д. Эксперимент также подтвердил возможность безопасных, дальних многодоменных передач между разными сетями или административными границами. Это насущная потребность для современных международных проектов, где данные нужно передавать через разные сети без ущерба производительности и безопасности. По словам финских исследователей, исследовательские сети проектируются с учётом потребностей будущего. В ЦОД CSC в Каяани уже размещен общеевропейский суперкомпьютер LUMI, а с реализацией подпроекта LUMI-AI и ввода других ИИ-фабрик EuroHPC наличие надёжной и масштабируемой системы связи Европе просто необходима.

02.06.2025 [17:48], Сергей Карасёв

Dell построит один из первых суперкомпьютеров на базе NVIDIA Vera Rubin — Doudna для Министерства энергетики СШАМинистерство энергетики США (DOE) объявило о заключении контракта с Dell Technologies на создание нового суперкомпьютера под названием Doudna, в основу которого лягут ИИ-ускорители NVIDIA Vera Rubin. НРС-комплекс расположится в Национальной лаборатории им. Лоуренса в Беркли (Berkeley Lab) в Калифорнии (США). Система Doudna, также известная как NERSC-10, станет флагманским суперкомпьютером Национального вычислительного центра энергетических исследований США (NERSC) в составе Berkeley Lab. Комплекс назван в честь Дженнифер Даудны (Jennifer Doudna) — американского биохимика и генетика, исследователя геномики, одной из создателей технологии редактирования генома CRISPR-Cas9. Ожидается, что Doudna по производительности в «научных результатах» превзойдёт своего предшественника — суперкомпьютер Perlmutter — более чем в 10 раз. При этом энергопотребление возрастёт только в 2–3 раза. Теоретически, как отмечает The Register, система должна демонстрировать FP64-быстродействие до 790 Пфлопс при потреблении 5,8–8,7 МВт. Однако на практике, скорее всего, показатели будут иными. Дело в том, что детальная информация о производительности суперчипов Vera Rubin пока не раскрывается. Но в случае NVIDIA Blackwell Ultra, например, быстродействие на операциях двойной точности, которое считается необходимым для научных вычислений, было принесено в жертву широкому использованию форматов с 4-бит точностью, адаптированных для рабочих нагрузок ИИ. Так, у GB300 NVL72 FP64-производительность составляет 100 Тфлопс, а у его предшественника GB200 NVL72 — 2880 Тфлопс. Эта тенденция может сохраниться и в случае Vera Rubin. AMD, по слухам, готовит два варианта ускорителей Instinct: MI430X с поддержкой FP64 и MI450X без таковой. Джек Донгарра (Jack Dongarra), один из крупнейших в мире специалистов области HPC и один создателей рейтинга самых мощных суперкомпьютеров в мире TOP500, предупреждает, что ИИ не сможет решить всех проблем научного сообщества, а отказ американских производителей от выпуска необходимых учёным чипов грозит большими проблемами уже всей стране. «Именно поэтому NVIDIA заявляет о более чем 10-кратном приросте "научного результата", а не производительности», — подчёркивает The Register. Таким образом, машина Doudna задумывается как нечто вроде «швейцарского армейского ножа», способного выполнять различные рабочие нагрузки, охватывающие и HPC-, и ИИ-задачи. Основой послужат системы Dell Integrated Rack Scalable Systems и серверы PowerEdge с ИИ-ускорителями NVIDIA Vera Rubin. Говорится об использовании платформы NVIDIA Quantum-X800 InfiniBand. Сообщается, что суперкомпьютер будут использовать примерно 11 тыс. специалистов и ученых, которые ведут исследования в таких областях, как термоядерная энергетика, материаловедение, разработка лекарственных препаратов, астрономия и многое другое. Машина заработает в 2026 году.

28.05.2025 [15:49], Руслан Авдеев

NVIDIA и промышленная династия Валленбергов создадут ИИ-инфраструктуру в ШвецииNVIDIA и группа компаний, за которыми стоит влиятельная шведская семья Валленберг, займутся созданием современной ИИ-инфраструктуры в Швеции, сообщает Bloomberg. В число партнёров входят AstraZeneca Plc, Ericsson AB, Saab AB, SEB AB и инвестиционная группа Валленбергов. Вместе они намерены построить «крупнейший в Швеции» ИИ-суперкомпьютер. Также NVIDIA готовится создать первый в стране центр ИИ-технологий для продвижения исследований совместно с производственными компаниями. По словам главы NVIDIA Дженсена Хуанга (Jensen Huang), страна создаёт первую ИИ-инфраструктуру, закладывая основу для прорывов в науке, промышленности и обществе в целом.

Источник изображения: Raphael Andres/unsplash.com В рамках новой инициативы Saab объявила об использовании ИИ для ускоренной разработки оборонных технологий. Использовать искусственный интеллект в своих интересах намерены и другие партнёры. По словам председателя Wallenberg Investments AB Маркуса Валленберга (Marcus Wallenberg), результатом инициативы станут «ценные сопутствующие эффекты». Валленберги — известная с XIX века промышленная династия. Они остаются активными акционерами некоторых ключевых европейских компаний, в основном благодаря долям в Investor AB и FAM. Их финансовая система включает сеть фондов, ежегодно направляющих более Kr2,9 млрд ($287 млн) на поддержку научных и образовательных проектов в Швеции. В Швеции и без того активно развиваются проекты в сфере искусственного интеллекта. Так, в декабре 2024 года было объявлено, что страна станет базой для одной из ИИ-фабрик EuroHPC.

20.05.2025 [12:10], Сергей Карасёв

NVIDIA открыла центр с самым мощным в мире исследовательским квантовым суперкомпьютеромКомпания NVIDIA объявила об открытии Глобального центра исследований и разработок для бизнеса в области искусственного интеллекта на базе квантовых технологий (Global Research and Development Center for Business by Quantum-AI Technology, G-QuAT). На этой площадке размещена система ABCI-Q — крупнейший в мире исследовательский суперкомпьютер, предназначенный для квантовых исследований. Система интегрирована с тремя квантовыми компьютерами. О проекте ABCI-Q сообщалось в марте 2024 года. Названный суперкомпьютер разработан Национальным институтом передовых промышленных наук и технологий Японии (AIST). В основу положены 2020 ускорителей NVIDIA H100. Задействованы интерконнект NVIDIA Quantum-2 InfiniBand, а также платформа с открытым исходным кодом NVIDIA CUDA-Q для организации гибридных квантово-классических вычислений. Ожидается, что сотрудничество NVIDIA и AIST будет способствовать ускорению разработок в таких областях, как квантовая коррекция ошибок и ИИ-приложения с поддержкой квантовых вычислений. В конечном итоге, проект призван помочь в решении некоторых из самых сложных глобальных задач, охватывающих различные отрасли, включая здравоохранение, энергетику и финансы. Суперкомпьютер ABCI-Q интегрирован с процессором на сверхпроводящих кубитах Fujitsu, квантовым чипом на нейтральных атомах QuEra и фотонным процессором OptQC. Благодаря этому становится возможным выполнение рабочих нагрузок в нескольких модальностях кубитов. Исследователи смогут экспериментировать с вычислениями, основанными на GPU-ускорителях и квантовых процессорах разного типа. При этом будет обеспечиваться бесшовная интеграция квантового оборудования и классического суперкомпьютера.

20.05.2025 [12:05], Сергей Карасёв

В Казахстане заработает самый мощный суперкомпьютер в Центральной АзииМинистерство цифрового развития, инноваций и аэрокосмической промышленности Республики Казахстан (МЦРИАП) сообщило о том, что в страну доставлены узлы нового НРС-комплекса, который после сборки и запуска станет самым мощным суперкомпьютером в Центральной Азии. Система будет смонтирована в новом дата-центре МЦРИАП класса Tier III. Напомним, Минцифры Казахстана, АО «Фонд национального благосостояния «Самрук-Қазына» и компания Presight AI Ltd. из ОАЭ подписали соглашение о создании суперкомпьютера в феврале 2024 года. Проект реализуется в рамках Концепции развития искусственного интеллекта до 2029 года и является одним из ключевых этапов формирования современной ИТ-инфраструктуры Казахстана. Доставленная в республику система представляет собой первый в истории центральноазиатского региона суперкомпьютерный кластер. В его основу положены ускорители NVIDIA H200 на архитектуре Hopper. Заявленная производительность достигает примерно 2 Эфлопс (на операциях ИИ). Более подробные технические характеристики машины пока не раскрываются.

Источник изображения: NVIDIA Ресурсы суперкомпьютера будут доступны всем участникам рынка. Мощности НРС-комплекса, в частности, смогут использовать стартапы для обучения нейросетей, университеты для проведения фундаментальных и прикладных исследований, а также научные центры и компании, внедряющие ИИ в бизнес-процессы. МЦРИАП подчеркивает, что запуск суперкомпьютера станет важным этапом в реализации послания президента страны по созданию собственной цифровой инфраструктуры и развитию национальной ИИ-экосистемы. В рамках проекта Казахстан впервые выстроил механизм ввоза высокотехнологичного оборудования без пошлин и НДС. Кроме того, во время официального визита в Казахстан наследного принца Абу-Даби, шейха Халеда бин Мохаммеда бин Зайда Аль Нахайяна состоялось открытие зарубежного офиса компании Presight (G42) в Астане. Новый офис, расположенный на территории «Экспо», выполняет функцию регионального хаба в Центральной Азии. В перспективе планируется формирование ситуационного центра, который станет интеллектуальным ядром городской инфраструктуры Астаны. Передовая платформа обеспечит мониторинг и принятие решений в различных областях, включая энергетику, общественную безопасность и управление городской инфраструктурой. «Это стратегически важный шаг в построении цифровой инфраструктуры страны. Он укрепит цифровой суверенитет Казахстана и лидирующую позицию в регионе по развитию технологий ИИ и привлечению глобальных IT-игроков», — говорит министр цифрового развития, инноваций и аэрокосмической промышленности Республики Казахстан Жаслан Мадиев.

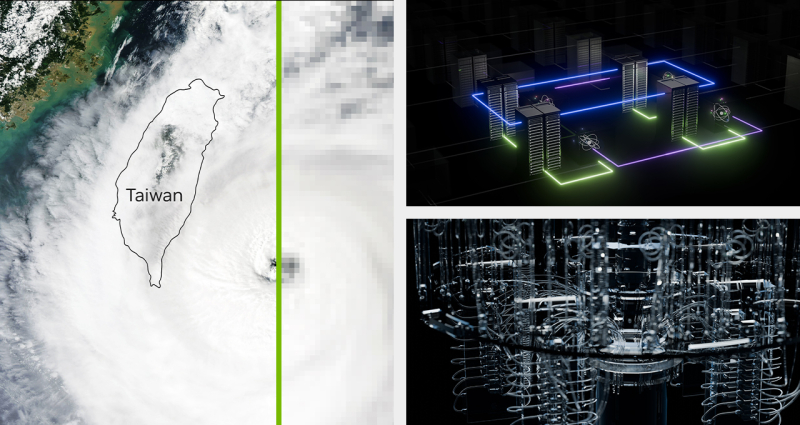

19.05.2025 [23:55], Владимир Мироненко

NVIDIA построит на Тайване новую штаб-квартиру и развернёт два ИИ-суперкомпьютераNVIDIA построит в ближайшем будущем на Тайване новую штаб-квартиру, а также два ИИ-суперкомпьютера. Об этом сообщил гендиректор американской компании Дженсен Хуанг (Jensen Huang), подтвердив свою приверженность Тайваню как глобальному технологическому центру, пишет The Financial Times. Хуан отдал должное Тайваню, «крупнейшему региону по производству электроники в мире», назвав его «центром компьютерной экосистемы». Строительством первого ИИ-суперкомпьютера на базе 10 тыс. ускорителей Blackwell займётся Big Innovation Company, «дочка» Foxconn, в сотрудничестве с NVIDIA и при поддержке тайваньского правительства. Стоимость суперкомпьютера, который будут использоваться в технологической экосистеме Тайваня, составит сотни миллионов долларов. В числе клиентов будущего суперкомпьютера Хуанг назвал TSMC, ключевого производственного партнёра NVIDIA, которая будет использовать его вычислительные мощности для исследований и разработки новых процессов создания чипов. Второй ИИ-суперкомпьютер построит ASUS в интересах Национального HPC-центра NCHC (National Center for High-Performance Computing). Он будет ориентирован на исследование климата, разработку квантовых технологий, создание LLM и иную R&D-деятельность. Система будет в восемь раз мощнее суперкомпьютера Taiwania 2, в создании которого также принимала участие ASUS. Новинка получит узлы HGX H200 (всего 1700 ускорителей), две стойки GB200 NVL72, а также HGX B300, объединённые интерконнектом Quantum InfiniBand. Кроме того, NCHC планирует установить системы DGX Spark и развернуть облачный HGX-кластер. «Мы растём за пределы нашего текущего офиса [на Тайване]», — заявил Хуан, демонстрируя видео приземления футуристического космического корабля и его последующей трансформации в дизайн новой штаб-квартиры Constellation («Созвездие»), строительство которой начнется в ближайшее время в Бэйтоу (Beitou), районе Тайбэя. Дженсен Хуанг также представил интерконнект NVLink Fusion, который позволит объединить решения NVIDIA с решениями конкурентов. Таким способом компания надеется закрепить свою технологию в качестве решения для базовой инфраструктуры. «Ничто не радует меня больше, чем, когда вы покупаете всё у NVIDIA… но мне доставляет огромную радость, если вы просто покупаете что-то у NVIDIA», — пошутил он. На вопрос о возможности создания NVIDIA нового чипа для Китая, который бы соответствовал последним экспортным ограничениям США, Хуанг заявил, что компания «оценивает, как лучше всего выйти на китайский рынок», отметив, что дальнейшие модификации H20 невозможны. Вместе с тем NVIDIA рассматривает возможность перепроектирования своих чипов с учётом новых ограничений, чтобы продолжать продавать их в Китае. На прошлой неделе стало известно о планах NVIDIA построить новый исследовательский центр в Шанхае в знак своей приверженности Поднебесной. Хуанг добавил, что «нет никаких доказательств контрабанды каких-либо ИИ-чипов» в Китай. Из-за опасений по поводу нелегальных поставок передовых чипов NVIDIA в Китай американские законодатели потребовали в прошлом месяце от компании предоставить отчёт о продажах её продукции в Китае и Юго-Восточной Азии. |

|