Материалы по тегу: ии

|

17.03.2026 [19:23], Руслан Авдеев

Amazon и NVIDIA расширят сотрудничество: в течение года AWS развернёт более 1 млн ИИ-ускорителей NVIDIAAWS и NVIDIA анонсировали расширение технологического сотрудничества. Речь идёт о взаимодействии в сфере ускоренных вычислений, технологий интерконнекта, настройки ИИ-моделей и инференса. План включают развёртывание AWS в облачных регионах по всему миру более 1 млн новых ИИ-ускорителей NVIDIA, в т.ч. семейств Blackwell и Rubin, и сетевых технологий NVIDIA Spectrum. Ведётся подготовка к запуску новых инстансов EC2 на основе ускорителей NVIDIA RTX Pro 4500 Blackwell Server Edition. AWS стала первым крупным облачным провайдером, анонсировавшим поддержку этих ускорителей. Эти инстансы предназначены для аналитики, «говорящих» ИИ-систем, генерации контента, рекомендательных систем, видеостриминга, видеорендеринга и др. Они будут построены на архитектуре AWS Nitro С ростом инфраструктуры ключевой проблемой становится взаимодействие между ускорителями NVIDIA и AWS Trainium. Компании объявили о поддержке NVIDIA Inference Xfer Library (NIXL) и AWS Elastic Fabric Adapter (EFA), что позволяет ускорить распределённый инференс ИИ-моделей на EC2. Подобная архитектура распределённого инференса позволяет эффективно совмещать вычисления и передачу данных, снижать задержки и максимизировать использование ИИ-ускорителей. NIXL с EFA интегрируются с популярными открытыми фреймворками, включая NVIDIA Dynamo, vLLM и SGLang.

Источник изображения: AWS Дополнительно AWS и NVIDIA объявили об использовании Apache Spark в конфигурации Amazon EMR на Amazon EKS с инстансами G7e на основе ускорителей NVIDIA RTX Pro 6000 Blackwell, что втрое ускорит аналитику данных. При этом сохраняется совместимость с имеющимися приложениями Spark. Наконец, компании объявили о расширении поддержки ИИ-моделей NVIDIA Nemotron в Amazon Bedrock с адаптацией моделей для юриспруденции, здравоохранения, финансов и других специализированных областей. Вся инфраструктура управляется Bedrock, что значительно упрощает задачи разработчиков. Вскоре ожидается появление гибридной MoE-модели NVIDIA Nemotron 3 Super для финансовых сервисов, кибербезопасности, ретейла, разработки ПО и др. В целом компании создали полный стек ИИ-инфраструктуры — от ИИ-ускорителей и сетей до управляемых сервисов. Это позволит клиентам быстрее внедрять ИИ-решения, не конструируя инфраструктуру из разрозненных компонентов. Как сообщает Datacenter Dynamics, в феврале 2026 года глава AWS Мэтт Гарман (Matt Garman) заявил, что компания всё ещё использовала устаревшие ускорители NVIDIA A100 в некоторых серверах, поскольку спрос был высок даже на них. Широкий доступ к NVIDIA Blackwell Ultra появился в декабре 2025 года, в скором будущем планируется организовать доступ и к ускорителям Rubin. В то же время компания намерена инвестировать в собственные ускорители Trainium. В феврале OpenAI объявила, что будет использовать 2 ГВт мощностей на основе Trainium и других ускорителей в облаке AWS, во многом благодаря $50 млрд инвестиций со стороны Amazon.

17.03.2026 [11:02], Руслан Авдеев

Meta✴ потратит до $27 млрд на ИИ-инфраструктуру NebiusMeta✴ Platforms в течение пяти лет намерена заплатить $27 млрд за ИИ-инфраструктуру, доступ к которой предоставит облачный провайдер Nebius Group, базирующийся в Нидерландах, сообщает Bloomberg. В Meta✴ подтвердили сделку с Nebius. Nebius — стратегический партнёр NVIDIA, с 2027 года предоставит Meta✴ мощности ЦОД на $12 млрд, ещё до $15 млрд Meta✴ потратит на покупку мощностей, которые облачный провайдер строит для сторонних клиентов. Это один из крупнейших «разовых» контрактов, заключенных Meta✴, что подчёркивает стремление компании развиваться в сфере ИИ. Недавно появилась информация, что компания сократит более 20 % штата из-за высоких затрат на ИИ-проекты. В 2025 году она уже заключила сделку с Nebius на $3 млрд. За последние 12 месяцев акции Nebius выросли в цене в четыре раза, а на фоне новостей подорожали на 15 %, а Meta✴ — на 2,8 %.

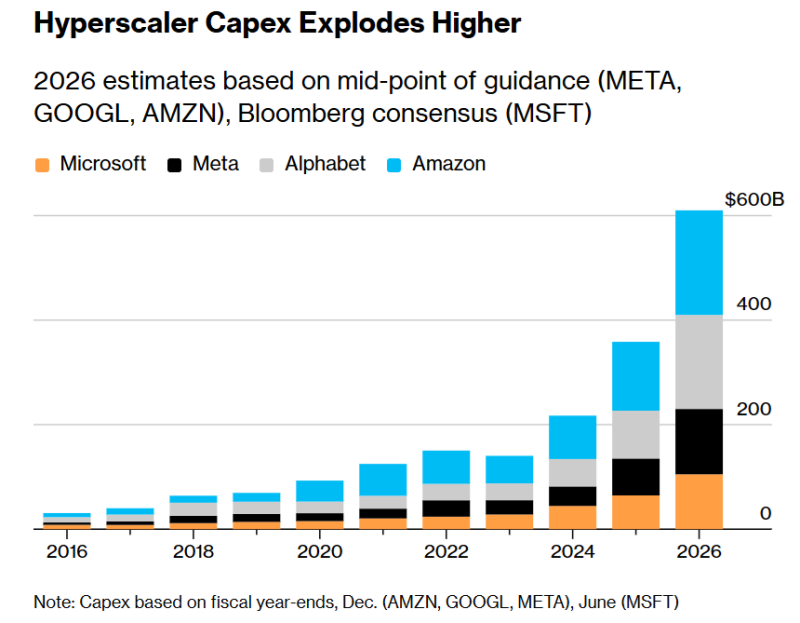

Источник изображения: Nebius Предполагается, что Meta✴ и её крупнейшие конкуренты потратят в 2026 году около $650 млрд на строительство ЦОД и покупку другой инфраструктуры на фоне взрывного роста спроса на ИИ-сервисы в ближайшие годы. Для Meta✴ ИИ в последнее время является ключевым приоритетом, и компания вкладывает значительные средства в конкуренцию с OpenAI, Google и др. С начала года заключены соглашения с NVIDIA и AMD о создании ИИ-инфраструктуры. Кроме того, Meta✴ разрабатывает и собственные ИИ-ускорители. В 2025 году заявлялось, что к 2028 году Meta✴ потратит на инфраструктурные инициативы в США $600 млрд. Для этого она будет использовать средства, вырученные от рекламного бизнеса и внешнее финансирование. Компания разрабатывает также и собственные ИИ-модели и др.

Источник изображения: Bloomberg Nebius, отделившаяся от «Яндекса» в 2024 году, — один из немногих новичков, очень успешно воспользовавшихся бумом ИИ-технологий. При этом немаловажную роль играет NVIDIA, активно инвестирующая в стартапы, конкурирующие с гиперскейлерами вроде Google и Amazon (AWS). На днях NVIDIA объявила о намерении инвестировать в Nebius $2 млрд, что привело к росту акций последней на 16 %. Значительная часть инвестиций NVIDIA была направлена компаниям, покупающим её собственные чипы. Это вызвало критику экспертов рынка, опасающихся, что такие инвестиции подпитывают создание ИИ-пузыря. Например, в январе NVIDIA сообщила об инвестициях $2 млрд в неооблачного провайдера CoreWeave, конкурирующего с Nebius, средства предназначались на внедрение ИИ-ускорителей самой NVIDIA. В 2026 году компания вложила $30 млрд в OpenAI, а также принимала участие в очередном раунде финансирования британской Nscale, желавшей привлечь $2 млрд. В январе сообщалось, что затраты Meta✴ на связанные с ИИ расходы в 2026 году составят от $115 до $135 млрд, это превышает прогнозы аналитиков в $110,7 млрд и почти вдвое больше, чем капитальные затраты компании в 2025 году, которые составили $72,2 млрд. Роста затрат направлен на поддержку подразделения Meta✴ Superintelligence Labs (MSL), а также основной повседневной деятельности компании.

17.03.2026 [10:32], Руслан Авдеев

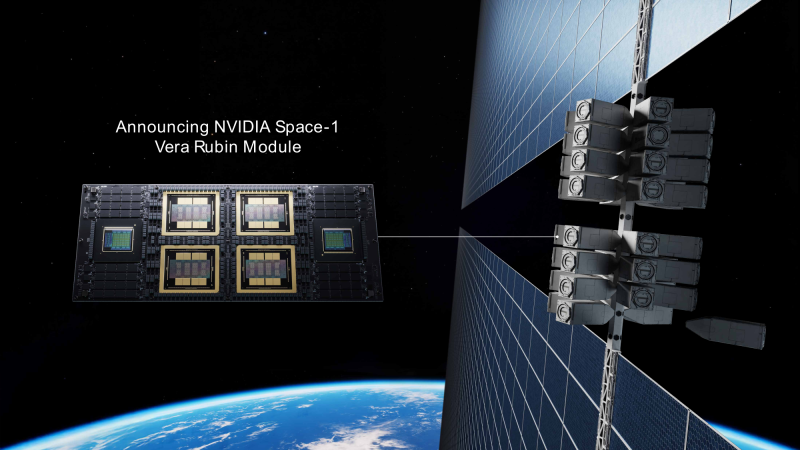

NVIDIA анонсировала Space-1 Vera Rubin Module — ИИ-ускоритель для орбитальных ЦОД, который в 25 раз быстрее H100Глава NVIDIA Дженсен Хуанг (Jensen Huang) представил космический вычислительный модуль на архитектуре Vera Rubin. По его словам, модуль до 25 раз производительнее, чем NVIDIA H100, и шесть коммерческих космических компаний уже внедрили платформу, сообщает Tom’s Hardware. Space-1 Vera Rubin Module предназначен для орбитальных дата-центров, работающих с ИИ-моделями непосредственно в космосе. Он имеет тесно интегрированную архитектуру CPU–GPU и высокоскоростной интерконнект для работы с большими потоками данных от космических инструментов в режиме реального времени. Также предлагается вариант NVIDIA IGX Thor для критически важных периферийных сред с поддержкой выполнения ИИ-задач в режиме реального времени, безопасной загрузки, автономных операций и др. Наиболее компактный вариант NVIDIA Jetson Orin рассчитан на использование в спутниках с ограниченными размерами, весом и энергопотреблением — для систем бортового «зрения», навигации и обработки данных с датчиков. По данным NVIDIA, сейчас её новые платформы на Земле и в космосе используют компании Aetherflux, Axiom Space, Kepler Communications, Planet Labs PBC, Sophia Space и Starcloud. Kepler внедряет Jetson Orin в своей спутниковой группировке для управления данными и их маршрутизацией с помощью ИИ-инструментов. Jetson Orin применяется непосредственно в спутниках. В октябре 2025 года основатель Amazon и Blue Origin Джефф Безос (Jeff Bezos) прогнозировал, что через 10–20 лет на орбите появятся ЦОД гигаваттного масштаба. Основными преимуществами таких решений назывались возможность непрерывного электроснабжения группировки с помощью солнечной энергии, а также упрощённая система охлаждения в космосе. Starcloud уже строит специальные орбитальные ИИ-ЦОД, предназначенные для обучения моделей и инференса непосредственно на орбите. Космические ЦОД — весьма перспективное направление в сфере ИИ. Одним из наиболее громких событий стала заявка SpaceX, попросившей у американских властей разрешение на вывод на орбиту миллиона микро-ЦОД. Инициатива подверглась критике Amazon как «спекулятивная», но компания столкнулась с критикой Федеральной комиссии по связи с США, потребовавшей навести порядок в собственном космическом бизнесе.

17.03.2026 [02:00], Владимир Мироненко

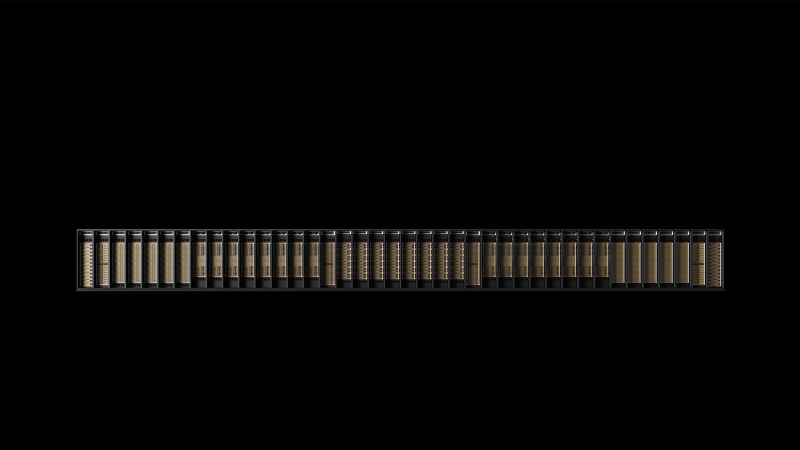

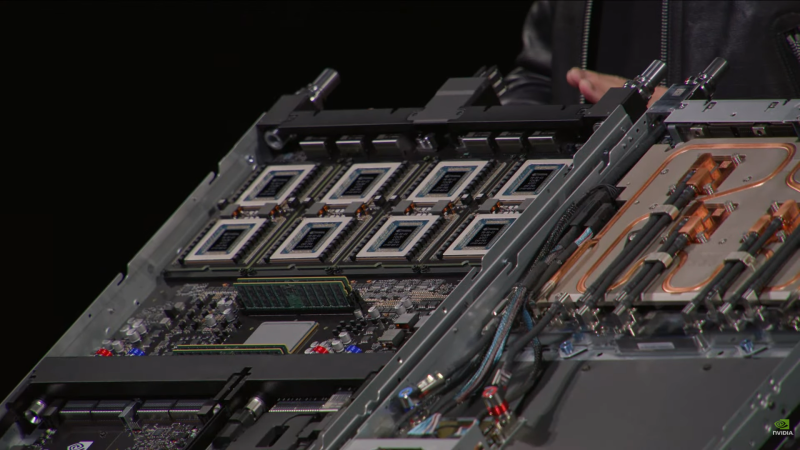

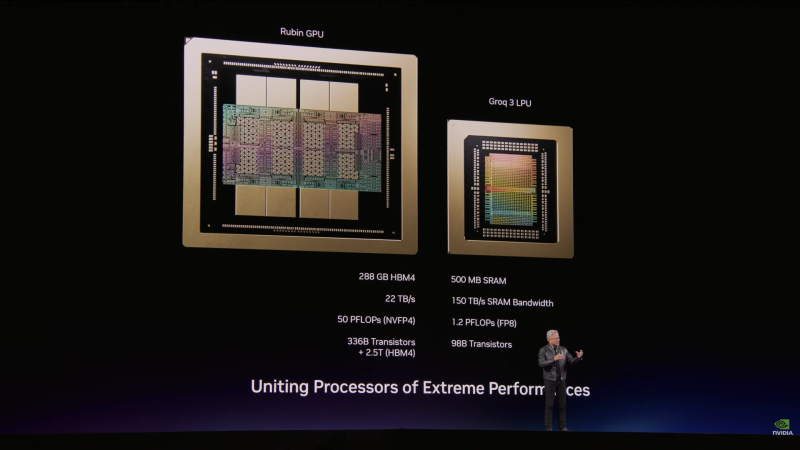

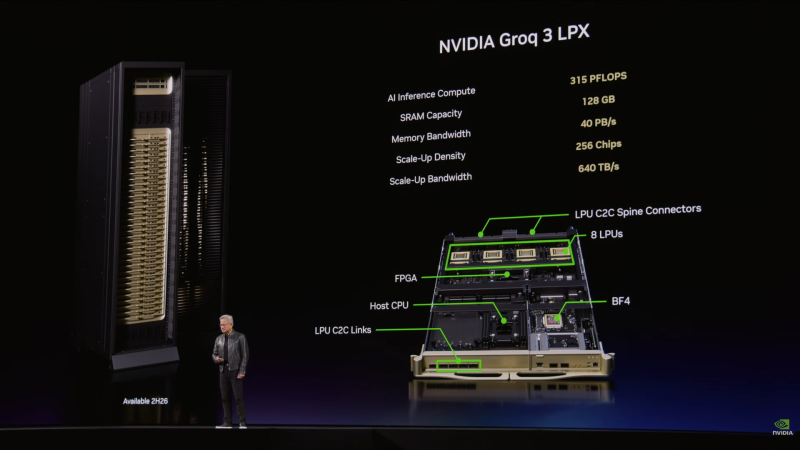

ИИ-ускорители Groq прописались в платформе NVIDIA Vera RubinNVIDIA объявила о том, что платформа Vera Rubin, объединяющая теперь уже семь различных чипов (ещё в январе их было шесть), которые вместе откроют новые горизонты агентного ИИ, запущена в производство. Платформа включает Arm-процессоры Vera, ускорители Rubin, интерконнект NVLink 6, адаптеры ConnectX-9 SuperNIC и DPU BlueField-4, а также Ethernet-коммутаторы Spectrum/Quantum-6. Седьмым чипом стал LPU Groq 3 — NVIDIA купила Groq за рекордные $20 млрд всего три месяца назад и активно наращивает производство LPU. Благодаря такому сочетанию компонентов платформа обеспечивает обработку ИИ-нагрузок на всех этапах — от масштабного предварительного обучения, постобучения и масштабирования во время тестирования до инференса агентных задач в реальном времени, говорит NVIDIA. «Vera Rubin — это скачок в развитии — семь прорывных чипов, пять стоек, один гигантский суперкомпьютер — созданный для обеспечения всех этапов работы ИИ», — сообщил Дженсен Хуанг (Jensen Huang), основатель и генеральный директор NVIDIA. Он отметил, что с появлением Vera Rubin в развитии агентного ИИ наступил переломный момент, положившей начало «крупнейшему в истории развёртыванию инфраструктуры». «Платформа NVIDIA Vera Rubin предоставляет нам вычислительные ресурсы, сетевые возможности и системную архитектуру, позволяющие продолжать работу, одновременно повышая безопасность и надёжность, на которые полагаются наши клиенты», — подтвердил Дарио Амодеи (Dario Amodei), генеральный директор и соучредитель Anthropic. «Инфраструктура NVIDIA — это основа, которая позволяет нам расширять границы ИИ, — заявил Сэм Альтман (Sam Altman), генеральный директор OpenAI. — С NVIDIA Vera Rubin мы будем запускать более мощные модели и агентов в огромных масштабах и предоставлять более быстрые и надёжные системы сотням миллионов людей». Как отметила компания, Vera Rubin предлагает самую обширную комплексную ИИ-платформу — суперкомпьютер с множеством стоек, специально разработанных для ИИ, работающих как одна массивная, целостная система. NVIDIA Vera Rubin NVL72 обеспечивает высокую эффективность в обучение больших MoE-моделей с использованием вчетверо меньшего количества ускорителей по сравнению с платформой Blackwell и достижение до 10 раз большей пропускной способности инференса на ватт при в десять раз меньшей стоимости токена. CPU-стойка Vera — это высокоплотная MGX-платформа с СЖО, объединяющая 256 процессоров Vera для обеспечения масштабируемой, энергоэффективной производительности с первоклассной однопоточной обработкой, что обеспечивает возможности для масштабируемого агентного ИИ. Стойки Vera имеют тесную синхронизацию сред во всей ИИ-фабрике. Вместе со стойками Rubin они обеспечивают основу крупномасштабных систем агентного ИИ и обучения с подкреплением — при этом Vera обеспечивает результаты в два раза эффективнее и наполовину быстрее, чем традиционные CPU (впрочем, в NVL8 по-прежнему будут Intel Xeon). Стойки Groq 3 LPX (тоже с СЖО и тоже на базе MGX) и Vera Rubin, разработанные для обеспечения низкой задержки и обработки больших контекстов, необходимых для агентных систем, обеспечивают до 35 раз более высокую пропускную способность инференса на мегаватт и до 10 раз больший потенциал дохода для моделей с триллионами параметров. В масштабе предприятия парк LPU функционирует как единый гигантский процессор для быстрого и детерминированного ускорения инференса. Стойка LPX с 256 LPU-чипами имеет 128 Гбайт SRAM с агрегированной пропускной способностью 640 Тбайт/с. В сочетании с Vera Rubin NVL72 чипы LPU повышают эффективность декодирования, совместно вычисляя каждый слой модели ИИ для каждого выходного токена. Всё это позволяет работать с моделями с триллионами параметров и контектсным окном в миллионы токенов, сохраняя максимальную эффективность по энергопотреблению, памяти и вычислительным ресурсам. Любопытно, что Rubin CPX в этот раз NVIDIA решила особо не упоминать. Анонсированная вместе с Vera Rubin СХД BlueField-4 STX разработана специально для ИИ-нагрузок, обеспечивая бесперебойное расширение памяти GPU по всему POD-кластеру. Впрочем, теперь компания говорит, что BlueField-4 включает CPU Vera, а не Grace, и ConnectX-9 SuperNIC. STX обеспечивает высокоскоростной общий слой данных, оптимизированный для хранения и извлечения больших объёмов KV-кеша, генерируемых LLM и рабочими процессами агентного ИИ. А программная платформа DOCA Memos позволяет использовать выделенное KV-хранилище для увеличения пропускной способности инференса до пяти раз, также повышая энергоэффективность по сравнению с архитектурами хранения общего назначения. Также NVIDIA совместно с более чем 200 партнёрами анонсировала платформу NVIDIA DSX для Vera Rubin, которая включает технологию DSX Max-Q, позволяющую динамически управлять питанием всей ИИ-фабрики целиком, позволяя увеличить на 30 % ИИ-инфраструктуру в ЦОД при том же энергопотреблении. ПО DSX Flex обеспечивает ИИ-фабрикам гибкость в работе с энергосетями, позволяя освоить до 100 ГВт неиспользуемой мощности сетей. Кроме того, NVIDIA выпустила эталонный проект Vera Rubin DSX AI Factory — схему для совместно разработанной ИИ-инфраструктуры, которая максимизирует количество токенов на ватт и общую пропускную способность, повышая отказоустойчивость системы и ускоряя развётывание. Продукты на базе Vera Rubin будут доступны у партнёров NVIDIA, начиная со II половины этого года. В их число входят гиперскейлеры AWS, Google Cloud, Microsoft Azure и Oracle Cloud, а также партнёры NVIDIA Cloud — CoreWeave, Crusoe, Lambda, Nebius, Nscale и Together AI. Ожидается, что широкий спектр серверов на базе продуктов Vera Rubin будут поставлять глобальные производители систем Cisco, Dell Technologies, HPE, Lenovo и Supermicro, а также Aivres, ASUS, Foxconn, GIGABYTE, Inventec, Pegatron, Quanta Cloud Technology (QCT), Wistron и Wiwynn.

16.03.2026 [10:54], Руслан Авдеев

Reuters: Meta✴ планирует уволить каждого пятого, чтобы компенсировать расходы на ИИ-проектыКомпания Meta✴ намерена провести масштабные сокращения штата, способные затронуть 20 % сотрудников или даже более. Предполагается, что это поможет компенсировать большие расходы на создание ИИ-инфраструктуры и «подготовиться» к повышению эффективности, связанному с массовым внедрением ИИ, сообщает Reuters со ссылкой на три источника, знакомых с вопросом. Источники свидетельствуют, что точная дата сокращений ещё не названа и их масштабы ещё не определены. По некоторым сведениям, топ-менеджмент недавно уведомил ряд других руководителей Meta✴ о предстоящих событиях и поручил начать планирование сокращения расходов. В самой компании поспешили заявить, что речь идёт о «спекулятивных заявлениях» и «теоретических выкладках». Если Meta✴ согласует увольнение пятой части сотрудников, это станет самым значимым для компании раундом сокращений с момента реструктуризации в конце 2022 — начале 2023 года. Этот период тогда назывался «годом эффективности», когда было уволено в общей сложности более 20 тыс. человек. По последним данным, на 31 декабря 2025 года в компании работало около 79 тыс. человек. В последнее время глава Meta✴ Марк Цукерберг (Mark Zuckerberg) поощряет более активное участие компании в ИИ-проектах. Для привлечения лучших специалистов в области ИИ предлагаются крупные компенсационные пакеты: выплаты новой команде для создания «суперинтеллекта» на ближайшие четыре года оценивались в сотни миллионов долларов.

Источник изображения: Allef Vinicius/unsplash.com Более того, компания заявляла о намерении инвестировать $600 млрд в строительство ЦОД к 2028 году. Не так давно сообщалось, что компания потратит не менее $2 млрд на покупку китайского ИИ-стартапа Manus и др. При этом Цукерберг ещё в январе 2026 года подчёркивал, что проекты, ранее требовавшие больших команд, теперь могут выполняться одним очень талантливым человеком. Запланированные Meta✴ инвестиции в ИИ последовали за рядом неудач с моделями семейства Llama 4 в 2025 году. В конце концов компания отказалась от выпуска крупнейшей версии модели под названием Behemoth, планировавшейся на лето. В текущем году команда по созданию «сверхразума» работала над восстановлением позиций компании на рынке ИИ, создав модель Avocado, однако и она не оправдала ожиданий. В январе сообщалось, что затраты компании на связанные с ИИ расходы в 2026 году составят от $115 до $135 млрд, это превышает прогнозы аналитиков в $110,7 млрд и почти вдвое больше, чем капзатраты в 2025 году, которые составили $72,2 млрд. Рост затрат направлен на поддержку подразделения Meta✴ Superintelligence Labs (MSL), а также основной повседневной деятельности компании. Тогда же появилась информация, что Meta✴ создаёт подразделение Meta✴ Compute для строительства ИИ ЦОД на десятки гигаватт, в феврале появились данные, что компания получит миллионы ИИ-ускорителей Google TPU, а в марте — сведения о том, что она представила четыре новых собственных ИИ-ускорителя MTIA.

16.03.2026 [10:49], Руслан Авдеев

США отозвали законопроект, запрещавший экспорт ИИ-чипов без прямого разрешения американских властейМинистерство торговли США отозвало законопроект, ограничивавший новый порядок экспорта ИИ-чипов в любую точку мира без разрешения американских властей. Электронное уведомление об этом появилось на одном из правительственных сайтов, сообщает Bloomberg. В прошлую пятницу на сайте Административно-бюджетного управления США (OMB) появилась информация о том, что межведомственная экспертиза документа завершена и документ отозван. При этом никаких других деталей не раскрывается. Представитель администрации США заявил, что документ действительно представлял собой лишь проект, и все дискуссии, касавшиеся его применения, носили предварительный характер. Информация о возможном принятии нового закона появилась в начале марта. Новые правила в случае принятия обязывали бы компании вроде NVIDIA и AMD получать разрешение на любые продажи ИИ-ускорителей у американских властей. По данным Bloomberg, сегодня их покупают более 40 стран. Специфика получения разрешений зависела бы от того, как много вычислительных мощностей необходимо. По данным Bloomberg, для тех, кто хотел бы купить до 1 тыс. NVIDIA GB300, потребовалась бы довольно простая процедура проверки для получения экспортной лицензии. Более крупных покупателей ожидали бы серьёзные предварительные проверки с раскрытием бизнес-моделей и разрешением для американских властей посещать площадки размещения ускорителей.

Источник изображения: Tim Mossholder/unsplash.com Наконец, для очень крупных клиентов, желавших купить более 200 тыс. GB300 на одну компанию в одной стране, требовалось участие в сделке местного правительства. США предполагали продажи в таких объёмах только союзникам, взяв с них обещание строго соблюдать требования безопасности и инвестировать в американскую ИИ-индустрию. Для примера — порядка 200 тыс. GB300 британская Nscale, сдающая ускорители в аренду, намерена предоставить Microsoft на четырёх площадках в США и Европе. Заявляется, что это «один из крупнейших инфраструктурных ИИ-контрактов, когда-либо подписанных». Ранее издание подчёркивало, что законопроект могут в любое время отменить или полностью «отправить на полку». В случае принятия закона это стало бы одним из ключевых элементов новой стратегии экспорта ИИ-чипов после того, как администрация Трампа в прошлом году отказалась от подхода, применявшегося при Байдене. В ответ на запрос СМИ Министерство торговли США заявило на днях, что США не намерены возвращаться к прежней системе регулирования, которая была названа «обременительной, чрезмерной и катастрофической». При этом ныне отозванный законопроект предполагал расширение роли подразделения Министерства торговли США, занимавшегося лицензированием, для проведения индивидуальных проверок экспорта чипов производителями уровня NVIDIA и AMD. В мае 2025 года Трамп отменил введённые ещё при Байдене правила экспортного контроля, фактически делившие покупателей из разных стран на «сорта». Например, неограниченный доступ к покупке получали даже не все страны Евросоюза. Какова была бы практика в соответствии с новым законом, неизвестно. Не исключено, что новый вариант законопроекта будет рассмотрен в будущем. Пока же США несколько ослабили контроль, не так давно разрешив поставлять в Китай относительно устаревшие ускорители NVIDIA H200, которые всё ещё очень востребованы в Поднебесной.

16.03.2026 [10:45], Владимир Мироненко

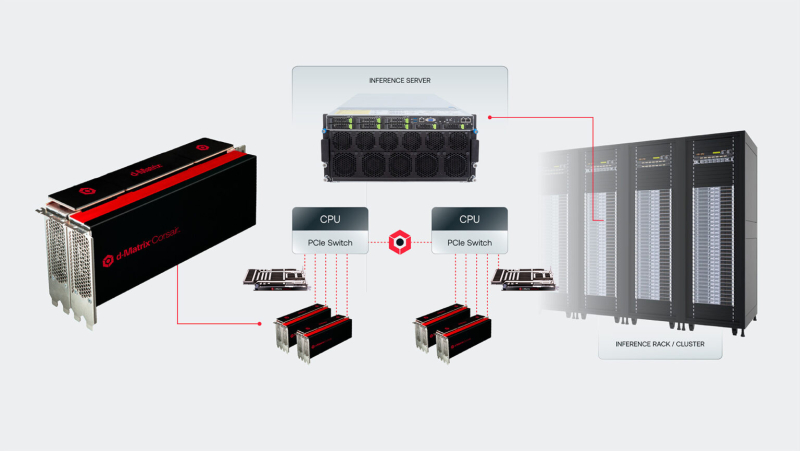

ASIC + GPU: d-Matrix и Gimlet Labs в 10 раз ускорят инференс агентного ИИКомпании d-Matrix и Gimlet Labs сообщили о решении объединить усилия с целью повышения производительности и энергоэффективности инференса для задач агентного ИИ в режиме реального времени. В рамках партнёрства Gimlet интегрирует ускорители d-Matrix Corsair в облако Gimlet Cloud наряду с традиционными GPU. В гибридной архитектуре GPU будут отвечать за ресурсоёмкие этапы инференса, в то время как операции, чувствительные к работе с памятью и задержкам, будут обрабатывать Corsair. Компании сообщили, что совместное решение может обеспечить десятикратное улучшение задержки и пропускной способности на ватт по сравнению с использованием только GPU. Согласно пресс-релизу, решение «идеально подходит для рабочих нагрузок, чувствительных к задержке, включая спекулятивное декодирование, которое часто используется в крупномасштабных развёртываниях ИИ для снижения задержки». Corsair поставляется в виде стандартной карты PCIe с воздушным охлаждением, что позволяет быстро устанавливать решение в ЦОД внутри существующих серверов с GPU без специальных корпусов или нестандартных систем трубопроводов. Сетевые карты d-Matrix Jetstream передают данные между Corsair и GPU посредством стандартного Ethernet, упрощая интеграцию в масштабах инфраструктуры и повышая эффективность использования. Заин Асгар (Zain Asgar), сооснователь и генеральный директор Gimlet Labs, заявил, что «аппаратное обеспечение d-Matrix — идеальное решение для тех этапов инференса, на которых GPU тратят энергию впустую». «Используя Corsair для таких сценариев использования, как спекулятивное декодирование, мы можем обеспечить нашим клиентам значительно более высокую производительность при тех же габаритах», — добавил он. Программный стек Gimlet интеллектуально распределяет и сопоставляет рабочие нагрузки агентов между различными ускорителями разных производителей, поколений и архитектур, запуская каждый сегмент на наиболее оптимальном оборудовании. ЦОД Gimlet включают в себя различные типы оборудования и высокоскоростные интерконнекты для обслуживания передовых лабораторий и других компаний, занимающихся разработкой ИИ. Аналитик Мэтт Кимбалл (Matt Kimball) из Moor Insights & Strategy сообщил ресурсу Data Center Knowledge, что ключевым моментом является сочетание специализированного оборудования и программной оркестрации. «Архитектура d-Matrix разработана с учётом эффективности инференса, а не масштабируемости обучения, что соответствует рынку в ходе внедрения приложений ИИ в производство, — сказал Кимбалл. — Но одного оборудования недостаточно — такие платформы, как Gimlet, стремятся упростить развёртывание и легко интегрироваться в существующие рабочие процессы. Именно это делает данное решение привлекательным». Аналитик добавил, что реальная ценность решения заключается в уровне абстракции, который предоставляет Gimlet, позволяя запускать рабочие нагрузки на гетерогенных чипах без переписывания кода. «Рабочие нагрузки в области ИИ становятся всё более гетерогенными, но большая часть инфраструктуры по-прежнему оптимизирована под один тип ускорителя», — отметил он. По его словам, если Gimlet сможет упростить разработчикам развёртывание на нескольких чипах, это обеспечит реальное повышение эффективности системы. «Успешные платформы — это те, которые разработчики могут использовать, не задумываясь об оборудовании», — считает Кимбалл. Компании планируют предоставить своё объединённое решение отдельным клиентам в рамках Gimlet Cloud во II половине 2026 года. Data Center Knowledge отметил, что это также подчёркивает более широкую тенденцию в инфраструктуре ИИ: гетерогенные системы, вероятно, будут доминировать на следующем этапе развёртывания ИИ, и успех будет зависеть как от оркестрации ПО, так и от производительности оборудования. NVIDIA тоже добавил к своим GPU Rubin новые ASIC Groq.

16.03.2026 [10:00], Сергей Карасёв

Selectel впервые проведет ежегодную конференцию MLечный путь в МосквеSelectel, крупнейший независимый провайдер сервисов IT-инфраструктуры в России, проведёт конференцию MLечный путь 22 апреля на площадке Connect Space в Москве. Мероприятие будет посвящено практическим кейсам, архитектурным решениям, а также экономическим аспектам внедрения и управления ИИ-проектами в бизнесе. MLечный путь — это ежегодная конференция компании Selectel, посвященная использованию искусственного интеллекта для решения бизнес-задач. Она объединяет специалистов, принимающих решения об использовании ИИ в корпоративной среде, а также инженеров, отвечающих за техническую реализацию и интеграцию моделей в IT-инфраструктуру. Мероприятие будет разделено на два параллельных направления: бизнес-трек и технический трек. В центре внимания первого трека – внедрение ИИ в бизнес-процессы и получение измеримого эффекта. Второй трек будет посвящён техническим особенностям интеграции ИИ в IT-инфраструктуру. Бизнес-трек будет интересен руководителям (CEO, СIO, CTO), аналитикам и специалистам по стратегическому внедрению ИИ. Эксперты Selectel и приглашенные спикеры расскажут о том, как в компаниях формируются решения по внедрению ИИ: сколько стоит внедрение ИИ-агентов и какие подводные камни есть в этом процессе, как составить роадмап внедрения ИИ на базе платформенных решений, а также как оптимизировать обмен знаниями в компании с помощью LLM. Технический трек ориентирован на инженеров, архитекторов и специалистов по DevOps. В программу включено обсуждение выбора серверного железа под разные ИИ-нагрузки, а также тема безопасного использования генеративных технологий. Дополнительно будет организована дискуссия о том, способен ли вайбкодинг заменить классические инструменты разработки. На площадке конференции гостей ожидает технологическая выставка с уникальными стендами и интерактивными зонами для знакомства с продуктами Selectel и партнёрами компании. Также будет организована онлайн-трансляция мероприятия. Более подробная программа — на странице мероприятия. Участие бесплатное, необходима предварительная регистрация на сайте конференции.

15.03.2026 [22:34], Владимир Мироненко

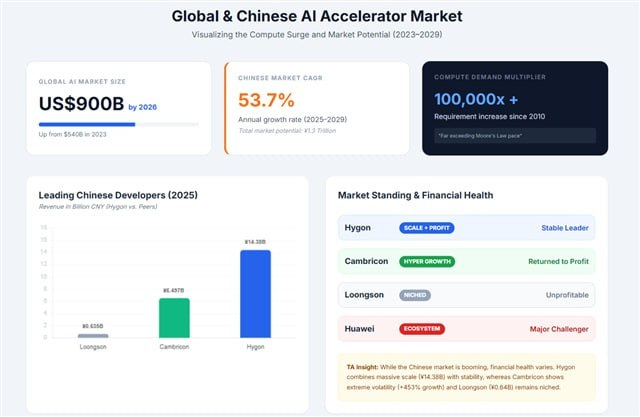

Сделка с AMD десятилетней давности и развитие ИИ-ускорителей помогли китайской Hygon нарастить выручкуКитайская компания Hygon Information Technology, специализирующаяся на выпуске ускорителей и процессоров, опубликовала финансовые результаты за 2025 год. Выручка компании составила ¥14,38 млрд (около $2,1 млрд), что на 56,91 % больше, чем годом ранее, а чистая прибыль выросла на 31,66 % до ¥2,54 млрд (около $0,4 млрд). Впервые в истории компании её выручка за год превысила ¥10 млрд, сообщил ресурс Digitimes. Hygon объяснила значительный рост продаж «продолжающимся ростом спроса на high-end чипы отечественного производства», пишет ресурс South China Morning Post. Компания заявила, что ее рыночная доля в сегменте высокопроизводительных процессоров расширилась благодаря сотрудничеству с производителями оригинального оборудования и другими партнёрами в ключевых отраслях и сферах. В I квартале 2026 года Hygon прогнозирует выручку в размере ¥3,91–4,22 млрд ($0,57–$0,61 млрд), что на 62,91–75,82 % больше по сравнению с аналогичным периодом прошлого года, а чистая прибыль, как ожидается, вырастет на 22,56–42,32 %. Ожидается, что скорректированная чистая прибыль за I квартал 2026 года вырастет на 63–82 % в годовом исчислении. Как отметил Digitimes, рост ИИ-рынка подтолкнул спрос на вычислительные ресурсы к беспрецедентным уровням. В период с 2010 по 2023 год глобальные потребности в вычислительных ресурсах ИИ увеличились в сотни тысяч раз, значительно превысив темпы согласно закону Мура. Глобальный ИИ-рынок быстро расширяется, достигнув $540 млрд в 2023 году и, по прогнозам, вырастет до $900 млрд к 2026 году. Внутренний рынок ускорителей ИИ в Китае вступает в фазу высокого роста. Согласно прогнозам отрасли, рынок ИИ-чипов может превысить в период с 2025 по 2029 год ¥1,3 трлн ($188,5 млрд) при среднегодовом темпе роста в 53,7 %. Финансовые показатели компаний в этом секторе Китая сильно различаются. Loongson сообщила о выручке в 2025 году в размере ¥635 млн ($92 млн, рост год к году на 25,99 %), оставаясь при этом убыточной. Компания Cambricon получила выручку в размере ¥6,497 млрд ($0,94 млрд), что на 453 % больше год к году и вернулась к прибыльности с чистой прибылью в ¥2,059 млрд ($0,3 млрд). Конкурентные позиции Hygon основаны на двух факторах: доступе к архитектуре x86, полученном в 2016 году благодаря соглашению о совместном предприятии и технологиях с AMD, а также собственным разработкам ускорителей. Архитектура x86 по-прежнему составляет примерно 85 % мировых серверных CPU по состоянию на 2024 год. Доступ к ISA позволяет поддерживать совместимость с существующими программными экосистемами, снижая затраты на миграцию и упрощая внедрение в корпоративной среде. Также Hygon вложила значительные средства в разработку DCU (Data Center Units), GPGPU-сопроцессоров для крупномасштабных параллельных рабочих нагрузок. Digitimes отметил, что высокий спрос на процессоры позволил Hygon повысить показатели прибыльности. С 2020 года по III квартал 2025 года валовая маржа Hygon выросла с 50,5 до 60,1 %, превзойдя показатели отечественных конкурентов, включая Loongson и Cambricon. При этом с 2021 года ежегодные инвестиции Hygon в НИОКР выросли более чем на 30 % в годовом исчислении, достигнув почти ¥3 млрд ($0,43 млрд) за 9 месяцев 2025 года. В 2025 году чистая прибыль компании росла медленнее, чем выручка, из-за более высокой интенсивности НИОКР и стимулирования инженерных кадров выделением акций. В течение первых трёх кварталов 2025 года чистый операционный денежный поток вырос на 465,64 % год к году до ¥2,26 млрд ($0,33 млрд), что улучшило возможности компании по финансированию исследований и разработки чипов. К концу III квартала 2025 года обязательства Hygon по контрактам достигли ¥2,8 млрд ($0,41 млрд). В марте Hygon объявила о том, что её ускорители DCU будут проходить тестирование в Шанхайской лаборатории ИИ, которая сосредоточится на гибридном планировании и совместном инференсе. Эта инициатива основана на разработанной в лаборатории гетерогенной вычислительной платформе DeepLink, которая позволяет выполнять смешанные задачи инференса на разных китайских ИИ-чипах, включая Huawei Ascend, MetaX, T-Head Semiconductor и Biren. В случае успеха различные китайские ускорители можно будет использовать в рамках общих вычислительных кластеров, смещая отрасль от изолированных аппаратных хранилищ к скоординированным вычислительным архитектурам. Ещё одним фактором роста спроса на вычислительную инфраструктуру Hygon может стать расширение использования ИИ-агентов. По оценкам экспертов отрасли, выполнение задач ИИ-помощниками может расти более чем на 500 % в год в период с 2025 по 2030 год, а потребление токенов может увеличиться более чем на 3000 %.

15.03.2026 [11:46], Руслан Авдеев

Microsoft ведёт переговоры об аренде мощностей в техасском кампусе Stargate на сотни мегаваттПо данным The Information, компания Microsoft ведёт переговоры об аренде сотен мегаватт мощностей дата-центров во флагманском кампусе проекта Stargate в Абилине (Техас). Некоторые резиденты площадки готовы отказаться от планов расширения бизнеса, поэтому предложение IT-гиганта может оказаться весьма кстати. Кампус строит компания Crusoe на территории Clean Campus, принадлежащей Lancium. Именно здесь располагается флагманская площадка Stargate — первые ЦОД совместного предприятия стоимостью $500 млрд, представленного в 2025 году. Дата-центры уже работают и управляются Oracle в интересах OpenAI. Два здания ввели в эксплуатацию в сентябре 2025 года, ещё шесть должны заработать в 2026-м. Совокупная мощность кампуса должна достичь 1,2 ГВт. Ранее предполагалось, что Oracle и OpenAI расширят площадку до 2 ГВт, однако от этих планов решили отказаться, в том числе из-за финансовых ограничений. Кроме того, OpenAI регулярно пересматривает прогнозы спроса и собственное видение развития проекта Stargate. Ожидается, что дополнительные мощности компании получат на других площадках. Полноценное электроснабжение кампуса в Абилине, по всей видимости, станет доступно лишь примерно через год. К тому времени OpenAI рассчитывает использовать ускорители NVIDIA Vera Rubin вместо Blackwell, которые планируется установить в Абилине, поэтому планы по развитию площадки были скорректированы. По информации The Information, переговоры Microsoft об аренде мощностей находятся на продвинутой стадии.

Источник изображения: Crusoe Microsoft в целом быстро наращивает инфраструктуру дата-центров. В последнем финансовом отчёте компания сообщила, что только за последний квартал ввела в эксплуатацию около 1 ГВт мощностей. Всего за 2025 год инфраструктура выросла примерно на 2 ГВт. Капитальные затраты за квартал также достигли рекордных $37,5 млрд, хотя вряд ли компания продолжит увеличивать инвестиции такими же темпами. Помимо Microsoft, переговоры о размещении в кампусе Stargate, по данным источников, ведёт и Meta✴. Потенциальные соглашения могут предусматривать использование в общей сложности около 600 МВт с поэтапным вводом мощностей. По слухам, NVIDIA уже выплатила Crusoe депозит в размере $150 млн, чтобы зарезервировать мощности после того, как Oracle отказалась от первоначальных планов расширения. Компания рассчитывает, что в дата-центрах кампуса будет использоваться именно её оборудование, а не решения конкурентов. |

|