Материалы по тегу: nvidia

|

10.10.2025 [15:25], Владимир Мироненко

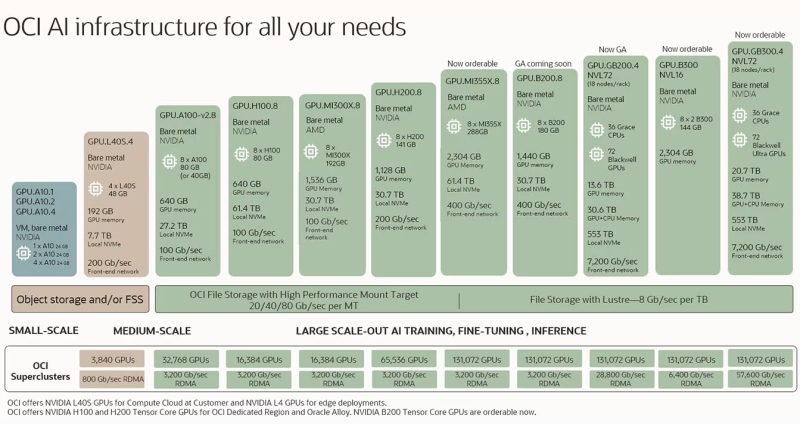

Бизнес Oracle по сдаче в аренду ИИ-мощностей оказался не таким прибыльным, как ожидалосьБизнес Oracle по сдаче в аренду ИИ-серверов оказался гораздо менее прибыльным, чем ранее прогнозировали фондовые аналитики, сообщил ресурс The Information после ознакомления со внутренними документами компании, о чём пишет DataCenter Dynamics. Средняя валовая рентабельность Oracle по сделкам с такими компаниями, как OpenAI, составила всего лишь 16 %, хотя выручка за последний год утроилась. Что касается новейших ускорителей NVIDIA, то компания терпит убытки, составившие почти $100 млн от сдачи в аренду чипов Blackwell за I квартал 2026 финансового года, закончившийся в августе. По данным The Information, за последний квартал Oracle выручила $900 млн от сдачи в аренду ИИ-серверов, получив валовую прибыль в размере $125 млн, или 14 центов на каждый доллар продаж. Компания не раскрывает финансовые показатели по использованию ИИ-серверов. На рентабельность влияют различные факторы, включая зарплату, стоимость электроэнергии и другие эксплуатационные расходы ЦОД Oracle, а также амортизационные расходы на оборудование. Кроме того, существует разрыв во времени между покупкой чипов и началом их использования клиентами. Oracle сообщила, что на конец I квартала 2026 финансового года благодаря подписанию многомиллиардных контрактов с тремя клиентами объём оставшихся обязательств по контрактам (RPO) составил более $455 млн. Позже выяснилось, что был заключён контракт с OpenAI на $300 млрд. Аналитики полагают, что для финансирования этой сделки Oracle может потребоваться привлечь до $100 млрд заёмных средств в течение следующих четырёх лет для наращивания мощностей. В прошлом месяце Oracle продала серию облигаций инвестиционного уровня на сумму $18 млрд для расширения бизнеса и строительства ИИ-инфраструктуры. Следует отметить, что речь идёт лишь о части бизнес-предложения Oracle. Как полагает The Information, если доля аренды ИИ-серверов в общем объёме бизнеса Oracle продолжит расти, общая валовая рентабельность снизится с нынешних 70 %. Ресурс предупредил, что это затронет всех основных провайдеров облачных услуг, поскольку ИИ-серверы на чипах NVIDIA значительно дороже традиционных серверов и их использование требует дополнительных расходов, в том числе на специализированное сетевое оборудование и электроэнергию. Чтобы привлечь клиентов, поставщики облачных услуг предлагают скидки, что также отражается на прибыльности бизнеса. The Information назвал такую ситуацию плохой новостью для Oracle, но не все эксперты разделяют это мнение. По мнению ряда аналитиков, рентабельность вполне соответствует ожиданиям. Например, согласно отчёту Investor's Business Daily, аналитик Stifel Брэд Рибак (Brad Reback) ранее прогнозировал валовую рентабельность облачного бизнеса Oracle примерно в 16 %. Он также указал в аналитической записке для инвесторов, что «по мере масштабирования этого сегмента OCI валовая рентабельность должна существенно вырасти». Аналитик Guggenheim Джон ДиФуччи (John DiFucci) тоже считает, что вышеупомянутый разрыв между вводом мощностей в эксплуатацию и оплатой клиентами не следует воспринимать как дурное предзнаменование. «Мы не удивимся, если увидим более низкую валовую рентабельность в начале сделки по обучению ИИ до начала получения дохода, но мы считаем разумным ожидать, что любая сделка будет обеспечивать не менее 25 % валовой рентабельности в течение всего срока её действия — иначе Oracle её не подпишет», — заявил ДиФуччи. Следует также учесть мнение NVIDIA по этому поводу, генеральный директор которой Дженсен Хуанг (Jensen Huang) отверг критику финансового положения Oracle, заявив, что компания «будет невероятно успешна». «Когда вы только начинаете внедрять новую технологию, вполне вероятно, что поначалу вы можете не заработать, но со временем система станет невероятно прибыльной», — сказал Хуанг.

10.10.2025 [14:50], Руслан Авдеев

Не для себя стараемся: Microsoft развернула для OpenAI первый в мире ИИ-кластер на базе суперускорителей NVIDIA GB300 NVL72Microsoft представила первый в мире ИИ-кластер, использующий более 4,6 тыс. NVIDIA Blackwell Ultra в составе суперускорителей NVIDIA GB300 NVL72, объединённых интерконнектом Quantum-X800 InfiniBand. Этот кластер — лишь первый из многих. Компания развернёт сотни тысяч ускорителей Blackwell Ultra в ИИ ЦОД по всему миру. Благодаря им Microsoft намерена стать первой, поддерживающей обучение для моделей с сотнями триллионов параметров. Как сообщают в Microsoft, запуск в Microsoft Azure суперкластера NVIDIA GB300 NVL72 стал важным шагом в развитии передовых ИИ-технологий. Разработанная совместно с NVIDIA система представляет собой первый в мире масштабируемый ИИ-кластер на основе GB300, обеспечивающий вычислительные мощности, необходимые OpenAI для обслуживания моделей с триллионами параметров. Речь идёт о новом стандарте ускоренных вычислений, говорят компании. Новые инстансы Azure ND GB300 v6 оптимизированы для рассуждающих моделей, агентных систем и мультимодального генеративного ИИ. Каждая стойка GB300 NVL72 обслуживает 18 виртуальных машин, а сам суперускоритель с производительностью до 1,44 Эфлопс (FP4 Tensor Core) включает:

Источник изображения: Microsoft Создание передовой инфраструктуры требует переосмысления всех уровней системы, включая вычисления, память, системы охлаждения и питания, ЦОД в целом как единой структуры. Новая архитектура стоек обеспечивает высокую пропускную способность инференса при меньших задержках на крупных моделях, это позволяет агентным и мультимодальным ИИ-системам быть более масштабируемыми и эффективными, чем когда-либо, говорит компания. Для масштабирования за пределы стойки используется NVIDIA Quantum-X800 InfiniBand, что гарантирует обучения сверхбольших моделей с применением десятков тысяч ИИ-ускорителей с минимальными накладными расходами на их синхронизацию, что дополнительно повышает производительность.

Источник изображения: Microsoft Передовые системы охлаждения Azure используют автономные теплообменники, чтобы свести к минимуму расход воды и поддерживать температурную стабильность для высокоплотных кластеров. Также продолжается разработка и внедрение новых моделей распределения питания, обеспечивающих высокую энергетическую плотность и динамический баланс нагрузок. Дополнительную помощь в оптимизации работы оказывает и модернизированное программное обеспечение. Ранее Microsoft обладала эксклюзивными правами на предоставление облачных сервисов компании OpenAI, но в январе 2025 года появилась новость, что ИИ-стартапу разрешили пользоваться и облаками других провайдеров, если у Microsoft не хватит собственных мощностей. Разногласия между компаниями продолжают нарастать. Формально первенство по создание кластера на базе GB300 NVL72 принадлежит CoreWeave, имеющей тесные отношения с NVIDIA и обслуживающей OpenAI — как напрямую, так и при посредничестве Microsoft.

09.10.2025 [13:10], Руслан Авдеев

Huawei попыталась продать свои ИИ-чипы Ascend в ОАЭ, пока США тянули с поставками ускорителей NVIDIA на Ближний ВостокВласти США, наконец, одобрили экспорт ИИ-чипов NVIDIA в Объединённые Арабские Эмираты (ОАЭ) на сумму в несколько миллиардов долларов. Это первый шаг на пути реализации двухсторонней сделки, которую американские чиновники могут взять за образец при организации экспорта ИИ-технологий в другие страны, сообщает Bloomberg. По словам источников издания, Министерство торговли США недавно выдало экспортные лицензии NVIDIA в соответствии с двусторонним соглашением по ИИ, анонсированным США и ОАЭ в мае. Разрешение на экспорт получено после того, как ОАЭ объявили о конкретных планах инвестиций на территории США. Речь идёт об ощутимом прогрессе в реализации соглашения, о котором было объявлено около пяти месяцев назад — оно касалось строительства кампуса ЦОД на 5 ГВт в ОАЭ, одним из арендаторов которого должна стать OpenAI. Некоторые политические фигуры в Вашингтоне усомнились в целесообразности реализации столь крупного ИИ-проекта за пределами США, особенно в регионе, имеющего тесные связи с Пекином. Получение разрешений на покупку чипов является одним из приоритетов для ОАЭ, многие чиновники страны недовольны темпами одобрения американского экспорта. Развитие ИИ является одним из ключевых интересов ближневосточной страны, вкладывающей огромные средства в инфраструктуру как на своей территории, так и за рубежом. По данным Bloomberg, в основе сделки — обещание ОАЭ инвестировать $1,4 трлн в США в следующие десять лет. Тем временем Вашингтон планировал ежегодно одобрять поставки в ОАЭ до 500 тыс. американских ИИ-ускорителей, каждый пятый из которых предназначался для ЦОД гиганта G42 из Абу-Даби. Правда, источники утверждают, что первая партия для G42, имеющей партнёрские отношения с OpenAI, не предназначена. Источники не сообщают, когда будут выданы дополнительные экспортные лицензии, отчасти это будет зависеть от реальных инвестиций ОАЭ. Страна предполагает вкладывать в экономику США ту же сумму, на которую США разрешать поставлять чипы (будут оплачиваться отдельно). На днях сообщалось, что задержки с одобрение поставок ускорителей в Объединённые Арабские Эмираты «расстраивают» NVIDIA и реализация сделки между странами фактически заморожена. В Персидском заливе большой спрос на ИИ и достаточно средств на их оплату, что делает регион одним из важнейших рынков для соответствующих технологий в перспективе для гигантов вроде NVIDIA и OpenAI. ОАЭ и Саудовская Аравия с 2023 года страдают от введённых США ограничений на поставку им ИИ-ускорителей. Вашингтон опасается, что технологии могут быть перенаправлены в Китай, экспорт в который строго ограничен. Ранее американские власти практически остановили утверждение экспортных лицензий, ограничив экспорт, в числе прочего, и в ОАЭ. Новая администрация уже меняет ситуацию. По некоторым данным, к концу прошлого года США выдали несколько лицензий для Эмиратов, а G42 заключила партнёрство с Microsoft, во многом основанное на обещание эмиратской компании разорвать связи с Huawei. ЦОД в Абу-Даби будет лишь одним из проектов, в ходе реализации которых планируется вытеснить Китай, также располагающий ИИ-технологиями, с Ближнего Востока.

Источник изображения: ZQ Lee/unspalsh.com В июле сообщалось, что Huawei пыталась привлечь клиентов в ОАЭ, предложив потенциальным покупателям тысячи ИИ-ускорителей Ascend 910B и удалённый доступ к более современным моделям, размещённым на территории КНР. Правда, усилия китайского бизнеса не увенчались успехом. Некоторые чиновники из США считают, что столь скромное предложение свидетельствует об ограниченных возможностях Китая для соперничества. До поездки Трампа на Ближний Восток ранее в этом году США планировали ежегодно одобрять поставку в регион около 100 тыс. ускорителей в год, но теперь речь идёт о 500 тыс. Некоторые чиновники считают, что майское соглашение не содержало подробно прописанного механизма обеспечения безопасности поставок ИИ-чипов в регионы, связанные с Пекином. Впрочем, администрация США заявляет, что подавляющее большинство передовых чипов в ОАЭ будет принадлежать американским компаниям и управляться ими же, местная G42 получит лишь 20 % от общего объёма поставок. Впрочем, когда именно эта и другие компании смогут покупать ускорители и на каких условиях, ещё неизвестно. В своё время министр торговли США Говард Лютник (Hovard Lutnik) заявлял, что союзники смогут покупать чипы при условии, что те будут использоваться аккредитованным американским оператором ЦОД, а облако, подключенное к этому дата-центру, будет также принадлежать аккредитованному американскому оператору.

08.10.2025 [23:55], Владимир Мироненко

xAI привлёк $20 млрд на покупку ускорителей NVIDIA для Colossus 2 — $2 млрд инвестировала сама NVIDIAxAI, ИИ-стартап Илона Маска (Elon Musk) проводит раунд финансирования, в рамках которого ему удалось привлечь гораздо больше средств, чем изначально планировалось — около $20 млрд, сообщил Bloomberg со ссылкой на информированные источники. В раунде также приняла участие NVIDIA, инвестировавшая $2 млрд в виде акций. Полученные инвестиции в виде акционерного капитала примерно на $7,5 млрд и заёмных средств на $12,5 млрд будут использованы на приобретение ускорителей NVIDIA для строящегося кластера Colossus 2. Для сделки по приобретению будет создана специализированная фирма, которая предоставит купленные чипы стартапу xAI в аренду на пять лет. Такая форма сделки позволяет институциональным инвесторам возмещать свои инвестиции за счёт аренды чипов, при этом долг будет обеспечен в виде залога ускорителями, а не более широкими активами xAI. Аналогичную схему использует и CoreWeave.

Источник изображения: xAI По данным источников, в привлечении заёмных средств участвуют Apollo Global Management и Diameter Capital Partners, а Valor Capital возглавляет часть сделки, посвящённую привлечению акционерного капитала. Ранее Bloomberg сообщал о планах xAI привлечь около $10 млрд инвестиций. Ресурс не исключает, что стартапу удастся получить даже больше, чем $20 млрд, поскольку сбор средств продолжается. В NVIDIA заявили, что будут использовать растущую финансовую мощь компании для ускорения внедрения ИИ в отрасли. В сентябре финансовый директор NVIDIA Колетт Кресс (Colette Kress) сообщила на конференции Goldman Sachs, что компания будет и дальше совершать стратегические приобретения и выкупать акции, но приоритетом останется использование денежных средств, чтобы помочь другим компаниям быстрее внедрять ИИ.

07.10.2025 [14:43], Владимир Мироненко

xAI потратит $18 млрд на ускорители NVIDIA для ИИ-кластера Colossus 2Появились новые подробности о ЦОД Colossus 2, строительство которого невдалеке от Мемфиса xAI начала в марте этого года. Согласно данным Wall Street Journal, для обеспечения его функционирования xAI приобретет у NVIDIA 300 тыс. ускорителей на сумму как минимум $18 млрд без учёта расходов на сопутствующее оборудование (серверы и т.д.). В июле основатель xAI Илон Маск (Elon Musk) заявил, что Colossus 2 будет включать 550 тыс. чипов, а также дал понять, что в конечном итоге их количество может быть увеличено до 1 млн. В прошлом году компания открыла свой первый ИИ-кластер Colossus 1 в Мемфисе на месте бывшего завода бытовой техники Electrolux. Для обеспечения ЦОД Colossus 2 площадью 92,9 тыс. м2 электроэнергией xAI построит новую электростанцию в Миссисипи мощностью более 1 ГВт, использующую газовые турбины. Этого объёма достаточно для обеспечения почти 1 млн домохозяйств. Как сообщает WSJ, Colossus 1 и Colossus 2 будут потреблять электроэнергии больше, чем всё население Мемфиса. Согласно нормативным документам, копии которых имеются у WSJ, компания планирует проложить линии электропередачи от электростанции к кампусу Colossus 2. Это подразумевает, что в рамках проекта xAI также построит подстанции. Сообщается, что системам охлаждения ЦОД потребуются тысячи кубометров питьевой воды ежедневно. В феврале xAI объявила о планах строительства очистных сооружений в рамках мер по снижению воздействия объекта на окружающую среду. Установка стоимостью $80 млн позволит компании повторно использовать около 49,2 тыс. м3 сточных вод в день. Для финансирования расширения инфраструктуры компании, видимо, понадобятся дополнительные средства. xAI недавно сообщила кредиторам, что в этом году ожидает убытки в размере $13 млрд. В июле появились слухи о том, что компания планирует привлечь дополнительный капитал при оценке её рыночной стоимости в пределах от $170 до $200 млрд.

06.10.2025 [14:00], Сергей Карасёв

HP представила компактный «ИИ-суперкомпьютер» ZGX Nano G1n AI Station на основе NVIDIA GB10Компания HP анонсировала рабочую станцию ZGX Nano G1n AI Station небольшого форм-фактора, предназначенную для работы с ИИ, включая «тонкую» настройку языковых моделей, инференс и агентные приложения. Основой новинки служит суперчип NVIDIA GB10 Grace Blackwell. В целом решение практически не отличается от систем на базе GB10 других вендоров. Устройство заключено в корпус с габаритами 150 × 150 × 51 мм, а масса составляет 1,25 кг. В состав чипа GB10 входят 20-ядерный процессор Grace (10 × Arm Cortex-X925 и 10 × Arm Cortex-A725) и ускоритель Blackwell. Имеется 128 Гбайт унифицированной системной памяти LPDDR5x, пропускная способность которой достигает 273 Гбайт/с. Компьютер может быть оборудован SSD типоразмера M.2 вместимостью 1 или 4 Тбайт (NVMe OPAL). В оснащение входят сетевой контроллер 10GbE (Realtek RTL8127), адаптер NVIDIA ConnectX-7 200GbE, беспроводной модуль MediaTek MT7925 с поддержкой Wi-Fi 7 (2×2) / Bluetooth 5.4. В тыльной части корпуса располагаются разъём USB Type-C для подачи питания, три порта USB Type-C (20 Гбит/с), гнездо RJ45 (10GbE), два порта QSFP и интерфейс HDMI 2.1a.

Источник изображения: HP На устройстве применяется программная платформа NVIDIA DGX OS на базе Ubuntu, оптимизированная специально для задач ИИ. Заявленная производительность достигает 1000 TOPS на операциях FP4. Возможна работа с ИИ-моделями, насчитывающими до 200 млрд параметров. Кроме того, два экземпляра ZGX Nano G1n AI Station могут быть объединены в одну систему, что позволит использовать ИИ-модели, оперирующие 405 млрд параметров. Продажи компактного ИИ-суперкомпьютера начнутся текущей осенью.

04.10.2025 [12:56], Сергей Карасёв

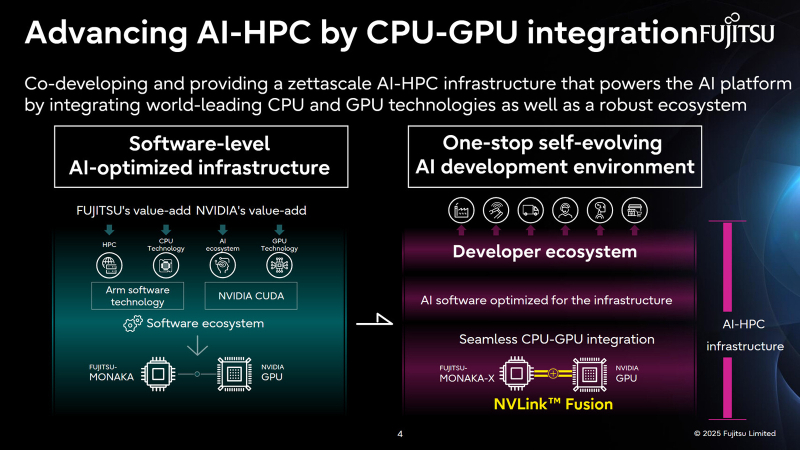

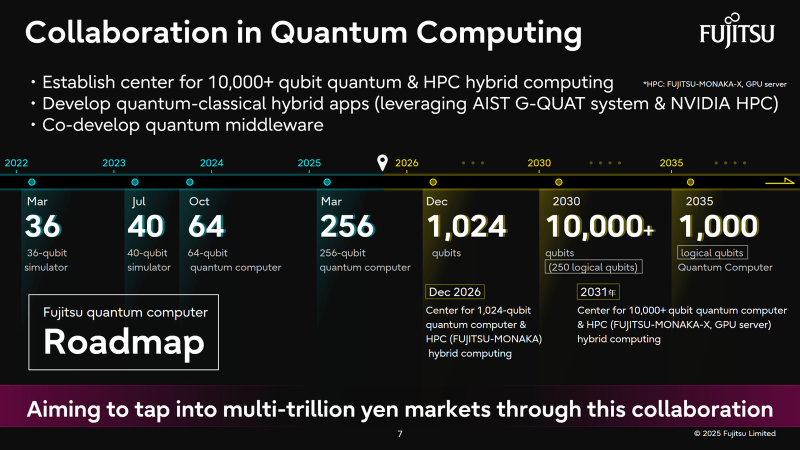

Fujitsu и NVIDIA создадут вычислительную ИИ-инфраструктуру нового поколенияЯпонская корпорация Fujitsu объявила о расширении стратегического сотрудничества с NVIDIA с целью создания полнофункциональной инфраструктуры ИИ следующего поколения, в состав которой войдут ИИ-агенты. Предполагается, что инициатива поможет ускорить развитие таких отраслей, как здравоохранение, производство, робототехника и др. Партнёры намерены работать по ряду направлений. В частности, Fujitsu и NVIDIA займутся созданием передовой вычислительной инфраструктуры для задач ИИ. Речь идёт об объединении серверных процессоров Fujitsu Monaka на архитектуре Arm с высокопроизводительными GPU разработки NVIDIA. Для этого будет задействована технология NVLink Fusion, позволяющая применять скоростные интерконнекты NVLink со сторонними чипами. Конечной целью является предоставление комплексной экосистемы HPC-ИИ с интегрированным софтом Fujitsu для Arm-процессоров и NVIDIA CUDA. Кроме того, сотрудничество предусматривает создание «саморазвивающейся» платформы ИИ-агентов. Она, как ожидается, обеспечит высокую производительность и безопасность. Планируется внедрение механизма, который позволит агентам и моделям ИИ развиваться автономно с возможностью оптимизации под запросы конкретных отраслей. В конечном итоге, такие агенты будут предоставляться заказчикам в виде микросервисов NVIDIA NIM. Ещё одним направлением сотрудничества названо формирование партнёрской экосистемы для расширения использования агентов и моделей ИИ. Планируется также разработка передовых квантовых технологий, включая гибридные квантово-классические вычислительные системы на основе чипов Monaka и НРС-решений NVIDIA. В целом, как отмечается, к 2030 году спрос на вычислительные мощности для ИИ в Японии вырастет в 320 раз по сравнению с 2020-м. На этом фоне местные компании, включая Fujitsu, SoftBank и KDDI, активно реализуют различные проекты, направленные на развитие рынка ИИ.

03.10.2025 [15:57], Руслан Авдеев

Задержки поставок ИИ-чипов в ОАЭ на десятки миллиардов долларов расстраивают NVIDIAСпустя пять месяцев после заключения многомиллиардной сделки по поставке ИИ-ускорителей в ОАЭ, процесс её реализации фактически заморожен. Это обескураживает как главу NVIDIA Дженсена Хуанга (Jensen Huang), так и некоторых чиновников из Белого дома, сообщает The Wall Street Journal. В рамках сделки, анонсированной в мае, ОАЭ пообещали инвестировать в США большие средства в обмен на обещание поставок сотен тысяч ИИ-ускорителей ежегодно. Однако спустя месяцы после переговоров инвестиции так и не стартовали. Будущее соглашения сейчас в руках министра торговли США Говарда Лютника (Howard Lutnick), в своё время поддержавшего сделку. Разрешение Министерства торговли имеет критическое значение, поскольку именно оно должно дать NVIDIA и другим производителям право на поставку ИИ-чипов в ОАЭ. По некоторым данным, министр оказывает давление на Эмираты, чтобы те, наконец, вложили в экономику США обещанные средства — иначе судьба поставок ускорителей в страну окажется под вопросом. Президент США Дональд Трамп (Donald Trump) одобрил сделку с ОАЭ в ходе майского турне, в надежде продвинуть собственные ИИ-технологии вместо китайских. На тот момент было заявлено, что Белый дом подготовил сделки с ОАЭ на сумму $200 млрд, включая соглашение о помощи в развитии американских технологий и производства. Результаты переговоров имеют немалое значение для Лютника, поскольку того и так критикуют за введение высоких импортных пошлин и платы $100 тыс. за визу H-1B, по которой в США въезжали попадали многие технические специалисты. Давление оказывает и NVIDIA, которая крайне заинтересована в расширении поставок. Хуанг и его соратники неоднократно жаловались на политику Лютника и медленный прогресс в одобрении экспорта. Правда, точных данных о том, что именно он заморозил поставки, пока нет. В ОАЭ придерживаются позиции, что в ответ на миллиардные инвестиции в страну должны поставлять ускорители NVIDIA на миллиарды долларов. По данным чиновников, как минимум $1 млрд будет вложен в США в обмен на поставки чипов на $1 млрд к концу года. По некоторым сведениям, за чипы ОАЭ будет расплачиваться отдельно и без учёта инвестиций. ОАЭ демонстрирует приверженность идее инвестиций в американские ЦОД и даже вели дела с представителями семьи самого Трампа. Что касается инвестиций, США стремятся поощрять вложения в американскую экономику не только со стороны Эмиратов. Так, недавно была заключена сделка с Японией, которая обязалась инвестировать в США $550 млрд, в специальный фонд поднадзорный министру торговли. Тем временем NVIDIA стремится добиться экспортных лицензий на поставку чипов и в Китай. В своё время у производителей потребовали отчислять 15 % от выручки за поставки в эту страну урезанных версий ускорителей. В рамках соглашения с ОАЭ, большинство чипов в страну будет поставляться представительствам американских компаний. Некоторые чиновники бьют тревогу в связи с участием в сделке G42 из Абу-Даби. Есть опасения, что прямые поставки чипов ей приведут к перепродаже их в Китай, с которым у компании были довольно тесные связи. Пока Министерство торговли не планирует поставок G42, но это не исключено в будущем.

02.10.2025 [21:02], Владимир Мироненко

Microsoft потратит $33 млрд на доступ к 100+ тыс. NVIDIA GB300 в неооблаках, но со временем хочет перейти на свои ИИ-ускорителиВ Сети появились новые подробности о сделке стоимостью до $19,4 млрд, заключённой Microsoft с Nebius Group NV в начале сентября. Как сообщает Bloomberg со ссылкой на информированные источники, Microsoft получит пятилетний доступ к выделенной инфраструктуре на базе более чем 100 тыс. суперускорителей NVIDIA GB300. Ранее сообщалось, что речь идёт о мощностях нового ЦОД Nebius в Вайнленде (Нью-Джерси, США). Как пишет Forbes, Nebius отличается от многих облачных провайдеров тем, что фокусируется только на рабочих нагрузках ИИ и МО, что позволяет лучше оптимизировать архитектуру ЦОД в отличие от гиперскейлеров, которые занимаются решением множества задач. Кроме того, Nebius отличается от других неооблаков, таких как CoreWeave, тем, что предоставляет инструменты и сервисы для разработчиков, которые позволяют совершенствовать ИИ-модели, выполнять инференс и разрабатывать кастомные решения, а не просто фокусируется на «чистой» вычислительной мощности. При этом Nebius начала наращивать вычислительные мощности ещё до того, как возник спрос на эти ресурсы, отметил Forbes. Подобные контракты Microsoft заключила с ещё несколькими неооблаками (neocloud), включая CoreWeave, Nscale и Lambda, на общую сумму в $33 млрд, и они обеспечивают её большую выгоду. Вместо того, чтобы тратить огромные ресурсы на строительство собственных ЦОД, Microsoft обращается к проверенному поставщику ИИ-инфраструктуры, благодаря чему может быстрее совершенствовать свою ИИ-инфраструктуру с меньшими первоначальными затратами, используя высвободившиеся мощности для предоставления клиентам прибыльных услуг на базе ИИ. Вдобавок такой подход позволяет Microsoft быстрее менять стратегию, чем при использовании собственных дата-центров. В начале бума ИИ Microsoft арендовала мощности даже у Oracle, своего прямого конкурента, для поддержки ИИ-функций в поиске Bing. Эти сделки также устраняют для Microsoft значительную часть финансовых рисков, связанных со строительством собственных ЦОД. Она не только сразу получает необходимые мощности для своих ИИ-сервисов, вместо того чтобы тратить годы на строительство ЦОД, но и перекладывает на других вопросы строительства, финансирования и управление этими ЦОД, что даёт компании большую финансовую гибкость. Так, Microsoft может отнести некоторые затраты к операционным, а не капитальным, что, по словам аналитика Bernstein Марка Мёрдлера (Mark Moerdler), даёт потенциальные преимущества для денежного потока, налогообложения и способа представления прибыли в финотчётах. Компания использует серверы неооблаков не только для обучения ИИ-моделей, но и для сложного инференса. Сделки с неооблаками становятся популярными и у конкурентов Microsoft, хотя им далеко до её масштабов. В мае 2025 года OpenAI расширила с конкурирующей с Nebius компанией CoreWeave контракт стоимостью $11,9 млрд на $4 млрд, после чего заключила ещё одно соглашение на $6,5 млрд, увеличив общую сумму соглашений до $22,4 млрд. Ещё один технологический гигант Meta✴ подписал сделку с CoreWeave на сумму в $14,2 млрд, обеспечив себе доступ к её облачным ИИ-сервисов на период до 2031 года. Вместе с тем в долгосрочной перспективе Microsoft намерена переключиться на ИИ-ускорители собственной разработки, которые обеспечивают лучший показатель TCO, передаёт CNBC. Два года назад компания представила первые ИИ-чипы Maia 100. Следующее поколение этих чипов, как ожидается, появится в 2026 году. При этом компания сосредоточится не на чипах в отдельности, а будет использовать более системный подход, учитывающий вопросы охлаждения, интерконнекта и т.д. Пока что, признаёт Microsoft, в течение многих лет решения NVIDIA обеспечивали лучшее соотношение цены к производительности.

29.09.2025 [11:10], Руслан Авдеев

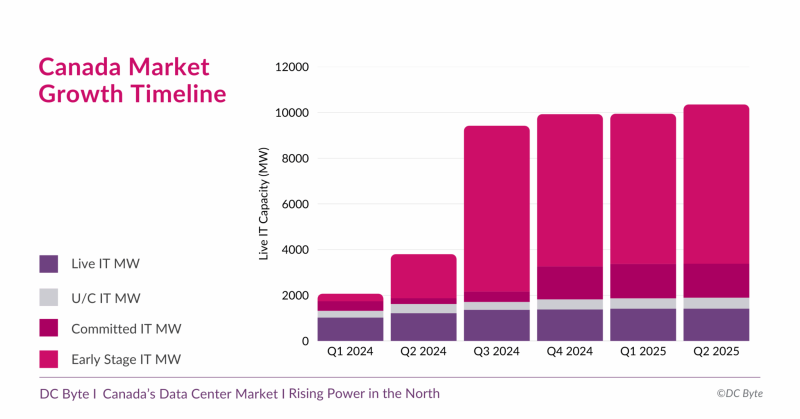

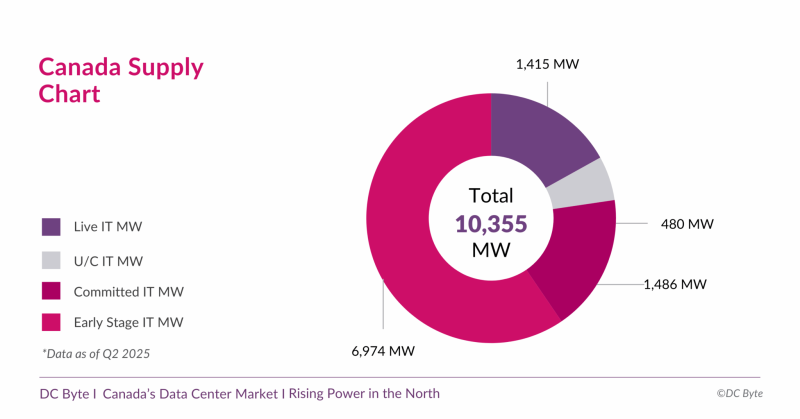

Канадский рынок дата-центров вырастет почти на порядок — до 10,3 ГВтКанада готовится к новой фазе развития рынка дата-центров. В отчёте аналитического агентства DC Byte говорится, что общая ёмкость рынка ЦОД в обозримом будущем вырастет до 10,3 ГВт с нынешних введённых в эксплуатацию 1,4 ГВт. Проекты общей мощностью 8,9 ГВт находятся на разных этапах реализации, их них 6,9 ГВт — на ранних этапах без фактического начала строительства. Во многом будущий рост объясняется серией анонсов, состоявшихся во II полугодии 2024 года. В том числе речь идёт о проекте инвестора, бизнесмена и шоумена Кевином О’Лири (Kevin O’Leary) Wonder Valley в провинции Альберта. В своё время было заявлено, что речь идёт о строительстве 55 объектов мощностью 100 МВт каждый с питанием от природного газа. Это крупнейший проект, на который приходится 5,6 ГВт от общего плана (по другим данным — 7,5 ГВт). В DC Byte отмечают, что речь идёт о новом этапе роста, связанном с бумом ИИ и ориентированных на ускорители дата-центров. Тем не менее, они должны заработать не раньше 2027 года, а пока же рынок всё ещё ориентирован на «традиционные» дата-центры, где лидируют Vantage, Cologix и Compass. 93 % IT-нагрузок ЦОД страны приходится на Торонто, Монреаль и провинцию Альберту (столица Эдмонтон). При этом в Канаде 60 % местной генерации приходится на ГЭС, т.е. «зелёную» энергетику, что при соблюдении некоторых условий, не может не привлекать глобальных игроков. Впрочем, природного газа здесь тоже хватает, и на него тоже делают ставку. Пока же местные проекты отличает скромность. Так, совокупная мощность сети ИИ ЦОД Bell AI Fabric, планируемой Bell Canada и Telus, составит 500 МВт. Впрочем, на конференции All In Canada AI Ecosystem в Монреале Канада представила стратегию развития суверенного ИИ, подчеркнув важность цифрового суверенитета и экономической независимости, и анонсировала открытие первой ИИ-фабрики Telus, построенной при поддержке NVIDIA и HPE. Фабрика обеспечивает полный цикл работы с ИИ — от обучения моделей до инференса, с хранением данных внутри страны и питанием от возобновляемой энергии на 99 %. Тогда AMD и канадская Cohere объявили о расширении сотрудничества в сфере ИИ. В частности, ключевые «безопасные» решения последней, включая Command A, Vision, Translate и North, будут доступны на ИИ-инфраструктуре на базе ускорителей Instinct. Благодаря этому корпоративные и государственные клиенты, включая канадские проекты «суверенного ИИ», получат больше возможностей выбора ИИ-инструментов. AMD станет использовать платформу Cohere North для решения собственных инженерных и бизнес-задач. |

|