Материалы по тегу: nvidia

|

28.09.2025 [12:30], Сергей Карасёв

«Зелёная» энергия для «зелёных» ускорителей: Lambda и ECL впервые запитали NVIDIA GB300 NVL72 от водородаОблачный провайдер Lambda и стартап ECL объявили о развёртывании первых в отрасли систем NVIDIA GB300 NVL72 с питанием от водорода. Высокопроизводительная платформа предназначена для обучения базовых ИИ-моделей, инференса и других ресурсоёмких задач. ECL специализируется на создании автономных модульных дата-центров с питанием от водорода, при возведении которых применяются технологии 3D-печати. Первым ЦОД компании стал объект MV1 мощностью 1 МВт на площадке в Маунтин-Вью (Калифорния, США). Кроме того, ECL заявила о намерении построить ИИ ЦОД TerraSite-TX1 мощностью 1 ГВт к востоку от Хьюстона (Техас, США). Как сообщается, системы NVIDIA GB300 NVL72 компании Lambda смонтированы на базе модульного дата-центра MV1. Эта площадка отличается нулевым потреблением воды и нулевым уровнем выбросов вредных газов в атмосферу. Питание обеспечивается исключительно от водородных топливных элементов. Развёрнутые устройства GB300 NVL72 разработаны компанией Supermicro. Они обладают мощностью 142 кВт. Для отвода тепла применяется система прямого жидкостного охлаждения, вода для которой поступает от водородных топливных элементов, на которых вырабатывается в качество побочного продукта при генерации электричества. Задействованы централизованные блоки распределения охлаждающей жидкости (CDU). Утверждается, что это первое в отрасли подобное сочетание инфраструктуры на базе ускорителей NVIDIA с водородным источником «зеленой» энергии. Отмечается, что развёртывание систем NVIDIA GB300 NVL72, масса которых составляет примерно 1800 кг, сопряжено с серьёзными трудностями. Лишь немногие дата-центры способны справиться с требованиями к плотности мощности и охлаждению. Водородные топливные элементы рассматриваются в качестве одного из наиболее перспективных способов решение проблемы питания таких объектов. При этом становится возможным устойчивое развитие облачных ИИ-платформ.

27.09.2025 [15:32], Сергей Карасёв

Майнинговая компания Iren увеличила мощность ИИ-облака, закупив тысячи ускорителей NVIDIA и AMD за $674 млнКриптомайнинговая компания Iren (ранее известная как Iris Energy), по сообщению Datacenter Dynamics, увеличила количество ИИ-ускорителей в своём облаке примерно в два раза. Стоимость приобретённого оборудования оценивается в $674 млн. Компании прочат статус серьёзного игрока на рынке неооблаков. Компания находится в процессе перехода от майнинга криптовалют к облачному бизнесу на базе ИИ. В частности, закуплены 7100 ускорителей NVIDIA B300 и 4200 изделий NVIDIA B200, а также 1100 AMD Instinct MI350X. В результате, общее количество ускорителей в составе платформы Iren достигло приблизительно 23 тыс. Новое оборудование в ближайшие месяцы будет развёрнуто в кампусе Iren в городе Принс-Джордже (Prince George) в северной части провинции Британская Колумбия в Канаде. В настоящее время на этой площадке ведётся строительство вычислительного комплекса с жидкостным охлаждением мощностью 10 МВт (ИТ-нагрузка), который сможет поддерживать более 4500 суперускорителей NVIDIA GB300. В конце августа нынешнего года Iren сообщила о приобретении 1200 ускорителей NVIDIA B300 для серверов с воздушным охлаждением и 1200 изделий NVIDIA GB300 для систем с жидкостным охлаждением: стоимость данной партии составила примерно $168 млн. Эти чипы также предназначены для ЦОД в Принс-Джордже. Тогда говорилось, что Iren привлекла финансирование в размере около $96 млн для покупки GB300: средства получены по схеме лизинга сроком на два года. В настоящее время Iren управляет пятью кампусами ЦОД общей мощностью 810 МВт, расположенными в Северной Америке: два в Техасе (США) и три в Британской Колумбии (Канада). Ещё 2,1 ГВт находятся в стадии строительства, причём 2 ГВт из них приходится на новый кампус в Техасе. Как отмечает Дэниел Робертс (Daniel Roberts), соучредитель и содиректор Iren, удвоение парка GPU позволит удовлетворить растущие потребности клиентов в масштабируемых вычислительных мощностях.

26.09.2025 [10:33], Руслан Авдеев

Media Stream AI построит в Манчестере 2-МВт ИИ ЦОД с охлаждением водой из местного каналаБританская медиакомпания Media Stream AI (MSAI) намерена открыть в Солфорде (Salford, Большой Манчестер) дата-центр в популярном «творческом» районе Media City. Объект мощностью 2 МВт будет использовать для охлаждения воду из канала Рочдейл (Rochdale), сообщает Datacenter Dynamics. Система охлаждения будет состоять из замкнутого контура с теплообменниками и драйкулеров. При поддержке Lenovo объект стоимостью £50 млн ($67,3 млн) сможет обеспечить плотность стоек на уровне 30–60 кВт при PUE менее 1,2. На площадке планируется разместить 1,1 тыс. ускорителей NVIDIA H200 в составе серверов Lenovo ThinkSystem с СЖО Neptune. В будущем возможно расширение до 2,3 тыс. ускорителей. Объект должен заработать в I квартале 2026 года. Компания намерена создать там же собственную виртуальную продакшн-студию и робототехническую лабораторию. Media Stream AI рассчитывает предоставлять ИИ-сервисы медиакомпаниям и работникам творческих профессий. На сайте стартапа объявлено, что он намерен предоставить доступ к ускорителям NVIDIA L4, A10G, A4000, A5000, A100, H100 и L40. Также компания намерена развернуть к концу 2026 года площадки в Германии и Франции. Более того, MSAI заключила соглашение с властями Ямайки о строительстве и эксплуатации первого на острове ИИ ЦОД. Прецеденты использования похожих систем охлаждения есть. Например, Digital Realty использует для охлаждения ЦОД во Франции и Великобритании проточную речную воду. Green Mountain намерена развернуть систему охлаждения речной водой на своём новом объекте в Германии. Речное охлаждение также используют Denv-R во Франции и Nautilus в Калифорнии. Наконец, сеть европейских супермаркетов Lidl объявила, что один из её ЦОД в Германии тоже использует охлаждение речной водой, а норвежский оператор дата-центров Polar утверждает, что для охлаждения одного из своих ЦОД намерен использовать близлежащую реку. Участвуют в подобных проектах и гиперскейлеры. Площадка Google в Финляндии использует для охлаждения и морскую воду.

24.09.2025 [16:55], Владимир Мироненко

OpenAI арендует, а не купит чипы у NVIDIA в рамках $100-млрд сделкиВ СМИ появились новые подробности о сделке NVIDIA и OpenAI, в рамках которой чипмейкер инвестирует в OpenAI $100 млрд. Как сообщает газета The Financial Times, переговоры прошли напрямую между гендиректором NVIDIA Дженсеном Хуангом (Jensen Huang) и главой OpenAI Сэмом Альтманом (Sam Altman). Главы компаний обсуждали подробности соглашения практически без официальных консультаций с банками, которые обычно выступают посредниками в подобных случаях. По данным The Information, в числе обсуждаемых вопросов было применение новой бизнес-модели лизинга чипов. Вместо того чтобы напрямую приобретать ускорители NVIDIA, OpenAI фактически будет брать у NVIDIA чипы в аренду с постепенной оплатой, что потенциально снизит первоначальные затраты на 10–15 % в течение пяти лет. Точные условия аренды или лизинга не разглашаются. У кого останутся чипы после окончания срока действия договора, тоже не говорится.

Источник изображения: NVIDIA Данный подход отражает более широкую тенденцию в ИИ-отрасли, где капиталоёмкая ИИ-инфраструктура рассматривается скорее как услуга, чем как основной актив. Такая бизнес-модель позволяют компаниям быстро масштабироваться без значительных капитальных затрат, в то время как NVIDIA обеспечивает себе долгосрочные источники дохода. Как отметил Альтман, сделка знаменует собой «новую модель финансирования <…>, при которой мы можем платить постепенно, а не покупать всё сразу». «Чипы и системы составляют огромную [долю] стоимости, и оплатить её авансом сложно», — добавил он. По словам аналитиков, действия Хуанга, направленные на то, чтобы сделать NVIDIA «предпочтительным стратегическим партнёром OpenAI в области вычислений и сетевых технологий», затруднят переход ИИ-разработчиков на конкурирующие чипы. Также укрепляет позиции компании в отрасли программная платформа NVIDIA CUDA, ставшая стандартным инструментом написания ИИ-приложений. Удерживая ИИ-разработчиков в своей экосистеме, Хуанг инвестирует в OpenAI, а также в десятки других стартапов, занимающихся ИИ-приложениями, облачными вычислениями, робототехникой и здравоохранением, что «многократно окупится для NVIDIA в будущем», говорят эксперты.

23.09.2025 [01:00], Владимир Мироненко

NVIDIA инвестирует в OpenAI $100 млрд, которые в основном пойдут на покупку её же ускорителейNVIDIA и OpenAI объявили о подписании соглашения о намерениях в рамках стратегического партнёрства, согласно которому NVIDIA поставит OpenAI ускорители для развёртывания ИИ-инфраструктуры мощностью не менее 10 ГВт, что позволит обучать и запускать модели следующего поколения на пути к созданию суперинтеллекта. Для поддержки планов OpenAI, включающих строительство нескольких дата-центров, NVIDIA обязалась инвестировать в неё до $100 млрд, но поэтапно и по мере развёртывания новых ИИ-кластеров NVIDIA. Запуск первого этапа запланирован на II половину 2026 года с началом поставок платформы Vera Rubin. Первые $10 млрд от NVIDIA станут доступны после того, как стороны достигнут окончательного соглашения о покупке OpenAI её ИИ-платформ. Ожидается, что детали нового этапа стратегического партнёрства будут определены в ближайшие недели. Проект не связан со Stargate. Агентство Reuters отметило взаимовыгодный характер сделки, в результате которой NVIDIA получает долю в крупнейшей в мире компании в области ИИ, уже являющейся её важным клиентом. В свою очередь, OpenAI получает необходимые денежные средства и доступ для покупки передовых чипов, которые необходимы ей в первую очередь для сохранения своего доминирования в условиях растущей конкуренции. По словам источника Reuters, близкого к OpenAI, сделка будет включать две отдельные, но взаимосвязанные транзакции. Стартап сам заплатит NVIDIA за чипы, в то время как деньги NVIDIA пойдут на приобретение миноритарной доли акций. Согласно пресс-релизу, OpenAI будет сотрудничать с NVIDIA в качестве приоритетного стратегического партнёра в области вычислений и сетевых технологий для реализации планов по развитию ИИ-фабрик. Компании будут совместно оптимизировать свои планы по разработке ПО OpenAI для моделирования и инфраструктуры, а также аппаратного и программного обеспечения NVIDIA. Напомним, что NVIDIA поддержала OpenAI в раунде финансирования на $6,6 млрд в октябре 2024 года. Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) сообщил телеканалу CNBC, что 10 ГВт эквивалентны от 4 до 5 млн GPU. По его словам, именно такой объём компания поставит в этом году, что «вдвое больше, чем в прошлом году». «Спрос на ускорители NVIDIA фактически является неотъемлемой частью разработки передовых ИИ-моделей», — заявил аналитик eMarketer Джейкоб Борн (Jacob Bourne), отметив, что подобные сделки также должны снизить опасения по поводу потери продаж в Китае. Он добавил, что это также опровергает предположение о том, что конкурирующие производители чипов или кастомные разработки крупных технологических платформ способны потеснить NVIDIA. Масштаб инвестиций NVIDIA может привлечь внимание антимонопольных органов, пишет Reuters. Министерство юстиции США и Федеральная торговая комиссия США (FTC) достигли соглашения в середине 2024 года, которое открыло путь для потенциальных расследований роли Microsoft, OpenAI и NVIDIA в ИИ-индустрии. Однако администрация Дональда Трампа (Donald Trump) пока придерживается более мягкого подхода к вопросам конкуренции по сравнению с предыдущей администрацией. Инвестиции NVIDIA последовали за недавним раундом вторичного финансирования, в ходе которого OpenAI получила у ряда инвесторов оценку в $500 млрд.

21.09.2025 [13:40], Сергей Карасёв

Schneider Electric готовит стойки NVIDIA GB300 NVL72 мощностью 142 кВтКомпания Schneider Electric анонсировала две эталонные платформы, призванные ускорить построение инфраструктур для дата-центров, ориентированных на ресурсоёмкие нагрузки ИИ и НРС. Разработка систем ведётся в партнёрстве с NVIDIA. Один из проектов предусматривает создание референсных стоек для суперускорителей NVIDIA GB300 NVL72. Такие стойки смогут обеспечивать мощность до 142 кВт. Предусмотрено использование жидкостного охлаждения. В одном машинном зале могут быть расположены три кластера GB300 NVL72, насчитывающих в общей сложности до 1152 ускорителей. Отмечается, что в основу решения положены наработки и опыт, полученные в ходе реализации аналогичного проекта для NVIDIA GB200 NVL72. Клиентам будет доступна специальная среда моделирования на базе вычислительной гидродинамики (CFD): могут применяться цифровые двойники для оценки различных конфигураций электропитания и охлаждения с целью оптимизации платформ под определённые нужды.

Источник изображения: Schneider Electric Второй эталонный проект, как утверждается, представляет собой первую и единственную в отрасли платформу, предполагающую интеграцию систем управления питанием и жидкостным охлаждением, включая решения Motivair (контрольный пакет акций этой фирмы Schneider Electric приобрела в конце 2024 года). Для новой платформы заявлена совместимость с NVIDIA Mission Control — программным обеспечением NVIDIA для контроля производственных процессов и оркестрации работы ИИ-систем, включая управление кластерами и рабочими нагрузками. В таких системах могут применяться суперускорители GB300 NVL72 и GB200 NVL72. Подчёркивается, что новые эталонные решения являются результатом продолжающегося сотрудничества Schneider Electric и NVIDIA, которое направлено на удовлетворение растущих потребностей операторов дата-центров в области ИИ.

21.09.2025 [13:23], Сергей Карасёв

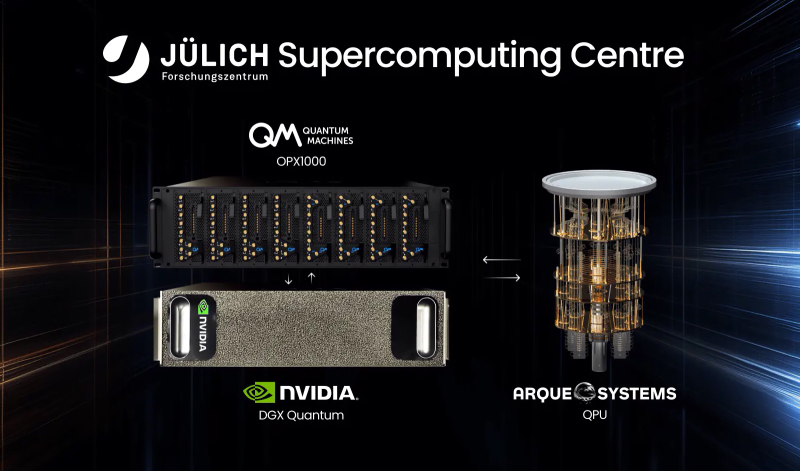

В Германии запущена квантово-классическая система с суперчипами NVIDIA GH200Компании Quantum Machines и Arque Systems развернули в Юлихском суперкомпьютерном центре в Германии (Jülich Supercomputing Centre, JSC) гибридную квантово-классическую вычислительную систему на платформе NVIDIA DGX Quantum. Это первый подобный проект, реализованный на базе крупной НРС-площадки в Европе. Новая система сочетает суперчипы NVIDIA GH200, 5-кубитный квантовый процессор Arque Systems и гибридный квантово-классический контроллер Quantum Machines OPX1000. Использованная архитектура, как утверждается, обеспечивает возможность квантовой коррекции ошибок (QEC), что является критически важным требованием при организации практических квантовых вычислений. Контроллер OPX1000, как отмечается, обеспечивает бесшовное взаимодействие между классическими и квантовыми вычислительными ресурсами. Достигается двусторонняя передача данных с задержкой менее 4 мкс, что в 1000 раз лучше, чем в предыдущих подобных реализациях. Ключевыми задачами проекта названы ускорение процедур калибровки кубитов и тестирование производительности квантовой коррекции ошибок. Кроме того, на базе комплекса планируется осуществлять разработку гибридных квантово-классических вычислительных алгоритмов. Одним из главных преимуществ платформы названа возможность запуска нейронных сетей и моделей машинного обучения на высокопроизводительных GPU с сохранением взаимодействия с квантовой подсистемой с низкой задержкой. Такой уровень интеграции, как подчёркивается, недоступен ни в одной другой современной системе квантовых вычислений. «Объединяя квантовые и классические вычислительные ресурсы на базе ведущего европейского суперкомпьютерного центра, мы открываем новые возможности для исследователей в плане изучения гибридных квантово-классических алгоритмов», — говорит доктор Кристель Михильсен (Kristel Michielsen), директор JSC. Нужно отметить, что JSC является оператором первого в Европе экзафлопсного суперкомпьютера — машины JUPITER, которая была официально запущена в эксплуатацию в сентябре 2025 года. Система использует примерно 6000 вычислительных узлов с гибридными ускорителями NVIDIA Quad GH200 и интерконнектом InfiniBand NDR200 (4×200G на узел, DragonFly+): в общей сложности задействованы почти 24 тыс. NVIDIA GH200.

20.09.2025 [01:40], Владимир Мироненко

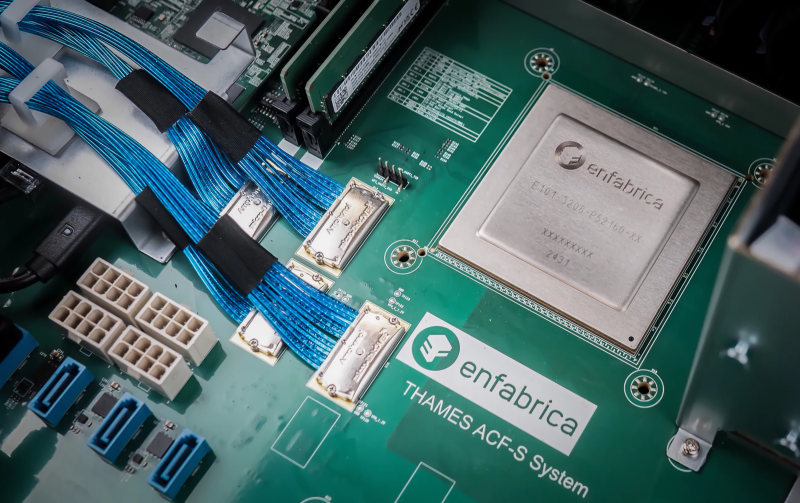

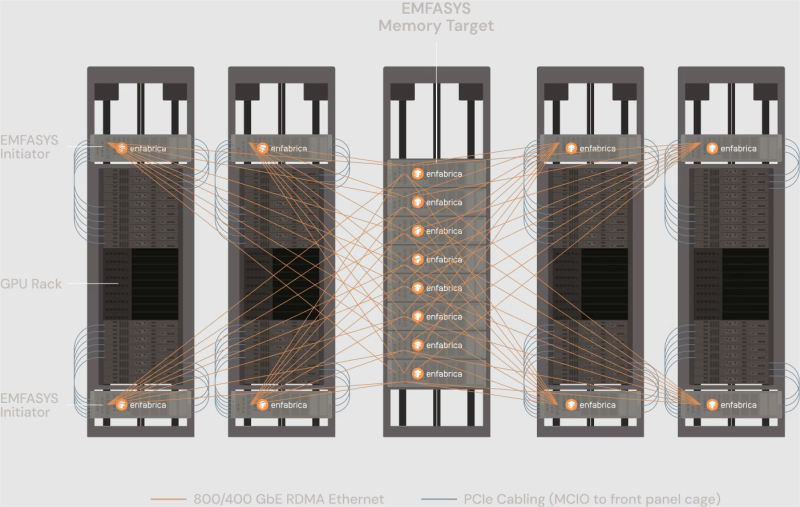

NVIDIA купила за $900 млн разработчика интерконнекта для ИИ-платформ EnfabricaСогласно публикациям CNBC и The Information, NVIDIA заключила сделку с разработчиком интерконнекта для ИИ-систем Enfabrica стоимостью $900 млн, чтобы лицензировать ряд его технологий, а также переманить его гендиректора и ключевых сотрудников. Оплата сделки, завершённой на прошлой неделе, производилась собственными средствами NVIDIA и её акциями. Глава Enfabrica Рочан Санкар (Rochan Sankar) уже присоединился к команде NVIDIA. Спрос на вычислительные мощности для поддержки генеративного ИИ со стороны таких компаний, как OpenAI, Anthropic, Mistral, AWS, Microsoft и Google, ставит перед NVIDIA сложную задачу: как создать унифицированный, отказоустойчивый GPU-кластер, способный справиться с такими огромными нагрузками. Решения Enfabrica, основанной в 2019 году, призваны решить эту задачу. Как пишет Network World со ссылкой на аналитиков, NVIDIA считает интеграцию технологий Enfabrica критически важной для повышения эффективности своих кластеров в обучении новейших ИИ-моделей. Во всяком случае, Enfabrica утверждает, что её технология позволяет бесшовно объединить более 100 тыс. ускорителей в единый кластер. Кроме того, к ускорителям можно добавить CXL-пулы DRAM/SSD. «Используя SuperNIC и фабрику Enfabrica, NVIDIA может ускорить передачу данных в кластерах, обойти текущие ограничения масштабирования сетевых фабрик и снизить зависимость от дорогостоящей памяти HBM», — отметила Рачита Рао (Rachita Rao), старший аналитик Everest Group, имея в виду чип ACF-S, разработанный для обеспечения более высокой пропускной способности, большей отказоустойчивости, меньшей задержки и лучшего программного управления для операторов ЦОД, работающих с ресурсоёмкими ИИ-системами и HPC. Enfabrica утверждает, что ACF-S более отказоустойчив в сравнении с традиционным интерконнектом, поскольку заменяет двухточечные соединения GPU многопутевой архитектурой, которая снижает перегрузку, улучшает распределение данных и гарантирует, что сбои в работе GPU не приведут к остановке процесса вычислений. По мнению Чарли Дая (Charlie Dai), главного аналитика Forrester, для NVIDIA также представляет интерес технология EMFASYS, позволяющая дать ИИ-серверам доступ к внешним пулам памяти. По словам Дая, сочетание ACF-S и EMFASYS может помочь NVIDIA добиться более высокой загрузки GPU и снижения совокупной стоимости владения (TCO) — ключевых показателей для гиперскейлеров и разработчиков LLM. Как сообщает Blocks & Files, Enfabrica привлекла в общей сложности $290 млн венчурного финансирования: $50 млн в раунде A в размере $50 млн в 2022 году при оценке в $50 млн; $125 млн в раунде B в 2023 году с оценкой в размере $250 млн; $115 млн в раунде C в 2024 году. По данным Pitchbook, оценочная стоимость компании сейчас составляет около $600 млн. NVIDIA инвестировала в компанию в раунде B. На этой неделе NVIDIA также объявила об инвестициях в Intel в размере $5 млрд в рамках совместной разработки специализированных чипов для ЦОД и ПК. Квазислияния получили широкое распространение в Кремниевой долине, поскольку позволяют обойти препоны регуляторов. В начале этого года Meta✴ приобрела за $14,3 млрд 49 % акций Scale AI, переманив его основателя Александра Ванга (Alexandr Wang) вместе с ключевыми сотрудниками. Месяц спустя Google объявила о похожем соглашении с ИИ-стартапом Windsurf, в рамках которого его соучредитель и гендиректор Варун Мохан (Varun Mohan) перешёл вместе с рядом сотрудников в подразделение Google DeepMind. Аналогичные сделки были в прошлом году у Google с Character.AI, Microsoft с Inflection AI и у Amazon с Adept.

19.09.2025 [14:43], Владимир Мироненко

NVIDIA инвестирует £2 млрд в развитие экосистемы ИИ-стартапов Великобритании — £500 млн получит NscaleNVIDIA объявила об инвестициях в размере £2 млрд ($2,7 млрд) в ИТ-рынок Великобритании с целью стимулирования развития экосистемы стартапов в сфере ИИ, разработки инновационных ИИ-технологий, создания новых компаний и рабочих мест, а также расширения конкурентных возможностей Великобритании на мировом ИИ-рынке. Как отмечено в пресс-релизе NVIDIA, развитие ИИ-компаний в Великобритании осложняется ограниченным доступом к суперкомпьютерам, ограниченным венчурным капиталом за пределами Лондона, а также растущими ценами на электроэнергию и трудностями с доступом венчурных капиталистов к ведущим академическим учреждениям, где многие исследователи также являются предпринимателями. В связи с этим американский технологический гигант планирует в сотрудничестве с британскими компаниями Accel, Air Street Capital, Balderton Capital, Hoxton Ventures и Phoenix Court ускорить развитие ИИ-экосистемы в Великобритании, предоставив новый капитал стартапам в этой сфере. Дженсен Хуанг (Jensen Huang), основатель и генеральный директор NVIDIA, заявил, что сейчас самое подходящее время для инвестиций в Великобританию, поскольку «ИИ открывает новые горизонты в науке и стимулирует развитие совершенно новых отраслей». «Благодаря новому капиталу и развитой инфраструктуре мы удваиваем усилия, чтобы дать Великобритании возможность возглавить следующую волну инноваций в области ИИ», — подчеркнул он. В связи с недавним обязательством NVIDIA производить в США суперкомпьютеры для ИИ-нагрузок на сумму до полутриллиона долларов, инвестиции будут осуществляться в Соединённых Штатах и «активироваться» в Великобритании, а британские венчурные партнеры помогут производителю чипов найти стартапы в области ИИ, которым необходима поддержка, отметил Bloomberg. По данным ресурса, NVIDIA планирует инвестировать в разработчиков технологий автономных транспортных средств Wayve и Oxa, финтех-компанию Revolut, а также ИИ-стартапы PolyAI, Synthesia, Latent Labs и Basecamp Research. Wayve сообщила, что NVIDIA инвестирует в компанию $500 млн для ускорения разработки и внедрения её ИИ-модели. Сумма в £2 млрд также включает в себя долю NVIDIA в размере £500 млн ($683 млн) в британской компании Nscale, занимающейся разработкой ИИ ЦОД. Средства будут выделены из баланса NVIDIA, сообщил представитель компании. Ранее Microsoft, OpenAI и Google также объявили об инвестициях на общую сумму в десятки миллиардов долларов и партнёрских соглашениях в Великобритании.

19.09.2025 [14:19], Сергей Карасёв

В Нью-Йорке заработал гибридный ЦОД Digital Realty с ИИ-кластером и квантовым компьютеромКомпания Digital Realty объявила об открытии на своей площадке JFK10 в Нью-Йорке специализированного дата-центра для задач ИИ, объединяющего вычисления на базе GPU и квантового компьютера. В реализации проекта приняли участие NVIDIA и Oxford Quantum Circuits (OQC). В состав платформы входит квантовая система Genesis, разработанная специалистами OQC. Она базируется на фирменной технологии двухканальных кубитов Dimon, которая, как утверждается, является прорывом в области устранения ошибок. Применение Dimon, по заявлениям OQC, позволяет снизить накладные расходы, одновременно открывая путь к отказоустойчивым квантовым вычислениям. Ещё одной составляющей нового дата-центра являются суперчипы NVIDIA GH200. Их использование в связке с Genesis позволяет сформировать среду для гибридных квантовых вычислений в области ИИ. Применённый подход предоставляет предприятиям доступ к интегрированной платформе, обеспечивающей более быстрое обучение ИИ-моделей и генерацию данных с повышенной эффективностью. Таким образом, компании могут одновременно задействовать возможности квантовых вычислений и ИИ при реализации сложных проектов и создании приложений следующего поколения.

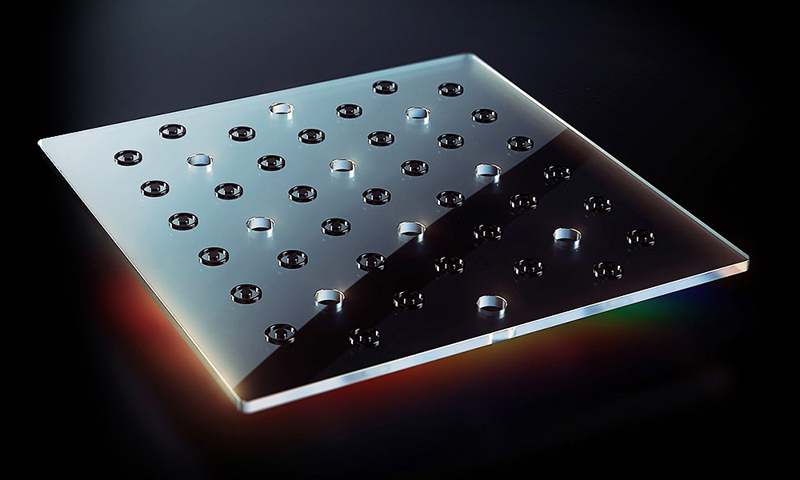

Источник изображения: OQC Одной из ключевых сфер использования гибридной платформы названы финансы. Речь идёт о высокоточном моделировании рисков, обнаружении мошенничества, оптимизации услуг и пр. Кроме того, система может применяться для улучшения логистических операций, поддержки принятия решений в условиях неопределённости, повышения устойчивости в критически важных областях и др. Квантовые вычисления открывают также новые возможности для самого ИИ. Предполагается, что в перспективе новые системы Genesis будут поставляться с ускорителями NVIDIA в стандартной комплектации. |

|