Лента новостей

|

19.06.2020 [18:09], Юрий Поздеев

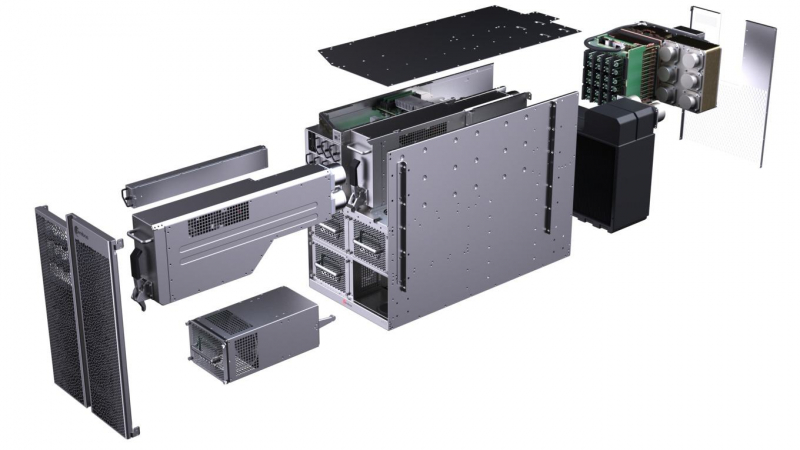

HPE анонсировала Superdome Flex 280: 224 ядра Cooper Lake и 24 Тбайт RAMHPE анонсировала Superdome Flex 280 с поддержкой процессоров Intel Xeon третьего поколения, которые вышли недавно. Данная модель дополняет портфель HPE Superdome Flex и ориентирована на средние предприятия, для которых избыточна масштабируемость до 32 сокетов. Оптимально данная модель подойдет для больших баз Oracle, SAP HANA или SQL-сервера. Новинка выпускается в форм-факторе 5U и поддерживает установку 2 или 4 процессоров Intel Xeon Gold или Intel Xeon Platinum. Это выгодно отличает Superdome Flex от других подобных систем, в которых можно использовать только Intel Xeon Platinum, который стоит значительно дороже.  Недавно анонсировали новые процессоры Intel Xeon третьего поколения, в которых не только добавили функции ускорения ИИ, но и поддержку более быстрой памяти DDR4-3200, что должно положительным образом сказаться на производительности. Максимально в одну платформу можно установить до 24 Тбайт оперативной памяти, а если и этого недостаточно, то можно использовать Intel Optane PMem 200 .  Слотов расширения PCIe тоже достаточно для большинства задач — до 32 на одну платформу, при этом можно установить до 16 графических ускорителей NVIDIA. Для локального хранилища можно использовать до 20 накопителей SAS/SATA/NVMe. Масштабируется платформа Superdome Flex 280 до 8 процессоров с шагом в 2 CPU, что позволяет работать с большими базами данных и моделями для ИИ, для которых требуется большой объем оперативной памяти. Суммарно можно получить до 224 ядер и до 24 Тбайт общей памяти. HPE Superdome Flex 280 будет доступен в 4 квартале 2020 года.

18.06.2020 [19:38], Владимир Мироненко

AWS Snowcone — мини-облако в дорогуКомпания Amazon анонсировала AWS Snowcone, нового представителя семейства устройств AWS Snow, предназначенных для периферийных вычислений, хранения и передачи данных из удалённых сред или мест, где отсутствует подключение к сети. Snowcone весит всего 2,1 кг и имеет габариты 227 × 148,6 × 82,65 мм. Мини-облако поддерживает запуск малых инстансов Amazon EC2:

Внутри у него неназванный x86-процессор c минимум двумя ядрами и 4 Гбайт оперативной памяти. Также у устройства имеется хранилище ёмкостью 8 Тбайт. AWS Snowcone можно подключать как к проводным, так и беспроводным сетям — у него есть два порта 1/10GbE и адаптер Wi-Fi 802.11a/b/g/n/ac. Питается устройство от порта USB Type-C (мин. 61 Вт), возможно подключение внешнего аккумулятора. Устройство защищено от внешнего воздействия согласно стандарту IP65. Диапазон рабочих температур: 0°...38° C. Максимальный расчётный срок службы составляет 4 года.  Перед отправкой клиенту Amazon загрузит в устройство желаемый образ AMI, в том числе с IoT Greengrass. Для обмена данными с внешним миром используется NFSv4. Устройство можно использовать с существующими локальными серверами и файловыми приложениями для чтения и записи данных. Как и в случае других решений семейства Snow, Snowcone с загруженными клиентом данными можно отправить назад в Amazon, чтобы они были перемещены в S3-хранилище в выбранном клиентом облачном регионе. В настоящий момент AWS Snowcone можно арендовать лишь в США: $60 за заказ + $6 за каждый день использования. В дальнейшем AWS будет предлагать эту услугу в других регионах.

18.06.2020 [16:00], Алексей Степин

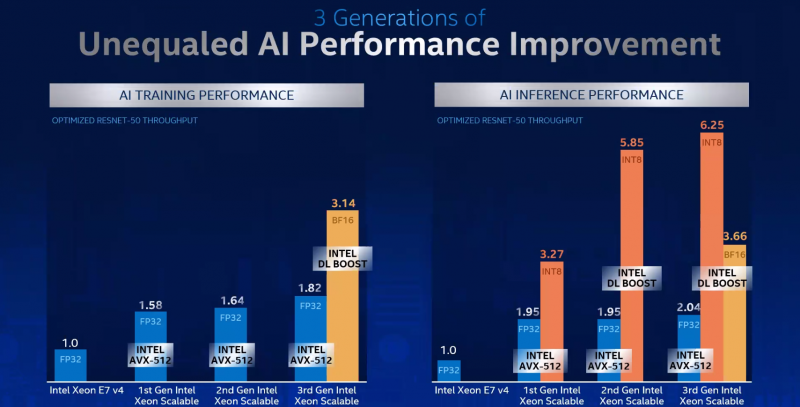

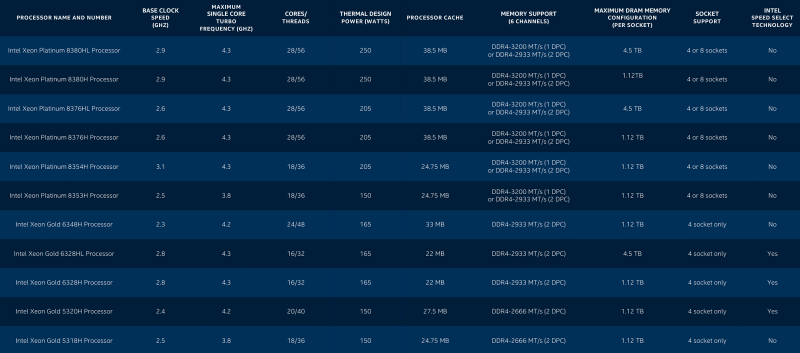

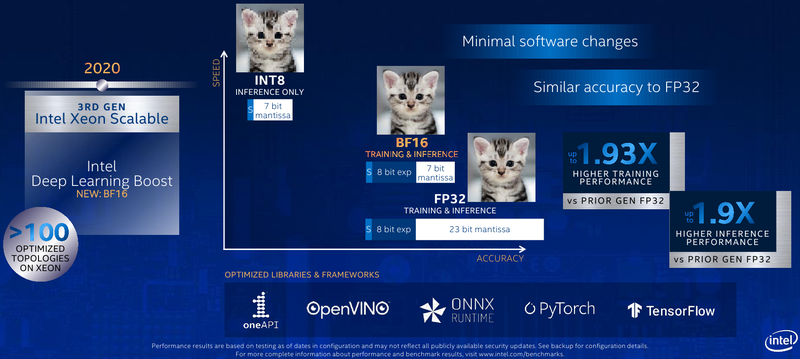

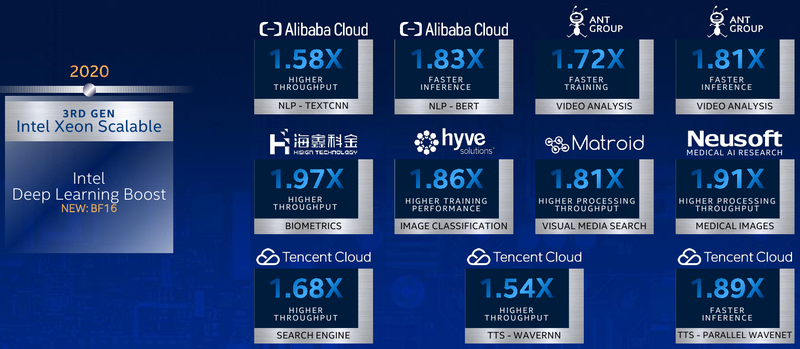

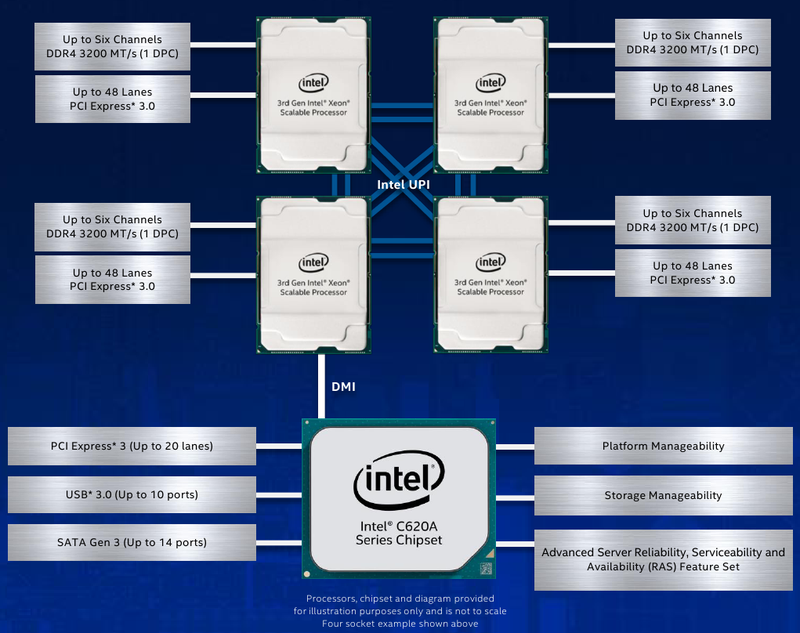

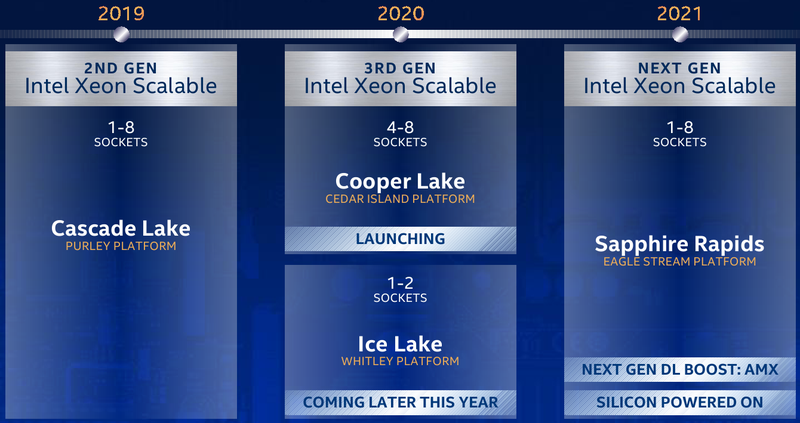

Intel представила Xeon Cooper Lake, третье поколение Scalable-процессоровКрупнейший в мире производитель процессоров с архитектурой x86, компания Intel, представила новую платформу, нацеленную на быстро растущий рынок машинного обучения, аналитики и периферийных вычислений. Хотя платформа состоит из нескольких компонентов, главным из них являются новые процессоры Intel Xeon Scalable — это уже третье поколение серии Scalable.  Первое поколение Xeon Scalable (Skylake) отличалось наличием поддержки векторных расширений с длиной 512 бит, хотя эта поддержка была наиболее полной в других процессорах с разъёмом LGA 3647, ныне почивших Xeon Phi 72xx. Во втором поколении Xeon Scalable, известном под кодовым именем Cascade Lake, появились расширения AVX-512 VNNI (Vector Neural Network Instructions, они же DL Boost), и это был первый реверанс в сторону машинного обучения со стороны Intel — расширения позволялил работать с INT8 и подходили для инференса.  Третье поколение, получившее имя Cooper Lake, ещё больше продвинулось в сторону поддержки нетипичных для традиционной архитектуры x86 форматов вычислений. Главным нововведением здесь является поддержка формата bfloat16, который часто используется в комплексах машинного обучения и системах принятия решений (инференс). Он требует меньше вычислительных мощностей, нежели традиционные форматы FP32/64, но при этом в большинстве случаев обеспечивает достаточную точность вычислений, а итоговый выигрыш в производительности может быть почти двухкратным.  Популярные фреймворки, такие как TensorFlow и Pytorch, уже давно поддерживают bfloat16, а Intel-оптимизированные версии доступны в комплекте Intel AI Analytics Toolkit. Компания также оптимизировала среды OpenVINO и ONNX с учётом возможностей новых процессоров Xeon Scalable. Собственно говоря, самое главное в Cooper Lake то, что их теперь можно использовать и для обучения нейронных сетей, а не только для инференса. Intel отдельно подчёркивает универсальность новых CPU. Что касается самих процессоров, то максимальное количество ядер сохранилось, их в серии Xeon Gold 53xx/63xx и Xeon Platinum 83xx по-прежнему 28 при поддержке SMT2. Однако улучшения есть, и достаточно серьёзные. Серия Xeon Platinum поддерживает память до DDR4-3200 (1DPC) и DDR4-2933 (2DPC), хотя младшие пяти- и шеститысячники так же ограничены 2666 и 2933 MT/с. Зато все они поддерживают память Intel Optane DCPMM 2-го поколения. Число каналов память осталось прежним, их шесть. Существенное отличие от Cascade Lake в том, что теперь у всех CPU есть 6 линий UPI — они могут может «бесшовно» устанавливаться в системы с четырьмя или восемью процессорными разъёмами. Другое важное отличие — серия 53xx теперь имеет два FMA-порта для AVX-512, а не один как раньше. Часть новинок поддерживает Intel Speed Select. У «ёмких» моделей с суффиксом HL максимальный объём оперативной памяти достиг 4,5 Тбайт, а у базовых H — до 1,12 Тбайт. Несколько подросли тактовые частоты, в серии есть модели с частотной формулой 2,9 ‒ 4,3 ГГц, причём большая часть новинок имеет частоту в турборежиме более 4 ГГц. Исключение — модели с пониженным энергопотреблением. Всё это делает новые процессоры привлекательными для крупных предприятий, облачных провайдеров и гиперскейлеров вообще. Если даже на секунду забыть все новововведения для ИИ, Cooper Lake всё равно останется многосокетной платформой, а это значит, что он подходит для работы с большими СУБД, анализа больших объёмов данных в реальном времени, OLTP и виртуализации. В области 4S/8S-платформ у Intel давно крепкие позиции, так что новинки наверняка приглянутся определённому кругу заказчиков. Но массовыми Cooper Lake в текущем виде не станут.  Основной системный чипсет — Intel C620A, то есть обновлённый Lewisburg. В серию пока входит всего три модели, две из которых поддерживают технологию Intel QAT, ускоряющую работы по компресии и шифрованию. Так это обновление уже имеющихся чипсетов, поддержки PCI Express 4.0 нет. Сами процессоры Xeon Scalable третьего поколения по-прежнему могут предоставить в распоряжение системы до 48 линий PCIe 3.0. С учётом того, что ориентированы они на 4-сокетные системы, этого может быть вполне достаточно.  Однако другие процессоры Xeon Scalable «Ice Lake», для одно-двухсокетных платформ Whitley, которые Intel планирует представить позднее в этом году, уже получат поддержку PCI Express 4.0. Также известно, что четвёртое поколение Xeon Scalable под именем Sapphire Rapids получит набор новых матричных расширений (Advanced Matrix Extensions, AMX), которые, вероятно, буду напоминать тензорные ядра. Она увидит свет уже в 2021 году. Для массовых одно- и двухсокетных платформ пока предлагается использовать Cascade Lake Refresh. Вместе с Intel Xeon Cooper Lake компания также анонсировала второе поколение памяти Intel Optane DCPMM 200, накопители Intel D7-P5500 и D7-5600 с интерфейсом PCIe 4.0 и новую FPGA Intel Stratix 10 NX.

09.06.2020 [19:49], Юрий Поздеев

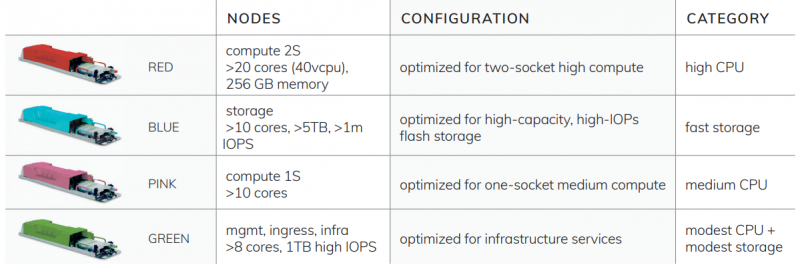

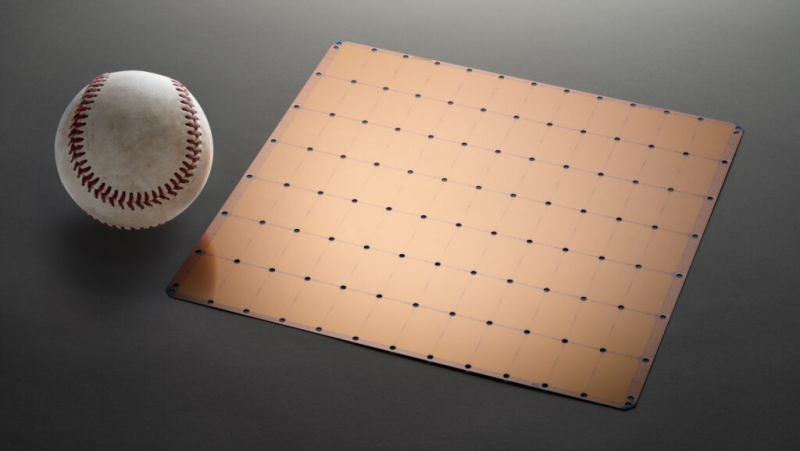

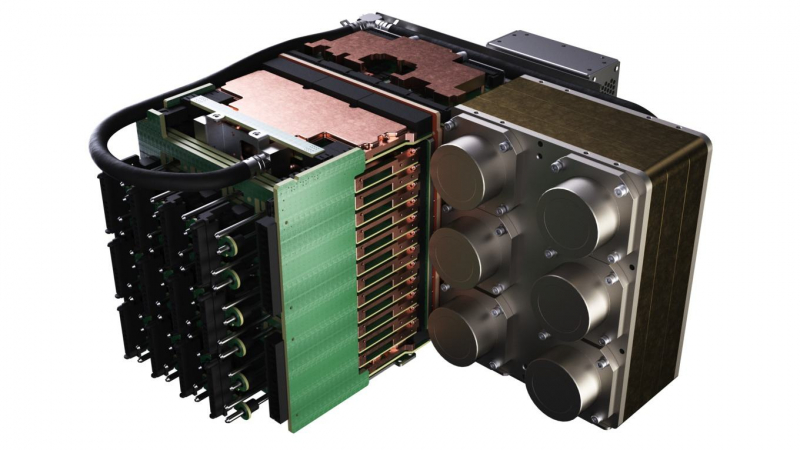

Суперкомпьютер Neocortex: 800 тыс. ядер Cerebras для ИИПиттсбургский суперкомпьютерный центр (PSC) получит $5 млн от Национального научного фонда на создание суперкомпьютера нового типа Neocortex, который объединяет ИИ-серверы Cerebras CS-1 и HPE SuperDome Flex в единую систему с общей памятью. Планируется, что решение будет введено в эксплуатацию до конца 2020 года.  Каждый сервер Cerebras CS-1 имеет процессор Cerebras Wafer Scale Engine (WSE), который содержит 400 000 ядер, оптимизированных для работы с ИИ (46 225 мм2, 1,2 трлн транзисторов). В паре с ними работает HPE SuperDome Flex, который используется для предварительной обработки информации и постобработки после Cerebras. SuperDome Flex представлен в максимальной комплектации, то есть с 32 процессорами Intel Xeon, 24 Тбайт оперативной памяти, 205 Тбайт флеш-памяти и 24 интерфейсными картами.  Каждый сервер Cerebras CS-1 подключается к SuperDome Flex через 12 каналов со скоростью 100 Гбит/с каждый. Процессор WSE способен обрабатывать 9 Пбайт данных в секунду, что, по подсчетам Nystrom, эквивалентно примерно миллиону фильмов в HD-качестве. Характеристики решения действительно впечатляют!

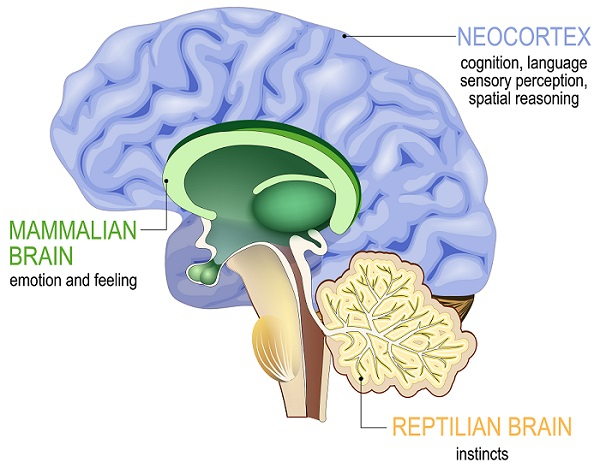

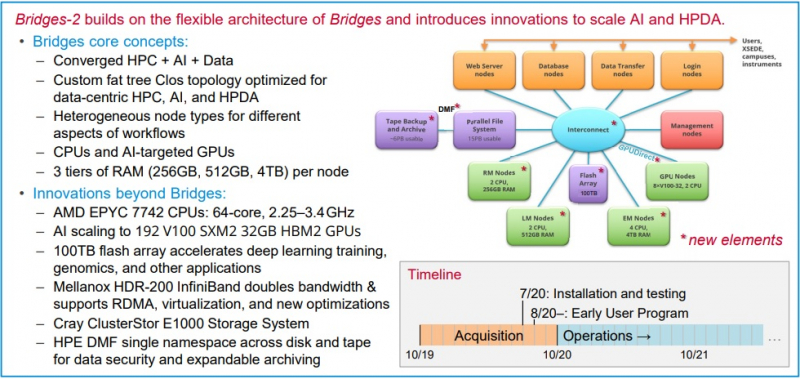

Neocortex назван в честь области мозга, отвечающей за функции высокого порядка, включая когнитивные способности, сновидения и формирование речи Архитектура решения строилась таким образом, чтобы не пришлось разбивать вычислительные блоки на множество узлов — это позволило снизить задержки в обработке информации и ускорить обучение моделей ИИ. Cerebras CS-1 разрабатывался специально для ИИ, поэтому он имеет преимущества перед серверами с графическими ускорителями, которые хорошо справляются с матричными операциями, но имеют многие конструктивные ограничения.  По заявлениям Neocortex, сервер CS-1 будет на несколько порядков мощнее системы PSC Bridges-AI. Один сервер Neocortex CS-1 будет эквивалентен примерно 800-1500 серверов с традиционной архитектурой с использованием графических ускорителей. Задачи, в которых Neocortex покажет себя максимально эффективно относятся к классу нейронных сетей DCIGN (deep convolutional inverse graphics networks) и RNN (recurrent neural networks). Если говорить простыми словами, то это более точное прогнозирование погоды, анализ геномов, поиск новых материалов и разработка новых лекарств.  PSC, помимо Neocortex, запускает еще и новое поколение системы Bridges-2, которое будет развернуто осенью 2020 года. Таким образом, до конца этого года будут введены в эксплуатацию два мощных суперкомпьютера для ИИ. Neocortex и Bridges-2 будут поддерживать самые популярные фреймворки машинного обучения, что позволит создать гибкую и мощную экосистему для ИИ, анализа данных, моделирования и симуляции. До 90% машинного времени Neocortex будет выделяться через XSEDE (Extreme Science and Engineering Discovery Environment), финансируемую NSF организацию, которая координирует совместное использование передовых цифровых услуг, включая суперкомпьютеры и ресурсы для визуализации и анализа данных, с исследователями на национальном уровне.

05.06.2020 [23:23], Алексей Степин

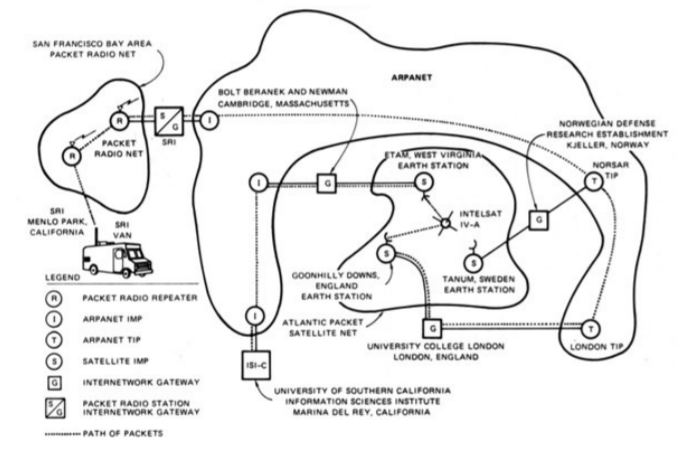

Предложение Huawei отказаться от TCP/IP восторгов не вызвалоСтеку TCP/IP, благодаря которому существует всемирная сеть, уже не один десяток лет. DARPA начало исследования по этой теме ещё в конце 60-х, и не все согласны с тем, что данная технология продолжает отвечать требованиям времени: Huawei предложила Международному союзу электросвязи (ITU) план по отказу от TCP/IP и переходу на более современное и безопасное, по её мнению, решение New IP. Определённый резон в этом есть: современные сети чрезвычайно сложны, они базируются на весьма разнообразном оборудовании, и что такое «кибервойна» сегодня, пожалуй, знают все, кто хоть сколько-то интересуется тематикой информационных технологий. Достаточно хотя бы сделать на нашем сайте поиск по слову «уязвимость» — и становится понятным, что понятия «интернет» и «безопасность» сегодня сочетаются не очень хорошо.

Демонстрация TCP/IP, объединяющая сети ARPANET, PRNET и SATNET. 1977 год Корпорация Huawei выступила в ITU с предложением отказаться от стека TCP/IP и перейти на использование более гибких и безопасных технологий. Понять позицию китайской компании можно: она находится в состоянии «войны» с США и желание продвинуть собственные технологии для нее совершенно естественно. Позиции, предлагаемые Huawei, выглядят довольно привлекательно:

Технических деталей, к сожалению, в публичном доступе пока нет. Реакция на предложение Huawei оказалась достаточно негативной: оно было охарактеризовано, как попытка внедрения централизации и «тоталитарных» методов. В частности, предложенный механизм отсечения частей сети можно использовать не только для защиты от DDoS-атак. Сама Huawei обвинения в «тоталитаризме» отвергла, заявив, что не связывает технологию с политикой. Еврокомиссия опубликовала свой ответ: в нём говорится, что за время своего существования модель TCP/IP доказала свою жизнеспособность, продемонстрировав нужную степень отказоустойчивости и масштабируемости. Аналогичной точки зрения придерживается Cisco, считая TCP/IP достаточно гибкой технологией, чтобы отвечать вызовам времени.

О дивный, новый Интернет! Нужда в усовершенствовании сетевых технологий существует, но это следует делать в рамках существующих стандартов. Евросоюз планирует защищать «видение единого, открытого, нейтрального, свободного и нефрагментированного интернета». («the vision of a single, open, neutral, free and unfragmented internet»). Тем не менее, война технологий, скорее всего, в ближайшее время продолжится. Предсказать исход пока не представляется возможным, но Huawei явно не собирается сдаваться просто так и будет продвигать инициативу New IP далее.

20.05.2020 [00:10], Юрий Поздеев

Б/У серверы Facebook✴ и Microsoft обретут новый дом благодаря ITRenew SesameГиганты Google, Facebook✴ и Microsoft каждый год покупают огромное количество серверов, которые могут работать и до 10 лет. Однако через 2–3 года они заменяются на новые, более производительные модели, так как для гиперскейлеров это проще и быстрее, чем строить или расширять ЦОД. При объемах закупок от 100 тыс. серверов в год каждый квартал более 10 тыс. единиц оборудования выводится из эксплуатации. Утилизировать всю эту технику было бы слишком расточительно, ведь даже серверы возрастом 2–3 года из ЦОД гиперскейлеров мощнее многих серверов, которые используются на предприятиях сегодня. ITRenew предлагает разумный выход из ситуации. ITRenew подписала с гиперскейлерами контракты на выкуп старого оборудования. Впрочем, «старое» — не совсем подходящее слово, так как оно отработало в среднем от 2 до 5 лет. Компания помогает значительно снизить издержки, дав, с одной стороны, возможность гипескейлерам вернуть часть вложенных средств, а с другой — снизить затраты на 40-50% для небольших предприятий, которые оснащают свои дата-центры.

Стойки ITRenew Sesame Для многих компаний это единственная возможность купить оборудование такого класса, так как ODM вроде Wiwynn, Inspur, Quanta продают его только гиперскейлерам 1-го уровня (Amazon, Facebook✴, Google) и не собираются менять свою модель продаж, поскольку у них нет проблем со сбытом своей продукции. Еще один важный момент, на который обращают большое внимание в Европе и США, связан с экологией. То, что техника продолжает использоваться, а не уничтожается, позволяет экономить ресурсы и не загрязнять окружающую среду. Это особенно важно в свете того, что Китай закрыл ввоз подобного оборудования для утилизации и сортировки. И пока тенденция агрессивного обновления крупнейших дата-центров сохраняется, объем выведенной из эксплуатации техники будет расти. Может сложиться впечатление, что покупка б/у оборудования — это удел отсталых и бедных компаний, которые не хотят вкладывать деньги в развитие IT. Однако это далеко не так! Оборудованием от ITRenew комплектуются целые дата-центры, например, шведский ЦОД Hydro66. Все оборудование в ITRenew проходит обязательную процедуру обслуживания: компоненты с малым остаточным ресурсом заменяются новыми или снятыми с других единиц техники. Затем всё проверяется, настраивается и упаковывается для транспортировки новым владельцам. Несмотря на то, что оборудование из дата-центров гиперскейлеров выпущено разными производителями (Wiwynn, Quanta и другими), оно проходит процедуру стандартизации и настройки, после чего управлять и поддерживать его гораздо проще, чем «зоопарком» обычного серверного оборудования разных брендов. Кроме того, многие компоненты таких систем открыты — они будут иметь полноценную поддержку долгие годы. Одна из причин, почему продажа б/у-оборудования от гиперскейлеров до сих по не стала действительно массовым явления, в том, что оно имеет OCP-исполнение, отличное от принятых в корпоративном мире стандартов. Это касается и шасси, и прошивок, и ПО. Именно поэтому ITrenew создала серию платформ, готовых принятть OCP-оборудование, со всем необходимым ПО для оркестрации Kubernetes. Sesame позволит объединить до 20 стоек (более 750 узлов) в один кластер с 25GbE-подключение. Слоган нового решения: «Сила гиперскейлеров для всех». Звучит довольно громко, однако так оно и есть. Теперь даже мелкие компании могут приобрести производительное оборудование, которое не стоит огромных денег. А для «самых маленьких» компания предлагает Sesame Fast Start, мини-стойку на колёсиках со всем необходимым. Fast-Start помещается под столом — она рассчитана на 5 узлов суммарной мощностью до 1600 Вт и имеет 10GbE-коммутатор.

14.05.2020 [18:52], Рамис Мубаракшин

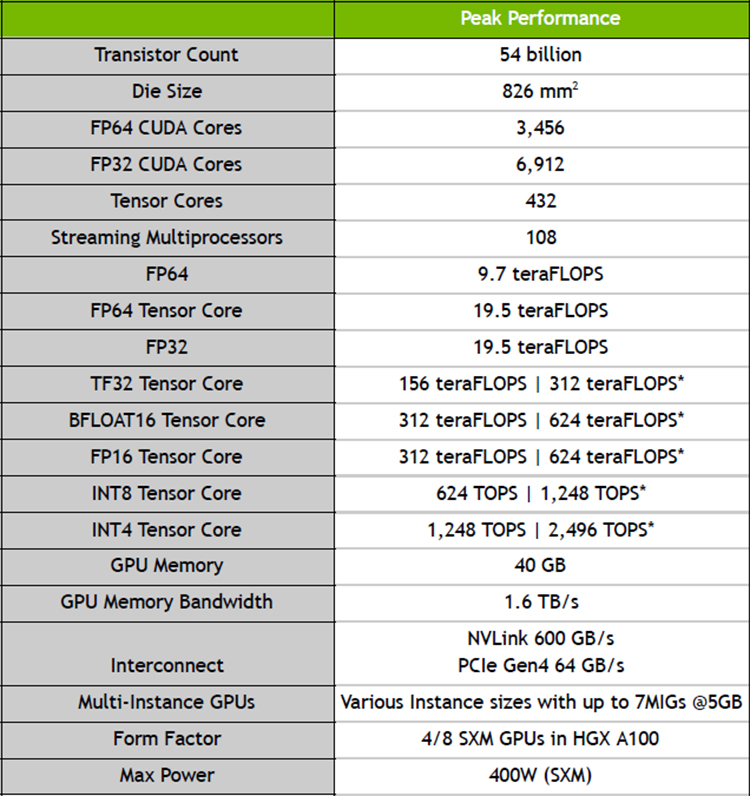

NVIDIA представила ускорители A100 с архитектурой Ampere и систему DGX A100 на их основеNVIDIA официально представила новую архитектуру графических процессоров под названием Ampere, которая является наследницей представленной осенью 2018 года архитектуры Turing. Основные изменения коснулись числа ядер — их теперь стало заметно больше. Кроме того, новинки получили больший объём памяти, поддержку bfloat16, возможность разделения ресурсов (MIG) и новые интерфейсы: PCIe 4.0 и NVLink третьего поколения. NVIDIA A100 выполнен по 7-нанометровому техпроцессу и содержит в себе 54 млрд транзисторов на площади 826 мм2. По словам NVIDIA, A100 с архитектурой Ampere позволяют обучать нейросети в 40 раз быстрее, чем Tesla V100 с архитектурой Turing.

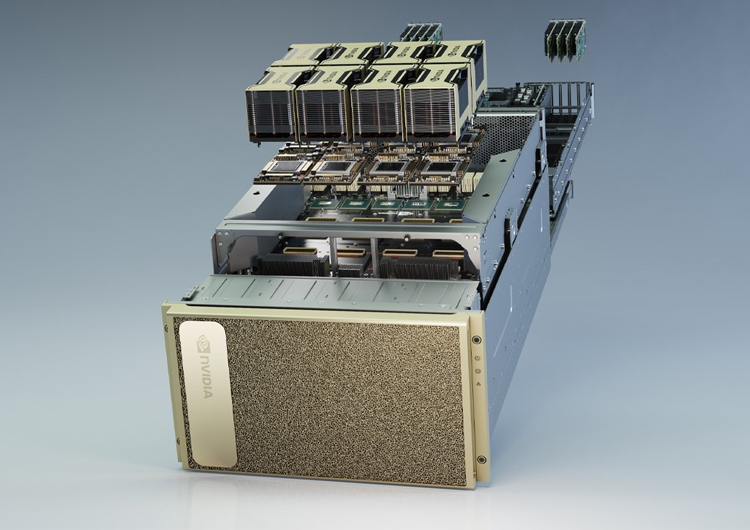

Характеристики A100 Первой основанной на ней вычислительной системой стала фирменная DGX A100, состоящая из восьми ускорителей NVIDIA A100 с NVSwitch, имеющих суммарную производительность 5 Пфлопс. Стоимость одной системы DGX A100 равна $199 тыс., они уже начали поставляться некоторым клиентам. Известно, что они будут использоваться в Аргоннской национальной лаборатории для поддержания работы искусственного интеллекта, изучающего COVID-19 и ищущего от него лекарство. Так как некоторые группы исследователей не могут себе позволить покупку системы DGX A100 из-за ее высокой стоимости, их планируют купить поставщики услуг по облачным вычислений и предоставлять удалённый доступ к высоким мощностям. На данный момент известно о 18 провайдерах, готовых к использованию систем и ускорителей на основе архитектуры Ampere, и среди них есть Google, Microsoft и Amazon.

Система NVIDIA DGX A100 Помимо системы DGX A100, компания NVIDIA анонсировала ускорители NVIDIA EGX A100, предназначенная для периферийных вычислений. Для сегмента интернета вещей компания предложила плату EGX Jetson Xavier NX размером с банковскую карту.

15.04.2020 [22:45], Владимир Мироненко

Индия-Израиль-Италия: Google потратит $400 млн на оптоволоконный кабель Blue-RamanКомпания Google объявила о планах проложить новый оптоволоконный кабель Blue-Raman стоимостью $400 млн, который соединит Индию и Италию и пройдёт через Израиль. Ожидается, что кабель достигнет Израиля в 2022 году, сообщил ресурс Haaretz. Участок кабеля Raman, названный в честь индийского лауреата Нобелевской премии Венката Рамана и разрабатываемый компанией Omantel, начинается в Мумбаи, далее он будет проложен по дну Индийского океана и по суше через пока не указанную страну (скорее всего, Саудовскую Аравию), вплоть до иорданского порта Акаба. Здесь Raman соединят с другим участком кабеля под названием Blue, разрабатываемым Sparkle Telecom Italia, который пройдёт через Израиль, затем вдоль Средиземного моря до Генуи (Италия). Используя Израиль в качестве соединительной точки на Ближнем Востоке, Google избегает Египта, где проложено значительное количество подводных кабелей. Отраслевой эксперт Сунил Тагар (Sunil Tagare) отметил, что прокладка кабеля через Египет обойдётся чрезвычайно дорого, поскольку страна взимает дополнительную плату за это. «Этот кабель не только обеспечит максимальное разнообразие маршрутов, проходящих через Израиль, но и снизит стоимость трафика из Азии в Европу как минимум на 50 %», — утверждает эксперт. Он высказал мнение, что есть и другая причина для прокладки этого оптоволоконного кабеля. В прошлом году индийский телекоммуникационный гигант Reliance Jio Infocomm заключил партнёрские отношения с Microsoft и, как утверждается, затем потребовал от Google более высокой платы за использование кабеля India-Asia-Xpress (IAX), который соединит Мумбаи и Ченнаи с Сингапуром.

09.04.2020 [18:32], Алексей Степин

HPE лишит энтузиастов лицензий на OpenVMSНа первый взгляд, в мире серверов царит господство двух операционных систем — Microsoft Windows Server и различных вариантов Linux. Однако есть ещё немало число оборудования с архитектурами, отличными от x86. Иногда оно поддерживается за счет таких явлений, как «хобби-лицензия» на операционную систему OpenVMS, некогда созданную в недрах знаменитой корпорации DEC. Сейчас правами на эту лицензию владеет HPE и, похоже, вскоре она собирается перекрыть кислород последним легальным пользователям VMS-систем, которые не приносят доход.

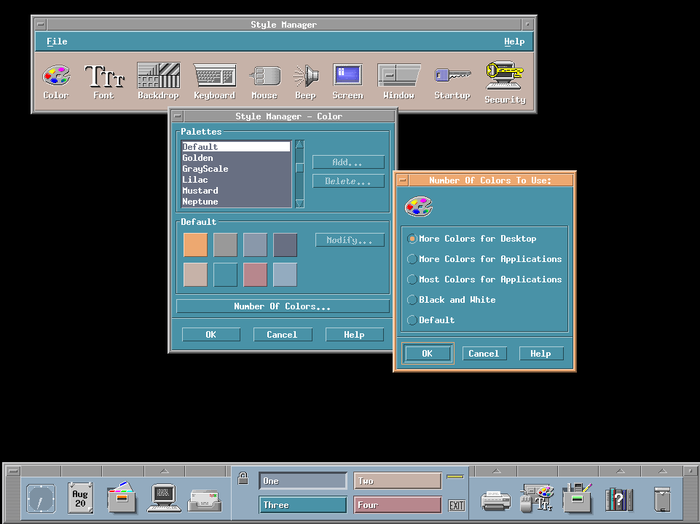

Пример рабочего стола в OpenVMS 8.4 Такие имена, как VAX или Alpha забыты ныне практически всеми, за исключением энтузиастов и тех, кто хочет поддерживать работоспособность устройств, унаследованных у эры разнообразия процессорных архитектур. VMS — весьма почтенная, но передовая на момент создания операционная система, созданная корпорацией Digital Equipment Corporation ещё в 1977 году для платформы VAX. Впоследствии она была портирована на платформы DEC Alpha и Intel Itanium, где, переименованная в OpenVMS, и продолжила свою службу на благо человечества. До недавних пор существовала возможность приобретения «хобби-лицензии», что позволяло официально эксплуатировать систему на платформах VAX, Alpha и HP Integrity, а также в эмуляторах.

DEC Alpha 21064: 1995 год, 275 МГц, 64 бита, 32 Кбайт L1 и 8 Мбайт внешнего L2 Однако двери закрываются: владеющая правами на выдачу таких лицензий HPE передала соответствующее подразделение в распоряжение VMS Software (VSI) и теперь закрывает свою программу, нацеленную на энтузиастов. Пока на сайте HPE ещё доступна опция продления лицензии на OpenVMS, но компания завершает цикл поддержки OpenVMS V8.4 и последний пакет лицензий будет действовать лишь до 31 декабря 2021 года, после чего пользователям предлагается рассмотреть возможность приобретения коммерческой лицензии. Как минимум, один владелец систем с процессорами Alpha, пользующийся такими лицензиями, нашёлся — и он подтвердил, что цены на них весьма далеки от гуманных: в последний раз стоимость лицензии для системы DS20 составляла почти $25 тыс. Мало какой энтузиаст сможет позволить себе такие затраты для некоммерческого проекта. У VSI есть студенческий вариант лицензионного пакета, но как сообщают пользователи, такой пакет действует всего полгода и получение новых версий является достаточно затруднительным процессом.

03.04.2020 [13:37], Геннадий Детинич

Консорциумы CXL и Gen-Z объединяют усилия: протоколы станут совместимыми, а возможности расширятсяКонсорциумы CXL и Gen-Z сообщили, что их руководящие органы подписали договор о взаимопонимании. Пописанный меморандум раскрывает планы сотрудничества между двумя организациями, обещая совместимые протоколы и расширенные возможности каждого из представленных интерфейсов. Первые версии спецификаций Gen-Z и CXL (Compute Express Link) вышли, соответственно, в феврале 2018 года и в марте 2019 года. Каждый из этих интерфейсов призван обойти ограничения по пропускной способности, накладываемые на многоядерные и многоузловые конфигурации процессоров и ускорителей.  Как один, так и другой интерфейс отвечают за согласованность кешей множества подключённых решений и обеспечивают минимальные задержки при доступе к вычислительным ресурсам и хранилищам данных на основе ОЗУ или долговременных накопителей. В то же время интерфейс CXL специализируется на согласованной работе внутри шасси, а интерфейс Gen-Z позволяет согласовывать работу на уровне блоков, стоек и массивов. В целом, участники консорциума Gen-Z поддержали идею Compute Express Link и признали её как дополняющую для развития интерфейса Gen-Z. В течение прошлого года в консорциум CXL, за организацией которого стоит компания Intel, вошли много компаний, включая AMD и ARM. Дело оставалось за малым ― объединить усилия и добиться совместимости протоколов и архитектур.  Сегодня такой день настал. Консорциумы CXL и Gen-Z договорились организовать совместные смешанные рабочие группы для разработки «мостов» между протоколами обеих спецификаций и сделать всё необходимое, чтобы расширить возможности каждого из стандартов за счёт возможностей другого. |

|