Лента новостей

|

24.09.2025 [15:33], Руслан Авдеев

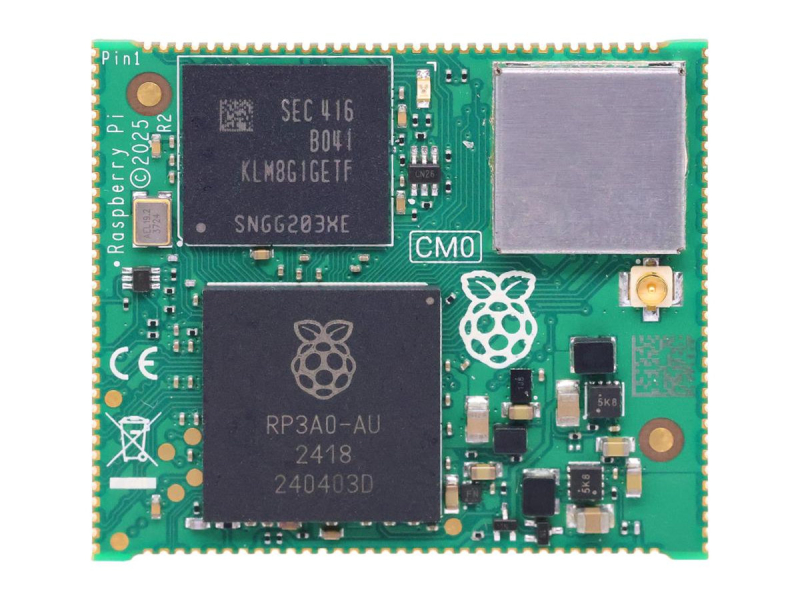

«Яндекс» строит во Владимирской области новый ЦОД, где разместится новая зона доступности Yandex CloudYandex Cloud намерена запустить в начале 2026 года новую зону доступности на базе дата-центра компании, сообщают «Ведомости». Это уже шестой ЦОД «Яндекса», его мощность составит более 40 МВт. Новый объект разместят неподалёку от уже действующего дата-центра «Яндекса». По данным пресс-службы «Яндекса», зона будет обеспечивать (минимальную) задержку до соседней зоны менее 1 мс, а общая ёмкость канала составит 25,6 Тбит/с. В компании подчёркивают, что такие показатели позволят ускорить работу критически важных для банков, ритейлеров и других крупных клиентов сервисов, требующих транзакций, бронирования и запросов во внутренние базы данных. Новая зона доступности получит независимые каналы для связи с другими зонами, что повысит общую надёжность системы. В «Яндексе» подчеркнули, что спрос на облака только увеличивается, в I полугодии 2025-го спрос на vCPU в Yandex Cloud вырос на 29,6 % год к году. Также в компании утверждают, что она первой в России запустила инструменты для проведения учений по отказоустойчивости инфраструктуры. PUE нового объекта будет на уровне 1,1 — благодаря использованию фрикулинга в течение всего года.

Источник изображения: Яндекс Как сообщают «Ведомости», по оценкам экспертов Apple Hills Digital, инвестиции в проект превышают 15–20 млрд руб. Новая зона доступности будет драйвером потребления сервисов текущими клиентами «Яндекса». Эксперты предполагают, что новое решение усилит позиции компании на рынке отечественных облаков. На фоне высокой фрагментированности российского облачного рынка у «Яндекса» сильная позиция, которую дополнительно укрепит открытие новой зоны доступности. В апреле сообщалось, что в Можайском округе Московской области построят очередной дата-центр «Яндекса» с инвестициями в объёме $16 млрд. Ввод в эксплуатацию запланирован на 2027 год.

24.09.2025 [15:21], Андрей Крупин

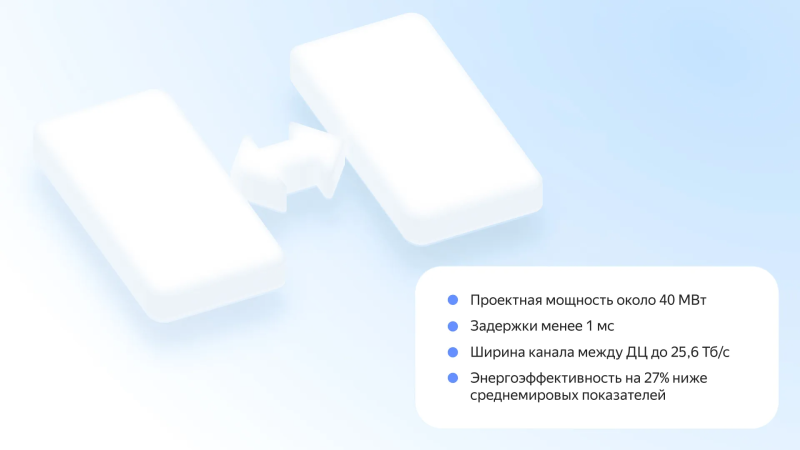

Платформа «Астра Мониторинг» дополнилась средствами контроля инфраструктуры «1С»«Группа Астра» объявила о выпуске обновлённого программного комплекса «Астра Мониторинг» 1.0. «Астра Мониторинг» представляет собой решение для сбора и анализа информации о состоянии узлов IT-инфраструктуры с целью их диагностики, своевременного обнаружения неполадок и повышения стабильности работы. Платформа масштабируема и может охватывать как несколько устройств, например, с SNMP-интерфейсом, так и географически распределённые сети с тысячами высоконагруженных нод. Техническая реализация продукта построена на взаимодействии двух частей — клиентской, выполняющей непосредственный сбор диагностической информации, и центральной, отвечающей за обработку полученных данных. На клиентской части с объектов мониторинга собираются метрики, логи и сигналы, которые сохраняются в центре обработки и формируются в события и проблемы, несущие полезную информацию о возникающих состояниях объектов наблюдения.

Источник изображения: astra.ru Ключевым нововведением «Астра Мониторинг» 1.0 стала функция мониторинга информационных баз на платформе «1С», позволяющая контролировать производительность систем, оптимизировать процессы и сокращать затраты на обслуживание. Также в программном комплексе реализована модель разграничения доступа на основе ролей (RBAC), обеспечивающая гибкое управление правами пользователей при создании и редактировании ресурсов. Платформа «Астра Мониторинг» зарегистрирована в реестре российского ПО, в полной мере отвечает задачам импортозамещения и может использоваться заказчиками при реализации программ по переходу на отечественные продукты с решений зарубежных разработчиков.

24.09.2025 [13:37], Сергей Карасёв

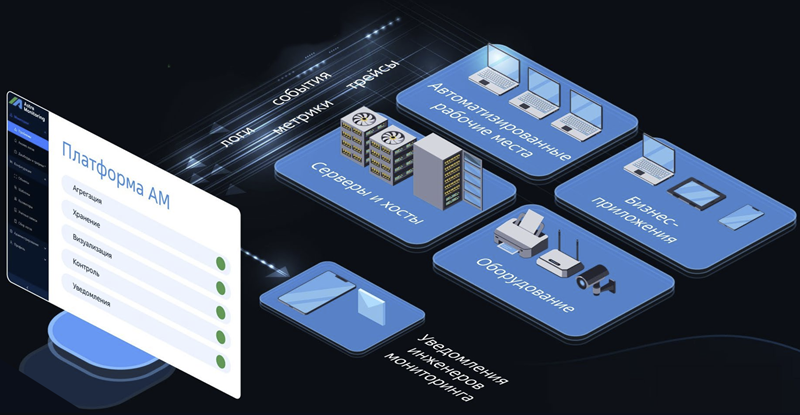

Raspberry Pi готовит вычислительный модуль CM0 с поддержкой Wi-Fi 4 и Bluetooth 4.2 LEКомпания Raspberry Pi, по сообщениям сетевых источников, продемонстрировала в Китае на мероприятии China International Industrial Expo вычислительный модуль Compute Module 0 (CM0). Ожидается, что новинка поступит в продажу по ориентировочной цене от $18. Основой решения служит система Raspberry Pi RP3A0 SiP (System-in-Package), которая содержит процессор Broadcom BCM2710A1 и 512 Мбайт оперативной памяти LPDDR2. В свою очередь, чип BCM2710A1 объединяет четыре вычислительных ядра Arm Cortex-A53 с частотой 1 ГГц, графический ускоритель VideoCore IV с поддержкой OpenGL ES 1.1/2.0 и VPU-блок с возможностью декодирования материалов H.264/MPEG-4 1080p30 и кодирования H.264 1080p30. Новинка будет доступна в модификациях без встроенной флеш-памяти (Raspberry Pi CM0 Lite), а также с накопителем eMMC вместимостью 8 или 16 Гбайт. В оснащение опционально могут быть включены контроллеры Wi-Fi 4 (802.11b/g/n) и Bluetooth 4.2 LE. Говорится о поддержке интерфейсов SDIO (только Raspberry Pi CM0 Lite), HDMI, TV DAC, MIPI DSI (4 линии), DPI (Display Parallel Interface), MIPI CSI (4 линии), PCM, USB 2.0, 28 × GPIO, UART, SPI, 2 × I2C. Размеры вычислительного модуля составляют 39 × 33 мм. Диапазон рабочих температур простирается от -20 до +85 °C. Для новинки будет доступна дополнительная интерфейсная плата Raspberry Pi CM0 I/O Board. Она оснащена разъёмом HDMI, двумя портами Micro-USB (питание и данные), коннекторами MIPI-DSI и MIPI-CSI, слотом для карты microSD и 40-контактной колодкой GPIO. Решение, как отмечает CNX Software, по всей видимости, сможет работать под управлением Raspberry Pi OS.

24.09.2025 [12:52], Руслан Авдеев

Гигаватт в неделю: OpenAI задумала развернуть крупнейшее производство ИИ-инфраструктурыПо словам главы OpenAI Сэма Альтмана (Sam Altman), ИИ-сервисы растут удивительными темпами, а в будущем они будут ещё более впечатляющими. По его мнению, по мере того как искусственный интеллект становится всё «умнее», доступ к нему становится базовым драйвером экономики и, в конце концов, такой доступ, возможно, признают одним из фундаментальных прав человека. Практически каждый захочет, чтобы ИИ всё больше работал от его имени. Для того, чтобы обеспечить мировые потребности в инференсе и обучении ИИ-моделей для их дальнейшего совершенствования, уже сегодня закладываются основы для значительного расширения строительства ИИ-инфраструктуры. Как утверждает Альтман, если ИИ останется на той траектории развития, которую прогнозируют в компании, пользователям будут доступны весьма впечатляющие возможности. Возможно, обладая 10 ГВт вычислительных мощностей, ИИ сможет найти способ лечения рака или оптимизировать процесс получения знаний для каждого учащегося в мире персонально. Если же человечество будет ограничено в вычислительных мощностях, придётся выбирать, чему отдать приоритет. При этом никто не хочет делать такой сложный выбор, поэтому стоит наращивать вычислительную инфраструктуру. Год назад Альтман убеждал власти США в необходимости постройки целой сети 5-ГВт ЦОД для обеспечения национальной безопасности. OpenAI рассчитывает создать производство, способное создавать 1 ГВт ИИ-инфраструктуры еженедельно. Выполнить этот план будет нелегко, на это уйдут годы и потребуются инновации на всех уровнях, от чипов до энергетики, строительства и робототехники. Тем не менее бизнес активно работает по всем этим направлениям и считает эпохальные изменения возможными. В OpenAI считают, что речь идёт о самом важном инфраструктурном проекте за всю историю, причём компания немало делает в США уже сегодня. При этом Альтман отметил, что «прямо сейчас» некоторые страны строят заводы по производству чипов и новые энергетические мощности намного быстрее, чем в США, но Альтман и его единомышленники намерены изменить такое положение дел. В следующую пару месяцев компания намерена раскрыть некоторые из своих планов, чтобы претворить их в жизнь. Позже в этом году компания расскажет и про финансовую сторону вопроса. С учётом того, что увеличение вычислительных мощностей способствует росту выручки, у компании уже есть некоторые «интересные новые идеи». На днях сообщалось, что OpenAI потратит $100 млрд на аренду резервных ИИ-серверов у облачных провайдеров, а чуть позже появились данные, что NVIDIA инвестирует в OpenAI $100 млрд, в основном пойдут на покупку её же ускорителей.

24.09.2025 [12:27], Руслан Авдеев

OpenAI, Oracle и SoftBank построят в США ещё пять ИИ ЦОД для проекта StargateOpenAI, Oracle и SoftBank объявили о намерении построить пять новых дата-центров для ИИ-проекта Stargate, реализуемого в США, сообщает Reuters. По-видимому, партнёрам удалось преодолеть препятствия, которые мешали активному развитию проекта. По словам главы OpenAI Сэма Альтмана (Sam Altman), ИИ сможет выполнить своё предназначение только если создать для него вычислительную базу. Сообщается об открытии трёх новых дата-центров совместно с Oracle в округах Шакелфорд (Shackelford,Техас), Донья-Ана (Doña Ana, Нью-Мексико) и где-то на Среднем Западе. Ещё два ЦОД построят в Лордстауне (Lordstown, Огайо) и округе Майлам (Milam, Техас) будут построены OpenAI, SoftBank и её дочерней структурой. Новые площадки, расширение кампуса Oracle-OpenAI в Абилине (Abilene, Техас) и совместные проекты с CoreWeave позволят в следующие три года довести общую мощность ЦОД Stargate до почти 7 ГВт, а инвестиции должны превысить $400 млрд. В целом проект предполагал строительство ЦОД мощностью 10 ГВт за $500 млрд. Ранее глава OpenAI заявил, что компания готова потратить триллионы долларов на ИИ-инфраструктуру.

Источник изображения: Mohamed Nohassi/unsplash.com Альтман также сообщил о намерении создать в США фабрику для производства 1 ГВт ИИ-инфраструктуры в неделю. Ранее NVIDIA объявила о намерении инвестировать в OpenAI $100 млрд в обмен на закупки её ИИ-чипов. Но по словам, источников, знакомых с вопросом, OpenAI и партнёры намерены использовать и заёмное финансирование для аренды ИИ-ускорителей в рамках проекта Stargate.

24.09.2025 [11:25], Сергей Карасёв

Luckfox представила PicoKVM — миниатюрный IP-KVM с сенсорным дисплеем и ИИ-блокомКомпания Luckfox, по сообщению ресурса CNX Software, начала приём заказов на устройство PicoKVM, предназначенное для удалённого управления персональными компьютерами, рабочими станциями и серверами. Новинка выполнена на аппаратной платформе Rockchip с прошивкой Buildroot (Linux 5.10.160 и U-Boot). Решение заключено в миниатюрный корпус с размерами 48,5 × 48,5 × 29 мм. В верхней части располагается небольшой информационный дисплей с диагональю 1,54″ и разрешением 240 × 240 пикселей; реализовано сенсорное управление. PicoKVM также предлагается в виде платы (44 × 42 × 23,6 мм) без корпуса и экрана.

Источник изображений: CNX Software Основой служит процессор Rockchip RV1106G3, который содержит ядра Arm Cortex-A7 (1,2 ГГц) и RISC-V. В состав изделия входит NPU-модуль с производительностью до 1 TOPS для ускорения операций, связанных с ИИ. Встроенный блок VPU способен декодировать видеоматериалы в форматах H.265/H.264 с разрешением 3072 × 1728 точек и скоростью 30 к/с. Объём оперативной памяти DDR3L составляет 256 Мбайт. В оснащение входит флеш-чип eMMC вместимостью 8 Гбайт с возможностью расширения при помощи карты microSD.  Устройство наделено сетевым портом 10/100MbE с разъёмом RJ45, интерфейсом HDMI, а также портом USB Type-C для подачи питания, программирования и эмулирования клавиатуры/мыши/USB-накопителей. Предусмотрен дополнительный I/O-разъём с поддержкой GPIO, UART, I2C и пр. Отмечается, что основная часть программного обеспечения PicoKVM (прошивка, SDK и т. д.) имеет открытый исходный код, но некоторые драйверы и медиабиблиотеки являются проприетарными. Стоимость PicoKVM составляет около $60 с корпусом и сенсорным дисплеем, тогда как модификацию в виде платы можно приобрести за $35.

24.09.2025 [09:37], Владимир Мироненко

Расходы ИИ-отрасли к 2030 году могут оказаться на $800 млрд больше её доходовЗаявления ИИ-компаний о планах потратить гигантские суммы на расширение инфраструктуры вызывают у аналитиков резонные вопросы о том, насколько такие вложения экономически и технологически обоснованы и подтверждены расчётами, отмечает Bloomberg. Так, OpenAI намерена со временем потратить триллионы долларов на ИИ ЦОД, но пока не спешит продемонстрировать, как она заработает, чтобы покрыть такие расходы. По оценкам консалтинговой фирмы Bain & Co., дефицит средств может быть гораздо больше, чем предполагалось ранее. Согласно отчёту Bain Global Technology Report к 2030 году компаниям в сфере ИИ потребуется $2 трлн совокупной годовой выручки для покрытия затрат на вычислительные мощности, необходимые для удовлетворения прогнозируемого спроса. Но их выручка, вероятно, будет на $800 млрд меньше этой суммы, поскольку, по прогнозам Bain, монетизация сервисов вроде ChatGPT отстаёт от потребностей в расходах на ЦОД и связанную с ними инфраструктуру. Экономическая эффективность ИИ-решений, т.е. прибыль ИИ-компаний, отстаёт от темпов роста спроса на вычислительные мощности и электроэнергию. OpenAI ежегодно теряет миллиарды долларов и ставит во главу угла рост, а не прибыль, но ожидает выхода на положительный денежный поток к 2029 году, сообщает Bloomberg. По данным Bloomberg Intelligence, к началу следующего десятилетия общие годовые расходы крупнейших технологических компаний, включая Microsoft., Amazon и Meta✴, на ИИ-технологии вырастут до более чем $500 млрд. Выпуск новых ИИ-моделей от OpenAI, DeepSeek и др. стимулирует спрос на ИИ-сервисы и побуждает всю отрасль увеличивать инвестиции. По оценкам Bain, к 2030 году глобальные ИИ-мощности вырастут до 200 ГВт, при этом на США будет приходиться половина этого объёма. Прорывы в разработке технологий и алгоритмов позволят облегчить задачу, однако ограничения в цепочке поставок или дефицит электричества могут помешать прогрессу, утверждают аналитики. «Если нынешние законы масштабирования останутся в силе, ИИ будет создавать всё большую нагрузку на цепочки поставок по всему миру», — отмечает Bain. Помимо инфраструктуры, компании в сфере ИИ тратят огромные средства на разработку продуктов. Одним из направлений является создание ИИ-агентов, способных автономно выполнять многоэтапные задачи. По оценкам Bain, в течение следующих трёх-пяти лет до 10 % расходов компаний на технологии будут приходиться на развитие основных возможностей ИИ, включая платформы ИИ-агентов. Отчёт Bain также содержит прогноз роста в таких областях, как квантовые вычисления. Эта новая технология может увеличить рыночную стоимость на $250 млрд в таких отраслях, как финансы, фармацевтика, логистика и материаловедение. Несмотря на ожидания некоторых аналитиков прорыва, Bain прогнозирует постепенный рост рынка квантовых вычислений с ранним внедрением в узких областях в течение следующих 10 лет и более широким внедрением со временем. Bain также отметила, что гуманоидные роботы становятся всё более распространёнными, привлекая инвестиции, но их внедрение находится на ранней стадии и в значительной степени зависит от человеческого контроля. По словам консалтинговой компании, коммерческий успех этого направления будет зависеть от готовности экосистемы, и компании, которые первыми начнут внедрять роботов, скорее всего, станут лидерами отрасли.

23.09.2025 [17:40], Владимир Мироненко

Oracle назначила сразу двух гендиректоровВ понедельник Oracle объявила о назначении Клэя Магоуйрка (Clay Magouyrk) и Майка Сицилии (Mike Sicilia) новыми гендиректорами, поскольку Сафра Кац (Safra Catz) покидает эту должность после более чем десяти лет руководства, чтобы занять пост исполнительного вице-председателя совета директоров. «Сейчас, когда компания находится на пике своей формы, самое время передать пост генерального директора следующему поколению способных руководителей», — заявила Кац CNBC. По данным источников The Wall Street Journal, 63-летняя Кац не рассчитывала, что останется генеральным директором надолго, так что всё к этому шло. Высшее руководство Oracle начало обсуждать кадровые перестановки несколько месяцев назад, а Кац заявила о своей готовности к ним после успешного квартала Oracle, сообщил источник WSJ. Что примечательно, Oracle называет её преемников генеральными директорами, а не соруководителями. Внутри компании Магоуйрк и Сицилия считаются более сильными специалистами, чем Кац, известная своей финансовой прозорливостью. По словам источника WSJ, их повседневная работа существенно не изменится. Магоуйрк будет курировать облачный бизнес компании, а Сицилия займётся продажей продуктов Oracle. Председатель совета директоров и технический директор Oracle Ларри Эллисон (Larry Ellison) заявил, что оба генеральных директора были выбраны благодаря их лидерским качествам и опыту в области ИИ, пишет CRN. «Многолетний опыт Клэя в руководстве крупным и быстрорастущим подразделением OCI продемонстрировал его готовность к роли генерального директора», — отметил он. Эллисон также сообщил, что Сицилия последние несколько лет занимался модернизацией бизнеса Oracle по разработке отраслевых приложений, включая Oracle Health, с использованием новейших ИИ-технологий. «Несколько лет назад Клэй и Майк начали внедрение ИИ в инфраструктуру и приложения Oracle — и это даёт плоды. Они оба — проверенные лидеры, — сказал Эллисон. — У Oracle блестящее будущее». Клэй Магоуйрк (39 лет) перешёл в компанию в 2014 году из AWS. В качестве одного из основателей команды разработчиков облачных решений Oracle, он руководил разработкой и внедрением в OCI высокопроизводительной облачной платформы второго поколения, которая обеспечивает работу как публичных облачных ЦОД, так и гигаваттных ИИ ЦОД. Как сообщает Oracle, под руководством Магоуйрка OCI добилась роста и стала ведущей платформой для обучения и инференса ИИ. Майк Сицилия (54 года) присоединился к Oracle после приобретения Primavera Systems в 2008 году. Он являлся президентом Oracle Industries, курируя разработку ПО для таких секторов как здравоохранение, банковское дело и розничная торговля, а также продвигая использование генерации приложений на основе намерений и встроенных ИИ-агентов для замены традиционного программирования при разработке приложений Oracle. Эксперты отмечают, что наличие двух человек у руля компании может привести к конфликтам из-за возможного несовпадения характеров. Но положение Oracle уникально, поскольку Ларри Эллисон в значительной степени рассматривается как главный руководитель, принимающий многие стратегические решения и делегирующий полномочия. «Сафра руководила Oracle, когда мы стали гигантом в сфере облачных технологий, что наглядно продемонстрировали наши недавние результаты, — сказал Эллисон. — Мы с Сафрой на посту заместителя председателя сможем продолжить наше 26-летнее партнёрство, помогая Oracle определять направление развития, рост и успех». Oracle также объявила в понедельник, что Марк Хура (Mark Hura), нынешний исполнительный вице-президент по продажам Oracle в Северной Америке, назначен президентом по глобальным операциям. А Даг Керинг (Doug Kehring), нынешний исполнительный вице-президент по операциям, получил повышение в виде назначения на должность главного финансового директора. Ресурс The Register сообщил, что эти решения были приняты спустя несколько недель после того, как в документах WARN была раскрыта информация об очередном раунде сокращений в Oracle, включающем увольнение более 350 сотрудников в Калифорнии и Вашингтоне. По данным источников, сокращение персонала по всему миру может исчисляться тысячами человек и, по некоторым оценкам, составляет до 12 тыс. специалистов. Компания предпочитает не афишировать масштабы увольнения, но они вызвали беспокойство внутри Oracle, особенно в командах разработчиков, отметил The Register. В частности, в подразделении MySQL было уволено около 70 человек, включая опытных специалистов.

23.09.2025 [17:07], Руслан Авдеев

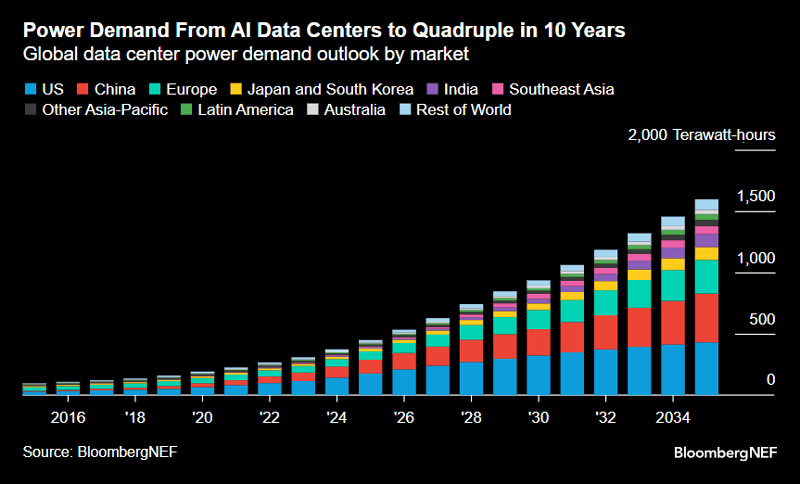

BloombergNEF: ИИ ЦОД способствуют ускорению роста спроса на электричествоУскоряющееся развитие ИИ-технологий превращает дата-центры в ключевых потребителей энергии. По мнению экспертов, связанный с обучением искусственного интеллекта и ИИ-сервисами спрос на электричество за десятилетие вырастет вчетверо, что сделает ЦОД одними из наиболее динамично растущих энергопотребителей в мире, Bloomberg. В краткосрочной перспективе нарастающий дефицит энергии, вероятно, поможет покрыть генерация на ископаемом топливе. В долгосрочной перспективе победителем, как ожидается, окажется «чистая» энергия, поскольку операторам ЦОД приходится учитывать давление политиков, заявленные цели по достижению нулевых выбросов и мнение собственных клиентов, требующих роста, но не желающих наносить лишний ущерб окружающей среде. К 2035 году энергопотребление ЦОД достигнет 1,6 тыс. ТВт∙ч, т.е. около 4,4 % от общемирового. Фактически, по уровню потребления речь идёт о четвёртом месте после Китая, США и Индии. Наибольшие изменения ожидаются в США — предполагается, что страна останется крупнейшим в мире рынком ЦОД в течение десятилетия. По темпам роста спроса на электричество в ключевых регионах США дата-центры, в частности, обгоняют электромобили и другие перспективные технологии.

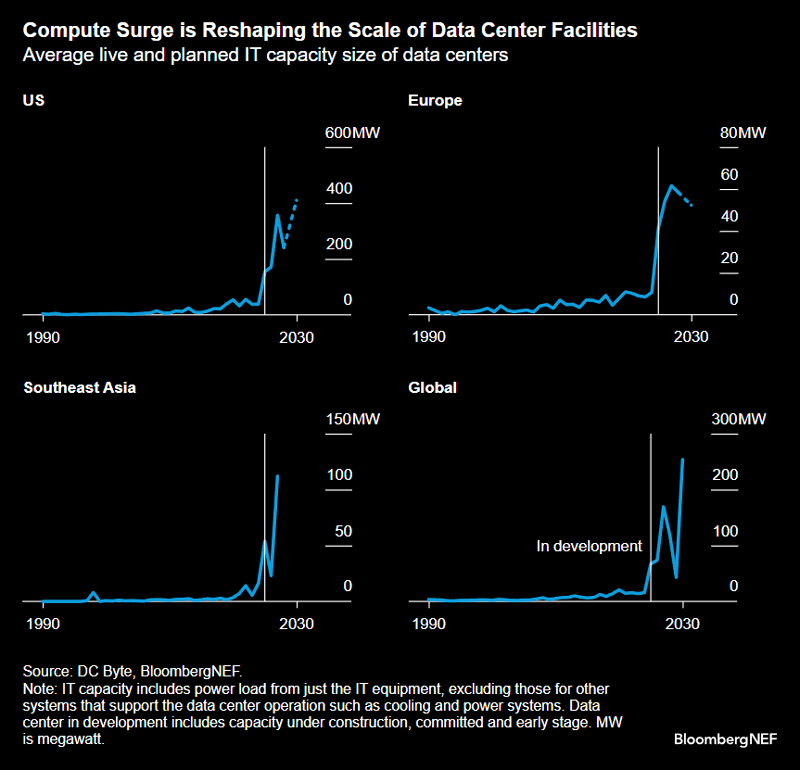

Источник изображения: BloombergNEF ИИ-инфраструктура стала самым значимым элементом энергетического ландшафта. Если ещё в 2010 года более половины всех ЦОД потребляли менее 5 МВт, то теперь стандартный планируемый дата-центр требует уже сотни мегаватт, а некоторые замахиваются и на гигаваттные масштабы. В то же время повышается эффективность оборудования. По прогнозам экспертов, к 2030 году средний коэффициент энергоэффективности (PUE) ЦОД должен уменьшиться с 1,4 до 1,2. Однако рост спроса на вычислительные мощности не позволит в полной мере компенсировать рост энергоэффективности.

Источник изображения: BloombergNEF Обучение ИИ-моделей требует высокой концентрации вычислительных мощностей, поэтому возникает новый класс ЦОД, преобразующих не только облака, но и сами электросети. Бум ИИ сегодня — не просто вычислительная задача, но и энергетическая гонка. Для передовых участников рынка доступ к электричеству жизненно необходим. Компании быстро строят объекты, часто ещё до появления поступлений от клиентов, причём приоритет отдаётся площадкам с быстрым доступом к электричеству, земле и разрешениям регуляторов. Лидерами в США традиционно выступают Вирджиния, Орегон, Техас и Огайо, но появляются и новые территории, поскольку скорость доступа к энергии и другим ресурсам иногда может быть важнее близости к конечным пользователям ИИ.

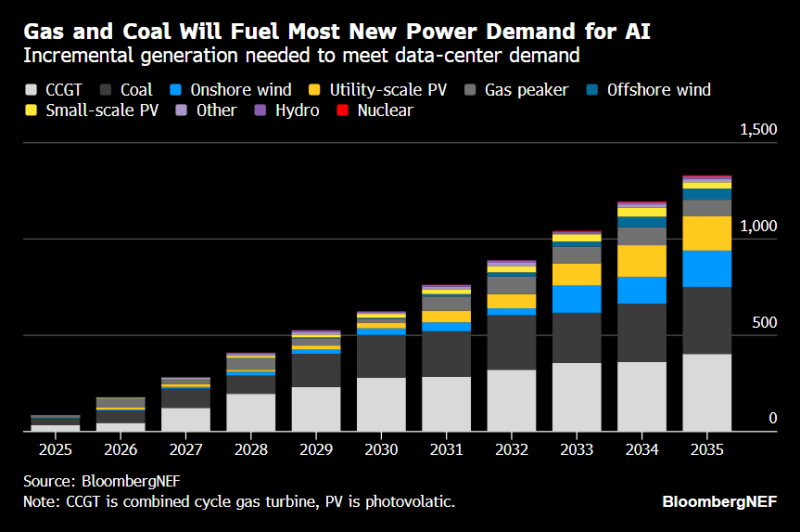

Источник изображения: BloombergNEF Удовлетворение спроса подразумевает использование существующих и новых энергосистем. В краткосрочной перспективе ставка делается на природный газ — именно газовые электростанции обеспечивают электроэнергией значительную часть новых ЦОД в Соединённых Штата, особенно там, где это топливо является ключевым энергоносителем. На днях появилась новость о том, что Meta✴ намерена стать энергокомпанией и самой продавать электричество для эффективного управления потребностями своих ЦОД, а AWS, Google и Microsoft уже делают то же самое. В начале сентября президент США Дональд Трамп (Donald Trump) пообещал операторам ЦОД решить проблемы с энергоснабжением дата-центров с помощью комплекса специальных мер.

23.09.2025 [16:21], Сергей Карасёв

РСК и «ХайТэк» представили ПАК с российскими ИИ-ускорителями LinQ HPQГруппа компаний РСК и российский разработчик ИИ-ускорителей «ХайТэк» представили отечественный программно-аппаратный комплекс LinQ HPC для ресурсоёмких ИИ-нагрузок. Производительность этой системы достигает 1920 TOPS на операциях INT8. В основу решения положены два узла LinQ HPS, в состав которых входят десять PCIe-ускорителей LinQ HPQ, разработанных компанией «ХайТэк». В свою очередь, каждый ускоритель несёт на борту четыре фирменных тензорных процессора LinQ H с тактовой частотой 500–812 МГц и памятью DDR4 ECC. По заявлениям «ХайТэк», ИИ-производительность одного чипа LinQ H составляет до 24 TOPS. Таким образом, у карт LinQ HPQ это значение достигает 96 TOPS, а у одного узла LinQ HPS — 960 TOPS. При соединении двух узлов обеспечивается показатель в 1920 TOPS. Задействованы внешний массив PCIe-коммутации RSC ScaleStream-C разработки группы компаний РСК и сервер, входящий в реестр Минпромторга РФ. Система LinQ HPC оперирует в общей сложности 1280 Гбайт многоканальной памяти DDR4 ECC, что позволяет обрабатывать большие объёмы данных и одновременно запускать более 100 моделей. При этом задержка составляет 2,3 мс для ResNet-50 с возможностью снижения до 1,5 мс при оптимизации. Говорится о поддержке TensorFlow 2.x и PyTorch. Заявленное энергопотребление находится на уровне 3000 Вт. Это достигается благодаря интеллектуальному управлению частотами чипов и адаптивному контролю посредством специализированного ПО. Встроенные алгоритмы температурного мониторинга и динамического управления рабочей частотой автоматически оптимизируют параметры, обеспечивая стабильное функционирование комплекса при различных нагрузках. В результате, достигается снижение операционных расходов на электроэнергию и охлаждение. Ключевым преимуществом LinQ HPC, как отмечают разработчики, является отказ от зарубежных решений, которые могут содержать скрытые уязвимости. В составе платформы не применяется стороняя интеллектуальная собственность. LinQ HPC подходит для решения различных задач, связанных с ИИ. Среди них названы предиктивное обслуживание оборудования, оптимизация энергопотребления, автоматизированный контроль качества производственных процессов, обнаружение мошенничества при финансовых операциях, а также интеллектуальная видеоаналитика в реальном времени, включая распознавание лиц, поведенческий анализ и контроль критически важных объектов. Система также может использоваться для ИИ-инференса и создания рекомендательных сервисов. |

|