Материалы по тегу: cpu

|

04.07.2025 [19:50], Владимир Мироненко

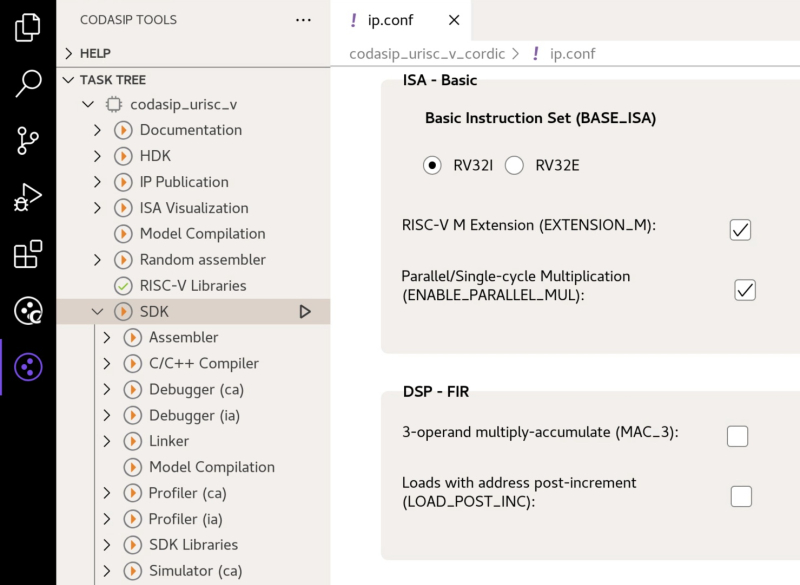

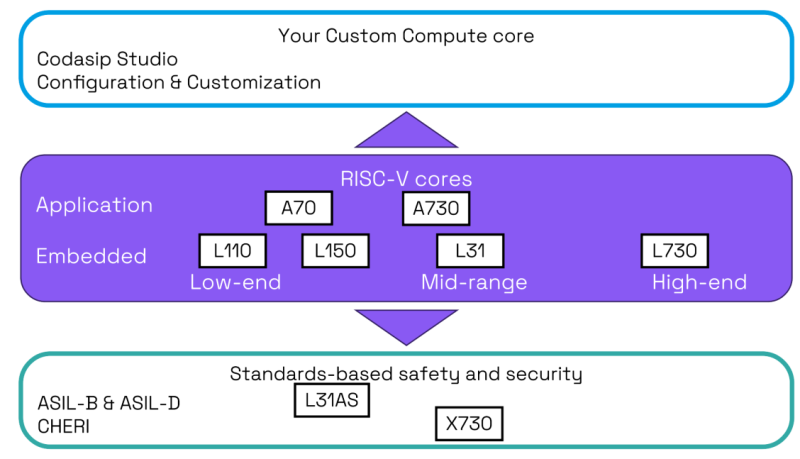

Разработчик RISC-V-чипов Codasip готов продаться — целиком или по частямРазработчик чипов с архитектурой RISC-V и инструментов проектирования из Мюнхена Codasip объявил о готовности продать свои активы, сославшись на проявление к ним интереса со стороны компаний во время недавнего раунда финансирования. Компания сообщила, что процесс приёма заявок на покупку, начавшийся 1 июля, продлится три месяца, что, по мнению ресурса The Register, может указывать на уже поступившие предложения. Ландшафт открытой архитектуры RISC-V превращается из экосистемы сотрудничества в высококонкурентную коммерческую среду, отметил ресурс EE Times. На фоне этого один из основных поставщиков EDA-инструментов Synopsys запустил полный набор основных IP-блоков RISC-V. Попутно крупные игроки рынка полупроводников, такие как Bosch, Infineon, NXP, Qualcomm и Nordic Semiconductor, сформировали консорциум Quintauris для разработки собственных процессорных решений для автомобильного сектора. В связи с этим Codasip попала в сложное положение, оказавшись между гигантами, предлагающими интегрированные решения, и крупными вертикальными игроками, разрабатывающими собственные продукты на базе RISC-V, что потенциально может сократить её целевой рынок. Codasip сообщила, что у неё есть несколько бизнес-подразделений, нацеленных на четыре ключевых направления продуктов, с «отделимыми» R&D-командами, намекая таким образом, что можно купить отдельные группы, а не компанию целиком.

Источник изображений: Codasip Как пишет The Register, у Codasip предполагаемая годовая выручка составляет $88,7 млн, что делает её одним из крупнейших разработчиков микросхем в экосистеме RISC-V. У Ventana Micro Systems предполагаемая выручка составляет $37,4 млн за год, а SiFive ожидала получить около $60 млн в прошлом году. Хотя RISC-V вызывает определённый интерес, предлагая открытый набор инструкций, лёгких путей для построения успешного бизнеса здесь не обещают — SiFive ранее уволила 20 % штата, Intel отказалась от программы Pathfinder for RISC-V, а Imagination Technologies отказалась от RISC-V, сосредоточившись на продуктах GPU и ИИ. У Codasip есть портфолио решений для прикладных и встраиваемых процессоров и портфолио процессоров с архитектурой безопасности CHERI с аппаратной защитой памяти, а также сопутствующее ПО. Отдельно разрабатываются высокопроизводительные прикладные процессоры в рамках проекта Евросоюза Digital Autonomy with RISC-V in Europe (DARE). Наконец, у компании есть и собственные EDA-инструменты для разработки и кастомизации чипов. Немалую часть средств компании приносят гранты от различных органов ЕС, многочисленных общеевропейских и национальных проектов, включая DARE, TRISTAN и NEUROKIT2E — более €119 млн ($140 млн). Однако большая часть этих денег пока не получена компанией. На следующих этапах грантовой поддержки компания может получить ещё €210 млн ($248 млн). Codasip также утверждает, что является частью новых консорциумов и проектов, которые могут принести ей финансирование в размере €51 млн ($60) или больше. По словам компании, эти средства могут быть переданы покупателю на разумных условиях. «В первую очередь, быть разработчиком CPU — это дорогостоящий бизнес, поэтому долгосрочное финансирование имеет важное значение — если рыночное признание низкое, доходы не появятся немедленно», — отметил Эндрю Басс (Andrew Buss), старший директор по исследованиям IDC в регионе EMEA. По оценкам EE Times, потенциальные приобретатели Codasip делятся на три категории. Первая включает гигантов в сфере EDA и интеллектуальной собственности (IP), таких как Synopsys, для которой приобретение Codasip означает возможность консолидации рынка благодаря получению уникального набора инструментов Codasip Studio, расширению портфеля интеллектуальной собственности и устранению значительного конкурента. Вторая категория состоит из вертикальных интеграторов, в основном американских технологических титанов, таких как Intel, Qualcomm и Broadcom. Intel уже предлагала в 2021 году более $2 млрд за SiFive, но сделка не состоялась. Приобретение Codasip даст Intel зрелый портфель интеллектуальной собственности для клиентов Intel Foundry Services (IFS), а также надёжную, отличающуюся от x86 архитектуру для собственных продуктов. Для Qualcomm, судящейся с Arm, сделка означала бы снижение зависимости от архитектуры Arm. Сертифицированные IP-блоки для автомобильных решений Codasip идеально соответствует роли Qualcomm в качестве соучредителя в Quintauris, пишет EE Times. Broadcom может быть интересен набор Codasip Custom Compute, который она могла бы использовать для внутренних ядер контроллеров в SoC. Хотя вероятность заявки от Broadcom довольно низкая. И, наконец, третья категория — организации ЕС, которые могли бы купить Codasip для потенциального европейского консорциума. Европейский союз сделал технологический суверенитет центральной политической целью, что очевидно на примере таких инициатив, как «Европейский закон о чипах» (European Chips Act). Для Евросоюза покупка является стратегической: не допустить приобретения неевропейской организацией критически важного европейского технологического актива, в значительной степени субсидируемого за счет средств ЕС. Покупатель из страны, не входящей в ЕС, должен будет предоставить твёрдые, юридически обязывающие обязательства по поддержанию и развитию европейских центров НИОКР Codasip, обеспечению постоянного участия в стратегических проектах ЕС и в целом соответствию технологической повестке ЕС, подчеркнул EE Times.

02.07.2025 [08:35], Руслан Авдеев

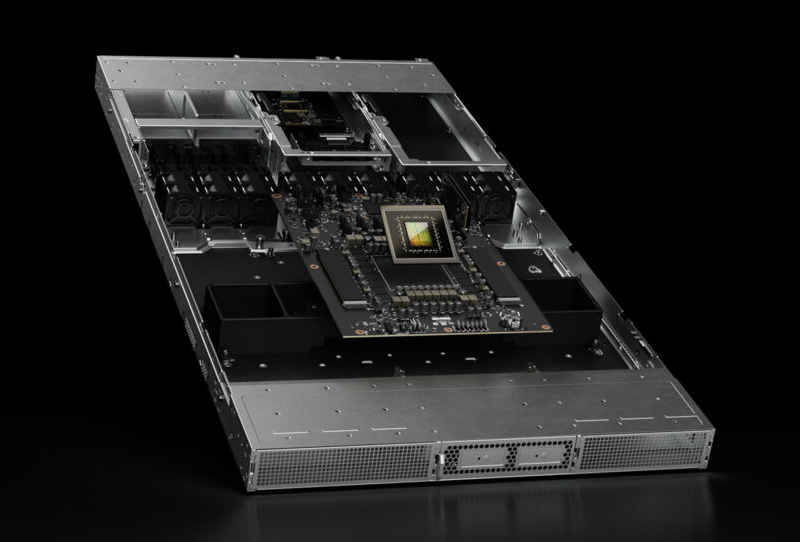

Arm-чипы захватывают рынок, но до доминирования в ЦОД им пока далекоСерверы на базе Arm-чипов стремительно набирают популярность — в 2025 году их поставки должны вырасти на 70 %. Тем не менее, этого не хвататит, чтобы к концу года добиться планируемого Arm Holdings охвата рынка в 50 %, сообщает The Register. Аналитики IDC утверждают, что Arm-серверы пользуются массовым спросом в основном благодаря стоечным системам вроде NVIDIA GB200 NVL72. В новейшем отчёте Worldwide Quarterly Server Tracker эксперты IDC подсчитали, что в текущем году на Arm-серверы придётся 21,1 % от общего объёма мировых поставок. Ожидается, что поставки серверов с хотя бы одним ИИ-ускорителем вырастут на 46,7 %, на них придётся в текущем году около половины рыночной стоимости. Всего за три года, по оценкам IDC, рынок серверов должен вырасти втрое благодаря гиперскейлерам и облачным провайдерам. В целом рынок серверов достиг в I квартале 2025 года $95,2 млрд, увеличившись год к году на 134,1 %. В результате IDC повысила прогноз на год до $366 млрд, на 44,6 % выше год к году — исторический максимум для данного сегмента. При этом поставки «стандартных» x86-серверов должны вырасти в 2025 году на 39,9 % до $283,9 млрд. При этом доля AMD непрерывно растёт. Сегмент альтернативных систем вырастет на 63,7 % год к году, а их общий прогнозируемый объём составит $82 млрд. По прогнозам IDC, наибольший рост, на 59,7 % год к году ожидается в США. К концу 2025 года на данный рынок будет приходиться почти 62 % общей выручки от продаж серверов. Ещё одной точкой роста является Китай. IDC прогнозирует рост на 39,5 % — более 21 % квартального дохода во всём мире. Регионы EMEA и Латинская Америка могут рассчитывать на 7 % и 0,7 % соответственно, а Канаду, вероятно, ожидает спад на 9,6 % из-за некой «очень крупной сделки» 2024 года. В IDC подчёркивают, что спрос на большие вычислительные мощности для ИИ, вероятно, сохранится — эволюция от старых чат-ботов к рассуждающим моделям и агентному ИИ потребует роста производительности на несколько порядков, особенно для инференса.

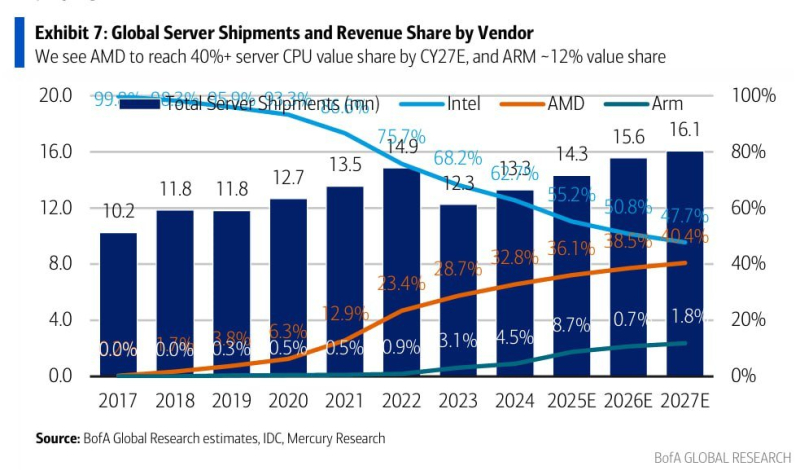

27.06.2025 [23:45], Владимир Мироненко

Intel скоро «догонит» AMD по доле рынка серверных процессоровУспехи AMD в разработке серверных процессоров EPYC на фоне проблем Intel с запуском некоторых поколений Xeon привели к постоянному росту в последние годы доли рынка серверных процессоров AMD, причём как по количеству единиц, так и по выручке, пишет ресурс HardwareLuxx. Впрочем, и AMD, и Intel уже угрожает Arm. В последнем отчёте Bank of America отмечается, что если в 2017 году доля рынка Intel составляла почти 100 %, в то время как процессоры AMD и Arm на нём практически, то в 2024 году доля AMD на рынке серверных процессоров составила около 33 % (и продолжает расти), а доля рынка Intel сократилась почти до 63 %. Переломный момент наступил после появления архитектуры AMD Zen и проблем Intel с переводом Xeon на более тонкие техпроцессы. К концу 2022 года доля рынка AMD превысила отметку в 20 %, в то время как доля Intel впервые упала ниже 75 %. Согласно оценкам Bank of America, основанным на данных IDC и Mercury Research, доля AMD на рынке серверных процессоров вырастет в 2025 году примерно до 36 %, в то время как доля Intel снизится примерно до 55 %. Также растёт конкуренция со стороны серверных процессоров с архитектурой Arm, поскольку поставщики облачных услуг ищут более энергоэффективные и экономичные варианты, а совокупная стоимость владения (TCO) в ЦОД становится все более важным фактором. Прогнозируется, что в следующем году на них будет приходиться примерно 9 % рынка серверных процессоров. В 2027 году, как ожидается доля рынка AMD может достичь 40 %, а доля Intel упадет ниже 50 %. Доля процессоров с Arm-архитектурой может составить от 10 до 12 %. Сама Arm Holdings намерена уже до конца этого занять половину рынка чипов для ЦОД, куда, впрочем, входят не только CPU. SoftBank, владеющая крупнейшей долей в Arm Holdings, решила приобрести разработчики серверных Arm-процессоров Ampere Computing. С 2028 года ожидается, что AMD и Intel будут в равных условиях. Следует отметить, что речь идёт о доле рынка исходя из выручки, то есть о продажах в денежном выражении, а не в количественном. Доход AMD в основном приносят высокопроизводительные многоядерные процессоры, в то время как Intel по-прежнему выпускает различные недорогие чипы. Как полагают аналитики, эта тенденция вряд ли изменится. AMD демонстрирует устойчивое развитие в серверном сегменте и готовит процессоры Venice, в то время как Intel пытается переломить ситуацию с помощью серии Xeon 6.

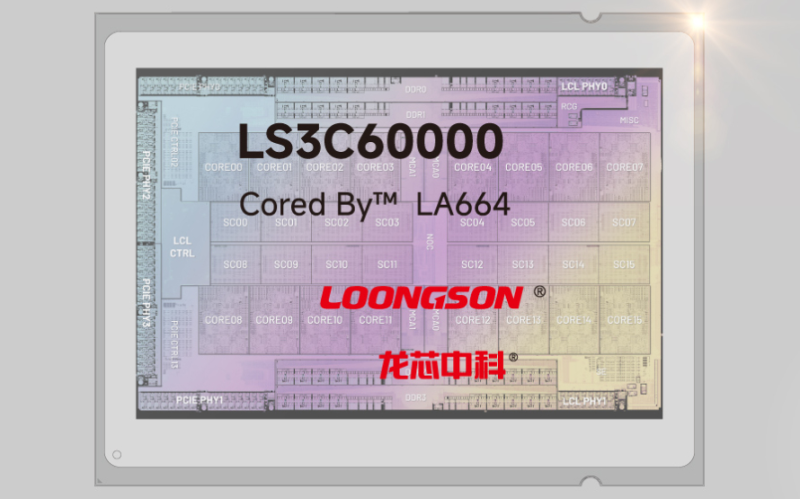

26.06.2025 [17:49], Алексей Степин

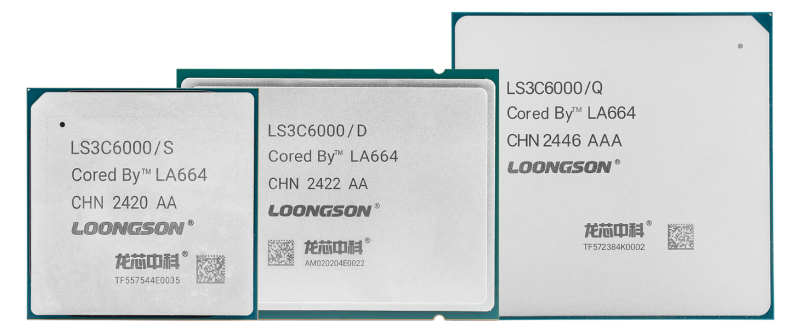

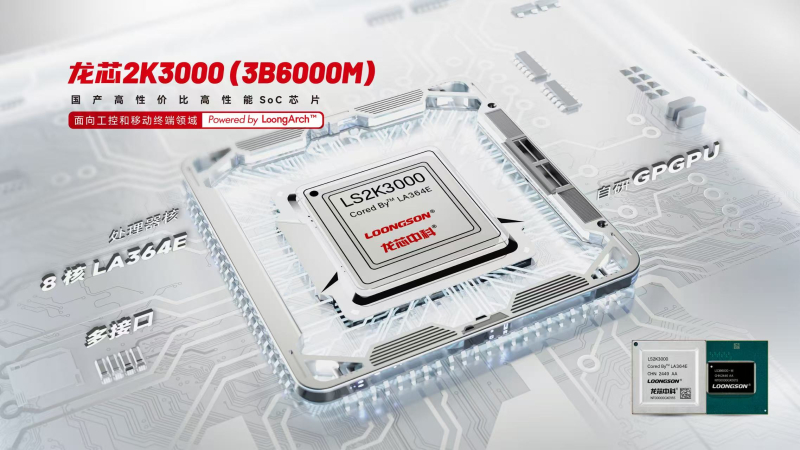

Loongson представила 64-ядерные серверные процессоры 3C6000 на базе LoongArchLoongson получила опытные образцы процессоров 3C6000 на базе архитектуры LoongArch ещё год назад, а сегодня китайская компания официально представила новинки. Эти процессоры, предназначенные для внутреннего рынка КНР, имеют чиплетную компоновку и содержат до 64 ядер LA664 с поддержкой SMT2. Это уже четвёртое поколение процессоров Longsoon с архитектурой LoongArch. Чиплетную компоновку сегодня используют все, и Loongson не исключение. Чиплетов в составе процессоров 3C6000 может быть от одного до четырёх. Чипы с литерой S имеют единственный чиплет, с D — два, а возглавляющие модельный ряд модели c индексом Q в названии несут на борту четыре 16-ядерных чиплета. Помимо стандартного набора инструкций LoongArch, имеется поддержка 126/256-бит векторных расширений. Дополнительно наличествует ядро LA264 (Loongson SE), выполняющее роль сопроцессора безопасности. Ядра LA664 имеют по 64 Кбайт кеша инструкций и данных, 256 Кбайт кеша L2, но кеш L3 общий, объёмом 32 Мбайт на чиплет. Дизайн ядер суперскалярный, с внеочередным исполнением с обработкой шести инструкций за такт. Каждое ядро содержит четыре целочисленных блока, четыре блока векторных операций и четыре модуля доступа к памяти. Подсистема памяти представлена четырёхканальным контроллером DDR4-3200, но многоядерные модели серий D и Q включают уже восемь каналов, а также могут работать в составе двух- и четырёхсокетных платформ. Базовые тактовые частоты ядер Loongson 3C6000 лежат в пределах 2,0–2,2 ГГц, но архитектура LA664 на частоте 2,2 ГГц показывает себя эффективнее в обработке целочисленных данных, нежели Xeon Scalable третьего поколения (Ice Lake-SP) на частоте 2,4 ГГц, хотя в вычислениях с плавающей запятой она, как было показано на презентации, несколько слабее. Речь о тестах SPEC CPU 2017, в ближайшее время ожидаются первые результаты новинок в других бенчмарках. На официальной сайте даны следующие показатели FP64-производительности: 844,8 Гфлопс на частоте 2,2 ГГц у S-модели, 1612,8 Гфлопс на частоте 2,1 ГГц у D-модели и 3072 Гфлопс на частоте 2,0 ГГц у Q-модели. Для связи между чиплетами применён фирменный интерконнект DragonChain. С внешним же миром процессоры общаются посредством интерфейса PCI Express 4.0 — 64 линии имеется даже у младших S-моделей, а у D и Q их уже 128. Теплопакет у одночиплетных процессоров укладывается в диапазон от 100 до 120 Вт, для более мощных моделей этот показатель варьируется в пределах 180 — 200 Вт для чипов D, для наиболее мощных Q он составляет от 250 до 300 Вт. Вместе с 3C6000 компания анонсировала процессоры 2K3000 и 3B6000M. Это сравнительно маломощные решения на базе архитектуры LA364E, содержащие до 8 ядер с частотой до 2,5 ГГц, а также интегрированный видеоускоритель LG200 (в предыдущих моделях использовался LG100) с производительностью 256 Гфлопс в режиме FP32. Имеется и ИИ-сопроцессор мощностью 8 Топс (INT8). Эти решения нацелены на применение в индустриальных системах, умных киосках и мобильных терминалах. Анонс новых решений Loongson очень важен для китайского рынка и страны в целом, особенно на фоне санкций со стороны США, не позволяющих КНР использовать решения Intel и AMD в вычислительных системах государственного сектора. Начало массового производства новых многоядерных процессоров Loongson 3C6000 должно если не решить проблему полностью, то заметно сгладить её.

23.06.2025 [09:05], Сергей Карасёв

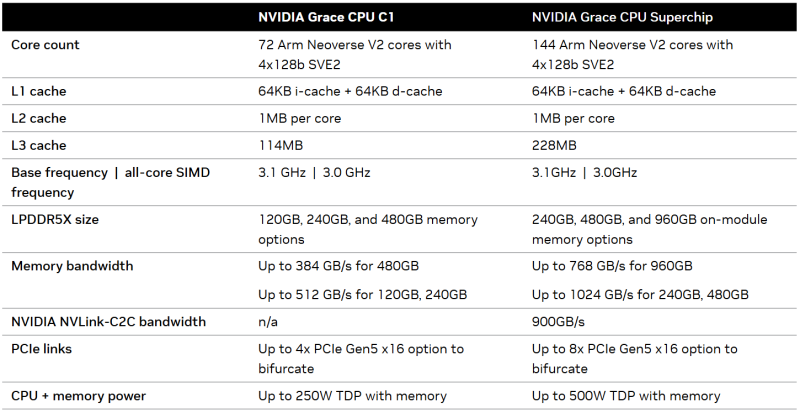

Половинка суперчипа: Arm-процессор NVIDIA Grace C1 набирает популярность в телеком-оборудовании, СХД и на периферииКомпания NVIDIA отметила рост популярности своего Arm-процессора Grace C1 среди ключевых ODM-партнёров. Изделие применяется в телекоммуникационном оборудовании, СХД, периферийных и облачных решениях, а также в других системах, где первостепенное значение имеет показатель производительности в расчёте на ватт затрачиваемой энергии. Архитектура NVIDIA Grace на сегодняшний день представлена в двух основных конфигурациях: это двухпроцессорный Grace Superchip и новый однопроцессорный Grace CPU C1. Последний содержит 72 ядра Arm Neoverse V2 (Armv9) с поддержкой векторных расширений SVE2. Объём кеша L2 составляет 1 Мбайт в расчёте на ядро. Кроме того, есть 114 Мбайт кеша L3. Тактовая частота достигает 3,1 ГГц.

Источник изображения: NVIDIA Процессор Grace CPU C1 функционирует в связке со 120, 240 или 480 Гбайт памяти LPDDR5X, пропускная способность которой достигает 512 Гбайт/с (384 Гбайт/с для варианта 480 Гбайт). Реализована поддержка четырёх массивов PCIe 5.0 x16, что даёт в общей сложности 64 линии (поддерживается бифуркация). Показатель TDP составляет до 250 Вт (вместе с памятью). По заявлениям NVIDIA, системы на базе Grace CPU C1 демонстрируют двукратное повышение производительности на ватт затрачиваемой энергии по сравнению с сопоставимыми по классу продуктами, построенными на чипах с архитектурой х86. Устройства на основе Grace CPU C1 проектируют такие компании, как Foxconn, Jabil, Lanner, MiTAC, Supermicro и QCT. В телекоммуникационной отрасли, как отмечается, востребован компьютер NVIDIA Compact Aerial RAN, объединяющий процессор Grace CPU C1 с ускорителем NVIDIA L4 и адаптером NVIDIA ConnectX-7 SmartNIC. Кроме того, Grace CPU C1 применяется в системах хранения WEKA и Supermicro.

19.06.2025 [11:21], Сергей Карасёв

AWS готовит чип Graviton и ускоритель Trainium следующего поколенияОблачная платформа Amazon Web Services (AWS), по сообщению ресурса CNBC, готовит обновлённую модификацию своего серверного процессора Graviton4, а также ускоритель Trainium следующего поколения, предназначенный для ресурсоёмких приложений ИИ. Оригинальная версия Graviton4 дебютировала в конце 2023 года. Изделие, разработанное подразделением Annapurna Labs в составе AWS, содержит 96 ядер Neoverse V2 Demeter с 2 Мбайт кеша L2 в расчёте на ядро. Используются 12 каналов памяти DDR5-5600. В общей сложности чип насчитывает 73 млрд транзисторов и изготавливается по 4-нм техпроцессу TSMC. По имеющейся информации, у инстансов на базе обновлённой версии Graviton4 пропускная способность сетевой подсистемы увеличится в 12 раз — с нынешних 50 Гбит/с до 600 Гбит/с. Прочие технические характеристики готовящегося изделия не раскрываются, но известно, что информацию о сроках его доступности AWS раскроет до конца текущего месяца. Сообщается также, что ускоритель Trainium следующего поколения выйдет до конца текущего года. Нынешнее решение Trainium2, основанное на ядрах NeuronCore-V3, было представлено в ноябре 2023-го. Его производительность достигает 1,29 Пфлопс в режиме FP8. Утверждается, что быстродействие Trainium3 увеличится в два раза, то есть будет составлять до 2,58 Пфлопс (FP8). Ранее появлялась информация, что энергопотребление Trainium3 может достигать 1000 Вт. Теперь говорится, что в плане энергетической эффективности ИИ-ускоритель нового поколения на 50 % превзойдёт предшественника. Возможно, имеется в виду быстродействие в расчёте на 1 Вт затрачиваемой энергии.

16.06.2025 [09:20], Владимир Мироненко

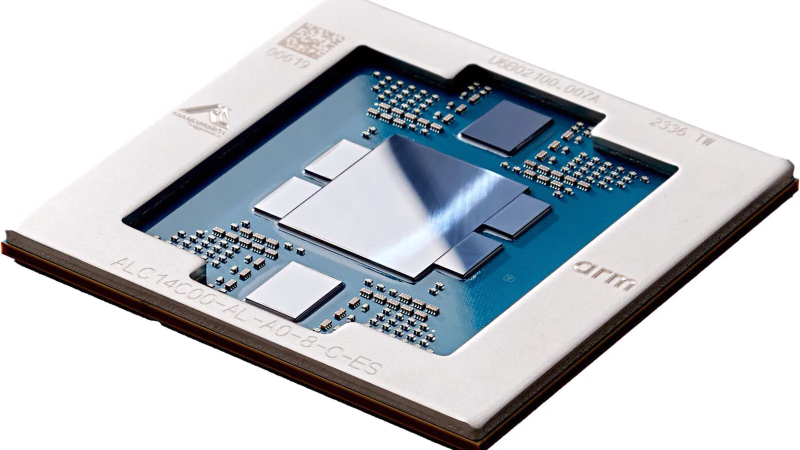

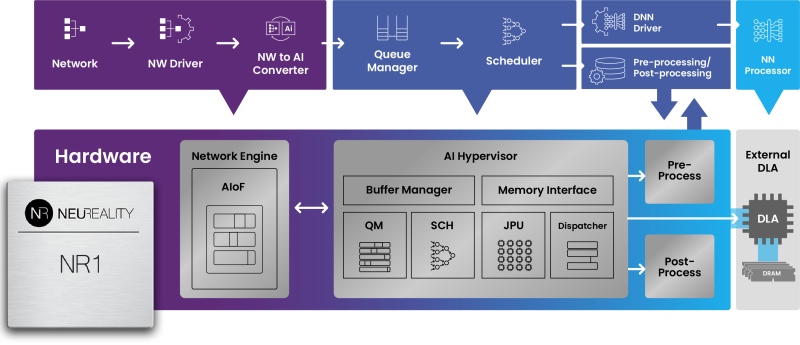

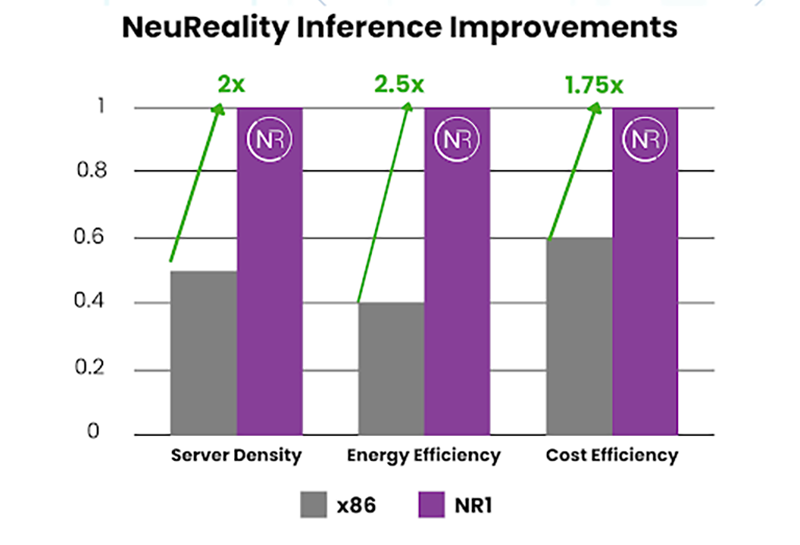

x86 не нужен: «недопроцессор» NeuReality NR1 кратно ускоряет инференс на любых GPUNeuReality объявила о выходе чипа NR1, специально созданного для оркестрации инференса, передаёт HPCwire. Он сочетается с любым GPU или ИИ-ускорителем, позволяя повысить эффективность использование GPU почти до 100 % по сравнению со средним показателем в 30–50 % при традиционном сочетании классического процессора и сетевого адаптера в современных серверах. Чип NR1 призван заменить традиционные CPU и NIC, которые являются узким местом для ИИ-нагрузок, предлагая вместе с тем шестикратное увеличение вычислительной мощности для обеспечения максимальной пропускной способности ускорителей и масштабного ИИ-инференса, утверждает разработчик. Как отметила компания, в течение многих лет разработчики развивали GPU, чтобы соответствовать требованиям ИИ, делая их быстрее и мощнее. Но традиционные CPU, разработанные для эпохи интернета, а не эпохи ИИ, в основном не менялись, становясь узким местом, поскольку ИИ-модели становятся всё более сложными, а запросы ИИ-нагрузок растут в объёме. NR1 включает все базовые функции CPU, необходимые для работы с ИИ-задачами, выделенные обработчики мультимедиа и данных, аппаратный гипервизор и комплексные сетевые IP-блоки, что обеспечивает значительно более высокую производительность, более низкое энергопотребление и окупаемость инвестиций. В тестах самой компании исполнение одной и той же модели на базе генеративного ИИ на одном и том же ИИ-ускорителе её чип NR1 позволяет получить в 6,5 раза больше токенов, чем x86-сервер при той же стоимости и энергопотреблении.  В соответствии с текущей тенденцией на разделение ресурсов хранения и вычислений, дезагрегация ИИ-ресурсов обеспечивает оптимизированную изоляцию ИИ-вычислений, отметила NeuReality. Такое разделение особенно важно в ЦОД и облаках. Традиционные программно-управляемые платформы, ориентированные на CPU, сталкиваются с такими проблемами, как высокая стоимость, энергопотребление и узкие места в системе при обработке задач ИИ-инференса. Сложность современной инфраструктуры и высокая стоимость часто ограничивают использование всех возможностей инференса, утверждает NeuReality. NR1 ориентирован на комплексную разгрузку ИИ-конвейера. Аппаратный ИИ-гипервизор отвечает за обработку путей данных и планирование заданий, охватывая механизмы пред- и постобработки данных, а также сетевой движок AI-over-Fabric. Благодаря этому достигнуто оптимальное соотношение цены и производительности и самые низкие эксплуатационные расходы, характеризующиеся низким энергопотреблением, минимальной задержкой и линейной масштабируемостью, говорит компания. Для DevOps и MLOps компания предоставляет полный SDK и сервисный слой на основе Kubernetes. Новый чип предлагается использовать для решения задач в сфере финансов и страхования, здравоохранении и фармацевтике, госуслугах и образовании, телекоммуникации, ретейле и электронной коммерции, для нагрузок генеративного и агентного ИИ, компьютерного зрения и т.д. NeuReality NR1 включает:

05.06.2025 [14:49], Сергей Карасёв

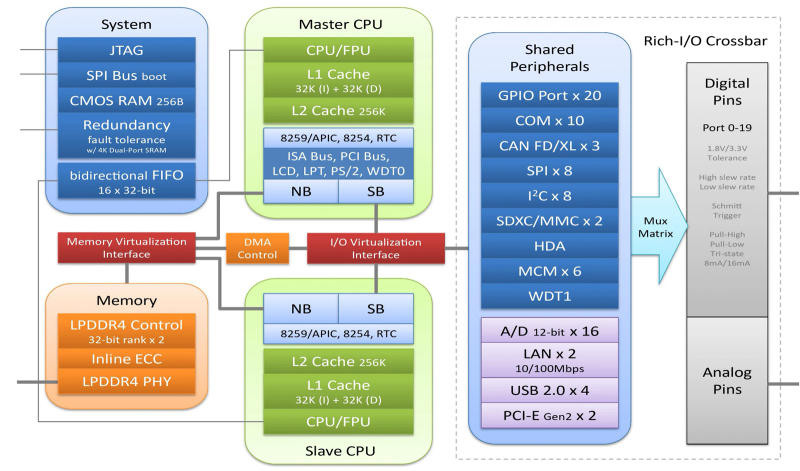

Два ядра, два BIOS, две ОС: DM&P представила x86-процессор Vortex86EX3Тайваньская компания DM&P Electronics, по сообщению ресурса CNX Software, подготовила к выпуску чип Vortex86EX3 — своё самое производительное решение с архитектурой x86. Процессор ориентирован на применение в индустриальной сфере, на что, в частности, указывает его широкий диапазон рабочих температур, который простирается от -40 до +85 °C. Изделие оснащено двумя вычислительными ядрами с тактовой частотой 1,2–1,6 ГГц. Они функционируют в конфигурации Master–Slave с двумя независимыми экземплярами BIOS и возможностью одновременного запуска двух ОС без применения гипервизора и средств виртуализации. Блок Master служит для поддержания работы пользовательского интерфейса и приложений, тогда как блок Slave отвечает за интерфейсы ввода-вывода в реальном времени. Каждое из ядер содержит 256 Кбайт кеша L2, а также по 32 Кбайт L1-кеша команд и данных. Процессор поддерживает работу с памятью LPDDR4 (ЕСС). Есть два интерфейса SD/eMMC, две линии PCIe 2.0, два сетевых интерфейса 10/100MbE и один параллельный порт. Прочие характеристики таковы: 4 × USB 2.0, 10 × COM, 20 × GPIO, 8 × SPI, 8 × I2C, 3 × CAN. Реализованы контроллеры HD-Audio и LCD. Чип выполнен в корпусе BGA (627 контактов) с размерами 17 × 17 мм.

Источник изображения: CNX Software Для новинки заявлена поддержка Windows 10, WinCE 5/6/7, Linux 2.x–6.6, QNX 7.0, RTOS-32, DOS и Yocto Project. Компания DM&P в партнёрстве с ICOP Technology продемонстрировала возможность одновременного запуска на Vortex86EX3 платформ Linux (Debian) и Windows Embedded Compact 7. Процессор может использоваться в том числе в системах автоматизации, функционирующих в реальном времени.

23.05.2025 [15:22], Владимир Мироненко

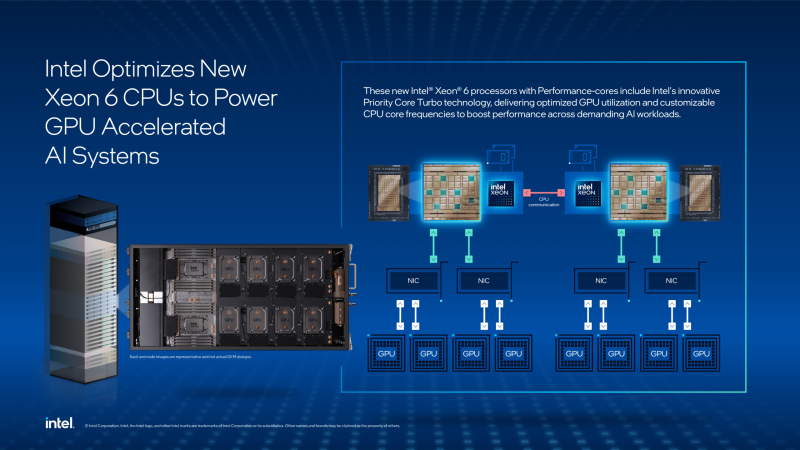

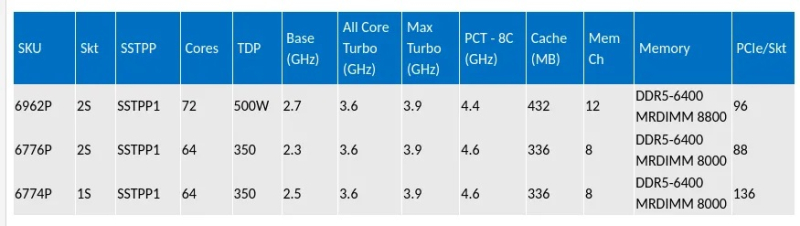

Специально для ИИ: Intel представила три оптимизированных процессора Intel Xeon Granite Rapids, один из которых используется в NVIDIA DGX B300Intel представила три новых процессора семейства Intel Xeon 6 Granite Rapids-SP/AP — 6962P, 6774P и 6776P, разработанные для управления «самыми передовыми ИИ-системами ускорителей». Новые процессоры с P-ядрами используют технологию Intel Priority Core Turbo (PCT), а также технологию Intel Speed Select Turbo Frequency (Intel SST-TF), которые позволяют настраивать частоты ядер процессора для повышения производительности ускорителя при обработке требовательных рабочих ИИ-нагрузок. Новые процессоры Xeon 6 уже доступны для заказчиков. В частности, Intel Xeon 6776P используется в ИИ-системе NVIDIA DGX B300, где «играет важную роль в управлении, оркестрации и поддержке ИИ-системы». «Новые чипы демонстрируют непревзойдённую производительность Xeon 6, что делает их идеальными процессорам для ИИ-систем с ускорением на GPU следующего поколения», — отметила Карин Айбшиц Сигал (Karin Eibschitz Segal), корпоративный вице-президент и временный генеральный директор Intel Data Center Group. Как сообщила Intel, внедрение PCT в сочетании с Intel SST-TF обеспечивает значительный скачок производительности ИИ-систем. PCT позволяет динамически формировать пул высокоприоритетных ядер, которые работают на более высоких турбочастотах, в то время как остальные ядра работают на базовой частоте, обеспечивая оптимальное распределение ресурсов процессора. Эта функция имеет решающее значение для рабочих ИИ-нагрузок, требующих последовательной и пакетной обработки, более быстрой отправки данных к ускорителям и повышения общей эффективности системы. Впрочем, в случае 6776P лишь до восьми ядер могут работать на повышенной турбочастоте. Процессоры Xeon 6 с P-ядрами, по словам Intel обеспечивают ведущие в отрасли характеристики для ИИ-систем, включая:

Новые процессоры отличаются высокой надёжности и удобством обслуживания, что сводит к минимуму перебои в работе. Как сообщается, новинки поддерживают AMX-вычисления с точностью FP16, что обеспечивает эффективную предобработку данных и выполнение критических задач ЦП в рабочих ИИ-нагрузках.

22.05.2025 [23:03], Владимир Мироненко

Qualcomm готовит 80-ядерный серверный Arm-процессор SD1 для ИИ-платформQualcomm провела в рамках выставки Computex 2025 мероприятие, на котором изложила свои планы на ближайшее будущее. Хотя немногим ранее компания подтвердила намерение вернуться на рынок серверных процессоров в подписанном с ИИ-стартапом Humain меморандуме о взаимопонимании, на нынешнем брифинге руководство Qualcomm лишь вскользь затронуло эту тему, уделив ей буквально считанные секунды, пишет ресурс ComputerBase. Вместе с тем на слайде, продемонстрированном в конце мероприятия, было сказано, что продвижение Qualcomm на рынке ЦОД станет следующим шагом по диверсификации компанией своей деятельности. Судя по всему, главным направлением, для которого Qualcomm займётся разработкой серверных чипов, станут ИИ-платформы. ComputerBase отметил, что генеральный директор Qualcomm Криштиану Амон (Cristiano Amon) неоднократно подчёркивал, что в ЦОД уже сейчас используется интеллектуальная собственность компании и её разработки. Лежащая в их основе технология считается «крайне революционной», предлагая высокую производительность чипа при низком энергопотреблении. Напомним, что Nuvia, которую приобрела Qualcomm, планировала выпустить «лучший в мире серверный процессор» с Arm-архитектурой и ядром Phoenix собственной разработки. Из-за этой сделки между Arm и Qualcomm начался серьёзный конфликт. Softbank же, контролирующая Arm, хочет купить производителя серверных Arm-процессоров Ampere Computing. Один из инсайдеров сообщил на платформе X о свежей публикации DigiTimes, согласно которой, Qualcomm «возвращается на рынок серверов на базе Arm-архитектуры», планируя выпустить 5-нм CPU под кодовым названием SD1. По данным издания, чип будет поддерживать память HBM и PCIe 5.0 и предназначен для интеграции со стоечными системами NVIDIA, закладывая основу для энергоэффективной экосистемы CPU+GPU. Новинка получит поддержку NVLink Fusion. Вместе с тем первая информация о процессорах SD1 появилась более года назад. Тогда говорилось, что процессор получит 80 ядер Oryon, работающих на частоте до 3,8 ГГц, 16 каналов DDR5-5600, 70 линий PCIe 5.0 с поддержкой CXL 1.1. Чип будет изготавливаться на TSMC по техпроцессу N5P и получит упаковку LGA9470 (98 × 95 мм). Возможно использование в двухсокетной конфигурации. Тогда же сообщалось, что Qualcomm сообщила своим партнёрам о готовящемся чипе на рубеже 2021-2022 гг., т.е. практически сразу после приобретения Nuvia. |

|