Материалы по тегу: c

|

21.03.2025 [14:17], Сергей Карасёв

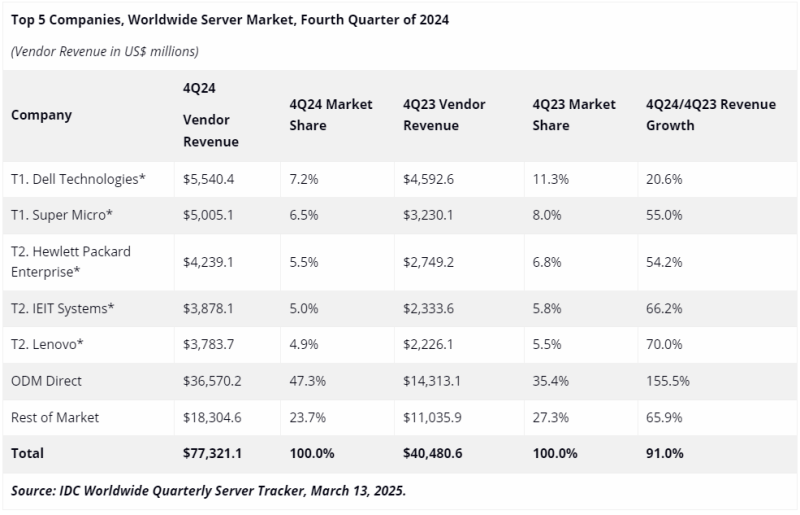

Во многом благодаря NVIDIA квартальные поставки серверов взлетели почти вдвое, достигнув рекордных $77,3 млрдКомпания International Data Corporation (IDC) подвела итоги исследования глобального серверного рынка в IV квартале 2024 года. Выручка достигла рекордных $77,3 млрд, что на 91 % больше по сравнению с последней четвертью 2023-го, когда продажи составляли $40,5 млрд. С октября по декабрь включительно серверы с архитектурой x86 принесли $54,8 млрд, что на 59,9 % больше по сравнению с аналогичным периодом 2023 года. Суммарная выручка от поставок систем с процессорами на всех других архитектурах за год взлетела на 262,1 %, достигнув $22,5 млрд. Это, в частности, указывает на быстрый рост популярности Arm-серверов. Высоким спросом продолжают пользоваться машины для ИИ-задач, оборудованные GPU-ускорителями: выручка от такого оборудования в IV квартале 2024 года поднялась на 192,6 % в годовом исчислении. В данном сегменте доминирует NVIDIA с долей более 90 % в общем объёме поставок в штучном выражении. Лидером глобального серверного рынка в последней четверти 2024-го стала Dell с продажами на уровне $5,5 млрд и долей в 7,2 % против 11,3 % годом ранее. На втором месте располагается Supermicro, у которой выручка составила $5,0 млрд, а доля снизилась в годовом исчислении с 8,0 % до 6,5 %. Замыкает тройку НРЕ с $4,2 млрд и 5,5 %: годом ранее эта компания контролировала 6,8 % отрасли. На четвёртом месте находится IEIT Systems с $3,9 млрд и 5,0 %, на пятом — Lenovo $3,8 млрд и 4,9 %. Прямые ODM-поставки обеспечили $36,6 млрд, или 47,3 % в общем объёме отрасли. На всех прочих игроков рынка пришлось $18,3 млрд, или около 23,7 %. В географическом плане Соединенные Штаты являются вторым по темпам роста регионом на рынке серверов сразу после Канады с приростом на 118,4 %, но США лидируют с долей 56 % от суммарных продаж серверов в IV квартале 2024 года, тогда как на Канаду приходится только 1,1 % продаж. В Китае выручка поднялась на 93,3 % — на КНР приходится почти четверть общемировых продаж. В Японии зафиксирован рост на 66,9 %, в Азиатско-Тихоокеанском регионе (за исключением Японии и Китая) — на 43,8 %, в регионе EMEA (Европа, Ближний Восток и Африка) — на 28,2 %, в Латинской Америке — на 7 %. В 2024 году в целом выручка на мировом рынке серверов достигла $235,7 млрд, что более чем в два раза превышает показатель 2020-го.

18.03.2025 [19:04], Руслан Авдеев

Crusoe получит 4,5 ГВт от газовых электростанций для питания ИИ ЦОДКомпания Crusoe Energy получит 4,5 ГВт от газовых электростанций для питания ИИ ЦОД. Строитель дата-центров создал совместное предприятие с американским хедж-фондом Engine No. 1, сообщает пресс-служба Crusoe. Ранее Engine No. 1 заключила с американским нефтегазовым гигантом Chevron соглашение о постройке электростанций, работающих на природном газе и использующих турбины GE Vernova. Электростанции будут питать дата-центры напрямую, без подключения к общей энергосети. Энергия, вероятно, будет доступна уже к 2027 году. Первый объект Stargate возводится на площадке Crusoe в техасском Абилине (Abilene). Он будет запитан от газовых турбин мощностью 360 МВт от всё той же GE Vernova. Дополнительно кампус получит солнечную электростанцию и энергохранилище. Пока нет точных данных, сколько из 4,5 ГВт достанется исключительно Stargate. Crusoe заявила, что пока ведёт переговоры с несколькими гиперскейлерами. Огромная мощность, которую получит Crusoe, делает компанию весьма привлекательным партнёром для гиперскейлеров, желающих быстро нарастить ёмкость ЦОД. Для сравнения: год назад ёмкость всех дата-центров Microsoft была на уровне 5 ГВт. Природный газ многими рассматривается как более экобезопасная альтернатива другим видам ископаемого топлива. Впрочем, такая энергия всё равно не столь «чиста», как получаемая из возобновляемых источников. Как сообщают в Engine No. 1, стратегическое партнёрство использует сильные стороны Crusoe в строительстве дата-центров, а фонд займётся обеспечением поставок энергии. Как это соотносится с планами Chevron строить собственные ЦОД и снабжать их энергией от семи генераторов GE Vernova, пока неизвестно.

18.03.2025 [16:35], Руслан Авдеев

На всё готовое: нефтегазовый гигант Chevron будет строить ЦОД в США и снабжать их энергиейНефтегазовая компания Chevron рассчитывает выйти на рынок дата-центров. Её представитель заявил, что сейчас она находится на стадии подготовки к получению разрешений и проектированию многочисленных площадок ЦОД в США, сообщает Reuters. Chevron не только намерена строить дата-центры, но и снабжать их электричеством в необходимых объёмах. В течение трёх лет компания намерена построить 1 ГВт мощностей. В ходе конференции CERAWeek в Хьюстоне вице-президент компании по энергетическим решениям Дэниэл Друг (Daniel Droog) отметил, что интерес клиентов к таким проектам весьма высок. По его словам, важно соблюдать баланс, при котором объёмы строительства или расширения объектов не превышало бы возможностей энергоснабжения. Компания рассчитывает, что к 2027–2028 гг. заработают ЦОД и электростанции мощностью порядка 1 ГВт. Детали о новых площадках пока не раскрываются, но компания ориентируется на работу на юге страны, в западных штатах, а также на Среднем Западе США. Дата-центры не будут подключаться к централизованным электросетям. Вместо этого они станут обеспечиваться энергией за счёт локальных газовых электростанций. Chevron рассчитывает на семь газовых генераторов GE Vernova, которые должны поставить в 2026 году. Похожий проект есть у ExxonMobil.

Источник изображения: Chevron Проекты по локальной генерации с использованием природного газа для дата-центров и майнинга криптовалют за последний год заметно выросло. Так, в ноябре прошлого года AXP Energy заключила юридически обязывающее соглашение о создании совместного предприятия (Joint Development Agreement, JDA) с Blackhart по продаже природного газа для питания модульных криптомайниновых ЦОД в Колорадо. До этого, в октябре того же года, MARA анонсировала запуск микро-ЦОД на 25 МВт, питаемых путём сжигания попутного газа на нефтяных скважинах в Техасе и Северной Дакоте. Наконец, недавно появилась информация, что Diversified Energy, FuelCell Energy и TESIAC намерены удовлетворить спрос операторов ЦОД на электричество тоже с помощью природного газа. Присматривается к нему и Microsoft, поскольку возобновляемые источники не успевают за аппетитами ИИ. Впрочем, в NextEra уверены, что электростанции на природном газе смогут удовлетворить лишь часть спроса на электричество. Вместо этого Соединённым Штатам необходимо в основном положиться на возобновляемые источники энергии, а остальное «добрать», отложив закрытие действующих угольных электростанций.

18.03.2025 [10:05], Сергей Карасёв

ExxonMobil развернёт суперкомпьютер Discovery 6 с суперчипами NVIDIA GH200Американская ExxonMobil, одна из крупнейших в мире нефтяных компаний, представила проект высокопроизводительного вычислительного комплекса Discovery 6. Этот суперкомпьютер планируется использовать для поддержания работы передовых систем 4D-сейсморазведки. Комплекс создаётся в партнёрстве с НРЕ и NVIDIA. В основу системы ляжет платформа HPE Cray Supercomputing EX4000. Будут задействованы 4032 суперчипа NVIDIA GH200 Grace Hopper. В состав Grace Hopper входят 72-ядерный Arm-процессор NVIDIA Grace, до 480 Гбайт LPDDR5x и ускоритель NVIDIA H100 с 96 или 144 Гбайт HBM3(e). Говорится об использовании интерконнекта HPE Slingshot. Отмечается, что по производительности новый суперкомпьютер примерно в четыре раза превзойдёт предшественника — систему Discovery 5, введённую в эксплуатацию в ноябре 2022 года. Этот комплекс использует платформу HPE Cray EX235n с 32-ядерными процессорами AMD EPYC 7543 и ускорителями NVIDIA A100 SXM4. В ноябрьском рейтинге TOP500 машина Discovery 5 занимала 46-ю позицию с пиковой производительностью 30,99 Пфлопс. Таким образом, быстродействие Discovery 6, как ожидается, будет находиться на уровне 120 Пфлопс. Для создаваемого суперкомпьютера предусмотрено использование высокоэффективной системы прямого жидкостного охлаждения (DLC). Благодаря запуску Discovery 6 ExxonMobil рассчитывает сократить время обработки сложных сейсмических данных с месяцев до недель. Это поможет повысить эффективность разведки месторождений нефти и газа, что приведёт к увеличению добычи ресурсов с меньшими капиталовложениями. Завершить монтаж Discovery 6 планируется в I половине текущего года.

17.03.2025 [10:21], Сергей Карасёв

MiTAC представила ИИ-серверы на базе Intel Xeon 6 и AMD EPYC 9005/9004Компания MiTAC Computing Technology (подразделение MiTAC Holdings) на конференции Supercomputing Asia 2025 анонсировала серверы G4520G6 и TN85-B8261, построенные на аппаратной платформе Intel и AMD соответственно. Новинки ориентированы на ресурсоёмкие задачи, связанные с ИИ, машинным обучением и НРС-нагрузками. Модель G4520G6 выполнена в форм-факторе 4U: допускается установка двух процессоров Intel Xeon 6700 в исполнении LGA4710 с показателем TDP до 350 Вт. Есть 32 слота для модулей RDIMM/RDIMM-3DS DDR5-5200/6400 и MRDIMM DDR5-8000 суммарным объёмом до 8 Тбайт. Во фронтальной части расположены восемь отсеков для SFF-накопителей NVMe U.2. Кроме того, доступны три внутренних коннектора для SSD формата М.2 22110/2280 с интерфейсом PCIe 4.0. Сервер располагает 11 слотами PCIe 5.0 x16 FHFL и тремя слотами OCP 3.0 (PCIe 5.0 x16). Возможна установка до восьми двуслотовых GPU-ускорителей. Упомянуты контроллер Aspeed AST2600, сетевой порт управления 1GbE (Realtek RTL8211F), разъёмы USB 3.0 (×2), USB 3.2 Gen1 (×2), D-Sub и последовательный порт. Питание обеспечивают четыре блока мощностью 9000 Вт с сертификатом 80 Plus Titanium. Применяется воздушное охлаждение. В свою очередь, модель TN85-B8261 типоразмера 2U может нести на борту два чипа AMD EPYC 9005 Turin или EPYC 9004 Genoa c величиной TDP до 500 Вт. Есть 24 слота для модулей DDR5-6000 суммарным объёмом до 6 Тбайт, восемь посадочных мест для SFF-накопителей NVMe U.2, шесть слотов PCIe 5.0 x16. Могут быть установлены до четырёх двуслотовых GPU-ускорителей полной высоты. Предусмотрены два сетевых порта 10GbE (Intel X550-AT2), выделенный сетевой порт управления 1GbE (Realtek RTL8211F), контроллер Aspeed AST2600, четыре порта USB 3.2 Gen1 и интерфейс D-Sub. Реализовано воздушное охлаждение. Установлены два блока питания мощностью 2700 Вт с сертификатом 80 Plus Titanium. Серверы могут эксплуатироваться при температурах от +10 до +35 °C.

15.03.2025 [14:08], Сергей Карасёв

Supermicro представила GPU-серверы на базе Intel Xeon 6900P и AMD EPYC 9005/9004

amd

b200

emerald rapids

epyc

genoa

granite rapids

hardware

intel

nvidia

sapphire rapids

supermicro

turin

xeon

ии

сервер

Компания Supermicro представила большое количество серверов, рассчитанных на ИИ-задачи, НРС-нагрузки и периферийные вычисления. В частности, дебютировали системы в форм-факторе 10U с возможностью установки восьми ускорителей NVIDIA B200 (SXM): это системы SuperServer SYS-A22GA-NBRT, SuperServer SYS-A21GE-NBRT и A+ Server AS-A126GS-TNBR. Модель SuperServer SYS-A22GA-NBRT рассчитана на два процессора Intel Xeon 6900P семейства Granite Rapids, каждый из которых может насчитывать до 128 ядер (TDP до 500 Вт). Доступны 24 слота для модулей оперативной памяти DDR5-8800 MRDIMM суммарным объёмом до 6 Тбайт. Есть десять фронтальных отсеков для SFF-накопителей с интерфейсом PCIe 5.0 x4 (NVMe) и два коннектора для SSD типоразмера M.2 2280/22110/25110 (PCIe 4.0 x4 NVMe). Предусмотрены десять слотов для карт PCIe 5.0 x16 LP и два слота для карт PCIe 5.0 x16 FHHL. Питание обеспечивают шесть блоков мощностью 5250 Вт. Реализовано воздушное охлаждение. Вариант SuperServer SYS-A21GE-NBRT поддерживает установку двух процессоров Intel Xeon поколения Emerald Rapids или Sapphire Rapids, содержащих до 64 вычислительных ядер (с показателем TDP до 350 Вт). Доступны 32 слота для модулей DDR5-4400/5600 максимальным объёмом 8 Тбайт. Предусмотрены десять отсеков для накопителей SFF (PCIe 5.0 x4 NVMe), два коннектора M.2 2280 (PCIe 3.0 x4 NVMe), восемь слотов PCIe 5.0 x16 LP, два слота PCIe 5.0 x16 FHHL, шесть блоков питания мощностью 5000 Вт. Модель A+ Server AS-A126GS-TNBR, в свою очередь, может комплектоваться двумя чипами AMD EPYC 9005 Turin или EPYC 9004 Genoa (максимум 192 ядра, до 500 Вт). Доступны 24 слота для модулей DDR5-6000 суммарным объёмом до 9 Тбайт. Реализованы десять фронтальных SFF-отсеков (8 × NVMe и 2 × SATA), два коннектора M.2 NVMe, восемь слотов PCIe 5.0 x16 LP и два слота PCIe 5.0 x16 FHHL. Задействованы шесть блоков питания мощностью 5250 Вт с сертификатом Titanium. Машина оборудована воздушным охлаждением.

Кроме того, Supermicro представила компактный сервер SYS-112D-36C-FN3P, в основу которого положена аппаратная платформа Intel Xeon 6 SoC (Granite Rapids-D), оптимизированная специально для сетевых и периферийных устройств. Эта модель наделена двумя портами 100GbE QSFP28 и слотом PCIe 5.0 FHFL. Поддерживается до 512 Гбайт памяти DDR5. Дебютировали системы SYS-E201-14AR и SYS-E300-14AR, рассчитанные на задачи IoT и ИИ на периферии.

14.03.2025 [10:46], Сергей Карасёв

Congatec представила кулер с тепловыми трубками на ацетоне для работы в экстремальных условияхКомпания Congatec анонсировала новый кулер на основе радиатора и тепловых трубок, предназначенный для отвода тепла от чипов в экстремальных условиях эксплуатации. Особенность изделия заключается в применении ацетона в качестве рабочей жидкости вместо традиционной воды. У ацетона температура замерзания находится на уровне −95 °C. Такие свойства ацетона предотвращают образование льда и снижают риски конденсации, благодаря чему формируется стабильный механизм теплопередачи даже при резких колебаниях температуры. Благодаря этому новый кулер может применяться в устройствах, которые рассчитаны на использование в суровых условиях — например, на открытых пространствах в Арктике. Диапазон рабочих температур у новинки простирается от −40 до +85 °C.

Источник изображения: Congatec По заявлениям Congatec, представленное изделие невосприимчиво к механическим нагрузкам, таким как удары и вибрация. Среди сфер применения кулера называются автономные и обычные транспортные средства, подвергающиеся воздействию экстремальных температур: это машины для портовых терминалов, железнодорожных и авиационных платформ и пр. Кроме того, охладитель может устанавливаться в индустриальные устройства, эксплуатация которых сопряжена с физическими возмущениями, в частности, тряской. Компания Congatec отмечает, что появление кулера на ацетоне расширяет сферу применения так называемых «компьютеров-на-модуле» (COM), которым ранее требовались сложные и дорогостоящие конструкции для работы при низких температурах. Решение может быть интегрировано с различными продуктами Congatec, включая COMe, COM-HPC и COM-HPC mini.

13.03.2025 [15:55], Руслан Авдеев

ESA запустила суперкомпьютер Space HPC для европейских космических исследованийЕвропейское космическое агентство (ESA) запустило суперкомпьютерную платформу ESA Space HPC, специально разработанную для развития космических исследований и технологий в Евросоюзе. Открытие нового объекта состоялось на территории принадлежащего ESA центра ESRIN в Италии, сообщает HPC Wire. ESA Space HPC обеспечит поддержку исследований и развития технологий в рамках всех программ ESA, обеспечивая учёным и малому и среднему бизнесу из стран Евросоюза доступ к вычислительным мощностям. Инициатива призвана развить использование высокопроизводительных вычислений (HPC) в аэрокосмическом секторе ЕС, она станет основой для более масштабных инициатив в будущем. Как сообщается на сайте проекта, Space HPC построен при участии HPE. Суперкомпьютер включает порядка 34 тыс. ядер процессоров Intel и AMD последних поколений, 156 Тбайт RAM, 108 ускорителей NVIDIA H100, All-Flash подсистему хранения ёмкостью 3,6 Пбайт и пропускной способностью 500 Гбайт/с, а также 400G-интерконнект InfiniBand. Общая пиковая производительность кластера составляет 5 Пфлопс (FP64). Space HPC использует прямое жидкостное охлаждение, а PUE системы не превышает 1,09. Избыточное тепло отправляется на нужды отопления кампуса. Локальная солнечная электростанция обеспечивает более половины энергетических нужд кластера. Представители итальянских властей заявили, что технологические инновации в космическом секторе являются приоритетом для обеспечения безопасности и «стратегической автономии», а также будут способствовать конкурентоспособности европейской промышленности. Также отмечено, что местный аэрокосмический хаб Lazio стал домом для 250 компаний и играет ключевую роль в развитии авионики, электроники, радаров, спутниковых технологий и материаловедения. В руководстве ESA отметили потенциал Space HPC для инноваций в космической индустрии Евросоюза. Новый объект обеспечит агентству гибкую суперкомпьютерную инфраструктуру для исследований и разработок, тестирования и бенчмаркинга, поддержки программ ESA и промышленных предприятий. Доступ к вычислениям будет иметь и малый и средний бизнес, стартапы и т.п. Также отмечается, что дебют Space HPC наглядно продемонстрировал, ESA не только берёт ресурсы у государств-участников, но и много может дать им взамен. Утверждается, что одной из ключевых сфер деятельности, где требуются HPC-платформы, для ESA является наблюдение за Землёй. Новые мощности обеспечат управление наблюдениями, разработку новых приложений и сервисов. Space HPC будет поддерживать сложные нагрузки, включая моделирование, инженерные симуляции, обучение ИИ-моделей, аналитику данных и визуализацию, а также прочие эксперименты, которые помогут снизить риски будущих космических проектов. Это позволит ESA повысить финансовую эффективность проектов и обеспечит возможность обмена данными между разными программами агентства. В конце 2024 года сообщалось, что в 2025 году в Евросоюзе появится сразу семь ИИ-фабрик EuroHPC, а в середине минувшего февраля появилась информация, что Евросоюз направит €200 млрд на развитие ИИ, чтобы не отстать от США и Китая в этой сфере. В прошлом году было отмечено, что реализация миссий NASA задерживается из-за устаревших и перегруженных суперкомпьютеров.

12.03.2025 [20:37], Владимир Мироненко

Евросоюз потратит €240 млн на создание трёх RISC-V чиплетов для суперкомпьютеров в рамках проекта DARE

eurohpc

hardware

hpc

risc-v

европа

ии

импортозамещение

инвестиции

суперкомпьютер

ускоритель

финансы

чиплеты

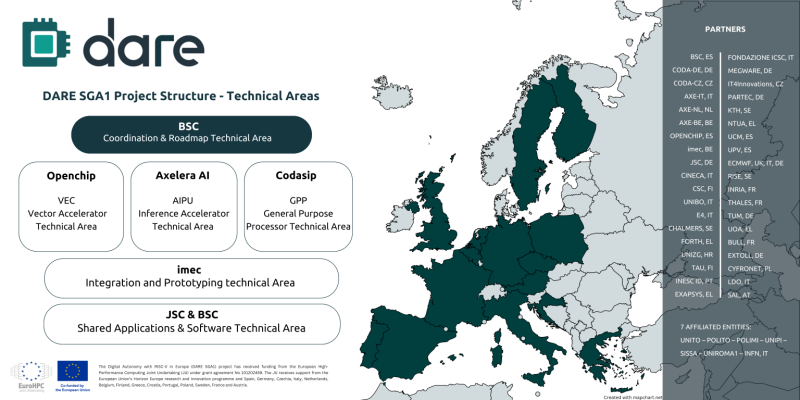

Digital Autonomy with RISC-V in Europe (DARE), крупнейший проект по разработке чипов из когда-либо финансируемых Европейским союзом, созданный с целью укрепления технологического суверенитета Европы в области высокопроизводительных вычислений (HPC) и искусственного интеллекта (ИИ), официально начал первый этап DARE SGA1, на реализацию которого выделено €240 млн ($262 млн), сообщается на сайте проекта. Европа и Китай делают ставку на RISC-V. Финансирование инициативы обеспечат 38 участников, включая ИТ-компании, исследовательские институты и университеты по всей Европе. Проект поддерживается EuroHPC JU и координируется Барселонским суперкомпьютерным центром (BSC-CNS). Последний имеет богатый опыт разработки чипов RISC-V и суперкомпьютерных систем. Половина инвестиций в проект DARE будет предоставлена Европейской комиссией через EuroHPC, а другая половина поступит напрямую от европейских партнёров, включая €34 млн от Министерства науки, инноваций и университетов Испании. Рассчитанный на три года DARE SGA1 является первым этапом шестилетней инициативы DARE. Цель — создание полноценного независимого европейского суперкомпьютерного программно-аппаратного стека для HPC и ИИ, включая чипы, системы на основе чиплетов и ПО. Инициатива направлена на удовлетворение стратегической потребности Европы в цифровом суверенитете и получения полного контроля над критической вычислительной инфраструктурой. Проектом DARE SGA1 предусмотрена разработка трёх чиплетов на основе архитектуры RISC-V, каждый из которых будет выполнять критически важную функцию в вычислениях HPC и ИИ:

В дополнение к указанным компаниям в качестве технических лидеров названы imec и Юлихский исследовательский центр (JÜLICH Supercomputing centre, JSC), которые будут продвигать ключевые инновации в рамках проекта. Помимо координации усилий, BSC также возглавит разработку планов и будет участвовать в разработке программных и аппаратных решений. Изготавливаться чиплеты будут по технологии CMOS с использованием современных техпроцессов. Axelera получит на разработку до €61 млн при условии выполнения различных задач в течение следующих трёх лет, рассказал ресурсу EE Times генеральный директор Axelera Фабрицио дель Маффео (Fabrizio del Maffeo). Хотя нынешний чип Axelera Metis AIPU предназначен для периферийных систем, дель Маффео сказал, что разрабатываемый в рамках DARE продукт на основе чиплетов не несёт кардинальные изменения, речь скорее о масштабировании. Codasip в прошлом году анонсировала 64-бит чип X730 на базе RISC-V с архитектурной защитой CHERI. По данным The Next Platform, за последнее десятилетие компания привлекла $34,6 млн общего финансирования, включая средства в рамках различных инициатив ЕС, а также посевной раунд в размере $2,5 млн в 2016 году и раунд A в размере $10 млн в 2018 году.

12.03.2025 [14:45], Сергей Карасёв

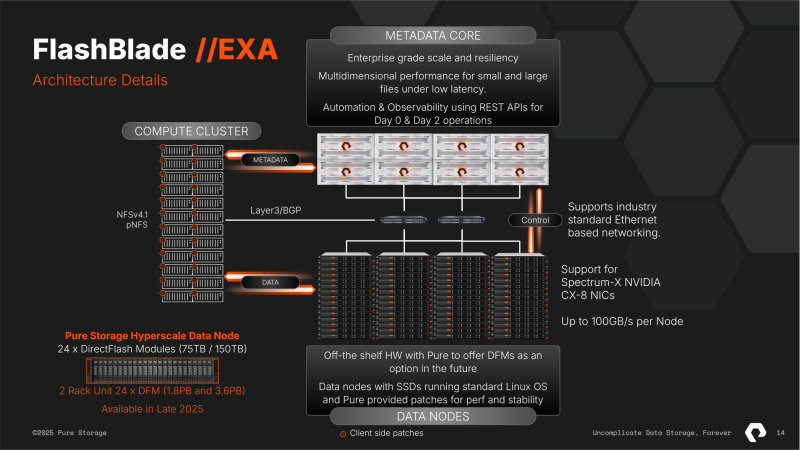

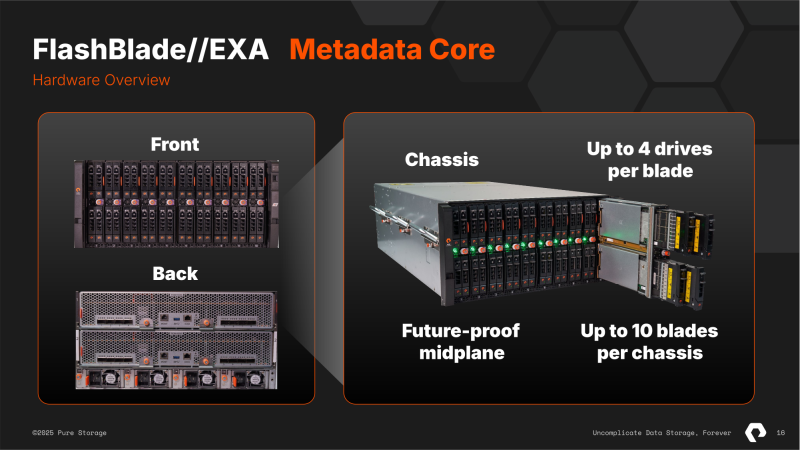

10+ Тбайт/с: Pure Storage представила высокопроизводительную All-Flash СХД FlashBlade//EXA для ИИ и НРСКомпания Pure Storage анонсировала систему FlashBlade//EXA: это, как утверждается, самая производительная на сегодняшний день платформа хранения данных, разработанная специально для наиболее требовательных нагрузок ИИ и HPC. Отмечается, что стандартные СХД оптимизированы для традиционных сред HPC с предсказуемыми операциями. Такие системы разрабатываются с прицелом на масштабирование «чистой производительности». Однако современные нагрузки ИИ являются гораздо более сложными и многомодальными: они предусматривают обработку данных разного типа — текстов, изображений и видео — одновременно на десятках тысяч ускорителей. Из-за этого возникает необходимость в оптимизации обработки метаданных наряду с масштабированием производительности. FlashBlade//EXA, по заявлениям Pure Storage, устраняет узкие места традиционных СХД в плане работы с метаданными. Архитектура новой платформы даёт возможность масштабировать ресурсы для обработки обычных данных и метаданных независимо друг от друга. Эффективная обработка метаданных имеет решающее значение для поддержания высокой производительности, надёжности и эффективности в крупномасштабных средах ИИ. Сегмент метаданных Metadata Core в составе FlashBlade//EXA может объединять от 1 до 10 5U-шасси с десятью blade-узлами в каждом. В каждом узле размещается от одного до четырёх фирменных 37.5-Тбайт модуля DFM. Ещё 2U приходится на пару XFM (External Fabric Modules), которые дают 16 подключений 400GbE. Metadata Core работает с фирменной ОС Purity//FB, общается напрямую с GPU-кластером (NFSv4.1 over TCP) и управляет потоками данных между узлами хранения и кластером (NFSv3 over RDMA). Узлы хранения Data Node обладают неограниченной масштабируемостью. Причём эти узлы могут быть самыми обычными x86-серверами любых вендоров. Каждый такой узел должен содержать 32-ядерный CPU, 192 Гбайт RAM, от 12 до 16 NVMe SSD (PCIe 4.0/5.0) вместимостью до 61,44 Тбайт, а также пару 400GbE NIC. Архитектура платформы предусматривает использование сетевых адаптеров NVIDIA ConnectX, коммутаторов Spectrum, компонентов LinkX и пр. Система FlashBlade//EXA обеспечивает производительность свыше 10 Тбайт/с на операциях чтения в одном пространстве имён. В результате, организации могут значительно ускорить процессы обучения ИИ-моделей и инференса, максимально используя потенциал GPU-ускорителей. Это также способствует снижению временных и финансовых затрат на решение ресурсоёмких задач. По-видимому, именно это решение компания и предлагает гиперскейлерам. У самой Pure Storage есть тестовая конфигурация из 300 узлов, которая показывает производительность на уровне 30 Тбайт/с. |

|