Лента новостей

|

21.03.2025 [14:17], Сергей Карасёв

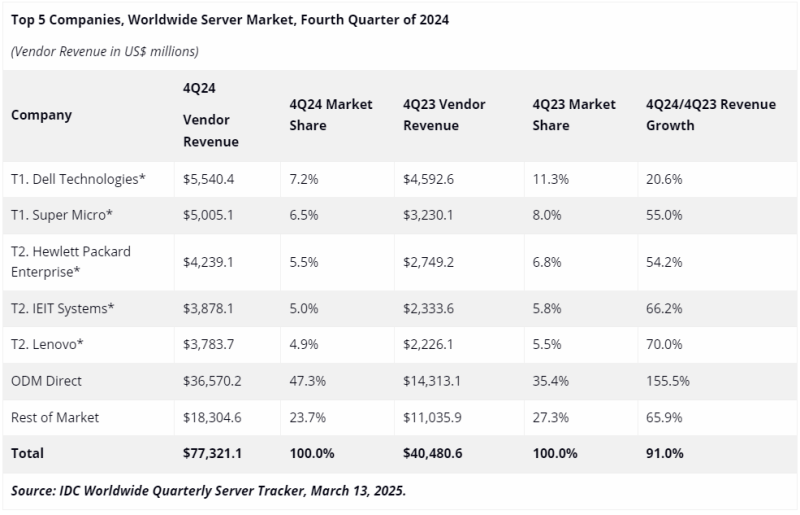

Во многом благодаря NVIDIA квартальные поставки серверов взлетели почти вдвое, достигнув рекордных $77,3 млрдКомпания International Data Corporation (IDC) подвела итоги исследования глобального серверного рынка в IV квартале 2024 года. Выручка достигла рекордных $77,3 млрд, что на 91 % больше по сравнению с последней четвертью 2023-го, когда продажи составляли $40,5 млрд. С октября по декабрь включительно серверы с архитектурой x86 принесли $54,8 млрд, что на 59,9 % больше по сравнению с аналогичным периодом 2023 года. Суммарная выручка от поставок систем с процессорами на всех других архитектурах за год взлетела на 262,1 %, достигнув $22,5 млрд. Это, в частности, указывает на быстрый рост популярности Arm-серверов. Высоким спросом продолжают пользоваться машины для ИИ-задач, оборудованные GPU-ускорителями: выручка от такого оборудования в IV квартале 2024 года поднялась на 192,6 % в годовом исчислении. В данном сегменте доминирует NVIDIA с долей более 90 % в общем объёме поставок в штучном выражении. Лидером глобального серверного рынка в последней четверти 2024-го стала Dell с продажами на уровне $5,5 млрд и долей в 7,2 % против 11,3 % годом ранее. На втором месте располагается Supermicro, у которой выручка составила $5,0 млрд, а доля снизилась в годовом исчислении с 8,0 % до 6,5 %. Замыкает тройку НРЕ с $4,2 млрд и 5,5 %: годом ранее эта компания контролировала 6,8 % отрасли. На четвёртом месте находится IEIT Systems с $3,9 млрд и 5,0 %, на пятом — Lenovo $3,8 млрд и 4,9 %. Прямые ODM-поставки обеспечили $36,6 млрд, или 47,3 % в общем объёме отрасли. На всех прочих игроков рынка пришлось $18,3 млрд, или около 23,7 %. В географическом плане Соединенные Штаты являются вторым по темпам роста регионом на рынке серверов сразу после Канады с приростом на 118,4 %, но США лидируют с долей 56 % от суммарных продаж серверов в IV квартале 2024 года, тогда как на Канаду приходится только 1,1 % продаж. В Китае выручка поднялась на 93,3 % — на КНР приходится почти четверть общемировых продаж. В Японии зафиксирован рост на 66,9 %, в Азиатско-Тихоокеанском регионе (за исключением Японии и Китая) — на 43,8 %, в регионе EMEA (Европа, Ближний Восток и Африка) — на 28,2 %, в Латинской Америке — на 7 %. В 2024 году в целом выручка на мировом рынке серверов достигла $235,7 млрд, что более чем в два раза превышает показатель 2020-го.

21.03.2025 [10:09], Владимир Мироненко

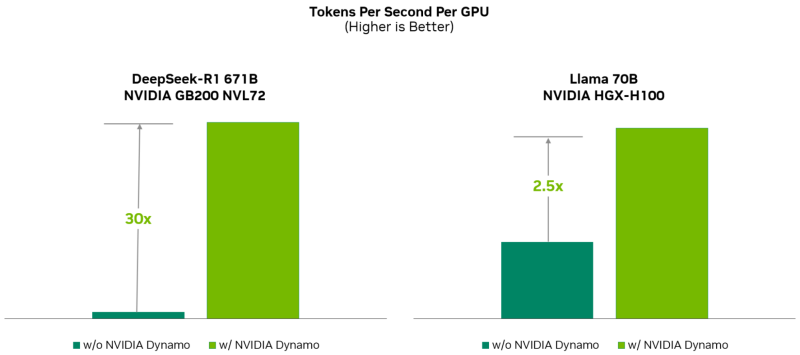

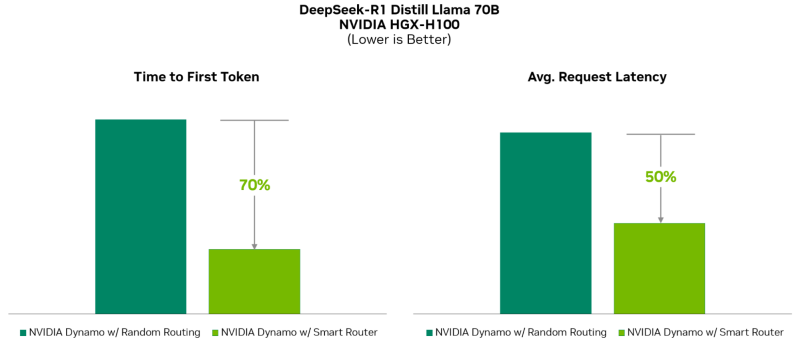

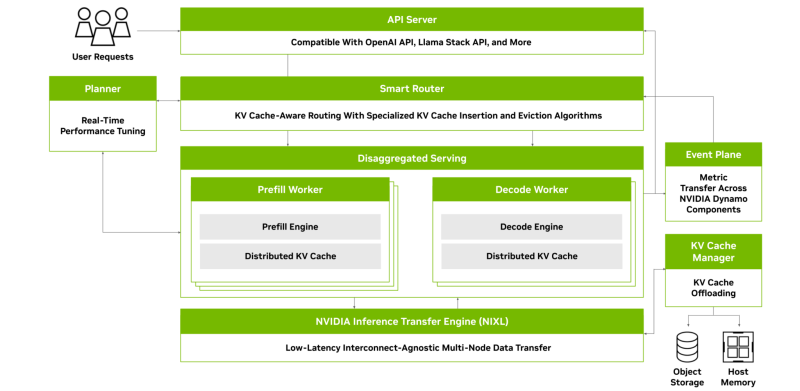

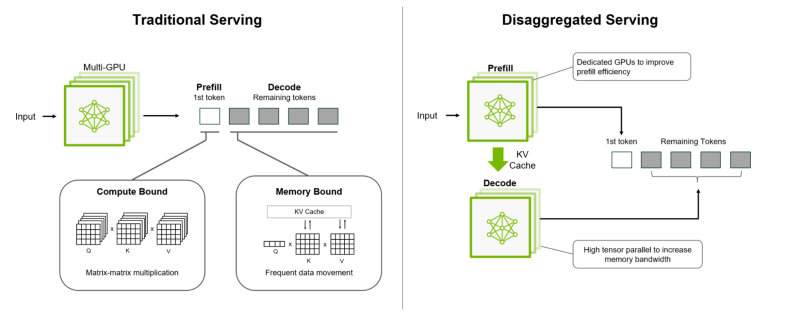

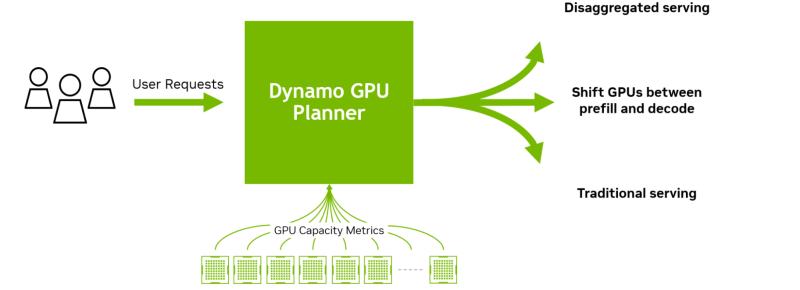

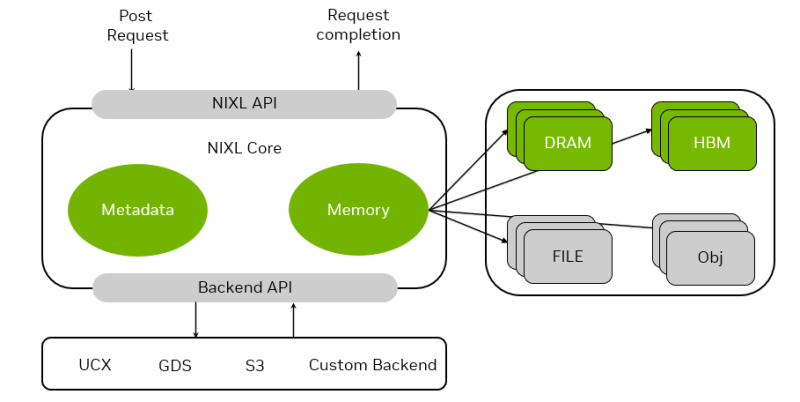

«ОС» для ИИ-фабрик: NVIDIA Dynamo ускорит инференс и упростит масштабирование рассуждающих ИИ-моделейNVIDIA представила NVIDIA Dynamo, преемника NVIDIA Triton Inference Server — программную среду с открытым исходным кодом для разработчиков, обеспечивающую ускорение инференса, а также упрощающую масштабирование рассуждающих ИИ-моделей в ИИ-фабриках с минимальными затратами и максимальной эффективностью. Глава NVIDIA Дженсен Хуанг (Jensen Huang) назвал Dynamo «операционной системой для ИИ-фабрик». NVIDIA Dynamo повышает производительность инференса, одновременно снижая затраты на масштабирование вычислений во время тестирования. Сообщается, что благодаря оптимизации инференса на NVIDIA Blackwell эта платформа многократно увеличивает производительность рассуждающей ИИ-модели DeepSeek-R1. Платформа NVIDIA Dynamo, разработанная для максимизации дохода от токенов для ИИ-фабрик (ИИ ЦОД), организует и ускоряет коммуникацию инференса на тысячах ускорителей, и использует дезагрегированную обработку данных для разделения фаз обработки и генерации больших языковых моделей (LLM) на разных ускорителях. Это позволяет оптимизировать каждую фазу независимо от её конкретных потребностей и обеспечивает максимальное использование вычислительных ресурсов. При том же количестве ускорителей Dynamo удваивает производительность (т.е. фактически доход ИИ-фабрик) моделей Llama на платформе NVIDIA Hopper. При запуске модели DeepSeek-R1 на большом кластере GB200 NVL72 благодаря интеллектуальной оптимизации инференса с помощью NVIDIA Dynamo количество генерируемых токенов на каждый ускоритель токенов увеличивается более чем в 30 раз, сообщила NVIDIA. NVIDIA Dynamo может динамически перераспределять нагрузку на ускорители в ответ на меняющиеся объёмы и типы запросов, а также закреплять задачи за конкретными ускорителями в больших кластерах, что помогает минимизировать вычисления для ответов и маршрутизировать запросы. Платформа также может выгружать данные инференса в более доступную память и устройства хранения данных и быстро извлекать их при необходимости. NVIDIA Dynamo имеет полностью открытый исходный код и поддерживает PyTorch, SGLang, NVIDIA TensorRT-LLM и vLLM, что позволяет клиентам разрабатывать и оптимизировать способы запуска ИИ-моделей в рамках дезагрегированного инференса. По словам NVIDIA, это позволит ускорить внедрение решения на различных платформах, включая AWS, Cohere, CoreWeave, Dell, Fireworks, Google Cloud, Lambda, Meta✴, Microsoft Azure, Nebius, NetApp, OCI, Perplexity, Together AI и VAST. NVIDIA Dynamo распределяет информацию, которую системы инференса хранят в памяти после обработки предыдущих запросов (KV-кеш), на множество ускорителей (до тысяч). Затем платформа направляет новые запросы на те ускорители, содержимое KV-кеша которых наиболее близко к новому запросу, тем самым избегая дорогостоящих повторных вычислений. NVIDIA Dynamo также обеспечивает дезагрегацию обработки входящих запросов, которое отправляет различные этапы исполнения LLM — от «понимания» запроса до генерации — разным ускорителям. Этот подход идеально подходит для рассуждающих моделей. Дезагрегированное обслуживание позволяет настраивать и выделять ресурсы для каждой фазы независимо, обеспечивая более высокую пропускную способность и более быстрые ответы на запросы. NVIDIA Dynamo включает четыре ключевых механизма:

Платформа NVIDIA Dynamo будет доступна в микросервисах NVIDIA NIM и будет поддерживаться в будущем выпуске платформы NVIDIA AI Enterprise.

21.03.2025 [08:56], Руслан Авдеев

NVIDIA инвестировала в CoreWeave, дала ей дефицитные ИИ-ускорители, а потом сама же арендовала ихКлиентам NVIDIA необходимо постоянно вкладывать миллиарды долларов в построение ИИ-инфраструктуры. При этом финансовая поддержка может прийти из самых неожиданных мест. Иногда — от самой NVIDIA, сообщает The Information. NVIDIA и её крупнейшим клиентам постоянно приходится искать баланс. С одной стороны, они поддерживают друг друга в краткосрочной перспективе, с другой — на длинной дистанции с NVIDIA намерены конкурировать многие гиперскейлеры. Microsoft, Meta✴, Google и Amazon (AWS) активно используют ИИ-чипы NVIDIA, одновременно пытаясь избавиться от такой зависимости и работая над собственными решениями: Maia, MTIA, TPU, Trainium и Inferentia. Поэтому NVIDIA инвестирует в т.н. неооблака (neocloud), ориентированные на предоставление ИИ-мощностей. Такие компании до некоторой степени способны стать альтернативой гиперскейлерам и вряд ли смогут разработать продукты, конкурирующие с чипами NVIDIA. К таковым относится и CoreWeave, которой NVIDIA активно помогает развиваться. В рамках подготовки к IPO компания раскрыла, что около 77 % выручки 2024 году ей принесли всего два клиента. Крупнейшим из них была Microsoft (62 %), которая к тому же обогнала по объёму закупок ускорителей NVIDIA всех ближайших конкурентов. А вот вторым по величине клиентом CoreWeave оказалась… сама NVIDIA (15 %). В начале 2023 года, когда спрос на ИИ-ускорители со стороны гиперскейлеров был фантастическим, NVIDIA сделала любопытный ход — в рамках т. н. Project Osprey она согласилась потратить в течение четырёх лет $1,3 млрд на аренду собственных чипов у CoreWeave, одновременно инвестировав в неё $100 млн. CoreWeave получила сотни тысяч современных ИИ-ускорителей и контракт с NVIDIA до августа 2027 года. NVIDIA действительно активно использует арендованные ускорители, не отвлекаясь на развёртывание ИИ ЦОД. В случае успешного выхода CoreWeave на биржу с оценкой более $30 млрд. заблаговременные инвестиции NVIDIA в акционерный капитал компании всего за два года превратятся в более чем $1 млрд. Однако для потенциальных инвесторов такое сотрудничество — повод для беспокойства, поскольку контракты с Microsoft и NVIDIA истекают в 2027–2029 гг. Подобные сделки на рынке ИИ — довольно распространённое явление. «Циклические» финансовые соглашения показывают, как деньги в отрасли уходят из компаний и возвращаются к ним же. SoftBank, намеренная стать одним из крупнейших инвесторов OpenAI, согласилась платить компании $3 млрд за использование её ИИ-продуктов. Microsoft вложила в OpenAI более $13 млрд, в результате чего получает долю в растущих доходах компании. В то же время OpenAI ежегодно выплачивает Microsoft миллиарды долларов за облачные сервисы. Amazon и Google заключили аналогичные сделки с Anthropic. Тем временем CoreWeave подпитывает расширение бизнеса за счёт долговых обязательств на $8 млрд и $15 млрд договоров долгосрочной аренды ЦОД и офисов. В своё время CoreWeave даже взяла в долг $2,3 млрд под залог ускорителей NVIDIA, чтобы купить ещё больше ускорителей NVIDIA. Пока инвесторы сомневаются, как оценивать компанию, поскольку малое количество якорных клиентов в совокупности с высокими темпами роста и большими долгами — довольно редкое явление. CoreWeave может сыграть роль и в развитии других компаний и проектов. В частности, речь идёт о намерении OpenAI подписаться на сервисы CoreWeave — пятилетний контракт на $11,9 млрд предполагает получение доли в компании. В этот период CoreWeave сможет получать дополнительные средства ежегодно, что несколько снизит её зависимость от NVIDIA и Microsoft. Однако данный контракт является лишь дополнением к контрактам с Microsoft и Oracle. Кроме того, идёт строительство ИИ ЦОД для проекта Stargate, поддерживаемого SoftBank и Oracle. Своим инвесторам OpenAI заявила, что к 2030 году Stargate обеспечит ¾ вычислительных мощностей, необходимых компании.

21.03.2025 [08:15], Руслан Авдеев

NVIDIA и xAI присоединились к $30-млрд инфраструктурному ИИ-консорциуму, возглавляемому Microsoft и BlackRock

blackrock

hardware

microsoft

nvidia

xai

возобновляемая энергия

ии

инвестиции

строительство

сша

финансы

цод

энергетика

NVIDIA и xAI присоединились к консорциуму, намеренному инвестировать $30 млрд в развитие ИИ-инфраструктуры. Консорциум AI Infrastructure Partnership (AIP), ранее известный как Global AI Infrastructure Investment Partnership, был сформирован Microsoft, BlackRock, Global Infrastructure Partners (GIP, принадлежит BlackRock) и дубайской государственной инвесткомпанией MGX (создана при участии Mubadala и G42) в сентябре 2024 года, Silicon Angle. На начальном этапе консорциум намерен инвестировать в ИИ-проекты более $30 млрд, а в долгосрочной перспективе — $100 млрд. В основном речь идёт об инвестициях в дата-центры и энергетическую инфраструктуру, преимущественно в США. Консорциум сообщил, что уже привлёк значительные средства и вызвал интерес у бизнеса. До того, как NVIDIA объявила о намерении присоединиться к AIP, она выступала техническим консультантом консорциума в области ИИ ЦОД. Эту роль она сохранит. Также стало известно, что с AIP работают производитель оборудования для энергетической отрасли GE Vernova, в прошлом году отделившийся от General Electric, и крупнейшая в США коммунальная компания NextEra Energy, занимающаяся электроснабжением. Она же является крупнейшим в мире провайдером в области ветроэнергетики. GE Vernova будет работать с AIP и партнёрами над формированием цепочек поставок. NextEra Energy поможет в масштабировании критически важных и разнообразных энергетических решений для ИИ ЦОД. Некоторые из поддерживающих AIP компаний также участвуют и в других инициативах по финансированию развития ИИ-инфраструктуры. В прошлом году Microsoft с Constellation Energy Generation объявили о возобновлении работы АЭС Three Mile Island. Обновление объекта обойдётся в $1,6 млрд. После того, как тот заработает приблизительно в 2026 году, все 837 МВт пойдут на питание дата-центров Microsoft. NVIDIA параллельно участвует в проекте Stargate.

21.03.2025 [01:15], Владимир Мироненко

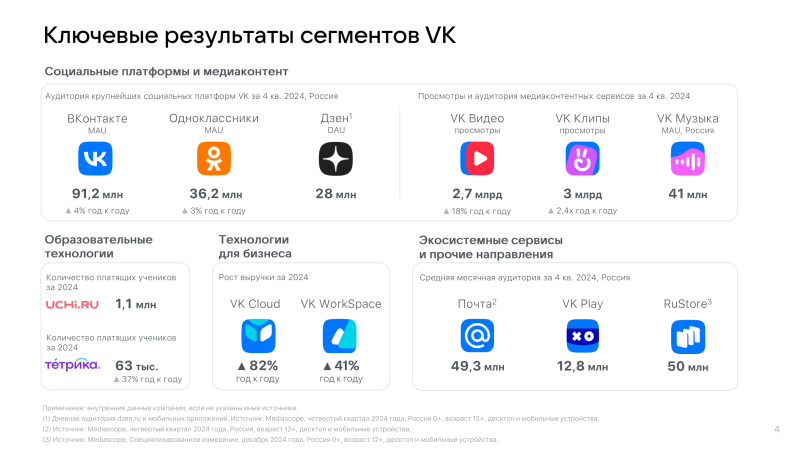

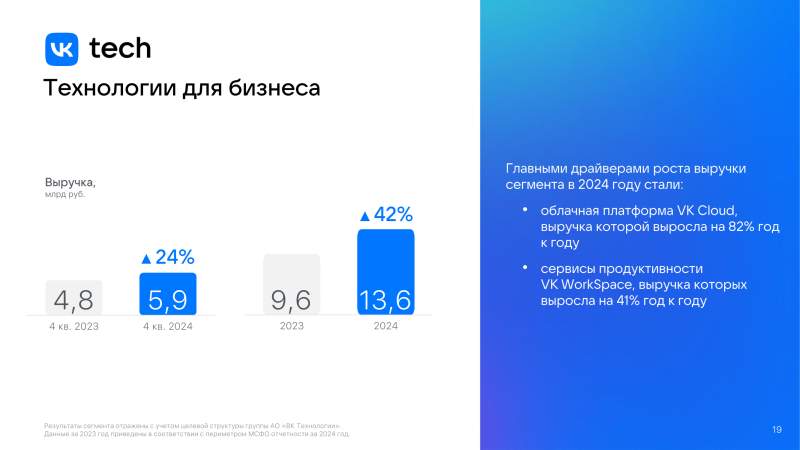

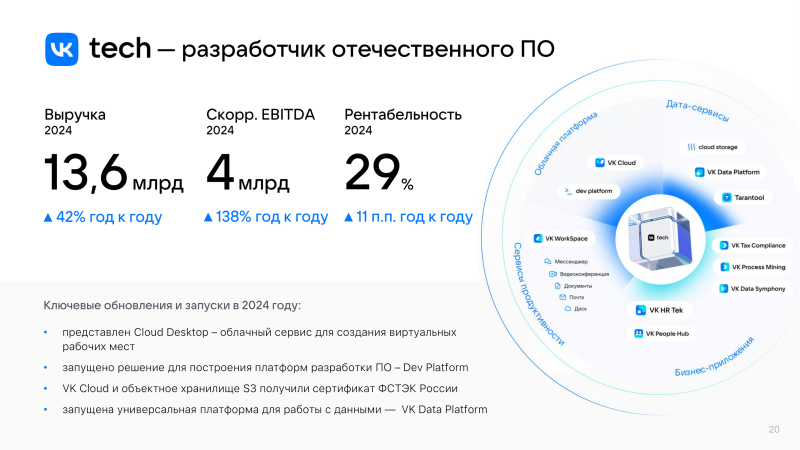

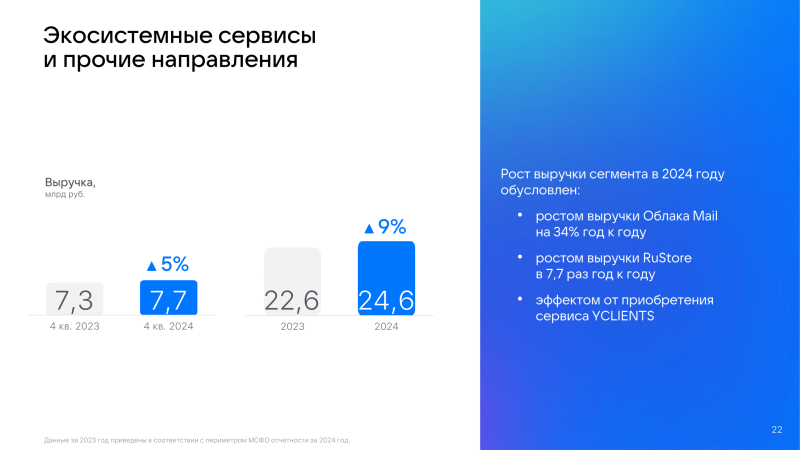

VK увеличила выручку за 2024 год на 23 %, а VK Tech — сразу на 42 %VK объявила аудированные финансовые результаты за 2024 год. Выручка компании выросла на 23 % по сравнению с 2023 годом до 147,6 млрд руб. Основным источником роста была онлайн-реклама, которая принесла компании 96,1 млрд руб. выручки, увеличившись по сравнению с предыдущим годом на 20 %. Вместе с тем выручка сегмента VK Tech увеличилась на 42 % год к году до 13,6 млрд руб., а скорректированная EBITDA выросла в 2,4 раза до 4 млрд руб. С момента выделения в отдельный сегмент в 2018 году среднегодовой рост выручки VK Tech по 2024 год составил 73 %, маржинальность по EBITDA — 29 %. Основными драйверами роста VK Tech в прошлом году были облачные сервисы платформы VK Cloud увеличившие выручку год к году на 82 % и сервисы продуктивности VK Workspace, показавшие рост выручки в 41 %. VK сообщила, что рассматривает возможность проведения первичного публичного размещения (IPO) акций VK Tech, и решение будет принято с учётом рыночной конъюнктуры. Как ожидается, это усилит потенциал развития VK Tech, а также будет способствовать узнаваемости и укреплению бренда. Выручка сегмента «Экосистемные сервисы и прочие направления», включающего сервис «Облако Mail.ru», выросла на 9 % до 24,6 млрд руб. При этом «Облако Mail.ru» увеличил выручку на 34 %. Средняя месячная аудитория сервиса в России за IV квартал 2024 года составила 21,8 млн пользователей, средняя дневная — 2,8 млн. Рост выручки от продаж единой подписки на «Почту» и «Облако Mail Space» за IV квартал составил 49 % год к году. Пользователи загрузили в «Облако Mail.ru» за три месяца 9 млрд файлов, что на 15 % больше, чем за IV квартал 2023 года. В «Облаке Mail.ru» появились тёмная тема, быстрая очистка места на устройстве и возможность кастомизации папок.

20.03.2025 [17:47], Руслан Авдеев

Crusoe расширит до 1,2 ГВт ИИ-кампус в Абилине, который, похоже, целиком достанется StargateКомпания Crusoe Energy начала вторую фазу строительства кампуса ИИ ЦОД в технопарке Lancium Clean Campus в Абилине (Abilene, Техас), который будет обслуживать ИИ-мегапроект Stargate. Предполагается, что она будет завершена в середине 2026 года, когда будут построены шесть новых зданий. Всего кампус будет включать восемь объектов. Итоговая площадь кампуса составит более 370 тыс. м2, а общая ёмкость вырастет до 1,2 ГВт. Первая фаза строительства ИИ ЦОД в Абилине стартовала в июне 2024 года. Она включает возведение двух зданий площадью более 90 тыс. м2 и ёмкостью более 200 МВт. Ожидается, что подача энергии начнётся в I половине 2025 года. OpenAI ранее заявляла о намерении управлять восемью зданиями в кампусе в Абилине. Crusoe отказалась комментировать, ведётся ли вторая фаза строительства в интересах Stargate. На этой неделе Crusoe анонсировала создание совместного предприятия на 4,5 ГВт не только для строительства ЦОД, но и для их автономного питания от газовых электростанций.

Источник изображения: Crusoe Как заявляют в Crusoe, экспансия в Абилине знаменует важную веху для ИИ-индустрии. Масштаб сконцентрированных на одной площадке вычислительных мощностей весьма примечателен — она, по оценкам, сможет разместить до 400 тыс. ускорителей. На рынке ИИ-инфраструктуры появилась новая категория — «ИИ-фабрика», позволяющая обрабатывать ИИ-нагрузки с беспрецедентными скоростью и масштабом. В Crusoe гордятся тем, что предоставляют инфраструктуру, которая будет способствовать развитию человечества. В Lancium добавляют, что управление ЦОД такого масштаба требует инноваций на уровне кампуса для обеспечения надёжности электросетей при любых нагрузках.

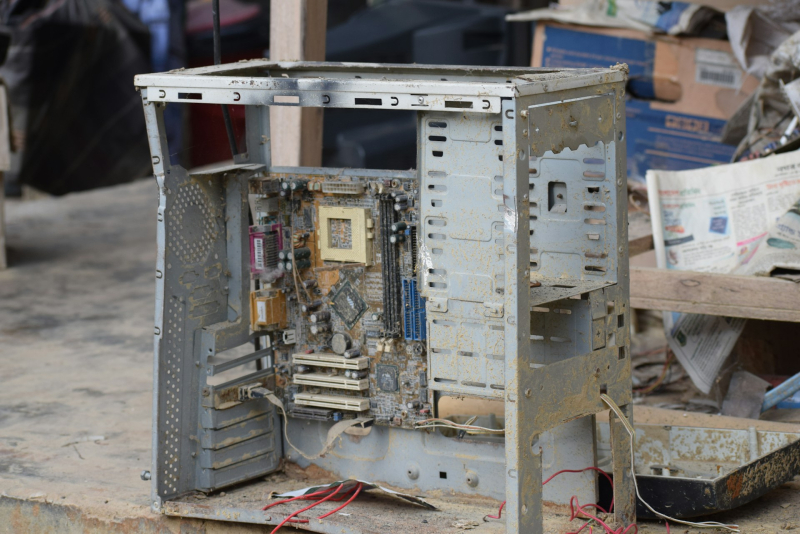

20.03.2025 [16:25], Татьяна Золотова

Почти вся ИТ-инфраструктура «Почты России» фактически «дышит на ладан», пожаловался глава госкомпанииПочти 90 % ИТ-инфраструктуры «Почты России» «дышит на ладан», а 55 % транспорта компании находится «за сроками полезного использования», сообщают «РИА Новости» со ссылкой на выступление главы ФГУП «Почта России» Михаила Волкова на расширенном заседании ИТ-комитета в Госдуме. Как заявил Михаил Волков, изношенность фондов очень большая. «Например, около 55 % нашего транспорта уже за сроками полезного использования. Что касается ИТ-инфраструктуры — 89 % фактически на ладан дышат», — был откровенен глава «Почты России». Ключевыми проблемами на 2025 год для организации ее глава называет низкий уровень заработных плат и крайняя изношенность инфраструктуры. При этом он указал, что в 2023 и 2024 годах зарплаты у специалистов основного производства повышались, но средний уровень выплат все равно в два раза ниже, чем в среднем по стране. С 2021 года уставный капитал «Почты России» был увеличен на 16,5 млрд руб. в рамках программы ее модернизации. Михаил Волков сообщил, что сейчас проходит программа модернизации и ремонта сельских отделений и совместно с Минцифры прорабатывается продление этой программы до 2030 года. Программа реализуется в соответствии с перечнем поручений Президента России. Глава «Почты России» объяснил, что организация работает над повышением операционной и финансовой эффективности: «На 36 % увеличена производительность труда, более чем на 30 % сокращены административно-управленческие расходы. И уже в 2023 году это позволило выйти на операционную прибыль, также и в 2024 году. Высокая ключевая ставка, конечно, сильно нас здесь сдерживает».

20.03.2025 [15:58], Сергей Карасёв

Supermicro анонсировала петабайтное 1U-хранилище All-Flash на базе Arm-суперчипа NVIDIA GraceКомпания Supermicro представила сервер ARS-121L-NE316R в форм-факторе 1U, на базе которого могут формироваться системы хранения данных петабайтной вместимости. В основу новинки положен суперчип NVIDIA Grace со 144 ядрами Arm Neoverse V2 и 960 Гбайт памяти LPDDR5x. Устройство оборудовано 16 фронтальными отсеками для NVMe-накопителей E3.S 1T. При использовании SSD ёмкостью 61,44 Тбайт суммарная вместимость может достигать 983 Тбайт. При этом до 40 серверов могут быть установлены в одну стойку, что обеспечит 39,3 Пбайт «сырой» ёмкости. Новинка располагает двумя внутренними посадочными местами для M.2 NVMe SSD и двумя слотами PCIe 5.0 x16 для карт типоразмера FHHL. Присутствуют сетевой порт управления 1GbE (RJ45), порт USB 3.0 Type-A и разъём mini-DP. Габариты сервера составляют 772,15 × 438,4 × 43,6 мм, масса — 19,8 кг без установленных накопителей. Питание обеспечивают два блока мощностью 1600 Вт с сертификатом 80 Plus Titanium. Применена система воздушного охлаждения с восемью съёмными вентиляторами диаметром 40 мм. Диапазон рабочих температур — от +10 до +35 °C. При необходимости сервер может быть оснащён двумя DPU NVIDIA BlueField-3 или двумя адаптерами ConnectX-8. Система подходит для поддержания рабочих нагрузок с интенсивным обменом данными, таких как ИИ-инференс, аналитика и пр. Отмечается, что при создании новинки Supermicro тесно сотрудничала с NVIDIA и WEKA (разработчик платформ хранения данных).

20.03.2025 [14:10], Татьяна Золотова

Роскомнадзор проверит, не используют ли операторы связи заграничные серверыСпециалисты Центра мониторинга и управления сетью связи общего пользования (ЦМУ ССОП) «Главного радиочастотного центра» (ГРЧЦ), который входит в Роскомнадзор (РКН), в ближайший месяц проведет плановые технические проверки использования российскими сервисами и операторами связи иностранной серверной инфраструктуры. Об этом сообщает «Интерфакс» со ссылкой на сообщение пресс-службы ведомства. Как поясняют в РКН, исследования необходимы для выработки мер по повышению устойчивости и безопасности работы упомянутых сервисов в рамках задачи обеспечения сетевого суверенитета. По данным сервиса по отслеживанию доступности сайтов и приложений Downdetector, сегодня в работе нескольких провайдеров РФ, операторов связи, мессенджеров и маркетплейсов произошел сбой. В РКН это связали с использованием иностранной серверной инфраструктуры, на которой и фиксируются сбои, сообщили «Известиям» в ведомстве. РКН порекомендовал отечественным организациям пользоваться мощностями российских хостинг-провайдеров. Согласно указу президента, с 1 января 2025 года органам государственной власти, заказчикам запрещается использовать иностранное программное обеспечение на принадлежащих им значимых объектах критической информационной инфраструктуры (КИИ). Как сообщал ранее ФСТЭК, по итогам 2024 года около 47 % из 170 российских организаций КИИ защита от киберугроз находится в критическом состоянии. Лишь у 13 % из них установлен минимальный базовый уровень защиты, а у около 40 % он относится к низким.

20.03.2025 [13:53], Руслан Авдеев

SoftBank решила купить производителя Arm-процессоров Ampere Computing за $6,5 млрдSoftBank Group подтвердила покупку производителя Arm-чипов Ampere Computing. Сделка оценивается в $6,5 млрд и, как ожидается, будет закрыта во II половине 2025 года, сообщает Silicon Angle. Оба главных акционера Ampere — Oracle и Carlyle Group — согласились продать свои доли в компании. После покупки Ampere будет действовать как независимое дочернее подразделение SoftBank, штаб-квартира компании по-прежнему останется в Санта-Кларе (Калифорния). Основанная в 2017 году бывшим вице-президентом Intel Рене Джеймс (Renee James) компания специализируется на выпуске серверных Arm-процессоров. Самой производительной моделью является AmpereOne M, поставки которого начались в декабре 2024 года. Процессор получил до 192 ядер и большую пропускную способность памяти, чем его предшественники. Также компания работает над разработкой ещё более производительного CPU Aurora который получит 512 ядер, HBM-память и выделенный ИИ-модуль.

Источник изображения: Ampere В SoftBank заявили, что покупают Ampere, в которой трудятся около 1 тыс. специалистов по полупроводникам, поскольку будущее «искусственного суперинтеллекта» требует прорывных вычислительных мощностей. Опыт Ampere в сфере чипов и HPC поможет ускорить соответствующие процессы и углубляет приверженность SoftBank к ИИ-инновациям в США. По имеющимся данным, Ampere впервые рассматривала продажу в сентябре 2024 года, позже компания наняла финансового консультанта для оценки перспектив. SoftBank выразила потенциальный интерес к покупке в январе 2025 года, а в прошлом месяце сообщалось, что переговоры о сделке идут весьма успешно. SoftBank уже является ключевым игроком на рынке чипов благодаря доле в Arm Holdings, купленной за $32 млрд в 2016 году. Arm вышла на IPO в 2023 году, но SoftBank всё ещё владеет крупнейшей долей компании. В прошлом июле SoftBank заключила сделку о покупке ещё одного производителя чипов — компании Graphcore, которая, как и Arm, базируется в Великобритании. Graphcore разрабатывает ИИ-ускорители. Сообщалось, что SoftBank может способствовать сотрудничеству Ampere и Graphcore в деле создания ИИ-серверов. |

|