Материалы по тегу: ии

|

24.06.2024 [15:45], Руслан Авдеев

OMS Group привлекла почти $300 млн на расширение флота кораблей для прокладки кабелейOptic Marine Group (OMS), занимающаяся прокладкой и обслуживанием подводных интернет-кабелей, объявила о скором пополнении флота компании. По данным Datacenter Dynamics, на расширение привлечено в долг RM1,35 млрд ($292,5 млн) благодаря соглашению с консорциумом «известных финансовых институтов». OMS объявила, что финансирование позволит компании получить новые возможности в обеспечении подводных телекоммуникаций. Руководимый KKR Capital Markets консорциум включает HSBC Bank, Affin Bank Bhd, Affin Hwang Investment Bank Bhd, BDO Capital & Investment Corporation, E-Sun Commercial Bank Ltd и SinoPac Co Ltd. В прошлом году компания уже получила $400 млн от группы KKR. Основанная в 1983 году OMS базируется в малайзийском Селангоре. Сегодня компания управляет шестью суднами для прокладки и ремонта кабелей, последний ввели в эксплуатацию в 2022 году. Всего же в мире на плаву остаётся около 60 подобных судов, многим из которых более 30 лет. Поскольку на планете имеется более 400 подводных кабелей и спрос только растёт, дефицит кораблей может привести к задержке реализации проектов и несвоевременным ремонтам. Например, на восстановление повреждённого кабеля у берегов королевства Тонга в своё время ушло 1,5 года, причём непосредственно ремонт занял всего 8 дней.

24.06.2024 [14:07], Руслан Авдеев

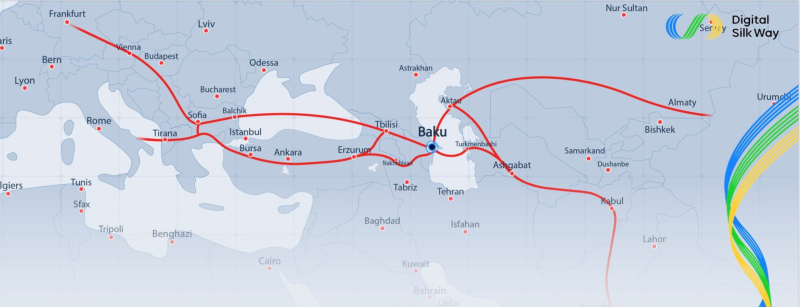

«Казахтелеком» и AzerTelecom создали СП для прокладки интернет-кабеля по дну Каспийского моряКомпания «Казахтелеком» создала совместное предприятие (СП) с азербайджанским телекоммуникационным холдингом. Datacenter Dynamics сообщает, что СП с AzerTelecom предназначено для прокладки подводного интернет-кабеля, который может стать частью более крупной магистрали. Соглашение предусматривает вложение более $50 млн в прокладку оптоволоконных кабелей по дну Каспийского моря. Основанная в 2008 году AzerTelecom является дочерней структурой азербайджанского мобильного оператора Bakcell. Компания входит в группу NEQSOL Holding. Стороны подписали меморандум о стратегическом сотрудничестве в 2022 году. Предполагается, что транскаспийская ВОЛС Trans-Caspian Fiber Optic Communication Line (FOCL) протянется на 370 км. Сейчас проводится тендер для поиска подрядчика, готового проложить ВОЛС. Кабельная система является частью проекта Цифрового Шелкового пути (Digital Dilk Way), в рамках которого планируется построить телекоммуникационный коридор между Европой и Азией. При этом на заседании Высшего Евразийского экономического совета (ЕАЭС) ещё в конце 2023 года было предложено проложить новую волоконно-оптическую линию связи по маршруту Россия — Казахстан — Иран, к которой может быть подключен и казахско-азербайджанский проект. Кроме того, Евросоюз планирует прокладку кабеля по дну Чёрного моря до Грузии, который также может стать частью общей системы. В то же время Россией ведётся строительство «Новой ТрансЕврАзийской волоконно-оптической линии связи» (TEA NEXT). Она призвана связать запад и восток страны с привязками к крупнейшим городам России и получит выходы на границы Россия — Монголия, Россия — Китай, а также посадочную станцию в Находке, откуда можно будет протянуть подводный сегмент до Пусана (Южная Корея).

24.06.2024 [13:20], Руслан Авдеев

Стоимость отечественного ПО в России растёт и будет растиУчастники российского рынка IT начали поднимать цены на предлагаемые решения. По данным «Коммерсанта», к лету цены выросли на 15-20 %, показатель сопоставим с изменениями за весь 2023 год в целом. В 2023 году рост цен к 2022 году составил 20 %. Отраслевые эксперты ожидают, что рост цен продолжится в III квартале. Одна из причин — намерение вернуть с 2025 года налог на прибыль на уровне 5 % — пока он является нулевым для поддержки IT-бизнеса. Кроме того, дефицит кадров привёл к росту затрат на разработку. По информации издания, опросившего представителей рынка, к июню цены выросли на 10–20 % год к году. Например, соответствующую статистику приводит «ТеДо» (ранее PwC), а в «КРОК» говорят о 10–15 %. Аналогичные цифры приводят и другие игроки рынка. Коробочное ПО подорожало в первую очередь у крупных вендоров, а заметнее всего цены подняли создатели защитного, системного и офисного ПО. Некоторые источники добавляют, что у отдельных вендоров цены на продукты, связанные с ИБ, в некоторых случаях выросли и на 30 %. В начале года сообщалось о создании «этической комиссии» IT-ассоциаций и Минцифры для согласования случаев повышения цен. А чуть более года назад была создана хартия по ограничению роста цен. В её рамках было предложено устанавливать лимит по стоимости, исходя из цены на ту же дату годом ранее, скорректированную с учётом годового индекса потребительских цен Росстата, плюс 15 %. По мнению некоторых экспертов сегодня рост цен во многом обусловлен новыми запросами клиентов IT-бизнеса. Если ранее речь шла лишь о пилотных внедрениях отечественного ПО на замену зарубежному, то теперь началось полномасштабное внедрение и клиенты ожидают привычного им ранее уровня возможностей и обслуживания. Впрочем, цены отчасти будет сдерживать конкуренция — многие компании и без того уже подняли их «с запасом» и теперь могут позволить себе ограничиться относительно небольшим повышением.

23.06.2024 [22:50], Владимир Мироненко

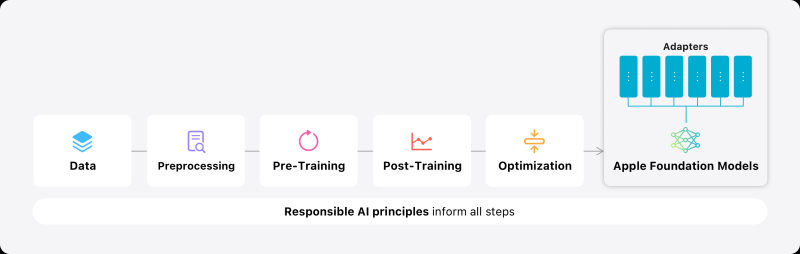

Облачный союз: Apple использует ИИ-инфраструктуру Google Cloud для Apple IntelligenceИИ-инфраструктура Apple Private Cloud Compute использует не только базовую ИИ-модель собственной разработки и серверы Apple для инференса, работающие на собственных чипах Apple, но и облако Google Cloud Compute, обратил внимание ресурс HPCWire. Сведения об ML-платформе Apple AXLearn указывают на гибридный подход к работе с ИИ, при котором Apple объединяет свои собственные серверы с возможностями Google Cloud, сообщил HPCwire, отметив, что новая инфраструктура является для Apple большим шагом вперёд. Например, Google и Microsoft, активно работают над развёртыванием ИИ ещё с конца 2022 года. Выпуск собственных систем знаменует возвращение Apple в сектор серверного оборудования после того, как в 2011 году она прекратила выпуск Xserve. Apple сообщила в своём блоге, что AXLearn использует фреймворк Google JAX и компилятор XLA и позволяет обучать модели с высокой эффективностью и масштабируемостью на различном оборудовании и облачных платформах, включая фирменные ИИ-ускорители Google TPU, а также облачные и локальные ускорители на базе GPU (конкретные модели не уточняются). У Apple есть две новые собственные ИИ-модели, одна из которых имеет 3 млрд параметров и используется для ИИ приложений на устройствах, а также более крупная LLM для запуска на серверах. Модели, разработанные с помощью фреймворка TensorFlow, созданного Google, были обучены на TPU Google. При этом AXLearn включает оркестратор, который пока работает только с Google Cloud. Впрочем, Apple оговаривается, что «теоретически его можно расширить для работы на платформах других облачных провайдеров». Инференс же выполняется исключительно на собственных серверах компании, причём для обработки запроса пользователя каждый раз создаётся новый временный инстанс, который безвозвратно удаляется вместе с данными после завершения задачи, а для передачи информации используется сквозное шифрование. Apple в рамках объявленного на WWDC 2024 сотрудничества c OpenAI интегрирует чат-бот ChatGPT в голосового помощника Siri, а также в другие инструменты iOS и остальных платформ. Поскольку существуют риски утечки данных на сторонней платформе, устройства Apple будут направлять запрос на разрешение пользователя отправлять данные в ChatGPT.

23.06.2024 [12:35], Сергей Карасёв

Между Microsoft и NVIDIA возникли разногласия по поводу использования ускорителей B200У компаний Microsoft и NVIDIA, по сообщению The Information, возникли разногласия по поводу использования новейших ускорителей B200 на архитектуре Blackwell. NVIDIA настаивает на том, чтобы клиенты приобретали эти изделия в составе полноценных серверных стоек, тогда как Microsoft с этим не согласна. Отмечается, что NVIDIA, удерживающая приблизительно 98 % рынка ускорителей для ЦОД, стремится контролировать использование своих продуктов. В частности, компания накладывает ограничения в отношении дизайна ускорителей, которые партнёры создают на чипах NVIDIA. Во время презентации Blackwell глава NVIDIA Дженсен Хуанг (Jensen Huang) неоднократно указывал на то, что теперь минимальной единицей для развёртывания должен стать суперускоритель GB200 NVL72. То есть NVIDIA призывает клиентов приобретать вместо отдельных ускорителей целые стойки и даже кластеры SuperPOD. По заявлениям компании, это позволит повысить ИИ-производительность благодаря оптимизации всех компонентов и их максимальной совместимости друг с другом. Кроме того, такая бизнес-модель позволит NVIDIA получить дополнительную выручку от распространения серверного оборудования и ещё больше укрепить позиции на стремительно развивающемся рынке ИИ. Однако у Microsoft, которая оперирует огромным количеством разнообразных ускорителей и других систем в составе своей инфраструктуры, возникли возражения в отношении подхода NVIDIA. Сообщается, что вице-президент NVIDIA Эндрю Белл (Andrew Bell) попросил Microsoft приобрести специализированные серверные стойки для ускорителей Blackwell, но редмондский гигант ответил отказом. По заявлениям Microsoft, решения NVIDIA затруднят корпорации внедрение альтернативных ускорителей, таких как AMD Instinct MI300X. Дело в том, что форм-факторы стоек NVIDIA и стоек Microsoft различаются на несколько дюймов. Из-за этого могут возникнуть сложности с изменением конфигурации и модернизацией, предусматривающей использование конкурирующих компонентов. Так, Microsoft использует единую базовую платформу и для ускорителей NVIDIA, и для ускорителей AMD. Microsoft эксплуатирует вариант стоек OCP и старается максимально унифицировать инфраструктуру своих многочисленных дата-центров. NVIDIA, в конце концов, согласилась с доводами Microsoft и пошла на уступки, но это, похоже, не последнее подобное разногласие между компаниями.

23.06.2024 [11:45], Сергей Карасёв

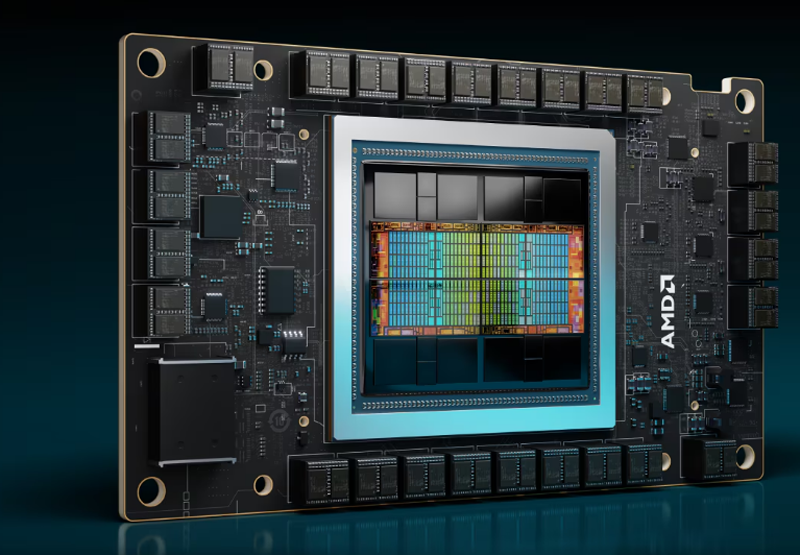

AMD отказывается от публичного тестирования ускорителей Instinct MI300X в бенчмарках MLPerfКомпания AMD, по сообщению ресурса Wccftech, отклонила просьбу стартапа Tiny Corp о сравнительном испытании ИИ-ускорителей Instinct MI300X в бенчмарке MLPerf, который предлагает тесты для множества разных сценариев, в том числе для задач машинного зрения, обработки языка, рекомендательных систем и обучения с подкреплением. Tiny Corp является разработчиком фреймворка Tinygrad для нейросетей. Кроме того, стартап проектирует компактные компьютеры Tinybox, ориентированные на выполнение ИИ-задач. В зависимости от типа используемых ускорителей (AMD или NVIDIA) производительность достигает 738 или 991 Тфлопс (FP16). Цена — $15 тыс. и $25 тыс. соответственно. Не так давно Tiny Corp предложила AMD предоставить ускорители Instinct MI300X для нового этапа тестов в MLPerf. Однако разработчик чипов по каким-то причинам отказался это сделать, дав крайне уклончивый ответ. «Наше предложение было отклонено. Они [компания AMD] не говорят чётко "нет", используя вместо этого не несущие смысловой нагрузки слова вроде "партнёрство" и "сотрудничество"», — отмечается в сообщении Tiny Corp.

Источник изображения: AMD Высказываются предположения, что нежелание AMD участвовать в тестах MLPerf может быть связано с заявлениями компании о превосходстве ускорителей Instinct MI300X над изделиями конкурентов. Фактическая оценка производительности в MLPerf может подорвать эти утверждения. Впрочем, в тестах MLPerf отказываются участвовать и другие игроки рынка, например, Groq. Так или иначе, на сегодняшний день чипы NVIDIA остаются безоговорочными лидерами в бенчмарке MLPerf. Вместе с тем единственным конкурентом для них в этом тесте выступают изделия Intel Gaudi. Изделия Intel не дотягивают по производительности до решений NVIDIA, но компания делает упор на стоимость своих продуктов и даже публично назвала цены на ускорители Gaudi, что для данной индустрии случай крайне редкий.

22.06.2024 [22:16], Владимир Мироненко

Илон Маск намерен построить сразу два крупнейших в мире ИИ-кластераНа этой неделе на платформе YouTube появился видеоролик блогера Брэда Слоана (Brad Sloan), посвящённый строительству новых объектов гигафабрики Tesla в Техасе (Gigafactory Texas), включая ЦОД, где будет размещён ИИ-кластер на базе суперкомпьютера Dojo. В соцсети X глава Tesla Илон Маск (Elon Musk) заявил, что уже в этом году энергопотребление этой системы составит 130 МВт, а через 18 месяцев этот показатель вырастет до 500 МВт и данный кластер станет крупнейшим в мире. Строительство ЦОД стартовало в октябре прошлого года. Хотя компания не стала предавать гласности график строительства и намеченные сроки завершения, пока всё идёт не так, как планировалось Маском. В частности, есть сложности с доставкой материалов в Остине. Также наблюдаются задержки со строительством под площадкой дата-центра туннеля для передвижения электрических пикапов Cybertruck, за которое несёт ответственность основанная Маском компания Boring Company. После посещения площадки Маск уволил директора по строительной инфраструктуре проекта, а также провёл кадровые перестановки. Также сообщается, что миллиардер отложил и даже отменил некоторые проекты Tesla, чтобы направить все строительные ресурсы на этот объект. Илон Маск уточнил в комментариях, что ИИ-кластер будет использовать не только чипы собственной разработки Tesla D1, но и ускорители NVIDIA, а также других поставщиков, хотя ранее он говорил, что в основу суперкомпьютера Dojo лягут только фирменные ускорители Tesla. Как сообщается, затраты Tesla на проект Dojo в этом году составят более $1 млрд. Маск уверен, что ИИ ускорит обучение систем автономного вождения электромобилей и разработку инновационных технологий для роботизированных автомобилей. Вместе с тем, Маск уделяет большое внимание строительству стартапом xAI «крупнейшего в мире» кластера ускорителей в Северной Дакоте. С его помощью он планирует расширить возможности чат-бота Grok благодаря совершенствованию больших языковых моделей, стоящих за ним. Недавно Маск подтвердил передачу ускорителей NVIDIA H100, ранее заказанных Tesla, социальной сети X и ИИ-стартапу xAI. Это вызвало вопросы у акционеров Tesla по поводу того, какой проект на самом деле является приоритетным для Илона Маска. Для xAI, в частности, планируется создать систему с 300 тыс. NVIDIA B200.

22.06.2024 [15:01], Сергей Карасёв

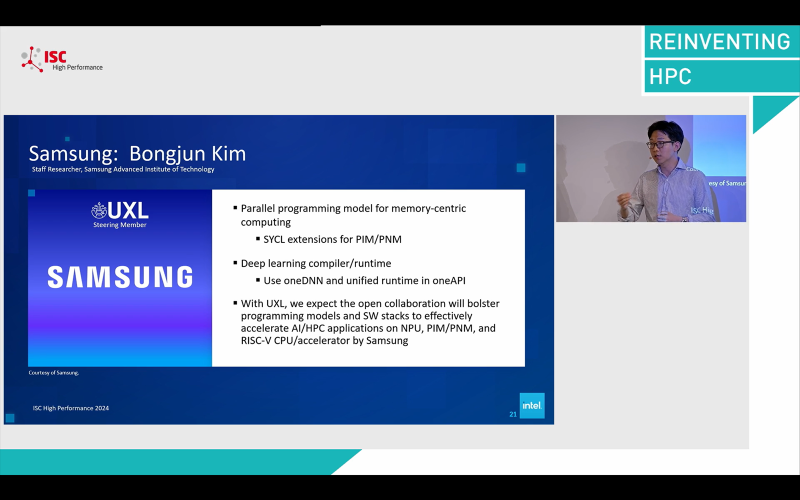

Samsung случайно упомянула о разработке RISC-V чипа для ИИ-задачВ ходе конференции ISC 2024 компания Samsung, по сообщению HPC Wire, намекнула на разработку некоего чипа на открытой архитектуре RISC-V. Предполагается, что это изделие будет использоваться при решении задач, связанных с ИИ и НРС. На одном из продемонстрированных южнокорейским производителем слайдов упоминается изделие CPU/ИИ-ускоритель на базе RISC-V («RISC-V CPU/AI accelerator from Samsung»). О чём именно идёт речь, сказать трудно. Возможно, Samsung проектирует процессор RISC-V с нейромодулем для ускорения ИИ-операций. С другой стороны, это может быть самостоятельный чип, предназначенный для работы в связке с ИИ-ускорителем. Например, Google уже использует RISC-V процессоры SiFive вместе со своим TPU. Отмечается, что слайд был показан на сессии ISC 2024, посвящённой инициативе UXL Foundation (Unified Acceleration Foundation). Целью данного проекта является создание универсального открытого ПО, которое позволит разработчикам ИИ-решений отказаться от CUDA и использовать ускорители других производителей. В состав UXL входят Intel, Qualcomm, Samsung, Arm и Google. На слайде также упоминается модель параллельного программирования в контексте вычислений в памяти. Данная концепция позволяет повысить производительность, в том числе при обучении ИИ-моделей. Ранее Samsung и AMD представили экспериментальный ИИ-суперкомпьютер, скрестив «вычислительную» память HBM-PIM и ускорители Instinct MI100. Кроме того, Samsung работает над похожей концепцией PNM (processing-near-memory), которая будет использоваться в модулях памяти CXL. Samsung также работает над собственными ИИ-ускорителями Mach-1, которые уже заказала ведущая южнокорейская интернет-компания Naver. По заявлениям Samsung, изделие Mach-1 позволяет выполнять инференс больших языковых моделей (LLM) даже с маломощной памятью. Таким образом, есть вероятность, что новый RISC-V-процессор Samsung сможет работать в связке с ИИ-ускорителями компании для максимизации производительности.

22.06.2024 [14:34], Сергей Карасёв

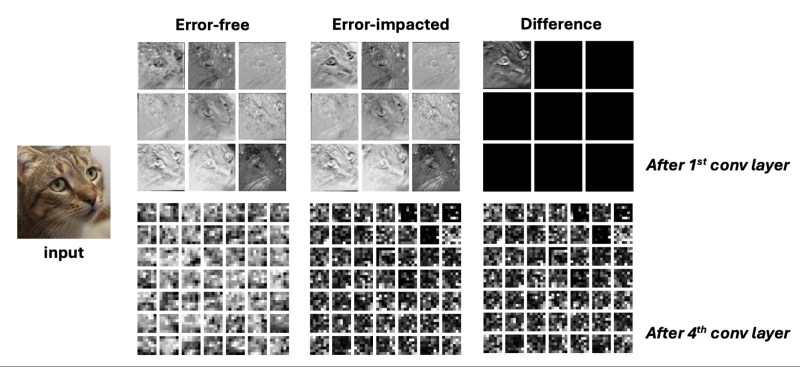

Галлюцинации от радиации: аппаратные сбои могут провоцировать ошибки в работе ИИ-системКомпания Meta✴, по сообщению The Register, провела исследование, результаты которого говорят о том, что ошибки в работе ИИ-систем могут возникать из-за аппаратных сбоев, а не только по причине несовершенства алгоритмов. Это может приводить к неточным, странным или просто плохим ответам ИИ. Говорится, что аппаратные сбои способны провоцировать повреждение данных. Речь идёт, в частности, о так называемом «перевороте битов» (bit flip), когда значение ячейки памяти может произвольно меняться с логического «0» на логическую «1» или наоборот. Это приводит к появлению ложных значений, что может обернуться некорректной работой ИИ-приложений. Одной из причин ошибок является космическое излучение, причём с ростом плотности размещения ресурсов его влияние нарастает. Впрочем, в современных комплексных системах такие ошибки по разным причинам могут возникать на любом из этапов хранения, передачи и обработки информации.

Ошибка в одном бите одного параметра существенно меняет ответ ИИ (Источник: Meta✴) Такие необнаруженные аппаратные сбои, которые не могут быть выявлены и устранены «на лету», называют тихими повреждениями данных (Silent Data Corruption, SDC). Подобные ошибки могут провоцировать изменения ИИ-параметров, что, в конечном счёте, приводит к некорректному инференсу. Утверждается, что в среднем 4 из 1000 результатов инференса неточны именно из-за аппаратных проблем. «Растущая сложность и неоднородность платформ ИИ делает их всё более восприимчивыми к аппаратным сбоям», — говорится в исследовании Meta✴. При этом изменение одного бита может привести к тому, что ошибки будут расти как снежный ком. Для оценки возможных неисправностей предлагается ввести новую величину — «коэффициент уязвимости параметров» (Parameter Vulnerability Factor, PVF). PVF показывает вероятность того, как повреждение конкретного параметра в конечном итоге приведёт к некорректному ответу ИИ-модели Эта метрика, как предполагается, позволит стандартизировать количественную оценку уязвимости модели ИИ к возможным аппаратным сбоям. Показатель PVF может быть оптимизирован под различные модели и задачи. Метрику также предлагается использовать на этапе обучения ИИ и для выявления параметров, целостность которых надо отслеживать. Производители аппаратного оборудования также принимают меры к повышению надёжности и устойчивости работы своих решений. Так, NVIDIA отдельно подчеркнула важность RAS в ускорителях Blackwell. Правда, делается это в первую очередь для повышения стабильности сверхкрупных кластеров, простой которых из-за ошибок обойдётся очень дорого.

22.06.2024 [12:42], Сергей Карасёв

«Аквариус» начал производство 1GbE-коммутаторов AQ-N3000, в том числе с поддержкой PoEГруппа компаний «Аквариус» сообщила о том, что на заводе в Твери произведена первая партия отечественных коммутаторов корпоративного класса серии AQ-N3000. Данная платформа, как утверждается, создана для трансформации типовой сетевой инфраструктуры в гибридную производственную среду, где рабочее место не фиксировано в пространстве, а доступ к информационным ресурсам осуществляется с любого устройства. На сегодняшний день в семейство входят четыре модели Aquarius AQ-N3000-48P4Y2Q, Aquarius AQ-N3000-48T4Y2Q, Aquarius AQ-N3000-24P4Y2Q и Aquarius AQ-N3000-24T4Y2Q. Первые две оснащены 48 портами 1GbE, две другие — 24. Все коммутаторы оборудованы четырьмя портами 10/25G SFP28 и двумя разъёмами 40G QSFP. Старшие версии обеспечивают производительность до 456 Гбит/с, младшие — до 408 Гбит/с. Модели AQ-N3000-48P4Y2Q и AQ-N3000-24P4Y2Q поддерживают технологию PoE с бюджетом мощности 2 × 1080 Вт и 2 × 380 Вт соответственно. Новинки оснащены двумя блоками питания с возможностью горячей замены. Для охлаждения применяются четыре вентилятора. Есть консольный порт RJ-45 и порт OOB 1GbE RJ-45. Диапазон рабочих температур — от 0 до +45 °C. Коммутаторы имеют габариты 44 × 440 × 440 мм, а масса в зависимости от модификации варьируется от 7,0 до 8,4 кг. «Аквариус» планирует в ближайшее время внести устройства в реестр телекоммуникационного оборудования российского происхождения Минпромторга. Уже запущен портал технической документации, где пользователи смогут получить всю необходимую информацию об изделиях и ОС коммутаторов Aquarius Network Operating System (AqNOS). Сервис предлагает свободный доступ к актуальным версиям технической документации AqNOS, руководству пользователя, справочникам команд, дизайн-инструкциям и пр. Кроме того, через портал можно будет получить доступ к онлайн-демонстрации оборудования и службе технической поддержки. «Запуск первой партии коммутаторов — важный шаг не только для компании, но и IT-рынка в целом, поскольку это позволит удовлетворить высокий спрос заказчиков на доверенное телекоммуникационное оборудование для построения ведомственных и корпоративных сетей связи. Наша ключевая задача как производителя сегодня — наладить производство, максимально возможно локализовав технологические операции в РФ», — отмечает президент группы компаний «Аквариус». |

|