Материалы по тегу: s

|

23.05.2025 [15:22], Владимир Мироненко

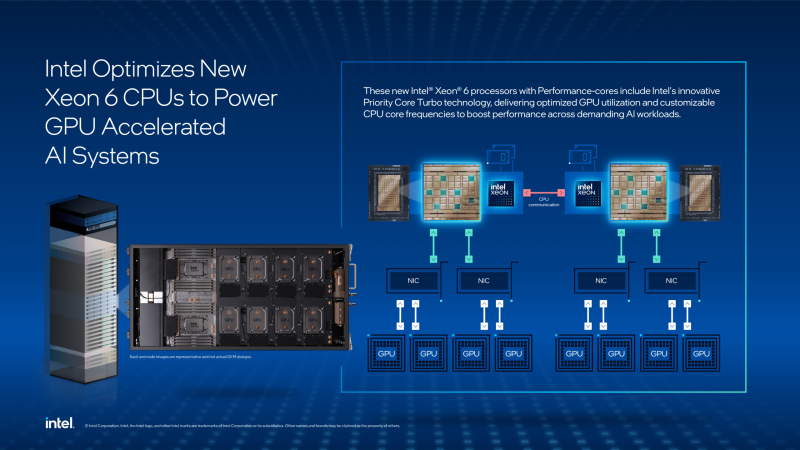

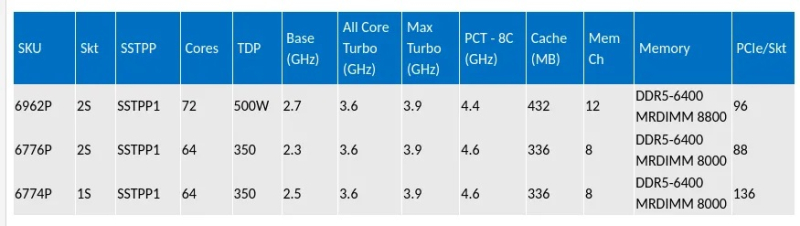

Специально для ИИ: Intel представила три оптимизированных процессора Intel Xeon Granite Rapids, один из которых используется в NVIDIA DGX B300Intel представила три новых процессора семейства Intel Xeon 6 Granite Rapids-SP/AP — 6962P, 6774P и 6776P, разработанные для управления «самыми передовыми ИИ-системами ускорителей». Новые процессоры с P-ядрами используют технологию Intel Priority Core Turbo (PCT), а также технологию Intel Speed Select Turbo Frequency (Intel SST-TF), которые позволяют настраивать частоты ядер процессора для повышения производительности ускорителя при обработке требовательных рабочих ИИ-нагрузок. Новые процессоры Xeon 6 уже доступны для заказчиков. В частности, Intel Xeon 6776P используется в ИИ-системе NVIDIA DGX B300, где «играет важную роль в управлении, оркестрации и поддержке ИИ-системы». «Новые чипы демонстрируют непревзойдённую производительность Xeon 6, что делает их идеальными процессорам для ИИ-систем с ускорением на GPU следующего поколения», — отметила Карин Айбшиц Сигал (Karin Eibschitz Segal), корпоративный вице-президент и временный генеральный директор Intel Data Center Group. Как сообщила Intel, внедрение PCT в сочетании с Intel SST-TF обеспечивает значительный скачок производительности ИИ-систем. PCT позволяет динамически формировать пул высокоприоритетных ядер, которые работают на более высоких турбочастотах, в то время как остальные ядра работают на базовой частоте, обеспечивая оптимальное распределение ресурсов процессора. Эта функция имеет решающее значение для рабочих ИИ-нагрузок, требующих последовательной и пакетной обработки, более быстрой отправки данных к ускорителям и повышения общей эффективности системы. Впрочем, в случае 6776P лишь до восьми ядер могут работать на повышенной турбочастоте. Процессоры Xeon 6 с P-ядрами, по словам Intel обеспечивают ведущие в отрасли характеристики для ИИ-систем, включая:

Новые процессоры отличаются высокой надёжности и удобством обслуживания, что сводит к минимуму перебои в работе. Как сообщается, новинки поддерживают AMX-вычисления с точностью FP16, что обеспечивает эффективную предобработку данных и выполнение критических задач ЦП в рабочих ИИ-нагрузках.

23.05.2025 [11:44], Сергей Карасёв

Asustor представила стоечные NAS серии Lockerstor R Pro Gen2 на чипах AMD Ryzen 7 ProКомпания Asustor на выставке Computex 2025 представила в числе прочих новинок стоечные сетевые хранилища семейства Lockerstor R Pro Gen2 для корпоративных пользователей, включая предприятия малого и среднего бизнеса. В основу устройств положена аппаратная платформа AMD. Дебютировали модели AS7212RDX и AS7216RDX, рассчитанные соответственно на 12 и 16 накопителей LFF/SFF с интерфейсом SATA/SAS. В обоих случаях предусмотрены коннектор M.2 для NVMe SSD (PCIe 5.0 x4) и слот PCIe 5.0 x8 для карты расширения, например, сетевого адаптера 25/40/100GbE. Питание обеспечивают два блока с резервированием, имеющие сертификат 80 PLUS Platinum. NAS оборудованы 8-ядерным процессором Ryzen 7 Pro, выполненным по 5-нм технологии. Объём оперативной памяти DDR5-4900 ECC в стандартной конфигурации составляет 16 Гбайт (возможно расширение до 192 Гбайт). Предусмотрены по два сетевых порта 10GbE и 1GbE с разъёмами RJ45. Есть четыре порта USB 3.2 Gen1 Type-A. В системе охлаждения задействованы вентиляторы с возможностью горячей замены. Модель AS7212RDX имеет размеры 576 × 439 × 88 мм и весит 14 кг без установленных накопителей. Габариты AS7216RDX составляют 576 × 439 × 116 мм, масса — 15,3 кг. Допускается подключение модулей расширения Xpanstor 12R SAS Expansion Unit, которые оборудованы двумя источниками питания и кулерами с горячей заменой. Производитель предоставляет на хранилища пятилетнюю гарантию. Кроме того, Asustor представила на Computex 2025 популярные модели «настольных» сетевых хранилищ серий Drivestor Gen2 и Lockerstor Gen2+, которые могут использоваться в небольших офисах и домашних условиях.

22.05.2025 [16:30], Руслан Авдеев

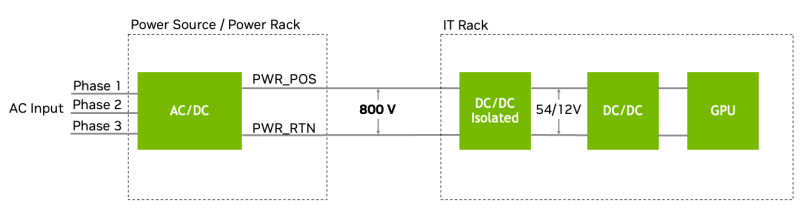

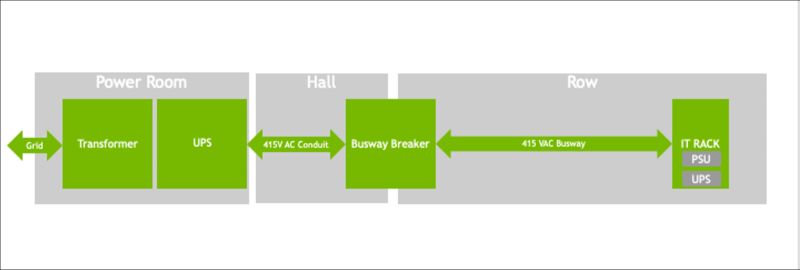

800 В прямо к ускорителям: Infineon и NVIDIA разрабатывают архитектуру HVDC-питания для ИИ ЦОДInfineon Technologies объединит усилия с NVIDIA для разработки централизованной архитектуры высоковольтного питания постоянным током (HVDC) на 800 В. Она рассчитана на дата-центры, обслуживающие ИИ-системы. Речь идёт о первом в отрасли решении по переходу от децентрализованного к централизованному питанию серверных стоек, сообщает Converge. Впрочем, пока Infineon не будет отказываться от традиционных и переходных архитектур питания. По данным пресс-службы Infineon, новая архитектура предусматривает преобразование энергии непосредственно на уровне ускорителя, в пределах серверной платы — предполагается, что это позволит поддерживать будущие системы с энергопотреблением более 1 МВт на стойку. Централизованный подход направлен на сокращение этапов преобразования энергии, оптимизацию размещения оборудования в стойках для экономии пространства, а также повышение надёжности и масштабируемости ИИ-инфраструктуры. Современные ИИ ЦОД используют не вполне эффективные методы распределения питания. В настоящее время система электропитания в дата-центрах децентрализована, а энергоснабжение ИИ-чипов обеспечивается большим количеством блоков и модулей питания. Проблема охлаждения модулей питания в серверных стойках из-за их компактного размещения весьма распространена. Решением может быть вынос преобразователей питания за пределы стоек, что снижает тепловую нагрузку, повышая общую отказоустойчивость системы. Пока речь идёт о выносе модулей питания в отдельную стойку, но в будущем возможно использование единых 800-В шин для ЦОД целиком.

Источник изображения: NVIDIA Использование высокоплотного централизованного распределения 800 В задаст новые стандарты энергоэффективности и масштабируемости, позволив оптимально использовать ограниченное пространство в серверных стойках. Изменение технологий происходит на фоне роста нагрузок в ИИ ЦОД, некоторые операторы уже эксплуатируют 100 тыс. ускорителей одновременно. Для поддержки новых технологий Infineon использует свой опыт в сфере силовых полупроводников на базе кремния, карбида кремния, нитрида галлия и др.

Источник изображения: NVIDIA Другими словами, ключевыми особенностями проекта являются:

По словам Infineon, сочетание её знаний в сфере энергообеспечения и позиций NVIDIA в роли мирового лидера ИИ-индустрии прокладывает дорогу к созданию нового стандарта архитектуры питания дата-центров, позволяющего создавать быструю, эффективную и масштабируемую инфраструктуру.

Традиционные системы. Источник изображения: NVIDIA Высоковольтные системы постоянного тока уже применялись в прошлом, но их внедрение, как сообщает NVIDIA, требует обеспечения безопасности эксплуатации, стандартизации и обучения персонала. NVIDIA и партнёры исследуют экономические и технологические аспекты перехода на 800 В, сравнивая традиционные трансформаторные решения с твердотельными (SST) модулями для оптимизации затрат и надёжности.

Системы нового типа. Источник изображения: NVIDIA В самой NVIDIA утверждают, что новая архитектура обеспечивает масштабируемость от 100 кВт до 1 МВт, а энергоэффективность повысится на уровень до 5 % в сравнении с современными системами на 54/12 В. Попутно снизится использование меди, повысится надёжность и останется задел на будущее, поскольку 1 МВт на стойку — это не предел. Microsoft и Meta✴ пока что предлагают перейти на использование 400 В DC. Речь о системе Mt. Diablo, спецификации которой предоставляются участникам проекта Open Compute Project (OCP). Идея заключается в разделении стойки на независимые шкафы для компонентов подсистемы питания и вычислительного оборудования. Речь идёт о дезагрегированной архитектуре, позволяющей гибко регулировать мощность в соответствии с меняющимися требованиями. А Veir, к примеру, предлагает дата-центрам перейти на сверхпроводящие силовые кабели.

22.05.2025 [12:36], Руслан Авдеев

На пути к гигаватту: Nebius увеличит капитальные затраты в 2025 году до $2 млрдПровайдер облачных ИИ-сервисов Nebius (ранее Yandex N.V.) увеличил прогнозируемые капитальные затраты в 2025 году на треть. В отчёте за I квартал сообщается, что теперь капзатраты за год составят порядка $2 млрд — ранее речь шла об $1,5 млрд, сообщает Datacenter Dynamics. По словам компании, увеличение связано с переносом затрат с IV квартала предыдущего периода на I квартал нового. Кроме того, виновата и «оппортунистическая» стратегия компании — речь идёт о недавно анонсированном суперкомпьютере в Израиле. Изначально израильского проекта за $140 млн в планах не было, но раз появилась такая возможность, то ей было решено воспользоваться, к тому же часть расходов оплатят израильские власти. Базового уровня мощности в 100 МВт компания рассчитывает добиться уже в 2025 году, но её руководство заявляет, что на деле амбиций гораздо больше — со временем планируется выйти на уровень в 1 ГВт. Сейчас компания располагает возможностью финансировать рост расходов за счёт неосновных активов, долей в сторонних монетизируемых проектах. Так, Nebius косвенно подтвердила, что сейчас идёт раунд сбора средств для Clickhouse, который может довести капитализацию этой компании до $6 млрд, что уже положительно сказалось на оценках самой Nebius. Также Nebius имеет значительные доли в Toloka и Avride. Недавно Toloka получила $72 млн инвестиций от Bezos Expeditions, которой владеет основатель Amazon Джефф Безос (Jeff Bezos).

Источник изображения: Alexander Grey/unsplash.com Также компания намерена получить доступ и к более традиционным источникам средств. В декабре 2024 года Nebius уже привлекала $700 млн в виде акционерного финансирования от Accel, NVIDIA и структур, подконтрольных Orbis Investments. Кроме того, компания завершила квартал с $1,4 млрд на балансе, что подчеркивает её финансовую устойчивость и перспективы для дальнейших инвестиций или роста. Несмотря на прогнозируемый рост капитальных затрат, Nebius отчиталась о квартальной выручке в размере $55,3 млн, на 385 % больше год к году в сравнении с $11,4 млн в 2024 году. Основным источником средств стала ИИ-инфраструктура компании. Скорректированный убыток по EBITDA за квартал составил $62,6 млн, на 12 % меньше год к году, чистый убыток от продолжающейся деятельности — $113,6 млн. Ожидается, что показатель EBITDA станет положительным в 2025 году. Прогноз головой выручки составляет $500–$700 млн, при этом годовой темп выручки оценивается компанией в $0,75—$1 млрд к концу 2025 года. В любом случае предполагается последовательный рост компании.

Источник изображения: Alexander Grey/unsplash.com Предложение ускорителей NVIDIA Blackwell клиентам даст уверенность в том, что показатели компании будут соответствовать собственным прогнозам. Компания уже предлагает доступ к GB200, а в III квартале начнёт развёртывать Blackwell Ultra (GB300). По словам генерального директора компании Аркадия Воложа (Arkady Volozh), текущая клиентская база компании — новые ИИ-бизнесы, появившиеся в последние пару лет. Большинство из них базируется в США, поэтому Nebius сосредоточена на том, чтобы нарастить мощности в этой стране. По словам бизнесмена, пока не привлечены передовые ИИ-лаборатории и действительно крупные клиенты, но в Nebius усердно работают над этим — таким клиентам понадобится больше ЦОД. Nebius также присоединилась к платформе NVIDIA DGX Cloud Lepton, которая упрощает облачный доступ к ускорителям NVIDIA. К Lepton также присоединились CoreWeave, Crusoe, Firmus, Foxconn, GMI Cloud, Lambda, Nscale, SoftBank и Yotta Data Services. Также известно, что компания назначила нового финансового директора — Марию дель Дадо Алонсо Санчес (Maria del Dado Alonso Sanchez), которая уже 1 июня должна сменить на этом посту Рона Джейкобса (Ron Jacobs). Новая CFO имеет за плечами более 25 лет опыта работы на руководящих должностях, в том числе в Amazon, Booking.com, Naspers/OLX и BBG.

21.05.2025 [22:58], Владимир Мироненко

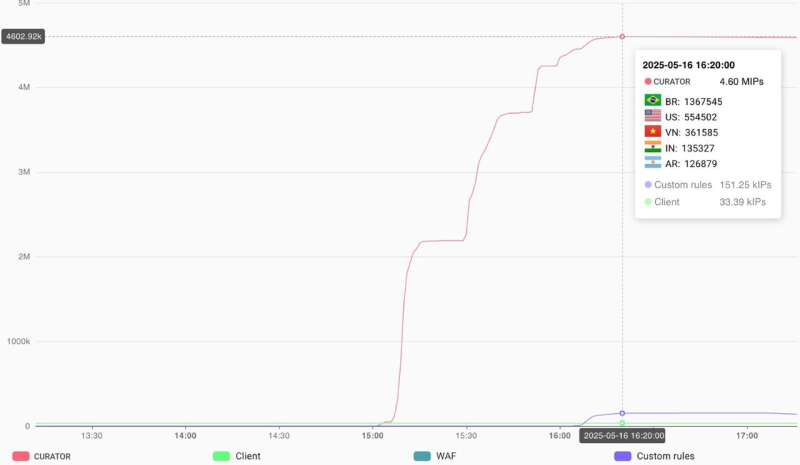

Curator отразила атаку крупнейшего в истории DDoS-ботнета из 4,6 млн устройствКомпания Curator сообщила об успешной нейтрализации атаки самого крупного за всю историю наблюдений DDoS-ботнета, состоявшего из 4,6 млн устройств. Для сравнения, самый большой DDoS-ботнет, выявленный в прошлом году, состоял из 227 тыс. устройств, а крупнейший ботнет, зафиксированный в 2023 году — из 136 тыс. устройств. По данным Curator, 16 мая 2025 года атаке подверглась организация из сегмента «Государственные ресурсы», микросегмент — «Общественные организации». Атака проводилась в несколько этапов. На первом этапе в ней было задействовано порядка 2 млн устройств. На втором этапе ботнет пополнился ещё 1,5 млн устройств, а на третьем этапе количество устройств достигло 4,6 млн. Как полагают аналитики Curator, преступники в итоге задействовали все имеющиеся ресурсы. Большая часть устройств, входивших в ботнет, была из Южной и Северной Америки. Около 1,37 млн заблокированных во время атаки IP-адресов (30 % всего ботнета), были зарегистрированы в Бразилии, порядка 555 тыс. были из США, 362 тыс. — из Вьетнама, 135 тыс. — из Индии и 127 тыс. — из Аргентины.

Источник изображения: Curator В Curator сообщили, что с этим ботнетом они сталкивались ранее в этом году, но тогда он включал всего 1,33 млн IP-адресов. Ботнет таких размеров может генерировать десятки миллионов запросов в секунду, что несёт угрозу выхода из строя атакуемых серверов в случае неудовлетворительной организации защиты. По словам Curator, такую атаку может выдержать не каждый провайдер DDoS-защиты, «что потенциально может поставить под угрозу доступность ресурсов всех клиентов одновременно».

21.05.2025 [13:36], Владимир Мироненко

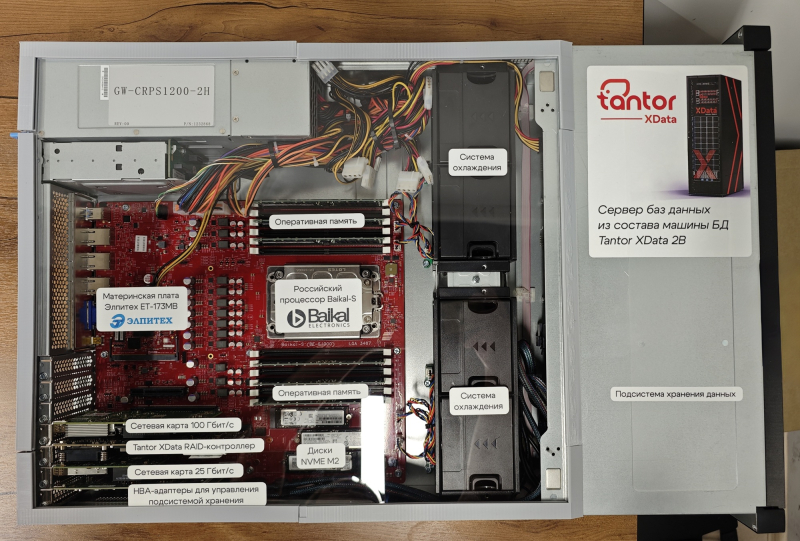

Представлен ПАК Tantor XData 2B — машина баз данных на российском процессоре Baikal-SКомпания «Тантор Лабс» (входит в «Группу Астра») представила первый серийный образец российской машины баз данных (МБД) Tantor XData 2B на процессоре Baikal-S от «Байкал Электроникс». Новинка пополнила семейство высокопроизводительных МБД Tantor XData, ориентированных на заказчиков, чьи потребности в скорости, надёжности и масштабируемости не удовлетворяют возможности традиционных СУБД. МБД Tantor XData 2B представляет собой единый программно-аппаратный комплекс (ПАК), основанный на 2U-серверах с российскими процессорами Baikal-S (48 ядер Arm Cortex-A75 с частотой до 2,5 ГГц). Узлы дополнены RAID- и HBA-контроллерами, двумя БП мощностью 1200 Вт каждый и двумя сетевыми картами — 100GbE и 25GbE. Программный комплекс Tantor XData Software используется для всей линейки МБД Tantor XData, в том числе для архитектуры ARM64, что упрощает обслуживание и эксплуатацию устройств семейства на различных аппаратных платформах. Все ключевые элементы Tantor XData 2B входят в реестры Минпромторга и Минцифры, а сама МБД сейчас проходит регистрацию в Минпромторге. В узлах используется системная плата «Элпитех» ET173-MB формата E-ATX с процессорным разъёмом LGA-3467 для Baikal-S и 12 слотами для UDIMM/RDIMM-модулей DDR4-3200 ECC общим объёмом до 768 Гбайт. Также предусмотрены разъёмы для подключения четырёх вентиляторов, два слота PCIe 4.0 x16, три слота PCIe 4.0 x8, два порта USB 3.0, два 1GbE-порта RJ45, выделенный 1GbE-порт для BMC (OCP RunBMC), видеовыход VGA, два разъёма M.2 Key M 2280 и один разъём M.2 Key M 2260/2280 для NVMe SSD. Есть колодки для двух портов USB 3.0, двух портов USB 2.0 и VGA-выхода, а также датчик вскрытия шасси. Вычислительная подсистема МБД Tantor XData 2B обеспечивает размещение сервисов БД (СУБД Tantor со встроенной платформой управления и мониторинга), изоляцию сервисов БД по ресурсам, отказоустойчивость, а также встроенное трёхкратное потоковое программно-аппаратное сжатие. Коммутационная подсистема обладает пропускной способностью до 100 Гбит/с. Управление ресурсами кластера возложено на подсистему управления и служебного хранения, которая также отвечает за безопасность и резервное копирование. Как сообщает компания, новая версия МБД даже в минимальной конфигурации обеспечивает обработку 60 000 транзакций в секунду и создание резервных копий со скоростью до 35 Тбайт/ч, гарантируя отказоустойчивость с возможностью масштабирования ресурсов без остановки работы. МБД Tantor XData 2B имеет графический интерфейс, CLI и API. Изготовитель предлагает различные готовые к использованию комплектации: от минимальной до конфигурации уровня Enterprise. На днях собственную МБД Postgres Pro Machine представила компания Postgres Professional. Эта система использует узлы Delta Computers. Также на российском рынке присутствует МБД от Скала^р.

20.05.2025 [19:00], Владимир Мироненко

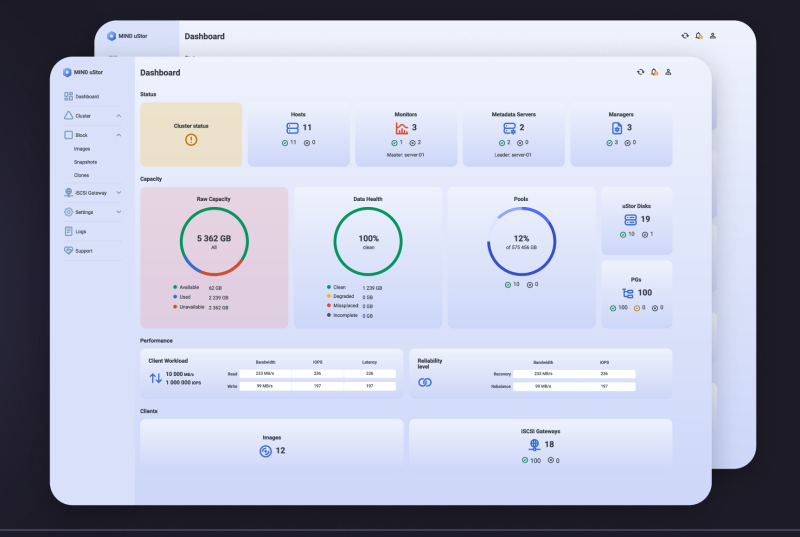

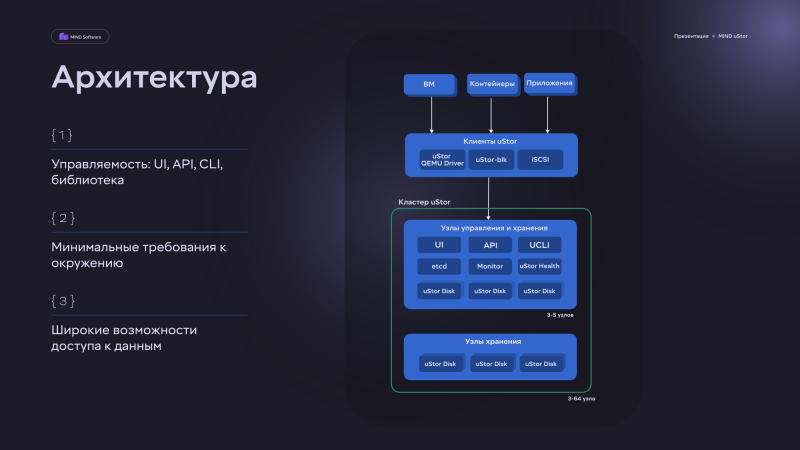

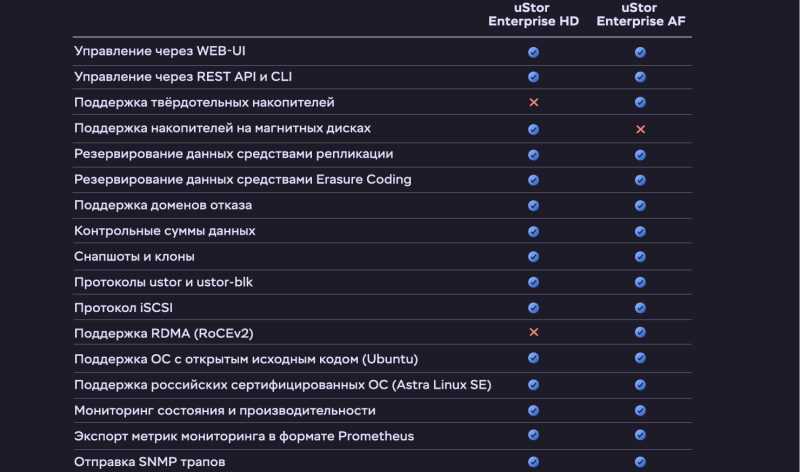

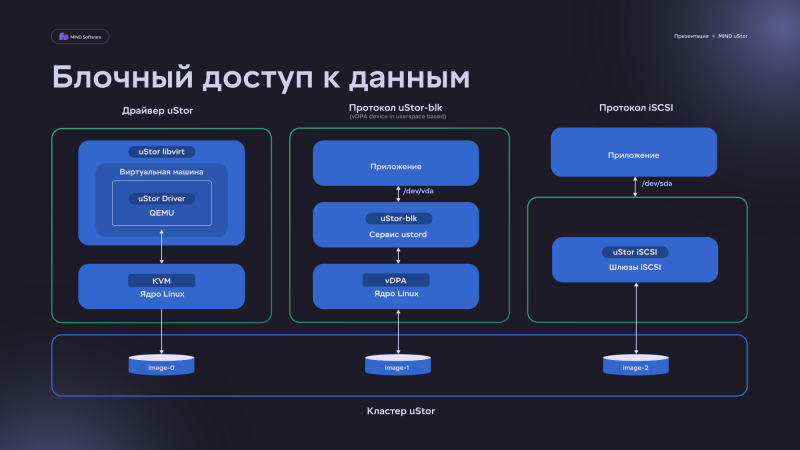

MIND Software анонсировала отечественную программно определяемую СХД MIND uStorMIND Software представила распределённую блочную программно определяемую СХД MIND uStor, предназначенную для корпоративного сегмента отечественного рынка. Ключевая функциональность новинки — сервисы оркестрации, мониторинга, информационной безопасности, графический интерфейс, снапшоты, REST API, CLI, доступ по iSCSI и т.п. — была создана компанией с нуля на основе собственных разработок в соответствии с современными требованиями к высокой надёжности, производительности и технологической независимости продукта, говорит MIND Software MIND uStor позволяет построить отказоустойчивое, масштабируемое и производительное хранилище данных с возможностью интеграции с платформами серверной и контейнерной виртуализации, в том числе в гиперконвергентных (HCI) конфигурациях. Платформа совместима с x86-серверами и поддерживает широкий спектр протоколов взаимодействия с виртуальной инфраструктурой. ПО MIND uStor может лицензироваться как для постоянного использования, так и в форме подписки. Доступны лицензии uStor Enterprise HD/AF и Standard. Компания также предлагает комплекс профессиональных услуг для помощи в проектировании и внедрении. Решение отличается универсальностью, позволяя применять его для организаций, чья инфраструктура включает различные облачные платформы и технологии виртуализации. Оно позволяет повысить эффективность использования систем хранения и оптимизировать совокупную стоимость владения инфраструктурой (TCO). По данным MIND Software, её SDS позволяет снизить TCO на 30–60 % по сравнению с традиционными СХД. По словам компании, MIND uStor — логичный и своевременный ответ на растущий спрос на отечественные инфраструктурные решения, способные заменить зарубежные аналоги без потери в надёжности и гибкости. Решение обладает простой архитектурой и минимальными требованиями к ресурсам, легко настраивается и масштабируется под любые задачи. Компания обеспечивает его поддержку на корпоративном уровне в режиме 24/7. Решение может использоваться для хранения томов виртуальных машин, данных контейнеров, а также для построения гиперконвергентных ландшафтов. СХД обладает поддержкой протоколов взаимодействия как собственной разработки, так и отраслевых, например, iSCSI. Подчёркивается, что решение «отлично работает в смешанных инфраструктурах и может применяться в качестве альтернативы или в дополнение к традиционным СХД». Минимальные требования MIND uStor к оборудованию включают наличие трёх узлов (оптимально от пяти узлов). Каждый узел должен иметь хотя бы 32 Гбайт RAM и два восьмиядерных процессора уровня Intel Xeon Skylake-SP с частотой от 2,8 ГГц. Также необходимо наличие двух портов 10/25/40/100GbE (лучше 25 Гбит/с и более) и накопителей NVMe/SATA/SAS SSD или SATA/SAS/NL-SAS HDD — оптимально 8–16 шт. в одном узле. В случае All-Flash конфигураций доступна поддержка RDMA (RoCEv2). Эффективная ёмкость SDS составляет до 80 % от «сырой», но в 2026 году появятся дедупликация и сжатие. Компания планирует запустить в июне программу сертифицированных конфигураций uStor, в рамках которых будет проводиться тестирование оборудования на совместимость и совместно с вендорами аппаратного обеспечения будут разработаны оптимальные конфигурации. На данный момент MIND Software находится на завершающей стадии интеграции с двумя лидирующими на российском рынке платформами виртуализации, официальный релиз совместных решений запланирован на лето 2025. Также на осень запланированы релизы решений по интеграции с платформами контейнеризации. Кроме того, прорабатывается создание ПАК на основе uStor.

20.05.2025 [17:27], Руслан Авдеев

Иначе не справиться: AWS заявила, что Великобритании необходимо больше АЭС для ИИ ЦОДПо словам генерального директора Amazon Web Services (AWS) Мэтта Гармана (Matt Garman), Великобритании нужно больше энергии для того, чтобы обеспечить потребности новых ИИ ЦОД. По его словам, миру придётся потрудиться, чтобы справиться с прогнозируемым растущим спросом на электричество для ИИ, сообщает The Register. Решением на перспективу в 10 лет он назвал атомную энергетику. Ранее AWS планировала инвестировать £8 млрд ($10,6 млрд) в создание инфраструктуры в Великобритании до конца 2028 года чтобы удовлетворить растущие потребности клиентов и партнёров. Впрочем, в Великобритании активно действует не только AWS. В 2024 году Google начала строить кампус ЦОД за $1 млрд недалеко от Лондона, а Microsoft начала возводить объект Park Royal ещё в 2023 году. В прошлом году сообщалось, что ещё один дата-центр компания намерена построить на месте бывшей электростанции в Лидсе (Leeds). Всего же Microsoft намеревалась вложить в инфраструктуру в стране £2,5 млрд ($3,15 млрд) в течение трёх лет. Oracle также вложит $5 млрд в развитие своего ИИ-облака в стране. Ранее в этом году DC01 UK получила разрешение на строительство «крупнейшего в Европе» ИИ ЦОД в Хартфордшире (Hertfordshire), а ещё одному объекту неподалеку недавно было выдано разрешение на планировку.

Источник изображения: Ajay Pal Singh Atwal/unsplash.com Деятельность активизируется благодаря правительственному проекту AI Opportunities Action Plan, упрощающему получение разрешений на строительство ИИ ЦОД. Однако Инфраструктура для ИИ с каждым поколением становится всё более энергоемкой, а расширение ЦОД для обслуживания растущего числа ИИ-сервисов привело к опасениям, что доступной энергии не хватит. Международное энергетическое агентство (IEA) предупредило, что к 2030 году мировое потребление электроэнергии увеличится более чем вдвое, а Национальная сетевая компания Великобритании (National Grid) подсчитала, что в стране оно вырастет на 500 % в следующие десять лет. Правительство даже сформировало совет AI Energy Council, чтобы обеспечить способность страны справиться с энергоснабжением ИИ ЦОД. Основное внимание уделяется модернизации энергосети и обеспечению своевременного обслуживания заявок на подключение, а не просто увеличению выработки электричества. По словам Гармана, атомная энергетика является «отличным решением» для удовлетворения потребностей ЦОД, поскольку обеспечивает стабильные поставки электричества с нулевым углеродным выбросом.

Источник изображения: Jametlene Reskp/unsplash.com При этом атомные проекты вряд ли можно быстро реализовать для удовлетворения спроса в краткосрочной перспективе. По словам экспертов, строительство АЭС занимает не менее пяти лет, а электростанции на природном газе — около двух. Например, строительство АЭС Hinkley Point C в Сомерсете (Somerset), началось в 2017 году, но, как ожидается, она заработает не раньше 2030 года. В Canalys подчёркивают, что, несмотря на важную роль атомной энергетике в мире, крупные инвестиции в соответствующую отрасль не решат проблемы длительного строительства АЭС, тогда как потребность в энергии есть уже сейчас. Некоторые гиперскейлеры вроде Google и AWS инвестируют в малые модульные реакторы (SMR), чтобы либо передавать энергию в общую сеть, либо питать свои дата-центры напрямую. При этом технология в коммерческом варианте вряд ли будет готова до 2030 года. Как предполагают в Omdia, широкое присутствие SMR на рынке будет достигнуто только к 2035 году, если брать в расчёт прагматичные оценки. Microsoft выбрала другой путь — перезапуск уже готовой, но остановленной АЭС Three Mile Island. В Министерстве энергетической безопасности и нулевых выбросов (Department for Energy Security and Net Zero, DESNZ) объявили, что план действий по чистой энергии будет способствовать развитию и росту новых энергоёмких отраслей, включая дата-центры. Ранее на уровне правительства заявлялось, что атомная энергетика поможет стать Великобритании «ИИ-сверхдержавой», но пока не вполне понятно, где брать дополнительное электричество.

19.05.2025 [23:55], Владимир Мироненко

NVIDIA построит на Тайване новую штаб-квартиру и развернёт два ИИ-суперкомпьютераNVIDIA построит в ближайшем будущем на Тайване новую штаб-квартиру, а также два ИИ-суперкомпьютера. Об этом сообщил гендиректор американской компании Дженсен Хуанг (Jensen Huang), подтвердив свою приверженность Тайваню как глобальному технологическому центру, пишет The Financial Times. Хуан отдал должное Тайваню, «крупнейшему региону по производству электроники в мире», назвав его «центром компьютерной экосистемы». Строительством первого ИИ-суперкомпьютера на базе 10 тыс. ускорителей Blackwell займётся Big Innovation Company, «дочка» Foxconn, в сотрудничестве с NVIDIA и при поддержке тайваньского правительства. Стоимость суперкомпьютера, который будут использоваться в технологической экосистеме Тайваня, составит сотни миллионов долларов. В числе клиентов будущего суперкомпьютера Хуанг назвал TSMC, ключевого производственного партнёра NVIDIA, которая будет использовать его вычислительные мощности для исследований и разработки новых процессов создания чипов. Второй ИИ-суперкомпьютер построит ASUS в интересах Национального HPC-центра NCHC (National Center for High-Performance Computing). Он будет ориентирован на исследование климата, разработку квантовых технологий, создание LLM и иную R&D-деятельность. Система будет в восемь раз мощнее суперкомпьютера Taiwania 2, в создании которого также принимала участие ASUS. Новинка получит узлы HGX H200 (всего 1700 ускорителей), две стойки GB200 NVL72, а также HGX B300, объединённые интерконнектом Quantum InfiniBand. Кроме того, NCHC планирует установить системы DGX Spark и развернуть облачный HGX-кластер. «Мы растём за пределы нашего текущего офиса [на Тайване]», — заявил Хуан, демонстрируя видео приземления футуристического космического корабля и его последующей трансформации в дизайн новой штаб-квартиры Constellation («Созвездие»), строительство которой начнется в ближайшее время в Бэйтоу (Beitou), районе Тайбэя. Дженсен Хуанг также представил интерконнект NVLink Fusion, который позволит объединить решения NVIDIA с решениями конкурентов. Таким способом компания надеется закрепить свою технологию в качестве решения для базовой инфраструктуры. «Ничто не радует меня больше, чем, когда вы покупаете всё у NVIDIA… но мне доставляет огромную радость, если вы просто покупаете что-то у NVIDIA», — пошутил он. На вопрос о возможности создания NVIDIA нового чипа для Китая, который бы соответствовал последним экспортным ограничениям США, Хуанг заявил, что компания «оценивает, как лучше всего выйти на китайский рынок», отметив, что дальнейшие модификации H20 невозможны. Вместе с тем NVIDIA рассматривает возможность перепроектирования своих чипов с учётом новых ограничений, чтобы продолжать продавать их в Китае. На прошлой неделе стало известно о планах NVIDIA построить новый исследовательский центр в Шанхае в знак своей приверженности Поднебесной. Хуанг добавил, что «нет никаких доказательств контрабанды каких-либо ИИ-чипов» в Китай. Из-за опасений по поводу нелегальных поставок передовых чипов NVIDIA в Китай американские законодатели потребовали в прошлом месяце от компании предоставить отчёт о продажах её продукции в Китае и Юго-Восточной Азии.

19.05.2025 [13:05], Руслан Авдеев

Nebius построит в Израиле национальный суперкомпьютер с 4 тыс. ускорителей NVIDIA Blackwell за $140 млнОблачный ИИ-провайдер Nebius (ранее Yandex N.V.) построит и будет управлять в Израиле национальным суперкомпьютером стоимостью $140 млн. Правительство выделит на строительство машины $45 млн — это уже второй этап реализации местного проекта National AI Program, сообщает Datacenter Dynamics. По данным местных СМИ, суперкомпьютер будет иметь производительность 16 Эфлопс (точность вычислений не называется), а сама Nebius предложила местным властям льготные расценки. Первую очередь проекта введут в эксплуатацию в начале 2026 года. По данным документов тендеров, попавших в руки журналистам, Nebius развернёт 4 тыс. ускорителей NVIDIA Blackwell. Google и Amazon (AWS), уже заключившие с израильскими властями договор об участии в военном облачном проекте Nimbus стоимостью $1,2 млрд. Изначально они тоже участвовали в тендере на создание суперкомпьютера, но позже отозвал заявки. Представители израильских властей заявили СМИ, что предложение Nebius было лучшим, при этом у сотрудников компании накоплены достаточные компетенции в строительстве аналогичных суперкомпьютеров.

Источник изображения: SEO Galaxy/unspalsh.com Nebius появилась только в прошлом году, когда часть «Яндекса» выделил европейский бизнес в отдельную компанию. Базирующаяся в Амстердаме Nebius управляет дата-центром в Финляндии, подразделением Nebius AI, а также компанией Toloka AI, провайдером образовательных технологий TripleTen и компанией Avride, занимающейся системами автономного вождения. После привлечения $700 млн и «повторного» выхода на Nasdaq, компания наращивает мощность своих ЦОД. Nebius обязалась инвестировать более $1 млрд в ИИ-инфраструктуру в Европе к середине 2025 года. Инвестиции предусматривают утроение мощности дата-центра в Финляндии, расширение бизнеса в США и аренду объектов для ЦОД в Канзас-Сити (Kansas City). Кроме того, запланирована аренда у Verne в Исландии и внедрение ускорителей в Париже совместно с Equinix. |

|