Материалы по тегу: s

|

01.04.2026 [15:05], Руслан Авдеев

Франция выкупила разработчика суперкомпьютеров Bull у AtosAtos Group сообщила о закрытии сделки по продаже своего подразделения Bull, занимающегося передовыми вычислительными системами. Его продали Франции за €404 млн, включая дополнительные выплаты в объёме €104 млн, сообщает HPC Wire. Единственным акционером Bull стало французское государство, стремящееся к расширению суверенных возможностей в сфере суперкомпьютеров и ИИ. 31 июля 2025 года Atos объявила о подписании договора купли-продажи, предусматривавшей покупку акций французским государством. Уже после подписания сделки из неё была исключена компания zData, а выплаты, полагающиеся продавцу лишь при достижении определённых условий, были скорректированы в меньшую сторону, со €110 млн до €104 млн. Соответственно, снизилась и стоимость продаваемого актива с €410 млн до €404 млн. Занимающееся передовыми вычислительными технологиями подразделение включает отделы, отвечающие за HPC и квантовые вычисления (HPC & Quantum), а также бизнес-вычисления и ИИ (Business Computing & Artificial Intelligence). В 2025 финансовом году выручка Bull составила порядка €0,7 млрд, ранее подразделение входило в состав бренда Atos Group — Eviden. После продажи Eviden займётся продуктами в сфере кибербезопасности, критически важными системами и технологиями Vision AI (ИИ в сфере компьютерного зрения). Скорректированная с учётом выделения Bull выручка Eviden составила в 2025 финансовом году около €0,3 млрд. Продажа Bull Франции знаменует важный шаг в рамках стратегии Atos Group, стремящейся сфокусировать бизнес на основных рынках. Оптимизируя своё портфолио, компания усиливает внимание к сегментам, отвечающим за обеспечение кибербезопасности, критически важные системы и цифровые сервисы. В этих областях она обладает значительным потенциалом дальнейшего роста. Предполагается, что по итогам сделки будет обеспечен «бесшовный», незаметный для клиентов и сотрудников Bull переход к новому собственнику. В январе Atos, столкнувшаяся с множеством финансовых проблем, официально перезапустила бренд Bull. Теперь он позиционируется как глобальный лидер в HPC-, ИИ- и квантовых системах. Bull разрабатывает, внедряет и обслуживает оборудование и ПО, в том числе суперкомпьютеры. Bull позиционируется, как единственный европейский игрок, способный разрабатывать, выпускать и внедрять решения подобного класса. Работа поддерживается командой исследователей и инженеров, производственными возможностями и др. В самой компании утверждают, что Bull позволяет странам и отраслям полностью контролировать свои ИИ-мощности и данные. Ранее сообщалось, что Atos не первый год теряет выручку по всем направлениям, а будущее компании всё более туманно. Поэтому она заключила сделку с французским государством, согласно которой ему будут переданы «золотые акции» Bull SA. После неоднократных попыток спасти компанию, частой смены директоров и даже новостей о её возможной национализации Францией, летом 2025 года появилась информация, что власти Франции сделали предложение купить подразделение Advanced Computing в составе группы Atos. Во Франции довольно серьёзно относятся к обретению цифрового суверенитета, в первую очередь, от США. Так, в числе прочего, в конце 2025 года сообщалось, что Airbus перенесёт критически важные нагрузки в суверенное европейское облако, а в январе появилась информация, что страна пересадит госслужащих с Zoom и Teams на суверенный видеочат Visio.

01.04.2026 [12:19], Сергей Карасёв

Toshiba начала поставки HDD вместимостью до 34 Тбайт с SMR и стеклянными пластинамиКорпорация Toshiba объявила о начале пробных отгрузок Nearline-накопителей серии M12, вместимость которых варьируется от 30 до 34 Тбайт. Эти HDD ориентированы на гиперскейлеров и облачных провайдеров, оперирующих крупными дата-центрами. Изделия M12 соответствуют типоразмеру LFF. Применена технология черепичной магнитной записи (SMR), которая позволяет увеличить ёмкость примерно на 15 % по сравнению с накопителями на основе традиционной магнитной записи (CMR) без перекрывающихся дорожек. Toshiba отмечает, что в обычных SMR-накопителях может наблюдаться снижение производительности на операциях случайной записи. В устройствах M12 эта проблема частично решена благодаря применению архитектуры SMR, управляемой хостом: при таком подходе хост-система контролирует размещение и перезапись данных внутри накопителя, что обеспечивает более эффективную обработку информации. В новых HDD используются стеклянные пластины, а не алюминиевые, что позволило уменьшить их толщину. Конструкция предусматривает использование 11 пластин с плотностью записи 3,09 Тбайт. Герметичная камера заполнена гелием. Задействована технология FC-MAMR (Flux Control Microwave Assisted Magnetic Recording) — магнитная запись с микроволновой поддержкой с управляемым потоком. Накопители семейства M12 обеспечивают максимальную скорость передачи данных в 282 МиБ/с, что примерно на 8 % выше, чем у решений предыдущего поколения (МА11). При этом энергопотребление (Вт/Тбайт) снизилось на 18 %. Новинки рассчитаны на эксплуатацию в круглосуточном режиме 24/7 и на годовую рабочую нагрузку до 550 Тбайт. Показатель MTBF (средняя наработка на отказ) достигает 2,5 млн часов, значение AFR (Annualized Failure Rate) находится на отметке 0,35 %. Сетевые источники добавляют, что новые HDD, как и предшественники, имеют скорость вращения шпинделя 7200 об/мин. Будут предлагаться варианты с интерфейсами SATA и SAS. Кроме того, в III квартале нынешнего года Toshiba начнёт пробные поставки HDD семейства M12 с технологией CMR: их вместимость составит до 28 Тбайт.

31.03.2026 [23:55], Владимир Мироненко

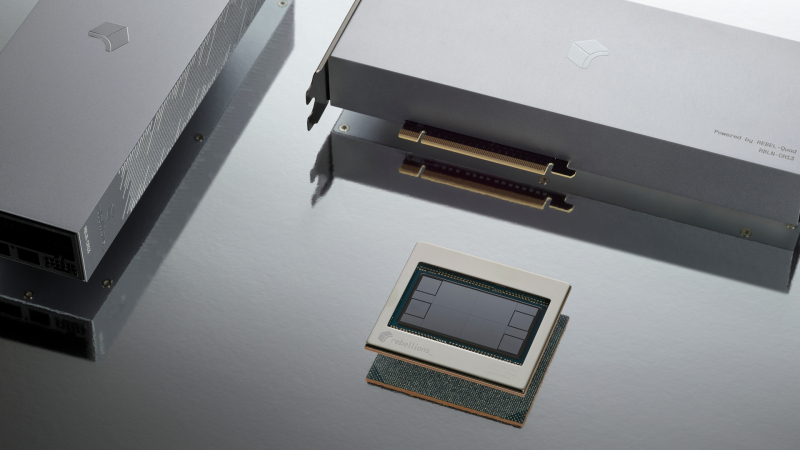

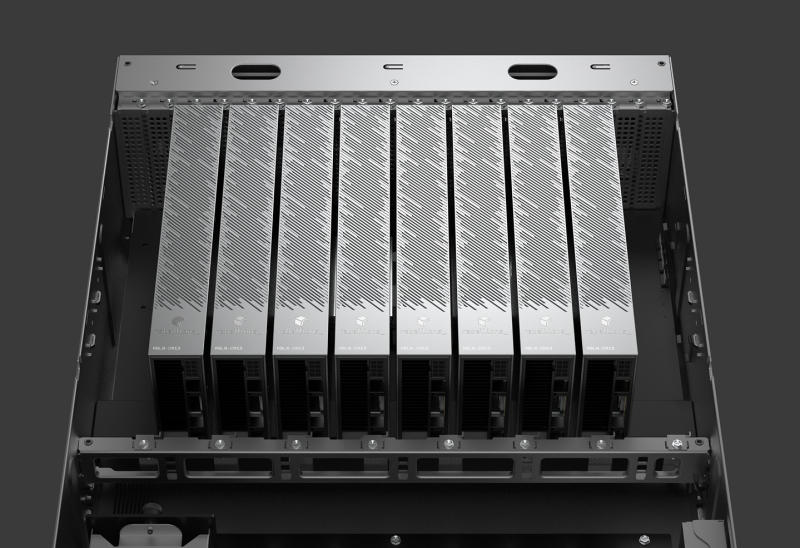

Rebellions привлёк $400 млн для выхода на международный рынок и дальнейшей разработки ИИ-ускорителейРазработчик ИИ-чипов Rebellions планирует расширить своё присутствие за пределами Южной Кореи с помощью поставок новой стоечной вычислительной платформы, которая не потребует от предприятий использования жидкостного охлаждения или сверхмощных стоек, пишет The Register. Основанный в конце 2020 года стартап производит ИИ-ускорители, которые используются многими компаниями Южной Кореи. Главный коммерческий директор Rebellions Маршалл Чой (Marshall Choy) сообщил The Register, что поначалу компания сосредоточились на телекоммуникационных предприятиях, поставщиках услуг и корпоративных пользователях на южнокорейском рынке. «Мы разработали сценарии использования для всего, от колл-центров и обслуживания клиентов до систем видеонаблюдения для национальной системы автомагистралей», — отметил он, добавив, что компания сейчас находится в сильной позиции, а накопленный ею опыт и возможности позволяют расширять поставки в другие регионы. После выпуска ИИ-ускорителя Rebel Quad, переименованного в Rebel100, компания начала предпринимать шаги по выходу на международный рынок. За последние несколько месяцев Rebellions открыла офисы в Японии, Саудовской Аравии, на Тайване и в США, где надеется завоевать доверие предприятий с помощью своих стоечных систем RebelRack и RebelPods на базе Rebel100. Ускоритель Rebel100, в отличие от NVIDIA H200, базирующегося на монолитном вычислительном кристалле, изготовленном TSMC, использует чиплетную архитектуру с четырьмя вычислительными кристаллами, произведёнными и упакованными Samsung. К нему подключены четыре стека памяти HBM3e общей ёмкостью 144 Гбайт и пропускной способностью 4,8 Тбайт/с. Благодаря тому, что Rebellions — южнокорейская компания, тесно связанная как с чеболем SK, так и с Samsung, крупнейшими поставщиками HBM, у неё нет проблем с закупкой этой памяти. Сам Rebel100 выпускается в виде PCIe-карты с TDP 600 Вт и производительностью до 1 Пфлопс в режиме FP16 и до 2 Пфлопс на операциях FP8. Референсный дизайн Rebellions предусматривает размещение восьми таких карт в одном 19″ узле с воздушным охлаждением. Опора на стандартные форм-факторы была ключевым приоритетом при проектировании Rebellions, поскольку это позволяет развернуть системы в существующих корпоративных ЦОД, тогда как последние поколения ускорителей NVIDIA требуют СЖО. Стоечная система RebelRack будет включать четыре таких узла, объединённых 400GbE-сетью, что в сумме даст 32 ускорителя с общей производительностью 64 Пфлопс (FP8) и 4,6 Тбайт HBM3e с агрегированной ПСП 153,6 Тбайт/с. Для более крупных развёртываний предназначена стоечная система RebelPod, которая может масштабироваться от 8 до 128 узлов, каждый из которых имеет восемь ускорителей Rebel100, соединённых 800GbE-интерконнектом. Чой говорит, что в дальнейшем компания будет уделять первостепенное внимание сетевой инфраструктуре. The Register отметил на примере стоечных систем от AMD и NVIDIA, что вычислительные ресурсы и сетевые возможности — это лишь две части решения задачи. Также необходимо ПО, которое сможет объединить всё это. Программный стек Rebellions работает на основе open source фреймворков, таких как vLLM, PyTorch и Triton. Для дезагрегированного инференса используется llm-d, ещё один открытый инструмент, позволяющий выполнять предварительное заполнение на одном наборе ускорителей, а декодирование — на другом. «Всё — open source, от vLLM до самого высокого уровня стека, Red Hat, OpenShift и т.д., — сказал Чой. — Если вы использовали какие-либо из этих технологий в другом контексте, вы уже знаете, как использовать Rebellions». В понедельник стартап привлёк $400 млн в рамках предварительного раунда финансирования, который возглавили Mirae Asset Financial Group и Корейский национальный фонд развития, как для поддержки своей экспансии на международном рынке, так и для дальнейшего развития более совершенных и эффективных акселераторов и систем ИИ. По данным The Register, компания может подать заявку на IPO уже в этом году или в начале следующего.

31.03.2026 [15:53], Руслан Авдеев

Selectel запустил защищённый катастрофоустойчивый облачный регион ru-6 с тремя зонами доступностиРоссийский провайдер облачной инфраструктуры Selectel запустил геораспределённый (Multi-AZ) облачный регион ru-6. Новое решение подойдёт корпоративным клиентам с крупными цифровыми проектами и сложными внутренними информационными системами, требующими высокопроизводительной вычислительной инфраструктуры, говорит компания. Регион включает три независимых зоны доступности (AZ) в Москве, с расстоянием до 15 км между дата-центрами. Связь площадок обеспечит высокоскоростная сеть с временем отклика менее 1 мс. Если раньше для распределения нагрузок между зонами было необходимо ручное конфигурирование, то теперь устойчивость сетевых и PaaS-сервисов можно получить «из коробки». Мастер-ноды Managed Kubernetes и ноды облачных баз данных в геораспределённых кластерах автоматически размещаются в разных AZ. Аналогичным образом организовано и распределённое резервное копирование. Подобная архитектура обеспечит работоспособность клиентских нагрузок, даже если из строя выйдет одна из зон доступности целиком. В случае инцидента задержка восстановления сервисов будет минимальной, всего от нескольких минут. В компании говорят о получении доступа к «отказоустойчивости как сервису». Связанные с работой ЦОД риски будут минимизироваться с помощью автоматической системы аварийного восстановления. Утверждается, что это обойдётся минимум вдвое дешевле обычного DR-механизма. В то же время сохранится возможность выбора того, где именно размещать критически важные сетевые компоненты с учётом требований к RTO и RPO.

Источник изображения6 Selectel Уже организован доступ к инфраструктуре ru-6 по предварительному заказу на её сайте. Сегодня компании размещают критически важные информационные системы сразу в нескольких ЦОД, а в некоторых случаях — у нескольких облачных провайдеров. Новое решение обеспечивает устойчивые PaaS: Managed Kubernetes, облачные СУБД, S3-хранилище и др. В основе нового региона — увеличенные лимиты произвольных конфигураций, выделенные ядра и возможность управлять топологией CPU. Облако построено на современном оборудовании с использованием собственной серверной платформы Selectel и процессоров AMD EPYC 9754 (Turin) и Intel Xeon 6747P (Granite Rapids-SP), сетевых дисков с производительностью 75 тыс. IOPS, а также ИИ-ускорителей NVIDIA H200 и RTX PRO 6000 Blackwell Server Edition. Компания рассчитывает дополнить систему геораспределённым хранилищем S3 с высокоскоростным подключением к облачным серверам, появится и специальное файловое хранилище. Планируется добавить функцию резервирования выделенных хостов виртуализации для конфиденциальных вычислений и экспорт бэкапов в другие географические регионы.

31.03.2026 [14:57], Владимир Мироненко

Nebius построит в Финляндии крупнейший в Европе ИИ ЦОДПровайдер облачных ИИ-сервисов Nebius (ранее Yandex N.V.) объявил о строительстве новой «ИИ-фабрики» мощностью до 310 МВт в финском городе Лаппеенранта (Lappeenranta). Как сообщает Reuters, новый ИИ ЦОД стоимостью более $10 млрд станет крупнейшим на континенте. Это уже десятый объект компании, который финский девелопер Polarnode строит в Лаппеенранте. Ввод мощностей ИИ ЦОД будет производиться поэтапно, начиная с 2027 года. Сообщается, что он не будет привязан ни к одному из клиентов компании. Строительство ЦОД в Лаппеенранте следует за недавним расширением Nebius своего первого ЦОД в Финляндии в Мянтсяля (Mäntsälä) до 75 МВт, завершённым ранее в этом году. Компания планирует дальнейшее расширение в Финляндии, чему способствуют благоприятные условия — низкие цены на энергоносители, возобновляемые источники электроэнергии и прохладный климат, позволяющий снизить затраты на охлаждение. Компания отметила, что Лаппеенранта отвечает всем требованиям для строительства ИИ ЦОД, включая доступность оформления участка под объект и пропускную способность сетей. «Мы считаем, что и общая экосистема здесь очень благоприятна», — сказала компания агентству Reuters. ЦОД в Лаппеенранте станет крупнейшим объектом Nebius за пределами США, превзойдя недавно анонсированный проект мощностью 240 МВт невдалеке от Лилля (Lille, Франция). «Мы много лет работаем в Финляндии и рады расширению нашего присутствия здесь. Лаппеенранта станет значительным дополнением к нашей глобальной инфраструктуре ИИ и внесет существенный вклад в достижение наших целей по мощности», — заявил основатель и генеральный директор Nebius Аркадий Волож. ЦОД Nebius в Лаппеенранте представляет собой многокорпусный комплекс на промышленной площадке площадью около 40,5 га. Его строительство и дальнейшая эксплуатация создадут новые рабочие места в регионе Южная Карелия в Финляндии. Ожидается, что появится около 100 рабочих мест после ввода ЦОД в эксплуатацию, а также сотни косвенных вакансий в сфере эксплуатации и технического обслуживания. Ключевым принципом проектирования ЦОД в Лаппеенранте будет экологичность, как и в ЦОД в Мянтсяля, который входит в число самых энергоэффективных объектов в мире, сообщила Nebius. Серверы будут охлаждаться с помощью замкнутой СЖО, что исключит необходимость использования воды из местных источников. Как и в Мянтсяля, система охлаждения будет спроектирована с учётом системы рекуперации тепла, что позволит передавать избыточное тепло от серверов в местную теплосеть. В Мянтсяля такой подход позволил избежать выбросов примерно 4 тыс. т CO2-эквивалента, связанных с производством тепла, в 2025 году и снизить затраты на отопление для подключённых домохозяйств примерно на 10 %. Nebius сообщила, что создаёт одну из крупнейших в мире сетей специализированных вычислительных мощностей для ИИ и планирует к концу 2026 года обеспечить более 3 ГВт контрактной мощности. В рамках реализации этих планов компания недавно получила разрешение на строительство своей первой гигаваттной ИИ-фабрики в Индепенденсе (Independence, штат Миссури). В регионе EMEA компания законтрактовала более 750 МВт на своих собственных площадках и в других ЦОД. В ЦОД в Мянтсяля размещена платформа NVIDIA GB300 NVL72, позже в этом году Nebius предложит и Vera Rubin NVL72.

30.03.2026 [11:59], Сергей Карасёв

ИИ-сервер Gigabyte G894-AD3 использует платформу NVIDIA HGX B300 и чипы Intel Xeon 6900Компания Gigabyte пополнила ассортимент серверов мощной моделью G894-AD3-AAX7, предназначенной для решения ресурсоёмких задач в сфере ИИ. Система выполнена на платформе NVIDIA HGX B300 с восемью SXM-ускорителями Blackwell Ultra. Допускается установка двух процессоров Intel Xeon 6900P поколения Granite Rapids-SP в исполнении LGA 7529 (Socket BR) с показателем TDP до 500 Вт. Доступны 24 слота для модулей DDR5-6400/8800 RDIMM/MRDIMM, два внутренних коннектора M.2 2280/22110 для SSD с интерфейсом PCIe 5.0 x4 и PCIe 5.0 x2, а также восемь отсеков для SFF-накопителей (NVMe) с доступом через фронтальную панель (возможна горячая замена). Реализованы четыре слота PCIe 5.0 x16 для карт расширения FHHL. В оснащение входят контроллер ASPEED AST2600, два сетевых порта 10GbE на основе Intel X710-AT2, выделенный сетевой порт управления 1GbE, а также восемь портов 800G OSFP InfiniBand XDR (NVIDIA ConnectX-8 SuperNIC). Подсистема питания включает 12 блоков мощностью 3000 Вт с сертификатом 80 PLUS Titanium. Реализовано воздушное охлаждение с 27 вентиляторами в следующей конфигурации: 6 × 60 мм в области материнской платы, 4 × 40 мм в зоне портов OSFP, 2 × 80 мм в секции PCIe-слотов и 15 × 80 мм в лотке GPU.

Источник изображения: Gigabyte Сервер выполнен в форм-факторе 8U с габаритами 447 × 351 × 923 мм, а масса составляет 91,6 кг. Диапазон рабочих температур — от +10 до +30 °C. Среди прочего упомянуты два порта USB 3.0 Type-A (5 Гбит/с), аналоговый интерфейс D-Sub, а также три гнезда RJ45 для сетевых кабелей. Опционально может быть добавлен модуль TPM 2.0 для обеспечения безопасности.

27.03.2026 [19:25], Сергей Карасёв

Вебинар T1 Облако и Curator. Выбор без выбора: почему защита от DDoS-атак — не опция, а необходимостьDDoS-атаки — это уже не гипотетический риск, а реальность, с которой сталкивается практически каждый онлайн-бизнес. Если сервис становится недоступным — вы теряете не только трафик и выручку, но и доверие пользователей. И чем позже вы задумываетесь о защите, тем выше цена. T1 и Curator приглашают вас на совместный вебинар: «Выбор без выбора: почему защита от DDoS-атак — не опция, а необходимость».

На вебинаре разберём:

Вебинар будет полезен:

Спикеры:

Не ждите, пока атака остановит ваш сервис — подготовьтесь заранее. Зарегистрируйтесь сейчас и узнайте, как сделать ваш онлайн-ресурс устойчивым к современным киберугрозам.

27.03.2026 [15:17], Руслан Авдеев

В Дубне заработал второй собственный дата-центр WildberriesКомпания RWB, более всего известная маркетплейсом Wildberries, запустила в эксплуатацию второй собственный ЦОД в Подмосковье. Расположенный в ОЭЗ «Дубна» объект расширит вычислительные возможности торговой площадки и других цифровых сервисов в сфере ответственности компании. Новый дата-центр поможет обеспечивать стабильную работу торговой платформы в периоды пиковых нагрузок и призван стать основой для эволюции сервисов, помогающих оптимизировать бизнес продавцам и обеспечить максимальное удобство покупателям, говорит компания. Машинные залы рассчитаны на размещение более 500 серверных стоек, потенциально вмещающих до 8,6 тыс. серверов. Резервное питание будут обеспечивать шесть дизельных генераторов, показатель PUE объекта составит 1,1–1,15.

Источник изображения: RWB Новый дата-центр общей площадью свыше 5,5 тыс. м2 и проектной мощностью 8 МВт представляет собой модульный объект с пятью помещениями, вместившими машинные залы, силовые блоки и генераторные установки, а также административно-бытовую инфраструктуру.

Источник изображения: RWB По словам RWB, собственная инфраструктура для крупной коммерческой платформы — один из ключевых элементов дальнейшего устойчивого роста. Именно строительство собственных дата-центров даёт компании возможность повышать отказоустойчивость обслуживания, масштабировать вычислительные мощности в зависимости от нагрузок и развивать цифровые продукты, в т.ч. решения на основе ИИ. Ввод в эксплуатацию нового ЦОД — лишь часть стратегии развития технологической инфраструктуры RWB. В 2023 году в Электростали ввели в эксплуатацию первый ЦОД компании.

26.03.2026 [11:10], Сергей Карасёв

HP представила рабочую станцию Z8 Fury G6i с поддержкой четырёх ускорителей NVIDIA RTX Pro 6000 Blackwell Max-Q Workstation EditionКомпания HP анонсировала настольную рабочую станцию Z8 Fury G6i, предназначенную для решения сложных задач в области моделирования, анализа данных, создания визуальных эффектов и разработки ИИ. Новинка построена на аппаратной платформе Intel Xeon 600. Максимальная конфигурация включает процессор Xeon 698X с P-ядрами (86C/172T, 2/4,8 ГГц). Применена материнская плата на наборе логики Intel W890. Объём оперативной памяти DDR5-6400 ECC может достигать 2 Тбайт (доступны 16 слотов для модулей DIMM). Суммарная вместимость подсистемы хранения данных составляет до 104 Тбайт. При этом допускается использование накопителей разных типов, включая HDD корпоративного класса с интерфейсом SATA-3 вместимостью до 12 Тбайт (7200 об/мин), SSD формата М.2 (например, HP Z Turbo Drive NVMe на 8 Тбайт), а также устройства U.2 и U.3. Во фронтальной части расположены посадочные места для четырёх NVMe-накопителей с возможностью горячей замены. Дополнительно может быть установлен оптический привод HP Slim DVD-ROM или HP Slim DVD-Writer. Рабочая станция может нести на борту до четырёх ускорителей NVIDIA RTX Pro 6000 Blackwell Max-Q Workstation Edition с 96 Гбайт памяти GDDR7 каждый (пропускная способность — 1792 Гбайт/с). Слоты расширения выполнены по схеме 4 × PCIe 5.0 x16, 3 × PCIe 5.0 x8,1 × PCIe 5.0 x4 и 1 × PCIe 4.0 x4. В оснащение включены сетевой контроллер Intel I219-LM PCIe стандарта 1GbE и звуковой кодек Realtek ALC3205-CG. Предлагаются гибкие опции по установке дополнительных сетевых адаптеров, включая 10GbE и 25GbE. Кроме того, упомянут модуль MediaTek MT7925 с поддержкой Wi-Fi 7 и Bluetooth 5.4. Габариты составляют 44,51 × 21,95 × 55,9 см, масса — 22,2 кг. На фронтальную панель выведены четыре порта USB 3.0 Type-A (5 Гбит/с), комбинированное аудиогнездо на 3,5 мм и SD-ридер. Сзади сосредоточены пять портов USB 3.0 Type-A (5 Гбит/с), разъём USB 3.2 Type-C (20 Гбит/с), гнездо RJ45 для сетевого кабеля и пр. Возможна установка одного или двух блоков питания мощностью 1350 или 1700 Вт. Говорится о совместимости с Windows 11 Pro for Workstations, Ubuntu 24.04 LTS, Red Hat Enterprise Linux.

24.03.2026 [15:39], Андрей Крупин

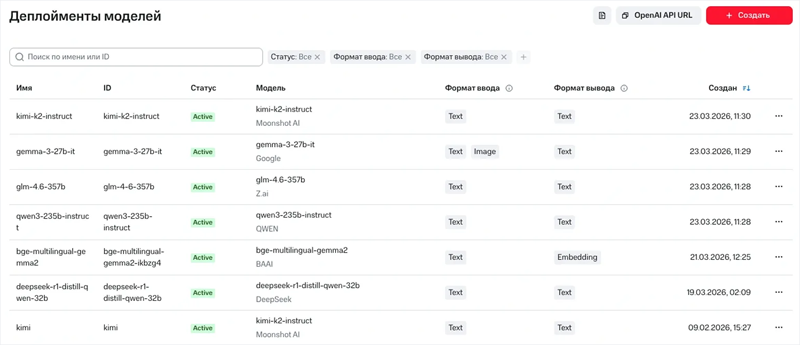

MWS Cloud запустила сервис GPT Model Hub для работы с большими языковыми моделямиКомпания MWS Cloud (входит в МТС Web Services) сообщила о запуске GPT Model Hub — облачного сервиса для развёртывания и использования больших языковых моделей (LLM) в инфраструктуре MWS Cloud Platform. Решение предоставляет готовую платформу для работы с ИИ-моделями и обеспечивает их безопасное, масштабируемое и управляемое использование. GPT Model Hub запущен на базе платформы MWS GPT и предоставляет доступ к большим языковым моделям через API внутри MWS Cloud Platform. В составе сервиса представлены 10 больших языковых моделей, среди которых ведущие мировые открытые LLM: DeepSeek, Google Gemma, Alibaba Qwen, Zhipu AI, Moonshot AI, BAAI и другие. До конца года будут добавлены ещё 10 моделей, включая модели TTS (преобразующие текст в речь) и ASR (преобразующие аудио в текст), а также реранкеры.

Источник изображения: mws.ru Сервис может использоваться разработчиками и организациями для внедрения ИИ-ассистентов в продукты, построения интеллектуального поиска, обработки текстовых данных, автоматизации поддержки, создания ИИ-инструментов для сотрудников и решения прочих задач. Модели доступны через OpenAI-совместимый API и могут быть интегрированы в backend-сервисы, developer-инструменты и пользовательские приложения. Сервис предоставляется по модели самообслуживания через консоль управления MWS Cloud Platform. LLM развёртывается по клику за несколько секунд и сразу доступна для работы через точку подключения в облаке MWS. Встроенные в платформу ресурсная модель, политики доступа и биллинга упрощают управление сервисом и позволяют отслеживать расходы на уровне проектов и команд. |

|