Материалы по тегу: llm

|

29.05.2026 [20:30], Руслан Авдеев

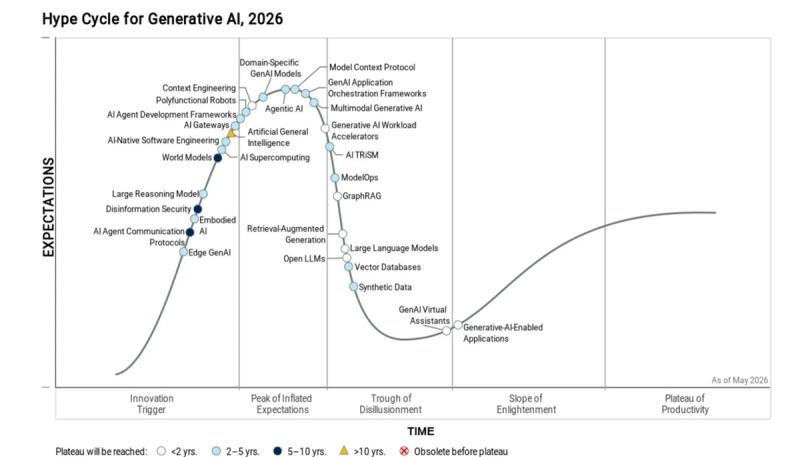

Gartner: большинство кастомных ИИ-моделей и проектов генеративного ИИ ожидает провалПо мнению Gartner, не менее половины всех проектов в сфере генеративного ИИ и создателей большинства ИИ-моделей ожидает неудача. Расходы на проекты будут выше планируемого из-за неудачных архитектурных решений и недостатка ноу-хау, а разработчики собственных моделей столкнутся с высокими затратами и другими сложностями, сообщает The Register. В докладе «Цикл хайпа вокруг генеративного ИИ» (Hype Cycle for Generative AI), в котором эксперты рассмотрели 30 ИИ-технологий, сообщается, что ни одна из них не достигла т.н. «плато производительности». На этом этапе продукты и технологии уже пережили два или три этапа эволюции, стабильны и приносят ощутимые выгоды. До достижения этого плато ИИ-технологии в своём развитии поднимаются до «Пика завышенных ожиданий» (Peak of Inflated Expectations), после чего следует спад в «Долину разочарований» (Trough of Disillusionment) и медленный подъём по «Склону просветления» (Slope of Enlightenment). По мнению Gartner, в областях вроде здравоохранения, финансов, юриспруденции и др. будут обеспечивать лучшие результаты модели, специально созданные «с нуля» под конкретную тематику, либо специально доработанные — в сравнении с универсальными моделями «общего назначения». Впрочем, подчёркивается, что создание специальных моделей требует значительных вычислительных ресурсов, специальных знаний и постоянного обслуживания. На достижение достаточной зрелости для массового применения таким моделям потребуется минимум 2–5 лет.

Источник изображения: Gartner Безусловный успех, по мнению Gartner, ожидает лишь ИИ-приложения вроде помощников в подготовке программного кода, создании графики и видео, а также обобщения контента. Впрочем, из-за проблем с интеллектуальной собственностью и склонностью ИИ к ошибкам, нишу ожидают некоторые проблемы. Тем не менее, Gartner уверена, что такие приложени довольно зрелые и они уже освоили более половины целевого рынка. Наименее зрелыми называются протоколы связи ИИ-агентов друг с другом и окружающей средой. Впрочем, этот сегмент довольно быстро развивается и даже уже имеется пара фаворитов. Наибольший потенциал по мнению экспертов имеют технологии защиты от дезинформации (Disinformation Security) и «Модели мира» (World Models). Технологии Disinformation Security помогают распознавать дипфейки, случаи кражи личности и создание другого фейкового контента, направленного на дискредитацию людей и организаций, а также на создание контента для кибератак и совершения других преступлений. По оценкам Gartner, до достижения зрелости этим технологиям ещё 5–10 лет. Модели мира позволяют ИИ выполнять сложные задачи прогнозирования и планирования, имитируя и понимая динамику окружающей среды. Это позволяет принимать обоснованные решения даже в условиях недостатка информации и непредвиденных обстоятельств. Такие инструменты также полезны для навигации робототехники в человеческом мире или создания видеоконтента с реалистичным отображением физики. Также Gartner считает, что организации, намеренные создавать ИИ-системы на основе открытых моделей, не получат доступ к самым передовым технологиям… если не готовы применять китайские разработки. Утверждается, что коммерциализация открытых LLM оказалась весьма сложной для их разработчиков. Многие западные технологические компании избирательно делают модели открытыми, благодаря чему все инновации в данной сфере пока сосредоточены в КНР, хотя развитие идёт и за пределами Китая.

12.05.2026 [13:24], Сергей Карасёв

Новое бизнес-подразделение OpenAI поможет клиентам во внедрении ИИГруппа OpenAI Group PBC сформировала бизнес-подразделение OpenAI Deployment Company, которое будет оказывать сторонним заказчикам услуги по внедрению ИИ-моделей и их оптимизации под конкретные задачи. Инвестиции в OpenAI Deployment Company на первом этапе составят $4 млрд при оценке этой структуры в $14 млрд. Средства поступят от самой OpenAI и более чем десяти других инвесторов, крупнейшим из которых является управляющая компания TPG. В раунде также приняли участие SoftBank Group, Bain Capital, Brookfield, Capgemini SE и McKinsey & Co. Контроль над формируемой организацией сохранит за собой OpenAI. Компания обязалась обеспечить минимальную доходность в размере 17,5% для внешних инвесторов OpenAI Deployment Company. Новая структура поможет крупным предприятиям во внедрении ИИ-моделей OpenAI. Для этого на объекты заказчиков будут направляться инженеры по развёртыванию (Forward Deployed Engineer, FDE) — специалисты, обладающие навыками разработки ПО и взаимодействия с клиентами. Такие инженеры выступают в качестве связующего звена между поставщиком продуктов и заказчиком. Внедрение ИИ-моделей на стороне клиента OpenAI намерена осуществлять в рамках многоэтапного процесса. Сначала специалисты оценят возможные варианты применения ИИ на площадке заказчика и разработают наиболее эффективные сценарии использования. Затем будет осуществлено пилотное развёртывание для «небольшого количества приоритетных рабочих процессов»: это поможет продемонстрировать отдачу от применения продуктов OpenAI. На финальном этапе произойдёт полноценное внедрение. Кроме того, по запросу клиента специалисты OpenAI Deployment Company могут осуществить сопутствующие работы, например, интегрировать ИИ-модель с существующими приложениями в IT-инфраструктуре заказчика. Для развития бизнеса OpenAI Deployment Company приобрела лондонскую фирму Tomoro AI Ltd., предоставляющую технологические услуги. В результате этой сделки, финансовые условия которой не раскрываются, OpenAI получила около 150 инженеров FDE и других технических специалистов.

21.04.2026 [20:48], Владимир Мироненко

В ВТБ призвали к партнёрству с Китаем для развития суверенного ИИРазвивать суверенные технологий ИИ в России, включая использование больших языковых моделей (LLM) и вычислительных мощностей, необходимо в партнёрстве с дружественными странами, прежде всего, с Китаем, заявил заместитель руководителя технологического блока ВТБ. Он подчеркнул, что при этом важно учитывать необходимость защиты данных россиян, которые используются при обучении ИИ. Топ-менеджер отметил, что открытые LLM, разработанные китайскими компаниями, работают «чуть лучше», чем российские модели, но их использование несёт определенные риски для технологического суверенитета, так как они созданы за пределами России. Использование российских моделей, в частности, от «Яндекса» и Сбера, снимает часть этих рисков. Вместе с тем топ-менеджер ВТБ считает, необходимо использовать лучшие технологии, чтобы не оказаться в числе отстающих: «Для того, чтобы наши модели были не хуже, мы стараемся обучать их на обезличенных данных. И считаем, что партнёрство с Китаем — это правильный возможный вариант, они действительно сейчас по многим направлениям лидируют». Это также относится к развитию суперкомпьютеров, необходимых для ИИ: «Если взять вычислительные мощности, которые есть за рубежом и которые есть у нас, понятно, что те суперкомпьютеры, которые сейчас работают, в первую очередь в США, многократно превышают те мощности, которые есть в России. И это тоже проблема». Он добавил, что в рамках кооперации уже запущены большие совместные лаборатории с китайскими коллегами. Также начинают осуществлять сборку серверов в России с китайскими GPU: «Это — будущее, так как без кооперации не обойтись. Мы большая и сильная страна, но есть другие большие и сильные страны, вместе с которыми мы достигнем больших результатов». Также было отмечено, что применение ИИ-технологий в финансовом секторе усложняется в связи с необходимостью выполнения требований по соблюдению банковской тайны и защите персональных данных. Поэтому, для того чтобы использовать самые эффективные и популярные большие языковые модели, но при этом не допустить утечку данных, в ВТБ используют их on-premise, ограничивая их применение защищённым банковским контуром. «На сегодняшний день к такому режиму работы готовы наши российские большие языковые модели, в том числе YandexGPT и GigaChat», — сообщил топ-менеджер.

27.03.2026 [10:03], Руслан Авдеев

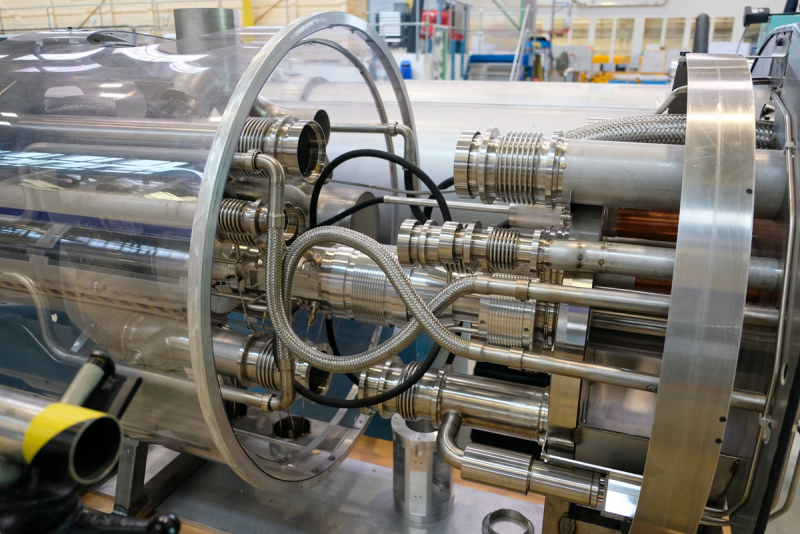

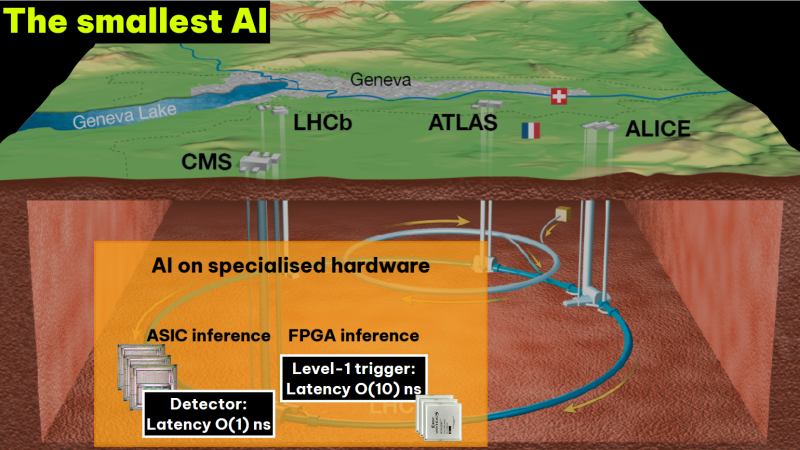

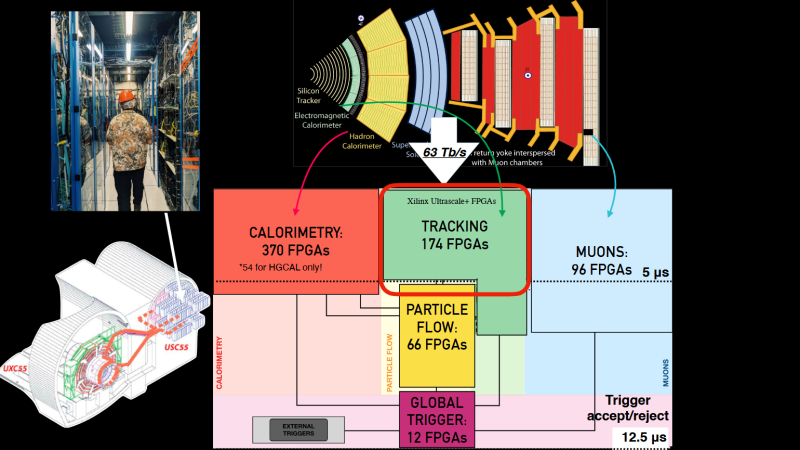

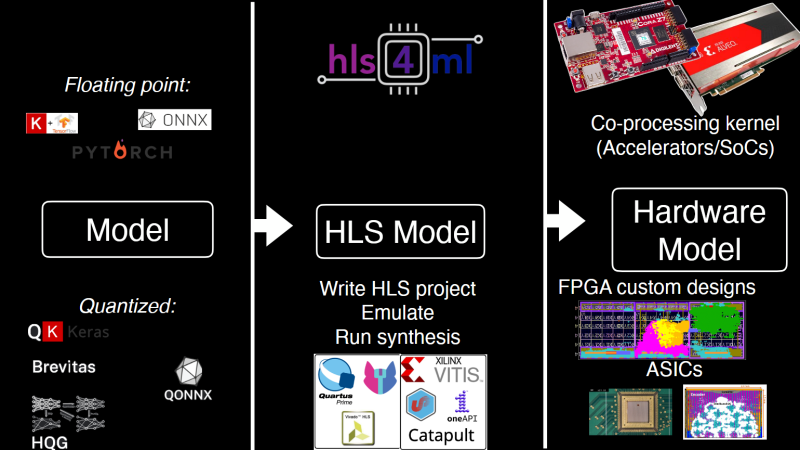

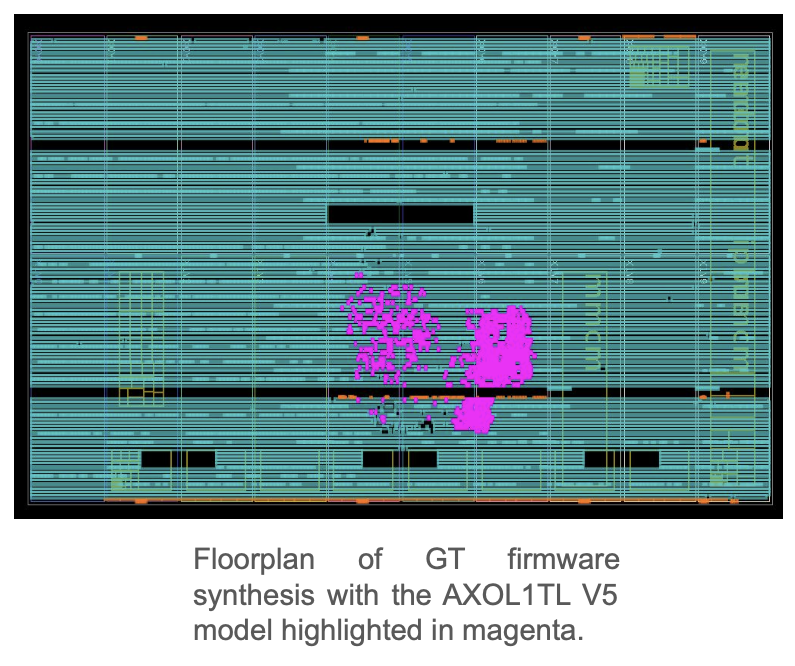

ЦЕРН: для самых больших открытий на БАК нужны самые маленькие ИИ-модели, которые «зашиты» прямо в чипыИИ-инфраструктура Большого адронного коллайдера (БАК) имеет мало общего с классическим решениями на основе TPU или GPU. Вместо этого ЦЕРН (CERN) буквально «выжигает» кастомные ИИ-модели в «кремнии» для фильтрации огромных массивов данных практически в реальном времени, сообщает The Register. Ежегодно коллайдер «генерирует» 40 тыс. Эбайт «сырых» данных от сенсоров — приблизительно четверть объёма всего интернета. Такую информацию CERN хранить не может, поэтому приходится выбирать в режиме реального времени то, что представляет какую-либо ценность. Речь идёт о потоке данных до сотен терабайт в секунду. Алгоритмы для их обработки должны быть чрезвычайно быстрыми. Именно поэтому их приходится буквально «выжигать» непосредственно в чипах. В 27-км кольце БАК субатомные частицы сталкиваются на скоростях, близких к скорости света. По кольцу постоянно перемещаются около 2,8 тыс. пучков протонов с 25-с интервалами. Хотя учёные «помогают» частицам, столкновения случаются сравнительно редко — из миллиардов протонов в каждой сессии сталкиваются лишь порядка 60 пар. При столкновении образуются новые частицы, улавливаемые детекторами CERN. Каждое столкновение пары частиц генерирует несколько мегабайт данных. В секунду происходит около миллиарда столкновений, что приблизительно даёт около 1 Пбайт информации. Естественно, собирать и хранить такие объёмы «сырой» информации технически невозможно, поэтому CERN создал гигантскую вычислительную систему для разделения данных на «интересные» и «неинтересные» ещё на уровне детекторов. Детекторы используют ASIC для буферизации данных за не более чем 4 мкс — они либо сохраняются, либо исчезают навсегда. Решение принимает фильтр Level One Trigger на базе порядка 1 тыс. FPGA, получающих данные по оптической линии на скорости около 10 Тбайт/с. Решения принимаются на лету силами самих чипов по мере поступления данных — даже самая быстрая внешняя память не справится с таким потоком информации. Специальный алгоритм AXOL1TL принимает решение не более чем за 50 нс. Фактически сохраняется лишь около 0,02 % информации о столкновениях, или приблизительно 110 тыс. событий в секунду. Отобранные сведения отправляются на поверхность, но даже после первичной фильтрации речь идёт о передаче терабайт данных ежесекундно. На поверхности второй фильтр — High Level Trigger — оставляет для изучения уже около 1 тыс. событий в секунду. Система оснащена 25,6 тыс. CPU и 400 GPU, которые реконструируют столкновения и отбирают наиболее интересные для анализа результатов. На выходе получается около 1 Пбайт/день новых данных, которые распределяются между 170 научными центрами в 42 странах, где их могут анализировать учёные со всего света. Совокупная вычислительная мощность всех участников проекта составляет около 1,4 млн ядер. CERN стремится измерить параметры столкновений с точностью 99,999 % — это «золотой стандарт», необходимый для заявлений о научных открытиях. Обычный ИИ-инструментарий плохо подходит для детекторов, поэтому инженерам CERN пришлось разработать собственный стек. ИИ-модели для БАК специально уменьшены, модернизированы, параллелизованы и «вымуштрованы» для выявления только действительно существенных данных. В случае с БАК они не менее производительны, но значительно «дешевле» традиционных ML-моделей. Для переноса моделей в аппаратную среду используется компилятор HLS4ML, конвертирующий модель в код C++, который можно запускать на ИИ-ускорителях, SoC, кастомных FPGA и даже «выжигать» в ASIC. При этом значительная часть ресурсов чипа отведена не под сам алгоритм, а под таблицы с предварительно рассчитанными результатами для типовых входящих значений, чтобы ещё быстрее фильтровать информацию.

Источник изображения: CERN В конце года БАК закроют, а новый, более мощный коллайдер High Luminosity LHC должен заработать в 2031 году. Он получит более сильные магниты для фокусировки пучков частиц, сами пучки удвоятся в размерах, коллайдер будет генерировать в 10 раз больше данных, а объём информации от каждого события увеличится с 2 до 8 Мбайт. CERN уже накопил 1 Эбайт от БАК, но это лишь десятая часть от того, что предстоит хранить и обрабатывать в последующие 10 лет. И пока передовые ИИ-лаборатории создают LLM всё большего объёма, CERN движется в противоположном направлении, всеми силами упрощая и ускоряя выявление необычных событий с помощью искусственного интеллекта.

26.03.2026 [14:25], Руслан Авдеев

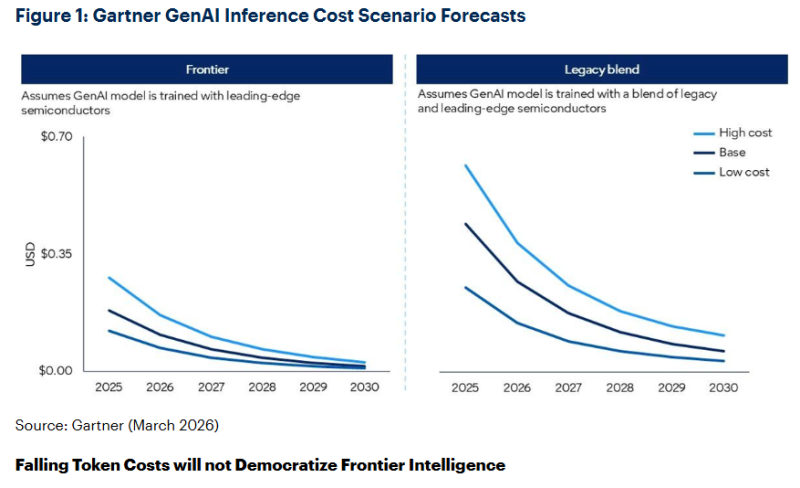

Gartner: к 2030 году себестоимость инференса снизится на 90 %, но качественный ИИ дешевле не станетСогласно прогнозу Gartner, к 2030 году инференс LLM с триллионом параметров будет обходиться провайдерам ИИ-сервисов более чем на 90 % дешевле в сравнении с 2025 годом. При этом речь не идёт о получении всеобщего доступа к передовым вычислениям. В Gartner для исследования каждый токен «оценили» в 3,5 байта или приблизительно четыре символа английского текста. Эксперты предполагают, что снижение затрат будет обусловлено сочетанием повышенной эффективности ИИ-чипов и сопутствующей инфраструктуры, инновациями в разработке самих моделей, повышением эффективности использования чипов, расширением использования специализированных инференс-ускорителей, а также распространением периферийных вычислений для определённых сценариев. В результате, по прогнозам Gartner, к 2030 году LLM станут в 100 раз более экономически эффективными в сравнении с первыми моделями аналогичного масштаба, представленными в 2022 году. Согласно выкладкам Gartner, эксплуатировать модели с помощью передовых ИИ-чипов будет предсказуемо значительно дешевле, чем с использованием более старого или смешанного оборудования на основе более доступных полупроводников с учётом меньшей вычислительной мощности. Про это, в частности, регулярно говорит NVIDIA.

Источник изображения: Gartner Впрочем, снижение стоимости токенов вовсе не означает, что передовые технологии станут более доступными для всех. Во-первых, снижение себестоимости для ИИ-провайдеров не будет означать соизмеримого падения цен для корпоративных клиентов. Кроме того, передовым ИИ-технологиям нужно будет значительно больше токенов, чем сегодня. Так, ИИ-агенты требуют на задачу в 5–30 раз больше токенов, чем обычный чат-бот, и способны выполнять значительно больше задач, чем обычный человек, использующий ИИ. Хотя возможности ИИ расширятся, это будет сопровождаться «непропорционально большим» ростом спроса на токены. Их потребление растёт быстрее, чем снижается стоимость, поэтому ожидается увеличение затрат на инференс. Подчёркивается, что речь не идёт о демократизации передовых вычислений. Стоимость «стандартного» ИИ действительно продолжит падать, но ресурсы, необходимые для сложных ИИ-проектов, по-прежнему будут в дефиците. Руководителям ИИ-проектов, пока маскирующим недостатки их архитектур дешевеющими токенами, придётся столкнуться с трудностями при масштабировании вычислений, связанных с ИИ-агентами. По прогнозам Gartner, наиболее востребованными станут платформы, позволяющие координировать рабочие нагрузки, распределяемые в рамках целого портфеля моделей. Так, рутинные задачи необходимо поручать небольшим, специализированным ИИ-моделям, лучше подходящим при меньших затратах для специальных рабочих процессов в сравнении с универсальными решениями. А дорогостоящие ресурсы передовых моделей необходимо выделять со строгими ограничениями, резервируя их только для сложного, но высокомаржинального инференса.

20.02.2026 [23:37], Руслан Авдеев

«Гонка вооружений» в сфере ИИ бессмысленна — США и Китай преследуют совершенно разные целиВ ИИ уже вложено больше денег, чем потребовалось для высадки людей на Луну, а в 2026 году расходы на технологию могут достигнуть $700 млрд, почти удвоившись год к году. В США политики и бизнес часто стремятся в этой сфере «победить Китай», однако такой подход предполагает общую цель двух стран и относительную «симметрию» при её достижении. На деле цели у стран на рынке ИИ весьма разные, сообщает IEEE Spectrum. По словам Селины Сюй (Selina Xu), руководящей исследованиями и стратегическими инициативами, касающимися Китая и ИИ в офисе Эрика Шмидта (Eric Schmidt), бывшего главы Google, внимательное изучение развития ИИ в двух странах показывает, что они не стремятся в этой сфере к одним и тем же целям. Более того, они движутся совсем в разных направлениях. По мнению Сюй, США делают акцент на масштабирование, стремясь создать «общий искусственный интеллект» (AGI), тогда как для Китая важнее повышение экономических показателей и использование в реальном мире. По словам Сюй, менталитет «гонки на выживание» способен только навредить — правительства и компании будут пренебрегать необходимыми мерами безопасности для достижения мнимого «первенства». Отчасти это уже наблюдается, например, в сфере энергетики, где администрация президента США продвигает «атомные кампусы» с ослабленными требованиями к безопасности АЭС. Сам Шмидт уже предупреждал об опасности стремления США к доминированию в области ИИ. По мере развития систем машинного обучения в 2010-х гг., видные общественные деятели вроде Стивена Хокинга и Илона Маска уже предупреждали, что универсальный потенциал ИИ невозможно будет отделить от военного и экономического — повторяется модель конкуренции времён Холодной войны. По мнению некоторых экспертов, концепция такого «состязания» выгодна передовым лабораториям, инвесторам и СМИ, которым просто удобнее оперировать простыми метриками успеха вроде размера моделей, контрольных показателей и большей вычислительной мощности. В парадигме «гонки вооружений» «общий искусственный интеллект» — и есть «финишная линия», победителем станет тот, кто первый её достигнет. Тем временем, как считают эксперты, нет никакой гарантии, что страна, создавшая AGI, станет именно победителем и её интересы восторжествуют, поскольку такой искусственный интеллект будет умнее людей и, следовательно, неуправляемым и непредсказуемым. Кроме того, Китай и США совсем-по разному подходят к реализации ИИ-проектов и экономические условия этих стран кардинально отличаются. После десятилетий быстрого роста КНР столкнулась с экономическим спадом, поэтому страна стремится найти новый «двигатель экономики». Вместо того, чтобы вкладывать ресурсы в «спекулятивные» модели развития искусственного интеллекта, Поднебесная рассматривает ИИ как инструмент, позволяющий совершенствовать действующие отрасли, от здравоохранения до энергетики и сельского хозяйства, как инструмент, улучшающий жизнь обычных людей. Для этого ИИ внедряется в производство, логистику, энергетику, финансы и госуслуги. Автопроизводители активно внедряют роботов на заводах с минимальным участием людей, по имеющейся статистике на 2024 год в КНР использовалось впятеро больше промышленных роботов, чем в США. Сельскохозяйственные модели помогают фермерам, в здравоохранении ИИ-инструменты помогают врачам ставить диагнозы и лечить пациентов и др. Даже очень маленькие предприятия изучают возможность использовать ИИ для повышения производительности. В США ИИ-модели тоже внедряются в разные отрасли всё чаще, но основной акцент делается на сервис и обработку информации с применением больших языковых моделей (LLM). Они применяются для обработки неструктурированных данных и автоматизации коммуникаций. Например, банками используются помощники на основе LLM для помощи в управлении счетами пользователей и обработки их рутинных запросов, LLM помогают врачам извлекать ключевые данные из медицинских записей и клинической документации. По словам отраслевых экспертов, LLM больше подходят для экономики США, ориентированной на сферу услуг, чем для китайской индустриальной экономики. Конечно, Китай и США конкурируют в некоторых областях, связанных с ИИ, в частности, касающихся разработки и производства полупроводников для обеспечения работы искусственного интеллекта. Также обе страны стремятся обрести контроль над цепочками поставок для обеспечения национальной безопасности. Китай, безусловно, стремится избавиться от зависимости от американских чипов. Важной сферой для конкуренции является ИИ для военного применения, поскольку та или иная сторона может получить преимущества в плоскости отдельных военных технологий. При этом Китай всё ещё не подобрал «фаворита» для военного и промышленного сектора. После триумфального дебюта DeepSeek в 2025 году, главный получатель средств для разработки «общего искусственного интеллекта» так и не выбран, а вкладывать все средства в AGI страна, похоже, не планирует, поскольку это слишком рискованно. На деле американские и китайские компании до сих пор сотрудничают, несмотря на постепенное «разделение» экономик двух стран. Фактически, по мнению Сюй, для создания безопасного и заслуживающего доверия ИИ было бы лучше, чтобы исследователи и политики США и КНР наладили диалог и достигли консенсуса относительно того, что запрещено, а потом конкурировали бы в этих рамках. В концепции «гонки вооружений» упускается из виду реальная ситуация на местах, обмен опытом между компаниями, обмен научными данными, переток талантов с одного рынка на другой и то, насколько тесно переплетены экосистемы двух стран в целом.

19.02.2026 [15:57], Руслан Авдеев

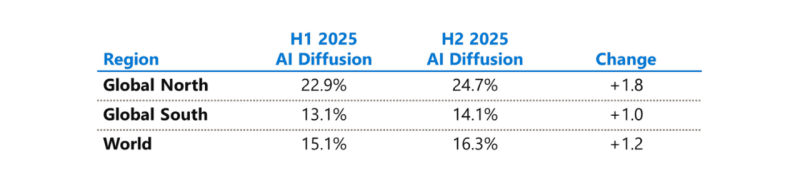

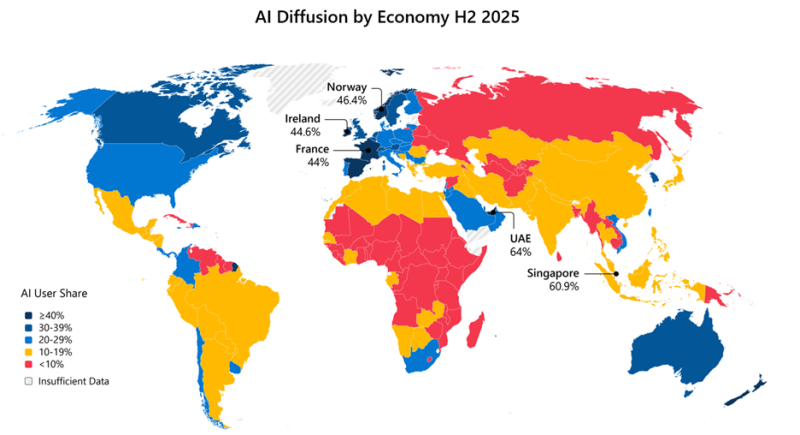

Microsoft бросилась исправлять ИИ-неравенство в мире и выделила на это $50 млрдНа недавнем мероприятии India AI Impact Summit представители Microsoft объявили, что компания готовится инвестировать к концу десятилетия $50 млрд для того, чтобы обеспечить доступ к ИИ странам Глобального Юга. Технологии искусственного интеллекта стремительно распространяются, но чрезвычайно неравномерно в мировом масштабе. В докладе Microsoft AI Diffusion Report утверждается, что в странах Глобального Севера ИИ используется вдвое активнее, чем на юге, и неравенство продолжает увеличиваться. Это сказывается не только на национальном и региональном экономическом росте, но и перспективах развития. Более века неравный доступ к электроэнергии увеличивал экономический разрыв между Глобальным Севером и Югом. С ИИ может произойти аналогичная история. Потребности в новых технологиях требуют существенных инвестиций и больших усилий правительств, частного сектора и НКО. Выделенные Microsoft $50 млрд призваны поддержать новые возможности в странах Глобального Юга. Программа развития ИИ состоит из пяти элементов:

Инфраструктура жизненно необходима для распространения ИИ, говорит компания. ИИ требует энергии, каналов связи, вычислительных мощностей. Только в последнем финансовом году Microsoft инвестировала более $8 млрд в инфраструктуру ЦОД, обслуживающую Глобальный Юг, включая Индию, Мексику, страны Африки, Южной Америки, Юго-Восточной Азии и Ближнего Востока. В первую очередь компания стремится расширить доступ в интернет 250 млн человек в макрорегионе. Microsoft заявила, что уже помогла получить доступ в интернет 117 млн человек в Африке. Инвестиции в ИИ-инфраструктуру осуществляются с учётом необходимости обеспечения местного суверенитета, хотя не так давно компания объявила, что не может обеспечить суверенитет данных в Европе из-за особенностей американского законодательства. Microsoft заявила о создании суверенного управления в публичных облаках, частных суверенных предложениях и тесном сотрудничестве с национальными партнёрами на местах. Утверждается, что в эру ИИ вся информация остаётся в руках клиентов под их полным контролем, без передачи сторонним провайдерам. При этом Глобальный Юг требует огромных инвестиций в инфраструктуру ЦОД, энергетику и связь, что крайне затруднительно без зарубежных инвестиций, в том числе со стороны техногигантов. В числе прочего для удовлетворения этих потребностей было сформировано партнёрство Trusted Tech Alliance, объединяющее 16 ведущих технологических компаний из 11 стран с четырёх континентов.

Источник изображения: Microsoft Однако ЦОД и интернет-каналы — лишь часть необходимой инфраструктуры. Не меньшее значение имеет доступ к технологиям для школ, университетов и НКО и цифровым компетенциям. В предыдущем финансовом году Microsoft инвестировала в программы для государств Глобального Юга $2 млрд, включая гранты, пожертвования, льготы и обучающие программы. В 2025 году компания запустила инициативу Microsoft Elevate, призванную к 2028 году подготовить 20 млн дипломированных специалистов с востребованными ИИ-компетенциями. В Индии компания обучила уже 5,6 млн человек, а к 2030 году намерена довести это число до 20 млн. Компания подготовит 2 млн учителей из более 200 тыс. школ и вузов, а также оснастит 25 тыс. учебных учреждений ИИ-инфраструктурой. Ещё одно направление — создание и доработка ИИ-моделей на местных языках, поскольку локальные решения пока что хуже, чем решения на английском языке. Microsoft поддержала инвестиции в инициативу LINGUA Africa (выделено $5,5 млн) по сбору языковых данных и развитие моделей для африканских языков. Дополнительно совершенствуется бенчмарк MLCommons AILuminate для индийских и азиатских языков для оценки безопасности ИИ вне англоязычной среды. Совместно с образовательными и коммерческими структурами из Индии, Японии, Кореи и Сингапура при участии Microsoft создаётся мультиязычная и мультимодальная подборка из 7 тыс. высококачественных промптов для хинди, тамильского, малайского, японского и корейского языков. Также Microsoft развивает метод Samiksha для учёта локальных языковых и культурных контекстов. Samiksha позволяет выявлять сбои, которые часто упускаются «англоцентричными» методами оценки. В Африке компания совместно с NASA, властями и др. организациями будет применять ИИ к спутниковым данным для анализа продовольственной ситуации. Технология уже отработана в Индии. В рамках Project Gecko компания развивает ИИ-технологии совместно с сообществами в Восточной Африке и Южной Азии для поддержки с/х. В том числе речь идёт о семействе моделей для распознавания речи Paza, способных работать на мобильных устройствах с шестью кенийскими языками. Ведутся работы над многоязыковыми инструментами Copilot, Multimodal Critical Thinking (MMCT) Agent для анализа видео с учётом голоса и текста, адаптацией LLM к низкоресурсным языкам (в т.ч. чичева, инуктитут, маори) и т.д.

Источник изображения: Microsoft Для ускоренного внедрения ИИ нужно понимать, где и как применяется ИИ, с каким недостатками приходится сталкиваться разработчикам, говорит Microsoft. На основе статистики публичных репозиториев GitHub и метрик Azure Foundry компания участвует в создании «рейтинга» Global AI Adoption Index Всемирного Банка. Например, индийское сообщество из 24 млн разработчиков — второе по величине на GitHub и самое быстрорастущее среди 30 ведущих экономик. С 2020 года ежегодный прирост составляет более 26 %, в 2025 году он составил более 36 %. Индийские специалисты занимают второе место в мире по вкладу в open source, использованию GitHub Education, по вкладу в публичные ИИ-проекты и др. Такие данные помогают точнее направлять инвестиции в инфраструктурные проекты, языковые технологии и на обучение. Поддержка подобных метрик помогает измерять достигнутый прогресс. Microsoft подчёркивает, что компания акцентирует внимание в вопросах внедрения ИИ на необходимости создания доступной инфраструктуры, надёжно работающих в реальном мире системах, а также технологиях, которые могут применяться с учётом местных условий. Для этого компания намерена работать с партнёрами, включая обмен данными для оценки прогресса.

01.02.2026 [12:05], Владимир Мироненко

Gartner: к 2029 году обеспечение цифрового ИИ-суверенитета будет обходиться странам в 1 % ВВП

gartner

llm

software

государство

ии

инвестиции

информационная безопасность

исследование

конфиденциальность

прогноз

финансы

По оценкам аналитической фирмы Gartner, к 2029 году для обеспечения цифрового суверенитета странам потребуется инвестировать не менее 1 % всего своего валового внутреннего продукта (ВВП) в ИИ-инфраструктуру, пишет The Register. В результате реализации цифрового суверенитета страны окажутся привязанными к региональным ИИ-платформам, основанным на собственных контекстных данных, что приведёт к сокращению сотрудничества между странами, дублированию усилий и увеличению стоимости проектов, утверждает Gartner. «Страны, стремящиеся к цифровому суверенитету, увеличивают инвестиции во внутренние платформы ИИ, поскольку они ищут альтернативы закрытой модели США, включая вычислительные мощности, ЦОД, инфраструктуру и ИИ-модели, соответствующие местным законам, культуре и региону», — заявил вице-президент и аналитик Gartner Гаурав Гупта (Gaurav Gupta). По оценкам Gartner, к следующему году 35 % стран будут привязаны к региональным системам. Локализованные модели обеспечивают большую контекстную ценность, превосходя неадаптированные глобальные модели в таких областях применения, как образование, соблюдение законодательства и государственные услуги, особенно, в случае использования языков, отличных от английского. Для Европы и других регионов стремление к цифровому суверенитету наталкивается на зависимость от облачной инфраструктуры США, отсюда и необходимость для стран тратить больше средств на собственную ИИ-инфраструктуру, отметил The Register. «Инфраструктура ЦОД и ИИ-фабрик составляет важнейшую основу стека, обеспечивающего суверенитет ИИ», — заявил Гупта. Он добавил, что в результате ЦОД и инфраструктура ИИ-фабрик будут стремительно развиваться и привлекать инвестиции в будущем, что позволит нескольким компаниям, контролирующим ИИ-стек, достичь оценок в триллионах долларов. Хотя 1 % ВВП страны представляет собой громадную сумму, которая, например, у Великобритании составляет около £30 млрд ($39 млрд), это для американских технологических гигантов не является проблемой, поскольку они уже инвестируют в ИИ-инфраструктуру больше, чем весь ВВП некоторых стран.

21.01.2026 [17:07], Руслан Авдеев

Глава Anthropic: продажа H200 в Китай равнозначна поставкам ядерного оружия Северной КорееГенеральный директор Anthropic Дарио Амодеи (Dario Amodei) недоволен тем, что США разрешили NVIDIA продавать китайским компаниям передовые ИИ-ускорители. Он сравнил это решение с раздачей ядерного оружия противникам, сообщает The Register. По словам Амодея, выступившего на Международном экономическом форуме в Давосе, руководители китайских компаний заявляют, что эмбарго на поставку американских чипов сдерживает их развитие. Он заявил, что продавать эти чипы — большая ошибка. Ранее США разрешили поставки ускорителей NVIDIA H200 китайским покупателям с пошлиной 25 %. Теперь слово за китайскими властями, которым ещё предстоит разрешить такие сделки. Anthropic желает, чтобы экспорт ИИ-технологий, наоборот, ужесточился — это заметно контрастирует с позициями NVIDIA и AMD, которые предупреждают, что запреты на экспорт только способствуют развитию ИИ-технологий в КНР. При этом на Китай приходится около половины исследователей в области искусственного интеллекта. Ранее Anthropic утверждала, что США и так лидируют в сфере ИИ-полупроводников, а экспортный контроль, на фоне того, что вычислительные мощности чипов удваиваются каждые два года, замедляет развитие Китая и укрепляет лидерство США. Компания уверена, что США на годы опережают Китай в способности выпускать передовые чипы. Доступ к американским разработкам позволит китайским создателям ПО вроде DeepSeek оказаться в лучшей позиции для конкуренции с Западом. При этом, как сообщает The Register, многие из наиболее производительных китайских LLM относятся к open source, поэтому их может использовать любой желающий, не опасаясь того, что данные его компании попадут в обучающий датасет, тогда как LLM американских компаний в основном «скрыты» за API, а сами компании расплывчато обещают не использовать пользовательские данные для обучения своих ИИ. При этом суды полны исков пользователей, связанных с нарушением прав на интеллектуальную собственность.

Источник изображения: CDC/unspalsh.com Слова Амодеи о том, что китайские разработчики LLM угрожают американскому бизнесу, слегка сгущают краски, но всё может действительно измениться, если китайские компании смогут импортировать передовые ускорители из США. Пока же, по словам бизнесмена, ИИ из КНР производителен только «на бумаге», а системы якобы специально оптимизируют для бенчмарков. Так или иначе, корпоративные пользователи действительно имеют немного вариантов, если желают получить доступ к хорошим открытым моделям — они в основном из Китая. Сама Anthropic называет главными конкурентами не стартапы из КНР, а OpenAI, Google и, чуть реже, другие американские компании. Anthropic пока не выкладывала ни одну из своих флагманских моделей в открытый доступ, но участвовала в нескольких совместных проектах с избранными клиентами, самым значимым из которых является AWS. Амодеи подчеркнул, что его продукты почти ни разу не проиграли в борьбе за контракт ИИ-модели из Поднебесной. Ключевое слово — «почти». Это означает, что китайским разработчикам всё-таки удавалось одержать верх несмотря на сложную ситуацию, в которой они находятся из-за экспортных ограничений. Компания последовательно критикует инициативы, способные обеспечить сотрудничество Запада с Китаем и даже не приветствует взаимодействие с другими мировыми игроками. Так, летом 2025 года сообщалось, что она намерена привлечь инвестиции с Ближнего Востока, но только потому, что избежать работы с регионом не удастся. В 2024 году Anthropic даже отказалась от инвестиций из Саудовской Аравии по соображениям «национальной безопасности».

21.01.2026 [15:28], Руслан Авдеев

ByteDance стремительно завоёвывает рынок облачных ИИ-сервисов КитаяКомпания ByteDance агрессивно осваивает китайский облачный рынок. Владелец популярной социальной сети TikTok пытается использовать свои достижения в сфере ИИ для выхода за пределы рынка пользовательских приложений, обеспечивших в своё время успех компании, сообщает The Financial Times. Компания продвигает облачные решения Volcano Engine для корпоративных клиентов, увеличивая команду продаж и устраивая ценовые войны с конкурентами. Источники сообщают, что ByteDance предлагает корпоративным клиентам собственные обширные данные и вычислительные ресурсы, например, для создания ИИ-агентов с использованием собственных моделей ByteDance. Тем самым она теснит Alibaba, Tencent и Huawei, которые долго доминировали на этом рынке. По данным IDC, Volcano Engine является в Китае вторым по величине провайдером ИИ-инфраструктуры и ПО после Alibaba. На долю ByteDance в I половине 2025 года приходилось около 13 % выручки от китайских облачных ИИ-сервисов ($390 млн), на долю Alibaba — 23 %. При этом на китайском облачном рынке в целом ByteDance имеет долю лишь 3 %. Иными словами, ByteDance стала лидером в сфере ИИ-сервисов, самом быстрорастущем сегменте рынка. По мнению некоторых аналитиков, компания может стать одним из ключевых игроков в Китае в сегменте кастомных ИИ-инструментов благодаря крупным собранным датасетам и развитой аппаратной инфраструктуре, добавив для достижения успеха агрессивное ценообразование и глубокую интеграцию со своей экосистемой пользователей.

Источник изображения: Liren/unsplash.com ByteDance хорошо разбирается в пользовательских технологиях, имея в портфолио социальную сеть TikTok и её китайский вариант Douyin, а также видеоредактор CapCut и новостной агрегатор Toutiao. Именно эти площадки обеспечивают большую часть выручки компании благодаря рекламе, продажам и подпискам. Согласно данным, предоставленным инвесторам, в III квартале выручка составила $50 млрд. Последние попытки выйти на рынок корпоративного ПО, включая премьеру похожего на Slack продукта Lark, не увенчались особенным успехом. Стратегия роста, ориентированная на ИИ, могла бы придать импульс для будущего выхода на IPO, которого инвесторы ожидают годами. ByteDance агрессивно выводит в коммерческую плоскость свои ИИ-возможности благодаря Volcano Engine. Компания акцентирует внимание на продажах флагманского сервиса HiAgent, посредством которого создаются кастомные ИИ-агенты для корпоративных клиентов. Стратегия опирается на массивные инвестиции в вычислительные мощности. ByteDance сегодня — в числе крупнейших покупателей ИИ-оборудования, она же была крупнейшим клиентом NVIDIA в 2024 году. По данным The Financial Times, в этом году значительная часть из ¥85 млрд, выделенных на ИИ-ускорители, будет потрачена на покупку NVIDIA H200, с некоторых пор разрешённых для поставок в КНР — если это одобрят китайские власти. При этом некоторые эксперты отмечают, что ByteDance имеет сильные позиции в разработке ПО и достаточные аппаратные ресурсы для получения значимой доли облачного рынка, но ей не хватает опыта в обслуживании корпоративных клиентов в сравнении с Tencent и Huawei, поэтому приходится навёрстывать упущенное.

Источник изображения: Claudio Schwarz/unsplash.com Крупные китайские игроки сами дают ByteDance такую возможность. Например, Tencent заявляла, что будет тратить ресурсы ИИ-ускорителей для внутренних нужд, не планируя масштабного расширения облачных сервисов для клиентов. Huawei, тем временем, сократила свои облачные ИИ-амбиции за последний год, сфокусировавшись на продаже чипов Ascend напрямую клиентам. По данным IDC, доля обеих компаний на облачном ИИ-рынке КНР слегка уменьшилась в I половине 2025 года. Становление ByteDance в качестве одного из китайских ИИ-гигантов привлекло меньше внимания, чем успехи DeepSeek и Alibaba, которые развивают успешные открытые ИИ-модели и одновременно публикуют исследования о своих методиках обучения ИИ. Напротив, ByteDance сохранила полный контроль над своими самыми передовыми моделями и компании-клиенты имеют к ним доступ только по подписке. К слову, Alibaba, яро выступавшая за open source подход к распространению моделей, в последние месяцы оставила некоторые из передовых вариантов «закрытыми». Другими словами, успехи ByteDance в сфере ИИ-моделей не освещаются слишком широко, поскольку отдача open source продуктов вызывает некоторые сомнения у многих разработчиков. Один из представителей команды ByteDance подчеркнул, что компания концентрирует усилия на создании лучших ИИ-моделей для клиентов, а не на гонке в сегменте open source. |

|