Материалы по тегу: ии

|

04.04.2025 [08:44], Сергей Карасёв

Объём мирового рынка генеративного ИИ в 2024 году вырос более чем в четыре раза, но заработали на нём в основном поставщики оборудованияКомпания Gartner подвела итоги исследования глобального рынка генеративного ИИ (GenAI) в 2024 году: расходы достигли $364,96 млрд, что на 336,7 % больше по сравнению с предыдущим годом, когда объём отрасли оценивался в $83,57 млрд. Аналитики полагают, что в дальнейшем затраты продолжат увеличиваться, но темпы роста снизятся. Gartner учитывает поставки ИИ-серверов и различного оборудования, включая персональные компьютеры с поддержкой ИИ, а также расходы в сегменте ПО и услуг. Основную часть выручки приносят аппаратные решения. В частности, в 2024 году продажи серверов для задач ИИ, по оценкам, достигли $135,64 млрд — это на 154,7 % больше, чем годом ранее. Всевозможные устройства с функциями ИИ обеспечили $199,6 млрд с ростом на 845,5 % в годовом исчислении. В сегменте ПО отмечен рост на 255,1 % — до $19,16 млрд, тогда как услуги принесли $10,57 млрд, показав прибавку в 177,0 % по отношению к 2023-му. Аналитики Gartner прогнозируют, что в 2025 году затраты на мировом рынке GenAI увеличатся на 76,4 %, достигнув $643,86 млрд. Причём около 80 % от этой суммы придётся на оборудование. Ожидается, что продажи серверов в годовом исчислении поднимутся на 33,1 %, составив $180,62 млрд. Всевозможные устройства с ИИ принесут $398,32 млрд, показав рост на 99,5 %. В сегменте ПО прогнозируется прибавка в 93,9 % — до $37,16 млрд. Услуги обеспечат около $27,76 млрд с ростом на 162,6 % по сравнению с 2024 годом. В целом, аналитики полагают, что технологии ИИ станут неотъемлемой частью многих бизнес-операций и продуктов для корпоративного и потребительского секторов.

03.04.2025 [19:29], Татьяна Золотова

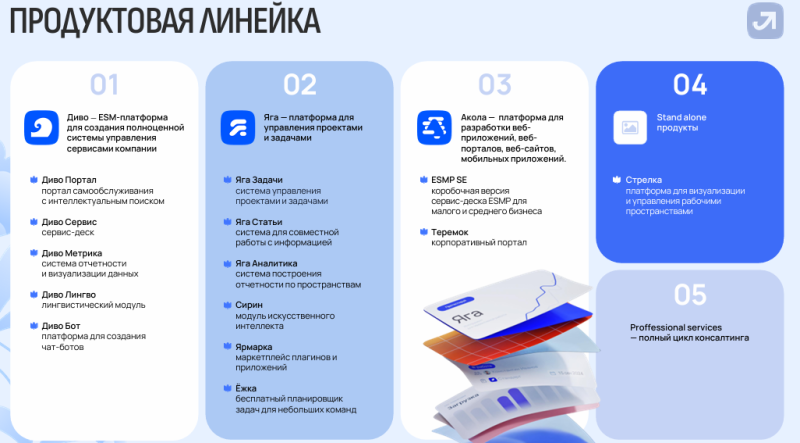

«РТК ИТ Плюс» пополнила ИТ-экосистему «Лукоморье» тремя новыми продуктамиВ экосистему отечественных ИТ-решений «Лукоморье» разработчика программного обеспечения «РТК ИТ Плюс» (входит в ГК «Ростелеком») вошли no-code платформа «Акола», ESM-система «Диво» и система управления пространством «Стрелка». Теперь экосистема состоит из 15 продуктов. В компании надеются, что по итогам 2025 года обновленное «Лукоморье» принесет около 1,5 млрд руб. выручки. «Акола» запущена в августе 2024 года и позволяет создавать корпоративные веб-приложения и сайты без программирования. В семейство no-code платформы входят ESMP SE — коробочная версия сервис-деска ESMP для малого и среднего бизнеса, а также «Теремок» — корпоративный портал. Разработчик утверждает, что у решения нет «прямых аналогов на отечественном рынке», а также что платформа позволяет запускать новые продукты в четыре раза быстрее и в пять раз дешевле по сравнению с традиционным подходом. «Диво» (первое название ESMP) состоит из пяти модулей, автоматизирует работу внутренних ИТ-служб. Встроенный ИИ-модуль классифицирует запросы и предлагает решения. В семейство ESM-системы входят портал самообслуживания с интеллектуальным поиском «Диво Портал», сервис-деск «Диво Сервис», система отчетности и визуализации данных «Диво Метрика», лингвистический модуль «Диво Лингво» и платформа для создания чат-ботов «Диво Бот». По словам генерального директора «РТК ИТ Плюс», внедрение «Диво» позволило «Ростелекому» сэкономить 169 млн руб. в рамках импортозамещения. «Стрелка» (ранее «Интерактивная карта») отвечает за управление рабочим пространством в условиях гибридного формата работы. Система адаптируется к большим офисам и рабочим площадям, а также соответствует требованиям защиты данных госкомпаний. По словам разработчиков, «Стрелка» помогла «Ростелекому», «Теле2» и «ВТБ Капитал» повысить производительность ряда подразделений, процесс размещения персонала стал прозрачнее и занимает меньше времени, сократились конфликты при бронировании переговорных или рабочих мест. Сначала экосистема «Лукоморье» развивалась как набор отдельных решений. В семейство продуктов «Яга» (отечественный вариант Jira, Confluence и др.) входят система управления проектами задачами «Яга Задачи», система для совместной работы с информацией «Яга Статьи», система построения отчетности по пространствам «Яга Аналитика», а также планировщик задач для малых команд «Ёжка», маркетплейс плагинов и приложений «Ярмарка» и ИИ-модуль «Сирин». Кроме того, «Лукоморье» включает Professional services, ориентированные на оказание полного цикла консалтинговых услуг. Выручка «РТК ИТ Плюс» по итогам 2024 года выросла более чем в два раза — до 433,8 млн руб., а штат увеличился на 81 % — до 350 сотрудников. По итогам 2025 года разработчик планирует утроить выручку. Семь разработок компании включены в реестр отечественного программного обеспечения Минцифры.

03.04.2025 [16:47], Руслан Авдеев

Google готовится к аренде ИИ-серверов с ускорителями NVIDIA Blackwell у CoreWeaveКомпания Google близка к тому, чтобы согласиться на сделку с CoreWeave. Предполагается, что гиперскейлер будет арендовать у последней серверы, оснащённые ускорителями серии NVIDIA Blackwell, сообщает The Information. Сделка находится на «поздних стадиях» согласования. Благодаря ей Google сможет получить доступ к большему количеству новейших ИИ-ускорителей. Об этом издание сообщает со ссылкой на два анонимных источника, знакомых с вопросом. Ещё два источника добавили, что Google уже пыталась договориться с конкурентами CoreWeave о доступе к свободным ускорителям — судя по всему, компании не хватает доступных вычислительных мощностей. Возможные партнёры пока не комментируют ситуацию. По информации Seeking Alpha, на момент закрытия торгов в среду акции CoreWeave выросли на 16 %, колебания курсов акций Google и NVIDIA оказались незначительными. По данным The Information, отдельно Google и CoreWeave ведут переговоры об аренде площадей в дата-центрах последней — там Google сможет разместить тензорные ускорители (TPU) собственной разработки, которые компания довольно успешно внедряет наряду с решениями NVIDIA.

Источник изображения: Microsoft Edge/unsplash.com Потенциальное соглашение косвенно свидетельствует о проблемах компаний, желающих пользоваться ускорителями NVIDIA, но не имеющих возможности удовлетворить спрос в полной мере. Уникальные отношения CoreWeave и NVIDIA и возможности оператора ЦОД предоставлять в распоряжение новые ИИ-мощности привлекают крупные облачные сервисы и ключевых ИИ-разработчиков вроде OpenAI и Meta✴. По данным Investing.com, за последние несколько дней крупные ИИ-структуры вроде xAI и OpenAI публично озвучивали необходимость увеличения доступных вычислительных ресурсов. Буквально на днях CoreWeave вышла на IPO — правда, планы развития компании могут оказаться под вопросом, поскольку средств привлечено меньше, чем ожидалось, а капитализация её оказалась значительно меньше, чем рассчитывалось. UPD 29.06.2025: Google действительно арендует ускорители у CoreWeave, но только для того, чтобы сдать их OpenAI. Вероятно, это часть более крупной сделки, в рамках которой OpenAI, по слухам, также начнёт использовать фирменные ускорители Google TPU.

03.04.2025 [15:26], Руслан Авдеев

В Пенсильвании построят газовую электростанцию мощностью 4,5 ГВт для ИИ ЦОД на месте заброшенной угольнойНа месте крупнейшей угольной электростанции Пенсильвании появится новая газовая станция мощностью 4,5 ГВт. Проект предполагает создание ЦОД для ИИ и HPC, а станцию должны ввести в эксплуатацию в 2027 году, сообщает The Register. За реализацию проекта отвечает Homer City Redevelopment (HCR). Потребуется порядка $10 млрд только на развитие энергетической инфраструктуры и подготовку площадки. Ещё миллиарды уйдут на строительство самого дата-центра. Электростанция и ЦОД будут находиться рядом друг с другом. Для преобразования угольных мощностей в газовые потребуется полная перестройка объекта. Зато можно будет использовать оставшуюся энергетическую инфраструктуру, включая линии электропередач и подстанции. HCR не рассказывает о будущих арендаторах, основное внимание уделяется подготовке дата-центра и энергетической инфраструктуре. Проект ориентирован на обеспечение работы ИИ-платформ и гиперскейлеров. Предусмотрено использование газовых турбин General Electric Vernova (GE Vernova), сообщает пресс-служба HCR. Установки предназначены для работы на природном газе, но в будущем их могут перевести и на водород. Впрочем, пока сроки поставок «зелёного» водорода — под вопросом. Хотя предполагается использование в генераторах природного газа, проект позиционируется как «низкоуглеродный», поскольку, по данным HCR, новая станция позволяет сократить выбросы парниковых газов на 60–65 % в сравнении с угольными мощностями, ранее работавшими там же.

Источник изображения: silas Tarus/unsplash.com Место выбрали не случайно. Территория бывшей угольной электростанции в Хомер-Сити (Homer City) уже имеет инфраструктуру, включая линии электропередач, подстанции и доступ к воде. Благодаря этому строительство и подключение к энергосистеме ускорятся и упростятся. Стройка, которую возглавит Kiewit Power Constructors, должна начаться уже в 2025 году, первые турбины планируют установить в 2026 году, а ввод в эксплуатацию намечен на 2027 год, как раз к появлению 600-кВт стоек NVIDIA Rubin Ultra NVL576. Новые электростанции для дата-центров — один из последних трендов в деле обеспечения энергией ИИ ЦОД. Meta✴ строит дата-центр для ИИ в Луизиане и совместно с Entergy готовят газовую электростанцию на 2,2 ГВт. Её также могут перевести на водород в будущем. Microsoft заключила соглашение с Constellation Energy о перезапуске реактора АЭС Three Mile Island. Amazon (AWS) приобрела кампус Cumulus Data в Пенсильвании, расположенный рядом с атомной электростанцией Susquehanna. Meta✴ и Oracle также активно изучают возможности ядерной энергетики. Первая рассчитывает приобрести до 4 ГВт атомной энергии к 2030-м годам, а Oracle намерена построить дата-центр на 1 ГВт с питанием от трёх малых модульных реакторов (SMR). Наконец, в марте появились новости о том, что и Crusoe, и Chevron получат газовые турбины GE Vernova для снабжения электричеством своих ЦОД, тоже по 4,5 ГВт — пока остаётся только догадываться, не идёт ли во всех случаях речь об одних и тех же турбинах. В конце марта сообщалось, что производители газовых генераторов с трудом справляются с заказами для ИИ ЦОД, но расширять производство опасаются из-за возможной низкой маржинальности проектов.

03.04.2025 [12:50], Руслан Авдеев

Ближневосточный след: Cerebras Systems развеяла сомнения регулятора CFIUS в благонадёжности перед выходом на IPOCerebras Systems, разрабатывающая ИИ-ускорители, объявила о решении основных проблем с Комитетом США по иностранным инвестициям (CFIUS) перед выходом на IPO. Главным предметом беспокойства CFIUS стала связь американского стартапа с компанией G42 из ОАЭ, сообщает The Register. На G42, согласно поданным данным о доходах, пришлось более 87 % выручки Cerebras в I половине 2024 года. При этом с середины 2023 года экспорт ИИ-ускорителей в страны Ближнего Востока строго регулируется США. От разработчиков чипов из США требуется получение экспортных лицензий для продажи товаров в регионе. В результате G42 финансировала строительство ИИ-суперкомпьютеров на основе чипов Cerebras на территории США, а общая сумма проектов составила порядка $900 млн. Компания планировала получать к ним удалённый доступ. В рамках IPO G42 также собиралась купить 22 млн акций Cerebras, что, вероятно, вызвало настороженность CFIUS. Ранее G42 уже привлекала внимание американских властей, опасающихся, что закупающая большие объёмы ускорителей на Ближнем Востоке компания может работать на Китай. В результате G42 была вынуждена разорвать связи с рядом партнёров, включая Huawei, рассчитывая «умиротворить» американских регуляторов и устранить препятствия для сотрудничества с Cerebras и Microsoft.

Источник изображения: Nimisha Mekala/unsplash.com В Cerebras заявили, что компания развеяла опасения CFIUS, внеся поправки в соглашение с G42 — последняя сможет приобретать только «неголосующие» акции, поэтому дальнейшая проверка, вероятно, не потребуется. Впрочем, стороны пока не дают дополнительных комментариев. Тем не менее, руководство Cerebras отметило в одной из социальных сетей, что при тесном сотрудничестве с G42 удалось достичь урегулирования с CFIUS. Новости появились менее чем через неделю после того, как ведущие СМИ сообщили, что дебют Cerebras на фондовом рынке был отложен из-за ожидания новых ключевых назначений в администрации США. Условия IPO пока не разглашаются, но ранее сообщалось, что компания намерена привлечь до $1 млрд, а её капитализация составит $7–8 млрд. G42 останется одним из ключевых клиентов Cerebras, но стартап очевидно ориентирован на диверсификацию клиентской базы благодаря платформе «инференс как сервис» и создание масштабной инфраструктуры в США, Канаде и Франции. К концу 2025 года стартап пообещал развернуть более тысячи ускорителей в шести новых ЦОД. Хотя на первый взгляд это не так много в сравнении сотнями тысяч ускорителей, внедряемых xAI и другими компаниями, стоит отметить, что чипы Cerebras размером с целую кремниевую пластину способны обеспечивать производительность до 125 Пфлопс (FP16) — приблизительно в 62 раза выше, чем у моделей серии NVIDIA H100, применяемых для создания суперкомпьютера Colossus с Мемфисе (Теннесси).

02.04.2025 [11:50], Руслан Авдеев

Царь-чипы с интегрированной фотоникой: Cerebras Systems и Ranovus выбраны DARPA для создания вычислительной платформы нового поколенияИИ-стартап Cerebras Systems выбран американским военно-техническим управлением DARPA для разработки высокопроизводительной вычислительной системы нового поколения. Cerebras объединит собственные ИИ-ускорители и фотонные CPO-интерконнекты Ranovus для обеспечения высокой производительности при малом энергопотреблении, сообщает пресс-центр Cerebras. Комбинация технологий двух компаний позволит обеспечить в реальном времени моделирование сложных физических процессов и выполнение масштабных ИИ-задач. С учётом успеха программы DARPA Digital RF Battlespace Emulator (DRBE), в рамках которой Cerebras уже разрабатывает передовой суперкомпьютер для радиочастотной эмуляции, именно Cerebras и Ranovus были выбраны для новой инициативы, позволяющей объединить вычислительные продукты Cerebras с первыми в отрасли фотонными интерконнектами Ranovus. Решение крайне актуальное, поскольку двумя ключевыми вопросами для современных вычислительных систем являются проблемы с памятью и обменом данных между ускорителями и иной серверной инфраструктурой — вычислительные потребности растут быстрее, чем возможности памяти или IO-систем ввода-вывода. Как утверждают в Cerebras, её WSE-чипы имеют в 7 тыс. раз большую пропускную способность, чем классические ускорители, что даёт самый быстрый в мире инференс и самое быстрое моделирование молекулярных процессов.

Источник изображения: Cerebras В рамках нового плана DARPA стартап Cerebras будет использовать интерконнект Ranovus, что позволит получить производительность, недоступную даже для крупнейших суперкомпьютерных кластеров современности. При этом энергопотребление будет значительно ниже, чем у самых современных решений с использованием коммутаторов. Последние являются одними из самых энергоёмких компонентов в современных ИИ-системах или суперкомпьютерах. Утверждается, что комбинация новых технологий двух компаний позволит искать решения самых сложных задач в реальном времени, будь то ИИ или сложное моделирование физических процессов, на недостижимом сегодня уровне. Подчёркивается, что оставаться впереди конкурентов — насущная необходимость для обороны США, а также местного коммерческого сектора. В частности, это открывает огромные возможности для работы ИИ в режиме реального времени — от обработки данных с сенсоров до симуляции боевых действий и управления боевыми или коммерческими роботами. В Ranovus заявили, что платформа Wafer-Scale Co-Packaged Optics в 100 раз производительнее аналогичных современных решений, что позволяет значительно повысить эффективность ИИ-кластеров, и значительно энергоэффективнее продуктов конкурентов. Партнёрство компаний позволит задать новый стандарт для суперкомпьютерной и ИИ-инфраструктуры, решая задачи роста спроса на передачу и обработку данных и давая возможность реализовать военное и коммерческое моделирование нового поколения. Помимо использования в целях американских военных, гигантские ИИ-чипы Cerebras применяются и оборонными ведомствами других стран. Так, весной 2024 года сообщалось, что продукты компании помогут натренировать ИИ для военных Германии.

02.04.2025 [11:04], Владимир Мироненко

MTS AI выпустила ИИ-модель Cotype Pro 2, которая станет основой ИИ-агентов для бизнесаКомпания MTS AI, дочерняя структура МТС, сообщила о выходе большой языковой модели (LLM) Cotype Pro 2 второго поколения, предназначенной для корпоративного сегмента. Новая модель значительно превосходит по целому ряду показателей предыдущую версию, адаптирована под выполнение более чем 100 сценариев использования компаниями в России и может быть запущена на собственной инфраструктуре предприятия без подключения к внешним серверам, чем обеспечивается защита от утечки данных. На основе Cotype Pro 2 компания подготовит в 2025–2026 гг. новую линейку ИИ-решений для семи отраслей: госсектора, банков, промышленности, ретейла, телекома, медицины и IT. Сначала будут созданы ИИ-помощники, затем — ИИ-агенты с большей автономностью, способные решать, как общие задачи (HR, клиентская поддержка, документооборот и другие), так и специфичные для каждой из этих отраслей. Cotype Pro 2 вошла в пятерку лучших русскоязычных LLM в бенчмарке MERA от Альянса в сфере ИИ. Она на 40 % быстрее предыдущей версии и на 50 % точнее обрабатывает длинные тексты — до 128 тыс. токенов, что соответствует примерно 900 тыс. символов с пробелами, сообщила компания. По сравнению с предшественником её эффективность в области генерации идей возросла с 44 до 57 %, точность в задаче извлечения информации выросла с 81 до 86 %, в части общения на общие темы зафиксировано улучшение с 55 до 64 %, благодаря чему обеспечивается более плавное и осмысленное взаимодействие. Также осталась на высоком уровне эффективность в классификации — 87 %, отмечены улучшения в суммаризации (с 79 до 85 %) и креативном письме (с 61 до 65 %). Для оценки эффективности сравнивалось количество ответов, схожих или превосходящих по качеству ответы модели GPT-4o. Как отметил директор по LLM-продуктам MTS AI, для ИИ-агентов важно не только работать с большим объёмом информации, но и давать ответы в структурированном виде, понятном другим системам. Чтобы оценить качество таких ответов компания разработала специальный бенчмарк, который включает задания с разным объёмом контекста и разной сложностью. В этом тесте Cotype Pro 2 справилась с 94 % задач, а GPT-4o — с 93 %. Также по данным бенчмарка длинного контекста LIBRA, качество работы Cotype Pro 2 в два раза выше, чем у Cotype Pro на задачах длиной 64 и 128 тыс. токенов (до 500 тыс. символов). В дополнение к выполнению базовых задач Cotype Pro 2 поддерживает «ролевой отыгрыш» — способность вести диалог от лица специалиста, адаптируя стиль общения под особенности профессии, что повышает качество взаимодействия в клиентской поддержке, обучении сотрудников и т.д. Перед анонсом Cotype Pro 2 прошла тестирование в реальных условиях. В течение трёх месяцев она автоматически сортировала обращения в поддержку банка, а для МТС Live создавала описания мероприятий. Также тестирование подтвердило возможность интеграции с инструментами RAG (Retrieval-Augmented Generation) для извлечения информации из баз знаний с генерацией текста, что будет востребовано, например, в чат-ботах, где нужно регулярно обновлять данные и в течение нескольких секунд предоставлять ответы на запросы. Как сообщили в MTS AI ресурсу Forbes, семейство корпоративных отраслевых ИИ-агентов, над которыми сейчас ведётся работа, будет, в частности, включать следующие решения:

Сообщается, что МТС также начала предоставлять консалтинговые услуги по внедрению ИИ-продуктов в эти сферы. Как ожидает компания, к 2027 году коммерциализация ИИ-агентов будет приносить её ИИ-направлению более половины выручки.

02.04.2025 [10:31], Сергей Карасёв

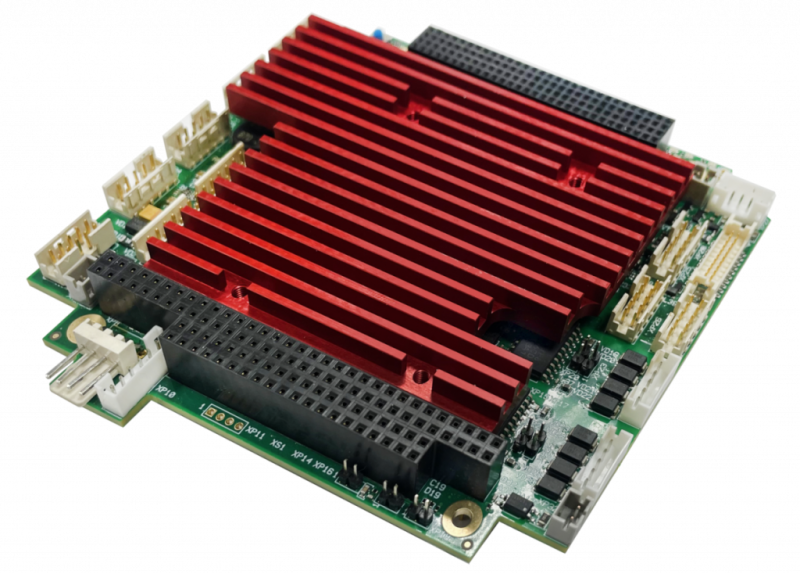

НПК «Атроник» выпустила одноплатный компьютер формата PC/104-Plus с чипом Vortex86 DX3Научно-производственная компания (НПК) «Атроник» представила встраиваемый одноплатный компьютер МЦП303 стандарта PC/104-Plus. Изделие, предназначенное для применения в промышленных системах управления, допускает эксплуатацию в широком температурном диапазоне, при высоких ударных и вибрационных нагрузках. Устройство выполнено на процессоре Vortex86DX3 с двумя ядрами, работающими на частоте 800 МГц. Объём памяти DDR3-533 SDRAM составляет 2 Гбайт, ёмкость встроенной флеш-памяти — до 64 Гбайт. Все эти компоненты напаяны на плате, что способствует повышению надёжности при работе в неблагоприятных условиях. Для вывода изображения могут быть задействованы интерфейсы D-Sub и LVDS (24 бит; до 1920 × 1440). Допускается подключение внешних устройств хранения данных через интерфейсы SATA и IDE (карта Compact Flash). Предусмотрены сетевые порты 1GbE и 100MbE, четыре последовательных порта, четыре порта USB 2.0 и восемь линий программируемого дискретного ввода-вывода, а также универсальный параллельный порт (LPT) с поддержкой режимов SPP/EPP и интерфейс PS/2 (клавиатура/мышь). Есть три сторожевых таймера (WDT): два внутренних с возможностью программного управления от 30,5 мкс до 512 с и внешний с фиксированным интервалом срабатывания 1,6 с. Габариты изделия составляют 115 × 102 × 24 мм, масса — 300 г. Диапазон рабочих температур простирается от -40 до +85 °C. Изделие выдерживает одиночные удары с пиковым ускорением до 150g. Среди прочего упомянуты часы реального времени, а также возможность сохранения настроек BIOS, установок системы и аварийных параметров в энергонезависимой памяти FRAM. Заявлена совместимость с программными платформами MS DOS, QNX, Windows, RTOS32 и Linux.

01.04.2025 [14:53], Владимир Мироненко

Arm намерена занять 50 % рынка чипов для ЦОД к концу 2025 года — NVIDIA ей в этом поможетСогласно прогнозу Arm Holdings, к концу 2025 года доля процессоров с Arm-архитектурой на мировом рынке CPU для ЦОД вырастет до 50 % с 15 % в 2024 году. В интервью агентству Reuters Мохамед Авад (Mohamed Awad), руководитель подразделения инфраструктурных решений Arm, отметил, что благодаря более низкому энергопотреблению, чем у процессоров Intel и AMD, Arm-чипы становятся все более популярными среди компаний, занимающихся облачными вычислениями. Журналист ресурса The Register обратился в Arm Holdings с просьбой пояснить, благодаря чему компания рассчитывает добиться столь стремительного роста доли на рынке. Как сообщили в британской компании, принадлежащей японскому конгломерату Softbank, её прогноз в значительной степени основан на росте поставок ИИ-серверов. Мохамед Авад сообщил The Register, что в течение следующих нескольких лет, как ожидает компания, продажи ИИ-серверов вырастут на 300 %. «Для этого увеличения энергоэффективность больше не является конкурентным преимуществом — это базовое отраслевое требование. Именно здесь вычислительная платформа Arm Neoverse является явным лидером и предпочтительной платформой для ведущих партнёров отрасли, включая AWS, Google, Microsoft и NVIDIA», — заявил он. Как утверждает Arm Holdings, Arm-архитектура всё чаще используется гиперскейлерами AWS, Google, Microsoft в своих чипах. По оценкам Bernstein Research, в 2023 году почти 10 % серверов по всему миру содержат Arm-процессоры приложений в качестве «основных мозгов», и половина из них была развёрнута Amazon, сообщившей, что у нее в облаке используется более 2 млн чипов Graviton собственной разработки. В свою очередь, Google объявила в 2024 году о выпуске собственного процессора Axion на базе Neoverse V2 для своих ЦОД, а Microsoft сообщила в конце прошлого года об общедоступности в облаке Azure инстансов с использованием процессоров собственной разработки Cobalt 100. Расширение использования этими провайдерами облачных услуг Arm-процессоров может объяснить часть роста, который Авад прогнозирует на этот год, но продукты NVIDIA также, вероятно, составят значительную долю, полагает The Register. Например, система DGX GB200 NVL72 включает 36 процессора NVIDIA Grace и 72 ускорителя Blackwell B200, что составляет 2592 ядра Arm Neoverse V2, и они, вероятно, будут востребованы в этом году, отметил ресурс. Также не следует забывать о других решениях для ЦОД, которые имеют ядра на базе Arm-архитектуры, такие как SmartNIC и DPU — BlueField-3 от NVIDIA, а также карты Nitro в серверах AWS.

01.04.2025 [14:07], Руслан Авдеев

Microsoft вновь заявила о намерении сотрудничать с OpenAI несмотря на пересмотр планов по развитию ЦОДMicrosoft отрицает слухи о том, что её решение отказаться от проектов ЦОД минимум на 2 ГВт и/или отложить их реализацию может означать сокращение сотрудничества с OpenAI. Компания объяснила своё решение совсем иными причинами, сообщает Computer Weekly. Ранее об отказе Microsoft от проектов новых ЦОД объявили в своём докладе аналитики TD Cowen. Указывалось, что речь идёт о проектах в США и Европе. Причиной изменений было названо решение Microsoft не поддерживать растущие нагрузки OpenAI по обучению новых ИИ-моделей. В TD Cowen заявляли, что отношения двух компаний постепенно сворачиваются после того, как в январе 2025 года Microsoft подтвердила отказ от эксклюзивного соглашения в части хостинга проектов OpenAI. В блоге Microsoft сообщалось, что OpenAI сохранила приверженность к реализации крупного проекта на базе Azure. При этом подчёркивалось, что «эксклюзивность» более не предусмотрена — у Microsoft просто сохранится «право первого отказа» при выборе облака ИИ-стартапом. Это означает, что Microsoft сможет первой решать, отказываться ли ей от нагрузок OpenAI. При этом последняя сохраняет право реализовать альтернативные проекты, если Microsoft не сможет удовлетворить запросы компании.

Источник изображения: Jose Vazquez/unsplash.com Теперь Microsoft выступила с заявлением, подтверждающим прочность связей с OpenAI и опровергающим гипотезы TD Cowen. Что касается решения компании сократить экспансию на рынке ЦОД, Microsoft заявила, что имеет «хорошие возможности» для удовлетворения текущего и растущего пользовательского спроса на свои сервисы благодаря «значительным инвестициям», уже сделанным в инфраструктуру на данный момент. В компании подчёркивают, что только в прошлом году она добавила своим ЦОД больше ёмкости, чем в любой предыдущий год в своей истории. Хотя некоторые оптимизации возможны в отдельных сферах, Microsoft продолжит «сильный рост во всех регионах». В частности, это позволит инвестировать и распределять ресурсы в зоны роста во имя будущего компании. В её планах — потратить более $80 млрд на инфраструктуру в текущем финансовом году. Microsoft выступает партнёром с OpenAI с 2019 года. Ранее компании заявляли, что работают над общей целью «ответственного развития ИИ-исследований», в то же время обеспечивая демократизацию соответствующих технологий, чтобы все могли ими воспользоваться. Впоследствии Microsoft опубликовала детали будущего сотрудничества с OpenAI. Последняя сообщила о намерении потратить $500 млрд в рамках проекта Stargate. Softbank, Oracle, MGX и OpenAI — инвесторы-акционеры инициативы, а Microsoft названа «технологическим партнёром». Говоря о сотрудничестве с OpenAI, представитель Microsoft заявляет, что компании останутся хорошими партнёрами и сохраняют приверженность к «продвижению ИИ-фронтира вперёд», делая передовые ИИ-модели доступными для клиентов и партнёров. Тем временем сама OpenAI становится всё более могущественной структурой. В ходе последнего раунда финансирования компания привлекла рекордные для отрасли $40 млрд и, возможно, до конца года выйдет на IPO для привлечения новых денег. |

|