Материалы по тегу: ии

|

10.07.2025 [17:30], Сергей Карасёв

Bloomberg: Китай строит в пустыне гигантский комплекс ИИ ЦОД для 115 тыс. ускорителей NVIDIA, поставки которых запрещены СШАНа окраине пустыни Гоби в Синьцзяне (автономный район на северо-западе Китая), по сообщению Bloomberg News, ведутся активные работы по строительству кампуса ЦОД для ИИ-задач. Согласно имеющейся информации, в этих дата-центрах будут применяться серверы с ускорителями NVIDIA, поставки которых запрещены в КНР в соответствии с американскими санкциями. Специалисты Bloomberg News проанализировали сведения, содержащиеся в инвестиционных одобрениях, тендерных документах и заявках китайских компаний. Утверждается, что масштабные планы Китая в отношении развития ИИ прямо предусматривают использование «запрещённых» продуктов NVIDIA, а не только местных решений вроде Huawei Ascend. В частности, в IV квартале 2024 года власти Синьцзяна (Xinjiang) и соседней провинции Цинхай (Qinghai) одобрили создание в общей сложности 39 дата-центров, в которых будет задействовано более 115 тыс. ИИ-ускорителей NVIDIA. Причём во всех случаях речь идёт об H100 и H200. Операторы ЦОД в Синьцзяне намерены разместить львиную долю этих ускорителей в одном крупном комплексе, который будет использоваться для обучения передовых ИИ-моделей и других ресурсоёмких нагрузок. Строительные работы организованы в уезде Иу (Yìwū). Сотрудникам Bloomberg News не удалось установить, каким способом китайские компании намерены приобретать изделия NVIDIA, закупки которых запрещены без получения специальных лицензий от правительства США. Местные операторы дата-центров, государственные чиновники и представители центрального правительства в Пекине отказались давать какие-либо комментарии по данному вопросу. Между тем, как отмечается в публикации, стоимость 115 тыс. указанных ИИ-ускорителей может составить миллиарды долларов, исходя из цен на чёрном рынке Китая. И всё же строительство комплекса ЦОД продолжается. Синьцзян, и особенно регион Хами (Hāmì), включающий уезд Иу, богаты ветровой и солнечной энергией, а также углём. Это позволит решить вопросы, связанные с энергообеспечением дата-центров. Дополнительными достоинствами выбранного региона являются доступность больших территорий, низкая стоимость земли и прохладный климат в высотных районах. Согласно тендерной документации, полученной Bloomberg, по состоянию на июнь 2025 года по семи проектам ЦОД в Синьцзяне либо начаты строительные работы, либо выиграны тендеры на услуги ИИ-вычислений. В частности, один из крупнейших проектов связан с энергокомпанией Nyocor из Тяньцзиня (Tianjin), которая специализируется на солнечной и ветровой энергетике. Инициатива предусматривает создание дата-центра на базе 625 серверов с ускорителями H100. Nyocor продаёт вычислительные мощности корпорации Infinigence AI — одной из крупнейших организаций в сфере ИИ-инфраструктуры в Китае. В документах по 27 другим проектам ЦОД, одобренным в Синьцзяне и Цинхае в прошлом году, упоминаются в общей сложности более 9 тыс. серверов и около 72 тыс. ускорителей H100/H200. Два высокопоставленных чиновника американской администрации заявили, что по их оценкам, в Китае имеется примерно 25 тыс. запрещенных ИИ-ускорителей NVIDIA: такое количество, как утверждается, не вызывает серьёзного беспокойства. Более того, даже в случае приобретения ещё 115 тыс. карт NVIDIA масштабы соответствующих ИИ-платформ в КНР окажутся несопоставимы с мощью развитой инфраструктурой ИИ в США. Нужно отметить, что за последние годы власти Китая потратили $6,1 млрд на строительство крупных кампусов ЦОД, тогда как ещё $28 млрд вложили частные инвесторы. Площадки дата-центров появились в регионе Внутренняя Монголия, провинциях Нинся, Ганьсу, Гуйчжоу, регионе Пекин-Тяньцзинь-Хэбэй, а также в дельте Янцзы и на других территориях. Однако многие подобные объекты оказались невостребованными из-за переоценённого спроса и архитектурных недоработок.

10.07.2025 [10:03], Руслан Авдеев

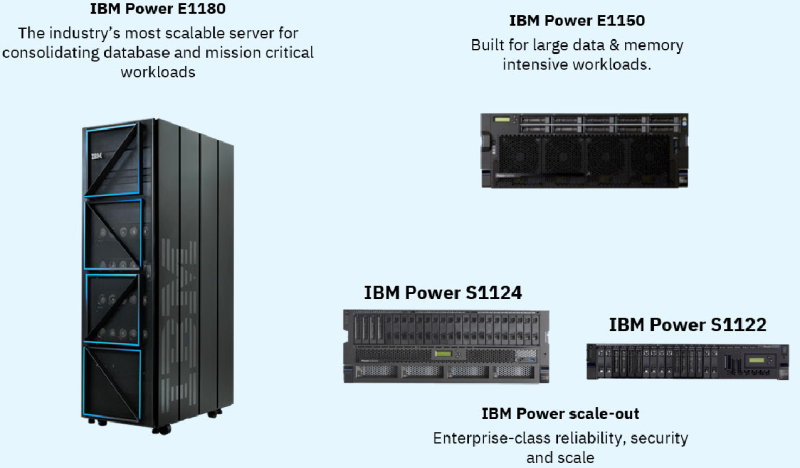

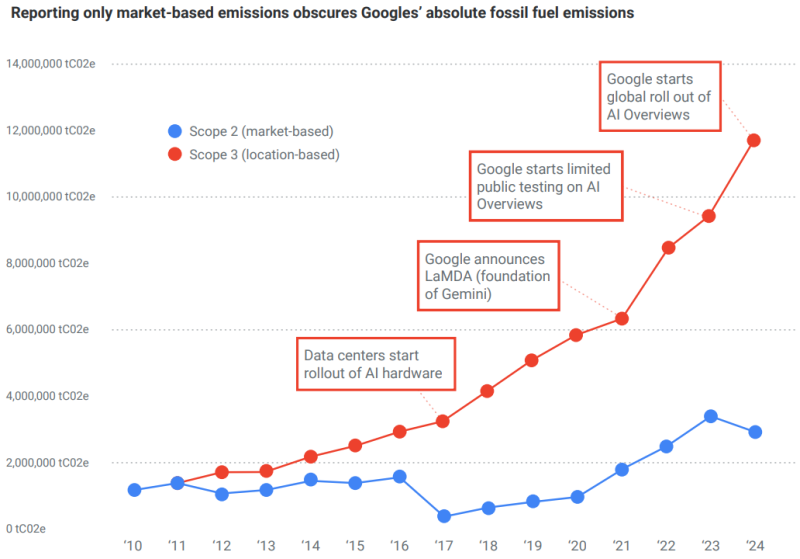

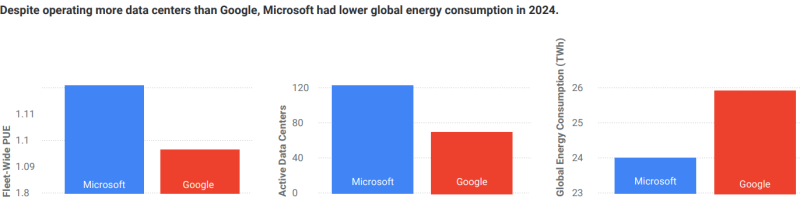

Углеродные выбросы Google выросли на 1515 % за 14 лет, но компания уверяет, что экоактивисты перевирают фактыGoogle негативно отреагировала на доклад НКО Kairos Fellowship, где говорится о «пробелах» в данных Google о сокращении углеродных выбросов. В Google утверждают, что анализ, проведённый НКО, «искажает факты» из ежегодных отчётов об экоустойчивости, сообщает Computer Weekly. В докладе Kairos Fellowship утверждается, что Google использует отчёты об экоустойчивости, чтобы ввести в заблуждение общество относительно прогресса в деле сокращения углеродных выбросов. Kairos Fellowship заявила, что 2,5 года работала над освещением вклада техногигантов в климатический кризис. Были тщательно проанализированы публичные отчёты Google, связанные с охраной окружающей среды, и проведены подробные расчёты и анализ представленных экологических данных. В результате НКО пришла к выводу, что данные о прогрессе Google в сокращении выбросов в 2024 календарном году не соответствуют истине. В отчёте Google говорится о сокращении выбросов ЦОД на 12 % несмотря на увеличение энергопотребления на 27 %. Также сообщается, что общие выбросы парниковых газов Scope 1, 2 и 3 выросли год к году на 6,2 %, они растут третий год подряд вместе с ростом бизнеса. Утверждается, что большая часть выбросов — косвенные, связанные с цепочкой поставок (Scope 3). При этом выбросы Scope 1 и 2 сократились на 8 % и 11 % соответственно год к году.

Источник изображения: Ella Ivanescu/unsplash.com Выбросы Scope 3 выросли на 22 %, во многом из-за роста мощностей ЦОД. Подчёркивается, что выбросы Scope 3 будут возникать в процессе производства и развёртывания ИИ-инфраструктуры, сопутствующей логистики, а также в процессе строительства самих дата-центров. Хотя в целом выбросы и увеличились, Google по-прежнему намерена достичь нулевых выбросов к 2030 году благодаря инвестициям в технологические решения, связанные с удалением углерода.

Источник: Kairos Fellowship Вместе с тем в отчёте признаётся, что отрасль ЦОД переживает переломный момент из-за быстрого внедрения ИИ и ситуация вносит значительную неопределённость, способную повлиять на будущие показатели. Одной из главных проблем является потенциальная возможность «нелинейного» роста ИИ из-за высоких темпов его развития и неизвестно, сколько для этого потребуется энергии и инфраструктуры, что затрудняет возможность прогнозирования. В Kairos Fellowship утверждают, что выбросы парниковых газов Google росли не три года, а почти 15 лет. В НКО уверены, что Google вводит общественность в заблуждение относительно сокращения выбросов. Так, расследование показало, что с 2010 по 2024 гг. они выросли на 1515 %. Другими словами, в 2024 году Google выбросила на 21,9 млн т больше, чем 14 лет назад. Снижение выбросов, связанных с энергопотреблением, рассчитывается по «рыночному» методу, который учитывает покупку «зелёной» энергии (включая экологические сертификаты), но не отражает физические выбросы от работы дата-центров.

Источник: Kairos Fellowship В том, что ИИ виновен в росте выбросов, выводы Google и Kairos Fellowship совпадают. В НКО заявили, что агрессивные инвестиции в генеративный ИИ и сопутствующую инфраструктуру — один из главных факторов, влияющих на климатические проблемы. Выбросы Scope 2, связанные с энергией, покупаемой Google для своих ЦОД, выросли с 2010 года на 820 %. Более того, с 2019 года Google сумела фактически сократить только выбросы Scope 1, составляющие лишь 0,31 % от общего объёма выбросов в 2025 году. Главная проблема, по мнению Kairos Fellowship, в том, что Google представляется добросовестным игроком, в то же время скрывая рост выбросов углерода и прочие подробности вроде объёмов использования питьевой воды, играя терминологией и т.п. Данные скрываются или маскируются, поэтому часто остаются незамеченными.

Источник: Kairos Fellowship Google заявила, что факты искажает сама Kairos Fellowship. Выбросы компании, как утверждается, подсчитываются в соответствии с распространённым Протоколом по парниковым газам (Greenhouse Gas Protocol) и подтверждаются независимыми экспертами. В частности, амбиции положительно оценила ведущая отраслевая организация Science Based Targets. Выбросы не просто сократились на 12 % — в этом году запущено более 25 проектов в области чистой энергетики. Правда, в прошлом году компания сама призналась, что из-за ИИ за пять лет выбросы парниковых газов выросли на 48 %.

10.07.2025 [08:01], Андрей Крупин

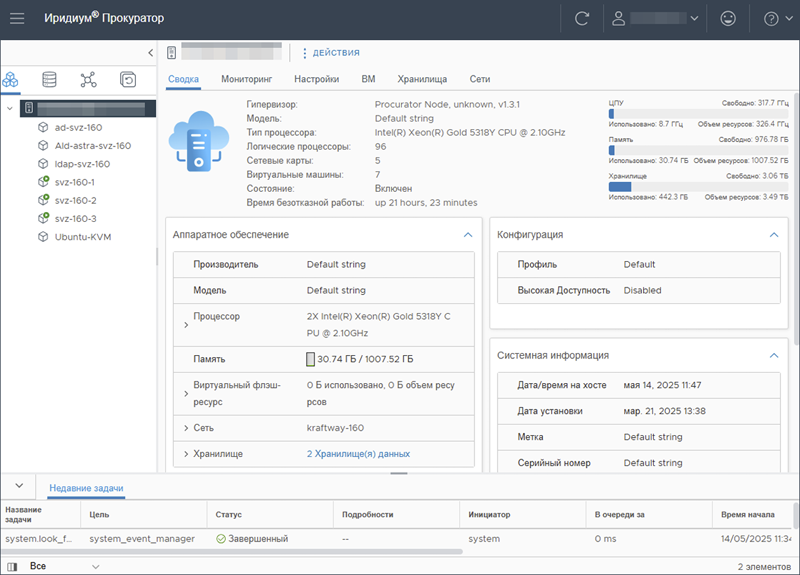

Релиз российской системы виртуализации «Иридиум» 2.0: поддержка VDI, резервное копирование ВМ, HA-кластеризация и многое другоеРоссийский разработчик «РТ-Иридиум» представил обновлённую версию системы виртуализации «Иридиум» 2.0. Презентация нового поколения продукта состоялась на полях международной промышленной выставки «Иннопром-2025». В основу программного комплекса «Иридиум» положены компоненты сообщества open source и собственные наработки «РТ-Иридиум». Продукт ведёт историю с 2009 года, зарегистрирован в реестре отечественного ПО, поддерживает работу с гипервизорами первого типа на базе KVM/Qemu, контейнерами Docker и является альтернативой VMware vSphere со схожим пользовательским интерфейсом. Платформа позволяет объединять физические серверы в кластер до 64 узлов, допускает использование в виртуальных машинах (ВМ) до 140 vCPU, поддерживает открытый стандарт Open Virtualization Format, технологию тонких томов LVM Thin Provision, кроссдоменную авторизацию и прочие функции, в полной мере отвечающие требованиям современных систем виртуализации, говорит компания. Для заказчиков, которые имеют в своём составе объекты КИИ, разработчиком может быть осуществлена поставка сертифицированной ФСТЭК версии «Иридиум».

Интерфейс платформы «Иридиум» (источник изображения: iridium-soft.com) Новое поколение платформы виртуализации «Иридиум» получило множество доработок. В частности, сообщается о реализации в продукте HA-кластеризации, полноценной системы разграничения прав доступа, средств резервного копирования и клонирования виртуальных машин, горячей и холодной миграции ВМ и др. Отдельный акцент делается на включении в состав программного комплекса системы управления виртуальными рабочими местами «VDI-Иридиум», поддерживающей работу с CPU, GPU, vGPU, прямой проброс в виртуальную среду видеокарт AMD и Nvidia, совместимость с Cloud Gaming и прочими технологиями. «В «VDI-Иридиум» входит разработанный нами протокол доставки рабочего стола, являющийся нашей гордостью. Это не адаптация существующих протоколов, а авторская реализация, созданная нашей командой. В традиционном подходе развёртывание рабочей станции требует три и более часов: установка ОС, настройка окружения, драйверов и прикладного софта. С использованием «VDI-Иридиум» этот процесс сокращается до 10–15 минут — благодаря механизму клонирования “золотого” образа ВМ, уже содержащего всё необходимое ПО. Пользователь получает готовое функциональное рабочее место в считаные минуты — без проблем совместимости и производительности», — говорит главный конструктор «РТ-Иридиум».

09.07.2025 [16:44], Руслан Авдеев

Mistral AI хочет привлечь $1 млрд для конкуренции с OpenAIФранцузский ИИ-стартап Mistral AI ведёт переговоры с базирующимся в Абу-Даби (ОАЭ) фондом MGX и другими структурами о привлечении до $1 млрд акционерного капитала, сообщает Bloomberg со ссылкой на осведомлённые источники. По информации источников, кроме акционерного финансирования Mistral пытается привлечь сотни миллионов евро в кредит — переговоры ведутся с французскими компаниями, включая Bpifrance SACA. На данный момент Bpifrance уже является инвестором Mistral AI. Пока переговоры носят предварительный характер и условия возможной сделки могут быть изменены. Нет точных данных, какой станет капитализация компании после привлечения инвестиций. В самих Mistral, MGX и Bpifrance информацию пока не комментируют. Предполагается, что сделка укрепит связи Франции и ОАЭ в сфере ИИ, где в последнее время всё отчётливее доминируют США и Китай. Mistral — крупнейший в Европе ИИ-стартап, с момента основания в 2023 году привлёкший более €1 млрд ($1,17 млрд). Его капитализация составила $5,8 млрд после прошлогоднего раунда финансирования. Впрочем, компания не успевает угнаться за конкурентами вроде американской OpenAI, поэтому старается переориентироваться на индивидуальные сервисы. Тем не менее, она сохраняет ключевую роль в планах Франции добиться суверенитета в сфере ИИ. Mistral, MGX и NVIDIA уже объединили усилия для строительства крупнейшего в Европе кампуса ИИ ЦОД, а власти ОАЭ обещали выделить €50 млрд на ИИ-проекты в стране.

Источник изображения: Rodrigo Kugnharski/unsplash.com Французские официальные лица заявили, что MGX предоставит первоначальный капитал для инвестиций ОАЭ. Этот фонд является активным инвестором в ИИ и уже поддерживал OpenAI и xAI. Также это участник проекта Stargate, курируемого OpenAI и другого мегафонда для ЦОД, в который входят NVIDIA и Microsoft. Ранее в этом году руководство Mistral заявило, что компания потратит несколько миллиардов евро на вычислительные мощности. В том числе предусмотрено строительство ЦОД, оснащённого новейшими чипами, близ Парижа. В июне 2025 года NVIDIA объявила о намерении содействовать развитию ИИ-облака Mistral Compute во Франции с использованием 18 тыс. новых ускорителей Grace Blackwell. По данным источников, знакомых с планами Mistral, заёмные средства, о которых компания ведёт переговоры, будут истрачены на Mistral Compute. Инвесторами Mistral уже являются Microsoft и американские венчурные фонды Lightspeed Venture Partners, General Catalyst и Andreessen Horowitz.

09.07.2025 [16:30], Руслан Авдеев

SambaManaged превратит почти любой ЦОД в ИИ ЦОД всего за три месяцаРазработчик ИИ-ускорителей SambaNova анонсировал решение SambaManaged на базе SN40L. Это первый в отрасли продукт, оптимизированный для инференса, внедрить который можно всего за 90 дней — намного быстрее, чем обычно требуется для систем такого уровня (18–24 мес.), говорит компания. Модульная платформа разработана специально для быстрого развёртывания и позволяет существующим дата-центрам почти немедленно организовать ИИ-инференс с минимальными модификациями инфраструктуры. По мере того, как стремительно растёт спрос на ИИ-задачи, связанные именно с инференсом, традиционные дата-центры сталкиваются с новыми проблемами — на внедрение систем, оптимизированных для таких задач, требуется от полутора до двух лет, много энергии, а также дорогостоящие обновления оборудования. Решение SambaManaged позволяет устранить эти барьеры, быстро развернув прибыльные инференс-сервисы, используя уже имеющуюся силовую и сетевую инфраструктуру. SambaManged формируется из стоек SambaRack SN40L-16, каждая из которых включает 16 ускорителей (RDU в терминологии SambaNova) SN40L с BF16-производительностью 10,2 Тфлопс. Платформа оснащена двумя 64-ядерными хост-процессорами, 2 Тбайт DDR4, четырьмя загрузочными 960-Гбайт SSD (RAID1 + два hot-spare) и шестью 7,6-Тбайт NVMe SSD в RAID10 для данных. Энергопотребление составляет всего 7–14,5 кВт (типовое 10 кВт). Стойка весит 485 кг. Рабочая температура — от +15 до +30 °C. Фактически это переименованная платформа DataScale SN40L, только теперь разработчик не говорит о возможности обучения моделей. Как подчёркивают в SambaNova, дата-центры сталкиваются с проблемами энергоснабжения и охлаждения, недостатком компетенций и др. на фоне роста спроса на ИИ. Система SambaManaged обеспечивает высокую ИИ-производительность при низком энергопотреблении и минимальных изменениях инфраструктуры. Преимуществами для ЦОД и облачных провайдеров называются рекордная производительность на каждый затраченный Вт, позволяющая снизить совокупную стоимость владения (TCO) и быстрее вернуть инвестиции. Систему можно внедрить всего за 90 дней. При этом обеспечивается невероятно быстрый инференс с ведущими open source моделями, что позволяет избежать привязки к конкретному вендору и гарантирует совместимость с будущими технологиями. Модульный дизайн позволяет быстро строить даже большие инференс-системы, включая т.н. Token Factory мощностью до 1 МВт (100 стоек). Систему можно масштабировать по мере изменения бизнес-потребностей. Можно выбрать полностью управляемое решение или взять на себя часть контроля за операциями. SambaManaged уже внедряется крупной публичной компанией в США, потребляющей немало энергии. Платформа обеспечивает максимальную пропускную способность для моделей вроде DeepSeek и ей подобных, помогая клиентам увеличивать доход от инференса и оптимизировать энергоэффективность (PUE). В SambaNova заявляют, что SambaManaged меняет правила игры для организаций, желающих ускорить реализацию ИИ-проектов без ущерба скорости, масштабу или эффективности. Везде, где есть доступ к Сети и электроэнергии, можно обеспечить необходимую инфраструктуру в рекордные сроки. В конце июня 2025 года сообщалось, что SambaNova делает ставку на инференс и партнёрство с облачными провайдерами и госзаказчиками из США. Groq, ещё один поставщик решений для инференса, первым сменил бизнес-подход, отказавшись от продажи ускорителей в пользу формирования целых ИИ ЦОД. Cerebras совместно с партнёрами также создаёт крупные ИИ-суперкомпьютеры и кластеры.

09.07.2025 [14:35], Владимир Мироненко

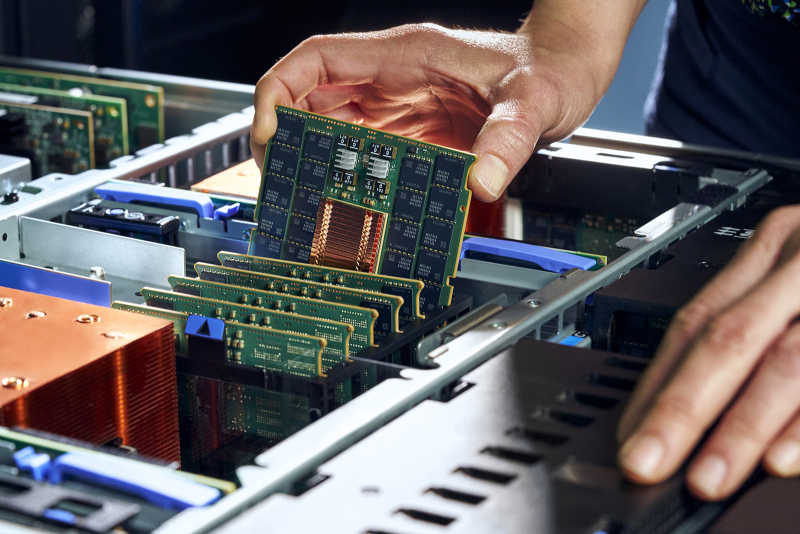

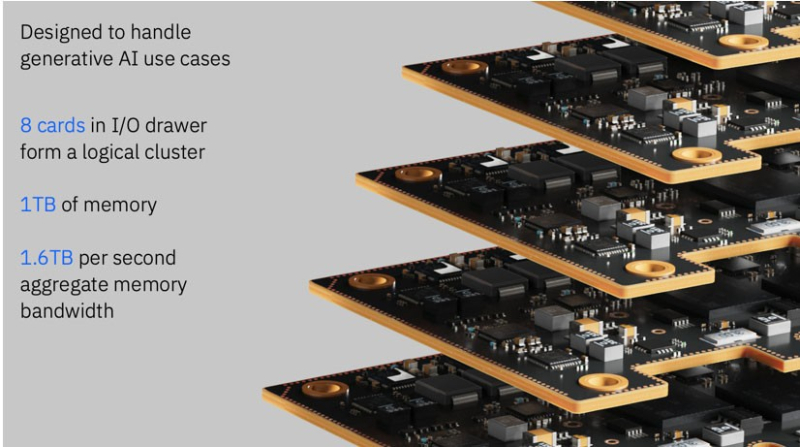

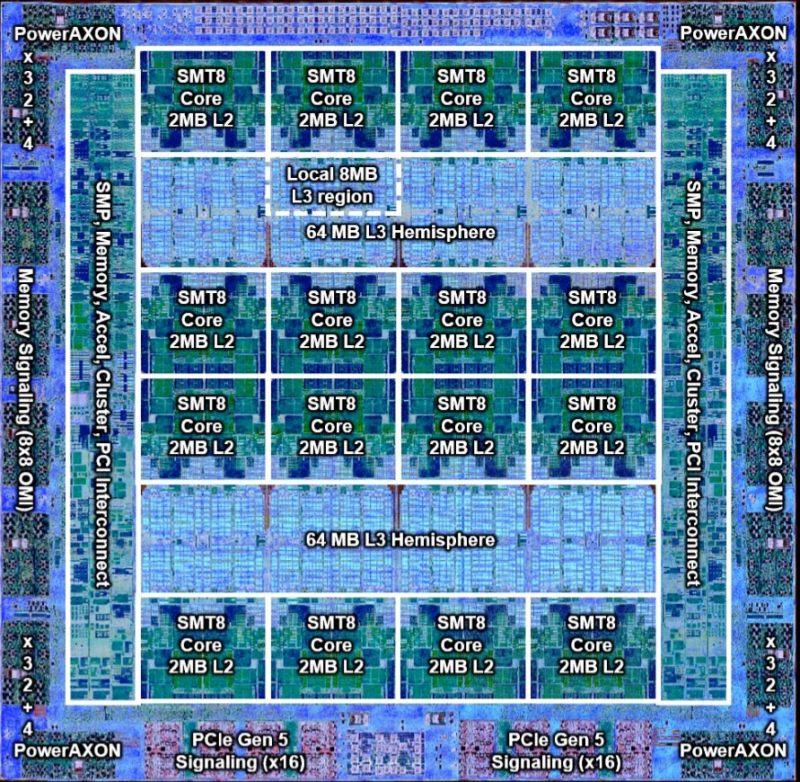

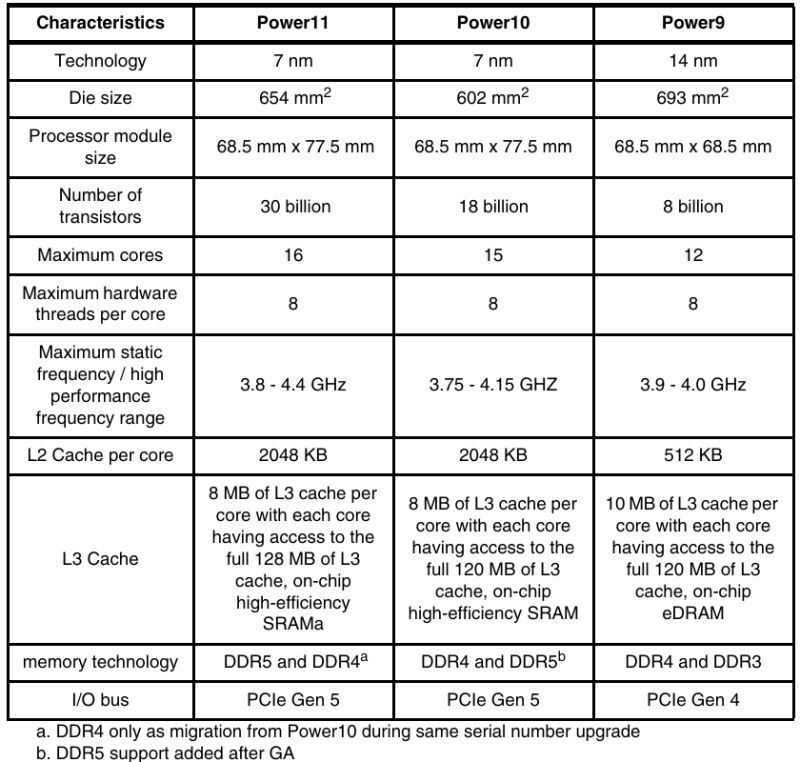

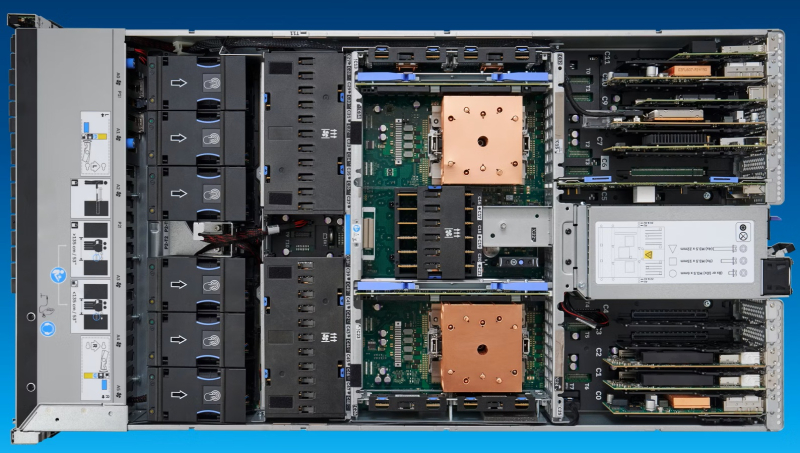

256 ядер, 2048 потоков и 64 Тбайт DDR5: IBM анонсировала «бесперебойные» серверы POWER11IBM представила серверы POWER11, получившие усовершенствованные процессоры, аппаратную архитектуру и программный стек виртуализации. Как заявила компания, POWER11 разработаны для обеспечения доступности, отказоустойчивости, производительности и масштабируемости, которые требуются предприятиям для бесшовного гибридного развёртывания on-premise или в облаке IBM Cloud. POWER11 представляет собой самый отказоустойчивый сервер в истории платформы IBM POWER с доступностью на уровне 99,9999 %, заявляет компания. Вместе с нулевым запланированным простоем для обслуживания системы и менее чем одной минутой гарантированного обнаружения угроз программ-вымогателей с помощью IBM POWER Cyber Vault, POWER11 устанавливает новую планку непрерывности ведения бизнеса, говорит IBM. Впервые общедоступная версия POWER11 будет одновременно включать высокопроизводительные серверы, модели среднего и начального уровня, а также решение IBM POWER Virtual Server (POWERVS) в IBM Cloud, обеспечивающее быстрый доступ в облако для рабочих нагрузок POWER и сертифицированное как гипермасштабируемая платформа для пакета RISE with SAP. POWER11 также является первым сервером семейства IBM POWER, поддерживающим 32-ядерные 5-нм ИИ-ускорители IBM Spyre Accelerator, которые будут доступны в IV квартале 2025 года. Они же используются в семействе мейнфреймов IBM z17. Процессор POWER11 изготавливается по 7-нм техпроцессу Samsung с использованием 18 слоёв металла и 2.5D-упаковки. Чип состоит из 30 млрд транзисторов, площадь кристалла, как и у предшественника, составляет 602 мм2. Процессор имеет 16 вычислительных ядер с поддержкой SMT8 15. Каждое ядро получило четыре блока MMA (Matrix Math Accelerator) для задач инференса. Как отмечает IT Jungle, в отличие от POWER10, 16-е ядро теперь является запасным, и может быть активировано в случае нештатной ситуации. Объём кеша L2 составляет 2 Мбайт на ядро, объём кеша L3 — 8 Мбайт на ядро, но суммарный объём L3 — до 120 Мбайт. Интерфейс POWERAXON/OMI обеспечивает пропускную способность до 2 Тбайт/с (32 ГТ/с). Возможна установка до 64 Тбайт DDR5 в модулях DDIMM, но в некоторых случаях осталась поддержка DDR4. Доступны 64 линии PCIe 5.0 и SMP-соединение для объединения до 16 сокетов. Для расширения доступны дисковые полки (24 × NVMe) и шасси с PCIe-слотами. Для обеспечения гибкости и масштабируемости POWER11 использует разные способы упаковки. Для высокопроизводительного сервера POWER E1180 задействован одночиповый вариант Single Chip Module (SCM), который обеспечивает один чип на сокет и до шестнадцати сокетов на систему. Для сервера среднего уровня POWER E1150 использовалась упаковка с двумя чипами на сокет Dual Chip Module (DCM) с поддержкой до четырёх сокетов на систему. Версия DCM также используется в линейке масштабируемых серверов POWER S1122/L1122 и POWER S1124/L1124 с двумя сокетами на систему. Также есть третий вариант упаковки — Single Core Module (eSCM), который используется для систем начального уровня POWER S1122 (4 или 10 ядер). POWER11 обеспечивает до 55 % более высокую производительность ядер по сравнению с POWER9 и до 45 % большую ёмкость с большим количеством ядер в системах начального и среднего уровня по сравнению с POWER10. Благодаря этому с POWER11 предприятия получат повышенную гибкость и безопасность, что повысит эффективность корпоративных процессов за счёт автоматизации, говорит IBM. Нулевой запланированный простой для обслуживания системы. POWER11 позволяет избежать дорогостоящего запланированного простоя и помочь снизить операционный риск. Благодаря использованию таких технологий, как автономное исправление и автоматизированное перемещение нагрузок, запланированные события по обслуживанию системы могут происходить без остановки критически важных приложений. Кроме того, IBM POWER будет взаимодействовать с IBM Concert, используя генеративный ИИ, чтобы помочь выявить операционные риски и автоматизировать их исправление, в том числе в области безопасности. Обнаружение угроз программ-вымогателей менее чем за минуту достигается с помощью IBM POWER Cyber Vault, интегрированного решения по обеспечению киберустойчивости, которое соответствует стандартам NIST. Cyber Vault умеет идентифицировать и автоматически реагировать на киберугрозы, защищая от кибератак, таких как повреждение данных и шифрование, с помощью проактивных неизменяемых снимков, которые автоматически создаются, сохраняются и тестируются по заданному пользователем расписанию. POWER 11 также использует одобренную NIST встроенную квантово-безопасную криптографию, предназначенную для защиты систем от атак с отложенной расшифровкой (HNDL) и атак на целостность встроенного ПО. IBM также отметила, что POWER11 обеспечивает значительный рост эффективности во всём ИТ-стеке. С точки зрения энергоэффективности POWER11 предлагает вдвое большую производительность на Вт (SPECint2017_rate) по сравнению с сопоставимыми x86-серверами — до двух раз в случае Intel Xeon Emerald Rapids. Кроме того, теперь разница в энергопотреблении между режимами максимальной производительности и режимом энергосбережения достигает 28 %, при этом пропускная способность падает всего на 6 %. Как утверждает ресурс StorageReview.com, этот режим будет полезен для сред разработки и тестирования с интенсивной загрузкой CPU. Вариант с прямым жидкостным охлаждением поддерживает 75 кВт на стойку (64 сокета в 42U), по сравнению с примерно 28 кВт для аналогичных x86-систем с воздушным охлаждением. Ожидается, что серверы IBM POWER11 — POWER E1180 (до 256 ядер, до 64 Тбайт DDR5), POWER E1150 (до 120 ядер, до 16 Тбайт DDR5), POWER S1124 (до 60 ядер, до 8 Тбайт DDR5) и POWER S1122 (до 60 ядер, до 4 Тбайт DDR5) поступят в продажу 25 июля.

08.07.2025 [17:41], Андрей Крупин

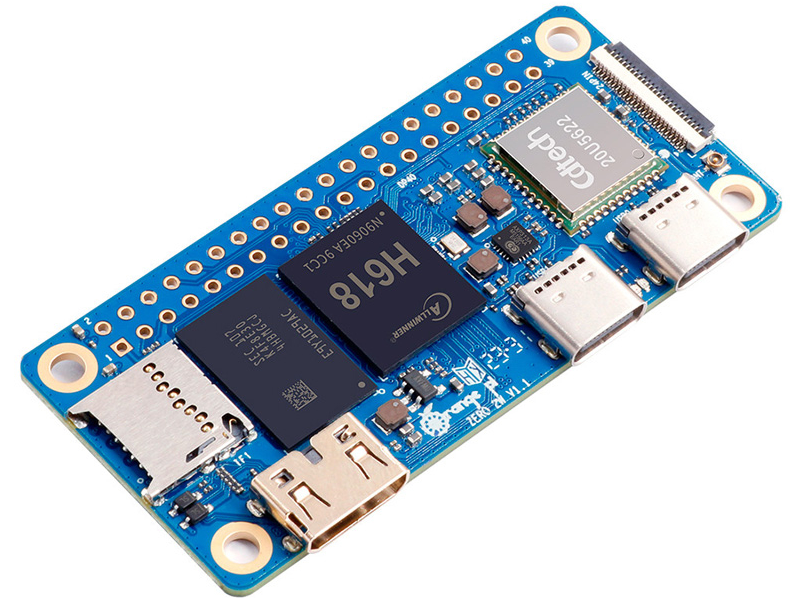

Российская «Ред ОС» 8 портирована на одноплатный компьютер Orange Pi Zero 2WКомпания «Ред Софт» сообщила об успешном завершении тестирования операционной системы «Ред ОС» 8 на одноплатном компьютере Orange Pi Zero 2W. Соответствующая сборка программной платформы и инструкции по её установке доступны для скачивания на сайте разработчика. Orange Pi Zero 2W был представлен командой Orange Pi в сентябре 2023 года. Устройство комплектуется процессором Allwinner H618 с квартетом ядер Arm Cortex-A53 и тактовой частотой 1,5 ГГц. Объём оперативной памяти стандарта LPDDR4 может составлять 1, 1,5, 2 или 4 Гбайт. Графический блок выполнен на контроллере Arm Mali-G31 MP2, также имеется VPU-узел. Предусмотрен разъём Micro HDMI 2.0 для вывода изображения. В оснащение компьютера входят адаптеры Wi-Fi 5 и Bluetooth 5.0, два порта USB 2.0 Type-C, слот для карты microSD, 40-контактная колодка GPIO, совместимая с Raspberry Pi (I2C, SPI, UART, PWM), а также 24-контактный интерфейсный разъём. Питание подаётся через один из портов USB 2.0 Type-C (5 В / 2 А). Габариты устройства составляют 65 × 30 × 1,2 мм.

Orange Pi Zero 2W (источник изображения: orangepi.org) По заверениям компании «Ред Софт», использование Orange Pi Zero 2W с «Ред ОС» 8 открывает широкие возможности для реализации разнообразных проектов, в том числе решений в сфере робототехники, умного дома, мультимедийных систем и многого другого.

08.07.2025 [17:09], Владимир Мироненко

Российский суперкомпьютер «Говорун» получил два узла «РСК Экзастрим ИИ» с NVIDIA H100 и фирменной СЖО

emerald rapids

h100

h200

hpc

intel

nvidia

sapphire rapids

xeon

россия

рск

сделано в россии

сервер

суперкомпьютер

ГК РСК продемонстрировала 2U-узел (912 × 508 × 88 мм) собственной разработки «РСК Экзастрим ИИ» на базе восьми ускорителей NVIDIA H100 с прямым жидкостным охлаждением. Два таких узла были установлены в суперкомпьютере «Говорун» в Дубне. «РСК Экзастрим ИИ» включает:

«РСК Экзастрим ИИ» имеет локальную подсистему хранения «тёплых данных», сетевую подсистему с доступом на основе технологии GPUDirect. Также есть возможность расширения ресурсов путём подключения дополнительных пар ускорителей или системы внешнего хранения данных на базе пула JBOF, подключаемой напрямую. Производительность «РСК Экзастрим ИИ» составляет до 208 Тфлопс (FP64). При установке 21 сервера в шкаф «РСК Экзастрим» пиковая производительность достигает 4,26 Пфлопс (FP64). Сервер отличается высокой энергоэффективностью, сверхвысокой плотностью монтажа и надёжной работой. Он может использоваться для решения ресурсоёмких задач в области машинного обучения и ИИ, создания мощных вычислительных ресурсов облачных провайдеров и в частных облаках и т.д.

Источник изображений: РСК Два узла «РСК Экзастрим ИИ» были установлены в суперкомпьютере «Говорун» в Лаборатории информационных технологий им М.Г. Мещерякова Объединенного института ядерных исследований (ЛИТ ОИЯИ) в Дубне в рамках нового этапа модернизации, проведенной силами специалистов ГК РСК и лаборатории. Как сообщается, новые серверы «РСК Экзастрим ИИ» уникальны и были сконструированы и изготовлены для СК «Говорун» с учётом его архитектурных особенностей. При этом пиковая FP64-производительность GPU-компоненты суперкомпьютера «Говорун» выросла на 36 % и достигла 1,4 Пфлопс, пиковая суммарная FP64-производительность суперкомпьютера теперь составляет 2,2 Пфлопс. Характеристики серверов «РСК Экзастрим ИИ», установленных в ОИЯИ:

В конце 2024 года было проведено расширение СХД суперкомпьютера «Говорун», после чего её ёмкость увеличилась до 10 Пбайт. В СХД вычислительного комплекса ОИЯИ были добавлены два узла хранения данных RSC Tornado AFS ёмкостью 1 Пбайт каждый. Обновленная модификация СХД RSC Tornado AFS включает серверную плату на базе процессоров Intel Xeon Sapphire Rapids, а также коммутатор с интерфейсом PCIe 4.0, что позволило установить по два адаптера интерконнекта с пропускной способностью 200 Гбит/с каждый.  СХД RSC Tornado AFS поддерживает технологию GPUDirect Storage (GDS), которая обеспечивает прямую передачу данных между локальным или удалённым хранилищем и памятью ускорителя. Две СХД, установленные ранее специалистами РСК в суперкомпьютере «Говорун» входят в мировой рейтинг IO500 самых высокопроизводительных системам хранения данных. В суперкомпьютере «Говорун» используются интегрированный программный комплекс «РСК БазИС 4» и модуль «РСК БазИС СХД» (включены в Реестр российского ПО). Микроагентная архитектура «РСК БазИС 4» обеспечивает функционирование объектов системы, позволяя также взаимодействовать с ними. «РСК БазИС» в сочетании с аппаратными платформами РСК позволяет создавать гиперконвергентные решения для HPC и эффективной обработки больших объёмов данных.

08.07.2025 [14:55], Руслан Авдеев

Groq запустила свой первый европейский ЦОД в ХельсинкиКомпания Groq, предлагающая сервисы ИИ-инференса, объявила о расширении своей сети дата-центров, открыв свой первый в Европе ЦОД в Хельсинки (Финляндия). Это поможет удовлетворить растущие потребности европейских клиентов, сообщает пресс-служба компании. Как заявил глава Groq Джонатан Росс (Jonathan Ross), спрос на ИИ-инференс растёт всё быстрее, а европейский дата-центр позволит местным клиентам получить минимальную задержку и готовую инфраструктуру для инференса уже сегодня. Кроме того, данные хранятся на территории Европы. Новый объект создан в Хельсинки на площадке Equinix. Партнёрство Equinix и Groq позволяет клиентам Equinix Fabric организовать инференс на платформе GroqCloud. Новые и действующие пользователи в США и EMEA получат доступ к мощностям для инференса через инфраструктуру Equinix Fabric — публичную, частную или суверенную. В Equinix подчеркнули, что Скандинавия — отличное место для ИИ-инфраструктуры. Благодаря политике поддержки экоустойчивой энергетики, возможности использования фрикулинга для охлаждения и надёжности электросети Финляндия стала приоритетным выбором для размещения новых мощностей. Европейские государственные и негосударственные структуры рассчитывают получить полный контроль над развёртываемой инфраструктурой, в местах, которые выбирают они сами — они пытаются сохранить баланс между потребностью в обеспечении суверенитета данных и защиты их конфиденциальности и обеспечением мобильности этих данных. Благодаря новому проекту клиенты могут получать доступ к GroqCloud через частные подключения. Экспансия в Европе расширяет мощности Groq на площадках Equinix и DataBank в США, Bell Canada в Канаде и HUMAIN в Саудовской Аравии. Они уже генерируют более 20 млн токенов в секунду по всей сети Groq. В некоторой степени это отражает спрос на ИИ-ускорители Groq LPU (Language Processing Unit). Чуть более года назад Groq объявила, что больше не продаёт свои ИИ-ускорители, предлагая вместо этого совместно создавать ЦОД и облачные сервисы. Как заявляют в Groq, компания обеспечивает самую низкую стоимость за токен без ущерба качеству, что делает масштабное использование ИИ экономически выгодным как для ИИ-стартапов, так и для крупных корпораций по всему миру.

08.07.2025 [14:33], Андрей Крупин

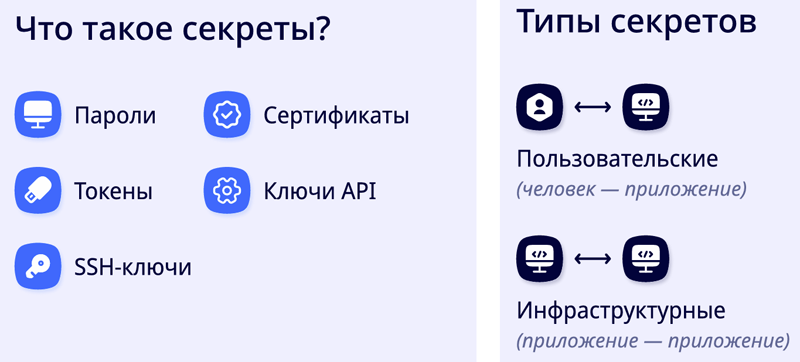

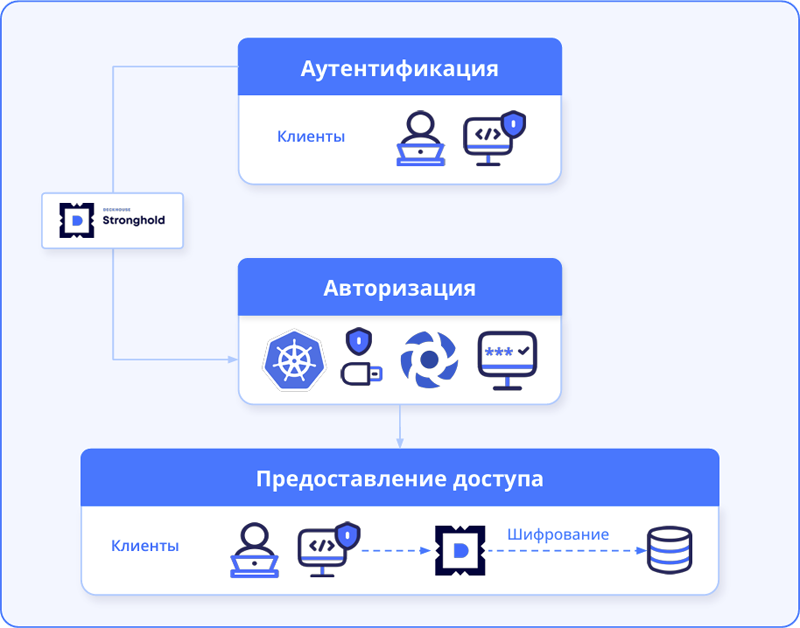

«Флант» выпустил бесплатную редакцию Deckhouse Stronghold для управления секретамиРоссийский разработчик инфраструктурного программного обеспечения «Флант» сообщил о выпуске Deckhouse Stronghold Community Edition — бесплатной версии решения для безопасного управления корпоративными секретами. Продукт зарегистрирован в реестре отечественного ПО и является полноценной альтернативой HashiCorp Vault Community Edition. Deckhouse Stronghold защищает пароли, ключи API, сертификаты, SSH-ключи, токены и другие конфиденциальные данные от утечек, а также обеспечивает безопасную доставку секретов в программные продукты. Решение обеспечивает защиту чувствительных данных при взаимодействии пользователей и приложений, что, в свою очередь, позволяет повысить уровень безопасности существующих бизнес-процессов организации, а также выполнить требования законодательства и различных стандартов по защите конфиденциальной информации в корпоративной среде.

Инфраструктурные секреты — ключевые компоненты безопасности информационных бизнес-систем и приложений (здесь и далее источник изображений: deckhouse.ru) Бесплатный вариант Deckhouse Stronghold предоставляет базовый набор функций для безопасного управления жизненным циклом секретов и решения задач, связанных с созданием, доставкой, хранением, отзывом и ротацией чувствительных данных. Поддерживаются популярные методы аутентификации (JWT, OIDC, Kubernetes, LDAP, Token) и Secret Engines (KV, Kubernetes, Database, SSH, PKI и др.). Решение работает с российскими операционными системами («Ред ОС», «РОСА Сервер», ALT Linux, Astra Linux Special Edition), может разворачиваться в закрытых контурах и интегрироваться с инструментами Infrastructure as Code, такими как Ansible и Terraform, что позволяет внедрять его в существующие DevOps-процессы. Также доступен веб-интерфейс.

Принцип работы Deckhouse Stronghold Функциональные возможности уровня Enterprise, такие как управление ролями (AppRole, OIDC/JWT Role) через веб-интерфейс, поддержка пространств имён, репликация данных, автоматическое создание резервных копий через API и аудит-логирование, доступны только в коммерческих редакциях продукта. Такой подход позволяет организациям начать работу с базовой функциональностью и масштабировать решение по мере роста потребностей. Deckhouse Stronghold Community Edition доступен исключительно в составе Deckhouse Kubernetes Platform как в бесплатной, так и в коммерческих редакциях. В дальнейшем разработчик планирует развивать функциональные возможности Deckhouse Stronghold Community Edition, а также открыть исходный код продукта. |

|