Материалы по тегу: i

|

06.05.2024 [10:00], Сергей Карасёв

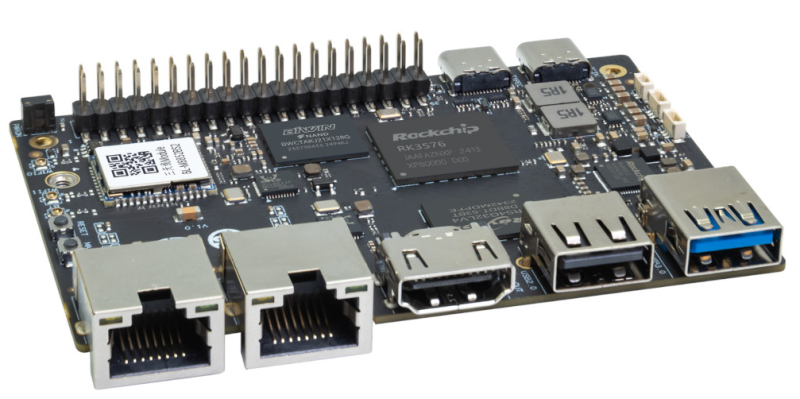

Низкопрофильный одноплатный компьютер Banana Pi BPI-M5 Pro для AIoT-устройств получил чип Rockchip RK3576В семействе одноплатных компьютеров Banana Pi, по сообщению ресурса CNX Software, появилась низкопрофильная модель BPI-M5 Pro, предназначенная прежде всего для построения интеллектуальных устройств Интернета вещей (AIoT). Говорится о совместимости с Android 14, Debian 11, Armbian Ubuntu и Debian. Новинка имеет размеры 92 × 62 мм. Используется процессор Rockchip RK3576, который содержит по четыре ядра Cortex-A72 (2,2 ГГц) и Cortex-A53 (1,8 ГГц), а также микроконтроллер Arm Cortex-M0. Есть GPU-блок Arm Mali-G52 MC3 с поддержкой OpenGL ES 1.1, 2.0 и 3.2, OpenCL 2.0 и Vulkan 1.1. Встроенный нейропроцессорный модуль облает ИИ-производительностью до 6 TOPS (INT8) и поддержкой INT4/INT8/INT16/BF16/TF32. Одноплатный компьютер может нести на борту 8 или 16 Гбайт оперативной памяти LPDDR4x. В дополнение к флеш-модулю eMMC вместимостью 32 или 128 Гбайт можно установить карту microSD и накопитель M.2 2280 NVMe SSD с интерфейсом PCIe 2.1 x1. В оснащение входят адаптеры Wi-Fi 6 и Bluetooth 5.2 на базе Realtek RTL8852BS, двухпортовый сетевой контроллер 1GbE с разъёмами RJ-45, по одному порту USB 3.0, USB 2.0 и USB Type-C, 40-контактная колодка GPIO и дополнительный коннектор USB Type-C для подачи питания (4,5–23 В). Имеются разъёмы для подключения вентилятора охлаждения и батареи. Для вывода изображения служат интерфейсы HDMI 2.0 (до 4Kp120), MIPI DSI (до 2Kp60) и DisplayPort 1.4 (через USB-C; до 4Kp120). Устройство может справляться с декодированием материалов H.264, H.265, VP9, AV1, AVS2 с разрешением 8K (до 30 к/с) или 4K (до 120 к/с), а также кодированием H.264 и H.265 с разрешением 4K (60 к/с). Доступны два коннектора камеры MIPI CSI. Диапазон рабочих температур простирается от 0 до +80 °C. Ориентировочная цена составляет $150 с 16 Гбайт RAM и eMMC на 128 Гбайт.

05.05.2024 [13:56], Сергей Карасёв

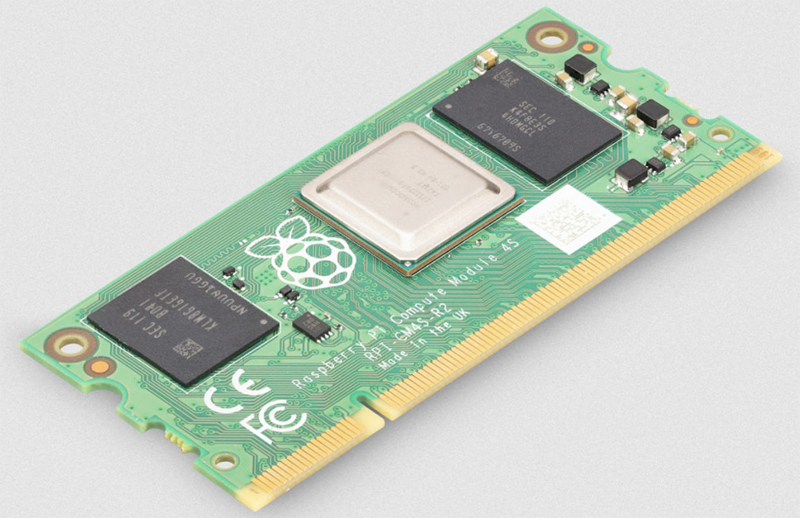

Власти США продали на аукционе 5,34-ПФлопс суперкомпьютер Cheyenne из-за растущего числа сбоев и протечек СЖОАдминистрация общих служб США (GSA) реализовала на аукционе НРС-систему под названием Cheyenne, которая была введена в строй в Центре суперкомпьютерных вычислений NCAR-Wyoming (NWSC) штата Вайоминг в 2016 году. Стоимость лота составила $480 085, тогда как затраты на строительство машины оцениваются как минимум в $25 млн. Cheyenne стал одним из последних суперкомпьютеров компании Silicon Graphics International (SGI). Корпорация HPE приобрела эту фирму после того, как Cheyenne был смонтирован, но до фактического запуска системы в эксплуатацию. На момент начала работы производительность комплекса составляла 5,34 Пфлопс, что соответствовало 20 месту в актуальном тогда списке ТОР500. Cheyenne представляет собой кластер SGI ICE XA с 4032 узлами, каждый из которых содержит два процессора Intel Xeon E5-2697v4 Broadwell (18C/36; 2,3 ГГц). Таким образом, суммарное количество ядер достигает 145 152. Применяется оперативная память DDR4-2400 ECC общей ёмкостью 313 Тбайт (4890 модулей на 64 Гбайт). В состав машины изначально входило хранилище данных вместимостью 40 Пбайт. Энергопотребление — приблизительно 1,7 МВт. Задействована система жидкостного охлаждения.

Источник изображения: GSA Две стойки управления с воздушным охлаждением состоят из 26 серверов типоразмера 1U (20 со 128 Гбайт ОЗУ и ещё 6 с 256 Гбайт ОЗУ), 10 коммутаторов и двух блоков питания. Суперкомпьютер эксплуатировался с 12 января 2017 года по 31 декабря 2023-го, решая задачи в области изменений климата и в других сферах, связанных с науками о Земле. Cheyenne превзошёл свой запланированный срок службы: в заявлении NWSC говорилось, что он будет эксплуатироваться до 2021 года. Однако к концу 2023-го количество сбоев и проблем стало слишком большим. В описании лота говорится, что «примерно 1 % узлов столкнулись с отказами за последние шесть месяцев», в основном из-за модулей памяти. Кроме того, система испытывает ограничения по техническому обслуживанию из-за неисправных быстроразъёмных соединений, вызывающих протечки воды. Таким образом, «учитывая затраты и время простоя, связанные с устранением проблем», дальнейшее использование комплекса признано нецелесообразным, в связи с чем он пущен с молотка. Вместе с тем, как отмечает Tom's Hardware, новый владелец суперкомпьютера может реализовать его основные компоненты на вторичном рынке. Например, стоимость чипов Xeon E5-2697 v4 на eBay составляет около $50, а модулей DDR4-2400 ECC ёмкостью 64 Гбайт — примерно $65. То есть, по самым скромным подсчётам, только эти компоненты могут принести новому владельцу суперкомпьютера приблизительно $700 тыс. без учёта затрат на демонтаж и вывоз машины массой 43 т, а также на тестирование компонентов. Впрочем, массовый выброс на рынок CPU и RAM в таких объёмах приведёт к снижению цен.

04.05.2024 [17:55], Владимир Мироненко

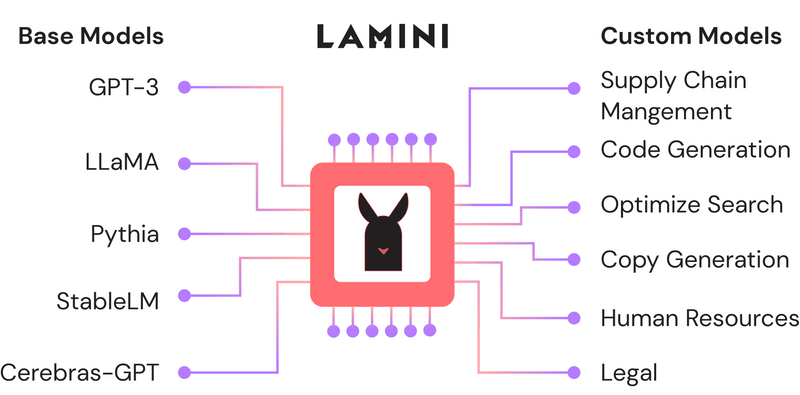

PowerML привлекла $25 млн на развитие ИИ-платформы Lamini, в том числе от AMD и Louis VuittonСтартап PowerML Inc., разработчик платформы Lamini для обучения и развёртывания ИИ-моделей, сообщил о привлечении $25 млн в ходе двух раундов финансирования. В раундах приняли участие компании Amplify Partners, возглавившая раунд Series A, First Round Capital, возглавившая Seed-раунд, AMD Ventures, пионер ИИ Эндрю Ын (Andrew Ng), соучредитель OpenAI Андрей Карпати (Andrej Karpathy), руководители Dropbox Inc., Figma Inc. и LVMH, материнской компании Louis Vuitton. Разработанная PowerML программная платформа предназначена для обучения и запуска больших языковых моделей (LLM) на ускорителях AMD или NVIDIA как в облачных, так и в локальных средах. В последнем случае можно развернуть Lamini в изолированной инфраструктуре. Платформа была создана с расчётом на крупномасштабные ИИ-проекты, которым может потребоваться более 1000 ускорителей.

Источник изображений: Lamini Одной из наиболее сложных задач, связанных с обучением LLM, является настройка гиперпараметров. Lamini предоставляет готовые наборы гиперпараметров, устраняя необходимость всё настраивать с нуля. Вместе с тем остаётся возможность определения пользовательских настроек LLM. Платформа также может использоваться для точной настройки уже обученных моделей ИИ под конкретную задачу. Lamini использует подход PEFT, который позволяет значительно сократить количество изменений параметров, а также снизить стоимость адаптации LLM к выполнению новых задач. Вместе с тем Lamini поддерживает методику RAG (Retrieval Augmented Generation), которая позволяет дообучать модель на собственных данных без изменения кода. Заодно Lamini предоставляет панель мониторинга, которая позволяет разработчикам сравнивать корректность точной настройки своих ИИ-моделей с исходной версией.  PowerML также упрощает развёртывание готовых ИИ-моделей, предоставляя различные настройки инференса и позволяя управлять стилем генерации, форматом выводимых данных и т.д. Компания утверждает, что её платформа в инференс-задачах более экономична по сравнению с проприетарными LLM-платформами, такими как Claude 3. Полученные инвестиции PowerML планирует использовать для найма большего количества сотрудников и расширения своей инфраструктуры ИИ, в частности, за счёт ускорителей большего количества ускорителей AMD, поскольку стартап делает ставку на решения AMD: ускорители Instinct и стек ROCm. Компания также планирует разработать «более глубокую техническую оптимизацию» для рабочих нагрузок машинного обучения.

25.04.2024 [17:13], Сергей Карасёв

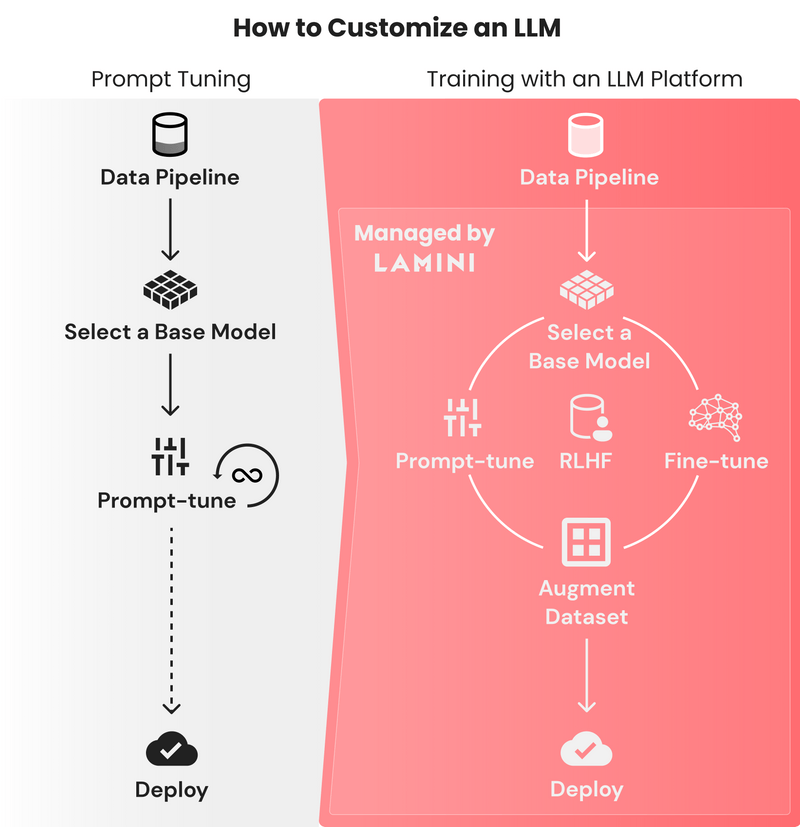

Вычислительный модуль Raspberry Pi Compute Module 4S получил до 8 Гбайт ОЗУКомпания Raspberry Pi анонсировала три новые модификации вычислительного модуля Compute Module 4S (CM4S), который впервые появился на рынке в 2022 году. Изделие может использоваться для создания всевозможных встраиваемых устройств, промышленного оборудования, систем медицинского мониторинга и пр. Модуль выполнен на архитектуре Raspberry Pi 4 Model B. Основой CM4S служит чип Broadcom BCM2711, который объединяет четыре вычислительных ядра Arm Cortex-A72 (Arm v8) с тактовой частотой 1,5 ГГц, а также блок VideoCore VI с поддержкой OpenGL ES 3.0 и Vulkan 1.1. Возможно декодирование видеоматериалов в формате H.265 (до 4Kp60).

Источник изображения: Raspberry Pi Оригинальная модель CM4S была укомплектована всего 1 Гбайт оперативной памяти LPDDR4-3200 SDRAM с поддержкой ECC. Новые версии доступны с 2, 4 и 8 Гбайт ОЗУ. Вместимость флеш-чипа eMMC может составлять 8, 16 и 32 Гбайт. Модуль имеет размеры 67,6 × 31,0 мм и соответствует форм-фактору SO-DIMM. Говорится о поддержке следующих интерфейсов: HDMI 2.0 (до 4Kp60), MIPI DSI (2 линии и 4 линии), композитный ТВ-выход (PAL или NTSC), MIPI CSI (2 линии и 4 линии), USB 2.0, GPIO и SDIO 2.0 (только модификация CM4SLite без чипа eMMC). Производить вычислительные модули CM4S планируется как минимум до января 2034 года. Цена составляет от $25 при заказе партиями от 200 штук по программе Raspberry Pi Approved Resellers.

24.04.2024 [14:30], Сергей Карасёв

Aruba Networking представила точки доступа Wi-Fi 7 для IoTКомпания HPE анонсировала точки доступа Wi-Fi 7 семейства Aruba Networking 730 Series для корпоративного сектора. Новинки, как утверждается, оптимизированы для задач Интернета вещей (IoT). Решения позволяют не только собирать данные с подключенных устройств, но и отслеживать их местоположение. Дебютировали модели HPE Aruba Networking AP-734 с внешними антеннами и HPE Aruba Networking AP-735 с внутренними антеннами. Поддерживается работа 2×2 в трёх частотных диапазонах — 2,4, 5 и 6 ГГц с каналами 20/40, 160 и 320 МГц соответственно. Максимальная заявленная канальная скорость составляет соответственно 688 Мбит/с, 2,9 Гбит/с и 5,8 Гбит/с. При этом радиомодуль 2,4 ГГц можно переключить в режим 5 или 6 ГГц. Одновременно могут быть подключены до 512 клиентов. Говорится о совместимости со стандартами 802.11a//b/g/n/ac/ac/be. В оснащение входят два модуля Bluetooth Low Energy (BLE) и Zigbee (802.15.4), а также приёмник GNSS L1/L5 с поддержкой GPS, Galileo, ГЛОНАСС и BeiDou. Упомянута технология 802.11az для отслеживания местоположения в сетях Wi-Fi: точность находится в пределах 1 м. Кроме того, предусмотрен барометрический датчик: он позволяет определять, на каком этаже здания находится устройство. Точки доступа получили новую функцию энергосбережения, которая основана на алгоритмах ИИ. Осуществлять мониторинг и управление можно посредством Aruba Central — облачной платформы для взаимодействия с сетевым оборудованием. Среди прочего упомянуты два порта USB 2.0 и два разъёма RJ-45 с поддержкой 5GbE и PoE (802.3bt Class 5, 40 Вт). Диапазон рабочих температур простирается от 0 до +50 °C. Реализованы средства обеспечения безопасности WPA3, Enhanced Open и WPA2-MPSK. В продажу точки доступа Aruba Networking 730 Series поступят в июле нынешнего года.

23.04.2024 [13:19], Руслан Авдеев

Глава OpenAI инвестировал в Exowatt, которая поможет запитать ИИ ЦОД от солнечных модулей нового поколенияЗанимающаяся разработкой и выпуском солнечных элементов питания компания Exowatt получила финансирование от руководителя OpenAI Сэма Альтмана (Sam Altman), а также двух других инвесторов. The Register сообщает, что точных данных об объёмах инвестиций Альтмана нет, но вкладывает деньги не его компания, а он лично. Доля вложений Альтмана в Exowatt неизвестна, но есть данные, что двумя другими инвесторами выступили Andreessen Horowitz и Atomic. Общий объём инвестиций составляет $20 млн. В Exowatt рассчитывают генерировать экобезопасное электричество, стоимость которого со временем упадёт до $0,01/кВт·ч. Серьёзные проекты начнут реализовать уже в 2024 году. Exowatt разрабатывает солнечные панели, сохраняющие энергию в виде тепла, которое конвертируется в электричество. Интеграция довольно больших «тепловых аккумуляторов» с собственно солнечными линзами в одном блоке, как заявляют в компании, и является ключевым отличием от других решений. Утверждается, что новое солнечное решение для питания ИИ и дата-центров будущего обеспечит меньшую стоимость энергии, чем у электростанций на ископаемом топливе.

Источник изображения: Exowatt Высокие энергетические показатели чрезвычайно важны, когда речь идёт о дата-центрах, не говоря о ЦОД для ИИ-систем — дефицит электричества является серьёзной проблемой для гиперскейлеров вроде AWS, Microsoft или Google. Сам Альтман ещё в январе 2024 года говорил о проблемах с электроснабжением и подчёркивал, что для развития ИИ потребуется «прорыв» в энергетических технологиях. Считается, что причиной инвестиций Альтмана отчасти стала дружба с главой Atomic Джеком Абрахамом (Jack Abraham), хотя глава OpenAI не впервые вкладывает деньги в энергетические проекты. Например, он поддерживает «атомные» стартапы Helion и Oklo. Примечательно, что первым потенциальным клиентом Helion является Microsoft, имеющая тесные связи с OpenAI — компания намерена получить доступ к электричеству, полученному за счёт термоядерного синтеза, уже в 2028 году. Впрочем, в краткосрочной перспективе будут применяться более привычные источники электричества — солнечная и атомная энергии. Exowatt и другие экзотические энергетические компании всё ещё находятся на стадии стартапов. В то же время Amazon, например, использует традиционную АЭС для питания недавно купленного кампуса ЦОД.

22.04.2024 [09:09], Сергей Карасёв

От LTO к iSCSI: Atto представила мост XstreamCORE 8100TКомпания Atto представила устройство XstreamCORE 8100T — специализированный мост, позволяющий подключать ленточные накопители к сети 10GbE iSCSI. Таким образом, упрощается формирование систем для резервного копирования и восстановления информации. Новинка заключена в корпус с габаритами 30,5 × 103,5 × 240 мм и весит около 0,91 кг. К одному мосту могут быть подключены до четырёх приводов стандартов LTO-9, LTO-8 и LTO-7 с интерфейсом SAS-3 (порт mini-SAS HD). Для подключения к сети есть два порта 10GbE. При этом в составе IT-инфраструктуры можно задействовать несколько мостов. Анонсированы модификации устройства XCET-8100-TS0 и XCET-8100-TN0. Первая использует порты SFP+, вторая предлагает RJ-45/SFP. Заявленная установившаяся скорость передачи данных в обоих случаях достигает 2 Гбайт/с, а технология SpeedWrite оптимизирует использование доступной полосы пропускания. Предусмотрен выделенный порт управления 1GbE RJ-45. Диапазон рабочих температур — от +5 до +40 °C. Энергопотребление у модели XCET-8100-TS0, согласно техническим характеристикам, не превышает 25 Вт, у модификации XCET-8100-TN0 — 29 Вт. Стоят эти устройства $2895 и $3095 соответственно. Для управления служит веб-интерфейс; мосты могут использоваться в составе инфраструктур с любыми ОС. Разработчик говорит о простоте развёртывания.

16.04.2024 [15:17], Сергей Карасёв

Akamai запустила облако с ускорителями NVIDIA RTX для обработки видеоCDN-провайдер Akamai Technologies объявил о запуске нового облачного сервиса, оптимизированного для задач по обработке видеоматериалов. Услуга ориентирована прежде всего на компании в сфере медиа и развлечений, которым необходимы ресурсы для быстрого и эффективного создания контента. В основу системы положены ускорители NVIDIA RTX 4000 поколения Ada. Согласно результатам тестирования Akamai, использование этих GPU позволяет повысить производительность при кодировании и транскодировании видео примерно в 25 раз по сравнению с CPU. Akamai отмечает, что в настоящее время облачные инфраструктуры на базе ускорителей NVIDIA ориентированы в первую очередь на большие языковые модели (LLM) и приложения ИИ, тогда как медиасегменту уделяется недостаточное внимание. Новое облако как раз и призвано удовлетворить потребности заказчиков, которые работают с мультимедийным контентом, включая потоковое видео. Утверждается, что ускорители NVIDIA RTX 4000 обеспечивают скорость и энергоэффективность, необходимые для решения сложных творческих и инженерных задач по созданию цифрового контента, 3D-моделированию, рендерингу и пр.

Источник изображения: NVIDIA Отмечается, что GPU-ускорители позволяют выполнять транскодирование видеоматериалов со скоростью, превышающей потребности сервисов реального времени: благодаря этому значительно улучшается качество потоковой передачи. Кроме того, может осуществляться одновременное кодирование и декодирование материалов. Новый облачный сервис также подходит для работы с приложениями виртуальной (VR) и дополненной (AR) реальности. Хотя Akamai оптимизировала платформу для медиарынка, она может применяться для анализа данных и научных вычислений, рендеринга графики, задач ИИ и машинного обучения, моделирования и других ресурсоёмких операций. При этом Akamai всё быстрее превращается в распределённого облачного провайдера, а не просто оператора CDN.

12.04.2024 [13:07], Сергей Карасёв

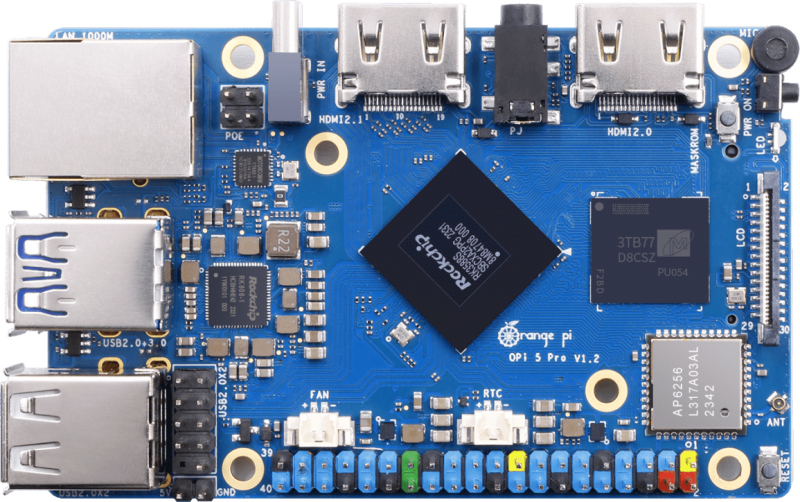

Вышел одноплатный компьютер Orange Pi 5 Pro с чипом Rockchip, 16 Гбайт ОЗУ и коннектором M.2 2280 NVMeСемейство одноплатных компьютеров Orange Pi, по сообщению ресурса CNX Software, пополнилось моделью Orange Pi 5 Pro, для которой заявлена поддержка Orange Pi OS (Droid), Orange Pi OS (Arch), Ubuntu, Debian и Android 12. Новинка подходит для создания edge-устройств, продуктов для умного дома и Интернета вещей, изделий со средствами ИИ и пр. В основу решения положен процессор Rockchip RK3588S с восемью ядрами (4 × Cortex-A76 @ 2,4 ГГц и 4 × Cortex-A55 @ 1,8 ГГц) и графическим ускорителем Arm Mali-G610 MP4 с поддержкой OpenGL ES1.1/2.0/3.2, OpenCL 2.2, Vulkan 1.2. Имеется нейропроцессорный блок (NPU) с производительностью 6 TOPS. Модуль VPU обеспечивает возможность декодирования материалов 8Kp60 H.265/AVS2/VP9/H.264/AV1 и кодирования 8Kp30 H.265/H.264. Плата имеет размеры 89 × 56 мм. Объём оперативной памяти LPDDR5 может составлять 4, 8 и 16 Гбайт. Допускается установка SSD формата M.2 2280 с интерфейсом PCIe 2.0 x1 (NVMe) или SATA, а также модуля eMMC (опционально). Есть слот для карты microSD. В оснащение входят адаптеры Wi-Fi 5 (2,4/5 ГГц) и Bluetooth 5.0, контроллер 1GbE с опциональной поддержкой PoE+. Набор разъёмов включает выходы HDMI 2.1 (вплоть до 8Kp60) и HDMI 2.0 (до 4Kp60), гнездо RJ-45 для сетевого кабеля, порт USB 3.0 и три порта USB 2.0, аудиогнездо на 3,5 мм (аудиокодек ES8388) и порт USB Type-C для подачи питания (5 В). Имеется 40-контактная колодка с поддержкой 28 × GPIO, 4 × UART, 8 × PWM, 4 × I2C, 1 × SPI, 1 × CAN и пр. Предусмотрены также коннекторы MIPI DSI (4 линии) и 2 × MIPI CSI (4 линии). Для заказа доступна старшая версия Orange Pi 5 Pro с 16 Гбайт ОЗУ: она оценена примерно в $110. Позднее выйдут модификации с 4 и 8 Гбайт памяти за $60 и $80.

16.11.2023 [02:43], Алексей Степин

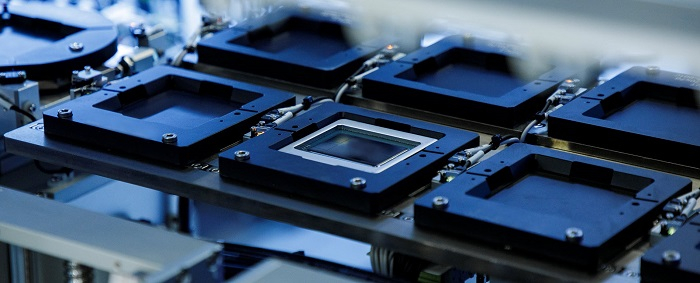

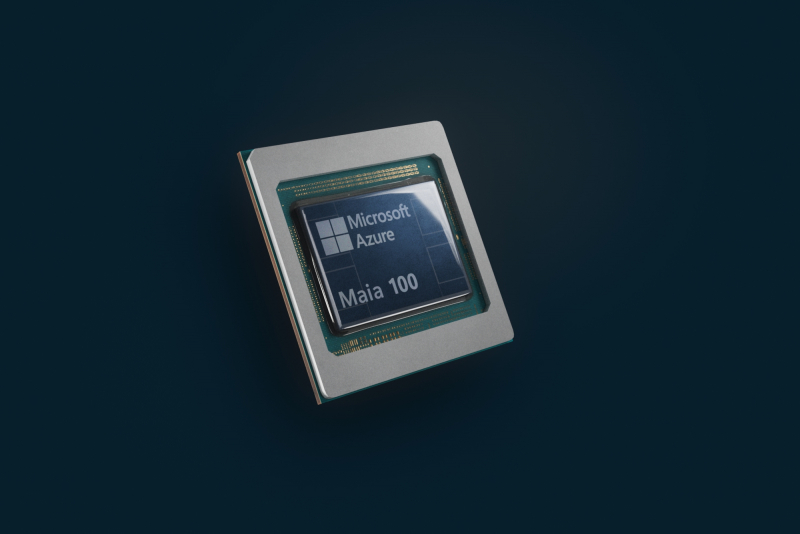

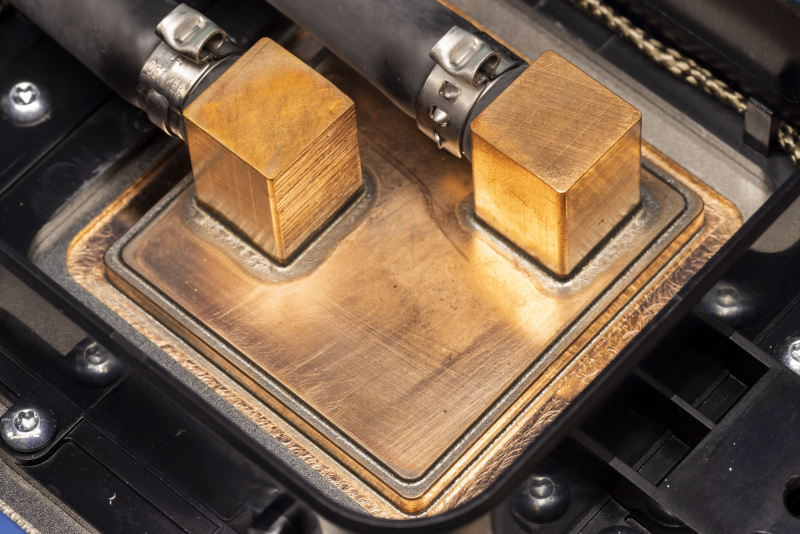

Microsoft представила 128-ядерый Arm-процессор Cobalt 100 и ИИ-ускоритель Maia 100 собственной разработкиГиперскейлеры ради снижения совокупной стоимости владения (TCO) и зависимости от сторонних вендоров готовы вкладываться в разработку уникальных чипов, изначально оптимизированных под их нужды и инфраструктуру. К небольшому кругу компаний, решившихся на такой шаг, присоединилась Microsoft, анонсировавшая Arm-процессор Azure Cobalt 100 и ИИ-ускоритель Azure Maia 100. Первопроходцем в этой области стала AWS, которая разве что память своими силами не разрабатывает. У AWS уже есть три с половиной поколения Arm-процессоров Graviton и сразу два вида ИИ-ускорителей: Trainium для обучения и Inferentia2 для инференса. Крупный китайский провайдер Alibaba Cloud также разработал и внедрил Arm-процессоры Yitian и ускорители Hanguang. Что интересно, в обоих случаях процессоры оказывались во многих аспектах наиболее передовыми. Наконец, у Google есть уже пятое поколение ИИ-ускорителей TPU. Microsoft заявила, что оба новых чипа уже производятся на мощностях TSMC с использованием «последнего техпроцесса» и займут свои места в ЦОД Microsoft в начале следующего года. Как минимум, в случае с Maia 100 речь идёт о 5-нм техпроцессе, вероятно, 4N. В настоящее время Microsoft Azure находится в начальной стадии развёртывания инфраструктуры на базе новых чипов, которая будет использоваться для Microsoft Copilot, Azure OpenAI и других сервисов. Например, Bing до сих пор во много полагается на FPGA, а вся ИИ-инфраструктура Microsoft крайне сложна. Microsoft приводит очень мало технических данных о своих новинках, но известно, что Azure Cobalt 100 имеет 128 ядер Armv9 Neoverse N2 (Perseus) и основан на платформе Arm Neoverse Compute Subsystem (CSS). По словам компании, процессоры Cobalt 100 до +40 % производительнее имеющихся в инфраструктуре Azure Arm-чипов, они используются для обеспечения работы служб Microsoft Teams и Azure SQL. Oracle, вложившаяся в своё время в Ampere Comptuing, уже перевела все свои облачные сервисы на Arm. Чип Maia 100 (Athena) изначально спроектирован под задачи облачного обучения ИИ и инференса в сценариях с использованием моделей OpenAI, Bing, GitHub Copilot и ChatGPT в инфраструктуре Azure. Чип содержит 105 млрд транзисторов, что больше, нежели у NVIDIA H100 (80 млрд) и ставит Maia 100 на один уровень с Ponte Vecchio (~100 млрд). Для Maia организован кастомный интерконнект на базе Ethernet — каждый ускоритель располагает 4,8-Тбит/с каналом для связи с другими ускорителями, что должно обеспечить максимально эффективное масштабирование. Сами Maia 100 используют СЖО с теплообменниками прямого контакта. Поскольку нынешние ЦОД Microsoft проектировались без учёта использования мощных СЖО, стойку пришлось сделать более широкой, дабы разместить рядом с сотней плат с чипами Maia 100 серверами и большой радиатор. Этот дизайн компания создавала вместе с Meta✴, которая испытывает аналогичные проблемы с текущими ЦОД. Такие стойки в настоящее время проходят термические испытания в лаборатории Microsoft в Редмонде, штат Вашингтон. В дополнение к Cobalt и Maia анонсирована широкая доступность услуги Azure Boost на базе DPU MANA, берущего на себя управление всеми функциями виртуализации на манер AWS Nitro, хотя и не целиком — часть ядер хоста всё равно используется для обслуживания гипервизора. DPU предлагает 200GbE-подключение и доступ к удалённому хранилищу на скорости до 12,5 Гбайт/с и до 650 тыс. IOPS. Microsoft не собирается останавливаться на достигнутом: вводя в строй инфраструктуру на базе новых чипов Cobalt и Maia первого поколения, компания уже ведёт активную разработку чипов второго поколения. Впрочем, совсем отказываться от партнёрства с другими вендорами Microsoft не намерена. Компания анонсировала первые инстансы с ускорителями AMD Instinct MI300X, а в следующем году появятся инстансы с NVIDIA H200. |

|