Материалы по тегу: i

|

06.06.2024 [13:23], Руслан Авдеев

Маск подтвердил передачу ИИ-стартапу xAI 12 тыс. ускорителей H100, предназначавшихся TeslaГлава Tesla и других компаний Илон Маск (Elon Musk) подтвердил передачу ускорителей NVIDIA H100, ранее заказанных Tesla, социальной сети X и ИИ-стартапу xAI. Слухи об этом, напоминает The Register, появились в СМИ — в распоряжение журналистов попала внутренняя документация и электронная переписка с NVIDIA. В частности, в одной из записок за декабрь прошлого года прямо указывалось, что Илон отдаёт приоритет внедрению 12 тыс. ускорителей в X вместо Tesla. Общая стоимость такого количества H100 превышает $500 млн. Вместо этого заказанные для X экземпляры H100 позже будут переданы Tesla (поставки ожидались в январе и июне 2024 года). Кроме того, есть проблемы и с созданием ИИ-суперкомпьютера Dojo на базе собственных чипов, который должен улучшить положение Tesla. Приоритетным для Маска, вероятно, является кластер H100, создаваемый X и тесно связанным с сетью стартапом xAI. Компании совместно работают над большими языковыми моделями, стоящими за чат-ботом Grok, уже доступным премиум-подписчикам X. По данным утечки из NVIDIA, 100 тыс. H100 приказано передать к концу года в xAI для создания «крупнейшего в мире» кластера ускорителей, который разместится в Северной Дакоте.

Источник изображения: Alexander Shatov/unsplash.com Хотя на уровне компаний комментариев не поступало, сам Маск подтвердил, что у Tesla просто не было места для чипов NVIDIA, поэтому они хранились на складе. При этом ещё не так давно Маск уверял инвесторов Tesla, как важны HPC-системы и ИИ для компании. Более того, ещё в апреле появилась новость о том, что автопроизводитель только в течение одного квартала вложил в ИИ $1 млрд. Также миллиардер сообщал, что один из заводов Tesla в Техасе вместит 50 тыс. H100 для обучения систем автономного вождения, в общей сложности число ускорителей достигло бы 85 тыс. Пока нет точных данных об обстоятельствах передачи ускорителей между Tesla и X или xAI. Нет даже информации о том, заплатила ли уже Tesla за «железо» и получила ли за него какую-то компенсацию. Условия передачи H100 могут иметь большое значение с учётом того, что Маск не является единоличным владельцем Tesla. Если выяснится, что Маск злоупотребил властью, к нему могут возникнуть вопросы как у инвесторов, так и у регуляторов. Впрочем, Tesla не впервые приходится делиться активами с X. Вскоре после покупки Twitter более 50 сотрудников автопроизводителя якобы отправили на «усиление» социальной соцсети. Есть данные, что сотрудников Tesla привлекают к работам и в других компаниях Маска, причём без дополнительной платы. Время для новостей не особенно удачное — на следующей неделе акционеры Tesla будут голосовать по ряду предложений, главным из которых является официальный перенос штаб-квартиры в Техас. Также речь пойдёт о переизбрании брата Кимбала, брата Илона Маска (Kimbal Musk), в совет директоров и других ключевых для бизнесмена вопросах. Тем временем в Tesla падают продажи со II половины 2022 года, увольняют сотрудников и, главное, стоимость акций компании падает критическими темпами. Приказ передать H100 станет дополнительным козырем в руках критиков миллиардера, которые утверждают, что его активное участие в других проектах мешает ему сконцентрироваться на автобизнесе и эффективно выполнять обязанности главы Tesla.

05.06.2024 [12:15], Сергей Карасёв

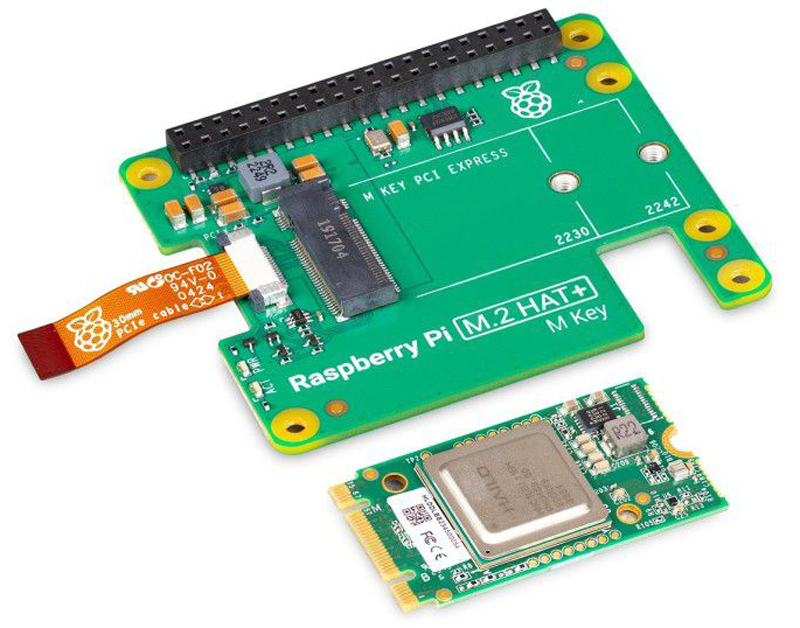

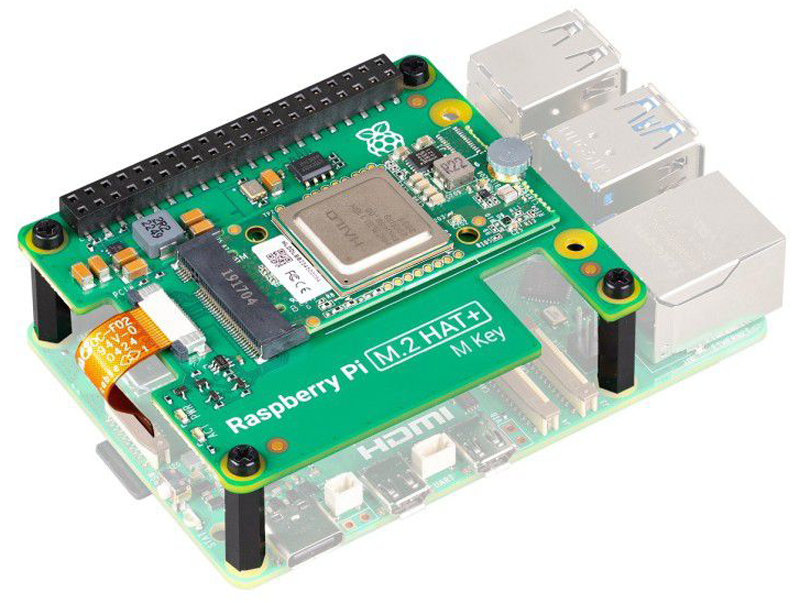

Комплект Raspberry Pi AI Kit с ИИ-ускорителем Hailo расширит возможности Raspberry Pi 5Команда Raspberry Pi анонсировала комплект Raspberry Pi AI Kit, который позволяет наделить ИИ-возможностями одноплатный компьютер Raspberry Pi 5, дебютировавший в сентябре 2023 года. Модуль расширения уже доступен для заказа по ориентировочной цене $70. В основу Raspberry Pi AI Kit положен ИИ-чип Hailo-8L, созданный Hailo Technologies. Это изделие ориентировано на приложения, которым не требуется слишком высокое ИИ-быстродействие. Заявленное быстродействие достигает 13 TOPS, а стандартное энергопотребление составляет 1,5 Вт.

Источник изображений: Raspberry Pi В случае Raspberry Pi AI Kit чип Hailo-8L установлен на модуль типоразмера M.2 2242, который подключается к соответствующему коннектору на плате расширения M.2 HAT+. Эта плата, в свою очередь, обменивается данными с Raspberry Pi 5 посредством интерфейса PCIe 2.0. Габариты M.2 HAT+ составляют 65 × 56,5 × 5,6 мм. Заявленный диапазон рабочих температур простирается от 0 до +50 °C. Новинка может быть смонтирована поверх одноплатного компьютера.  Отмечается, что при использовании обновлённой версии Raspberry Pi OS распознавание чипа Hailo-8L происходит автоматически, после чего ускоритель становится доступен для обработки ИИ-нагрузок. Говорится о полной интеграции с программным стеком Raspberry Pi Camera, что позволяет реализовывать различные приложения на основе машинного зрения.

04.06.2024 [15:04], Сергей Карасёв

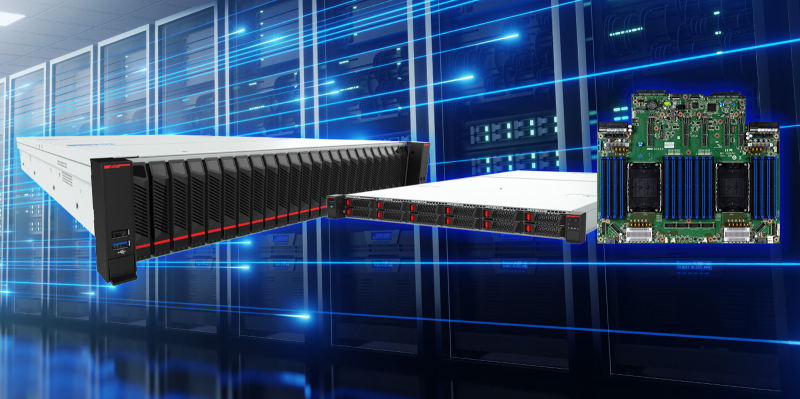

MSI анонсировала серверы на базе Intel Xeon 6 в формате 1U/2UКомпания MSI представила серверы на новейшей аппаратной платформе Intel Xeon 6 с процессорами Xeon, оснащёнными энергоэффективными ядрами E-core (Sierra Forest). В частности, дебютировали модели CX170-S5062 и CX270-S5062 в форм-факторе 1U и 2U соответственно. Они оснащены материнской платой стандарта DC-MHS. Серверы имеют двухсокетное исполнение, располагают 32 слотами DDR5-DIMM и одним разъёмом PCIe 5.0 x16 OCP NIC 3.0. Модель CX170-S5062 будет предлагаться в модификациях с поддержкой 8 или 12 накопителей SFF U.2 NVMe с интерфейсом PCIe 5.0. Предусмотрены два слота расширения для карт PCIe 5.0. В свою очередь, решение CX270-S5062 может нести на борту до 24 накопителей SFF U.2 NVMe (PCIe 5.0). Доступны шесть разъёмов PCIe 5.0, два из которых рассчитаны на двухслотовые ускорители на базе GPU. Кроме того, MSI анонсировала односокетный сервер CX271-S3066 формата 2U c 24 отсеками для SFF-накопителей U.2 NVMe. Система поддерживает 16 модулей оперативной памяти DDR5. Есть три слота PCIe 5.0 x16, два разъёма OCP NIC 3.0 и два коннектора M.2 NVMe. Сервер предназначен прежде всего для рабочих нагрузок общего назначения. Все новинки поддерживают модуль управления DC-SCM2 Server Management Module с контроллером Aspeed AST2600 BMC. Отсеки для накопителей располагаются во фронтальной части.

04.06.2024 [12:10], Руслан Авдеев

Илон Маск готовит для xAI суперкомпьютер c 300 тыс. NVIDIA B200, но пока придётся обойтись H100Илон Маск (Elon Musk) заявляет, что к лету 2025 года его ИИ-стартап xAI введёт в эксплуатацию суперкомпьютер c 300 тыс. новейших ускорителей NVIDIA B200 и SuperNIC ConnectX-8, передаёт Datacenter Dynamics. Заодно Маск пообещал уже в ближайшие месяцы ввести в эксплуатацию кластер из 100 тыс. ускорителей NVIDIA H100 с жидкостным охлаждением. При этом важно помнить, что Маск нередко даёт обещания, которые потом никогда не выполняет или выполняет совсем не так, как ожидалось. Например, на днях The Information сообщала, что 100 тыс. ускорителей H100 должны заработать только следующим летом. Вероятнее всего, компания построит компактный и относительно недорогой кластер, который позже расширится до 100 тыс. ускорителей. Такую же схему могут реализовать и с системой из 300 тыс. ускорителей. Предполагается, что такой суперкомпьютер будет стоить десятки миллиардов долларов — больше, чем xAI привлекла от инвесторов. По словам главы NVIDIA Дженсена Хуанга (Jensen Huang), один B200 стоит $30-40 тыс. Даже если Маску удастся приобрести ускорители подешевле, речь будет идти о $9 млрд. С учётом того, что компании понадобится инфраструктура, связь, классические процессоры, земля и коммунальное обслуживание, речь будет идти о ещё более дорогостоящем проекте — даже не принимая во внимание стоимости потребляемой воды и электроэнергии. В прошлом месяце xAI привлекла $6 млрд в ходе очередного раунда финансирования, что подняло стоимость компании до $24 млрд. В совокупности с предыдущим раундом, в ходе которого удалось собрать $1 млрд, средств будет достаточно для покупки 100 тыс. H100, оплату работы персонала и текущих вычислительных потребностей — пока xAI арендует около 16 тыс. ускорителей H100 у Oracle Cloud, а недавно сообщалось о намерении xAI потратить $10 млрд на серверы в облаке Oracle.

28.05.2024 [13:10], Владимир Мироненко

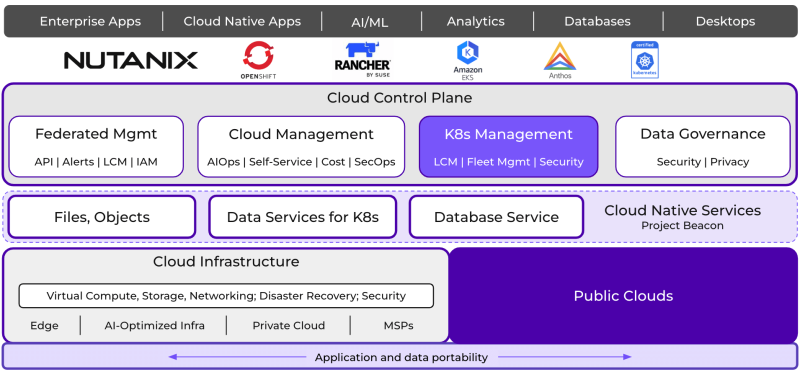

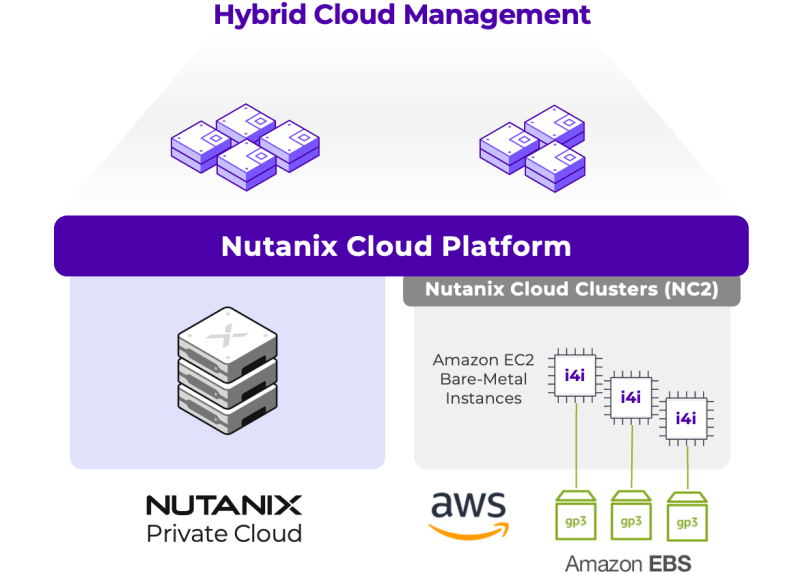

Nutanix укрепила дружбу с Dell, представила свою Kubernetes-платформу и предложила переехать с VMware на её решенияКомпания Nutanix, специализирующаяся на разработке решений в области гибридных мультиоблачных платформ и HCI, объявила о партнёрстве с Dell Technologies, благодаря которому их клиенты смогут использовать гибридные мультиоблачные решения Dell и Nutanix для улучшения ИТ-операций, повышения отказоустойчивости и гибкости в работе. Как сообщается, Nutanix и Dell будут сотрудничать в работе над двумя решениями. Клиенты смогут оптимизировать развёртывание частных и гибридных мультиоблачных сред благодаря сочетанию предложений Dell по серверам и СХД и ПО Nutanix. В рамках соглашения Dell предложит интегрированное гиперконвергентное решение «под ключ», которое объединяет облачную платформу Nutanix Cloud Platform (NCP) с серверами Dell. Решение будет доступно в широком ассортименте моделей и конфигураций серверов PowerEdge для широкого спектра приложений. Чтобы обеспечить гибкость и возможность выбора экосистемы платформа NCP for Dell PowerFlex объединит преимущества NCP на базе гипервизора AHV с программно-определяемым блочным хранилищем Dell PowerFlex. Решение позволит клиентам масштабировать хранилище независимо от вычислений. Помимо предоставления двух новых совместных решений, компании будут сотрудничать в области проектирования, вывода решений на рынок, поддержки и обслуживания. Решения будут предлагаться отделами продаж и партнёрами Dell по всему миру, что позволит Nutanix расширить сеть дистрибуции. Совместные решения Dell и Nutanix пока находятся в разработке и появятся в раннем доступе позднее в этом году. Кроме того, Nutanix договорилась об интеграции AHV с Cisco ACI Virtual Machine Manager (VMM). Также Nutanix сделала своё хранилище доступным в AWS EKS, пишет The Register. Ресурс также отметил, что Nutanix представила платформу Nutanix Kubernetes Platform (NKP), появившуюся в результате приобретения в конце 2023 года фирмы D2IQ (MesSphere). Главная особенность платформы заключается в том, что она позволяет управлять кластерами, работающими в средах, отличных от Nutanix. Эта особенность будет использоваться в анонсированном Nutanix в прошлом году проекте Project Beacon, нацеленном на создание ряда продуктов PaaS, которые работают в любом облаке и не требуют наличия стека Nutanix. Также Nutanix расширила поддержку гипервизором AHV большего количества оборудования, добавив в этот перечень узлы VSAN Ready Node — ориентированные на системы хранения данных серверы, которые OEM-производители создают для массивов хранения данных VMware. Nutanix гарантирует, что AHV сможет работать на этих устройствах, если пользователи захотят перепрофилировать их. Это поможет тем, кто, возможно, пожелает прекратить или уменьшить использование решений VMware после её поглощения Broadcom.

26.05.2024 [22:25], Александр Бенедичук

«Гигафабрика» для ИИ: стартап xAI Илона Маска хочет построить суперкомпьютер со 100 тыс. NVIDIA H100Как сообщает Reuters со ссылкой на The Information, Илон Маск планирует построить гигантский суперкомпьютер для своего ИИ-стартапа xAI для работы над следующей версией чат-бота Grok. Запуск предполагаемого суперкомпьютера ожидается к осени 2025 года, при этом, по словам Маска, xAI может сотрудничать с Oracle. Для обучения Grok 2 использовалось около 20 тыс. ускорителей NVIDIA H100, а для Grok 3 и более поздних версий потребуется уже 100 тыс. NVIDIA H100. После завершения строительства суперкомпьютер будет как минимум в четыре раза больше самых больших существующих на сегодняшний день GPU-кластеров, утверждается в презентации, сделанной для инвесторов в мае. Семейство ускорителей NVIDIA доминирует на рынке ИИ-чипов для ЦОД, но из-за высокого спроса их может быть трудно приобрести. Маск основал xAI в прошлом году в качестве конкурента OpenAI и Google. Маск также был соучредителем OpenAI и членом совета директоров до 2018 года. В феврале этого года он подал иск к OpenAI и соучредителям Альтману и Брокману, посчитав, что они нарушили соглашение о некоммерческом характере деятельности.

16.05.2024 [14:22], Руслан Авдеев

xAI Илона Маска потратит $10 млрд на облачные ИИ-серверы Oracle для чат-бота GrokИИ-стартап Илона Маска (Elon Musk) xAI готов потратить $10 млрд на серверы в облаке Oracle. По данным The Information, ссылающейся на осведомлённые источники, компании ведут переговоры о долгосрочном сотрудничестве, которое сделает детище Маска одним из крупнейших клиентов Oracle. Предполагается, что xAI требуется больше вычислительных ресурсов для соперничества с OpenAI, Anthropic и другими компаниями, уже заключившими многомиллиардные инвестиционные сделки с Microsoft и AWS соответственно. Это позволяет им получать доступ к облачной инфраструктуре для обучения и запуска больших языковых моделей (LLM). Например, Microsoft и OpenAI, по слухам, готовы потратить $100 млрд на кампус ЦОД Stargate ёмкостью 5 ГВт. Пока Micosoft вынуждена сама арендовать часть ИИ-ускорителей у Oracle. В прошлом году xAI представила чат-бот Grok, доступный платным пользователям соцсети X, а сейчас разрабатывается вторая версия. Имеются сведения, что xAI завершает раунд привлечения инвестиций в размере $6 млрд, а Маск уже заявил, что полученные средства будут потрачены на аренду инфраструктуры. В прошлом месяце миллиардер заявил, что новинка обучается на 20 тыс. ускорителей NVIDIA, но для Grok 3.0 потребуется уже 100 тыс. ускорителей. Маск и основатель Oracle Ларри Эллисон (Larry Ellison) крепко дружат, кроме того, Элиссон входил в совет директоров Tesla. В декабре прошлого года он заявлял, что xAI уже является крупнейшим клиентом Oracle и утверждал, что у облачного гиганта достаточно ускорителей для Grok первого поколения, но, по его признанию, в xAI хотят намного больше. Сейчас xAI арендует у Oracle 15 тыс. ускорителей NVIDIA H100. Tesla, ещё одно детище Маска, уже ввела в эксплуатацию ИИ-ресурсы, эквивалентные по производительности 35 тыс. H100. ИИ-инфраструктура стала выгодным источником дохода для облачного оператора, в марте Эллисон заявлял, что компания строит новые ЦОД, включая некий «крупнейший в мире» объект. Примечательно, что после покупки социальной сети Twitter (ныне X), Маск и его менеджмент не хотели платить за услуги Oracle (а также AWS и Google), пытаясь оптимизировать расходы.

13.05.2024 [10:30], Сергей Карасёв

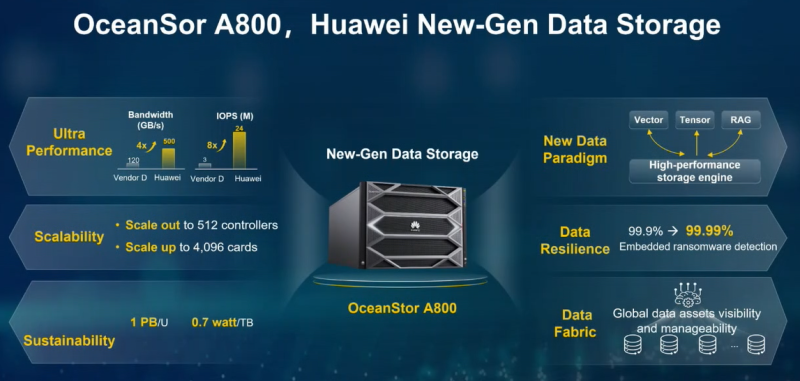

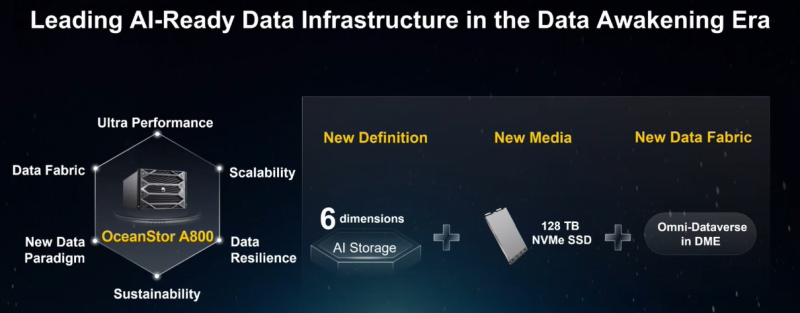

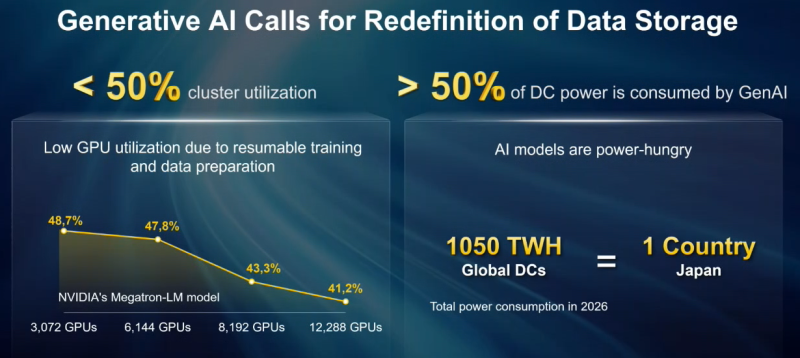

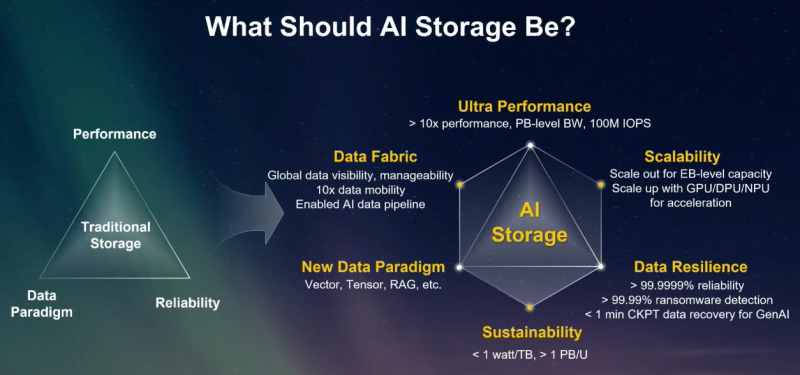

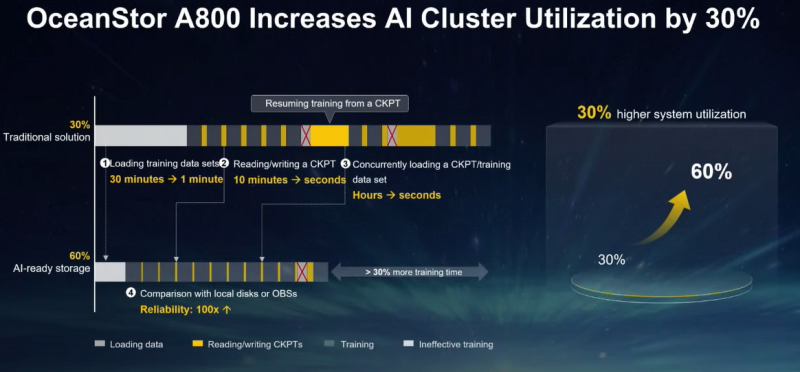

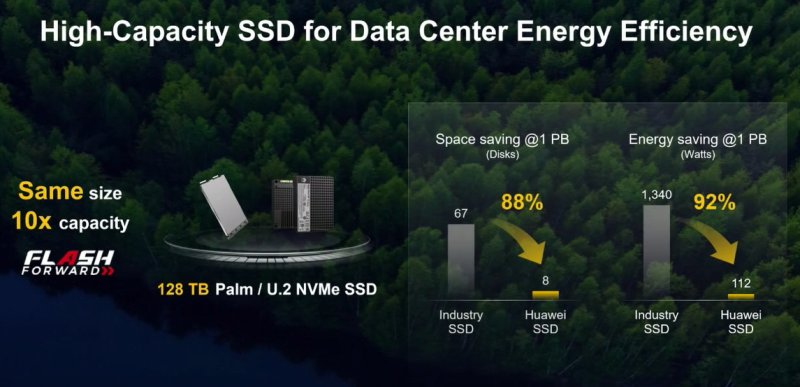

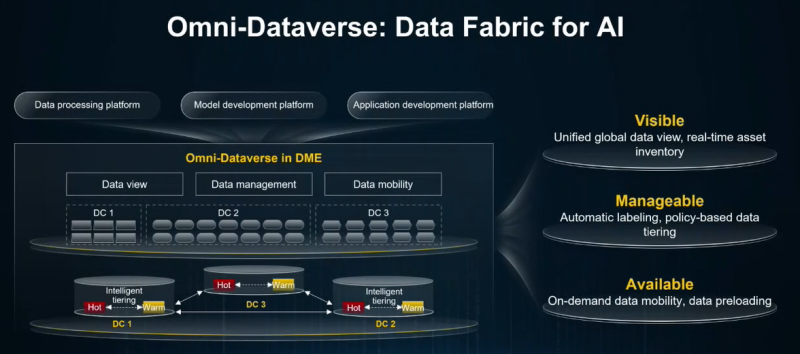

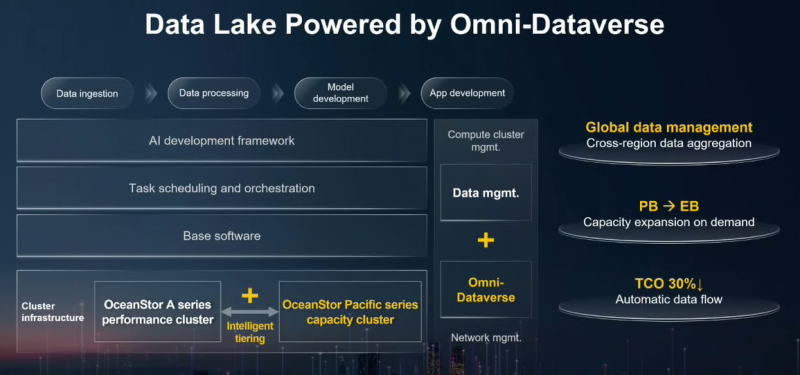

Экзабайты для ИИ: Huawei представила All-Flash СХД OceanStor A800Компания Huawei, по сообщению Datacenter Dynamics, представила СХД нового поколения OceanStor A800, специально разработанную для задач ИИ. Новинка позволяет формировать массивы экзабайтного уровня. Питер Чжоу (Peter Zhou), президент подразделения систем хранения Huawei, отмечает, что стремительное внедрение ИИ, в том числе генеративных сервисов, изменило требования к традиционным платформам СХД. Поэтому возникают проблемы с производительностью, надёжностью и масштабируемостью. В этой связи Huawei стремится переосмыслить подход к хранению информации, внедряя инновации по ряду направлений, включая новые парадигмы данных, повышение устойчивости и быстродействия. Платформа OceanStor A800 использует архитектуру SmartMatrix Pro для разделения уровней данных и управления: это позволяет передавать информацию через интерфейсные модули на/с SSD, обходя узкие места, связанные с CPU и памятью. В результате, как утверждается, производительность повышается практически на порядок по сравнению с традиционными хранилищами. В частности, A800 до восьми раз быстрее позволяет загружать наборы данных для обучения ИИ, а средняя утилизация GPU/NPU в кластере повышается почти на треть. Новая система выполнена в формате 8U. Конструкция включает два модуля обработки с поддержкой CPU и GPU, а также два модуля хранения на основе SSD. В качестве CPU применяется фирменное изделие Huawei Kunpeng с архитектурой Arm. Модули обработки могут дооснащаться дополнительными GPU, DPU и NPU. Основной шиной является PCIe 5.0. Показатель IOPS достигает 24 млн, а пропускная способность — 500 Гбайт/с. СХД поддерживает проприетарные накопители Palm SSD с высокоплотной упаковкой NAND-чипов и вместимостью 30 или 50 Тбайт, а в следующем году будет реализована возможность применения SSD на 128 Тбайт. Утверждается, что OceanStor A800 обеспечивает плотность хранения более 1 Пбайт на 1U, а энергоэффективность составляет 0,7 Вт/Тбайт. Платформа может масштабироваться до 512 контроллеров и 4096 вычислительных блоков, что обеспечивает вместимость в экзабайты и возможность обслуживания моделей с триллионами параметров. Применена параллельная файловая система OceanFS, причём Huawei предлагает унифицированное управление данными сразу в нескольких кластерах посредством Omni-Dataverse. Поддерживаются протоколы NFS, SMB, HDFS, S3, POSIX, MP-IO, а также интерфейсы для работы с векторными/тензорными данными. Предусмотрены встроенные средства обнаружения программ-вымогателей, эффективность которых, по заявлениям Huawei, достигает 99,99 %.

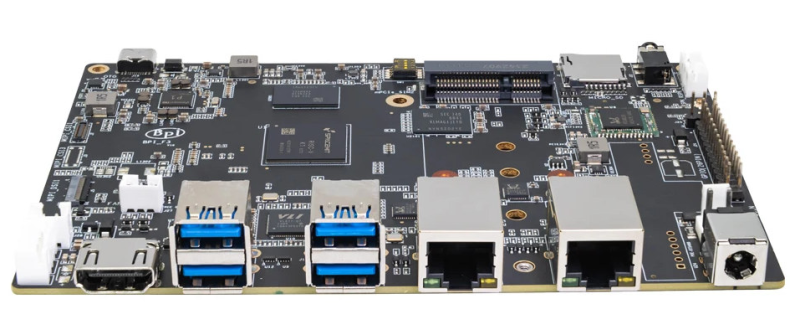

10.05.2024 [21:34], Сергей Карасёв

Восьмиядерный RISC-V с NPU: одноплатный компьютер Banana Pi BPI-F3 получил чип SpacemiT K1Banana Pi, по сообщению ресурса CNX Software, начала поставки одноплатного компьютера BPI-F3, особенностью которой является использование процессора SpacemiT K1 на открытой архитектуре RISC-V. Изделие подходит для работы с приложениями ИИ. Новинка была анонсирована в феврале этого года. Чип SpacemiT K1 объединяет восемь 64-бит RISC-V ядер, неназванный графический блок с поддержкой OpenCL 3.0, OpenGL ES3.2 и Vulkan 1.2, а также нейропроцессорный модуль (NPU) с производительностью до 2 TOPS. Говорится о возможности кодирования/декодирования материалов H.265, H.264, VP9, VP8.

Источник изображения: Banana Pi Объём оперативной памяти LPDDR4 может составлять 2 или 4 Гбайт, вместимость флеш-модуля eMMC — 8 или 16 Гбайт. Есть слот для карты microSD и коннектор M.2 Key-M для SSD с интерфейсом PCIe 2.1 x1 или SATA. Опционально могут быть добавлены флеш-чипы SPI NAND на 32 Мбайт и SPI NOR на 4 Мбайт. В оснащение входят два порта 1GbE (RJ-45) на контроллере Realtek RTL8211F с опциональной поддержкой PoE (через плату RT5400), а также адаптеры Wi-Fi 5 (2,4/5 ГГц) и Bluetooth 4.2 на базе Realtek RTL8852BS. Дополнительно предлагается модем 4G в виде модуля mPCIe (плюс слот для SIM-карты). Доступны четыре порта USB 3.0 Type-A, разъём USB 2.0 Type-C и коннектор HDMI 1.4 (до 1080p60). Поддерживаются интерфейсы MIPI DSI (4 линии) и 2 × MIPI-CSI (4 линии). Кроме того, упомянуты 26-контактная колодка GPIO, инфракрасный порт и разъём для подсоединения вентилятора. Питание (12 В / 3 A) подаётся через DC-гнездо. Габариты составляют 148 × 100 мм, вес — около 200 г. Цена начинается примерно с $63.

07.05.2024 [13:50], Сергей Карасёв

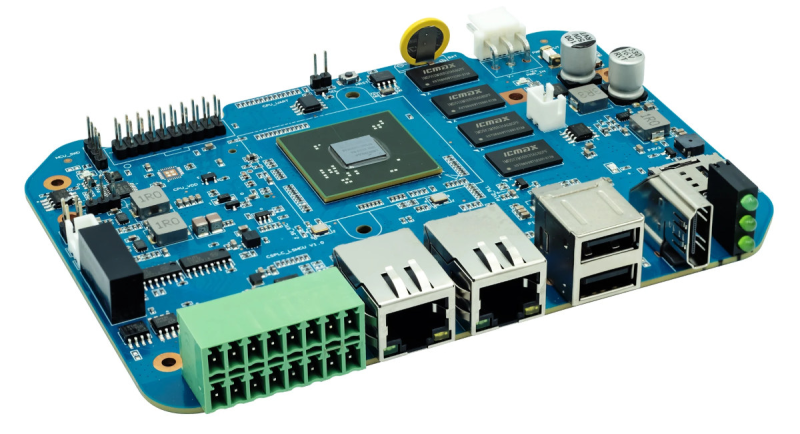

Одноплатный компьютер Banana Pi BPI-5202 оснащён китайским чипом Loongson 2K1000LAКитайская компания Loongson, по сообщению ресурса CNX Software, поставляет процессор 2K1000LA для промышленных устройств и оборудования IoT. Этот чип лёг в основу одноплатного компьютера Banana Pi BPI-5202, который предлагается по ориентировочной цене $220. 64-бит процессор Loongson 2K1000LA содержит два вычислительных ядра на архитектуре LoongArch с частотой 1 ГГц. Кеш инструкций и кеш данных L1 составляет по 32 Кбайт, общий кеш L2 — 1 Мбайт. Имеется контроллер памяти DDR3-1066. Среди поддерживаемых интерфейсов — SATA 2.0, 2 × DVO, I2S, HDA, GMAC, USB 2.0, PCIe 2.0 х2, SPI, UART, GPIO, SDIO, I2C. Энергопотребление чипа варьируется от 1 до 5 Вт.

Источник изображений: CNX Software Одноплатный компьютер Banana Pi BPI-5202, в свою очередь, несёт на борту 4 Гбайт памяти DDR3 и флеш-модуль NAND ёмкостью 1 Гбайт. Есть коннектор M.2 2242 для SATA SSD. Предусмотрены два сетевых порта 1GbE, а опционально может быть установлен адаптер Wi-Fi или модем 4G/5G (есть слот Nano SIM) в виде модуля mPCIe. Изделие оснащено портом HDMI 1.4 с поддержкой видео 1080p60, двумя гнёздами RJ-45 для сетевых кабелей, двумя портами USB 2.0 Type-A, коннектором для вентилятора охлаждения и гнездом для подачи питания (9–36 В). Есть 20-контактная колодка GPIO с поддержкой RS485 и SPI, а также 20-контактный коннектор UART FPC. Возможно использование интерфейсов RS485 и RS232 с изоляцией. Габариты платы составляют 140 × 100 мм. Говорится о совместимости с платформами Loongnix Linux и LoongOS. Для новинки будут доступны различные I/O-модули. |

|