Материалы по тегу:

|

10.06.2026 [15:05], Руслан Авдеев

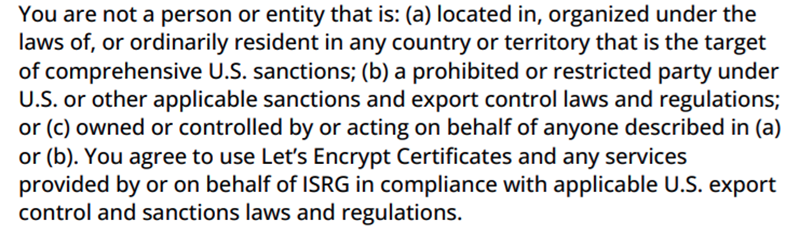

Санкции на сертификат: Let’s Encrypt перестанет работать с недружественными США странами, лицами и организациямиВ пользовательском соглашении удостоверяющего центра Let's Encrypt, бесплатно предоставляющего TLS-сертификаты, появились изменения, запрещающие их выдачу людям и организациям из стран и территорий, на которых наложены «всеобъемлющие» (comprehensive) американские санкции. Запрет коснулся и тех лиц и организаций, на кого наложены персональные санкции. Также учитываются ограничения, связанные с экспортным контролем США. Пострадают и организации, находящиеся под контролем лиц, на которых действуют санкции или действующих от имени таких людей. По имеющимся данным, пока сервис Let's Encrypt применял «точечные» блокировки для конкретных доменов, внесённых в чёрные списки Управления по контролю за иностранными активами США (OFAC). По словам ISRG (Internet Security Research Group), управляющей сервисом Let's Encrypt, сертификаты по-прежнему будут доступны в России и Иране, за исключением государственных структур стран. Официально утверждается, что запреты действуют уже давно, и обновление пользовательского соглашения лишь формально закрепляет уже сложившуюся практику.

Источник изображения: Let's Encrypt По некоторым данным, запросы из России к удостоверяющему центру принимаются без ограничений — если доменов нет в санкционных списках. OpenNET сообщает, что полномасштабные санкции касаются, например, Ирана, КНДР и Кубы, однако относительно РФ тотальный запрет пока не действует. Утверждается, что возможность выдавать сертификаты российским и прочим негосударственным учреждениям и частным лицам обеспечена фактически благодаря принятым и контролируемым OFAC послаблениям, объясняемым содействием защите прав и свобод человека, а также благодаря законам США о защите частной переписки.

10.06.2026 [14:56], Сергей Карасёв

Представлен GL.iNet Comet X — стоечный KVM с возможностью управления четырьмя серверамиКомпания GL.iNet анонсировала изделие Comet X — KVM-устройство корпоративного уровня, предназначенное для удалённого управления серверами и рабочими станциями. Новинка может монтироваться в стойку, предоставляя возможность интеграции в существующую серверную среду. Решение выполнено на неназванном Arm-процессоре с четырьмя вычислительными ядрами. В оснащение входят 1 Гбайт DDR3L и флеш-накопитель eMMC вместимостью 64 Гбайт. Во фронтальной части располагается 3,69″ сенсорный дисплей, который служит для управления и отображения служебной информации: можно просмотреть IP-адреса оборудования, статус (онлайн/офлайн) и активные сессии. В качестве программной платформы применяется ОС на ядре Linux 6.1.

Источник изображений: GL.iNet Новинка наделена семью портами USB 2.0 Type-A для периферийных устройств. Кроме того, есть четыре разъёма USB 2.0 Type-C для подсоединения хост-систем, четыре входа HDMI, один выход HDMI, а также один сетевой порт 1GbE RJ45 с поддержкой PoE (802.3af/at). Питание может подаваться через дополнительный коннектор USB Type-C (5 В / 3 А).  Comet X позволяет управлять четырьмя серверами/компьютерами из любой точки мира через браузер или приложение, получая изображение в формате 4K (30 к/с). Допускается также локальное управление: можно подключить клавиатуру, мышь и монитор для устранения неполадок на сервере или рабочей станции, настройки или установки операционной системы. Новинка совместима с 10″ и 19″ серверными стойками (кронштейны обоих типов входят в комплект). Габариты составляют 170 × 90 × 40 мм, масса — 560 г.

10.06.2026 [14:00], Сергей Карасёв

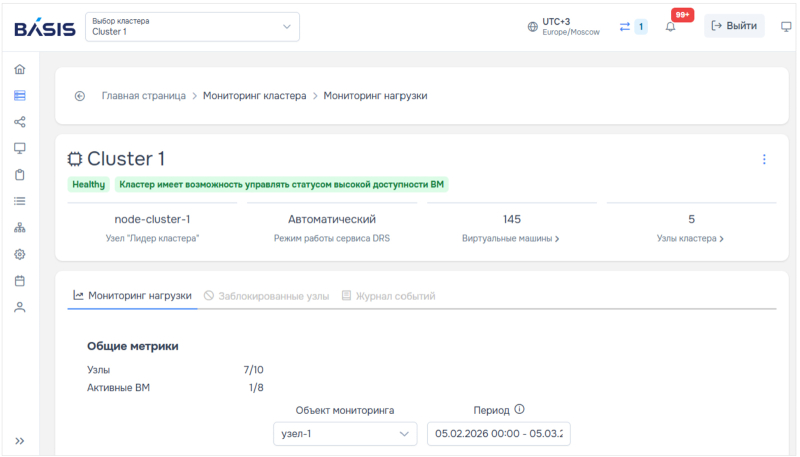

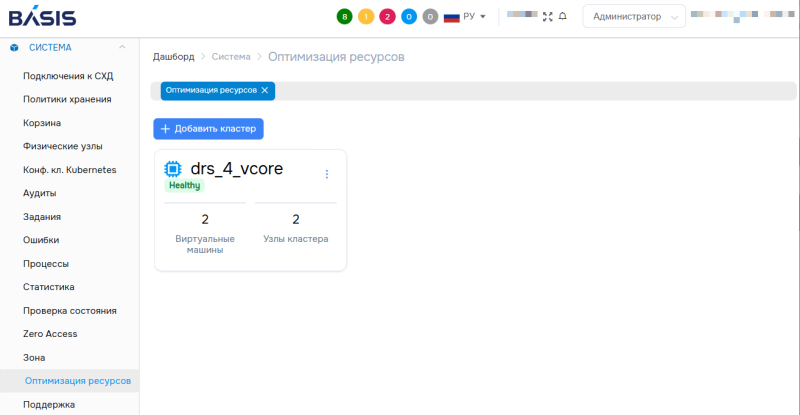

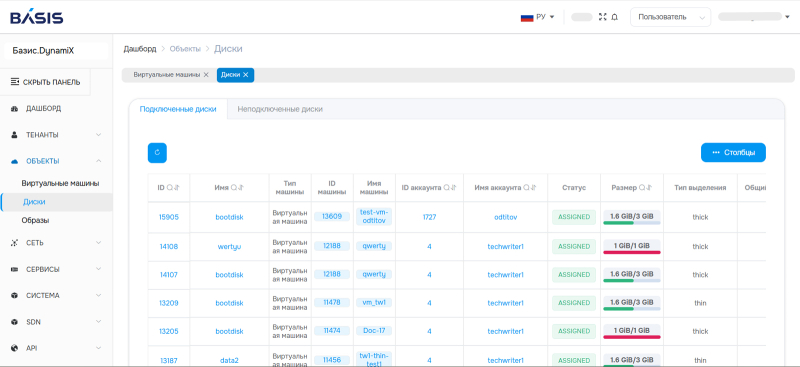

Новый релиз Basis Dynamix Enterprise 4.6: автоматическая балансировка нагрузки, связанные клоны и поддержка современных протоколов работы с СХД«Базис», лидер российского рынка ПО для управления динамической инфраструктурой, объявляет о выпуске новой версии платформы серверной виртуализации Basis Dynamix Enterprise 4.6. Релиз сосредоточен на трёх ключевых направлениях: автоматической балансировке нагрузки между вычислительными узлами, экономии дискового пространства за счёт связанных клонов и поддержке современных протоколов работы с системами хранения данных. Всего в новую версию вошло более 60 улучшений и доработок. Динамическая балансировка нагрузкиВ Basis Dynamix Enterprise 4.6 добавлен механизм Distributed Resource Scheduler (DRS), который обеспечивает взаимодействие платформы и модуля Basis Resource Optimizer. Вместе они балансируют нагрузку на вычислительных узлах — следят за состоянием инфраструктуры и при необходимости перераспределяют виртуальные машины между узлами для более равномерного использования ресурсов кластера, что позволяет снизить простои оборудования. Basis Resource Optimizer анализирует метрики потребления процессора и памяти и на их основе формирует рекомендации: о переносе виртуальных машин между узлами для равномерной загрузки, об изменении количества vCPU и объема оперативной памяти, а также следит за соблюдением правил размещения — Affinity (держать ВМ на одном узле) и Anti-Affinity (разносить по разным узлам). В зависимости от выбранного режима и настроек правила рекомендации применяются автоматически или после подтверждения оператора. Операции, которые требуют перезагрузки виртуальной машины, например, изменение выделенных ей ресурсов, можно выполнять в заранее заданные интервалы. За это отвечает сервис технических окон: администратор задаёт разовые или повторяющиеся расписания, и подобные задачи планируются на ближайшее разрешённое окно в период минимальной нагрузки. DRS в составе Basis Dynamix Enterprise устанавливается в кластере управления. Администратор может создавать планировщики внутри отдельных зон, добавлять и удалять узлы из их области действия, запускать и останавливать механизм через API. Это позволяет администраторам заказчика настраивать политики балансировки под особенности конкретной инфраструктуры — от компактных кластеров до крупных геораспределённых установок. Связанные клоны и экономия дискового пространстваДля хранения данных на локальных дисках вычислительных узлов (Local SEP) в платформе появилась поддержка тонких дисков и связанных клонов. Если виртуальная машина создаётся из образа, размещённого в том же пуле, её диск становится зависимым потомком этого образа — фактическое копирование данных не выполняется, а изменения записываются по принципу copy-on-write. Это сокращает расход дискового пространства при массовом развёртывании однотипных ВМ — например, в сценариях VDI, на тестовых стендах или в сервис-провайдерских инсталляциях. Параллельно внедрена поддержка механизма «множественный образ» (MultiImage), который объединяет ссылки на копии одного шаблонного образа, размещённые в разных пулах хранения. Это позволяет создавать связанные клоны из одного источника на различных СХД и снижает зависимость операций развёртывания от состояния отдельного пула. В административном портале для пулов с тонкими дисками выводятся параметры физического лимита и фактически записанного объёма с цветовой индикацией заполнения: пул подсвечивается жёлтым при заполнении от 75% и красным при 90% и выше — администратор сразу видит, где требуется вмешательство. Поддержка NVMe-over-TCPПлатформа получила поддержку протокола NVMe-over-TCP для систем хранения данных, подключённых через SEP SHARED и SEP Tatlin в режиме RDM. Этот сетевой протокол обеспечивает доступ к блочным устройствам с производительностью, близкой к локальному NVMe, при использовании стандартной Ethernet-инфраструктуры — без необходимости развёртывания отдельной фабрики Fibre Channel или специализированного оборудования RDMA. Поддержка NVMe-over-TCP расширяет совместимость Basis Dynamix Enterprise с современными СХД и даёт заказчикам возможность строить высокопроизводительные системы хранения на привычной сетевой инфраструктуре. Управление через виртуальный контроллерВ новом релизе расширен набор инструментов для администрирования и эксплуатации платформы. В частности, была добавлена возможность администрирования Basis Dynamix Enterprise при помощи виртуальных узлов управления (контроллеров). Благодаря этому пользователи могут не выделять физические узлы для управляющего слоя платформы, если её размер не превышает 40 узлов. Также появилась возможность осуществлять резервное копирование управляющего узла классическими инструментами, быстрее проводить его восстановление в случае выхода из строя за счёт хранения узла на СХД, и перемещать виртуальные машины между узлами для управления нагрузкой. Помимо этого, в Basis Dynamix Enterprise 4.6 переработаны интерфейсы создания виртуальных машин и управления зонами, упрощено развёртывание новых инсталляций, расширены сетевые возможности и обновлены сервисные компоненты платформы. «В новом релизе мы сделали ещё один заметный шаг от ручного администрирования к автоматизированному управлению инфраструктурой, независимо от её размеров и сложности. Планировщик ресурсов DRS снимает с администратора рутинную задачу балансировки нагрузки, связанные клоны и тонкие диски сокращают расход дискового пространства, а поддержка NVMe-over-TCP открывает доступ к современным архитектурам хранения без изменения сетевой инфраструктуры. Это последовательное движение к платформе, которая берёт на себя всё больше задач эксплуатации и оставляет администраторам пространство для развития сервисов», — прокомментировал Дмитрий Сорокин, технический директор компании «Базис».

10.06.2026 [13:51], Владимир Мироненко

В 2025 году российский рынок инфраструктурных облачных сервисов вырос почти на третьВ 2025 году российский рынок инфраструктурных облачных сервисов вырос на 29 % — до 96 млрд руб. Платформенные сервисы в публичном облаке росли такими же темпами, достигнув 38 млрд руб., сообщили «Ведомости» со ссылкой на совместное исследование компании Apple Hills Digital и облачных провайдеров Cloud.ru, Selectel и VK Tech. В рамках исследования был проведён опрос 419 компаний из госсектора, а также IT-, телекоммуникационной, промышленной, транспортной, строительной и медиаотраслей. При этом респонденты могли выбрать несколько вариантов ответа. В качестве драйвера роста облачных сервисов 33 % участников опроса указали рост объёмов данных, 32 % — модернизацию бизнеса. 30 % респондентов видят причину роста в увеличении стоимости оборудования, столько же — в росте требований к информационной безопасности. Немного меньше — 27 % — назвали драйвером роста ИИ, и лишь 20 % — импортозамещение. На росте рынка также сказалось то, что всё больше компаний предпочитают параллельно использовать услуги нескольких вендоров. Около 30 % компаний прибегают к услугам двух провайдеров, 15 % компаний пользуются сервисами сразу трёх провайдеров и 1 % — четырёх, хотя почти половина респондентов (42 %) всё же пользуется сервисами только одного провайдера облачных услуг. Согласно исследованию, использование услуг сразу нескольких провайдеров связано со стремлением снизить зависимость от одного вендора, оптимизировать стоимость ресурсов и уменьшить риск изменения тарифов. Как отметили эксперты, использование облаков разных провайдеров — это мировая практика. Компании хотят сочетать преимущества публичного облака с возможностью размещать часть систем и данных в собственном контуре, подтвердили в Yandex Cloud. Рост рынка облачной инфраструктуры в РФ был обеспечен несколькими экономическими факторами, включая недоступность капитала, сложности с поставками и подорожание оборудования для собственной IT-инфраструктуры, утверждают в Apple Hills Digital. В компании прогнозируют дальнейший рост рынка, хотя его темпы снизятся примерно до 20 % в год, что связано со зрелостью рынка и уменьшающейся долей новых клиентов. В Astra Cloud (входит в «Группу Астра») назвали ключевыми драйверами роста, помимо новых проектов, инфляцию и ИИ. В условиях высокой ключевой ставки провайдеры планомерно повышали тарифы, которые отражали рост стоимости оборудования, электроэнергии, аренды ЦОД и зарплат. В «Базисе» объяснили рост облачного рынка развитием цифровизации бизнес-процессов. Появляется всё больше онлайн-сервисов, растёт объём данных, медиафайлов и документов, которые необходимо хранить, обрабатывать и защищать. Также развиваются такие сервисы, как «Госуслуги» и мобильные приложения банков, для работы которых нужны вычислительные мощности и гибкая инфраструктура, которую не всегда рационально разворачивать внутри компании, отметили в компании. Все опрошенные «Ведомостями» эксперты сошлись во мнении, что в 2026 году рынок продолжит расти. По оценкам MWS Cloud, он вырастет на 23 % — до 274 млрд руб.

10.06.2026 [13:42], Руслан Авдеев

Китай готовится потратить $295 млрд на строительство ИИ-инфраструктуры по всей странеВ следующие пять лет Китай рассчитывает потратить ¥2 трлн ($295 млрд) на строительство ИИ ЦОД по всей стране. Это поддержит стратегию Пекина, направленную на то, чтобы превзойти США в технологиях, которые могут определить мирового технологического лидера на десятилетия вперёд, сообщает Bloomberg. Источники сообщают, что ключевые государственные ведомства, включая Государственный комитет по развитию и реформам КНР, работают над проектом создания сети вычислительных хабов. В основном их будут использовать государственные компании вроде China Mobile и China Telecom. Предполагается, что не менее 80 % технологий, включая ИИ-чипы, будет поставляться китайскими производителями уровня Huawei и др., что фактически вытеснит с местного рынка продукцию NVIDIA и AMD. Это амбициозная попытка Пекина создать основу для будущего развития ИИ в КНР. Проект напоминает инициативы прошлых лет, когда госструктуры мобилизовали ресурсы для замещения американских технологий. Кроме того, он, вероятно, является ключевой частью анонсированной ранее в этом году программы «Шесть сетей», посвящённой строительству критически важной инфраструктуры — от объектов водоснабжения и электроэнергетики до мощностей ЦОД. По словам источников, пожелавших остаться анонимными, проект строительства ИИ-хабов пока находится на ранней стадии реализации. Тем не менее Пекин решительно настроен развивать передовые технологии даже на фоне сокращения расходов в других сферах. В основном финансирование будет осуществляться за счёт роста госдолга, в том числе выпуска сверхдолгосрочных государственных облигаций сроком обращения более 10 лет. Кроме того, участие в финансировании примут государственные фонды, инвестирующие в стратегически важные отрасли. Помогут и банковские кредиты, а также частный капитал в том или ином виде. По словам экспертов, единая вычислительная сеть позволит объединить разрозненные ресурсы в регионах и предоставить бизнесу более широкий доступ к высокопроизводительным вычислениям. Также она будет способствовать распространению агентного и физического ИИ.

Источник изображения: Simone Dinoia/unspalsh.com Идея строительства единой вычислительной сети была изложена в последнем пятилетнем плане Китая, действующем до 2030 года, в рамках которого власти намеревались уделить первоочередное внимание развитию инфраструктуры данных. Так или иначе, инвестиционная инициатива выглядит весьма скромно в сравнении с планом американских IT-гигантов выделить $725 млрд на развитие ИИ только в текущем году. Впрочем, ЦОД в Китае обходятся дешевле благодаря меньшим затратам на кадры, инфраструктуру и строительство, а названная сумма не включает частные инвестиции компаний вроде Alibaba Group и Tencent Holdings. Пока нет данных о том, как вычислительная сеть будет взаимодействовать с уже действующими частными площадками. Общая цель заключается в объединении разрозненных объектов в единую сеть, что поможет распространению ИИ в здравоохранении, транспортной сфере, управлении городами и других областях. Помимо ИИ-объектов, включая ЦОД и телеком-инфраструктуру, Китай планирует интегрировать в проект и энергетическую сеть страны. В этом случае общий объём инвестиций может достичь как минимум ¥5 трлн. Не так давно Вашингтон согласился продавать относительно устаревшие ИИ-чипы NVIDIA H200 китайским покупателям, фактически стремясь затормозить технологическое развитие КНР, которая пытается нагнать США в сфере разработки и производства ИИ-ускорителей, пока уступая системам Blackwell минимум на одно поколение. Впрочем, поставки чипов ещё не начались, что косвенно свидетельствует о намерении Пекина заменить некоторые ИИ-мощности оборудованием отечественного производства. В мае проверку безопасности прошли девять типов ИИ-чипов китайского происхождения, включая модели, разработанные Huawei, Alibaba, Shanghai Biren Technology и Moore Threads Technology. Это даёт им «зелёный свет» для более широкого использования в отраслях с повышенными требованиями к защите данных. Кроме того, доступ к более гибким ИИ-ресурсам получат компании из финансового сектора, промышленности, здравоохранения, логистики и других отраслей. По мнению экспертов Bloomberg Intelligence, перспективы монетизации китайского ИИ-сектора по-прежнему остаются под вопросом. Тем не менее такие масштабные вложения будут способствовать развитию экономики страны в целом, а не только отдельных частных компаний, включая Tencent, Alibaba, Baidu, MiniMax и Zhipu AI. Больше всего выиграют местные поставщики чипов, включая Huawei, а NVIDIA, вероятно, останется в стороне.

10.06.2026 [11:40], Руслан Авдеев

Crusoe набрала контрактов почти на 5 ГВт ИИ ЦОД, хотя один из крупных проектов поставлен на паузуСтроитель дата-центров для компаний уровня OpenAI и Microsoft — компания Crusoe заявила, что располагает контрактами на ЦОД общей мощностью почти 5 ГВт, даже с учётом приостановки работ на важной для неё площадке в Вайоминге, сообщает Bloomberg. Crusoe работала с поддерживаемой Blackstone компанией Tallgrass над строительством 1,8-ГВт кампуса в Шайенне (Cheyenne, Вайоминг) для неназванного арендатора. Во вторник она заявила, что по запросу клиента приостановила строительные работы на площадке. Законтрактованные мощности объёмом 4,9 ГВт включают флагманскую площадку проекта Stargate компаний OpenAI и Oracle в Абилине (Abilene, Техас). Первые два здания кампуса ЦОД уже функционируют, ещё шесть находятся в стадии строительства. Общая мощность объекта составит 1,2 ГВт.

Источник изображения: Amina Atar/unsplash.com В марте сообщалось, что ещё один клиент Crusoe — компания Microsoft, договорилась арендовать добавочные мощности на площадке Stargate в Техасе, от которых отказались Oracle и OpenAI. Будут арендованы 700 МВт дополнительных мощностей на новой площадке общей мощностью в 900 МВт. По данным Crusoe, строительные работы на объекте недавно начались. Crusoe также заключила контракты на строительство двух других крупных кампусов в Техасе. Речь идёт об объекте в Клоде неподалёку от Амарилло, где, по некоторым данным, заказчиком выступает Google. При этом Crusoe отказалась называть арендаторов обоих этих проектов, а также арендатора площадки в Вайоминге. Основанная в 2018 году компания специализируется на проектах крупных ЦОД для ИИ-вычислений. В показатель 4,9 ГВт входят мощности для её собственного облачного сервиса. В целом же портфель проектов компании, включая уже заключённые контракты, обсуждаемые с арендаторами проекты строительства площадок и объекты на стадии активного строительства, превышает 40 ГВт.

10.06.2026 [11:12], Андрей Крупин

«Рег.облако» и ispmanager запустили бесплатный облачный сервер для миграции с виртуального хостингаПровайдер «Рег.облако» и разработчик панели управления ispmanager сообщили о расширении программы Free Tier и запуске бесплатного решения для бесшовного перехода с классического хостинга на облачную инфраструктуру «Рег.облака». Вместо ручной настройки через специальную консоль владельцам веб-ресурсов предоставляется готовая облачная среда с панелью ispmanager, через которую можно управлять сайтом, базами данных, почтой и файлами. Техническая начинка предложения включает облачный сервер с 1 виртуальным ядром, 1 Гбайт оперативной памяти и 10 Гбайт на NVMe-диске, публичный IPv4-адрес, резервное копирование и стартовую лицензию ispmanager, созданную специально для клиентов «Рег.облака» в рамках сотрудничества двух компаний. По запросу возможно расширение мощности сервера в два раза выше базовой конфигурации.

Источник изображения: Flipsnack / unsplash.com Программа Free Tier (бесплатный уровень ресурсов) распространяется на всех новых пользователей «Рег.облака», зарегистрировавшихся после 13 апреля 2026 года. Срок предоставления бесплатных облачных ресурсов ограничен 6 месяцами.

10.06.2026 [10:54], Руслан Авдеев

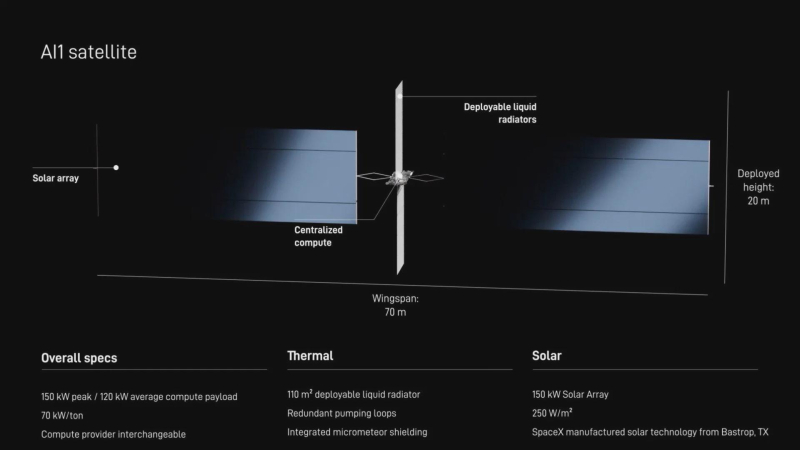

SpaceXAI раскрыла подробности будущих ЦОД на околоземной орбитеКомпания SpaceX изучает амбициозную концепцию развёртывания вычислительной ИИ-инфраструктуры на низкой околоземной орбите с учётом использования возможностей Starship для доставки спутников-ЦОД, сетевых технологий Starlink и спутниковых платформ с питанием от солнечной энергии. Всё это планируется применить для создания «ИИ-спутников», действующих в качестве орбитальных ЦОД, сообщает Converge Digest. В недавно опубликованных материалах компания обнародовала план, который позволит в перспективе перейти от развёртывания отдельных ЦОД с ИИ-возможностями, несущих ускорители на борту, к многогигаваттной орбитальной вычислительной инфраструктуре. Концепция основана на размещении ИИ-нагрузок непосредственно в космосе, где в избытке имеется солнечная энергия, а терморегуляцию можно организовать с помощью специальных радиаторов. По имеющимся данным, изначально ИИ-спутникам будет обеспечено по 120–150 кВт вычислительных мощностей — это приблизительный эквивалент одной современной стойки на основе систем класса NVIDIA GB300. Размах крыльев спутника составит 70 м, высота в развёрнутом состоянии — 20 м, солнечные элементы обеспечат мощность 250 Вт/м2, а двусторонние радиаторы — 1400 Вт/м2. Спутники будут использовать большие солнечные панели, основанные на технологиях, изначально разрабатывавшихся для нового поколения спутников Starlink. Платформы-ЦОД предназначены не для обеспечения связи — они будут состоять из солнечных батарей, радиаторов, вычислительного оборудования и оптических интерконнектов. По словам Илона Маска (Elon Musk), радиатор площадью 110 м2 будет использовать систему жидкостного охлаждения с «резервными насосными контурами», вероятно для поддержания циркуляции жидкости. Какой именно, не указывается, но эксперты уверены, что это не вода, поскольку темературы её замерзания и кипения для систем в вакууме вряд ли оптимальны. Эксперты предполагают, что будет использоваться аммиак, как на МКС, который не замерзает даже при низких температурах и оптимально подходит для сбора тепла и рассеивания его в космос. Вполне возможно, что спутники SpaceX будут использовать именно такую технологию с радиаторами, направленными в сторону от Земли и от Солнца. По мнению Маска, для ИИ-спутников не требуется «никакой магии». В основе технологии для спутников Starlink V3, которые отправятся в космос в конце 2026 года. При этом Маск подчеркнул, что ИИ-спутник намного проще, чем спутник Starlink, имеющий гигантские фазированные антенные решётки, параболические антенны, множественные лазерные каналы связи и пр.

Источник изображения: SpaceX По словам представителей SpaceX, аппараты будут работать на высотах 600–800 км и окажутся связаны как напрямую друг с другом с помощью лазеров, так и через возможности группировки Starlink. По оценкам компании, задержка для наземных пользователей может оказаться довольно низкой из-за относительной близости спутников к земной поверхности. Потенциально размещение вычислительных мощностей в космосе добавит лишь несколько миллисекунд к задержке. Подчёркивается, что ключевые аппаратные средства уже разрабатываются в недрах SpaceX. Starship позволит значительно увеличить объёмы доставки грузов на орбиту, а Starlink обеспечивает рабочую модель для взаимодействия больших группировок спутников и их оптической связи в космосе. Компания отметила, что планирует создать мощности для производства солнечных панелей и ИИ-спутников в Техасе. По мнению Маска, инициатива является частью более масштабного плана по использованию солнечной энергии за пределами поверхности Земли. По его словам, ограниченная доступность земельных участков, погодные условия и дефицит энергетических мощностей не позволяют в достаточной мере масштабировать ИИ-инфраструктуру непосредственно на планете. Полный переход в космос должен обеспечить ИИ-системам значительно больше солнечной энергии, одновременно избавив их от многих ограничений наземной инфраструктуры. Не так давно SpaceX подала заявку на размещение в космосе миллион спутников-ЦОД. При этом компания столкнулась с противодействием AWS, которая, в лице связанной Blue Origin, похоже, сама имеет схожие планы.

09.06.2026 [22:37], Андрей Крупин

Orion soft представил платформу StarGuard AI для безопасной работы с ИИРоссийский разработчик Orion soft выпустил шлюз безопасности StarGuard AI, предназначенный для централизованной и контролируемой работы с большими языковыми моделями (LLM) в корпоративной среде. Решение может быть актуально для крупного бизнеса, финансового сектора, промышленности, государственных организаций и компаний, внедряющих корпоративных ИИ-ассистентов, агентские системы и внутренние платформы на базе искусственного интеллекта. StarGuard AI функционирует как обратный прокси-сервер (Reverse Proxy) между пользователями и LLM-провайдерами. Каждый запрос и ответ проходят через набор детекторов до выхода за пределы защищённого контура. Шлюз помогает блокировать чувствительные данные, jailbreak- и prompt-инъекции, токсичный, запрещённый или нецелевой контент в ИИ-чатах, ассистентах, сервисах поддержки и корпоративных помощниках. Благодаря этому программный комплекс снижает репутационные риски во внутренних и клиентских ИИ-сервисах, закрывает риски утечки данных, контролирует разрешённые сценарии использования, централизует доступ к нескольким моделям и даёт прозрачный аудит всех событий.

Источник изображения: Steve Johnson / unsplash.com Решение позволяет подключать облачные и локальные LLM, включая ChatGPT, Claude, DeepSeek, GigaChat, YandexGPT, а также любые локальные модели. Поддерживается интеграция с OpenWebUI, IDE, AI-агентами и корпоративными платформами. «Корпоративные ИИ-сервисы постепенно становятся частью критической IT-инфраструктуры, а значит требуют сопоставимого уровня контроля и защиты. StarGuard AI создаёт единый контур безопасной работы с LLM и позволяет организациям внедрять ИИ-инструменты без потери контроля над данными с политиками безопасности и нормативными требованиями», — поясняют разработчики продукта.

09.06.2026 [18:19], Руслан Авдеев

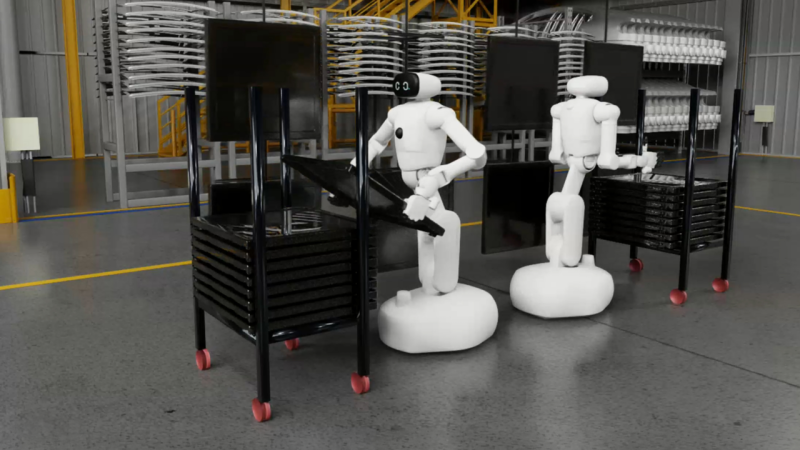

NVIDIA поможет SK hynix, Naver, Doosan, SK Telecom и LG расширить ИИ-инфраструктуру Южной КореиNVIDIA анонсировала новые партнёрства с южнокорейскими технологическими гигантами. В их числе — поставщик чипов памяти SK hynix, интернет-гигант Naver, транснациональный конгломерат Doosan Group, а также SK Telecom и LG, сообщает Silicon Angle. Сделки последовали за поездкой в Южную Корею главы NVIDIA Дженсена Хуанга (Jensen Huang). Прибыв в конце прошлой недели, он провёл выходные за встречами с руководителями южнокорейских технологических компаний. SK hynix подписала с NVIDIA соглашение о многолетнем технологическом партнёрстве, основное внимание в рамках которого уделяется совершенствованию чипов памяти нового поколения для использования в передовых ИИ ЦОД. В рамках договора компания будет взаимодействовать с NVIDIA для обеспечения стабильных поставок памяти для ИИ-индустрии. Кроме того, она попытается расширить присутствие в смежных нишах «персонального ИИ» и «физического ИИ» — например, в сфере автономной робототехники и транспорта. По словам Хуанга, стабильные поставки памяти имеют ключевое значение для ускорения строительства и масштабирования ИИ-фабрик, которые возглавят новую промышленную революцию под предводительством ИИ. Также партнёры намерены сотрудничать в области «технологий симуляции» для разработки полупроводников. SK hynix будет применять библиотеку NVIDIA CUDA-X и фреймворк PhysicsNeMo для повышения скорости и эффективности симуляций, используемых при разработке и производстве передовых чипов. Это включает технологии автоматизированного проектирования (т. н. Technology Computer-Aided Design, TCAD) для анализа характеристик полупроводниковых техпроцессов и технологии вычислительной литографии для создания схем микрочипов.

Источник изображения: NVIDIA Дополнительно родственная SK hynix компания SK Telecom рассчитывает построить в Южной Корее новое ИИ-облако гигаваттного масштаба на основе ИИ-ускорителей и инфраструктурных решений NVIDIA. Первый из нескольких ИИ ЦОД в составе этого облака должен быть введён в эксплуатацию в начале следующего года. С Naver и Doosan компания тоже договорилась о дополнительных проектах в сфере ИИ ЦОД. В случае с Naver взаимодействие стартует в Седжоне (Sejong), где расположен один из крупнейших в Азии ИИ ЦОД — Naver GAK Sejong. Компании намерены нарастить возможности объекта, а позже заняться строительством дополнительных ИИ-фабрик гигаваттного уровня, хотя будущее этих планов зависит от того, сможет ли Naver обеспечить необходимые закупки оборудования и доступ к электроэнергии. Doosan, разрабатывающая интеллектуальную робототехнику и выпускающая компоненты для GPU NVIDIA, поможет последней задействовать её энергетические решения в своих платформах для ЦОД. Doosan же рассчитывает применять технологии физического ИИ NVIDIA в своих роботах. Наконец, NVIDIA и LG Group строят ИИ-фабрику для ускорения развития нового поколения бизнесов LG, драйвером которых выступит ИИ, — от робототехники до автономного вождения, технологий ЦОД и облачных GPU-сервисов. ИИ-фабрика обеспечит LG инфраструктурой для обучения ИИ, симуляций, оценки и внедрения ИИ-приложений в ключевых сегментах бизнеса. Совместно компании объединят разработку ИИ-моделей, генерацию данных для физического ИИ, моделирование и обучение робототехники, развёртывание решений на периферии и создание цифровых двойников в масштабах целых предприятий в единый рабочий процесс для создания систем физического ИИ. Партнёрство с южнокорейскими компаниями должно помочь расширить присутствие NVIDIA в Южной Корее — одном из мировых технологических лидеров. Кстати, SK hynix и её конкурент Samsung Electronics являются двумя из трёх крупнейших производителей чипов памяти в мире, продукция которых имеет жизненно важное значение для ИИ ЦОД. В ноябре 2025 года сообщалось, что NVIDIA продаст Южной Корее 260 тыс. ускорителей для создания суверенной ИИ-инфраструктуры. |

|