Материалы по тегу: а

|

08.12.2022 [14:24], Сергей Карасёв

Закрыта $11-млрд сделка по продаже одного из крупнейших операторов ЦОД Switch — компания станет частнойDigitalBridge Group и IFM Investors сообщили о завершении сделки по поглощению одного из крупнейших операторов дата-центров — компании Switch. Соответствующее соглашение было заключено в мае 2022 года. Продажа осуществлена из расчёта $34,25 за одну ценную бумагу Switch. Общая сумма сделки с учётом долговых обязательств составила $11 млрд денежными средствами — это одна из крупнейших сделок на рынке ЦОД в этом году. После завершения слияния Switch превратится в частную компанию, а продажи её акций на Нью-Йоркской фондовой бирже прекратятся. Ранее этот оператор ЦОД торговался под тикером SWCH. Switch управляет крупными американскими площадками Prime в Рино, Лас-Вегасе, Гранд-Рапидсе и Атланте. В 2021 году компания открыла пятый кампус ЦОД в Техасе и сообщила, что планирует до 2030 года построить более 1,02 млн м2 дополнительных площадей.

Источник изображения: Switch «Мы рады приступить к следующему этапу развития Switch в партнёрстве с DigitalBridge и IFM Investors, двумя ведущими инвестиционными компаниями в области цифровой инфраструктуры. Благодаря своему стратегическому опыту и ресурсам Switch имеет отличные возможности для удовлетворения растущего спроса клиентов на наиболее передовую и экологически устойчивую инфраструктуру дата-центров в мире», — отмечает Switch. В настоящее время активы DigitialBridge на рынке ЦОД, помимо компании Switch, включают DataBank, Scala Data Centers, Landmark Dividend LLC, Vantage Data Centers и AtlasEdge. При этом Switch также сотрудничает с FedEx в рамках проекта по созданию периферийных ЦОД в США. Ожидалось, что в этом году состоится ещё одна крупная сделка по продаже другого оператора ЦОД со схожим названием, Global Switch, который оценён в $10 млрд.

21.10.2022 [13:26], Сергей Карасёв

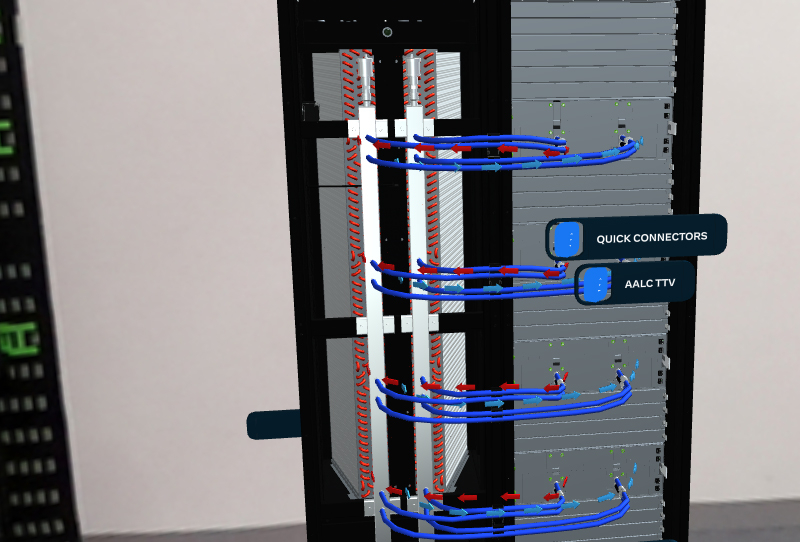

Meta✴ готова к массовому внедрению СЖО в своих дата-центрахКомпания Meta✴ в ходе саммита OCP (Open Compute Project) рассказала о планах по внедрению жидкостного охлаждения в своих ЦОД. Речь идёт об использовании гибридной системы AALC (Air-Assisted Liquid Cooling), предусматривающей совмещение компонентов воздушного охлаждения и жидкостного контура. Отмечается, что по мере развития машинного обучения и метавселенных всё острее встаёт проблема эффективного отвода тепла от оборудования. Дело в том, что внедряемые алгоритмы требуют больших вычислительных мощностей, что приводит к увеличению энергозатрат. Система AALC предназначена для охлаждения серверов в ЦОД, которые изначально могли быть и не спроектированы под использование СЖО. Отметим, что QCT уже представила аналогичное, полностью интегрированное решение.

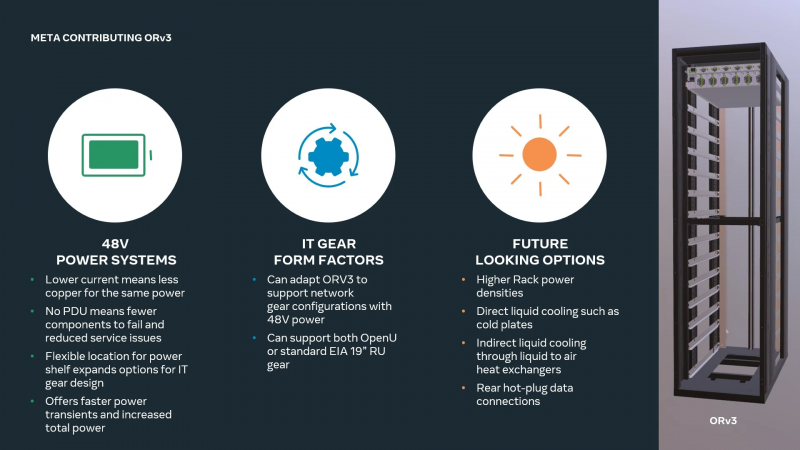

Источник изображений: Meta✴ AALC совместима со стойкой Open Rack v3 (ORV3), которая, впрочем, может интегрироваться и с другими вариантами СЖО. Система AALC в исполнении Meta✴ использует водоблоки для самых горячих компонентов, которые подключаются к отдельной стойке с помпами и прочим оборудованием. На задней панели или двери стойки располагается теплообменник, позволяющий охлаждать жидкость за счёт воздуха, циркулирующего в ЦОД. Прототипы решения справляются с охлаждением оборудования мощностью до 40 кВт на стойку. ORV3 также предлагает общую архитектуру стойки и подсистемы питания для устранения разрыва между нынешними и будущими ЦОД. Обеспечивается широкий спектр вариантов использования, включая поддержку Grand Teton. Модуль питания для общей на всю стойку шины 48 В DC не имеет жёстко определённого расположения и может устанавливается в любом месте стойки, что обеспечивает гибкость конфигурации. При этом он может быть не один, так что пиковая мощность может достигать 30 кВт на стойку. Усовершенствованный ИБП обеспечивает работу в течение 4 мин. при мощности 15 кВт (против 1,5 мин. у решения предыдущего поколения). Этот блок также может монтироваться в любом месте стойки, а дополнительно возможно применение второго резервного блока. Всё это позволит Meta✴ уже сейчас развёртывать в ЦОД высокоплотную инфраструктуру для ИИ и иных требовательных к питанию и охлаждению решений.

07.10.2022 [19:02], Руслан Авдеев

Google запустила оптоволоконный подводный кабель Grace Hopper — между США и Европой появился канал на 350 Тбит/сКомпания Google ввела в эксплуатацию новый подводный оптоволоконный кабель Grace Hopper, который обеспечивает соединение сетевой инфраструктуры США, Великобритании, а также Испании. Как сообщает DataCenter Dynamics, кабель проложен от Нью-Йорка до британского города Бьюд в графстве Корнуолл, а ответвление также идёт в испанский Бильбао. Grace Hopper, названный в честь американской учёной и контр-адмирала Грейс Брюйстер Мюррей Хоппер (Grace Brewster Murray Hopper), состоит из 16 оптоволоконных пар и обеспечивает пропускную способность 350 Тбит/с по основной магистрали протяжённостью 6354 км. Как сообщают средства массовой информации, новый кабель начал работать 27 сентября, о чём Google уже оповестила Федеральную комиссию связи США (FCC). Это первый подводный кабель, построенный для связи США и Великобритании с 2003 года, дополнительно имеется ответвление в испанский Бильбао для обеспечения связи с облачным регионом в Мадриде.

Источник изображения: Google В реализации проекта участвовала Lumen Technologies, помимо инвестиций ответственная за наземные узлы связи на обоих концах кабеля и наземную инфраструктуру. Для обеспечения оптимального качества связи при сбоях различной природы кабель Grace Hopper использует оптоволоконную коммутацию. Предусмотрена связь и с другими кабелями Google. 10 сентября прошлого года выход кабеля на сушу обеспечен в Испании, 14 сентября 2021 года — в Корнуолле.

21.09.2022 [19:39], Алексей Степин

NVIDIA представила новые сверхкомпактные модули Jetson Orin NanoКомпания NVIDIA полна решимости занять лидирующие позиции на рынке робототехники: помимо новой платформы IGX, предназначенной для «умной» промышленности и медицины, на конференции GTC 2022 она представила и другие новинки в этой сфере. В частности, анонсированы новые модули в серии Jetson. Если в основу IGX лёг старший вариант, Jetson AGX Orin (Arm Cortex-A78AE + 1792 ядра Ampere + 56 тензорных ядер), то для более простых сценариев, требующих пониженного энергопотребления, он подходит не лучшим образом. Но именно для таких случаев предназначено пополнение серии — Jetson Orin Nano.

NVIDIA Jetson Orin Nano 8GB (слева) и 4GB. Здесь и далее источник изображений: NVIDIA Архитектурно Orin Nano похож на старшего собрата, но вычислительных ресурсов у него поменьше: 6 ядер Arm Cortex-A78AE и кластер GPC Ampere, состоящий из 1024 ядер CUDA и 32 тензорных ядер. Имеется отдельный процессор управления питанием, широко развиты подсистемы различных шин, от SPI, CAN и I2C до USB 3.2 Gen2, Ethernet и PCIe 3.0.

Архитектура процессора Orin Nano Доступны новые модули будут в самом начале следующего года по цене от $199, причём изначально компания планирует выпустить два варианта, с 4 и 8 Гбайт оперативной памяти LPDDR5. Старший вариант будет сконфигурирован в рамках теплопакета 7–15 Вт, его пиковая производительность в INT8 составит 40 Топс. Младший вариант с усечённой вдвое конфигурацией GPU будет ограничен 5–10 Вт и 20 Топс.

Характеристики семейства Jetson Orin Nano Модули Orin Nano совместимы по контактам с Orin NX и имеют тот же форм-фактор, 70 × 45 мм SODIMM, но за счёт использования более продвинутой архитектуры в задачах инференса новинки могут опережать предшественников в 80 раз. Благодаря обновлению фирменного SDK начать разработку приложений под Orin Nano заказчики смогут уже сейчас, пусть и в режиме эмуляции.

21.09.2022 [01:10], Алексей Степин

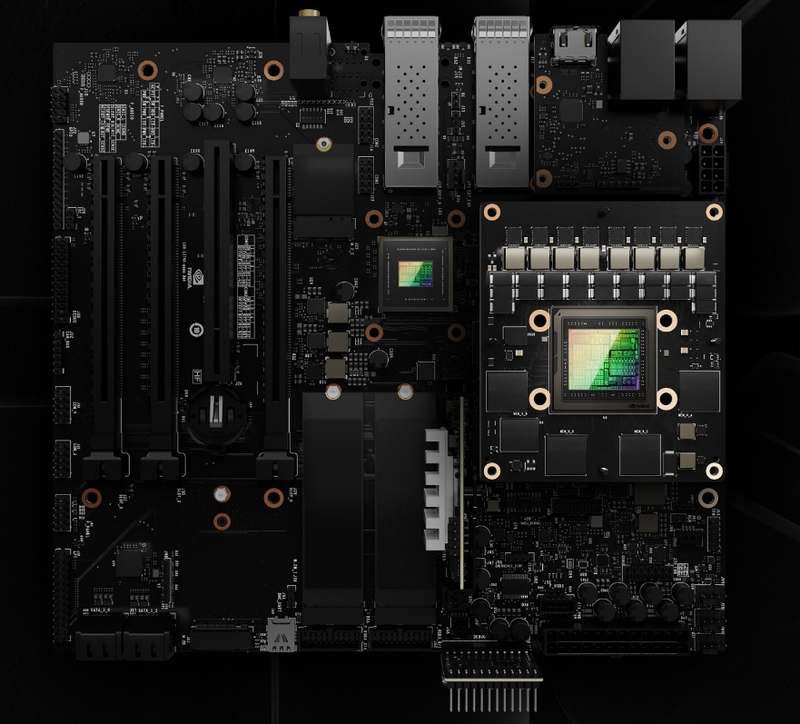

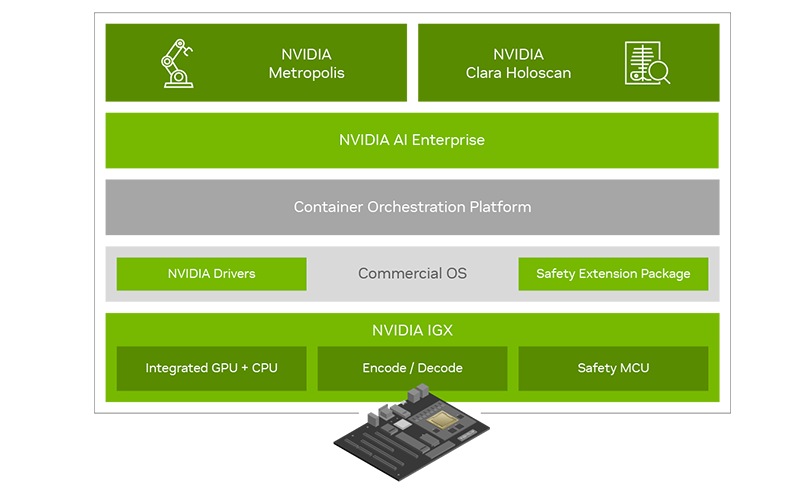

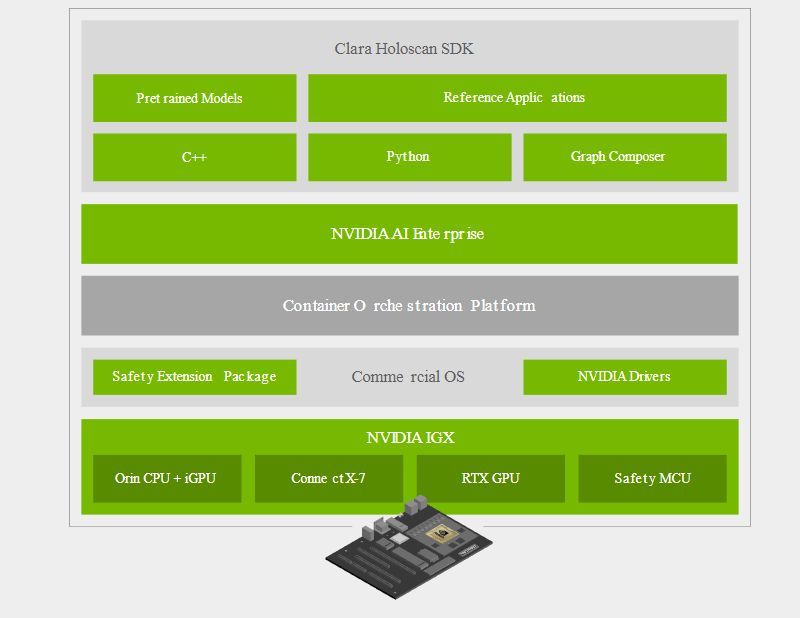

NVIDIA представила платформу IGX для «умной» промышленности и медициныПомимо новых GPU с архитектурой Ada компания NVIDIA на конференции GTC 2022 анонсировала множество новинок и не последней из них стала новая периферийная платформа IGX, призванная вывести «умную» промышленность на новый уровень. Главный упор в IGX сделан на обеспечении повышенной безопасности, причём как информационной, так и физической. Использовать совместный труд роботов в промышленности пытаются уже давно, но до недавних пор такие решения были нестандартными и весьма дорогостоящими. IGX призвана обеспечить безопасность, стандартизацию и высокий уровень производительности, достаточный для современной робототехники. Сердцем платформы IGX являются высокоинтегрированные модули серии Jetson AGX Orin, сочетающие в себе достаточно мощный процессор общего назначения, GPU-ускоритель, ускорители ИИ, машинного зрения, а также отдельный сопроцессор sMCU, отвечающий за обеспечение безопасности в проактивном режиме. Последний работает в комплексе с новыми программными расширениями, легко интегрируемыми в большинство коммерческих ОС благодаря сопутствующему программному стеку NVIDIA AI Enterprise.

NVIDIA IGX. Здесь и далее источник изображений: NVIDIA Что касается проактивной защиты, то, к примеру, получив сигнал с видеокамер о том, что человек приближается к «зоне ответственности» роботов, система автоматически изменит траекторию движения последних, предупредит сотрудников, а также на основании полученных данных скорректирует поведение роботов в дальнейшем. Также с помощью технологии «цифровых двойников» можно будет провести симуляцию, дабы заранее выяснить возможные точки потенциально опасных столкновений машин и людей.

NVIDIA IGX сделает подобные сценарии безопасными Производительность центрального модуля IGX составляет 275 Топс в режиме INT8. Обеспечение сетевых возможностей возложено на плечи современного сетевого адаптера ConnectX-7, гарантирующего прецизионные тайминги, позволяющие использовать платформу не только в промышленности, но и в медицине, где вопросы безопасности и точности жизненно важны. Естественно, индустрия нового поколения не может обойтись без унифицированных средств управления и обеспечения кибербезопасности. Весь комплекс решений на базе новой платформы IGX может развёртываться и управляться с единой консоли с помощью облачной системы NVIDIA Fleet Command. За безопасность при этом отвечает выделенный контроллер. На более высоком уровне за интеграцию новой платформы в единую экосистему отвечает фреймворк NVIDIA Metropolis, с помощью которого можно создавать по-настоящему крупномасштабные комплексы, включая целые «умные города».

Программно-аппаратный состав новой платформы Отдельного упоминания заслуживает то, что новая платформа NVIDIA IGX избрана в качестве основы разработчиками медицинских систем, в частности, цифровой и робо-хирургии, такими как Activ Surgical, Moon Surgical и Proximie. Это стало возможным как благодаря аппаратным свойствам платформы, таким как низкая латентность и гарантированное время отклика, так и сочетанию фреймворков MONAI и Clara Holoscan.  Первый позволяет обучать специфические ИИ-модели на основании массивов медицинских данных. Эти модели затем могут интегрироваться с помощью Clara Holoscan SDK в реальные системы ультразвукового сканирования, эндоскопии или робохирургии. Помимо встроенных средств ускорения IGX, Clara Holoscan поддерживает и внешние ускорители NVIDIA RTX A6000, а технология Rivermax обеспечит передачу видеоданных для робота-хирурга на скорости 100 Гбит/с прямо в набортную память GPU.  Комплекты разработчика IGX Orin будут доступны заказчикам в начале следующего года. Уже достигнуты соглашения с производителями встраиваемого оборудования ADLINK, Advantech, Dedicated Computing, Kontron, Leadtek, MBX, Onyx, Portwell, Prodrive Technologies и YUAN; уже испытывает новинку в деле Siemens. Также NVIDIA сотрудничает с Canonical, Red Hat и SUSE в целях обеспечения долговременной поддержки платформы, срок которой составит не менее 10 лет.

08.09.2022 [23:04], Игорь Осколков

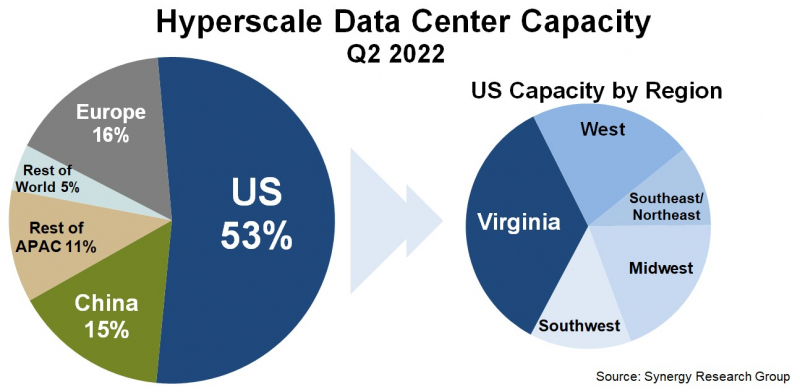

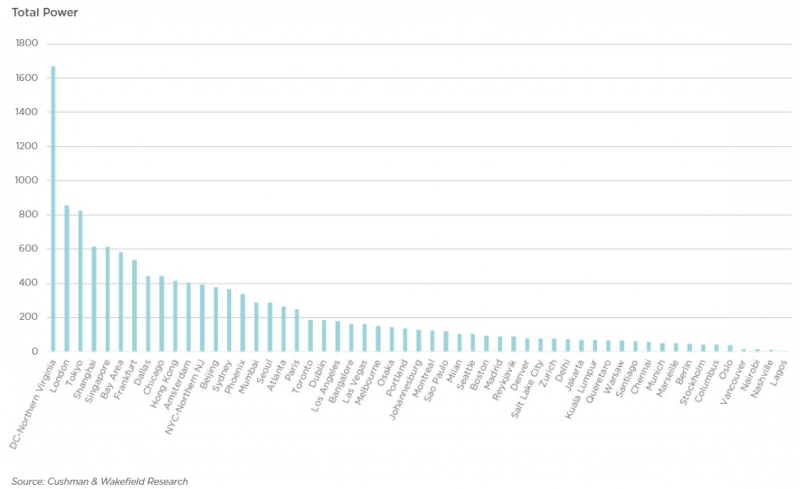

Серверная Вирджиния: один-единственный штат США всё ещё обгоняет по ёмкости сверхкрупных дата-центров и Европу, и КитайПо оценкам аналитиков Synergy Research Group, к концу II квартала 2022 года число дата-центров гиперскейлеров превысило 800 шт., а к концу 2026 года их станет в полтора раза больше. Причём расти будет не только количество таких ЦОД, но и их мощность. При этом 53 % ёмкости ЦОД гиперскейлеров приходится на США, а оставшаяся доля практически поровну поделена между Европой, Китаем и остальным миром. Наиболее крупные игроки на этом рынке — «большая тройка» облачных провайдеров (Amazon, Google, Microsoft). У каждой из этих компаний имеется более 130 дата-центров, причем не менее 25 в каждом из трёх основных регионов, Североамериканском, Азиатско-Тихоокеанском и Европейском. По мощности дата-центров лидируют компании Amazon, Google, Microsoft, Facebook✴, Alibaba и Tencent. Всего же в исследовании Synergy Research Group учитывались дата-центры 19 крупнейших компаний, оказывающих облачные и иные интернет-услуги. По мощности дата-центров лидируют компании Amazon, Google, Microsoft, Facebook✴, Alibaba и Tencent. При этом, как и прежде, более трети мощностей в США приходится на один-единственный штат — Вирджинию, которая обгоняет по этому показателю Европу и Китай. Здесь находится так называемая Аллея дата-центров, охватывающая округи Лаудон (Loudoun), Принс-Уильям (Prince William) и Фэрфакс (Fairfax). ЦОД в основном концентрируются вокруг городов Эшберн (Ashburn), Стерлинг (Sterling), Манассас (Manassas) и Шантийи (Chantilly). Суммарная ёмкость ЦОД в штате достигла 1,7 ГВт. В частности, Amazon именно здесь размещает значительную часть своих ЦОД. Другими крупными игроками на локальном рынке являются Microsoft, Meta✴, Google, ByteDance. Столь привлекательной для операторов ЦОД Вирджиния стала в силу доступности площадей и энергии, развитой инфраструктуры, а также особенностей местного законодательства, в том числе налоговых послаблений. Правда, теперь местные жители жалуются на «катастрофический шум» от дата-центров, а возможностей энергосети стало не хватать. Что касается других регионов, то в Европе ведущими рынками для гиперскейлеров остаются Ирландия и Нидерланды, где в последнее время также наметился кризис — обе страны больше не рады крупным игрокам, которые один за другим отменяют или приостанавливают проекты по созданию и развитию ЦОД. Китайский рынок остаётся относительно изолированным, поскольку он включает по большей части дата-центры местных IT-гигантов: Alibaba, Tencent и Baidu. В целом же аналитики прогнозируют, что в течение следующих пяти лет важность ключевых на текущий момент рынков ЦОД несколько снизится.

06.09.2022 [22:47], Алексей Степин

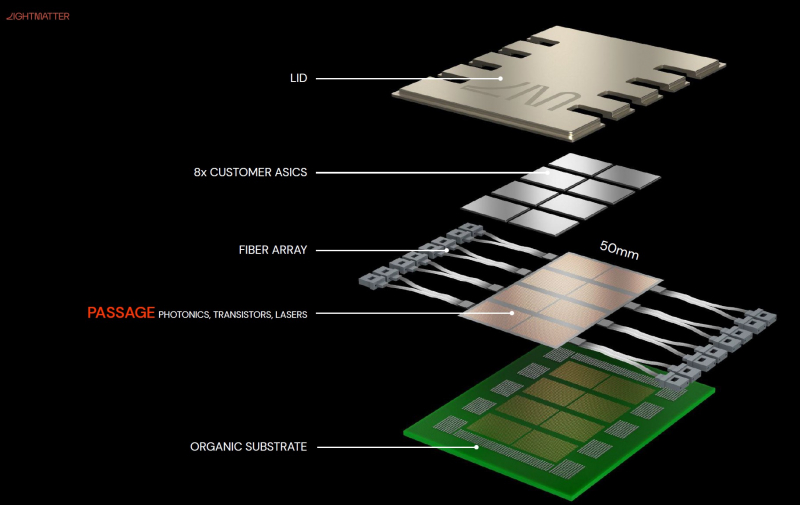

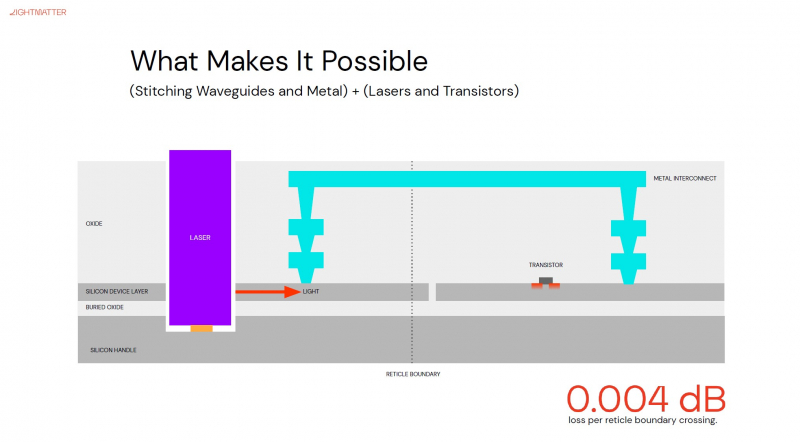

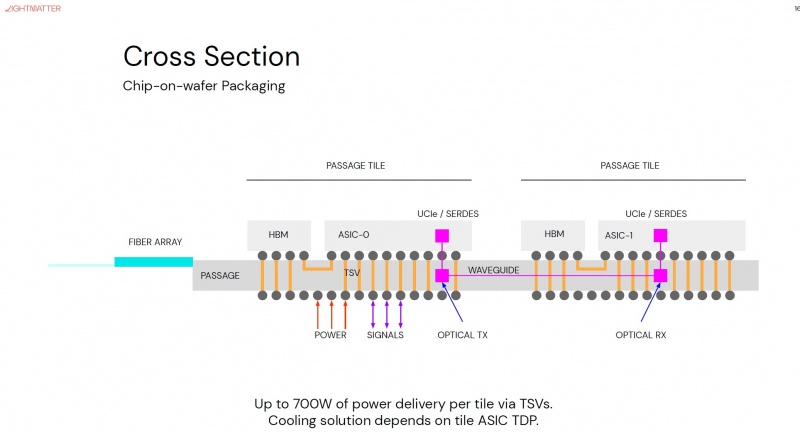

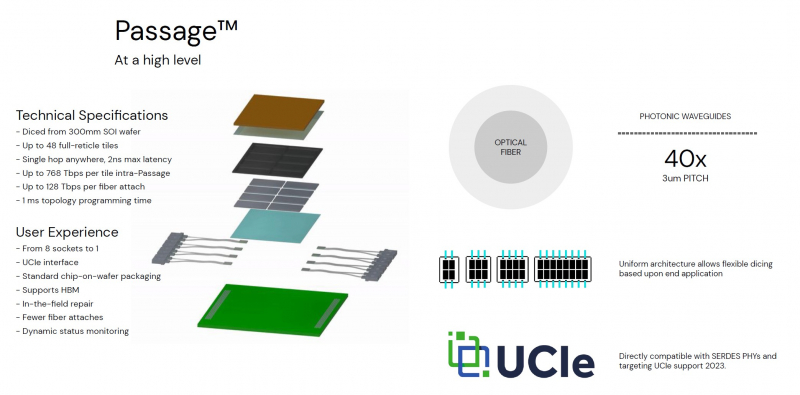

Кремниевая фотоника Lightmatter Passage объединит чиплеты на скорости 96 Тбайт/сНа конференции Hot Chips 34 компания Lightmatter, занимающаяся созданием фотонного ИИ-процессора, рассказала о своей новой разработке, Lightmatter Passage, открывающей для чиплетов эру фотоники. Как известно, переход на чиплеты позволил разработчикам сложных чипов сравнительно малой кровью обойти ограничения, накладываемые технологиями на создание монолитных кристаллов большой площади. Однако современный высокоскоростной межчиплетный интерконнект всё равно весьма сложен и потребляет сравнительно много энергии. И по мере роста количества чиплетов на общей подложке проблема будет лишь обостряться. Но технология Lightmatter Passage, призванная заменить электрический интерконнект оптическим, позволит эту проблему обойти. По сути, Passage — универсальная кремниевая прослойка, содержащая в своём составе лазеры, оптические модуляторы, фотодетекторы, волноводы, а также классические транзисторы для сопутствующей логики. Поверх этой прослойки Lightmatter и предлагает размещать чиплеты любой архитектуры. Электрическая часть Passage имеет изменяемую конфигурацию и в текущей реализации поддерживает установку до 48 чиплетов (в виде матрицы 6×8). Производится такая прослойка из 300-мм кремниевой пластины SOI, верхний и нижний слои Passage имеют классические контакты для чиплетов и установки на PCB соответственно. При этом максимальная подводимая электрическая мощность может достигать 700 Вт. Вся же коммуникация чиплетов между собой происходит внутри и является оптической. Матрица фотонных волноводов, плотность которой в 40 раз выше, чем у традиционных оптоволоконные технологий, обеспечивает латентность одного перехода на уровне менее 2 нс. Как заявляют разработчики, расстояние между чиплетами при этом роли не играет — для любого сочетания пары точек «входа» и «выхода» сигнала значение задержки одинаково. Высокая плотность волноводов позволяет «накормить» каждый чиплет потоком данных до 96 Тбайт/с, а внешние каналы Passage позволяют связать чипы с другими компонентами системы на скоростях до 16 Тбайт/с. Основой данной технологии является фирменная разработка компании, позволяющая точно «сшивать» в пределах нескольких слоев SOI-кремния электрические соединения с многочисленными волноводами. Уже существующая в кремнии тестовая реализация Passage потребляет 21 Вт, позволяет устанавливать до 48 чиплетов площадью по 800 мм2, обеспечивает каждое посадочное место 32 каналами с пропускной способностью 1024 Тбит/с, причём топологию интерконнекта можно динамически менять. Тестовая подложка Passage, полученная из 300-мм пластины, содержит 288 лазеров мощностью 50 мВт каждый. Всего в состав системы входит 150 тыс. компонентов, и это заявка на абсолютный рекорд для фотонных чипов. Кроме того, новая технология совместима со стандартом UCIe — говорится о скорости 32 Гбит/с на линию. Впрочем, в случае простого SerDes-соединения, как считают создатели, этот показатель можно поднять до 112 Гбит/с.

06.09.2022 [16:16], Руслан Авдеев

Google ввела в эксплуатацию 150-Тбит/с подводный кабель Equiano длиной 15 тыс. км и стоимостью $1 млрдКомпания Google помогла повысить качество связи между Западной Европой и Южной Африкой, введя в эксплуатацию 150-Тбит/с подводный интернет-кабель Equiano стоимостью $1 млрд. Как сообщает Datacenter Dynamics, кабель назван в честь рождённого в Нигерии писателя Олауда Эквиано (Olaudah Equiano). Протяжённость кабеля, проложенного из Португалии в Южную Африку, составляет 15 тыс. км, он имеет 9 ответвлений и состоит из 12 оптоволоконных пар с поддержкой SDM (Space Division Multiplexing). Месяц назад завершилось приземление кабеля в окрестностях Кейптауна, а на прошлой неделе Google провела церемонию открытия. В Google утверждают, что его эксплуатация позволит создать 1,6 млн рабочих мест, а цена передачи данных в регионе должна упасть на 16-21 %. Проект, изначально анонсированный в 2019 году, является одним из крупнейших в портфолио подводных интернет-кабелей Google — он проложен от Португалии вдоль западного побережья африканского континента.

Источник изображения: Google Это один из шести кабелей, принадлежащих Google из числа уже действующих и находящихся в разработке, и девятнадцатый по счёту из тех, в создание которых Google инвестировала. В точках ответвлений к кабелю получили возможность подключиться и другие страны, включая Намибию и Того. Также планируется подключение Нигерии, Демократической республики Конго и островов Св. Елены. Весной сообщалось, что Google также намерена проложить подводный транстихоокеанский интернет-кабель Topaz от канадского Ванкувера до Миэ и Ибараки в Японии.

01.08.2022 [15:52], Руслан Авдеев

На крупнейшем в мире рынке ЦОД наметился катастрофический недостаток электроэнергии — дата-центрам не хватает ЛЭПРынок ЦОД Северной Вирджинии продолжают преследовать неприятности. Помимо того, что местные жители активно выступают против старых и новых дата-центров, в местной округе наметилась масштабная нехватка электроэнергии. Как сообщает The Register, в регионе буквально не хватает линий электропередач для снабжения всех ЦОД энергией. По данным Digital Realty, владеющей и обслуживающей более 290 ЦОД, местная энергоснабжающая компания Dominion Energy разослала оповещение ключевым местным потребителям, сообщив, что проблемы с электроснабжением в регионе закончатся не раньше 2026 года. При этом проблема заключается не в нехватке генерирующих мощностей, а именно в дефиците линий электропередач для достаточного энергообеспечения ЦОД. Текущая ёмкость дата-центров в штате составляет порядка 1,7 ГВт.

Источник изображения: Matthew Henry/unsplash.com Округ Лаудон (Loudoun County) фактически является крупнейшим в мире хабом для дата-центров с общей полезной площадью ЦОД в миллионы квадратных метров. Округ нередко называют «ключевым игроком» в мировой цифровой экономике. Одни только налоги на недвижимость от сектора ЦОД должны составить в фискальном 2023 году почти $600 млн — этого достаточно, чтобы покрыть все расходы властей округа. Проблемы с энергоснабжением могут означать, что многие планируемые проекты переедут в соседние округа Принс-Уильям (Prince William) и Фокир (Fauquier), а то и вовсе в соседний штат Мэриленд. Dominion Energy как минимум частично обслуживает и Принс-Улильям, а вот округ Фредерик в Мэриленде подключен к другой энергосети.

Источник изображения: Álvaro Serrano/unsplash.com Известно, что беспрецедентный рост нагрузки на сеть Dominion начался в 2018 году на фоне стремительного развития дата-центров и всё ещё не остановился, поэтому в существующие планы развития энергосетей придётся вносить корректировки. На днях Dominion Energy признала, что не сможет обслуживать потребности города Эшберна (Ashburn) в округе Лаудон, где расположена т.н. «Аллея дата-центров». Это будет означать не только остановку уже стартовавших многомиллиардных проектов строительства ЦОД, но и снижение налоговых поступлений. Как сообщает портал DataCenter Dynamics, по прогнозам Wells Fargo, компания может остановить поставки энергии новым ЦОД до 2025 или 2026 года — если проектам, до завершения строительства которых осталось не более полугода, энергии может хватить, то совсем новые объекты, возможно, электричества не получат, несмотря на ранее полученные от Dominion гарантии. А строительство ЦОД, запланированных на 2023-2024 годы, может быть значительно отложено. Впрочем, в Wells Fargo считают, что с нехваткой электричества могут в скором времени столкнуться и уже существующие в регионе кампусы ЦОД.

28.07.2022 [18:12], Руслан Авдеев

Европейские дата-центры хотят снизить потребление воды до 400 мл/кВт·ч, но только к 2040 годуГруппа Climate Neutral Data Centre Pact (CNDCP), объединяющая 90 % европейских операторов ЦОД, предложила добровольно снизить потребление воды до 400 мл на 1 кВт·ч к 2040 году и добиться углеродной нейтральности намного раньше 2050 года. Соответствующая цель уже поставлена ЕС, но операторы намерены добиваться её без законодательного принуждения и с опережением графика, — сообщает Data Center Dynamics. Хотя использование воды способно оказать значительное влияние на экологию, этот фактор часто недооценивают, учитывая только расход энергии. При этом многие ЦОД активно используют воду для охлаждения оборудования, благодаря чему снижается расход всё той же энергии, но растут затраты самой жидкости, что имеет критическое значение для некоторых регионов. Группу CNDCP сформировали в 2021 году с намерением достичь углеродной нейтральности европейских ЦОД к 2030 году, а также обеспечить достойный ответ прочим экологическим вызовам, в том числе снизить расход воды. Для оценки эффективности использования воды используется коэффициент WUE, который отражает расход воды на каждый затраченный киловатт·час электричества. Например, исследование 2016 года показало, что на тот момент WUE для ЦОД в США составлял в среднем 1,8 л/кВт·ч.

Источник изображения: Christian Lue/unsplash.com Цели поставлены с учётом жизненного цикла уже действующих систем охлаждения, поскольку их немедленная массовая замена может принести больше вреда, чем пользы из-за ущерба экологии в процессе производства самих систем. Поэтому в CNDCP заявили, что все 74 оператора ЦОД, участвовавшие в заключении пакта, добьются потребления не более 400 мл/кВт·ч только к 2040 году. Такой показатель вывели с учётом разницы технологий, климатических и иных условий, характерных для тех или иных ЦОД. Отдельные участники рынка уже заявили о намерении добиться положительного водного баланса для своих дата-центров — ЦОД будут отдавать больше чистой воды, чем потреблять. Так, Meta✴ и Microsoft планируют добиться этой цели к 2030 году. Последняя также начала устанавливать станции для очистки сточных вод ЦОД. А вот Google отметилась тем, что пыталась всеми возможными способами скрыть расход воды своими дата-центрами даже от властей. Помимо ограничения расхода воды, подписанты CNDCP предложили ввести и другие цели для дата-центров. Например, уже сформированы две рабочие группы для подготовки к переходу на «циркулярную экономику» со вторичным использованием материалов и переработкой различных ресурсов. В частном порядке аналогичную инициативу уже несколько лет развивает Microsoft в рамках проекта Circular Center. |

|