Лента новостей

|

10.11.2025 [10:30], Руслан Авдеев

«Здоровое» питание: ExxonMobil предложила ИИ ЦОД электростанции на природном газе с интегрированной системой захвата углеродных выбросовОдна из крупнейших нефтегазовых компаний мира — ExxonMobil активно ведёт переговоры с поставщиками электричества и технологическими компаниям. Также ведутся переговоры о поставке в дата-центры генерирующих установок на природном газе, интегрированных с системами захвата и хранения углерода, сообщает Datacenter Dynamics. По словам ExxonMobil, она намерена улавливать до 90 % выбросов CO2. В компании надеются, что заявления гиперскейлеров о желании получить мощности с низким углеродным выбросом искренни, поскольку в краткосрочной и среднесрочной перспективе компания, вероятно, является единственным игроком, способным реально добиться этого. ExxonMobil уже «продвинулась в переговорах» и даже подобрала подходящие площадки. У неё есть инфраструктура и технологии улавливания, транспортировки и хранения углекислого газа. Также утверждается, что развитие ИИ создаст новые бизнес-возможности в «низкоуглеродных» дата-центрах, которыми Exxon намерена воспользоваться. В декабре 2024 года компания объявила о намерении построить новую газовую электростанцию мощностью 1,5 ГВт для дата-центров. Пока реализация проекта находится на ранней стадии, это будет первая электростанция Exxon, предназначенная не для обеспечения собственных нужд.

Источник изображения: ExxonMobil Дополнительно Exxon представила ряд продуктов для охлаждения ЦОД. В апреле она заключила партнёрское соглашение с Intel для создания новых технологий жидкостного охлаждения дата-центров. В октябре ExxonMobil сообщила о намерении выйти на рынок охлаждающих жидкостей для ЦОД, представив портфолио из синтетических и несинтетических продуктов. Дальнейшее расширение ассортимента планируется при поддержке Intel. На сектор ЦОД ориентируются и другие нефтегазовые компании помимо Exxon. В январе Chevron заключила соглашение с американским хедж-фондом Engine No. 1 о строительстве и масштабировании электростанций на природном газе мощностью до 4 ГВт для прямого обслуживания в США расположенных поблизости дата-центров. В марте 2025 года появились данные, что строитель флагманского дата-центра Stargate в Абилине (Техас) — компания Crusoe подписала контракт с Engine No. 1 о поставке 4,5 ГВт электричества, вырабатываемого турбинами.

10.11.2025 [10:10], Руслан Авдеев

Orange Marine занялась модернизацией флота, занимающегося укладкой и обслуживанием кабелейПодразделение телеком-оператора Orange — компания Orange Marine анонсировала строительство двух передовых кораблей по прокладке и обслуживанию кабелей. Ожидается, что это поможет повысить устойчивость подводных кабельных систем в Европе, на Ближнем Востоке и в Африке (регион EMEA), сообщает Orange. После постройки у Orange Group будет сразу четыре передовых корабля для обслуживания кабелей в Атлантике, Ла-Манше, Северном море, Индийском океане, Средиземном и Красном морях — в дополнение к двум кораблям для прокладки кабелей и судна-разведчика для мониторинга. Они управляются Orange Marine и её итальянской дочерней структурой Elettra. В Orange подчёркивают, что стратегические инвестиции во флотилию компании — ключ для обеспечения устойчивости и безопасности мирового интернета. Это демонстрирует уверенность бизнеса в перспективах Orange Marine и квалификации её команд.

Источник изображения: Orange Marine Два новых однотипных судна на основе дизайна Sophie Germain 2023 года в основном будут заниматься обслуживанием и ремонтом. Впрочем, они способны и прокладывать небольшие связующие сегменты протяжённостью до 1 тыс. км. Они заменят суда Léon Thévenin (построено в 1983 году и базируется в Южной Африке) и Antonio Meucci (построено в 1987 году, базируется в Италии), которые сейчас обслуживают кабели в Атлантическом и Индийском океанах, в Средиземном, Чёрном и Красном морях. Строительство поручено верфи Colombo Dockyard в Шри-Ланке (на ней же строили Sophie Germain), корабли будут готовы в 2028 и 2029 гг. соответственно. Дизайн новых судов позволит на 20 % снизить выбросы CO2 в сравнении с действующими кораблями. Среди особенностей кораблей отмечаются:

По словам Orange Marine, дефицит кораблей, способных работать с кабелями — одна из ключевых проблем для морской кабельной индустрии. Благодаря новым моделям компания получит самый современный профильный флот в мире и сможет обеспечить глобальное обслуживание клиентов, обеспечивая сниженные углеродные выбросы. В июле 2025 года Infra-Analytics совместно с TelegeGeography обнародовали материалы, посвящённые трендам, вызовам и стратегиям, касающимся кабельной интернет-инфраструктуры. Главный вывод — в ближайшем будущем миру грозит дефицит судов для ремонта подводных кабелей.

10.11.2025 [09:24], Сергей Карасёв

QNAP выпустила стоечное хранилище TS-h2477AXU-RP на платформе AMDКомпания QNAP Systems анонсировала сетевое хранилище (NAS) корпоративного класса TS-h2477AXU-RP, которое использует аппаратную платформу AMD, ОС QTS 5.2.6 и файловую систему ZFS. Новинка выполнена в форм-факторе 4U для монтажа в серверную стойку. Применён процессор серии Ryzen 7 Pro 7000 с восемью ядрами (16 потоков) с максимальной тактовой частотой до 5,3 ГГц. В состав чипа входит ускоритель AMD Radeon Graphics. Объём оперативной памяти DDR5 в стандартной конфигурации составляет 32 Гбайт (расширяется до 192 Гбайт в виде четырёх модулей на 48 Гбайт). Есть 5 Гбайт интегрированной флеш-памяти. Во фронтальной части располагаются 24 отсека для LFF/SFF-накопителей с интерфейсом SATA-3: могут применяться HDD или SSD с горячей заменой. Кроме того, предусмотрены два внутренних коннектора M.2 2280 для SSD с интерфейсом PCIe 5.0 x2. При использовании HDD на 30 Тбайт суммарная полезная ёмкость, как отмечает QNAP, достигает 600 Тбайт. При этом могут быть добавлены модули расширения: например, при использовании восьми дополнительных массивов TL-R2400PES-RP на 24 накопителя каждый можно получить ещё 192 отсека для HDD/SSD. Есть по два сетевых порта 2.5GbE и 10GbE. Хранилище получило три слота PCIe 4.0 х4, в которые могут устанавливаться карты расширения, включая сетевые адаптеры 25GbE. Имеются также два порта USB 3.2 Gen2 Type-A. Питание обеспечивают два блока мощностью 800 Вт с резервированием. За охлаждение отвечают три системных вентилятора диаметром 60 мм. Диапазон рабочих температур — от 0 до +40 °C. Габариты устройства составляют 177,35 × 432,4 × 511,7 мм, масса — 18,62 кг без установленных накопителей. Производитель предоставляет на модель TS-h2477AXU-RP пятилетнюю гарантию.

09.11.2025 [13:38], Сергей Карасёв

Nebius Аркадия Воложа развернула в Великобритании платформу AI Cloud на базе NVIDIA HGX B300Компания Nebius (бывшая материнская структура «Яндекса» Yandex N.V.) объявила о своём первом развёртывании ИИ-инфраструктуры в Великобритании. Кластер Nebius AI Cloud расположен в кампусе Longcross Park на площадке Ark Data Centres недалеко от Лондона. Как отмечает основатель и генеральный директор Nebius Аркадий Волож, Великобритания является одним из ведущих ИИ-центров в мире. Поэтому для компании создание кластера на территории этой страны имеет большое значение. Кластер состоит из 126 стоек с оборудованием, размещённых в трёх машинных залах. В рамках первой фазы проекта установлены 4 тыс. ускорителей NVIDIA HGX B300 (Blackwell Ultra) в составе серверов пятого поколения (Gen5) собственной разработки Nebius. Вторая фаза предполагает монтаж ещё 3 тыс. ускорителей B300. Общая мощность системы — 16 МВт. По заявлениям Nebius, британский кластер AI Cloud использует передовые энергоэффективные технологии охлаждения, сетевое подключение NVIDIA Quantum-X800 InfiniBand с низкой задержкой и надёжную локальную систему генерации электроэнергии. Говорится о полной интеграции с программной платформой NVIDIA AI Enterprise, предназначенной для разработки и развёртывания ИИ-приложений. Объединяя нашу облачную инфраструктуру с новейшими технологиями NVIDIA, мы предоставляем организациям по всей Великобритании возможность обучать, развёртывать и масштабировать модели и приложения ИИ быстрее, безопаснее и эффективнее, чем когда-либо», — говорит Волож. Британский кластер использует облачную платформу Nebius AI Cloud 3.0 Aether, которая разработана специально для создания и использования ИИ в таких областях, как здравоохранение, финансы, науки о жизни, корпоративный сектор и государственная сфера. Говорится о поддержке сквозного шифрования и о полном соответствии стандартам защиты данных GDPR и CCPA. Ранее Nebius сообщила о запуске своего первого кластера AI Cloud в Израиле, который расположился на площадке в Модиине (Modiin). У Nebius также имеются дата-центры в Финляндии, Франции и США.

09.11.2025 [00:35], Владимир Мироненко

Создание Microsoft массивной ИИ-инфраструктуры в ОАЭ повышает риск утечки технологий и ресурсов в КитайПоддержка Microsoft масштабного развёртывания ИИ-инфраструктуры в ОАЭ, объём инвестиций которой в 2023–2029 гг. в различные проекты в стране составит $15,2 млрд, вызывает опасения у экспертов по поводу обеспечения безопасности, пишет ресурс Dark Reading. В партнёрстве с местной ИИ-компанией G42, поддерживаемой суверенным фондом благосостояния ОАЭ, Microsoft строит первую очередь ИИ-кампуса с новейшими ускорителями NVIDIA. За время президентства Джо Байдена (Joe Biden) Microsoft поставила в ОАЭ эквивалент 21,5 тыс. ускорителей NVIDIA A100. А при администрации Дональда Трампа (Donald Trump) компания получила экспортные лицензии, которые позволяют поставить в ОАЭ эквивалент ещё 60,4 тыс. A100. В прошлом году Microsoft инвестировала в G42 $1,5 млрд. В мае этого года пять компаний — Cisco, NVIDIA, OpenAI, Oracle и SoftBank Group — объединили усилия с G42 для создания Stargate UAE — вычислительного кластера мощностью 1 ГВт в рамках проекта по строительству 5-ГВт ИИ-кампуса. Что касается безопасности, то при заключении Microsoft соглашения об инвестициях в G42 обеим сторонам пришлось согласовать обязательный рамочный документ — Межправительственное соглашение о гарантиях (IGAA) — для соблюдения передовых требований в области кибербезопасности, физической безопасности, экспортного контроля и политики «Знай своего клиента» (KYC). Однако, по неофициальным данным, одним из условий сделки Microsoft с G42 также был отказ ОАЭ от сотрудничества с Китаем и вывод ряда китайских решений из инфраструктуры страны. Безопасность — ключевой элемент уравнения, особенно учитывая, что ОАЭ считаются «сложным» партнёром для США, говорит Джанет Иган (Janet Egan), старший научный сотрудник и заместитель директора программы технологий и национальной безопасности Центра новой американской безопасности (CNAS), указав на то, что в ОАЭ не демократический режим и поддерживаются тесные партнёрские отношения с Китаем, в том числе по вопросам безопасности. «США стремятся приблизить [ОАЭ] к своей орбите и геостратегическому партнёрству, но в то же время должны быть очень осторожны, чтобы не вооружить другую страну, которая может затем сместить или отделить свои интересы от интересов США», — отметила Иган. Опасения понятны — контролировать дата-центры с новейшими технологиями за пределами США гораздо сложнее. Это касается и возможных утечек, и готовности к атакам любого рода. Кроме того, КНР уже не раз ловили на использовании облачной инфраструктуры с передовыми чипами через посредников. Этот вопрос снова был поднят в связи со сделками между G42 и Cerebras. Последняя не только является разработчиком ИИ-ускорителей, но и поставщиком облачных ИИ-решений. ОАЭ — важный союзник США в регионе и самый активный в мире разработчик ИИ-технологий — согласно отчёту Microsoft «AI Diffusion Report» страна занимает первое место по уровню использования ИИ. Страна всерьёз собирается стать ИИ-сверхдержавой. Впрочем, это не мешает, к примеру, китайской Alibaba Cloud развиваться в стране, а Huawei — пытаться продать ОАЭ собственные ускорители Ascend, пока США тянули с разрешением на поставки чипов NVIDIA. По словам вице-председателя и президента Microsoft Брэда Смита (Brad Smith), при администрации Байдена компания проделала «значительную работу… для соответствия строгим требованиям кибербезопасности, национальной безопасности и другим технологическим требованиям, предъявляемым лицензиями на экспорт чипов». Последние разрешения на экспорт чипов, выданные нынешней администрацией Белого дома, потребовали ещё более строгих технологических гарантий, отметил Dark Reading.

08.11.2025 [12:53], Сергей Карасёв

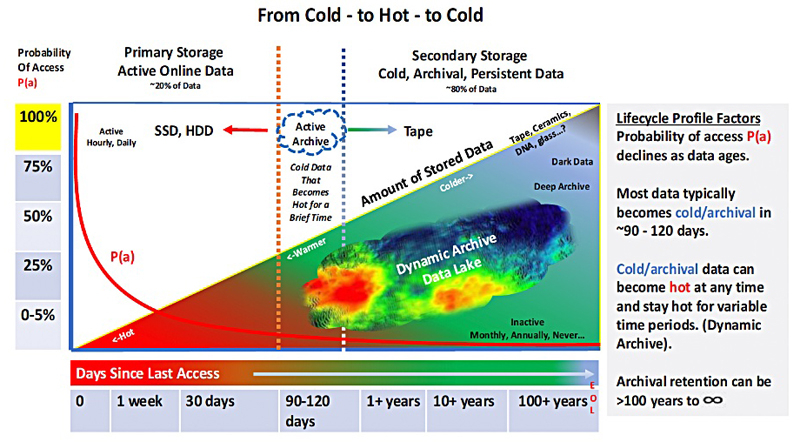

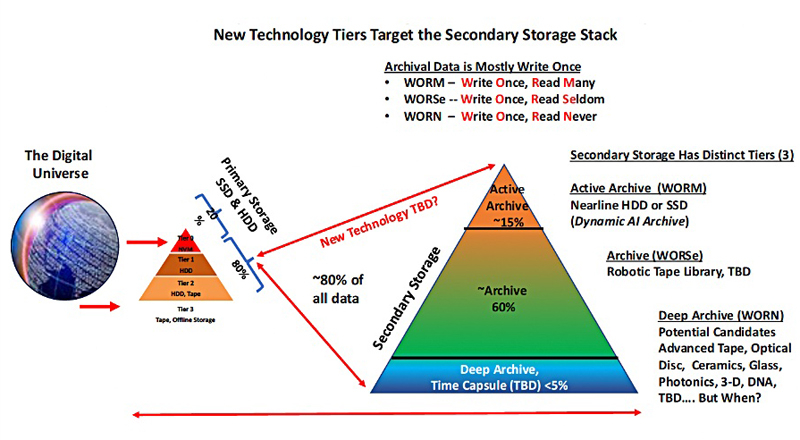

WORM, WORSe и WORN — определены три уровня архивного хранения данных для ИИ-системОрганизация Active Archive Alliance, по сообщению ресурса Blocks & Files, определила три основных уровня архивного хранения данных в эпоху ИИ. Предложенная концепция поможет преобразовать архивы из пассивных хранилищ в активные механизмы с возможностью быстрого извлечения нужных сведений. Active Archive Alliance — это отраслевая группа, сформированная в 2010 году для продвижения концепции «активных архивов». Такие системы обеспечивают упрощённый и быстрый доступ к любым данным в любое время. В состав альянса входят Arcitecta, BDT Media Automation GmbH, Cerebyte, FujiFilm, IBM, Iron Mountain, MagStor, Point, Savartus, Spectra Logic, Wasabi, Western Digital и XenData.

Источник изображений: Horison Information Strategies / Blocks & Files Отмечается, что на фоне стремительного развития ИИ организациям в различных отраслях всё чаще требуется быстрый доступ к огромным объёмам исторической информации. Помочь в удовлетворении таких потребностей призван «активный архив». Архитектура таких платформ предполагает применение накопителей разных типов — SSD, HDD, оптических дисков и ленточных устройств. Распределение данных между ними управляется при помощи специального интеллектуального ПО. Сами накопители могут размещаться локально или в облаках. Предусмотрены различные слои архивирования: «горячие» (SSD, HDD), «тёплые» (HDD, оптические диски) и «холодные» (LTO). Данные по мере старения перемещаются от горячего до холодного слоя, но могут вернуться обратно в случае необходимости.  При этом Active Archive Alliance предлагает три уровня доступа к информации — WORM (Write Once, Read Many), WORSe (Write Once, Read Seldom) и WORN (Write Once, Read Never.) Первый предполагает однократную запись и многократное чтение, второй — однократную запись и редкое чтение, третий — однократную запись при практически полном отсутствии операций чтения. Эти уровни соответствуют трём типам хранилищ — активному, архивному и глубокому. Все они относятся к вторичным массивам, на которые, по оценкам, приходится около 80 % данных (ещё 20 % располагаются в первичных высокопроизводительных системах). Причём активный ярус хранения обеспечивает около 15 % ёмкости, архивный — 60 %, глубокий — только 5 %.

08.11.2025 [12:47], Владимир Мироненко

Минюст США одобрил крупнейшую сделку Alphabet — покупку стартапа Wiz за $32 млрдAlphabet, материнская компания Google, получила одобрение Министерства юстиции США на покупку стартапа Wiz в области облачной кибербезопасности, сообщил на этой неделе исполнительный директор Wiz Ассаф Раппапорт (Assaf Rappaport) на мероприятии Wall Street Journal. Это крупнейшая для Google сделка на сегодняшний день. Официального сообщения Минюста США по этому поводу пока не поступало, но его одобрение фактически уже получило ранее подтверждение в заявлении Федеральной торговой комиссии (FTC) от 24 октября, согласно которому сделке был предоставлен «статус предоставления», сообщил SiliconANGLE. Прежде чем дать разрешение регулятор, как сообщается, провёл тщательную проверку сделку вместе с другими антимонопольными органами. Раппапорт отметил, что до завершения сделки предстоит получить одобрение Великобритании, ЕС, Японии и других стран, поскольку Google и Wiz ведут деятельность по всему миру. Представитель Google подтвердил ресурсу The Register факт получения одобрения Минюста США, добавив, что теперь Google и Wiz переходят к обсуждению мнения других юрисдикций о сделке. «Расширение доступа к решениям безопасности для мультиоблачных сред, как это приобретение, предоставит компаниям и правительствам больше выбора в способах защиты», — сообщил он в электронном письме. В отдельном заявлении Google отметила, что флагманское предложение Wiz — унифицированная платформа облачной безопасности, объединяющая «все основные облака и среды разработки кода» на единой панели управления — отличается от сервисов облачной безопасности, которые компания предлагает в настоящее время, что делает приобретение вполне естественным шагом. Google уже пыталась приобрести Wiz в 2024 году, предложив $23 млрд, но генеральный директор стартапа ответил отказом, намереваясь выйти на биржу вместо того, чтобы стать дочерней компанией Google. Wiz провела 7 раундов финансирования, в ходе которых привлекла $1,9 млрд, включая раунд в $1 млрд при оценке рыночной стоимости в $12 млрд в мае 2024 года. Весной 2025 года Google предложила стартапу уже $32 млрд, причём 10 % этой суммы Google обязана выплатить стартапу, если покупка в итоге не состоится. Сделка является крупнейшим приобретением Alphabet, которое значительно расширит портфель услуг облачной безопасности Google. Программная платформа Wiz позволяет компаниям обнаруживать уязвимости и вредоносную активность в своих облачных системах, предоставляя им всю необходимую информацию в одном месте в любом масштабе для более быстрого анализа и принятия обоснованных решений. Функции платформы также включают ранжирование уязвимостей, позволяющее пользователям оценивать уязвимости и неправильные настройки на основе серьёзности, подверженности риску, возможности использования, радиуса действия и влияния на бизнес. Платформа поддерживает AWS, Microsoft Azure, Google Cloud Platform и Kubernetes. Комментируя сделку, Дэнни Брикман (Danny Brickman), соучредитель и генеральный директор компании Oasis Security, занимающейся управлением идентификационными данными, сообщил, что приобретение улучшит предложения Google в области безопасности, отметив, что «инвестиции Google в Wiz являются ярким подтверждением той важной роли, которую компании нового поколения, занимающиеся кибербезопасностью, играют в современном облачном ИИ-управляемом мире. Это не только подтверждает огромную ценность инновационных решений в области кибербезопасности, но и указывает на хорошие перспективы отрасли в целом».

08.11.2025 [12:14], Сергей Карасёв

Маршрутизатор Turris Omnia NG: Wi-Fi 7, 2.5/10GbE-порты и цветной мини-дисплейОрганизация CZ.NIC (регистратор чешского домена первого уровня CZ) анонсировала маршрутизатор Turris Omnia NG, функционирующий под управлением Turris OS на базе OpenWRT. Новинка может использоваться в том числе для построения сетевых хранилищ (NAS), виртуальных серверов и пр. Устройство несёт на борту процессор Qualcomm IPQ 9574 с четырьмя ядрами Arm Cortex-A73, функционирующими на частоте 2,2 ГГц. Объём оперативной памяти составляет 2 Гбайт. В оснащение входит флеш-модуль eMMC вместимостью 8 Гбайт. Во фронтальной части корпуса располагается цветной информационный дисплей. Маршрутизатор оборудован портами 10GbE WAN (SFP+) и 10GbE LAN (SFP+), а также четырьмя портами 2.5GbE LAN (RJ45). В оснащение входит адаптер Wi-Fi 7 в виде модуля М.2 E key (Noni 56M2-B QCN-6274), который обеспечивает скорость передачи данных до 11 530 Мбит/с в диапазоне 6 ГГц и до 8647 Мбит/с в диапазоне 5 ГГц. Кроме того, предусмотрен встроенный контроллер Wi-Fi 6 (Qualcomm QCN 5124), поддерживающий пропускную способность до 800 Мбит/с в диапазоне 2,4 ГГц. Возможно подключение до восьми антенн. Новинка получила два порта USB 3.0 — по одному в лицевой и тыльной частях корпуса. Есть также слот M.2 M key для SSD с интерфейсом PCIe 3.0 х2 и коннектор М.2 B key для сотового модема 4G/5G (плюс два разъёма для SIM-карт). Применяется пассивное охлаждение; возможен монтаж в стойку. Поддержку и выпуск обновлений прошивки производитель намерен обеспечивать в течение как минимум 10 лет. Приём заказов на Turris Omnia NG уже начался: приобрести маршрутизатор можно по ориентировочной цене €560.

07.11.2025 [22:12], Владимир Мироненко

VAST Data и CoreWeave заключили сделку на $1,17 млрдИИ-стартап VAST Data объявил о заключении сделки с облачным провайдером CoreWeave стоимостью $1,17 млрд, в рамках которой CoreWeave будет использовать VAST AI OS в качестве основной платформы управления данными для своей облачной ИИ-инфраструктуры. Финансовые подробности сделки, включая сроки действия не раскрываются. VAST лишь сообщил, что такие контракты обычно заключаются на три-пять лет. «Объединяя инфраструктуру CoreWeave и VAST AI, компании создают новый класс интеллектуальной архитектуры данных, предназначенной для поддержки непрерывного обучения, инференса в реальном времени и обработки больших объёмов данных для критически важных отраслей», — сообщается в пресс-релизе. Говорится, что расширенное партнёрство подтверждает давнюю приверженность CoreWeave использованию VAST AI OS в качестве основной платформы данных, укрепляя позиции VAST в качестве ключевого компонента ИИ-облака CoreWeave. VAST также сообщил, что его программно-определяемое хранилище построено на базе бесконечно масштабируемой архитектуры, которую можно развернуть в крупных ЦОД, где требуется надёжность и масштабируемость. Платформа управления данными VAST AI OS объединяет сервисы данных — DataSpace, DataBase, DataStore, DataEngine, AgentEngine, InsightEngine — поверх архитектуры DASE (Distributed and Shared Everything). Стек хранения CoreWeave включает локальные, объектные и распределённые файловые сервисы хранения. Локальное хранилище поддерживает эфемерные тома до 60 Тбайт, в то время как выделенные кластеры используют технологии VAST, WEKA, DDN, IBM Spectrum Scale и Pure Storage. Уровень объектного хранилища S3 использует локальный ускоритель передачи объектов (LOTA) для кеширования данных непосредственно на узлах GPU. Соглашение позволяет CoreWeave «управлять и защищать сотни петабайт данных одновременно. Кроме того, мы совместимы с POSIX и подходим для совместного доступа между несколькими экземплярами», заявили в Coreweave ресурсу Blocks & Files. VAST Data и CoreWeave планируют согласовать планы развития своих продуктов, чтобы улучшить хранение и доступ к данным для рабочих ИИ-нагрузок и повысить эффективность работы. Разрабатываемое VAST Data ПО позволяет компаниям эффективно хранить и обрабатывать большие объёмы информации, используемой для обучения и эксплуатации ИИ-систем, и получать доступ к неструктурированным данным, таким как электронные письма, сообщения клиентов, видео и PDF-файлы. Компания взимает с клиентов плату в зависимости от ёмкости и используемых функций. В числе партнёров VAST Data компания NVIDIA, заключившая с ней соглашение по созданию собственной инфраструктуры обработки данных. В прошлом году на встрече с главой VAST Data Ренен Халлак (Renen Hallak) генеральный директор и основатель NVIDIA Дженсен Хуанг (Jensen Huang) высоко оценил решения компании и заявил, что рассчитывает на сотрудничество с ней в течение следующих 80 лет, пишет CRN. Также среди партнёров стартапа ведущие провайдеры облачных услуг (AWS и др.), неооблака (Nebius и др.), лаборатории ИИ (xAI и др.), сообщил соучредитель VAST Джефф Денворт (Jeff Denworth) в интервью агентству Reuters. Сделка может помочь компании в привлечении финансирования. В августе сообщалось, что VAST ведёт переговоры о привлечении нескольких миллиардов долларов нового капитала при оценке до $30 млрд. Среди потенциальных инвесторов — фонд Alphabet CapitalG и NVIDIA. VAST Data оценивалась в $9,1 млрд после раунда финансирования в 2023 году. Инвесторы рассматривают компанию как потенциального кандидата на IPO.

07.11.2025 [18:08], Руслан Авдеев

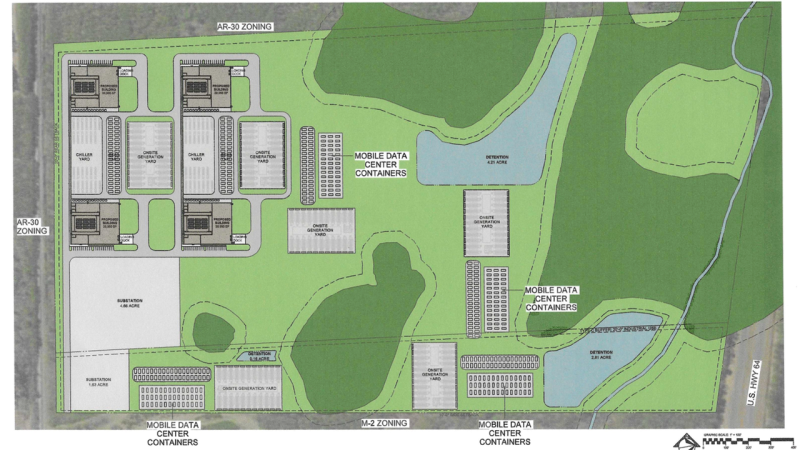

Energy Storage Solutions построит в Северной Каролине гигантские кампусы ЦОД стоимостью $38 млрдПлан девелопера Energy Storage Solutions по созданию огромного парка ЦОД с энергохранилищами в Северной Каролине, наконец, получил разрешение местных властей, разрешивших строительство в рамках действующего зонирования, сообщает Datacenter Knowledge. Кампус мощностью 900 МВт намерены возвести в восточной части штата на участке площадью более 120 га. Начать реализацию первой фазы проекта, которая обойдётся в $19,2 млрд, намерены на площадке Kingsboro в Тарборо (Tareboro, Северная Каролина) в I квартале 2026 года. Проект-близнец рассчитывают реализовать в Фейетвилле (Fayetteville) по соседству. После завершения работ кампусы станут одними из крупнейших на юго-востоке США. Строительство на обоих объектах будет осуществляться в 24 этапа в течение 3–5 лет, каждый кампус обеспечит работой более 1 тыс. сотрудников. В каждом будет около дюжины зданий площадью около 3,6 тыс. м2. Первоначально предусматривалась реализация менее масштабных проектов, но инвесторы попросили увеличить площади, чтобы удовлетворить рост спроса. Компания намерена использовать природный газ для питания ЦОД. На модернизацию инфраструктуры в регионе может уйти до $176 млн, зато газовая генерация позволит продавать излишки электроэнергии местным коммунальным службам. Впрочем, не всё идёт гладко. Ранее Energy Storage Solutions не удалось вовремя получить разрешение строительство ещё одного объекта из-за протестов местного сообщества. По словам аналитиков HyperFrame Research, локальные законы о зонировании территорий продолжат оказывать влияние на крупные проекты в США, поскольку гиперскейлеры и другие участники рынка активно масштабируют строительство ЦОД для удовлетворения спроса на рынке ИИ. При этом бизнесу приходится налаживать контакты на местном уровне, а также на уровне штата и федеральном. И если стратегическая задача конкуренции с Китаем — федерального уровня, то на местах приходится решать тактические задачи, связанные с зонированием. Большую роль играет противодействие строительству со стороны общественности. Ранее в этом году AWS отменила строительство дата-центра в Вирджинии из-за протестов местных жителей, а в августе власти Тусона (Tuscon) в Аризоне отклонили постройку кампуса Project Blue AI. Energy Storage Solutions подчёркивают, что компания хочет оказать положительное влияние на регион с помощью реализации проектов ЦОД. Другие проекты планируется реализовать в Южной Каролине и Вирджинии. В компании подчёркивают, что иногда опасения местных сообществ не имеют собой почвы — и негативные слухи могут быть основаны на информации из интернета. В сентябре Институт Банка Америки (Bank of America Institute) опубликовал данные, согласно которым затраты на строительство дата-центров в США в последние годы бьют рекорды. |

|