Материалы по тегу: x

|

30.01.2025 [08:58], Владимир Мироненко

Суперкомпьютер Aurora стал доступен исследователям со всего мираАргоннская национальная лаборатория (ANL) Министерства энергетики США объявила о доступности суперкомпьютера Aurora экзафлопсного класса для исследователей по всему миру. Как указано в пресс-релизе, благодаря широким возможностям моделирования, ИИ и анализа данных, Aurora будет способствовать прорывам в целом ряде областей, включая проектирование самолётов, космологию, разработку лекарств и исследования в сфере ядерной энергетики. Майкл Папка (Michael Papka), директор Argonne Leadership Computing Facility (ALCF), вычислительного центра Управления науки Министерства энергетики США, отметил, что уже первые проекты с использованием Aurora продемонстрировали его огромным потенциал. «С нетерпением ждём, как более широкое научное сообщество будет использовать систему для преобразования своих исследований», — заявил он. Aurora уже зарекомендовала себя как один мировых лидеров по производительности ИИ, заняв первое место в бенчмарке HPL-MxP в ноябре 2024 года, отметила ANL. Возможности машины для выполнения ИИ-задач используются учёными для открытия новых материалов для аккумуляторов, разработки новых лекарств и ускорения исследований в области термоядерной энергии. Перед его развёртыванием команда под руководством ANL продемонстрировала потенциал Aurora, используя его для обучения моделей ИИ для моделирования белков. В числе первых проектов, реализуемых с помощь Aurora, — разработка высокоточных моделей сложных систем, таких как кровеносная система человека, ядерные реакторы и сверхновые звезды. Кроме того, способность суперкомпьютера к обработке огромных наборов данных имеет решающее значение для анализа растущих потоков данных из крупных исследовательских установок, таких как Усовершенствованный источник фотонов (APS) Аргоннской национальной лаборатории, научные объекты Управления науки Министерства энергетики США (DoE) и Большой адронный коллайдер Европейской организации ядерных исследований (CERN). Чтобы гарантировать готовность Aurora к использованию для научных исследования с первого дня запуска, при его создании применили так называемое совместное проектирование. Используя этот подход, команда Aurora разработала в тандеме аппаратное и программное обеспечение для оптимизации производительности и удобства использования. Это потребовало многолетнего сотрудничества между ALCF, Intel, HPE и исследователями по всей стране, участвующими в проекте Exascale Computing Project (ECP) Министерства энергетики США и программе Aurora Early Science Program (ESP) центра. Пока велись работы по монтажу Aurora, команды ECP и ESP запускали приложения для стресс-тестирования оборудования, одновременно оптимизируя свой код для максимально эффективной работы в системе. В результате десятки научных приложений, а также широкий спектр ПО и инструментов разработки были готовы ещё до того, как Aurora ввели в строй, говорится в пресс-релизе.

29.01.2025 [16:15], Владимир Мироненко

«Группа Астра» увеличила отгрузки в 2024 году до рекордных 20 млрд рублей«Группа Астра», специализирующаяся на разработке инфраструктурного программного обеспечения (ПО), объявила о росте отгрузок в 2024 году по сравнению с предыдущим годом на 78 % до исторического максимума в 20 млрд руб. Сообщается, что рекордных отгрузок удалось достичь благодаря масштабированию бизнеса, увеличению числа клиентов, а также развитию продуктово-сервисной экосистемы. Компания уделяет большое внимание укреплению партнёрства с разработчиками инфраструктурного ПО. Число совместимых с экосистемой группы партнёрских решений за год увеличилось на 28 % до 3229. А число клиентов «Группы Астра» превысило 29 тыс. В минувшем году были реализованы проекты по переходу на решения «Группы Астра» для крупнейших российских компаний из B2G и B2B-сегментов, а также для малого и среднего бизнеса. Среди наиболее крупных — проекты для «Сбера», ВТБ, «Алросы». Также «Группа Астра» занимается развитием продуктового портфель за счёт собственных разработок и с помощью M&A-сделок, фокусируясь на улучшении совместимости своих решений с решениями других вендоров. Было представлено новое решение Desktop X, которое выступает единой точкой доступа организации к почте и другим ресурсам для корпоративного общения. Компания также укрепила бизнес-направление виртуализации и облачных сервисов, приобретя платформу контейнеризации «Боцман». Кроме того, совместно с компанией «Аквариус» был разработан программно-аппаратный комплекс (ПАК) для создания частного или публичного облака, а также ПАК Tantor XData 2.0. Как сообщается, в IV квартале облачная платформа виртуализации «Брест» и решение для управления службой каталогов ALD Pro получили сертификаты по второму уровню доверия ФСТЭК России, а система резервного копирования RuBackup — по четвёртому. Получение сертификатов означает возможность использования этих решений в работе с конфиденциальной информацией и государственной тайной.

24.01.2025 [02:05], Владимир Мироненко

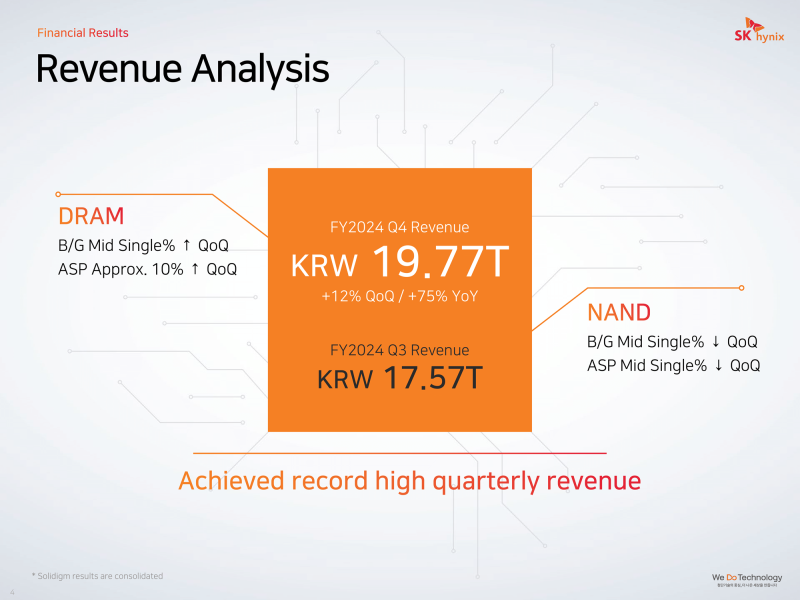

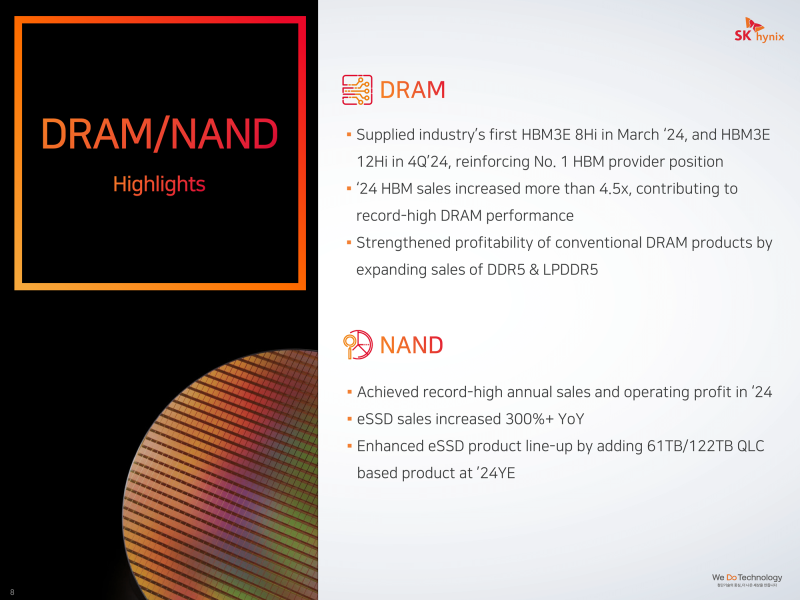

В IV квартале 2024 года SK hynix получила самую большую операционную прибыль в Южной Корее, опередив SamsungКомпания SK hynix, один из крупнейших производителей микросхем памяти в мире, объявила финансовые результаты IV квартала и 2024 года в целом. Компания отметила, что были достигнуты рекордные показатели благодаря высокому спросу на ряд её продуктов, в том числе на память HBM, которая используется в ИИ-ускорителях. SK hynix объявила, что были достигнуты лучшие финансовые показатели за год за всю её историю — по выручке, операционной прибыли и чистой прибыли. Выручка SK hynix за IV квартал составила ₩19,76 вон ($13,76 млрд), что на 74,7 % больше год к году и на 12 % последовательно при консенсус-прогнозе аналитиков, опрошенных LSEG, в ₩19,76 трлн вон, а операционная прибыль подскочила на 2236 % до ₩8,08 трлн (около $5,6 млрд) или на 15 % последовательно. Прогноз Уолл-стрит, согласно данным LSEG, равен ₩8,08 трлн. Чистая прибыль в размере ₩8 трлн (около $5,56 млрд) заметно контрастирует с убытком в ₩1,38 трлн (около $960 млн) годом ранее. По словам SK hynix, чипы HBM принесли ей 40 % от общего дохода от производства DRAM. Согласно данным ресурса The Korea Times, SK hynix впервые опередила по квартальной операционной прибыли своего конкурента и крупнейший бизнес страны Samsung Electronics, став лидером по этому показателю в Южной Корее. За 2024 год выручка SK hynix составила ₩66,19 трлн (около $45,97 млрд), превысив показатель предыдущего года на 102 %. Операционная прибыль равняется ₩23,47 трлн (около $16,4 млрд) по сравнению убытками в 2023 году и чистая прибыль — ₩19,8 трлн (около $13,8 млрд, в 2023 году — убытки). Выручка SK hynix от HBM увеличилась в 2024 году более чем в 4,5 раза по сравнению с 2023 годом. Компания отметила, что «сектор памяти трансформируется в рынок высокопроизводительной и высококачественной памяти с ростом спроса на память для ИИ». Также в 2024 году продажи серверных SSD подскочили на 300 % благодаря высокому спросу со стороны провайдеров ЦОД. Однако акции SK hynix упали на 4,7 % после того, как финансовый директор Ким У-хен (Kim Woo-hyun) предупредил о слабом спросе, растущей конкуренции и растущей рыночной неопределённости, пишет Reuters. «В этом году рынок микросхем памяти остается неопределённым, поскольку растёт торговый протекционизм и углубляются геополитические риски, в то время как производители ПК и смартфонов корректируют запасы», — сообщил финансовый директор в ходе отчёта о финансовых результатах. До объявления финансовых результатов акции SK hynix выросли с начала года примерно на 30 %. Вместе с тем SK hynix прогнозирует рост спроса на HBM и высокоплотную серверную DRAM для HPC-нагрузок «по мере роста инвестиций крупных мировых технологических компаний в ИИ-серверы и повышения значимости инференса», пишет Blocks & Files. Korean Times сообщает, что SK hynix ожидает, что её продажи памяти HBM удвоятся в 2025 году. Вместе с тем компания заявила, что поставки чипов DRAM и NAND снизятся на 10–20 % в I квартале по сравнению с предыдущим. Согласно Reuters, компания сообщила аналитикам, что её капитальные расходы в 2025 году вырастут лишь незначительно год к году, и этот консервативный план усилил опасения рынка по поводу замедления спроса. В комментарии к финансовому отчёту SK hynix говорится, что в I половине этого года на чипы HBM3E будет приходиться более половины дохода от памяти HBM. Компания полагает, что 12-ярусная HBM4 станет её флагманским продуктом в 2026 году. В этом году SK hynix планирует завершить её разработку и начать подготовку к массовому производству во II полугодии. Поставки HBM4 начнутся с чипов 12-Hi, а затем последуют и 16-Hi. «Ожидается, что 16-ярусные чипы будут поставляться в соответствии с требованиями клиентов, вероятно, во II половине 2026 года», — сообщила компания.

23.01.2025 [19:54], Андрей Крупин

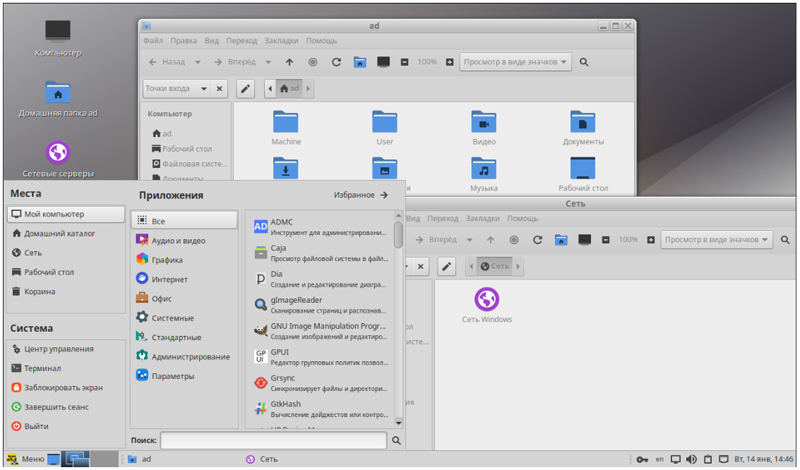

Сертифицированная ФСТЭК России ОС «Альт СП» получила крупное обновление и поддержку процессоров «Эльбрус»Компания «Базальт СПО» сообщила о релизе сертифицированного ФСТЭК обновления операционной системы «Альт СП» 10.2. Платформа построена на базе ядра Linux, представлена в редакциях для рабочих станций и серверов и может применяться в организациях, предъявляющих высокие требования к обеспечению защиты обрабатываемых данных и информационной безопасности корпоративной IT-инфраструктуры. Дистрибутив платформы «Альт СП» 10.2 поставляется с сертифицированными ФСТЭК России средствами виртуализации и контейнеризации, а также СУБД PostgreSQL версии 16.6, отвечающей требованиям ведомства по 4 классу защиты. Согласно новым нормам регулятора в состав ОС включены программные интерпретаторы (php, perl, lua, python, nodejs) и веб-сервер (nginx), прошедшие испытания по выявлению уязвимостей и недекларированных возможностей в ПО в соответствии с методикой ФСТЭК России.

Источник изображения: «Базальт СПО» / basealt.ru В числе прочих изменений и доработок ОС «Альт СП» 10.2 фигурируют обновлённые средства управления контейнерами и виртуальными машинами, новые инструменты мониторинга событий безопасности и ограничения доступа к USB-устройствам. Также сообщается об улучшениях пользовательского интерфейса платформы, обновлении среды Java, добавлении корневых сертификатов для сайтов от российского центра сертификации ООО «ТЦИ», реализации поддержки «Сигнатуры-L» — разработанной Банком России системы криптографической авторизации электронных документов и интеграции с платформой идентификации и управления доступом Keycloak. В числе прочих изменений разработчик отмечает появление сборок дистрибутива «Альт СП» 10.2 для рабочих станций с российскими процессорами Эльбрус 8СВ и Эльбрус 2С3, включение в инсталляционный пакет ОС для серверов программного комплекса для централизованного управления рабочими станциями и учётными записями пользователей «Альт Домен» (аналог Microsoft AD) и добавление модуля Linstor, предназначенного для управления блочными устройствами хранения данных. ОС зарегистрирована в реестре российского ПО и может применяться государственными и коммерческими организациями при реализации программ по импортозамещению зарубежных софтверных продуктов.

20.01.2025 [07:53], Владимир Мироненко

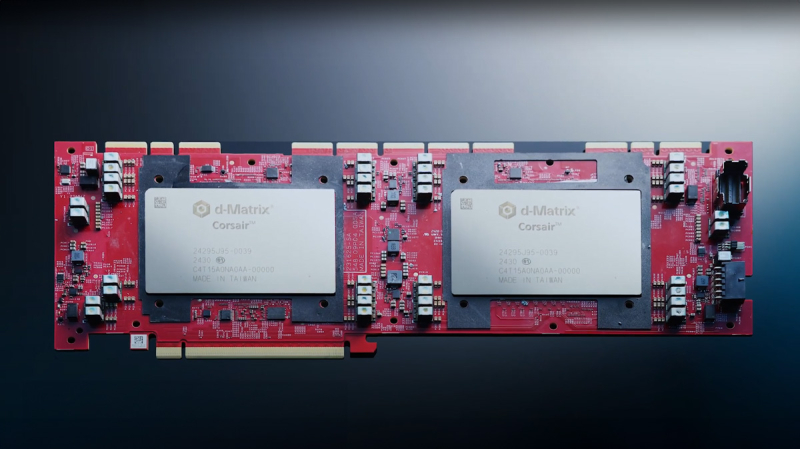

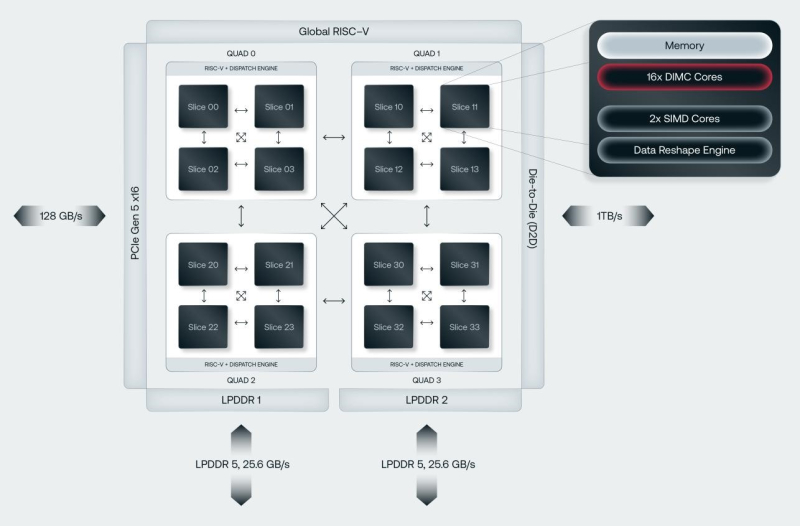

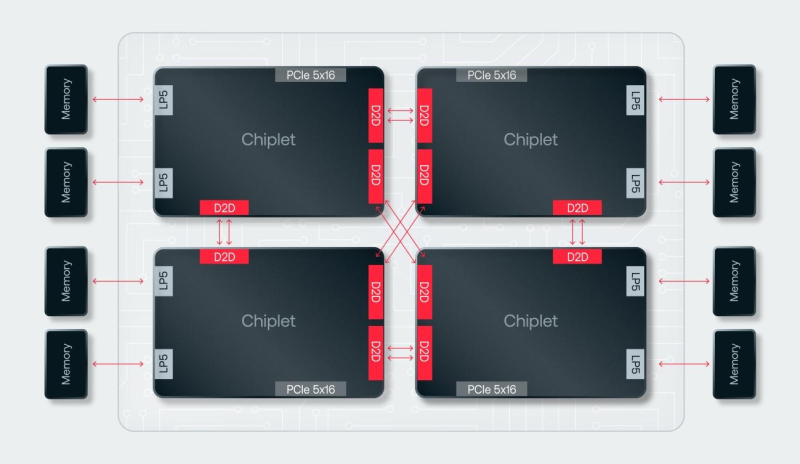

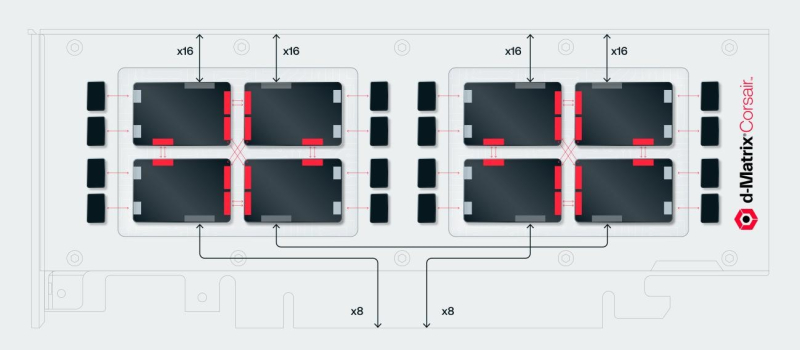

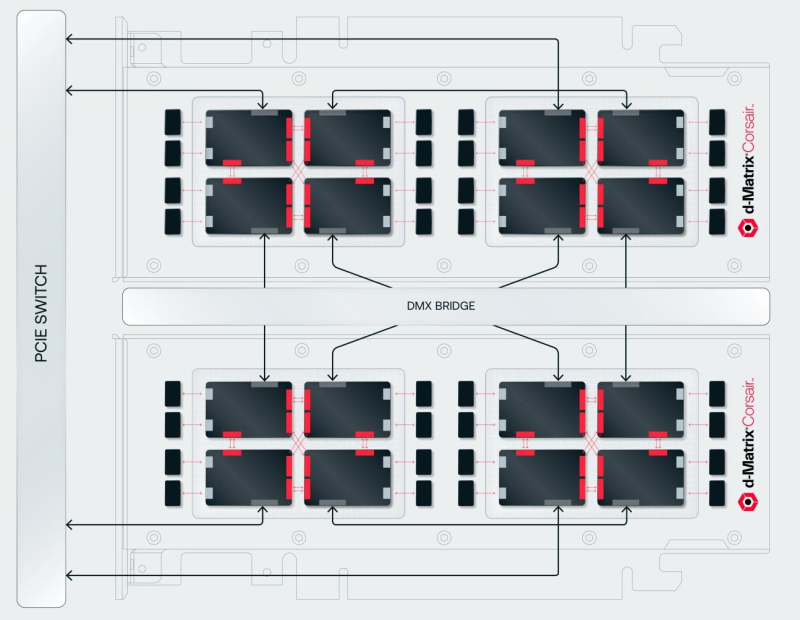

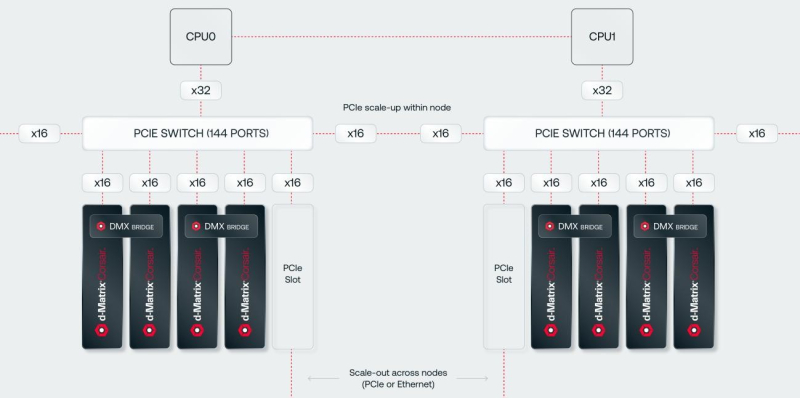

SRAM, да и только: d-Matrix готовит ИИ-ускоритель CorsairСтартап d-Matrix создал ИИ-ускоритель Corsair, оптимизированный для быстрого пакетного инференса больших языковых моделей (LLM). Архитектура ускорителя основана на модифицированных ячейках SRAM для вычислений в памяти (DIMC), работающих на скорости порядка 150 Тбайт/с. Новинка, по словам компании, отличается производительностью и энергоэффективностью, пишет EE Times. Массовое производство Corsair начнётся во II квартале. Среди инвесторов d-Matrix — Microsoft, Nautilus Venture Partners, Entrada Ventures и SK hynix. d-Matrix фокусируется на пакетном инференсе с низкой задержкой. В случае Llama3-8B сервер d-Matrix (16 четырёхчиплетных ускорителей в составе восьми карт) может производить 60 тыс. токенов/с с задержкой 1 мс/токен. Для Llama3-70B стойка d-Matrix (128 чипов) может производить 30 тыс. токенов в секунду с задержкой 2 мс/токен. Клиенты d-Matrix могут рассчитывать на достижение этих показателей для размеров пакетов порядка 48–64 (в зависимости от длины контекста), сообщила EE Times руководитель отдела продуктов d-Matrix Шри Ганесан (Sree Ganesan). Производительность оптимизирована для исполнения моделей в расчёте до 100 млрд параметров на одну стойку. По словам Ганесан, это реалистичный сценарий использования LLM. В таких сценариях решение d-Matrix обеспечивает 10-кратное преимущество в интерактивности (время до получения токена) по сравнению с решениями на базе традиционных ускорителей, таких как NVIDIA H100. Corsair ориентирован на модели размером менее 70 млрд параметров, подходящих для генерации кода, интерактивной генерации видео или агентского ИИ, которые требуют высокой интерактивности в сочетании с пропускной способностью, энергоэффективностью и низкой стоимостью. Ранние версии архитектуры d-Matrix использовали MAC-блоки на базе SRAM-ячеек, дополненных большим количеством транзисторов для операций умножения. Сложение же выполнялось в аналоговом виде с использованием разрядных линий, измерения тока и аналого-цифрового преобразования. В 2020 году компания выпустила чиплетную платформу Nighthawk на основе этой архитектуры. «[Nighthawk] продемонстрировал, что мы можем значительно повысить точность по сравнению с традиционными аналоговыми решениями, но мы всё ещё отстаем на пару процентных пунктов от традиционных решений типа GPU», — сказал EE Times генеральный директор d-Matrix Сид Шет (Sid Sheth). Однако потенциальным клиентам не понравилось, что при таком подходе возможно снижение точности, так что в Corsair компания вынужденно сделала выбор в пользу полностью цифрового сумматора. ASIC d-Matrix включает четыре чиплета, каждый из которых содержит по четыре вычислительных блока, объединённых посредством DMX Link по схеме каждый-с-каждым, и по одному планировщику и RISC-V ядру. Внутри каждого вычислительного блока есть 16 DIMC-ядер, состоящих из наборов SRAM-ячеек (64×64), а также два SIMD-ядра и движок преобразования данных. Суммарно доступен 1 Гбайт SRAM с пропускной способностью 150 Тбайт/с. ASIC объединён со 128 Гбайт LPDDR5 (до 400 Гбайт/с) посредством органической подложки (без дорогостоящего кремниевого интерпозера). Хотя текущее поколение ASIC включает только четыре чиплета именно из-за ограничений подложки, в будущем их количество увеличится. Внешние интерфейсы ASIC представлены стандартным PCIe 5.0 x16 (128 Гбайт/с) и фирменным интерконнектом DMX Link (1 Тбайт/с) для объединения чиплетов. FHFL-карта Corsair включает два ASIC d-Matrix (т.е. всего восемь чиплетов) и имеет TDP на уровне 600 Вт. Ускоритель работает с форматами данных OCP MX (Microscaling Formats) и обеспечивает до 2400 Тфлопс в MXINT8-вычислениях или 9600 Тфолпс в случае MXINT4. Две карты Corsair можно объединить посредством 512-Гбайт/с мостика DMX Bridge. Их, по словам компании, достаточно для задействования тензорного параллелизма. Дальнейшее масштабирование возможно посредством PCIe-коммутации. Именно поэтому d-Matrix работает с GigaIO и Liqid. В одно шасси можно поместить восемь карт Corsair, а в стойку, которая будет потреблять порядка 6–7 кВт — 64 карты. d-Matrix уже разрабатывает ASIC следующего поколения Raptor, который должен выйти в 2026 году. Raptor будет ориентирован на «думающие» модели и получит ещё больше памяти за счёт размещения DRAM непосредственно поверх вычислительных чиплетов. SRAM-чиплеты Raptor также перейдут с 6-нм техпроцесса TSMC, который используется при изготовлении Corsair, к 4 нм без существенных изменений микроархитектуры. По словам компании, она потратила два года на работу с TSMC, чтобы создать 3D-упаковку для нового поколения ASIC. Как отмечает EETimes, команда разработчиков ПО d-Matrix в два раза больше команды разработчиков оборудования (120 против 60). Стратегия компании в области ПО заключается в максимальном использовании open source экосистемы, включая PyTorch, OpenAI Triton, MLIR, OpenBMC и т.д. Вместе они образуют программный стек Aviator, который отвечает за конвертацию моделей в числовые форматы d-Matrix, применяет к ним фирменные методы разрежения, компилирует их, распределяет нагрузку по картам и серверам, а также управляет исполнением моделей, включая обслуживание большого количества запросов.

16.01.2025 [13:10], Сергей Карасёв

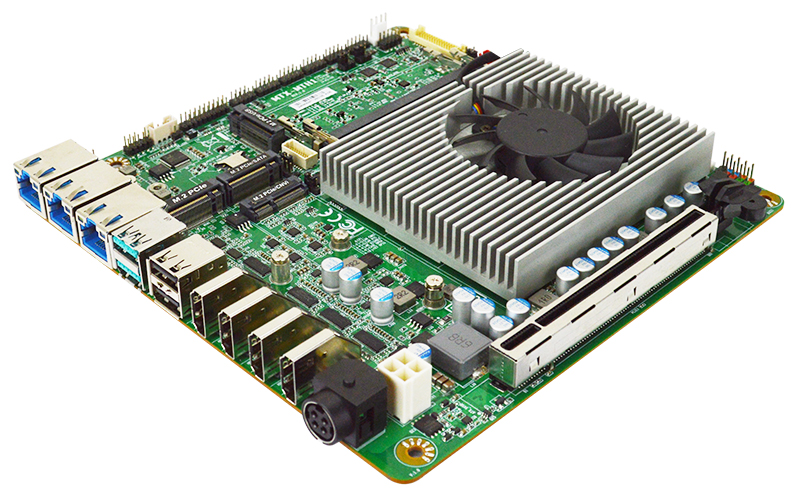

Плата Jetway MTX-MTH1 формата Thin Mini-ITX получила чип Intel Core Ultra 5/7, три порта 2.5GbE и слот PCIe 5.0 x8Компания Jetway анонсировала плату MTX-MTH1 типоразмера Thin Mini-ITX, предназначенную для создания встраиваемых систем, периферийного оборудования, устройств промышленной автоматизации, ИИ-платформ и пр. Новинка имеет широкий диапазон рабочих температур — от -20 до +60 °C. Плата изначально комплектуется процессором Intel поколения Meteor Lake: это может быть чип Core Ultra 7 155H или Core Ultra 5 125H с графикой Intel Arc Graphics. Установлен кулер с довольно крупным радиатором и вентилятором. Доступны два слота SO-DIMM для модулей DDR5-5600 суммарным объёмом до 96 Гбайт. Новинка располагает полноразмерным слотом PCIe 5.0 x8, разъёмом M.2 M-Key 2242 (PCIe 4.0 x4) для NVMe SSD, коннектором M.2 M-Key 2242/2280 (PCIe 4.0 x4 / SATA-3) для ещё одного SSD (NVMe или SATA), разъёмом M.2 B-Key 3042/3052 (PCIe 3.0 x1 / USB 3.2 Gen2 / USB 2.0 плюс Nano SIM) для модема 4G/5G, а также коннектором M.2 E-Key 2230 (USB 2.0 / PCIe x1) для адаптера Wi-Fi/Bluetooth. Накопитель также может быть подключён к порту SATA-3.

Источник изображения: Jetway Плата получила три сетевых порта 2.5GbE, один из которых реализован на контроллере Intel I226-LM, два других — на базе Intel I226-V. В основу аудиосистемы положен кодек Realtek Audio. Допускается вывод изображения одновременно на четыре дисплея через порты HDMI 2.1 (до 7680 × 4320 точек, 60 Гц). Кроме того, присутствует интерфейс LVDS (1920 × 1200 пикселей, 60 Гц). Предусмотрены по два порта USB 3.2 Gen 2×1 Type-A (10Gbps) и USB 2.0 Type-A. Через коннекторы на плате можно задействовать два порта USB 3.2 и четыре порта USB 2.0, четыре последовательных порта RS-232 и два RS-232/422/485. Имеется колодка GPIO. Питание (12–36 В) подаётся через разъём DC. Размеры платы составляют 170 × 170 мм. Говорится о совместимости с Windows 10/11 и Linux.

28.12.2024 [01:55], Владимир Мироненко

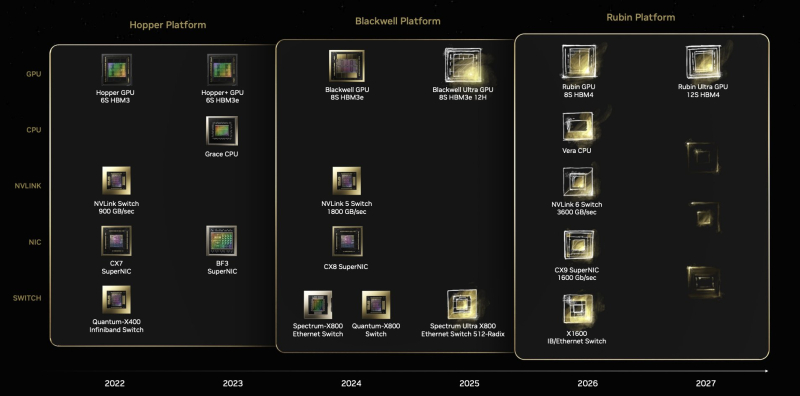

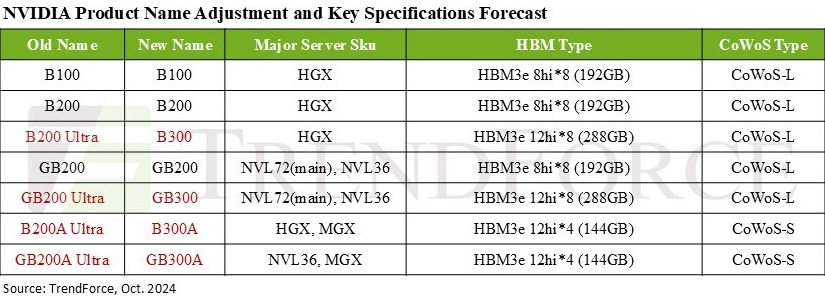

Дороже, но втрое эффективнее: NVIDIA готовит ускорители GB300 с 288 Гбайт HBM3E и TDP 1,4 кВтNVIDIA выпустила новые ускорители GB300 и B300 всего через шесть месяцев после выхода GB200 и B200. И это не минорное обновление, как может показаться на первый взгляд — появление (G)B300 приведёт к серьёзной трансформации отрасли, особенно с учётом значительных улучшений в инференсе «размышляющих» моделей и обучении, пишет SemiAnalysis. При этом с переходом на B300 вся цепочка поставок меняется, и от этого кто-то выиграет, а кто-то проиграет. Конструкция вычислительного кристалла B300 (ранее известного как Blackwell Ultra), изготавливаемого с использованием кастомного техпроцесса TSMC 4NP. Благодаря этому он обеспечивает на 50 % больше Флопс (FP4) по сравнению с B200 на уровне продукта в целом. Часть прироста производительности будет получена за счёт увеличения TDP, достигающим 1,4 кВт и 1,2 кВт для GB300 и B300 HGX соответственно (по сравнению с 1,2 кВт и 1 кВт для GB200 и B200). Остальное повышение производительности связано с архитектурными улучшениями и оптимизациями на уровне системы, такими как динамическое распределение мощности между CPU и GPU. Кроме того, в B300 применяется память HBM3E 12-Hi, а не 8-Hi, ёмкость которой выросла до 288 Гбайт. Однако скорость на контакт осталась прежней, так что суммарная пропускная способность памяти (ПСП) по-прежнему составляет 8 Тбайт/с. В качестве системной памяти будут применяться модули LPCAMM. Разница в производительности и экономичности из-за увеличения объёма HBM намного больше, чем кажется. Усовершенствования памяти имеют решающее значение для обучения и инференса больших языковых моделей (LLM) в стиле OpenAI O3, поскольку более длинные последовательности токенов негативно влияют на скорость обработки и задержку. На примере обновления H100 до H200 хорошо видно, как память влияет на производительность ускорителя. Более высокая ПСП (H200 — 4,8 Тбайт/с, H100 — 3,35 Тбайт/с) в целом улучшила интерактивность в инференсе на 43 %. А большая ёмкость памяти снизила объём перемещаемых данных и увеличила допустимый размер KVCache, что увеличило количество генерируемых токенов в секунду втрое. Это положительно сказывается на пользовательском опыте, что особенно важно для всё более сложных и «умных» моделей, которые могут приносить больше дохода с каждого ускорителя. Валовая прибыль от использования передовых моделей превышает 70 %, тогда как для отстающих моделей в конкурентной open source среде она составляет менее 20 %.

Источник изображения: TrendForce Однако одного наращивания скорости и памяти, как это делает AMD в Instinct MI300X (192 Гбайт), MI325X и MI355X (256 Гбайт и 288 Гбайт соответственно), мало. И дело не в том, что забагованное ПО компании не позволяет раскрыть потенциал ускорителей, а в особенности общения ускорителей между собой. Только NVIDIA может предложить коммутируемое соединение «все ко всем» посредством NVLink. В GB200 NVL72 все 72 ускорителя могут совместно работать над одной и той же задачей, что повышает интерактивность, снижая задержку для каждой цепочки размышлений и в то же время увеличивая их максимальную длину. На практике NVL72 — единственный способ увеличить длину инференса до более чем 100 тыс. токенов и при этом экономически эффективный, говорит SemiAnalysis. По оценкам, GB300 NVL72 обойдётся заказчиками минимум в $7,5 млн, тогда как GB200 NVL72 стоил порядка $3 млн.

27.12.2024 [12:40], Сергей Карасёв

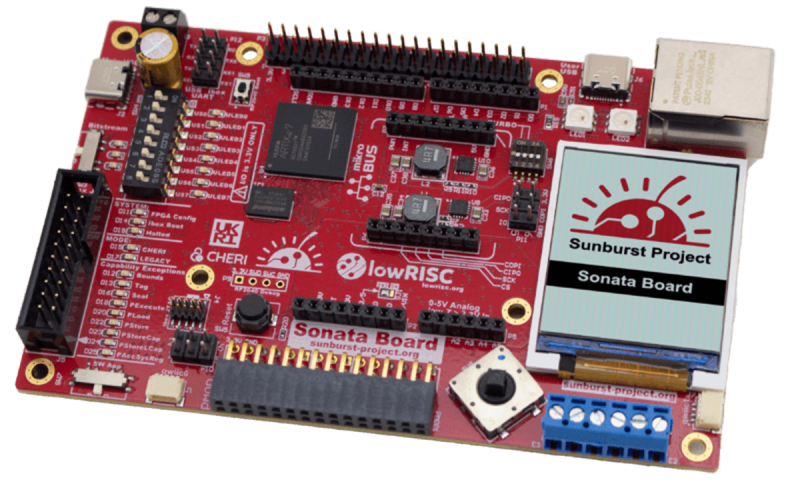

Плата lowRISC Sonata v1.0 с системой защиты памяти CHERIoT объединяет FPGA AMD Artix-7 и микроконтроллер Raspberry Pi RP2040Участники проекта lowRISC по созданию 64-бит чипов RISC-V, как сообщает ресурс CNX Software, анонсировали аппаратную платформу Sonata v1.0 для разработчиков встраиваемых систем и всевозможных устройств Интернета вещей (IoT). Новинка поддерживает технологию CHERIoT (Capability Hardware Extension to RISC-V for IoT). Напомним, летом уходящего года lowRISC, а также Capabilities Limited, Codasip, FreeBSD Foundation, SCI Semiconducto и Кембриджский университет создали альянс CHERI для продвижения средств надёжной защиты памяти от атак. Специальные механизмы исключают ряд потенциальных уязвимостей, таких как переполнение буфера или некорректная работа с указателями. Отмечалось, что первыми новую технологию могут получить процессоры RISC-V. В основе платформы Sonata v1.0 лежит FPGA AMD Xilinx Artix-7 (XC7A35T-1CSG324C). Изделие содержит Soft-процессорное ядро AMD MicroBlaze с архитектурой RISC и 400 Кбайт распределённой памяти RAM. Ещё одной составляющей платы является микроконтроллер Raspberry Pi RP2040 (два ядра Cortex-M0+ с частотой 133 МГц), который отвечает за IO-функции. Есть 64 Мбит памяти HyperRAM (Winbond W956D8MBYA5I), 256 Мбит памяти SPI-флеш (Winbond W25Q256JVEIQ) для FPGA AMD Artix-7 или Raspberry Pi RP2040, ещё 64 Мбит SPI-флеш (Winbond W25Q64JVZEIQ) для RP2040 и 256 Мбит памяти SPI-флеш (Winbond W25Q256JVEIQ) для FPGA. В арсенале Sonata v1.0 — встроенный цветной ЖК-дисплей с диагональю 1,8″, сетевой порт 10/100MbE, два разъёма USB Type-C (для программирования и подачи питания) и слот microSD. Реализованы последовательные интерфейсы RS-232 и RS-485, 40-контактный разъём Raspberry Pi, две 10-контактные колодки Ibex JTAG, две 4-контактные колодки Ibex UART и пр. Размеры составляют 125 × 80 мм. Разработчики могут получить доступ к подробной документации и дополнительным ресурсам на сайтах lowRISC и GitHub, чтобы в полной мере использовать возможности платформы Sonata v1.0. Цена новинки — примерно $413.

26.12.2024 [16:50], Руслан Авдеев

Equinix предложил ИИ-фабрики на базе систем Dell с ускорителями NVIDIAОператор ЦОД Equinix совместно с Dell Technologies предложил частные ИИ-облака на базе Dell AI Factory. Использование комплекса Dell AI Factory with NVIDIA в ЦОД IBX позволяет комбинировать различные продукты, решения и сервисы на нейтральной площадке, где клиенты смогут безопасно и экономически эффективно объединить ресурсы публичных облаков, колокейшн-объектов, а также собственных облачных и локальных инфраструктур. Dell AI Factory with NVIDIA включает серверы Dell PowerEdge XE9680 с ускорителями NVIDIA, Ethernet-решения NVIDIA Spectrum-X и BlueField-3, а также СХД Dell PowerScale F710. Кроме того, будут доступны и 4U-серверы PowerEdge XE9680L, поддерживающие до восьми новейших ускорителей NVIDIA Blackwell. Решение будет доступно в более чем 260 ЦОД Equinix IBX. В Equinix объявили, что намерены обеспечить клиентов передовой ИИ-инфраструктурой, отвечающей самым высоким стандартам производительности, безопасности и надёжности, а сотрудничество с Dell и NVIDIA позволит использовать максимум ресурсов систем генеративного ИИ, сохраняя контроль над данными и поддерживая собственные корпоративные цели достижения экоустойчивости. Наличие площадок Equinix в более 70 мегаполисах мира, время бесперебойной работы 99,999 %, масштабируемость проектов и сотрудничество с тысячами сетей и провайдеров, а также обеспечение ЦОД на 96 % возобновляемой энергией (100 % на ключевых рынках) в сочетании с платформой Dell AI Factory with NVIDIA, которая уже доступна в ЦОД Equinix в большинстве регионов мира, позволит заказчикам повысить удобство, безопасность и экологичность работы с генеративным ИИ.

25.12.2024 [14:00], Владимир Мироненко

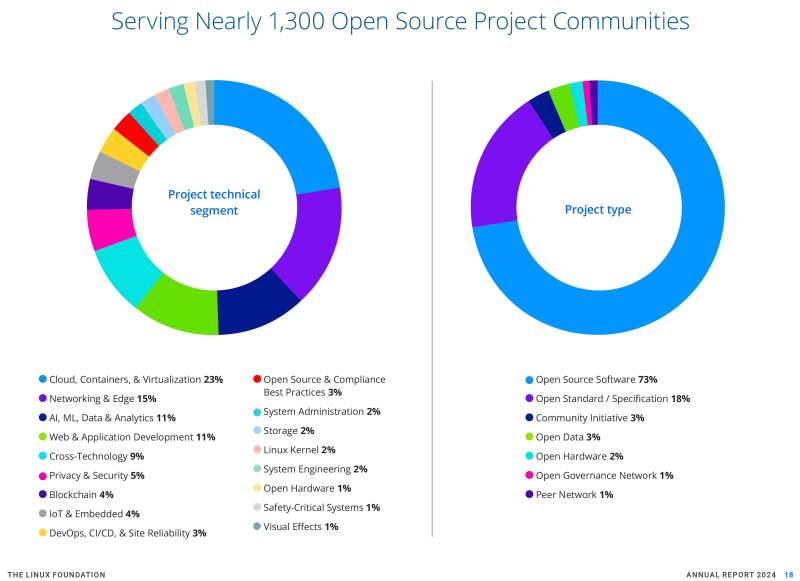

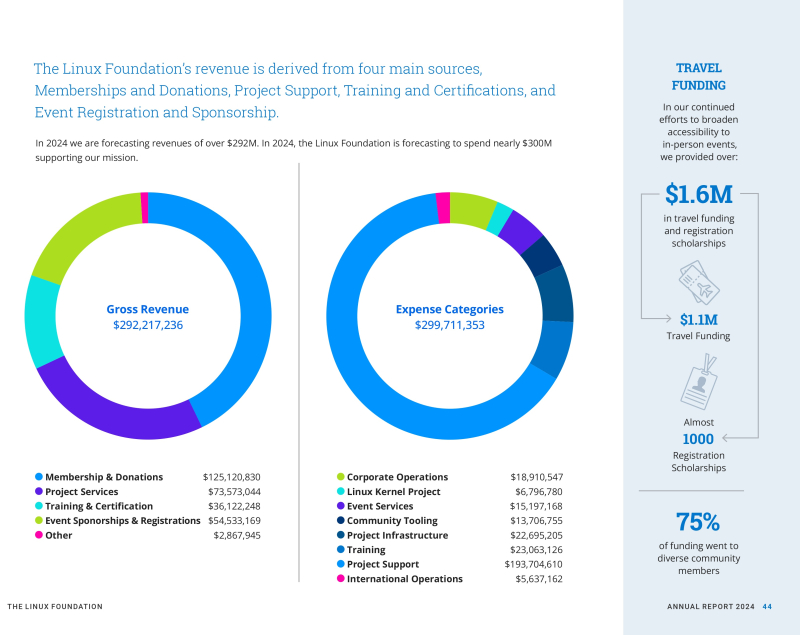

Linux Foundation сократила расходы на разработку ядра Linux до $6,8 млнОрганизация Foundation опубликовала отчёт за 2024 год. Всего за отчётный период организация получила $292,2 млн (год назад — $263,6 млн). Почти половина (43 % или $125,1 млн) полученных средств приходится на пожертвования и взносы участников организации. В прошлом году по этой статье было получено $118,2 млн. 25,1 % ($73,6 млн, год назад — $67 млн) было выделено организации в качестве целевой поддержка проектов; 18,6 % ($54,5 млн, год назад — $49,5 млн) приходится на поддержку мероприятий, а также регистрационные взносы на конференциях; 12,3 % ($36,1 млн, год назад — $27,2 млн) получено в качестве оплаты за обучающие курсы и получение сертификатов. Организация отметила, что доля затрат, связанных с разработкой ядра, в общем объёме расходов снизилась до 2,3 % с 2,9 % в 2023 году. В 2022 доля составляла 3,2 %, в 2021 году — 3,4 %. На разработку ядра Linux в этом году было израсходовано $6,8 млн, что на $1 млн меньше, чем в прошлом году и на $1,4 млн меньше, чем в позапрошлом году. Общая сумма расходов за 2024 год равняется 299,7 млн (в 2023 году — $269 млн). Расходы на не связанные с ядром проекты увеличились с $171,8 млн в прошлом году до $193,7 млн (64,6 % всех расходов). Расходы на поддержание инфраструктуры составили $22,69 млн (7,6 %, в прошлом году — $22,58 млн), затраты на программы обучения и сертификации — $23,1 млн (7,7 %, в прошлом году — $18,57 млн), затраты на корпоративные операции — $18,9 млн (6,3 %, в прошлом году — $17,1 млн), расходы на проведение мероприятий — $15,2 млн (5,0 %, в прошлом году — $14,61 млн), затраты на сопровождение сообщества — $13,7 млн (4,5 %, год назад — $13,5 млн). Расходы на международные операции выросли с $2,96 млн до $5,6 млн (1,8 %). Сообщается, что количество курируемых Linux Foundation проектов приблизилось к 1300, тогда как год назад их насчитывалось около 1100. Наибольшее число проектов Linux Foundation связано с облачными технологиями, контейнерами и виртуализацией (23 %), с сетевыми технологиями (15 %), ИИ (11 %), web-разработкой (11 %), cross-technology (9 %), безопасностью (5 %), Интернетом вещей (4 %) и блокчейном (4 %). |

|