Материалы по тегу: ram

|

11.04.2026 [19:53], Сергей Карасёв

Everspin увеличит мощности по производству MRAM-памятиКомпания Everspin Technologies, разработчик магниторезистивной энергонезависимой памяти с произвольным доступом (MRAM), объявила о заключении соглашения о стратегическом сотрудничестве с Microchip Technology. Партнёрство направлено на расширение производственных мощностей и обеспечение долгосрочных поставок MRAM-изделий. В настоящее время Everspin изготавливает MRAM-чипы и туннельные магниторезистивные (TMR) датчики на линии в Чандлере (Аризона, США), которая располагается на площадке NXP. В рамках нового соглашения Everspin создаст точную копию такого производства на объекте Microchip в американском штате Орегон. Партнёрство с Microchip, как ожидается, обеспечит ряд стратегических преимуществ. В частности, Everspin сможет нарастить объёмы выпуска продукции и обеспечить стабильность поставок. Кроме того, Everspin получит дополнительные возможности для реализации научно-исследовательских программ, направленных на улучшение характеристик MRAM и развитие соответствующей технологии. Речь идёт о новых сценариях использования такой памяти и о поддержке рабочих нагрузок следующего поколения.

Источник изображения: Everspin «Сотрудничество с Microchip позволит увеличить масштабы производства продукции для удовлетворения спроса, одновременно способствуя дальнейшей реализации наших планов в области MRAM», — заявил глава Everspin. Соглашение между Everspin и Microchip Technology заключено на 10 лет с возможностью последующего расширения каждые два года. Первые продукты, изготовленные на предприятии в Орегоне, поступят на рынок во II половине 2027 года. Everspin продолжит производить чипы MRAM и TMR-датчики на линии в Чандлере.

01.04.2026 [16:04], Сергей Карасёв

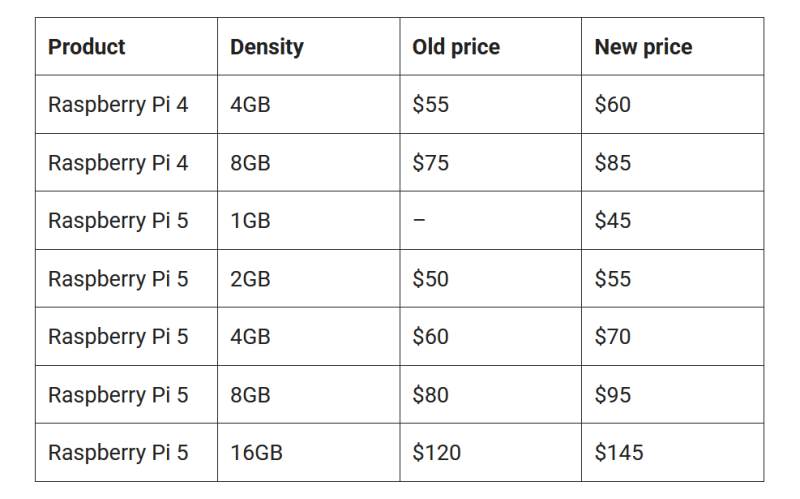

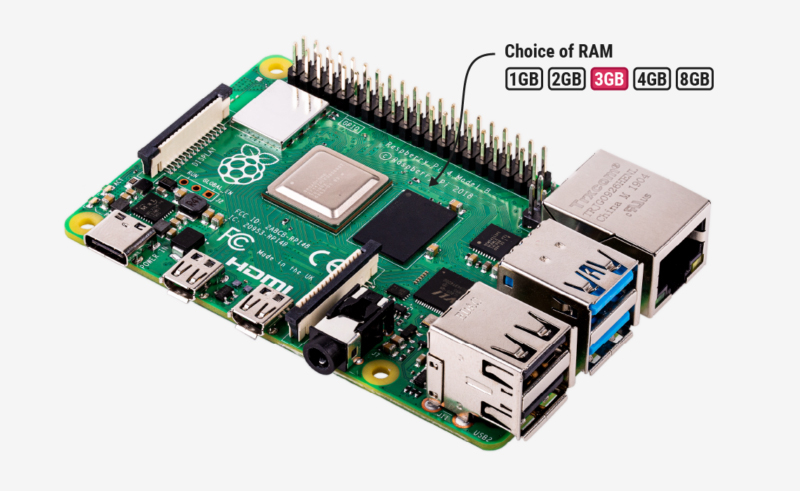

Дефицит памяти привёл к выпуску 3-Гбайт версии Raspberry Pi 4 и повышению цены Raspberry Pi 500+ сразу на $150Компания Raspberry Pi объявила об очередном повышении цен на свои одноплатные компьютеры и другие продукты. Удорожание связано с дефицитом чипов памяти DRAM и NAND на фоне стремительного развития инфраструктуры дата-центров для ИИ. Стоимость изделий Raspberry Pi уже была значительно увеличена два месяца назад. Новое повышение цен распространяется на Raspberry Pi 4 и Raspberry Pi 5 с объемом памяти 4 Гбайт и более, Raspberry Pi 500 и Raspberry Pi 500+, все варианты Compute Module 4, Compute Module 4S и Compute Module 5 и другие изделия. В целом, подорожали следующие продукты:

Источник изображения: Raspberry Pi Вместе с тем Raspberry Pi представила новую модификацию одноплатного компьютера Raspberry Pi 4, оснащённую 3 Гбайт ОЗУ. Такое изделие, занявшее промежуточное положение между версиями с 2 и 4 Гбайт оперативной памяти, предлагается за $83,75. Отмечается также, что пока не планируется повышать цены на классические продукты, включая Raspberry Pi Zero, Raspberry Pi Zero W и Raspberry Pi Zero 2 W, Raspberry Pi 1, Raspberry Pi 3, Raspberry Pi 3B+ и Raspberry Pi 3A+, а также Raspberry Pi Compute Module 1 и Raspberry Pi Compute Module 3+ . В этих устройствах используется более старая память LPDDR2 DRAM, которая в достаточном количестве имеется на складах Raspberry Pi.

16.03.2026 [09:32], Сергей Карасёв

Everspin представила MRAM-чипы Unisyst ёмкостью до 2 ГбитEverspin Technologies анонсировала новое семейство чипов магниторезистивной энергонезависимой памяти с произвольным доступом (MRAM) — изделия Unisyst, ориентированные на применение во встраиваемых системах. Отмечается, что решения Unisyst используют унифицированную архитектуру MRAM, объединяющую традиционную память и постоянное хранилище высокой плотности. На первом этапе чипы новой серии будут предлагаться в вариантах ёмкостью от 128 Мбит до 2 Гбит. Задействован последовательный интерфейс xSPI (8 линий, работающих на частоте 200 МГц).

Источник изображения: Everspin Technologies Устройства на базе Unisyst будут соответствовать стандарту AEC-Q100 Grade 1. Гарантирована сохранность записанной информации в течение как минимум 10 лет. При этом чипы могут эксплуатироваться при экстремальных температурах. Заявленная скорость чтения данных достигает 400 Мбайт/с, скорость записи — приблизительно 90 Мбайт/с: это, как подчёркивает Everspin, более чем в 400 раз превосходит показатели памяти NOR. Изделия Unisyst предназначены для приложений, которым требуется энергонезависимая память, сочетающая высокую пропускную способность, износостойкость и предсказуемое поведение при изменении температуры. В качестве ключевых сфер использования названы автомобильная, аэрокосмическая и промышленная отрасли, а также периферийные системы с ИИ-функциями. Инженерные образцы MRAM-чипов Unisyst станут доступны в IV квартале 2026 года. Впоследствии Everspin намерена расширять данное семейство.

05.03.2026 [14:21], Владимир Мироненко

Дефицит памяти поможет Broadcom подзаработать, но не так, как вы подумалиВ связи с ростом цен на оперативную память на фоне её дефицита, который, по прогнозам экспертов, сохранится и в 2027 году, VMware (подразделение Broadcom) предложила частное облако VMware Cloud Foundation (VCF) 9.0 в качестве решения, необходимого для работы в новых условиях. VMware заявила, что «традиционный подход, заключающийся в увеличении количества оборудования для решения проблем производительности и масштабируемости, больше не является жизнеспособным». «Broadcom разработала VCF 9.0 специально для решения этой экономической задачи, предложив три различных подхода: снижение совокупной стоимости владения за счёт многоуровневого хранения памяти, отсрочка капитальных затрат за счёт передовых технологий повышения эффективности и обеспечение немедленного внедрения в существующий парк оборудования», — сообщила она. Как отметил The Register, VMware всегда продвигала многоуровневую организацию памяти VCF 9 как возможность снизить затраты на инфраструктуру за счёт уменьшения установленного объёма DRAM путём прозрачного переноса части данных на NVMe. Вместе с тем, не следует забывать, что стоимость SSD также выросла. VMware также признаёт, что её архитектура памяти подходит не для всех рабочих нагрузок и не предназначена для виртуальных машин, чувствительных к задержкам, или очень больших инстансов. Но VMware всё равно утверждает, что «наиболее прямое решение проблемы стремительного роста цен на DRAM — это просто использовать её меньше», а VCF 9.0 позволяет «заменить дорогостоящую DRAM значительно более дешёвым хранилищем NVMe». Многоуровневое распределение памяти VMware в настоящее время превосходит альтернативу в виде CXL, пишет The Register. Кроме того, новые поколения серверных процессоров AMD и Intel создали возможность очередного этапа консолидации нагрузок. Dell утверждает, что её клиенты заменяют семь серверов одной новой машиной; Intel говорит о консолидации 5:1. Новые серверы позволяют запускать огромное количество ВМ, что концентрирует риски и требует огромного количества дорогостоящей памяти. Но VMware и не требует, чтобы в каждом хосте в кластере использовалось многоуровневое распределение памяти. Так что VCF 9 в текущей ситуации действительно может оказаться эффективным средством снижения затрат. В то же время The Register отметил, что многие пользователей vSphere считают VCF 9 очень дорогим продуктом, несмотря на уверения Broadcom в обратном. При этом Broadcom, похоже, в принципе не готова идти на ценовые уступки — или бери, или уходи.

02.03.2026 [12:35], Сергей Карасёв

Team Group анонсировала новые индустриальные NVMe SSD и модули памятиTeam Group готовит новые SSD в различных форм-факторах, а также модули оперативной памяти для индустриальных и встраиваемых систем. В частности, готовятся накопители Team Group Industrial R252 стандарта U.2 (NVMe), предназначенные для серверов. Эти устройства оснащены интерфейсом PCIe 5.0 x4. Они обеспечивают скорость последовательного чтения информации до 14 000 Мбайт/с, скорость последовательной записи — до 10 000 Мбайт/с. Кроме того, выйдут SSD серии Team Group Industrial R253, ориентированные на решение разнообразных задач в современных дата-центрах и на периферии. Такие устройства, получившие формат EDSFF E3.S, позиционируются в качестве накопителей большой ёмкости с улучшенной защитой данных. Они подходят для обработки ИИ-нагрузок, аналитики в реальном времени и пр. Дебютируют также SSD семейства Team Group Industrial R251 стандарта EDSFF E1.S, оптимизированные для серверов форм-фактора 1U. Эти накопители имеют сертификацию по стандартам виброустойчивости MIL-STD, что означает надёжность при эксплуатации в системах с высокой плотностью размещения оборудования.

Источник изображений: Team Group В сегменте оперативной памяти Team Group представит новые модули Industrial DDR4 U-DIMM и SO-DIMM, специально разработанные для промышленного применения и IoT-устройств. Помимо этого, готовятся изделия Industrial DDR5 CU-DIMM и CSO-DIMM с частотой до 7200 МГц, рассчитанные на ИИ-платформы. На системы со значительной интенсивностью вычислений ориентированы решения Team Group Industrial LPDDR5X CAMM2: они обеспечивают высокую пропускную способность и низкую задержку.

05.02.2026 [17:58], Сергей Карасёв

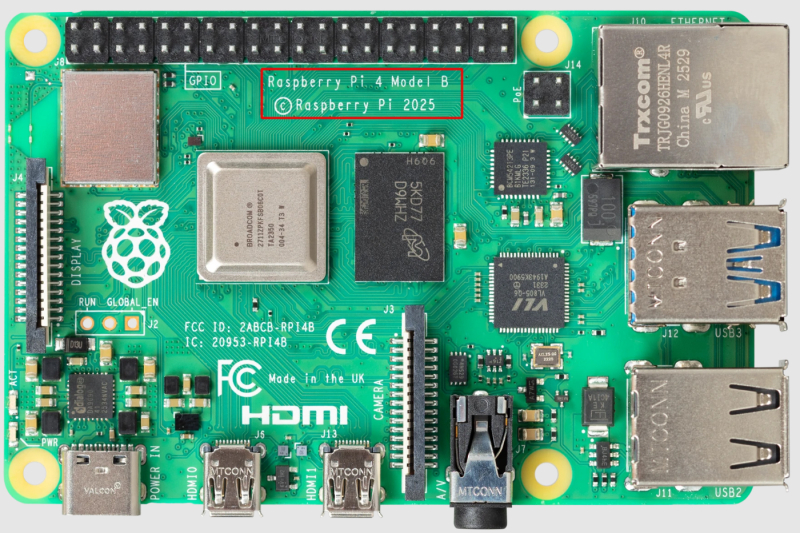

Из-за дефицита памяти у Raspberry Pi 4 появился версия со «сдвоенной» RAM, а 16-Гбайт версия Raspberry Pi 5 существенно подорожалаКомпания Raspberry Pi, по сообщению ресурса CNX Software, из-за дефицита чипов памяти, сформировавшегося на фоне бума ИИ, продолжает поднимать цены на свои одноплатные компьютеры. А в конструкцию отдельных моделей даже внесены изменения с целью обеспечения гибкости в цепочке поставок DRAM. Напомним, в конце прошлого года повысились цены на изделия Raspberry Pi 4 и Raspberry Pi 5: прирост составил от $5 до $25 в зависимости от модификации. Очередное изменение стоимости затронуло названные одноплатные компьютеры, а также вычислительные модули Raspberry Pi Compute Module 4 и Raspberry Pi Compute Module 5, несущие на борту 2 Гбайт оперативной памяти и более (модификации с 1 Гбайт ОЗУ предлагаются по прежней цене). Прибавка выглядит следующим образом:

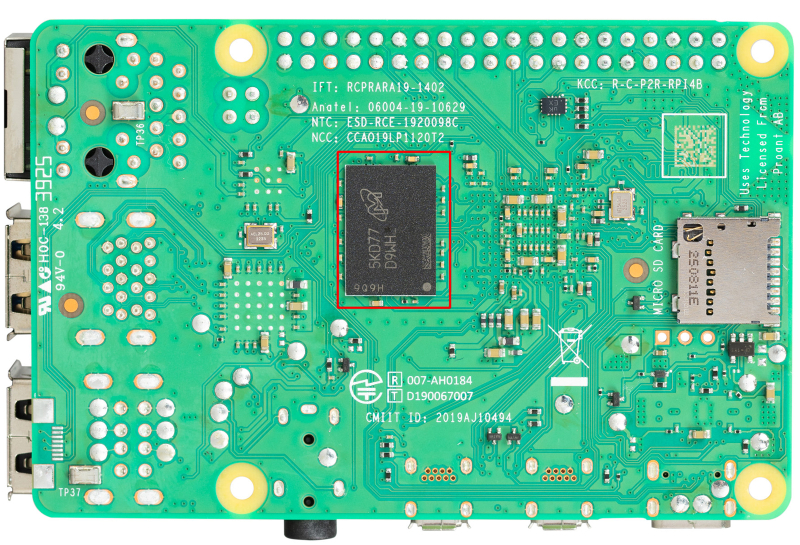

Вместе с тем выпущен новый вариант Raspberry Pi 4 — изделие Raspberry Pi 4 v1.5 Dual RAM (маркировка «Raspberry Pi 4 Model B © Raspberry Pi 2025»). У такого одноплатного компьютера вместо одного чипа LPDDR4 используются два, которые расположены на лицевой и обратной сторонах. CNX Software отмечает, что на фоне нехватки компонентов DRAM может сложиться ситуация, когда два чипа памяти на 4 Гбайт будут стоить дешевле одного на 8 Гбайт. Кроме того, такая компоновка позволит решить проблему недоступности модулей LPDDR4 большой ёмкости: производитель сможет заменять их парой чипов вдвое меньшего объема.

04.02.2026 [10:12], Сергей Карасёв

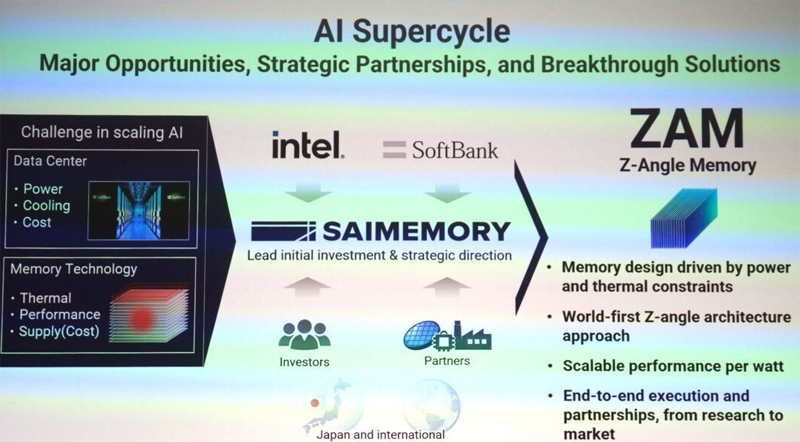

Intel и SoftBank займутся разработкой памяти Z-Angle Memory (ZAM) — альтернативы HBM для ИИ-системКорпорации Intel и SoftBank объявили о сотрудничестве в рамках проекта по разработке высокопроизводительной памяти нового типа Z-Angle Memory (ZAM), ориентированной на ИИ-системы. Предполагается, что в перспективе такие решения составят конкуренцию HBM. В инициативе принимает участие Saimemory — дочернее предприятие SoftBank, сформированное в декабре 2024 года. Речь идёт о разработке многослойной архитектуры DRAM с вертикальной компоновкой. Цель заключается в увеличении ёмкости чипов памяти и их пропускной способности по сравнению с HBM при одновременном снижении энергопотребления. Проект ZAM основан на результатах исследований, полученных по программе передовых технологий памяти AMT (Advanced Memory Technology), которая управляется Министерством энергетики США (DOE) и Администрацией по национальной ядерной безопасности США (NNSA). В данной программе участвуют Сандийские национальные лаборатории (SNL), Ливерморская национальная лаборатория имени Лоуренса (LLNL) и Лос-Аламосская национальная лаборатория (LANL) в составе DOE. Планируется использование технологии сборки Intel Next Generation DRAM Bonding (NGDB), которая, как утверждается, значительно повышает производительность DRAM, снижает энергопотребление и оптимизирует затраты на память.

Источник изображения: TechPowerUp В целом, в рамках нового проекта Intel и Saimemory планируют увеличить ёмкость модулей памяти в два–три раза по сравнению с современными HBM, снизить энергопотребление на 40–50 % и при этом сохранить конкурентоспособную стоимость. Предполагается, что появление ZAM позволит устранить ключевые узкие места при масштабировании высокопроизводительных систем ИИ. Работы над памятью нового типа начнутся в текущем квартале. Демонстрация прототипов запланирована на 2027 год, а коммерциализация технологии — на 2030-й.

29.12.2025 [14:09], Руслан Авдеев

Fujitsu поможет SoftBank в создании дешёвой и доступной альтернативы HBMКомпания Fujitsu присоединится к проекту, возглавляемому японской инвестиционной группе SoftBank. Партнёры намерены разрабатывать память нового поколения для ИИ и суперкомпьютеров, сообщает Nikkei Asian Review. Япония намерена восстановить компетенции, в своё время позволившие стране стать одним из лидеров в сфере производства модулей памяти. «Командным центром» для реализации государственно-частного проекта должна стать компания Saimemory, основанная SoftBank; участие, помимо Fujitsu, примут и другие партнёры. Saimemory рассчитывает разработать высокопроизводительную память, способную стать альтернативой HBM. Проект предусматривает инвестиции в ¥8 млрд ($51,2 млн) в 2027 финансовом году для завершения создания прототипа. Массовое производство должно начаться к 2029 финансовому году. Сама SoftBank к 2027 финансовому году выделит Saimemory ¥3 млрд, Fujitsu и японский научно-исследовательский институт Riken в совокупности вложат около ¥1 млрд. Часть расходов, как ожидается, должно компенсировать японское правительство посредством программ поддержки разработки полупроводников нового поколения. В своё время Fujitsu была ключевым игроком в некогда ведущей в мире японской полупроводниковой индустрии. Хотя она со временем отказалась от производства памяти, у неё накоплен богатый опыт в области массового производства модулей и контроля их качества. Сейчас компания продолжает заниматься разработкой энергоэффективных CPU и сохраняет прочные связи с клиентами.

Источник изображения: Fujitsu Saimemory намерена наладить масовое производство памяти с ёмкостью вдвое или втрое больше, чем у HBM при энергопотреблении вдвое ниже, при этом цена будет сопоставимой или даже более привлекательной. Компания рассчитывает использовать полупроводниковые технологии, разработанные Intel и Токийским университетом, а Shinko Electric Industries и тайваньская Powerchip Semiconductor Manufacturing помогут с производством и созданием прототипов. Intel обеспечит базовую технологию вертикального штабелирования, разработанную при поддержке американского военного ведомства DARPA, которая позволит увеличить количество чипов памяти на единицу площади и сократить расстояние передачи данных. Также будут применяться технологии Токийского университета и других компаний для рассеивания тепла и упрощения передачи данных. Saimemory будет специализироваться на управлении интеллектуальной собственностью и разработке чипов, передавая заказы на производство сторонним компаниям. С распространением систем генеративного ИИ, требуемая вычислительная мощность в Японии, по некоторым оценкам, увеличится более чем в 300 раз между 2020 и 2030 гг. Тем не менее Япония, некогда бывшая одним из лидеров в производстве полупроводников, теперь сильно зависит от зарубежных компаний. В результате существуют риски перебоев с поставками и вероятность неконтролируемого роста цена на них. На южнокорейские компании приходится около 90 % доли выпуска HBM-памяти. По данным Nikkei, в своё время японский бизнес постепенно прекратил производство собственной памяти приблизительно в 2000 году. Появление и развитие ИИ-технологий может изменить положение. SoftBank движется к строительству собственных больших дата-центров, а Fujitsu уже выпускает CPU для ЦОД и инфраструктуру связи, практическое применение которым, вероятно, найдут уже в 2027 году.

23.12.2025 [12:28], Сергей Карасёв

Goodram представила 122,88-Тбайт SSD для ЦОД с иммерсионным охлаждениемКомпания Goodram Industrial, принадлежащая Wilk Elektronik SA, без громких анонсов представила свой первый SSD вместимостью 122,88 Тбайт, предназначенный для использования в системах с иммерсионным (погружным) жидкостным охлаждением. Устройство рассчитано на дата-центры и площадки гиперскейлеров. Накопитель относится к семейству DC25F. В его основу положены чипы флеш-памяти QLC NAND. Доступны модификации в форм-факторах E3.S и E3.L: в обоих случаях для подключения служит интерфейс PCIe 5.0 x4. Заявленная скорость последовательного чтения информации достигает 14 600 Мбайт/с, скорость последовательной записи — 3200 Мбайт/с. Показатель IOPS составляет до 3 млн при произвольном чтении данных 4K-блоками и до 35 тыс. при произвольной записи. Накопители способны выдерживать 0,3 полных перезаписи в сутки (0,3 DWPD) на протяжении пяти лет. Это ставит их в один ряд с другими QLC-устройствами корпоративного класса, предназначенными для «теплого» и «холодного» хранения данных.

Источник изображения: Goodram Goodram отмечает, что накопители прошли всестороннее тестирование с использованием различных диэлектрических жидкостей для иммерсионного охлаждения, включая составы Shell и Chevron. Утверждается, что эти SSD рассчитаны на длительную эксплуатацию без деградации. Помимо модели вместимостью 122,88 Тбайт, Goodram предлагает широкий выбор других SSD для систем с иммерсионным охлаждением. Это устройства ёмкостью от 1,92 Тбайт и выше на основе чипов TLC NAND и QLC NAND с интерфейсами SATA, PCIe 4.0 и PCIe 5.0. Они доступны в форм-факторах SFF U.2 и U.3, E3.S и E1.S, M.2 2280 и M.2 22110.

01.12.2025 [19:10], Владимир Мироненко

Дефицит памяти добрался и до Raspberry Pi: цены на четвёртую и пятую «малинку» вырослиРост цен на компоненты для вычислительных систем, который в основном объясняют бумом на ИИ-рынке, привёл к удорожанию даже традиционно дешёвых одноплатных компьютеров Raspberry Pi. Как сообщила компания, после увеличения в октябре цен на вычислительные модули CM4/CM5 из-за ограничений поставок памяти DDR4, ей пришлось повысить цены на Raspberry Pi 4 и 5. Для тех, кто ищет более доступный вариант, компания выпустила модель Raspberry Pi 5 1 Гбайт. Однако его цена выше традиционных $35 — сразу $45. Впрочем, цена Raspberry Pi 4 1 Гбайт не изменилась и по-прежнему составляет $35. Напомним, что в октябре цена CM4/CM5 с 4 Гбайт памяти выросла на $5, с 8 Гбайт памяти — на $10. Стоимость Raspberry Pi 500 была увеличена на $10 — до $100. Компания пообещала вернуть цены к прежним значениям, как только снизится цена памяти. Ранее она так уже делала. «…, чтобы компенсировать недавний беспрецедентный рост стоимости памяти LPDDR4, мы объявляем о повышении цен на некоторые модели Raspberry Pi 4 и 5. Эти изменения во многом отражают повышение цен на наши вычислительные модули, о котором мы объявили в октябре, и помогут нам обеспечить поставки памяти в условиях всё более ограниченного рынка в 2026 году», — объявила Raspberry Pi. Ниже показано, как изменились цены на компьютеры Raspberry Pi. В перечне не указаны модели Raspberry Pi 4 2 Гбайт, Raspberry Pi 3+ и более ранние модели, а также семейство Raspberry Pi Zero, которых не коснулось изменение цен. Как отметил ресурс CNX Software, Raspberry Pi 5 1 Гбайт доступен ограниченно, поскольку, по всей видимости, он продаётся в основном через европейских реселлеров, а также через Canakit в США и Канаде. Однако найти его в Азии будет сложно, и ни у одного из реселлеров «остального мира» эта модель не имеется в наличии, отметил ресурс. |

|