Материалы по тегу: nvidia

|

05.06.2024 [14:58], Руслан Авдеев

Зачем арендовать, когда можно купить: CoreWeave захотела приобрести за $1 млрд своего хостинг-провайдера Core Scientific [Обновлено]Облачный провайдер CoreWeave предложил $1 млрд компании Core Scientific, предоставляющей хостинг для HPC-систем и параллельно занимающейся криптомайнингом. Datacenter Dynamics сообщает, что предложение поступило всего через несколько дней после подписания соглашения на аренду 200 МВт в течение 12 лет за $3,5 млрд. Как сообщают отраслевые источники, речь идёт о покупке компании из расчёта $5,75 за акцию — это несколько меньше биржевой стоимости Core Scientific на момент предложения. Компании сотрудничают уже несколько лет — в Core Scientific говорят об аренде «тысяч ускорителей» с 2019 по 2022 гг. Если соглашение об аренде 200 МВт останется в силе, то последней придётся модифицировать многочисленные площадки для размещения ускорителей NVIDIA, принадлежащих CoreWeave. Модернизация должна начаться летом 2024 года, а закончить её планируется в первой половине 2025-го. На это потребуется около $300 млн, которые будут получены от платежей CoreWeave за хостинг, но инвестировать можно будет не более половины от ежемесячной платы. Договор с CoreWeave позволяет дважды продлить аренду мощностей сроком на пять лет, в том числе на других площадках Core Scientific. Предполагается, что сделка с CoreWeave позволит диверсифицировать бизнес и сбалансировать майнинг и хостинг для ИИ-проектов для максимизации прибыли и минимизации рисков. В Core Scientific заявили, что из доступных ей почти 1,2 ГВт мощностей она может выделить до 500 МВТ для HPC/ИИ-хостинга. Часть майнинговых проектов перенесут с одних площадок на другие, компактно высвобождая место для HPC-кластеров. CoreWeave, основанная в 2017 году, в своё время и сама занималась криптовалютами и блокчейн-технологиями, но впоследствии переключилась на облачные ИИ-платформы. Компания привлекла миллиарды долларов в качестве инвестиций и просто в долг. На сегодня она предлагает сервисы в трёх регионах: US East (Нью-Джерси), US West (Невада) и US Central (Иллинойс). Компания активно арендует мощности и к концу 2023 года намеревалась управлять 14 дата-центрами, а к концу 2024 — 28 ЦОД. CoreWeave заявила, что потратит $1,6 млрд на постройку ЦОД для ИИ-супероблака, перенесёт часть мощностей в ЦОД Chirisa, арендует дата-центры Flexential и TierPoint в США. В марте этого года CoreWeave арендовала 16 МВт в ЦОД Core Scientific в Остине (Техас). Компания считается крупным клиентом Digital Realty, арендующим стойки для «десятков тысяч» ускорителей в одном из ЦОД на западном побережье США. Недавно компания анонсировала строительство двух ЦОД в Великобритании и присматривается к ЦОД EdgeConneX в Барселоне. Прямым конкурентом компании считается Lambda Labs, масштабы бизнеса которой гораздо скромнее. Core Scientific тоже основана в 2017 году, но управляет криптомайнинговыми кампусами ЦОД в США. Всего компания располагает 745 МВт доступной энергии и ещё 372 МВт зарезервированной ёмкости. У неё имеется собственное майнинговое оборудование и, конечно, на её мощностях расположено оборудование клиентов. Впрочем, дела Core Scientific идут довольно плохо — в декабре 2022 года она подала заявление о банкротстве, после чего цена её акций упала на 98 %. UPD 06.06.2024: руководство Core Scientific отказалось от предложения CoreWeave о покупке, отметив, что ведёт переговоры с другими клиентами по поводу предоставления ёмкостей для хостинга HPC- и ИИ-проектов. Компания считает, что для неё это пока более прибыльно, чем продажа. На фоне последних новостей акции компании выросли. UPD 26.06.2024: CoreWeave подписала с Core Scientific ещё одно соглашение об аренде, на этот раз на 12 лет и 70 МВт.

04.06.2024 [17:52], Руслан Авдеев

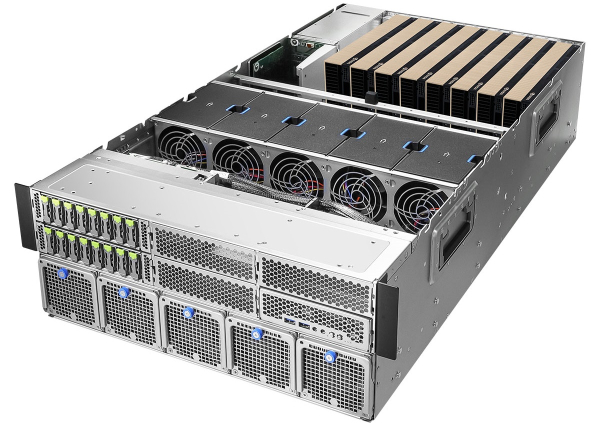

Sharp, KDDI и Supermicro построят крупнейший в Азии дата-центр для ИИ на базе суперускорителей NVIDIA GB200 NVL72Японский производитель электроники Sharp совместно с телеком-компанией KDDI готовятся построить «крупнейший в Азии» дата-центр для ИИ-вычислений на базе завода Sakai Plant по выпуску LCD-дисплеев в Осаке. По данным Datacenter Dynamics, партнёры привлекли к проекту и другие компании. В частности, подписано соглашение с Supermicro и Datasection. Вместе они переделают завод Sakai в современный дата-центр для ИИ-задач на базе аппаратных решений NVIDIA. Ранее сообщалось, что «материнская» компания данного предприятия — тайваньская Foxconn — планирует закрыть завод осенью этого года и превратить его в ЦОД из-за растущих убытков на рынке LCD. В заявлении KDDI указывается, что дата-центр будет использовать новейшие суперускорители NVIDIA GB200 NVL72, на которых возложат задачи обучения и запуска LLM. Более подробных официальных спецификаций ЦОД пока нет, но издание Nikkei Asian Rewiew сообщает, что ЦОД получит минимум 1 тыс. узлов. Говорится, что инфраструктура бывшего завода Sharp Sakai Plant отлично подойдёт для дата-центра, поскольку имеет достаточно подходящих площадей и достаточно энергии для питания мощных серверов. Datasection будет поддерживать функционирование ЦОД, KDDI возьмёт на себя строительство, в том числе сетевой инфраструктуры — компания является «родительскоим» бизнесом для Telehouse, уже управляющей ЦОД по всему миру, в том числе в Азии. Supermicro обеспечит передовые комплексные системы жидкостного охлаждения (СЖО) с системами мониторинга их работы. По словам Supermicro, сотрудничество участвующих в проекте ЦОД компаний стали хорошим примером приверженности индустрии к «зелёным» вычислениям и готовности к глобальному внедрению ИИ-систем.

04.06.2024 [12:10], Руслан Авдеев

Илон Маск готовит для xAI суперкомпьютер c 300 тыс. NVIDIA B200, но пока придётся обойтись H100Илон Маск (Elon Musk) заявляет, что к лету 2025 года его ИИ-стартап xAI введёт в эксплуатацию суперкомпьютер c 300 тыс. новейших ускорителей NVIDIA B200 и SuperNIC ConnectX-8, передаёт Datacenter Dynamics. Заодно Маск пообещал уже в ближайшие месяцы ввести в эксплуатацию кластер из 100 тыс. ускорителей NVIDIA H100 с жидкостным охлаждением. При этом важно помнить, что Маск нередко даёт обещания, которые потом никогда не выполняет или выполняет совсем не так, как ожидалось. Например, на днях The Information сообщала, что 100 тыс. ускорителей H100 должны заработать только следующим летом. Вероятнее всего, компания построит компактный и относительно недорогой кластер, который позже расширится до 100 тыс. ускорителей. Такую же схему могут реализовать и с системой из 300 тыс. ускорителей. Предполагается, что такой суперкомпьютер будет стоить десятки миллиардов долларов — больше, чем xAI привлекла от инвесторов. По словам главы NVIDIA Дженсена Хуанга (Jensen Huang), один B200 стоит $30-40 тыс. Даже если Маску удастся приобрести ускорители подешевле, речь будет идти о $9 млрд. С учётом того, что компании понадобится инфраструктура, связь, классические процессоры, земля и коммунальное обслуживание, речь будет идти о ещё более дорогостоящем проекте — даже не принимая во внимание стоимости потребляемой воды и электроэнергии. В прошлом месяце xAI привлекла $6 млрд в ходе очередного раунда финансирования, что подняло стоимость компании до $24 млрд. В совокупности с предыдущим раундом, в ходе которого удалось собрать $1 млрд, средств будет достаточно для покупки 100 тыс. H100, оплату работы персонала и текущих вычислительных потребностей — пока xAI арендует около 16 тыс. ускорителей H100 у Oracle Cloud, а недавно сообщалось о намерении xAI потратить $10 млрд на серверы в облаке Oracle.

03.06.2024 [09:21], Владимир Мироненко

NVIDIA объявила об интеграции NIM с KServeNVIDIA объявила, что набор инференес-микросервисов NVIDIA NIM будет работать с open source платформой KServe на базе Kubernetes, которая позволит автоматизировать развёртывание ИИ-моделей. Это также делает NIM широкодоступным на платформах различных компаний, таких как Canonical, Nutanix и Red Hat. Интеграция NIM в KServe позволяет расширить возможность использования технологий NVIDIA сообществом, партнёрами по экосистеме и клиентами. Благодаря интеграции с KServe пользователи смогут получить доступ к NIM на многих корпоративных платформах, таких как Charmed KubeFlow от Canonical, Charmed Kubernetes, Nutanix GPT-in-a-Box 2.0, Red Hat OpenShift AI и многих других.

Источник изображения: NVIDIA В рамках интеграции NIM компания NVIDIA планирует активно участвовать в продвижении KServe, опираясь на свой портфель ПО с открытым исходным кодом, включая Triton и TensorRT-LLM. NVIDIA также является активным членом фонда Cloud Native Computing Foundation. NVIDIA и ранее участвовала в разработке KServe и адаптации этого инструмента под свои нужды, равно как и AWS, Bloomberg, Canonical, Cisco, Hewlett Packard Enterprise, IBM, Red Hat, Zillow.

03.06.2024 [07:53], Владимир Мироненко

Сети и периферия: NVIDIA расширила свою программу сертификацииNVIDIA объявила о расширении программы сертифицирования систем, которая теперь включает две новых платформы: Spectrum-X и IGX. Как сообщается, каждая сертифицированная компанией система проходит тщательное тестирование и проверяется на предмет обеспечения должного уровня производительности, управляемости, безопасности и масштабируемости корпоративного уровня. Наличие сертификации свидетельствует о поддержке NVIDIA AI Enterprise, в том числе микросервисов MVIDIA NIM. Серверы, получившие сертификат NVIDIA Spectrum-X Ready, смогут выступать в качестве строительных блоков для HPC- и ИИ-кластеров и должны поддерживать современные ускорители NVIDIA. От сертифицированных периферийных систем на базе платформы NVIDIA IGX требуется долгосрочная поддержка, защищённость и проактивная безопасность, возможность удалённого управления и высокая производительность с низкой задержкой отклика. NVIDIA сообщила, что её ведущие партнёры готовы получить новые сертификаты. Такие компании, как ASUS, Dell, GIGABYTE, HPE, Ingrasys, Lenovo, QCT и Supermicro вскоре предложат сертифицированные NVIDIA системы Spectrum-X Ready. А сертифицированные NVIDIA системы IGX скоро будут доступны у ADLINK, Advantech, Aetina, Ahead, Cosmo Intelligent Medical Devices (подразделение Cosmo Pharmaceuticals), Dedicated Computing, Leadtek, Onyx и YUAN.

02.06.2024 [16:20], Сергей Карасёв

NVIDIA представила ускорители GB200 NVL2, платформы HGX B100/B200 и анонсировала экосистему следуюшего поколения Vera RubinNVIDIA сообщила о широкой отраслевой поддержке своей архитектуры нового поколения Blackwell. Эти ускорители, а также чипы Grace легли в основу многочисленных систем для ИИ-фабрик и дата-центров, которые, как ожидается, будут способствовать «следующей промышленной революции». Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) объявил о том, что серверы на базе Blackwell выпустят ASRock Rack, ASUS, Gigabyte, Ingrasys, Inventec, Pegatron, QCT, Supermicro, Wistron и Wiwynn. Речь идёт об устройствах разного уровня, рассчитанных на облачные платформы, периферийные вычисления и ЦОД клиентов. «Началась очередная промышленная революция. Компании и целые страны сотрудничают с NVIDIA, чтобы трансформировать традиционные дата-центры общей стоимостью в триллионы долларов в платформы нового типа — фабрики ИИ», — говорит Хуанг. Для решения ИИ-задач и поддержания других ресурсоёмких приложений будут выпущены серверы с CPU на архитектурах х86 и Arm (изделия Grace) с воздушным и жидкостным охлаждением. Заказчикам будут доступны модели с одним и несколькими ускорителями. В частности, сама NVIDIA предлагает DGX-системы Blackwell, а для сторонних производителей доступны готовые платформы HGX B100 и HGX B200. Кроме того, компания представила ускоритель GB200 NVL2, т.е. сборку из двух GB200, объединённых NVLink 5. NVIDIA также сообщила о том, что модульная архитектура NVIDIA MGX отныне поддерживает Blackwell, включая и GB200 NVL2. В целом, NVIDIA MGX предлагает свыше 100 различных конфигураций. На сегодняшний день на базе MGX выпущены или находятся в разработке более 90 серверов от более чем 25 партнёров NVIDIA по сравнению с 14 системами от шести партнёров в 2023 году. В составе MGX, в частности, впервые будут использоваться изделия AMD EPYC Turin и чипы Intel Xeon 6 (ранее — Granite Rapids). Отмечается, что глобальная партнёрская экосистема NVIDIA включает TSMC, а также поставщиков различных компонентов, включая серверные стойки, системы электропитания, решения для охлаждения и пр. В число поставщиков такой продукции входят Amphenol, Asia Vital Components (AVC), Cooler Master, Colder Products Company (CPC), Danfoss, Delta Electronics и Liteon. Серверы нового поколения готовят Dell Technologies, Hewlett Packard Enterprise (HPE) и Lenovo. В скором времени NVIDIA представит улучшенные ускорители Blackwell Ultra, которые получат более современную HBM3e-память. А уже в следующем году компания покажет решения на архитектуре следующего поколения: ускорители Rubin, процессоры Vera, NVLink 6 с удвоенной пропускной способностью (3,6 Тбайт/с), коммутаторы X1600 и DPU SuperNIC CX9 для сетей 1,6 Тбит/с.

02.06.2024 [15:30], Сергей Карасёв

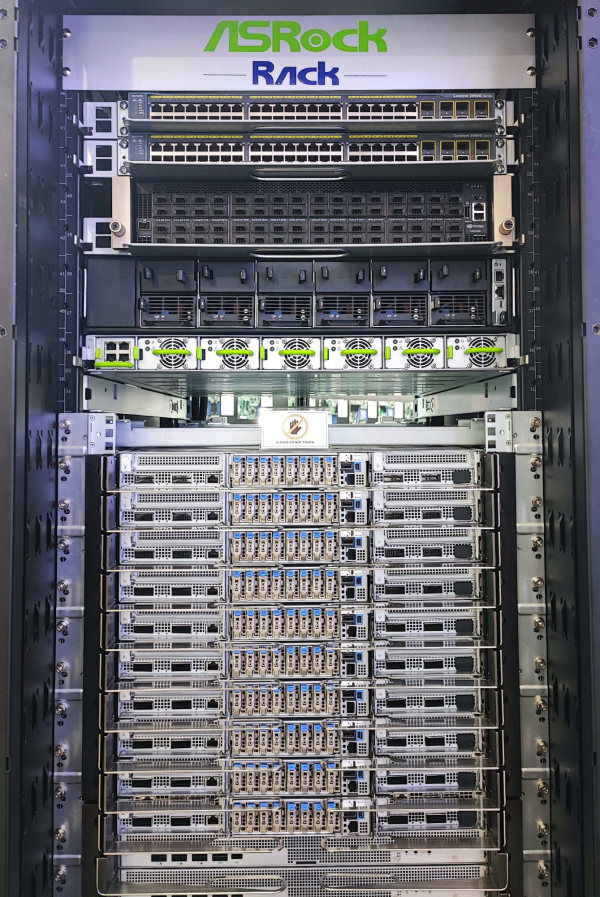

ASRock Rack анонсировала ИИ-системы с ускорителями NVIDIA Blackwell GB200, B200 и B100Компания ASRock Rack представила серверы с ускорителями NVIDIA Blackwell, предназначенные для решения ресурсоёмких задач в области ИИ и НРС. В частности, демонстрируются устройства, оборудованные системой жидкостного охлаждения. В число новинок на базе архитектуры NVIDIA Blackwell входят стоечная система ORV3 NVIDIA GB200 NVL72 с СЖО и сервер 6U8X-GNR2/DLC NVIDIA HGX B200 с технологией прямого жидкостного охлаждения Direct-to-chip. Второе из названных устройств выполнено в формате 6U; поддерживаются до восьми ускорителей NVIDIA HGX B200. А сервер 6U8X-EGS2 NVIDIA HGX B100, в свою очередь, рассчитан на восемь NVIDIA HGX B100. Все новые серверы ASRock Rack NVIDIA HGX допускают использование до восьми DPU NVIDIA BlueField-3 SuperNIC. ASRock Rack также продемонстрировала системы, выполненные на модульной архитектуре NVIDIA MGX. Это, в частности, двухсокетный сервер 4UMGX-GNR2 формата 4U с возможностью установки восьми ускорителей FHFL. Устройство располагает пятью слотами FHHL PCIe 5.0 x16 и одним разъёмом HHHL PCIe 5.0 x16 с поддержкой NVIDIA BlueField-3 DPU и NVIDIA ConnectX-7 NIC. Есть 16 отсеков для накопителей E1.S (PCIe 5.0 x4) с возможностью горячей замены. «Мы представили решения для дата-центров на базе архитектуры NVIDIA Blackwell для самых требовательных рабочих нагрузок в области обучения больших языковых моделей (LLM) и генеративного ИИ. Мы и дальше намерены расширять семейство этих серверов», — сказал Вейши Са, президент ASRock Rack. На выставке Computex 2024 компания ASRock Rack демонстрирует и другие системы с ускорителями NVIDIA. Например, представлена модель MECAI-GH200 (на изображении) — на момент анонса это самый компактный в мире сервер с суперчипом NVIDIA GH200.

02.06.2024 [15:30], Сергей Карасёв

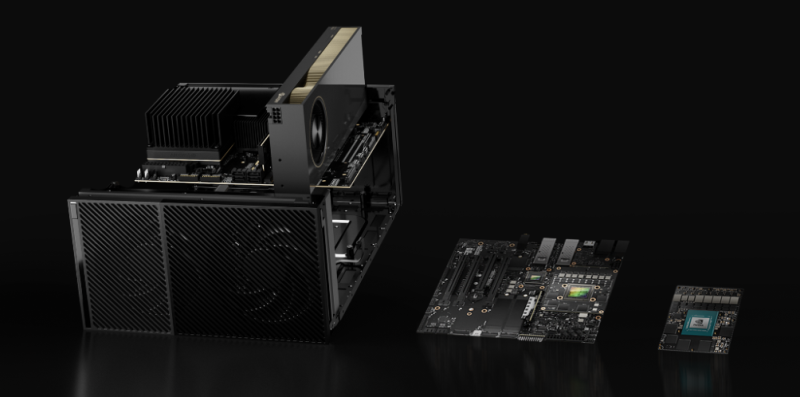

NVIDIA представила платформу AI Enterprise-IGX для индустриальных ИИ-приложенийКомпания NVIDIA сообщила о доступности комплексного решения AI Enterprise-IGX, которое, как утверждается, призвано удовлетворить растущую потребность в ИИ-вычислениях в реальном времени на периферии в таких областях, как медицина, промышленность и пр. Продукт объединяет NVIDIA IGX и систему Holoscan, а также Isaac и Metropolis. Напомним, IGX — это платформа индустриального уровня для ИИ-вычислений на периферии, специально разработанная для промышленных и медицинских сред. Holoscan предоставляет собой полнофункциональную инфраструктуру, необходимую для масштабируемой программно-определяемой обработки потоковых данных в режиме реального времени на периферии. Отмечается, что AI Enterprise-IGX предоставляет предприятиям новый уровень производительности, безопасности и поддержки для всего стека ПО для периферийных вычислений. В результате, упрощается и ускоряется развёртывание ИИ-приложений на периферии. Благодаря сочетанию NVIDIA AI Enterprise-IGX и Holoscan на базе IGX-платформ клиенты получают решение с гибкими возможностями интеграции сенсоров, высокой ИИ-производительностью и безопасностью для решения задач на периферии. Вместе с тем NVIDIA объявила об обновлении самой аппаратной платформы IGX. В частности, для IGX Orin 700 (кодовое имя IGX Boardkit) реализована поддержка ускорителей NVIDIA RTX 6000 Ada, что обеспечивает ИИ-производительность до 1,705 TOPS — это в семь раз больше по сравнению с показателем, который достигается при использовании интегрированного GPU. Кроме того, появилась поддержка «системы на модуле» IGX Orin 500. Говорится также, что программа сертификации NVIDIA-Certified Systems теперь распространяется на платформу IGX. Такие продукты готовят Advantech, Adlink, Aetina, Ahead, Cosmo Intelligent Medical Devices (подразделение Cosmo Pharmaceuticals), Dedicated Computing, Leadtek, Onyx, YUAN и др. Вместе с тем многие компании, работающие в области медицинских технологий, включая Barco, Karl Storz, Medtronic и Moon Surgical, внедряют NVIDIA IGX с системой Holoscan для ускорения разработки ИИ-решений для медицинской диагностики, хирургических роботов, средств по уходу за пациентами и пр.

02.06.2024 [15:30], Владимир Мироненко

NVIDIA объявила о доступности NIM для разработчиков ИИNVIDIA объявила о доступности NVIDIA NIM, микросервисов инференса, которые предоставляют готовые модели в виде заранее оптимизированных контейнеров, доступных для развёртывания в облаках, ЦОД или на рабочих станциях. Это, по словам компании, позволяет разработчикам возможность без труда создавать приложения генеративного ИИ за считанные минуты, хотя ранее на это уходили недели. Сложность приложений генеративного ИИ растёт и часто в них используется несколько моделей с различными возможностями для генерации текста, изображений, видео, речи и т.д. NVIDIA NIM позволяет значительно повысить производительность разработчиков, предоставляя простой стандартизированный способ добавления генеративного ИИ в их приложения. NIM также позволяет компаниям максимизировать свои инвестиции в инфраструктуру. Например, NIM-контейнер с оптимизированным вариантом Meta✴ Llama 3-8B выдаёт втрое больше токенов за единицу времени, чем LLM без оптимизаций. Более 200 технологических партнёров NVIDIA, включая Cadence, Cloudera, Cohesity, DataStax, NetApp, Scale AI и Synopsys, уже используют NIM, чтобы ускорить развёртывание генеративного ИИ для приложений, специфичных для их индустрии, таких как ИИ-помощники, помощники по созданию кода, цифровые человеческие аватары и многое другое. Кроме того, экосистему NIM поддерживают Canonical, Red Hat, Nutanix, VMware, Kinetica и Redis. Доступна и интеграция с KServe. NIM интегрирован в платформу NVIDIA AI Enterprise. Начиная со следующего месяца участники программы NVIDIA Developer Program получат бесплатный доступ к NIM для исследований, разработки и тестирования. Контейнеры NIM могут включать ПО NVIDIA CUDA, NVIDIA Triton Inference Server и NVIDIA TensorRT-LLM. А на ai.nvidia.com уже доступно более 40 готовых моделей, включая Databricks DBRX, Google Gemma, Meta✴ Llama 3, Microsoft Phi-3, Mistral Large, Mixtral 8x22B и Snowflake Arctic. Компания также представила и NVIDIA BioNeMo NIM для биомедицинской сферы. Ведущие провайдеры ИИ-решений и MLOps-платформ, включая Amazon SageMaker, Microsoft Azure AI, Dataiku, DataRobot, deepset, Domino Data Lab, LangChain, Llama Index, Replicate, Run.ai, ServiceNow, Securiti AI и Weights & Biases также внедрили NIM. Hugging Face теперь тоже предлагает NIM-контейнейры и позволяет развернуть модели в различных облаках всего за несколько кликов. Микросервисы NIM также интегрированы в AWS, Google Cloud, Microsoft Azure и Oracle Cloud. Наконец, компетенциями в области NIM обзавелись Accenture, Deloitte, Infosys, Latentview, Quantiphi, SoftServe, TCS и Wipro. Предприятия могут запускать приложения с поддержкой NIM практически в любом месте, в том числе на сертифицированных NVIDIA системах Cisco, Dell, HPE, Lenovo и Supermicro, а также ASRock Rack, ASUS, GIGABYTE, Ingrasys, Inventec, Pegatron, QCT, Wistron и Wiwynn. Более того, например, Foxconn и Pegatron уже используют NIM для разработки предметно-ориентированных LLM для собственных производственных нужд.

27.05.2024 [22:20], Алексей Степин

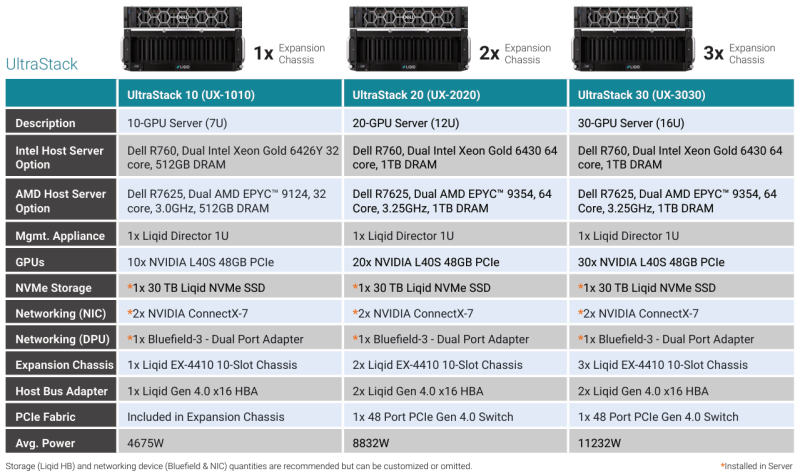

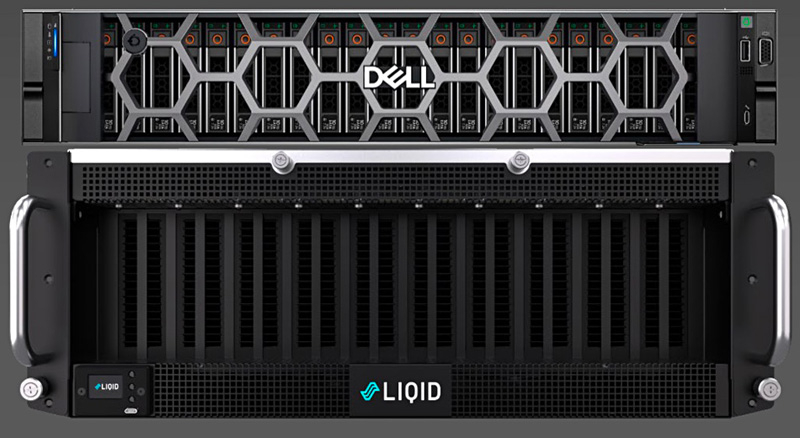

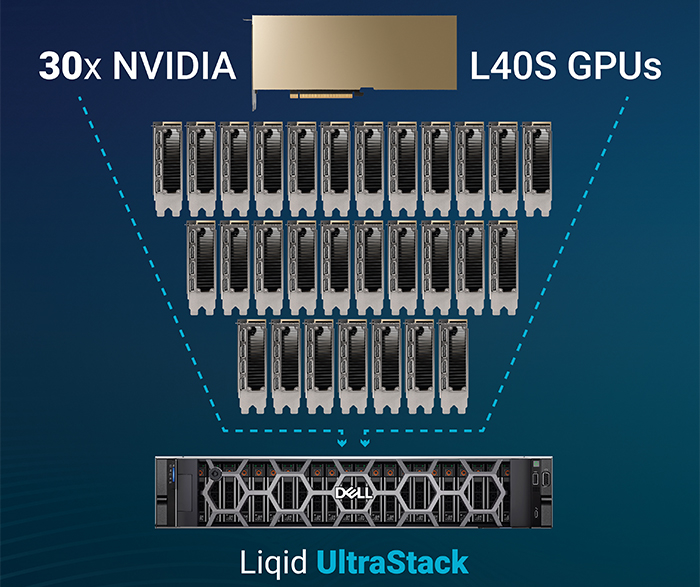

Тридцать на одного: Liqid UltraStack 30 позволяет подключить десятки GPU к одному серверуКомпания Liqid сотрудничает с Dell довольно давно — ещё в прошлом году она смогла добиться размещения 16 ускорителей в своей платформе UltraStack L40S. Но на этом компания не остановилась и представила новую композитную платформу UltraStack 30, в которой смогла довести число одновременно доступных хост-системе ускорителей до 30. Для подключения, конфигурации и управления ресурсами ускорителей Liqid использует комбинацию фирменного программного обеспечения Matrix CDI и интерконнекта Liqid Fabric. В основе последнего лежит PCI Express. Это позволяет динамически конфигурировать аппаратную инфраструктуру с учётом конкретных задач с её возвратом в общий пул ресурсов по завершению работы. Сами «капсулы» с ресурсами подключены к единственному хост-серверу, что упрощает задачу масштабирования, минимизирует потери производительности, повышает энергоэффективность и позволяет добиться наиболее плотной упаковки вычислительных ресурсов, нежели это возможно в классическом варианте с раздельными серверами. А благодаря гибкости конфигурирования буквально «на лету» исключается простой весьма дорогостоящих аппаратных ресурсов.

Источник здесь и далее: Liqid В случае UltraStack 30 основой по умолчанию является сервер серии Dell PowerEdge R760 с двумя Xeon Gold 6430 и 1 Тбайт оперативной памяти, однако доступен также вариант на базе Dell R7625, оснащённый процессорами AMD EPYC 9354. Опционально можно укомплектовать систему NVMe-хранилищем объёмом 30 Тбайт, в качестве сетевых опций доступны либо пара адаптеров NVIDIA ConnectX-7, либо один DPU NVIDIA Bluefield-3.  За общение с ускорительными модулями отвечает 48-портовой коммутатор PCI Express 4.0 вкупе с фирменными хост-адаптерами Liqid. Технология ioDirect позволяет ускорителям общаться друг с другом и хранилищем данных напрямую, без посредничества CPU. В трёх модулях расширения установлено по 10 ускорителей NVIDIA L40S, каждый несет на борту 48 Гбайт памяти GDDR6. Такая конфигурация теоретически способна развить 7,3 Пфлопс на вычислениях FP16, вдвое больше на FP8, и почти 1,1 Пфлопс на тензорных ядрах в формате TF32. Платформа UltraStack 30 предназначена в первую очередь для быстрого развёртывания достаточно мощной ИИ-инфраструктуры там, где требуется тонкая подстройка и дообучение уже «натасканных» больших моделей. При этом стоит учитывать довольно солидное энергопотребление, составляющее более 11 кВт. Также в арсенале компании есть решения SmartStack на базе модульных систем Dell PowerEdge C-Series, позволяющие подключать к каждому из лезвийных модулей MX760c, MX750с и MX740c до 20 ускорителей. Модульные решения Liqid поддерживают также ускорители других производителей, включая достаточно экзотические, такие как Groq. |

|