Материалы по тегу: hardware

|

11.02.2026 [08:42], Руслан Авдеев

Австралийское неооблако Firmus привлекло $10 млрд в кредит для строительства ИИ-фабрик Project SouthgateАвстралийский неооблачный провайдер Firmus привлёк в кредит $10 млрд. Главными участниками кредитного соглашения стали инвестиционные компании Blackstone и Coatue, сообщает Datacenter Dynamics. По словам Firmus, финансирование позволит развернуть ИИ-фабрики на основе эталонной архитектуры NVIDIA по всей Австралии. Новый план — часть проекта Southgate, реализуемого Firmus в рамках стратегического партнёрства с CDC Data Centres и NVIDIA. Firmus была основана в 2019 году и поначалу специализировалась на криптовалютах и HPC, а также системах иммерсионного охлаждения. Неооблачная компания заявила, что речь идёт об одной из «крупнейших частных сделок по привлечению заёмных средств» за всю историю Австралии. Представитель Blackstone сообщил, что инструменты, стоящие за революцией в сфере ИИ — одно из наиболее перспективных инвестиционных направлений, и Австралия сможет сыграть центральную роль в развитии ИИ-инфраструктуры. Firmus подчеркнула, что благодаря Blackstone и Coatue она поможет удовлетворить растущий спрос на вычислительные мощности для ИИ в мире и создать долгосрочные выгоды как для клиентов, так и для местной экономики в целом. Стоит отметить, что Blackstone владеет крупным региональным оператором ЦОД AirTrunk.

Источник изображения: Firmus Firmus впервые упомянула Project Southgate в сентябре 2025 года в описании ИИ-кампуса в городе Лонсестон (Launceston, Тасмания). На тот момент компания заявляла, что совместный с правительством Тасмании проект к 2026 году обеспечит создание ИИ-инфраструктуры мощностью 90 МВт. Месяцем позже Firmus сообщила, что проекта расширят и на материковую Австралию при содействии CDC Data Centres. Предполагается развёртывание дополнительных объектов в Сиднее, Канберре, Мельбурне и Перте. В ноябре 2025 года сообщалось о привлечении для Project Southgate AU$500 млн ($351 млн). В последнем заявлении Firmus объявила о строительстве нескольких ИИ-фабрик в Австралии, где планируется развернуть тысячи ИИ-ускорителей — общая мощность к 2028 году должна достигнуть 1,6 ГВт. Каждая ИИ-фабрика будет учитывать современные требования к энергоэффективности и параметрам генерации токенов, чтобы удовлетворять потребности самых требовательных клиентов со всего мира. Подчёркивается, что Австралия имеет конкурентоспособный «энергетический профиль» и квалифицированные кадры.

10.02.2026 [15:33], Владимир Мироненко

IBM сворачивает продажи серверов POWER10Спустя несколько месяцев после презентации серверов POWER11 компания IBM уведомила клиентов о предстоящем прекращении продаж систем на базе процессоров POWER10. Как отметил ресурс ITJungle, обычно IBM делает такие объявления заблаговременно, как правило, за полгода или более. В информационном письме AD26-0012 IBM сообщила, что следующие модели не будут продаваться после 31 июля 2026 года, за исключением Китая и Южной Кореи, где их можно будет приобрести до 30 июля 2027 года и где платформы POWER9 и POWER10 оказались чрезвычайно популярны в банковской и финансовых сферах, а также в индустрии страхования:

В перечень снятых с производства серверов не вошёл POWER S1012 Mini, анонсированный в мае 2024 года, поскольку его преемник POWER S1112 Mini всё ещё не анонсирован. Снятие с производства не распространяется на модернизацию POWER E1080 — то, что IBM называет спецификацией дополнительного оборудования (Miscellaneous Equipment Specification, MES). Модернизация на POWER E1080 с предыдущих систем по-прежнему будет доступна, что помогает продлить амортизацию. Это важно для балансов компаний, использующих крупногабаритное оборудование POWER. По данным ITJungle, для других устройств линейки POWER10 модернизация с использованием MES с предыдущих моделей недоступна, а для машин начального и среднего уровня в линейке POWER Systems её давно нет. После июльских дат 2026 и 2027 годов также будет отключена возможность активации процессоров на этих устройствах в процессе перехода с одной модели на другую (что не то же самое, что обновление в понимании IBM). Однако по традиции это не касается оставшихся, но ещё не активированных в рамках одной машины процессоров и памяти. Также после указанных дат для снятых с производства серверов POWER10 не будут предлагаться различные уровни услуг Advanced Expert Care и POWER Expert Care от IBM. Некоторые кабели также будут исключены из каталога, а для более компактных моделей будет снят с продажи ряд плат расширения, адаптеров, памяти DDR5, флеш-накопителей и других периферийных устройств. Это касается только заказов на новые системы. Как полагает ITJungle, немногие клиенты перейдут с POWER10 на POWER11, если только они не приобрели POWER10 на очень раннем этапе цикла. Безусловно, между POWER10 и POWER11 есть важные различия, но их недостаточно, чтобы оправдать масштабное и сложное обновление или переход на новую систему. Согласно прогнозу ITJungle, клиенты POWER10 будут мигрировать уже на POWER12 — возможно, года через три.

10.02.2026 [13:16], Руслан Авдеев

Hitachi рассматривает продажу поставщика СХД Hitachi Vantara за $1,3 млрдЯпонский транснациональный конгломерат Hitachi намерен продать своё подразделение, предлагающее решения для хранения и анализа данных. Для Hitachi Vantara рассчитывают найти покупателя, готового выложить до ¥200 млрд ($1,3 млрд), сообщает Bloomberg. Компания уже наняла консультанта по продажам и передала материалы о бизнесе Hitachi Vantara заинтересованным сторонам, вероятным потенциальным покупателем называется какая-либо частная акционерная компания. По имеющимся данным, сама Hitachi намерена сосредоточиться на более маржинальном бизнесе, чем Hitachi Vantara, вроде инициатив, связанных с передачей энергии и цифровой трансформацией. Сегодня в сферу интересов Hitachi входит энергетика (атомные и иные системы генерации, а также системы передачи), транспорт (поезда и автомобильные платформы), промышленность (индустриальное оборудование), измерительные и аналитические системы, здравоохранение, системы для зданий — лифты и эскалаторы, а также многие бизнесы, связанные с цифровыми решениями. Конечно, попадает туда и бизнес, связанный с хранением и управлением данных, включая Hitachi Vantara.

Источник изображения: Hitachi Vantara Имеется два номинально независимых подразделения Hitachi Vantara — Hitachi Vantara Ltd. в Японии и Hitachi Vantara LLC в США. Выручка Hitachi в 2025 финансовом году включала ¥475 млрд от подразделения IT Products, рост составил 7 % год к году, к этим средствам относится и выручка, связанная с СХД. Показатель EBITDA подразделения IT Products составлял 4,4 %, против 14,8 % для «материнского» бизнеса Digital Systems and Services. По данным Westgrove Research, совокупная годовая выручка бизнеса Hitachi Vantara составила ¥300 млрд ($1,95 млрд). Корнями бизнес Hitachi Vantara уходит в 1989 год, когда Hitachi и EDS приобрели National Advanced Systems у National Semiconductor и назвали новый бизнес, связанный с хранением данных, Hitachi Data Systems (HDS). Hitachi выкупила EDS в 1999 году. В результате череды дальнейших изменений в 2017 году Hitachi организовала слияние HDS с купленной компанией Pentaho, занимавшейся бизнес-аналитикой и подразделением Hitachi Insight Group, занимавшимся преимущественно Интернетом вещей. В результате и появилась Hitachi Vantara. Её массивы хранения данных корпоративного уровня Virtual Storage Platform One (VSP One) имеют хорошую репутацию и ценятся за надёжность. Тем не менее, попытки закрепиться на рынках файловых NAS и объектных хранилищ особенным успехом не увенчались, так что компании не удалось пробиться дальше «второго эшелона». Кроме того, в значительной степени компания упустила возможность массовых поставок систем для ИИ, не сумев вовремя войти в число ключевых партнёров NVIDIA в нише систем хранения данных. Компании не удалось конвертировать свой опыт в сфере монолитных высокопроизводительных корпоративных хранилищ в успешные решения среднего уровня. Предпринимались попытки освоить рынок All-Flash хранилищ, компания даже разрабатывала собственное аппаратное обеспечение для него, но по мере развития массового производства SSD и ужесточения конкуренции, отстала от компаний уровня Dell EMC. Hitachi Consulting присоединилась к Hitachi Vantara в 2020 году. Результат оказался неудовлетворительным, и в 2023 году началась реорганизация в попытках оживить бизнес, в том числе путём найма новых топ-менеджеров. Для бренда VSP One были анонсированы новые продукты, связанные с хранением данных, анонсирована поддержка публичных облачных хранилищ. Как сообщает Blocks & Files, похоже, Hitachi Vantara продолжит обычные бизнес-операции. Слабость позиций компании некоторые эксперты оценивают как результат её подчинения японской Hitachi Ltd. — в результате старшие руководители «размыли» влияние потенциально более предприимчивых лидеров из Кремниевой долины в США. Такое отсутствие успехов в сфере хранения данных преследовало и другие японские конгломераты, включая коллег из Fujitsu и NEC.

09.02.2026 [23:25], Владимир Мироненко

Alphabet возьмёт в долг $20 млрд на 100 лет, чтобы вложиться в ИИХолдинг Alphabet (включает Google), объявивший на прошлой неделе о планах удвоить капзатраты в 2026 году до ≈$180 млрд, планирует привлечь $20 млрд за счёт выпуска долларовых облигаций, сообщил Bloomberg со ссылкой на информированные источники. Поначалу источники сообщали о планах Alphabet привлечь таким образом $15 млрд. По словам источников, помимо США холдинг предлагает инвесторам свои первые в истории размещения облигации в Швейцарии и Великобритании. Последнее будет включать редкую продажу 100-летних облигаций — первый случай, когда технологическая компания пытается осуществить подобное размещение со времён бума доткомов в конце 1990-х годов, отметил Bloomberg. В последний раз такой возможностью воспользовалась Motorola в 1997 году. Источники утверждают, что объявление Alphabet о выпуске долларовых облигаций в понедельник привлекло заявки на более чем $100 млрд. Собеседники Bloomberg сообщили, что холдинг разместит семь выпусков, самый «длинный» из которых со сроком погашения в 2066 году и доходностью на 0,95 п.п. выше, чем у казначейских облигаций США (ранее сообщалось о 1,2 п.п.). Согласно прогнозу Morgan Stanley, в 2026 году крупные инвестиционные компании займут $400 млрд, что намного больше $165 млрд в 2025 году. Массовое размещение облигаций, вероятно, приведёт к рекордному объему выпуска высококачественных долговых обязательств в этом году в размере $2,25 трлн, указал в своей аналитической записке Вишвас Паткар (Vishwas Patkar), глава отдела кредитной стратегии в США Morgan Stanley. Некоторые кредитные стратеги ожидают, что масштабный выпуск облигаций приведёт к расширению спредов (увеличению разницы между ценами покупки и продажи) по корпоративным облигациям, что означает увеличение рисков при операциях с такими активами. «Мы считаем, что сценарий похож на 1997/98 или 2005 год: кредиты показывают худшие результаты, но не “конец цикла”», — написал Паткар, имея в виду период, когда растёт число дефолтов и сокращается доступность кредитов. Последний раз Alphabet выходил на американский рынок облигаций в ноябре 2025 года, когда привлёк $17,5 млрд в рамках сделки с продажей 50-летних облигаций. Это было самое долгосрочное предложение корпоративных технологических облигаций в долларах США в прошлом году, согласно данным Bloomberg. Alphabet также продал в то время облигации на €6,5 млрд в Европе. Другие технологические компании тоже наращивают капзатраты в борьбе за доминирование на ИИ-рынке. Amazon объявила о планах направить на капзатраты в 2026 году $200 млрд, а Meta✴ Platforms планирует потратить от $115 до $135 млрд. Ожидаемые затраты Microsoft составят $145 млрд, а Oracle — $55 млрд.

09.02.2026 [14:20], Сергей Карасёв

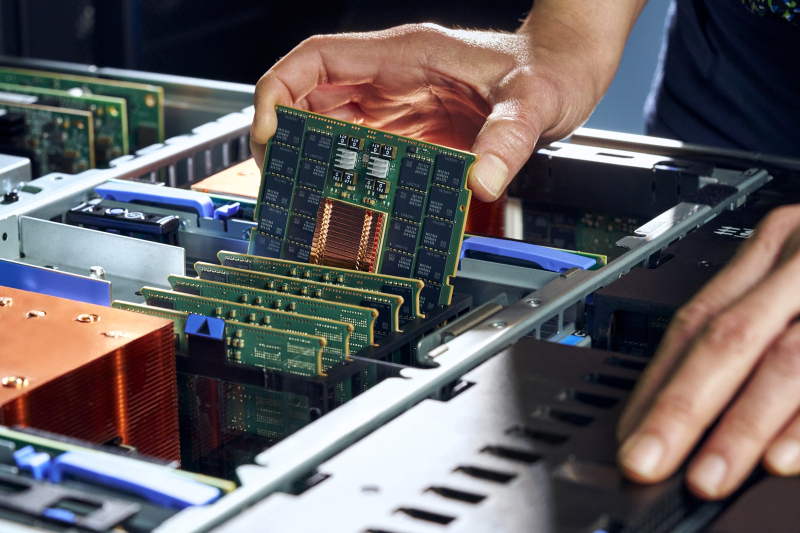

OpenYard выпустила российский двухсокетный сервер RS202A на базе AMD EPYC TurinРоссийский разработчик и производитель корпоративного оборудования OpenYard объявил о начале серийного выпуска серверов RS202A на аппаратной платформе AMD. Устройства предназначены для построения масштабируемых и отказоустойчивых IT-инфраструктур, включая виртуальные среды, аналитические системы и хранилища данных. Серверы выполнены в форм-факторе 2U. Допускается установка двух процессоров AMD EPYC 9005 поколения Turin в исполнении LGA 6096 (SP5) с показателем TDP до 500 Вт. Предусмотрены 24 слота для модулей оперативной памяти DDR5-6400 суммарным объёмом до 6 Тбайт. В оснащение входят контроллер ASPEED AST2600, двухпортовый сетевой адаптер 1GbE (Intel I350-AM2) и выделенный сетевой порт управления 1GbE. Во фронтальной части корпуса в зависимости от модификации располагаются 24 отсека для SFF-накопителей (SATA/SAS-4/NVMe PCIe 5.0) или 12 отсеков для LFF-изделий. В тыльной секции находятся четыре посадочных места для SFF-изделий с интерфейсом SATA/SAS-4. Во всех случаях допускается горячая замена. Кроме того, сеть два внутренних слота для SSD типоразмера M.2 2280/22110 с интерфейсом PCIe 3.0 x4 и один слот M.2 2280/22110 PCIe 3.0 x2. Доступны до пяти разъёмов PCIe 5.0 x16 для карт расширения FHHL и до двух разъёмов OCP 3.0 PCIe 5.0 x16 с поддержкой NCSI. Габариты составляют 438 × 87,5 × 815 мм. Установлены два блока питания мощностью 2000 Вт с сертификатом 80 PLUS Platinum. Упомянуты два порта USB 3.2, коннектор Mini-DP и три гнезда RJ45 для сетевых кабелей. Диапазон рабочих температур — от +10 до +35 °C. Производство серверов RS202A осуществляется на собственной площадке OpenYard в Рязани. В настоящее время системы проходят пилотные внедрения в корпоративных IT-средах, а объёмы выпуска планируется масштабировать в зависимости от рыночного спроса, говорит компания.

09.02.2026 [14:08], Сергей Карасёв

Геопатриация для изоляции: расходы на суверенные IaaS-сервисы в 2026 году превысят $80 млрд

gartner

hardware

iaas

анализ рынка

импортозамещение

конфиденциальность

миграция

облако

прогноз

финансы

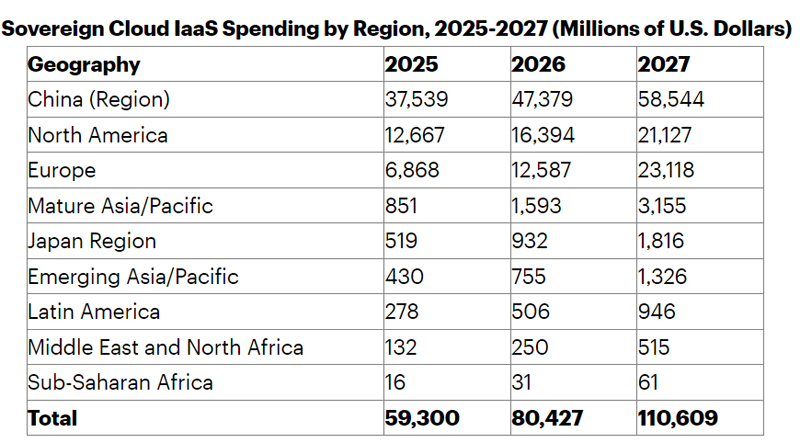

По оценкам Gartner, в 2025 году объём глобального рынка суверенных облачных сервисов IaaS (инфраструктура как услуга) достиг $59,3 млрд. Данный сектор стремительно расширяется, что связано с геополитической напряжённостью: компании и государственные организации по всему миру стремятся к достижению технологической независимости, в связи с чем активно развивают локальные облачные платформы. В целом, по данным Gartner, из-за растущего спроса на проекты по геопатриации около 20 % текущих рабочих нагрузок будут перенесены с глобальных облачных площадок на суверенные платформы. В географическом разрезе наибольшую выручку на рынке суверенных IaaS-сервисов в 2025 году обеспечил Китай — $37,5 млрд. На втором месте находится Северная Америка с $12,7 млрд, а замыкает тройку Европа с $6,9 млрд. Ещё около $851 млн пришлось на развитые страны Азиатско-Тихоокеанского региона, $519 млн — на Японию. В 2026 году, согласно оценкам аналитиков Gartner, объём рынка увеличится на 35,6 %, составив $80,4 млрд. Вклад Китая ожидается в размере $47,4 млрд, Северной Америки — $16,4 млрд, Европы — $12,6 млрд. Самые высокие темпы роста в годовом исчислении прогнозируются на Ближнем Востоке и в Африке (89 %), в развитых государствах Азиатско-Тихоокеанского региона (87 %) и в Европе (83 %).

Источник изображения: Gartner В 2027-м, полагают специалисты Gartner, глобальные расходы на суверенные IaaS-сервисы достигнут $110,6 млрд, что будет соответствовать росту на 37,6 % по отношению к 2026-му. Китай останется лидером с $58,5 млрд, тогда как на второе место выйдет Европа с результатом в $23,1 млрд. В Северной Америке затраты, согласно прогнозам, поднимутся до $21,1 млрд.

09.02.2026 [13:17], Сергей Карасёв

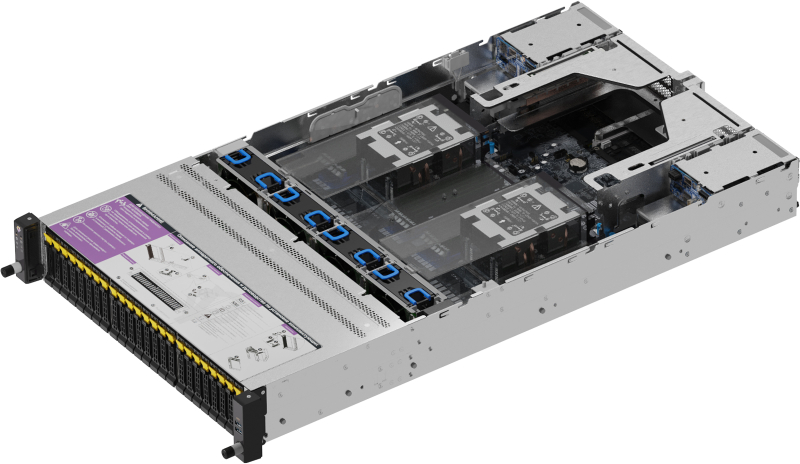

«Ядерный» суперкомпьютер Teton производительностью 20,8 Пфлопс полагается только на AMD EPYC TurinНациональная лаборатория Айдахо (INL) в составе Министерства энергетики США (DOE) сообщила о запуске суперкомпьютера Teton. Система присоединилась к четырём другим НРС-комплексам лаборатории — Bitterroot, Hoodoo, Wind River и Sawtooth, увеличив доступные вычислительные ресурсы вчетверо. В основу Teton положена платформа HPE Cray EX 4000. Объединены 1024 вычислительных узла, каждый из которых содержит 384 ядра CPU и 768 Гбайт памяти. Задействованы процессоры AMD EPYC 9005 поколения Turin. Таким образом, в общей сложности используются около 393 тыс. CPU-ядер и 768 Тбайт памяти. Как отмечает INL, на сегодняшний день Teton — это один из самых мощных суперкомпьютеров в мире, архитектура которого базируется исключительно на CPU (без применения GPU и других специализированных компонентов). Такая конфигурация обусловлена спецификой использования системы: комплекс предназначен для сложных физических моделирований в рамках проектов по разработке передовых реакторов на быстрых нейтронах, малых модульных реакторов и микрореакторов. Утверждается, что традиционные CPU лучше подходят для подобных расчётов, нежели GPU.

Источник изображений: INL «Teton позволит исследователям моделировать ядерные технологии следующего поколения с беспрецедентной точностью, что значительно сократит время работ от создания концепции до внедрения критически важных проектов в области ядерной энергетики», — отмечает Бренден Хайдрих (Brenden Heidrich), руководитель научной программы Nuclear Science User Facilities (NSUF), реализуемой DOE.  В рамках NSUF исследователям в области ядерной энергетики предоставляется доступ к широкому спектру ресурсов INL и других учреждений. Новый суперкомпьютер поможет учёным моделировать сложную физику реакторов, поведение перспективных материалов и процессы топливного цикла.

09.02.2026 [12:22], Сергей Карасёв

ASUS IoT представила защищённый индустриальный компьютер PE1000U на базе Intel Arrow LakeКомпания ASUS IoT, подразделение ASUS по выпуску умных устройств для интернета вещей, анонсировала индустриальный компьютер PE1000U в защищённом исполнении, предназначенный для систем машинного зрения, роботизированных платформ и пр. Устройство выполнено в корпусе повышенной прочности в соответствии со стандартами IP40 и MIL-STD-810H. Диапазон рабочих температур простирается от -25 до +70 °C. Ребристая верхняя поверхность улучшает рассеяние тепла. Габариты составляют 63 × 110 × 160 мм, масса — около 1 кг. Допускается монтаж на DIN-рейку. Применена аппаратная платформа Intel Arrow Lake. Максимальная конфигурация включает процессор Core Ultra 7 265U с 12 ядрами (2P+8E+2LPE; 14 потоков), работающими на частоте 1,7–5,3 ГГц. В состав чипа входят графический ускоритель Intel Xe и нейропроцессорный блок Intel AI Boost с производительностью 12 TOPS (INT8). Суммарное ИИ-быстродействие (CPU + GPU + NPU) достигает 24 TOPS. Доступны два слота SO-DIMM для модулей оперативной памяти DDR5 общим объёмом до 64 Гбайт. Компьютер может быть оборудован SFF-накопителем с интерфейсом SATA и SSD формата M.2 2280 с интерфейсом PCIe x4 (NVMe). Есть два сетевых порта 2.5GbE на основе Intel i226-IT, коннектор M.2 2230 E-key (CNVi, PCIe x1, USB 2.0) для комбинированного адаптера Wi-Fi 6 / Bluetooth 5.2 и слот M.2 3042/3052 B-key (PCIe x1, USB 3.0, USB 2.0 плюс Nano SIM) для сотового модема 4G/5G. Предусмотрены интерфейсы DisplayPort (до 5120 × 3200 точек; 60 Гц) и HDMI 2.0 (до 4096 × 2160 пикселей; 60 Гц), четыре порта USB 3.1 Type-A (10 Гбит/с), аудиогнёзда на 3,5 мм, два гнезда RJ45 для сетевых кабелей. Поддерживаются до четырёх последовательных портов RS-232/422/485. Питание (9–36 В) подаётся через 3-контактный DC-коннектор. Заявлена совместимость с Windows 11 IoT Enterprise.

09.02.2026 [12:16], Сергей Карасёв

Крошечный одноплатный компьютер Radxa Cubie A7S поддерживает Wi-Fi 6, Bluetooth 5.4 и 1GbEКомпания Radxa пополнила семейство одноплатных компьютеров моделью Cubie A7S, построенной на аппаратной платформе Allwinner. В качестве ОС может применяться Android 13 или Debian Linux (Radxa OS). Устройство уже доступно для заказа по ориентировочной цене от $25. Задействован процессор Allwinner A733, который содержит два ядра Arm Cortex-A76 с частотой 2,0 ГГц, шесть ядер Arm Cortex-A55 с частотой 1,8 ГГц, а также ядро реального времени RISC-V E902 с частотой 200 МГц. В состав чипа входят графический ускоритель Imagination Technologies BXM-4-64 MC1 GPU с поддержкой OpenGL ES 3.2, OpenCL 3.0 и Vulkan 1.3. Интегрированный VPU-модуль обеспечивает возможность декодирования материалов 8Kp24 H.265/VP9/AVS2 и кодирования 4Kp30 H.265/H.264. Опционально доступен NPU-движок с ИИ-быстродействием до 3 TOPS.

Источник изображения: Radxa Одноплатный компьютер может нести на борту до 16 Гбайт оперативной памяти LPDDR5-4800 и флеш-модуль eMMC вместимостью до 256 Гбайт (плюс карта microSD). Есть сетевой контроллер 1GbE, адаптеры Wi-Fi 6 и Bluetooth 5.4 на базе чипа Quectel FCU760K. Реализованы по одному порту USB 3.1 Type-C OTG (DisplayPort Alt Mode; до 4Kp60), USB 2.0 OTG Type-C и USB 2.0 Type-A, гнездо RJ45 для сетевого кабеля, интерфейс камеры MIPI CSI (4 линии), 30- и 15-контактная колодки GPIO, а также 16-контактный FFC-коннектор (PCIe 3.0), совместимый с Raspberry Pi 5. Модель Radxa Cubie A7S имеет размеры 51 × 51 мм. Питание подаётся через порт USB Type-C (5 В / 3 A) или через GPIO-коннектор (5 В). Возможно подсоединение вентилятора охлаждения.

09.02.2026 [10:09], Сергей Карасёв

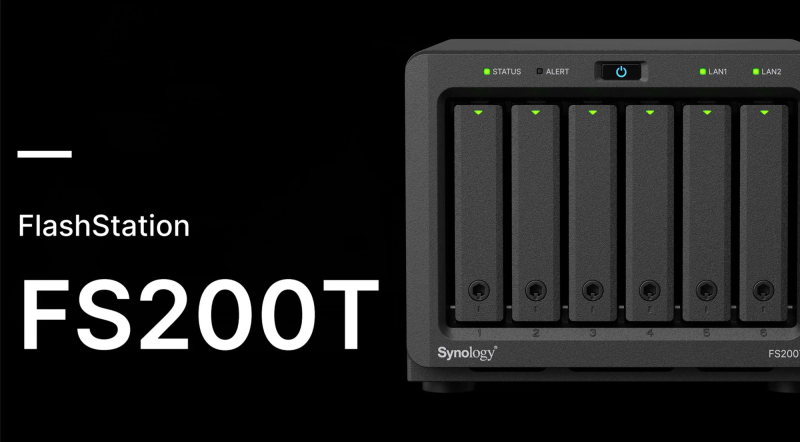

Synology готовит сетевое хранилище FS200T на шесть SATA SSDКомпания Synology, по сообщению NAS Compares, готовит к выпуску NAS в «настольном» форм-факторе FS200T на аппаратной платформе Intel. Устройство, ориентированное прежде всего на небольшие офисы, поступит в продажу во II половине текущего года. Применён процессор Celeron J4125 поколения Gemini Lake Refresh. Чип содержит четыре ядра (без многопоточности) с тактовой частотой 2,0–2,7 ГГц. Показатель TDP равен 10 Вт. Объём оперативной памяти DDR4 в базовой конфигурации составляет 4 Гбайт (без поддержки ECC), в максимальной — 8 Гбайт (два модуля SO-DIMM). Устройство располагает шестью фронтальными отсеками для SFF-накопителей с интерфейсом SATA-3 (допускается горячая замена). По имеющейся информации, могут применяться только фирменные SSD семейства Synology SAT5200 корпоративного класса: стоимость таких изделий варьируется от €160 за модель вместимостью 480 Гбайт до €1900 за вариант на 7 Тбайт. Таким образом, в максимальной конфигурации цена NAS перевалит за €11 тыс. Впрочем, как ожидается, в дальнейшем будет обеспечена поддержка накопителей сторонних производителей, что снизит общую стоимость. Хранилище оснащено одним портом 2.5GbE (RJ45) и одним портом 1GbE (RJ45), а также двумя разъёмами USB 3.2 Gen1 (5 Гбит/с). Габариты составляют 121 × 151 × 175 мм, масса — 1,4 кг. В тыльной части располагается вентилятор охлаждения диаметром 80 мм. Задействована фирменная программная платформа Synology DiskStation Manager (DSM) с набором экосистемных приложений. |

|