Материалы по тегу: сервер

|

08.06.2026 [09:41], Сергей Карасёв

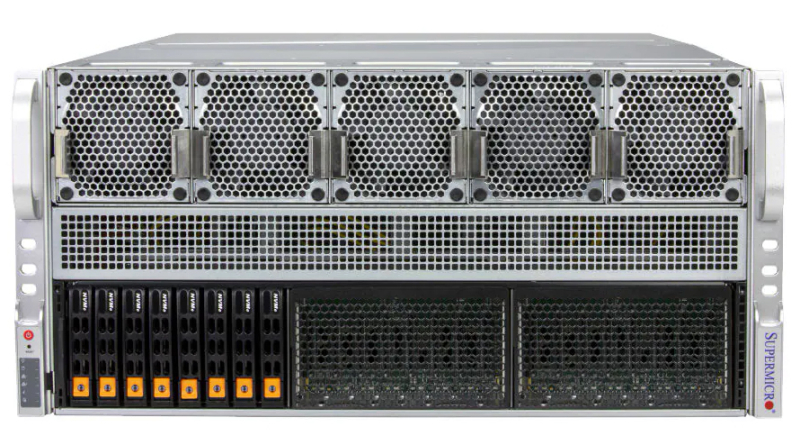

Supermicro представила Arm-серверы для агентного ИИКомпания Supermicro анонсировала серверы с Arm-процессорами, оптимизированные для агентного ИИ. Устройства обеспечивают высокую энергоэффективность и масштабируемость, позволяя формировать стойки высокой плотности. Представлены модели с воздушным и жидкостным охлаждением. В частности, дебютировал сервер ARS-222H-NR типоразмера 2U, допускающий установку двух процессоров Arm AGI с 64, 128 или 136 вычислительными ядрами. Предусмотрены 24 слота для модулей DDR5-8800 суммарным объёмом до 6 Тбайт. Во фронтальной части расположены восемь отсеков для SFF-накопителей (NVMe). Есть пять слотов PCIe 6.0 x16 для карт FHHL, по одному разъёму PCIe 6.0 x8 FHHL и PCIe 6.0 x8 AIOM (OCP 3.0), а также коннектор M.2 22110/2280 для SSD с интерфейсом PCIe 4.0 x1. Применено воздушное охлаждение. Питание обеспечивают два блока мощностью 2700 Вт с сертификатом 80 Plus Titanium. Кроме того, представлен GPU-сервер ARS-522GP-NR формата 5U с поддержкой двух чипов Arm AGI. Эта машина позволяет задействовать до восьми ИИ-ускорителей двойной ширины (восемь слотов PCIe 5.0 x16). Конфигурация включает 24 разъёма для модулей DDR5-8800 (до 6 Тбайт), четыре слота PCIe 5.0 x16 FHHL, по одному слоту PCIe 6.0 x16 FHFL и PCIe 5.0 x8 AIOM (OCP 3.0). Доступны восемь фронтальных отсеков для SFF-накопителей (NVMe) и коннектор M.2 22110/2280 (PCIe 4.0 x1). Задействованы шесть блоков питания мощностью 2700 Вт с сертификатом 80 Plus Titanium и воздушное охлаждение. В свою очередь, модель ARS-242TP-QNR-LCC стандарта 2OU использует четырёхузловую конфигурацию с прямым жидкостным охлаждением D2C (Direct to Chip). Каждый узел рассчитан на два чипа Arm AGI, 24 модуля DDR5-8800 (до 6 Тбайт) и два накопителя M.2 22110/2280 (PCIe 6.0 x4). Кроме того, имеются два слота PCIe 6.0 x16 AIOM (OCP 3.0) и два опциональных фронтальных отсека для накопителей E1.S (PCIe 5.0 x4). Питание осуществляется от централизованного шинопровода. Наконец, анонсирован сервер ARS-212HE-FNR формата 2U с поддержкой одного процессора Arm AGI (до 136 ядер) и 12 модулей DDR5-8800 (до 3 Тбайт). Возможны различные варианты исполнения подсистемы хранения данных, включая четыре или шесть фронтальных отсеков E1.S и шесть тыльных посадочных мест SFF. Стандартная конфигурация предлагает три слота PCIe 6.0 x16 FHFL, по одному слоту PCIe 6.0 x8 FHFL и PCIe 6.0 x16 AIOM (OCP 3.0). Реализован один слот M.2 22110/2280 (PCIe 4.0 x1). Применено воздушное охлаждение. Мощность двух установленных блоков питания с сертификатом 80 Plus Titanium достигает 3200 Вт. У всех новинок диапазон рабочих температур простирается от +10 до +35 °C. Помимо Arm-серверов, компания Supermicro представила 12 новых систем серии X14 на аппаратной платформе Intel Xeon 6+ Clearwater Forest, включая модели ультравысокой плотности. Устройства входят в различные семейства — Hyper, SuperBlade, FlexTwin и GrandTwin. В зависимости от варианта используется форм-фактор 1U, 2U или 6U; доступны версии с воздушным и жидкостным охлаждением.

06.06.2026 [11:24], Сергей Карасёв

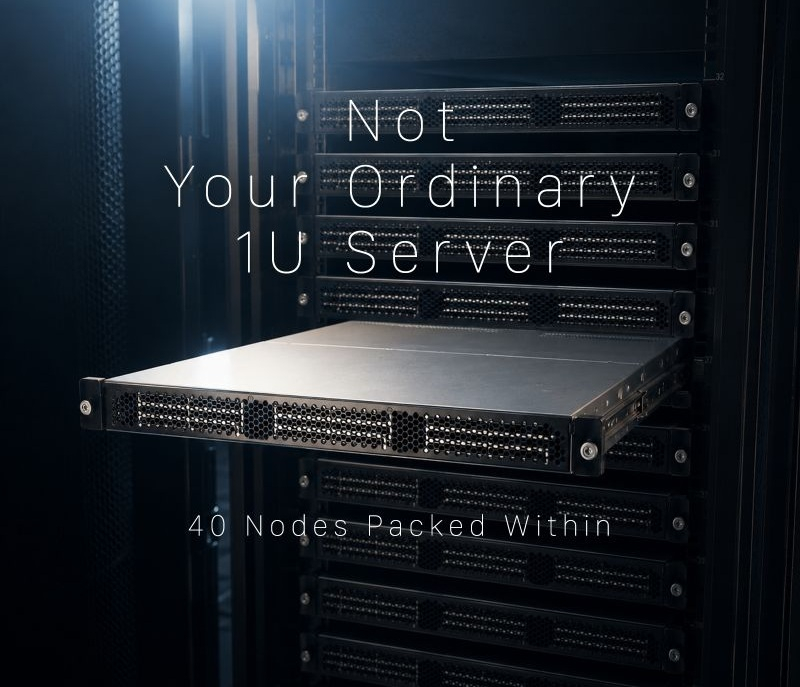

Gigabyte показала 40-узловой сервер на платформе Intel Lunar LakeКомпания Gigabyte, по сообщению The Register, продемонстрировала на выставке Computex 2026 сервер высокой плотности R1C7-K0A-AS1. Его конструкция включает 40 компактных маломощных вычислительных узлов на аппаратной платформе Intel Lunar Lake, заключённых в корпус формата 1U. Каждый узел несёт на борту процессор Intel Core Ultra 7 258V с восемью ядрами: это четыре производительных ядра Lion Cove P с максимальной тактовой частотой 4,8 ГГц и четыре энергоэффективных ядра Skymont E с частотой до 3,7 ГГц. В состав чипа входят графический ускоритель Intel Arc 140V с восемью ядрами Xe (до 1,95 ГГц) и нейропроцессорный блок Intel AI Boost с ИИ-производительностью до 47 TOPS (INT8). Каждый процессор работает в тандеме с 32 Гбайт оперативной памяти LPDDR5Х-8533. Таким образом, вся система оперирует 320 вычислительными ядрами и 1,28 Тбайт ОЗУ. Узлы наделены двумя SSD типоразмера М.2 с интерфейсом PCIe 5.0. Общее ИИ-быстродействие достигает 1880 TOPS. Шасси сервера содержит пять несущих модулей, на которые установлены по восемь вычислительных узлов. Система располагает двумя сетевыми портами QSFP28 с пропускной способностью 100 Гбит/с. Кроме того, доступен порт CMC LAN. За питание отвечают два блока мощностью 3200 Вт с сертификатом 80 Plus Titanium.

Источник изображения: Gigabyte Новинка позиционируется в качестве платформы для микросервисных рабочих нагрузок, таких как Kubernetes. Кроме того, сервер может стать основой VDI-инфраструктур. Наличие интегрированной графики в каждом CPU означает, что клиентам не придётся беспокоиться о стоимости лицензирования vGPU.

03.06.2026 [10:59], Сергей Карасёв

Dell представила серверы PowerEdge на базе NVIDIA Vera для агентного ИИКомпания Dell Technologies сообщила об обновлении семейства решений AI Factory with NVIDIA, ориентированных на внедрение ИИ. Дебютировали серверы PowerEdge R9822 и PowerEdge M9822 на аппаратной платформе NVIDIA Vera, предназначенные в том числе для развёртывания ИИ-агентов. Процессоры Vera содержат 88 ядер Olympus (176 потоков инструкций), совместимых с набором инструкций Arm v9.2. Возможно использование до 1,5 Тбайт LPDDR5X с пропускной способностью до 1,2 Тбайт/с. Сервер PowerEdge R9822 выполнен в форм-факторе 3U и оснащён воздушным охлаждением. Система подходит для различных сценариев использования — от агентных приложений и аналитики данных до задач общего назначения, обрабатываемых посредством CPU. Машина может интегрироваться в инфраструктуры существующих дата-центров. В свою очередь, модель PowerEdge M9822 наделена системой прямого жидкостного охлаждения. Этот сервер обеспечивает высокую плотность мощности в средах, оптимизированных для ИИ-агентов и НРС.

Источник изображения: Dell Прочие характеристики новинок пока не раскрываются. Но отмечается, что платформа Dell AI Factory with NVIDIA поддерживает такие сетевые технологии, как Spectrum-X Ethernet и Quantum-X800 InfiniBand. Могут использоваться программные решения NVIDIA AI Enterprise, мультимодальные языковые модели NVIDIA Nemotron, среда OpenShell и пр. В продажу по всему миру серверы PowerEdge R9822 и PowerEdge M9822 поступят в сентябре текущего года. Нужно отметить, что решения на платформе NVIDIA Vera готовят и другие ведущие поставщики серверного оборудования. В частности, такие системы недавно анонсировала компания HPE.

02.06.2026 [11:12], Сергей Карасёв

HPE представила сервер ProLiant Compute DL394 Gen12 на платформе NVIDIA VeraКомпания HPE анонсировала сервер ProLiant Compute DL394 Gen12 для ресурсоёмких нагрузок в области ИИ и обработки данных. Система выполнена на аппаратной платформе NVIDIA Vera. Изделия Vera насчитывают 88 ядер Olympus, совместимых с набором инструкций Arm v9.2. Возможна одновременная обработка до 176 потоков инструкций. Поддерживается до 1,5 Тбайт LPDDR5X с пропускной способностью до 1,2 Тбайт/с. Характеристики ProLiant Compute DL394 Gen12 пока полностью не раскрываются. Известно, что новинка выполнена в форм-факторе 2U. HPE отмечает, что изделия Vera благодаря монолитной конструкции позволяют решить проблему неоднородного доступа к памяти, которая может наблюдаться при использовании традиционных чиплетных архитектур с большим количеством ядер. Эта особенность приводит к переменным задержкам и непредсказуемой производительности. В случае Vera каждому вычислительному ядру предоставляется полоса пропускания до 14 Гбайт/с, что даёт возможность обрабатывать данные на стабильно высокой скорости. В сервере реализованы средства управления HPE Integrated Lights-Out (HPE iLO 7). Говорится о защите от будущих кибератак, основанных на квантовых вычислениях, в соответствии с требованиями Национального института стандартов и технологий США (NIST). Средства HPE Compute Ops Management (COM) обеспечивают унифицированное управление серверной инфраструктурой из единой консоли. ProLiant Compute DL394 Gen12 может применяться для агентного ИИ, обработки больших объёмов транзакций и других задач. В продажу сервер поступит осенью текущего года.

25.05.2026 [10:18], Сергей Карасёв

Представлен 48-узловой ИИ-сервер Firefly CSC2-N48SPK3 с архитектурой RISC-VКомпания Firefly анонсировала многоузловой сервер CSC2-N48SPK3, предназначенный для решения ИИ-задач. Суммарная заявленная производительность этой системы, выполненной на архитектуре RISC-V, достигает 2880 TOPS на операциях INT4. Устройство получило форм-фактор 2U с 48 вычислительными узлами. Каждый из них содержит процессор SpacemiT Key Stone K3 с восемью 64-бит ядрами RISC-V X100M с тактовой частотой до 2,4 ГГц, 8/16/32 Гбайт оперативной памяти LPDDR5 и флеш-накопитель UFS 2.2 вместимостью 128 Гбайт. Говорится о полной поддержке профиля RVA23. Кроме того, в состав сервера входит один узел управления с процессором Rockchip RK3588: он содержит по четыре ядра Cortex-A76 (2,4 ГГц) и Cortex-A55 (1,8 ГГц), а также графический блок Arm Mali-G610 и нейропроцессорный узел (NPU) с производительностью до 6 TOPS. Объём ОЗУ этого узла равен 8 Гбайт. Реализован консольный порт RJ45. Новинка располагает интерфейсом HDMI с поддержкой видео 1080p60, четырьмя сетевыми разъёмами 10GbE SFP+, двумя портами USB 3.0 и сенсорным дисплеем во фронтальной части, на котором отображаются различные параметры (температура, скорость вращения вентиляторов, сетевые данные и пр.). Опционально предлагается возможность установки до 48 накопителем формата M.2 2280 с интерфейсом PCIe (NVMe): при использовании SSD вместимостью 16 Тбайт суммарная ёмкость подсистемы хранения может достигать 768 Тбайт. Габариты составляют 724 × 430 × 88,8 мм, масса — 23,1 кг. Питание обеспечивают два блока с резервированием и возможностью горячей замены. Сервер Firefly CSC2-N48SPK3 доступен для заказа по цене $38 829 в комплектации с 48 вычислительными узлами, оборудованными 16 Гбайт оперативной памяти каждый.

24.05.2026 [07:25], Сергей Карасёв

Dell анонсировала серверы PowerEdge на платформе AMD EPYC VeniceDell анонсировала серверы PowerEdge 18-го поколения, рассчитанные на различные рабочие нагрузки, включая ресурсоёмкие задачи ИИ. Утверждается, что прирост производительности по сравнению с предшественниками достигает 70 %. В частности, дебютировала модель PowerEdge M9825 с процессорами AMD EPYC Venice. Это устройство с жидкостным охлаждением ориентировано на платформы высокой плотности. Сервер может монтироваться в 21″ ORv3-стойки серии IR7000 мощностью до 480 кВт. Система PowerEdge M9825, предназначенная для ИИ-развёртываний, появится в продаже во II половине текущего года. Кроме того, представлены ИИ-серверы PowerEdge XE5845 и PowerEdge XE7845 с возможностью установки ускорителей на базе GPU. Эти машины оснащены воздушным охлаждением. Начало продаж намечено на I квартал 2027-го. В число новинок также вошли двухсокетный сервер PowerEdge R9825 формата 3U и односокетный вариант R9815 типоразмера 2U на базе AMD EPYC Venice. Данные модели отличаются высокой плотностью ядер — до 256 на сокет, а также увеличенной пропускной способностью подсистемы ввода-вывода. Устройства могут применяться для ресурсоёмких задач без необходимости внедрения СЖО или модернизации ЦОД. На рынке системы появятся во II полугодии 2026-го.

Источник изображения: Dell Анонсированы и компактные серверы Dell PowerEdge R8815 и R6815 в форм-факторе 1U с чипами AMD EPYC Venice. На платформе AMD также построены универсальные системы Dell PowerEdge R7815 с гибкими возможностями в плане конфигурации PCIe 6.0 и подсистемы хранения данных. Будут выпущены односокетная версия PowerEdge R7815xd и двухсокетная модель R7825, подходящая для задач виртуализации и аналитики. Эти решения выйдут в следующем году. Наконец, дебютировал сервер Dell PowerEdge R9810 типоразмера 2U. Основой данной односокетной машины послужат процессоры Intel следующего поколения с кодовым именем Diamond Rapids. Старт продаж намечен на 2027 год.

22.05.2026 [12:00], Сергей Карасёв

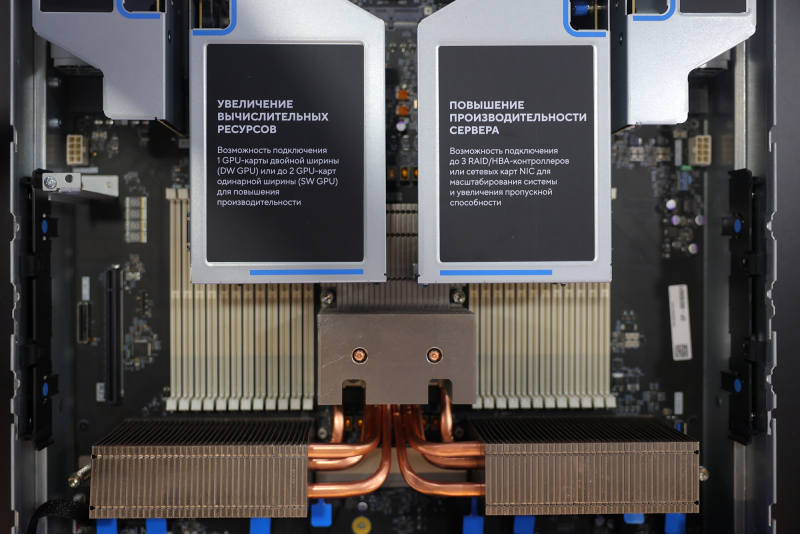

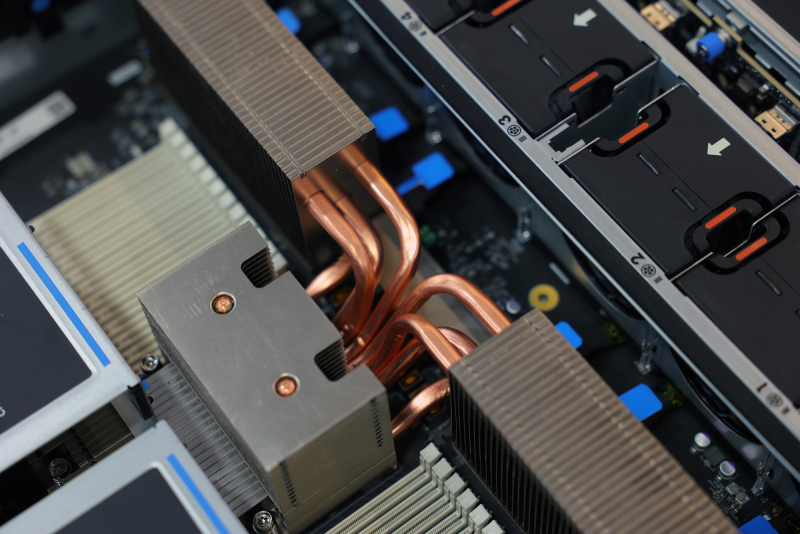

Представлен российский сервер Delta Orca на базе Intel Xeon 6 для работы с неструктурированными даннымиКомпания Delta Computers анонсировала однопроцессорный сервер Delta Orca, построенный на аппаратной платформе Intel Xeon 6. Новинка ориентирована на использование в инфраструктурах Lakehouse, объединяющих гибкость «озёр данных» (Data Lake) и надёжность централизованных хранилищ (Data Warehouse). Устройство выполнено в форм-факторе 2OU для монтажа в 21″ стойку. В зависимости от модификации задействуется процессор Granite Rapids-SP (до 80 P-ядер) или Sierra Forest-SP (до 96 E-ядер) с показателем TDP до 350 Вт. Доступны восемь слотов для модулей оперативной памяти RDIMM/LRDIMM DDR5-6400 (или MCRDIMM-8000) суммарным объёмом до 2 Тбайт. Сервер допускает установку до 20 NVM-накопителей SFF U.2 (PCIe 5.0) толщиной 7 мм или до 10 устройств такого же типа толщиной 15 мм во фронтальной части. Кроме того, есть два коннектора для NVME SSD формата M2.2280. Предусмотрены слот PCIe 5.0 x16 для карты расширения HHHL, по одному порту USB 3.0 Type-A, USB Type-C (сервисный разъем) и Mini DP, сетевой порт управления 1GbE. Говорится о поддержке сетевых адаптеров 400GbE. Питание осуществляется от централизованного шинопровода OCP. Применена система гибридного охлаждения Delta Hybrid Cooling для поддержания работы процессора в режиме Turbo Boost Max в течение продолжительного времени. Модель Delta Orca, по заявлениям производителя, оптимизирована для работы с неструктурированными данными и объектными хранилищами. Реализованы средства мониторинга и управления в собственной системе Delta BMC (внесено в реестр Минцифры и имеет сертификат ФСТЭК). Среди преимуществ новинки выделяются масштабируемость, высокая пропускная способность и надёжное хранение данных. Сервер уже доступен для предварительного заказа.

21.05.2026 [20:51], Сергей Карасёв

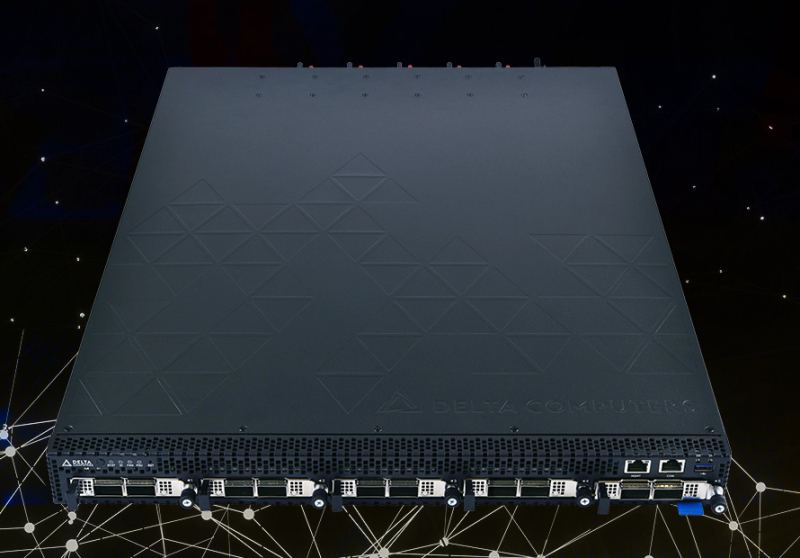

Представлен российский коммуникационный сервер Delta Octopus 6 на платформе Intel Xeon 6Delta Computers анонсировала отечественный коммуникационный сервер Delta Octopus 6, который продолжает развитие серии Octopus. В основу новинки положена аппаратная платформа Intel Xeon 6. В зависимости от модификации применяется процессор Xeon 6 Granite Rapids-SP (до 86 P-ядер) или Sierra Forest-SP (до 144 E-ядер) с показателем TDP до 350 Вт. Доступны 16 слотов для модулей оперативной памяти DDR5-6400/8000. Могут быть установлены два NVMe SSD типоразмера M2.22110. Благодаря наличию пяти слотов PCIe 5.0 x16 OCP 3.0 возможен монтаж до пяти сетевых адаптеров с пропускной способностью до 400 Гбит/с каждый. Присутствуют сетевой порт управления 1GbE (Delta BMC), разъём USB 3.0 и консольный порт RJ45. Предусмотрен датчик вскрытия корпуса. Устройство выполнено в форм-факторе 1U с габаритами 600 × 439 × 43 мм. При этом система может монтироваться как в стандартные 19″ стойки, так и в 21″ OCP-шасси. Питание может быть организовано от двух блоков мощностью 800/1300Вт, от централизованного шинопровода OCP (12 В) или от шины питания 48 В телеком-стандарта (Telco Rack). Платформа Delta Octopus 6 предназначена для использования в сценариях межсетевых экранов нового поколения (NGFW), балансировщиков сетевой нагрузки (Load Balancer), VPN-концентраторов, BRAS/BNG и различных крипто-аналитических приложений. Применяется собственное программное обеспечение Delta BMC и Delta BIOS. Сервер может использоваться на объектах КИИ.

20.05.2026 [09:09], Владимир Мироненко

От теории к практике ИИ: Dell анонсировала масштабное обновление платформы AI Factory with NVIDIA

dell

nvidia

software

ии

конфиденциальность

оркестрация

охлаждение

рабочая станция

сервер

схд

частное облако

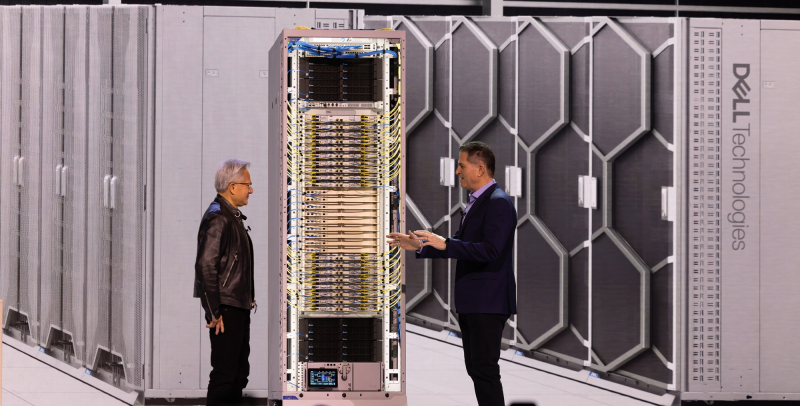

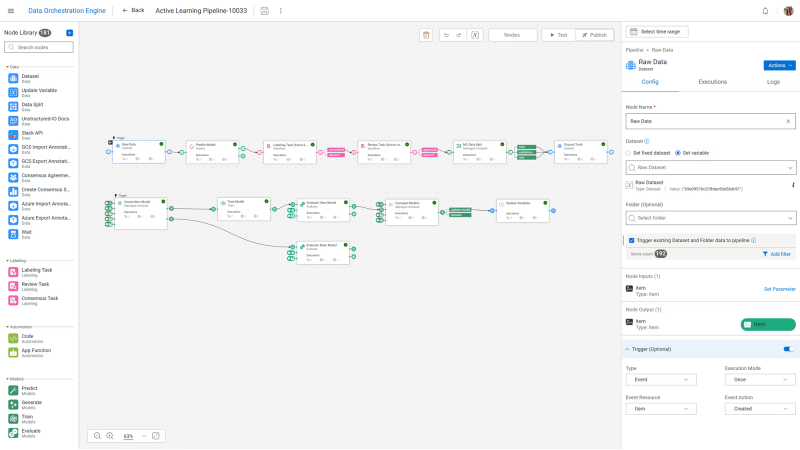

Компания Dell Technologies объявила о масштабном обновлении платформы AI Factory with NVIDIA, призванном помочь предприятиям перейти от планирования к практическому применению ИИ. Платформа отличается модульной архитектурой данных для ИИ, где их преобразование, обработка и хранение работают вместе как специально разработанный стек. Компания отметила, что AI Factory используют более 5 тыс. клиентов по всему миру, и обновлённая версия платформы обеспечит более интегрированный подход к управлению данными и инфраструктурой, что позволит сократить время, необходимое для развёртывания решений ИИ. Одним из ключевых анонсов мероприятия стала презентация Dell Deskside Agentic AI. Это новое предложение, которое объединяет рабочие станции Dell, эталонный программный стек NemoClaw от NVIDIA и среду выполнения OpenShell, позволяя предприятиям создавать, запускать и управлять автономными агентами на системах, хранящих данные локально или на периферии сети, а не полагаться исключительно на облачную инфраструктуру. Dell позиционирует это предложение как решение для контроля затрат, снижения задержки и суверенитета данных, особенно для разработки ПО, исследований и регулируемых сред. Локальный подход разработан для таких секторов, как разработка ПО, академические исследования и регулируемые отрасли, позволяя этим группам хранить данные внутри компании и преобразовывать переменные расходы на облачные сервисы в предсказуемые инвестиции в инфраструктуру. Dell заявила, что этот подход позволит достичь паритета затрат с публичными облаками в течение трёх месяцев. Dell также интегрирует NVIDIA OpenShell во все продукты портфеля Dell AI Factory, чтобы обеспечить «безопасную песочницу для запуска, создания, тестирования и тонкой настройки агентов» локально. Это обеспечивает Dell единый уровень среды выполнения и политик, охватывающий все уровни — от настольных рабочих станций до серверов Dell PowerEdge XE, с поддержкой Ubuntu и Red Hat AI. Dell также продвигает эталонную архитектуру Dell-NVIDIA AI-Q 2.0, работающую на базе Dell AI Data Platform with NVIDIA, как готовую к продуктовому развёртыванию основу для многоагентных рабочих процессов в таких секторах, как финансовые услуги, производство и госсектор, где требуется более жёсткий контроль над данными и операциями. Dell объявила о ряде улучшений платформы Dell AI Data Platform. В ней были расширены возможности механизма оркестрации данных Dell AI Data Platform путём глубокой интеграции MetadataIQ со всем портфелем хранилищ Dell, начиная с PowerScale — файлового механизма в рамках Dell AI Data Platform with NVIDIA — и расширяя его на другие платформы в будущем. Уровень оркестрации теперь поддерживает индексирование миллиардов неструктурированных файлов и их привязку к управляемым конвейерам обработки данных. Благодаря партнёрству со Starburst и NVIDIA платформа предлагает аналитику SQL с ускорением на GPU через улучшенный Dell Data Analytics Engine, до шести раз быстрее на оборудовании NVIDIA Blackwell и с будущей поддержкой NVIDIA Vera. Это позволяет ускорить получение данных как для традиционной аналитики, так и для ресурсоёмких приложений ИИ с использованием агентов. Возможности хранения данных были расширены с помощью новой системы ObjectScale X7700, которая обеспечивает на 45 % большую ёмкость, чем предыдущее поколение, с гибким масштабированием вычислительных ресурсов и хранилища. В будущем появится поддержка флеш-накопителей объёмом 245 Тбайт, что более чем втрое увеличит плотность хранения. Благодаря интеграции с NVIDIA Omniverse корпоративные хранилища данных могут быть напрямую связаны с цифровыми двойниками и физическими рабочими процессами ИИ. По мере роста объёма данных для ИИ, объектное хранилище становится логичным местом для обучающих данных, контрольных точек и долгосрочных баз знаний. Dell ObjectScale — объектный движок в рамках Dell AI Data Platform с NVIDIA — создан для выполнения этой роли, обладая высокопроизводительной архитектурой облачного масштаба и, по словам компании, лучшей в отрасли киберустойчивостью. Dell ObjectScale на серверах PowerEdge R7725xd также получил сертификацию NVIDIA Foundation, что означает его пригодность для высокоскоростного доступа к данным в средах с большим количеством GPU. Dell также расширила перечень инфраструктурных решений, запустив PowerRack, готовую систему стоечного масштаба, которая объединяет вычислительные ресурсы, сети, хранилище данных, охлаждение и управление в предварительно спроектированные блоки для развёртывания систем ИИ и HPC. Сообщается, что система может быть полностью настроена и введена в эксплуатацию в течение 6,5 ч. после доставки. Как отметил ресурс Techzine, это не новая концепция, поскольку Dell поставляла комплексные решения и раньше, но компания расширяет возможности PowerRack по трём направлениям. Сетевой вариант обеспечивает коммутационную способность 800 Тбит/с благодаря восьми новым коммутаторам PowerSwitch SN6600 на стойку. Это в первую очередь предназначено для так называемого трафика east-west, поддерживающего рабочие нагрузки ИИ-инференса. Dell также интегрирует PowerFlex (решение «4-в-1») в свою архитектуру хранения данных Exascale, обеспечивая поддержку блочного, файлового и объектного хранения в стоечном исполнении через PowerFlex, PowerScale, Lightning File System и ObjectScale для нагрузок ИИ, HPC и ресурсоёмких корпоративных рабочих нагрузок. Dell также представила Pro Precision 7 R1 — стоечную рабочую станцию высотой 1U с ускорителями NVIDIA RTX PRO Blackwell Max-Q Workstation Edition и объёмом хранилища до 64 Тбайт. Обновлённые версии Dell Integrated Rack Controller и OpenManage Enterprise расширяют возможности на уровне стойки. В то же время новый PowerCool CDU C7000 разработан для отвода тепла от платформ NVIDIA следующего поколения в компактном стоечном форм-факторе. Это первый CDU для установки в стойку, отвечающий потребностям в охлаждении платформы NVIDIA Vera Rubin NVL72 в компактном форм-факторе 4U (19″) и расширяющий возможности охлаждения Dell и поддержку использования горячей воды с температурой до +40 °C. Сообщается, что Dell PowerRack для вычислительных систем уже доступна, PowerRack для сетей будет доступна в сентябре 2026 года, а для хранилищ — во II половине 2026 года. Также уже доступны решение Dell Deskside Agentic AI, поддержка NVIDIA OpenShell, NVIDIA AI-Q 2.0 для Dell AI Factory и эталонная архитектура Dell-NVIDIA AI-Q 2.0. В свою очередь, Dell Pro Precision 7 R1 будет доступна в июле 2026 года, Data Orchestration Engine с MetadataIQ — во II квартале 2026 года, CDU — в III квартале 2026 года, а Data Analytics Engine with Starburst — в I квартале 2027 года.

19.05.2026 [20:19], Сергей Карасёв

YADRO представила российский 2U-сервер Vegman R215 G4 на базе AMD EPYC TurinКомпания YADRO, входящая в «ИКС Холдинг», расширила ассортимент отечественных серверов, анонсировав модель Vegman R215 G4 в форм-факторе 2U. Новинка, как утверждается, подходит для широкого спектра корпоративных и облачных нагрузок. Устройство, выполненное на аппаратной платформе AMD, имеет односокетную конфигурацию. Может устанавливаться процессор EPYC 9005 Turin или EPYC 9004 Genoa с показателем TDP до 500 Вт (до 192 вычислительных ядер). Реализованы 24 слота для модулей оперативной памяти DDR5-6400 (2 DPC) (L)RDIMM ECC суммарным объёмом до 6 Тбайт. Предусмотрены два варианта исполнения подсистемы хранения данных: 12 × LFF SAS/SATA/NVMe или 24 × SFF SAS/SATA/(16 × NVMe). Отсеки для накопителей располагаются во фронтальной части. Кроме того, могут быть установлены два SSD формата M.2/E1.S или два диска SFF SATA в тыльной зоне корпуса. Упомянуты два сетевых порта 1GbE (RJ45) и выделенный сетевой порт управления 1GbE (RJ45). Спереди находятся по одному разъёму USB 2.0 Type-A и D-Sub, а также два порта USB 3.1 Type-C. Сзади сосредоточены два разъёма USB 3.1 Type-A, последовательный порт (разъём USB Type-C, RS-232) и интерфейс Mini DisplayPort (BMC). Сервер предоставляет до восьми слотов PCIe 5.0 (с учетом отсеков OCP 3.0 SFF и гнезда под контроллер RAID/HBA). Доступны различные HBA- или RAID-контроллеры (с поддержкой RAID 0/1/5/6/50/60), а также опциональный суперконденсатор для защиты содержимого кеш-памяти при отключении питания. Питание обеспечивают два блока мощностью до 3400 Вт с сертификатом 80 Plus Platinum. Применена система воздушного охлаждения с шестью вентиляторами диаметром 60 мм с горячей заменой. Диапазон рабочих температур — от +10 до +35 °C. Говорится о совместимости с Astra Linux, ALT Linux, РЕД ОС, zVirt, VDP. |

|