Материалы по тегу: облако

|

31.03.2026 [15:53], Руслан Авдеев

Selectel запустил защищённый катастрофоустойчивый облачный регион ru-6 с тремя зонами доступностиРоссийский провайдер облачной инфраструктуры Selectel запустил геораспределённый (Multi-AZ) облачный регион ru-6. Новое решение подойдёт корпоративным клиентам с крупными цифровыми проектами и сложными внутренними информационными системами, требующими высокопроизводительной вычислительной инфраструктуры, говорит компания. Регион включает три независимых зоны доступности (AZ) в Москве, с расстоянием до 15 км между дата-центрами. Связь площадок обеспечит высокоскоростная сеть с временем отклика менее 1 мс. Если раньше для распределения нагрузок между зонами было необходимо ручное конфигурирование, то теперь устойчивость сетевых и PaaS-сервисов можно получить «из коробки». Мастер-ноды Managed Kubernetes и ноды облачных баз данных в геораспределённых кластерах автоматически размещаются в разных AZ. Аналогичным образом организовано и распределённое резервное копирование. Подобная архитектура обеспечит работоспособность клиентских нагрузок, даже если из строя выйдет одна из зон доступности целиком. В случае инцидента задержка восстановления сервисов будет минимальной, всего от нескольких минут. В компании говорят о получении доступа к «отказоустойчивости как сервису». Связанные с работой ЦОД риски будут минимизироваться с помощью автоматической системы аварийного восстановления. Утверждается, что это обойдётся минимум вдвое дешевле обычного DR-механизма. В то же время сохранится возможность выбора того, где именно размещать критически важные сетевые компоненты с учётом требований к RTO и RPO.

Источник изображения6 Selectel Уже организован доступ к инфраструктуре ru-6 по предварительному заказу на её сайте. Сегодня компании размещают критически важные информационные системы сразу в нескольких ЦОД, а в некоторых случаях — у нескольких облачных провайдеров. Новое решение обеспечивает устойчивые PaaS: Managed Kubernetes, облачные СУБД, S3-хранилище и др. В основе нового региона — увеличенные лимиты произвольных конфигураций, выделенные ядра и возможность управлять топологией CPU. Облако построено на современном оборудовании с использованием собственной серверной платформы Selectel и процессоров AMD EPYC 9754 (Turin) и Intel Xeon 6747P (Granite Rapids-SP), сетевых дисков с производительностью 75 тыс. IOPS, а также ИИ-ускорителей NVIDIA H200 и RTX PRO 6000 Blackwell Server Edition. Компания рассчитывает дополнить систему геораспределённым хранилищем S3 с высокоскоростным подключением к облачным серверам, появится и специальное файловое хранилище. Планируется добавить функцию резервирования выделенных хостов виртуализации для конфиденциальных вычислений и экспорт бэкапов в другие географические регионы.

29.03.2026 [20:47], Сергей Карасёв

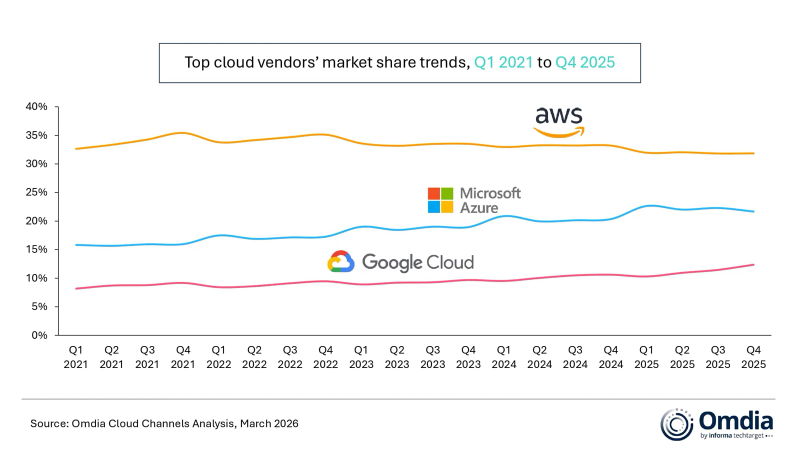

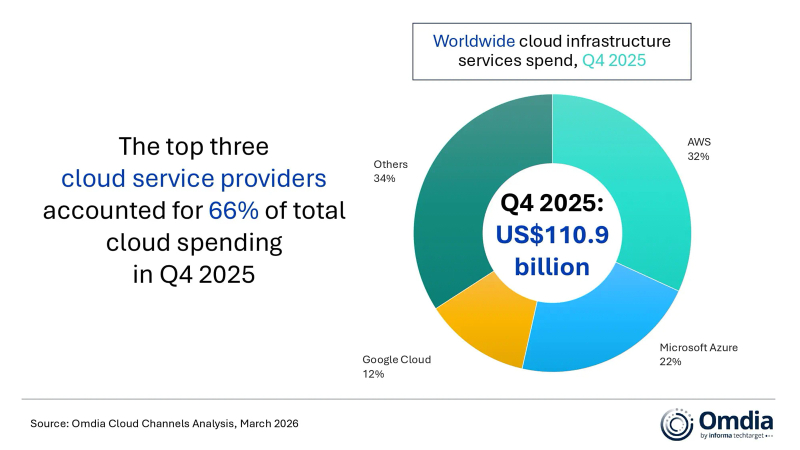

Квартальные затраты на облачную инфраструктуру превысили $110 млрдКомпания Omdia подвела итоги исследования глобального рынка облачных инфраструктур в IV квартале 2025 года. Затраты достигли $110,9 млрд, что на 29 % больше по сравнению с аналогичным периодом предыдущего года. Отрасль продолжает стремительно расширяться на фоне активного внедрения ИИ. Аналитики отмечают, что мировой рынок облачных инфраструктур в течение шести кварталов подряд показывает тем роста свыше 20 % в годовом исчислении. Во многом это связано с тем, что использование ИИ в корпоративной среде смещается от экспериментов к масштабным развёртываниям. Речь идёт, в частности, об использовании ИИ-агентов, различных сервисов на основе данных и т. д. Крупнейшим игроком рассматриваемого рынка остаётся AWS с долей 32 % по итогам последней четверти 2025-го. Выручка компании год к году поднялась на 24 %, а общий портфель заказов составил $244 млрд. AWS продолжает расширять свою глобальную инфраструктуру ЦОД, развивая площадки в Европе и США. На втором месте в рейтинге располагается Microsoft Azure с долей 22 % и ростом выручки на 39 % по сравнению с IV кварталом 2024 года. Редмондская корпорация развивает спектр моделей, доступных в Azure AI Foundry: появились Mistral Large 3, GPT-5.2 и Claude Opus 4.6. Замыкает тройку облако Google Cloud, которое показало самые высокие темпы роста среди лидеров — плюс 50 % в годовом исчислении. Рыночная доля платформы составляет 12 %. К концу IV квартала 2025 года общий портфель заказов компании достиг $240 млрд против $157,7 млрд кварталом ранее. Таким образом, суммарная доля трёх ведущих облачных провайдеров в последней четверти 2025 года составила 66 %. То есть, AWS, Microsoft Azure и Google Cloud сообща контролируют две трети мирового рынка.

26.03.2026 [15:36], Андрей Крупин

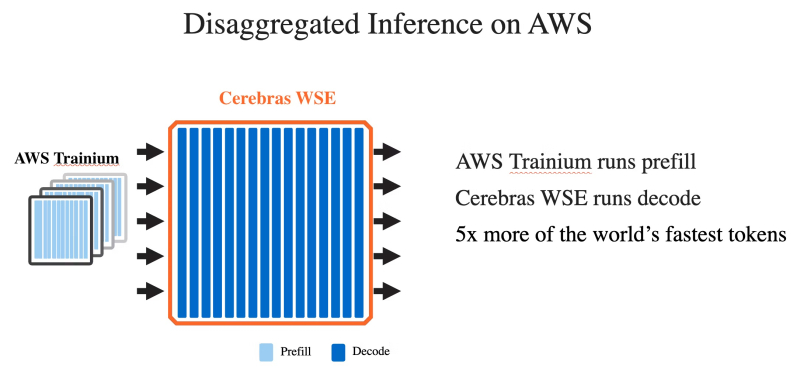

Yandex B2B Tech запустила Cloud Stackland — платформу контейнеризации с интегрированными PaaS‑сервисами Yandex CloudYandex B2B Tech (бизнес-группа «Яндекса», объединяющая технологии и инструменты компании для корпоративных пользователей, включая продукты Yandex Cloud и «Яндекс 360») вывела на рынок Cloud Stackland. Yandex Cloud Stackland представляет собой инфраструктурное решение со встроенными управляемым сервисами Yandex Cloud, предназначенное для развёртывания в закрытом контуре организации и объединяющее все необходимые компоненты для централизованного управления микросервисными и ИИ‑приложениями. Платформа поставляется со встроенными управляемыми базами данных, контейнерным оркестратором и объектным хранилищем. Для работы с ИИ-нагрузками предусмотрены инструменты управления доступом к графическим ускорителям для задач инференса. Также в продукт интегрированы средства безопасности и ограничения доступа разработчиков к тем или иным проектам.

Источник изображения: Yandex B2B Tech / yandex.cloud Cloud Stackland позволяет не только разворачивать и настраивать среду для разработки продуктов, но и быстро внедрять сервисы Yandex Cloud. Уже сейчас на платформе доступны инструмент для речевой аналитики Yandex SpeechSense и BI-система Yandex DataLens. В ближайшее время добавятся ещё несколько решений, в том числе флагманский продукт «Яндекса» для разработки ИИ-приложений и агентов — Yandex AI Studio. Платформа зарегистрирована в реестре отечественного ПО и находится в процессе сертификации по четвёртому уровню ФСТЭК России.

24.03.2026 [15:39], Андрей Крупин

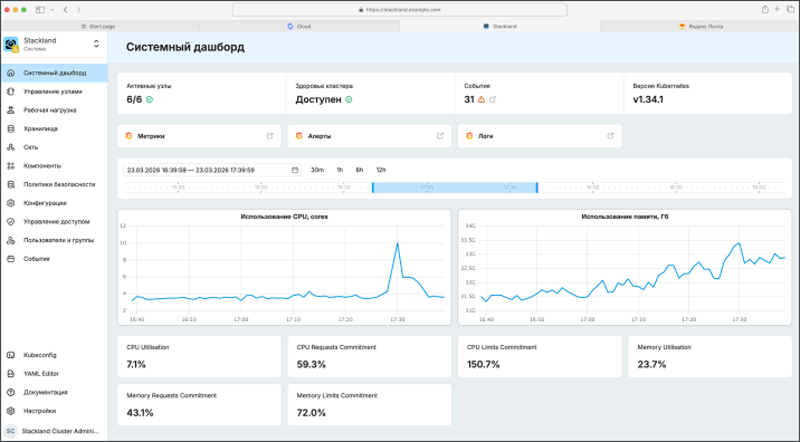

MWS Cloud запустила сервис GPT Model Hub для работы с большими языковыми моделямиКомпания MWS Cloud (входит в МТС Web Services) сообщила о запуске GPT Model Hub — облачного сервиса для развёртывания и использования больших языковых моделей (LLM) в инфраструктуре MWS Cloud Platform. Решение предоставляет готовую платформу для работы с ИИ-моделями и обеспечивает их безопасное, масштабируемое и управляемое использование. GPT Model Hub запущен на базе платформы MWS GPT и предоставляет доступ к большим языковым моделям через API внутри MWS Cloud Platform. В составе сервиса представлены 10 больших языковых моделей, среди которых ведущие мировые открытые LLM: DeepSeek, Google Gemma, Alibaba Qwen, Zhipu AI, Moonshot AI, BAAI и другие. До конца года будут добавлены ещё 10 моделей, включая модели TTS (преобразующие текст в речь) и ASR (преобразующие аудио в текст), а также реранкеры.

Источник изображения: mws.ru Сервис может использоваться разработчиками и организациями для внедрения ИИ-ассистентов в продукты, построения интеллектуального поиска, обработки текстовых данных, автоматизации поддержки, создания ИИ-инструментов для сотрудников и решения прочих задач. Модели доступны через OpenAI-совместимый API и могут быть интегрированы в backend-сервисы, developer-инструменты и пользовательские приложения. Сервис предоставляется по модели самообслуживания через консоль управления MWS Cloud Platform. LLM развёртывается по клику за несколько секунд и сразу доступна для работы через точку подключения в облаке MWS. Встроенные в платформу ресурсная модель, политики доступа и биллинга упрощают управление сервисом и позволяют отслеживать расходы на уровне проектов и команд.

24.03.2026 [15:25], Руслан Авдеев

Работа облака AWS в Бахрейне снова нарушена в результате активности беспилотниковКомпания Amazon объявила, что региональное подразделение Amazon Web Services (AWS), расположенное в Бахрейне, пострадало от «нарушения работы», связанного с текущим конфликтом на Ближнем Востоке. Это уже второй случай за месяц, когда в регионе страдает инфраструктура ЦОД компании, напоминает Reuters. Сбой в работе AWS вызван активностью в районе ЦОД беспилотников. Впрочем, пока подробностей нет, а Amazon пока не ответила на запрос о том, был ли объект в Бахрейне непосредственно атакован беспилотниками или сбой вызван ударами дронов по объектам в близлежащей округе. Компания помогает клиентам перевести свои данные в другие регионы AWS, пока работа не будет восстановлена, но масштаб ущерба и вероятная продолжительность отсутствия обслуживания не разглашаются. Регион AWS в Бахрейне пострадал после начала активной фазы конфликта на Ближнем Востоке уже второй раз. Ранее в марте AWS объявила, что зоны доступности в Бахрейне и ОАЭ пострадали в результате удара БПЛА, оставшись без электроснабжения. Сообщалось, что компания работает над восстановлением работоспособности инфраструктуры, включая перенос вычислительных нагрузок в другие облачные регионы.

Источник изображения: Afsal Shaji/unsplash.com По данным Reuters, удар по объекту в ОАЭ носит знаковый характер — это первый случай, когда военные действия нарушили работу объекта одной из крупнейших американских технологических компаний. Из-за структурных повреждений Amazon ориентировалась на «длительный» период восстановления работоспособности. Сообщается, что удары «причинили структурный ущерб, нарушили подачу электричества, а в некоторых случаях потребовалось тушение пожаров, что вызвало дополнительный ущерб от воды». На момент первых атак Amazon заявила, что расположенный в Бахрейне регион пострадал от удара беспилотника «в непосредственной близости» от одного из объектов компании.

17.03.2026 [19:23], Руслан Авдеев

Amazon и NVIDIA расширят сотрудничество: в течение года AWS развернёт более 1 млн ИИ-ускорителей NVIDIAAWS и NVIDIA анонсировали расширение технологического сотрудничества. Речь идёт о взаимодействии в сфере ускоренных вычислений, технологий интерконнекта, настройки ИИ-моделей и инференса. План включают развёртывание AWS в облачных регионах по всему миру более 1 млн новых ИИ-ускорителей NVIDIA, в т.ч. семейств Blackwell и Rubin, и сетевых технологий NVIDIA Spectrum. Ведётся подготовка к запуску новых инстансов EC2 на основе ускорителей NVIDIA RTX Pro 4500 Blackwell Server Edition. AWS стала первым крупным облачным провайдером, анонсировавшим поддержку этих ускорителей. Эти инстансы предназначены для аналитики, «говорящих» ИИ-систем, генерации контента, рекомендательных систем, видеостриминга, видеорендеринга и др. Они будут построены на архитектуре AWS Nitro С ростом инфраструктуры ключевой проблемой становится взаимодействие между ускорителями NVIDIA и AWS Trainium. Компании объявили о поддержке NVIDIA Inference Xfer Library (NIXL) и AWS Elastic Fabric Adapter (EFA), что позволяет ускорить распределённый инференс ИИ-моделей на EC2. Подобная архитектура распределённого инференса позволяет эффективно совмещать вычисления и передачу данных, снижать задержки и максимизировать использование ИИ-ускорителей. NIXL с EFA интегрируются с популярными открытыми фреймворками, включая NVIDIA Dynamo, vLLM и SGLang.

Источник изображения: AWS Дополнительно AWS и NVIDIA объявили об использовании Apache Spark в конфигурации Amazon EMR на Amazon EKS с инстансами G7e на основе ускорителей NVIDIA RTX Pro 6000 Blackwell, что втрое ускорит аналитику данных. При этом сохраняется совместимость с имеющимися приложениями Spark. Наконец, компании объявили о расширении поддержки ИИ-моделей NVIDIA Nemotron в Amazon Bedrock с адаптацией моделей для юриспруденции, здравоохранения, финансов и других специализированных областей. Вся инфраструктура управляется Bedrock, что значительно упрощает задачи разработчиков. Вскоре ожидается появление гибридной MoE-модели NVIDIA Nemotron 3 Super для финансовых сервисов, кибербезопасности, ретейла, разработки ПО и др. В целом компании создали полный стек ИИ-инфраструктуры — от ИИ-ускорителей и сетей до управляемых сервисов. Это позволит клиентам быстрее внедрять ИИ-решения, не конструируя инфраструктуру из разрозненных компонентов. Как сообщает Datacenter Dynamics, в феврале 2026 года глава AWS Мэтт Гарман (Matt Garman) заявил, что компания всё ещё использовала устаревшие ускорители NVIDIA A100 в некоторых серверах, поскольку спрос был высок даже на них. Широкий доступ к NVIDIA Blackwell Ultra появился в декабре 2025 года, в скором будущем планируется организовать доступ и к ускорителям Rubin. В то же время компания намерена инвестировать в собственные ускорители Trainium. В феврале OpenAI объявила, что будет использовать 2 ГВт мощностей на основе Trainium и других ускорителей в облаке AWS, во многом благодаря $50 млрд инвестиций со стороны Amazon.

17.03.2026 [11:02], Руслан Авдеев

Meta✴ потратит до $27 млрд на ИИ-инфраструктуру NebiusMeta✴ Platforms в течение пяти лет намерена заплатить $27 млрд за ИИ-инфраструктуру, доступ к которой предоставит облачный провайдер Nebius Group, базирующийся в Нидерландах, сообщает Bloomberg. В Meta✴ подтвердили сделку с Nebius. Nebius — стратегический партнёр NVIDIA, с 2027 года предоставит Meta✴ мощности ЦОД на $12 млрд, ещё до $15 млрд Meta✴ потратит на покупку мощностей, которые облачный провайдер строит для сторонних клиентов. Это один из крупнейших «разовых» контрактов, заключенных Meta✴, что подчёркивает стремление компании развиваться в сфере ИИ. Недавно появилась информация, что компания сократит более 20 % штата из-за высоких затрат на ИИ-проекты. В 2025 году она уже заключила сделку с Nebius на $3 млрд. За последние 12 месяцев акции Nebius выросли в цене в четыре раза, а на фоне новостей подорожали на 15 %, а Meta✴ — на 2,8 %.

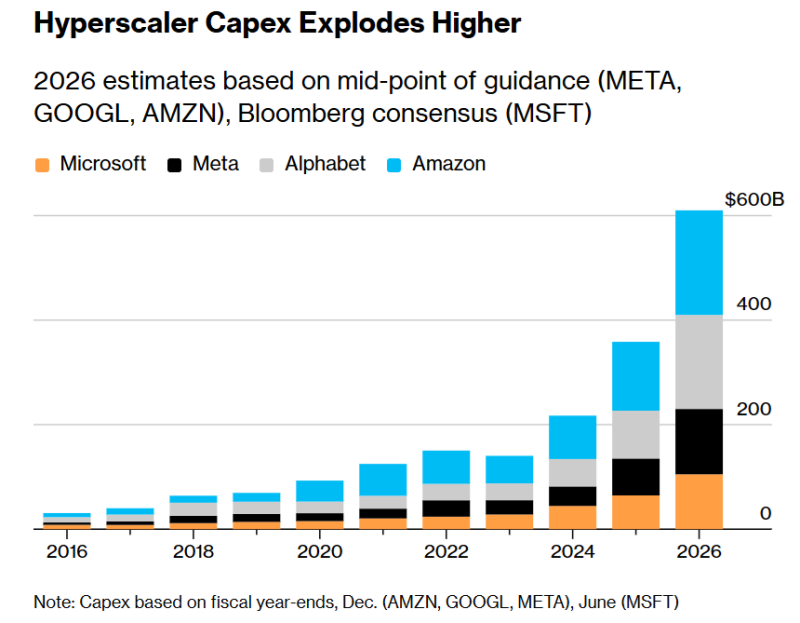

Источник изображения: Nebius Предполагается, что Meta✴ и её крупнейшие конкуренты потратят в 2026 году около $650 млрд на строительство ЦОД и покупку другой инфраструктуры на фоне взрывного роста спроса на ИИ-сервисы в ближайшие годы. Для Meta✴ ИИ в последнее время является ключевым приоритетом, и компания вкладывает значительные средства в конкуренцию с OpenAI, Google и др. С начала года заключены соглашения с NVIDIA и AMD о создании ИИ-инфраструктуры. Кроме того, Meta✴ разрабатывает и собственные ИИ-ускорители. В 2025 году заявлялось, что к 2028 году Meta✴ потратит на инфраструктурные инициативы в США $600 млрд. Для этого она будет использовать средства, вырученные от рекламного бизнеса и внешнее финансирование. Компания разрабатывает также и собственные ИИ-модели и др.

Источник изображения: Bloomberg Nebius, отделившаяся от «Яндекса» в 2024 году, — один из немногих новичков, очень успешно воспользовавшихся бумом ИИ-технологий. При этом немаловажную роль играет NVIDIA, активно инвестирующая в стартапы, конкурирующие с гиперскейлерами вроде Google и Amazon (AWS). На днях NVIDIA объявила о намерении инвестировать в Nebius $2 млрд, что привело к росту акций последней на 16 %. Значительная часть инвестиций NVIDIA была направлена компаниям, покупающим её собственные чипы. Это вызвало критику экспертов рынка, опасающихся, что такие инвестиции подпитывают создание ИИ-пузыря. Например, в январе NVIDIA сообщила об инвестициях $2 млрд в неооблачного провайдера CoreWeave, конкурирующего с Nebius, средства предназначались на внедрение ИИ-ускорителей самой NVIDIA. В 2026 году компания вложила $30 млрд в OpenAI, а также принимала участие в очередном раунде финансирования британской Nscale, желавшей привлечь $2 млрд. В январе сообщалось, что затраты Meta✴ на связанные с ИИ расходы в 2026 году составят от $115 до $135 млрд, это превышает прогнозы аналитиков в $110,7 млрд и почти вдвое больше, чем капитальные затраты компании в 2025 году, которые составили $72,2 млрд. Роста затрат направлен на поддержку подразделения Meta✴ Superintelligence Labs (MSL), а также основной повседневной деятельности компании.

16.03.2026 [10:45], Владимир Мироненко

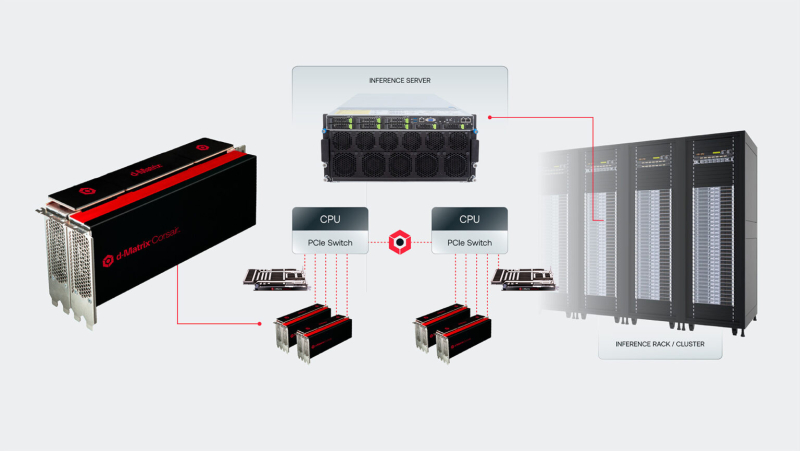

ASIC + GPU: d-Matrix и Gimlet Labs в 10 раз ускорят инференс агентного ИИКомпании d-Matrix и Gimlet Labs сообщили о решении объединить усилия с целью повышения производительности и энергоэффективности инференса для задач агентного ИИ в режиме реального времени. В рамках партнёрства Gimlet интегрирует ускорители d-Matrix Corsair в облако Gimlet Cloud наряду с традиционными GPU. В гибридной архитектуре GPU будут отвечать за ресурсоёмкие этапы инференса, в то время как операции, чувствительные к работе с памятью и задержкам, будут обрабатывать Corsair. Компании сообщили, что совместное решение может обеспечить десятикратное улучшение задержки и пропускной способности на ватт по сравнению с использованием только GPU. Согласно пресс-релизу, решение «идеально подходит для рабочих нагрузок, чувствительных к задержке, включая спекулятивное декодирование, которое часто используется в крупномасштабных развёртываниях ИИ для снижения задержки». Corsair поставляется в виде стандартной карты PCIe с воздушным охлаждением, что позволяет быстро устанавливать решение в ЦОД внутри существующих серверов с GPU без специальных корпусов или нестандартных систем трубопроводов. Сетевые карты d-Matrix Jetstream передают данные между Corsair и GPU посредством стандартного Ethernet, упрощая интеграцию в масштабах инфраструктуры и повышая эффективность использования. Заин Асгар (Zain Asgar), сооснователь и генеральный директор Gimlet Labs, заявил, что «аппаратное обеспечение d-Matrix — идеальное решение для тех этапов инференса, на которых GPU тратят энергию впустую». «Используя Corsair для таких сценариев использования, как спекулятивное декодирование, мы можем обеспечить нашим клиентам значительно более высокую производительность при тех же габаритах», — добавил он. Программный стек Gimlet интеллектуально распределяет и сопоставляет рабочие нагрузки агентов между различными ускорителями разных производителей, поколений и архитектур, запуская каждый сегмент на наиболее оптимальном оборудовании. ЦОД Gimlet включают в себя различные типы оборудования и высокоскоростные интерконнекты для обслуживания передовых лабораторий и других компаний, занимающихся разработкой ИИ. Аналитик Мэтт Кимбалл (Matt Kimball) из Moor Insights & Strategy сообщил ресурсу Data Center Knowledge, что ключевым моментом является сочетание специализированного оборудования и программной оркестрации. «Архитектура d-Matrix разработана с учётом эффективности инференса, а не масштабируемости обучения, что соответствует рынку в ходе внедрения приложений ИИ в производство, — сказал Кимбалл. — Но одного оборудования недостаточно — такие платформы, как Gimlet, стремятся упростить развёртывание и легко интегрироваться в существующие рабочие процессы. Именно это делает данное решение привлекательным». Аналитик добавил, что реальная ценность решения заключается в уровне абстракции, который предоставляет Gimlet, позволяя запускать рабочие нагрузки на гетерогенных чипах без переписывания кода. «Рабочие нагрузки в области ИИ становятся всё более гетерогенными, но большая часть инфраструктуры по-прежнему оптимизирована под один тип ускорителя», — отметил он. По его словам, если Gimlet сможет упростить разработчикам развёртывание на нескольких чипах, это обеспечит реальное повышение эффективности системы. «Успешные платформы — это те, которые разработчики могут использовать, не задумываясь об оборудовании», — считает Кимбалл. Компании планируют предоставить своё объединённое решение отдельным клиентам в рамках Gimlet Cloud во II половине 2026 года. Data Center Knowledge отметил, что это также подчёркивает более широкую тенденцию в инфраструктуре ИИ: гетерогенные системы, вероятно, будут доминировать на следующем этапе развёртывания ИИ, и успех будет зависеть как от оркестрации ПО, так и от производительности оборудования. NVIDIA тоже добавил к своим GPU Rubin новые ASIC Groq.

14.03.2026 [18:42], Владимир Мироненко

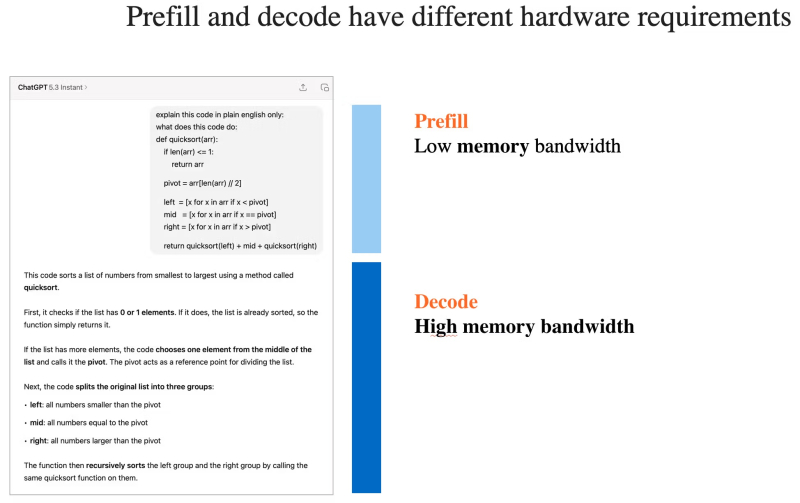

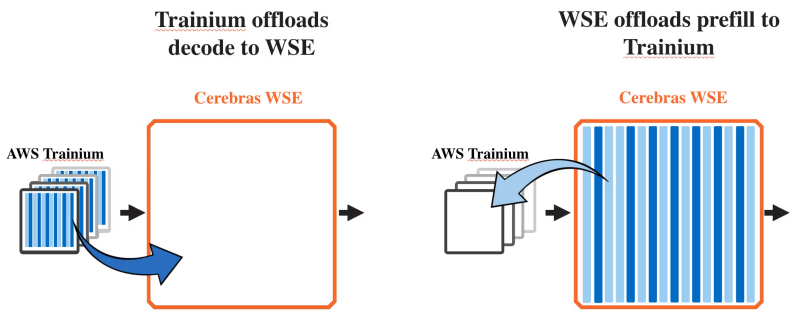

Царь-ускорители Cerebras в облаке AWS пятикратно ускорят инференс ИИAmazon Web Services (AWS) и Cerebras Systems объявили о сотрудничестве, «которое позволит создать в ближайшие месяцы самые быстрые решения для инференса в системах генеративного ИИ и рабочих нагрузок машинного обучения». Решение, которое будет развёрнуто на платформе Amazon Bedrock в ЦОД AWS, объединяет серверы на базе ускорителей Trainium, системы Cerebras CS-3 на базе царь-чипов WSE-3 и DPU EFA. Ожидается, что эта технология увеличит скорость генерации результатов ИИ-моделями в пять раз. Позже в этом году AWS предложит ведущие open source решения машинного обучения и собственные ИИ-модели Amazon Nova, использующие оборудование Cerebras. Как отметил Дэвид Браун (David Brown), вице-президент по вычислительным и машинным сервисам AWS, при инференсе критическим узким местом для ресурсоёмких рабочих нагрузок, таких как помощь в кодировании в реальном времени и интерактивные приложения, остаётся скорость: «Решение, которое мы разрабатываем совместно с Cerebras, решает эту проблему: разделяя нагрузку по инференсу между Trainium и CS-3 и соединяя их с помощью EFA, каждая система делает то, что у неё лучше всего получается. В результате инференс будет на порядок быстрее и производительнее, чем сегодня». Совместное решение использует «дезагрегацию вывода» — метод, который разделяет ИИ-инференс на два этапа: этап интенсивной обработки подсказок, или «предварительного заполнения» (процесс обработки запроса LLM), и этап генерации выходных данных, известный как «декодирование», на котором модель формирует ответ на вопрос пользователя. Предварительное заполнение является параллельным, вычислительно интенсивным процессом и не требует большой пропускной способности памяти. Декодирование, с другой стороны, является последовательным процессом с минимальными требованиями к вычислительным ресурсам, но интенсивно использует пропускную способность памяти. Декодирование обычно занимает большую часть времени при инференсе, поскольку каждый выходной токен должен генерироваться последовательно, отметила AWS. Задачи предварительного заполнения и декодирования обычно выполняются одним и тем же чипом. В дезагрегированной архитектуре AWS чипы Trainium обеспечивают этап предварительного заполнения, а чипы WSE-3 выполняют декодирование. «Дезагрегированный подход идеален, когда у вас большие, стабильные рабочие нагрузки, — сообщил в блоге директор по маркетингу продукции Cerebras Джеймс Ванг (James Wang). — Большинство клиентов используют смешанные рабочие нагрузки с различными коэффициентами предварительного заполнения/декодирования, где традиционный агрегированный подход по-прежнему идеален. Мы ожидаем, что большинство клиентов захотят иметь доступ к обоим вариантам». Одним из главных преимуществ WSE-3 является то, что он может передавать данные между своими логическими схемами и цепями памяти быстрее, чем многие другие чипы. По данным Cerebras, WSE-3 обеспечивает внутреннюю пропускную способность памяти в 21 Пбайт/с, что значительно превышает пропускную способность NVLink для ускорителей от NVIDIA. Впрочем, у NVIDIA теперь есть ускорители Groq, которые тоже помогают ускорить инференс. Несколько недель назад Cerebras заключила с OpenAI сделку на $10 млрд по поставке чипов общей мощностью 750 МВт до 2028 года. Сделка была объявлена в период между двумя раундами финансирования, которые в совокупности принесли Cerebras более $2 млрд. Ожидается, что компания подаст заявку на IPO уже во II квартале 2026 года. Сделки с AWS и OpenAI могут способствовать повышению интереса инвесторов к листингу, отметил SiliconANGLE.

13.03.2026 [17:10], Руслан Авдеев

Crusoe представила периферийные ИИ ЦОД Crusoe Edge Zones на базе модулей SparkКомпания Crusoe анонсировала запуск периферийных зон доступности Crusoe Edge Zones на базе модульных ЦОД Crusoe Spark, обеспечивающих ИИ-вычисления практически в любой локации. Edge Zones предоставят ИИ-инфраструктуру с низкой задержкой и позволят внедрять суверенные ИИ-решения клиентам со всего мира. Crusoe Edge Zones на базе Crusoe Spark — дальнейшее масштабирование вертикально интегрированных ИИ-фабрик. Модули Crusoe Spark выпускаются на недавно представленном заводе Spark Factory. Благодаря контролю над полным стеком работы над ИИ-инфраструктурой — от заводской сборки до облачной оркестрации — Crusoe способна развёртывать новые периферийные облака всего за три месяца. При этом они значительно дешевле, чем классические ЦОД. Зоны оптимизированы для работы с облачной платформой Crusoe Cloud и инференс-службой Managed Inference. Благодаря запатентованной технологии Crusoe MemoryAlloy можно сократить «время до первого токена» в 9,9 раза. Кроме того, система обеспечит в пять раз более высокую пропускную способность, чем стандартные конфигурации для инференса, говорит Crusoe. В результате периферийные пользователи получат доступ к сверхэффективной инфраструктуре с высоким быстродействием. Ключевые сценарии применения:

В компании уверены, что в будущем ИИ-инфраструктура будет включать как гигантские кампусы гигаваттного масштаба для обучения ИИ, так и распределённые модули для обработки информации на периферии. На данный момент Crusoe инвестирует в оба направления. Концепция сетей модульных ЦОД, практически независимых от крупных кампусов, в последнее время на фоне конфликта на Ближнем Востоке становится всё популярнее. Независимо от этих событий недавно Akamai пообещала развернуть тысячи ускорителей NVIDIA RTX Blackwell для распределённого инференса. |

|