Материалы по тегу: nvidia

|

14.01.2026 [01:29], Владимир Мироненко

Безоблачно: США запретили Китаю удалённый доступ к передовым ИИ-ускорителямПалата представителей США приняла подавляющим большинством «Закон о безопасности удалённого доступа» (Remote Access Security Act). Как сообщается на сайте Специального комитета Палаты Представителей США по стратегическому соперничеству между Соединёнными Штатами и Компартией Китая (CCP), этот закон расширяет действие «Закона о реформе экспортного контроля», позволяя федеральным властям «ограничивать возможности иностранных противников получать удалённый доступ к технологиям, включая ИИ-чипы, через облачные вычислительные сервисы». Проще говоря, теперь китайским компаниям запрещён доступ к передовым ускорителям в ЦОД и облаках за пределами КНР. Хотя экспорт ускорителей NVIDIA H200 теперь разрешён, поставка в Китай более мощных чипы на базе архитектуры Blackwell по-прежнему запрещена, как и ускорителей с новой архитектурой Vera Rubin. Новый закон призван перекрыть пробелы в законодательстве США, которыми с успехом пользуются китайские компании, получая доступ к находящимся под санкциями ИИ-ускорителям, покупая или арендуя их для использования на территории США. О таких обходных путях стало известно в 2024 году, когда выяснилось, что ByteDance, китайский владелец TikTok, арендовал передовые чипы NVIDIA у Oracle, пишет Data Center Dynamics. Как передаёт The Register, китайские компании обходят экспортные ограничения на высокопроизводительные ускорители NVIDIA и другие чипы, получая к ним доступ через такие платформы, как AWS и Azure, по крайней мере, с 2023 года. The Register также ранее сообщал, что китайские облачные провайдеры, такие как Alibaba и Tencent, могут предоставлять доступ к находящимся под экспортными ограничениями GPU клиентам в Китае, арендуя облачное оборудование, размещённое за пределами страны. В свою очередь, Microsoft и AWS предлагают в Китае через местных партнёров облачные услуги, в целом аналогичные тем, что доступны в других странах. «Амбиции КПК в области ИИ подпитываются доступом к американским чипам, размещённым в ЦОД за пределами Китая, — заявил председатель Специального комитета по Китаю, один из соавторов законопроекта. — Этот законопроект переводит наши законы в цифровую эпоху и ясно даёт понять, что облачные вычисления подпадают под действие американского законодательства об экспортном контроле, так же как и физические чипы. Устранение этих лазеек укрепит национальную безопасность США и защитит американские инновации». Новый закон теоретически может целиком перекрыть бизнес некоторых азиатских компаний. После появления сообщения о том, что NVIDIA потребует от китайских клиентов, приобретающих ускорители H200, полной предоплаты, чипмейкер выступил с опровержением, заявив агентству Reuters, которое первым сообщило об этом что «никогда не будет требовать от клиентов оплаты за продукцию, которую они не получают». В начале декабря администрация Трампа разрешила NVIDIA продавать H200 «одобренным клиентам» в Китае и других странах при условии выплаты 25-% пошлины. В свою очередь, китайское правительство попросило технологические компании страны приостановить оформление заказов на ускорители, пока регулирующие органы не определятся с соотношением приобретаемых чипов H200 и отечественных чипов «в нагрузку» к ним.

13.01.2026 [09:03], Руслан Авдеев

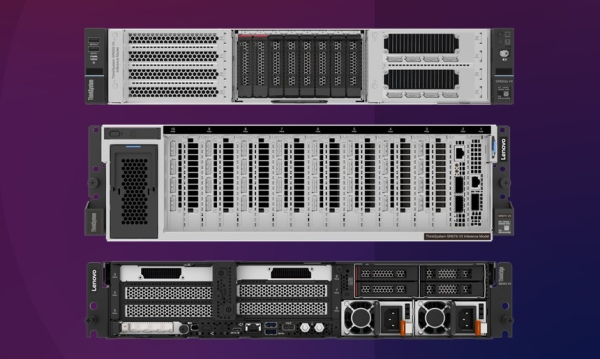

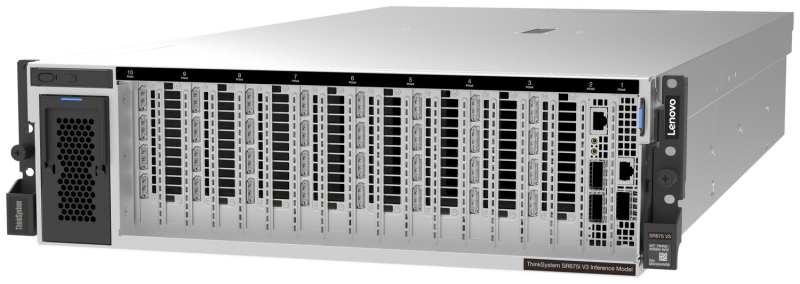

Lenovo представила серверы для ИИ-инференса: ThinkSystem SR675i V3/SR650i V4 и ThinkEdge ThinkEdge SE455i V4Lenovo представила новые серверные системы серии Lenovo Hybrid AI Advantage, оптимизированные для ИИ-инференса: ThinkSystem SR675i V3, ThinkSystem SR650i V4 и ThinkEdge SE455i V4. Если ранее акцент делался на решениях для обучения всё более производительных ИИ-моделей, то теперь бизнес обращает всё больше внимания на продукты для инференса. Новинки предлагаются параллельно с ПО для оптимизации инференса — для унификации и получения данных из разных источников для использования ИИ-моделями. Флагманской версией серии является ThinkSystem SR675i V3 в исполнении 3U на платформе AMD EPYC Turin 9535 (64C/128T, 2,4 ГГц, TDP 300 Вт). Сервер получил 1,5 Тбайт DDR5-6400 (24 × 64 Гбайт). За хранение данных отвечают до двух E3.S NVMe SSD по 3,84 Тбайт (PCIe 5.0 x4) и до двух M.2 NVMe SSD по 960 Гбайт (PCIe 4.0 x4). Возможна установка восьми ускорителей NVIDIA RTX PRO 6000 Blackwell Server Edition, а также пяти DPU NVIDIA BlueField-3 (4 × 400G, 1 × 200G). IPMI в данной модели не доступен. Для карт расширения доступно до шести слотов PCIe 5.0 х16 и один слот OCP 3.0 x8/x16. За питание отвечают четыре блока Titanium второго поколения (по 2300 Вт), а за охлаждение — пять вентиляторов. ThinkSystem SR650i V4 позиционируется в качестве системы для инференса и корпоративных рабочих нагрузок. Этот 2U-сервер получил два Intel Xeon Granite Rapids-SP 6530P (32C/64T, 2,3 ГГц, TDP 225 Вт), 512 Гбайт DDR5-6400 (8 × 64 Гбайт), два ускорителя RTX PRO 6000 Blackwell Server Edition. За хранение отвечают два 3,84-Тбайт U.2 NVMe SSD (PCIe 5.0 x4), хотя всего таких слотов восемь, а также RAID1-массив из пары 960-Гбайт M.2 SATA SSD. Всего доступно шесть слотов расширения PCIe 5.0 x16 и два слота OCP 3.0 x8/x16. Имеется двухпортовый 25GbE-адаптер Broadcom 57414 (SFP28). За питание отвечают два Titanium-блока мощностью 2700 Вт каждый, а за охлаждение шесть вентиляторов, но есть и опция установки фирменной СЖО Neptune. Наконец, Lenovo ThinkEdge SE455i V3 (2U) глубиной всего 440 мм представляет собой компактную модель, предназначенную для периферийного инференса — в ретейле, телекоммуникациях и промышленности. Сервер имеет защищённую конструкцию и может работать при температурах от -5 до +40 °C. Сервер построен на базе одного процессора AMD EPYC Embedded 8534P (64C/128T, 2,3 ГГц, TDP 200 Вт), дополненного 576 Гбайт DDR5-4800 (6 × 96 Гбайт) и двумя ускорителями NVIDIA L4 24 Гбайт (PCIe 4.0 x16). В комплекте идёт один 3,84-Тбайт NVMe SSD и один 960-Гбайт SATA SSD. Имеется два блока питания Platinum второго поколения с возможностью горячей замены. Для карт расширения есть до двух слотов PCIe 5.0 x16 и до четырёх слотов PCIe 4.0 x8, а также один слот OCP 3.0 (PCIe 5.0 x16). Установлен двухпортовый OCP-адаптер Broadcom 57416 (10GbE). IPMI отключён. Фактически компания предлагает готовые конфигурации, которые можно переконфигурировать лишь слегка, чаще всего добавив накопители и/или сетевые адаптеры. Платформы будут доступны в рамках подписки TruScale. Также компания анонсировала новые сервисы Hybrid AI Factory Services, в том числе консультации по инференсу, которые помогают развёртывать оборудование и управлять им для оптимизации ИИ-производительности.

12.01.2026 [14:41], Сергей Карасёв

ASRock Rack показала ИИ-сервер на базе NVIDIA HGX B300 с СЖО ZutaCore HyperCoolКомпания ASRock Rack на выставке CES 2026 продемонстрировала ИИ-сервер 4U16X-GNR2/ZC, первая информация о котором была раскрыта в октябре прошлого года. Новинка создана в партнёрстве с разработчиком систем жидкостного охлаждения ZutaCore. Устройство выполнено в форм-факторе 4U. Возможна установка двух процессоров Intel Xeon 6700E (Sierra Forest-SP) или Xeon 6500P/6700P (Granite Rapids-SP). Доступны 32 слота для модулей оперативной памяти DDR5, три разъёма PCIe 5.0 x16 для карт FHHL и два сетевых порта 1GbE на базе контроллера Intel I350-AM2. Задействована аппаратная платформа NVIDIA HGX B300. Для отвода тепла используется система прямого жидкостного охлаждения ZutaCore HyperCool. Это двухфазное решение основано на применении специальной диэлектрической жидкости, которая не вызывает коррозии. Утверждается, что конструкция HyperCool безопасна для IT-оборудования и гарантирует сохранение работоспособности даже в случае утечки. СЖО поставляется в полностью собранном виде, что сокращает время монтажа в стойку. Сервер 4U16X-GNR2/ZC оборудован 12 фронтальными отсеками для SFF-накопителей с интерфейсом PCIe 5.0 x4 (NVMe); допускается горячая замена. Кроме того, есть внутренний разъём для одного SSD типоразмера М.2 (PCIe 5.0 x2). За питание отвечают десять блоков мощностью 3000 Вт с сертификатом 80 Plus Titanium. Габариты машины составляют 900 × 448 × 175 мм. Отмечается, что в стандартной стойке 42U могут быть размещены до восьми подобных серверов, что обеспечивает высокую плотность вычислительной мощности для наиболее ресурсоёмких нагрузок ИИ.

12.01.2026 [09:54], Владимир Мироненко

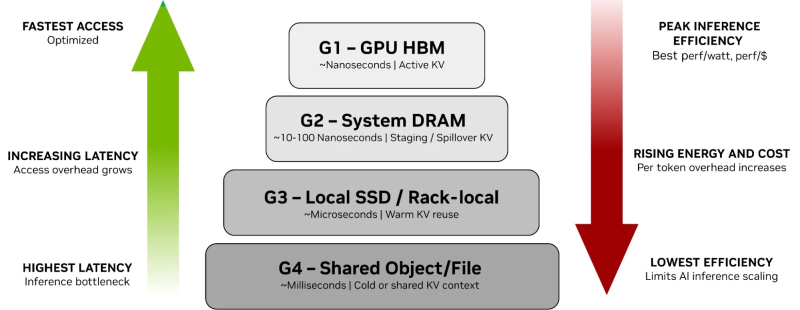

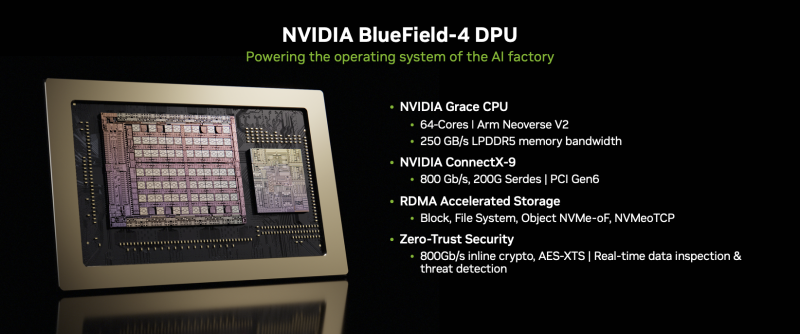

От NVMe к GPU: NVIDIA представила платформу хранения контекста инференса ICMSPВместе с официальным анонсом ИИ-платформы следующего поколения Rubin компания NVIDIA также представила платформу хранения контекста инференса NVIDIA Inference Context Memory Storage Platform (ICMSP), позволяющую решить проблемы хранения KV-кеша, который становится всё крупнее по мере роста LLM и решаемых задач. При выполнении инференса контекст растёт по мере генерации новых токенов, часто превышая доступную память ускорителя. В этом случае старые записи вытесняются из памяти, сначала в системную память, а потом на диск, чтобы не пересчитывать всё заново, когда они снова понадобятся. Проблемы существенно усугубляются при работе с агентным ИИ и обработке рабочих нагрузок с большим контекстом. Агентный ИИ приводит к появлению контекстных окон в миллионы токенов, а объём моделей может составлять уже триллионы параметров. В настоящее время эти системы полагаются на долговременную память для хранения контекста, позволяя агентам опираться на предыдущие рассуждения и расширять их на протяжении многих шагов, а не начинать с нуля при каждом запросе. По мере увеличения контекстных окон растут требования к ёмкости KV-кеша, делая эффективное хранение и повторное использование данных, в том числе совместное использование различными сервисами инференса, крайне важными для повышения производительности системы. Контекст инференса является производным и пересчитываемым, что требует архитектуры хранения, которая отдаёт приоритет энергоэффективности и экономичности, а также скорости и масштабируемости, а не традиционной надёжности хранения данных. NVIDIA отметила, что ИИ-фабрикам необходим дополнительный, специально разработанный уровень контекста, который рассматривает KV-кеш как собственный класс данных, предназначенный для ИИ, а не принудительно помещает его в дефицитную память HBM или в хранилище общего назначения. Платформа ICMSP использует DPU BlueField-4 для создания специализированного уровня памяти, чтобы преодолеть разрыв между высокоскоростной памятью GPU и масштабируемым общим хранилищем. Хранилище KV-кеша на основе NVMe должно эффективно обслуживать ускорители, узлы, стойки и кластеры целиком, говорит компания. Платформа ICMSP создаёт новый уровень (G3.5 на схеме выше) — флеш-память, подключённая через Ethernet и оптимизированная специально для KV-кеша. Этот уровень выступает в качестве долговременной агентной памяти на уровне ИИ-инфраструктуры, достаточно большой для одновременного хранения общего, развивающегося контекста многих агентов, но при этом достаточно близко расположенной для частой работы с памятью ускорителей и хостов. BlueField-4 отвечает за аппаратное ускорение размещения кеша и устранение накладных расходов на подготовку и перемещение данных и обеспечение безопасного, изолированного доступа к ним узлов с GPU, снижая зависимость от CPU хоста и минимизируя сериализацию и работу с системной памятью хоста. Программные продукты, такие как фреймворк DOCA, механизм разгрузки KV-кеша Dynamo и входящее в комплект ПО NIXL (Nvidia Inference Transfer Library), обеспечивают интеллектуальное, ускоренное совместное использование данных KV-кеша между ИИ-узлами. А Spectrum-X Ethernet обеспечивает оптимизированный RDMA-интерконнект, который связывает ICMS и узлы GPU. KV-кеш принципиально отличается от корпоративных данных: он является временным, производным и может быть пересчитан в случае потери. В качестве контекста инференса он не требует надёжности, избыточности или обширных механизмов защиты данных, разработанных для долговременных записей. Выделяя KV-кеш как отдельный, изначально предназначенный для ИИ класс данных, ICMS устраняет избыточные накладные расходы, обеспечивая повышение энергоэффективности до пяти раз по сравнению с универсальными подходами к хранению данных, сообщила NVIDIA. А своевременная подготовка и отдача данных более полно нагружает ускорители, что позволяет увеличить темп генерации токенов до пяти раз. Как сообщила NVIDIA, первоначальный список её партнёров, готовых обеспечить поддержку ICMSP с BlueField-4, который будет доступен во II половине 2026 года, включает AIC, Cloudian, DDN, Dell, HPE, Hitachi Vantara, IBM, Nutanix, Pure Storage, Supermicro, VAST Data и WEKA.

09.01.2026 [19:23], Владимир Мироненко

Pay 'n' Pray: NVIDIA требует полную предоплату за поставку H200 в КитайПосле того, как США дали NVIDIA добро на поставку ИИ-ускорителей H200 в Китай в обмен на выплату 25 % от суммы продаж, китайские компании выразили готовность приобрести у чипмейкера более 2 млн ускорителей. Это в несколько раз превышает имеющиеся запасы на складах NVIDIA. Ранее сообщалось, что NVIDIA готова отгрузить первые партии H200 в середине февраля до наступления лунного Нового года. Китайские власти пока не дали разрешение на импорт этих чипов, но, как утверждает Bloomberg со ссылкой на проверенные источники, правительство готово уже в этом квартале разрешить приобретение H200 для отдельных коммерческих целей. При этом из-за соображений безопасности под запретом окажутся закупки чипов для военных организаций, госучреждений, объектов критической инфраструктуры и предприятий с госсобственностью. По словам источника, власти КНР попросили некоторые китайские технологические компании приостановить на время размещение заказов на чипы H200, поскольку регуляторами пока не решено, в каком соотношении к покупке ускорителей американской компании они должны будут приобрести чипы отечественного производства.

Источник изображения: NVIDIA Для NVIDIA возобновление поставок означает возврат на ключевой рынок. Генеральный директор NVIDIA Дженсен Хуанг (Jensen Huang) заявил, что спрос клиентов в Китае на чипы H200 «довольно высок» и что компания «запустила свою цепочку поставок» для наращивания производства. Хуанг отметил, что вне зависимости от официального заявления правительства Китая об одобрении, поступление заявок от китайских компаний на покупку «будет означать, что они могут размещать заказы». По словам источников агентства Reuters, в случае с поставками H200 компания решила полностью переложить на клиентов риски, связанные с неопределённостью ситуации, потребовав полную предоплату за заказ. NVIDIA и раньше требовала предоплату, хотя могла в порядке исключения согласиться и на размещение депозита. При полной предоплате поставок, если Китай вдруг изменит решение и заблокирует импорт чипов, возврата предоплаты не будет и убытки полностью лягут на плечи китайских клиентов американской компании. UPD 13.01.2026: NVIDIA опровергла сообщения о предоплате, заявив, что «никогда не стал бы требовать от клиентов оплаты за товары, которые они не получают».

08.01.2026 [14:43], Руслан Авдеев

Valor Equity Partners привлекла $5,4 млрд на покупку ускорителей NVIDIA для xAI — часть денег снова дала сама NVIDIAИнвестиционная группа Valor Equity Partners привлекла $5,4 млрд для покупки ИИ-ускорителей NVIDIA в интересах xAI. Инвестиционная компания основала дочернюю компанию Valor Compute Infrastructure (VCI), которая будет покупать и сдавать в аренду ИИ-инфраструктуру для стартапа Илона Маска (Elon Musk), сообщает Datacenter Dynamics. Предусмотрена закупка ускорителей NVIDIA GB200, причём часть денег на них дала сама NVIDIA. Фонды, управляемые инвестиционной компанией Apollo Capital, внесут вклад в общие инвестиции в объёме $3,5 млрд. Сделка предусматривает «тройную чистую аренду» (triple net lease) — это происходит на фоне недавних новостей о привлечении xAI $20 млрд в раунде финансирования серии E, одним из инвесторов также является Valor. NVIDIA тоже вложила средства в этом раунде, но в виде акций. Средства будут потрачены на строительство дата-центров. Создание VCI является новым шагом в партнёрстве Valor и xAI. Фонд обеспечивает инвесторам возможность вкладывать средства в критическую вычислительную ИИ-инфраструктуру с ежеквартальными выплатами. При этом инвестор будет владеть и самими вычислительными активами. Тройная чистая аренда означает, что xAI будет платить не только за аренду ускорителей, но и оплачивать любые расходы, связанные с их использованием.

Источник изображения: NVIDIA В числе институциональных спонсоров VCI названа и NVIDIA. Это означает, что лидер рынка ускорителей подписал очередное циклическое финансовое соглашение — средства NVIDIA будут потрачены на покупку её же продуктов. Такие соглашения NVIDIA также заключала с компаниями, включая OpenAI и неооблачных партнёров — это подогревает опасения, что рынок ИИ по сути является самоподдерживающимся пузырём. В результате NVIDIA пришлось даже выпустить памятку для финансовых аналитиков, в которой убеждает тех, что всё в порядке и ни о каком очередном пузыре не может быть и речи.

08.01.2026 [13:35], Руслан Авдеев

«Дата-центр в чемодане»: Odinn представила переносной нано-ЦОД Omnia с четырьмя NVIDIA H200Громоздкость оборудования для дата-центров не позволяет легко переносить его с места на место, но у стартапа Odinn своё видение этой проблемы. Компания представила на днях своеобразный «нано-ЦОД» с четырьмя ИИ-ускорителями NVIDIA H200 (NVL), сообщает The Register. По данным компании, 35-кг платформа Odinn Omnia помимом ускорителей включает до двух CPU AMD EPYC 9965 (Turin), до 6 Тбайт DDR5 ECC, 1 Пбайт NVMe SSD, 400GbE-адаптер, встроенный 23,8″ 4K-дисплей и откидную клавиатуру. Шасси снабжено рукоятками для переноски. Фактически речь идёт об устройстве размером с чемодан, хотя Omnia не позиционируется как портативный ПК или даже мобильная рабочая станция. «Чемоданный» ЦОД предлагается в нескольких конфигурациях, включая AI, Creator, Search и X. Использовать их можно для критически важных периферийных вычислений, военных миссий, симуляций корпоративного уровня, работы с киноматериалами буквально в любой локации. Кроме того, Omnia могут использоваться как модули для создания более масштабных структур, объединённых в кластеры Infinity Racks.

Источник изображения: Odinn Конечно, всё это обойдётся недёшево — один NVIDIA H200 стоит около $32 тыс. Можно предположить, что немногие компании позволят сотрудникам разгуливать с такими дорогими «чемоданами», которые довольно легко похитить. Впрочем, Odinn пока ничего не сообщает о цене устройств. Внешне, со встроенным дисплеем и откидной клавиатурой, Omnia отчасти напоминает портативные ПК далёкого прошлого. Если же встроенные дисплей и клавиатура не нужны, то есть решения попроще и в буквально смысле полегче. Так, 25-кг модульная платформа GigaIO Gryf объединяет в одном шасси-чемодане до пяти узлов различной конфигурации (плюс один обязательный модуль питания), в том числе с H200 NVL. Gryf тоже можно объединять в мини-кластеры.

07.01.2026 [12:23], Руслан Авдеев

xAI привлекла $20 млрд в раунде финансирования, возглавленном NVIDIA и CiscoИИ-стартап xAI, основанный и поддерживаемой Илоном Маском (Elon Musk), объявил о том, что привлёк $20 млрд в ходе раунда позднего финансирования. В раунде серии E приняли участие NVIDIA и Cisco, сообщает Silicon Angle. К ним присоединились Valor Equity Partners, Stepstone Group, Fidelity Management & Research, Qatar Investment Authority, MGX, Baron Capital Group и другие инвестиционные структуры. В ноябре сообщалось, что следующий раунд финансирования позволит оценить компанию в $230 млрд. Компания намерена использовать капитал для расширения своей ИИ-инфраструктуры. Она обучает флагманские ИИ-модели серии Grok с использованием суперкомпьютеров Colossus. Недавно Маск анонсировал, что компания приобрела новый дата-центр для увеличения вычислительной мощности. По слухам, ЦОД находится недалеко от электростанции, которую xAI строит, чтобы удовлетворить растущие потребности Colossus в энергии. По данным Маска, запланированные доработки Colossus увеличат энергопотребление до 2 ГВт. Маск уже похвалил недавно представленные ускорители NVIDIA Rubin. Судя по новостям об участии NVIDIA в финансировании xAI, высока вероятность, что новые чипы будут активно применяться для расширения проекта Colossus. Помимо строительства новой инфраструктуры, xAI будет использовать собранные средства для запуска новых продуктов. Компания объявила, что речь идёт о разработках как для пользовательского, так и для корпоративного рынков. В декабре 2025 года xAI представила корпоративную версию Grok, предусматривающую интеграцию Google Drive. Сотрудники компаний могут использовать чат-бот для поиска материалов, хранящихся в облачном хранилище. Тариф Grok Enterprise также предусматривает доступ к инструментам по обеспечению кибербезопасности. Использующие его организации могут задавать настройки доступа и использовать собственные ключи шифрования для защиты бизнес-данных. В ближайшие месяцы xAI намерена обеспечить интеграцию со сторонними сервисами помимо Google Drive. Компания также добавит и новые функции, включая возможность создания кастомных ИИ-агентов. Обновления должны выйти одновременно с премьерой флагманской ИИ-модели Grok 5. Компания сообщила, что её обучение уже началось. Последний раунд финансирования состоялся всего через неделю после того, как OpenAI, по слухам, получила $22,5 млрд от ключевого инвестора SoftBank Group. Средства поступили в рамках раунда финансирования на $40 млрд, объявленного ещё в марте 2025 года. Как и xAI, компания OpenAI активно строит инфраструктуру ИИ ЦОД для поддержки обучения ИИ-моделей нового поколения.

07.01.2026 [07:01], Владимир Мироненко

Lenovo показала концепт ИИ-хаба Lenovo Personal AI Hub Concept для обработки ИИ-приложений в экосистеме устройств пользователяLenovo продемонстрировала на выставке CES 2026 концепт ИИ-хаба Lenovo Personal AI Hub Concept, получивший кодовое название Project Kubit. Как сообщает компания, персональный ИИ-хаб — периферийное облачное устройство для поддержки ИИ-приложений в экосистеме потребителя, включающей ПК, смартфоны, носимые устройства и решения для умного дома. В частности, Lenovo Personal AI Hub собирает данные с различных платформ, предоставляя пользователю доступ к новым уровням аналитики и ИИ-приложениям, обеспечивая высокопроизводительные персональные вычисления с использованием ИИ.

Источник изображения: Lenovo Lenovo Personal AI Hub Concept представляет собой систему из двух рабочих станций Lenovo ThinkStation PGX, соединённых с помощью адаптера NVIDIA ConnectX-7. Lenovo ThinkStation PGX использует для вычислений суперчип NVIDIA GB10, включающий ускоритель с архитектурой Blackwell и 20-ядерный Arm-процессор. Объём унифицированной оперативной памяти LPDDR5X-9400 составляет 128 Гбайт, ёмкость накопителя NVMe M.2 составляет до 4 Тбайт. Станция обеспечивает производительность 1 PFLOPS в вычислениях FP4. Система из двух станций поддерживает работу с ИИ-моделями размером до 405 млрд параметров. ИИ-хаб Lenovo Personal AI Hub поддерживает управление как с помощью касаний сенсорного экрана, так и с использованием голосовых команд.

06.01.2026 [14:28], Владимир Мироненко

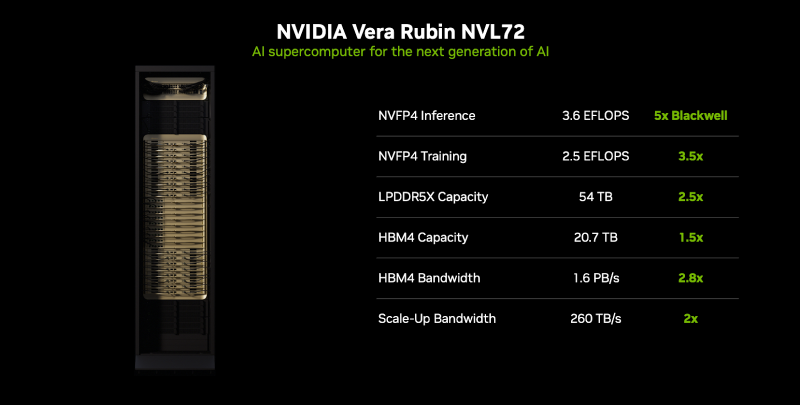

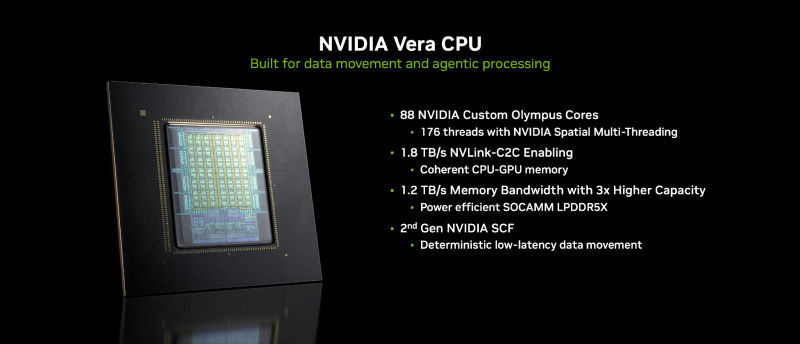

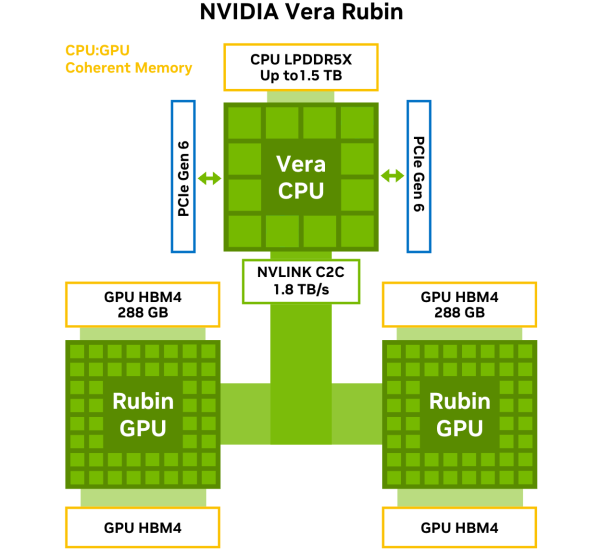

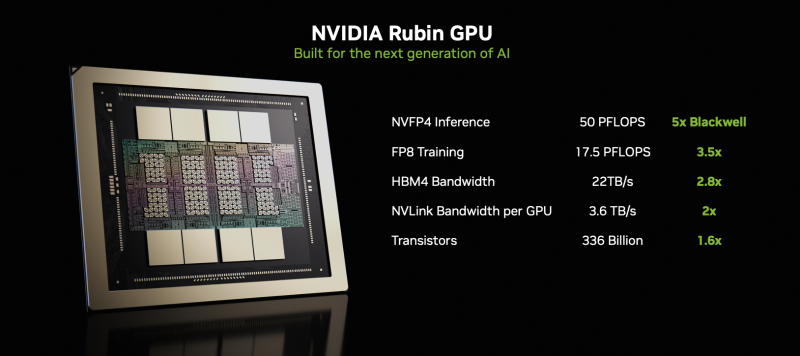

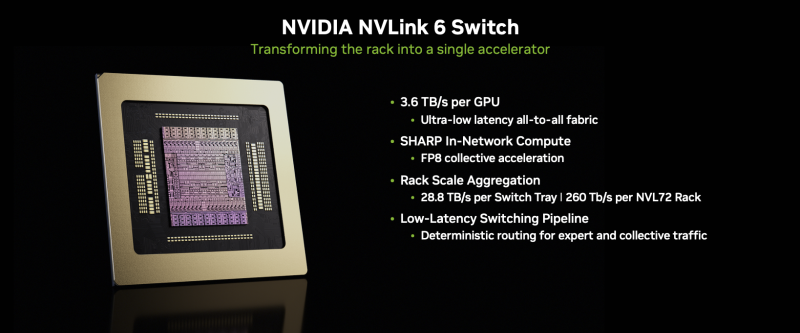

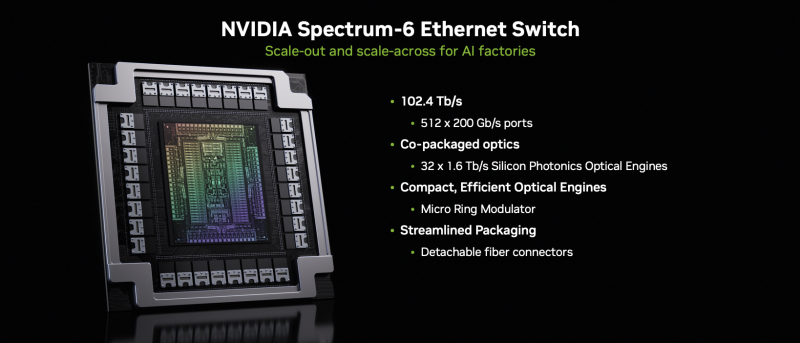

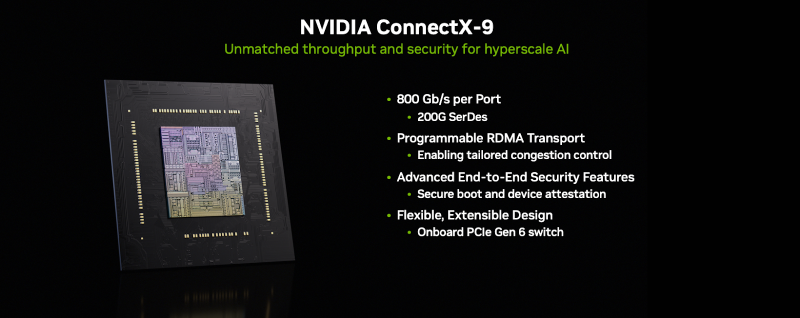

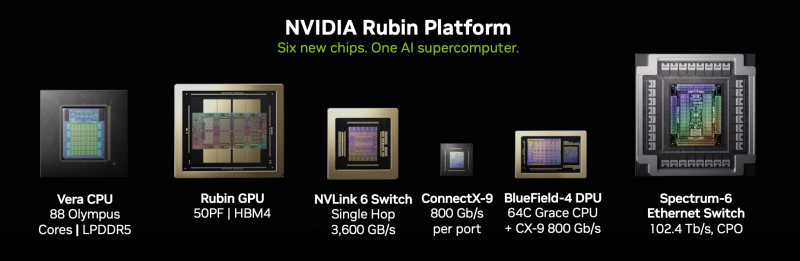

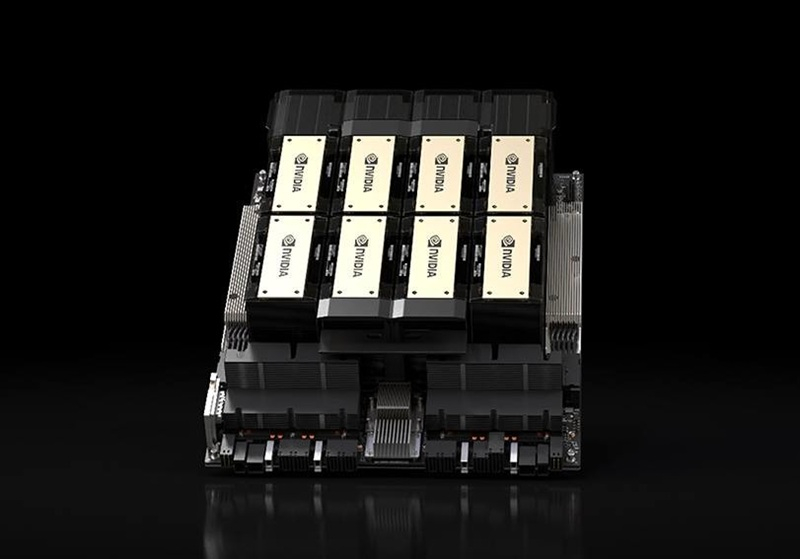

NVIDIA объявила о запуске платформы Vera Rubin NVL72NVIDIA объявила о запуске платформы следующего поколения Rubin, которая приходит на смену Blackwell Ultra. Компания отметила, что платформа Rubin объединяет сразу пять инноваций, включая новейшие поколения интерконнекта NVIDIA NVLink, Transformer Engine, Confidential Computing и RAS Engine, а также процессор NVIDIA Vera. Примечательно, что NVIDIA снова решила вернуться к именованию на основе количества суперчипов (NVL72), а не ускорителей (NVL144), как обещала в прошлом году. Созданная с использованием экстремального совместного проектирования на аппаратном и программном уровнях, NVIDIA Vera Rubin обеспечивает десятикратное снижение стоимости токенов для инференса и четырёхкратное сокращение количества ускорителей для обучения моделей MoE по сравнению с платформой NVIDIA Blackwell. Коммутационные системы NVIDIA Spectrum-X Ethernet Photonics обеспечивают пятикратное повышение энергоэффективности и времени безотказной работы. Платформа Rubin построена на шести чипах — Arm-процессоре Vera, ускорителе Rubin, коммутаторе NVLink 6, адаптере ConnectX-9 SuperNIC, DPU BlueField-4 и Ethernet-коммутаторе NVIDIA Spectrum-6. Ускорители Rubin поначалу будут доступны в двух форматах. В первом случае — в составе стоечной платформы DGX Vera Rubin NVL72, которая объединяет 72 ускорителя Rubin и 36 процессоров Vera, NVLink 6, ConnectX-9 SuperNIC и BlueField-4. Также ускорители Rubin будут доступны в составе платформы DGX/HGX Rubin NVL8 на базе x86-процессоров. Обе платформы будут поддерживаться кластерами NVIDIA DGX SuperPod, сообщил ресурс CRN. Как отметила NVIDIA, разработанный для агентного мышления, процессор NVIDIA Vera является самым энергоэффективным процессором для крупномасштабных ИИ-фабрик. Он оснащён 88 кастомными Armv9.2-ядрами Olympus с 176 потоками с новой технологией пространственной многопоточности NVIDIA, 1,5 Тбайт системной памяти SOCAMM LPDDR5x (1,2 Тбайт/с), возможностями конфиденциальных вычислений и быстрым интерконнектом NVLink-C2C (1,8 Тбайт/с в дуплексе). NVIDIA Rubin с аппаратным адаптивным сжатием данных обеспечивает до 50 Пфлопс (NVFP4) для инференса, что в пять раз быстрее, чем Blackwell. Он также обеспечивает до 35 Пфлопс (NVFP4) в режиме, что в 3,5 раза быстрее, чем его предшественник. Пропускная способность 288 Гбайт HBM4 составляет 22 Тбайт/с, что в 2,8 раза быстрее предшественника, а пропускная способность NVLink на один ускоритель вдвое выше — 3,6 Тбайт/с (в дуплексе). NVIDIA также сообщила, что Vera Rubin NVL72 обладает 54 Тбайт памяти LPDDR5x, что в 2,5 раза больше, чем у Blackwell, и 20,7 Тбайт памяти HBM4, что на 50 % больше, чем у предшественника. Агрегированная пропускная способность HBM4 достигает 1,6 Пбайт/с, что в 2,8 раза больше, а скорость интерконнекта составляет 260 Тбайт/с, что вдвое больше, чем у платформы Blackwell NVL72, и «больше, чем пропускная способность всего интернета». Ожидаемый уровень энергопотребления составит от 190 до 230 кВт на стойку. Компания отметила, что Vera Rubin NVL72 — первая стоечная платформа, обеспечивающая конфиденциальные вычисления, которая поддерживает безопасность данных на уровне доменов CPU, GPU и NVLink. Коммутатор NVLink 6 с жидкостным охлаждением оснащён 400G-блоками SerDes, обеспечивает пропускную способность 3,6 Тбайт/с на каждый GPU для связи между всеми GPU, общую пропускную способность 28,8 Тбайт/с и 14,4 Тфлопс внутрисетевых вычислений в формате FP8. Хотя NVIDIA заявила, что Rubin находится в «полномасштабном производстве», аналогичные продукты от партнёров появятся только во II половине этого года. Среди ведущих мировых ИИ-лабораторий, поставщиков облачных услуг, производителей компьютеров и стартапов, которые, как ожидается, внедрят Rubin, компания назвала Amazon Web Services (AWS), Anthropic, Black Forest Labs, Cisco, Cohere, CoreWeave, Cursor, Dell Technologies, Google, Harvey, HPE, Lambda, Lenovo, Meta✴, Microsoft, Mistral AI, Nebius, Nscale, OpenAI, OpenEvidence, Oracle Cloud Infrastructure (OCI), Perplexity, Runway, Supermicro, Thinking Machines Lab и xAI. ИИ-лаборатории, включая Anthropic, Black Forest, Cohere, Cursor, Harvey, Meta✴, Mistral AI, OpenAI, OpenEvidence, Perplexity, Runway, Thinking Machines Lab и xAI, рассматривают платформу NVIDIA Rubin для обучения более крупных и мощных моделей, а также для обслуживания мультимодальных систем с длинным контекстом с меньшей задержкой и стоимостью по сравнению предыдущими поколениями ускорителей. Партнёры по инфраструктурному ПО и хранению данных AIC, Canonical, Cloudian, DDN, Dell, HPE, Hitachi Vantara, IBM, NetApp, Nutanix, Pure Storage, Supermicro, SUSE, VAST Data и WEKA работают с NVIDIA над разработкой платформ следующего поколения для инфраструктуры Rubin. В связи с тем, что рабочие нагрузки агентного ИИ генерируют огромные объёмы контекстных данных, NVIDIA также представляла новую платформу хранения контекста инференса NVIDIA Inference Context Memory Storage Platform — новый класс инфраструктуры хранения, разработанной для масштабирования контекста инференса. Сообщается, что платформа, работающая на базе BlueField-4, обеспечивает эффективное совместное использование и повторное применение данных KV-кеша в рамках всей ИИ-инфраструктуры, повышая скорость отклика и пропускную способность, а также обеспечивая предсказуемое и энергоэффективное масштабирование агентного ИИ. Дион Харрис (Dion Harris), старший директор NVIDIA по высокопроизводительным вычислениям и решениям для ИИ-инфраструктуры, сообщил, что по сравнению с традиционными сетевыми хранилищами для данных контекста инференса, новая платформа обеспечивает до пяти раз больше токенов в секунду, в пять раз лучшую производительность на доллар и в пять раз лучшую энергоэффективность. |

|