Материалы по тегу: ии

|

25.03.2025 [16:45], Руслан Авдеев

В России началась разработка проекта плавучих дата-центровВ России ведутся работы по проектированию плавучих дата-центров. Предполагается, что такие ЦОД можно развернуть значительно быстрее наземных вариантов, при этом они будут на 20–30 % дешевле в строительстве, сообщают «Известия» со ссылкой на пресс-службу Национальной технологической инициативы (НТИ). Описание проекта имеется на портале «Университета 20.35», связанного с НТИ, и некоторых других ресурсах. Работы ведутся не первый год. По словам авторов проекта, наземные ЦОД нередко сталкиваются с проблемами ещё на этапе строительства, в результате чего проекты могут свернуть из-за нехватки или высокой стоимости земли, удалённости площадки от доступной инфраструктуры, высоких тарифов на электричество, больших затрат на охлаждение и др. Особенными зонами риска для России считаются Арктическая зона, Сибирь и Дальний Восток. Кроме того, по словам экспертов, традиционный дата-центр может быть разрушен или повреждён из-за природных или техногенных катаклизмов. Фактически речь идёт об использовании несамоходных барж или самоходных судов с установленной инфраструктурой ЦОД. Их преимуществом является возможность быстро сменить локацию, чтобы быть ближе к источникам данных, и даже юрисдикцию, в том числе на время. Управление флотом плавучих дата-центров может осуществляться с помощью единой платформы оркестрации. Плавучий ЦОД можно быстро переместить к месту назначения водными путями, а для охлаждения оборудования использовать забортную воду. Энергия может поступать как от наземных электростанций, так и от автономных — например, от расположенных на самих судах мини-АЭС. По последним данным, авторы проекта приступили к эскизному проектированию плавучих ЦОД и подбору необходимых для реализации проекта технологий. Потенциальные заказчики — государственные корпорации, министерства и другие структуры, а также крупные бизнес-пользователи и даже иностранные государства, у которых имеются пригодные для развёртывания плавучих ЦОД водные ресурсы и ограничения по строительству наземной инфраструктуры — вроде Сингапура, где аналогичным проектом занимается Keppel Data Centres. Авторы проекта считают, что плавучие ЦОД могли бы быть интегрированы в инфраструктуру Севморпути или даже стать майнинговыми фермами в местах, где стоимость энергии невелика, а электростанции недостаточно загружены. Также ЦОД могут стать базами для хранения и обработки информации при совместном использовании парка беспилотников и безэкипажных судов. Результатом строительства может стать укрепление технологического суверенитета России, в том числе в сфере хранения и обработки критически важных для страны данных. Стоит отметить, что плавучие дата-центры уже довольно активно развиваются по всему миру. Так, ещё в октябре 2024 года французский стартап Denv-R запустил плавучий 200-кВт дата-центр на Луаре, а в ноябре того же года сообщалось, что Nautilus намерена продать уникальный плавучий ЦОД в Калифорнии. А Del Complex придумала, как обойти санкции и ограничения для ИИ в отдельных регионах — предполагается строительство модульных плавучих структур, имеющих почти государственный уровень суверенитета.

25.03.2025 [15:55], Татьяна Золотова

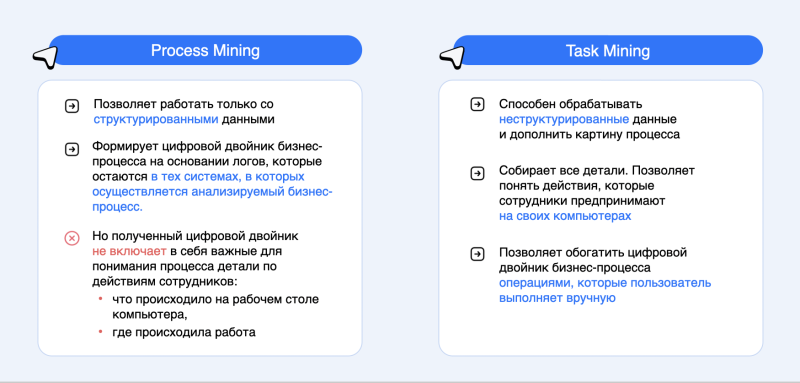

VK Task Mining расширил возможности платформы VK Process MiningVK Tech анонсировала продукт VK Task Mining — решения для анализа и оптимизации рабочих процессов внутри компании, которые помогут автоматизировать бизнес-процессы, сократив их время и стоимость. Новый инструмент является частью платформы процессной аналитики VK Process Mining, которая анализирует данные из корпоративных систем. Об этом сообщила пресс-служба компании. VK Task Mining собирает данные о рутинных действиях пользователей, анализирует информацию, объединяет ее с бизнес-данными и строит цифровую модель рабочего дня. На основе этой информации можно применить технологию RPA (Robotic Process Automation) или избежать ненужных действий. Это позволяет компаниям оценивать стоимость операций, управлять загрузкой персонала и минимизировать операционные риски. Система также маскирует или исключает конфиденциальные данные из мониторинга, а встроенные BI-дашборды обеспечивают глубокую аналитику рабочих процессов. По итогам сбора и обработки логов формируется интерактивная отчетность. Встроенное браузерное расширение позволяет извлекать дополнительный бизнес-контекст из веб-страниц. VK Task Mining состоит в реестре российского ПО. В 2025 году будет введена поддержка Linux и Mac OS. VK Process Mining — платформа процессной аналитики для управления процессами и показателями бизнеса в режиме реального времени. Как поясняют в компании, с ее помощью можно визуализировать реальные процессы и сравнить их с регламентами, выявить узкие места, предотвратить связанные с ними риски, а также определить потенциал для автоматизации.

25.03.2025 [12:52], Сергей Карасёв

«Скала^р» представила Машину для искусственного интеллекта — отечественный аналог NVIDIA DGX SuperPODКомпания «Скала^р» анонсировала специализированный программно-аппаратный комплекс (ПАК) для работы с ИИ-моделями — Машину Скала^р МБД.ИИ. Эта система, как утверждается, представляет собой функциональный аналог платформ NVIDIA DGX SuperPOD и Huawei Atlas 900 PoD. Полностью технические характеристики новинки пока не раскрываются. Известно, что Машина Скала^р МБД.ИИ использует интерконнект NVLink с возможностью объединения двух, четырёх или восьми ускорителей. Задействованы технологии GPUDirect и NVMe-oF для обработки и передачи данных, а также система прямого доступа к ресурсам RDMA. Заявлена поддержка всех популярных фреймворков для машинного обучения: TensorFlow, PyTorch, Keras и др. Вычислительный комплекс будет предлагаться в конфигурациях с ускорителями NVIDIA и в вариантах с альтернативными ИИ-картами, в том числе на основе неназванных тензорных процессоров. Кроме того, в разработке находятся решения с поддержкой отечественных ускорителей. Возможно развёртывание системы как в дата-центре заказчика, так и в составе частных и гетерогенных облачных систем. Машина может интегрироваться с другими ПАК семейства Скала^р, предназначенными для работы с большими данными. Для нового комплекса подтверждена совместимость с различными платформами машинного обучения и моделями ИИ, в том числе MTS AI Cotype Pro, T1 Сайбокс, Red_Mad_Robot Neuraldeep.tech, WaveAccess ValueAI, DeepSeek и LLaMA. По заявлениям разработчика, система имеет гибкую унифицированную архитектуру, соответствующую отраслевым стандартам, что позволяет использовать её с YandexGPT, GigaChat и др. Развёртывание приложений ИИ в контейнерной среде обеспечивает эффективное использование аппаратных ресурсов, а реализация интерконнекта с применением топологий Fat-tree, HyperCube, DragonFly или классической архитектуры Leaf-Spine даёт возможность более гибко масштабировать вычислительный кластер. Среди преимуществ Машины Скала^р МБД.ИИ названы:

«Машина Скала^р МБД.ИИ позволяет создать надёжную и производительную инфраструктуру для работы с искусственным интеллектом, используя проверенные технологии и компоненты из реестра Минпромторга и Минцифры РФ с подтверждённой производительностью до 1,5 Пфлопс на вычислительный кластер. Мы видим большой потенциал применения комплекса в различных отраслях экономики, включая промышленность и финансы, где использование ИИ помогает существенно повысить эффективность бизнес-процессов», — говорит директор по технологическим инновациям Скала^р.

25.03.2025 [08:45], Руслан Авдеев

Бум ИИ превратил азиатские проекты ЦОД в «магнит» для инвесторовРазвитие систем искусственного интеллекта (ИИ) подпитывает ажиотаж, связанный со строительством азиатских дата-центров. В результате на континенте выдана серия рекордных кредитов на создание ЦОД, ещё больше сделок может быть заключено в будущем, сообщает Bloomberg. Только за неделю два крупных азиатских оператора ЦОД получили самые значимые в своей истории кредиты, частично предназначенные для расширения проектов в Малайзии, намеренной стать новым региональным хабом для дата-центров. Сам факт таких крупных сделок свидетельствует о росте привлекательности отрасли для инвесторов, бум ИИ стимулирует их интерес. Также сделки стали своеобразным маркером того, что Азия становится одним из ключевых рынков ЦОД. Как прогнозирует Cushman and Wakefield, спрос будет расти на 32 % ежегодно до 2028 года. Это выше, чем предполагаемый рост в США (CAGR 18 %), хотя в начале 2024 года прогнозы были более скромными. По данным юридической компании Morrison Foerster, рост спроса на ЦОД вызвал интерес у пула инвесторов по всему Азиатско-Тихоокеанскому региону (АТР). Если раньше инвесторами выступали в основном банки, то теперь появились частные кредитные и инфраструктурные фонды. Среди недавних инициатив — проект компании Bridge Data Centres, принадлежащей Bain Capital. Она получила в кредит $2,8 млрд для развития в Малайзии, а DayOne (ранее GDS International) привлекла заём, эквивалентный $3,4 млрд. Готовятся и новые сделки. Сингапурское подразделение австралийской Firmus Technologies желает получить кредит на $120 млн, а индийская Yotta Data Services договаривается с частными фондами о привлечении около $500 млн для своих парков ЦОД. Боле того, чем сильнее напряжённость между США и КНР, тем активнее транснациональные компании готовы вкладывать средства в ЦОД за пределами Китая. Одним из ключевых бенефициаров наметившейся тенденции стал малайзийский штат Джохор (Johor), граничащий с Сингапуром, где около 30 проектов дата-центров завершены или находятся на стадии строительства, а ещё 20 ожидают одобрения регуляторов. Таиланд одобрил инвестиционные заявки на $5,9 млрд буквально на прошлой неделе, в том числе на проекты в секторе, связанном с ЦОД. Тем не менее, в отрасли царит неопределённость, поскольку США готовят новые пошлины, риск глобальной торговой войны не так уж мал. В числе возможных целей — страны, поставляющие продукцию для индустрии дата-центров (в основном в Азии). Также не исключено нарушение цепочек поставок, в том числе полупроводников. В Morrison Foerster допускают, что геополитические риски могут привести к росту кредитных рисков для финансистов, поэтому те могут потребовать большего вознаграждения или, например, отказаться от проектов, связанных с китайскими структурами. Это потенциально затормозит рост на рынке ЦОД в Юго-Восточной Азии.

25.03.2025 [07:38], Руслан Авдеев

5-ГВт дата-центр Data City в Техасе намерен стать «местом рождения AGI»На участке более 20 тыс. га корпорация Energy Abundance Development Corporation намерена построить кампус ЦОД ёмкостью 5 ГВт, использующий собственные источники энергии. Проект Data City намерены реализовать недалеко от города Ларедо (Laredo) на юго-западе Техаса вблизи от мексиканской границы, сообщает пресс-служба компании. Первые 300 МВт и более 92 тыс. м2 намерены ввести в эксплуатацию в 2026 году. Предполагается, что объект будет работать на «чистой» энергии. Фактически электричество будет поставляться с соседней площадки Hydrogen City, проект которой тоже реализуется Energy Abundance. Первую фазу «водородного города» намерены запустить до 2028 года. Также будут задействованы ветряные и солнечные генераторах, а также природный газ — фактически речь всё же идёт о применении ископаемого топлива, сообщает Datacenter Dynamics. Впрочем, в пресс-релизе компании говорится о постепенном переходе на питание на 100 % за счёт энергии водорода. Компания не сообщала, когда именно она намерена довести мощность ЦОД до 5 ГВт.

Источник изображения: Energy Abundance В Energy Abundance заявляют, что Data City — проект мирового класса, который поможет Америке выиграть «гонку ИИ», одновременно продемонстрировав, как добиться круглосуточных поставок «зелёной» энергии с помощью водорода и хранилищ в соляных пещерах. В компании считают, что именно Data City станет местом рождения AGI — «общего искусственного интеллекта», равного человеческому или превосходящему его. Energy Abundance ранее была известна как Green Hydrogen International. По словам её представителей, управленцы компании имеют большой опыт в развитии крупномасштабных инициатив в глобальной энергетике, а также проектировании генерирующих мощностей «на местах» — она подготовила и построила энергетические проекты по всему миру общей мощностью более 3 ГВт. Энергия водорода уже активно используется компаниями вроде Equinix . Более того, ECL намерена построить гигантский «зелёный» ЦОД TerraSite-TX1 ёмкостью до 2 ГВт (в перспективе), а Microsoft проводит эксперименты по питанию дублинского ЦОД от водородных топливных ячеек GeoPura. Наконец, Modern Hydrogen и Mesa Solutions объединились для выработки водорода из природного газа непосредственно на территории кампуса ЦОД.

24.03.2025 [23:55], Владимир Мироненко

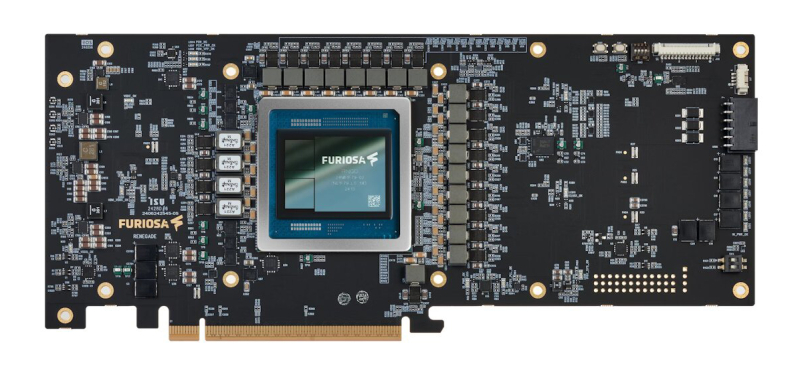

Разработчик ИИ-ускорителей FuriosaAI отказался «влиться» в Meta✴ за $800 млнСтартап FuriosaAI из Южной Кореи, представивший в прошлом году ИИ-ускоритель RNGD для работы с большими языковыми моделями (LLM) и мультимодальным ИИ, отклонил предложение о поглощении со стороны Meta✴ Platforms, которая была готова заплатить за это $800 млн. FuriosaAI намерена и дальше развивать бизнес в качестве независимой компании. Об этом сообщил Bloomberg со ссылкой на информированный источник. По словам собеседника Bloomberg, Meta✴ вела переговоры о приобретении FuriosaAI из Сеула с начала этого года. После того как в феврале появились слухи о возможном поглощении стартапа, начали расти в цене акции его крупнейшего инвестора, южнокорейской венчурной компании DSC Investment, но после известий об отказе их стоимость упала в понедельник на 16 %. Ускоритель RNGD, выполненный по 5-нм техпроцессу компании TSMC и использующий чипы памяти HBM3, поставляемые SK Hynix, способен конкурировать чипами NVIDIA, а также других ИИ-стартапов, включая Groq, SambaNova и Cerebras. Персонал FuriosaAI составляет около 150 сотрудников, включая 15 человек, работающих в офисе в Кремниевой долине. В конце прошлого года стартап начал тестирование RNGD и рассылку образцов чипов клиентам, включая LG AI Research (ИИ-подразделение LG Group) и Saudi Aramco. Сообщается, что более десяти потенциальных клиентов будут тестировать образцы RNGD в I половине этого года. По словам источников, FuriosaAI планирует привлечь дополнительный капитал и лишь потом провести первичное публичное размещение акций (IPO). Ожидается, что примерно через месяц компания завершит расширенный раунд финансирования серии C, который позволит получить намеченную сумму. До этого основанная в 2017 году FuriosaAI привлекла за четыре раунда финансирования $115 млн, пишет Data Center Dynamics. В свою очередь, Meta✴ вкладывает значительные средства в ИИ-инфраструктуру, стремясь опередить конкурентов, включая OpenAI и Google. В январе 2025 года гендиректор Meta✴ Марк Цукерберг (Mark Zuckerberg) заявил, что компания выделит до $65 млрд на развитие ИИ в 2025 году, включая расходы на строительство крупного ЦОД и найм персонала в сфере ИИ. А всего неделю спустя Цукерберг сообщил инвесторам, что Meta✴ планирует потратить сотни миллиардов долларов на инфраструктуру ИИ. Meta✴ также работает над созданием собственных чипов. В 2023 году она представила чип Meta✴ Training and Inference Accelerator (MTIA) для ИИ-нагрузок, а в 2024 году был анонсирован ИИ-ускоритель MTIA второго поколения, втрое превосходящий предшественника по производительности. Сейчас компания ведёт тестирование собственного ускорителя для обучения ИИ-моделей.

24.03.2025 [20:02], Владимир Мироненко

ИИ в один клик: NVIDIA и Equinix предложат готовые к использованию кластеры DGX GB300 и DGX B300 в 45 регионах по всему мируЧтобы удовлетворить растущий спрос на ИИ-инфраструктуру, NVIDIA представила NVIDIA Instant AI Factory — управляемый сервис на базе платформ NVIDIA DGX SuperPOD с ускорителями Blackwell Ultra и ПО NVIDIA Mission Control. NVIDIA сообщила, что её партнёр Equinix станет первой компанией, которая предложит новые системы DGX GB300 и DGX B300 в своих предварительно сконфигурированных ЦОД с жидкостным или воздушным охлаждением, готовых к обработке ИИ-нагрузок и расположенных на 45 рынках по всему миру. Как пишет SiliconANGLE, Тони Пейкдей (Tony Paikeday), старший директор NVIDIA по маркетингу продуктов и систем ИИ, заявил, что партнёрство с Equinix позволит компании выйти на более чем 45 рынков по всему миру «с предварительно настроенными объектами, которые готовы в зависимости от спроса клиентов масштабировать, эксплуатировать и управлять ИИ-инфраструктурой». NVIDIA отметила, что сервис предоставит предприятиям полностью готовые ИИ-фабрики, оптимизированные для обучения современных моделей и рабочих нагрузок моделей рассуждений в реальном времени, что избавит от многомесячного планирования инфраструктуры перед развёртыванием. Поскольку Equinix предоставляет средства и инфраструктуру для разработки ИИ, Пейкдей возлагает большие надежды на платформу SuperPOD и считает, что она окажет позитивное влияние на развёртывание ИИ компаниями. «Equinix — ключевой компонент этой платформы, потому что вам нужно жидкостное охлаждение, вам нужны ЦОД следующего поколения, вам нужны сверхскоростные соединения с внешним миром, чтобы передавать эти данные», — заявил он.

24.03.2025 [19:10], Руслан Авдеев

«Аквариус» открыла в Твери роботизированную линию сборки серверовНа базе промышленной площадки ГК «Аквариус» в Твери заработала линия выпуска пластиковых комплектующих и сборки серверов. Всего в производственные процессы группа компаний вложила в 2024 году 1,8 млрд руб., сообщает её пресс-служба. Ключевым компонентом цеха является линия сборки серверного оборудования на основе лифтового механизма, распределяющего устройства между параллельными участками тестирования. Такой вариант сокращает время сборки и позволяет качественно контролировать каждое выпускаемое изделие. Ежедневно можно будет выпускать до 1 тыс. серверов, т.е. в 2,5 раза больше того, на что способно предприятие сегодня. Дополнительно в новом цехе будут выпускать с помощью литья под давлением пластиковые детали — благодаря этому корпуса клиентских устройств и электронной периферии можно будет производить непосредственно в Тверской области. Это, в частности, сократит зависимость производителя от внешних поставок.

Источник изображения: ГК «Аквариус» По словам представителя «Аквариуса», инновационная лифтовая система в сборочной линии — уникальное для России производственное решение, позволяющее тестировать втрое больше готовых устройств, чем при стандартном подходе. Более того, её внедрение знаменует новый шаг в рамках долгосрочного сотрудничества с Тверской областью — вместе создаётся и развивается локальное высокотехнологичное производство, конкурентоспособное в международном масштабе. По словам представителей власти, сходящая с конвейеров в Твери продукция конкурентоспособна как функционально, так и по цене. Другими словами, кроме вклада в обеспечение технологического суверенитета России обеспечивается и добавленная стоимость, которая останется в стране, с неё заплатят налоги, она будет способствовать расширению экономики. Кроме того, речь идёт о дополнительном развитии промышленности и новом уровне кадров на производстве — выпускники местных учебных заведений работают на ГК «Аквариус».

24.03.2025 [13:14], Сергей Карасёв

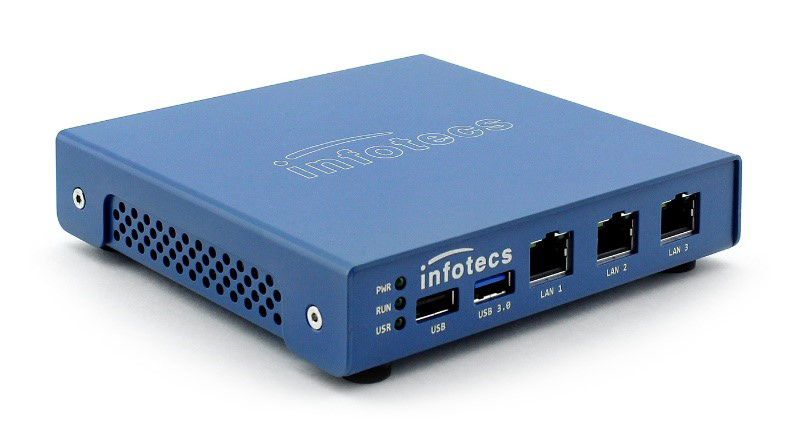

«ИнфоТеКС» выпустила шлюз безопасности ViPNet Coordinator HW50 в формате мини-компьютера«ИнфоТеКС» представила компактный шлюз безопасности ViPNet Coordinator HW50, выполненный на аппаратной платформе компании «АТБ-Электроника». Новинка предназначена для использования в небольших офисах и филиалах организаций. Шлюз построен на основе мини-компьютера «АТБ-Электроника» АТБ-АТОМ-1.3. Устройство оборудовано процессором Intel Atom E3845 поколения Bay Trail (4C/4T; 1,91 ГГц; 10 Вт), максимум 8 Гбайт оперативной памяти DDR3L-1067 (non-ECC), а также SSD формата М.2 2242 вместимостью до 256 Гбайт. Решение обеспечивает производительность в режиме шифрования (VPN) до 250 Мбит/с, в режиме межсетевого экрана — до 700 Мбит/с. Количество обслуживаемых соединений достигает 150 тыс. Устройство ViPNet Coordinator HW50 (платформа HW50 A1) располагает тремя сетевыми интерфейсами 1GbE (RJ45), портами USB 2.0 и USB 3.0, выходом HDMI и консольным портом (RJ45) для локального подключения к шлюзу. Беспроводные интерфейсы не предусмотрены. Габариты составляют 136 × 28 × 130 мм, масса — 0,4 кг. Питание подаётся через внешний адаптер. Диапазон рабочих температур простирается от 0 до +50 °C. Среднее время наработки на отказ (MTBF) — 40 тыс. часов.

Источник изображения: «ИнфоТеКС» Изделия АТБ-АТОМ-1.3 включено в Единый реестр российской радиоэлектронной продукции (ПП РФ 878). ViPNet Coordinator HW50 A1 сертифицирован во ФСТЭК России по требованиям к межсетевым экранам типа А, типа Б четвёртого класса и четвёртого уровня доверия. Завершаются работы по сертификации платформы по требованиям ФСБ России к СКЗИ класса КС3. «ИнфоТеКС» планирует добавить платформу HW50 A1 в новое поколение криптошлюзов ViPNet Coordinator HW 5, реализующих концепцию NGFW (межсетевой экран нового поколения). Кроме того, аппаратные платформы «АТБ-Электроники» рассматриваются для развития модельного ряда индустриальных шлюзов безопасности.

24.03.2025 [11:59], Руслан Авдеев

OpenAI и Meta✴ ведут переговоры с индийской Reliance Jio о сотрудничестве в сфере ИИMeta✴ и OpenAI по отдельности ведут переговоры с индийской Reliance Industries о потенциальном сотрудничестве для расширения ИИ-сервисов, сообщает The Information. Так, OpenAI хотела бы при помощи Reliance Jio расширить использование ChatGPT в Индии — об этом изданию сообщили два независимых источника, знакомых с вопросом. Более того, OpenAI обсуждала с сотрудниками сокращение стоимости подписок на платный вариант ChatGPT с $20/мес. до всего нескольких долларов. Пока неизвестно, велись ли разговоры об этом в ходе переговоров с Reliance. С последней, как утверждается, обсуждали продажу ИИ-моделей OpenAI корпоративным клиентам (через API). Также индийская компания заинтересована в локальном хостинге моделей OpenAI, чтобы данные местных клиентов будут храниться в пределах Индии. По имеющимся данным, с OpenAI и Meta✴ велись переговоры о запуске ИИ-моделей компаний в 3-ГВт ЦОД, который Reliance пока только планирует построить. Утверждается, что это будет «крупнейший дата-центр в мире» — его возведут в Джамнагаре (штат Гуджарат). Стоит отметить, что Reliance Industries является одним из крупнейших конгломератов Индии, имеющих интересы как в нефтегазовой отрасли, так и в IT и смежных отраслях, а также в сфере «зелёной» энергетики.

Источник изображения: Shivam Mistry/unsplash.com Индия в целом считается очень перспективной страной для развития инвестиций в ИИ. Например, в конце прошлого года глава NVIDIA Дженсен Хуанг (Jensen Huang) заявил, что страна должна стать одним из лидеров в области ИИ и создать собственную инфраструктуру. Тогда сообщалось, что Индия на государственном уровне обсуждает с NVIDIA совместную разработку чипов для ИИ-проектов, адаптированных к местным задачам. Также страна осваивает связанные с ИИ технологии — например, она затратит $1,2 млрд на суверенный ИИ-суперкомпьютер с 10 тыс. ускорителей и собственные LLM, а также готова покупать много ускорителей, включая ослабленные варианты, которые не достались Китаю после ужесточения американских санкций. И это далеко не все проекты, находящиеся сейчас на стадии разработки и реализации. |

|