Материалы по тегу: x

|

29.03.2025 [10:57], Владимир Мироненко

SK hynix распродала почти всю память HBM, которую выпустит в 2026 годуНа этой неделе состоялось ежегодное собрание акционеров компании SK hynix, на котором Квак Но-чжун (Kwak Noh-jung) заявил, что переговоры компании с клиентами о продажах памяти HBM в 2026 году близки к завершению. Как пишет The Register, заявление гендиректора было воспринято как знак того, что, как и в прошлом году, SK hynix распродаст весь объём выпуска HBM на год вперёд. На мероприятии было объявлено, что в последние недели наблюдается всплеск заказов на поставки HBM, поскольку компании стремятся заключить контракты до ожидаемого увеличения США пошлин на импортируемые полупроводники. Напомним, что в феврале президент США Дональд Трамп (Donald Trump) заявил о намерении ввести тарифы на импорт полупроводников на уровне 25 % и выше, добавив, что в течение года они могут вырасти до 50 % и даже 100 %.

Источник изображений: SK hynix Квак также сообщил акционерам, что SK hynix ожидает «взрывного» роста продаж HBM. На вопрос о том, представляет ли угрозу планам компании то, что DeepSeek использует для обучения своих ИИ-моделей сравнительно небольшие вычислительные мощности, глава SK hynix заявил, что достижения китайского стартапа станут стимулом для более широкого внедрения ИИ, что повлечёт за собой ещё больший спрос на продукцию SK hynix со стороны большего количества покупателей. Такой ответ стал почти стандартным для руководителей компаний, предоставляющих оборудование для обработки рабочих ИИ-нагрузок, на вопрос о том, формируется ли на ИИ-рынке «ценовой пузырь» и что может произойти, если он лопнет, отметил The Register. На прошлой неделе компания заявила, что отправила клиентам первые образцы 12-слойной памяти HBM4, отметив, что «образцы были доставлены с опережением графика» и что «она намерена завершить подготовку к массовому производству 12-слойной продукции HBM4 во второй половине года».

24.03.2025 [20:02], Владимир Мироненко

ИИ в один клик: NVIDIA и Equinix предложат готовые к использованию кластеры DGX GB300 и DGX B300 в 45 регионах по всему мируЧтобы удовлетворить растущий спрос на ИИ-инфраструктуру, NVIDIA представила NVIDIA Instant AI Factory — управляемый сервис на базе платформ NVIDIA DGX SuperPOD с ускорителями Blackwell Ultra и ПО NVIDIA Mission Control. NVIDIA сообщила, что её партнёр Equinix станет первой компанией, которая предложит новые системы DGX GB300 и DGX B300 в своих предварительно сконфигурированных ЦОД с жидкостным или воздушным охлаждением, готовых к обработке ИИ-нагрузок и расположенных на 45 рынках по всему миру. Как пишет SiliconANGLE, Тони Пейкдей (Tony Paikeday), старший директор NVIDIA по маркетингу продуктов и систем ИИ, заявил, что партнёрство с Equinix позволит компании выйти на более чем 45 рынков по всему миру «с предварительно настроенными объектами, которые готовы в зависимости от спроса клиентов масштабировать, эксплуатировать и управлять ИИ-инфраструктурой». NVIDIA отметила, что сервис предоставит предприятиям полностью готовые ИИ-фабрики, оптимизированные для обучения современных моделей и рабочих нагрузок моделей рассуждений в реальном времени, что избавит от многомесячного планирования инфраструктуры перед развёртыванием. Поскольку Equinix предоставляет средства и инфраструктуру для разработки ИИ, Пейкдей возлагает большие надежды на платформу SuperPOD и считает, что она окажет позитивное влияние на развёртывание ИИ компаниями. «Equinix — ключевой компонент этой платформы, потому что вам нужно жидкостное охлаждение, вам нужны ЦОД следующего поколения, вам нужны сверхскоростные соединения с внешним миром, чтобы передавать эти данные», — заявил он.

21.03.2025 [14:21], Сергей Карасёв

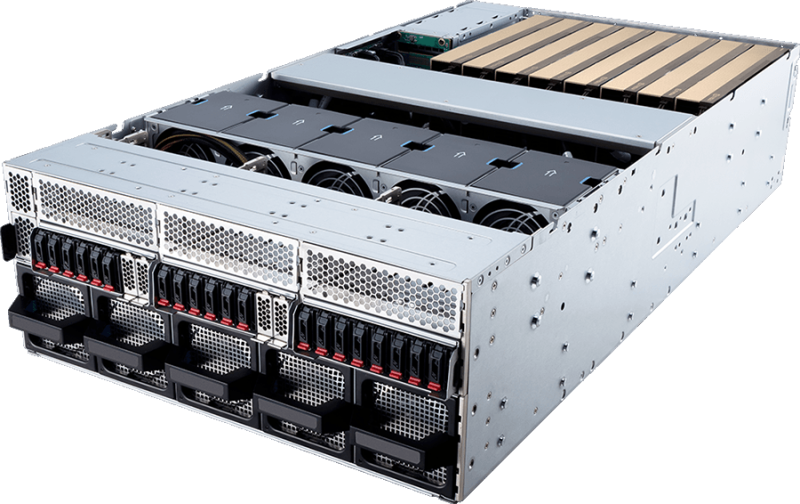

MSI представила серверы на архитектуре NVIDIA MGX с процессорами Intel Xeon 6Компания MSI анонсировала серверы CG480-S5063 и CG290-S3063 для задач ИИ и HPC, а также приложений с интенсивным использованием данных. В основу систем положены процессоры Intel Xeon 6500P и 6700P поколения Granite Rapids и модульная архитектура NVIDIA MGX. Модель CG480-S5063 выполнена в форм-факторе 4U. Возможна установка двух чипов Xeon 6 в исполнении LGA4710 с показателем TDP до 350 Вт. Доступны 32 слота для модулей DDR5-6400/8000 RDIMM/RDIMM-3DS/MRDIMM суммарным объемом до 8 Тбайт. Во фронтальной части расположены 20 отсеков для накопителей E1.S с интерфейсом PCIe 5.0 x4 (NVMe). Кроме того, есть два внутренних слота для SSD в формате М.2 2280/22110 PCIe 5.0 x2 (NVMe). В общей сложности реализованы 13 слотов PCIe 5.0 x16. Допускается применение до восьми ускорителей NVIDIA H200. Предусмотрены два сетевых порта 10GbE на базе Intel X710-AT2, выделенный сетевой порт управления 1GbE, контроллер ASPEED AST2600, порты USB 3.0/2.0 Type-A и Mini-DisplayPort. Питание обеспечивают четыре блока мощностью 3200 Вт с сертификатом 80 PLUS Titanium. Задействовано воздушное охлаждение. В свою очередь, сервер CG290-S3063 рассчитан на один процессор Xeon 6 с TDP до 350 Вт. Объем памяти DDR5-6400/8000 RDIMM/RDIMM-3DS/MRDIMM может достигать 4 Тбайт (16 слотов). Доступны восемь тыльных отсеков для SFF-накопителей, два коннектора для SSD М.2 2280/22110 с интерфейсом PCIe 5.0 x2 (NVMe), а также восемь слотов PCIe 5.0 x16. Поддерживается установка до четырёх ускорителей NVIDIA H200. В оснащение входят контроллер ASPEED AST2600, сетевой порт управления 1GbE, интерфейсы USB 3.0/2.0 Type-A и Mini-DisplayPort. Применены два блока питания мощностью 2400 Вт с сертификатом 80 PLUS Titanium и система воздушного охлаждения. Серверы могут эксплуатироваться при температурах от 0 до +35 °C.

20.03.2025 [13:14], Сергей Карасёв

Micron, Samsung и SK hynix представили компактные модули памяти SOCAMM для ИИ-серверовКомпании Micron, Samsung и SK hynix, по сообщению ресурса Tom's Hardware, создали модули оперативной памяти SOCAMM (Small Outline Compression Attached Memory Modules) на основе чипов LPDDR5X. Изделия ориентированы на ИИ-системы и серверы с пониженным энергопотреблением. Модули SOCAMM имеют размеры 14 × 90 мм, что примерно в три раза меньше по сравнению с традиционными решениями RDIMM. В состав SOCAMM входят до четырёх 16-кристальных стеков памяти LPDDR5X. Изделия нового формата спроектированы специально для дата-центров, оптимизированных для приложений ИИ. Micron разработала модули SOCAMM ёмкостью 128 Гбайт, при производстве которых используется техпроцесс DRAM 1β (пятое поколение 10-нм техпроцесса). Скоростные показатели не раскрываются. Но Micron говорит о производительности на уровне 9,6 GT/s (млрд пересылок в секунду). В свою очередь, SK Hynix на конференции NVIDIA GTC 2025 представила модули SOCAMM, для которых заявлена скорость в 7,5 GT/s. Отмечается, что на оперативную память приходится значительная доля энергопотребления серверов. Например, в системах, оснащённых терабайтами DDR5, энергопотребление ОЗУ может превышать энергопотребление CPU. Компания NVIDIA учла это при разработке чипов Grace, выбрав для них память LPDDR5X, которая потребляет меньше энергии, чем DDR5. Однако в случае GB200 Grace Blackwell пришлось использовать впаянные блоки LPDDR5X, поскольку самостоятельные стандартные модули LPDDR5X не соответствовали требованиям в плане ёмкости. Изделия SOCAMM, массовое производство которых уже началось, позволяют решить данную проблему. На первом этапе модули SOCAMM будут применяться в серверах на основе суперчипов NVIDIA GB300. Но пока не ясно, станут ли решения SOCAMM отраслевым стандартом, поддерживаемым JEDEC, или останутся фирменным продуктом, разработанным Micron, Samsung, SK hynix и NVIDIA для серверов, построенных на чипах Grace и Vera.

19.03.2025 [20:39], Татьяна Золотова

«Увеон — облачные технологии» выпустил отечественный контроллер доставки приложенийРазработчик инфраструктурного ПО «Увеон – облачные технологии» (входит в «Группу Астра») выпустил контроллер доставки приложений Termidesk Connect — решение для балансировки нагрузки, повышения отказоустойчивости и масштабирования ИТ-сервисов. В компании уверяют, что новое решение способно заменить аналоги от Citrix, F5, Radware, A10, Kemp и других глобальных вендоров. Termidesk Connect позволяет создавать и масштабировать геораспределенные архитектуры, балансировать нагрузку на ИТ-сервисы и обеспечивать высокую степень их отказоустойчивости и доступности, в том числе, когда количество пользователей растет. Решение объединяет ключевые технологии, необходимые для работы бизнес-приложений организаций: GSLB (Global Server Load Balancing) для георезервирования сервисов, балансировку нагрузки на уровнях L4 и L7, Content Switching для создания гибкой логики перенаправления запросов, HA-кластер с синхронизацией конфигураций. Как поясняют в компании, это позволяет создавать геораспределенные архитектуры, оптимальные для компаний с несколькими ЦОД или филиальной сетью. Кроме того, Termidesk Connect позволит быстро обрабатывать большие потоки транзакций: SSL Offload балансирует нагрузку на уровне приложений, а задача шифрования и дешифрования SSL переносится с backend-серверов на сам балансировщик. В ближайших планах «Увеона — облачные технологии» — добавление новых функций. Также разработчик рассматривает выпуск Termidesk Connect в формате аппаратной платформы.

19.03.2025 [08:28], Сергей Карасёв

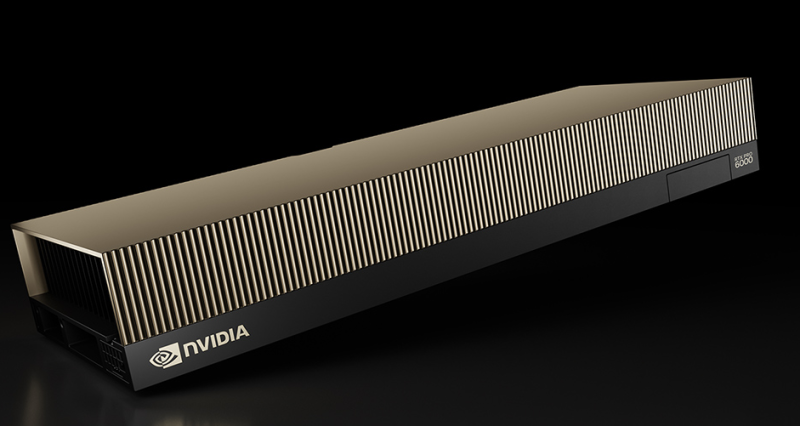

NVIDIA представила ускоритель RTX Pro 6000 Blackwell Server Edition с 96 Гбайт памяти GDDR7Компания NVIDIA анонсировала ускоритель RTX Pro 6000 Blackwell Server Edition для требовательных приложений ИИ и рендеринга высококачественной графики. Ожидается, что новинка будет востребована среди заказчиков из различных отраслей, включая архитектуру, автомобилестроение, облачные платформы, финансовые услуги, здравоохранение, производство, игры и развлечения, розничную торговлю и пр. Как отражено в названии, в основу решения положена архитектура Blackwell. Задействован чип GB202: конфигурация включает 24 064 ядра CUDA, 752 тензорных ядра пятого поколения и 188 ядер RT четвёртого поколения. Устройство несёт на борту 96 Гбайт памяти GDDR7 (ECC) с пропускной способностью до 1,6 Тбайт/с. Ускоритель RTX Pro 6000 Blackwell Server Edition использует интерфейс PCIe 5.0 x16. Энергопотребление может настраиваться в диапазоне от 400 до 600 Вт. Реализована поддержка DisplayPort 2.1 с возможностью вывода изображения в форматах 8K / 240 Гц и 16K / 60 Гц. Аппаратный движок NVIDIA NVENC девятого поколения значительно повышает скорость кодирования видео (упомянута поддержка 4:2:2 H.264 и HEVC). Всего доступно по четыре движка NVENC/NVDEC. По заявлениям NVIDIA, по сравнению с ускорителем предыдущего поколения L40S Ada Lovelace модель RTX PRO 6000 Blackwell Server Edition обеспечивает многократное увеличение производительности в широком спектре рабочих нагрузок. В частности, скорость инференса больших языковых моделей (LLM) повышается в пять раз для приложений агентного ИИ. Геномное секвенирование ускоряется практически в семь раз, а быстродействие в задачах генерации видео на основе текстового описания увеличивается в 3,3 раза. Достигается также двукратный прирост скорости рендеринга и примерно такое же повышение скорости инференса рекомендательных систем. Ускоритель RTX PRO 6000 Blackwell Server Edition может использоваться в качестве четырёх полностью изолированных экземпляров (MIG) с 24 Гбайт памяти GDDR7 каждый. Это обеспечивает возможность одновременного запуска различных рабочих нагрузок — например, ИИ-задач и обработки графики. Упомянута поддержка TEE.

12.03.2025 [14:57], Сергей Карасёв

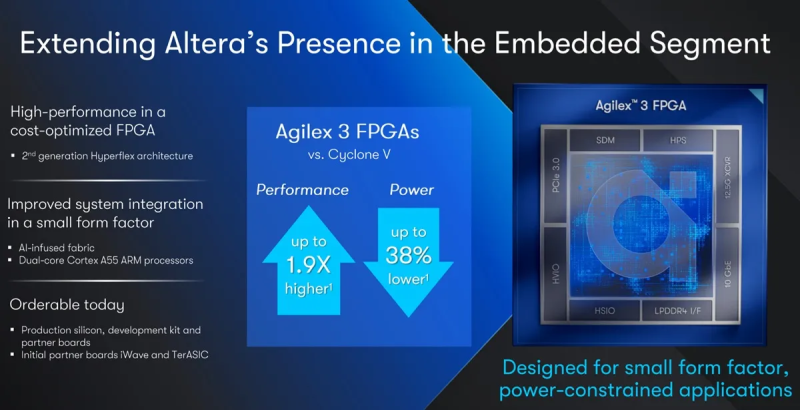

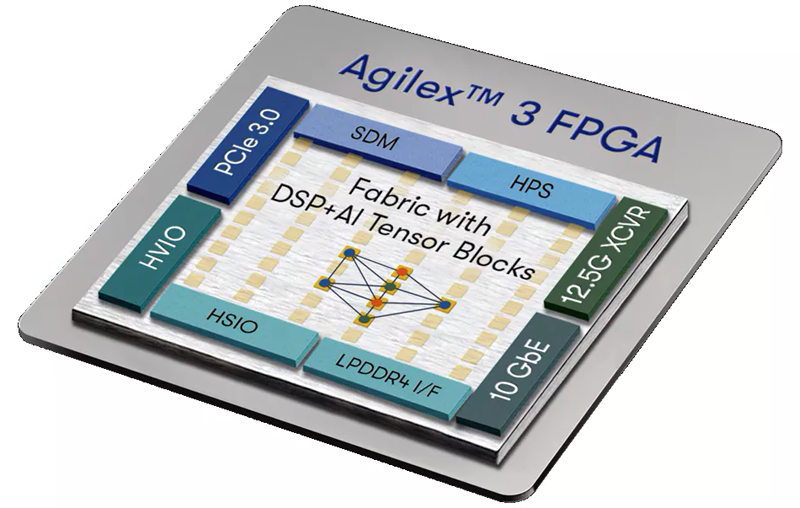

Altera представила малые FPGA семейства Agilex 3 для энергоэффективных системКомпания Altera, сформированная на базе выделенной из Intel группы программируемых решений (PSG), анонсировала FPGA семейства Agilex 3 для маломощных и экономичных систем. Среди сфер применения изделий названы автоматизация производственных процессов, медицинская визуализация, видеонаблюдение, мониторинг транспортных систем, периферийные ИИ-вычисления и пр. О подготовке Agilex 3 сообщалось в сентябре прошлого года. Задействована архитектура HyperFlex второго поколения. В состав решений входят ПЛИС с возможностями ИИ и два ядра Arm Cortex-A55 с тактовой частотой 800 МГц. По заявлениям Altera, чипы Agilex 3 обеспечивают 1,9-кратный рост производительности по сравнению Cyclone V при снижении энергопотребления до 38 %. Для трансиверов Agilex 3 заявлена скорость передачи данных до 12,5 Гбит/с. Говорится о поддержке интерфейсов PCIe 3.0 x4 и 10GbE. Усовершенствованный цифровой сигнальный процессор с блоком AI Tensor Block обеспечивает пиковую ИИ-производительность 2,8 TOPS на операциях INT8. Реализованы различные средства обеспечения безопасности, включая защищённую загрузку, шифрование AES и управление конфигурацией FPGA.  В семейство Agilex 3 вошли модели A3C025, A3C050, A3C065, A3C100 и A3C135, насчитывающие от 25 075 до 135 110 логических элементов. Поддерживается работа с памятью LPDDR4-2133. Изделия могут быть выполнены в корпусе с размерами 12 × 12, 16 × 16 или 18 × 18 мм. В качестве примеров использования Agilex 3 компания Altera приводит роботизированные системы, где FPGA обеспечивают управление в реальном времени для многоосевых манипуляторов. В составе промышленных камер чипы улучшают обнаружение дефектов. Приём предварительных заказов на изделия уже начался.

12.03.2025 [12:12], Сергей Карасёв

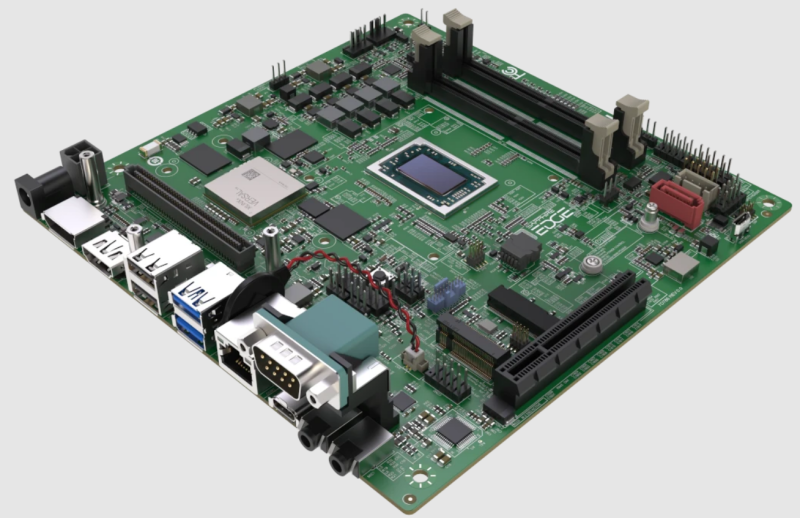

Mini-ITX-плата Sapphire Edge+ VPR-5050 содержит чип AMD Ryzen V2748 и FPGA VersalКомпания Sapphire анонсировала материнскую плату Edge+ VPR-5050 на платформе AMD Embedded+, выполненную в форм-факторе Mini-ITX с размерами 170 × 170 мм. Новинка предназначена для таких задач, как ИИ-приложения, промышленная автоматизация, обработка данных от различных датчиков в режиме реального времени и пр. Плата содержит процессор AMD Ryzen Embedded V2748 с восемью ядрами (2,9/4,15 ГГц) и графическим ускорителем Radeon RX Vega 7 с частотой 1,6 ГГц. Кроме того, задействована FPGA AMD Versal AI Edge VE2302 с двумя ядрами Arm Cortex-A72 (до 1,6 ГГц), двумя ядрами Arm Cortex-R5F, ИИ-движком с производительностью до 23 TOPS, памятью LPDDR4 (2 × 4 Гбайт или 2 × 8 Гбайт) и опциональным чипом eMMC на 64 Гбайт. Материнская плата располагает двумя слотами SO-DIMM с поддержкой до 64 Гбайт памяти DDR4-3200. Есть коннектор M.2 для SSD (PCIe 3.0 x4 или SATA-3) и порт SATA-3 для дополнительного накопителя (SSD или HDD). В разъём M.2 Key-E 2230 (PCIe 3.0 x1 и USB 2.0) может быть установлен комбинированный модуль Wi-Fi/Bluetooth. Доступен слот расширения PCIe x8. Набор интерфейсов включает выходы DP и HDMI, по два порта USB 3.2 Gen2 Type-A и USB 2.0 Type-A, один порт USB 3.2 Gen2 Type-C, гнездо RJ-45 для сетевого кабеля (контроллер 2.5GbE), последовательный порт и 3,5-мм аудиогнёзда. Диапазон рабочих температур простирается от 0 до +60 °C. Говорится о совместимости с RHEL/CentOS 7.9, RHEL 8.2–8.6 и Ubuntu 22.04. Для новинки доступны различные индустриальные модули расширения, в частности, с двумя портами 10/25GbE или 1GbE. Материнская плата может быть оборудована активным кулером с вентилятором.

06.03.2025 [18:58], Татьяна Золотова

«Сургуч» для ЭЦП: в ОС «Альт появилось новое приложение для упрощения ЭДОКомпания «Базальт СПО» разработала «Сургуч» — программное решение для работы с электронными цифровыми подписями (ЭЦП) в операционных системах «Альт Рабочая станция», «Альт Рабочая станция К», «Альт Образование» и «Альт СП». Приложение работает с документами в формате PDF, совместимо с криптопровайдером «КриптоПро CSP» и помогает упростить процесс электронного документооборота (ЭДО). Пакет surguch доступен в репозиториях p10, p11 и c10f2. Среди основных функций приложения разработчики называет создание ЭЦП в форматах Cades-BES/T/XLT1 в PDF и штампа ЭЦП в соответствии с требованиями 63-ФЗ, отображение наличия подписей в документе PDF, проверка цепочки сертификатов и вывод информации о сертификатах, использованных при формировании ЭЦП, в том числе с использованием OCSP-сервера. Также приложение может отслеживать изменения в документах после подписания и сохранять пользовательские профили для подписания. Пользователи могут работать как через графический интерфейс, так и через командную строку. Программа поддерживает стандарт PAdES (PDF Advanced Electronic Signatures), который позволяет встраивать подпись непосредственно в PDF-файл и генерировать визуальные штампы. При передаче подписанного документа получатель может видеть полную информацию о подписи: кто и когда подписал документ, какие сертификаты были использованы. Подробности о новинке можно узнать в ALT Linux Wiki.

05.03.2025 [11:51], Сергей Карасёв

Lenovo представила компактный ИИ-сервер ThinkEdge SE100 для инференсаLenovo анонсировала сервер ThinkEdge SE100, предназначенный для решения задач ИИ-инференса на периферии. Новинка ориентирована на предприятия в различных отраслях, включая розничную торговлю, производство, телекоммуникации и здравоохранение. Сервер комплектуется процессором Intel поколения Arrow Lake-H: это может быть чип Core Ultra 7 255H (6P+8E+2LP-E) с частотой до 5,1 ГГц или Core Ultra 5 225H (4P+8E+2LP-E) с частотой до 4,9 ГГц. Поддерживается до 64 Гбайт оперативной памяти DDR5-6400 в виде двух модулей CSO-DIMM (Clocked Small Outline DIMM). Устройство располагает одним слотом PCIe 4.0 x8 HHHL для ускорителя на базе GPU, например, NVIDIA RTX 2000E ADA или NVIDIA RTX A1000. Система может быть оборудована загрузочным накопителем M.2 2280 вместимостью до 960 Гбайт, а также двумя SSD формата M.2 (NVMe) ёмкостью до 3,84 Тбайт. Присутствуют два сетевых порта 1GbE и выделенный сетевой порт управления 1GbE RJ-45. Для модели ThinkEdge SE100 предусмотрен широкий выбор вариантов монтажа, включая крепление VESA и на DIN-рейку, установку в стойку и использование в «настольном» режиме. Базовый модуль имеет размеры 53 × 142 × 278 мм, блок расширения — 53 × 214 × 278 мм. Во фронтальной части сервера расположены порты USB 3.2 Gen2 Type-A (×2), USB 3.2 Gen2 Type-C, HDMI 2.0 (×2) и RJ-45. Сзади сосредоточены разъёмы USB Type-C (×2), USB 3.2 Gen2 Type-A (×2) и RJ-45 (×3). Диапазон рабочих температур — от +5 до +45 °C. Заявлена совместимость с программными платформами Windows 11 Enterprise, Ubuntu 24.04, RHEL. По утверждениям Lenovo, сервер ThinkEdge SE100 на 85 % компактнее традиционных систем, ориентированных на ИИ-инференс. При этом обеспечивается «производительность корпоративного уровня». На устройство предоставляется трёхлетняя гарантия. |

|