Материалы по тегу: h100

|

27.06.2024 [12:58], Сергей Карасёв

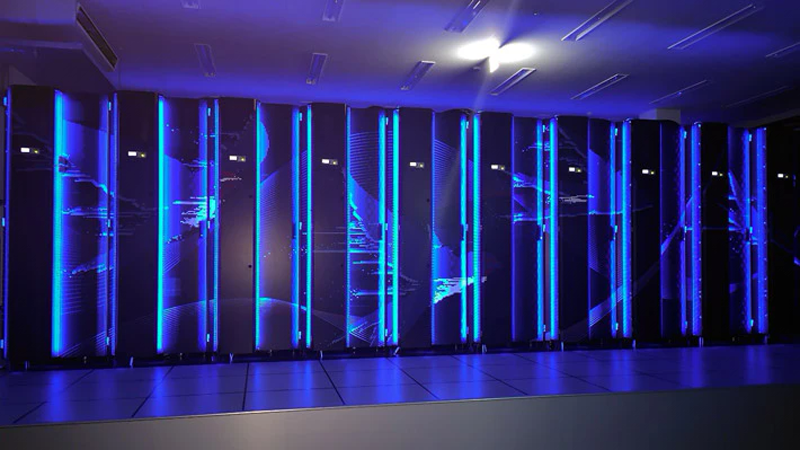

В Японии запущен суперкомпьютер TSUBAME4.0 с ускорителями NVIDIA H100 для ИИ-задачГлобальный научно-информационный вычислительный центр (GSIC) Токийского технологического института (Tokyo Tech) в Японии объявил о вводе в эксплуатацию вычислительного комплекса TSUBAME4.0, созданного компанией HPE. Новый суперкомпьютер будет применяться в том числе для задач ИИ. В основу машины легли 240 узлов HPE Cray XD665. Каждый из них несёт на борту два процессора AMD EPYC Genoa и четыре ускорителя NVIDIA H100 SXM5 (94 Гбайт HBM2e). Объём оперативной памяти DDR5-4800 составляет 768 Гбайт. Задействован интерконнект Infiniband NDR200. Вместимость локального накопителя NVMe SSD — 1,92 Тбайт. В состав НРС-комплекса входит подсистема хранения данных HPE Cray ClusterStor E1000. Сегмент на основе HDD имеет ёмкость 44,2 Пбайт — это в 2,8 раза больше по сравнению с суперкомпьютером предыдущего поколения TSUBAME 3.0. Кроме того, имеется SSD-раздел ёмкостью 327 Тбайт. Пиковая производительность TSUBAME4.0 достигает 66,8 Пфлопс (FP64), что в 5,5 больше по отношению к системе третьего поколения. Быстродействие на операциях половинной точности (FP16) поднялось в 20 раз по сравнению с TSUBAME3.0 — до 952 Пфлопс.

Источник изображения: Tokyo Tech На сегодняшний день TSUBAME4.0 является вторым по производительности суперкомпьютером в Японии после Fugaku. Эта система в нынешнем рейтинге TOP500 занимает четвёртое место с показателем 442 Пфлопс. Лидером в мировом масштабе является американский комплекс Frontier — 1,21 Эфлопс.

21.06.2024 [12:05], Сергей Карасёв

«ИИ-гигафабрику» для xAI построят Dell и SupermicroОборудование для мощнейшего ИИ-суперкомпьютера компании xAI, курируемой Илоном Маском (Elon Musk), как сообщает Datacenter Dynamics, будут поставлять Dell и Supermicro. Речь идёт о серверах, оборудованных высокопроизводительными ускорителями NVIDIA. После анонса акции обеих компаний выросли в цене. Напомним, что xAI реализует проект по созданию самого мощного в мире вычислительного комплекса, ориентированного на задачи ИИ. Строительство суперкомпьютера будет осуществляться в несколько этапов. Так, в ближайшее время должна быть запущена система, содержащая 100 тыс. ускорителей NVIDIA H100. А летом 2025 года планируется ввести в эксплуатацию кластер из 300 тыс. новейших ускорителей NVIDIA B200. О том, что участие в масштабном проекте xAI принимает корпорация Dell, сообщил её генеральный директор Майкл Делл (Michael Dell). Эти сведения подтвердил и сам Маск: по его словам, Dell «соберёт половину стоек, которые войдут в состав суперкомпьютера». За строительство оставшейся части системы будет отвечать Supermicro. По имеющейся информации, огромный дата-центр xAI, прозванный «ИИ-гигафабрикой», расположится в окрестностях Мемфиса (штат Теннесси). О том, в какой пропорции работы по строительству машины будут распределены между Dell и Supermicro, на данный момент нет. Стоимость проекта оценивается в миллиарды долларов. xAI в настоящее время арендует около 16 тыс. ускорителей NVIDIA H100 в облаке Oracle Cloud, а также использует веб-сервисы Amazon и свободные мощности на ЦОД-площадках X/Twitter. В мае 2024 года стартап осуществил раунд финансирования Series B, в ходе которого было привлечено $6 млрд. В результате, рыночная стоимость xAI достигла $24 млрд. Создаваемый суперкомпьютер будет использоваться в том числе для поддержания работы чат-бота xAI Grok следующего поколения.

12.06.2024 [18:00], Владимир Мироненко

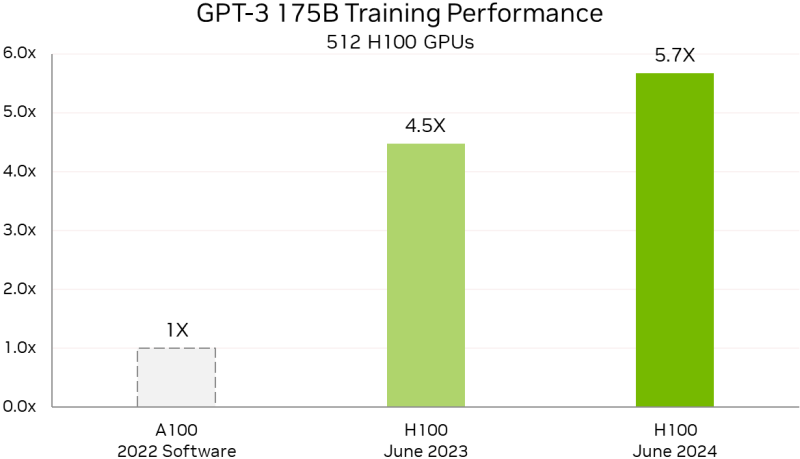

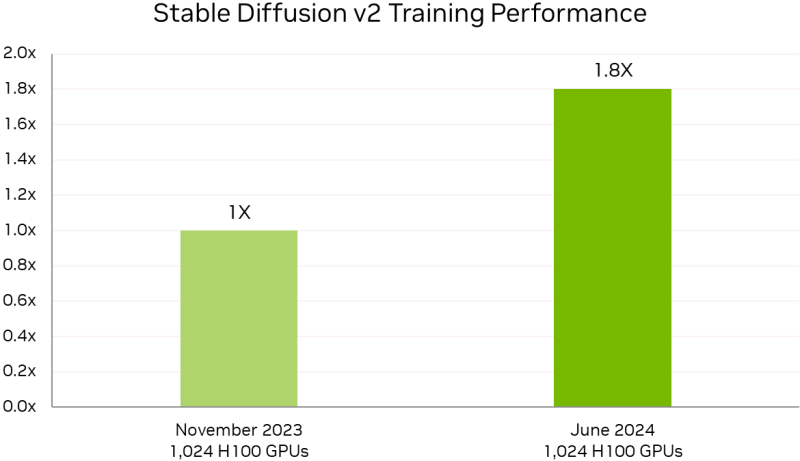

Уже рутина: NVIDIA снова улучшила результаты в ИИ-бенчмарке MLPerf TrainingВычислительные платформы NVIDIA снова продемонстрировали высокую производительность, на этот раз в свежих тестах MLPerf Training v4.0. Так, суперкомпьютер NVIDIA EOS-DFW более чем утроил свою производительность в LLM-тесте на базе GPT-3 175B по сравнению с прошлогодним результатом. Как сообщается, 11 616 ускорителей NVIDIA H100, объединённых 400G-интерконнектом NVIDIA Quantum-2 InfiniBand, позволили суперкомпьютеру EOS достичь столь значительного результата благодаря более масштабному и комплексному подходу к проектированию системы. А это позволяет более эффективно обучать и запускать крупные модели, экономя время и ресурсы, говорит компания. А более современный ускоритель H200 с улучшенной подсистемой памяти в MLPerf Training быстрее H100 на 14 %, а в GNN-тестах (RGAT) узлы с H200 оказались быстрее узлов с H100 сразу на 47 %. По словам компании, поставщики услуг LLM могут всего за четыре года, инвестировав $1, получить $7, используя модель Llama 3 70B на серверах на базе NVIDIA HGX H200, если исходить из того, что обслуживание обходится в $0,60 за миллион токенов, а пропускная способность HGX H200 составляет 24 тыс. токенов в секунду. Росту производительности также способствовало совершенствование и оптимизация ПО. Так, кластер из 512 чипов H100 за год стал на 27 % быстрее, а рост производительности с увеличением количества ускорителей теперь более линеен. В новом тесте MLPerf Training по тюнингу LLM (LoRA применительно к Meta✴ Llama 2 70B) системы NVIDIA показали эффективное масштабирование при количестве ускорителей от 8 до 1024. NVIDIA также увеличила производительность обучения Stable Diffusion v2 почти на 80 % при тех же масштабах систем, что были представлены в прошлом тестировании. NVIDIA отметила, что для компаний, запускающих приложения на базе LLM, высокая производительность имеет большое значение. Возможность обучать и настраивать более мощные модели — и быстрее их развёртывать и запускать — позволит получить лучшие результаты и более высокий доход. А с выходом платформы NVIDIA Blackwell скоро появится возможность как обучения, так и инференса моделей генеративного ИИ с триллионом параметров.

07.06.2024 [15:42], Руслан Авдеев

«ИИ-гигафабрика» xAI разместится в гигантском дата-центре в ТеннесиИИ-стартап xAI, курируемый Илоном Маском (Elon Musk), намерен построить гигантский дата-центр с самым производительным в мире ИИ-суперкомпьютером. По данным Datacenter Dynamics, ЦОД разместится в окрестностях Мемфиса (штат Теннесси), а пока ожидает одобрения властей. В обозримом будущем компания должна получить сотни тысяч ускорителей для обучения новых моделей, в частности, чат-бота Grok, предлагаемого, например, по подписке в социальной сети X (Twitter). Ранее в Сеть утекла информация, что NVIDIA передаст xAI чипы, изначально предназначавшиеся для Tesla — Маск весьма вольно распоряжается активами подконтрольных ему бизнесов, часто вызывая недовольство инвесторов. Пока проект ожидает окончательного разрешения от местного бизнес-инкубатора Memphis Shelby County Economic Development Growth Engine (EDGE), а также муниципальных и федеральных властей. Впрочем, гораздо важнее дождаться одобрения энергетической компании Tennessee Valley Authority (TVA). Реализация проекта сулит появление высокооплачиваемых рабочих мест и увеличение доходов штата, что поможет поддерживать и модернизировать местную инфраструктуру. Муниципальные власти уже назвали проект «крупнейшей мультимиллиардной инвестицией в истории Мемфиса, а Маск окрестил ЦОД «гигафабрикой для вычислений» по аналогии с Tesla Gigafactory. По данным местных СМИ, приглянувшаяся Маску площадка принадлежит инвесткомпании Phoenix Investors, сотрудничающей с xAI и местными властями. Ранее объект управлялся компанией Electrolux. Неизвестно, насколько масштабной будет первая фаза проекта и сколько средств на неё потратят. Ранее Маск заявлял, что xAI развернёт в ближайшие месяцы 100 тыс. ускорителей NVIDIA H100, а кластер из ещё 300 тыс. B200 введут в эксплуатацию следующим летом. Считается, что xAI арендует около 16 тыс. H100 у Oracle Cloud, также компания пользуется услугами AWS и свободными мощностями X (Twitter).

06.06.2024 [13:23], Руслан Авдеев

Маск подтвердил передачу ИИ-стартапу xAI 12 тыс. ускорителей H100, предназначавшихся TeslaГлава Tesla и других компаний Илон Маск (Elon Musk) подтвердил передачу ускорителей NVIDIA H100, ранее заказанных Tesla, социальной сети X и ИИ-стартапу xAI. Слухи об этом, напоминает The Register, появились в СМИ — в распоряжение журналистов попала внутренняя документация и электронная переписка с NVIDIA. В частности, в одной из записок за декабрь прошлого года прямо указывалось, что Илон отдаёт приоритет внедрению 12 тыс. ускорителей в X вместо Tesla. Общая стоимость такого количества H100 превышает $500 млн. Вместо этого заказанные для X экземпляры H100 позже будут переданы Tesla (поставки ожидались в январе и июне 2024 года). Кроме того, есть проблемы и с созданием ИИ-суперкомпьютера Dojo на базе собственных чипов, который должен улучшить положение Tesla. Приоритетным для Маска, вероятно, является кластер H100, создаваемый X и тесно связанным с сетью стартапом xAI. Компании совместно работают над большими языковыми моделями, стоящими за чат-ботом Grok, уже доступным премиум-подписчикам X. По данным утечки из NVIDIA, 100 тыс. H100 приказано передать к концу года в xAI для создания «крупнейшего в мире» кластера ускорителей, который разместится в Северной Дакоте.

Источник изображения: Alexander Shatov/unsplash.com Хотя на уровне компаний комментариев не поступало, сам Маск подтвердил, что у Tesla просто не было места для чипов NVIDIA, поэтому они хранились на складе. При этом ещё не так давно Маск уверял инвесторов Tesla, как важны HPC-системы и ИИ для компании. Более того, ещё в апреле появилась новость о том, что автопроизводитель только в течение одного квартала вложил в ИИ $1 млрд. Также миллиардер сообщал, что один из заводов Tesla в Техасе вместит 50 тыс. H100 для обучения систем автономного вождения, в общей сложности число ускорителей достигло бы 85 тыс. Пока нет точных данных об обстоятельствах передачи ускорителей между Tesla и X или xAI. Нет даже информации о том, заплатила ли уже Tesla за «железо» и получила ли за него какую-то компенсацию. Условия передачи H100 могут иметь большое значение с учётом того, что Маск не является единоличным владельцем Tesla. Если выяснится, что Маск злоупотребил властью, к нему могут возникнуть вопросы как у инвесторов, так и у регуляторов. Впрочем, Tesla не впервые приходится делиться активами с X. Вскоре после покупки Twitter более 50 сотрудников автопроизводителя якобы отправили на «усиление» социальной соцсети. Есть данные, что сотрудников Tesla привлекают к работам и в других компаниях Маска, причём без дополнительной платы. Время для новостей не особенно удачное — на следующей неделе акционеры Tesla будут голосовать по ряду предложений, главным из которых является официальный перенос штаб-квартиры в Техас. Также речь пойдёт о переизбрании брата Кимбала, брата Илона Маска (Kimbal Musk), в совет директоров и других ключевых для бизнесмена вопросах. Тем временем в Tesla падают продажи со II половины 2022 года, увольняют сотрудников и, главное, стоимость акций компании падает критическими темпами. Приказ передать H100 станет дополнительным козырем в руках критиков миллиардера, которые утверждают, что его активное участие в других проектах мешает ему сконцентрироваться на автобизнесе и эффективно выполнять обязанности главы Tesla.

05.06.2024 [22:51], Илья Коваль

ИИ-кластер в один клик и без долгого ожидания: Lambda Labs представила услугу краткосрочной аренды до 512 NVIDIA H100Облачный провайдер Lambda Labs представил услугу 1-Click Clusters, которая позволяет без длительного ожидания получить ИИ-кластер, включающий от 64 до 512 ускорителей NVIDIA H100, на срок от двух недель по единой цене $4,49/час за каждый ускоритель. По словам сооснователя компании, данное предложение является уникальным и с рыночной, и с технической точки зрения. Lambda Labs говорит, что на практике большинству ИИ-разработчиков как правило требуется доступ к кластерам из десятков или сотен ускорителей на относительно короткие периоды обучения и проверки моделей длительностью несколько недель. При этом долгосрочная аренда кластера, который будет периодически простаивать, обходится дорого. А аренда на короткий срок нередко сопряжена с длительным ожиданием доступности ускорителей как раз в тот момент, когда они больше всего нужны. При этом без общения с отделом продаж вряд ли удастся обойтись. Именно поэтому Lambda Lambs и предложила услугу 1-Click Clusters, в рамках которой на получение ИИ-кластера уходит не более нескольких дней. Аппаратная составляющая включает узлы на базе HGX H100 с 208 vCPU, 1,9 Тбайт RAM и локальным NVMe-хранилищем ёмкостью 24 Тбайт. Все узлы связаны 400G-интерконнектом NVIDIA Quantum-2 InfiniBand, а каждому ускорителю полагается свой адаптер NVIDIA ConnectX-7. Как утверждает сооснователь Lambda Labs, мало кто из облачных провайдеров способен «нарезать» крупную InfiniBand-фабрику, объединяющую тысячи ускорителей, на небольшие виртуализированные кластеры, причём делать это без участия человека. В состав каждого кластера также входят три управляющих узла: 8 vCPU, 34 Гбайт RAM, 208 Гбайт NVMe SSD и один внешний IP-адрес. За интернет-подключение отвечают два общих 100-Гбит/с канала, причём плата не берётся ни за входящий, ни за исходящий трафик. Дополнительно можно арендовать сетевое хранилище по цене $0,20/мес. за каждый Гбайт. Кластеры поставляются вместе с набором ПО Lambda Stack, который включает все необходимые драйверы и библиотеки, популярные фреймворки и средства разработки.

04.06.2024 [12:10], Руслан Авдеев

Илон Маск готовит для xAI суперкомпьютер c 300 тыс. NVIDIA B200, но пока придётся обойтись H100Илон Маск (Elon Musk) заявляет, что к лету 2025 года его ИИ-стартап xAI введёт в эксплуатацию суперкомпьютер c 300 тыс. новейших ускорителей NVIDIA B200 и SuperNIC ConnectX-8, передаёт Datacenter Dynamics. Заодно Маск пообещал уже в ближайшие месяцы ввести в эксплуатацию кластер из 100 тыс. ускорителей NVIDIA H100 с жидкостным охлаждением. При этом важно помнить, что Маск нередко даёт обещания, которые потом никогда не выполняет или выполняет совсем не так, как ожидалось. Например, на днях The Information сообщала, что 100 тыс. ускорителей H100 должны заработать только следующим летом. Вероятнее всего, компания построит компактный и относительно недорогой кластер, который позже расширится до 100 тыс. ускорителей. Такую же схему могут реализовать и с системой из 300 тыс. ускорителей. Предполагается, что такой суперкомпьютер будет стоить десятки миллиардов долларов — больше, чем xAI привлекла от инвесторов. По словам главы NVIDIA Дженсена Хуанга (Jensen Huang), один B200 стоит $30-40 тыс. Даже если Маску удастся приобрести ускорители подешевле, речь будет идти о $9 млрд. С учётом того, что компании понадобится инфраструктура, связь, классические процессоры, земля и коммунальное обслуживание, речь будет идти о ещё более дорогостоящем проекте — даже не принимая во внимание стоимости потребляемой воды и электроэнергии. В прошлом месяце xAI привлекла $6 млрд в ходе очередного раунда финансирования, что подняло стоимость компании до $24 млрд. В совокупности с предыдущим раундом, в ходе которого удалось собрать $1 млрд, средств будет достаточно для покупки 100 тыс. H100, оплату работы персонала и текущих вычислительных потребностей — пока xAI арендует около 16 тыс. ускорителей H100 у Oracle Cloud, а недавно сообщалось о намерении xAI потратить $10 млрд на серверы в облаке Oracle.

24.05.2024 [13:29], Сергей Карасёв

Облачный провайдер Scaleway расширил охват до 52 стран и закупил ещё тысячу NVIDIA H100Французский облачный провайдер Scaleway, по сообщению ресурса Datacenter Dynamics, значительно расширил зону охвата. Компания теперь предоставляет свой сервис Dedibox Virtual Private Server (VPS) в 65 городах на территории 52 стран. По заявлениям Scaleway, Dedibox VPS даёт компаниям гибкость в развёртывании виртуальной инфраструктуры. Доступны различные конфигурации, а стоимость начинается примерно с €5/мес. Услуга охватывает Северную Америку, Южную Америку, Европу, Ближний Восток, Африку, Азию и Океанию. Кроме того, провайдер объявил о приобретении более 1000 дополнительных ускорителей NVIDIA H100, которые будут использованы для расширения вычислительных мощностей в дата-центре Iliad DC5 в Большом Париже. Scaleway использует Ethernet-платформу Spectrum-X, разработанную для облачных провайдеров. Scaleway также запустила новую услугу под названием GPU Cluster On Demand. Она позволяет клиентам зарезервировать необходимое количество вычислительных кластеров на базе GPU — от нескольких штук до нескольких тысяч. Таким образом, можно гибко масштабировать ресурсы при реализации различных проектов в области ИИ и НРС. Наконец, Scaleway объявила о подписании соглашения о предоставлении ускорителей H100 компании H из Парижа. Этот стартап сформирован командой бывших руководителей Google DeepMind. Компания занимается разработкой мультиагентных моделей и фундаментальных моделей поведения.

16.05.2024 [14:22], Руслан Авдеев

xAI Илона Маска потратит $10 млрд на облачные ИИ-серверы Oracle для чат-бота GrokИИ-стартап Илона Маска (Elon Musk) xAI готов потратить $10 млрд на серверы в облаке Oracle. По данным The Information, ссылающейся на осведомлённые источники, компании ведут переговоры о долгосрочном сотрудничестве, которое сделает детище Маска одним из крупнейших клиентов Oracle. Предполагается, что xAI требуется больше вычислительных ресурсов для соперничества с OpenAI, Anthropic и другими компаниями, уже заключившими многомиллиардные инвестиционные сделки с Microsoft и AWS соответственно. Это позволяет им получать доступ к облачной инфраструктуре для обучения и запуска больших языковых моделей (LLM). Например, Microsoft и OpenAI, по слухам, готовы потратить $100 млрд на кампус ЦОД Stargate ёмкостью 5 ГВт. Пока Micosoft вынуждена сама арендовать часть ИИ-ускорителей у Oracle. В прошлом году xAI представила чат-бот Grok, доступный платным пользователям соцсети X, а сейчас разрабатывается вторая версия. Имеются сведения, что xAI завершает раунд привлечения инвестиций в размере $6 млрд, а Маск уже заявил, что полученные средства будут потрачены на аренду инфраструктуры. В прошлом месяце миллиардер заявил, что новинка обучается на 20 тыс. ускорителей NVIDIA, но для Grok 3.0 потребуется уже 100 тыс. ускорителей. Маск и основатель Oracle Ларри Эллисон (Larry Ellison) крепко дружат, кроме того, Элиссон входил в совет директоров Tesla. В декабре прошлого года он заявлял, что xAI уже является крупнейшим клиентом Oracle и утверждал, что у облачного гиганта достаточно ускорителей для Grok первого поколения, но, по его признанию, в xAI хотят намного больше. Сейчас xAI арендует у Oracle 15 тыс. ускорителей NVIDIA H100. Tesla, ещё одно детище Маска, уже ввела в эксплуатацию ИИ-ресурсы, эквивалентные по производительности 35 тыс. H100. ИИ-инфраструктура стала выгодным источником дохода для облачного оператора, в марте Эллисон заявлял, что компания строит новые ЦОД, включая некий «крупнейший в мире» объект. Примечательно, что после покупки социальной сети Twitter (ныне X), Маск и его менеджмент не хотели платить за услуги Oracle (а также AWS и Google), пытаясь оптимизировать расходы.

13.05.2024 [11:12], Сергей Карасёв

Supermicro представила ИИ-серверы на базе Intel Gaudi3 и AMD Instinct MI300XКомпания Supermicro анонсировала новые серверы для задач ИИ и НРС. Дебютировали системы высокой плотности с жидкостным охлаждением, а также устройства, оборудованные высокопроизводительными ускорителями AMD, Intel и NVIDIA.

Источник изображений: Supermicro В частности, представлены серверы SYS-421GE-TNHR2-LCC и AS-4125GS-TNHR2-LCC в форм-факторе 4U, оснащённые СЖО. Первая из этих моделей рассчитана на установку двух процессоров Intel Xeon Emerald Rapids или Xeon Sapphire Rapids (до 385 Вт), а также 32 модулей DDR5-5600. Второй сервер поддерживает два чипа AMD EPYC 9004 Genoa с показателем TDP до 400 Вт и 24 модуля DDR5-4800. Обе новинки могут быть оборудованы восемью ускорителями NVIDIA H100 (SXM). В одной стойке могут размещаться до восьми серверов, что в сумме даст 64 ускорителя. При этом общая заявленная производительность такого кластера на операциях FP16 превышает 126 Пфлопс. Серверы оборудованы восемью фронтальными отсеками для SFF-накопителей NVMe. Питание обеспечивают четыре блока мощностью 5250 Вт с сертификатом Titanium. Слоты расширения выполнены по схеме 8 × PCIe 5.0 x16 LP и 2 × PCIe 5.0 x16 FHHL. На ISC 2024 компания Supermicro также демонстрирует сервер типоразмера 8U, оборудованный ускорителями Intel Gaudi3. Это одна из первых систем такого рода. Кроме того, представлена система AS-8125GS-TNMR2 формата 8U, рассчитанная на восемь ускорителей AMD Instinct MI300X. Этот сервер может комплектоваться двумя процессорами EPYC 9004 с TDP до 400 Вт, 24 модулями оперативной памяти DDR5-4800, фронтальными накопителями SFF (16 × NVMe и 2 × SATA), двумя модулями M.2 NVMe. Установлены шесть блоков питания на 3000 Вт с сертификатом Titanium. Наконец, Supermicro готовит серверы формата 4U с жидкостным охлаждением, которые могут оснащаться восемью ускорителями NVIDIA H100 и H200. Компания демонстрирует на конференции ISC 2024 и другие системы для приложений ИИ, а также задач НРС. |

|