Лента новостей

|

29.01.2025 [12:21], Сергей Карасёв

System76 представила мини-компьютер Meerkat на базе Intel Meteor Lake, Linux и CorebootКомпания System76 анонсировала компьютер небольшого форм-фактора Meerkat следующего поколения, который построен на аппаратной платформе Intel Meteor Lake и ОС с ядром Linux. Новинка уже доступна для заказа по ориентировочной цене от $800. Устройство заключено в корпус с размерами 117,5 × 110 × 49 мм. В зависимости от модификации применяется процессор Core Ultra 7 155H с 16 ядрами (6P+8E+2LPE; 22 потока; до 4,8 ГГц) или чип Core Ultra 5 125H с 14 ядрами (4P+8E+2LPE; 18 потоков; до 4,5 ГГц). В обоих случаях задействован графический ускоритель Intel Arc. Объём оперативной памяти DDR5-5600 может достигать 96 Гбайт. Допускается установка SSD формата M.2 (PCIe 4.0 NVMe) вместимостью до 8 Тбайт, а также SFF-накопителя с интерфейсом SATA-3, ёмкость которого также может достигать 8 Тбайт. В оснащение входят адаптеры Wi-Fi 6E (802.11ax) и Bluetooth 5.3, двухпортовый сетевой контроллер 2.5GbE (Intel). Во фронтальной части расположены по одному порту USB 3.2 Gen2 Type-A, USB 4/Thunderbolt 4 (с поддержкой DP 2.1) и USB 3.2 Gen2x2 Type-C (с поддержкой DP1.4a), 3,5-мм аудиогнездо. Сзади находятся два разъёма HDMI 2.1, два гнезда RJ-45 для сетевых кабелей и два порта USB 3.2 Gen2 Type-A. Возможен вывод изображения одновременно на четыре монитора. На мини-компьютер может быть установлена ОС Pop!_OS 22.04 LTS, Ubuntu 22.04/24.04 LTS. Используется открытый загрузчик Coreboot (альтернатива BIOS/UEFI) с прошивкой System76 Open Firmware. Разработчик подчёркивает, что конструкция Meerkat допускает возможность апгрейда ключевых компонентов, таких как модули ОЗУ и накопители. Питание обеспечивает внешний адаптер мощностью 90 или 120 Вт (в зависимости от конфигурации компьютера). Новинка поставляется в более чем 60 стран по всему миру и обеспечивается пожизненной поддержкой. При этом System76 предоставляет гарантию сроком один год. Если устройство по какой-то причине не подойдёт покупателю, его можно будет вернуть в течение 30 дней, обещает производитель.

29.01.2025 [12:17], Сергей Карасёв

Spectra Logic представила SAS-коммутатор OSW-2400 для ленточных СХДКомпания Spectra Logic анонсировала коммутатор Spectra OSW-2400, предназначенный для подключения ленточных накопителей в дата-центрах. Новинка, выполненная на основе стандарта Serial-Attached SCSI 4.0 (SAS-4), уменьшает или полностью устраняет необходимость в развёртывании более дорогой сетевой инфраструктуры Fibre Channel. Коммутатор предоставляет до 48 линий 24G, работающих на скорости 22,5 Гбит/с. Таким образом, обеспечивается пропускная способность до 1,08 Тбит/с, а совокупная скорость передачи данных достигает 108 Гбайт/с. Отмечается, что затраты на подключение оборудования в случае Spectra OSW-2400 до 70 % ниже, чем при использовании сопоставимой инфраструктуры Fibre Channel. По заявлениям Spectra Logic, благодаря использованию активных оптических кабелей новинка обеспечивает возможность организации соединений протяжённостью до 100 м. Это позволяет охватывать ЦОД площадью до 10 тыс. м2, а также организовывать передачу данных между несколькими этажами и даже между отдельно стоящими зданиями. Коммутатор поддерживает ленточные приводы SAS-3, включая LTO-9 и IBM TS1170 Enterprise. Кроме того, заявлена обратная совместимость с устройствами SAS-2, в том числе LTO-6, LTO-7, LTO-8 и IBM TS1160 Enterprise. Поддерживаются ленточные библиотеки TFinity, T950, Spectra Cube и Spectra Stack. Изделие оборудовано 12 портами Mini-SAS HD (24/12 Gb), к каждому из которых можно подключить до четырёх устройств, например, серверов или ленточных накопителей. Кроме того, имеется сетевой порт управления 1GbE. Коммутатор выполнен в форм-факторе 1U с размерами 439,7 × 304,8 × 44,5 мм. Предусмотрены два блока питания мощностью 220 Вт с возможностью горячей замены. За охлаждение отвечают три вентилятора, которые также допускают горячую замену.

28.01.2025 [23:48], Владимир Мироненко

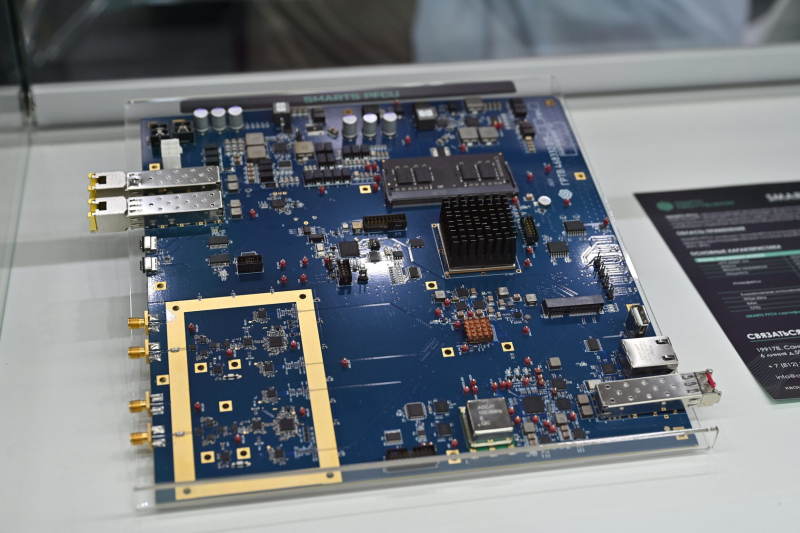

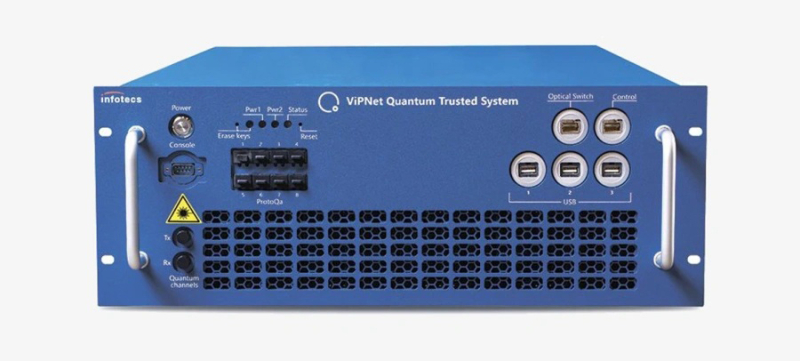

ФСБ сертифицировала оборудование для квантовых коммуникаций «ИнфоТеКС» и «СМАРТС-Кванттелеком» — теперь его можно использовать на спецобъектахВ конце 2024 года ФСБ сертифицировала новое оборудование для квантовых коммуникаций от компаний «ИнфоТеКС» и «СМАРТС-Кванттелеком», сообщил ресурс РБК со ссылкой на сайты компаний. До этого, в 2022 году ФСБ сертифицировала так называемый квантовый телефон ViPNet QSS, созданный «ИнфоТеКСом» и Центром компетенций НТИ на базе МГУ им. М.В. Ломоносова. Его испытания прошли в ОАО «РЖД» и «Газпроме». По словам представителя «ИнфоТеКСа», к концу 2024 года протяжённость магистральной линии квантовой связи «РЖД» достигала 7 тыс. км. «ИнфоТеКС» также реализовал проекты с «Газпромом» и «Ростелекомом». Кроме того, квантовые сети действуют в нескольких университетах. Как отметили в «РЖД», сертификация «откроет возможность для применения квантового оборудования на тех объектах, где требуется использование сертифицированных средств. В 2019 году правительство назначило «РЖД» ответственной за реализацию направления «Квантовые коммуникации». Существенным препятствием для коммерческого внедрения сервисов в железнодорожной компании назвали высокую стоимость такого оборудования. По словам источника РБК, стоимость квантового телефона осенью 2022 года составляла примерно 40 млн руб. «Ростелеком» с 2018 года реализовал более десяти пилотных проектов в области квантовых коммуникаций, в том числе построил квантовую сеть между ЦОД в Москве и Удомле. В компании отметили, что «гарантированно высокий уровень безопасности передачи критически важных данных необходим государственным и корпоративным клиентам, в частности финансовому сектору». Гендиректор «СМАРТС-Кванттелекома» заявил, что получение сертификата «означает возможность реального применения квантовых систем для защиты информации потенциальными потребителями». В «Росатоме» сообщили, что лидером в построении квантовых сетей в мире является Китай, а Россия — один из лидеров по совокупности таких параметров, как протяжённость квантовых сетей, уровень развития технологий, наличие сформированной экосистемы, централизованной программы поддержки исследований и разработок и др. Концепция регулирования отрасли квантовых коммуникаций была утверждена в России в 2023 году.

28.01.2025 [23:07], Владимир Мироненко

Российское телеком-оборудование подорожало из-за роста цен на компоненты, инфляции и проблем с логистикойВ России в январе этого года ряд отечественных производителей телеком-оборудования повысил цены на свою продукцию на 10–30 %, пишет «Коммерсантъ». Практически все опрошенные «Коммерсантом» компании объясняют рост цен увеличением стоимости компонентов, усложнением цепочек поставок компонентов, ростом ключевой ставки и колебаниями курсов валют. В компании «Элтекс», известившей заказчиков о повышении цен с 21 января на 20 %, объяснили этот шаг удорожанием необходимых для производства комплектующих и «усложнением логистических цепочек». В РДП.ру, занимающейся производством систем фильтрации трафика, маршрутизаторов и т. д., сообщили «Коммерсанту» о росте стоимости продукции в среднем на 30 % из-за увеличения цен на аппаратные платформы и комплектующие, а также перехода на отечественные аналоги зарубежных решений. Директор производителя сетевого оборудования «Вектор Технологии» рассказал газете, что с нового года были увеличены цены «в среднем менее чем на 10 %», в том числе, из-за «инфляции, зарплатных ожиданий сотрудников и изменения курсов валют». В Fplus не планируют в этом году повышения цен «в виде добавления фиксированного процента к цене продукта», разве что «точечно», если потребуют рыночные условия. Глава компании объяснил рост стоимости компонентов в прошлом году инфляцией и «стоимостью финансирования сделки, которое, благодаря текущим ставкам, стоит больше, чем в прошлом году». Также в числе факторов повышения он назвал сложности с доступностью «некоторых компонентов в силу санкционных ограничений». При этом дальнейшего повышения цен выше уровня инфляции производители не планируют из-за ограниченной покупательной способности. В нынешних условиях эксперты предлагают компаниям выходить на другие рынки, чтобы можно было увеличивать производство и снижать цены, поскольку себестоимость мелкосерийного производства заведомо дороже.

28.01.2025 [23:00], Руслан Авдеев

Первый ЦОД Stargate получит собственные газовые турбины, солнечную электростанцию и энергохранилище

caterpillar

crusoe energy

general electric

hardware

openai

oracle

softbank

stargate

аккумулятор

ибп

ии

кадры

сша

цод

электропитание

энергетика

Для бесперебойного снабжения электроэнергией американского суперпроекта Stargate, помимо подключения к энергосети, будут использоваться солнечная энергия, природный газ, аккумуляторные энергохранилища и дизель-генераторы, сообщает Datacenter Dynamics. Строительство первого ЦОД уже начато в Техасе. По данным источников Bloomberg, знакомых с планами развития Stargate, часть энергии, вероятно, будет поступать от SB Energy, дочерней структуры компании SoftBank, предлагающей солнечные и аккумуляторные решения. SB Energy уже довольно давно планировала запитать ЦОД в Техасе. В прошлом году компания объявила о трёх соответствующих проектах для дата-центров Google. Речь идёт о «солнечном поясе» Orion Solar Belt — солнечных электростанциях Orion I, Orion II и Orion III суммарной мощностью почти 900 МВт (258 МВТ, 302 МВт и 315 МВт соответственно). OpenAI сообщила журналистам, что рассматриваются различные варианты модернизации энергосистемы Соединённых Штатов с использованием самых разных технологий — от атомной энергетики до аккумуляторных энергохранилищ. Поскольку одной только солнечной энергии для Stargate вряд ли хватит, OpenAI будет использовать и другие источники. Подрядчики Stargate уже подали заявку на строительство электростанции на природном газе мощностью 360,5 МВт и стоимостью около $500 млн. Всего будет задействовано десять газовых турбин — по пять от GE Vernova и Solar Turbines («дочка» Caterpillar). Они напрямую будут питать дата-центр. Заявку подала компания, работающая в интересах Crusoe Energy, которая, в свою очередь, ещё летом начала строительство 205-МВт ИИ ЦОД для Oracle и OpenAI в техасском Абилине (Abilene), также известного как Project Ludicrous. Именно этот кампус, как ожидается, станет первой действующей площадкой Stargate. Кроме того, уже получено разрешение на установку резервных дизель-генераторов. Дополнительно появилась информация о том, что OpenAI ищет для Stargate менеджера по закупкам, ответственного за оборудованиее и работу с поставщиками, и технического руководителя программ, отвечающий за инфраструктурную стратегию. Обе вакансии предполагают широкий круг обязанностей, от соискателей требуется не менее пяти лет опыта работы в крупных проектах. Не так давно OpenAI уже переманила из Meta✴ специалиста по цепочкам поставок для помощи в реализации проекта Stargate.

28.01.2025 [18:40], Владимир Мироненко

«Рынки ошибаются»: DeepSeek не угрожает NVIDIA и другим американским IT-гигантам

deepseek

fortune

hardware

nvidia

анализ рынка

ии

инференс

китай

прогноз

санкции

сша

ускоритель

финансы

Рост популярности ИИ-технологий способствовал росту рыночной стоимости NVIDIA выше $3 трлн. Однако её акции обрушились в понедельник на 17 %, вызвав падение рыночной стоимости компании почти на $600 млрд, после анонса китайским стартапом DeepSeek ИИ-моделей V3 и R1, способных соперничать с лучшими моделями любой американской компании, хотя и были обучены за малую часть стоимости на менее продвинутых чипах NVIDIA H800 и A100, пишет Fortune. Также в начале недели приложение AI Assistant стартапа DeepSeek вышло на первое место в рейтинге самых популярных бесплатных приложений в интернет-магазине в Apple App Store в США, опередив ИИ-чат-бот ChatGPT от OpenAI. Более того, модель DeepSeek R1, призванная бросить вызов модели «рассуждений» OpenAI o1, можно запустить на рабочей станции, а не в ЦОД. Поскольку мощные ускорители NVIDIA являются одной из самых больших статей расходов на разработку самых передовых моделей ИИ, инвесторы начали пересматривать свои представления относительно вложений в ИИ-бизнес. Да, DeepSeek явно потряс рынок ИИ, однако разговоры о крахе NVIDIA могут быть преждевременными, равно как и заявления о том, что успех DeepSeek означает, что США следует отказаться от политики, направленной на ограничение доступа Китая к самым передовым ИИ-чипам, предупреждают аналитики Fortune. DeepSeek утверждает, что использует 10 тыс. ускорителей NVIDIA A100, а также чипы H800, что на порядок меньше, чем используют американские компании для обучения своих самых передовых ИИ-моделей. Например, Xai Илона Маска (Elon Musk) построила вычислительный кластер Colossus в Теннесси на базе 100 тыс. ускорителей NVIDIA H100, его планирует расширить до 1 млн чипов. Это дало повод некоторым экспертам утверждать, что введение ограничений США подстегнуло инновации в Китае. В Fortune считают такие умозаключения недальновидными и утверждают, что влияние DeepSeek может, как это ни парадоксально звучит на первый взгляд, увеличить спрос на передовые чипы ИИ — как NVIDIA, так и её конкурентов. Причина отчасти заключена в феномене, известном как парадокс Джевонса (Jevons Paradox). Парадокс Джевонса, также известный как эффект отскока, назван в честь британского экономиста XIX века Уильяма Стэнли Джевонса (William Stanley Jevons), который заметил: когда технический прогресс делает использование ресурса более эффективным, общее потребление этого ресурса имеет тенденцию к увеличению. Это имеет смысл, если спрос на что-либо относительно эластичен — снижающаяся из-за повышения эффективности цена создаёт ещё больший спрос на продукт. Одной из причин слабого внедрения ИИ-моделей в крупных организациях была их дороговизна. Это особенно касалось новых «рассуждающих» моделей, таких как o1 от OpenAI. Модели DeepSeek гораздо дешевле конкурентов в эксплуатации, так что теперь компании могут позволить себе развёртывать их для многих сценариев использования. В масштабах отрасли это может привести к резкому росту спроса на вычислительную мощность. В понедельник гендиректор Microsoft Сатья Наделла (Satya Nadella) и бывший гендиректор Intel Пэт Гелсингер (Pat Gelsinger) указали на это в сообщениях в социальных сетях. Наделла напрямую сослался на парадокс Джевонса, в то время как Гелсингер сказал, что «вычисления подчиняются» тому, что он назвал «законом газа». «Если сделать его значительно дешевле, рынок для него расширится… это сделает ИИ гораздо более широко распространенным, — написал он. — Рынки ошибаются». В Fortune задались вопросом: «Какая именно вычислительная мощность потребуется?». Топовые ускорители NVIDIA оптимизированы для обучения крупнейших больших языковых моделей (LLM), таких как GPT-4 от OpenAI или Claude 3-Opus от Anthropic. Для инференса чипы NVIDIA меньше подходят, чем изделия конкурентов, включая AMD и, например, Groq, чипы которых позволяют исполнять ИИ-нагрузки быстрее и намного эффективнее. Google и Amazon также создают свои собственные чипы ИИ, некоторые из которых оптимизированы для инференса. NVIDIA сейчас занимает более 80 % рынка ИИ-вычислений на базе ЦОД (если исключить кастомные ASIC облачных провайдеров, её доля может составить до 98 %) и вряд ли утратит доминирование быстро или полностью, отметили в Fortune. Ёе ускорители также могут использоваться для инференса, а программная платформа CUDA имеет большое и лояльное сообщество разработчиков, которое вряд ли откажется от него в одночасье. Если общий спрос на ИИ-чипы увеличится из-за парадокса Джевонса, общие доходы NVIDIA всё равно смогут вырасти даже при падении доли на рынке из-за увеличившегося рынка. Ещё одна причина, по которой спрос на передовые ИИ-чипы, вероятно, продолжит рост, связана с особенностями работы моделей рассуждений, таких как R1. В то время как способности предыдущих типов LLM росли по мере увеличения доступной вычислительной мощности во время обучения, то модели рассуждений зависят от вычислительных ресурсов во время инференса — чем их больше, тем лучше ответы. Запустив R1 на ноутбуке, можно получить хороший ответ на сложный математический вопрос, скажем, через час, в то время как при использовании ускорителей в облаке на тот же ответ уйдут считанные секунды. Для многих бизнес-приложений задержка или время, необходимое модели для ответа, имеет большое значение. И чтобы сократить время выполнения задачи, по-прежнему будут нужны передовые ИИ-ускорители. Кроме того, многие эксперты сомневаются в правдивости заявления DeepSeek о том, что её модель V3 была обучена примерно на 2048 урезанных ускорителях NVIDIA H800 или что её модель R1 была обучена на столь малом количестве чипов. Александр Ван (Alexandr Wang), генеральный директор Scale AI, сообщил в интервью CNBC, что, по его данным, DeepSeek тайно получила доступ к кластеру из 50 тыс. ускорителей H100. Также известно, что хедж-фонд HighFlyer, которому принадлежит DeepSeek, успел закупить до введения санкций значительное количество менее производительных ускорителей NVIDIA. Так что вполне возможно, что NVIDIA находится в лучшем положении, чем предполагают паникующие инвесторы, и что проблема с экспортным контролем США заключается не в политике, а в её реализации, подытожили аналитики Fortune.

28.01.2025 [15:50], Руслан Авдеев

Blackstone купит газовую электростанцию в аллее дата-центровПодразделение Blackstone Energy Transition Partners, занимающееся инвестициями в энергетику, купит 774-МВт электростанцию Potomac Energy Center, работающую на природном газе, у Ares Management. Электростанция расположена в округе Лаудон (Вирджиния), где находится т.н. «аллея дата-центров», сообщает Reuters. В прошлом году Blackstone и EQT объявили о создании совместного предприятия с капиталом $3,5 млрд для строительства газопровода. Финансовая сторона проекта не разглашалась, но источники сообщают, что стоимость сделки составит $1 млрд. Северная Вирджиния является крупнейшим в мире рынком дата-центров, превосходящим по ёмкости все прочие, включая, например, рынок Китая. Вероятно, это и стало одним из факторов, повлиявших на решение о покупке. По данным пресс-службы Blackstone, вблизи электростанции находится порядка 130 дата-центров. По данным представителя Energy Transition Partners, речь идёт об уникальной возможности — не только из-за чрезвычайно удачного местоположения электростанции рядом с огромным парком ЦОД, но и из-за высокой эффективности электростанции. Кроме того, это относительно новый объект — электростанция была введена в коммерческую эксплуатацию в 2017 году. Рост числа и масштаба ИИ-проектов ведёт к стремительному росту спроса и на энергию для дата-центров. Активы, связанные с энергетикой, включая газовые электростанции, стали невероятно востребованными среди инвесторов. Они очень важны для ЦОД, которым требуется круглосуточное стабильное электроснабжение. Так, Constellation Energy объявила о покупке Calpine Energy за $26,6 млрд (если учитывать компенсацию за долги компании). Calpine — крупнейший в США производитель электричества из природного газа и геотермальных источников (79 объектов, более 2,7 ГВт). Впрочем, как сообщает Datacenter Dynamics, эксперты не исключают того, что рост ЦОД в Северной Вирджинии когда-нибудь обгонит поставки электроэнергии. В прошлом году власти Вирджинии опубликовали отчёт, согласно которому для удовлетворения спроса ЦОД потребуется запускать по газовой электростанции мощностью 1,5 ГВт каждые два года в течение 15 лет. Ранее предсказывалось, что рост рынка ЦОД подстегнёт спрос на природный газ в США. Blackstone приобрела несколько ЦОД за последние 12 месяцев. В сентябре 2024 года она купила австралийскую компанию AirTrunk за $16,1 млрд — это одна из крупнейших сделок на рынке. Облачная ИИ-компания CoreWeave в мае 2024 года объявила о получении в долг от инвестиционных компаний, включая Blackstone, $7,5 млрд. Пока в портфолио Blackstone имеются ЦОД на $70 млрд, в перспективе оно, вероятно, расширится ещё на $100 млрд.

28.01.2025 [15:38], Руслан Авдеев

Газ и атом: NextEra с GE Vernova развернут газовые турбины и перезапустят АЭС, чтобы запитать ИИ ЦОДАмериканский производитель энергии NextEra Energy заключил соглашение с поставщиком энергетического оборудования GE Vernova — компании совместно организуют поставки энергии газовых электростанций для ЦОД. Кроме того, NextEra намерена перезапустить АЭС Duane Arnold Energy Center (DAEC) в Айове, сообщает Datacenter Dynamics. Об этом NextEra рассказала во время публикации финансового отчёта за IV квартал и 2024 год в целом. По словам NextEra, рамочное соглашение с GE Vernova будет действовать четыре года. Компании будут вместе искать узловые точки в энергосистеме США, которые выиграют от новых генерирующих мощностей. Новое сотрудничество позволит поставить до нескольких гигаватт дата-центрам и другим промышленным объектам, перенести производство энергии и улучшить обслуживание коммунальных предприятий, муниципалитетов, коммерческих и иных структур. Партнёрство рассчитано на крупных клиентов и обеспечит комплексное решение, предусматривающее использование газовых генерирующих мощностей, возобновляемых источников энергии и энергохранилищ, которыми партнёры намерены владеть в равных долях. Клиенты смогут рассчитывать на долгосрочное сотрудничество. В NextEra даже допускают возможность передачи права собственности на газовую генерацию, если это станет частью более масштабной сделки, которая будет включать возобновляемые источники энергии. Что касается 601-МВт АЭС Duane Arnold, о перезапуске которой сообщалось ранее, компания уже обратилась в Комиссию по ядерному регулированию (NRC). Ожидается, что станция, проработавшая 45 лет и закрытая в 2020 году, сможет снова заработать уже к концу 2028 года. Впрочем, NextEra признаёт, что перезапуск не сможет в действительно значимой степени удовлетворить рост спроса на энергию для ЦОД. Поэтому приходится рассчитывать на возобновляемые источники энергии и энергохранилища, а постепенно к ним добавится и генерация энергии на природном газе. Заявления соответствуют распространённой в последнее время среди коммунальных служб концепции — на фоне роста спроса на электричество они готовы использовать все доступные источники энергии. В результате природный газ всё больше востребован в сегменте энергетики для ЦОД, несколько производителей электричества объявили об инвестициях в соответствующий рынок. Ранее в январе поддерживаемая Сэмом Альтманом (Sam Altman) компания Oklo совместно с RPower объявили о трёхэтапном подходе к питанию, который предусматривает установку генераторов на природном газе в течение 24 месяцев для удовлетворения насущных потребностей ИИ ЦОД. Позже, по мере коммерческой готовности, будут установлены малые модульные реакторы (SMR) компании Oklo, а газовые генераторы будут использоваться только в качестве резервных питания.

28.01.2025 [13:32], Сергей Карасёв

Tamboran Resources предложила военным США и Австралии ЦОД на природном газе стоимостью $5 млрдАвстралийская газоэнергетическая компания Tamboran Resources, по сообщению Datacenter Dynamics, представила новому правительству США проект дата-центра, работающего на природном газе. Стоимость строительства такого комплекса оценивается в $5 млрд. Tamboran Resources была основана в 2009 году. Своей целью компания ставит поддержку перехода к энергетике с нулевыми выбросами углекислого газа в Австралии и Азиатско-Тихоокеанском регионе. Для этого ведётся разработка экологичных газовых ресурсов на севере Австралии. Новый проект Tamboran Resources предполагает создание ЦОД, для энергоснабжения которого планируется задействовать газовые месторождения компании в бассейне Биталу (Beetaloo Basin, Северная территория). Дата-центр, как ожидается, смогут использовать оборонные ведомства, базирующиеся на таких объектах, как Пайн-Гэп (Pine Gap) — это совместная американо-австралийская станция спутниковой и радиоэлектронной разведки. Она находится в ведении австралийского Оборонного радиотехнического управления, Центрального разведывательного управления США (ЦРУ), Агентства национальной безопасности США (АНБ) и Национального разведывательного управления США (NRO).

Источник изображения: Tamboran Resources Отмечается, что генеральный директор Tamboran Resources Джоэл Риддл (Joel Riddle) ранее вылетел в Вашингтон, чтобы обсудить возможность привлечения средств на строительство ЦОД с американскими чиновниками, агентствами и потенциально заинтересованными инвесторами. По словам Риддла, Северная территория хорошо подходит для создания дата-центров благодаря наличию обильных энергетических ресурсов, обширных территорий и существующей инфраструктуры. Сама Tamboran Resources получает поддержку со стороны американской нефтесервисной компании Liberty Energy, генеральным директором которой является Крис Райт (Chris Wright), недавно приведённый к присяге в качестве нового министра энергетики США. По мнению экспертов, стремительный рост рынка дата-центров в США, связанный с быстрым внедрением ИИ, приведёт к увеличению спроса на природный газ. На этом фоне Blackstone и EQT намерены сформировать совместное предприятие стоимостью $3,5 млрд для строительства газопровода. А компании Oklo и RPower займутся созданием гибридной модели электроснабжения ЦОД с использованием природного газа и атомной энергии. Вместе с тем американская криптомайнинговая компания MARA (Marathon Digital Holdings) запустила микро-ЦОД на 25 МВт с питанием от попутного (факельного) газа с нефтяных скважин в Техасе и Северной Дакоте.

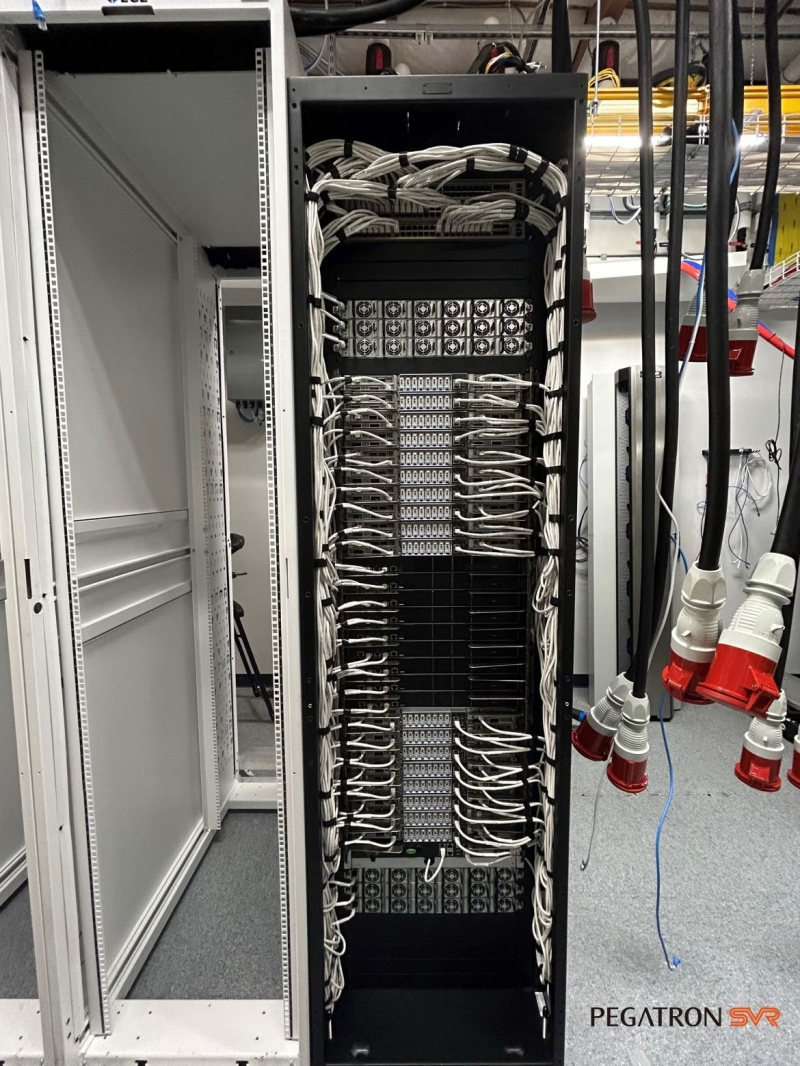

28.01.2025 [12:10], Сергей Карасёв

Pegatron поставит суперускорители NVIDIA GB200 NVL72 ИИ-стартапу Lambda LabsСтартап Lambda Labs, по сообщению ресурса Datacenter Dynamics, заключил партнёрское соглашение с серверным подразделением тайваньского ODM-производителя компьютерных комплектующих Pegatron. В рамках договора Pegatron развернёт суперускорители NVIDIA GB200 NVL72 для ИИ-инфраструктуры Lambda Labs. Напомним, фирма Lambda Labs была основана в 2012 году. Она предоставляет услуги облачных ИИ-вычислений с использованием собственных систем, оснащённых ускорителями NVIDIA, а также процессорами AMD и Intel. Кроме того, компания продаёт рабочие станции на базе GPU и предоставляет услуги колокации. Lambda Labs провела несколько раундов финансирования: полученные средства направляются на наращивание вычислительных мощностей и увеличение штата. В июле 2024 года сообщалось, что у суперускорителей с чипами NVIDIA GB200 возникли проблемы с СЖО: из-за дефектных компонентов фиксировались протечки. А в ноябре появилась информация, что стойки NVL72 перегревались, в связи с чем NVIDIA была вынуждена обратиться к поставщикам с просьбой внести ряд изменений в конструкцию стоек. Кроме того, NVIDIA и Schneider Electric занялись разработкой эталонной архитектуры охлаждения для ЦОД на основе GB200 NVL72. Впрочем, на текущий момент все проблемы устранены, а NVIDIA и партнёры организовали полномасштабное производство серверов на базе Blackwell. При этом клиенты уже приступили к монтажу суперускорителей GB200 NVL72. Такие системы, в частности, устанавливает стартап xAI Илона Маска (Elon Musk). Как отмечается, стратегическое партнёрство с Lambda Labs позволит Pegatron выйти на стремительно расширяющийся рынок ИИ-серверов. Первая система GB200 NVL72 (производства Supermicro), принадлежащая Lambda, была запущена на прошедших выходных в «водородном» дата-центре EdgeCloudLink. |

|