Материалы по тегу: ии

|

06.10.2021 [13:07], Сергей Карасёв

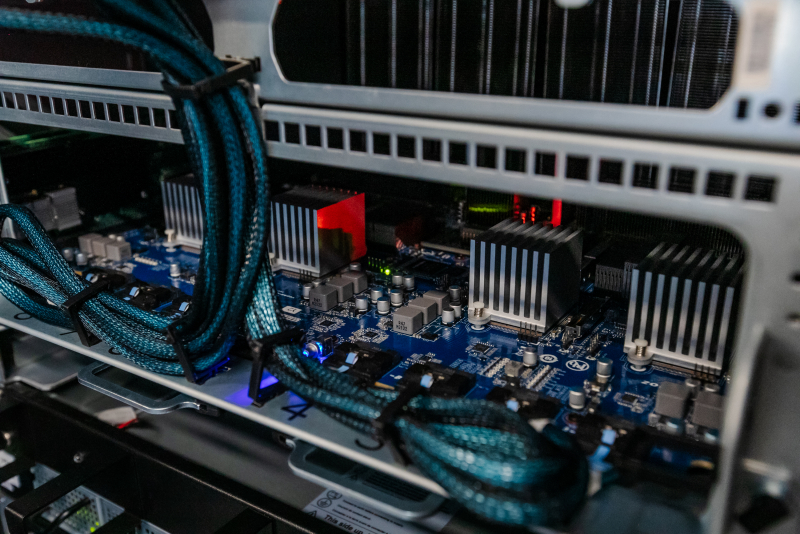

«Яндекс», «ЛАНИТ», Gigabyte и ВТБ вложат 1 млрд руб. в российский завод по выпуску серверовВ России неподалёку от Рязани, на территории индустриального парка «Рязанский», началось строительство нового завода по производству серверов. Проект реализуется совместным предприятием, созданным «Яндексом», группой компаний «ЛАНИТ», разработчиком компьютерной техники Gigabyte и банком ВТБ. На заводе будет выпускаться оборудование под торговой маркой Openyard. В частности, планируется организовать производство серверов, систем хранения данных, шлюзов и компонентов умных устройств. Участники проекта на начальном этапе вложат в новую производственную площадку более миллиарда рублей. Пуско-наладочные работы намечены на третий квартал следующего года: их выполнят специалисты Gigabyte. Первый сервер со сборочных линий должен сойти до конца 2022-го. «Первая очередь будет включать производственные линии, лаборатории и тестовые зоны. Здесь будут выполняться все операции, начиная от поверхностного монтажа компонентов и заканчивая испытаниями готовой продукции», — говорится в сообщении.

Фото: Яндекс Производимые в Рязани серверы будут спроектированы на основе разработок и технологий «Яндекса». Отмечается, что выбор места для строительства завода продиктован хорошей транспортной доступностью, наличием необходимых коммуникаций и близостью учебных заведений, которые готовят профильных специалистов.

28.08.2021 [00:16], Владимир Агапов

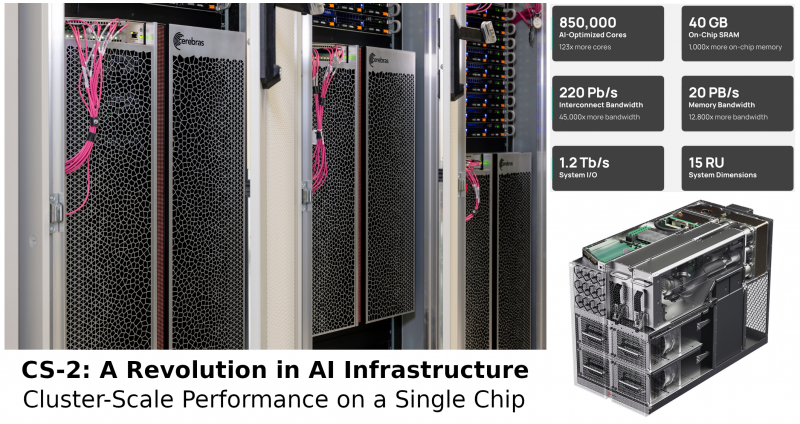

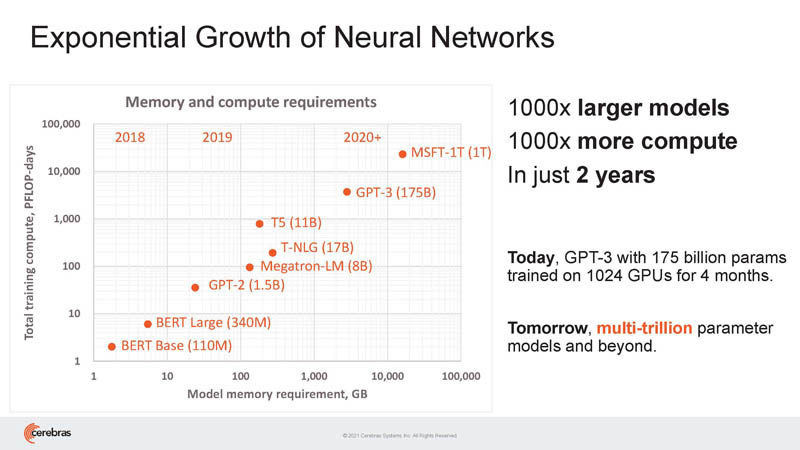

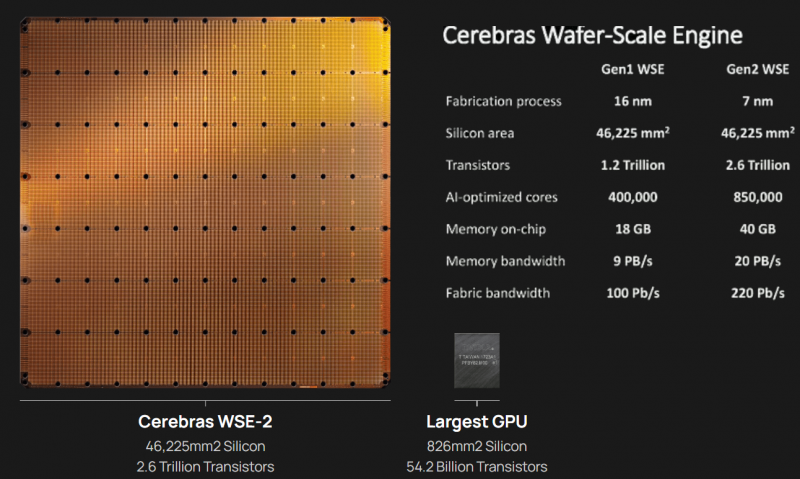

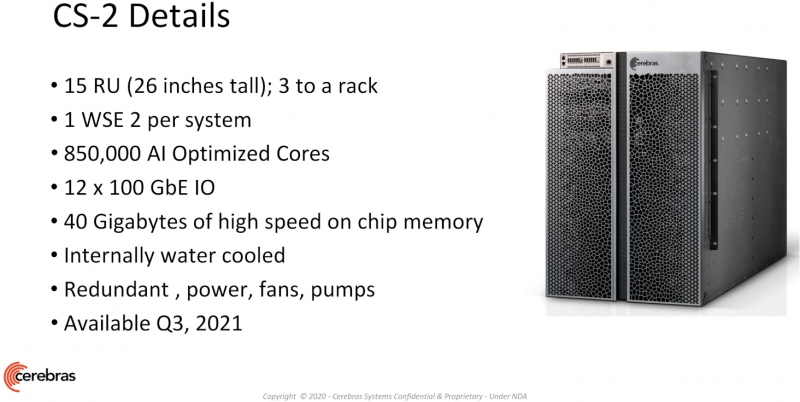

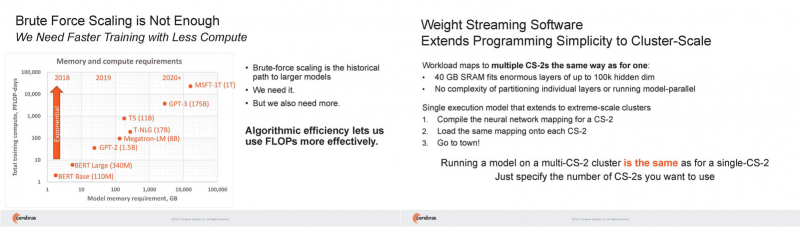

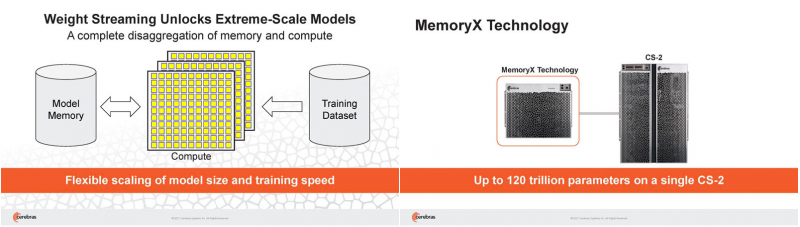

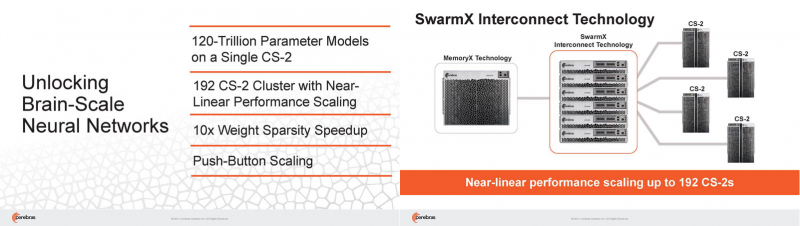

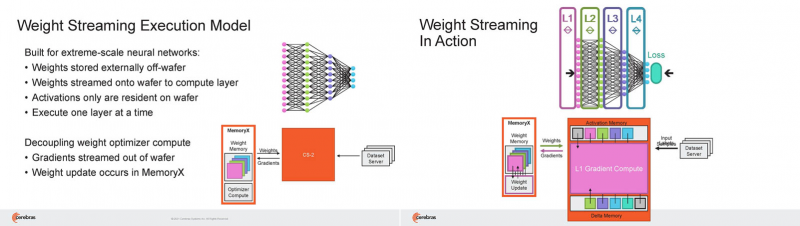

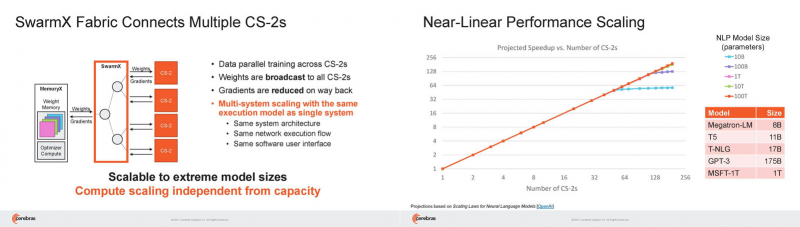

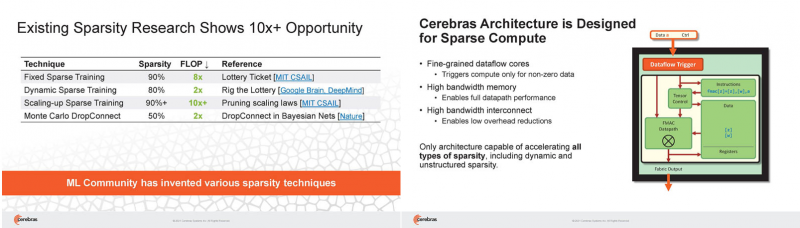

Кластер суперчипов Cerebras WSE-2 позволит тренировать ИИ-модели, сопоставимые по масштабу с человеческим мозгомВ последние годы сложность ИИ-моделей удваивается в среднем каждые два месяца, и пока что эта тенденция сохраняется. Всего три года назад Google обучила «скромную» модель BERT с 340 млн параметров за 9 Пфлоп-дней. В 2020 году на обучение модели Micrsofot MSFT-1T с 1 трлн параметров понадобилось уже порядка 25-30 тыс. Пфлоп-дней. Процессорам и GPU общего назначения всё труднее управиться с такими задачами, поэтому разработкой специализированных ускорителей занимается целый ряд компаний: Google, Groq, Graphcore, SambaNova, Enflame и др. Особо выделятся компания Cerebras, избравшая особый путь масштабирования вычислительной мощности. Вместо того, чтобы печатать десятки чипов на большой пластине кремния, вырезать их из пластины, а затем соединять друг с другом — компания разработала в 2019 г. гигантский чип Wafer-Scale Engine 1 (WSE-1), занимающий практически всю пластину. 400 тыс. ядер, выполненных по 16-нм техпроцессу, потребляют 15 кВт, но в ряде задач они оказываются в сотни раз быстрее 450-кВт суперкомпьютера на базе ускорителей NVIDIA. В этом году компания выпустила второе поколение этих чипов — WSE-2, в котором благодаря переходу на 7-нм техпроцесс удалось повысить число тензорных ядер до 850 тыс., а объём L2-кеша довести до 40 Гбайт, что примерно в 1000 раз больше чем у любого GPU. Естественно, такой подход к производству понижает выход годных пластин и резко повышает себестоимость изделий, но Cerebras в сотрудничестве с TSMC удалось частично снизить остроту этой проблемы за счёт заложенной в конструкцию WSE избыточности. Благодаря идентичности всех ядер, даже при неисправности некоторых их них, изделие в целом сохраняет работоспособность. Тем не менее, себестоимость одной 7-нм 300-мм пластины составляет несколько тысяч долларов, в то время как стоимость чипа WSE оценивается в $2 млн. Зато система CS-1, построенная на таком процессоре, занимает всего треть стойки, имея при этом производительность минимум на порядок превышающую самые производительные GPU. Одна из причин такой разницы — это большой объём быстрой набортной памяти и скорость обмена данными между ядрами. Тем не менее, теперь далеко не каждая модель способна «поместиться» в один чип WSE, поэтому, по словам генерального директора Cerebras Эндрю Фельдмана (Andrew Feldman), сейчас в фокусе внимания компании — построение эффективных систем, составленных из многих чипов WSE. Скорость роста сложности моделей превышает возможности увеличения вычислительной мощности путём добавления новых ядер и памяти на пластину, поскольку это приводит к чрезмерному удорожанию и так недешёвой системы. Инженеры компании рассматривают дезагрегацию как единственный способ обеспечить необходимый уровень производительности и масштабируемости. Такой подход подразумевает разделение памяти и вычислительных блоков для того, чтобы иметь возможность масштабировать их независимо друг от друга — параметры модели помещаются в отдельное хранилище, а сама модель может быть разнесена на несколько вычислительных узлов CS, объединённых в кластер. На Hot Chips 33 компания представила особое хранилище под названием MemoryX, сочетающее DRAM и флеш-память суммарной емкостью 2,4 Пбайт, которое позволяет хранить до 120 трлн параметров. Это, по оценкам компании, делает возможным построение моделей близких по масштабу к человеческому мозгу, обладающему порядка 80 млрд. нейронов и 100 трлн. связей между ними. К слову, флеш-память размером с целую 300-мм пластину разрабатывает ещё и Kioxia. Для обеспечения масштабирования как на уровне WSE, так и уровне CS-кластера, Cerebras разработала технологию потоковой передачи весовых коэффициентов Weight Streaming. С помощью неё слой активации сверхкрупных моделей (которые скоро станут нормой) может храниться на WSE, а поток параметров поступает извне. Дезагрегация вычислений и хранения параметров устраняет проблемы задержки и узости пропускной способности памяти, с которыми сталкиваются большие кластеры процессоров. Это открывает широкие возможности независимого масштабирования размера и скорости кластера, позволяя хранить триллионы весов WSE-2 в MemoryX и использовать от 1 до 192 CS-2 без изменения ПО. В традиционных системах по мере добавления в кластер большего количества вычислительных узлов каждый из них вносит всё меньший вклад в решение задачи. Cerebras разработала интерконнект SwarmX, позволяющий подключать до 163 млн вычислительных ядер, сохраняя при этом линейность прироста производительности. Также, компания уделила внимание разрежённости, то есть исключения части незначимых для конечного результата весов. Исследования показали, что должная оптимизации модели позволяет достичь 10-кратного увеличения производительности при сохранении точности вычислений. В CS-2 доступна технология динамического изменения разрежённости Selectable Sparsity, позволяющая пользователям выбирать необходимый уровень «ужатия» модели для сокращение времени вычислений. «Крупные сети, такие как GPT-3, уже изменили отрасль машинной обработки естественного языка, сделав возможным то, что раньше было невозможно и представить. Индустрия перешла к моделям с 1 трлн параметров, а мы расширяем эту границу на два порядка, создавая нейронные сети со 120 трлн параметров, сравнимую по масштабу с мозгом» — отметил Фельдман.

26.08.2021 [03:07], Алексей Степин

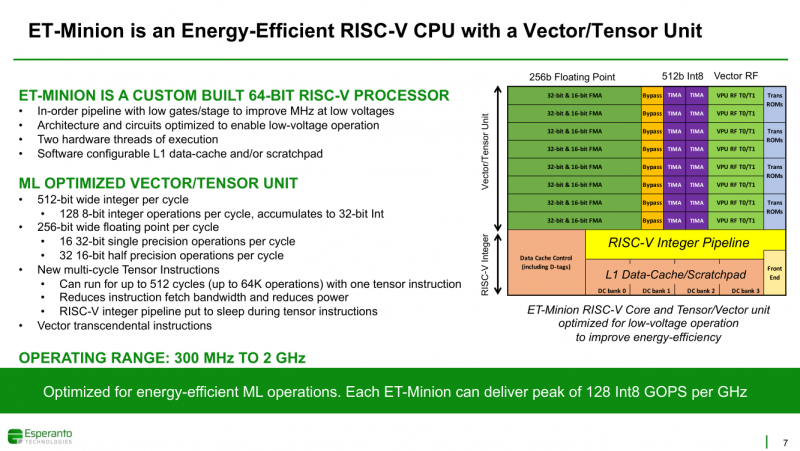

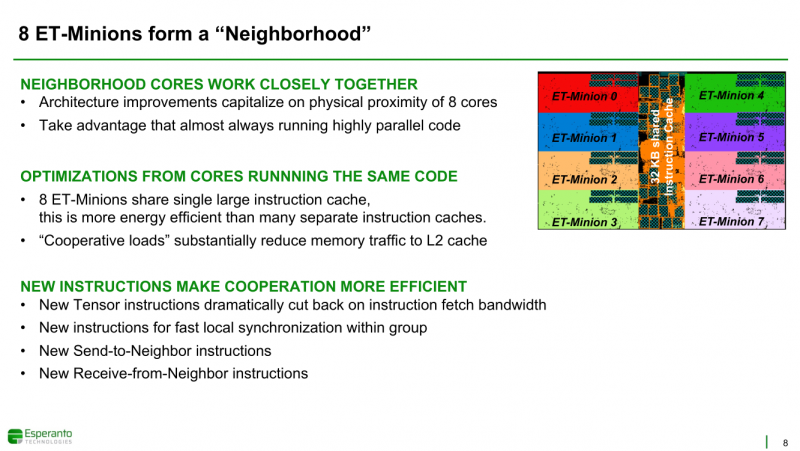

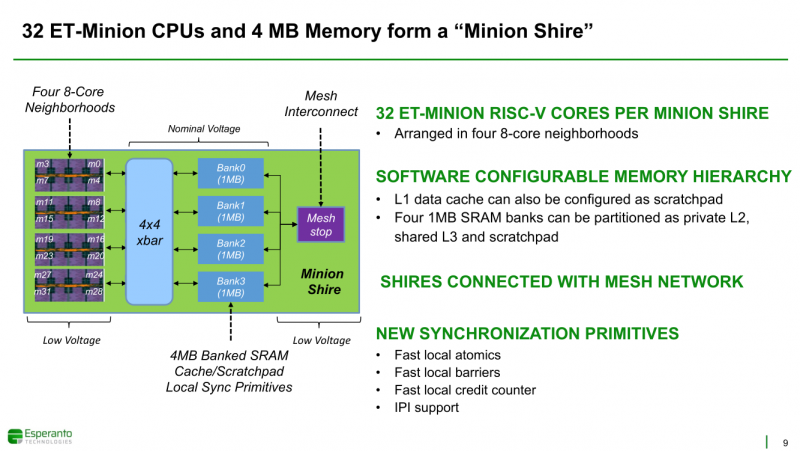

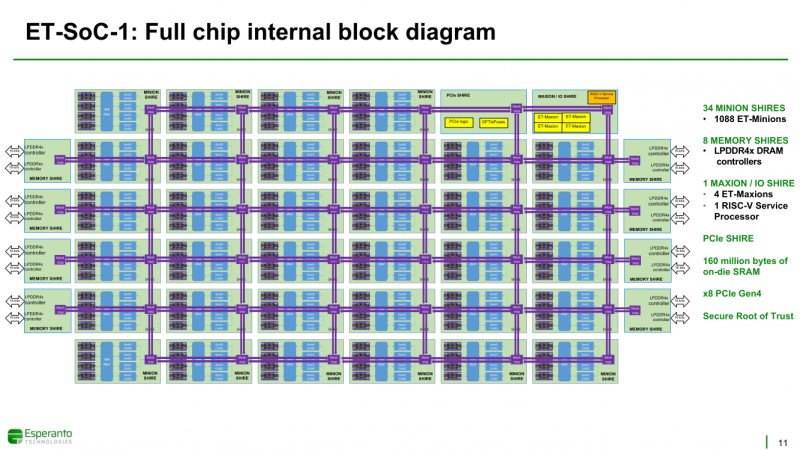

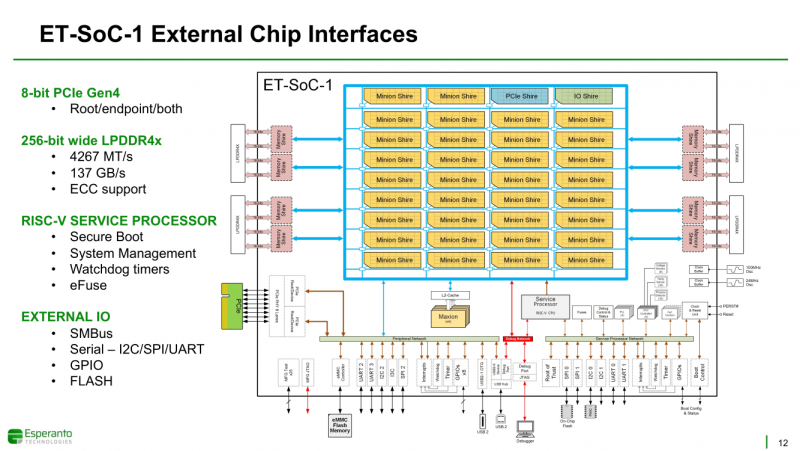

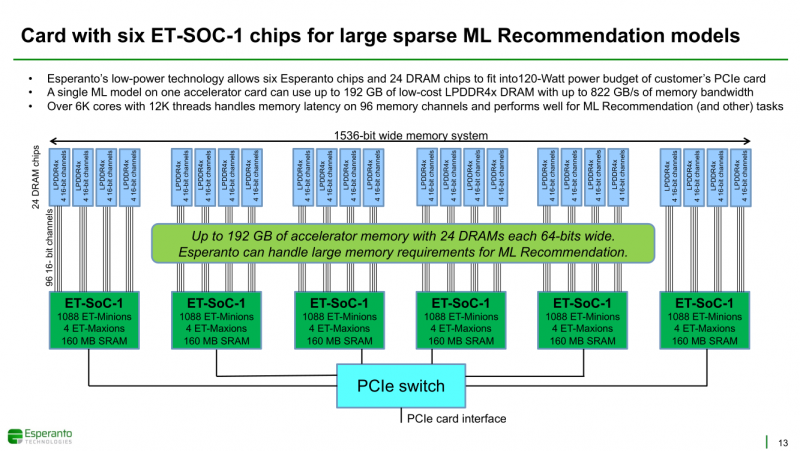

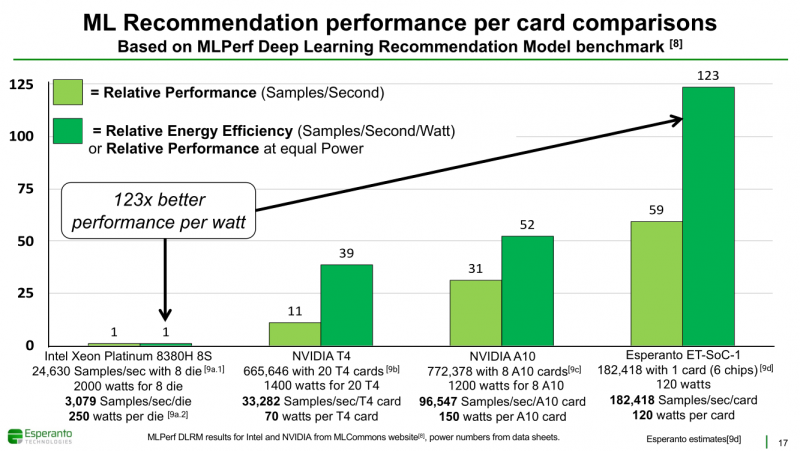

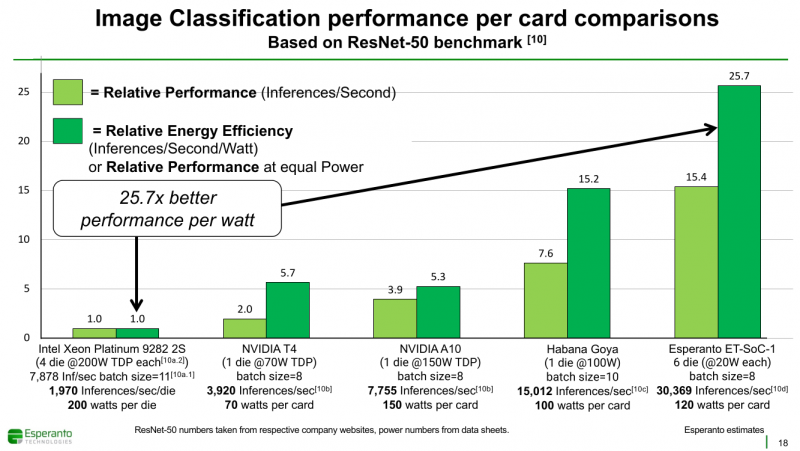

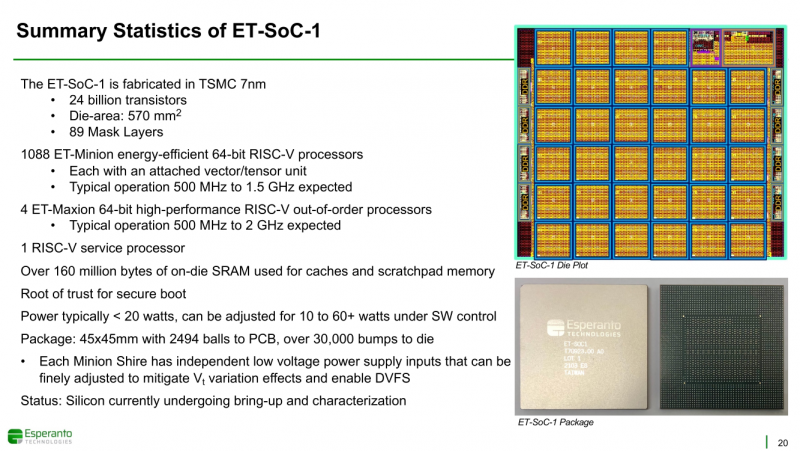

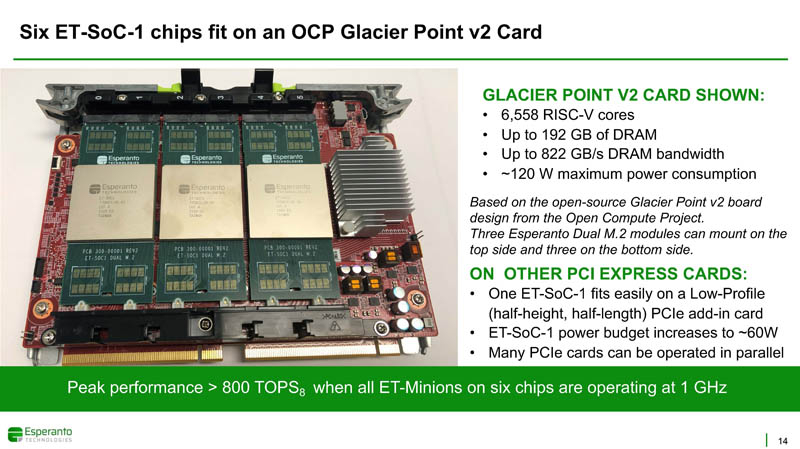

Получены первые образцы 1000-ядерного суперкомпьютера-на-чипе Esperanto ET-SoC-1Рекомендательные системы, активно используемые социальными сетями, рекламными платформами и т.д. имеют специфические особенности. От них требуется высокая скорость отклика, но вместе с тем их ИИ-модели весьма объёмны, порядка 100 Гбайт или более. А для их эффективной работы нужен ещё и довольно большой кеш. Для инференса чаще всего используется либо CPU (много памяти, но относительно низкая скорость) или GPU (высокая скорость, но мало памяти), но они не слишком эффективны для этой задачи. При этом существуют ещё и физические ограничения со стороны гиперскейлеров: в сервере не так много полноценных PCIe-слотов и свободного места + есть жёсткие ограничения по энергопотреблению и охлаждению (чаще всего воздушному). Всё это было учтено компанией Esperanto, чьей специализацией является разработка чипов на базе архитектуры RISC-V. На днях она получила первые образцы ИИ-ускорителя ET-SoC-1, который она сама называет суперкомпьютером-на-чипе (Supercomputer-on-Chip).  Новинка предназначена для инференса рекомендательных систем, в том числе на периферии, где на первый план выходит экономичность. Компания поставила для себя непростую задачу — весь комплекс ускорителей с памятью и служебной обвязкой должен потреблять не более 120 Вт. Для решения этой задачи пришлось применить немало ухищрений. Самое первое и очевидное — создание относительно небольшого, но универсального чипа, который можно было бы объединять с другими такими же чипами с линейным ростом производительности. Для достижения высокой степени параллелизма основой такого чипа должны стать небольшие, но энергоэффективные ядра. Именно поэтому выбор пал на 64-бит ядра RISC-V, поскольку они «просты» не только с точки зрения ISA, но и по транзисторному бюджету. Чип ET-SoC-1 сочетает в себе два типа ядер RISC-V: классических «больших» ядер (ET-Maxion) с внеочередным выполнением у него всего 4, зато «малых» ядер (ET-Minion) с поддержкой тензорных и векторных вычислений — целых 1088. На комплекс ядер ET-Maxion возлагаются задачи общего назначения и в ИИ-вычислениях он напрямую не участвует, зато позволяет быть ET-SoC-1 полностью автономным, так как прямо на нём можно запустить Linux. Помогает ему в этом ещё один служебный RISC-V процессор для периферии. А вот ядра ET-Minion довольно простые: внеочередного исполнения инструкций в них нет, зато есть поддержка SMT2 и целый набор новых инструкций для INT- и FP-операций с векторами и тензорами. За каждый такт ядро ET-Minion способно выполнять 128 INT8-операций с сохранением INT32-результата, 16 FP32-операций или 32 — FP16. «Длинные» тензорные операции могут непрерывно исполняться в течение 512 циклов (до 64 тыс. операций), при этом целочисленные блоки в это время отключаются для экономии питания. Система кешей устроена несколько непривычным образом. На ядро приходится 4 банка памяти, которые можно использовать как L1-кеш для данных и как быструю универсальную память (scratchpad). Восемь ядер ET-Minion формируют «квартал» вокруг общего для них кеша инструкций, так как на таких задачах велика вероятность того, что инструкции для всех ядер действительно будут одни и те же. Кроме того, это энергоэффективнее, чем восемь индивидуальных кешей, и позволяет получать и отправлять данные большими блоками, снижая нагрузку на L2-кеш. Восемь «кварталов» формируют «микрорайон» с коммутатором и четырьмя банками SRAM объёмом по 1 Мбайт, которые можно использовать как приватный L2-кеш, как часть общего L3-кеша или как scratchpad. Посредством mesh-сети «микрорайоны» общаются между собой и с другими блоками: ET-Maxion, восемь двухканальных контроллеров памяти, два root-комплекса PCIe 4.0 x8, аппаратный RoT. Суммарно на чип приходится порядка 160 Мбайт SRAM. Контроллеры оперативной памяти поддерживают модули LPDDR4x-4267 ECC (256 бит, до 137 Гбайт/с). Тактовая частота ET-Minion варьируется в пределах от 500 МГц до 1,5 ГГц, а ET-Maxion — от 500 МГц до 2 ГГц. В рамках OCP-блока Glacier Point V2 компания объединила на одной плате шесть ET-SoC-1 (всего 6558 ядер RISC-V), снабдив их 192 Гбайт памяти (822 Гбайт/с) — это больше, нежели у NVIDIA A100 (80 Гбайт). Такая связка развивает более 800 Топс, требуя всего 120 Вт. В среднем же она составляет 100 ‒ 200 Топс на один чип с потреблением менее 20 Вт. Это позволяет создать компактный M.2-модуль или же наоборот масштабировать систему далее. Шасси Yosemite v2 может вместить 64 чипа, а стойка — уже 384 чипа. В тесте MLPerf для рекомендательных систем производительность указанной выше связки из шести чипов в пересчёте на Ватт оказалась в 123 раза выше, чем у Intel Xeon Platinum 8380H (250 Вт), и в два-три раза выше, чем у NVIDIA A10 (150 Вт) и T4 (70 Вт). В «неудобном» для чипа тесте ResNet-50 разница с CPU и ускорителем Habana Goya уже не так велика, а вот с решениями NVIDIA, напротив, более заметна. При этом о поддержке со стороны ПО разработчики также подумали: чипы Esperanto могут работать с широко распространёнными фреймворками PyTorch, TensorFlow, MXNet и Caffe2, а также принимать готовые ONNX-модели. Есть и SDK для C++, а также драйверы для x86-хостов. Опытные образцы изготовлены на TSMC по 7-нм техпроцессу. Кристалл площадью 570 мм2 содержит 24 млрд транзисторов. Чип имеет упаковку BGA2494 размерами 45 × 45 мм2. Энергопотребление (а вместе с ним и производительность) настраивается в диапазоне от 10 до 60+ Ватт. Потенциальным заказчикам тестовые чипы станут доступны до конца года. Компания также готова адаптировать ET-SoC-1 под другие техпроцессы и фабрики, но демо на базе OCP-платформы и сравнение с Cooper Lake — это недвусмысленный намёк для Facebook✴, что Esperanto будет рада видеть её в числе первых клиентов.

16.08.2021 [16:56], Владимир Агапов

Новая нефть: Норвегия намерена стать «фантастической площадкой» для размещения дата-центровКонцепция развития центров обработки данных (ЦОД) впервые оформилась в Норвегии в 2018 г., когда правительство задалось целью повысить привлекательность своей страны для представителей отрасли. C 2019 г. власти инвестировали в новые ЦОД порядка €255 млн, а также отменили налоги на имущество для производственного оборудования и установок на предприятиях и в других сферах, стимулировали создание оптоволоконных каналов связи и вели работу по информированию партнёров по всем необходимым для начала работы вопросам. Обновлённая стратегия развития ЦОД была представлена министром Линдой Хофстад Хеллеланд (Linda Hofstad Helleland). Она позиционирует Норвегию как оптимальную страну для строительства ЦОД и иностранных инвестиций. В число ключевых преимуществ входят понятные и стабильные правила игры, доступность возобновляемых источников энергии, широкополосной связи, квалифицированной рабочей силы и подключений с высокой безопасностью. Экологический аспект норвежской стратегии усилен требованием к объектам ЦОД о повторном использовании отработанного тепла.

Дата-центр DC1-Stavanger «Ожидается сильный рост экономики, основанной на данных, и здесь Норвегия может внести свой вклад, предлагая устойчивые решения в норвежских дата-центрах для служб социального обеспечения, индустрии аквакультуры и многого другого», — сказала Хеллеланд в предисловии к документу — «Мы должны работать над тем, чтобы в Норвегии стало больше центров обработки данных». Норвегия имеет сильную индустрию возобновляемых источников энергии, стабильность которой поддержана развитой гидроэнергетикой. Хотя страна всё ещё экспортирует нефть, Хеллеланд прогнозирует, что использование искусственного интеллекта и больших данных поможет удвоить темпы роста ВВП Норвегии к 2030 г. и важнейшим условием для этого является увеличение числа дата-центров. Сейчас в секторе ЦОД Норвегии занято всего 2400 человек, но Хеллеланд уверена, что в будущем их число значительно вырастет, поскольку в стране уже несколько лет наблюдается тенденция к росту использования компаниями облачных сервисов. По данным Статистического управления Норвегии, 64% компаний с числом сотрудников больше 10 покупали облачные услуги в 2020 г., что на 51% выше по сравнению с 2018 г. В 2021 г. одну или несколько услуг, предоставляемых из облака, использовали 92% государственных учреждений. Европейская комиссия ожидает рост объёма цифровой экономики в ЕС-27 с €301 млрд. в 2018г до €829 млрд. к 2025г. Ежегодный прирост этого сектора в Норвегии к 2030 г. может достигнуть €29 млрд., что представляет большие экономические возможности для норвежского бизнеса и промышленности, в том числе для игроков из сектора ЦОД.

Дата-центр DC2-Telemark «У нас в Норвегии фантастическая стартовая площадка с хорошим и надежным доступом к возобновляемым источникам энергии, прочной цифровой инфраструктурой, высокой компетентностью и стабильными рамочными условиями. Но конкуренция глобальна, и мы всегда должны становиться лучше. Важно также активно работать на благо местных жителей. Именно поэтому мы сейчас обновляем национальную стратегию создания центров обработки данных — всего через три года после первой инициативы», — добавила Хеллеланд.

16.07.2021 [17:31], Алексей Степин

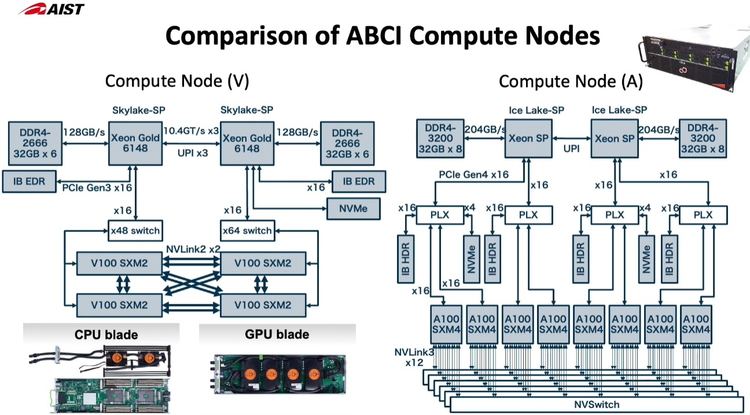

Японский облачный суперкомпьютер ABCI подвергся модернизацииПопулярность идей машинного обучения и искусственного интеллекта приводит к тому, что многие страны и организации планируют обзавестись HPC-системами, специально предназначенными для этого класса задач. В частности, Токийский университет совместно с Fujitsu модернизировал существующую систему ABCI (AI Bridging Cloud Infrastructure), снабдив её новейшими процессорами Intel Xeon и ускорителями NVIDIA. Как правило, когда речь заходит о суперкомпьютерах Fujitsu, вспоминаются уникальные наработки компании в сфере HPC — процессоры A64FX, но ABCI имеет более традиционную гетерогенную архитектуру. Изначально этот облачный суперкомпьютер включал в себя вычислительные узлы на базе Xeon Gold и ускорителей NVIDIA V100, объединённых 200-Гбит/с интерконнектом. В качестве файловой системы применена разработка IBM — Spectrum Scale. Это одна систем, специально созданных для решения задач искусственного интеллекта, при этом доступная независимым исследователям и коммерческим компаниям.  Так, 86% пользователей ABCI не входят в состав Японского национального института передовых технических наук (AIST); их число составляет примерно 2500. Но система явно нуждалась в модернизации. Как отметил глава AIST, с 2019 года загруженность ABCI выросла вчетверо, и сейчас на ней запущено 360 проектов, 60% из которых от внешних заказчиков. Сценарии использования самые разнообразные, от распознавания видео до обработки естественных языков и поиска новых лекарств.

Новые узлы ABCI 2.0 заметно отличаются по архитектуре от старых Как и в большей части систем, ориентированных на машинное обучение, упор при модернизации ABCI был сделан на вычислительную производительность в специфических форматах, включая FP32 и BF16. Изначально в состав ABCI входило 1088 узлов, каждый с четырьмя ускорителями V100 формата SXM2 и двумя процессорами Xeon Gold 6148. После модернизации к ним добавилось 120 узлов на базе пары Xeon Ice Lake-SP и восьми ускорителей A100 формата SXM4. Здесь вместо InfiniBand EDR используется уже InfiniBand HDR.

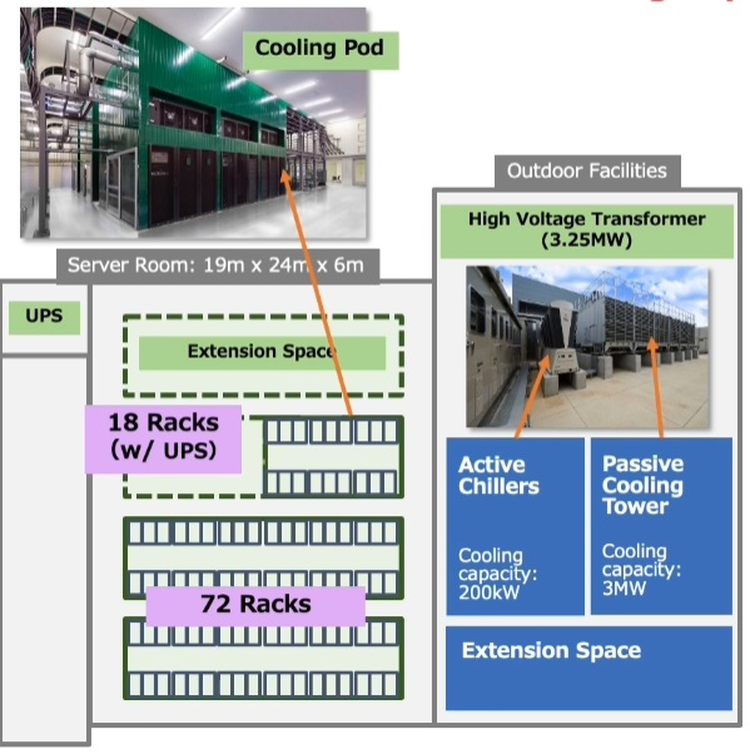

Стойка с новыми вычислительными узлами ABCI 2.0 Согласно предварительным ожиданиям, производительность обновлённого суперкомпьютера должна вырасти практически в два раза на задачах вроде ResNet50, в остальных случаях заявлен прирост производительности от полутора до трёх раз. На вычислениях половинной точности речь идёт о цифре свыше 850 Пфлопс, что вплотную приближает ABCI к системам экза-класса. Разработчики также надеются повысить энергоэффективность системы путём применения специфических ускорителей, включая ASIC, но пока речь идёт о связке Intel + NVIDIA. ABCI и сейчас можно назвать экономичной системой — при максимальной общей мощности комплекса 3,25 МВт сам суперкомпьютер при полной нагрузке потребляет лишь 2,3 МВт. Поскольку система ориентирована на предоставление вычислительных услуг сторонним заказчикам, модернизировано и системное ПО, в котором упор сместился в сторону контейнеризации.

02.06.2021 [19:14], Игорь Осколков

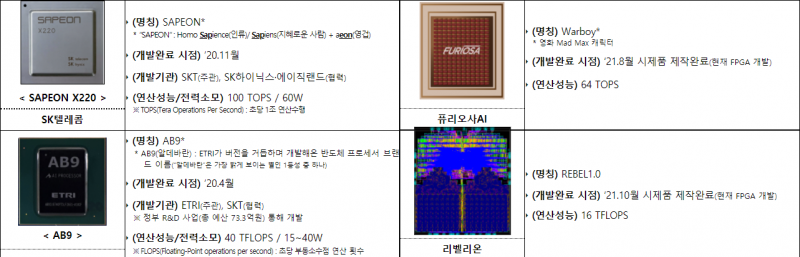

Южная Корея намерена разработать собственные CPU и ИИ-чипы для суперкомпьютеров и серверовЮжная Корея намерена добиться большей независимости в сфере разработки и производства чипов для серверов и суперкомпьютеров, в первую очередь для нужд внутри страны. По сообщению Министерства науки и ИКТ Южной Кореи, пять гиперскейлеров подписали меморандум о взаимопонимании с пятью производителями микросхем. Меморандум предполагает расширение использования отечественных технологий, в частности, ИИ-ускорителей в центрах обработки данных на территории страны. Производители и разработчики чипов — SK Group, Rebellions, FuriosaAI и Исследовательский институт электроники и телекоммуникаций — также согласились создать для этого новый технологический центр в Кванджу на юго-западе страны. Отечественные чипы получат компании Naver Cloud, Douzone Bizon, Kakao Enterprise, NHN и KT. Все они являются крупными игроками на местном рынке и, каждая в своей области, довольно успешно конкурируют с зарубежными IT-гигантами. Это во многом напоминает ситуацию в Китае и Японии, которые также имеют сильных локальных игроков и вкладываются в разработку собственной микроэлектроники, чтобы быть менее зависимыми от США, как минимум, в области суперкомпьютинга. Несколько недель назад правительство объявило о пакете поддержки в размере 510 трлн вон ($451 млрд) для увеличения производства микросхем в стране, что принесёт пользу не только Samsung и SK Hynix, но и небольшим компаниям. Также ранее сообщалось, что Южная Корея намерена к 2030 году построить суперкомпьютер экзафлопсного класса на базе преимущественно «домашних» компонентов.

15.04.2021 [01:31], Владимир Мироненко

TSMC остановит выпуск Arm-процессоров Phytium — судьба китайского экзафлопсного суперкомпьютера Tianhe-3 под вопросомТайваньская компания Taiwan Semiconductor Manufacturing Company (TSMC) приостановила поставку чипов по новым заказам китайской компании Phytium, которая на прошлой неделе была добавлена властями США в «чёрный» список Министерства торговли. Внесение компаний в этот перечень означает запрет для американских компаний на работу с ними и предоставление продуктов или услуг без получения соответствующих лицензий. Иностранные компании, такие как TSMC, теоретически могут продолжать работать с компаниями из «чёрного списка», но США могут оказывать на них давление через их американских поставщиков. Например, когда США занесли Huawei в «чёрный» список, TSMC была вынуждена отказаться от сотрудничества с ней, поскольку многие ключевые технологии, лежащие в основе её производственных процессов, были разработаны американскими фирмами. Пока неясно, оказывалось ли сейчас подобное давление на TSMC, и были ли ею прекращены поставки остальным шести суперкомпьютерным китайским фирмам из «чёрного» списка. Как сообщает South China Morning Post, TSMC выполнит заказы, размещённые Phytium до внесения в «чёрный список», но больше поставлять ей чипы не будет.

Прототип Tianhe-3. Фото: Xinhua Предполагается, что Phytium стоит за развёртыванием систем высокопроизводительных вычислений для китайского военно-промышленного комплекса, использующего её разработки при создании гиперзвуковых ракет. Компания сотрудничает с Оборонным научно-техническим университетом Народно-освободительной армии Китая (NUDT), который ранее создал суперкомпьютеры Tianhe-1 и Tianhe-2, в своё время занимавшие первые строчки рейтинга TOP500. Tianhe-3, один из трёх проектов китайских суперкомпьютеров экзафлопсного класса, должен был быть закончен в прошлом году, однако осенью было объявлено, что из-за пандемии коронавируса сроки сдвигаются. Летом 2020 года в распоряжении исследователей уже был прототип новой машины, имевший теоретическую производительность 3,146 Пфлопс. Он включал 512 плат с тремя процессорами Phytium MT2000+ и 128 плат с четырьмя Phytium FT2000+. Точные параметры этих 7-нм Arm-чипов не приводятся, но в одной из свежих научных публикаций упоминается, что на каждый 64-ядерный FT2000+ в прототипе Tianhe-3 приходилось 64 Гбайт RAM. А каждый MT2000+ можно поделить на четыре NUMA-узла с 32 ядрами и 16 Гбайт RAM, то есть, судя по описанию, это 128-ядерный чип, о котором ранее ничего не было известно. Теперь же судьба этих CPU и суперкомпьютера Tianhe-3 и вовсе под вопросом.

17.02.2021 [00:43], Игорь Осколков

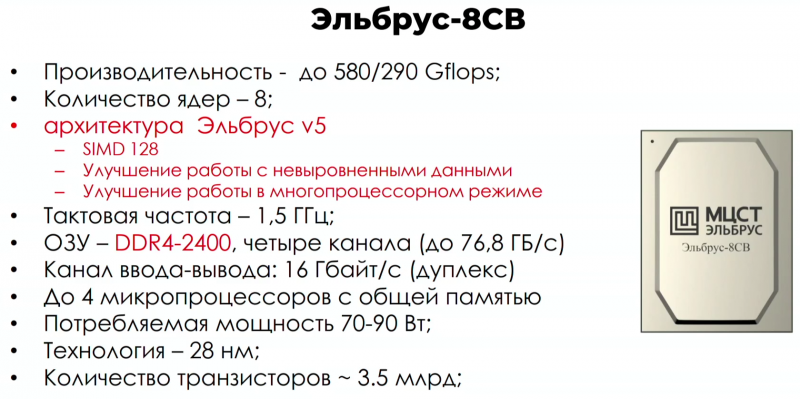

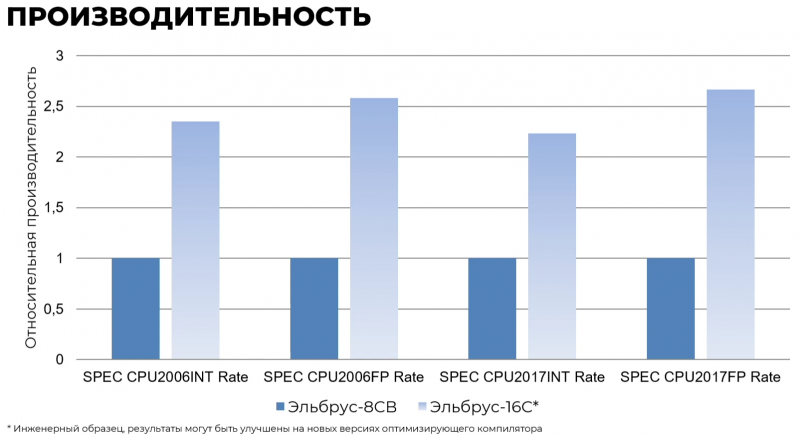

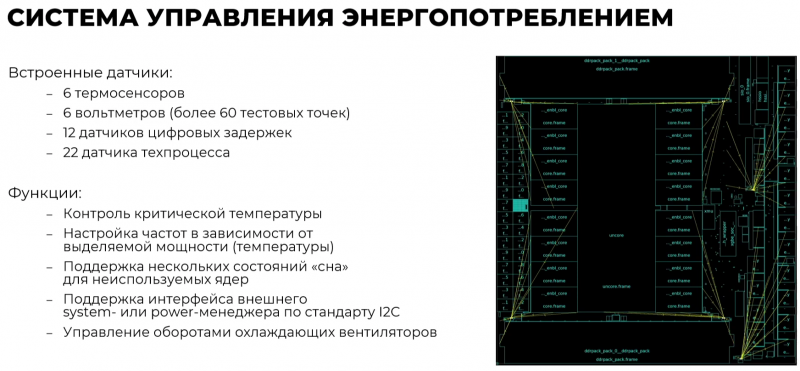

Российские процессоры Эльбрус-16С, Эльбрус-12С и Эльбрус-2С3 получат ядра шестого поколения архитектуры E2KНа мероприятии Elbrus Tech Day компания МСЦТ рассказала о текущих достижениях и планах развития серии российских процессоров Эльбрус. Сейчас наиболее современным CPU этой линейки является Эльбрус-8СВ на базе архитектуры E2K (Эльбрус 2000) пятого поколения, но в ближайшие годы появятся сразу три SoC шестого поколения: Эльбрус-16С, Эльбрус-2С3 и Эльбрус-12С. Эльбрус-8СВ является эволюционным развитием Эльбрус-8. Оба чипа используют 28-нм техпроцесс, но за счёт оптимизаций у 8СВ удалось поднять частоту, что вкупе с поддержкой широких векторных инструкций и более современного стандарта памяти дало двукратный рост теоретической пиковой производительности. Впрочем, для программ, не использующих SIMD, прирост пропорционален увеличению тактовой частоты + они всё равно выигрывают от увеличения скорости работы памяти.

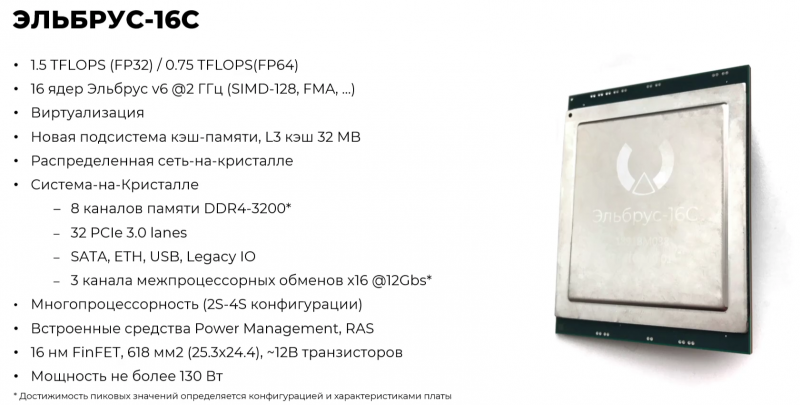

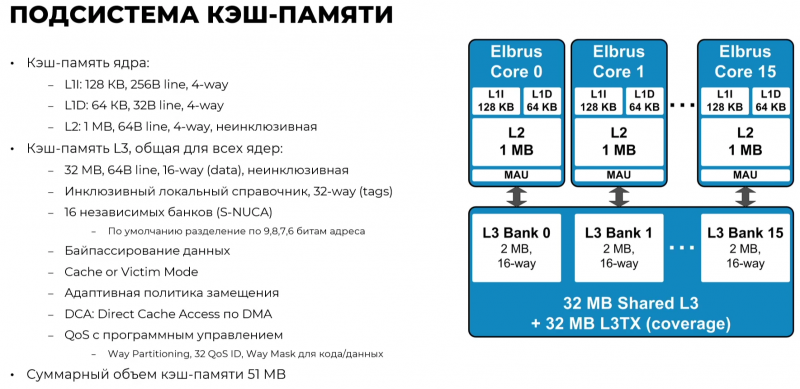

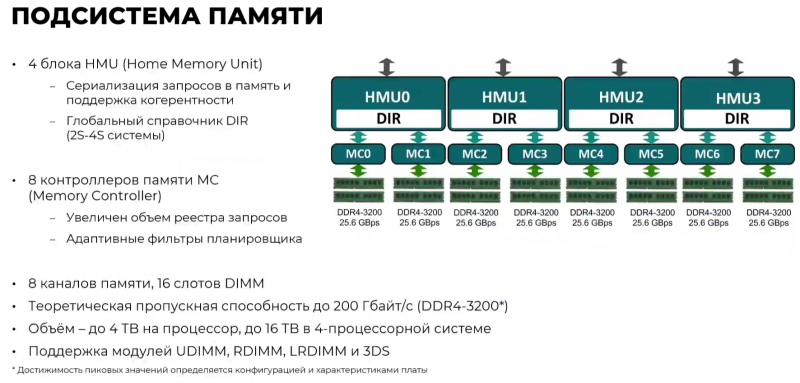

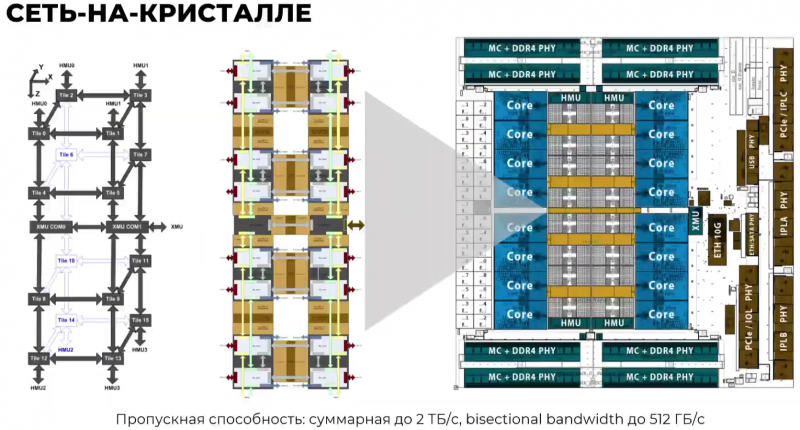

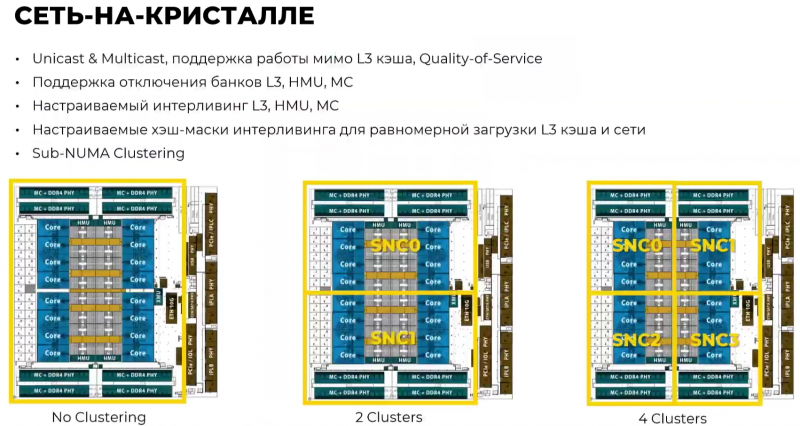

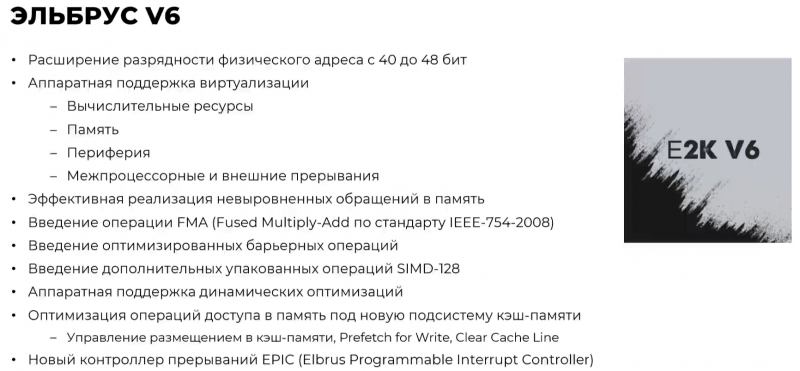

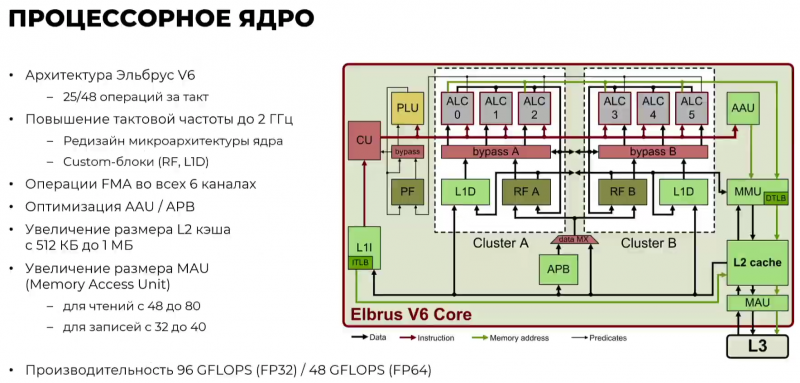

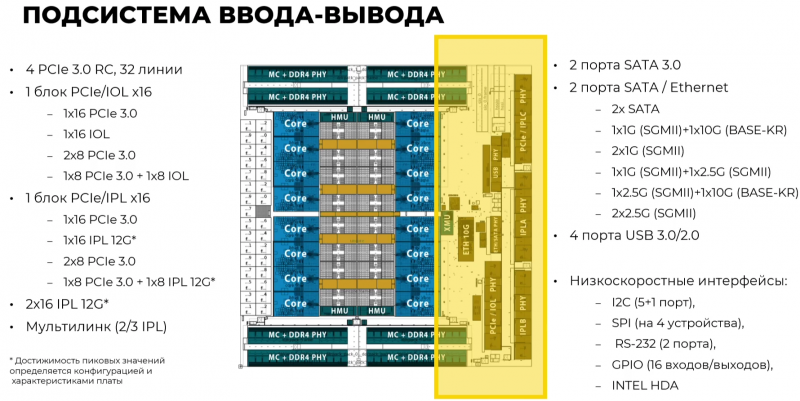

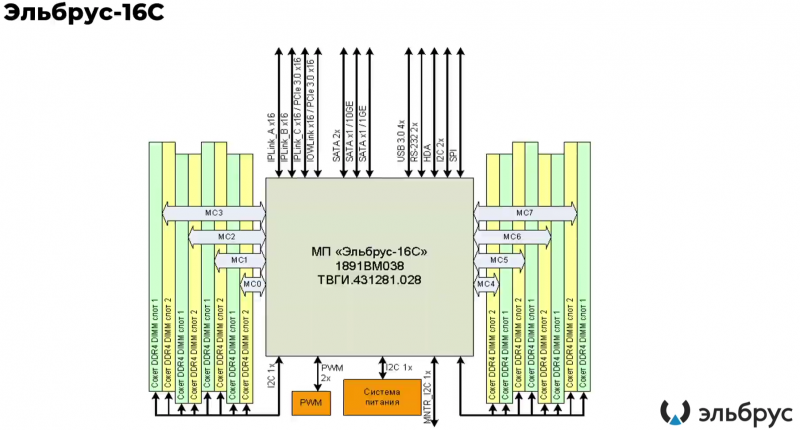

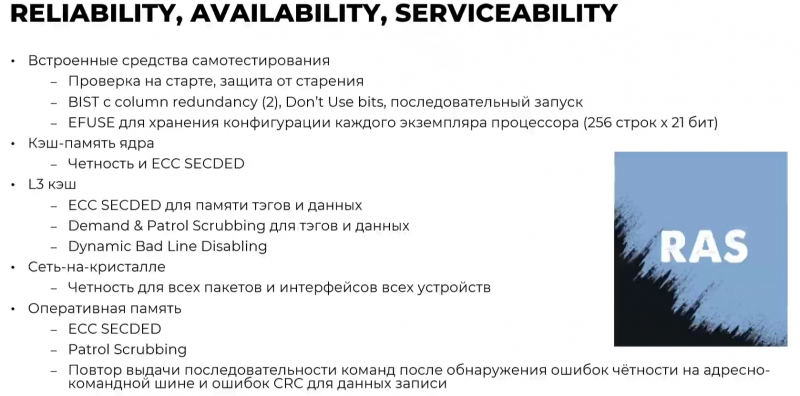

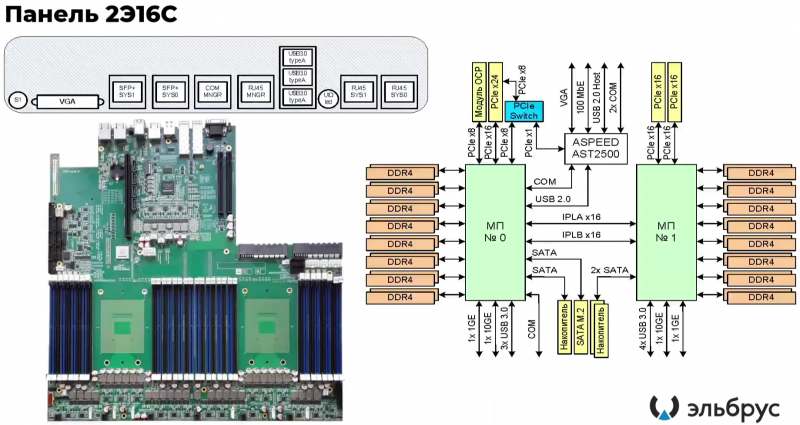

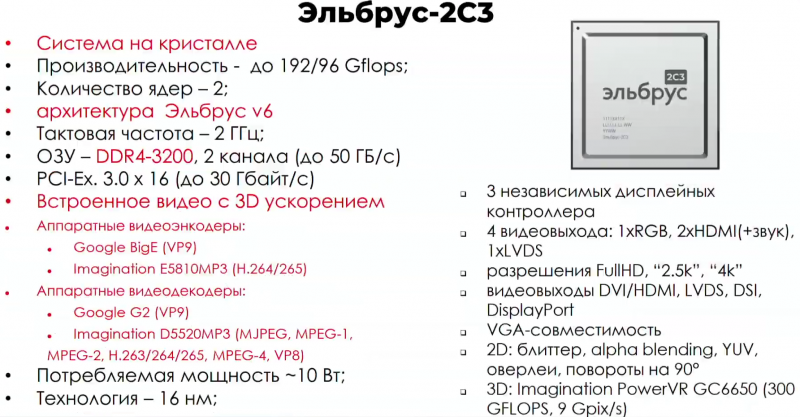

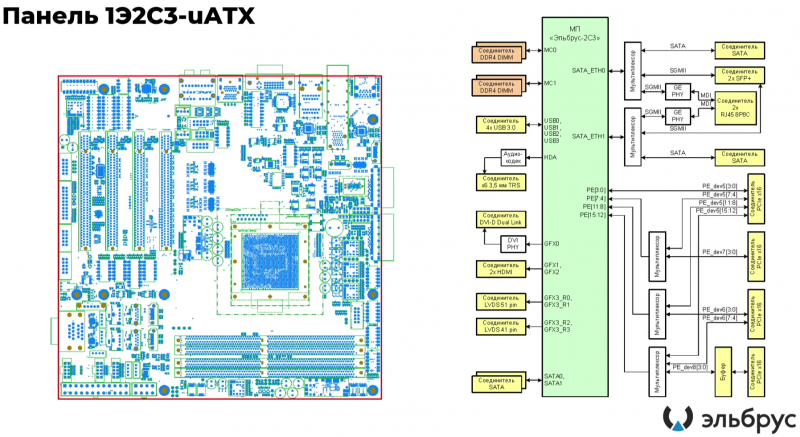

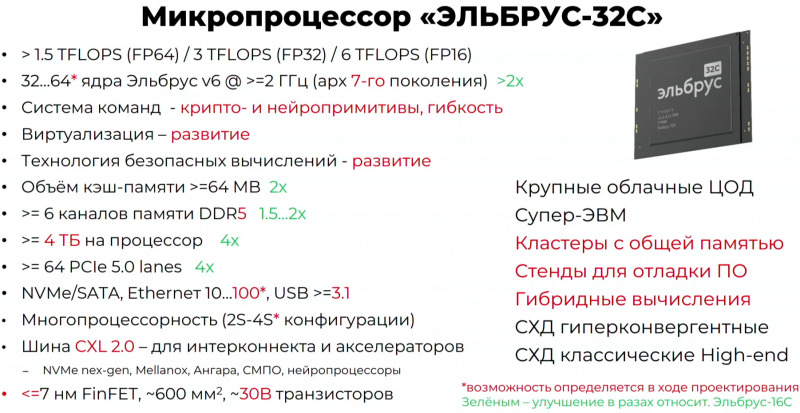

На базе этих и других процессоров компания МЦСТ разрабатывает референсные дизайны материнских плат различных форм-факторов, которые можно лицензировать для дальнейшей кастомизации. Часть партнёров компании разрабатывает собственные материнские платы и изделия на их основе. В скором времени на TSMC будет размещён заказ на изготовление очередной партии Эльбрус-8СВ объёмом 10 тыс. штук. В целом, вокруг уже имеющихся CPU сложилась достаточно заметная экосистема как аппаратных, так и программных продуктов и решений. Следующее поколение процессоров будет разнообразнее. Помимо 16-ядерного Эльбрус-16С, ориентированного на высокопроизводительные серверные системы, будет и модель попроще, которая появится позже остальных — Эльбрус-12С. Этот 12-ядерный CPU рассчитан на серверы начального уровня, а также рабочие станции. А главное отличие от 16С будет в цене. Наконец, ещё один чип, двухъядерный Эльбрус-2С3, ориентирован на мобильные системы, в том числе планшетные компьютеры. Все чипы будут изготавливаться на TSMC по 16-нм техпроцессу FinFET и будут основаны на шестом поколении архитектуры E2K. Строго говоря, это уже не процессоры, а полноценные SoC с интегрированными контроллерами для различной периферии, и для работы им не требуется внешний чип южного моста, как было ранее. В случае Эльбрус-16С площадь кристалла составляет 618 мм2 (25,3 × 24,4 мм), упакован он в корпус HFCBGA4804 с габаритами 63 × 78 мм. Кристалл содержит 12 млрд транзисторов, а его мощность не превышает 130 Вт. Значительная часть изменений в архитектуре коснулась подсистемы памяти. В частности, были увеличены размеры кешей, суммарный объём которых достиг 51 Мбайт: общий для всех L3-кеш 32 Мбайт, увеличенный до 1 Мбайт L2-кеш, L1-кеш для инструкций на 128 Кбайт + L1-кеш данных на 64 Кбайт. Контроллер памяти стал восьмиканальным, получил поддержку модулей DDR4-3200 и 2DPC, что даёт до 4 Тбайт RAM на сокет с суммарной пропускной способностью до 200 Гбайт/с. Первые инженерные образцы Эльбрус-16С, полученные в конце прошлого года, уже выдают в бенчмарке stream скорость порядка 70-80% от максимально возможной. Контроллеры попарно подключены к четырём агентам (HMU), «прикреплённым» к внутренней mesh-шине с пропускной способностью 2 Тбайт/с, объединяющей память и ядра. Чип можно разделить на два или четыре NUMA-домена, что полезно для ряда задач. Одной из таких задач является виртуализация, и в Эльбрус-16С она, наконец, стала полноценной — новые процессоры поддерживают аппаратную виртуализацию практически всех важных ресурсов, в том числе и для режима x86-трансляции, который тоже никуда не делся. Для CPU прошлых поколений всё ещё можно использовать контейнеризацию, но МЦСТ занимается и подготовкой паравиртуализированного ядра и сопутствующих компонентов, включая KVM, QEMU, libvirt и virt-manager. Для самих ядер был произведён редизайн микроархитектуры, что дало повышение скорости работы и новые возможности. В частности, появились новые SIMD-инструкции в дополнение к имеющимся, поддержка FMA по стандарту IEEE 754-2008 (требуется в современных стандартах C), динамическая оптимизация (касается планирования, что важно для VLIW), новый контроллер прерываний (необходим для виртуализации) и так далее. Пиковая теоретическая производительность ядра составляет 96 Гфлопс для вычислений одинарной точности и 48 Гфлопс — для двойной. Для всего CPU это 1,5 Тфлопс и 768 Гфлопс соответственно. Предварительные тесты показывают прирост производительности в 2-2,5 раза в сравнении с Эльбрус-8СВ, но надо помнить, что очень много зависит от оптимизаций со стороны компилятора. Само ядро хоть и стало сложнее, но оно всё равно проще, чем ядра современных x86-64 процессоров. Слабым местом новых чипов, на наш взгляд, является IO-блок. В состав SoC входят четыре root-комплекса PCIe 3.0, которые в сумме дают 32 линии. Из них 8 или 16 линий можно выделить на подключение внешнего южного моста, если не хватает того, что встроен в сам чип. Он предоставляет 2 порта SATA 3.0, 4 порта USB 3.0/2.0 и два мульти-порта, дающих или пару SATA, или пару Ethernet с максимальной конфигурацией 10GbE + 2.5GbE. Ещё 8 линий PCIe можно отдать на канал для межпроцессорной связи (IPL) в дополнение к двумя каналам, которые есть всегда. В двухсокетной системе, таким образом, можно объединить CPU двумя или тремя IPL. Правда, скорость одного такого канала составляет всего 12 Гбит/с (на инженерных образцах пока достигли 10 Гбит/с), что значительно меньше, чему у UPI или Infinity Fabric. Всего в одной системе может быть объединение до четырёх процессоров. Помимо прочего, в чипах реализованы различные RAS-функции для повышения надёжности работы. Также улучшен мониторинг процессора и управление его питанием и охлаждением. Вероятно, теперь уже все системы на базе новых CPU будут комплектоваться BMC-контроллером — ASPEED AST2500 и в перспективе AST2600 — с собственной прошивкой на базе OpenBMC и с встроенной микро-ОС, упрощающей инициализацию и работу с оборудованием. Референсный дизайн двухсокетной платы 2Э16С-SPRC появится в середине этого года, а однопроцессорной Micro-ATX — к концу. В 2022 году появятся и другие варианты двух- и четырёхсокетных систем с Эльбрус-16С, а также одно- и двухсокетные платы для Эльбрус-12С. Партнёры МЦСТ, надо полагать, тоже не будут сидеть без дела. Напомним, что формально окончание разработки Эльбрус-16С намечено на конец этого года. Для Эльбрус-2С3 и Эльбрус-12С точные сроки озвучены не были. И если 12-ядерная модель, скорее всего, очень похожа на 16-ядерную, то младший чип серии заметно от них отличается. Эльбрус-2С3 имеет всего два ядра шестого поколения с тактовой частотой 2 ГГц, два канала памяти DDR4-3200 и производительность до 192/96 Гфлопс FP32/FP64. У него есть 16 линий PCIe 3.0. В его состав входит 3D-ядро Imagination PowerVR GX6650 (300 Гфлопс), ряд (де)кодеров видео, а также 2D-ядро собственной разработки. Есть четыре видеовыхода (из них 2 HDMI) и поддержка 4K-вывода. Для этой SoC компанией в течение 2021 года будут подготовлены первые платы Micro-ATX и Mini-ITX. Характеристики будущих процессоров Эльбрус-32С пока до конца не определены, но примерные очертания будущего продукта уже есть. CPU должен иметь производительность не ниже 1,5/3/6 Тфлопс для вычислений FP64/FP32/FP16 и содержать от 32 ядер с частотой более 2 ГГц. Возможно, будет и 64 ядра седьмого поколения E2K. Объём L3-кеша должен как минимум удвоиться, а контроллер памяти, возможно, получит поддержку DDR5 объёмом не менее 4 Тбайт/сокет. Предполагается возможность работы как минимум двухсокетных конфигураций. Дальнейшее развитие могут получить виртуализация и фирменная технология безопасных вычислений с попутным добавлением новых инструкций. Уже сейчас разработчики хотят предоставить 64 линии PCIe 5.0, что открывает путь к использованию CXL 2.0. К встроенным контроллерам, помимо NVMe, без которого уже точно не обойтись, могут добавиться 100GbE и USB 3.1 или более новые. Будущие кристаллы перейдут на техпроцесс не толще 7 нм, а их площадь вырастет до 600 мм2.

02.10.2020 [16:47], Алексей Степин

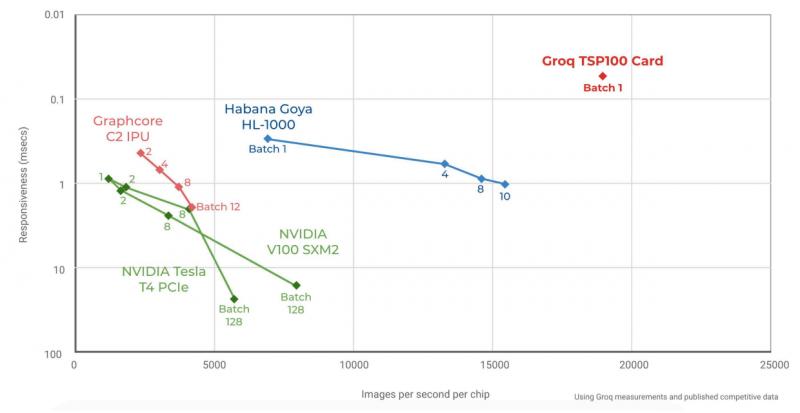

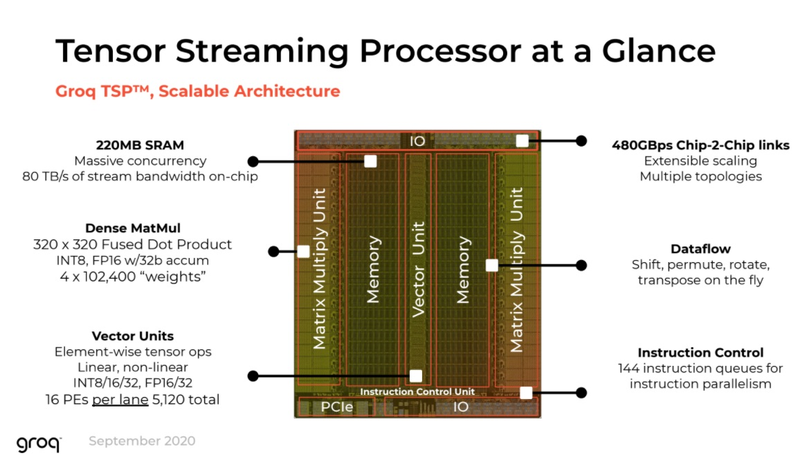

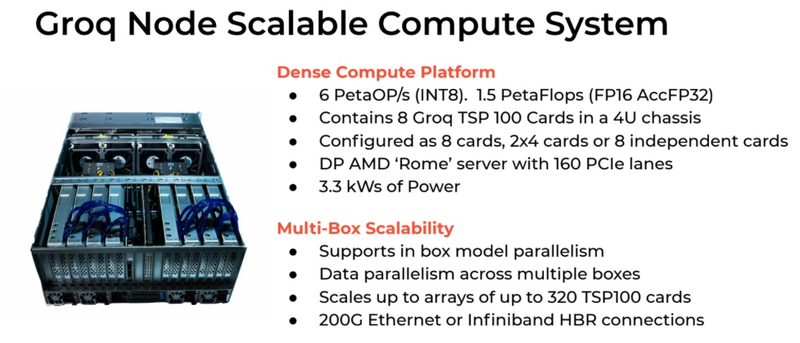

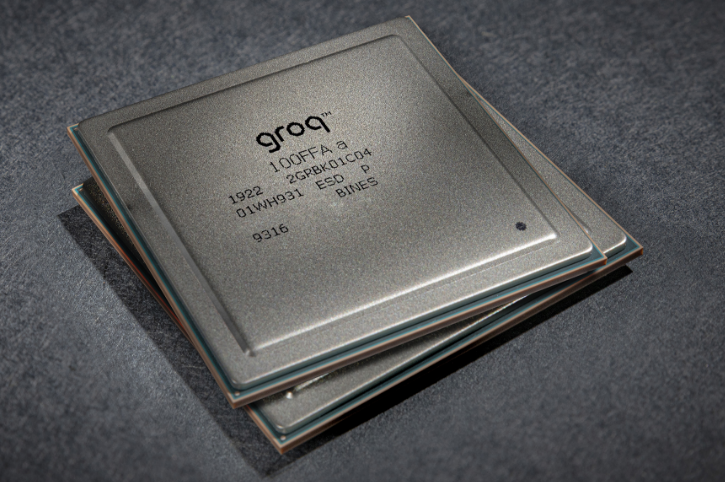

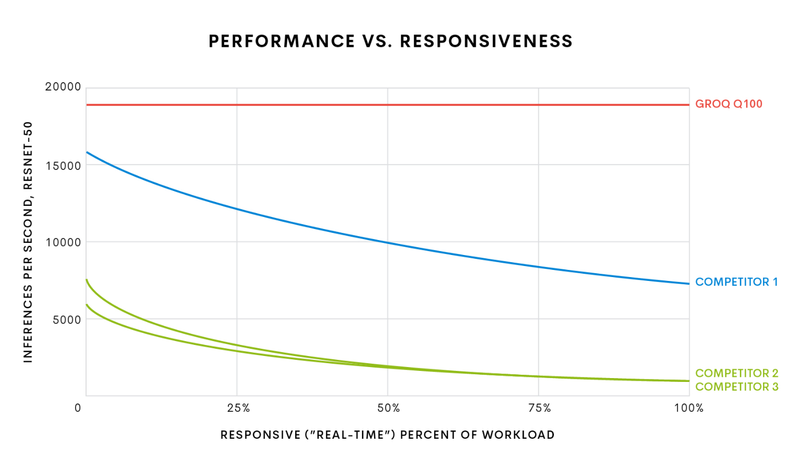

Groq начала поставки самой быстрой в мире ИИ-платформы TSPСистемы машинного интеллекта и особенно инференс-системы, чьей задачей является принятие решений в нейросетевых сценариях обработки, требуют особого подхода к реализации аппаратной части для достижения действительно высокой производительности при приемлемом уровне энергопотребления. Стартап Groq, который ещё осенью 2019 года анонсировал свой тензорный процессор Groq TSP, начал поставки систем на базе этого чипа. В своё время Groq наделали немало шума, заявив о создании самого быстрого ИИ-процессора с производительностью 1 Петаопс (PetaOPS, 1015 операций в секунду, обычно целочисленных), оставляющего позади даже таких монстров, как NVIDIA Tesla V100. Добиться этого удалось благодаря уникальной многоядерной архитектуре, из которой Groq исключила всё лишнее для тех задач, на которые ориентирован свой процессор.  Подход оказался плодотворным: прототип ускорителя на базе Groq TSP, работая на частоте 1 ГГц, развил 205 Тфлопс в режиме FP16 и 820 Топс в режиме INT8. Для сравнения, V100 при аналогичном потреблении 300 Ватт показала лишь 125 Тфлопс и 250 Топс соответственно. В тесте ResNet-50 новый чип смог достичь производительности на уровне 21700 распознаваний в секунду, уступив лишь проприетарному ASIC Alibaba HanGuang, недоступному для приобретения.

Архитектура Groq TSP (Изображение: The Next Platform) Об архитектуре Groq до недавних пор было известно немного, однако компания-разработчик, похоже, успешно набирает обороты: начались коммерческие поставки ускорителей на базе Groq TSP и даже законченных вычислительных узлов, позволяющих организовывать целые кластеры с высочайшим уровнем производительности. На днях компания рассказала The Next Platform об особенностях своих решений.

Шасси Groq (Изображение: The Next Platform) Главной особенностью своего TSP разработчики по-прежнему называют наличие блока SRAM объёмом 220 Мбайт. Такая память обеспечивает пропускную способность на уровне 80 Тбайт/с, что является настоящим подарком для инференс-сценариев. Кроме того, теперь известно, что каждый TSP содержит два блока матричной математики (320×320 Fused Dot Product, INT8 или FP16, 32-битный аккумулятор) и один блок векторных вычислений (тензорные линейные и нелинейные вычисления в режимах INT8/16/32 и FP16/32, 5120 вычислительных элементов).

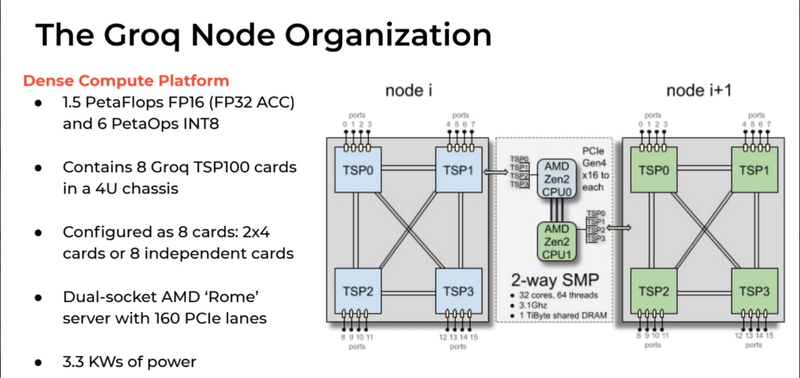

Структура узла Groq (Изображение: The Next Platform) Как обычно, по краям кристалла расположены различные блоки ввода-вывода, в частности, контроллер PCI Express 4.0, а также два I/O-модуля для межпроцессорной связи. Последние обеспечивают Groq TSP 16 линиями с общей пропускной способностью 512 Гбайт/с, так что узким местом в многопроцессорных кластерах на базе TSP они стать не должны. Кроме того, на кристалле присутствует и небольшой блок управления, могущий оперировать очередями из 144 инструкций, так что полностью отказываться от управляющих структур в TSP разработчики всё-таки не стали.  Структура вычислительной системы на базе Groq TSP довольно проста. Она состоит из трёх функциональных блоков, два из которых занимаются собственно вычислениями и управляющего блока с классическими процессорами. Каждый из вычислительных модулей содержит по четыре ускорителя Groq TSP, соединённых по схеме «каждый с каждым» и имеет 16 свободных портов для дальнейшего масштабирования и добавления новых модулей TSP. Ускорители могут использоваться независимо, каждый для своей задачи, либо работать вместе над одной задачей, развивая большую производительность.

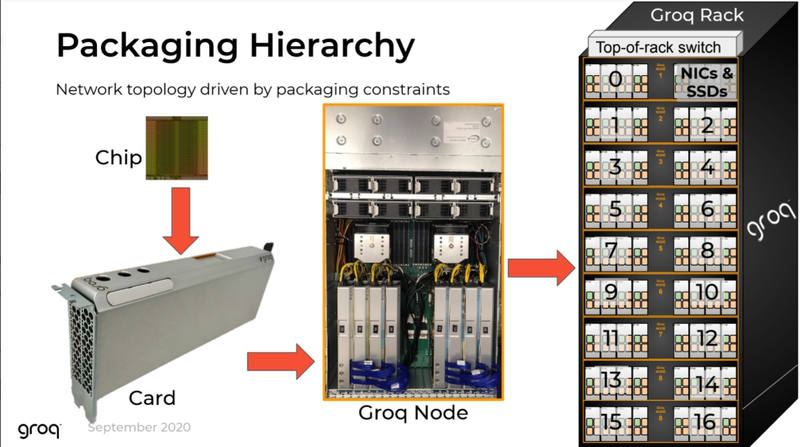

Стартовавший, как отдельный ускоритель, Groq TSP вырос в масштабируемый кластер (Изображение: The Next Platform) Управляющая часть с точки зрения архитектуры выглядит несложно: это обычная двухпроцессорная система на базе AMD EPYC 7002, и каждый из четырёх ускорителей подключен к своему процессору посредством PCI Express 4.0 x16. В этой части используются 32-ядерные процессоры AMD и установлен общий пул оперативной памяти объёмом 1 Тбайт. Вся система занимает модифицированный стоечный корпус высотой 5U и потребляет в пределе 3,3 кВт. Производительность такого комплекса заявлена на уровне 6 Петаопс в режиме INT8 и 1,5 Пфлопс в режиме FP16.

Сервер Groq Node И это далеко не предел, недаром Groq называет своё решение Node Scalable Compute System. Новинка действительно масштабируется, поскольку каждый из ускорителей имеет по четыре свободных порта интерконнекта. Стойка, разработанная и представленная Groq, может включать в себя 17 вычислительных модулей с вышеописанной архитектурой. 18-ое место занято модулем, содержащим в себе сетевые интерфейсы и дисковую подсистему.  Без программного обеспечения любая система мертва, тем более, с учётом архитектурных особенностей Groq TSP, практически целиком полагающегося на компилятор. Компания сопровождает новые системы комплектом ПО Groqware SDK. Он включает в себя все необходимые средства разработки и набор API, что позволит разработчикам в кратчайшие сроки начать создавать ПО, в полной мере раскрывающее немалый потенциал новой платформы. Из-за того, что Groq лучше всего раскрывается на задачах с небольшой очередью (в пределе при batch size 1), эта инференс-платформа обеспечивает великолепную латентность, что делает её привлекательной для финансовых структур. Интересна платформа и учёным, но те более заинтересованы в возможностях TSP в области классических вычислений, в частности, линейной алгебры. Из-за этого сложилась любопытная ситуация: стартовал Groq TSP как инференс-ускоритель, но первые клиенты компании потребовали большей универсальности, так что разработчикам пришлось создать сначала Groq Node, описанный выше, а потом и целый масштабируемый кластер на базе таких узлов. Таким образом, платформа, стартовавшая как узкоспециализированное решение, эволюционировала в более универсальный вычислительный комплекс, гибкий и масштабируемый.

01.10.2020 [11:51], Юрий Поздеев

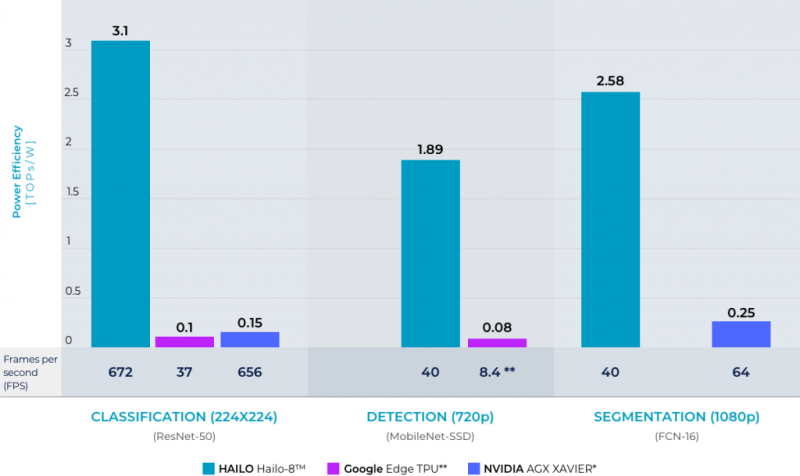

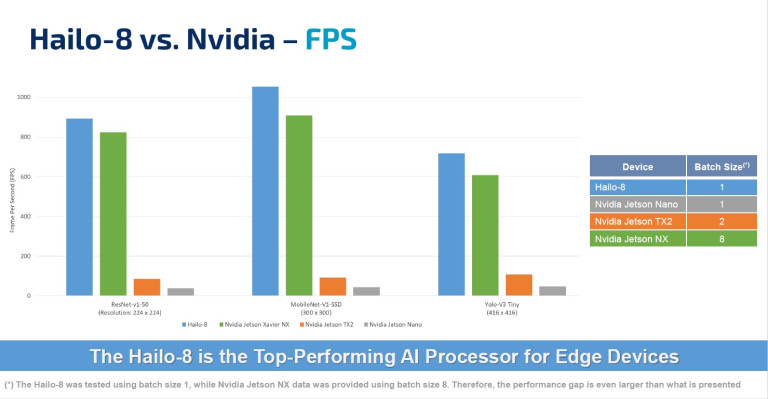

Hailo: новые модули ускорения ИИ для периферийных вычисленийHailo, производитель микросхем для систем искусственного интеллекта (ИИ), выпустила новые высокопроизводительные модули в форм-факторах M.2 и mini PCIe для расширения возможностей периферийных систем. Модули на базе процессора Hailo-8 можно подключать к различным периферийным устройствам, что позволяет использовать возможности ИИ в умных домах, розничной торговле и промышленности.  Модули Hailo легко интегрируются в стандартные платформы, такие как TensorFlow и ONNX, что позволяет значительно упростить использование новинок в комплексных решениях. Заказчики могут оперативно перенести свои решения с нейронными сетями на модули Hailo-8. Спрос на высокопроизводительные периферийные устройства постоянно растет, поэтому безвентиляторные модули Hailo-8 будут востребованы, например, в видеоаналитике, либо для подключения большого количества внешних датчиков для сбора и обработки информации в режиме реального времени. Процессор Hailo-8 способен обеспечить 26 TOPS, при этом имеет энергоэффективность 3 TOPS/Вт.  Модуль Hailo-8 M.2 уже интегрирован в следующее поколение Foxconn BOXiedge (24-ядерный мини сервер, который потребляет всего 30 Вт, при этом обладает неплохими показателями производительности). Наличие готового продукта позволит ускорить внедрение новых модулей в периферийные вычисления и значительно упростить этот процесс для конечного заказчика. |

|