Материалы по тегу: ии

|

24.01.2022 [15:37], Сергей Карасёв

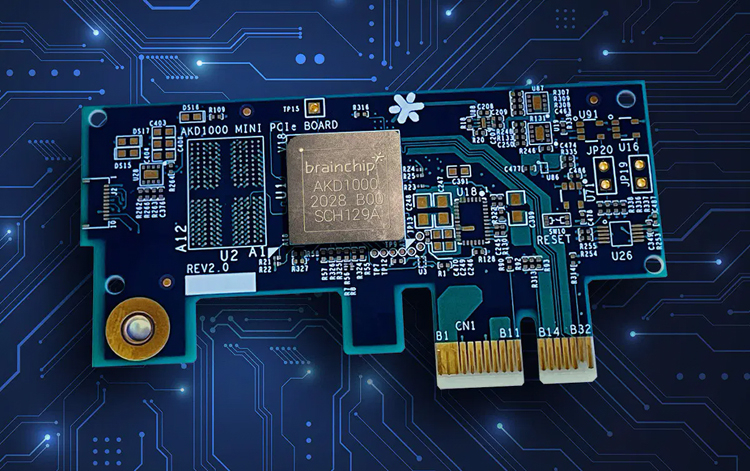

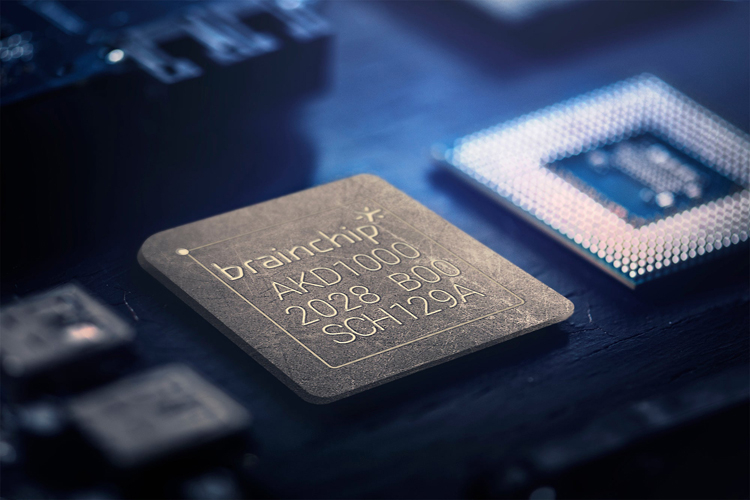

Нейроморфный ИИ-ускоритель BrainChip Akida AKD1000 оценён в $499Компания BrainChip сообщила о начале продаж специализированной карты расширения Akida AKD1000, предназначенной для организации периферийных ИИ-вычислений. Цена изделия составляет $499: оно доступно для заказа в количестве до десяти штук. Сама плата имеет размеры 76 × 40 × 5,3 мм и использует интерфейс PCI Express 2.0 x1. В основу положен одноимённый нейроморфный процессор, дополненный ядром Arm Cortex-M4 (300 МГц). Akida AKD1000 предлагает 1,2 млн нейронов и 10 млрд синапсов. Решение содержит 512 Мбайт памяти LPDDR4-2400 и 128 Мбит флеш-памяти Quad SPI NOR.

Источник изображений: BrainChip Отмечается, что BrainChip предоставит заказчикам всю необходимую документацию, что позволит системным интеграторам и разработчикам создавать собственные решения на базе ИИ-акселератора. Создание, обучение и тестирование нейросетей осуществляется в среде MetaTF с поддержкой Tensorflow и Keras, а также набором готовых моделей и конвертером CNN-SNN.  На поставку новых карт Akida AKD1000 будет уходить около восьми недель после оформления заказа. Эти сроки будут варьироваться в зависимости от работы логистических цепочек. Впрочем, это временные ограничения, так как, по словам компании, налажено массовое производство. Ранее BrainChip выпустила комплекты разработчика на базе ПК Shuttle и Raspberry Pi

07.01.2022 [00:05], Алексей Степин

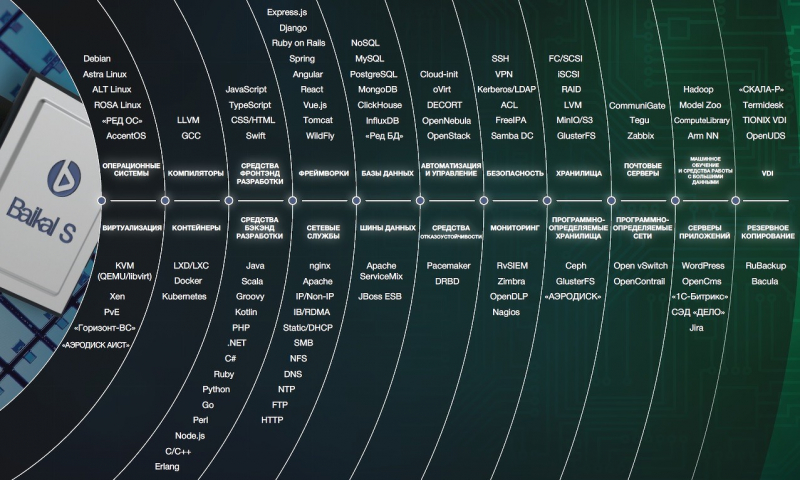

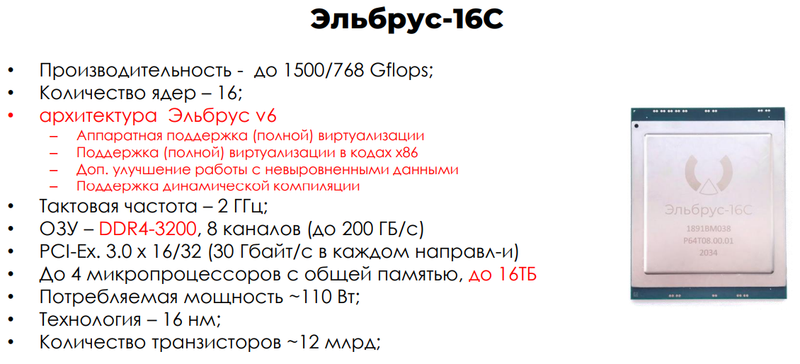

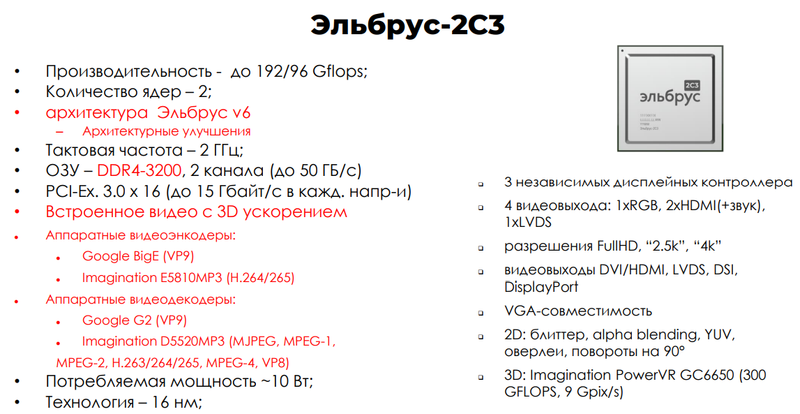

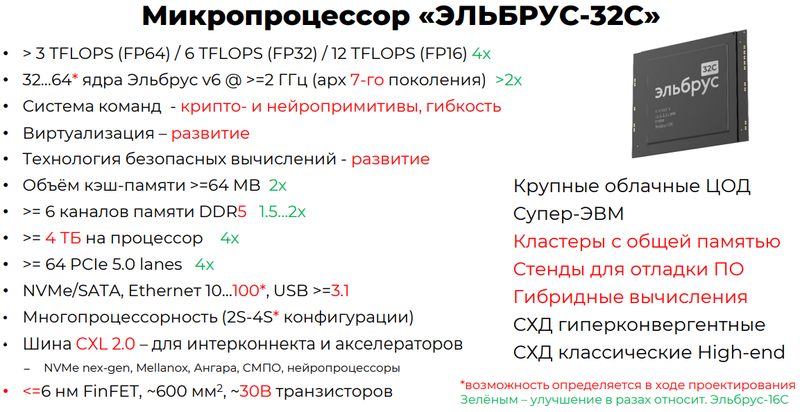

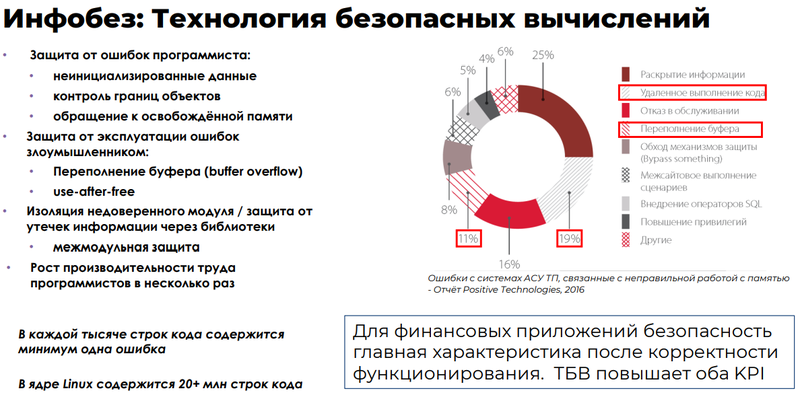

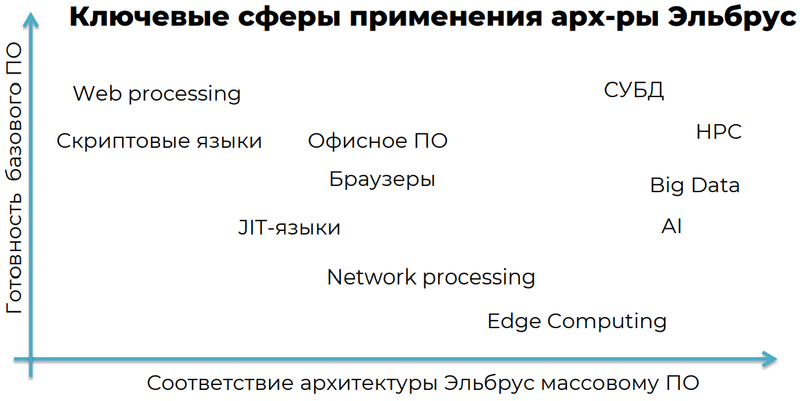

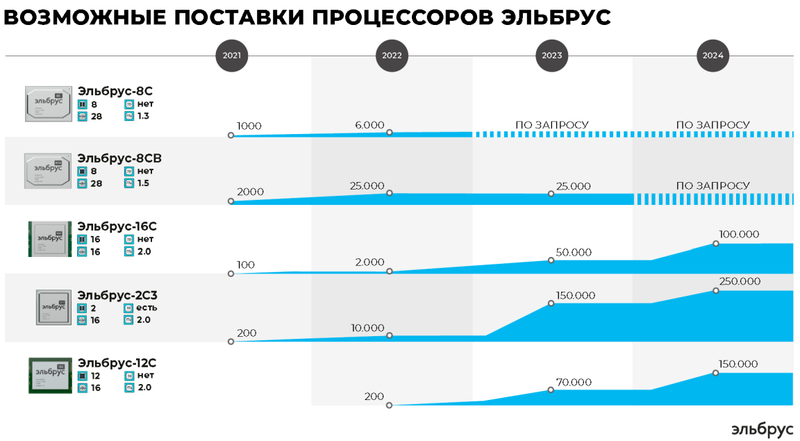

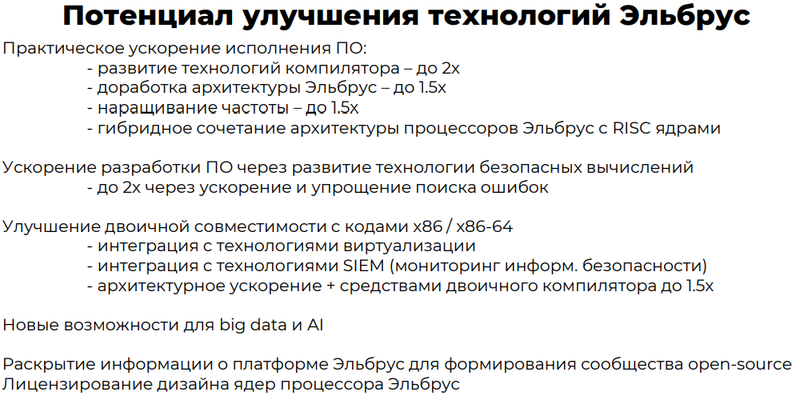

Серийное производство Эльбрус-16С и 2С3 начнётся в этом годуРоссийские процессоры Эльбрус, разрабатываемые компанией МЦСТ, вызывают немало споров вокруг самой архитектуры и доступности изделий на её основе. Но платформа продолжает жить и развиваться, несмотря на все трудности. Для всех процессоров разработан типовой ряд модулей и системных плат, от простых вариантов с одним CPU до высокоплотных четырёхсокетных. Есть решения и для обычных настольных ПК, а также модули для встраиваемых и терминальных систем. В конце прошлого года на очередной партнёрской конференции МЦСТ были опубликованы новые доклады, в том числе, освещающие изменения в ситуации с доступностью процессоров и решений на их основе. А изменений этих немало. Во-первых, окончательно устаревшими можно признать чипы Эльбрус-8. Им на смену пришла усовершенствованная версия Эльбрус-8СВ. Крупная партия этих чипов в настоящее время уже получена и находится в процессе таможенного оформления. Этот чип, напомним, лишён целого ряда недостатков, присущих Эльбрус-8С.  Однако 28-нм техпроцесс себя исчерпал, и в 2022 году на смену придут 16-нм процессоры Эльбрус-16С, Эльбрус-12С и Эльбрус-2С3. В их основу легла новая, шестая версия VLIW-архитектуры МЦСТ. Она сопровождается отказом от уже устаревшей и медленной схемотехники подсистем ввода-вывода, реализованной в предыдущем поколении Эльбрус на базе моста КПИ-2 и переходом на интегрированный контроллер PCI Express.  Старший 16-ядерный вариант получил 8-канальный контроллер DDR4-3200, что вполне отвечает требованиям современности. Планка максимального объёма оперативной памяти поднята до 16 Тбайт в четырёхпроцессорной системе (4х4 Тбайт). Благодаря новому техпроцессу удалось удержать в приличных рамках теплопакет, выросший с 80 до 110 ватт при вдвое большем количестве ядер.  Современный серверный процессор немыслим без виртуализации, и в новых решениях МЦСТ её аппаратная поддержка реализована в полном объёме, в том числе, для кода x86. Появилась поддержка динамической компиляции, дополнительно оптимизирована работа с невыровненными данными. Но главное, что образцы Эльбрус-16С и 2С3 получены и успешно прошли тесты. Подготовлена вторая ревизия, данные по ней уже переданы контрактному производителю.  Младший Эльбрус-2С3 в дополнение к интегрированному GPU получил продвинутый набор аппаратных кодеков, который включает VP9 и H.264/H.265. Процессор пойти в серию в течение этого года, а рабочие прототипы систем на его базе уже есть. 12-ядерный Эльбрус-12С наиболее интересный, как платформа для рабочих станций разработки ПО для данной архитектуры, пока ждёт второй ревизии, которая должна быть готова в течение первой половины 2022 года.  Не забывает МЦСТ и о корнях — разработке архитектур на базе SPARC. Образцы процессора R2000+ также получены и прошли инженерные тесты. Это чип, ориентированный на сверхэкономичные системы — его теплопакет составляет всего 5 Ватт, но при этом он имеет встроенное графическое ядро с функциями 3D-ускорения.  Что касается приверженности самой архитектуре VLIW, то МЦСТ продолжает настаивать на преимуществах явного параллелизма команд, осознавая, разумеется, необходимость качественного компилятора. Интерес представляет диаграмма применимости архитектуры Эльбрус: она не очень подходит для веб-задач и скриптовых языков, а лучше всего, по мнению разработчиков, раскрывает себя в задачах HPC/Big Data, СУБД и ИИ-системах.  Что касается внедрения, то серверы на базе процессоров Эльбрус активно внедряются в государственных учреждениях: ЦОД для ГИС «Мир» содержит порядка 200 серверов, а МВД России недавно закупило более 400 серверов для автоматизированной системы фиксации нарушений. РЖД внедряет тонкие клиенты на базе Эльбрус, а также использует его в системах автоматики управления стрелочным хозяйством. Силами Ростелеком создано первое облако на базе Эльбрус-8С/СВ.  Но, пожалуй, наибольшего успеха в импортозамещении добились энергетики: удалось разработать и внедрить самый широкий спектр решений на базе Эльбрус, от систем автоматики для подстанций до полноценной АСУ ТП «ПАК МАРС» для компании Россети. В последнем случае Эльбрус используется во всех компонентах, от клиентских рабочих мест до серверов и СХД.  С точки зрения программной экосреды наиболее интересна система двоичной трансляции, позволяющая запускать ПО, разработанное для х86-64, которое затем постепенно можно оптимизировать и переводить в «родной режим». Начаты работы по внедрению механизмов динамической оптимизации на базе LCC и LLVM. Также стоит отметить появление поддержки LLVM 13-ой ветки и бета-версию систем виртуализации на базе KVM + QEMU + libvirt.  МЦСТ заботится о разработчиках: первые 100 экземпляров плат на базе Эльбрус-16С и 2С3 уже разосланы партнёрам для реализации пилотных проектов. Компания готовится сертифицировать дизайн-центры и контрактные производства, а также сообщает о том, что появились первые дистрибьюторы, работающие с продукцией на базе Эльбрус.  Весьма интересны как планы МЦСТ по выпуску новых процессоров на базе VLIW-архитектуры седьмого поколения, так и данные относительно нововведений в этой архитектуре. В планах создание процессора с числом ядер до 64 и с системой команд, включающей крипто- и нейропримитивы, продвинутыми средствами виртуализации и безопасных вычислений, и, что немаловажно, поддержкой прогрессивного универсального стандарта CXL 2.0.  Запланировано использование 6-нм техпроцесса, а также выпуск чипов с меньшим количеством ядер для рабочих станций и ноутбуков. Также рассматривается возможность создания гибридного процессора, сочетающего ядра Эльбрус и RISC-V. Такой чип с учётом поддержки бинарной трансляции сможет претендовать на звание самого универсального ЦП в мире.  Ознакомиться полнее с материалами конференции можно на сайте МЦСТ. В целом, архитектура Эльбрус выглядит живой и развивающейся, решения на базе уже освоенных 8-ядерных процессоров активно внедряются в России, а более новые 12 и 16-ядерные CPU гораздо лучше соответствуют современным требованиям. Что касается Эльбрус-32С, то это амбициозный проект, в котором сочетаются как новейшие технологии (DDR5 и CXL 2.0), так и уникальные архитектурные особенности.

17.12.2021 [01:35], Алексей Степин

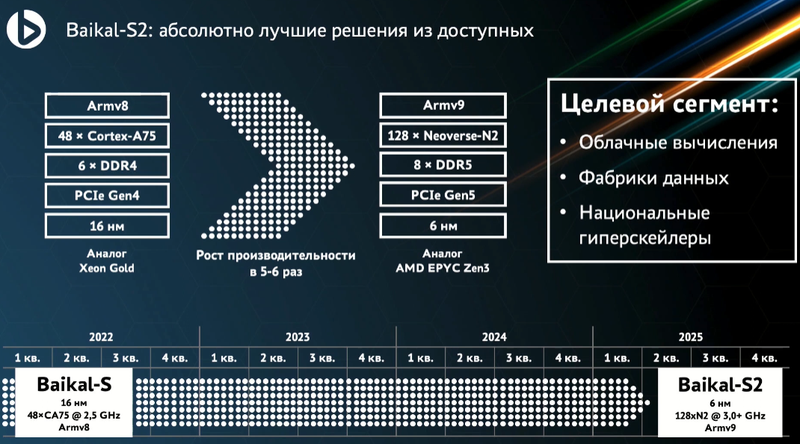

Российский серверный процессор Baikal-S2 получит чиплетную компоновку, 128 ядер Armv9 с частотой 3 ГГц, 8 каналов DDR5, 192 линии PCIe 5.0 и CXL 2.0На ежегодной итоговой конференции Байкал Электроникс состоялся анонс 128-ядерных серверных Arm-процессоров второго поколения Baikal-S2, были показаны результаты тестов 48-ядерных Baikal-S, анонсированы первые же российские серверы и СХД на их основе, а также было объявлено о заключении стратегических сделок и планах на будущее. Если говорить о сделках, то можно смело сказать, что рамками только Arm Байкал себя уже не ограничивает: получение доли в CloudBEAR означает и получение основы для разработки собственных чипов с архитектурой RISC-V, и первым же проектом станет создание сертифицированной системы доверенной загрузки для процессоров Baikal-L и Baikal-S2. Но среди равноправных партнёров значатся не только российские разработчики — заключена сделка с Esperanto Technologies.

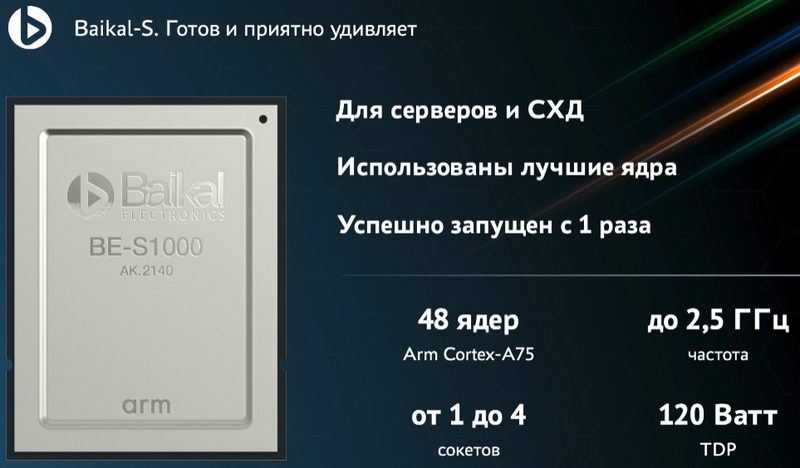

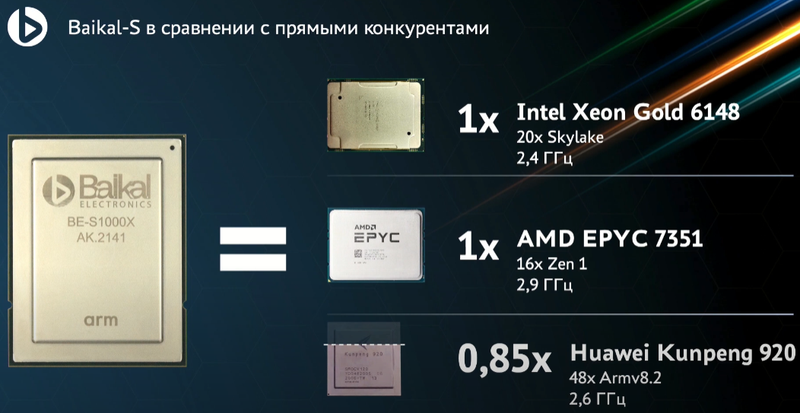

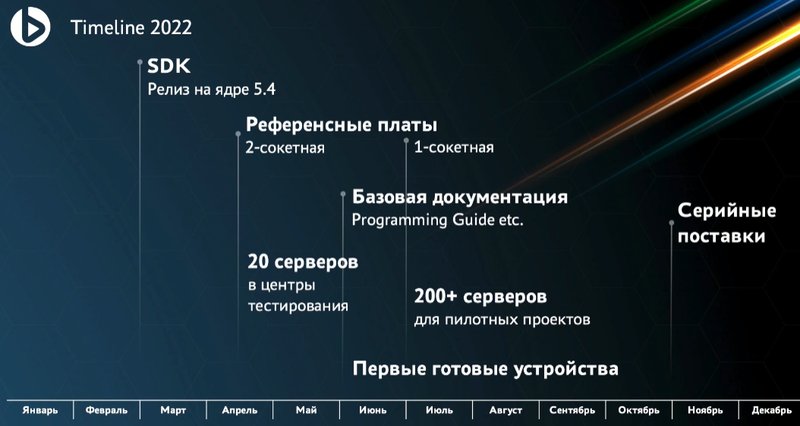

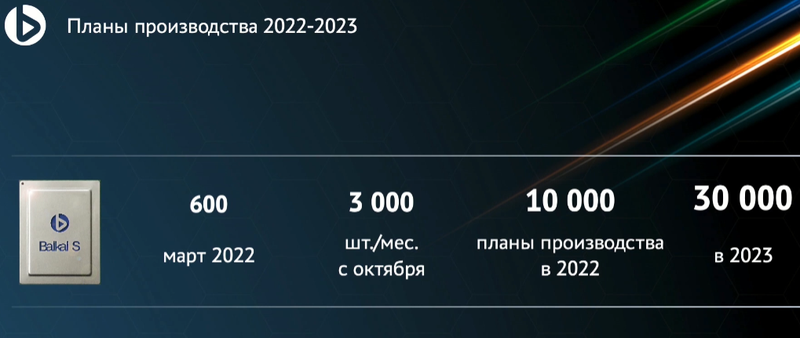

Тестовая плата с процессором Baikal-S (Изображения: Байкал Электроникс) Данная сделка позволит получить доступ к весьма серьёзным разработкам: напомним, Esperanto создала ET-SoC-1, мощнейший ИИ-ускоритель с более чем тысячью ядер RISC-V в составе. Связка из четырёх таких чипов развивает более 800 Топс в задачах инференса, потребляя всего 120 Вт. Надо ли говорить, насколько это важно в эпоху нейросетей, машинного обучения и разнообразных сопроцессоров-ускорителей.  Несмотря на то, что Baikal-S «старичком» назвать никак нельзя, компания анонсировала уже второе поколение чипов — Baikal-S2 базируется на новейшей архитектуре Neoverse-N2 (ARMv9). Процессор будет выполнен по 6-нм техпроцессу с использованием чиплетной компоновки и получит 128 ядер с частотой порядка 3 ГГц, 8 каналов DDR5 (возможно, будет и больше), 192 линии PCIe 5.0, поддержку CXL 2.0 и CCIX 2.0. Ожидается, что он станет аналогом AMD EPYC Milan. Разработку планируется закончить к 2025 году.  Что касается текущего поколения Baikal-S, то осенью этого года была получена первая партия чипов, а также было анонсировано несколько решений на его основе. Как теперь отрапортовали разработчики, первые чипы оказались очень удачными во всех отношениях, так что больших препятствий на пути их внедрения быть не должно. На конференции были представлены одно- и двухсокетные серверы и СХД от российских компаний 3Logic, Aquarius, ICL, iRU, Норси-Транс. Впоследствии появятся и четырёхпроцессорные системы.  Напомним, что Baikal-S содержит в своём составе 48 ядер Arm Cortex-A75 с частотой до 2,5 ГГц и имеет TDP 120 Вт. Шестиканальный контроллер памяти поддерживает до 768 Гбайт DDR4-3200. Современно выглядит и поддержка PCI Express 4.0 (80 линий), и наличие выделенного управляющего ядра для организации доверенных вычислений, и аппаратная виртуализация.  В синтетических тестах новинка показала результаты, сравнимые с Intel Xeon Gold 6148 или AMD EPYC 7351, а своему китайскому «коллеге» в лице HiSilicon Kunpeng 920 процессор уступил лишь в некоторых тестах. Разработчики уверены, что процессор получился универсальным и его можно использовать практически везде: в серверах любых профилей, СХД, суперкомпьютерах, устройствах сетевой безопасности и даже в базовых станциях 5G. Результаты тестов также доступны и на сайте Geekbench.  Ожидается, что SDK для новой платформы будет доступен уже в конце февраля следующего года. Весной появятся двухпроцессорные платы и первые 20 серверов попадут в центры тестирования, а к середине лета 200 с лишним серверов примут своё участие в пилотных проектах. Старт серийного производства CPU намечен на октябрь-ноябрь 2022 года — речь идёт примерно о 10 тыс. процессоров. В 2023 году этот объём будет утроен и при необходимости увеличен.  Таким образом, Байкал Электроникс доказала, что может создавать достойные серверные решения, не уступающие зарубежным, причём, как на базе x86-64, так и на базе Arm. Уже сейчас процессоры Baikal-S могут стать основой для производительных серверов российской разработки, а сделка с Esperanto сделает российские HPC-системы и комплексы машинного обучения по-настоящему мощными.

16.12.2021 [16:59], Сергей Карасёв

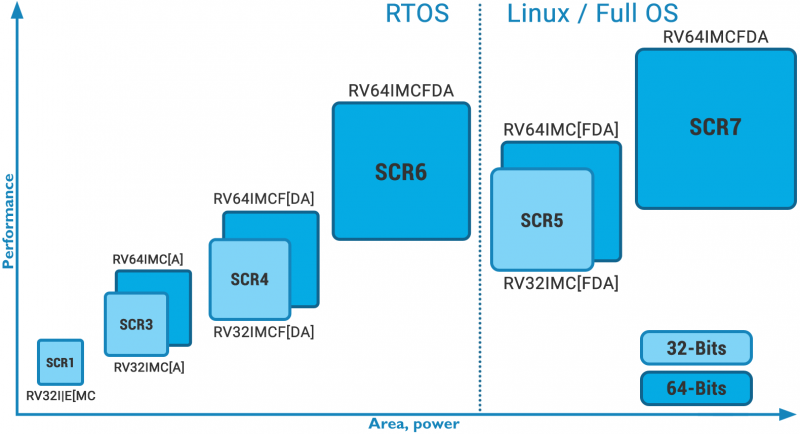

Российская компания Syntacore вошла в состав правления RISC-V InternationalRISC-V International сообщила о том, что российская компания Syntacore, подконтрольная российской же компании YADRO, получила статус премиального участника названной организации. При этом сооснователь и исполнительный директор Syntacore Александр Редькин вошёл состав правления RISC-V International. Syntacore является отечественным разработчиком микропроцессорных ядер и специализированных инструментов на архитектуре RISC-V. Компания входит в число основателей открытого международного консорциума RISC-V. Его цель заключается в разработке и продвижение одноимённой открытой архитектуры.

Изображение: Syntacore «Сегодняшний анонс ещё сильнее укрепляет наше лидирующее положение на рынке интеллектуальной собственности RISC-V в новом году и дальше. Вся наша интеллектуальная собственность полностью совместима с последней версией спецификации RISC-V», — отметил господин Редькин. Компания Syntacore является одним из лидеров экосистемы RISC-V и лицензирует микропроцессорные технологии собственной разработки на базе данной архитектуры клиентам в России и за рубежом. Продукты на основе процессорных технологий компании разрабатываются по нормам от 180 до 7 нм.

14.12.2021 [21:11], Владимир Агапов

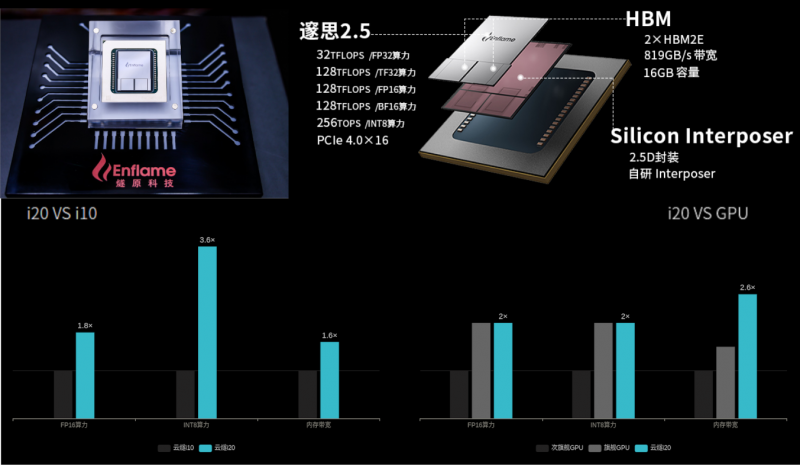

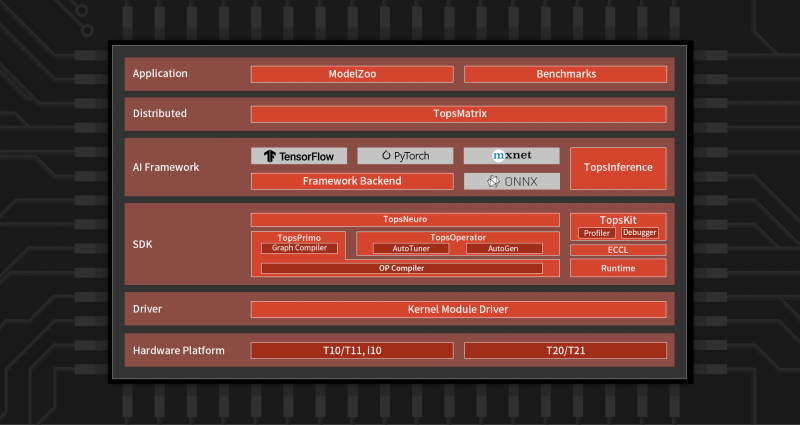

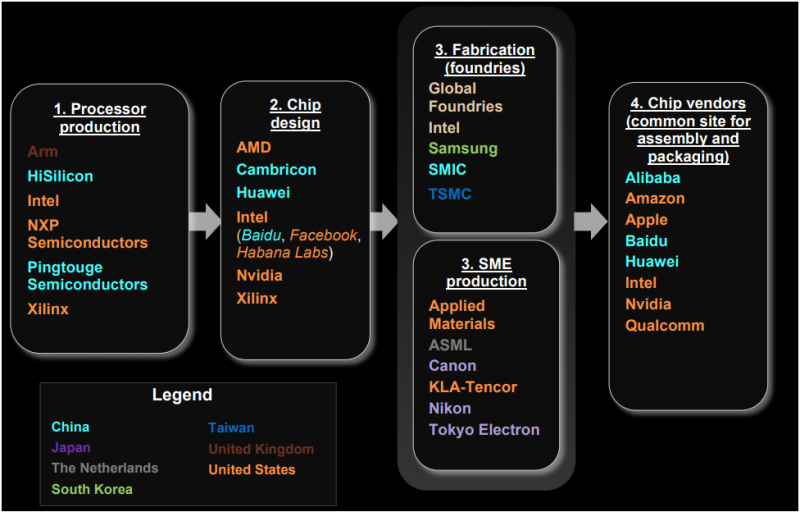

Китайская Enflame выпустила новый ИИ-ускоритель Cloudblazer Yunsui i20Компания Enflame, которая летом этого года представляла ускорители на базе второго поколения своих ИИ-чипов DTU, выпустила новый инференс-ускоритель Cloudblazer Yunsui i20 с чипом Suixi 2.5. Он изготовлен по 12-нм FinFET-техпроцессу GlobalFoundries и имеет обновлённую высокопроизводительную архитектуру вычислительных ядер GCU-CARE 2.0, благодаря чему, по словам создателей, удалось достичь эффективности, сопоставимой с массовыми 7-нм GPU. В числе ключевых особенностей новинки компания отмечает возросшую вычислительную мощность, возможность исполнения тензорных, векторных и скалярных вычислений, API для C++ и Python, а также поддержку основных фреймворков и форматов моделей (TensorFlow, PyTorch, ONNX). Комплектное ПО предоставляет гибкие возможности для миграции с поддержкой технологий виртуализации, а также многопользовательских и многозадачных окружений с безопасной изоляцией процессов. Yunsui i20 обладает 16 Гбайт памяти HBM2e с пропускной способностью до 819 Гбайт/c. Новинка поддерживает работу со всеми ключевыми форматами и предоставляет универсальную инференс-платформу, в том числе для облаков. Пиковая вычислительная FP32-производительность достигает 32 Тфлопс, TF32 (не уточняется, идёт ли речь о совместимости с NVIDIA) — 128 Тфлопс, FP16/BF16 — 128 Тфлопс, а INT8 достигает 256 Топс. По сравнению с первым поколением продуктов, Yunsui i20 увеличил FP-производительность в 1,8 раза, а INT-вычислений — в 3,6 раза. Для сравнения — у PCIe-версии NVIDIA A100 производительность в расчётах FP32, TF32, FP16/BF16 и INT8 составляет 19,5, 156, 312 и 624 Тфлопс (Топс для INT), а объём и пропускная способность памяти равны 40/80 Гбайт и 1555/1935 Гбайт/с соответственно. У AMD MI100 объём HBM2-памяти равен 32 Гбайт (1,23 Тбайт/с), а производительность FP32, FP16 и BF16 равна 46,1, 184,6 и 92,3 Тфлопс соответственно. Все три ускорителя имеют интерфейс PCIe 4.0. Значительный вклад в повышение производительности принесла оптимизация фирменного программного стека TopsRider, благодаря которой снизилась нагрузка на подсистему памяти. В результате средняя производительность исполнения моделей увеличилась в 3,5 раза, а эффективность использование вычислительной мощности — в среднем в 2 раза. Кроме того, новая модель программирования и технологии автоматизации позволяют ускорить эффективность разработки и снизить стоимость миграции моделей. В компании убеждены, что всё это сделает Yunsui i20 более конкурентноспособным решением. Благодаря технологии виртуализации, Yunsui i20 можно разделить на 6 независимых, изолированных друг от друга доменов — такое ранее предлагала только NVIDIA. Вместе с другими продуктами, которые также полностью переведены на новое поколение ИИ-ускорителей, Enflame рассчитывает получить значимую долю рынка в таких инновационных секторах как умные города и цифровое правительство, а также в традиционных отраслях вроде финансов, транспорта и энергетики, где будут востребованы более совершенные решения на основе ИИ. Несмотря на очевидные успехи, достигнутые командой Enflame и другими китайскими разработчиками — SoC от YITU Technology для глубокого обучения, IoT-чип Horizon Robotics Sunrise 2 с интегрированными ИИ-возможностями, Hanguang 800 от T-Head Semiconductor («дочка» Alibaba), серии Huawei Ascend и других — иностранные производители ИИ-чипов, по данным People's Daily, по-прежнему доминируют на китайском рынке с долей более 80%.

14.12.2021 [19:41], Алексей Степин

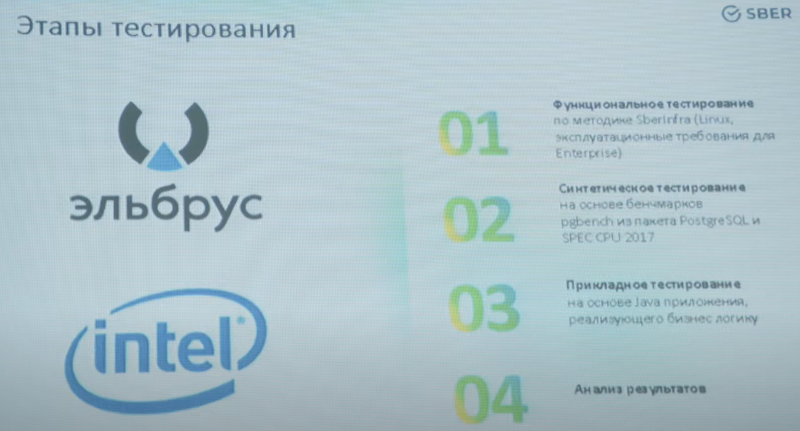

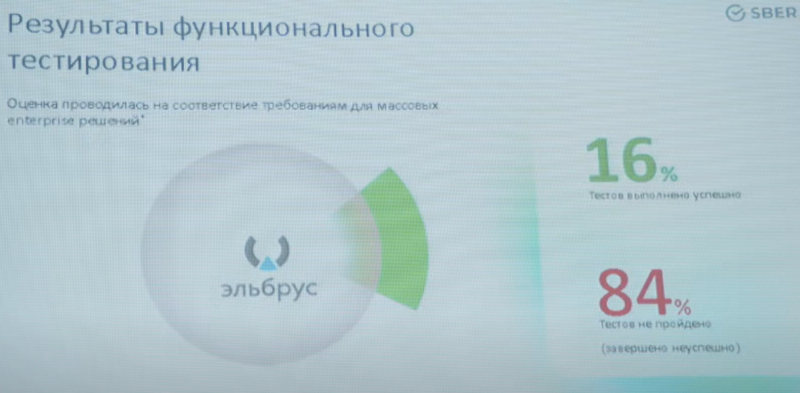

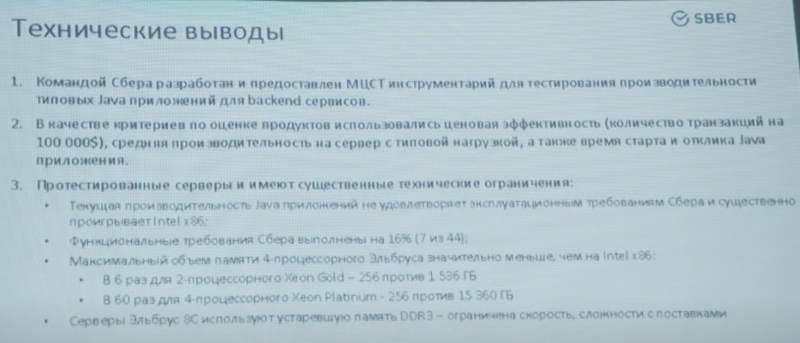

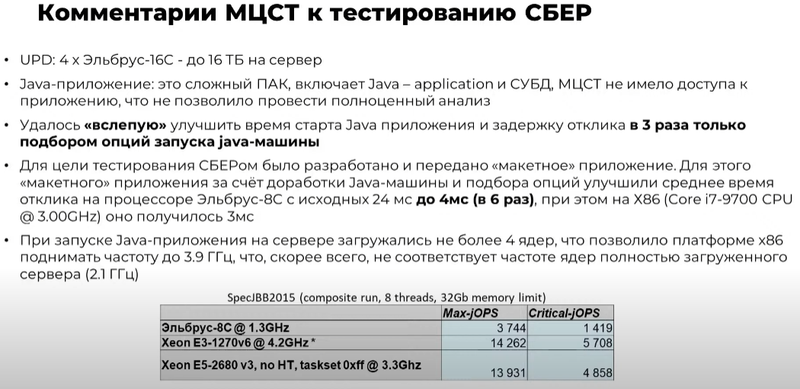

Серверы на базе «Эльбрус» не прошли тесты Сбербанка, но не всё потеряноВ рамках программы импортозамещения СберТех провёл тестирование серверов на базе процессоров Эльбрус-8С. По результатам системы признаны работоспособными, но не отвечающими предъявляемым требованиям по целому ряду параметров. Все пожелания и замечания переданы МЦСТ, разработчику Эльбрус. Банковские информационные системы — критически важная часть любого государства. Поэтому неудивительно стремление использовать в них решения собственной разработки, дабы меньше зависеть от чужих чипов и серверов. Примеры Huawei это подтверждают, но в данной заметке речь пойдёт не о китайских процессорах, а о российских. Лаборатория СберТех провела полноценное тестирование серверов на базе процессоров Эльбрус-8С, результаты которого, к сожалению, трудно назвать удовлетворительными.

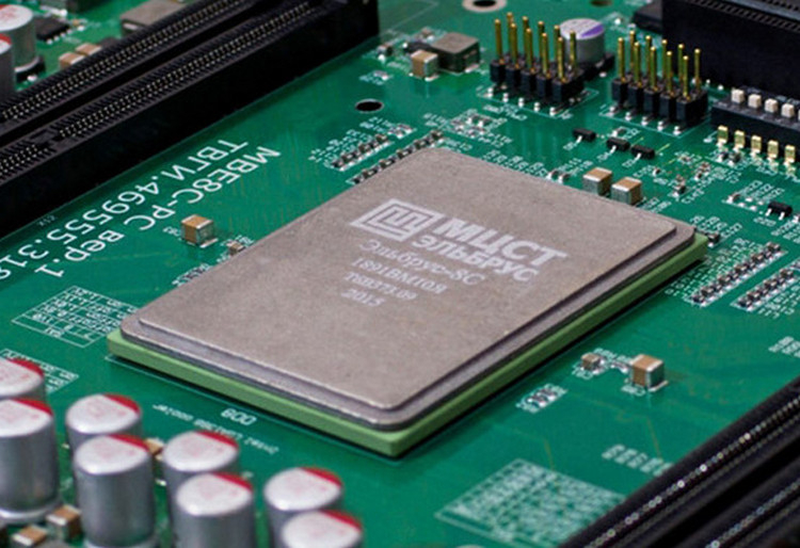

Фото: МЦСТ Это первое полномасштабное испытание процессоров Эльбрус в «полевых условиях», то есть, на уровне реальных серверов и задач, которые эти серверы должны выполнять. В испытаниях приняли участие платформы с двумя и четырьмя чипами Эльбрус-8С (VLIW, 8C/8T, 1,3 ГГц, 16 Мбайт L3-кеш, 70 Вт TDP, 28 нм). В качестве оппонентов выступили «типичные системы» на базе Intel Xeon Gold 6230 (x86-64, Cascade Lake-SP, 20C/40T, 2,1-3,9 ГГц, 27,5 Мбайт кеш, 125 Ватт TDP, 14 нм), которых в Сбере тысячи и тысячи.

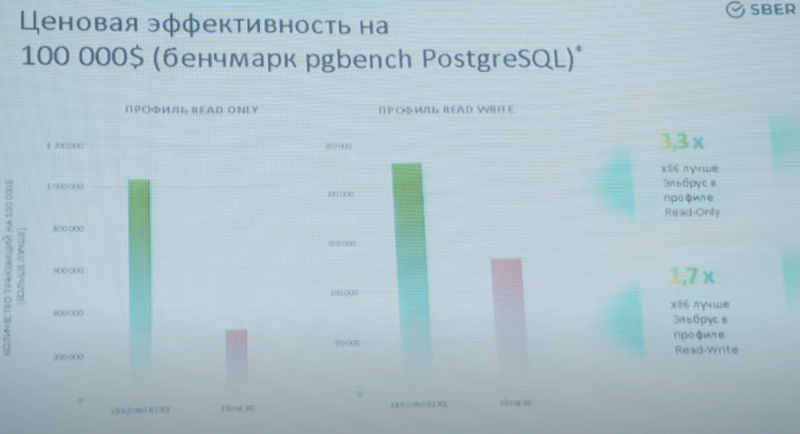

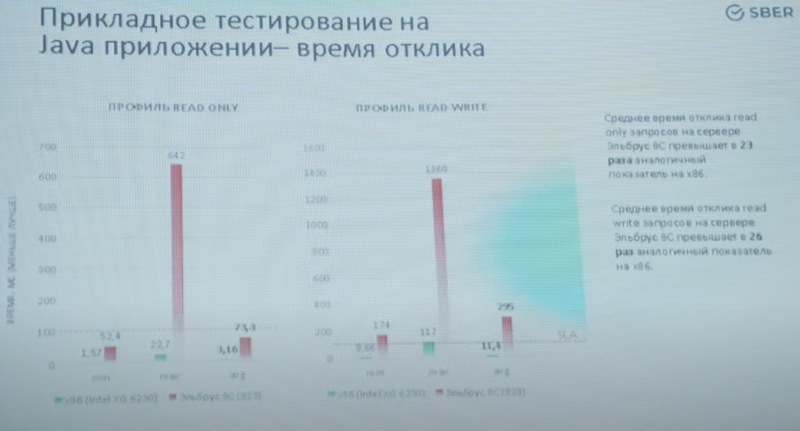

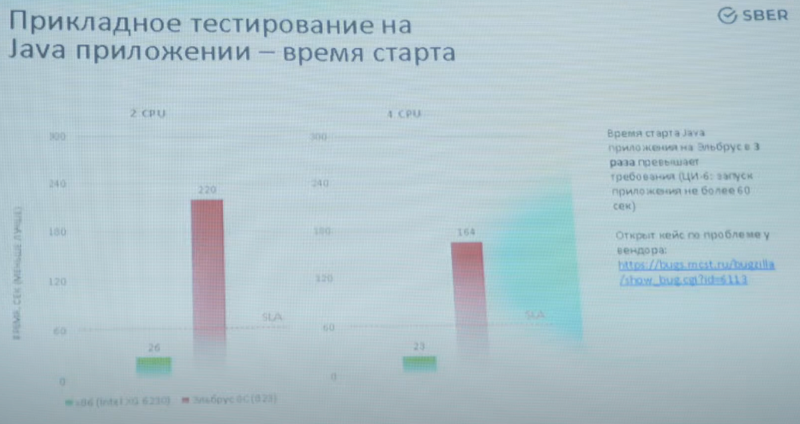

Изображения: YouTube/ElbrusTV По итогам тестирования серверы признаны работоспособными, но показавшими неудовлетворительный уровень производительности. Озвучены основные выводы: «мало памяти, медленная и устаревшая память, мало ядер, низкая тактовая частота». Особенно низкой оказалась производительность в приложениях, использующих Java.  Если в тестах PGbench/PostreSQL Xeon опередил Эльбрус в 1,7-3,3 раза, то в тестах на время отклика Java-приложения разница составила 23-26 раз. Запуск приложения, который по нормативам СберТеха должен укладываться в 60 секунд, занял у серверов Эльбрус 220 секунд в двухпроцессорном варианте и 164 секунды — в четырёхпроцессорном.  Кроме того, в рамках стандартных спецификаций компании системы на базе Эльбрус-8С смогли пройти всего по 7 параметрам из 44 предъявляемых. Если отсутствие монтажных стоечных рельсов можно отнести к «мелким претензиям», которые легко решаются, то отсутствие системы удалённого управления — недоработка весьма серьёзная, поскольку затраты на увеличение штата ИТ-специалистов окажутся непомерно велики.  Стоит, однако, отметить, что Эльбрус-8С уже устарел в рамках собственной экосистемы: МЦСТ обещает представить на тестирование усовершенствованные варианты серверов на базе Эльбрус-8СВ с более высокой частотой (1,5 против 1,3 ГГц), удвоенной производительностью в операциях над числами с плавающей запятой, а также использующие память DDR4-2400 (до 1 Тбайт на сервер) вместо окончательно устаревшей DDR3-1600. Однако массовые поставки таких серверов при заказе 1-5 тыс. единиц возможны не ранее IV квартала 2022 года при заказе в III квартале 2021 года.  Признана необходимость проведения тестов систем на базе Эльбрус под управлением ОС, сертифицированных ФСТЭК по профилю не ниже ОС.А4 (использование для обработки персональных данных и ГИС). Также отмечена необходимость введения полноценной поддержки технологий виртуализации, а не только контейнеризации.  Отметим также, что МЦСТ успешно завершила разработку Эльбрус-16С, в котором ряд фундаментальных недостатков, присущих процессорам Эльбрус-8С/8СВ успешно устранён. Новый чип будет иметь 16 ядер с возросшей до 2 ГГц частотой, восьмиканальный контроллер памяти DDR4-3200 (до 16 Тбайт на сервер), контроллер 10GbE и интегрированный контроллер PCIe 3.0 (32 линии). Последний снимает серьёзные ограничения по пропускной способности чипов Эльбрус-8C/CB к периферийным устройствам. Также с 8 до 48 Гбайт/с возрастёт скорость межпроцессорного обмена данными.  Представитель МЦСТ отметил, что низкие результаты в Java-тестах отчасти обусловлены «слепым тестированием», в котором разработчикам не были предоставлены данные, необходимые для полноценной оптимизации Java-машины. Простым подбором опций МЦСТ удалось улучшить показатели в три раза, а «макет» оптимизированного приложения СберТеха позволил сократить время отклика с 24 до 4 мс, что практически равнозначно показателям систем на базе процессоров Intel (Core i7-9700, 3 мс).

10.12.2021 [12:00], Алексей Степин

Аквариус T50 D224CF: надёжный и масштабируемый сервер для любых задачКомпания «Аквариус» работает на российском рынке с 1989 года, постоянно расширяя ассортимент производимой продукции. При этом она практически не использует оборудование ОЕМ-поставщиков, 94% из всего модельного ряда устройств «Аквариус» составляют системы собственной разработки. В этом году компания сообщила о разработке двадцати новых моделей серверов и преодолела рубеж в 250 тысяч произведенных серверных устройств. Юбилейной стала флагманская модель — Aquarius T50 D224CF.  Это сервер форм-фактора 2U, располагающий серьёзными возможностями: новая модель разработана с прицелом на максимальную гибкость конфигурирования и расширения, поэтому она одинаково хорошо подойдёт как для развёртывания среды виртуализации или работы с объемными базами данных, так и для создания современной высокопроизводительной системы хранения данных. Базируется Аквариус T50 D224CF на хорошо известной и доказавшей свою надёжность платформе Intel® Xeon® Scalable (LGA 3647). Системная плата на базе чипсета Intel® C624 предусматривает установку процессоров Xeon® Scalable с этим разъёмом как первого (Skylake-SP), так и второго (Cascade Lake-SP/Refresh) поколения с теплопакетом вплоть до 205 Вт включительно. 24 слота для модулей памяти позволяют установить до 3 Тбайт оперативной памяти стандарта DDR4, а с использованием модулей Optane DCPMM этот показатель можно довести и до 6 Тбайт. Но по-настоящему интересной данную модель делает её гибкость в конфигурировании. Во-первых, она имеет 24 дисковых корзины формата 2,5″ с поддержкой SAS-3/SATA-3 и NVMe (до 16 накопителей) и опционально может оснащаться ещё 4 такими отсеками на тыльной стороне (но уже без NVMe). А поддержка одновременной работы 16 NVMe SSD делает Aquarius T50 D224CF отличной платформой для создания высокопроизводительной СХД. Во-вторых, новый сервер Аквариус может поставляться в двух конфигурациях в зависимости от адаптеров расширения:

Оба варианта прекрасно работают с любыми картами расширения, включая ускорители, периферийные и сетевые адаптеры стандартов Ethernet, InfiniBand 10/40/100 Гбит/с, а также Fibre Channel. Сервер имеет развитую систему мониторинга и удалённого управления на основе популярного контроллера ASPEED AST2500, поддерживающего стандарты IPMI 2.0 и Redfish 1.1. Контроллер имеет свой выделенный порт 1GbE.

Стапельная сборка сервера на производственном комплексе «Аквариус», город Шуя, Ивановская область Максимальная конфигурация сервера требует наличие высокоэффективной системы охлаждения, которая в данной модели состоит из 6-ти вентиляторов с ШИМ-управлением, имеющих вибропоглощающие крепления и поддерживающих горячую замену. Дополнительную отказоустойчивость системы охлаждения обеспечивает индикатор отказа. Заменять в горячем режиме можно и ряд других компонентов сервера, за исключением процессоров, что позволяет в случае неисправности сократить время простоя до минимума. За питание отвечает пара (1+1) блоков, которые, в зависимости от конфигурации, могут иметь мощность от 800 до 2000 Ватт. Базовый вариант предполагает питание от стандартной сети, опционально «Аквариус» предлагает питание от сети постоянного тока 48 В, либо высоковольтной сети 380 В. Также доступен встроенный источник бесперебойного питания. Гибкость и масштабируемость данного сервера делают его поистине универсальным решением: Аквариус T50 D224CF может применяться в облачных системах, кластерах HPC, комплексах виртуализации (в том числе для виртуальных рабочих мест, VDI), системах машинного обучения или как сервер веб-приложений. Он может стать частью комплекса ИИ, основой СХД или мощной сетевой инфраструктуры.  Компания-производитель гарантирует совместимость с широчайшим спектром операционных систем и программного обеспечения. В частности, модель сертифицирована для работы с ПО VMware, RedHat, SUSE, Microsoft Windows Server, а также протестирована на совместимость работы с ускорителями вычислений NVIDIA и российскими средствами защиты информации «Соболь» и «Аккорд». Более того, сервер может комплектоваться двумя микросхемами BIOS, предоставляя заказчику возможность переключаться между AMI BIOS и отечественной разработкой NUMA BIOS.  Аквариус T50 D224CF — это современный, высокопроизводительный сервер, который отличается гибкостью конфигурирования и широкоми возможностями расшириения системы. Именно гибкость и масштабируемость делают его действительно универсальной системой для поддержки самого широкого спектра нагрузок и формирования различных IT-систем. Стоимость нового сервера варьируется в зависимости от конфигурации, цена базового варианта стартует от 400 000 рублей. При необходимости можно получить более точную информацию на сайте компании-производителя, либо по телефону +7 (495) 729-51-50.

07.12.2021 [00:36], Алексей Степин

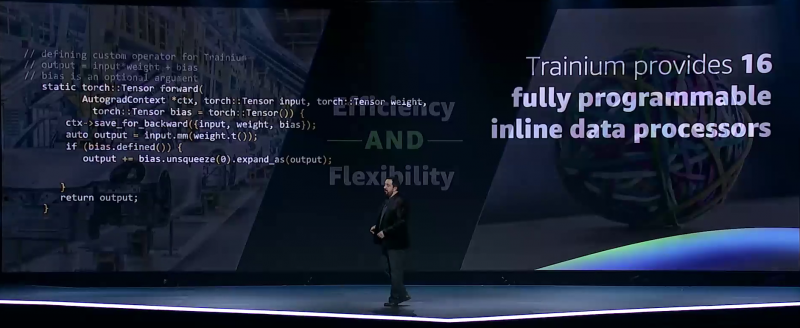

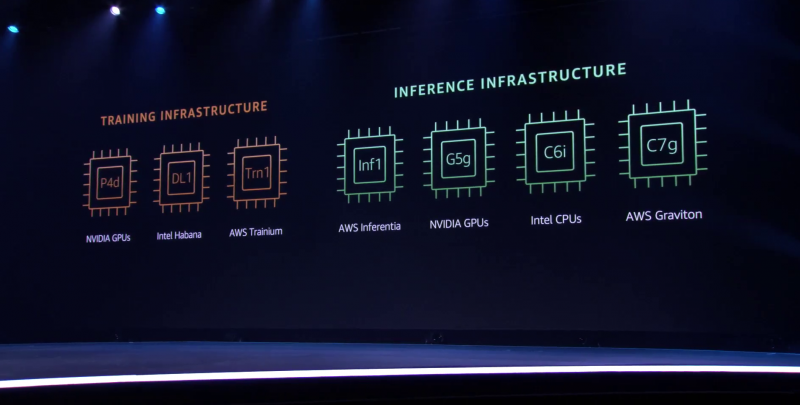

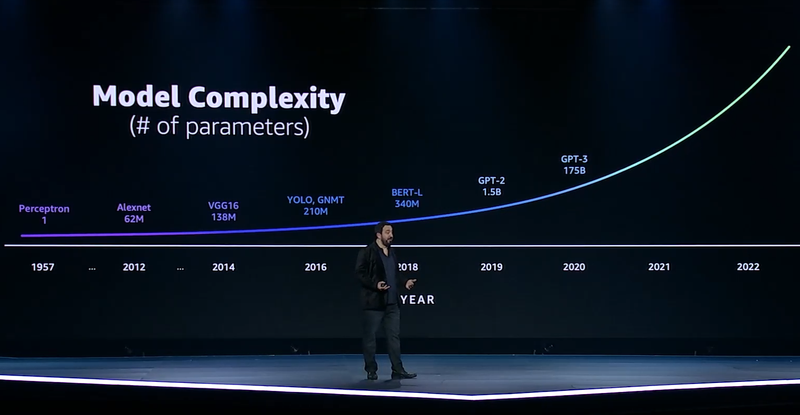

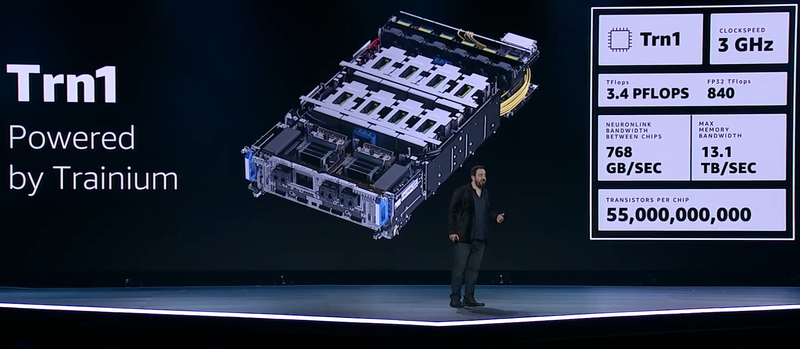

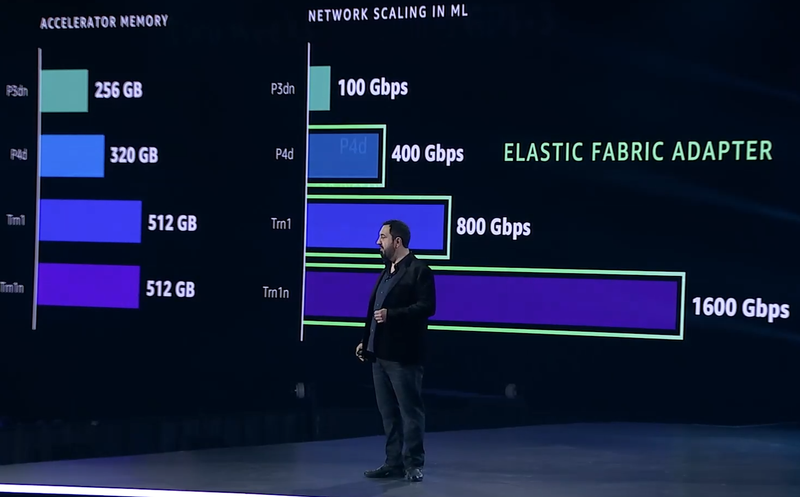

ИИ-ускорители AWS Trainium: 55 млрд транзисторов, 3 ГГц, 512 Гбайт HBM и 840 Тфлопс в FP32GPU давно применяются для ускорений вычислений и в последние годы обросли поддержкой специфических форматов данных, характерных для алгоритмов машинного обучения, попутно практически лишившись собственно графических блоков. Но в ближайшем будущем их по многим параметрам могут превзойти специализированные ИИ-процессоры, к числу которых относится и новая разработка AWS, чип Trainium. На мероприятии AWS Re:Invent компания рассказала о прогрессе в области машинного обучения на примере своих инстансов P3dn (Nvidia V100) и P4 (Nvidia A100). Первый вариант дебютировал в 2018 году, когда модель BERT-Large была примером сложности, и благодаря 256 Гбайт памяти и сети класса 100GbE он продемонстрировал впечатляющие результаты. Однако каждый год сложность моделей машинного обучения растёт почти на порядок, а рост возможностей ИИ-ускорителей от этих темпов явно отстаёт.

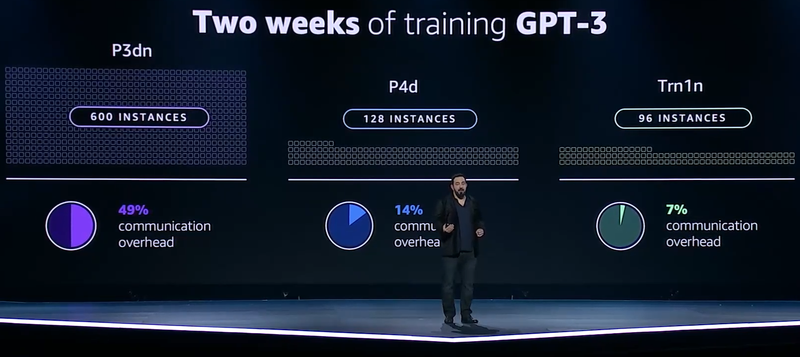

Сложность моделей машинного обучения будет расти всё быстрее Когда в прошлом году был представлен вариант P4d, его вычислительная мощность выросла в четыре раза, а объём памяти и вовсе на четверть, в то время как знаменитая модель GPT-3 превзошла по сложности BERT-Large в 500 раз. А теперь и 175 млрд параметров последней — уже ничто по сравнению с 10 трлн в новых моделях. Приходится наращивать и объём локальной памяти (у Trainium имеется 512 Гбайт HBM с суммарной пропускной способностью 13,1 Тбайт/с), и активнее использовать распределённое обучение.  Для последнего подхода узким местом стала сетевая подсистема, и при разработке стека Elastic Fabric Adapter (EFA) компания это учла, наделив новые инстансы Trn1 подключением со скоростью 800 Гбит/с (вдвое больше, чем у P4d) и с ультранизкими задержками, причём доступен и более оптимизированный вариант Trn1n, у которого пропускная способность вдвое выше и достигает 1,6 Тбит/с. Для связи между самими чипами внутри инстанса используется интерконнект NeuroLink со скоростью 768 Гбайт/с.

Прогресс подсистем сети и памяти в ИИ-инстансах AWS Но дело не только в возможности обучить GPT-3 менее чем за две недели: важно и количество используемых для этого ресурсов. В случае P3d это потребовало бы 600 инстансов, работающих одновременно, и даже переход к архитектуре Ampere снизил бы это количество до 200. А вот обучение на базе чипов Trainium требует всего 130 инстансов Trn1. Благодаря оптимизациям, затраты на «общение» у новых инстансов составляют всего 7% против 14% у Ampere и целых 49% у Volta.

Меньше инстансов, выше эффективность при равном времени обучения — вот что даст Trainium Trainium опирается на систолический массив (Google использовала тот же подход для своих TPU), т.е. состоит из множества очень тесно связанных вычислительных блоков, которые независимо обрабатывают получаемые от соседей данные и передают результат следующему соседу. Этот подход, в частности, избавляет от многочисленных обращений к регистрам и памяти, что характерно для «классических» GPU, но лишает подобные ускорители гибкости. В Trainium, по словам AWS, гибкость сохранена — ускоритель имеет 16 полностью программируемых (на С/С++) обработчиков. Есть и у него и другие оптимизации. Например, аппаратное ускорение стохастического округления, которое на сверхбольших моделях становится слишком «дорогим» из-за накладных расходов, хотя и позволяет повысить эффективность обучения со смешанной точностью. Всё это позволяет получить до 3,4 Пфлопс на вычислениях малой точности и до 840 Тфлопс в FP32-расчётах. AWS постаралась сделать переход к Trainium максимально безболезненным для разработчиков, поскольку SDK AWS Neuron поддерживает популярные фреймворки машинного обучения. Впрочем, насильно загонять заказчиков на инстансы Trn1 компания не собирается и будет и далее предоставлять на выбор другие ускорители поскольку переход, например, с экосистемы CUDA может быть затруднён. Однако в вопросах машинного обучения для собственных нужд Amazon теперь полностью независима — у неё есть и современный CPU Graviton3, и инфереренс-ускоритель Inferentia.

09.11.2021 [12:33], Алексей Степин

NVIDIA представила платформу Jetson AGX Orin для периферийных ИИ-вычислений, робототехники и автономного транспортаОдним из лидеров в создании высокопроизводительных встраиваемых решений давно является NVIDIA с серией Jetson. На смену уже немолодой платформе Jetson AGX Xavier пришла Jetson AGX Orin, обладающая ускорителем с архитектурой Ampere. Компания не без оснований называет Jetson AGX Orin самой мощной, компактной и энергоэффективной платформой для робототехники, автономного транспорта и встраиваемых решений для работы на периферии — её производительность оценивается в 200 Топс, что более чем в шесть раз выше показателей Xavier. По словам NVIDIA новинка сравнима по скорости работы с GPU-сервером, но при этом умещается на человеческой ладони.  Новая 7-нм SoC состоит из 17 млрд транзисторов. Она включает 12 ядер Cortex-A78AE, одних из самых мощных в арсенале Arm, предназначенных для задач класса mission critical и имеющих продвинутые механизмы защиты от системных сбоев Это немаловажно, к примеру, при применении в беспилотных транспортных средствах и промышленной автоматике. Всё это дополнено 2048 ядрами NVIDIA Ampere. ускорители. Ускорена подсистема памяти (200 Гбайт/с). Серьёзно возросли сетевые возможности — новый чип имеет сразу четыре интерфейса 10 Гбит/с.  Разработчики решений на базе Jetson AGX Orin могут использовать NVIDIA CUDA-X, JetPack SDK и наиболее новые версии утилит NVIDIA. Также на момент анонса уже доступны предварительно натренированные и оптимизированные под новую платформу ИИ-модели из каталога NVIDIA TAO, которые помогут сократить время создания новых решений на базе Orin. Доступность новых плат Jetson AGX запланирована на первый квартал следующего года. Дабы не пропустить этот момент, NVIDIA предлагает зарегистрироваться в соответствующем разделе своего сайта.

26.10.2021 [22:45], Игорь Осколков

Получена первая партия российских серверных Arm-процессоров Baikal-S: 48 ядер, 6 каналов DDR4-3200 и 80 линий PCIe 4.0Компания «Байкал Электроникс» сообщила о получении первой партии инженерных образцов серверных Arm-процессоров Baikal-S объёмом 400 шт. Следующую партию компания ожидает получить в первом квартале следующего года, а первые массовые поставки (партия более 10 тыс. шт.) должны начаться до конца третьего квартала. Инженерные платы для разработчиков, созданы «Гаоди рус» (Dannie Group) и выпущены компанией «Рутек». Baikal-S, изготавливаемый по 16-нм техпроцессу на TSMC, имеет 48 ядер Arm Cortex-A75 на базе достаточно свежей 64-бит архитектуры ARMv8.2-A, которая была анонсирована в 2017 году. Частота составляет до 2,2 ГГц, а уровень TDP равен 120 Вт. Заявленный диапазон рабочих температур простирается от 0 до +70 °C. Производительность в HPL составляет 385 Гфлопс, а рейтинг в SPEC CPU2006 INT — до 600. Ориентировочная цена одного процессора ожидается на уровне $3 тыс.  L1-кеш имеет объём по 64 Кбайт для данных и инструкций, а L2 — 512 Кбайт на ядро. Любопытно, что в дополнение к L3-кешу (по 2 Мбайт на кластер) есть ещё и L4-кеш на 32 Мбайт. Контроллер памяти имеет шесть каналов DDR4-3200 ECC и обслуживает до 128 Гбайт на канал (суммарно 768 Гбайт на сокет). Кроме того, каждый процессор имеет 80 линий PCIe 4.0, из которых 48 линий делятся тремя интерфейсами CCIX x16. Также есть пара 1GbE-интерфейсов. При этом новинка поддерживает аппаратную виртуализацию, Arm TrustZone и позволяет создавать четырёхсокетные платформы. Всё это делает её привлекательным решением не только для традиционных серверов и СХД, но и для и HCI- и HPC-систем. С экосистемой ПО проблемы вряд ли будут. Во-первых, для «малого» Байкал-М уже сейчас есть отечественные ОС и другие продукты. Во-вторых, серверные платформы Arm в мире развивают сразу несколько игроков, да и сама Arm стимулирует процесс разработки и портирования ПО. Кроме того, «Байкал Электроникс» имеет тесные связи с ГК Astra Linux. |

|