Материалы по тегу: ии

|

11.01.2025 [22:37], Владимир Мироненко

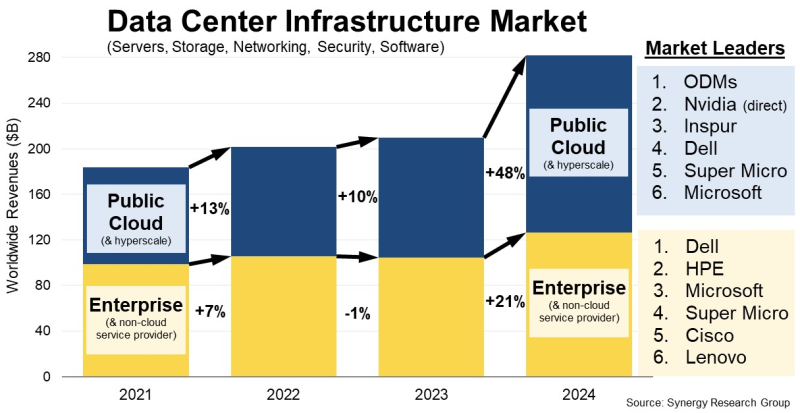

На волне бума генеративного ИИ продажи оборудования для ЦОД в 2024 году выросли до исторического максимумаСогласно данным Synergy Research Group, мировые расходы на оборудование и ПО для ЦОД в 2024 году выросли по сравнению с 2023 годом на 34 %, достигнув исторического максимума. Хотя рост наблюдался во всех сегментах рынка, в значительной мере он был обусловлен 48 % скачком расходов на инфраструктуру публичного облака, на которую теперь приходится 55 % общего объёма рынка. После незначительного роста, наблюдавшегося в течение предыдущих пяти лет, в 2024 году было отмечено оживление продаж корпоративным клиентам, увеличившихся на 21 %. Аналитики Synergy Research Group отметили, что уже 15 лет рост услуг публичного облака стимулирует рост инвестиций в облачную инфраструктуру, что ведёт к ограничению расходов на собственные ЦОД предприятий. Эта тенденция продолжилась и в 2024 году, но новым драйвером рынка, обеспечившим огромный рост расходов, стал генеративный ИИ. Провайдеры облачных услуг и предприятия в равной степени стремились приобретать ускорители. Бум на рынке ИИ повлёк за собой взрывной рост выручки NVIDIA, прямые продажи которой гиперскейлерам и корпоративным клиентам вывели её в число ведущих поставщиков оборудования для ЦОД. Также был отмечен рост продаж Inspur, SuperMicro и продолжающееся доминирование ODM-производителей, поставляющих оборудование гиперскейлерам. Согласно прогнозу Synergy, общие доходы от продаж оборудования инфраструктуры ЦОД, включая облачное, а также от ПО, достигнут $282 млрд в 2024 году. Из них $156 млрд придётся на инфраструктуру публичного облака. Цифры основаны на фактических данных за первые три квартала 2024 года, а также прогнозе Synergy на IV квартал. На серверы, хранилища и сетевые решения в совокупности пришлось 85 % рынка инфраструктуры ЦОД. Остальная часть включает ПО, ПО для виртуализации, управления облаком и сетевой безопасности. Synergy отметила, что если исключить ODM, то Dell является лидером по доходам сегмента серверов и хранилищ, а Inspur — лидером по продажам серверов публичным облакам. Cisco лидирует в сетевом сегменте. А Microsoft выбилась в лидеры благодаря серверным ОС и виртуализации. NVIDIA занимает ведущие позиции в качестве поставщика как для вендоров, так и для поставщиков услуг. Помимо перечисленных пяти компаний в число ведущих поставщиков на рынке также входят HPE, SuperMicro, Lenovo, VMware, Huawei, IBM и Arista Networks. ИИ-ускорители и системы генеративного ИИ вызвали настоящий ажиотаж на рынке в 2024 году, что привело к рекордным темпам роста отрасли, отметил Джон Динсдейл (John Dinsdale), главный аналитик Synergy Research Group. Он сообщил, что корпоративный сегмент рынка снова растёт, хотя в долгосрочной перспективе публичные облака останутся основными инвесторами в ЦОД: «Десять лет назад продажи поставщикам публичных облачных сервисов составляли всего 20 % рынка. В 2024 году этот показатель вырос до 55 %, и, по нашему прогнозу, через пять лет он достигнет почти 65 %».

10.01.2025 [16:09], Руслан Авдеев

Штаб-квартира на острове, ЦОД — на материке: Малайзия и Сингапур подписали соглашение о создании особой экономической зоны JS-SEZМалайзия и Сингапур содписали соглашение, предусматривающее создание особой экономической зоны Johor-Singapore Special Economic Zone (JS-SEZ). Оно должно укрепить сотрудничество и взаимные инвестиции между Джохором и Сингапуром, использовав их близость для общего роста, как это было с Шэньчжэнем и Гонконгом, сообщает DigiTimes. Площадь JS-SEZ составит 3,5 тыс. км2. В ОЭЗ партнёры намерены в течение пяти лет привлечь 50 инвестиционных проектов. Малайзия рассчитывает, что ОЭЗ позволит создать около 100 тыс. рабочих мест и к 20230 году начнёт приносить MYR260 млрд ($57,78 млрд). Инвестиции ожидаются преимущественно со стороны сингапурских компаний, которые увидели для себя новые возможности для роста. Впрочем, компании подчёркивают необходимость расширения благоприятных для бизнеса политик в рамках новой экономической зоны, включая упрощение бюрократических процедур, расширение налоговых льгот и развитие инфраструктуры. Уникальное географическое положение Сингапура и его особый экономический ландшафт привели к созданию стратегии Singapore+1, поощряющей бизнесы открывать азиатско-тихоокеанские штаб-квартиры именно в Сингапуре, а производство и прочие виды деятельности переносить в близлежащие регионы вроде Джохора (Малайзиия) и Батама (Индонезия). Такой подход приобрёл особое значение в отраслях, требующих земли, например, для строительства ЦОД, поскольку в самом Сингапуре острый дефицит свободных площадей, энергии и природных ресурсов. В 2019–2022 гг. сингапурские власти приостановили развитие новых дата-центров. За это время Джохор успешно привлёк 50 проектов ЦОД. Реализовать проекты в Сингапуре до сих пор непросто, а Джохор становится всё более привлекательным для размещения объектов, которые Сингапур более не может себе позволить из-за нехватки места. По словам Министерства экономики Малайзии, основной целью JS-SEZ является устранение барьеров для перемещения людей и товаров и стимулирование бизнеса. По данным Bloomberg, пока сохраняются логистические вызовы. Ежедневно граница между странами пересекается 300 тыс. раз, но передвижению мешают задержки на таможне. При этом реализация проекта высокоскоростной железной дороги между Куала-Лумпуром и Сингапуром задерживается. Впрочем, отраслевые эксперты предупреждают, что основными вызовами является повышение административной эффективности и работа с инвесторами. При этом Малайзия и сама претендует на роль IT-хаба, способного составить конкуренцию Сингапуру, и как будет развиваться сотрудничество в таких условиях, предсказать довольно трудно. Индонезия, с которой Сингапур также планирует расширить сотрудничество, сама не прочь стать новым IT-лидером региона.

10.01.2025 [14:21], Руслан Авдеев

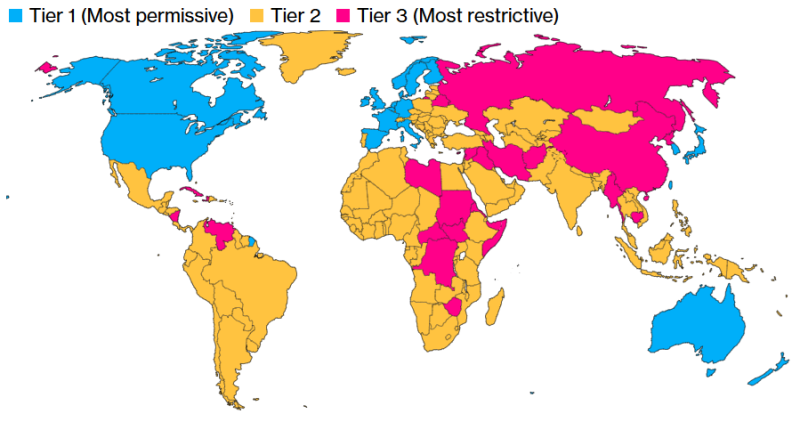

ИИ по квотам: США распространят ограничения на поставку ускорителей и обучение моделей почти на весь мирАдминистрация действующего президента США Джо Байдена (Joe Biden) до окончания своих полномочий намерена провести очередной раунд ограничений на экспорт ИИ-чипов. Это новая попытка перекрыть доступ к передовым технологиям Китаю, Ирану, России и другим странам, сообщает Bloomberg. После появления новостей акции NVIDIA и AMD несколько упали в цене. По данным источников, США намерены ограничить продажи ИИ-полупроводников для ЦОД как на уровне стран, так и на уровне отдельных компаний. Основная цель — обеспечить развитие передовых ИИ-систем только «дружественным» государствам и приведение мирового бизнеса в соответствие с американскими стандартами. В результате ограничения в той или иной степени распространятся почти на весь мир. Неограниченный доступ к современным технологиям сохранит только небольшая группа союзников США вроде Канады, ряда стран ЕС, Южной Кореи и Японии. Остальным доступ постараются перекрыть максимально, а большая часть мира, по мнению администрации, оказалась недостаточно благонадёжной, чтобы покупать ИИ-ускорители без ограничений. Появятся квоты, ограничивающие вычислительные способности каждой отдельной страны. Компании, базирующиеся в таких странах, могут обойти подобные ограничения — но для этого им необходимо будет привести свой бизнес в соответствие с американскими стандартами. Для этого вводится термин «проверенный конечный пользователь» (Validated End User, VEU). Разумеется, в NVIDIA выступили против инициативы, подчеркнув, что ограничение экспорта не прекратит злоупотребления, но создаст угрозу экономическому росту и поставит под вопрос лидерство США. Пока общемировой интерес к ускоренным вычислениям в повседневной жизни — невероятная возможность для экономики Соединённых Штатов. Многолетние санкции уже ограничивают возможности NVIDIA, AMD и др. компаний поставлять передовые чипы любому заказчику. Теперь США пытаются ограничить доступ к чипам через посредников на Ближнем Востоке и в Юго-Восточной Азии. Против инициативы выступает и Ассоциация полупроводниковой промышленности (Semiconductor Industry Association). Ассоциация не одобряет принятия решения в период смены президентов, без учёта мнения отрасли — это может сказаться на конкурентоспособности США в мире. Китай имеет собственные ИИ-чипы, хотя и не такие производительные и, возможно, будет поставлять их и другим странам, усиливая своё влияние. Новые меры готовятся ввести на фоне гигантского спроса на ИИ-ускорители. Буквально каждая страна намерена использовать их в своих ЦОД, в чём и заключается «уникальная возможность» США и в политической плоскости — чтобы, по словам конгрессменов, «увести компании и страны с орбиты Пекина». К первому «разряду» (Tier I), по данным источников издания, отнесут США и 18 союзников, включая Канаду, Австралию, Японию, Великобританию, Германию, Францию, Южную Корею и Тайвань. Компании из этих регионов могут свободно пользоваться вычислительными ресурсами, а их штаб-квартиры в этих странах смогут получить разрешение на поставку чипов в ЦОД практически по всему миру. Однако им запрещено размещать более 25 % вычислительных мощностей за пределами стран Tier I и более 7 % — в любой из стран Tier II. Кроме того, они должны будут соблюдать требования к безопасности, выдвигаемые американским правительством. Компании со штаб-квартирами в США должны будут размещать не менее половины вычислительных мощностей на американской земле. В целом США и приближённые страны, согласно новому плану, должны располагать большими вычислительными мощностями, чем весь остальной мир. Подавляющее большинство стран относится ко второму разряду (Tier II). Каждой из них можно внедрить порядка 50 тыс. ИИ-ускорителей с 2025 по 2027 гг. При этом отдельные компании могут добиться гораздо больших лимитов, если получат статус VEU в каждой стране, где намерены оснастить ЦОД. Для этого необходимо иметь доказанную историю соблюдения американских норм и стандартов в сфере прав человека, или, как минимум, иметь убедительные планы для достижения необходимых результатов. Если компания получит статус VEU, её импорт чипов не будет сказываться на общей квоте страны. Это поощряет бизнес приводить свою деятельность в соответствие с американскими стандартами. Вместе с тем накладываются и требования по физической безопасности объектов, кибербезопасности и отбору персонала. Наконец, больше всего ограничения коснутся России, Беларуси, Китая, Ирана, КНДР, а также всех стран, на которые распространяется американское эмбарго на поставки вооружений. Речь идёт приблизительно о двух дюжинах государств уровня Tier III. Поставки ИИ-ускорителей в ЦОД этих стран будут запрещены. Помимо контроля над полупроводниками, новые правила также ограничивают и экспорт закрытых ИИ-моделей. Компаниям будет запрещён их хостинг в странах Tier III, а страны Tier II должны будут выполнять ряд требований. Конечно, ограничения не распространяются на страны, получившие универсальный статус VEU. Открытых моделей эти правила не коснутся, то же касается и маломощных закрытых моделей, менее производительных, чем имеющиеся в свободном доступе. Тем не менее, если компания захочет настроить открытую модель для выполнения специальных задач и этот процесс потребует значительных вычислительных мощностей, ей также понадобится подавать заявку на получение разрешения США для выполнения подобных задач в странах Tier II. Ранее США запрещали поставки в страны вроде России на неопределённый срок. В Китай разрешено было поставлять версии с ограниченной функциональностью, а в ноябре прошлого года появилась новость, что США запретили TSMC выпускать передовые ускорители по заказу китайских компаний. На большинство стран мира ограничения не распространялись, что способствовало стремительному росту бизнеса NVIDIA.

10.01.2025 [08:20], Руслан Авдеев

Siemens: спрос на энергию со стороны ИИ ЦОД нормализуется, но «зелёных» источников всё равно на всех не хватитПо словам представителя Siemens Маттиаса Ребеллиуса (Matthias Rebellius), ИИ ЦОД не могут полагаться только на «зелёные» источники для удовлетворения своего спроса на электричество. Им придётся прибегнуть к помощи поставщиков других типов электроэнергии, сообщает The Wall Street Journal. Несмотря на то, что крупнейшие гиперскейлеры заключают долгосрочные соглашения о покупке возобновляемой энергии, Ребеллиус заявил, что это не решение для энергетических запросов сектора. По его словам, мир нуждается в новом плане по быстрому наращиванию генерирующих мощностей в короткие сроки. В 2024 году гиперскейлеры активно уделяли внимание атомной энергетике в качестве низкоуглеродной альтернативы ископаемому топливу. AWS и Microsoft заключили соглашения о выкупе энергии у крупных атомных электростанций. Кроме того, Equinix, AWS и Google подписали контракты питание от малых модульных реакторов (SMR). Впрочем, коммерческих SMR пока не существует, а внедрять их начнут не раньше 2030-х гг. При этом традиционная атомная энергетика доступна далеко не везде и не всем, поэтому она не сможет удовлетворить спрос на электричество в ближайшем будущем. В Siemens считают, что рост спроса на энергию в связи с развитием ИИ неизбежно нормализуется после текущей фазы быстрого роста. Ребеллиус утверждает, что ежегодного прироста на уровне 50 % ждать не придётся, хотя Siemens и другие компании всё же ожидают со стороны дата-центров двузначного роста в процентном выражении на энергии, что, впрочем, всё равно вдвое выше, чем на обычном инфраструктурном рынке. Чтобы удовлетворить спрос, энергетические компании в США используют все доступные источники энергии, а некоторые из них анонсировали, что отложат закрытие электростанций на ископаемом топливе или перезапустят уже закрытые в связи с беспрецедентным спросом. Некоторые операторы уже объявили, что в «ультракороткой перспективе» дата-центры могут полагаться на энергию газовых электростанций из-за высочайшего спроса на электричество. Это послужит своеобразным «мостиком» при переходе на низкоуглеродные источники энергии. Ранее в докладе S&P Global сообщалось, что спрос на природный газ для обеспечения энергией дата-центров в США может вырасти до 85 млн или даже 170 млн м3 в день для обеспечения потребностей ИИ. Кроме того, не так давно сообщалось о намерении запустить на территории старых атомных и классических электростанций в США новые реакторы.

10.01.2025 [01:20], Руслан Авдеев

США упростят подключение ИИ ЦОД к геотермальным источникам энергииУходящее в ближайшие дни правительство США намерено упростить получение разрешений на работу с геотермальной энергией. Новая инициатива будет реализована в рамках более общей программы поддержки ИИ ЦОД, сообщает Bloomberg. Приказ будет одним из последних, подписанных действующим президентом США Джо Байденом (Joe Biden) до того, как тот оставит должность. Ожидается, что документ будет опубликован на следующей неделе. Новые меры в числе прочего предусматривают упрощение процесса строительства дата-центров на федеральных землях, а также ускорение выдачи разрешений для реализации геотермальных и атомных проектов. Министерство внутренних дел США выделит зоны приоритетного развития геотермальной энергетики, а Министерство обороны и Министерство энергетики определят площадки, принадлежащие федеральным ведомствам, где можно будет построить крупные дата-центры. Расположенные на федеральных землях объекты должны соответствовать особым стандартам и нормам кибербезопасности, на них будут распространяться ограничения на иностранное финансирование. Кроме того, участвующим в проектах бизнесам придётся выделить часть вычислительных ресурсов на национальные исследования в области ИИ. В последнее время уходящая администрация США буквально фонтанирует всевозможными приказами. Не исключено, что после прихода нового президента Дональда Трампа (Donald Trump), часть из них может быть отменена. Впрочем, вряд ли это касается сектора ЦОД. Администрация Трампа дала понять, что развитие дата-центров останется в приоритете — это вопрос обеспечения национальной безопасности. Будущие власти обещают предоставить ИИ ЦОД все доступные виды энергии. Некоторые гиперскейлеры уже подписали с геотермальными электростанциями соглашения на поставку энергии для их ЦОД. В августе 2024 года Meta✴ анонсировала 150-МВт сделку со стартапом Sage Geosystems. Первая фаза проекта должна завершиться введением объектов в эксплуатацию в 2027 году. Ранее Google договорилась о сотрудничестве с Fervo Energy и NV Energy о покупке более 100 МВт геотермальной энергии в Неваде, а Microsoft подписала связанные с геотермальной энергетикой соглашения о покупке энергии (PPA) в Новой Зеландии с Contact Energy, а также развивает геотермальный проект в Кении.

10.01.2025 [01:09], Владимир Мироненко

Tencent потеряла $35 млрд капитализации после попадания в чёрный список ПентагонаМинистерство обороны США объявило в начале недели о включении ИТ-гиганта Tencent, производителя аккумуляторов CATL и ещё целого ряда компаний из КНР в чёрный список, также известный как «список раздела 1260H». В него Пентагон с 2021 года добавляет компании, которые, по его мнению, помогают модернизировать армию Китая, пишет Fortune.com. Черный список Пентагона не налагает никаких конкретных санкций на включённые в него компании, кроме запрета предоставлять услуги армии США. Тем не менее аналитики Morningstar предупреждают, что попадание в него может привести к «репутационному ущербу» и отказу других компаний от сотрудничества с Tencent и CATL. В этот список уже попали Huawei, чипмейкеры SMIC и YMTC, а также производитель дронов DJI. Акции Tencent на бирже в Гонконге упали во вторник на 7,3 %, в связи чем компания потеряла около HK$275 млрд (порядка $35,4 млрд) рыночной стоимости. Акции CATL, зарегистрированные в Шэньчжэне, закрылись со снижением на 2,8 %, что привело к потере ¥32,2 млрд (около $4,4 млрд) рыночной стоимости. Представитель Tencent назвал включение фирмы в чёрный список «явной ошибкой» и отметил, что это не окажет никакого влияния на её бизнес. «Мы не военная компания и не поставщик [армии]… Тем не менее мы будем работать с Министерством обороны, чтобы устранить любые недоразумения», — заявил он. Министерство иностранных дел Китая выступило с критикой этого решения. «Китай всегда решительно выступал против обобщения американской стороной концепции национальной безопасности, создания различных дискриминационных списков, необоснованного подавления китайских предприятий и сдерживания развития Китая», — заявил журналистам пресс-секретарь Го Цзякунь (Guo Jiakun). Morningstar считает, что у Tencent «хорошие шансы» отменить включение в «чёрный» список через суд, ссылаясь на то, что её бизнес-модель в основном нацелена на сегменты социальных сетей и видеоигр. Так, китайскому производителю телефонов Xiaomi, включённому в чёрный список в конце работы первой администрации Трампа, которая запретила инвестиции США в компанию, удалось доказать в суде, что это было «незаконным и неконституционным». И спустя четыре месяца Министерство обороны США исключило Xiaomi из списка. И таких примеров можно привести несколько. Министерство обороны США отметило, что компании, включённые в список, имеют право потребовать пересмотра решения. Пентагон уже исключил несколько компаний из чёрного списка, включая Beijing Megvii Technology Co., China Marine Information Electronics Co., China Railway Construction Corp., China State Construction Group Co., China Telecommunications Corp. и ShenZhen Consys Science & Technology Co.

09.01.2025 [12:43], Руслан Авдеев

DeepGreenX и Sente Ventures направят $25 млрд на развитие «зелёных» ЦОДЮжнокорейская DeepGreenX заключила рамочное соглашение с Sente Ventures для создания новой стратегической инвестиционной программы сроком на пять лет на сумму $25 млрд. Инвестициями смогут воспользоваться компании, предлагающие решения в области производства «чистой» энергии, виртуальных энергосетей, энергохранилищ, микрореакторной энергетики и инфраструктуры ЦОД, сообщает Datacenter Dynamics. В рамках нового партнёрства создано совместное предприятие DXG-Hues. DXG-Hues сформирует два фонда по $5 млрд каждый для проектов в сфере «зелёной» энергетики, ИИ и вычислительных мощностей в США, Европе и странах Юго-Восточной Азии. Планируется использовать программу привлечения клиентов, ориентированных на устойчивое развитие, и внедрение передовых решений для платформы DeepGreenX, предназначенной для монетизации данных на основе ИИ-алгоритмов. В DeepGreenX рассчитывают, что программа откроет новые возможности для компаний и проектов, связанных с «зелёной» энергетикой. Сеульская DeepGreenX, основанная в 2020 году, действует в 20 странах, занимаясь торговлей углеродными кредитами, сертификацией «зелёной» энергии и управлением активами для секторов ЦОД и технологий в целом. Sente Ventures — венчурный инвестор из Чикаго, специализирующийся на снижении инвестиционных рисков в низкоуглеродные технологии. Компания действует в 24 странах. Азиатский банк развития и инвестиций (Asia Development and Investment Bank, ADIB) объявил в ноябре о стратегических вложениях в DeepGreenX. В частности, компания получит $140 млрд на инжиниринг, закупки, строительство и управление данными. При этом банк получит 36 % акций компании. Впрочем, слишком много «зелёной» энергии — тоже не всегда хорошо: в прошлом году Нидерланды приняли новые нормы работы энергосетей, страдающих от эпизодических перегрузок в результате многочисленных подключений частных электростанций на возобновляемой энергии.

09.01.2025 [12:27], Руслан Авдеев

Microsoft инвестирует $3 млрд в ИИ и облачные вычисления в ИндииКомпания Microsoft намерена инвестировать порядка $3 млрд в расширение ИИ и облачных мощностей в Индии. Об инвестициях объявил 7 января в Бангалоре глава компании Сатья Наделла (Satya Nadella) в ходе поездки Microsoft AI Tour, сообщает Datacenter Dynamics. По его словам, ИИ не существует сам по себе, он требует полного вычислительного стека. Глава Microsoft добавил, что инфраструктура должна быть высочайшим приоритетом, компания внедряет инновации на каждом её уровне. Анонс инвестиций последовал за встречей Наделлы с премьер-министром Индии. 6 января последний сообщил в соцсети X, что в восторге от визита гендиректора Microsoft и рад узнать об амбициозных планах экспансии и инвестиций компании в стране. Microsoft уже располагает несколькими облачными регионами в Индии, а всего в мире у неё есть более 60 облачных регионов и 300 дата-центров. В рамках инициативы ADVANTA(I)GE INDIA компания планирует к 2030 году обучить навыкам работы с ИИ в стране 10 млн человек.

Источник изображения: Yadu Krishnan K S/unsplash.com В 2015 году компания открыла в Индии три облачных региона Azure: в Пуне (Центральная Индия), Ченнаи (Южная Индия), а также Мумбаи (Западная Индия). С тех пор компания отключила регион в Мумбаи, который, возможно, будет превращён в регион резервного доступа. В 2024 году компания приобрела участок на 6,5 га в пригороде Пуна для строительства нового ЦОД. Также компания приобрела 20 га в Хайдарабаде. Недавно компания сообщила, что намерена потратить $80 млрд на строительство ИИ ЦОД в 2025 финансовом году, речь идёт о значительном росте в сравнении с годом ранее. Более половины инвестиций придётся на Соединённые Штаты.

08.01.2025 [22:50], Владимир Мироненко

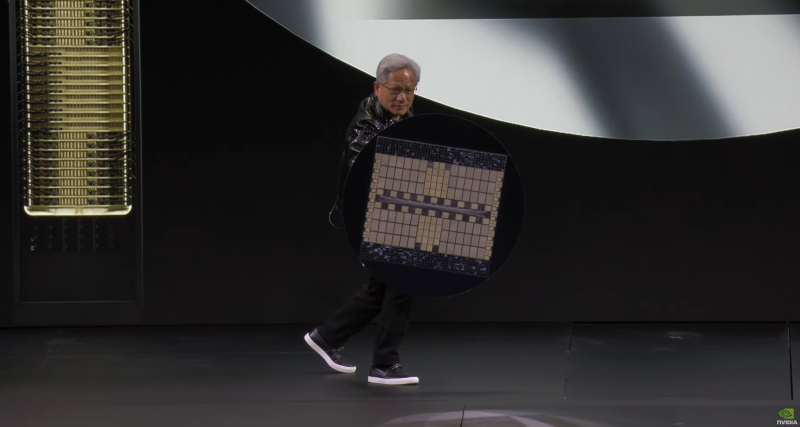

NVIDIA и партнёры запустили полномасштабное производство серверов на базе BlackwellNVIDIA и её партнёры запустили полномасштабное производство систем с ускорителями Blackwell, заявил глава компании Дженсен Хуанг (Jensen Huang): «Каждый поставщик облачных услуг теперь имеет работающие системы». Первой компанией, которая начала поставки серверов на базе Blackwell, стала Dell. Отдельные провайдеры облачных услуг ещё в середине ноября прошлого года стали обладателями её платформ, передаёт Tom's Hardware. На данный момент, по словам NVIDIA, круг поставщиков заметно расширился. Их предложения включают системы на базе Blackwell в более чем 200 различных конфигурациях. «Есть системы от примерно 15 производителей с 200 различными наименованиями в 200 различных конфигурациях, — сказал Хуанг. — Есть с жидкостным охлаждением, воздушным охлаждением, с чипами x86, с NVIDIA Grace, NVL36×2, NVL72. Целый ряд различных типов систем, которые подойдут практически к любому ЦОД в мире». Он отметил, что такие системы производятся на 45 заводах, что говорит о том, насколько активно отрасль переходит на выпуск систем с ИИ. Blackwell от Nvidia значительно увеличивают производительность вычислений для приложений ИИ и HPC по сравнению с чипами поколения Hopper, но при этом потребляют значительно больше энергии, что предъявляет повышенные требования к мощности ЦОД и его системам охлаждения. Если стойка на базе Hopper потребляет 40 кВт, то суперускоритель GB200 NVL72 потребляет порядка 120 кВт или даже больше.

08.01.2025 [16:09], Руслан Авдеев

Дубайская DAMAC инвестирует $20 млрд в строительство дата-центров в СШАДональд Трамп (Donald Trump) объявил о намерении дубайского девелопера элитной недвижимости DAMAC вложить $20 млрд в строительство ЦОД в Соединённых Штатах, сообщает The Register. В какие сроки будет истрачена указанная сумма, не сообщается, но сам Трамп говорит об «очень коротком промежутке времени». Для сравнения — одна только Microsoft намерена в 2025 финансовом году потратить более $40 млрд на ИИ ЦОД в США. В DAMAC напомнили о своих достижениях — компания уже построила 45 тыс. объектов элитной недвижимости по всему миру и намерена построить ещё 45 тыс. в 20 странах. Кроме того, компания инвестирует в ЦОД в 10 странах, в частности, в Таиланде. Не исключается, что в строительство ЦОД для ИИ и гиперскейлеров будет вложено даже больше $20 млрд, «если позволят обстоятельства». Основателем DAMAC является Хусейн Саджвани (Hussain Sajwani), близкий друг Трампа. Трамп ожидает, что инвестиции поддержат создание крупных дата-центров на Среднем Западе и Юге. По словам будущего президента, первую фазу проекта реализуют в Техасе и Аризоне, Оклахоме, Луизиане, Огайо, Иллинойсе, Мичигане и Индиане. Политик добавил, что желающие инвестировать $1 млрд и более будут проходить природоохранные проверки по ускоренному сценарию, поэтому не попадут в «трясину экологических норм». Однако воздействие ЦОД на окружающую среду уже вызывает опасения. Недавно в Google заявили, что с 2019 года выбросы её ЦОД выросли на 48 %. В первую очередь это результат развития ИИ-технологий — так, ИИ-запросы в поиске требуют в 10 раз больше энергии, чем традиционные. По некоторым оценкам, мировой спрос ЦОД на энергию может удвоиться к 2026 году. Сейчас в США работают более 5 тыс. ЦОД и до 2030 года их число будет расти в среднем на 9 % в год. Регулятор NTIA сообщает, что американские ЦОД потребляли более 4 % электричества в США в 2022 году, а к 2030 году этот показатель вырастет до 9 %, причём доля ИИ ЦОД стремительно растёт. National Parks Conservation Association (NPCA) отмечает, что всё больше зелёных зон переводят в категорию индустриальных. Группы экоактивистов и даже сотрудников гиперскейлеров тоже не вполне разделяют энтузиазм строителей. Есть и ещё один нюанс. Так, Citizens Action Coalition of Indiana (CACI) подсчитали, что выделенная дата-центрам энергия обеспечила бы больше рабочих мест, если бы ей нашли применение в других отраслях. Так, по их данным на 1 МВт ЦОД создаётся 0,26 рабочих мест, а в других отраслях — на два порядка больше. Тем временем OpenAI продвигает строительство в стране сети 5-ГВт ЦОД, каждый из которых, как ожидается, позволит создать 40 тыс. рабочих мест. Кроме того, каждый такой ЦОД обеспечит вклад буквально в десятки миллиардов долларов в ВВП штатов. |

|