Материалы по тегу: hardware

|

05.05.2026 [16:11], Сергей Карасёв

РТК-ЦОД инвестировал в развитие инфраструктуры дата-центров более 38 млрд рублейПровайдер РТК-ЦОД сообщил о завершении пятилетней инвестиционной программы по развитию инфраструктуры дата-центров в России. На строительство новых объектов и модернизацию ранее действовавших площадок направлено в общей сложности более 38 млрд руб. В рамках программы выполнено расширение ключевых столичных кластеров. Так, в Московском регионе средства инвестировались в комплекс Медведково, который стал одним из крупнейших коммерческих дата-центров в стране. Не так давно площадка «Медведково-2» вошла в реестр дата-центров Минцифры России. Кроме того, запущен проект в Санкт-Петербурге. Параллельно РТК-ЦОД расширял региональное присутствие. В 2025 году провайдер инвестировал 3,6 млрд руб. в запуск нового объекта в Нижнем Новгороде и ввод новых очередей в Удомле в Тверской области. В 2025-м совокупный прирост сети составил примерно 1,4 тыс. стойко-мест, или 5 %, по сравнению с 2024 годом. В апреле нынешнего года введена в эксплуатацию третья очередь ЦОД в Екатеринбурге. В целом, по итогам реализации программы количество серверных стоек в инфраструктуре компании увеличилось в два раза, достигнув 27 637 ед. При этом сформирована одна из крупнейших в России распределённых структур коммерческих дата-центров с объектами в Москве и региональными узлами. Широкая география охвата, как отмечается, помогает клиентам размещать IT-системы ближе к пользователям, гибко распределять нагрузку между регионами и оптимизировать архитектуру сервисов с учётом требований по задержкам и отказоустойчивости. Около трети от общих затрат за пятилетний период направлено на инженерное и IT-оборудование. Компания сформировала модель плановой модернизации инфраструктуры и замены старых узлов в условиях ограниченной доступности зарубежного оборудования. Для ключевых импортных изделий подобраны отечественные аналоги. На базе созданных ЦОД предоставляются облачные услуги, защищённые среды для критической информационной инфраструктуры и пр. «За последние пять лет РТК-ЦОД удвоил масштаб бизнеса благодаря диверсификации моделей развития — от собственного строительства и управления до аренды и покупки активов. Это позволило сформировать многокомпонентную и устойчивую инфраструктуру. Наше ключевое конкурентное преимущество — сильная инженерная команда и собственная технологическая экспертиза. В условиях ограничений на доступ к иностранному оборудованию всё это гарантирует заказчикам отказоустойчивость и запас мощностей под новые задачи», — говорит глава РТК-ЦОД.

05.05.2026 [15:10], Руслан Авдеев

Panthalassa разработала морские ИИ-платформы, работающие от энергии волнАмериканская Panthalassa привлекла $140 млн в рамках раунда финансирования серии B. Полученные средства позволят разработчикам ИИ-платформы, работающей на энергии океанских волн, перейти к пилотному производству и первому внедрению, сообщает Converge! Digest. Раунд возглавил известный инвестор Питер Тиль (Peter Thiel), к нему присоединились Джон Доэрр (John Doerr), а также компании TIME Ventures, SciFi Ventures, Susquehanna Sustainable Investments, Hanwha Group, Fortescue Ventures, Supermicro, Sozo Ventures, Founders Fund, Lowercarbon Capital и др. Компания из Орегона намерена завершить в штате строительство пилотного объекта поблизости от Портленда, а до конца 2026 года развернуть несколько подобных узлов в северной части Тихого океана. Плавучие ИИ-узлы с автономным энергоснабжением будут получать электричество благодаря преобразованию энергии океанских волн, а для связи с землёй задействуют низкоорбитальные спутники. Ранние прототипы Ocean-1, Ocean-2 и Wavehopper были протестированы в 2021–2024 гг.

Источник изображения: Panthalassa По данным Panthalassa, использование морских ИИ-платформ позволяет избежать ряда ограничений, обычных для традиционных ЦОД — в частности, задержек с подключением к электросетям. Платформа использует узлы в корпусах из листовой стали, которые можно выпускать на заводах, расположенных у побережья. При этом окружающий океан обеспечит прямое охлаждение серверного ИИ-оборудования. По словам компании, на Земле доступны три источника энергии с «запасом» в десятки тераватт — солнечная и атомная энергия, а также энергия открытого океана. Компания создала технологическую платформу, работающую в самых энергоёмких районах планеты, вдали от берегов преобразующую доступный ресурс в «зелёное» электричество. Теперь компания заявляет о готовности строить заводы, выводить в море флоты и обеспечить человечество устойчивой энергией из нового источника.

Источник изображения: Panthalassa Технологии Panthalassa рассчитаны на зоны в открытом море с «высокой плотностью энергии». Прибрежные волновые электростанции обычно размещают ближе к берегу, и они способны генерировать меньше электричества. Размещая свои платформы дальше в море, Panthalassa потенциально способна решить проблему масштабируемости. Стоит отметить, что в морях нередко применяются довольно экзотические технологии энергоснабжения. Например, в 2024 году сообщалось, что ЦОД Iron Mountain запитают от подводных «воздушных змеев» SeaQurrent, а в марте 2026 года появилась информация, что Aikido объединила морские ветряки с модульными ИИ ЦОД.

05.05.2026 [14:15], Руслан Авдеев

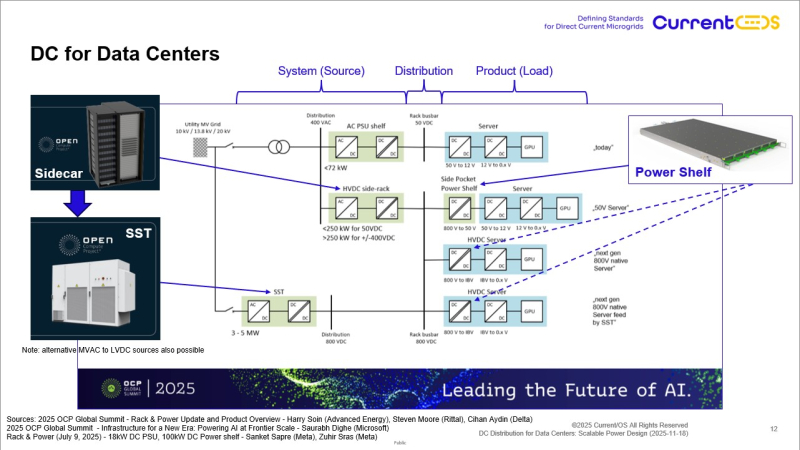

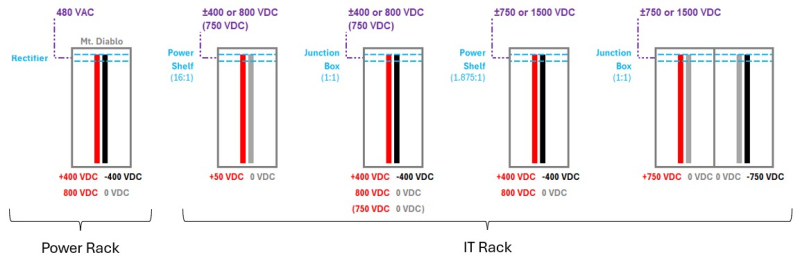

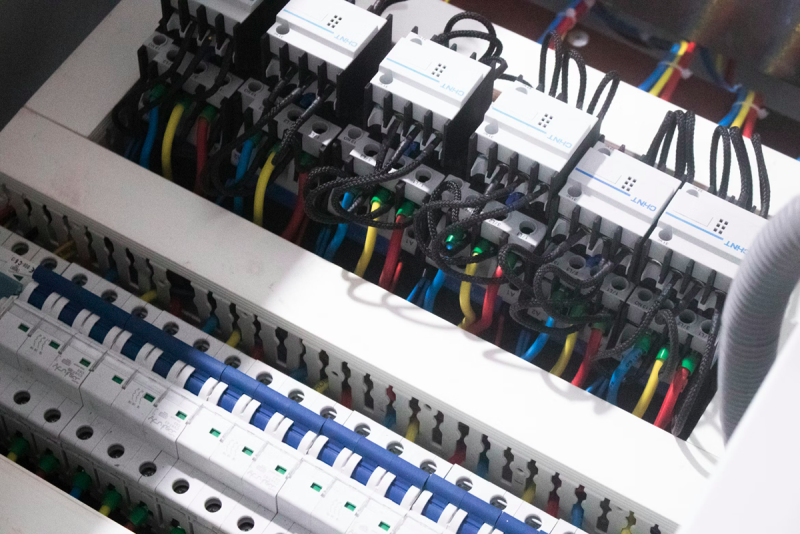

OCP продвигает переход ЦОД на DC-питание для повышения плотности и энергоэффективности вычисленийВходящие в состав Open Compute Project (OCP) компании призывают участников глобальной цифровой инфраструктуры присоединиться к своей инициативе, направленной на внедрение в ЦОД питания от постоянного тока (LVDC). Предполагается, что подобные решения станут основой интенсивных ИИ-вычислений, сообщает Datacenter Dynamics. Google, ABB и Siemens создали рабочую группу, изучающую стандартизацию LVDC-решений для дата-центров. В марте 2026 года опубликованы аргументы в пользу DC-питания машинных залов, а также обозначены ключевые вызовы для подобного перехода. Представители OCP подчеркнули необходимость более активного участия индустрии в стандартизации. Во всяком случае, с термином LVDC уже определились, поскольку некоторые компании называли такие системы HVDC. В классической архитектуре питания переменный ток (AC) поступает из сети, после чего он преобразуется в DC для энергохранилищ или ИБП, потом снова в AC для подачи к серверным стойкам, где для электроснабжения серверных компонентов снова происходит преобразование в DC. В результате происходит потеря энергии на всех этапах, из-за чего падает общая энергоэффективность системы.

Источник изображения: mostafa mahmoudi/unspalsh.com В индустрии давно обсуждают возможный переход на постоянный ток в качестве основного источника энергии в качестве более эффективной альтернативы AC. Тем не менее концепция пока не получила широкого распространения, хотя ситуация стремительно меняется на фоне быстрого роста энергопотребления ИИ-мощностями. Если традиционные серверные стойки потребляют считанные киловатты, то современные системы высокой плотности требуют около 120 кВт, а в скором будущем, по оценкам NVIDIA, речь может идти об 1 МВт на стойку. Первым шагом к внедрению DC называется проект Mount Diablo, разработанный участниками OCP — Microsoft, Meta✴ и Google. Концепция предусматривает вынос подсистемы питания в отдельную стойку и переход к 400 В DC, чего достаточно для ИИ-нагрузок. При этом подчёркивается, что это — лишь временное решение, усложняющее общую архитектуру, и в будущем необходимо перейти к стандартизированной архитектуре с возможностью масштабирования. Новая модель распределения энергии предполагает, что преобразование AC/DC вообще нужно вынести за пределы серверных, на уровень трансформаторов среднего напряжения, что позволит высвободить в ЦОД дополнительные площади. Передача энергии будет осуществляться либо через общую DC-шину, соединяющую все стойки, либо по отдельным кабелям, либо комбинированно. Потенциально такая архитектура позволяет подавать в серверные не только 800 В DC, но и до 1,5 кВ в будущем. Для преобразования тока рассматриваются как традиционные трансформаторно-выпрямительные установки (TRW), так и новые твердотельные трансформаторы (SST), значительно более эффективные, но пока не доросшие до гигаваттного уровня. Рабочая группа OCP намерена выпустить обновлённый план развития DC-архитектуры в этом году, и призывает участвовать в разработке стандартов больше компаний. При этом подчёркивается, что ни один поставщик технологических решений не сможет решить задачу самостоятельно. Эксперты уверяют, что будущее — за открытыми стандартами. В 2025 году сообщалось, что Google готовит мегаваттные стойки с питанием 400 В и СЖО для ИИ-платформ будущего, Infineon и NVIDIA разрабатывают архитектуру HVDC-питания для ИИ ЦОД на 800 В, а ABB поддержит NVIDIA в их внедрении. В октябре 2025 года OCP запустила инициативу Open Data Center for AI для стандартизации инфраструктуры передовых ИИ ЦОД с мегаваттными стойками.

05.05.2026 [12:25], Руслан Авдеев

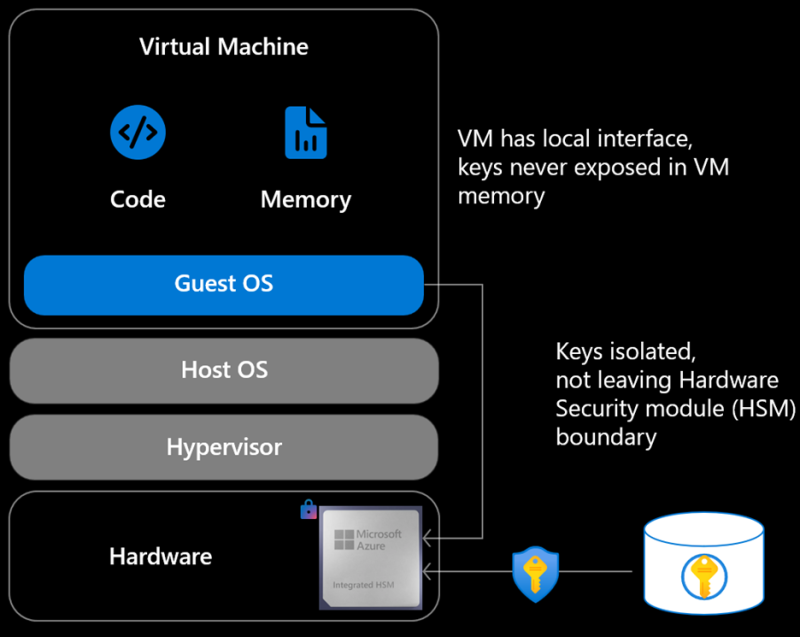

Microsoft поделится Azure Integrated HSM с OCP для укрепления аппаратной защиты облаковПо мере развития цифровых систем вопрос доверия к инфраструктуре играет всё более важную роль. Microsoft объявила об открытии аппаратных модулей безопасности Azure Integrated Hardware Security Module (Azure HSM), которые позволяют сделать аппаратную криптографическую защиту базовым элементом облака. Аппаратный модуль Microsoft Azure Integrated HSM встроен в каждый новый сервер Azure (и ВМ V7). Модуль соответствует стандарту FIPS 140-3 Level 3 и защищает криптографические ключи непосредственно в месте выполнения задач, а не только на централизованном уровне. В результате системы устойчивы к физическому вмешательству и защищены от извлечения ключей логическими средствами. Компания объявила об открытии ключевых компонентов Azure Integrated HSM (прошивки, драйверов и программного стека) — они будут опубликованы в рамках OCP. Прошивка уже доступна в репозитории GitHub вместе с материалами независимой проверки, включая аудит OCP SAFE. Azure Integrated HSM также поддерживает отраслевые стандарты, включая TDISP, что позволяет связать HSM и среды, участвующие в конфиденциальных вычислениях. Новейшее решение дополняет сервисы вроде Azure Key Vault и Azure Managed HSM, обеспечивая новый уровень защиты индивидуальных серверов. Ключи защищаются не только во время хранения, но и во время использования. С Azure Integrated HSM ключи шифрования генерируются, хранятся и используются полностью внутри защищённого аппаратного контура. Они не появятся в памяти виртуальных машин, в программных процессах и во время активных криптографических операций. В результате блокируются целые классы атак, нацеленных на получение данных из памяти или программного слоя. В отличие от вариантов с «централизованными» HSM-технологиями, хотя и эффективными, но имеющими проблемы с масштабированием, новый подход позволяет привязать криптографическую защиту непосредственно к серверу. За счёт аппаратных RoT, проверяемой загрузки и аттестации Azure Integrated HSM обеспечивает доказательство корректности аппаратно-программных конфигураций оборудования. В совокупности с другими инструментами защиты, включая Azure Boost, технология Azure Integrated HSM обеспечивает создание вертикально интегрированной цепочки доверия, от чипов до программного обеспечения.

05.05.2026 [09:26], Руслан Авдеев

Немецкий разработчик энергохранилищ для ИИ ЦОД CMBlu Energy привлёк €50 млн инвестиций при капитализации €1 млрдКапитализация немецкой CMBlu Energy перевалила за €1 млрд после первичного закрытия раунда финансирования серии C на сумму €50 млн. Это промежуточный этап, и конечная сумма может быть значительно больше. Тем не менее, уже собранные средства отражают растущий интерес инвесторов к долговременным энергохранилищам, спосоным питать ИИ ЦОД в течение нескольких часов, сообщает Converge! Digest. В раунде приняли участие Samsung Ventures, а также уже имеющиеся инвесторы, в т.ч. STRABAG SE. Вырученные средства станут драйвером коммерциализации аккумуляторной платформы SolidFlow, не использующей литий. Последняя позиционируется как новая архитектура, специально разработанная для энергохранилищ, работающих 10 и более часов. Такая система будет востребована гиперскейлерами и коммунальными компаниями. Платформа применяет негорючие электролиты на водной основе, а также твердотельную компоненты для хранения энергии. Это позволит избавиться от зависимости от цепочек постава литиевого сырья и даст возможность масштабировать мощность и ёмкость независимо друг от друга. CMBlu подчёркивает, что это устраняет одно из ключевых ограничений классической ИИ-инфраструктуры — трудности со стабильным обеспечением ЦОД электроэнергией.

Источник изображения: CMBlu Energy На счету компании — уже заключенное рамочное соглашение на 5 ГВт∙ч с Uniper. Это свидетельствует об интересе со стороны европейских энергокомпаний. CMBlu утверждает, что такая система хранения энергия способно пять часов обеспечивать электричеством ЦОД мощностью 1 ГВт или десять часов — объект на 500 МВт. Это позволит компенсировать ночной дефицит энергии из-за невозможности получения солнечной энергии в это время. Средства, полученные в ходе раунда C будут потрачены на масштабирование производства, а также первые проекты коммерческого внедрения платформы в Европе и США. Расширение производства намечено в Германии, США и Греции. Стремление CMBlu использовать элементы без лития — часть более широкой отраслевой тенденции в отрасли. В последнее время ЦОД всё чаще используют аккумуляторные решения без лития на основе различных технологий. Ранее сообщалось, что Министерство энергетики США вложит $100 млн в создание «зелёных» энергохранилищ без использования лития. Около года назад появилась информация, что Prometheus Hyperscale и XL Batteries впервые задействуют в американском ИИ ЦОД проточные аккумуляторы без лития, а на днях — появились сведения о том, что Meta✴ зарезервировала 100 ГВт·ч ёмкости для хранения энергии на базе накопителей Noon Energy. При этом в целом в индустрии бывают и провалы. Так, в прошлом году разработчик натрий-ионных аккумуляторов для ЦОД Natron Energy прекратил работу.

05.05.2026 [00:15], Владимир Мироненко

Cerebras объявила о запуске IPO с оценкой капитализации в $26 млрдКомпания Cerebras Systems объявила о планах начать так называемое роуд-шоу — серию встреч с потенциальными инвесторами — в рамках подготовки в первичному публичному размещению (IPO) своих акций. Заявку в Комиссию по ценным бумагам и биржам США (SEC) на размещение 28 млн своих обыкновенных акций класса А на бирже Nasdaq Global Select Market под тикером CBRS компания подала 17 апреля. Cerebras также сообщила о планах предоставить андеррайтерам 30-дневный опцион на приобретение до 4,2 дополнительных акций своих обыкновенных акций класса А. Ожидается, что цена акции во время IPO составит от $115,00 до $125,00. При верхней границе диапазона Cerebras будет оцениваться до $26,62 млрд, что сделает ее крупнейшей компанией, специализирующейся исключительно на чипах для ИИ, на бирже за последнее время. Это размещение также рассматривается как важный барометр для оценки рыночного энтузиазма в отношении инвестиций в ИИ-инфраструктуру. В качестве ведущих андеррайтеров, несущих основную ответственность за заполнение книги заявок при размещении, выступят банки Morgan Stanley, Citigroup, Barclays и UBS Investment Bank. Им окажут помощь Mizuho и TD Cowen. А Needham & Company, Craig-Hallum, Wedbush Securities, Rosenblatt, Academy Securities, Credit Agricole CIB, MUFG и First Citizens Capital Securities выступят в качестве соорганизаторов. Размещение будет осуществляться только посредством проспекта. Заявление о регистрации ценных бумаг было подано в SEC, но ещё не вступило в силу. Cerebras пользуется поддержкой серьёзных инвесторов. Ранее в этом году компания завершила раунд финансирования в размере $1 млрд, возглавляемый технологическим инвестиционным гигантом Tiger Global при участии Benchmark, Fidelity Management, Altimeter, AMD и Coatue, а также других известных институциональных инвесторов. После его проведения оценка рыночной капитализации Cerebras составляет $23 млрд. Следует отметить, что это вторая попытка Cerebras провести первичное публичное размещение акций. Компания отозвала свою предыдущую заявку на IPO в октябре прошлого года. Её возвращение сейчас — на фоне усиливающегося интереса к инвестициям в ИИ и более широкого восстановления рынка IPO — привлекло значительно большее внимание рынка. В отличие от прошлогоднего незаметного отзыва, Cerebras возвращается с высокими финансовыми показателями и крупными клиентскими контрактами. В частности, она заключила соглашение с OpenAI на сумму $20 млрд на поставку в течение следующих трёх лет ИИ-ускорителей в дополнение к предыдущей сделке на $10 млрд. UPD 12.05.2026: Cerebras подняла оценку стоимости акций до $150–$160/шт., что позволит получить ей во время IPO не $3,5 млрд, как ожидалось ранее, а около $4,8 млрд.

04.05.2026 [14:33], Владимир Мироненко

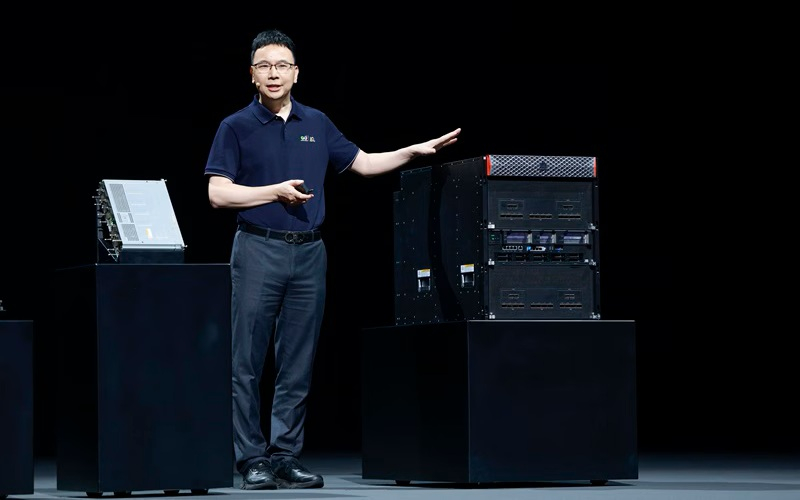

На фоне торговой войны США и Китая Huawei прогнозирует рост выручки от продажи ИИ-чипов на 60 %В этом году Huawei прогнозирует рост выручки от продажи своих ИИ-чипов на 60 % — с $7,5 млрд в 2025 году до $12 млрд — исходя из полученных заказов, сообщил ресурс Financial Times со ссылкой на источники. Большая часть заказов приходится на Ascend 950PR, серийное производство которого началось в марте. По данным источников, в IV квартале должна выйти усовершенствованная версия ИИ-ускорителя Ascend 950DT. Высокому спросу на чипы Huawei способствует противодействие властей Китая поставкам в страну чипов NVIDIA. Несмотря на то, США дали добро на экспорт ускорителей H200 «одобренным клиентам» в Китай и другие, их поставки так и не начались. Пекин призывает китайские технологические компании поддерживать отечественных производителей и ограничить использование чипов NVIDIA зарубежными странами, в то время американские регуляторы требуют, чтобы чипы компании, заказанные китайскими клиентами, использовались только в Китае. Из-за этого таможенное оформление H200 для поставки китайским клиентам по факту невозможно. В прошлом месяце министр торговли США заявил, что чипы H200 не поставляются в Китай из-за проблем у китайских компаний с получением разрешения от правительства, пишет Data Center Dynamics, хотя NVIDIA была готова начать массовый выпуск H200 для китайских клиентов. Huawei производит большую часть своих ИИ-чипов на заводе SMIC. В конце этого года SMIC планирует запуск двух дополнительных заводов, предназначенных для удовлетворения её потребностей. Хотя, как пишет Financial Times, новейшие чипы Huawei всё ещё отстают от передовых продуктов NVIDIA как минимум на два поколения, китайская компания неуклонно улучшает производительность и эффективность своих ИИ-чипов.

Источник изображения: Huawei В прошлом месяце DeepSeek объявила о выходе ИИ-модели DeepSeek V4, специально оптимизированной для работы на чипах Huawei, в частности, Huawei 950PR, который отличается улучшенной эффективностью инференса при сниженных затратах. Однако, по словам источников, знакомых с ситуацией, большая часть обучения V4 по-прежнему производилась на чипах NVIDIA. «День, когда DeepSeek сначала выйдет на оборудовании Huawei, станет ужасным исходом для нашей страны», — сказал недавно гендиректор NVIDIA Дженсен Хуанг (Jensen Huang). По его словам, это может привести к тому, что «ИИ-модели по всему миру будут разрабатываться и лучше всего работать на неамериканском оборудовании». Ключевой проблемой для китайских конкурентов NVIDIA является создание программной экосистемы, способной конкурировать с CUDA, которая остается доминирующей на мировом рынке. Система Cann от Huawei, вышедшая через десять лет после CUDA, вызывает нарекания клиентов из-за сложности использования, что значительно увеличивает их расходы. Несмотря на произведённые улучшения, у неё по-прежнему значительные недостатки, говорят разработчики. Новые ускорители Huawei, как сообщается, имеют улучшенную совместимость с CUDA. Согласно прогнозам Morgan Stanley, рынок ИИ-чипов в Китае достигнет $67 млрд к 2030 году, при этом 86 %, как ожидается, будет приходиться на отечественную продукцию. По оценкам аналитиков, в этом году объём рынка за счёт продаж отечественных решений в Китае составит около $21 млрд.

04.05.2026 [14:18], Сергей Карасёв

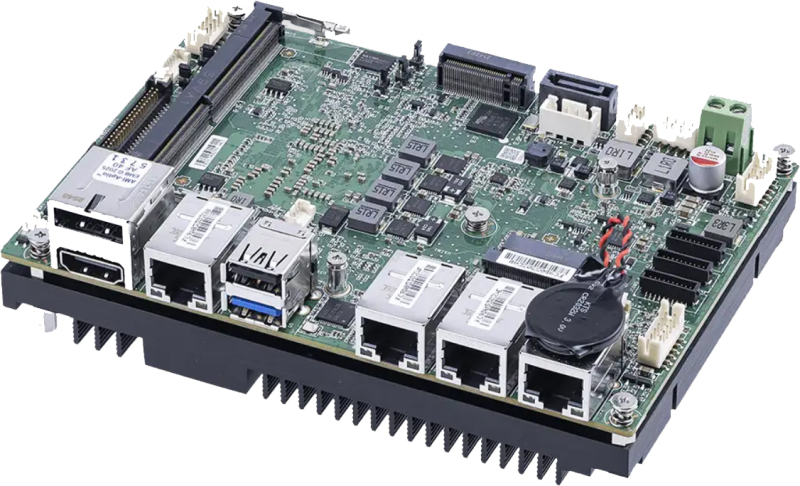

MSI IPC выпустила 3,5″ одноплатный компьютер MS-CF27 с четырьмя портами 2.5GbEКомпания MSI IPC анонсировала одноплатный компьютер MS-CF27, построенный на аппаратной платформе Intel. Новинка предназначена для создания встраиваемых систем и индустриальных решений: это могут быть различные периферийные устройства, платформы промышленной автоматизации, информационные терминалы, умные шлюзы, комплексы машинного зрения и пр. Компьютер выполнен в 3,5″ форм-факторе с габаритами 146 × 102 мм. В зависимости от модификации задействован чип Intel Processor N97 (4C/4T; до 3,6 ГГц; 12 Вт) или Core i3-N305 (8C/8T; до 3,8 ГГц; 15 Вт) поколения Alder Lake-N, Atom x7433RE (4C/4T; до 3,4 ГГц; 9 Вт) серии Amston Lake или Intel Processor N150 (4C/4T; до 3,6 ГГц; 6 Вт) семейства Twin Lake-N. Поддерживается до 32 Гбайт оперативной памяти DDR5-4800 в виде одного модуля SO-DIMM. Есть порт SATA-3 для накопителя и слот M.2 M key 2280 для SSD с интерфейсом SATA. Предусмотрены коннектор M.2 B key 3042 (USB 3.0) для сотового модема и разъём M.2 E key 2230 (PCIe x1, USB 2.0) для адаптера Wi-Fi. В оснащение входят звуковой кодек Realtek ALC897 HD, IO-чип Fintek F81966AB-I, а также четыре сетевых порта 2.5GbE на базе Intel I226-V. Возможен вывод изображения через интерфейсы LVDS (1920 × 1200; 60 Гц), eDP (1920 × 1080; 60 Гц), HDMI (3840 × 2160; 30 Гц) и DisplayPort (4096 × 2304; 60 Гц). Допускается подключение до трёх мониторов одновременно. Доступны четыре гнезда RJ45 для сетевых кабелей, по одному порту USB 3.1 Type-A и USB 2.0 Type-A. Через разъёмы на плате могут быть задействованы шесть последовательных портов (по три RS-232/422/485 и RS-232), дополнительные порты USB 2.0 и пр. Питание (12–24 В) подаётся через DC-коннектор. Диапазон рабочих температур простирается от -10 до +60 °C. Заявлена совместимость с Windows 10/11 IoT Enterprise LTSC и Linux.

04.05.2026 [13:12], Сергей Карасёв

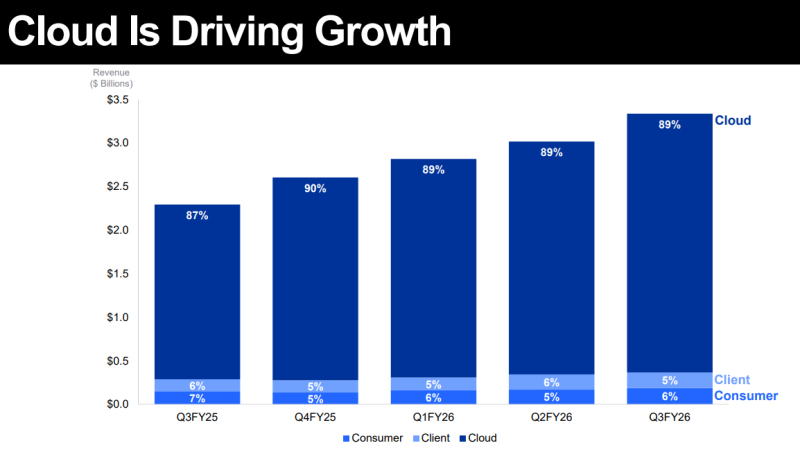

Western Digital увеличила квартальную выручку в полтора раза благодаря ИИКомпания Western Digital отчиталась о работе в III четверти 2026 финансового года, которая была закрыта 3 апреля. Выручка одного из крупнейших в мире поставщиков HDD достигла $3,34 млрд, что практически в полтора раза (на 45 %) больше по сравнению с аналогичным периодом предыдущего года, когда было получено $2,29 млрд. Значительный рост обусловлен высоким спросом на накопители со стороны облачных провайдеров и гиперскейлеров. На соответствующий сегмент пришлось около 89 % продаж в денежном выражении ($2,97 млрд) против 87 % годом ранее. Ещё 6 % выручки принесли устройства для потребительского сектора, 5 % — клиентские продукты. Суммарная вместимость отгруженных за квартал накопителей Western Digital достигла 222 Эбайт против 166 Эбайт годом ранее, что соответствует росту на 33,7 %. При этом на Nearline-устройства пришлось 199 Эбайт, на все прочие продукты вместе взятые — 23 Эбайт. Генеральный директор Western Digital, подчёркивает, что основным драйвером роста является ИИ. По его словам, практически любая рабочая нагрузка в сфере ИИ — от обучения моделей и инференса до агентного и физического ИИ — приводит к генерации данных, для эффективного хранения которых требуются HDD большой ёмкости. В результате, продажи таких устройств увеличиваются. Дополнительно повышению спроса на HDD способствует быстрое повышение цен на чипы флеш-памяти NAND на фоне их дефицита. Чистая прибыль компании в годовом исчислении взлетела на 320 % — с $755 млн до $3,17 млрд. Прибыль в пересчёте на одну ценную бумагу составила $8,2 против $2,11 в III четверти предыдущего финансового года. В IV финансовом квартале Western Digital рассчитывает получить выручку в размере $3,65 млрд ± $100 млн. Чистая прибыль, как ожидается, составит $3,25 ± $0,15 на одну ценную бумагу.

04.05.2026 [09:52], Владимир Мироненко

Fujitsu распрощается с мейнфреймами к 2035 году — на смену придут квантовые или ИИ-суперкомпьютерыКомпания Fujitsu планирует закрыть свой бизнес в области мейнфреймов в 2035 году, пишет The Register. Об этом сообщил генеральный директор Такахито Токита (Takahito Tokita) на брифинге для инвесторов, посвящённом планам компании в среднесрочной перспективе, отметив, что в 2035 году компании исполнится 100 лет. Напомним, что в 2022 году Fujitsu сообщала о решении прекратить продажи мейнфреймов в 2030 году. Если IBM не забросит это направление, то она останется единственным поставщиком мейнфреймов. По словам главы Fujitsu, к этому времени вместо мейнфреймов компания начнёт предлагать либо ИИ-суперкомпьютеры на процессорах семейства Monaka, либо квантовые компьютеры. Гендиректор подчеркнул, что планы Fujitsu связаны с ИИ. «Мы создали глобально стандартизированную платформу данных, — сказал Токита. — Начиная с этого финансового года, на основе этой платформы данных мы ускорим полномасштабное внедрение управления на основе ИИ с использованием наших собственных разработок. Это повысит как скорость, так и качество принятия решений и управленческих оценок». Компания планирует сохранить бренд Uvance, объединяющий консалтинг и ИТ-услуги, но откажется от работы по системной интеграции и почасовой оплаты в пользу «структуры прибыли, основанной на ценности и результатах». Токита сообщил компания также откажется от модели работы, что при которой выручка в значительной степени сконцентрирована в IV квартале в пользу более равномерного распределения поступлений по кварталам, что важно для повышения качества управления, добавив, что отказ будет проходить постепенно. Гендиректор отметил, что есть ещё много возможностей для дальнейшего улучшения модели ценообразования. «Я хотел бы рассмотреть подход, при котором мы будем взимать плату с клиентов на основе таких факторов, как рабочая нагрузка нашего персонала и объём данных», — рассказал он. По словам Токиты, Fujitsu Japan прекратила ежегодный набор выпускников и теперь нанимает специалистов с конкретными необходимыми навыками. Также он сообщил о планах компании сотрудничать с оборонным сектором страны. |

|