Лента новостей

|

16.01.2025 [20:51], Алексей Степин

Broadcom представила FC64-коммутатор седьмого поколения Brocade G710Несмотря на торжество Ethernet, в мире сетей хранения данных (SAN) семейство технологий Fibre Channel не просто остаётся актуальным, но и продолжает развиваться. Компания Broadcom анонсировала пополнение в серии FC64-решений седьмого поколения. Это коммутатор Brocade G710, ориентированный на использование в SAN-средах малого и среднего бизнеса и предоставляющий от 8 до 24 FC64-портов SFP+. По словам производителя, новинка обеспечивает рекордный в индустрии показатель задержки между портами, не превышающий 460 нс. Помимо этого, Brocade G710 может похвастаться надёжностью на уровне 99,9999%, функцией самовосстановления сети, а также высокой энергоэффективностью: при коммутирующей способности 1,5366 Тбит/с он потребляет лишь 65 Вт в конфигурации с 12 портами при половинной загрузке сети и 105 Вт с 24 портами при 100 % нагрузке.

Источник здесь и далее: Broadcom Новинка способна работать в составе достаточно масштабных сетей: сертифицирована конфигурация, включающая 6000 активных узлов и 56 коммутаторов, с 19 «хопами» в SAN на базе Brocade Fabric OS. Также доступна сертификация и для более масштабных сетей, вплоть до 239 коммутаторов.  Поддерживаются все актуальные на сегодня скорости Fibre Channel в полнодуплексных режимах, от 8,5 Гбит/с (FC 8G) до 57,8 Гбит/с (FC 64G). В базовой конфигурации G710 имеет 8 активных портов, но с помощью пары POD (Ports on Demand) её легко нарастить до 24 портов. Для управления предусмотрены выделенные консольный порт и порт Ethernet, имеется разъём USB для выгрузки логов или перепрошивки устройства. Сетевая безопасность обеспечивается за счёт управляемого доступа (реализованы все современные методы безопасной аутентификации), сетевой изоляции и аппаратного Root-of-Trust. Кроме того, компания-производитель сопровождает Brocade G710 пожизненной гарантией (до окончания сопровождения серии в целом) с техподдержкой в режиме 24x7.

16.01.2025 [17:30], Владимир Мироненко

Microsoft Project по-прежнему лидирует на российском рынке, хотя и сократил долю вдвоеНесмотря на уход в 2022 году с российского рынка, американская компания Microsoft сохранила лидерство с программой Microsoft Project (MS Project) в сегменте специализированного софта для управления проектами, хотя после появления российских аналогов её доля сократилась вдвое — примерно с 80 % до 43 %, сообщили «Ведомости» со ссылкой на данные российского разработчика офисного софта «Мойофис». В России есть несколько альтернатив MS Project, например, «Гранд-смета» и «1С: управление проектами» с интеграцией в экосистему 1С, сообщили «Ведомостям» в «Мойофис». Сам «Мойофис» готовит к выпуску решение схожей функциональности в I квартале 2025 года. Кроме того, компании используют российские решения Directum Projects, Spider Project, Advanta, NaumenProject Ruler, «ПМ Форсайт» и Visary Project, а также open source решения.

Источник изображения: Glenn Carstens-Peters/unsplash.com По словам экспертов, MS Project пользуется популярностью в сферах строительства и энергетики, где требуется высокая функциональность для планирования и мониторинга крупных проектов — продукт по старым лицензиям продолжает использовать около 15 % компаний сектора ТЭК в РФ. В госструктурах MS Project применяют в меньшей степени. Это связано, в том числе, с тем, что использование иностранного ПО на объектах критической информационной инфраструктуры (КИИ) запрещено. Переход с MS Project на другой инструмент требует значительных затрат и времени на переобучение сотрудников, говорят эксперты, прогнозируя, что пакет ещё в течение 5–7 лет будет использоваться при управлении проектами. Они также отметили, что MS Project особенно сложно заменить в крупных компаниях, где он автоматизирует множество бизнес-процессов проектного и портфельного управления, и зачастую в значительной степени доработан с учётом их специфики. Влияет и интеграция с другими продуктами экосистемы Microsoft. Аналогичные доводы приводятся и относительно Microsoft Visio. По оценкам «Мойофиса», в 2024 году объём рынка систем управления проектами в России составил 17,39 млрд руб. Рост рынка в 2025 году продолжится за счёт импортозамещения и составит примерно 17 %, прогнозирует компания.

16.01.2025 [17:10], Руслан Авдеев

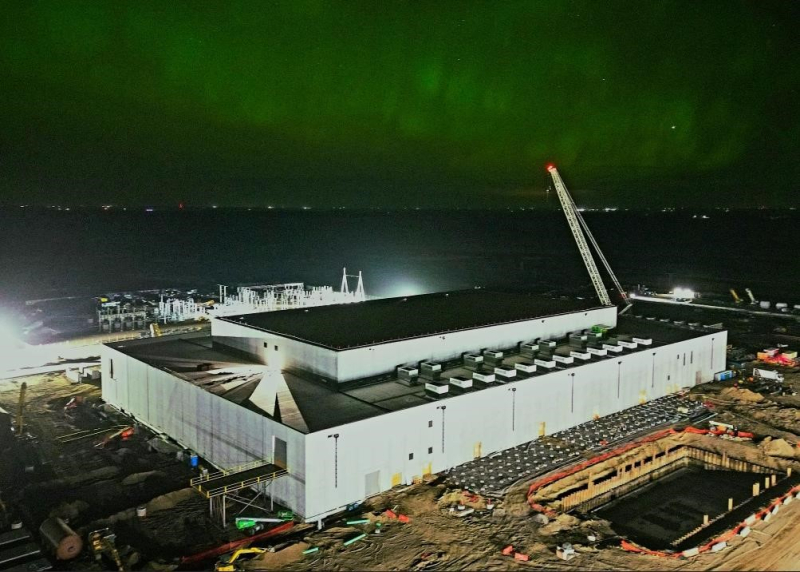

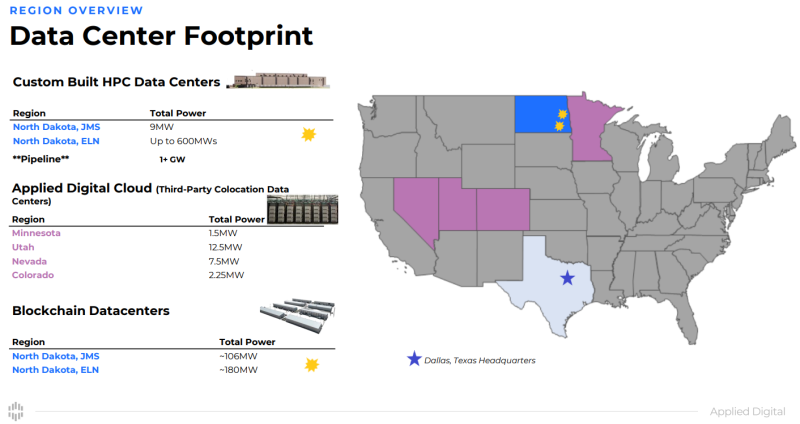

Австралийская Macquarie выделит до $5 млрд на ИИ ЦОД Applied DigitalВенчурные капиталисты пока не боятся возможного финансового «пузыря», связанного с ИИ-технологиями, поэтому вливают миллиарды долларов в новые ИИ ЦОД. Так, австралийская финансовая компания Macquarie сообщила о намерении вложить $5 млрд в проекты американского оператора дата-центров Applied Digital, сообщает The Register. Техасский оператор работает на рынке ИИ и HPC относительно недавно, но это не мешает ему на равных соперничать с сильными конкурентами с более богатой историей. Во многом история компания напоминает путь CoreWeave, вышедшей на рынок HPC-объектов приблизительно в 2022 году и свернувшей бизнес по майнингу криптовалют. Applied Digital, как и CoreWeave и Lambda Labs, предлагает услуги ЦОД и облачные сервисы на базе ускорителей NVIDIA. Австралийские инвестиции, в том числе в ходе начального раунда финансирования в объёме $900 млн, позволят компании продолжить работу над кампусом Ellendale High Performance Computing в Северной Дакоте мощностью 100 МВт (до 400 МВт в перспективе), а также вернуть порядка $300 млн, ранее инвестированных в объект в виде акционерного капитала. Кампус в Эллендейле (Ellendale) — лишь одна из площадок Applied Digital, в которые Macquarie готова вложить средства. В соответствии с новым соглашением, она получила преимущественное право участвовать в новых проектах, связанных с ИИ ЦОД в следующие 30 месяцев на сумму $4,1 млрд. В Applied Digital заявляют, что с сегодняшними ценами на строительство у компании будет значительная часть средств, необходимых для создания HPC-объектов мощностью более 2 ГВт, включая кампус в Эллендейле. Место, по-видимому, привлекательное для таких объектов — две неизвестных компании готовы потратить до $250 млрд на строительство в штате гигаваттных ИИ ЦОД. Пока не сообщается, когда, где и сколько дата-центров Applied Digital в итоге построят, но, согласно пресс-релизу, объекты получат жидкостное охлаждение. Вероятнее всего, как и в Северной Дакоте, другие объекты получат ускорители NVIDIA. Не исключено даже использование 120-кВт GB200 NVL72. В сентябре NVIDIA вместе с другими инвесторами сама вложила в оператора $160 млн. Большая часть инвестиций, вероятно, вернётся в виде заказов на чипы и подписки AI Enterprise. Что касается Macquarie, она фактически выкупила себе 15 % в бизнесе Applied HPC, а оператор сохранил за собой 85 %. $1,5 млрд обычно достаточно для создания ЦОД с 16 тыс. ускорителей уровня NVIDIA H100 для последующей сдачи в аренду. В течение четырёх лет это принесёт около $5,27 млрд выручки при благоприятных условиях. С учётом уровня окупаемости инвестиций нетрудно понять, почему многие инвесторы желают участвовать в подобных проектах. Не мешает и высокий спрос на ускорители — иногда они используются в качестве залога при крупных кредитах. Так, в апреле 2024 года Macquarie помогла привлечь Lambda порядка $500 млн заёмного финансирования под залог ускорителей NVIDIA. Среди крупнейших бенефициаров таких сделок — CoreWeave, по данным Crunchbase, только в 2024 году получившая $9,9 млрд финансирования и заёмных средств. Деньги под залог ускорителей она брала ещё в 2023 году.

16.01.2025 [16:16], Руслан Авдеев

США вводят очередные ограничения на выпуск и экспорт современных чиповМинистерство торговли США вводит новый пакет экспортных ограничений, призванных помешать Китаю и другим странам закупать передовые чипы, сообщает Silicon Angle. В частности, ограничения коснутся предприятий, выпускающих микросхемы, а также работающих по заказу других организаций. Так, новые меры коснутся TSMC и Samsung Electronics, а также упаковщиков чипов, включая ту же TSMC. Новые правила предусматривают получение производителями чипов и упаковщиками полупроводников лицензий на экспорт «определённых передовых чипов» в ряд регионов. Власти откажутся от подобных требований, если производитель чипов получит технические аттестации от доверенных участников цепочек поставок. Так, разработчики чипов могут получить от американских властей статус «одобренных» или «авторизованных». Если разработчик подтверждает, что его чипы не достигают по своим характеристикам установленных США порогов производительности, лицензионные требования к ним отменяются. То же касается фабрик и компаний-упаковщиков. Если характеристики производимых чипов не превышают определённого порога, новые экспортные ограничения не применяются. Объявлено и о ряде других нормативных изменений. В частности, запускается процесс утверждения компаний в перечне одобренных дизайн-центров и поставщиков чипов и услуг OSAT (Outsourced Semiconductor Assembly and Test). Также оптимизированы процедуры раскрытия информации в случаях, если производитель принимает заказ клиента, потенциально способного перенаправить продукцию в Китай. В связи с новыми правилами в чёрный список Entity List отправятся 16 новых организаций, включая некоторые ИИ-компании, поддерживающие развитие производства передовых чипов в Китае. Одной из таких компаний стала Sophgo — в прошлом году выяснилось, что она якобы передала выпущенную для неё продукцию компании Huawei, давно пребывающей в американском чёрном списке, после чего TSMC прекратила выполнение её заказов и поставки. Министерство торговли вводит новые правила всего через несколько дней после того, как администрация уходящего президента США ввела глобальные ограничения на поставки ИИ-чипов и передовых моделей ИИ. Ранее американские власти уже вводили санкции, ограничивающие возможности китайской полупроводниковой индустрии. Речь идёт о закупках чипов NVIDIA, памяти HBM и других компонентов. Не щадят и союзников. Нидерландской ASML запрещено поставлять в КНР оборудование для DUV-литографии, на котором можно изготавливать 5- и 7-нм полупроводники.

16.01.2025 [14:41], Андрей Крупин

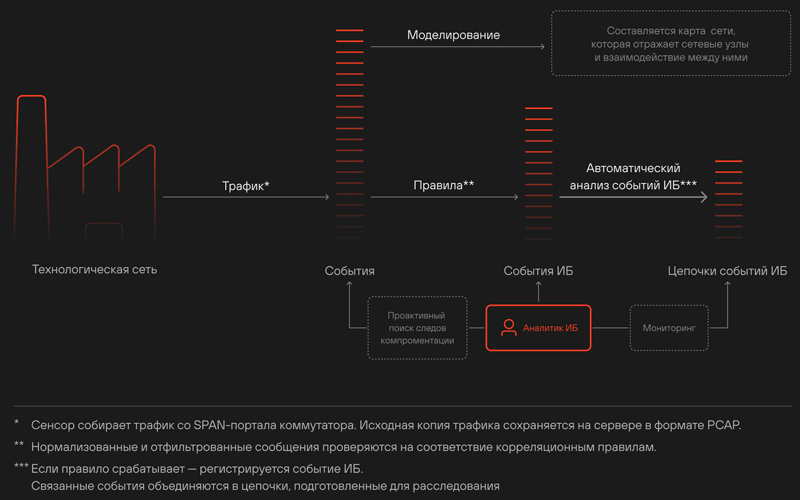

Positive Technologies выпустила новую версию системы мониторинга безопасности промышленных инфраструктурКомпания Positive Technologies сообщила о выпуске новой версии программного комплекса PT Industrial Security Incident Manager (PT ISIM), предназначенного для контроля безопасности и мониторинга технологических сетей, IIoT-систем промышленных предприятий и объектов инженерной инфраструктуры. PT ISIM обеспечивает инвентаризацию технологической инфраструктуры и контроль изменений, выявляет аномалии и события безопасности в сетевом трафике, обнаруживает эксплуатацию уязвимостей, вредоносного ПО и другие техники злоумышленников. Также решение в автоматическом режиме распознаёт опасные технологические команды и помогает ИБ-персоналу соблюдать требования регулирующих организаций.

Схема работы PT ISIM (источник изображения: Positive Technologies) Обновлённый PT ISIM получил компонент PT ISIM Endpoint, выявляющий аномалии, нелегитимные операции и подозрительную активность на рабочих станциях и серверах SCADA. Компонент учитывает особенности работы систем промышленной автоматизации и содержит правила выявления киберугроз, специфичных для таких сетей. Ещё одно важное изменение в PT ISIM — новая карта сетевых взаимодействий, которая позволяет специалистам по ИБ ориентироваться в крупных распределённых промышленных инфраструктурах с десятками тысяч узлов. Дополнительно были расширены функции модуля, который контролирует технологические процессы. Появился также обновлённый стартовый дашборд: на нём теперь отображаются последние инциденты, уведомления о появлении новых узлов, неавторизованных соединений и сведения об инвентаризации компонентов технологической сети.

16.01.2025 [13:58], Руслан Авдеев

Балтийский городовой: НАТО анонсировала программу Baltic Sentry по защите подводных кабелейСтраны НАТО организуют систему защиты подводных кабелей от возможных диверсий в рамках новой военной программы Baltic Sentry, сообщает Datacenter Dynamics. В программе задействуют фрегаты, самолёты, беспилотники и другие средства наблюдения стран альянса. Предполагается, что инициатива усилит присутствие НАТО в Балтийском регионе и повысит способность блока реагировать на возможные «диверсии». Baltic Sentry будет курироваться руководством Объединенного командования сил НАТО в Брюнсюме (JFCBS), а Морское командование НАТО (MARCOM) будет играть центральную роль в координации действий, связанных с защитой подводной инфраструктуры. Предполагается и разработка и новых методов защиты. Генсек НАТО Марк Рютте (Mark Rutte) напоминает: капитаны кораблей должны понимать, что за попытками диверсий последуют абордаж, конфискация и арест судна. В конце 2024 года был оборван энергокабель Estlink 2, связывавший Финляндию и Эстонию. Почти в то же время были повреждены три интернет-кабеля, соединявшие эти страны, и ещё один оптоволоконный кабель между Финляндией и Германиией. В ноябре произошёл другой инцидент — экипаж китайского судна подозревают в намеренном использовании якоря для обрыва ещё двух подводных кабелей в Балтике. В начале декабря уже сообщалось, что НАТО тестирует плавучие беспилотники для защиты подводных кабелей и береговой охраны, а в сентябре американская военная разведка предупреждала о возросшей активности российского флота в районах нахождения кабельной инфраструктуры стран НАТО и их союзников. На днях три корабля и самолёт для патрулирования Балтики выделила Швеция.

16.01.2025 [13:14], Сергей Карасёв

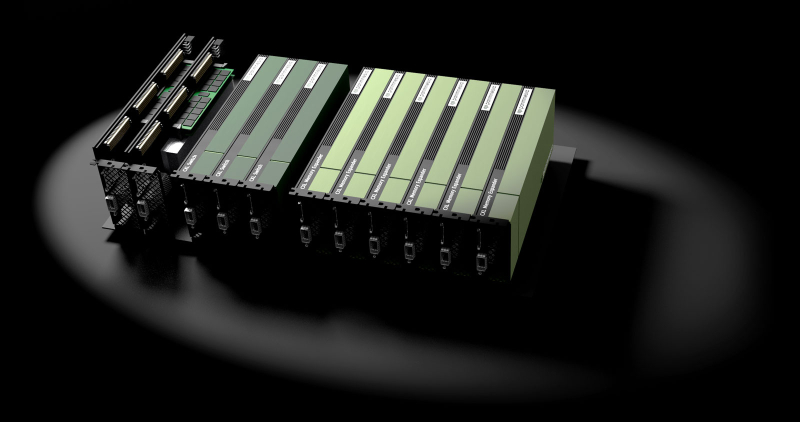

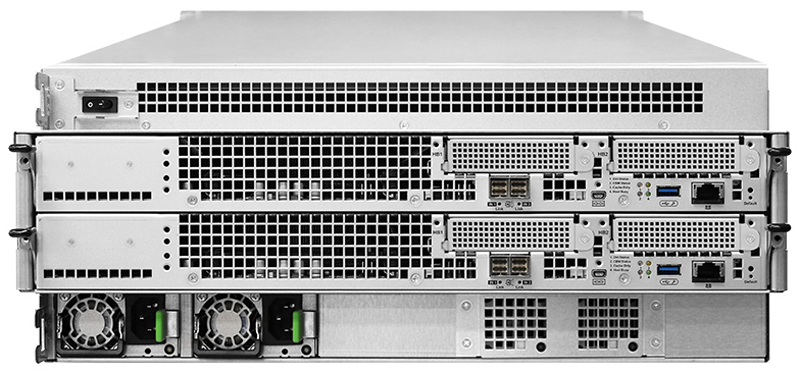

Infortrend представила СХД EonStor GS 5090 с поддержкой 90 накопителейКомпания Infortrend анонсировала СХД EonStor GS 5090, а также модуль расширения JB 4090: обе новинки выполнены в форм-факторе 4U. В качестве основных сфер применения названы задачи НРС, а также приложения, связанные с развлечениями и мультимедиа. В основу EonStor GS 5090 положен неназванный процессор Intel Xeon. Возможны конфигурации с двумя контроллерами с функцией аварийного переключения или с одним контроллером. В первом случае объём оперативной памяти DDR5 составляет 128 Гбайт с возможностью расширения до 1 Тбайт, во втором — 64 Гбайт с расширением до 512 Гбайт. Доступны варианты с портами FC32G FC (×4), 25GbE SFP28 (×2 или ×4), 100GbE QSFP56 (×2, RDMA), 200GbE QSFP56 (×1, RDMA), SAS-3 (×2). Поддерживаются протоколы CIFS/SMB (2.0/3.0), NFS (2/3/4), AFP (3.1.12), FTP/FXP (vsftp 2.3.4), WebDAV (httpd 2.4.6), FC, iSCSI, SAS, RESTful API. Заявлена совместимость с ОС Windows Server, Red Hat Enterprise Linux, SUSE Linux Enterprise, Sun Solaris, macOS X, VMware, Citrix XenServer, OpenStack Cinder. Кроме того, обеспечивается поддержка широкого спектра облачных платформ: Amazon S3, Microsoft Azure, Alibaba Cloud, Google Cloud, Baidu Cloud, Tencent Cloud, OpenStack, Wasabi, Yandex, hiCloud, Backblaze Cloud.

Источник изображений: Infortrend СХД рассчитана на установку 90 накопителей. Это могут быть изделия SFF SSD/HDD или LFF HDD с интерфейсом SAS-3. Возможна организация массивов RAID 0, 1, 3, 5/5F, 6/6F, 10, 30, 50, 60. Питание обеспечивают два блока мощностью 2700 Вт с сертификатом 80 PLUS Titanium. Диапазон рабочих температур — от 0 до +40 °C. Габариты составляют 435 × 175,8 × 1063 мм.  В свою очередь, модуль расширения JB 4090 также рассчитан на 90 накопителей: возможна установка SFF SSD с интерфейсом SAS или SATA, а также HDD формата SFF и LFF с интерфейсом SAS. Установлены два блока питания мощностью 1600 Вт с сертификатом 80 PLUS Titanium. Устройство имеет размеры 435 × 175,8 × 965,6 мм.

16.01.2025 [13:10], Сергей Карасёв

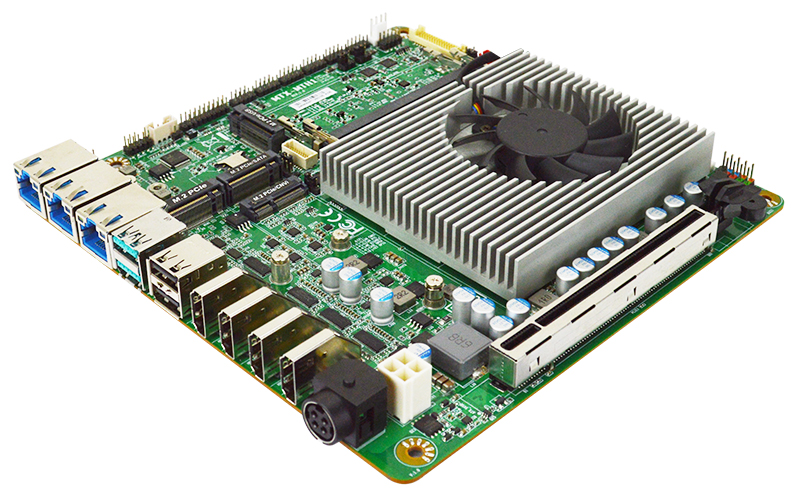

Плата Jetway MTX-MTH1 формата Thin Mini-ITX получила чип Intel Core Ultra 5/7, три порта 2.5GbE и слот PCIe 5.0 x8Компания Jetway анонсировала плату MTX-MTH1 типоразмера Thin Mini-ITX, предназначенную для создания встраиваемых систем, периферийного оборудования, устройств промышленной автоматизации, ИИ-платформ и пр. Новинка имеет широкий диапазон рабочих температур — от -20 до +60 °C. Плата изначально комплектуется процессором Intel поколения Meteor Lake: это может быть чип Core Ultra 7 155H или Core Ultra 5 125H с графикой Intel Arc Graphics. Установлен кулер с довольно крупным радиатором и вентилятором. Доступны два слота SO-DIMM для модулей DDR5-5600 суммарным объёмом до 96 Гбайт. Новинка располагает полноразмерным слотом PCIe 5.0 x8, разъёмом M.2 M-Key 2242 (PCIe 4.0 x4) для NVMe SSD, коннектором M.2 M-Key 2242/2280 (PCIe 4.0 x4 / SATA-3) для ещё одного SSD (NVMe или SATA), разъёмом M.2 B-Key 3042/3052 (PCIe 3.0 x1 / USB 3.2 Gen2 / USB 2.0 плюс Nano SIM) для модема 4G/5G, а также коннектором M.2 E-Key 2230 (USB 2.0 / PCIe x1) для адаптера Wi-Fi/Bluetooth. Накопитель также может быть подключён к порту SATA-3.

Источник изображения: Jetway Плата получила три сетевых порта 2.5GbE, один из которых реализован на контроллере Intel I226-LM, два других — на базе Intel I226-V. В основу аудиосистемы положен кодек Realtek Audio. Допускается вывод изображения одновременно на четыре дисплея через порты HDMI 2.1 (до 7680 × 4320 точек, 60 Гц). Кроме того, присутствует интерфейс LVDS (1920 × 1200 пикселей, 60 Гц). Предусмотрены по два порта USB 3.2 Gen 2×1 Type-A (10Gbps) и USB 2.0 Type-A. Через коннекторы на плате можно задействовать два порта USB 3.2 и четыре порта USB 2.0, четыре последовательных порта RS-232 и два RS-232/422/485. Имеется колодка GPIO. Питание (12–36 В) подаётся через разъём DC. Размеры платы составляют 170 × 170 мм. Говорится о совместимости с Windows 10/11 и Linux.

16.01.2025 [08:04], Алексей Степин

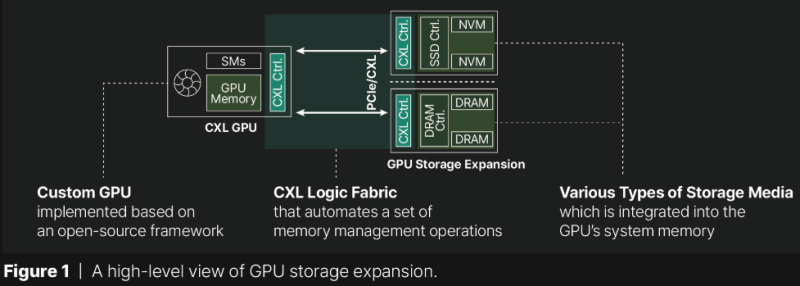

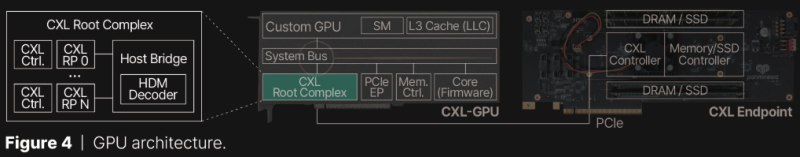

Терабайтные GPU: Panmnesia продемонстрировала CXL-память для ИИ-ускорителейКомпания Panmnesia работает в области проектирования CXL-пулов DRAM довольно давно: в 2023 году она демонстрировала систему, оставляющую позади все решения на базе RDMA и обеспечивающую доступ к 6 Тбайт оперативной памяти. Но большие объёмы памяти сегодня, в эпоху всё более усложняющихся ИИ-моделей, нужны не только и не столько процессорам, сколько ускорителям, априори лишённым возможности апгрейда набортной RAM. На выставке CES 2025 компания продемонстрировала решение данной проблемы. По мнению разработчиков Panmnesia, производительность при обучении масштабных ИИ-моделей упирается именно в объёмы набортной памяти ускорителей: вместо десятков гигабайт требуются уже терабайты, а установка дополнительных ускорителей может обходиться слишком дорого при том, что вычислительные мощности окажутся избыточными. Продемонстрированная на выставке CXL-система построена на базе новейшего контроллера Panmnesia с поддержкой CXL 3.1. В двунаправленном режиме латентность доступа составила менее 100 нс и находится примерно на уровне 80 нс. Ключ к успеху здесь кроется в фирменной реализации CXL 3.1, включая программную часть, благодаря которой GPU могут обращаться к общему пулу памяти, используя те же инструкции типа load/store, что при доступе к набортной HBM или GDDR. Однако технология требует наличия на борту GPU фирменного контроллера CXL Root Complex, одной из важнейших частей которого является декодер HDM, отвечающий за управление адресным пространством памяти (host physical address, HPA), так что уже выпущенные ускорители напрямую работать с системой Panmnesia не смогут. Тем не менее, технология выглядит многообещающей. Она уже привлекла внимание со стороны компаний, занимающихся ИИ, как потенциально позволяющая снизить стоимость инфраструктуры ЦОД.

16.01.2025 [00:32], Руслан Авдеев

Землю — дата-центрам: федеральные владения США отдадут под строительство ИИ-инфраструктуры и объектов «зелёной» энергетикиУходящий президент США в последние дни своей работы подписал приказ, который разрешает строить дата-центры на федеральных землях. Кроме того, документ обеспечит поддержку «зелёной» энергетики, направленной на обеспечение новых объектов экологичной электроэнергией, сообщает Silicon Angle. Согласно новым правилам, Министерство энергетики (DoE) и Министерство обороны США (DoD) обяжут сдавать в аренду федеральные объекты девелоперам ИИ ЦОД. Часть объектов будут предназначены для малого бизнеса и стартапов. Кроме того, участники соответствующих инициатив должны будут реализовать энергетические проекты, полностью удовлетворяющие потребности их ИИ ЦОД. Министерство внутренних дел США (занимается земельными вопросами) определить площадки в федеральной собственности, подходящие для объектов «чистой» энергетики. Также оно упростит процесс получения лицензий на использование геотермальной энергии. Собственную программу поддержки «чистой» энергии запускает и Министерство энергетики — помимо прочего, она будет сосредоточена на развитии и ядерных инициатив. Примут участие и другие федеральные ведомства, которые выделят сотрудников для оперативной выдачи разрешений на проекты ИИ-инфраструктуры. Упростить процесс получения разрешений поможет инструмент «категорических исключений» из Национального закона об экологической политике США (National Environmental Policy Act). Он, в частности, позволяет ускорить процессы прохождения проверок проектам, которые не будут оказывать значительного воздействия на окружающую среду. Такие исключения будут искаться федеральными ведомствами намеренно. Кроме строительства новых ЦОД и объектов «зелёной» энергетики, документ предусматривает и расширение сети линий электропередачи для питания ЦОД. Министерство энергетики поможет девелоперам с поиском финансирования, планированием и постройкой новых ЛЭП. Власти определят регионы, где для избежания перегрузок потребуются новые линии. Планируется сотрудничать с коммунальными службами, чтобы определить, каким именно образом необходимо совершенствовать энергетическую инфраструктуру. Поддержка будет оказана и производителям оборудования вроде трансформаторов. Министерства обороны, энергетики и торговли предварительно оценят возможности создания запасов такого оборудования, а также рассмотрят вопросы гарантий по кредитам. По мнению экспертов консалтинговой NCC Group, больше всего выиграет от нового проекта NVIDIA. Впрочем, параллельный акт о запрете свободных поставок ИИ-оборудования в другие страны, негативно отразится на компании. Недавно эксперты компании JLL спрогнозировали в 2025 году стремительный рост мирового спроса на дата-центры, несмотря на ограничения поставок и дефицит энергии. По их прогнозам, в 2025 году в мире начнут строить ещё 10 ГВт, а проекты на 7 ГВт будут уже готовы. |

|