Материалы по тегу: ии

|

03.07.2025 [11:00], Сергей Карасёв

ПСБ и YADRO разработали систему мониторинга инфраструктуры храненияПСБ и YADRO успешно интегрировали в ИТ-инфраструктуру банка более 100 систем хранения данных (СХД) TATLIN.UNIFIED и разработали систему мониторинга ресурсов СХД, чтобы отслеживать состояние оборудования, динамику работы систем и измерять их производительность. Система мониторинга позволяет собирать метрики производительности компонентов, обрабатывать сообщения, мониторить состояние сервера, отображать данные мониторинга в виде графических интерфейсов и оповещать о нештатных ситуациях и пороговых состояниях. Решение было разработано на базе продукта TATLIN.SATELLITES, в который входит набор драйверов, плагинов и шаблонов для интеграции СХД TATLIN со сторонними системами.

Источник изображения: YADRO «В конечном итоге мы получили инструмент, который ПСБ использует на ежедневной основе, экономя при этом ресурсы, как вычислительные, так и кадровые, за счёт автоматизации процесса мониторинга состояния и нагрузки на отечественные системы хранения данных. За это время в систему мониторинга были внесены дополнительные улучшения в ходе её эксплуатации. Наше сотрудничество позволило добиться более точечной, адресной настройки решения в соответствии с актуальными потребностями бизнеса», — сказал Игорь Панов, директор департамента трансформации и информационного контроля информационных технологий ПСБ. «С помощью новой системы мониторинга задачи решаются за считанные минуты. Можно быстро узнать, какая часть хранилища занята, сколько свободного места осталось, какие пулы переполнены, отсортировать их по нагрузке и объёму, а также проверить количество доступных слотов в массивах, — прокомментировал Егор Литвинов, директор продуктового направления СХД компании YADRO. — Профессиональная экспертиза ПСБ сыграла ключевую роль в создании продукта, необходимого отрасли. Благодаря такому сотрудничеству заказчика и вендора было разработано решение, которое отвечает актуальным требованиям рынка».

02.07.2025 [18:44], Руслан Авдеев

IT-компании с готовностью откликнулись на призыв построить ИИ-гигафабрики на деньги ЕвросоюзаNVIDIA, AMD и многочисленные строители ЦОД, возможно, скоро получат обильно финансирование от Евросоюза, готового в рамках проекта AI Continent Action Plan выделить €20 млрд ($23,6 млрд) на создание т.н. ИИ-гигафабрик (AI Gigafactory) для повышения компетенций ЕС в сфере искусственного интеллекта, сообщает The Register. Еврокомиссия заявила, что компании активно откликнулись на призыв участвовать в строительстве ИИ ЦОД. Подано 76 заявок для 60 разных площадках в 16 странах Евросоюза. Среди заявителей — транснациональные и европейские организации из числа операторов ЦОД, поставщиков телеком-услуг и энергетических компаний. Речь идёт о строительстве в ЕС «современных крупномасштабных вычислительных центров и хранилищ данных» для масштабных ИИ-моделей с сотнями триллионов параметров и соответствующих приложений. Главными выгодоприобретателями, по-видимому, станут производители ИИ-ускорителей, поскольку для новых объектов потребуется не менее 3 млн ИИ-чипов.

Источник изображения: Taylor Walling/unspalsh.com Цель инвестиций — обеспечить Евросоюзу место за столом держав и политических структур, лидирующих в сфере искусственного интеллекта. Сегодня регион отстаёт от США и Китая по масштабам разработки и внедрения ИИ. Впрочем, заявки не являются официальными предложениями — они лишь информируют Еврокомиссию и государства ЕС о потенциальных кандидатах на создание гигафабрик) на территории всего блока. Решения начнут принимать в конце 2025 года. Еврокомиссия не раскрывает потенциальных участников проекта, но журналисты выяснили, что немецкий хостинг-провайдер Ionos подал заявку на участие в строительстве и эксплуатации одной из ИИ-фабрик, а Telefónica и MasOrange рассчитывают принять участие в аналогичных проектах в Испании. Политики Дании с энтузиазмом относятся к возможности размещения в своей стране одного из подобных объектов, но реализация проекта под вопросом из-за высокого энергопотребления. Бельгия же предлагает возвести гигафабрики в Шарлеруа (Charleroi) и Зеллике (Zellik) близ Брюсселя. В феврале сообщалось, что Евросоюз при участии частных инвесторов направит €200 млрд на то, чтобы не остать от США и Китая в гонке ИИ.

02.07.2025 [12:41], Владимир Мироненко

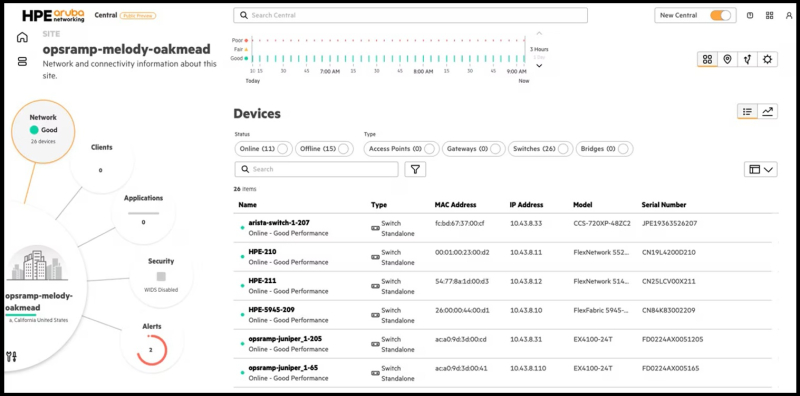

Сеть, которая думает сама за себя: HPE добавила ИИ-агентов в Aruba Central, но клиенты не спешат передавать им полный контрольHPE одной из главных тем конференции HPE Discover 2025 выбрала повсеместное внедрение ИИ-агентов. Хотя не все автономные ИИ-агенты, о которых было объявлено на конференции, уже готовы к работе и использованию клиентами, в подразделении HPE Aruba Networking с энтузиазмом смотрят на будущее таких систем, пишет The Register. В своём выступлении глава HPE Антонио Нери (Antonio Neri) отметил новые возможности Aruba в применении ИИ-агентов. «Эти ИИ-агенты используют набор моделей рассуждений… воспринимайте их как дополнительную административную команду, которая никогда не спит и не ест…, [но всегда] работает на вас. Результатом является сеть, которая думает сама за себя, автономно выявляя проблемы, предлагая решения и со временем становясь умнее», — цитирует его слова ресурс TechTarget. Фил Моттрам (Phil Mottram), исполнительный вице-президент и генеральный директор HPE Aruba Networking, рассказавший об основных инновациях в портфолио компании, коснулся растущей роли агентского ИИ в сетевых операциях, о чём сообщает ресурс Convergedigest.com. Он отметил, что функции на основе ИИ — от автоматического управления питанием до динамической настройки сети — позволяют сократить ручные операции и помогают командам справляться с растущей сложностью и нехваткой навыков. Моттрам также спрогнозировал переход в дальнейшем на более автономные сети, отметив, что, тем не менее, многие корпоративные клиенты считают необходимым сохранить контроль человека в цикле принятия решений. Он отметил, что добавление mesh-группы взаимосвязанных ИИ-агентов и «второго пилота» (copilot) в Aruba Networking Central повысит эффективность сети в целом. Как уточнил The Register, новая технология передаёт агентов, ориентированных на выполнение конкретных задач, под управление многоагентного оркестратора (MAO), который может агрегировать данные, предоставленные ему его субагентами. Клиенты будут иметь доступ к MAO через многомодального второго пилота, которому можно дать задание по сбору данных, обеспечению автоматизированного анализа первопричин сетевых проблем и проблем безопасности и их устранения. По словам Моттрама, это похоже на «наличие дополнительной команды бесплатных сетевых администраторов, находящихся рядом». Вместе с тем он отметил, что ИИ-агенты не предназначены для замены сетевых администраторов, а должны дополнять их набор инструментов: «Это не тот случай, когда “у меня 20 сетевых администраторов, а я хочу, чтобы их было 15”». По его словам, усовершенствования платформы Aruba Networking Central позволят «снизить нагрузку на этих 20 администраторов, чтобы они могли сосредоточиться на безопасности… это упрощает людям управление сетью». Сетевой администратор, столкнувшийся с проблемой, теперь сможет взаимодействовать с ИИ-агентом в разговорном режиме. «Он [ИИ-агент] интерпретирует запрос, а затем отфильтрует данные и скажет: “Это похоже на проблемы безопасности”, после чего может запустить исправление», — говорит Моттрам. Например, автономный сетевой ИИ-агент может заметить ухудшение работы роуминга Wi-Fi 802.11r, что характерно для Android-устройств. Агент определит, что на определённой точке доступа Wi-Fi находится большое количество Android- устройств, и временно отключит роуминг, пока проблемных устройств не станет меньше. «На это администратору сети потребуется некоторое время, чтобы понять и настройки, — пояснил Моттрам. — Интеллектуальная платформа, которая отслеживает пользовательский опыт во всей сети, может довольно быстро обнаружить эту проблему». Он также сообщил ресурсу The Register, что сценарий восстановления 802.11r доступен уже сегодня. По словам Силана Манавалана (Seelan Manavalan), вице-президента по продуктам Aruba, новая версия Aruba Networking Central включает около 200 готовых автономных функций на основе ИИ. Автоматизированный агентский ИИ также может оптимизировать энергопотребление и устранять простые проблемы — всё, что связано с простым анализом первопричин и реагированием на проблемы. Он отметил, что многие клиенты пока не доверяют MAO полный контроль над сетью: «Большинство клиентов всё ещё пробуют это и привыкают к тому, чтобы ИИ-агент действует автономно».

02.07.2025 [11:55], Сергей Карасёв

D-Robotics выпустила одноплатный компьютер RDK X5 для роботов и систем машинного зренияКомпания D-Robotics, по сообщению CNX Software, выпустила одноплатный компьютер RDK X5, предназначенный для различных задач компьютерного зрения, управления робототехникой и машинного обучения. Устройство работает под управлением Ubuntu 22.04 и поддерживает популярные фреймворки с открытым исходным кодом, такие как ROS, TensorFlow и PyTorch. Новинка оборудована процессором Sunrise X5 с восемью ядрами Arm Cortex-A55, работающими на частоте 1,5 ГГц. Интегрированный графический ускоритель с быстродействием 32 Гфлопс обеспечивает возможность (де-)кодирования видео в форматах H.265/H.264 с разрешением до 3840 × 2160 пикселей (60 к/с). Встроенный нейропроцессорный блок обладает ИИ-производительностью до 10 Топс. Благодаря этому, как отмечается, системы на основе RDK X5 способны эффективно анализировать свое окружение в сложных условиях, включая плохое освещение и блики. Изделие может комплектоваться 4 или 8 Гбайт оперативной памяти LPDDR4. Для хранения данных применяется карта microSD. Есть сетевой контроллер 1GbE с опциональной поддержкой PoE, адаптеры Wi-Fi 6 и Bluetooth 5.4. Одноплатный компьютер располагает четырьмя портами USB 3.0 Type-A, разъёмами USB 2.0 Type-C и Micro-USB, гнездом RJ45, портом HDMI (до 1080p60), стандартным аудиогнездом на 3,5 мм. Кроме того, есть два интерфейса MIPI CSI (по 4 линии) для подключения камер с поддержкой стереоскопического зрения, интерфейс MIPI DSI (4 линии), 40-контактная колодка GPIO (UART, PWM, I2C, SPI, I2S). Питание (5 В / 5 A) подаётся через коннектор USB Type-C. Габариты платы составляют 85 × 56 × 20 мм. Эксплуатироваться изделие может при температурах от -20 до +60 °C. Цена начинается примерно с $90.

01.07.2025 [16:55], Сергей Карасёв

«Базальт СПО» приглашает на XXI конференцию разработчиков свободных программКомпания «Базальт СПО» совместно с Институтом программных систем им. А.К. Айламазяна РАН проводит XXI конференцию разработчиков свободных программ. Мероприятие пройдет 3–5 октября 2025 года в г. Переславле-Залесском на базе ИПС РАН. Оргкомитет принимает заявки на доклады по следующим темам:

Тезисы докладов выйдут отдельным сборником и будут опубликованы в национальной библиографической базе данных научного цитирования РИНЦ. Сроки подачи заявокДля докладчиков:

Для слушателей:

Участие для докладчиков и слушателей бесплатное. Трансфер

Проживание выступающих оплачивается организаторами для одного докладчика на доклад. Компенсация проезда докладчиков по территории РФ возможна по дополнительному согласованию с оргкомитетом. Требования к докладамДоклады о проприетарном ПО не допускаются. Для тем о программном обеспечении:

Для OSHW:

Онлайн-трансляция конференции будет доступна на VK Видео и странице конференции. Присоединяйтесь, чтобы обменяться опытом, найти единомышленников и запустить новые проекты.

01.07.2025 [14:59], Андрей Крупин

МТС Web Services запустила B2B-платформу MWS Data с ИИ-агентами для работы с большими даннымиКомпания МТС Web Services (MWS, входит в группу МТС) сообщила о запуске платформы MWS Data для работы с большими данными. Решение предоставляет целый комплекс инструментов для хранения, обработки, визуализации, контроля качества и безопасности данных и позволяет одновременно управлять данными, полученными в режиме реального времени, и историческими массивами. MWS Data нацелена на крупный и средний бизнес в разных отраслях экономики. Платформа объединяет преимущества хранилищ и озёр данных в единую систему, позволяет хранить и обрабатывать любые типы данных. Особенностью продукта является поддержка технологий машинного обучения и искусственного интеллекта на базе нейронных сетей. В частности, в составе MWS Data представлен ИИ-агент для автоматизации наполнения каталога данных. Также в платформу встроен ИИ-агент для анализа данных по запросу от пользователя на естественном языке. Он преобразует текстовый запрос в SQL-код и формирует отчёт с визуализацией. В результате все категории пользователей за несколько секунд получают доступ к сложной аналитике без привлечения разработчиков.

Источник изображения: Luke Peters / unsplash.com Утверждается, что использование платформы MWS Data позволит компаниям сократить время обработки информации, повысить точность прогнозных моделей, а также снизить расходы на хранение данных на 40 %. Решение доступно как для развёртывания на инфраструктуре заказчика, так и для использования в облачном окружении MWS.

01.07.2025 [14:20], Сергей Карасёв

Обновление системы резервного копирования TATLIN.BACKUP для защиты данных от вирусов-шифровальщиковКомпания YADRO представила обновлённую версию специализированных корпоративных систем для хранения и восстановления данных резервных копий TATLIN.BACKUP v1.3. Функциональные возможности были расширены, в том числе за счёт внедрения технологии создания мгновенных снимков (snapshots), одного из самых надёжных инструментов защиты данных от атак злоумышленников и вредоносных вирусов-шифровальщиков. В версии TATLIN.BACKUP v1.3 технология мгновенных логических снимков (snapshots) реализована в трёх режимах с разным уровнем доступа и защищённости — Basic, Secure и Locked. Basic-снимки позволяют задавать срок хранения и управляются напрямую администратором. Secure-снимки доступны только через специального пользователя с ролью Security, что защищает от несанкционированного удаления. Locked-снимки не могут быть удалены или изменены вообще, даже администратором — это уровень защиты, который может быть снят только службой поддержки YADRO, что позволяет навсегда зафиксировать данные, если есть такое требование. Данный подход обеспечивает максимальную степень защиты от различных киберугроз, а также от потери логической целостности данных из-за ошибки пользователя. Кроме того, в новой версии дополнительную защиту обеспечивает аутентифицированное соединение по протоколу T-BOOST, дополненное разграничением прав доступа к файловым системам и генерацией отдельных паролей-токенов. Такой механизм позволяет передавать доступ к отдельным виртуальным файловым системам без раскрытия паролей, включая учётные данные AD/LDAP, а также гибко управлять безопасностью и изоляцией данных.

Источник изображения: YADRO Среди других нововведений: публичный REST API для автоматизации и интеграции, поддержка NFS Kerberos для повышения безопасности и контроля доступа к файловым ресурсам, улучшенное управление и мониторинг системы за счёт обновления CLI/Web-интерфейса и другие изменения, направленные на повышение производительности и стабильности всей системы. «Мы развиваем продуктовые возможности TATLIN.BACKUP так, чтобы наши заказчики получали надёжное и адаптивное решение, которое соответствует самым высоким требованиям к безопасности. Реализация технологии мгновенных снимков с несколькими уровнями защиты данных — это важный шаг к тому, чтобы сделать управление данными не только удобным, но и максимально защищённым», — отметил Егор Литвинов, директор продуктового направления TATLIN в компании YADRO. Сейчас инженерная команда TATLIN работает над следующим релизом v1.4, в котором планируется реализация поддержки HA (high availability) в режиме раннего доступа и SDK T-BOOST, а также появится расширенная статистика дедупликации и поддержка квот.

01.07.2025 [12:33], Руслан Авдеев

Google договорилась о покупке термоядерной энергии у детища MIT — Commonwealth Fusion SystemsКомпания Google объявила о заключении сделки, предусматривающей покупку электричества у проекта ARC компании Commonwealth Fusion Systems (CFS). Последняя отделилась от Массачусетского технологического института (MIT) в 2018 году и занимается технологиями термоядерного синтеза, сообщает Reuters. В Google объявили, что речь идёт о первой в своём роде прямой корпоративной закупке электроэнергии (PPA) подобного типа. Google получит от ARC 200 из 400 возможных МВт. Проект реализуется в Вирджинии — там находится крупнейший хаб энергоёмких дата-центров. Поскольку ИИ и ЦОД стали драйвером роста спроса на электроэнергию по всему миру, стремительно растёт и интерес к термоядерному синтезу. Отсутствие радиоактивных отходов делает его более экологичным. Для стимулирования реакций термоядерного синтеза учёные всего мира десятилетиями пытались использовать различные технологии, от лазеров до, в случае с CFS, больших магнитов. По данным Reuters, в 2022 году в Ливерморской национальной Лаборатории им. Лоуренса (LLNL) в Калифорнии впервые на короткое время удалось добиться чистого энергетического выигрыша (net energy gain) в эксперименте с использованием лазеров.

Источник изображения: Luke Jones/unsplash.com Впрочем, о коммерческом использовании термоядерных технологий пока не может быть и речи. В Google сообщили, что есть ряд серьёзных физических и инженерных проблем, которые ещё предстоит решить, но компания готова инвестировать в такие технологии. CFS рассчитывает начать выработку электричества в рамках проекта ARC в начале 2030-х годов, но пока необходимо решить имеющиеся технические проблемы. В понедельник Google также заявила о наращивании инвестиций в CFS, хотя их объём не раскрывается. Ранее Google входила в число инвесторов, вложивших в компанию $1,8 млрд в 2021 году. Предполагается, что текущие усилия CFS по сбору средств сопоставимы с раундом финансирования 2021 года. В мае 2025 года CFS привлекла более $1 млрд благодаря неизвестному гиперскейлеру. Известно, что помимо Google довольно тесные отношения с компанией имеет и Microsoft. В июне Google также вложилась в разработчика термоядерных реакторов TAE Technologies.

01.07.2025 [09:02], Владимир Мироненко

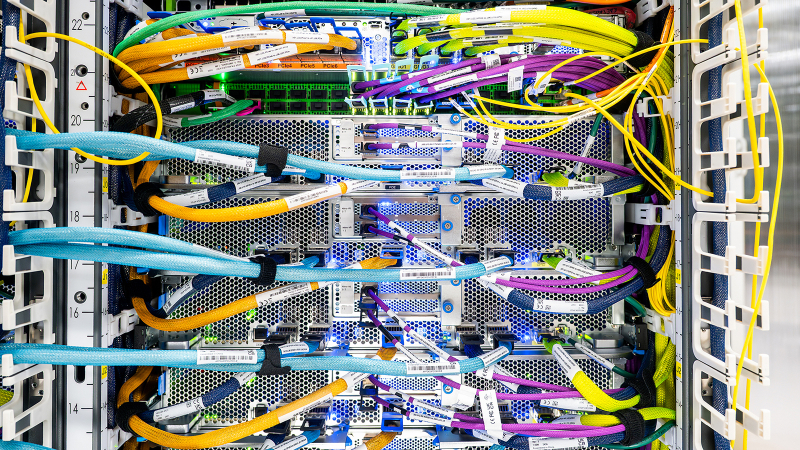

Крупнейший в истории AWS ИИ-суперкомпьютер Project Rainier охватит несколько ЦОД, но будет экологичнымВ настоящее время Amazon Web Services (AWS) занимается строительством ИИ-суперкомпьютера Project Rainier. Проект, охватывающий несколько ЦОД в США, по своим масштабам не похож ни на что, что когда-либо пыталась реализовать AWS. Этот огромный уникальный суперкомпьютер разработан для создания и работы ИИ-моделей следующего поколения. Партнёром AWS в реализации проекта выступает ИИ-стартап Anthropic, который будет использовать новый ИИ-кластер для создания и развёртывания будущих версий LLM Claude. У компаний довольно тесные отношения, а появление Project Rainier снизит зависимость Anthropic и AWS от дефицитных ускорителей NVIDIA, которых не хватает и для собственных нужд Amazon. «Rainier обеспечит в пять раз больше вычислительной мощности по сравнению с крупнейшим в настоящее время кластером Anthropic», — сообщил Гади Хатт (Gadi Hutt), директор по разработке и проектированию продуктов Annapurna Labs, подразделения AWS по разработке чипов. Чем больше вычислений вложить в обучение Claude, тем умнее и точнее будет модель. «Мы создаём вычислительную мощность в масштабах, которых никогда не было раньше, и мы делаем это с беспрецедентной скоростью и гибкостью», — подчеркнул Хатт. Сообщается, что Project Rainier спроектирован как огромный кластер EC2 UltraCluster, состоящий из серверов UltraServers с Trainium2. Trainium2 — ИИ-ускоритель собственной разработки Amazon, предназначенный для обучения ИИ-моделей. UltraServer — новый тип вычислительной системы, которая объединяет четыре физических сервера, каждый из которых содержит 16 ускорителей Trainium2, взаимодействие между которыми осуществляется с помощью интерконнекта NeuronLinks (кабели синего цвета на фото). Связь между компонентами суперкомпьютера реализуется на двух критических уровнях: NeuronLinks обеспечивают высокоскоростные соединения внутри UltraServer, в то время как DPU Elastic Fabric Adapter (EFA) объединяет UltraServer внутри ЦОД и между ЦОД. Этот двухуровневый подход позволяет максимизировать скорость в местах, где в этом больше всего есть потребность, сохраняя гибкость масштабирования в рамках нескольких дата-центров. Эксплуатация и обслуживание такого огромного вычислительного кластера отличается повышенной сложностью. И в данном случае надёжность системы имеет первостепенное значение. Именно здесь подход компании к разработке оборудования и ПО действительно выходит на первый план, говорит компания. Благодаря тому, что AWS сама занимается разработкой оборудования, она может контролировать каждый аспект технологического стека, от мельчайших компонентов чипа до ПО и архитектуры самого ЦОД. Это также позволяет ускорить внедрение технологий и снизить затраты при внедрении ИИ. «Когда у вас есть полная картина, от чипа до ПО и самих серверов, вы можете проводить оптимизацию там, где это имеет наибольший смысл», — говорит директор по инжинирингу Annapurna Labs Рами Синно (Rami Sinno). «Иногда лучшим решением может быть перепроектирование того, как подаётся питание серверов, или переписывание ПО, которое всё координирует. Это может происходить и одновременно. Поскольку у нас есть обзор всего на каждом уровне, мы можем быстро устранять неполадки и внедрять инновации гораздо быстрее», — добавил он. Вместе с тем, по словам Amazon, внедрение мощной ИИ-инфраструктуры будет достаточно экологичным. Вся электроэнергия, потребляемая Amazon, включая её ЦОД, в 2023 году была полностью компенсирована закупками из возобновляемых источников энергии. В течение последних пяти лет Amazon была крупнейшим корпоративным покупателем возобновляемой энергии в мире. Компания инвестирует миллиарды долларов в ядерную энергию и использование аккумуляторов, а также в финансирование масштабных проектов возобновляемой энергии по всему миру. Amazon по-прежнему намерена добиться нулевого уровня выбросов углерода к 2040 году. И Project Rainier ей в этом поможет. В прошлом году AWS объявила, что будет развёртывать новые компоненты, которые объединяют достижения в области питания и охлаждения, не только в строящихся, но и в существующих ЦОД. Их использование, как ожидается, позволит снизить потребление энергии механизмами до 46 % и сократить выбросы парниковых газов при производстве бетона на 35 %. Новые объекты для Project Rainier будут включать в себя различные усовершенствования для повышения энергоэффективности и экологичности с акцентом на сокращение потребления водных ресурсов и использованию забортного воздуха для охлаждения. Например, в ЦОД в округе Сент-Джозеф (St. Joseph), штат Индиана, с октября по март ЦОД вообще не будут использовать воду для охлаждения, а с апреля по сентябрь питьевая вода будет нужна только в течение нескольких часов в день. Amazon не уточняет, о каком именно кампусе идёт речь, но уже известно, что компания строит в Индиане дата-центр, который будет потреблять энергии как половина населения штата. Благодаря инженерным инновациям AWS является лидером отрасли по эффективности использования воды, заявляет компания. На основании результатов недавнего исследования Национальной лаборатории Лоуренса в Беркли, посвящённого эффективности использования воды в ЦОД, отраслевой стандартный показатель составляет 0,375 л/кВт·ч, тогда как у AWS он равен всего 0,15 л/кВт·ч. Компания улучшила этот параметр на 40 % по сравнению с 2021 годом.

30.06.2025 [22:25], Руслан Авдеев

В деревню, в глушь, на север: московский регион страдает от дефицита мощностей ЦОД, но скоро операторы могут уйти в провинциюХотя компании вводят всё новые мощности дата-центров в Московском регионе несмотря на дорогие кредиты, скоро ситуация может измениться. До сих пор большинство ЦОД размещались в Москве из-за удобной локации и наличия квалифицированных кадров, но скоро доля дата-центров за пределами столицы может вырасти в пользу провинции, сообщает «Коммерсантъ». Агентство iKS-Consulting и оператор ЦОД 3data провели исследование, согласно которому свободного предложения мощностей в Москве и Подмосковье для крупных клиентов практически не осталось. Сданные в прошлом и позапрошлом году площадки заполнены, остались ресурсы лишь для розничных клиентов, т.е. свободные мощности в Москве заканчиваются. Значимыми мощностями обладает лишь сданный в начале 2025 года ЦОД DC N1 и новые мощности IXcellerate. При этом стоимость колокейшн-сервисов за последний год выросла на 30 %, а дефицит только усиливается из-за роста числа компаний, работающих с облаками и большими данными. Свою роль сыграли и ИИ-приложения, требующие всё больше мощностей. Для подобных задач, по мнению экспертов, нужно немало высоконагруженных стоек, для чего необходимо менять структуру самих ЦОД, от систем охлаждения до энергоснабжения. По самым скромным оценкам, рынок дата-центров будет расти в России минимум на 10 % ежегодно.

Источник изображения: Roman Purtov/unsplash.com Пока основные ЦОД России расположены в Московском регионе и Санкт-Петербурге, что обусловлено высокой концентрацией там конечных пользователей. При этом свободных мест нет, а расширению готовых площадок мешает нехватка электричества, спрос на которое в столицах растёт не в последнюю очередь из-за ИИ. За пределами столиц такого дефицита нет, а условия для переезда компаний в другие регионы весьма благоприятны. По мнению экспертов, рано или поздно переезд в регионы неизбежен. При этом в близких от Москвы регионах мощности зачастую простаивают, поскольку важна не только близость к столице, но и транспортная доступность, наличие качественной связи и др. У колокейшн-провайдеров и бизнесов, строящих собственные дата-центры, параметры выбора значительно отличаются, поскольку первым важна доступность объектов для клиентов. В будущем перспективным видится размещение ЦОД в более северных районах, где возможен фрикулинг. Кроме того, для многих компаний актуально развитие ЦОД вблизи производственных площадок далеко от столиц. Регионы уже пытаются привлечь дата-центры, предлагая налоговые льготы и субсидии, повышая качество телеком-инфраструктуры. Строительство новых дата-центров может ускориться после снижения ключевой ставки ЦБ, хотя и сейчас проекты будут рентабельны при оптимизации затрат и эффективном планировании. Из-за высокой ключевой ставки был заморожен или отложен ряд новых проектов, но это касается в первую очередь компаний, развивающихся за счёт кредитных средств. Крупные компании (ретейл, банки, промышленность и др.) продолжают строить свою инфраструктуру. Если на крупные ЦОД нужны десятки миллиардов рублей, то серверная комната может быть построена и за 100 млн руб. По оценкам, окупаемость ЦОД составляет 10–15 лет. Ещё одна проблема — импортозамещение оборудования и сопровождение имеющегося. Как считают эксперты, решающую роль в развитии рынка ЦОД в России играют меры по льготному кредитованию, возможность освобождения от НДС, субсидирование энерготарифов. Кроме того, в перспективе выбор госзаказчиков может упростить система оценки надёжности дата-центров, вводимая Минцифры. |

|