Материалы по тегу: c

|

16.08.2025 [14:45], Сергей Карасёв

Dell представила ИИ-серверы PowerEdge R7725 и R770 на базе NVIDIA RTX Pro 6000 Blackwell Server EditionКомпания Dell анонсировала серверы PowerEdge R7725 и PowerEdge R770 в форм-факторе 2U, построенные на аппаратной платформе AMD и Intel соответственно. Новинки оснащаются ускорителями NVIDIA RTX Pro 6000 Blackwell Server Edition. Модель PowerEdge R7725 может нести на борту два процессора AMD EPYC 9005 (Turin), а также до 6 Тбайт оперативной памяти DDR5-6400 в виде 24 модулей. Доступны до восьми слотов PCIe 5.0 x8 или x16. При этом возможна установка двух GPU-ускорителей. Сервер предлагает различные варианты исполнения подсистемы хранения данных с фронтальным доступом: 12 × LFF SAS/SATA, 8/16/24 × SFF SAS/SATA, 16 × SFF SAS/SATA + 8 × U.2/NVMe или 8/16/32/40 × EDSFF E3.S. Имеется выделенный сетевой порт управления 1GbE, а дополнительно предлагается установка адаптеров с поддержкой 1GbE, 10GbE, 25GbE, 100GbE и 400GbE. В свою очередь, вариант PowerEdge R770 комплектуется двумя чипами Intel Xeon 6 Granite Rapids с производительными Р-ядрами или Xeon 6 Sierra Forest с энергоэффективными Е-ядрами. Реализованы 32 слота для модулей оперативной памяти DDR5-6400 суммарным объёмом до 8 Тбайт. Предлагается широкий набор опций в плане установки накопителей в лицевой и тыльной частях корпуса, включая 24 × SFF SAS/SATA и 40 × EDSFF E3.S. Система может быть укомплектована четырьмя картами OCP NIC 3.0 (вплоть до 400GbE). Есть слоты PCIe 5.0 x8 и x16. Серверы поддерживают воздушное и прямое жидкостное охлаждение (DLC). Мощность блоков питания с сертификатом 80 Plus Titanium достигает 3200 Вт. Заявлена совместимость с Canonical Ubuntu Server LTS, Windows Server (Hyper-V), Red Hat Enterprise Linux, SUSE Linux Enterprise Server и VMware ESXi.

15.08.2025 [09:10], Сергей Карасёв

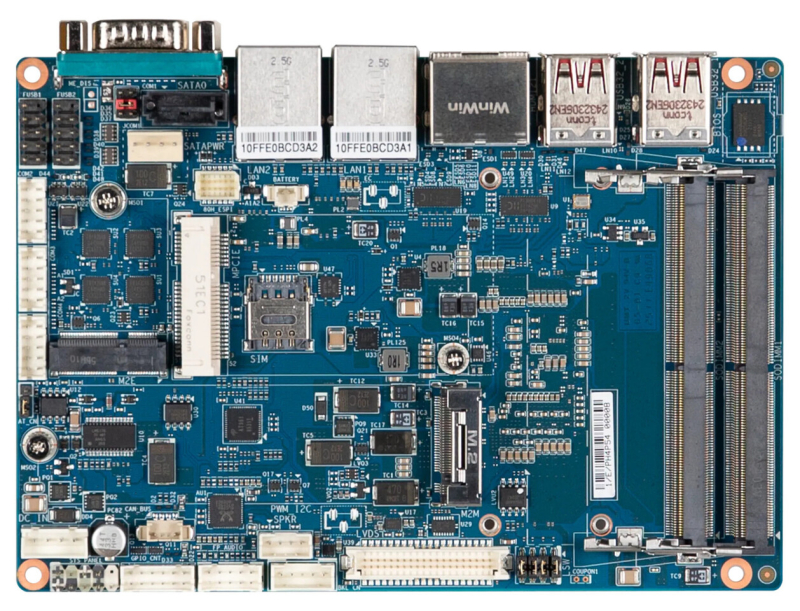

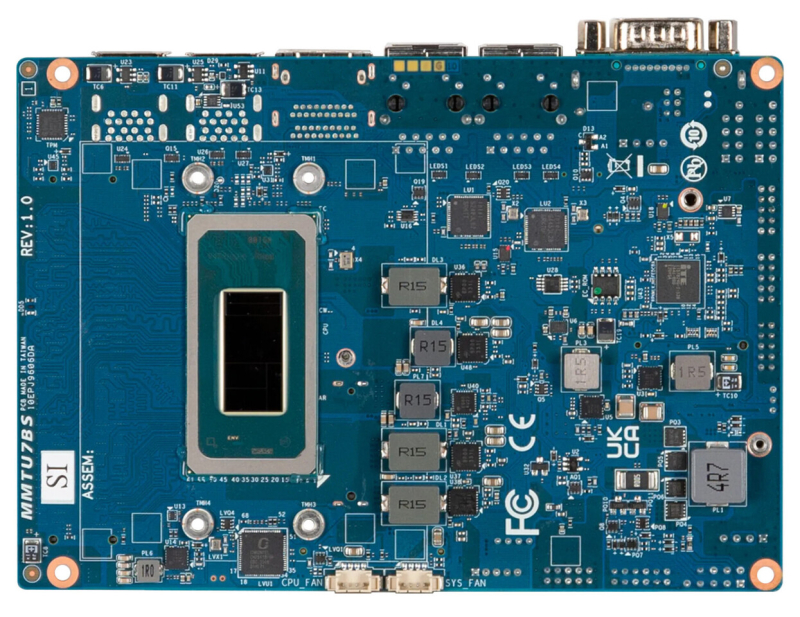

GigaIPC выпустила индустриальные одноплатные компьютеры на платформе Intel Meteor LakeКомпания GigaIPC, подразделение Gigabyte, анонсировала индустриальные одноплатные компьютеры QBiP-155UB и QBiP-125UB в форм-факторе 3,5″, подходящие для создания edge-систем. В основу новинок положена аппаратная платформа Intel Meteor Lake. Изделия несут на борту чип Core Ultra 7 Processor 155U и Core Ultra 5 Processor 125U соответственно. Эти CPU содержат 12 вычислительных ядер в конфигурации 2P+8E+2LPE (14 потоков инструкций), а показатель TDP составляет 15 Вт. Максимальная тактовая частота у первого из процессоров достигает 4,8 ГГц, у второго — 4,3 ГГц. Доступны два слота SO-DIMM для модулей оперативной памяти DDR5-5600 суммарным объёмом до 96 Гбайт. Одноплатные компьютеры располагают двумя сетевыми портами 2.5GbE на основе контроллеров Intel I226V & I226LM, звуковым кодеком Realtek ALC269 и модулем TPM 2.0 для обеспечения безопасности. Есть порт SATA-3 для накопителя, коннектор M.2 2280 M-Key (PCIe 4.0 x4, SATA-3) для SSD, разъём M.2 2230 E-Key для адаптера Wi-Fi и слот Mini PCIe (плюс SIM) для сотового модема. Предусмотрены четыре порта USB 3.2 Gen2, два гнезда RJ45 для сетевых кабелей, два коннектора HDMI 2.1 (до 7680 × 4320 пикселей, 60 Гц) и последовательный порт (RS-232/422/485). Через разъёмы на платах могут быть задействованы ещё три последовательных порта (RS-232/422/485) и четыре порта USB 2.0. Упомянут также интерфейс LVDS с поддержкой разрешения 1920 × 1200 точек (60 Гц). Таким образом, изображение может выводиться одновременно на три монитора. Новинки имеют размеры 146 × 101,7 мм. Диапазон рабочих температур простирается от 0 до +60 °C. Заявлена совместимость с Windows 10/11.

13.08.2025 [11:51], Сергей Карасёв

HPE представила серверы ProLiant с ускорителями NVIDIA RTX Pro 6000 Blackwell Server EditionКомпания HPE анонсировала серверы ProLiant DL385 Gen11 и ProLiant Compute DL380a Gen12, построенные соответственно на аппаратной платформе AMD и Intel. Устройства оснащаются ускорителями NVIDIA RTX Pro 6000 Blackwell Server Edition, которые ориентированы на требовательные приложения ИИ и рендеринг высококачественной графики. Модель ProLiant DL385 Gen11 выполнена в форм-факторе 2U. Она может нести на борту два процессора AMD EPYC 9004 (Genoa) или EPYC 9005 (Turin), а также до 6 Тбайт оперативной памяти DDR5-6000 в конфигурации 12 × 512 Гбайт. Поддерживаются до восьми слотов PCIe 5.0 и до двух слотов OCP. Установлены две карты RTX Pro 6000 Blackwell Server Edition. В зависимости от модификации во фронтальной части могут располагаться до 12 отсеков для накопителей LFF HDD/SSD с интерфейсом SAS/SATA, до 24 отсеков для устройств SFF HDD/SSD (SAS/SATA/NVMe), до 36 посадочных мест для изделий EDSFF E3.S 1T или до 48 отсеков для SFF HDD/SSD.  Внутри могут размещаться до восьми устройств SFF SAS/SATA/NVMe или до четырёх LFF SAS/SATA, сзади — два накопителя SFF SAS/SATA/NVMe или четыре LFF SAS/SATA. Кроме того, есть два коннектора M.2 NVMe. Применяется воздушное охлаждение с возможностью опционального развёртывания прямого жидкостного охлаждения Direct Liquid Cooling (DLC). Мощность блоков питания — до 2200 Вт. Сервер оснащён системой удалённого управления iLO 6.  В свою очередь, ProLiant Compute DL380a Gen12 имеет формат 4U. Это устройство комплектуется двумя чипами Intel Xeon 6, насчитывающими до 144 ядер. Объём оперативной памяти DDR5 достигает 4 Тбайт в виде 32 модулей. Допускается установка до восьми GPU, накопителей SFF (NMVe) и EDSFF. Питание обеспечивают восемь блоков. Упомянута система HPE iLO 7. В продажу данная модель поступит в сентябре текущего года.

08.08.2025 [11:50], Руслан Авдеев

Tesla отказалась от развития ИИ-суперкомпьютеров DojoTesla распускает команду, стоявшую за суперкомпьютером Dojo, сообщает TechCrunch со ссылкой на Bloomberg. Как сообщают анонимные источники, глава проекта Питер Бэннон (Peter Bannon) покидает компанию, а оставшихся участников команды переведут на работу с другими вычислительными проектами Tesla. О закрытии Dojo стало известно после ухода из Tesla порядка 20 сотрудников, основавших собственный ИИ-стартап DensityAI, который займётся разработкой чипов, аппаратного и программного обеспечения для ИИ ЦОД, связанных с робототехникой, ИИ-агентами и автомобильными приложениями. DensityAI основана бывшим руководителем Dojo Ганешем Венкатарамананом (Ganesh Venkataramanan), причём в не самый удачный для Tesla момент, поскольку глава компании Илон Маск (Elon Musk) ранее настоял на том, чтобы акционеры рассматривали компанию как бизнес, занимающийся ИИ и робототехникой. Решение о закрытии Dojo стало значительным изменением стратегии. Ранее Маск утверждал, что суперкомпьютер станет краеугольным камнем для удовлетворения амбиций компании в сфере ИИ и основная цель — добиться полной автономии машин благодаря способности Dojo обрабатывать огромные массивы видеоданных. В 2023 году Morgan Stanley посчитал, что Dojo может поднять капитализацию Tesla на $500 млрд за счёт новых источников дохода — проектов роботакси и программных сервисов. В 2024 году Маск сообщил, что команда Tesla, занятая искусственным интеллектом, «удвоит ставку» на Dojo перед презентацией роботакси. Тем не менее разговоры о Dojo уже в августе того же года постепенно сошли на нет, когда Маск начал продвигать ИИ-кластер Cortex (на базе ускорителей NVIDIA) при штаб-квартире Tesla в Остине (Техас). Проект Dojo включал в себя как суперкомпьютер, так и предполагал собственное производство ИИ-ускорителей. Ещё в 2021 году Tesla во время официального анонса Dojo представила чип D1, который должен был бы использоваться совместно с ускорителями NVIDIA для обеспечения работы Dojo. Также сообщалось, что ведутся работы над чипом D2, в котором будут устранены недостатки предшественника. По данным источников Bloomberg, теперь Tesla намерена сделать ставку преимущественно на NVIDIA, а также других сторонних партнёров вроде AMD, а Samsung будет выпускать чипы на заказ. В прошлом месяце с Samsung подписан контракт на выпуск инференс-чипов AI6, которые будут работать как с автопилотами Tesla, так и использоваться в роботах Optimus и дата-центрах. Ранее Маск намекнул, что в случае с Dojo 3 (D3) и инференс-чипом AI6, речь, возможно, будет идти о едином чипе. Недавно совет директоров Tesla предложил Маску пакет акций на $29 млрд, чтобы тот оставался в Tesla и продвигал ИИ-разработки компании, вместо того чтобы отвлекаться на другие бизнесы.

05.08.2025 [11:16], Сергей Карасёв

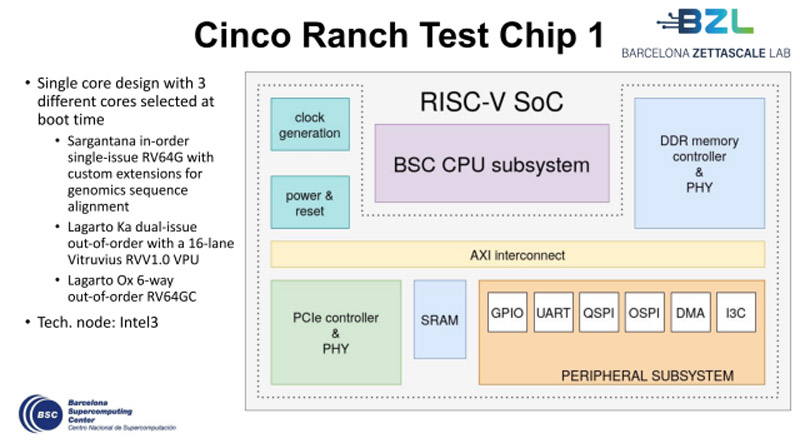

Европейские чипы Cinco Ranch на базе RISC-V близки к началу массового производстваУчастники проекта Barcelona Zettascale Laboratory (BZL), координируемого Барселонским суперкомпьютерным центром (BSC) в Испании, по сообщению ресурса EETimes, достигли фазы Tape-out в рамках разработки европейских процессоров Cinco Ranch на открытой архитектуре RISC-V. Tape-out — это финальная стадия проектирования интегральных схем или печатных плат перед их отправкой в производство. Данный процесс предполагает перенос цифрового макета чипа на фотошаблон для последующего изготовления. Производством изделий займётся предприятие Intel Foundry с применением техпроцесса Intel 3. Cinco Ranch представляет собой пятое поколение чипов серии Lagarto. По сути, это «система на кристалле» (SoC) промышленного класса с высокой энергетической эффективностью. Конструкция чипа включает три отдельных специализированных ядра, каждое из которых оптимизировано под определённые вычислительные задачи. В частности, присутствует ядро Sargantana (RV64G) с однопоточным выполнением инструкций по порядку. Кроме того, имеется двухпоточное ядро Lagarto Ka с внеочередным исполнением машинных инструкций. Довершает картину высокопроизводительное 6-поточное ядро Lagarto Ox (RV64GC) с внеочередным исполнением инструкций. Нужное ядро выбирается в момент загрузки системы.

Источник изображения: BSC Решение Cinco Ranch содержит 16-канальный векторный блок Vitruvius++ VPU и трёхуровневую систему кеша. Реализована поддержка памяти DDR5 и интерфейса PCIe 3.0. Площадь чипа составляет 16 мм2. Главной целью проекта BZL является разработка суверенных суперкомпьютерных технологий в Европе. Предполагается, что создаваемые чипы найдут применение в различных областях, включая НРС-платформы, автономные транспортные средства, системы ИИ и пр. После всестороннего тестирования чипов Cinco Ranch будет освоено их массовое производство.

05.08.2025 [10:39], Сергей Карасёв

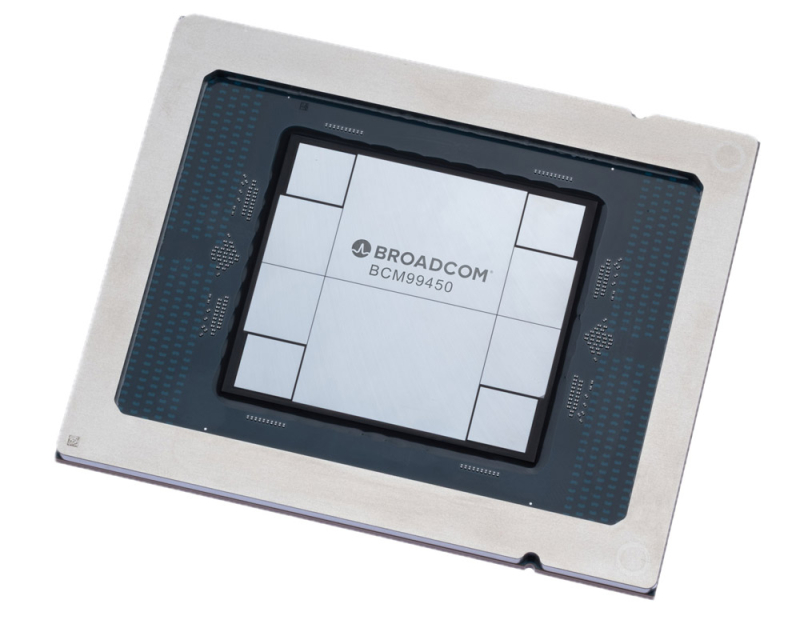

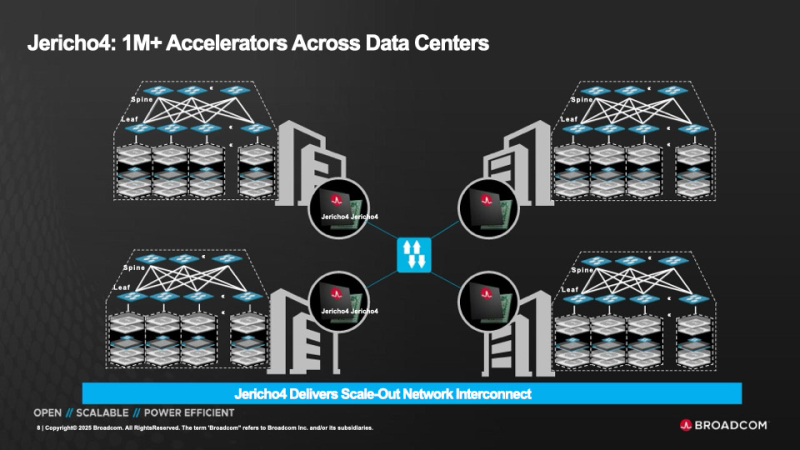

HyperPort на 3,2 Тбит/с: Broadcom выпустила чип-коммутатор Jericho4 для распределённой ИИ-инфраструктурыКомпания Broadcom объявила о начале поставок коммутационного чипа Jericho4, специально разработанного для распределённой инфраструктуры ИИ. Изделие, как утверждается, позволяет объединять более миллиона ускорителей (GPU, TPU) в географически разнесённых дата-центрах, преодолевая традиционные ограничения масштабирования. Отмечается, что по мере роста размера и сложности моделей ИИ требования к инфраструктуре ЦОД повышаются: создаётся необходимость в объединении ресурсов нескольких площадок, каждая из которых обеспечивает мощность в десятки или сотни мегаватт. Для этого требуется оборудование нового поколения, оптимизированное для сверхширокополосной и безопасной передачи данных на значительные расстояния. Новинка позволяет решить проблему. Jericho4 обладает коммутационной способностью 51,2 Тбит/с. Благодаря глубокой буферизации и интеллектуальному управлению перегрузкой изделие обеспечивает поддержку RoCE без потерь на расстоянии более 100 км, что позволяет формировать распределённую инфраструктуру ИИ, говорит Broadcom. Могут быть задействованы интерфейсы 50GbE, 100GbE, 200GbE, 400GbE, 800GbE и 1.6TbE. Реализована технология HyperPort, которая объединяет четыре порта 800GbE в один канал с пропускной способность 3,2 Тбит/с, что упрощает проектирование и управление сетью. Единая инфраструктура на базе Jericho4 может масштабироваться до 36 тыс. портов HyperPort, каждый из которых работает со скоростью 3,2 Тбит/с. Jericho4 поддерживает шифрование MACsec на каждом порту на полной скорости для защиты передаваемой между ЦОД информации без ущерба для производительности — даже при самых высоких нагрузках. Новинка полностью соответствует спецификациям, разработанным консорциумом Ultra Ethernet (UEC): благодаря этому достигается бесшовная интеграция с широкой экосистемой сетевых карт, коммутаторов и программных стеков. Чип Jericho4 производится по 3-нм технологии. Он оснащён модулями Broadcom PAM4 SerDes 200G. Это устраняет необходимость в дополнительных компонентах, таких как ретаймеры, что способствует снижению энергопотребления и повышению надёжности системы в целом. В частности, энергозатраты уменьшены на 40 % в расчёте на бит по сравнению с решениями предыдущего поколения. Это помогает организациям снижать эксплуатационные расходы и достигать целей устойчивого развития, говорит Broadcom.

29.07.2025 [11:10], Руслан Авдеев

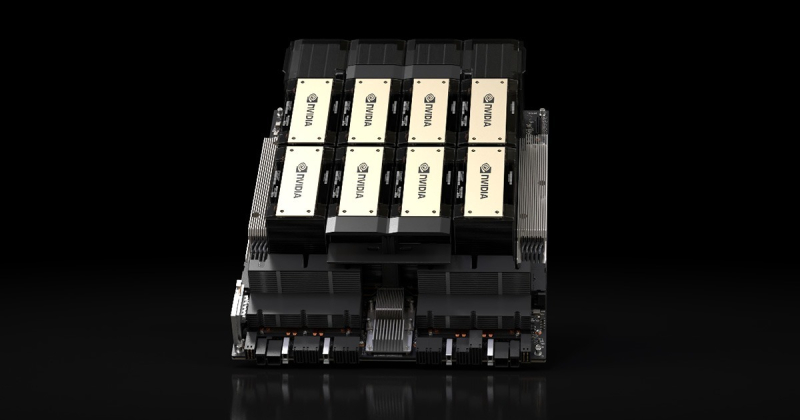

NVIDIA заказала у TSMC производство 300 тыс. ИИ-ускорителей H20 в ответ на высокий спрос в КитаеНа прошлой неделе NVIDIA обратилась к тайваньской TSMC с заказом на выпуск 300 тыс. ИИ-ускорителей H20. Причиной тому — большой спрос на специально ослабленные чипы в Китае, сообщает Reuters со ссылкой на осведомлённые источники. Один из них подчеркнул, что высокий спрос в Поднебесной фактически заставил NVIDIA не полагаться на существующие запасы, а сделать новый заказ. Дело в том, что в июле администрация президента США Дональда Трампа (Donald Trump) вновь позволила продавать ухудшенные ускорители H20 в Китай — в апреле их поставки в страну были запрещены полностью. В своё время NVIDIA разрабатывала H20 специально для китайского рынка — после очередных экспортных ограничений, введённых США на поставку в Китай в конце 2023 года. H20 далеко не так хорош, как модели вроде NVIDIA H100 и, тем более, NVIDIA Blackwell, которые свободно поставляются в некоторые, «дружественные» США страны. По данным источников, новые заказы у TSMC дополнят уже имеющиеся запасы в 600-700 тыс. ускорителей H20, которые находятся на складах NVIDIA. Для сравнения, по данным экспертов SemiAnalysis, в 2024 году NVIDIA продала около 1 млн чипов H20. В ходе поездки в Пекин в текущем месяце глава NVIDIA Дженсен Хуанг заявил, что возобновление производства H20 будет зависеть от объёмов новых заказов на эти ускорители. При этом он добавил, что на «перезапуск» цепочки поставок потребуется девять месяцев. После визита Хуанга СМИ сообщали, что NVIDIA имеет ограниченные запасы H20 на складах и пока не имеет немедленных планов на возобновление производства полупроводниковых пластин для них.

Источник изображения: NVIDIA Для поставок H20 разработчику потребуется получать экспортные лицензии у американских властей. В середине июля компания якобы получила заверения в том, что они скоро будут выданы. Правда, Министерство торговли США всё ещё должно одобрить выдачу лицензий. В понедельник NVIDIA отказалась комментировать новые заказы или статус своих заявок на получение экспортных лицензий. Министерство торговли пока воздерживается от комментариев. По некоторым данным, NVIDIA запросила у китайских компаний, заинтересованных в закупках ускорителей H20, представить новую документацию, в том числе прогнозируемые объёмы закупок. По данным представителя администрации Трампа, возобновление продаж H20 в Китай стало одним из результатов переговоров о закупке в КНР редкоземельных магнитов, необходимых во многих отраслях. В своё время Пекин ограничил их экспорт в разгар американо-китайской торговой войны. Решение возобновить экспорт H20 в КНР вызвало осуждение ряда американских политиков, как демократов, так и республиканцев. Те считают, что это помешает США сохранить лидерство в сфере ИИ-технологий. Тем не менее, Дженсен Хуанг не так давно раскритиковал запрет на продажу чипов в Китай, заявив, что это только ускоряет технический прогресс в Поднебесной. Многие политики из США считают, что сохранение экспорта помешает Китаю полностью перейти на собственные решения, такие как продукция Huawei. До апрельского запрета китайские технологические гиганты, включая Tencent, ByteDance и Alibaba, увеличили закупки H20, внедряя относительно недорогие и эффективные ИИ-модели DeepSeek китайской разработки, а также собственные модели. Популярность продуктов NVIDIA в Китае трудно переоценить — их активно ремонтируют в КНР и ввозят контрабандой в страну. После запрета на продажи Р20 в апреле, NVIDIA предупредила, что должна буквально «списать» запасы на $5,5 млрд, а Хуанг заявил в одном из интервью, что компания потеряет от отказа от потенциальных продаж ещё $15 млрд.

25.07.2025 [17:26], Руслан Авдеев

По пути Маска: Crusoe заказала 29 газовых турбин для ИИ ЦОД, часть которых достанется OpenAI

crusoe energy

general electric

hardware

stargate

ии

полезные ископаемые

цод

электропитание

энергетика

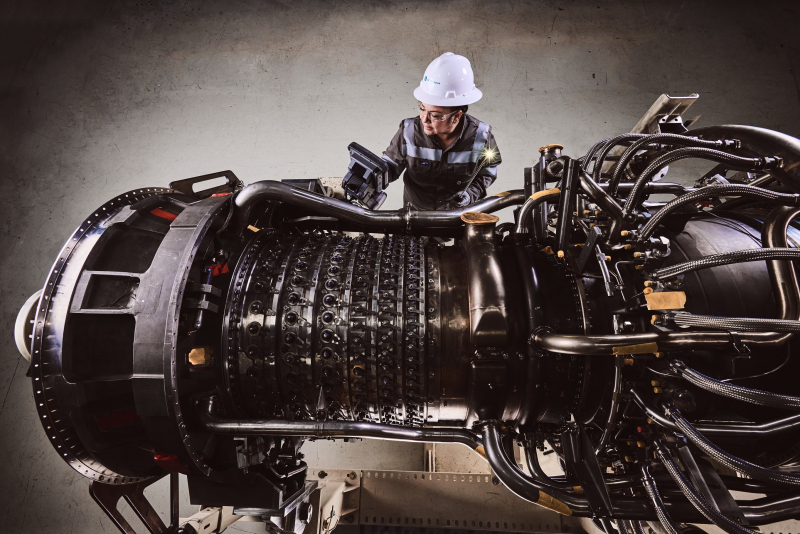

Crusoe заказала у GE Vernova ещё 19 газотурбинных установок LM2500XPRESS на основе авиационных двигателей, сообщает Datacenter Dynamics. В общей сложности Crusoe получит 29 турбин — с учётом заказанных в декабре 2024 года. Ожидается, что в совокупности они обеспечат мощность 1 ГВт. Сейчас Crusoe строит в интересах OpenAI 1,2-ГВт кампус Stargate I в Абилине (Техас), который частично будет запитан именно от газовых турбин. По словам Crusoe, экспоненциальный рост ИИ требует энергетических решений с возможностью быстрого развёртывания. В том числе рассматривает строительство генерирующих мощностей непосредственно рядом с дата-центрами, чтобы обеспечить последние устойчивым и контролируемым энергоснабжением. В компании заявляют, что создают ИИ-фабрики с рекордной скоростью, а технология GE Vernova является ключевым фактором, ускоряющим энергообеспечение клиентов и партнёров. Кроме того, компания использует аккумуляторы и готова подключиться к солнечным и ветряным электростанциям, а в перспективе рассматривает возможность установки малых модульных реакторов. LM2500XPRESS — это мобильная газотурбинная электростанция мощностью до 35 МВт на базе авиационного двигателя General Electric LM2500, адаптированного для наземного использования, включающая газовый компрессор и систему контроля выбросов. В GE Vernova заявили, что выбросы сокращаются за счёт каталитического нейтрализатора, преобразующего окиси азота в водяной пар и безвредный азот. В результате генератор обеспечивает на 90 % меньше выбросов, чем традиционные поршневые двигатели на газе или дизельном топливе. Ранее в этом году Crusoe создала совместное предприятие с инвестиционной компанией Engine No. 1 из Сан-Франциско для закупки газовых турбин на 4,5 ГВт у GE Vernova и Chevron. Производители газовых турбин столкнулись с резко возросшим спросом со стороны дата-центров, особенно из-за бума ИИ и высоких энергозатрат на вычисления. Тем не менее, расширять производство они пока опасаются. Очередь на турбины растянулась как минимум до 2030 года, что создаёт задержки в строительстве энергомощностей для новых дата-центров. Дело в том, что операторы ЦОД не желают годами ждать присоединения к энергосетям, пока не готовым к столь высоким нагрузкам. Примечательно, что активным освоением газовой энергетики занимается не только Crusoe. ИИ-стартап xAI Илона Маска (Elon Musk) в своё время установил газовые генераторы на территории своего кампуса ЦОД и даже получил разрешение на 15 турбин из оставшихся 24-х. Конечно, довольны этим далеко не все, и компания встретила жёсткое противодействие со стороны местных жителей. Впрочем, ещё в мае сообщалось, что второй ЦОД в Мемфисе, вероятно, тоже получит газовые генераторы, тем более, что Маск анонсировал запуск нового суперкомпьютера Colossus 2, которому тоже понадобится немало энергии.

25.07.2025 [17:04], Руслан Авдеев

Anthropic: к 2028 году для ИИ в США потребуется 50 ГВт электроэнергии, а для передовых ИИ-моделей — 5-ГВт ЦОДКомпания Anthropic объявила, что для сохранения лидерства в гонке ИИ США потребуется «не менее 50 ГВт электричества» для нужд искусственного интеллекта к 2028 году. При этом в компании уверены, что для обучения передовых ИИ-моделей потребуются дата-центры мощностью по 5 ГВт, сообщает Datacenter Dynamics. OpenAI тоже мечтает о 5-ГВт ЦОД. Если раньше Anthropic сообщала, что 50 ГВт нужно ввести в эксплуатацию до 2027 года, то теперь сроки перенесены на год. Из них к 2028 году 20–25 ГВт пойдёт на обучение передовых ИИ-систем в нескольких локациях. Эксперты расходятся в оценках, но даже если эти цифры приблизительно верны, удовлетворить потребности ИИ в энергии будет нелегко. По прогнозам Национальной лаборатории им. Лоуренса в Беркли (LBNL) при Министерстве энергетики США, в 2028 году ЦОД разных типов потребуется 74–132 ГВт. При этом отмечается, что за последний год КНР ввела в эксплуатацию более 400 ГВт генерирующих мощностей, а в США речь идёт лишь о нескольких десятках гигаватт. Как отмечают в компании, строить соответствующую энергетическую инфраструктуру трудно, поскольку приходится добиваться «дублирующих» разрешений на местном уровне, уровне штатов и федеральном уровне. Дополнительно необходимы разрешения на линии электропередачи, возможны задержки с подключением объектов к сети. Anthropic уже внесла ряд предложений, в основном связанных с сокращением регулирования и количества разрешений в целом — что вполне соответствует новому плану администрации США. Среди предложений — разрешить арендовать земли Министерства обороны (DoE) и Министерства энергетики США (DoE) для строительства дата-центров. Ещё при прошлом президенте власти поручили им рассмотреть возможность выдачи участков для ЦОД. Работы продолжились и при новой администрации, в апреле объявлено о выборе 16 площадок, но официально ни одного проекта ещё не анонсировали. Правда, попутно администрация отказалась от проектов «зелёной» энергетики и зачем-то уволила специалистов DoE по ЛЭП. Дополнительно Anthropic призывает ускорить пересмотр Закона о национальной политике в области охраны окружающей среды (NEPA), провести реформы, касающиеся сетевых соединений и создать магистрали передачи электроэнергии в интересах страны. Также необходимо ускорить выдачу разрешений на использование геотермальной, газовой и атомной энергетики, нарастить национальное производство важнейших компонентов электросетей и турбин, а также обучить рабочих. В целом предложения походят на прошлогодние рекомендации OpenAI для правительства. Стоит отметить, что крупнейшие обучающие кластеры Anthropic управляются её ключевым инвестором в лице AWS. Облачный гигант в рамках Project Rainier создаёт для Anthropic масштабный вычислительный кластер с чипами Trainium2, размещёнными сразу в нескольких ЦОД. Поскольку OpenAI намерена развернуть часть кампусов Stargate в ОАЭ, руководство Anthropic неохотно признало, что компании тоже придётся пойти на сотрудничество с ближневосточными режимами, иначе компания просто не выдержит конкуренции.

23.07.2025 [17:18], Руслан Авдеев

Anthropic намерена привлечь инвестиции с Ближнего Востока, хотя сама этому не очень радаAnthropic намерена привлечь инвестиции из ОАЭ и Катара, сообщил глава компании Дарио Амодей (Dario Amodei) во внутренней памятке сотрудникам. Он добавил, что бизнес фактически невозможно вести, пытаясь сделать так, чтобы «плохие люди» не могли извлечь выгоду, сообщает Wired. От работы с Ближним Востоком отказаться не удастся. Ранее компания выступала против поставок ИИ-ускорителей в КНР и страны Ближнего Востока. Информация появилась на фоне конкуренции ИИ-бизнесов за привлечение капитала, необходимого для разработки передовых ИИ-моделей и развития ЦОД. Так, в январе 2025 года OpenAI анонсировала проект Stargate, финансирование которого во многом возложено на государственного инвестора MGX из ОАЭ, а четыре месяца спустя компания объявила о намерении построить в Абу-Даби крупный дата-центр. Anthropic дата-центры здесь строить не намерена. Anthropic подчёркивает, что «цепочка поставок» для создания передовых ИИ моделей должна находиться в США для сохранения лидерства Америки, но в компании считают важным делиться преимуществами ИИ с другими регионами мира, если такие действия не противоречат её «Политики использования» продуктов. Более того, в 2024 году Anthropic отказалась от инвестиций из Саудовской Аравии по соображениям «национальной безопасности». При этом криптобиржа FTX, владевшая 8 % Anthropic, обанкротилась, и значительная часть акций компании на сумму около $500 млн досталась ATIC Third International Investment из ОАЭ. В мае 2025 года президент США Дональд Трамп (Donald Trump) посетил ОАЭ и Саудовскую Аравию в рамках поездки, в основном посвящённой инвестициям. Во встрече приняли участие и представители технологической индустрии, включая Илона Маска (Elon Musk), Сэма Альтмана (Sam Altman) и главу NVIDIA Дженсена Хуанга (Jensen Huang). Руководства Anthropic на встрече не было, хотя, по словам Амодея, в этом регионе сосредоточено около $100 млрд инвестиционного капитала. Если компания желает остаться на переднем крае инноваций, доступ к таким деньгам даст серьёзное преимущество, без него сохранять лидерство будет намного сложнее. Компания намерена привлекать целевые, «чисто финансовые» инвестиции из стран Персидского залива, в то же время не давая возможности влиять на неё. Однако Амодей признал, что инвесторы способны добиться «мягкого влияния» благодаря обещанию будущих инвестиций, что усложнит отказ от сотрудничества. Бизнесмен считает, что стоит посмотреть, сколько можно получить без уступок. По его мнению, речь всё равно идёт о миллиардах долларов. Компания выступила против создания ИИ-кластеров на Ближнем Востоке и поставок NVIDIA H20 в КНР, заявляя, что «цепочка поставок» для ИИ — слишком опасный инструмент. В итоге США разрешили поставки H20 Китаю, но приостановили поставки более мощных ускорителей в ОАЭ. Амодей опасается, что без централизованных запретов компании станут получать средства, всё более ввязываясь в сотрудничество с Ближним Востоком. Впрочем, они, по словам Амодея, уже вынуждены вести дела с регионом по отдельности, не сумев сформировать общей позиции. Бизнесмен подчеркнул, что решение о будущем сотрудничестве, как и многие другие решения, имеет свои минусы, но в целом в компании считают его правильным. Осталось дождаться новостей о том, посчитают ли в странах Персидского залива правильным сотрудничество с компанией, придерживающейся подобных взглядов — особенно на фоне того, что желающие получить инвестиции буквально выстраиваются в очередь. |

|