Лента новостей

|

27.06.2024 [13:54], Руслан Авдеев

NTT DATA сформирует первый в Японии REIT для строительства ЦОДЯпонская компания NTT DATA Group, занимающаяся инфраструктурными цифровыми проектами и их сервисным обслуживанием, намерена выйти на рынок ипотечных инвестиционных трастов (REIT), основной акцент в этой деятельности она сделает на строительстве дата-центров. По данным w.media, речь идёт о первом REIT в Японии, специализирующемся именно на ЦОД. Траст, начало работы которого запланировано на март 2026 года, получит до ¥100 млрд (более $623 млн). Компания также передаст свои дата-центры, в первую очередь зарубежные, в распоряжение REIT, сохранив право управления ими. Фактически компания намерена вывести ЦОД из числа своих основных активов. REIT позволит ускорить строительство дата-центров, спрос на которые стремительно растёт благодаря ИИ-системам.

Источник изображения: Sorasak/unsplash.com NTT DATA намерена привлечь средства инвесторов и рассчитывает на IPO новой структуры, которое, как ожидается, принесёт от сотен миллиардов до триллиона йен ($6,2 млрд). К марту 2026 года NTT DATA намерена посредством REIT и других каналов продать активов на более чем $3 млрд. Это поможет получить дополнительные средства на постройку новых ИИ ЦОД. NTT DATA нацелена на экспансию и рассчитывает инвестировать более ¥1,5 трлн иен ($9,35 млрд) в дата-центры в следующие пять лет. REIT может стать спасением для NTT DATA, задолженность которой по состоянию на март 2024 года превышала $13 млрд. REIT-фонды являются решением проблемы высоких начальных затрат на строительство ЦОД, а используемый ими механизм финансирования позволит привлечь инвесторов и высвободить собственные средства для других начинаний. Формат REIT широко распространён за пределами Японии, лидеры индустрии вроде Equinix и Digital Realty Trust вполне успешны (с оговорками) в подобном бизнесе. Также инвесторы довольно охотно расстаются с деньгами из-за относительной стабильности подобных фондов.

27.06.2024 [13:01], Сергей Карасёв

Бывшее российское подразделение Legrand представило бренд DaccordПроизводитель электрооборудования ООО «Легран», ранее входивший во французскую индустриальную группу Legrand, анонсировал новый бренд: теперь продукция будет выпускаться под торговой маркой Daccord (Даккор). Компания намерена развивать деятельность в России, расширяя ассортимент продукции. Legrand Group объявила об уходе с российского рынка в январе 2023 года. Позднее активы французской группы приобрёл один из ведущих производителей электротехники в России ООО «ИЭК ХОЛДИНГ» (IEK GROUP). В сделку вошли производственные площадки АО «Контактор», ООО «ЭБС», филиал ООО «Легран Волга», филиал ООО «Легран Ульяновский». Как теперь сообщается, появление бренда Daccord является «закономерным шагом», направленным на поддержание бизнеса. Производства продолжают деятельность, сохраняя «мировой уровень экспертизы, стандартов качества продукции и принципы работы». Отмечается, что у компании сформировался склад готовых товаров под прежней маркой — как импортированных, так и произведённых в России. Эти изделия планируется реализовать в текущем году. Говорится, что название Daccord (фр. «согласие») является отсылкой к «французским корням, приверженности традициям и высоким стандартам качества». Графический элемент логотипа, выполненного в традиционных для группы цветах, напоминает электроустановочное изделие — выключатель или розетку. «Наша задача — осуществить бесшовный переход от Legrand к Daccord, обеспечить потребителя полным ассортиментом высококачественного электрооборудования. В процессе сделки и после ухода группы Legrand из России производство не останавливалось ни на день, компания сохранила пул ключевых партнёров», — подчёркивает глава ООО «Легран».

27.06.2024 [12:58], Сергей Карасёв

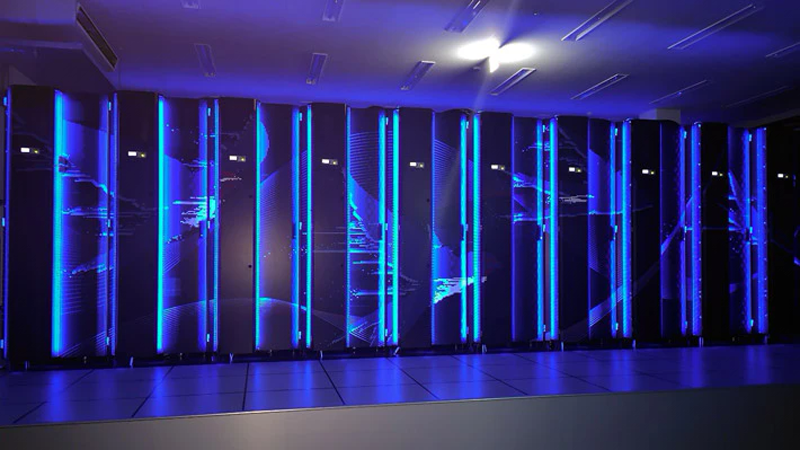

В Японии запущен суперкомпьютер TSUBAME4.0 с ускорителями NVIDIA H100 для ИИ-задачГлобальный научно-информационный вычислительный центр (GSIC) Токийского технологического института (Tokyo Tech) в Японии объявил о вводе в эксплуатацию вычислительного комплекса TSUBAME4.0, созданного компанией HPE. Новый суперкомпьютер будет применяться в том числе для задач ИИ. В основу машины легли 240 узлов HPE Cray XD665. Каждый из них несёт на борту два процессора AMD EPYC Genoa и четыре ускорителя NVIDIA H100 SXM5 (94 Гбайт HBM2e). Объём оперативной памяти DDR5-4800 составляет 768 Гбайт. Задействован интерконнект Infiniband NDR200. Вместимость локального накопителя NVMe SSD — 1,92 Тбайт. В состав НРС-комплекса входит подсистема хранения данных HPE Cray ClusterStor E1000. Сегмент на основе HDD имеет ёмкость 44,2 Пбайт — это в 2,8 раза больше по сравнению с суперкомпьютером предыдущего поколения TSUBAME 3.0. Кроме того, имеется SSD-раздел ёмкостью 327 Тбайт. Пиковая производительность TSUBAME4.0 достигает 66,8 Пфлопс (FP64), что в 5,5 больше по отношению к системе третьего поколения. Быстродействие на операциях половинной точности (FP16) поднялось в 20 раз по сравнению с TSUBAME3.0 — до 952 Пфлопс.

Источник изображения: Tokyo Tech На сегодняшний день TSUBAME4.0 является вторым по производительности суперкомпьютером в Японии после Fugaku. Эта система в нынешнем рейтинге TOP500 занимает четвёртое место с показателем 442 Пфлопс. Лидером в мировом масштабе является американский комплекс Frontier — 1,21 Эфлопс.

27.06.2024 [11:08], Сергей Карасёв

Встраиваемая система AAEON Boxer-8658AI получила модуль NVIDIA Jetson Orin NX и восемь 1GbE-портов с PoEКомпания AAEON представила встраиваемую систему Boxer-8658AI, предназначенную для использования прежде всего в транспортной сфере. Устройство выполнено на аппаратной платформе NVIDIA Jetson Orin NX в соответствии со стандартом MIL-STD-810G, что означает защиту от вибрации, ударов и других воздействий. В зависимости от модификации система комплектуется модулем Orin NX 8GB или Orin NX 16GB с шестью и восемью ядрами Arm Cortex-A78AE соответственно. Отмечается, что производительность Boxer-8658AI на операциях ИИ достигает 100 TOPS. Объём памяти LPDDR5 — 8 и 16 Гбайт. Есть посадочное место для SFF-накопителя с интерфейсом SATA-3 и коннектор M.2 2280 для SSD (NVMe).

Источник изображений: AAEON Устройство заключено в корпус с габаритами 210 × 164,2 × 76 мм (без монтажных планок), а масса составляет около 3 кг. Доступны восемь сетевых портов 1GbE RJ-45 с поддержкой PoE/PSE (802.3af/at, до 120 Вт) и ещё два разъёма 1GbE RJ-45 без РоЕ. Предусмотрены коннектор M.2 2230 E Key для комбинированного адаптера Wi-Fi/Bluetooth и разъём M.2 3052 B Key для модема 4G (плюс два слота для SIM-карт).  В число доступных интерфейсов входят HDMI 2.0, USB 3.2 Gen2 Type-A (×4), DB-9 (CANBus FD), DB-15 (RS232/422/485), линейный аудиовыход, порт Micro-USB и трёхконтактный разъём для подачи питания (9–36 В). Диапазон рабочих температур простирается от -15 до +60 °C. Говорится о совместимости с программными платформами на ядре Linux.

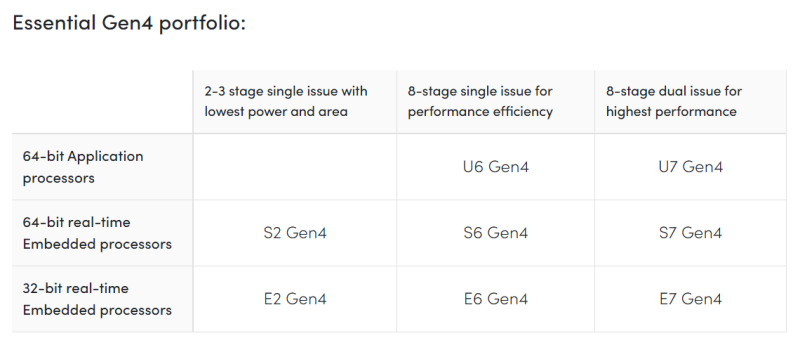

27.06.2024 [11:04], Сергей Карасёв

SiFive анонсировала новое семейство процессоров RISC-V для встраиваемых устройствКомпания SiFive, разработчик процессоров на архитектуре RISC-V, представила решения семейства Essential Gen4 для различных встраиваемых устройств. В серию вошли восемь модификаций базовых ядер RISC-V, которые могут применяться в таком оборудовании, как камеры наблюдения, решения FPGA, накопители на основе флеш-памяти, носимые гаджеты и пр. В частности, анонсированы 64-бит решения U6 и U7 для процессоров приложений, 64-бит ядра реального времени S2, S6 и S7 для встраиваемых систем, а также 32-бит ядра реального времени E2, E6 и E7. Для новинок заявлено снижение энергопотребления в рабочем режиме до 40 % по сравнению с ядрами RISC-V предыдущего поколения. Говорится об улучшенном кеше L2 и расширенном кеше L1. Разработчикам предоставляются гибкие возможности в плане конфигурирования устройств: тип CPU, различные варианты интегрированной памяти, выбор периферийных компонентов и портов. Кроме того, упомянуты развитые средства управления питанием и обеспечения безопасности. Ядра SiFive Essential Gen4 могут использоваться со встраиваемыми ОС Linux и FreeRTOS. Заявлена интеграция с IDE Eclipse. В целом, изделия четвёртого поколения обеспечивают более высокую производительность, повышенную энергоэффективность и более гибкие возможности в плане использования интерфейсов. При этом полные технические характеристики новинок компания не раскрывает. Отмечается также, что на сегодняшний день по всему миру реализовано более 2 млрд чипов с ядрами SiFive RISC-V для встраиваемых устройств. Данный рынок продолжает активно развиваться, что говорит о росте популярности открытой архитектуры RISC-V.

27.06.2024 [09:30], Илья Коваль

Ловкий патч и никакого мошенничества: эмуляция NUMA повышает производительность Raspberry Pi 5 на 18 %Портал Phoronix обратил внимание на необычный патч, заметно повышающий производительность Raspberry Pi 5. Инженеры Igalia в результате экспериментов с эмуляцией NUMA на UMA-системах с чипами ARM64 (AArch64) добились повышения эффективности использования памяти. Так, простой патч для ядра Linux позволил улучшить результаты в Geekbench на 6 % в однопоточном режиме и на целых 18 % — в многопоточном. Авторы патча пишут, что разделение RAM на несколько независимых блоков с последующим попеременными доступом (interleaving) позволяет контроллеру в Broadcom BCM2712 более полно использовать параллелизм на уровне физической организации чипов памяти (parallelism in physical memory chip organisation). Почему так происходит, авторы не уточняют, но, вероятно, это связано с особенностями организации кеша в SoC. 16-нм SoC BCM2712 включает четыре ядра Cortex-A76 (2,4 ГГц), каждому из которых полагается по 64 Кбайт кеша для инструкций и данных и 512 Кбайт L2-кеша. Объём общего L3-кеша составляет 2 Мбайт. Встроенный 32-бит контроллер памяти предлагает LPDRR4x-интерфейс, теоретическая пропускная способность которого достигает 17 Гбайт/с. Важно отметить, что этот чип не создавался эксклюзивно для Raspberry Pi — он был выбран среди актуальных массовых решений Broadcom из-за удачного сочетания цены, производительности и доступности. Патч добавляет в Kconfig новую опцию, а для активации эмуляции NUMA (Non-uniform memory access) нужно передать соответствующий параметр при загрузке ядра. Дальнейшая работы осуществляется с помощью стандартной утилиты numactl.

26.06.2024 [23:18], Андрей Крупин

VK Cloud интегрировала Dev Platform с инструментами безопасной разработки

positive technologies

software

swordfish security

vk

vk cloud

информационная безопасность

облако

разработка

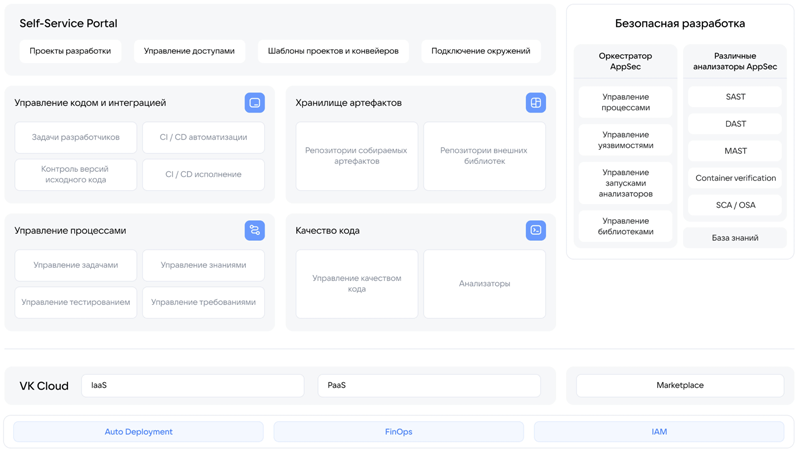

Облачная платформа VK Cloud сообщила об интеграции среды Dev Platform с инструментами безопасной разработки Positive Technologies и Swordfish Security. Dev Platform предоставляет набор предустановленных, прединтегрированных и преднастроенных инструментов, с помощью которых можно создать единую среду разработки, сделать прозрачным и эффективным весь жизненный цикл продукта. Архитектуру решения можно гибко масштабировать, добавляя к базовым компонентам платформы внешние инструменты через систему плагинов. Бизнес может развернуть Dev Platform в своей IT-инфраструктуре, в том числе в рамках Private Cloud, или в публичном облаке VK Cloud. Dev Platform совместима с инструментами для поиска уязвимостей в приложениях PT BlackBox и PT Application Inspector, а также с продуктом для защиты контейнерных сред PT Container Security, который выявляет и предотвращает атаки на системы компании, запущенные в контейнерах.

Архитектура Dev Platform (источник изображения: cloud.vk.com/dev-platform) Кроме того, платформа интегрирована с решениями Swordfish Security — AppSec.Hub класса ASPM (Application Security Posture Management) и AppSec.Track класса OSA (Open Source Analysis) и SCA (Software Composition Analysis). AppSec.Hub — инструмент оркестрации сканеров уязвимостей, фильтрации ложных срабатываний на базе ИИ-технологий и отображения метрик качества построения процесса безопасной разработки. Инструмент AppSec.Track, позволяет не допустить попадания небезопасных внешних компонентов в контур разработки на самом начальном этапе и проверяет наличие ИБ-проблем в них на этапе сборки ПО.

26.06.2024 [21:10], Владимир Мироненко

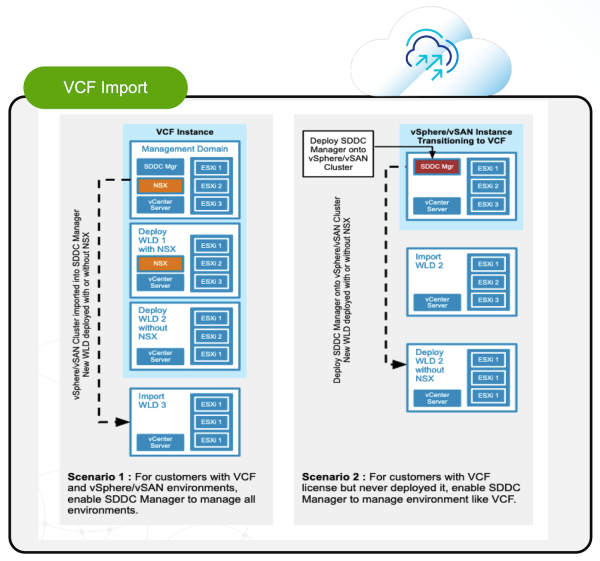

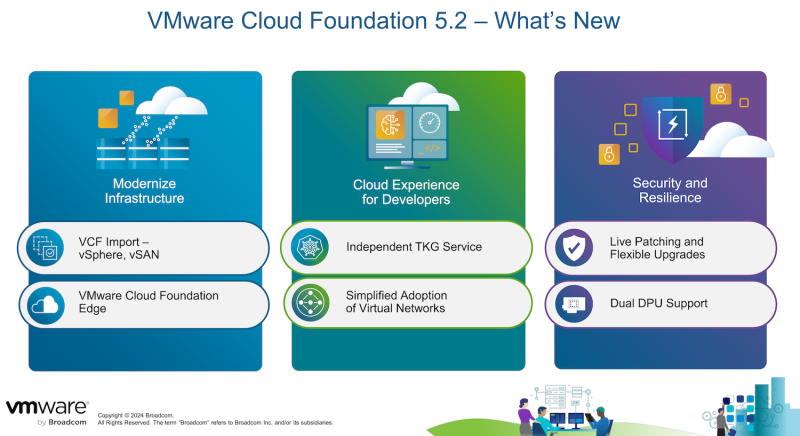

Новая страница: Broadcom представила VMware Cloud Foundation 5.2Компания Broadcom объявила о выходе обновления облачной платформы VMware Cloud Foundation (VCF) 5.2, которое обеспечит более быструю модернизацию инфраструктуры, рост продуктивности разработчиков, а также повышение киберустойчивости и безопасности, сохранив при этом более низкую общую стоимость владения. «Мы изменили нашу стратегию, чтобы сделать VCF лучшей доступной платформой частного облака <…>, где клиенты могут развернуть сеть, хранилище, вычисления, автоматизацию и управление в составе единой платформы там, где они хотят», — цитирует SiliconAngle Прашанта Шеноя (Prashanth Shenoy), вице-президента по маркетингу облачных платформ, инфраструктуры и решений VMware, дочерней компании Broadcom.

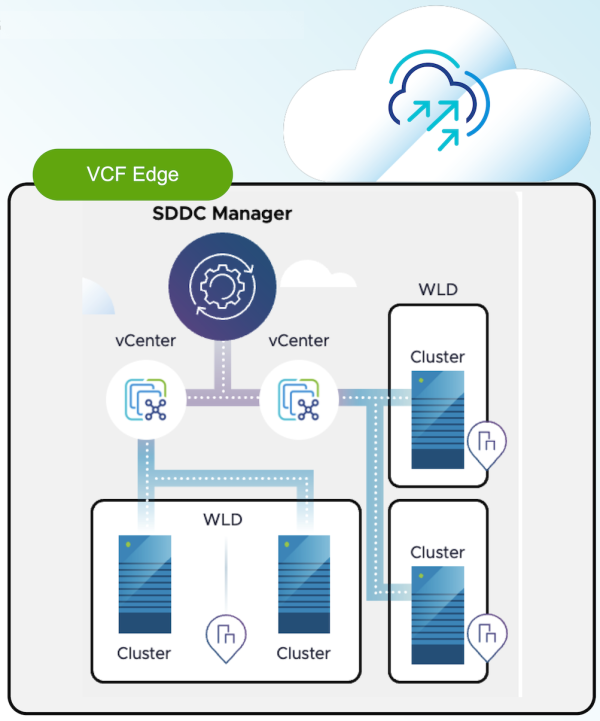

Источник изображений: StorageReview.com Сообщения о повышении цен на продукты VMware он назвал далёкими от действительности. «Нет ничего более далекого от правды. Мы вдвое снизили цену на VCF и перешли от модели бессрочной лицензии к модели на основе подписки, которая является стандартом, который каждый поставщик инфраструктуры и ПО применяет в последние годы. VMware была одной из последних компаний, которая продолжала использовать бессрочное лицензирование», — сообщил Шеной. В обновлении стала доступна функция VCF Import, которая позволяет интегрировать существующие среды vSphere и vSAN в VMware Cloud Foundation. Эта функция обеспечивает централизацию управления и оптимизирует ресурсы без необходимости полной перестройки среды клиента, что позволит повысить эффективность, сократить затраты и ускорить окупаемость инвестиций, говорит компания. Также VCF теперь включает полную поддержку vSAN Max и vSAN ESA, предоставляя клиентам дезагрегированное хранилище петабайтного масштаба и доступность «активный-активный». В свою очередь, версия VCF Edge предоставляет оптимизированную конфигурацию VMware Cloud Foundation для сценариев использования на периферии с согласованным управлением от ЦОД до периферии. VCF 5.2 также включает шаблоны быстрого развёртывания приложений, упрощённую сетевую интеграцию и расширенные отчёты о производительности. Сообщается, что VCF получил усовершенствованную сетевую подсистему, что упрощает развёртывание и настройку по мере того, как пользователи переходят от традиционных архитектур на основе VLAN к расширенной виртуализации NSX. А VMware Avi Load Balancer в составе VCF обеспечивает упрощённую настройку балансировки. Кроме того, появилась возможность использовать два DPU в vSphere Distributed Services Engine, что повышает надёжность и производительность. Наконец, интеграция VMware Avi с SDDC Manager упрощает управление жизненным циклом Avi. Обновления VCF, а также связанные с ними надстройки, такие как VMware Live Recovery и VMware vDefend, повышают целостность и доступность облака, улучшают производительность сети и защиту от вредоносных программ и программ-вымогателей. Так, ESXi Live Patching позволяет на лету устанавливать апдейты, сводя к минимуму возможные простои. Также можно обновлять отдельные компоненты VCF. Что касается защиты, то vSAN Data Protection позволяет администраторам легче и быстрее восстанавливать виртуальные машины после случайного удаления и запуска. VMware vDefend защищает от горизонтального перемещения взломщиков в системе, упрощает масштабирование распределённых межсетевых экранов и предлагает интеграцию с SIEM-системами. Среди прочих обновлений отмечается появление SSO для всех компонентов VCF, упрощённый доступк к IaaS-функциям для разработчиков, упрощённые управление и диагностика для всего облака VCF, включая глобальную инвентаризацию, централизованное управление сертификатами и унифицированное лицензирование. Наконец, упомянуто, что служба Tanzu Kubernetes Grid (TKG) стала независимой.

26.06.2024 [16:49], Андрей Крупин

Компания «Пассворк» получила лицензии ФСТЭК России на деятельность в сфере защиты информацииКомпания «Пассворк», занимающаяся разработкой и развитием одноимённого менеджера паролей для бизнеса, сообщила о получении лицензий Федеральной службы по техническому и экспортному контролю на деятельность по разработке средств защиты конфиденциальной информации, а также на деятельность по её технической защите. Выданные ФСТЭК России лицензии подтверждают соответствие компании предъявляемым ведомством требованиям в области IT-безопасности. Согласно полученным документам, специалисты «Пассворка» вправе участвовать в разработке и доработке ПО и технических средств защиты информации, а также оказывать услуги по развёртыванию и настройке защитных решений.

«Пассворк» повышает безопасность при работе с корпоративными паролями «Это важное событие для российского IT-сектора, так как теперь корпорации и госкомпании, для которых наличие упомянутых лицензий является обязательным условием, смогут обеспечивать сохранность своих данных, а также наладить удобный процесс работы с паролями, пользуясь отечественным решением», — говорится в заявлении компании-разработчика. «Пассворк» ведёт деятельность на российском IT-рынке с 2014 года. Разрабатываемый компанией продукт упрощает совместную работу с корпоративными паролями и обеспечивает их хранение на сервере организации в зашифрованном виде. Поддерживается интеграция с Active Directory/LDAP, авторизация с помощью SAML SSO, а также аудит безопасности паролей. Решение зарегистрировано в реестре отечественного софта и может представлять интерес для организаций, реализующих проекты в сфере импортозамещения ПО. Открытый для аудита исходный код менеджера паролей позволяет убедиться в отсутствии уязвимостей и скрытых функций.

26.06.2024 [16:39], Руслан Авдеев

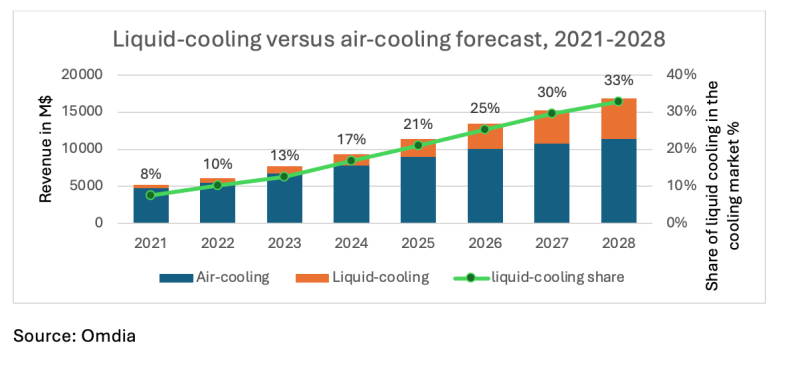

К 2028 году СЖО займут треть рынка систем охлаждения ЦОДСогласно новому исследованию Omdia, рынок систем охлаждения для ЦОД уже достиг $7,67 млрд — результаты превзошли предыдущие прогнозы экспертов. Среднегодовой темп прироста ожидается на уровне 18,4 % до 2028 года. Основным драйвером стало развитие ИИ-платформ и рост инфраструктуры с высокой энергетической плотностью. Ожидается, что объём рынка достигнет $16,87 млрд к 2028 году, а доля СЖО вырастет до 33 %. Поскольку энергоёмкие ИИ-системы получили повсеместное распространение, спрос на жидкостное охлаждение серьёзно вырос. В числе главных трендов — быстрое распространение теплообменников задних дверей (RDHx) в комбинации с однофазным прямым жидкостным охлаждением чипов. Рост в этом сегменте составил впечатляющие 65 % год к году. Нередко в таких системах применяются технологии передачи тепла в системы отопления зданий или подогрева различных объектов и вроде бассейнов. Комбинация воздушного и жидкостного охлаждения позволяет создавать эффективные и сбалансированные системы терморегулирования. Как заявляют в Omdia, в 2023 году произошла консолидация рынка, в результате основные прибыли получают считанные компании. Впрочем, Omdia расширила свой обзор, который теперь включает 49 вендоров вместо 40. Аналитики добавили китайских OEM-производителей и поставщиков компонентов прямого жидкостного охлаждения. Лидерами рынка остались Vertiv, Johnson Controls и Stulz, причём Veritiv увеличила долю на 6 % благодаря устойчивому росту спроса в Северной Америке и партнёрству с облачными операторами.

Источник изображения: Omdia Рост рынка систем охлаждения для ЦОД ранее ограничивался преимущественно недостатком производственных мощностей, в частности, нехваткой компонентов вроде блоков распределения охлаждения (CDU), на спрос производители давно не жалуются. Поставщики всеми силами стремились удовлетворить спрос, но взрывной рост потребностей операторов ЦОД всё равно создал дефицит на определённых участках цепочек поставок. К счастью, в 2024 году прогнозируется улучшение ситуации.

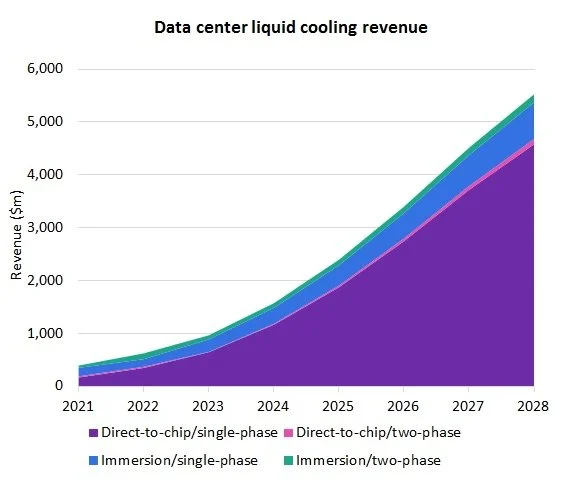

Источник изображения: Omdia Также Omdia отмечает рост доли систем жидкостного охлаждения. Этот рынок активно развивается в Северной Америке и Китае, в дело вступают всё новые вендоры, а прежние участники рейтингов расширяют свою деятельность. На рынке СЖО, объём которого близок к $1 млрд, лидером остаётся CoolIT, предлагающее прямое жидкостное охлаждение. Второе место занимает Sugon, преимущественно занимающаяся системами иммерсионного охлаждения, а замыкает тройку Lenovo, комплектующая некоторые свои системы фирменной СЖО. Системы терморегулирования неизбежно развиваются под влиянием ИИ-решений и из-за росту требований к экоустойчивости серверного оборудования и ЦОД в целом. Несмотря на прогнозы роста, будет наблюдаться нехватка СЖО и недостаток экобезопасных технологий. Ожидается, что в будущем внедрение оптимизированных с помощью ИИ систем охлаждения, договоры о стратегическом партнёрстве между вендорами, а также рост энергоэффективных и экоустойчивых решений определят развитие индустрии. В результате технологии охлаждения будут соответствовать потребностям в охране окружающей среды. |

|