Материалы по тегу: ai

|

15.05.2026 [08:38], Сергей Карасёв

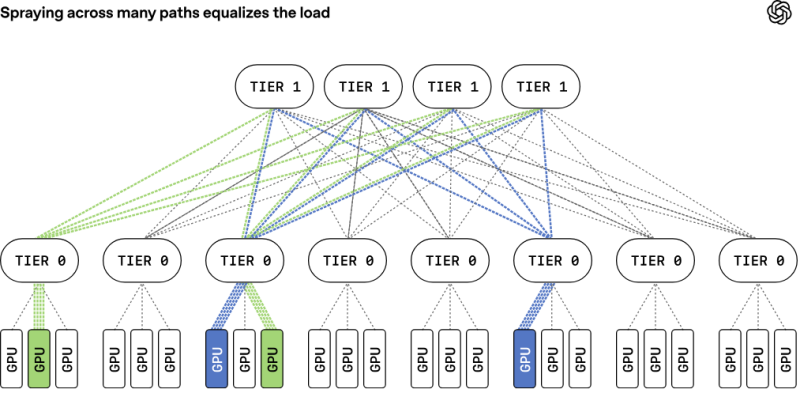

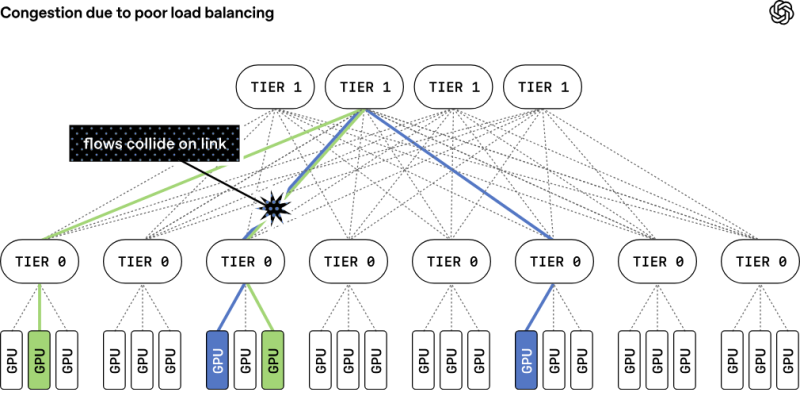

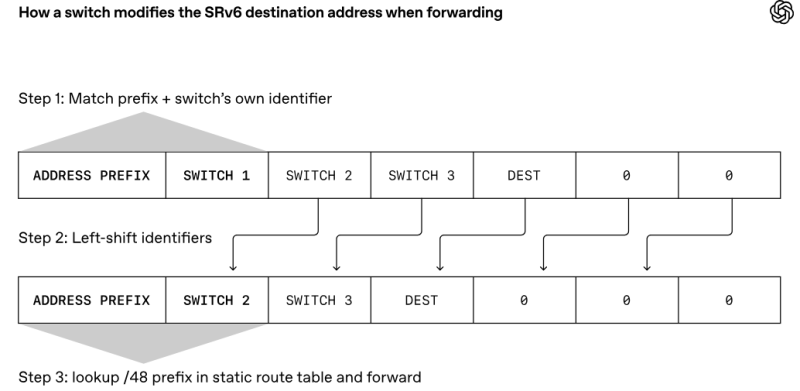

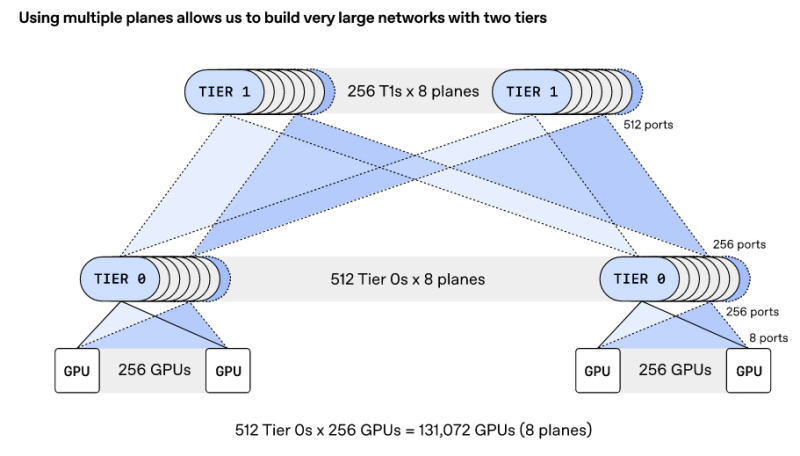

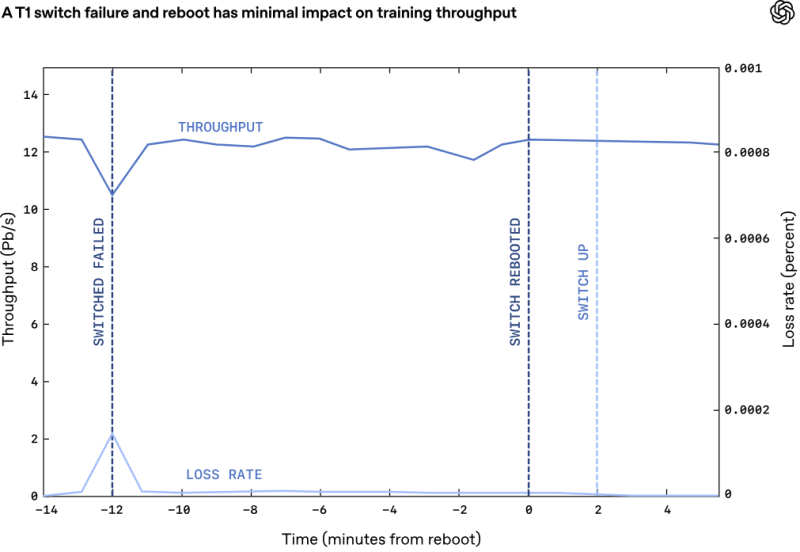

Сетевой протокол Multipath Reliable Connection (MRC) улучшит производительность и надёжность ИИ-кластеровOpenAI в партнёрстве с AMD, Broadcom, Intel, Microsoft и NVIDIA анонсировала технологию Multipath Reliable Connection (MRC) — сетевой протокол, призванный повысить производительность и отказоустойчивость масштабных GPU-кластеров, ориентированных на ресурсоёмкие задачи ИИ. MRC уже используется во всех крупных кластерах OpenAI c NVIDIA GB200, в том числе в первом ЦОД Stargate, а также в ЦОД Microsoft по проекту Fairwater. Отмечается, что при обучении больших языковых моделей (LLM) каждый этап предполагает огромное количество пересылок данных между узлами в кластере. При этом единственная задержка при подобных транзакциях может повлиять на весь процесс, потенциально провоцируя простои тысяч ИИ-ускорителей. Такие прерывания приводят к снижению эффективности использования имеющихся вычислительных мощностей и к увеличению временных затрат. Наиболее распространёнными причинами задержек и нестабильности при передаче данных являются перегрузка сети, сбои в работе каналов связи и коммутационных устройств. Причём по мере увеличения масштабов кластеров проблемы усугубляются: неполадки возникают всё чаще, а их устранение становится более затруднительным. Протокол MRC, как утверждается, устраняет ряд ключевых недостатков сетей Ethernet применительно к инфраструктурам ИИ. В частности, вводятся такие механизмы, как адаптивная многопутевая передача данных, многоканальные перекрёстные Ethernet-фабрики, «распыление» пакетов, быстрое восстановление после сбоев и пр. MRC коренным образом меняет способ передачи трафика по сети. Традиционные платформы RoCE обычно привязывают поток данных к одному сетевому пути, что может снижать эффективность при возникновении неполадок. MRC же распределяет пакеты из одной серии одновременно по сотням путей и нескольким физическим сетевым каналам. В пакетах содержатся сведения об их конечном назначении, что позволяет ускорителям размещать данные в нужной последовательности, даже если пакеты поступают не по порядку. MRC хранит информацию о состоянии множества используемых путей: если обнаруживается перегрузка какого-либо из них, выбирается альтернативный маршрут, что позволяет оперативно перераспределить нагрузку по всей сети. Ещё одной важной особенностью MRC является многоуровневая архитектура, которая изменяет саму физическую концепцию построения интерконнекта. Так, например, сетевой интерфейс 800GbE может быть разделён на 100GbE-каналы, связанные с восемью различными коммутаторами отдельными каналами. В результате можно построить восемь отдельных параллельных сетей. Такой подход оказывает значительное влияние на структуру кластера. В частности, коммутатор c 64 портами 800GbE можно использовать в конфигурации на 512 × 100GbE. И это позволяет построить сеть, объединяющую около 131 тыс. GPU, используя всего два уровня коммутации, против традиционных трёх- или четырёхуровневых топологий. В протоколе MRC также используется новый способ обработки перегрузок и потери пакетов в сетях Ethernet. Обычно применяется технология PFC (Priority Flow Control) — управление потоками на основе приоритетов: этот механизм предполагает приостановку передачи данных для конкретных классов трафика, а не для всего порта целиком. В случае MRC задействован иной подход, основанный на выборочных подтверждениях, явных запросах на повторную передачу и обрезке пакетов. Так, когда коммутатор сталкивается с перегрузкой, он может отрезать полезную нагрузку и переслать в пункт назначения только заголовок пакета, что позволяет получателю быстро идентифицировать отсутствующие данные и запросить повторную передачу. Утверждается, что это даёт возможность восстанавливаться после сбоев и перегрузок в течение микросекунд, что на порядки быстрее по сравнению с обычными архитектурами. С внедрением MRC сокращается необходимость в динамической маршрутизации. Если пакеты теряются на каком-либо пути, система на основе MRC просто перестаёт использовать этот путь. Вместо динамической маршрутизации применяется так называемая сегментная маршрутизация IPv6 (IPv6 Segment Routing, SRv6), которая позволяет отправителю напрямую задать путь прохождения пакета, прописав последовательность идентификаторов коммутаторов. При пересылке данных коммутатор проверяет наличие собственного идентификатора. Если он присутствует, он удаляет из пакета свой идентификатор и ищет следующий за ним идентификатор в статической таблице маршрутизации, которая указывает, куда необходимо отправить пакет данных. В отличие от динамической маршрутизации, такая статическая таблица формируется при первой настройке коммутатора и в дальнейшем не изменяется. MRC использует SRv6 для передачи пакетов по всем физическим каналам и уровням, а также по множеству путей в каждом из них. Если какой-либо путь становится недоступен, система игнорирует его. При этом коммутаторам не нужно пересчитывать маршруты или выполнять другие действия, кроме как строго следовать статическим маршрутам, заложенным в таблице. Протокол MRC выпущен в рамках проекта OCP. В целом, как отмечается, MRC обеспечивает три ключевых преимущества перед стандартными Ethernet-сетями для кластеров ИИ. Во-первых, MRC позволяет создавать многоуровневые высокоскоростные инфраструктуры для платформ с более чем 131 072 конечных точек, используя всего два уровня коммутаторов. Во-вторых, адаптивное распределение пакетов обеспечивает эффективную балансировку нагрузки, благодаря чему практически отсутствуют перегрузки в ядре сети. В-третьих, применение SRv6 обеспечивает быстрый обход сбоев и отправку пакетов только по работающим путям. Компания Broadcom заявила, что её сетевые адаптеры Thor Ultra, а также коммутаторы Tomahawk 5 и Tomahawk 6 изначально поддерживают функциональность MRC. В частности, Thor Ultra позволяет использовать 2, 4 или 8 параллельных сетей на одном порту и распределять трафик одновременно по 128 каналам. При этом Tomahawk 5 обеспечивает коммутационную способность до 51,2 Тбит/с, а Tomahawk 6 — до 102,4 Тбит/с. В свою очередь, NVIDIA отмечает, что протокол MRC, будучи расширением RoCE, совместим с решениями Spectrum-X Ethernet. OpenAI уже использовала MRC при обучении нескольких ИИ-моделей, задействовав коммутаторы Broadcom и NVIDIA. Конкуренцию MRC составляет схожий во многих аспектах Ultra Ethernet.

12.05.2026 [13:24], Сергей Карасёв

Новое бизнес-подразделение OpenAI поможет клиентам во внедрении ИИГруппа OpenAI Group PBC сформировала бизнес-подразделение OpenAI Deployment Company, которое будет оказывать сторонним заказчикам услуги по внедрению ИИ-моделей и их оптимизации под конкретные задачи. Инвестиции в OpenAI Deployment Company на первом этапе составят $4 млрд при оценке этой структуры в $14 млрд. Средства поступят от самой OpenAI и более чем десяти других инвесторов, крупнейшим из которых является управляющая компания TPG. В раунде также приняли участие SoftBank Group, Bain Capital, Brookfield, Capgemini SE и McKinsey & Co. Контроль над формируемой организацией сохранит за собой OpenAI. Компания обязалась обеспечить минимальную доходность в размере 17,5% для внешних инвесторов OpenAI Deployment Company. Новая структура поможет крупным предприятиям во внедрении ИИ-моделей OpenAI. Для этого на объекты заказчиков будут направляться инженеры по развёртыванию (Forward Deployed Engineer, FDE) — специалисты, обладающие навыками разработки ПО и взаимодействия с клиентами. Такие инженеры выступают в качестве связующего звена между поставщиком продуктов и заказчиком. Внедрение ИИ-моделей на стороне клиента OpenAI намерена осуществлять в рамках многоэтапного процесса. Сначала специалисты оценят возможные варианты применения ИИ на площадке заказчика и разработают наиболее эффективные сценарии использования. Затем будет осуществлено пилотное развёртывание для «небольшого количества приоритетных рабочих процессов»: это поможет продемонстрировать отдачу от применения продуктов OpenAI. На финальном этапе произойдёт полноценное внедрение. Кроме того, по запросу клиента специалисты OpenAI Deployment Company могут осуществить сопутствующие работы, например, интегрировать ИИ-модель с существующими приложениями в IT-инфраструктуре заказчика. Для развития бизнеса OpenAI Deployment Company приобрела лондонскую фирму Tomoro AI Ltd., предоставляющую технологические услуги. В результате этой сделки, финансовые условия которой не раскрываются, OpenAI получила около 150 инженеров FDE и других технических специалистов.

07.05.2026 [12:21], Руслан Авдеев

Anthropic достанутся все мощности ИИ-кластера xAI Colossus 1Anthropic рассчитывает использовать все вычислительные мощности ИИ-кластера Colossus 1 компании xAI в рамках сделки с её новым владельцем — компанией SpaceX, сообщает Datacenter Dynamics. Anthropic в течение месяца получит доступ к более 300 МВт мощностей ЦОД, обеспечивающих работу более 220 тыс. ИИ-ускорителей NVIDIA. Новый ЦОД значительно расширит возможности пользователей Claude Pro и Claude Max. Кроме того, к Anthropic присоединится Росс Нордин (Ross Nordeen), один из сооснователей xAI, который ранее покинул стартап. Дополнительно Anthropic «выразила заинтересованность» в партнёрском соглашении со SpaceX для строительства орбитальных ЦОД на несколько гигаватт. SpaceX ещё в январе 2026 года подала заявку в Федеральную комиссию по связи США (FCC), чтобы получить разрешение на развёртывание группировки космических ЦОД из миллиона спутников с ИИ-модулями. Проект по-прежнему не одобрен, а AWS даже препятствует его реализации. В апреле xAI объявила, что мощности простаивающего Colossus будет использовать компания Cursor, занимающаяся написанием кода с применением ИИ. Последняя согласилась на возможное поглощение со стороны SpaceX с оценкой в $60 млрд. По существующей договорённости, если SpaceX не купит этот бизнес, она должна будет выплатить Cursor $10 млрд. В рамках соглашения с Anthropic ей будет отдано чуть менее половины общего парка ИИ-ускорителей, сегодня насчитывающего порядка 500 тыс. ускорителей. Сколько именно чипов будет использовать Cursor, неизвестно. По словам Илона Маска (Elon Musk), стоящего за xAI и SpaceX, он согласился сдать в аренду Colossus 1, поскольку обучение LLM xAI переведено на Colossus 2. В дата-центре Colossus 1 используются NVIDIA H100, H200 и GB200. Активисты критикуют кампус ЦОД за использование газовых турбин. ИИ-суперкомпьютер Colossus 1 заработал в Мемфисе в 2024 году, в ЦОД на площадке бывшего завода Electrolux. В марте 2025 года приобретён участок под строительство Colossus 2, дата-центр ввели в эксплуатацию в январе 2026 года. Сейчас ведётся работа над третьим кампусом в Саутхейвене (Southaven), дополнительно будет инвестировано ещё $659 млн в строительство ещё одного здания.

06.05.2026 [17:08], Сергей Карасёв

Президент OpenAI оказался владельцем долей в Cerebras и CoreWeave, у которых миллиардные сделки с самой OpenAIСоучредитель и президент OpenAI Грег Брокман (Greg Brockman), по сообщению ресурса Datacenter Dynamics, владеет долями в ряде технологических компаний: Cerebras, CoreWeave, Stripe и Helion. С двумя из них OpenAI имеет контракты на десятки миллиардов долларов. Об этом стало известно в ходе судебного разбирательства, инициированного миллиардером Илоном Маском (Elon Musk). В декабре 2015 года Брокман вместе с Маском, Сэмом Альтманом (Sam Altman) и др. основали некоммерческую организацию OpenAI с целью разработки безопасного и самодостаточного ИИ. После того, как Маск в 2019 году покинул компанию, Альтман стал генеральным директором, и OpenAI сформировала дочернюю коммерческую структуру для привлечения средств. В тот момент Брокман получил крупную долю в OpenAI, оцениваемую сейчас примерно в $30 млрд. В своём иске Маск пытается получить от OpenAI крупную материальную компенсацию, добиться отстранения Альтмана и Брокмана от управления компанией и трансформировать её обратно исключительно в некоммерческую организацию. Примечательно, что Брокман в момент основания OpenAI пообещал пожертвовать организации $100 тыс., но так этого и не сделал.

Источник изображения: персональный сайт Брокмана В том же 2019 году, как стало известно, Брокман начал покупать акции CoreWeave: его доля по состоянию на апрель 2026 года оценивается в $817,37 тыс. Между тем сама OpenAI заключила ряд соглашений по аренде ИИ-инфраструктуры у CoreWeave, обязавшись потратить на услуги этой компании в общей сложности $22,4 млрд. В ходе более раннего судебного разбирательства, инициированного Маском в 2024 году, выяснилось, что OpenAI рассматривала возможность приобретения компании Cerebras — разработчика ИИ-ускорителей. С этим стартапом OpenAI недавно заключила соглашение на приобретение оборудования стоимостью более $20 млрд. Выяснилось, что по состоянию на конец 2025 года стоимость доли Брокмана в Cerebras составляет $2,82 млн. В 2023 году Брокман также начал скупать акции Helion Energy, которая занимается разработкой термоядерных реакторов: на конец прошлого года его доля в деньгах составляла $433,58 тыс. Любопытно, что Альтман инвестирует в эту компанию с 2015-го и до нынешнего года входил в совет её директоров. При этом OpenAI намерена закупать термоядерную энергию у Helion в «огромных объёмах». Что касается компании Stripe (создаёт решения для приёма и обработки электронных платежей), то в ней Брокман получил долю ещё до начала работы в OpenAI. В Stripe он трудился на позиции технического директора, а его доля в этой фирме составляет в акциях $471,26 млн. Stripe обрабатывает часть платежей OpenAI. В 2023 году было объявлено о трёхлетнем контракте стоимостью $60 млн.

29.04.2026 [21:36], Руслан Авдеев

ИИ ЦОД Project Jupiter для OpenAI запитают от топливных элементов Bloom Energy мощностью 2,45 ГВт

bloom energy

hardware

openai

oracle

stargate

сша

топливные элементы

цод

экология

электропитание

энергетика

Масштабный кампус ИИ ЦОД Project Jupiter, строящийся в округе Донья-Ана (Doña Ana, Нью-Мексико) компанией BorderPlex Digital Assets для Oracle в интересах проекта OpenAI Stargate, будет запитан от топливных элементов Bloom Energy мощностью 2,45 ГВт, сообщает Converge! Digest. Оценочная стоимость Project Jupiter составляет $165 млрд, совокупная мощность — до 2,45 ГВт. Кампус из четырёх ЦОД займёт территорию около 567 га, где также разместятся электрическая микросеть, энергохранилище и установка по опреснению воды. Генерация «за счётчиком» обеспечит кампус автономное питание. Основой стало расширенное соглашение между Oracle и Bloom, предполагающее развёртывание топливных элементов в США общей мощностью 2,8 ГВт. Oracle объявила, что решения Bloom позволяют сократить как выбросы, так и водопотребление, в то же время обеспечивая надёжную подачу электричества для ресурсоёмких ИИ-задач. Также компания подтвердила, что возьмёт расходы на электроснабжение проекта на себя, а работа нового кампуса не скажется на местных тарифах на электричество. Предполагается создание около 1,5 тыс. постоянных рабочих мест. А инвестиции в местное сообщество должны составить $416,9 млн. Oracle сообщает, что для охлаждения будет использоваться «непитьевая» вода — в системе замкнутого цикла с минимальной необходимостью пополнения, единовременная заправка системы потребует порядка 3,6 тыс. м3, а ежедневно потребуется около 75 м3 и до 227 м3 на пике. Для топливных элементов в норме воды не требуется. На системы водоснабжения и сопутствующую инфраструктуру потратят $50 млн. Проект более не предусматривает использования газовых турбин или резервных дизельных генераторов. Основное внимание уделяется обретению независимости от магистральных электросетей, снижению водопотребления и снижению выбросов. Впрочем, выбор элементов Bloom Energy может быть объяснён банальной нехваткой газовых турбин. Project Jupiter — ещё одна инициатива, предусматривающая отказ от использования централизованных электросетей для энергоснабжения ИИ-инфраструктуры, особенно для регионов, где электроэнергия в дефиците. Газовые топливные элементы обеспечивают быстрое внедрение, но ключевыми факторами остаются экономическая целесообразность в долгосрочной перспективе и вопросы поставок «голубого» топлива. Летом 2025 года аналитики Bloom Energy утверждали, что к 2030 году более четверти ЦОД в США обзаведутся собственными электростанциями.

28.04.2026 [17:24], Руслан Авдеев

С миру по миллиарду: Oracle всё-таки насобирала $16 млрд на ИИ ЦОД OpenAI в МичиганеКомпания Oracle завершила сделку по привлечению $16 млрд для финансирования строительства в Мичигане дата-центра The Barn в рамках проекта OpenAI Stargate Мичигане. После нескольких месяцев переговоров компания обеспечила получение заёмных средств и акционерного капитала для продолжения работ, сообщает Datacenter Dynamics. Для финансирования проекта Bank of America продал связанные с проектом облигации на сумму $14 млрд. Из них ценные бумаги на сумму $10 млрд привлекла компания Pimco, остальную часть инвестиций обеспечили другие участники рынка. Срок погашения ценных бумаг — 2045 год, до этого времени владельцы облигаций станут получать фиксированные выплаты из расчёта 7,5 % годовых от номинальной стоимости. Blackstone, по имеющимся данным, внесла $2 млрд. Проект в Салине (Saline) утверждён в октябре 2025 года. Ожидается, что площадка обеспечит 1 ГВт мощностей и обойдётся приблизительно в $10 млрд. За строительство отвечает Related Digital. STE Energy согласилась обеспечить проект 100 % необходимой электроэнергии, в т.ч. речь идёт о реализации вспомогательного проекта аккумуляторного энергохранилища, финансируемого Oracle. По словам представителя Oracle Cloud Infrastructure (OCI), вместе с партнёрами компания создаёт «высококачественные» рабочие места, инвестирует в сообщества, в которых работает и способствует долгосрочному экономическому росту на местах.

Источник изображения: Brad Switzer/unsplash.com Ранее сообщалось, что уже началось «вертикальное» строительство — возведение стен, кровли и др. после укладки фундамента и прокладки коммуникаций. Утверждалось, что все работы выполняются в срок и в соответствии с планом. Впрочем, после анонса OpenAI, Oracle и Related Digital кампуса The Barn в октябре 2025 года дела пошли не слишком гладко. Так, инвестор Blue Owl Capital отказался выделять средства, а через некоторое время TD Cowen констатировала, что банки расхотели давать Oracle деньги, и предложила последней поправить финансовое положение путём увольнения 20–30 тыс. сотрудников. Pimco является американской инвестиционной компанией, принадлежащей Allianz Group и активно ведущей дела в Европе. В 2023 году компания запустила новую европейскую платформу ЦОД Apto. В своё время Pimco объединилась с Blue Owl, чтобы помочь Meta✴ получать финансирование для своего ЦОД Hyperion.

28.04.2026 [01:11], Владимир Мироненко

Microsoft и OpenAI пересмотрели «брачный договор»: эксклюзивных прав больше нет, но и выручкой делиться не надоMicrosoft и OpenAI объявили о пересмотре условий партнёрского соглашения, что некоторые эксперты рассматривают как победу разработчика ChatGPT, хотя многие считают, обе стороны остаются в выигрыше. Как отметили обе компании, обновлённое соглашение призвано упростить партнерство и способы совместной работы, обеспечивая большую предсказуемость. Согласно обновлённому соглашению, у Microsoft по-прежнему будет лицензия на интеллектуальную собственность OpenAI для моделей и продуктов, срок владения которой ограничен 2032 годом, однако теперь она будет неисключительной. До этого у Microsoft были эксклюзивные права на интеллектуальную собственность OpenAI до тех пор, пока та не создаст «общий ИИ» (AGI). Microsoft по-прежнему является «основным облачным партнёром» OpenAI, т.е. основная часть облачных ресурсов OpenAI, вероятно, будет обслуживаться Azure в течение шести лет, охватываемых этим соглашением, даже несмотря на то, что OpenAI спешит построить собственные ЦОД в сотрудничестве с другими партнёрами. В октябре OpenAI обязалась приобрести облачные ресурсы Microsoft на сумму ещё $250 млрд. Фраза о том, Microsoft по-прежнему является «основным облачным партнёром» — сигнал акционерам Microsoft о том, что OpenAI по-прежнему будет крупным клиентом Azure, отметил ресурс TechCrunch. В обновлённом соглашении указано, что «продукты OpenAI будут в первую очередь поставляться Azure, если только Microsoft не сможет и не решит отказаться от поддержки». Судя по всему, Microsoft теперь будет в числе поставщиков, предлагающих новейшие продукты OpenAI. Но что более важно, «теперь OpenAI может предоставлять все свои продукты клиентам у любого облачного провайдера». Это означает, что Microsoft теперь не сможет подать в суд на OpenAI из-за того, что та в рамках инвестиционного соглашения с Amazon на $50 млрд пообещала, что AWS получит эксклюзивные права на предоставление нового инструмента OpenAI для создания агентов — Frontier. Согласно первоначальному соглашению, OpenAI запрещалось предлагать Frontier эксклюзивно в AWS (или даже не эксклюзивно, а вообще). Когда OpenAI объявила о сделке с AWS, Microsoft публично опровергла эксклюзивные условия AWS, указав: «Microsoft сохраняет свою эксклюзивную лицензию и доступ к интеллектуальной собственности в отношении моделей и продуктов OpenAI. <…> Azure остаётся эксклюзивным поставщиком облачных услуг для stateless API-вызовов OpenAI. <…> Любые stateless-вызовы API к моделям OpenAI, являющиеся результатом сотрудничества OpenAI с любой третьей стороной, включая Amazon, будут размещаться в Azure. <…> Собственные продукты OpenAI, включая Frontier, будут по-прежнему размещаться в Azure». Microsoft также подчеркнула, что её условия действуют до тех пор, пока OpenAI не получит AGI. Financial Times тогда сообщила, что Microsoft даже рассматривала возможность подачи судебного иска по этому поводу. Комментируя заключение обновлённого соглашения, генеральный директор Amazon Энди Джасси (Andy Jassy), в частности, отметил, что это означает, что модели OpenAI станут доступны клиентам на AWS Bedrock. Хотя эта сделка выгодна для OpenAI, Microsoft тоже в выигрыше. Новое соглашение позволяет Microsoft прекратить выплату доли выручки OpenAI, в то время как OpenAI продолжит выплачивать долю выручки Microsoft до 2030 года, независимо от технологического прогресса OpenAI, хотя теперь эта сумма ограничена. В прошлом квартале Microsoft заработала $7,5 млрд благодаря инвестициям в OpenAI. Также Microsoft продолжает напрямую участвовать в развитии OpenAI в качестве крупного акционера. Владея примерно 27 % коммерческой компании, Microsoft будет иметь финансовую выгоду от роста OpenAI, даже в случае продаж её продуктов в AWS.

27.04.2026 [13:09], Сергей Карасёв

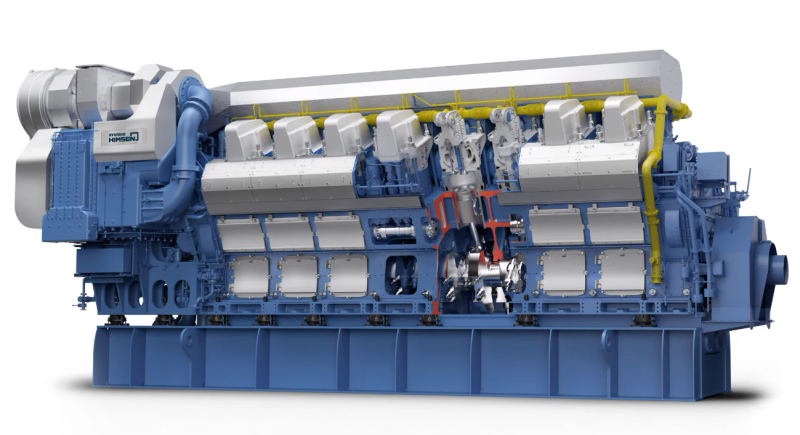

Hyundai поставит газовые генераторы мощностью 684 МВт для ЦОД в СШАЮжнокорейский конгломерат Hyundai Heavy Industries, по сообщению ресурса Datacenter Dynamics, заключил соглашение о поставках газовых генераторов компании Aperion Energy Group — разработчику энергетических решений для дата-центров. Стоимость контракта составляет около $423,7 млн: это крупнейший заказ на силовые установки в истории Hyundai. В рамках соглашения Hyundai предоставит генераторы семейства HiMSEN мощностью до 20 МВт. Эти электростанции будут использоваться для обеспечения питанием ЦОД-инфраструктуры в США. По условиям договора, Aperion Energy Group закупит оборудование суммарной мощностью 684 МВт. Отмечается, что системы HiMSEN отличаются высокой производительностью, быстрым запуском и предсказуемой реакцией на нагрузки, что делает их оптимальным вариантом для дата-центров. Хан Джу-сок (Han Ju-seok), руководитель подразделения двигателей и машиностроения HD Hyundai Heavy Industries, заявил, что контакт с Aperion Energy Group является отправной точкой для выхода на рынок дата-центров США. В дальнейшем южнокорейская компания намерена укреплять позиции в Северной Америке, развивая бизнес в том числе в смежных областях, таких как системы резервного электроснабжения и промышленные энергетические платформы. На фоне этого и других крупных контрактов акции HD Hyundai Heavy Industries подскочили почти на 45 % всего за две недели. Рыночная капитализация компании превысила ₩70 трлн ($51 млрд). Нужно отметить, что ведущие облачные провайдеры и гиперскейлеры на фоне дефицита энергоресурсов всё активнее развивают направление генерации с применением природного газа. В частности, Meta✴ намерена установить более 800 газовых генераторов для питания своего ИИ ЦОД в Техасе. Собственные газовые турбины получит ЦОД Stargate. А Microsoft заключила соглашение с Chevron и Engine No. 1 на закупку до 2,5 ГВт мощностей от газовых генераторов для питания нового ИИ ЦОД.

22.04.2026 [13:12], Владимир Мироненко

xAI готова купить ИИ-стартап Cursor за $60 млрд или заплатить $10 млрд в рамках партнёрстваSpaceX, которая не так давно слилась с xAI, заявила, что заключила соглашение о сотрудничестве с ИИ-стартапом Cursor, получив право приобрести его за $60 млрд в конце этого года или заплатить $10 млрд за совместную работу. Компания Илона Маска сообщила в соцсети Х, что сейчас работает с Cursor над созданием «лучшего в мире ИИ для программирования и работы со знаниями». «Сочетание передового продукта Cursor и его распространения среди опытных инженеров-программистов с суперкомпьютером Colossus компании SpaceX, эквивалентным миллиону H100, позволит нам создать самые полезные в мире модели», — отметила SpaceX. Colossus — кластер суперкомпьютеров xAI в Мемфисе (Memphis), который компания позиционирует как крупнейший в мире. Илон Маск (Elon Musk), основатель и генеральный директор SpaceX, в феврале объединил компанию со своим ИИ-стартапом xAI в рамках сделки, оцененной им в $1,25 трлн. Эта сделка должна помочь в реализации планов компании по запуску ЦОД на орбите. Теперь он готовится вывести объединённую компанию на биржу в рамках рекордного IPO, которое, как ожидается, состоится в июне. Генеральный директор Cursor Майкл Труэлл (Michael Truell) заявил, что он «рад сотрудничать с командой SpaceX для масштабирования (ИИ-модели) Composer». «Значительный шаг на нашем пути к созданию лучшего места для программирования с использованием ИИ», — отметил он, сообщает CNBC. По данным источников CNBC, Cursor ведёт переговоры о привлечении финансирования в размере $2 млрд при её оценке более чем в $50 млрд. Ожидается, что одним из лидеров предстоящего раунда финансирования станет Andreessen Horowitz, также в нём примут участие NVIDIA и Thrive Capital. Andreessen и NVIDIA также ранее поддержали xAI. Для Маска эта сделка означает шанс догнать конкурентов в области ИИ — OpenAI, создавшую ИИ-агента Codex, и Anthropic, разработчика LLM Claude. Впрочем, некоторые эксперты отмечают, что фактическое использование вычислительных мощностей Colossus гораздо ниже, чем у конкурентов, поэтому такая сделка гораздо важнее для xAI, чем для Cursor.

17.04.2026 [22:53], Владимир Мироненко

ИИ-стартап Cerebras поставит OpenAI ускорители ещё на $20 млрдКомпания OpenAI заключила соглашение с ИИ-стартапом Cerebras, согласно которому она выплатит более $20 млрд в течение следующих трёх лет за поставку ИИ-ускорителей, сообщило издание The Information. В рамках сделки OpenAI получит варранты на миноритарную долю в Cerebras, при этом её доля может увеличиться по мере роста расходов, утверждают источники The Information. По их данным, OpenAI также согласилась предоставить Cerebras около $1 млрд для финансирования развёртывания ЦОД на базе её ИИ-ускорителей. До этого, в январе Cerebras договорилась с OpenAI о поставке в течение трёх лет своих ускорителей общей мощностью 750 МВт. Стоимость этой сделки оценивается в $10 млрд. Новое соглашение подчеркивает растущий интерес отрасли к вычислительным мощностям для инференса, отметило агентство Reuters. По его данным, Cerebras может раскрыть некоторые подробности своего соглашения с OpenAI, когда предоставит регулятору документы для проведения первичного публичного размещения (IPO). Исходя из общей суммы контрактов The Information допускает, что OpenAI может получить варранты, представляющие до 10 % доли в Cerebras. Сотрудничество с OpenAI является ключевым элементом в планах Cerebras по выходу на биржу, планирующего провести листинг во II квартале этого года. Cerebras, чья рыночная стоимость, по последним оценкам, составляет $23,1 млрд, планирует привлечь $3 млрд в ходе первичного публичного размещения акций в следующем месяце при оценке примерно в $35 млрд, сообщил The Information. Выход на биржу неоднократно откладывался. Сначала компанию подозревали в опосредованных связях с Китаем и зависимости от ближневосточных нефтедолларов, а потом компания дважды получила крупные инвестиции и нарастила капитализацию. Сделки с AWS и OpenAI укрепили её позиции и успокоили инвесторов. В пятницу Cerebras объявила о подаче заявки на первичное публичное размещение акций (IPO) в США. Компания планирует разместить свои акции на Nasdaq под тикером CBRS. Ведущими андеррайтерами размещения являются Morgan Stanley, Citigroup, Barclays и UBS. Ранее на этой неделе Morgan Stanley открыл Cerebras возобновляемую кредитную линию с доступом до $250 млн, с возможностью увеличения лимита до $850 млн после IPO, сообщил CNBC. Согласно документам, поданным в пятницу, среди инвесторов Cerebras — Alpha Wave, Benchmark, Eclipse, Fidelity и Foundation Capital. На сайте Cerebras также указан генеральный директор OpenAI Сэм Альтман (Sam Altman) в качестве инвестора. Cerebras указала в заявке, что не владеет ЦОД, которые использует для предоставления облачных услуг, но может построить собственные в будущем. В документе также сообщается, что чистая прибыль Cerebras за 2025 год составила $87,9 млн при выручке в $510 млн (рост год к году на 76 %). Компания получила прибыль в размере $1,38 на акцию, по сравнению с убытком в $9,90 на акцию годом ранее. По состоянию на 31 декабря 2025 года у Cerebras оставалось $24,6 млрд невыполненных обязательств, и ожидается, что 15 % этой суммы будет учтено в 2026 и 2027 годах. |

|