Материалы по тегу: сбой

|

22.06.2024 [14:34], Сергей Карасёв

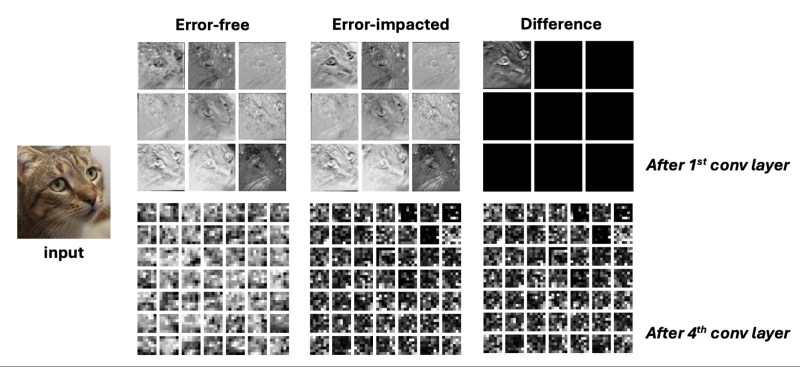

Галлюцинации от радиации: аппаратные сбои могут провоцировать ошибки в работе ИИ-системКомпания Meta✴, по сообщению The Register, провела исследование, результаты которого говорят о том, что ошибки в работе ИИ-систем могут возникать из-за аппаратных сбоев, а не только по причине несовершенства алгоритмов. Это может приводить к неточным, странным или просто плохим ответам ИИ. Говорится, что аппаратные сбои способны провоцировать повреждение данных. Речь идёт, в частности, о так называемом «перевороте битов» (bit flip), когда значение ячейки памяти может произвольно меняться с логического «0» на логическую «1» или наоборот. Это приводит к появлению ложных значений, что может обернуться некорректной работой ИИ-приложений. Одной из причин ошибок является космическое излучение, причём с ростом плотности размещения ресурсов его влияние нарастает. Впрочем, в современных комплексных системах такие ошибки по разным причинам могут возникать на любом из этапов хранения, передачи и обработки информации.

Ошибка в одном бите одного параметра существенно меняет ответ ИИ (Источник: Meta✴) Такие необнаруженные аппаратные сбои, которые не могут быть выявлены и устранены «на лету», называют тихими повреждениями данных (Silent Data Corruption, SDC). Подобные ошибки могут провоцировать изменения ИИ-параметров, что, в конечном счёте, приводит к некорректному инференсу. Утверждается, что в среднем 4 из 1000 результатов инференса неточны именно из-за аппаратных проблем. «Растущая сложность и неоднородность платформ ИИ делает их всё более восприимчивыми к аппаратным сбоям», — говорится в исследовании Meta✴. При этом изменение одного бита может привести к тому, что ошибки будут расти как снежный ком. Для оценки возможных неисправностей предлагается ввести новую величину — «коэффициент уязвимости параметров» (Parameter Vulnerability Factor, PVF). PVF показывает вероятность того, как повреждение конкретного параметра в конечном итоге приведёт к некорректному ответу ИИ-модели Эта метрика, как предполагается, позволит стандартизировать количественную оценку уязвимости модели ИИ к возможным аппаратным сбоям. Показатель PVF может быть оптимизирован под различные модели и задачи. Метрику также предлагается использовать на этапе обучения ИИ и для выявления параметров, целостность которых надо отслеживать. Производители аппаратного оборудования также принимают меры к повышению надёжности и устойчивости работы своих решений. Так, NVIDIA отдельно подчеркнула важность RAS в ускорителях Blackwell. Правда, делается это в первую очередь для повышения стабильности сверхкрупных кластеров, простой которых из-за ошибок обойдётся очень дорого.

18.06.2024 [16:03], Руслан Авдеев

Интернет во Вьетнаме снова под угрозой: отказали три из пяти подводных кабелейБуквально день спустя после начала раздачи во Вьетнаме национальных доменов в зоне .VN, знаменующей укрепление цифрового суверенитета государства, там начались серьёзные неприятности со связью. По данным The Register, 15 июня отказали три из пяти морских интернет-кабелей, связывающих Вьетнам с остальным миром. По информации местного государственного агентства VNA, сбои серьёзно повлияли на связность, а к некоторым зарубежным сайтам вообще очень трудно получить доступ. Пострадал кабель Intra Asia (IA), связывавший Вьетнам с Сингапуром, цифровая магистраль Asia Pacific Gateway (APG) и Sia-Africa-Europe-1 (AAE-1). Полноценно связь до сих пор не восстановлена, так что вся нагрузка пока легла на немногочисленные наземные линии связи. Операторы не сообщают, когда связь восстановится, но в этом нет ничего удивительного, поскольку специализированные корабли для ремонта всегда в дефиците. Кроме того, довольно сложно установить точное место обрыва, а у кораблей могут уйти недели на то, чтобы добраться до него. Точная причина сбоев пока не называется, но ранее подобные инциденты обычно случались из-за естественной деградации кабелей или из-за непреднамеренного повреждения, либо, что бывало намного реже, в результате намеренного саботажа (как, вероятно, в Красном море). В начале 2023 года у Вьетнама уже были подобные проблемы, когда отказали не три, а все пять подводных ВОЛС. Тогда виноватыми назначили китайское рыболовное судно и неопознанный грузовой корабль. В целом именно якори и тралы нередко становятся причиной неумышленного повреждения подводных коммуникаций. Во Вьетнаме активно пытаются улучшить состояние морских кабельных соединений. План правительства предполагает получение ещё 60 Тбит/с через 2–4 новых подводных кабеля. С учётом того, что все пять уже имеющихся кабелей по плану должны сохранить работоспособность к 2025 году, общая пропускная способность каналов связи должна вырасти до 122 Тбит/с. Обрыв кабелей произошёл в не самое удачное время. Местное Министерство информации и коммуникаций 14 июня объявило, что бизнес-пользователи доменных имён BIZ.VN для новых сайтов получат два года бесплатного обслуживания, как и граждане страны от 18 до 23 лет, использующие домен ID.VN в личных целях. Таким образом власти пытаются привлечь к использованию домена .VN побольше местных пользователей. Сейчас национальные использует только четверть вьетнамских компаний, тогда как в развитых странах этот показатель находится на уровне 70 %.

06.06.2024 [15:11], Руслан Авдеев

Virgin Media намерена отсудить €800 тыс. у рыболовов, повредивших её подводный интернет-кабель почти 10 лет назадБританская телеком-компания Virgin Media Wholesale подала в суд на владельцев рыболовецкого траулера Lida Suzanna. По информации Datacenter Dynamic, предположительно именно это судно повредило подводный кабель, соединяющий Ирландию и Великобританию, 26 января 2015 года. Компания подала иск в Ирландии, требуя возместить €800 тыс. ($870 тыс.) ущерба «владельцами и иными заинтересованными лицами», имеющими отношение к траулеру. Проложенный в 1999 году кабель Sirius South протяжённостью 219 км проложен между Дублином и Блэкпулом. Предполагается, что ловившее морских гребешков судно задело дно жёсткими металлическими рамными сетями, повредив телекоммуникационную инфраструктуру. Всего Virgin владеет двумя кабелями между Ирландией и «большим» островом: Sirius South и Sirius North. Последний проложен в пределах Соединённого Королевства между Шотландией и Северной Ирландией. После инцидента оператор быстро переключился на второй кабель, но пользователи заметили падение скорости интернет-доступа. Юристы истцов заявили, что ответчики должны были знать о расположении кабеля, отмеченного на используемых в отрасли картах и в ирландском Морском атласе, поскольку существующие правила обязывают экипаж иметь документы о расположении инфраструктурных цифровых магистралей. Представители владельцев траулера утверждают, что нет никаких доказательств того, что именно этот корабль имеет отношение к инциденту, а за любое повреждение несёт ответственность сама Virgin, не обеспечившая достаточного заглубления и защиты кабеля.

Источник изображения: Fer Nando/unsplash.com В своё время неисправность устранило принадлежащее Orange Marine судно Pierre de Fermat, спустя несколько дней после происшествия. Всего известны 18 случаев повреждения именно этого кабеля с 1999 года, когда его проложила предшественница Virgin — компания NTL. Ранее Virgin Media подавала иск против другого траулера Willie Joe — тоже за повреждения в минувшие годы. Впрочем, в этом случае дело было улажено в 2022 году. Нарушения целостности подводных интернет-кабелей случаются во всём мире довольно регулярно. Например, недавно были повреждены кабели в Красном море и на западе Африки, из-за чего сократился трафик между континентами. А Великобритания даже приобрела специальный корабль для защиты подводных оптоволоконных и силовых кабелей.

04.06.2024 [13:04], Руслан Авдеев

Вся IT-система муниципалитета в Западной Австралии оказалась зависимой от единственного сервера без возможности быстрой заменыВ Западной Австралии вскрылся случай вопиющей небрежности местных властей в IT-сфере. Datacenter Dynamics сообщает, что неназванный муниципалитет в регионе полностью положился при создании местной IT-системы на один-единственный сервер — резервирование попросту не предусмотрено. На случай чрезвычайных происшествий предусмотрена замена в течение 48 часов, однако поставщика оборудования об этом даже не уведомили. Аудит в шести муниципалитетах штата выявил, что ни один из них не готов к IT-инцидентам и к полному восстановлению ключевых систем. В докладе, посвящённом муниципалитету с единственным сервером, указывается, что в случае повреждения сервера в результате инцидента план восстановительных работ (DRP) требует от IT-вендора замены в течение 48 часов. При этом в соглашении с вендором не прописаны ни сроки, ни спецификации оборудования для замены. В ходе аудита выяснилось, что муниципальные советы не задокументировали должным образом планы восстановления IT-систем и даже не знали, сработают ли их планы вообще. Соглашения с вендорами также признаны «неадекватными». Все советы полностью полагались в восстановлении работоспособности и тестировании на сторонние компании. Причём в одном случае имелись только устные договорённости, а письменное соглашение начали разрабатывать лишь после аудита. Генеральный аудитор Кэролайн Спенсер (Caroline Spencer) отметила, что её ведомство постоянно выявляет у органов местного самоуправления проблемы с планированием работ на случай инцидентов с IT-системами. Базовые планы реагирования есть у всех, но никто на практике не готов к сбоям в полной мере. Спенсер подчеркнула, что своевременное восстановление IT-систем сможет снизить финансовые и репутационные издержки и минимизировать задержки с возобновлением обслуживания населения.

27.05.2024 [23:27], Александр Бенедичук

Google Cloud полностью взяла на себя вину за скандальное удаление облака пенсионного фонда UniSuperРанее в этом месяце Google Cloud по ошибке удалила учётную запись австралийского пенсионного фонда UniSuper. После восстановления работоспособности систем UniSuper и завершения внутренней проверки компания опубликовала информацию, призванную прояснить характер инцидента. В соответствии с отчётом, инцидент затронул только и исключительно одного клиента, только один его сервис Google Cloud VMware Engine (GCVE) и только в одном облачном регионе из двух, используемых компанией UniSuper. Резервные копии данных клиента, хранящиеся в Google Cloud Storage (GCS) в том же регионе не пострадали. По данным Google, во время первоначального развертывания частного облака для клиента в 2023 году операторы Google Cloud случайно неправильно настроили сервис GCVE, оставив поле неназванного параметра пустым. Это привело к непреднамеренному и непредсказуемому результату: частное облако UniSuper было автоматически удалено по истечении одного года (срок жизни по умолчанию), причём без уведомления о событии кого бы то ни было. Восстановление GCVE, конфигурации сети, систем безопасности, приложений и данных потребовало от команды UniSuper и Google нескольких дней работы в режиме 24×7. Google Cloud предприняла ряд мер для исключения подобных инцидентов в будущем, в том числе проверку вручную всех GCVE-развёртываний других клиентов. Кроме того, теперь процесс создания GCVE полностью автоматизирован и не требует участия живых операторов даже при формировании нестандартных конфигураций. Однако необычно долгое восстановление сервиса и произошедший спустя неделю после инцидента с UniSuper похожий, а возможно и связанный с описанной историей, сбой в работе Google Cloud ставит под сомнение надёжность облачной платформы в целом, а также в очередной раз показывает, насколько хрупка и уязвима ИТ-инфраструктура и насколько велико значение человеческого фактора.

20.05.2024 [13:50], Руслан Авдеев

Google Cloud умудрилась поломать собственную сетевую инфраструктуру, но быстро исправиласьПрошла всего неделя после того, как Google удалила облачную учётную запись австралийского пенсионного фонда UniSuper, но, похоже, инженеры компании только начинают входить во вкус. По данным The Register, в минувшую пятницу Google Cloud нарушила работу десятков сервисов. Изначально в Google Cloud объявили о запуске «автоматизации техобслуживания для отключения неиспользуемого компонента контроля сети в одной локации». Но в результате отключение состоялось сразу в 40 локациях, так что почти три часа пользователи 33 сервисов Google Cloud, включая крупные службы вроде Compute Engine и Kubernetes Engine, столкнулись с рядом проблем:

Прочие сервисы, требовавшие использования виртуальных машин в Google Cloud Engine или обновление конфигураций сети, столкнулись с проблемами с 15:22 по 18:10 по тихоокеанскому времени США. В Google объяснили инциденты ошибкой в системе автоматизированного отключения сетей. После перезапуска некорректно работавшего компонента проблема была устранена. Инструмент автоматизации заблокировали до принятия необходимых мер безопасности, а клиентам сообщили, что пока риска повторения сбоев нет. Впрочем, подмоченная репутация компании позволяет усомниться в её заявлениях. Облачное подразделение Google пообещало со временем раскрыть больше информации о произошедшем.

09.05.2024 [21:40], Владимир Мироненко

Google Cloud случайно удалила частное облако австралийского пенсионного фонда UniSuper. И запасное тожеОколо недели более полумиллиона участников австралийского пенсионного фонда UniSuper не имели доступа к своим аккаунтам из-за сбоя, который привёл к удалению частного облака фонда в Google Cloud, пишет The Guardian. Главы UniSuper и Google Cloud выступили с совместным заявлением, согласно которому это был «отдельный, “единственный в своем роде случай”, который никогда раньше не происходил ни с одним из клиентов Google Cloud во всем мире». В Google Cloud отметили, что «сбой произошёл из-за беспрецедентной последовательности событий, в результате которых непреднамеренная неправильная конфигурация во время предоставления услуг частного облака UniSuper в конечном итоге привела к удалению подписки фонда на частное облако». Облачный провайдер заявил, что выявил события, которые привели к этому сбою, и принял меры, чтобы это больше не повторилось.

Источник изображения: UniSuper UniSuper дублирует данные в двух географических регионах, чтобы восстановить работу в случае потери одного из них. Но поскольку была удалена облачная подписка фонда целиком, это привело к потере в обоих облачных регионах. К счастью, фонд имел резервные копии у другого провайдера, поэтому данные удалось восстановить. Ранее UniSuper распределял рабочие нагрузки между сервисами Azure и двумя собственными ЦОД, но в прошлом году перенёс большую часть нагрузок на платформу Google Cloud Platform. UniSuper управляет средствами на сумму около $125 млрд. К полудню четверга по австралийскому времени облачная инфраструктура UniSuper восстановила работу, а участники фонда получили доступ к своим аккаунтам. Вместе с тем балансы счетов пока не будут обновляться, хотя, как сообщается, часть операций уже доступна, а финансы участников не пострадали. Google также заверила членов UniSuper, что сбой не был вызван кибератакой и, следовательно, их конфиденциальные данные не были раскрыты неавторизованным лицам. Сбои облачных сервисов случались и раньше, причём с ним сталкивались и основные провайдеры, включая AWS и Microsoft Azure. Но они справлялись с проблемами довольно быстро, чего не произошло в случае с UniSuper. Это может нанести ущерб Google с репутационной точки зрения и вызвать у клиентов недоверие к компании как поставщику услуг, говорит глава EEITrend. «На устранение сбоя в облаке UniSuper в Google Cloud в Австралии ушло необычно много времени, что негативно влияет на репутацию Google Cloud в регионе», — отметил он.

21.09.2023 [18:52], Руслан Авдеев

Энергетический кризис ЮАР привёл к кражам аккумуляторов, генераторов и кабелей на телеком-объектахОператор Vodacom, действующий на территории Южной Африки, наметил планы борьбы с участившимися кражами аккумуляторов, питающих базовые станции и иные инфраструктурные объекты. По данным DataCenter Dynamics, ежемесячно в регионе регистрируется 15–28 инцидентов вандализма, связанных с мобильной инфраструктурой, АКБ крадут по 18–30 раз в месяц. В ЮАР у Vodacom есть 45 млн абонентов, и после каждого инцидента без коммуникаций остаются тысячи человек, а стоимость восстановления связи обходится в лучшем случае в несколько тысяч долларов. Проблема тесно связана с перебоями в электросетях страны и только усугубляет ситуацию — Vodacom Central Region стала использовать резервные источники питания и генераторы для подстраховки, после чего преступники стали красть аккумуляторы, генераторы, кабели и другое вспомогательное оборудование. Только в мае государственная энергоснабжающая компания Eskom предупреждала, что, возможно, число перебоев с подачей энергии вырастет этой зимой (с июня по август) до беспрецедентного уровня, поскольку в Южной Африке продолжается энергетический кризис. В Eskom предупреждали, что отключения за 32-часовой цикл могут достигнуть 16 часов. В Vodacom уже объявили, что усилили меры безопасности на площадках с базовыми станциями, установив камеры видеонаблюдения. Кроме того, начался монтаж станций в антивандальных контейнерах с сигнализаций.

Источник изображения: Sergio-sq/pixabay.com Также указывается, что некоторые преступники уже предстали перед судом и приговоры за порчу инфраструктуры весьма жёсткие. Например, в мае 2022 года за кражу аккумуляторов базовых станций трое преступников приговорены к 15 годам тюрьмы за каждый эпизод, каждый получил по 30 лет заключения. Аналогичные приговоры выносятся и за кражу генераторов — ущерб для оператора в таких случаях иногда составляет десятки тысяч долларов. Это не единственная проблема телеком-корпораций в Африке и далеко за её пределами. Так, в Ботсване оператор Botswana Telecommunications Corporation (BTC) наметил планы отказа от медных компонентов в своём оборудовании из-за участившихся краж. Проблема коснулась даже относительно благополучных стран вроде Великобритании — в прошлом месяце преступники оставили без интернета Оксфордшир, украв 500 м медного кабеля, причём это далеко не первый случай.

19.10.2022 [21:48], Сергей Карасёв

Пожар в южнокорейском дата-центре Kakao привёл к остановке 32 тыс. серверов, отказу в обслуживании 45 млн человек, падению акций и отставке топ-менеджера компанииИсполнительный содиректор южнокорейской интернет-компании Kakao Намкун Вон (Namkoong Whon) принял решение подать в отставку после массового сбоя в работе сервисов, спровоцированного пожаром в кампусе ЦОД SK C&C Data Center неподалёку от Сеула, принадлежащем SK Group. Возникшие проблемы вызвали недовольство как со стороны многочисленных пользователей, так и со стороны представителей бизнеса и власти. Пожар начался 15 октября 2022 года с возгорания в аккумуляторной в одном из зданий ЦОД. В результате была нарушена работа мессенджера KakaoTalk, аудитория которого составляет 43–47 млн пользователей в Южной Корее (при населении всей страны в почти 52 млн человек). Кроме того, возникли сбои в работе платёжной системы KakaoPay, почтовой службы, такси и других сервисов компании. Не был затронут только сервис Kakao Bank, который размещался в другом дата-центре. По состоянию на 17 октября работоспособность большинства функций KakaoTalk была восстановлена, однако доступность ряда служб всё же оставалась ограниченной.

Источник изображения: Yonhap Инцидентом лично заинтересовался президент страны, а стоимость акций Kakao при этом рухнула на 9,5 % — до минимального значения с мая 2020 года. Нарушение работы KakaoTalk негативно сказалось на работе сотен предприятий малого бизнеса, использующих названный мессенджер. Kakao уже сообщила о намерении выплатить компенсации и выяснить причины медленного восстановления работы своих служб. Кроме того, Kakao намерена вложить $325 млн в открытие в 2023 году собственного ЦОД, а в 2024-м будет запущен второй дата-центр. Любопытно, что в том же кампусе находился и дата-центр Naver, ещё одного южнокорейского IT-гиганта, на работу которого инцидент оказал намного меньшее влияние. Основная претензия к Kakao заключается в том, что у компании не были разработаны планы поведения в экстренных ситуациях. В частности, компания оказалась не готова к тому, что ЦОД будет быстро обесточен после начала пожара. При этом, вероятно, это самый крупный инцидент в ЦОД в мире, поскольку речь идёт об остановке сразу 32 тыс. серверов. Нужно отметить, что в течение последнего времени пожары охватили сразу несколько крупных ЦОД. В частности, в марте прошлого года пожар уничтожил дата-центр французской компании OVHcloud в Страсбурге. В результате этого ЧП оказались недоступны в общей сложности 3,6 млн веб-сайтов, в том числе ресурсы ряда правительственных организаций, банков, интернет-магазинов и пр. А пожар, случившийся в ЦОД иранской Telecommunication Infrastructure Company (TIC), практически оставил без доступа в интернет всю страну.

20.07.2022 [15:56], Владимир Мироненко

Аномальная жара привела к сбоям в лондонских дата-центрах Google и Oracle

google cloud platform

hardware

oracle cloud infrastructure

великобритания

облако

охлаждение

сбой

цод

Во вторник, 19 июля, в ЦОД Google Cloud Platform (GCP) в Лондоне произошёл сбой в системе охлаждения, в связи с чем несколько сервисов компании временно вышло из строя. В лондонском регионе облака Oracle тоже возникли проблемы с охлаждением оборудования ЦОД. Сбои произошли из-за рекордной жары в Великобритании — температура превысила +40°C. Некоторые операторы дата-центров были вынуждены принять нестандартные меры, начав обрызгивать водой внешние модули систем кондиционирования, установленные на крыше. Отключение ряда сервисов Google произошло в 18:13 по местному времени (20:13 мск). В журнале статуса оборудования сбой описан как «связанный с охлаждением». Google заявила, что сбой затронул лишь небольшое количество клиентов. В частности, отключение коснулось сервисов Persistent Disk и Autoscaling. Хотя Google утверждает, что сбой продолжался до 22:00 BST (24:00 мск), в означенное время всё ещё поступали жалобы на ошибки в работе Persistent Disk. С подобными проблемами в Лондоне столкнулась и облачная служба Oracle. Проблемы с перегревом у неё начались примерно в 17:00 по местному времени (19:00 мск). Oracle ранее арендовала ресурсы в ЦОД Equinix в лондонском кампусе Слау, но сейчас не раскрывает местонахождение своих мощностей. «В результате несезонных температур в регионе возникла проблема с частью инфраструктуры охлаждения в центре обработки данных на юге Великобритании (в Лондоне), — говорится в сообщении компании. — Это привело к тому, что часть нашей сервисной инфраструктуры пришлось отключить, чтобы предотвратить неконтролируемые сбои оборудования». |

|