Материалы по тегу: разработка

|

17.04.2026 [12:00], Сергей Карасёв

Конференция OS DAY 2026 «Встроенные операционные системы, реальное время»Ежегодная XIII научно-практическая конференция «OS DAY. Встроенные ОС, реальное время» пройдёт 4–5 июня на базе РЭУ им. Г.В. Плеханова. Центральными на OS DAY 2026 станут вопросы, касающиеся операционных систем для встроенных устройств и ОС реального времени. Необходимость создания собственных локализованных автоматических систем управления технологическими процессами и сопутствующей им инфраструктуры становится сегодня вопросом национальной безопасности, что делает темы этого года особенно актуальными. Участие в конференции примут специалисты в области системного программирования, представители отраслевых регуляторов, руководители высших учебных заведений, профильных факультетов и кафедр. Приглашены к диалогу и представители компаний-производителей аппаратных систем: успешное решение задачи безопасности АСУТП может быть только комплексным, с учётом как операционных систем и средств их разработки, так и «железа». Только так можно добиться максимальной надёжности встроенных систем. Участники OS DAY обсудят, какие задачи ставит промышленность перед компактными устройствами, каковы границы применения одноплатных компьютеров и микрокомпьютеров, как из решаемых задач получаются требования к операционным системам, где применяется «мягкое» и «жёсткое» реальное время, как производители встраиваемых устройств и ПО для них решают задачи построения разносторонних экосистем своих продуктов. Председатель программного комитета OS DAY, директор ИСП РАН, академик Арутюн Аветисян отметил: «Развитие отечественных встроенных систем — один из ключевых факторов достижения технологической независимости России. Перед отраслью стоят традиционные задачи: надёжность, безопасность и работа в реальном времени. Однако формируются и новые вызовы, связанные с внедрением технологий искусственного интеллекта. Их применение во встроенных системах требует глубокой оптимизации в условиях ограниченных вычислительных ресурсов, а также сотрудничества с отечественными производителями аппаратного обеспечения. Поэтому ключевая задача — сбалансировать традиционные инженерные подходы и новые ИИ-технологии, обеспечив устойчивое формирование таких решений». В рамках OS DAY 2026 состоится панельная дискуссия «Технологический суверенитет промышленного производства: встраиваемые устройства», в которой примут участие разработчики российских операционных систем и систем автоматического управления технологическими процессами, представители промышленных предприятий и отраслевых регуляторов. Участники обсудят безопасность встраиваемых устройств и программное обеспечение для них — ОС и прикладные программы, пути достижения технологического суверенитета встраиваемых АСУТП. На второй день конференции запланировано проведение круглого стола, посвящённого преподаванию системного программирования в современной образовательной системе. Его участниками станут топ-менеджеры компаний, специализирующихся на создании операционных систем, и представители отечественных профильных вузов. Основной темой для обсуждения станет необходимость перемен в системе подготовки специалистов в области системного программирования, достижение синергии в работе высших учебных заведений, готовящих кадры для отрасли, и компаний-разработчиков ОС, как работодателей. Будет уделено внимание будущим переменам в образовательном процессе после отмены болонской системы, необходимости корректировки программ преподавания системного программирования. История проведения OS DAY показывает, что принятые на конференции решения становятся не просто важными, а ключевыми для отрасли системного программирования. Есть все основания полагать, что в этом году они окажутся таковыми и для системы образования. На конференцию OS DAY 2026 принимаются доклады до 28 апреля по темам:

Программный комитет традиционно рассматривает доклады, которые не вписываются в указанную тематику, но укладываются в общее направление конференции — разработка операционных систем и системного инструментария. Конференцию организует консорциум OS DAY: ИСП РАН, «Лаборатория Касперского», «Открытая мобильная платформа», «Базальт СПО», «РЕД СОФТ» и НТЦ ИТ РОСА. Конференция проводится при поддержке: РАН, ФСТЭК России, АРПП «Отечественный софт», НП «РУССОФТ». Партнёр конференции: управление цифровой трансформации РЭУ им. Г.В. Плеханова. Время и место проведения: 04–05 июня 2026 г., РЭУ им. Г.В. Плеханова. Адрес: Москва, ул. Большая Серпуховская, д. 11, корпус 9, этаж 6, «Точка-кипения РЭУ». Для участия просьба зарегистрироваться на сайте https://osday.ru. Зарегистрированным участникам, выбравшим формат онлайн, будет предоставлен доступ на адрес электронной почты, указанный при регистрации. По дополнительным вопросам просьба обращаться: Анна Новомлинская, исполнительный директор OS DAY, an@ispras.ru.

16.04.2026 [23:55], Владимир Мироненко

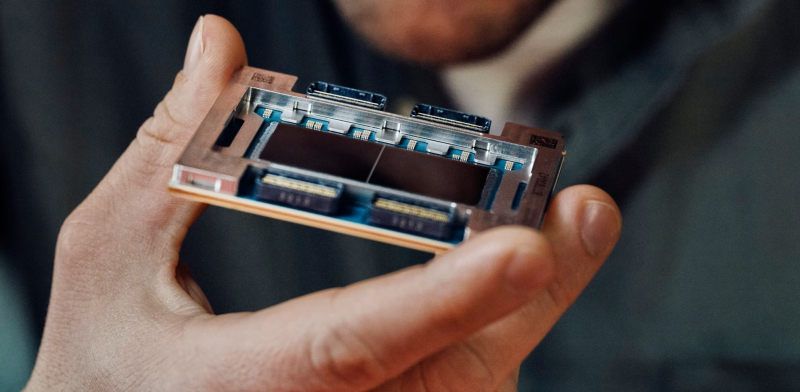

Ядро Linux лишается поддержки российских процессоров «Байкал-Т1»Как сообщают ресурс OpenNET и Phoronix, в состав ядра Linux 7.1 приняты изменения, удаляющие поддержку контроллеров AHCI SATA и PCIe, применяемых в SoC Baikal-T1. Процесс начался не сегодня — в ядре 7.0 уже была удалена поддержка драйверов i2c и spi dw. В качестве причины удаления указано отсутствие сопровождения и незавершённая интеграция в состав ядра компонентов платформы Baikal. В частности, драйвер PCIe так и не был доведён до полностью работоспособного состояния.  Помимо этого, на рассмотрении находятся pull-запросы на удаление связанных с Baikal драйверов таймера, памяти, physmap, шины, hwmon, dwc и bt1-rom. Поддержка «Байкал-Т1» была включена в ядро Linux, начиная с ветки 5.8. Сохранилась она и в ядре Linux 6.18 LTS. В 2023 году сообщество разработчиков ядра Linux отказалось принимать от российской компании «Байкал Электроникс» патчи для ядра в связи с введением в отношении неё санкций США. По этой же причине из официального файла MAINTAINERS были удалены упоминания о ряде разработчиков, потенциально связанных с Россией — создатель проекта Linux Линус Торвальдс (Linus Torvalds) поддержал это решение.

16.04.2026 [10:22], Владимир Мироненко

ИИ не поможет: Gartner предрекает провал автоматизированному переносу древнего ПО с мейнфреймовБольшинство пользователей мейнфреймов, которые попытаются воспользоваться ИИ для миграции устаревшего кода на альтернативные платформы, потерпят неудачу, сообщил The Register со ссылкой на данные аналитической компании Gartner. «Более 70 % проектов по уходу с рынка мейнфреймов, начатых в 2026 году, не принесут ожидаемых результатов из-за переоценки возможностей инструментов генеративного ИИ», — говорится в материале под названием «Too Big to Fail: Why Mainframe Exit Projects Are Likely to Fail in the Age of Generative AI», опубликованной Gartner на прошлой неделе. Gartner также считает, что рынок услуг миграции с мейнфреймов с использованием ИИ вот-вот лопнет. «К 2030 году 75 % поставщиков, работающих на рынке “ухода с мейнфреймов”, либо изменят свои бизнес-модели, либо прекратят свое существование», — предупреждает компания. Пессимизм Gartner объясняется ролью мейнфреймов как хранилища критически важных приложений и данных в течение долгого периода. «Для большинства крупных предприятий огромный объём и взаимосвязанная сложность данных делают полную миграцию физически и финансово невозможной», — считают в Gartner. Аналитики отметили, что мейнфреймы являются значительным источником технического долга и что генеративный ИИ очень полезен для выявления и описания этого долга. Вместе с тем они указали на то, что генеративный ИИ имеет «значительные ограничения, когда речь идет об автоматизированных переписывании и миграции устаревшего кода». «Также не учитываются уникальные возможности, которые предлагает мейнфрейм, например, сохранения той же производительности и пропускной способности после миграции», — добавили они. В Gartner сообщили, что одной из причин, по которой поставщики предлагают ИИ для проектов по отказу от мейнфреймов, является «агрессивный спрос инвесторов на возможности ИИ как единственный показатель долгосрочного “здоровья” поставщика, вынуждающий поставщиков внедрять ИИ даже там, где это не требуется». Это давление усиливает опасения пользователей по поводу трудностей с поиском персонала для работы с мейнфреймами и технического долга. Аналитики отметили «разрыв между “маркетинговым заявлениями” о генеративном ИИ и его реальными возможностями в трансформации кода». «Поддавшись обещаниям “кажущегося волшебным решения” в виде миграции и игнорируя подход, ориентированный на конкретную платформу (то есть, тщательную оценку рабочих нагрузок и выбор оптимальной платформы для соответствующих задач), мы наращиваем огромный технический долг и создаём критические риски для всего предприятия», — сообщается в статье Gartner. В связи с этим пользователям предлагается искать способы улучшения своих систем, а не переходить на новые. «Стремление отказаться от мейнфреймов ослабевает, — пишут аналитики. — Клиенты всё больше осознают, что практически невозможно отказаться от мейнфреймов с приемлемыми затратами и рисками, что заставляет их отказаться от давней надежды на создание совершенного инструмента для осуществления этой миграции». Согласно Gartner, мейнфреймы по-прежнему являются «ведущей платформой для некоторых критически важных приложений, даже с учётом продолжающегося стремления к облачным архитектурам». Публикацию Gartner позитивно восприняли в IBM, чьи акции резко упали после того, как Anthropic разрекламировала возможности своего инструмента Claude Code по преобразованию COBOL, что вызвало очередной виток спекуляций о том, что мейнфреймы, возможно, находятся на грани исчезновения. Аналогичное решение на базе Google Gemini во время анонса такого эффекта не вызвало.

13.04.2026 [10:12], Руслан Авдеев

Red Hat уволила сотни программистов в Китае, чтобы перенести разработку в ИндиюПохоже, Red Hat полностью ликвидировала команду разработки в Китае, не считая более страну приоритетной для своего бизнеса. Большая часть разработчиков теперь будет в Индии, сообщает The Register. Ранее в Сети появились слухи о роспуске китайского подразделения Red Hat, а после появился пост от имени старшего разработчика (principal software engineer) Red Hat China, который в минувший четверг лишился доступа к корпоративной сети, а через некоторое время получил уведомление от руководства о том, что компания смещает фокус на центры разработки в Азиатско-Тихоокеанском регионе (APAC). Китайские СМИ сообщают о 300–500 уволенных, а также о служебной записке, разосланной техническим директором компании Крисом Райтом (Chris Wright). Согласно утекшему в Сеть документу, Red Hat подготовила «стратегию размещения», в соответствии с которой определены «ключевые места для приоритетного найма и стратегических инвестиций в кадры». Судя по всему, в Red Hat решили, что Индия является ключевой локацией для размещения сотрудников, а Китай — не является, поэтому и компания прекратит разработки в Поднебесной, перенеся большую часть рабочих мест в Индию. В записке Райта сообщается, что уход из Китая не приведёт к чистому сокращению числа сотрудников. Также подчёркивается, что об изменениях публично объявлено не будет, поэтому официальных комментариев ждать не стоит. IBM, которой принадлежит Red Hat, заявляет, что в Индии у компании больше сотрудников, чем в США, всего около 264 тыс. человек. Ранее IBM полностью перенесла разработку ОС AIX в Индию. Стоит отметить, что присутствие в Китае сократила не только Red Hat. Так, Microsoft покинула КНР в 2025 году после того, как выяснилось, что многие разработчики, работавшие над внедрением Azure в Пентагоне, годами работали с территории Китая. Военное ведомство заявило, что из-за Microsoft подверглось «неприемлемому риску». Red Hat так же многие годы плотно сотрудничает с различными военными структурами США, в 2024 году она заключила договор на $848 млн в рамках реализуемой Пентагоном Enterprise Software Initiative. Возможно, компания намерена продемонстрировать приверженность обеспечению национальной безопасности США, чтобы избежать возможных проблем в будущем. Хотя Китай является гигантским рынком ПО и IT-технологий в целом, его власти всё чаще рекомендуют участникам инвестировать в местные разработки. Поскольку значительная часть кода Red Hat относится к open source, китайские структуры от ухода компании не особенно пострадают, тем более что Red Hat не собирается прекращать продажи коммерческих продуктов в стране. Некоторые проблемы может испытать сама Red Hat, поскольку в Китае немало талантливых программистов. Тем не менее, как отмечает The Register, это в некоторой степени нивелируется тем, что в стране уникально нормативно-правовая база и правила, в частности предписывающие крупным компаниям нанимать представителей КПК.

03.04.2026 [01:00], Владимир Мироненко

IBM «подружит» мейнфреймы с Arm, но пока, похоже, сама не до конца понимает, зачем

arm

ibm

linux

software

виртуализация

конфиденциальность

мейнфрейм

миграция

разработка

сотрудничество

IBM объявила о стратегическом сотрудничестве с Arm с целью «разработки нового оборудования с двойной архитектурой, которое поможет предприятиям запускать будущие ресурсоёмкие рабочие нагрузки, связанные с ИИ и обработкой данных, с большей гибкостью, надёжностью и безопасностью». Пока что компании объявили о возможности запуска ПО для Arm на мейнфреймах IBM, а в остальном ограничились довольно общими словам об «инновациях» и «светлом будущем». Сотрудничество будет сосредоточено на трёх ключевых областях: расширение технологий виртуализации, чтобы программные среды на базе Arm могли работать на корпоративных платформах IBM; обеспечение возможности корпоративным системам распознавать и выполнять приложения Arm для соответствия Arm-сред требованиям надёжности, безопасности, эксплуатации и размещения данных, которым должны следовать регулируемые отрасли; создание в рамках долгосрочного развития экосистемы общих технологических уровней для большей гибкости предприятий в развёртывании и управлении приложениями на обеих платформах. «Этот момент знаменует собой очередной шаг на нашем пути к инновациям для будущих поколений наших систем IBM Z и LinuxONE, подтверждая, что наша комплексная системная архитектура является мощным конкурентным преимуществом», — отметил Кристиан Якоби (Christian Jacobi), главный технический директор и научный сотрудник IBM Systems Development. Компания уже представила патч для ядра Linux, добавляющий в KVM для s390-систем поддержку arm64. Иными словами, речь о запуске Arm-софта в виртуальной машине. Дополнительно IBM пополнила набор инструкций s390 для совместимости и ускорения работы Arm-гостей. Компания подчеркнула, что сотрудничество направлено на обслуживание предприятий, которые выполняют регулируемые рабочие нагрузки и не могут просто перенести их в облако. Arm утверждает, что почти половина всех вычислительных мощностей, поставленных ведущим гиперскейлерам в 2025 году, работает на чипах Arm, при этом AWS, Google и Microsoft развёртывают свои собственные Arm-чипы Graviton, Axion и Cobalt. AWS сообщила, что третий год подряд более половины всех новых CPU-мощностей приходится на Graviton. На днях и Arm представила собственный процессор Arm AGI, ориентированный на работу с ИИ. Среди крупных разработчиков серверных Arm-процессоров остались Ampere Computing (SoftBank) и Qualcomm. Исследование Signal65 показало, что Graviton4 обеспечивает до 168 % более высокую производительность при работе с LLM и на 220 % более высокую производительность по соотношению цены и качества по сравнению с аналогичными x86-чипами AMD. По мнению Рачиты Рао (Rachita Rao), старшего аналитика Everest Group, если гиперскейлеры активно осваивают Arm ради экономии средств, то IBM метит в суверенные и изолированные рабочие среды, где традиционно используются её мейнфреймы. Более того, речь идёт и о «железе», и о людях — специалистов для поддержки устаревающих систем всё меньше, передаёт NetworkWorld. Если удариться в фантазии, в таком шаге IBM можно усмотреть и потенциальный отказ от POWER в пользу Arm. Представитель IBM, отвечая на вопрос ресурса The Register о сроках появления первого плода этого партнёрства, сообщил, что об этом пока рано говорить и что это зависит от многих факторов. По мнению Рао, предприятиям следует планировать трёхлетний горизонт разработки, исходя из того, сколько времени уходило у IBM на поставки оборудования IBM. Хотя IBM представила процессор Telum II и ускоритель Spyre в августе 2024 года, мейнфреймы z17 стали доступны только в июне 2025-го, примерно тогда же были представлены LinuxONE Emperor 5, а Spyre появились лишь в ноябре. Т.е. цикл занимает примерно 12–18 мес. Параллельно IBM заключает партнёрства в области ИИ-инфраструктуры с другими производителями, включая AMD и Groq (теперь NVIDIA). При этом ПО для IBM является ключевым источником дохода, и она не скупится на крупные приобретения. По мнению Рао, «IBM не рассматривает совместимость с Arm как основное решение для масштабирования корпоративного ИИ. Крупномасштабный ИИ по-прежнему перемещается в среды с большим количеством GPU. Совместимость с Arm может помочь приблизить новые стеки и сервисы к мейнфреймам, но она не изменит основную стратегию в области ИИ-инфраструктуры».

18.03.2026 [12:14], Руслан Авдеев

Великобритания выделит £45 млн на ИИ-суперкомпьютер Sunrise для моделирования физики термоядерного синтезаВласти Великобритании намерены выделить £45 млн (порядка $60 млн) на новый ИИ-суперкомпьютер Sunrise, специально предназначенный для моделирования процессов, сопутствующих термоядерному синтезу. Систему планируют ввести в эксплуатацию летом 2026 года в кампусе Управления по атомной энергии Великобритании (UKAEA), сообщает The Register. Sunrise позиционируется как самый мощный ИИ-суперкомпьютер, специально предназначенный для исследований в сфере термоядерной энергетики. Система мощностью 1,4 МВт финансируется министерским Департаментом энергетической безопасности и нулевых выбросов (Department for Energy Security and Net Zero, DESNZ). Она должна заработать в июне и станет первым элементом «Зоны роста ИИ» (AI Growth Zone) в Калхэме (Оксфордшир). Задача Sunrise — объединение HPC- и ИИ-вычислений, оптимизированных для исследования физических процессов. Это позволит более точно моделировать различные события и создавать цифровых двойников сложных термоядерных систем до проведения дорогостоящих экспериментов в реальном мире. Сообщается, что ИИ-производительность составит до 6,76 Эфлопс. Машина получит узлы Dell PowerEdge с AMD EPYC и Instinct (всего 672 шт.), а также хранилище WEKA. По данным UKAEA, за классические вычислительные мощности отвечают 192 двухпроцессорных узла с 56-ядерными Intel Xeon Max (Sapphire Rapids с HBM). Intel является одной из компаний, поддерживающих проект, наряду с образовательными и государственными структурами — Кембриджским университетом и самим UKAEA.

Источник изображения: Kristina Gadeikyte Gancarz/unsplash.com Представители властей подчёркивают, что система поможет решать ключевые задачи, связанные с термоядерным синтезом, от моделирования турбулентности плазмы до разработки материалов для реакторов и совершенствования технологий для получения тритиевого топлива. Кроме того, предполагается создание цифровых двойников оборудования, что позволит снизить затраты и риски. Суперкомпьютер будет работать на ряд британских энергетических инициатив, включая программу LIBRTI (Lithium Breeding Tritium Innovation), призванную решить проблему производства трития, а также флагманский правительственный проект STEP, предполагающий создание прототипа электростанции на основе сферического токамака. Великобритания рассчитывает построить его в Ноттингемшире в 2040-х гг. Sunrise является частью более широкой инициативы британского правительства, предусматривающей расширение мощностей для ИИ и HPC. Ранее в 2026 году правительство страны подтвердило инвестиции £36 млн (порядка $48 млн) в суперкомпьютерный центр в Кембридже. Тем временем кампус в Калхэме, вероятно, станет центром ИИ-вычислений, связанных с исследованиями в сфере энергетики. Пока не известно, поможет ли искусственный интеллект значительно ускорить довольно медленное продвижение к созданию коммерческих термоядерных проектов. Великобритания делает ставку на то, что увеличение вычислительных мощностей поможет решить одну из ключевых задач физики, имеющих важнейшее прикладное значение. Ещё в 2025 году сообщалось, что на появление коммерческих термоядерных реакторов рассчитывает Microsoft, средства в технологию вкладывают и другие компании — например, в сентябре 2025 года Commonwealth Fusion Systems привлекла на развитие своей термоядерной программы ещё $863 млн, а NVIDIA и General Atomics создали виртуальный термоядерный реактор с помощью ИИ. Впрочем, коммерческих версий термоядерных реакторов пока не существует.

16.03.2026 [10:00], Сергей Карасёв

Selectel впервые проведет ежегодную конференцию MLечный путь в МосквеSelectel, крупнейший независимый провайдер сервисов IT-инфраструктуры в России, проведёт конференцию MLечный путь 22 апреля на площадке Connect Space в Москве. Мероприятие будет посвящено практическим кейсам, архитектурным решениям, а также экономическим аспектам внедрения и управления ИИ-проектами в бизнесе. MLечный путь — это ежегодная конференция компании Selectel, посвященная использованию искусственного интеллекта для решения бизнес-задач. Она объединяет специалистов, принимающих решения об использовании ИИ в корпоративной среде, а также инженеров, отвечающих за техническую реализацию и интеграцию моделей в IT-инфраструктуру. Мероприятие будет разделено на два параллельных направления: бизнес-трек и технический трек. В центре внимания первого трека – внедрение ИИ в бизнес-процессы и получение измеримого эффекта. Второй трек будет посвящён техническим особенностям интеграции ИИ в IT-инфраструктуру. Бизнес-трек будет интересен руководителям (CEO, СIO, CTO), аналитикам и специалистам по стратегическому внедрению ИИ. Эксперты Selectel и приглашенные спикеры расскажут о том, как в компаниях формируются решения по внедрению ИИ: сколько стоит внедрение ИИ-агентов и какие подводные камни есть в этом процессе, как составить роадмап внедрения ИИ на базе платформенных решений, а также как оптимизировать обмен знаниями в компании с помощью LLM. Технический трек ориентирован на инженеров, архитекторов и специалистов по DevOps. В программу включено обсуждение выбора серверного железа под разные ИИ-нагрузки, а также тема безопасного использования генеративных технологий. Дополнительно будет организована дискуссия о том, способен ли вайбкодинг заменить классические инструменты разработки. На площадке конференции гостей ожидает технологическая выставка с уникальными стендами и интерактивными зонами для знакомства с продуктами Selectel и партнёрами компании. Также будет организована онлайн-трансляция мероприятия. Более подробная программа — на странице мероприятия. Участие бесплатное, необходима предварительная регистрация на сайте конференции.

05.03.2026 [19:07], Андрей Крупин

Представлена российская GitOps-платформа HyperDrive для автоматизации процессов разработкиКомпания Orion soft, занимающаяся разработкой экосистемы инфраструктурного программного обеспечения для Enterprise-сегмента, выпустила новый продукт — GitOps-платформу HyperDrive. HyperDrive помогает стандартизировать динамическую инфраструктуру для процессов разработки ПО, автоматизировать типовые задачи бизнеса по созданию софтверных решений и сократить время вывода новых продуктов на рынок без увеличения штата и операционных рисков. Система позволяет командам разработки и DevOps предоставлять комплексные среды «по запросу» через веб-интерфейс или как код, управлять Kubernetes и инфраструктурными сервисами декларативно и без ручных операций. Платформа фиксирует целевое состояние инфраструктуры в коде, также следит за его параметрами и вносимыми изменениями.

Источник изображения: Flipsnack / unsplash.com Отдельный акцент в HyperDrive сделан на безопасности и соответствии требованиям регуляторов. Платформа поддерживает управление доступами, аудит, работу с секретами и сертификатами, что делает её применимой в регулируемых отраслях, где SaaS-решения невозможны. HyperDrive поставляется как готовый продукт с поддержкой и гибкой кастомизацией. Программный комплекс разворачивается в контуре заказчика и поддерживает интеграцию с CI/CD- и корпоративными системами.

23.02.2026 [20:40], Владимир Мироненко

Вовремя сбежавший в Исландию вице-президент NetApp отвертелся от суда в СШАФедеральный окружной суд США по Среднему округу Флориды отклонил «без ущерба для дальнейшего разбирательства» (without prejudice) из-за вопросов по поводу юрисдикции иск NetApp с обвинением бывшего технического директора и старшего вице-президента Йона Торгримура Стефанссона (Jón Thorgrímur Stefánsson), неожиданно скрывшегося в Исландии, в нарушении контракта и незаконном присвоении коммерческой тайны. NetApp уже подала апелляцию, уведомив об этом на прошлой неделе, сообщил ресурс Blocks & Files. История берёт начало в августе 2017 года, когда NetApp приобрела исландскую компанию Greenqloud и её ПО Qstack для оркестрации и управления облачными сервисами в гибридных облачных средах за $51 млн. Генеральный директор Greenqloud Стефанссон вместе с командой присоединился к NetApp. В июне 2025 года Стефанссон и ещё пять сотрудников Greenqloud покинули NetApp и основали Red Stapler. Через два месяца компания VAST Data приобрела этот стартап. Стефанссон стал генеральным директором по облачным технологиям в VAST Data, а пять его коллег заняли должности архитекторов и инженеров ПО. По мнению NetApp, все они фактически участвовали в разработке VAST AI OS, которая получила сходную с ONTAP Data Fabric функциональность в части работы с облаками. Причём, как считает NetApp разработать эти функции за десять недель между созданием и продажей Red Stapler никак не могла, т.е. дорогостоящие наработки были украдены у NetApp и переданы VAST Data, а Red Stapler была создана лишь для прикрытия. Стефанссон заявил, что не передавал никакую интеллектуальную собственность NetApp конкурентам, в то время как NetApp утверждала, что приобретение Red Stapler «было лишь средством конкурента для найма Стефанссона и его команды». Отметим, что сама VAST Data не указана в качестве ответчика в иске NetApp. В постановлении суда говорится, что есть два трудовых договора между Стефанссоном и NetApp, подписанных примерно в одно и то же время. Когда Стефанссон присоединился к NetApp в 2017 году, он проживал в Исландии, где отсутствует закон о неконкуренции (non-compete law). Он подписал трудовой договор и «Соглашение о конфиденциальной информации, изобретениях и неразглашении» (PIIA), которое обязывало Стефанссона передавать NetApp «любые изобретения, разработанные во время его работы, уведомлять компанию о любых изобретениях, разработанных им в течение шести месяцев после увольнения, воздерживаться от незаконного присвоения конфиденциальной и коммерческой информации NetApp и воздерживаться от переманивания сотрудников и деловых партнёров NetApp». Трудовой договор «подлежал исключительной юрисдикции судов Исландии», что было указано в пункте о выборе подсудности. При этом и соглашение PIIA также подлежало исландской юрисдикции, если оно было включено в трудовой договор. В январе 2023 года Стефанссон переехал в Орландо (Orlando, шт. Флорида) по трёхлетней визе, официально став старшим вице-президентом NetApp, в результате чего прошлый трудовой договор был расторгнут. Позже он переехал в Исландию, но затем «вернулся во Флориду, чтобы собрать вещи, подготовить дом к продаже и уладить все дела». В это время NetApp подала на него в суд, ссылаясь на соглашение PIIA, но не на трудовой договор. В итоге спор свёлся к вопросу юрисдикции. Адвокаты Стефанссона заявили, что спор должен рассматриваться в исландском суде, поскольку Флорида не обладает юрисдикцией в этом деле. Юристы настаивали на том, чтобы дело было прекращено, поскольку в трудовом договоре было указано, что юридические вопросы, касающиеся этого дела, должны решаться в исландском суде. Адвокаты также утверждали, что соглашение о предоставлении юридической помощи (PIIA) фактически объединено с трудовым договором в одном документе, что означает, что Исландия обладает общей юридической юрисдикцией. NetApp заявила, что надлежащим местом рассмотрения дела является суд Флориды, поскольку Стефанссон работал во Флориде и «ему лично вручили судебные документы, когда он добровольно находился в этом штате». Также компания утверждала, что «пункт о выборе подсудности в трудовом договоре Стефанссона неприменим к этому спору, поскольку она подала иск против Стефанссона исключительно на основании соглашения PIIA, которое имеет свои собственные положения о выборе права и подсудности». Окружной судья Джули Снид (Julie Sneed) не согласилась с аргументами NetApp, указав в постановлении, что «NetApp не доказала, что это исключительный случай, когда факторы общественного интереса в подавляющем большинстве случаев не позволяют применять пункт о выборе подсудности сторон». Она удовлетворила ходатайство Стефанссона об отклонении иска, но без ущерба для дальнейшего разбирательства в соответствии с доктриной forum non conveniens. Это означает, что суд счёл, что для рассмотрения этого вопроса есть более подходящий суд и юрисдикция. Компания NetApp заявила: «Флоридский суд отклонил иск без ущерба для дальнейшего рассмотрения исключительно по причине несоответствия подсудности, не рассматривая дело по существу. NetApp уже обжаловала это решение и предпринимает отдельные юридические действия в Исландии, чтобы обеспечить прямое и решительное рассмотрение этих вопросов».

20.02.2026 [23:37], Руслан Авдеев

«Гонка вооружений» в сфере ИИ бессмысленна — США и Китай преследуют совершенно разные целиВ ИИ уже вложено больше денег, чем потребовалось для высадки людей на Луну, а в 2026 году расходы на технологию могут достигнуть $700 млрд, почти удвоившись год к году. В США политики и бизнес часто стремятся в этой сфере «победить Китай», однако такой подход предполагает общую цель двух стран и относительную «симметрию» при её достижении. На деле цели у стран на рынке ИИ весьма разные, сообщает IEEE Spectrum. По словам Селины Сюй (Selina Xu), руководящей исследованиями и стратегическими инициативами, касающимися Китая и ИИ в офисе Эрика Шмидта (Eric Schmidt), бывшего главы Google, внимательное изучение развития ИИ в двух странах показывает, что они не стремятся в этой сфере к одним и тем же целям. Более того, они движутся совсем в разных направлениях. По мнению Сюй, США делают акцент на масштабирование, стремясь создать «общий искусственный интеллект» (AGI), тогда как для Китая важнее повышение экономических показателей и использование в реальном мире. По словам Сюй, менталитет «гонки на выживание» способен только навредить — правительства и компании будут пренебрегать необходимыми мерами безопасности для достижения мнимого «первенства». Отчасти это уже наблюдается, например, в сфере энергетики, где администрация президента США продвигает «атомные кампусы» с ослабленными требованиями к безопасности АЭС. Сам Шмидт уже предупреждал об опасности стремления США к доминированию в области ИИ. По мере развития систем машинного обучения в 2010-х гг., видные общественные деятели вроде Стивена Хокинга и Илона Маска уже предупреждали, что универсальный потенциал ИИ невозможно будет отделить от военного и экономического — повторяется модель конкуренции времён Холодной войны. По мнению некоторых экспертов, концепция такого «состязания» выгодна передовым лабораториям, инвесторам и СМИ, которым просто удобнее оперировать простыми метриками успеха вроде размера моделей, контрольных показателей и большей вычислительной мощности. В парадигме «гонки вооружений» «общий искусственный интеллект» — и есть «финишная линия», победителем станет тот, кто первый её достигнет. Тем временем, как считают эксперты, нет никакой гарантии, что страна, создавшая AGI, станет именно победителем и её интересы восторжествуют, поскольку такой искусственный интеллект будет умнее людей и, следовательно, неуправляемым и непредсказуемым. Кроме того, Китай и США совсем-по разному подходят к реализации ИИ-проектов и экономические условия этих стран кардинально отличаются. После десятилетий быстрого роста КНР столкнулась с экономическим спадом, поэтому страна стремится найти новый «двигатель экономики». Вместо того, чтобы вкладывать ресурсы в «спекулятивные» модели развития искусственного интеллекта, Поднебесная рассматривает ИИ как инструмент, позволяющий совершенствовать действующие отрасли, от здравоохранения до энергетики и сельского хозяйства, как инструмент, улучшающий жизнь обычных людей. Для этого ИИ внедряется в производство, логистику, энергетику, финансы и госуслуги. Автопроизводители активно внедряют роботов на заводах с минимальным участием людей, по имеющейся статистике на 2024 год в КНР использовалось впятеро больше промышленных роботов, чем в США. Сельскохозяйственные модели помогают фермерам, в здравоохранении ИИ-инструменты помогают врачам ставить диагнозы и лечить пациентов и др. Даже очень маленькие предприятия изучают возможность использовать ИИ для повышения производительности. В США ИИ-модели тоже внедряются в разные отрасли всё чаще, но основной акцент делается на сервис и обработку информации с применением больших языковых моделей (LLM). Они применяются для обработки неструктурированных данных и автоматизации коммуникаций. Например, банками используются помощники на основе LLM для помощи в управлении счетами пользователей и обработки их рутинных запросов, LLM помогают врачам извлекать ключевые данные из медицинских записей и клинической документации. По словам отраслевых экспертов, LLM больше подходят для экономики США, ориентированной на сферу услуг, чем для китайской индустриальной экономики. Конечно, Китай и США конкурируют в некоторых областях, связанных с ИИ, в частности, касающихся разработки и производства полупроводников для обеспечения работы искусственного интеллекта. Также обе страны стремятся обрести контроль над цепочками поставок для обеспечения национальной безопасности. Китай, безусловно, стремится избавиться от зависимости от американских чипов. Важной сферой для конкуренции является ИИ для военного применения, поскольку та или иная сторона может получить преимущества в плоскости отдельных военных технологий. При этом Китай всё ещё не подобрал «фаворита» для военного и промышленного сектора. После триумфального дебюта DeepSeek в 2025 году, главный получатель средств для разработки «общего искусственного интеллекта» так и не выбран, а вкладывать все средства в AGI страна, похоже, не планирует, поскольку это слишком рискованно. На деле американские и китайские компании до сих пор сотрудничают, несмотря на постепенное «разделение» экономик двух стран. Фактически, по мнению Сюй, для создания безопасного и заслуживающего доверия ИИ было бы лучше, чтобы исследователи и политики США и КНР наладили диалог и достигли консенсуса относительно того, что запрещено, а потом конкурировали бы в этих рамках. В концепции «гонки вооружений» упускается из виду реальная ситуация на местах, обмен опытом между компаниями, обмен научными данными, переток талантов с одного рынка на другой и то, насколько тесно переплетены экосистемы двух стран в целом. |

|