Лента новостей

|

08.11.2024 [23:37], Владимир Мироненко

На льготное кредитование строительства ЦОД денег не нашлось, но Минцифры РФ планирует привлечь дополнительные источникиНесмотря на то, что в мае этого года глава Минцифры Максут Шадаев сообщил о планах ведомства по введению льготного кредитования строительства ЦОД с целью ускорения развития отрасли, эта мера не вошла в готовящийся нацпроект «Экономика данных». Поэтому в Минцифры считают, что необходимо привлечь дополнительные источники финансирования. В своём выступлении на CNews Forum глава министерства Максут Шадаев заявил: «…мы будем сейчас обсуждать, какие дополнительные источники мы можем задействовать для того, чтобы ее профинансировать. Пока нет, но это у нас в периметре активных задач». По данным «Интерфакса» на льготное кредитование строительства ЦОД в 2025–2030 гг. министерством предлагалось выделить из бюджета 32,1 млрд руб. Министр отметил, что высокая ставка является сдерживающим фактором для ускорения строительства инфраструктуры: «Ключевая ставка, конечно, серьёзное для нас сейчас такое ограничение. Потому что понятно, что все крупные инфраструктурные объекты в основном строятся за счет заёмных средств. Конечно, при такой ставке, в общем, это, наверное, можно продолжить строить, но, конечно, это поднимет в целом тарифы на этом рынке. Как бы нам этого не хотелось».

08.11.2024 [22:36], Руслан Авдеев

1,5 ГВт по дну Чёрного моря: предложен амбициозный проект энергокабеля от Азербайджана до Венгрии

азербайджан

венгрия

возобновляемая энергия

грузия

евросоюз

кабель

лэп

подводный

румыния

сети

экология

энергетика

IEEE Spectrum сообщает, что Азербайджан предложил многонациональный проект генерации и поставок возобновляемой энергии с Южного Кавказа в Евросоюз — от Каспийского моря через Азербайджан и Грузию по дну Черного моря до Румынии и Венгрии. Все четыре страны создали совместное предприятие со штаб-квартирой в Румынии. Солнечная энергия, ветряная энергия и энергия ГЭС, генерируемая в Азербайджане и Грузии, а также энергия с оффшорных турбин в Каспийском море будет поставляться в румынскую Констанцу, а оттуда уже распределяться по Европе. Предполагается, что линия позволит поставлять до 1,5 ГВт. Необходимые кабели длиной более 1,5 тыс. км можно проложить за шесть лет. Весь проект Black Sea Submarine Cable Project (BSSC) оценивается в €3,5 млрд ($3,8 млрд), из которых до €2,3 ($2,5 млрд) можно получить в виде грантов Евросоюза, если он, конечно, согласится. Помимо электрического кабеля предполагается и прокладка ВОЛС. В Грузии речь идёт о возведении новых ГЭС, дамб и сопутствующей инфраструктуры, что может встретить сопротивление общественности. В Азербайджане большая часть поставок придётся на ветряные и солнечные электростанции, которые построят за счёт иностранных инвестиций, например, от Masdar из ОАЭ. Летом компания начала реализацию ветряных и солнечных проектов на 1 ГВт, а к 2030 году рассчитывает генерировать до 9 ГВт. Саудовская ACWA Power намерена достроить солнечную электростанцию на 240 МВт и уже заключила сделку с местным Министерством энергетики для установки оффшорных и береговых турбин мощностью до 2,5 ГВт. Сторонники проекта заявляют, что он поможет снизить мировые углеродные выбросы, обеспечит надёжные поставки энергии европейцам, а также будет способствовать модернизации развивающихся экономик на европейской периферии. Для реализации заинтересованные страны должны преодолеть ряд технических, финансовых и политических препятствий. Как заявляют представители Грузии, это очень амбициозный проект, реализация которого к 2030 году с рекомендованной ёмкостью 1,3 ГВт — весьма оптимистичный сценарий. Техническая часть во многом зависит от успеха прокладки кабеля для передачи постоянного тока высокого напряжения (HVDC) в Чёрном море. Задача непростая с учётом необходимости работ в акватории протяжённостью 1,2 тыс. км. В большинстве мест глубина превышает 2 км, а на некоторых участках немало морских мин. Для сравнения — самый протяжённый подводный энергокабель North Sea Link ёмкостью 1,4 ГВт соединяет Англию и Норвегию. Он имеет длину 720 км и залегает на глубине до 700 м. Впрочем, бывали и более амбициозные проекты. Неудавшийся проект Australia-Asia PowerLink предполагал передачу порядка 3 ГВт с огромных солнечных электростанций Северной Австралии в Сингапур по кабелю длиной 4,3 тыс. км. Проект Morocco-U.K. Power Project рассчитывает связать Великобританию с Марокко, передавая до 3,6 ГВт и по кабелю длиной 3,8 тыс. км. Похожий проект Desertec пе передаче энергии из Северной Африки в Европу провалился. А Тайвань изучает возможность прокладки подводной ЛЭП с Филиппин.

08.11.2024 [21:32], Владимир Мироненко

«Группа Аренадата» увеличила выручку за девять месяцев на 114 %Российский разработчик систем управления и обработки данных ПАО «Группа Аренадата» (Группа Arenadata) сообщил неаудированные результаты работы за девять месяцев 2024 года. С начала года по 30 сентября выручка группы увеличилась год к году на 114 %, составив 3,6 млрд руб. благодаря росту дохода от продажи лицензий, услуг технической поддержки и консалтинга текущим клиентам, а также привлечению новых клиентов. Группа отметила, что результаты за отчётный период также отражают снижение фактора сезонности B2B бизнеса в текущем году. Чистая прибыль «Группы Аренадата» составила 733 млн руб. против убытка 77 млн руб. в прошлом году. Точка безубыточности была достигнута в I полугодии 2024 года. В прошлом году с учётом сезонности группа вышла на чистую прибыль в IV квартале. OIBDA группы равняется 794 млн руб., тогда как в аналогичном периоде прошлого года у неё были убытки в 16 млн руб. По состоянию на 30 сентября у группы был отрицательный чистый долг в размере 516 млн руб., что отражает её устойчивое финансовое положение, говорится в сообщении. 1 октября группа провела IPO и теперь раскрывает промежуточные результаты по основным метрикам управленческой отчётности. За последние три года темпы роста бизнеса группы превышали 50 %. После IPO акции группы вошли в индекс IPO (MIPO), сектор РИИ (Рынок инноваций и инвестиций) Московской биржи, а также в перечень бумаг высокотехнологического сектора экономики. В настоящее время в группу входит пять компаний: «Аренадата Софтвер», «Пикодата», «Клин Дейта», «ДатаКаталог» и «Тера Интегро». Её основными акционерами являются АО «ГС-инвест» и ООО «ТС-центр» (структура ИТ-холдинга Т1).

08.11.2024 [20:52], Руслан Авдеев

Обновлённые дата-центры atNorth в Исландии помогут в выращивании зелениОператор экологичных HPC ЦОД atNorth анонсировал существенное расширение двух дата-центров в Исландии. В рамках курса на обеспечение экоустойчивости компания заключила соглашение со стартапом Hringvarmi, специализирующемся в том числе на утилизации ненужного тепла. Кампус ICE02 возле исландского Кеблавика (Keflavík) получит дополнительно 35 МВт, ICE03 в Акюрейри (Akureyri) — 16 МВт. Обе площадки располагают дополнительным пространством для дальнейшего расширения мощностей с учётом роста спроса. Обе обеспечивают PUE на уровне 1,2 и готовы к применению технологий фрикулинга и СЖО. ЦОД готовые к размещению высокоплотной HPC-инфраструктуры. Все работы по обновлению обеих площадок должны завершиться в I половине 2025 года. atNorth также заключила договор о сотрудничестве со агротехническим стартапом Hringvarmi для утилизации тепла ЦОД, которое поможет в выращивании продуктов. Стартап совместно с агрохолдингом Rækta Microfarm разместит на территории ICE03 прототип оборудования для выращивания микрозелени. В Hringvarmi заявляют, что партнёрство нацелено на развитие исландского сельского хозяйства, на снижение импорта продуктов и увеличения вклада в местную циркулярную экономику. В atNorth заявляют, что отмечает интерес к своим экобезопасным и энергоэффективным дата-центрам. Сегодня её клиентами являются Crusoe, Advania, RVX, DNV, Opera, BNP Paribas, Tomorrow.io и др. Гиперскейлеров и других клиенов с ресурсоёмкими задачами привлекает качество инфраструктуры и выгодное географическое положение Исландии. Климат здесь прохладный, есть много возобновляемой энергии, каналов связи и квалифицированных кадров. atNorth управляет семью ЦОД в четырёх странах Северной Европы. Ещё четыре кампуса находятся в стадии строительства: финские FIN02 (Хельсинки) и FIN04 (Коувола) и датские DEN01 (Баллеруп) и DEN02 (Варде).

08.11.2024 [15:53], Владимир Мироненко

Oracle готова выкупить долги российской «дочки», но с большим дисконтомOracle выразила готовность выкупить долги своей российской «дочки», но со значительным дисконтом, пишет ресурс РБК. О согласии Oracle на выплату долга заявил представитель компании на судебном заседании 6 ноября. По его словам, выплата долгов российским кредиторам стала возможной после получения компанией лицензии регулирующего органа. Представитель также сообщил, что по поручению Oracle кредиторам были разосланы письма, в которых сообщается о готовности американской корпорации выкупить требования к своей российской «дочке» «Оракл компьютерное оборудование» не более чем за 60 % от номинала. Также указано условие сделки — отказ кредиторов от любых новых требований к российскому юрлицу. Общая сумма долга российской «дочки» Oracle перед кредиторами составляет более 1,4 млрд руб., то есть сумма выплат может составить 840 млн руб., или около $8,5 млн по текущему курсу. Среди кредиторов Oracle в России есть компании, попавшие под блокирующие санкции США.

Источник изображения: Oracle В письме сообщается, что «разрешение на выкуп части долга удалось получить по итогам нескольких месяцев взаимодействия с регулятором». Также указано, что, согласно выданному разрешению регулятора, максимальная сумма, как и другие условия, не могут меняться. При этом «по регуляторным причинам и с учётом позиции зарубежных консультантов компания пока считает другие опции (в том числе вариант с заключением мирового соглашения по закону о банкротстве) недоступными». По словам источника РБК, в письме Oracle речь может идти о получении лицензии Управления по контролю за иностранными активами США (OFAC). По словам экспертов, зарубежные компании обычно предпочитают «забыть» о российских «дочках» с долгами.

08.11.2024 [15:08], Руслан Авдеев

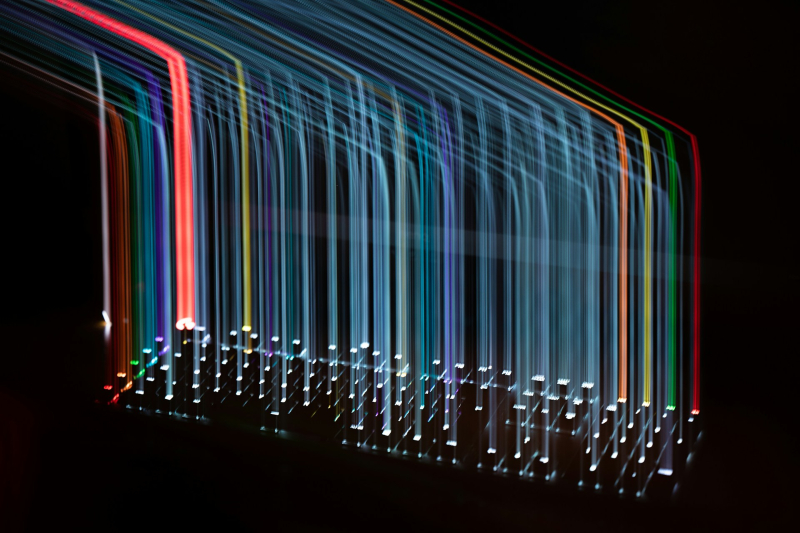

Франция выкупила у Nokia производителя и прокладчика подводных интернет-кабелей Alcatel Submarine NetworksФранцузское государство стало владельцем «стратегически важной» компании. Le Monde сообщает, что производитель и прокладчик подводных телекоммуникационных кабелей Alcatel Submarine Networks (ASN), ранее принадлежащий Nokia, перешёл в собственность Франции. Представители французского правительства подписали соответствующее соглашение с Nokia в Кале на севере Франции 5 ноября — там расположен завод ASN. Переговоры о продаже начались летом этого года. Переход прав обошёлся Франции в €100 млн, но при этом государство также обязалось взять на себя обязательства по долгу ASN в размере €250 млн. Nokia временно сохранит в предприятии долю в 20 %, но в дальнейшем местное государственное агентство APE выкупит и её, хотя условия пока неизвестны. Покупка не затронет французский бюджет 2025 года — средства будут выделены из специального правительственного фонда. Завод ASN попал в распоряжение финской компании в 2015 году после покупки Alcatel-Lucent, после чего в Nokia ещё два года размышляли о будущем полученного актива. По данным журналистов, французские власти не хотели, чтобы предприятие попало «не в те руки», поскольку в правительстве назвали производство «стратегическим».

Источник изображения: ASN Сегодня 99 % международного интернет-трафика проходит через более 480 кабелей, проложенных по дну морей и океанов. Обычно они принадлежат телеком-операторам, а в последние годы и гиперскейлерам. Береговая линия Франции стала её естественным преимуществом — страна является одним из «нервных узлов» Сети. Четыре трансатлантических кабеля, связывающих Европу с США, имеют здесь посадочные станции. А в Марселе есть сразу 18 станций, связывающих Азию и Африку. ASN — единственный европейский производитель подводных оптоволоконных телеком-кабелей. Компании принадлежит около трети мирового рынка наряду с американской SubCom и японской NEC. Она отвечала за производство всех кабелей, связывающих Африку, включая кабельную систему Meta✴ 2Africa протяжённостью 45 тыс. км, которая связывает Европу, Азию и Африку и имеет посадочные станции в 33 странах. Кроме того, бывшее дочернее предприятие Nokia имеет семь судов, два из которых применяются для ремонта и обслуживания кабелей. В этой сфере Франция также может рассчитывать на помощь Orange Marine — специализированное подразделение телеком-оператора Orange S.A.

08.11.2024 [14:31], Андрей Крупин

Вышел релиз СУБД «Ред база данных 5.0» c улучшенными возможностями администрирования и оптимизации баз данныхКомпания «Ред софт» сообщила о выпуске новой версии системы управления базами данных «Ред база данных 5.0», построенной на базе кроссплатформенной реляционной СУБД Firebird и зарегистрированной в реестре российского ПО. Система управления базами данных «Ред база данных» соответствует принятым в IT-отрасли стандартам и может быть задействована в проектах различного масштаба: от встроенных аппаратных комплексов и решений для небольших организаций до IT-систем крупных корпораций с размерами баз данных до десятков терабайт и десятками миллионов транзакций в день. В состав дистрибутива СУБД входят серверный модуль (с исполняемыми и исходными кодами), дополнительные компоненты, средства инсталляции, настройки и администрирования программной платформы.

Источник изображения: rdb.red-soft.ru Среди ключевых нововведений СУБД «Ред база данных 5.0»: табличные пространства, поддержка формата JSON, профайлер SQL- и PSQL-кода, возможность параллельного выполнения операций резервного копирования, восстановления и сборки мусора, поддержка частичных индексов, улучшенный оптимизатор запросов, кеш компилированных запросов, улучшенный алгоритм сжатия записей, новые функции и пакеты для работы с BLOB, поддержка синхронно-асинхронного режима репликации. В дополнение к вышеперечисленному разработчики реализовали в продукте планировщик заданий, в также дополнительные возможности для организации безопасной работы с данными и администрирования программного комплекса. «Ред база данных 5.0» соответствует новым требованиям по безопасности информации к системам управления базами данных, утверждённым приказом ФСТЭК России №64 от 14 апреля 2023 года, по 4 классу защиты и 4 уровню доверия. Сертификат соответствия действителен до 8 октября 2028 года.

08.11.2024 [14:27], Руслан Авдеев

В погоне за ИИ: капитальные затраты гиперскейлеров в 2025 году составят $300 млрдФинансовый гигант Morgan Stanley прогнозирует капитальные затраты гиперскейлеров в 2025 году на уровне $300 млрд. По данным Seeking Alpha, основные затраты придутся на Amazon, Google, Microsoft и Meta✴, рост расходов связан с повышенными инвестициями в ИИ. В Morgan Stanley рассчитывают, что Amazon и Microsoft станут лидерами «гонки капиталовложений» и потратят $96,4 млрд и $89,9 млрд соответственно. За ними последуют Google и Meta✴ с $62,6 млрд и $52,3 млрд. Ранее в этом месяце появилась информация о том, что капитальные затраты этих четырёх компаний превысят в 2024 году $200 млрд, рост год к году составит 50 %. Согласно докладу экспертов Morgan Stanley для инвесторов, Google и Microsoft смогут добиться значительного роста в долгосрочной перспективе благодаря активному использованию ИИ в своих продуктах и услугах, в частности, в поиске и YouTube. Это должно привести к увеличению в ближайшие годы доходов и повышению рыночной стоимости этих компаний.

Источник изображения: Alvin Mahmudov/unsplash.com По словам представителя Morgan Stanley Брайана Новака (Brian Nowak), Amazon, которая, как ожидается, потратит больше всех в 2025 году, за счёт высокой маржинальности бизнеса сможет обеспечивать хороший уровень прибыли, продолжая при этом инвестировать в развитие бизнеса. Облачные технологии, как утверждается, находятся в многолетнем цикле постепенного и устойчивого внедрения. Хотя гиперскейлеры всё больше делают ставку на ИИ, далеко не все уверены, что такие вложения окупятся. Ранее в этом году исследователи Goldman Sachs предупредили, что крупные технологические компании увеличили капитальные затраты для поддержки развития ИИ-технологий, но до сих пор не продемонстрировали устойчивых бизнес-моделей для возврата инвестиций. По оценкам, в следующие несколько лет на дата-центры, полупроводники, сети и прочую ИИ-инфраструктуру будет потрачено около $1 трлн, но пока непонятно, обеспечит ли это такую финансовую отдачу, на которую надеются инвесторы. Похожего мнения придерживается и Sequoia Capital.

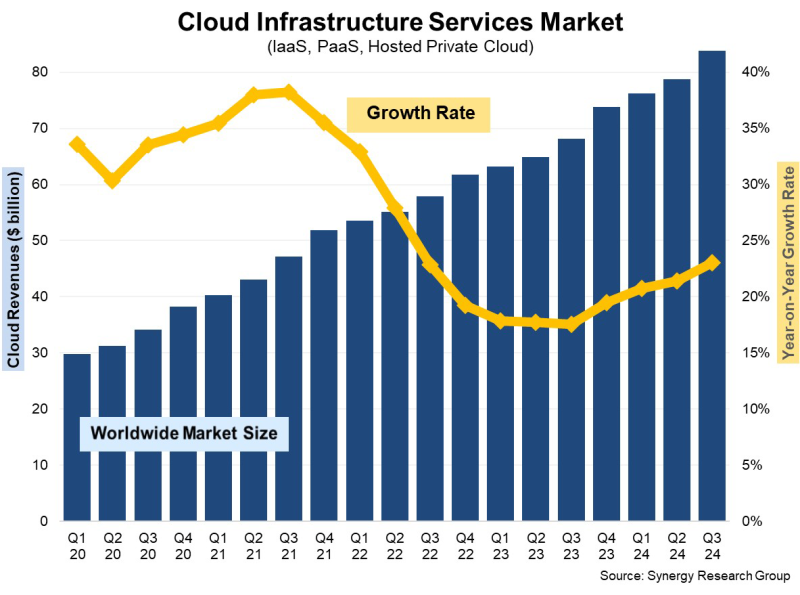

08.11.2024 [12:56], Сергей Карасёв

Квартальный объём мирового рынка облачных инфраструктур вырос почти на четвертьКомпания Synergy Research Group обнародовала результаты исследования глобального рынка облачных инфраструктур: отрасль продолжает стремительно развиваться, а её основным драйвером является генеративный ИИ. Причём темпы роста увеличиваются четвёртый квартал подряд после снижения в 2022–2023 гг. на фоне ухудшения геополитической обстановки и макроэкономической ситуации. В III четверти 2024 года затраты на рассматриваемом рынке достигли $83,8 млрд. Это практически на четверть, или на 23 %, больше по сравнению с результатом годичной давности. В абсолютном выражении прибавка составила примерно $15,7 млрд. Ведущие облачные платформы продолжают наращивать выручку. Доли Amazon Web Services (AWS), Microsoft Azure и Google Cloud составили 31 %, 20 % и 13 % соответственно. Таким образом, по итогам III квартала 2024 года эти компании сообща заняли практически две трети (64 %) глобальной отрасли. Среди поставщиков облачных услуг второго эшелона самые высокие темпы роста в годовом исчислении показали Oracle, Huawei, Snowflake и Cloudflare. На публичные сервисы IaaS и PaaS приходится основная часть выручки, а рост в этих сегментах в III квартале 2024-го оказался на отметке 24 %. В секторе публичных облаков доминирование AWS, Microsoft Azure и Google Cloud ещё более заметно: их суммарная доля оценивается в 68 %. С географической точки зрения рынок продолжает развиваться во всех регионах мира. При оценке в местных валютах наиболее сильный рост показали Индия, Япония, Бразилия и Италия: у них всех показатель превысил среднее значение по отрасли. США остаются крупнейшим рынком облачных услуг, размер которого существенно превосходит затраты в Азиатско-Тихоокеанском регионе. Расходы в США в III квартале 2024 года поднялись на 23 %. В Европе крупнейшими рынками облачных услуг являются Великобритания и Германия, тогда как самые высокие темпы роста продемонстрировали Ирландия, Италия и Испания.

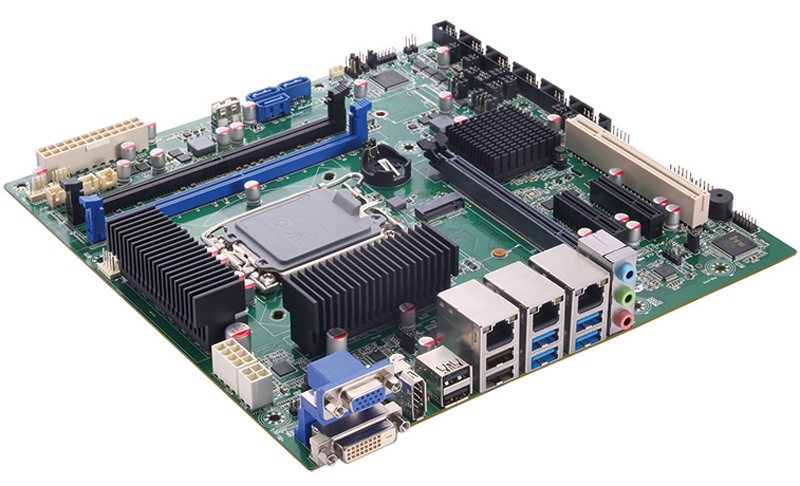

08.11.2024 [12:51], Сергей Карасёв

Axiomtek выпустила плату MMB541 формата Micro ATX для Intel Core Raptor LakeКомпания Axiomtek анонсировала материнскую плату MMB541 на платформе Intel, предназначенную, по словам создателей, для создания ИИ-систем, платформ промышленной автоматизации и других индустриальных решений. Новинка выполнена в форм-факторе Micro ATX с размерами 244 × 244 мм. В основу положен набор логики Intel H610; допускается установка процессоров Core 14-го поколения (Raptor Lake) в исполнении LGA 1700 с показателем TDP до 125 Вт. Предусмотрены два слота для модулей DDR4-3200 non-ECC; максимально поддерживаемый объём ОЗУ составляет 64 Гбайт. Плата получила один коннектор M.2 Key M 2280/2242 для SSD с интерфейсом SATA-3, а также три стандартных порта SATA-3 без поддержки RAID. Для карт расширения доступны один разъём PCIe 4.0 x16, два слота PCIe 3.0 x2, а также один 32-битный слот PCI. В оснащение входят сетевые адаптеры Intel I226-V (один порт 2.5GbE) и Intel I210-AT (два порта 1GbE).

Источник изображения: Axiomtek Изображение может выводиться на три монитора через интерфейсы DisplayPort (до 4096 × 2160 пикселей; 30 Гц), DVI-D (1920 × 1200 точек; 60 Гц) и D-Dub (до 1920 × 1200 пикселей; 60 Гц). В набор разъёмов входят по четыре порта USB 3.2 Gen1x1 (USB 3.0) Type-A и USB 2.0 Type-A, три гнезда RJ45 для сетевых кабелей и набор аудиогнёзд на 3,5 мм. Через коннекторы на плате можно задействовать ряд последовательных портов (4 × RS-232, 1 × RS-232/RS-485/RS-422 и 1 × RS-232/RS-485), а также пять портов USB 2.0. Опционально может быть добавлен модуль TPM 2.0. Диапазон рабочих температур простирается от 0 до +60 °C. |

|