Материалы по тегу: ии

|

06.03.2026 [12:37], Руслан Авдеев

На просвет не видно, чьё: кабели с иностранным оптоволокном предложено временно считать российскимиМинпромторг РФ выступил с предложением отложить обязательное использование российского оптоволокна в кабелях ВОЛС на два года, сообщает «Коммерсантъ». В ПП №719 указаны параметры, при которых продукция признаётся российской. В этом случае производители могут включать её в реестр Минпромторга, что, например, позволяет участвовать в государственных закупках. Требование подтверждать отечественное происхождение оптоволокна министерство предложило перенести на 2028 год. Предлагается считать с 1 июня 2026 года российским кабель, выпущенный в стране из иностранного оптоволокна. Утверждается, что единственный в ЕАЭС завод по выпуску оптоволокна «Оптиковолоконные системы» (ОВС) в Мордовии приостановил производство в результате повреждения оборудования, а запасы на складах подходят к концу. Восстановление производства вероятно в декабре 2027 года. Не исключено, что к 2028 году потребности рынка удовлетворить отечественным волокном в полной мере не удастся. По данным «Коммерсанта», новый проект постановления способен расширить количество предприятий, которые могут подтвердить российское происхождение продукции для включения в реестр. По данным ассоциации «Электрокабель», пока существующее требование об обязательном использовании российского оптоволокна невыполнимо и сейчас оно блокирует закупки оптоволоконных кабелей для критически важных систем связи, энергетического комплекса и др.

Источник изображения: Compare Fibre/unsplash.com До приостановки производства, по некоторым оценкам, доля продукции ОВС на российском рынке составляла порядка 30-40 %, общие мощности компании обеспечивали выпуск 4 млн км оптоволокна в год, хотя стране требуется не менее 20 млн км. По имеющимся данным, оптоволокно зарубежного, преимущественно китайского, производства уже кратно подорожало в последнее время. По словам экспертов, современный объём потребления оптоволокна в России в рыночных целях составляет около 15 млн км ежегодно, из них на выпуск кабелей уходит около 2 млн км. В случае, если отсрочка будет одобрена, заводы смогут продолжить своевременный выпуск кабелей и обеспечат выполнение программы госзакупок, но решение носит временный характер и «фиксирует» зависимость страны от импорта до 2028 года.

06.03.2026 [08:58], Руслан Авдеев

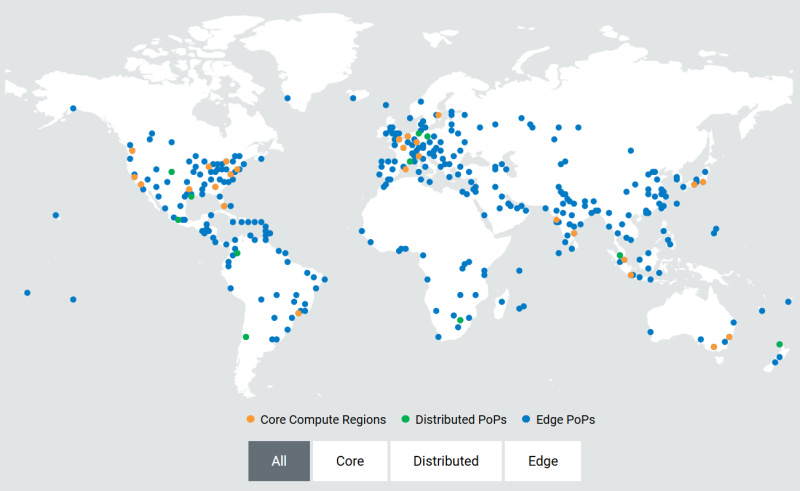

Akamai развернёт тысячи ускорителей NVIDIA RTX Blackwell для распределённого инференсаОблачный провайдер Akamai анонсировал покупку «тысяч» ИИ-ускорителей для развития своей распределённой облачной инфраструктуры по всему миру. Развёртывание новых чипов позволит создать единую оптимизированную ИИ-платформу для быстрого и распределённого инференса в глобальной сети Akamai. По словам компании, она готовит базовую инфраструктуру для «физического» и «агентного» ИИ, где решения необходимо принимать в режиме реального времени. Ранее компания анонсировала проект Akamai Inference Cloud. Как заявляет Akamai, пока крупные облачные бизнесы расширяют проекты обучения ИИ, компания сосредоточилась на удовлетворении потребностей эпохи инференса. Централизованные ИИ-фабрики имеют важное значение для создания моделей, но для их масштабной эксплуатации необходима децентрализованная «нервная система». Внедрение NVIDIA Blackwell в распределённая инфраструктуру, как ожидается, позволит ИИ взаимодействовать с «физическим» миром на местах — с системами автономной доставки, умными энергосетями, роботами-хирургами, антифрод-системами т.п. — без географических и финансовых ограничений, характерных для классических облаков. Интеграция ускорителей Blackwell обеспечит:

Предоставляя инструментарий для выполнения задач ближе к конечным пользователям, Akamai обеспечивает высокую пропускную способность и, как утверждается, одновременно снижает задержку до 2,5 раз. Это позволит бизнесам экономить до 86 % на инференсе в сравнении с обычными облачными компаниями-гиперскейлерами. Платформа объединяет серверы на основе ускорителей NVIDIA RTX Pro 6000 Blackwell Server Edition с DPU NVIDIA BlueField-3 и распределённую облачную инфраструктуру Akamai с 4,4 тыс. точек присутствия. Cloudflare применяет платформу с «бессерверным» инференсом в более чем 200 городах. Её Workers AI обеспечивают глобальный инференс с задержкой менее 100 мс без специального выделения кластеров ускорителей. Fastly применяет платформу периферийных вычислений, но предлагает меньшее количество локальных точек присутствия (PoP) для выполнения задач на GPU/CPU.

06.03.2026 [01:05], Владимир Мироненко

Планирование пошло не по плану: аналоги ERP SAP и Oracle причислили к КИИВ России признали ERP-системы, аналогичные продуктам зарубежных SAP и Oracle, объектами критической информационной инфраструктуры (КИИ). Распоряжением правительства №360-р они были добавлены в единый перечень из 397 типовых отраслевых объектов КИИ. Они прямо включены в перечень объектов КИИ для химической, металлургической, горнодобывающей, ракетно-космической и оборонной промышленности, сообщил «Коммерсантъ». Ресурс отметил, что решение правительства формализует принятые ранее отраслевые перечни (с 2024 года) и обязывает предприятия проводить категорирование ERP, усиливать их защиту по требованиям ФСТЭК, что влечёт за собой дополнительные расходы. Также включение в перечень стимулирует к переходу на отечественные аналоги вместо иностранных SAP или Oracle из-за возможных штрафов, производственных простоев и роста IT-затрат. Ранее было предложено создание национального аналога SAP, но она не нашла поддержки у бизнеса. Импортозамещение ERP-систем, в том числе в субъектах КИИ, сейчас курирует Национальный центр компетенций по информационным системам управления (НЦК ИСУ). Он предлагает поэтапный подход, чтобы минимизировать риски: сначала провести категорирование объектов с обязательным аудитом текущих платформ (включая SAP и Oracle), а затем начать миграцию на отечественные аналоги с сохранением ключевых бизнес-процессов. НЦК ИСУ отметил, что вводимые правила в итоге затруднят категорирование ERP, приведут к усложнению проектов и росту затрат на них, а причисление ERP к КИИ означает, что регулятор видит риски защищённости самих этих решений. Вместе с тем эксперты отметили, что явных требований к самим системам распоряжение правительства не добавляет, а существующие приказы ФСТЭК и других ведомств описывают лишь меры обеспечения защиты от различных угроз. Поэтому следует ожидать, что поддержка иностранных ERP-решений, которая всё ещё осуществляется без участия западных вендоров, сохранится. Как ожидается, из-за перевода в объекты КИИ затраты компаний вырастут из-за внедрения дополнительных средств защиты, сегментации сети, резервирования и пересмотра архитектуры, но основная сумма пойдёт не на лицензии, а на интеграцию, аудит и сопровождение.

05.03.2026 [22:49], Андрей Крупин

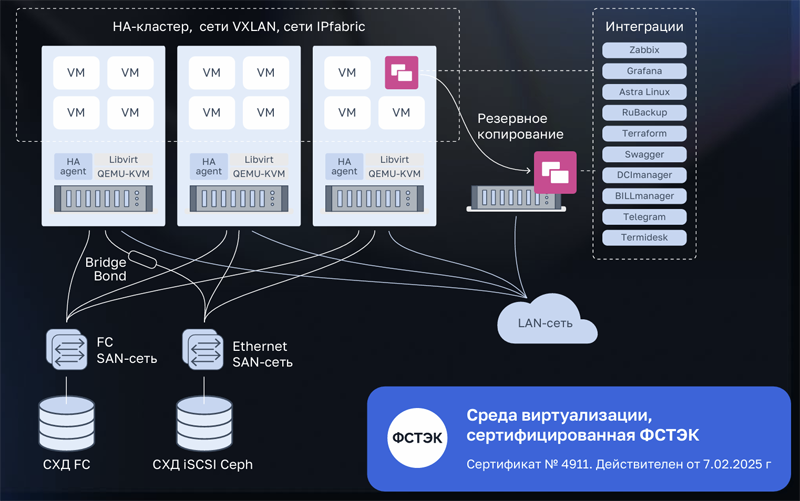

Платформа серверной виртуализации VMmanager дополнилась инструментами резервного копирования RuBackup«Группа Астра» объявила о выпуске комплексного решения, объединяющего платформу серверной виртуализации VMmanager и систему резервного копирования RuBackup. Платформа VMmanager предназначена для решения задач серверной виртуализации и построения отказоустойчивых кластеров — в её составе представлены все необходимые инструменты для создания отказоустойчивой среды виртуализации, включая High Availability, живую миграцию, автоматическую балансировку и поддержку аппаратных систем хранения данных. В свою очередь, RuBackup обеспечивает защиту обрабатываемой информации. Интеграция продуктов выполнена на системном уровне: копирование выполняется безагентно через API гипервизора без остановки приложений, с поддержкой полных, инкрементальных и дифференциальных копий при минимальном влиянии на производительность.

Архитектура платформы серверной виртуализации VMmanager (источник изображения: astra.ru) По словам разработчиков, объединение VMmanager с RuBackup даёт заказчику комплексный эффект. С одной стороны, это операционная и коммерческая эффективность: единая закупка, общая техническая поддержка и снижение совокупной стоимости владения. С другой — технологическая синергия: платформы развиваются с учётом друг друга, а их взаимодействие реализовано до уровня, когда защита данных становится естественной функцией виртуальной среды. Обе разработки имеют сертификаты ФСТЭК России и включены в реестр отечественного ПО Минцифры, что гарантирует соответствие требованиям безопасности и готовность к использованию в государственных и корпоративных проектах.

05.03.2026 [19:48], Руслан Авдеев

Nebius одобрили строительство первой гигаваттной ИИ-фабрики в США — экологичной и малошумнойКомпания Nebius приветствовала решение городского совета Индепенденса (Independence, шт. Миссури), утвердившего план стимулов для промышленного развития города, который позволяет Nebius начать строительство ИИ-фабрики мощностью 1,2 ГВт — крупнейшей для компании в США. Подчёркивается, что это первый, но не последний проект такого масштаба. Кампус рассматривается в качестве ключевого этапа роста компании в США. Проект представляет собой многофункциональный кампус на территории более 160 га. Будет создано около 130 постоянных рабочих мест для обслуживания ЦОД после его полного ввода в эксплуатацию. ИИ-фабрику оснастят замкнутой системой охлаждения, поддерживающей потребление питьевой воды всего лишь на уровне среднестатистического ресторана или офисного здания. Сообщается, что механическая система охлаждения потребует единовременного заполнения в объёме 3785 м3 на 200 МВт, из которых надо будет обновлять ежегодно около 20 %. Ещё 1,5–2,4 тыс. м3/год потребуется на нужды сотрудников и прочие задачи. Кампус спроектирован так, чтобы минимально вмешиваться в повседневную жизнь граждан. В частности, предусмотрены системы снижения шума ЦОД. Кампус получит питание от муниципальной коммунальной компании Independence Power & Light (IPL), участвующей в региональной системе Southwest Power Pool (SPP). Утверждается, что кампус спроектирован таким образом, что использование ресурсов не вызовет роста тарифов на электричество для жителей и даже стабилизирует цены. Компания обязуется обеспечить строительство необходимой инфраструктуры и будет стимулировать развитие энергосети. Строительство кампуса должно начаться во II полугодии 2026 года и будет продолжаться минимум до 2029 года. К началу 2029 года будет инициировано изучение возможности получения дополнительной энергии. Дополнительно вероятно строительство генерирующих мощностей на месте. Так, уже на первом этапе будут развёрнуты четыре резервных генератора. Загрязнение воздуха, как обещает компания, будет «незначительным». Компания обязуется осуществлять т.н. платежи вместо налогов (Lieu of Taxes, PILOT) — такие нередко выплачиваются по договорённости вместо налога на имущество. Ожидается, что это принесёт местным властям более $650 млн за 20 лет. Также соглашение предусматривает участие в школьных программах повышения грамотности в области STEM-дисциплин и ИИ, развитие трудовых резервов, поддержку местных экстренных служб и даже формирование специальной группы для взаимодействия с жителями Индепенденса. Пока дела у Nebius идут почти блестяще. Выручка в IV квартале 2025 года выросла на 547 %, за весь год — на 479 % до $529,8 млн. Впрочем, квартальные показатели оказались немного ниже прогнозов экспертов. У компании имеются крупные контракты с Meta✴ и Microsoft. Компания развивает ЦОД во Франции, Финляндии, США, Исландии, Израиле и Великобритании.

05.03.2026 [19:07], Андрей Крупин

Представлена российская GitOps-платформа HyperDrive для автоматизации процессов разработкиКомпания Orion soft, занимающаяся разработкой экосистемы инфраструктурного программного обеспечения для Enterprise-сегмента, выпустила новый продукт — GitOps-платформу HyperDrive. HyperDrive помогает стандартизировать динамическую инфраструктуру для процессов разработки ПО, автоматизировать типовые задачи бизнеса по созданию софтверных решений и сократить время вывода новых продуктов на рынок без увеличения штата и операционных рисков. Система позволяет командам разработки и DevOps предоставлять комплексные среды «по запросу» через веб-интерфейс или как код, управлять Kubernetes и инфраструктурными сервисами декларативно и без ручных операций. Платформа фиксирует целевое состояние инфраструктуры в коде, также следит за его параметрами и вносимыми изменениями.

Источник изображения: Flipsnack / unsplash.com Отдельный акцент в HyperDrive сделан на безопасности и соответствии требованиям регуляторов. Платформа поддерживает управление доступами, аудит, работу с секретами и сертификатами, что делает её применимой в регулируемых отраслях, где SaaS-решения невозможны. HyperDrive поставляется как готовый продукт с поддержкой и гибкой кастомизацией. Программный комплекс разворачивается в контуре заказчика и поддерживает интеграцию с CI/CD- и корпоративными системами.

05.03.2026 [17:00], Владимир Мироненко

В ближайшие годы Broadcom не ожидает конкуренции от ИИ-компаний в разработке чиповBroadcom утверждает, что компании в сфере ИИ не смогут в ближайшем будущем создавать и развёртывать собственные чипы, отметив, что у неё имеются заказы на разработку и поставку чипов на годы вперёд, пишет The Register. В своём выступлении по итогам I квартала 2026 финансового года, завершившегося 1 февраля, президент и генеральный директор Broadcom Хок Тан (Hock Tan) отметил 106-% рост продаж чипов для ИИ-инфраструктуры в годовом исчислении, что превысило собственный прогноз и принесло $8,4 млрд за квартал. «Рост обусловлен высоким спросом на кастомные ИИ-ускорители и сетевые решения для ИИ, — заявил Хок Тан, — Рост выручки от ИИ ускоряется, и мы ожидаем, что выручка от полупроводниковых решений для ИИ во II квартале составит $10,7 млрд». Как сообщает The Register, Тан отметил успешную работу по разработке ускорителей с пятью клиентами, добавив, что он ожидает, что Google продемонстрирует «ещё больший спрос» на микросхемы Broadcom по мере развёртывания TPU следующего поколения. Anthropic вскоре внедрит TPU на 1 ГВт, разработанные Broadcom, и по словам Тана, она планирует запустить оборудование на 3 ГВт в 2027 году. Meta✴ установит «несколько гигаватт» XPU от Broadcom «в 2027 году и позже». Также ожидается, что OpenAI развернёт «более 1 ГВт вычислительных мощностей» на основе кастомных XPU в 2027 году. Тан заявил, что Broadcom уже обеспечила себе заказы на поставки всего оборудования, включая высокоскоростную память, и удовлетворения спроса до 2028 года. И он предсказал, что Broadcom будет и дальше заключать аналогичные сделки в течение многих лет, поскольку крупные облачные провайдеры и стартапы в области ИИ не могут сравниться с ней в способности проектировать и поставлять кастомные чипы. «Они сталкиваются с огромными проблемами», — сообщил Хок Тан, имея в виду привлечение талантливых разработчиков микросхем, способных создавать чипы, оптимизированные для конкретных рабочих нагрузок, управлять производственным процессом, развивать опыт в области упаковки, а затем создавать сетевые решения для своих чипов. По словам Тана, процесс создания собственных чипов должен привести к разработке микросхем, конкурентоспособных не только с NVIDIA, но и со «всеми другими игроками». Но он не видит, чтобы это стало возможным в какой-либо крупной компании или ИИ-стартапе, «в течение многих лет». Бизнес Broadcom в сфере сетевых решений, ориентированных на ИИ, также переживает бум, увеличив выручку на 60 % год к году. Тан заявил, что в следующем году компания представит чип-коммутатор Tomahawk 7, который вдвое превысит по производительности текущую модель, и сделает то же самое для своих медных интерконнектов, а это значит, что у клиентов не будет необходимости в рассмотрении перехода на оптические сети. Общий доход группы полупроводниковых решений Semiconductor Solutions за квартал составил $12,52 млрд, что на 52 % больше, чем годом ранее и выше прогнозируемых аналитиками StreetAccount $12,25 млрд (по данным CNBC). Выручка от чипов, не связанных с ИИ, осталась на уровне $4,1 млрд. Во II финансовом квартале компания прогнозирует выручку на этом же уровне, что на 4 % больше год к году. Бизнес Broadcom по разработке инфраструктурного ПО, объединяющий CA, Symantec Enterprise и VMware, показал рост выручки на 1 %, достигнув $6,8 млрд, что ниже консенсус-прогноза StreetAccount в $7,02 млрд. При этом выручка VMware выросла на 13 %. «Наше инфраструктурное ПО не подвержено влиянию ИИ», — подчеркнул Тан, комментируя падение акций некоторых компаний из-за появления новых разработок ИИ-стартапов в сфере программирования. В отчётном квартале выручка Broadcom выросла на 29 % год к году до $19,31 млрд при консенсус-прогнозе аналитиков, опрошенных LSEG, в размере $19,18 млрд. Скорректированная прибыль на акцию (Non-GAAP) составила $2,05 при консенсус-прогнозе от LSEG в $2,03. Чистая прибыль (GAAP) выросла до $7,35 млрд, или $1,50 на акцию, по сравнению с $5,50 млрд, или $1,14 на акцию годом ранее. Во II квартале 2026 финансового года Broadcom прогнозирует выручку в размере $22,0 млрд (рост год к году на 47 %), что превышает средний прогноз в $20,56 млрд, согласно данным LSEG. Также компания прогнозирует скорректированную EBITDA в 68 %. Кроме того, согласно прогнозу Broadcom выручка группы полупроводниковых решений Semiconductor Solutions составит $14,8 млрд (рост год к году на 76 %), выручка подразделения по разработке инфраструктурного ПО — $7,2 млрд (рост — 9 %), согласно данным MarketBeat.

05.03.2026 [09:36], Руслан Авдеев

National Grid и Emerald AI успешно умерили энергетические аппетиты британского ИИ ЦОД NebiusВедущий оператор электросетей Великобритании National Grid провёл первое в стране испытание «гибкой» системы электроснабжения дата-центров при участии Nebius и с использованием ИИ-системы управления нагрузками и питанием Emerald AI. По данным Computer Weekly, эксперимент проходил с использованием кластера из 96 ускорителей NVIDIA Blackwell Ultra. В декабре 2025 года в течение пяти дней были проведены более 200 симуляций «сетевых событий» для проверки способности ПО Emerald динамически оптимизировать энергопотребление дата-центра. Платформа Emerald AI смогла подогнать энергопотребление к заданному уровню, сократить спрос на энергию до −40 % и сохранить исполнение критических нагрузок в нормальном режиме. Система успешно реагировала на скачки спроса в энергосети в перерывах во время футбольных матчей, справилась с запросом на понижение энергопотребления продолжительностью до 10 часов и отработала резкое снижение потребление (30 %) — всё для сохранения стабильности работы энергосети. По оценкам исследователей, при таком подходе ИИ ЦОД по запросу могут «высвобождать» для энергосети до 2 ГВт. Если дата-центры перестанут быть просто крупными потребителями энергии и будут «вовлечены» в работу энергосети, это позволит лучше использовать существующую инфраструктуру и поддержит подключение к сети различных источников.

Источник изображения: Toolmash Expo/unsplash.com По словам National Grid Partners, большинство энергосистем используют, вероятно, 30 % от имеющейся мощности в течение года, а пиковые нагрузки случаются довольно редко. Если присоединённые объекты могут быстро и контролируемо снижать энергопотребление по запросу энергосети, сетевому оператору не нужно будет наращивать мощности. По словам Emerald AI, эксперимент показал способность ИИ-оборудования ЦОД Nebius гибко регулировать энергопотребление в любой момент времени. Даже после получения сигнала среди ночи удалось за 30 с снизить энергопотребление более чем на треть. Система отлично подходит при питании от источников возобновляемой энергии. Например, когда ветра мало в течение восьми часов, дата-центр может снизить потребление, на 100 % сохрание питание критически важных вычислительных нагрузок. По словам Emerald AI, есть три основных способа добиться «гибкости» энергопотребления для ИИ-задач. Во-первых, можно замедлить некоторые процессы или приостановить их. Напрмиер, тонкую настройку модели обычно можно отложить на час. Во-вторых, можно перемещать рабочие нагрузки. Так, компания уже протестировала перенос генерации ответа ИИ из одного ЦОД Oracle в другой, что вызвало не такую критичную для данной нагрузки задержку примерно в 10 мс. На самом деле гиперскейлеры, включая Google и Microsoft, уже давно используют перемещение нагрузок между регионами, хотя и не с такой скоростью и с другими целями. В-третьих, можно организовать мониторинг работы ЦОД. В этом случае Emerald AI управляет рабочими нагрузками с помощью ИИ, расставляя для них приоритеты. Это оптимальный способ обеспечить энергосистеме необходимые ресурсы, при этом сохраняя для пользователя целостность рабочих нагрузок, говорит компания.

05.03.2026 [09:07], Владимир Мироненко

5G-виртуализация с ИИ-монетизацией: Broadcom представила VMware Telco Cloud Platform 9 с фокусом суверенные облака

5g

6g

vmware

автоматизация

виртуализация

ии

информационная безопасность

конфиденциальность

сети

частное облако

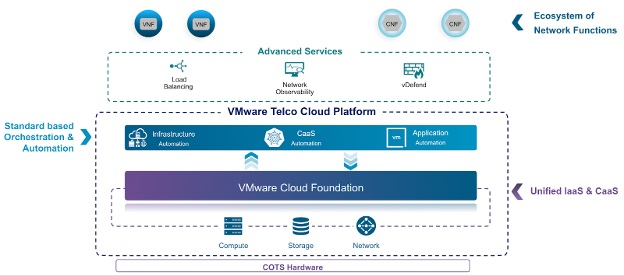

Broadcom представила VMware Telco Cloud Platform 9 — частную облачную платформу для телекоммуникационных ЦОД, которая позволит глобальным телекоммуникационным операторам повысить эффективность оборудования и снизить эксплуатационные расходы при предоставлении суверенных и ИИ-сервисов. Созданная на базе VMware Cloud Foundation 9 с дополнительными возможностями, специфичными для телекоммуникационных компаний, платформа позволит операторам добиться в течение пяти лет совокупной экономии совокупной стоимости владения (TCO) на 40 % по сравнению с изолированными архитектурами; снизить энергопотребление и связанные с ним затраты на 25–30 % за счёт повышения производительности серверов и плотности виртуальных машин. Также сообщается, что благодаря использованию Advanced NVMe Memory Tiering новая платформа позволит достичь до 38 % снижения совокупной стоимости владения (TCO) памятью и серверами, и на 38 % сократить TCO хранилища с помощью функции vSAN ESA Global Deduplication, позволяющей глобально дедуплицировать данные. Кроме того, новая платформа позволит повысить эффективность, управляемость и соответствие нормативным требованиям за счёт интеллектуальной автоматизации, интегрированного управления затратами и соблюдения политик.

Источник изображений: VMware «VMware Telco Cloud Platform 9 позволит телекоммуникационным операторам предоставлять безопасную, суверенную, ориентированную на ИИ инфраструктуру, которая способствует внедрению технологий следующего поколения, ускорению роста доходов и снижению затрат», — заявил Пол Тернер (Paul Turner), главный директор по продуктам подразделения VMware Cloud Foundation. Broadcom отметила, что VMware Telco Cloud Platform развивается, поддерживая как функции ядра сети 4G/5G, так и ресурсоёмкие рабочие ИИ-нагрузки на единой открытой платформе, позволяя операторам предоставлять суверенное облако и ИИ. С целью улучшения монетизации ИИ в Telco Cloud Platform 9 добавят такие возможности, как частный ИИ (Private AI-as-a-Service), GPU-виртуализацию (GPU Virtualization) и GPUaaS (с логической изоляцией конфиденциальных данных). Планы также включают расширенный мониторинг физических и виртуальных GPU. При реализации опции «Частный ИИ как услуга» включение собственных инструментов, таких как хранилище моделей, среда выполнения моделей и векторные базы данных, позволит операторам предлагать клиентам готовые ИИ-среды, обеспечивая при этом строгую изоляцию данных и соответствие нормативным требованиям. vGPU позволят повысить эффективность использования оборудования и снизить затраты. Благодаря этому телекоммуникационным компаниям смогут одновременно запускать высокопроизводительные рабочие нагрузки без необходимости выделения оборудования для каждого пользователя. Также платформа будет поддерживать автоматизированное управление жизненным циклом (LCM), обеспечивая разработчикам развёртывание готовых к производству частных ИИ-сред за считанные минуты, а не недели. Компания также представила «Сервис создания агентов» (Agent Builder) — Low-code платформу, которая упростит создание сложных ИИ-агентов ИИ, автоматизируя оркестрацию моделей, извлечение данных и возможности подключения инструментов. Broadcom отметила, что по мере перехода сетей к модели, ориентированной на ИИ, они должны стать самокорректирующимися и основанными на намерениях. Платформа VMware Telco Cloud Platform обеспечит возможности для автоматизации управления жизненным циклом и оптимизации энергопотребления в ядре 5G и, в конечном итоге, в 6G. Поддержка энергоэффективной инфраструктуры на базе новых процессоров и интеллектуальное планирование ресурсов позволят оптимизировать энергопотребление для энергоёмких приложений 5G и ИИ. Также планируются изменения в работе Kubernetes, с модернизированной моделью управления жизненным циклом CaaS и вариантами обновления, ориентированными на операторов связи. Broadcom внедрит унифицированную автоматизацию на основе GitOps. Планируется использование централизованной панели управления с единым интерфейсом для управления парком, контроля затрат и лицензирования. А ESX Live Patching позволит администраторам применять критически важные обновления безопасности к хостам без необходимости проведения плановых работ или нарушения работы активных ВМ. При этом ИИ-ассистенты помогут оптимизировать процесс подключения к платформе и устранения неполадок. Суверенное облако стало центральным требованием к закупкам для многих рабочих нагрузок государственного сектора и регулируемых отраслей в Европе и других странах. Broadcom заявила, что платформа Telco Cloud Platform 9 будет включать «архитектурные механизмы защиты», соответствующие суверенным требованиям, с акцентом на локальный контроль, проверку и операции в пределах границ.

Также будет использоваться централизованная панель мониторинга SecOps, обеспечена поддержка конфиденциальных вычислений в защищённых анклавах AMD и Intel, и реализовано обеспечение горизонтальной безопасности с использованием VMware vDefend для микросегментации и контроля на основе принципа нулевого доверия.

04.03.2026 [23:30], Руслан Авдеев

Aikido объединила морские ветряки с модульными ИИ ЦОДАмериканская Aikido, поставщик плавучих ветрогенераторов, представила оффшорную ВЭУ-платформу, объединённую с модульным дата-центром, рассчитанным на ИИ-нагрузки, сообщает Datacenter Dynamics. Платформа включает ветряную турбину мощностью 15–18 МВт, способную обеспечить до 10–12 МВт IT-мощности. Непосредственно под стальной оболочкой платформы размещаются три вычислительных модуля мощностью 3–4 МВт каждый. Расчётный PUE — 1,08. Платформа также получит аккумуляторное энергохранилище для обеспечения стабильности работы IT-модулей. В компании рассчитывают на доступность вычислительных мощностей не менее 75 % рабочего времени. Потенциально этот показатель может быть увеличен до 90 % путём использования более ёмких аккумуляторных систем. За охлаждение отвечает система замкнутого цикла на основе пресной воды. Тепло через стальную структуру платформы передаётся окружающей морской воде. Компания уверяет, что тепловое воздействие будет ограниченным — в радиусе всего нескольих метров от платформы. Бизнес-модель Aikido сконцентрирована не на поставках энергии, а на прямой продаже вычислений. Для масштабирования выбран модульный подход, позволяющий собирать платформы до 10 раз быстрее, чем обычные прибрежные конструкции. Кроме того, компания сообщила, что аккумуляторы можно зарядить заранее, что ускорит ввод новых мощностей. На сборку прототипа у Aikido ушло менее недели. Помещения для IT-оборудования в ходе финального монтажа в порту были подключены к системам питания и охлаждения на набережной. Теперь компания работает в Норвегии над более функциональным модулем, призванным стать «доказательством концепции». Он должен заработать в 2026 году. Первый коммерческий проект планируется реализовать в Великобритании в 2028 году. Aikido, являющаяся участником программы NVIDIA Inception, заявила её решение уже вызвало интерес у потенциальных заказчиков. Впрочем, остаются некоторые опасения в связи с состоянием рынка оффшорных ветряных электростанций. Несмотря на предварительные многообещающие результаты, на нём наметилась стагнация из-за роста стоимости. По имеющимся данным, многие проекты сегодня попросту невыгодны без государственной поддержки, так что рынок замер в ожидании более ясных «сигналов». В частности, в США эта отрасль фактически лишилась поддержки. Впрочем, Aikido рассчитывает, что её новая бизнес-модель придать новый импульс сегменту плавучих электростанций. В компании заявляют, что комбинация проверенных прибрежных ветряных энергосистем и вычислений высокой плотности позволит создать новый класс инфраструктуры, где генерация энергии, системы охлаждения и вычислительные мощности размещены в одном месте. |

|