Материалы по тегу: а

|

20.06.2022 [13:27], Владимир Мироненко

TikTok, наконец, перенёс данные пользователей из США в облако Oracle, но резервные копии по-прежнему хранит у себя

bytedance

oracle

oracle cloud infrastructure

software

tiktok

информационная безопасность

конфиденциальность

облако

сша

Видеосервис TikTok сообщил в конце прошлой недели, что в рамках т.н. Project Texas «изменил место хранения пользовательских данных в США по умолчанию» на платформу Oracle и что «100% пользовательского трафика в США направляется в Oracle Cloud Infrastructure» после длившихся более года переговоров двух компаний. Решение направлено на устранение опасений властей США по поводу того, что связи социальной сети с Китаем могут представлять угрозу для национальной безопасности страны. Объявление о переносе данных совпало (и вряд ли случайно) с публикацией итогов расследования ресурса BuzzFeed, которое показало, что сотрудники TikTok в Китае на постоянной основе получали доступ к персональным данным пользователей TikTok в США как минимум в период с сентября 2021 года по январь 2022 года. После этого TikTok сообщил, что все личные данные пользователей из США, включая номера телефонов, даты рождения и черновики видео, теперь хранятся на серверах облака Oracle. Принадлежащий китайской компании ByteDance видеосервис также сообщил, что предложил Oracle заняться разработкой протоколов управления данными, которые помогут в защите конфиденциальной информации.

Источник изображения: Pixabay По словам TikTok, резервные копии пользовательских данных TikTok из США по-прежнему хранятся на собственных серверах TikTok в Виргинии и Сингапуре, но в конечном итоге они будут удалены в рамках продолжающегося перехода на платформу Oracle. Сроки запланированного удаления копий пока неизвестны. Однако BuzzFeed сообщает, что сотрудники ByteDance в Пекине по-прежнему будут иметь доступ к публичным данным пользователей из США, включая видео, комментарии и профили, что позволит им делать выводы об интересах американцев. Напомним, что в августе 2020 года власти США выступили с угрозой запретить TikTok в США, сославшись на опасения, что правительство Китая будет использовать данные, собранные TikTok, для слежки за гражданами США. К сентябрю ими был подготовлен контракт, в рамках которого компания ByteDance, материнская компания TikTok, должна была продать миноритарную долю в видеосервисе двум американским компаниям, Oracle и Walmart, при этом Oracle брала на себя хранение данных TikTok в США. В итоге сделка была заключена, но воспользовавшись приходом к власти нового президента, ByteDance выторговала себе возможность не продавать долю в TikTok, а лишь перевести данные на хранение в облаке Oracle. Для Oracle обслуживание более чем 100 млн пользователей TikTok в США является возможностью приблизиться к конкурентам Amazon и Microsoft, взявшим под свой контроль более половины рынка. При этом для самой ByteDance сотрудничество с Oracle, похоже, не является оптимальным вариантом. В прошлом году компания стала вторым по величине арендатором ЦОД в США (суммарно 92 МВт), хотя по сравнению с 2020 годом (134 МВт) объём арендованных мощностей снизился. Ранее компания отказалась от услуг Alibaba Cloud за пределами Китая, что заметно повлияло на выручку последней. А в конце прошлого года ByteDance взялась за развитие собственной облачной платформы Volcano Engine.

17.06.2022 [17:04], Руслан Авдеев

Отголоски Brexit: фондовая биржа Euronext переехала из британского ЦОД в итальянскийФондовая биржа Euronext завершила проект по переносу своего дата-центра из британского Базилдона в кампус IT3 компании Aruba Global Cloud, расположенный в итальянском Бергамо. Миграция планировалась не первый год в связи с несколькими факторами, включая покупку итальянской Borsa Italiana Group, а также Brexit. Компания заявила о наличии «веских оснований» разместить основной дата-центр в стране, где у Euronext имеется большой бизнес. В частности, руководство биржи говорит о предсказуемой нормативной среде — после Brexit перспективы правовых отношений между Великобританией и ЕС остаются неясными. По словам руководства Euronext, миграция мощностей в Италию через год с небольшим после закрытия сделки по приобретению итальянской фондовой биржи Borsa Italiana Group является важной вехой в переносе инфраструктуры на территорию Евросоза. В 2011 году Euronext перенесла ЦОД из Парижа в Лондон, но после приняла решение уйти из Великобритании. Теперь главный ЦОД компании обслуживает 25 % объёмов общеевропейских торгов. Общая площадь дата-центра в Бергамо составит 200 тыс. м2, мощность — 60 МВт. По данным Euronext, новый дата-центр будет полностью запитан от возобновляемых источников, так что будут задествованые солнечная и гидроэнергетика, а также геотермальные источники. В ЦОД используется система динамического естественного охлаждения.

15.06.2022 [23:40], Алексей Степин

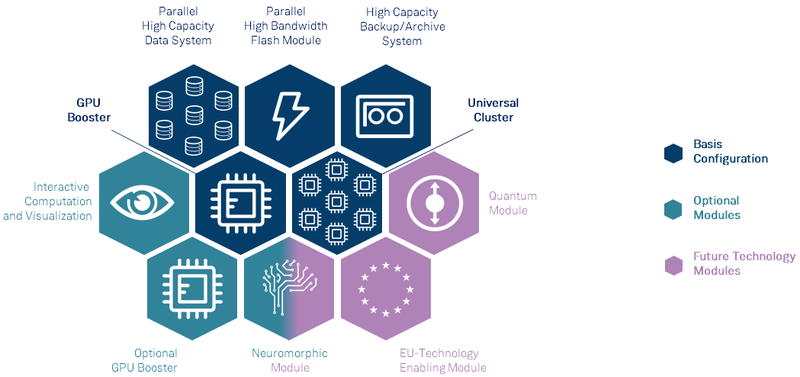

Анонсирован первый европейский суперкомпьютер экзафлопсного класса — JUPITERВсемирная гонка суперкомпьютеров экзафлопсного класса продолжается, и теперь в игру, наконец, вступил Евросоюз — консорциума EuroHPC сегодня раскрыл некоторые подробности о первой европейской система подобного уровня. Им станет машина под названием JUPITER (Joint Undertaking Pioneer for Innovative and Transformative Exascale Research), которая должна будет войти в строй в следующем году. Система будет смонтирована в Юлихском исследовательском центре (FZJ) в Германии. Сведений об аппаратной начинке JUPITER пока не так много, но в конструкции нового HPC-монстра будет применён тот же модульный подход, что был опробован на его предшественнике, суперкомпьютере JUWELS. Последний вступил в строй в 2018 году и на данный момент содержит несколько кластеров и бустеров с различной архитектурой.

Архитектура европейской экзафлопсной системы включает необычные средства. Источник: FZJ Новая система получит отдельные модули, куда входят вычислительные узлы, пулы памяти, узлы с различными ускорителями, узлы визуализации и т.д. Более того, она может быть дополнена блоками, которые содержат нейроморфные и квантовые системы, а также любые вычислительные модули, построенные на технологиях Евросоюза. Стоимость JUPITER оценивается примерно в €502 млн. Половину оплатит EuroHPC, четверть предоставит Министерство образования и науки Германии, оставшаяся четверть придётся на долю Министерства культуры и науки Северной Рейн-Вестфалии.

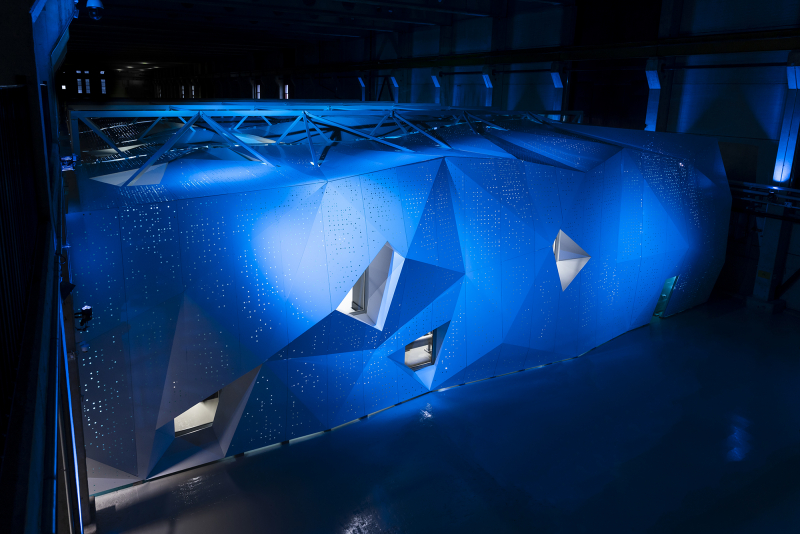

Машинный зал JUWELS. Источник: FZJ Проектировщики уделят серьёзное внимание энергоэффективности новой системы. Ожидается, что её потребление составит около 15 МВт, то есть она будет экономичнее нынешнего лидера TOP500 в лице Frontier. Для питания JUPITER планируется задействовать возобновляемые источники энергии, а СЖО будет использовать теплоноситель с относительно высокой рабочей температурой. Рассматривается возможность утилизации выделяемого системой тепла, как это реализовано в финском LUMI.

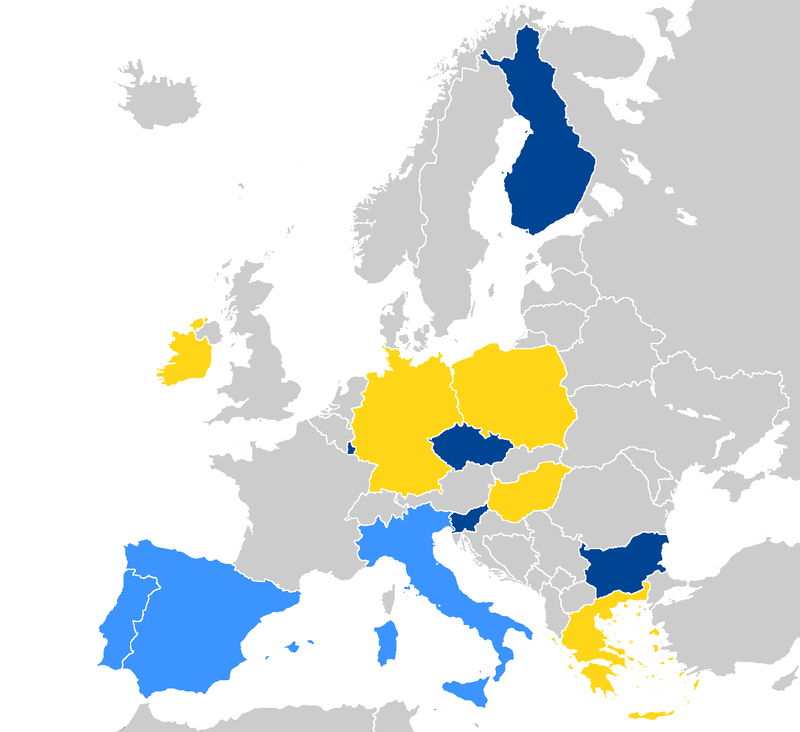

Страны, уже запустившие системы EuroHPC отмечены тёмно-синим, светло-синие — в процессе, жёлтым отмечены новички. Источник: EuroHPC Консорциум также анонсировал ещё четыре, более скромных суперкомпьютера. Это греческий DAEDALUS, венгерский LEVENTE, ирландский CASPIr и польский EHPCPL. В течение следующих нескольких лет EuroHPC планирует ввести в строй ещё минимум два суперкомпьютера экзафлопсного класса, так что гонка за зеттафлопом станет ещё интереснее. Впрочем, и Европе, и США надо опасаться в первую очередь Китая.

14.06.2022 [16:33], Владимир Мироненко

В Финляндии официально запущен LUMI, самый мощный суперкомпьютер в ЕвропеHPE и EuroHPC официально ввели в эксплуатацию вычислительную систему LUMI, установленную в ЦОД центре IT Center for Science (CSC) в Каяани (Финляндия), которая на данный момент считается самым мощным суперкомпьютером в Европе. LUMI — это первая система предэкзафлопсного класса, созданная в рамках совместного европейского проекта EuroHPC. LUMI будет в основном использоваться для решения важных для общества задач, включая исследования в области изменения климата, медицины, наук о жизни и т.д. Система будет применяться для приложений, связанных с высокопроизводительными вычислениями (HPC), искусственным интеллектом и аналитикой данных, а также в областях их пересечения. Для отдельных пользователей суперкомпьютер будет доступен в рамках второй пилотной фазы в августе, а полностью укомплектованная система станет общедоступной в конце сентября. Суперкомпьютер стоимостью €202 млн принадлежит EuroHPC (JU). Половина из этой суммы была предоставлена Евросоюзом, четверть — Финляндией, а остальная часть средств поступила от остальных членов консорциума, включающего 10 стран. По состоянию на 30 мая LUMI занимал третье место в списке TOP500 самых быстрых суперкомпьютеров мира. Сейчас его производительность составляет 151,9 Пфлопс при энергопотреблении 2,9 МВт. LUMI (снег в переводе с финского) базируется на системе HPE Cray EX. Система состоит из двух комплексов. Блок с ускорителями включает 2560 узлов, каждый из которых состоит из одного 64-ядерного кастомного процессора AMD EPYC Trento и четырёх AMD Instinct MI250X. Второй блок под названием LUMI-C содержит только 64-ядерные CPU AMD EPYC Milan в 1536 двухсокетных узлах, имеющих от 256 Гбайт до 1 Тбайт RAM. LUMI также имеет 64 GPU NVIDIA A40, используемых для рабочих нагрузок визуализации, и узлы с увеличенным объёмом памяти (до 32 Тбайт на кластер). Основной интерконнект — Slingshot 11. Хранилище LUMI построено на базе СХД Cray ClusterStor E1000 c ФС Lustre: 8 Пбайт SSD + 80 Пбайт HDD. Также есть объектное Ceph-хранилище ёмкостью 30 Пбайт. Агрегированная пропускная способность СХД составит 2 Тбайт/с. В ближайшее время суперкомпьютер получит дополнительные узлы. После завершения всех работ производительность суперкомпьютера, как ожидается, вырастет примерно до 375 Пфлопс, а пиковая производительность потенциально превысит 550 Пфлопс. Общая площадь комплекса составит порядка 300 м2, а энергопотребление вырастет до 8,5 МВт. Впрочем, запас у площадки солидный — от ГЭС она может получить до 200 МВт. «Мусорное» тепло идёт на обогрев местных домов.

13.06.2022 [16:34], Руслан Авдеев

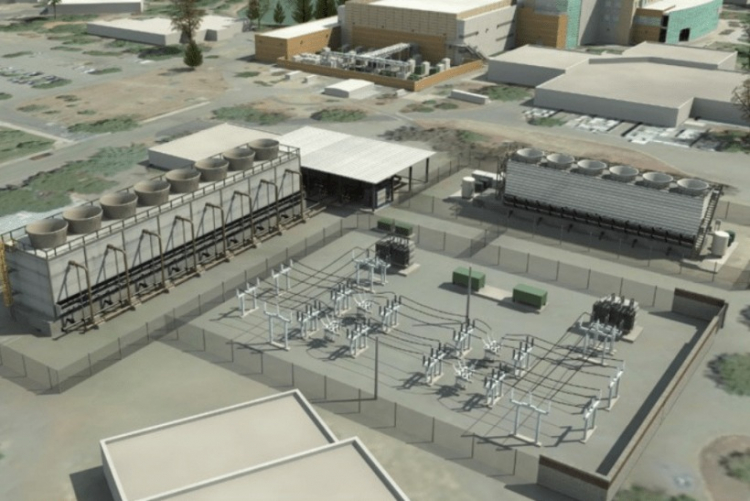

Площадка для будущего 2-Эфлопс суперкомпьютера El Capitan готова: 85 МВт + мощная система охлажденияНациональное управление ядерной безопасности (NNSA) при Министерстве энергетики США официально закончило реконструкцию ЦОД при Ливерморской национальной лаборатории (LLNL) в рамках проекта Exascale Computing Facility Modernization. Обновлены энергетическая система и система охлаждения местного вычислительного центра для использования вычислительных мощностей экзафлопсного уровня. Первой новой действующей системой NNSA станет 2-Эфлопс суперкомпьютер El Capitan, предназначенный для выполнения задач Ливерморской лаборатории, Лос-Аламосской национальной лаборатории и Сандийской национальной лаборатории. По словам представителя NNSA, экзафлопсные вычисления помогут стране в важных, неотложных проектах модернизации вооружений.

Источник изображения: Department of Energy Обновление позволит Ливерморской лаборатории выполнять ресурсоёмкие задачи, 3D-моделирование и симуляцию процессов, связанных с реализацией военных проектов — это необходимо для того, чтобы соответствовать требованиям к сертификации Программы сопровождения ядерного арсенала, реализуемой под эгидой NNSA, основной миссией которой декларируется расширение возможностей американских средств ядерного сдерживания. Сейчас стадия обновления ЦОД завершена и намечен переход к следующим этапам. В результате реализации проекта более, чем удвоилась охлаждающая мощность объекта — теперь он способен ежедневно поглощать количество тепла, достаточного для того, чтобы растопить 28 тыс. тонн льда. Энергетическая мощность ЦОД увеличена с 45 до 85 МВт, а в процессе строительства были обновили линии электропередач, подстанции и управляющее оборудование. Ожидается, что итоговая производительность El Capitan составит более 2 Эфлопс, а потреблять он будет порядка 30–35 МВт. Проработать он должен до 2029 года, однако параллельно будет строиться ещё один суперкомпьютер нового поколения. Некоторые предполагают, что подобные площадки станут последними в своём роде, в первую очередь из-за проблем с электропитанием.

30.05.2022 [10:00], Игорь Осколков

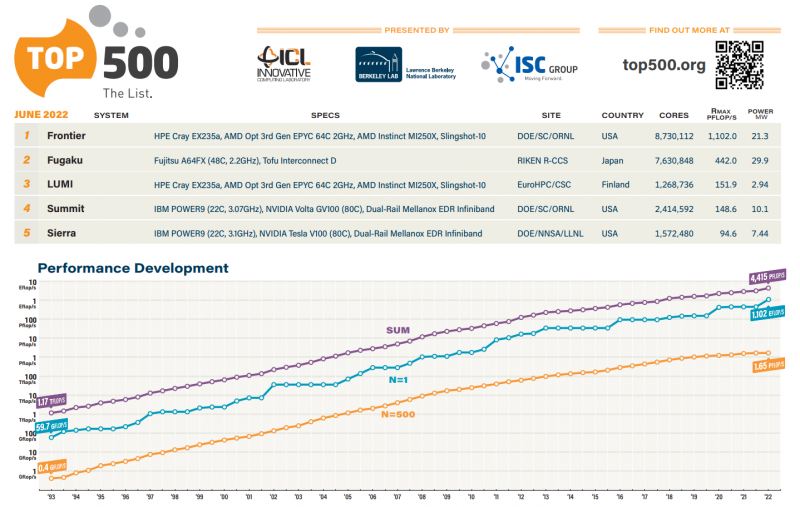

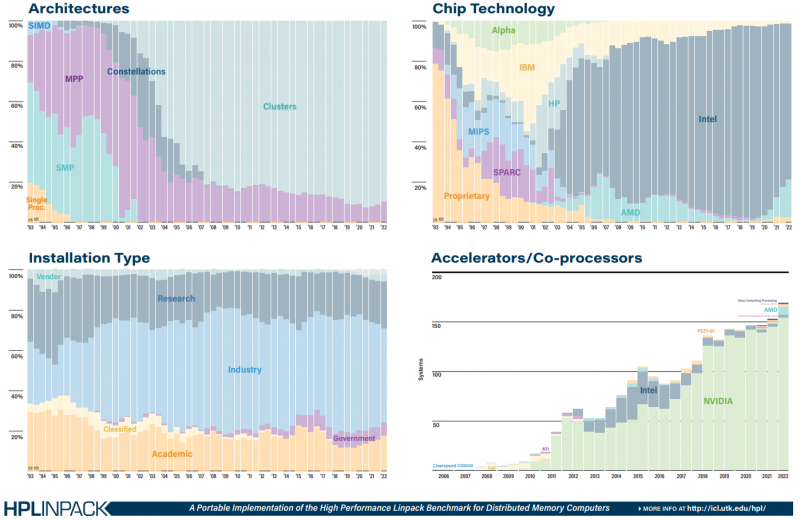

Июньский TOP500: есть экзафлопс!59-я редакция TOP500, публичного рейтинга самых производительных суперкомпьютеров мира, стала наиболее знаменательной за последние 14 лет, поскольку официально был преодолён экзафлопсный барьер. Путь от петафлопса оказался долгим — первой петафлопсной системой стал суперкомпьютер IBM Roadrunner, и произошло это аж в 2008 году. Но минимальным порогом для попадания в TOP500 эта отметка стала только в 2019 году. Как и было обещано, официально и публично отметку в 1 Эфлопс в бенчмарке HPL на FP64-вычислениях первым преодолел суперкомпьютер Frontier — его устоявшаяся производительность составила 1,102 Эфлопс при теоретическом пике в 1,686 Эфлопс. Система на платформе HPE Cray EX235a использует оптимизированные 64-ядерные процессоры AMD EPYC Milan (2 ГГц), ускорители AMD Instinct MI250X и фирменный интерконнект Slingshot 11-го поколения. Система имеет суммарно 8 730 112 ядер, потребляет 21,1 МВт и выдаёт 52,23 Гфлопс/Вт, что делает её второй по энергоэффективности в мире. Впрочем, первое место в Green500 по данному показателю всё равно занимает тестовый кластер в составе всё того же Frontier: 120 832 ядра, 19,2 Пфлопс, 309 кВт, 62,68 Гфлопс/Вт. Третье и четвёртое места достались европейским машинам LUMI и Adastra, новичкам TOP500, которые по «железу» идентичны Frontier, но значительно меньше. Да и разница в Гфлопс/Вт между ними минимальна. Скопом они сместили предыдущего лидера — экзотичную японскую систему MN-3 от Preferred Networks. Японская система Fugaku, лидер по производительности в течение двух последних лет, сместилась на второе место TOP500. Третье место у финской системы LUMI с показателем производительности 151,9 Пфлопс — обратите внимание, насколько велик разрыв в первой тройке машин. Наконец, в Топ-10 последнее место занял новичок Adastra (46,1 Пфлопс), который расположен во Франции. В бенчмарке HPCG всё ещё лидирует Fugaku (16 Пфлопс), но, судя по всему, только потому, что для Frontier данных пока нет. Ну и потому, что результат суперкомпьютера LUMI, который почти на порядок медленнее Frontier, в HPCG составляет 1,94 Пфлопс. Наконец, в HPL-AI Frontier также отобрал первенство у Fugaku — 6,86 Эфлопс в вычислениях смешанной точности против 2 Эфлопс. В общем, у Frontier полная победа по всем фронтам, и эту машину можно назвать не только самой быстрой в мире, но первой по-настоящему экзафлопсной системой. Если, конечно, не учитывать неофициальные результаты OceanLight и Tianhe-3 из Поднебесной, которые в TOP500 никто не заявил. Число китайских систем в нынешнем рейтинге осталось прежним (173 шт.), тогда как США «ужались» со 150 до 127 шт. Российских систем в списке всё так же семь. Лидерами по числу поставленных систем остаются Lenovo, HPE и Inspur, а по их суммарной производительности — HPE, Fujitsu и Lenovo. С другой стороны, массовых изменений и не было — в нынешнем списке всего около сорока новых систем. Однако нельзя не отметить явный прогресс AMD — да, чуть больше трёх четвертей машин из списка используют процессоры Intel, но AMD удалось за полгода отъесть около 4 %. При этом AMD EPYC Milan присутствует в более чем трёх десятках систем, а доля Intel Xeon Ice Lake-SP вдвое меньше, хотя эти процессоры появились практически одновременно. Ускорители ожидаемо стали использовать больше — они применяются в 170 системах (было 150). Подавляющее большинство приходится на решения NVIDIA разных поколений, но и для новых Instinct MI250X нашлось место в восьми машинах. Ну а в области интерконнекта Infiniband потихоньку догоняет Ethernet: 226 машин против 196 + ещё 40 с Omni-Path + редкие проприетарные решения.

25.05.2022 [16:02], Руслан Авдеев

Microsoft построит в США фабрику Circular Center по переработке серверов и компьютеровКомпания Microsoft подала заявку на строительство специального объекта Circular Center в городке Куинси штата Вашингтон. После ввода в эксплуатацию здесь планируется перерабатывать старые серверы и компьютеры. Городские власти пошли навстречу компании, подтвердив, что проект не должен оказать значительно негативного влияния на окружающую среду. Проект MWH90 CC предусматривает строительство здания площадью 1905 м2 для переработки бывших в эксплуатации компьютеров, серверов и комплектующих. Для этого в Куинси будет расширен и доработан кампус компании, на территории которого уже имеется функционирующий ЦОД. К 2025 году Microsoft планирует перерабатывать 90 % своего облачного оборудования, а к 2030 году этот показатель должен достигнуть 100 %. При этом в докладе за прошлый год упомянуто, что расширение инфраструктуры ЦОД и продажи Xbox привели к росту выбросов класса Scope 3 на 23 % — такие выбросы не являются прямым результатом деятельности компании, но она своей деятельностью косвенно влияет на их объёмы. Новый Circular Center будет очередным из специальных центров, строительство которых началось в 2020 году. В переработку там идут облачные серверы и прочее оборудование, причём некоторые компоненты могут быть использованы заново, перепроданы или перепрофилированы для использования в иных целях. Например, отдельные части могут использоваться даже в электронных игрушках и игровых системах. В 2020 году работу начали три Circular Center в Амстердаме, Дублине и американском Бойдтоне. В компании утверждают, что она уже получила возможность заново использовать 83 % критически важных комплектующих, снизив выбросы на 145 тыс. т. В обозримом будущем планируется строительство ещё нескольких центров аналогичного назначения по всему миру — от США до ЕС и Австралии. Прочие облачные компании, включая Google, Oracle и AWS реализуют похожие проекты, причём часть бывших в употреблении комплектующих используется в инфраструктуре самих компаний, а часть продаётся на вторичном рынке. Так, только Google и только в 2020 году продала 8,2 млн уже использовавшихся компонентов. А ITRenew, известный игрок на рынке утилизации оборудования гиперскейлеров, предлагает б/у серверы для микро-ЦОД и даже для отопления. Похожие решения есть и у Qarnot. Ранее сообщалось, что у Microsoft довольно необычный подход к защите природы. В январе появилась информация, что компания намерена вырубить более 2500 деревьев в Техасе для строительства дата-центра. В качестве компенсации компания обещала высадить более 800 новых и заплатить в фонд защиты деревьев около $1,5 млн.

24.05.2022 [14:09], Андрей Крупин

Selectel приступила к строительству в Москве нового 20-МВт дата-центра на 2 тыс. стоекКомпания Selectel, являющаяся специализированным поставщиком IT-решений на базе собственной сети дата-центров в Москве, Санкт-Петербурге и Ленинградской области, планирует ввести в эксплуатацию ещё один вычислительный комплекс. Новый центр обработки данных под названием «Юрловский» будет развёрнут в Москве и рассчитан на 2 тыс. серверных стоек. Дата-центр проектируется в соответствии с уровнем надёжности Tier IV. Основная ёмкость центра обработки данных будет задействована для предоставления облачных сервисов Infrastructure as a Service (IaaS). Особенностью ЦОД станет самый большой единый машинный зал в России площадью 4500 м2, в котором компания планирует разместить до 80 тыс. серверов. Общая подведённая мощность объекта составит 20 МВт, средняя мощность на стойку — 8 кВт. Selectel уже получила технические условия на подключение к ближайшему питающему центру с верхним уровнем напряжения 500 кВ, который расположен в 700 м от кампуса. Подключение будет выполнено по второй категории надёжности, то есть будет проложено две линии от независимых ячеек на подстанции, а между ними на стороне подстанции будет организован автоматический ввод резерва. Дата-центр «Юрловский» будет построен с применением технологии охлаждения без использования фреоновых систем, что позволит минимизировать воздействие на окружающую среду. ЦОД будет охлаждаться наружным воздухом (технология фрикулинга), а в качестве доохлаждения будут использоваться адиабатические маты. Предполагается, что эти и другие меры позволят Selectel экономить электроэнергию и занимать меньше полезной площади машинного зала. Среднегодовой коэффициент эффективности использования энергии (Power Usage Effectiveness, PUE) будет в диапазоне от 1,1 до 1,15. Таким образом, «Юрловский» станет самым «зелёным» дата-центром Selectel. В инфраструктуре дата-центра «Юрловский» будет задействована схема резервирования 6/5N — для каждой части на 1000 стоек будет выделено пять рабочих кластеров и один резервный. Фактически работать будут все шесть, но один можно в любой момент отключить. Кроме того, такой подход позволяет добиться физической изоляции резервируемых кластеров друг от друга. А автоматизации бесперебойной подачи питания и непрерывное охлаждение обеспечат возможность проводить любые профилактические и ремонтные работы без приостановки оказания услуг. Для поддержания связности новый ЦОД будет подключен несколькими независимым ВОЛС к MSK-IX (M9) и ЦОД «Берзарина», который уже имеется независимые подключения к нескольким IX. Вопрос с закупкой оборудования компания намерена решать в конце текущего года, поскольку в текущей ситуации прогнозировать что-либо затруднительно. На текущем этапе Selectel занимается проектированием и выполняет общестроительные работы. Ввод объекта в коммерческую эксплуатацию запланирован на 2023 год, однако сроки могут быть скорректированы в зависимости от ситуации на рынке. Инвестиции в проект оцениваются в миллиарды рублей.

29.04.2022 [21:35], Руслан Авдеев

Новые дата-центры Meta✴ для метавселенной будут построены из «зелёного» бетона, созданного с помощью ИИКомпания Meta✴ приступила к расширению кампуса дата-центров DeKalb в штате Иллинойс (США), которые, как предполагается, будут применяться для дальнейшего развития метавселенной. Для того, чтобы разработать материал для новых построек, Meta✴ прибегла к помощи искусственного интеллекта — специально подобранные «зелёные» компоненты позволят частично заменить традиционный бетон. Цемент является основой множества современных строительных материалов, применяемых в промышленных масштабах — по имеющейся статистике на его производство приходится порядка 8 % всех углеродных выбросов в мире. Для того, чтобы создать более приемлемую для экологии альтернативу, Meta✴ объединила усилия с Университетом Иллинойса в Урбане-Шампейне (UIUC), Массачусетским технологическим институтом (MIT) и IBM.

Источник изображения: tech.fb.com При участии системы искусственного интеллекта была обработана база данных со сведениями о характеристиках и компонентах бетонов. В результате проведённой работы была подобрана смесь летучей золы и шлака, способная частично заменить классический цемент. Полученные данные были переданы поставщику бетона — компании Ozinga, которая оптимизировала смесь исходя из своего опыта и доступности материалов, сохранив при этом необходимую прочность. Новый «зелёный» бетон, по оценкам Meta✴, обеспечивает на 40 % меньший углеродный выброс при создании. Помимо двух уже строящихся зданий для кампуса будут построены ещё три с использованием новых технологий. По имеющимся сведениям, новую смесь уже применили при строительстве второстепенных объектов. Общая площадь зданий ЦОД составит более 222 тыс. м2.

Источник изображения: tech.fb.com Как и многие штаты, Иллинойс предложил в 2019 году налоговые льготы на ЦОД-оборудование для привлечения операторов. Meta✴ так и не воспользовалась данными преимуществами, но от послаблений при расчётах налога на собственность не отказалась. После введения объектов в эксплуатацию новые ЦОД не только будут способствовать расширению метавселенной, но и обеспечат работой более 200 человек. На момент первого анонса проекта Meta✴ обещала, что кампус будет использовать 100 % возобновляемой энергии, а строения получат золотой сертификат Leadership in Energy and Environmental Design (LEED) за экологическую безопасность конструкции. Общий объёмы инвестиций в кампус в Иллинойсе составят более $1 млрд. Ранее сообщалась, что Meta✴ активно наращивает инвестиции в строительство ЦОД и сетевую инфраструктуру по всему миру.

24.03.2022 [00:23], Владимир Мироненко

IBM подала в суд на LzLabs, предлагающую дешёвую облачную альтернативу её мейнфреймамIBM подала в Окружной суд в Уэйко (штат Техас) на разработчика ПО LzLabs, заявив, что созданная им платформа Software Defined Mainframe (SDM, программно определяемый мейнфрейм) нарушает её патенты. В судебном иске корпорация утверждает, что платформа LzLabs, позволяющая выполнять приложения для мейнфреймов на стандартном оборудовании в облаке, базируется на ПО, основанном на проприетарной технологии IBM. IBM также обвинила LzLabs в том, что та делает ложные заявления о своих продуктах. Кроме того, в иске сообщается, что люди, стоящие за LzLabs, и раньше нарушали патенты IBM. Среди руководителей LzLabs оказался бывший гендиректор стартапа Neon Enterprise Software, который создал ПО zPrime, предлагающее похожую на SDM функциональность. Более того, компания сама подала в 2009 году иск к IBM, обвиняя последнюю в принуждении заказчиков пользоваться дорогими мейнфреймами. В ответном иске IBM обвинили компания в нарушении патентов, и в 2011 году продукт zPrime прекратил существования. По счастливой случайности в том же году появилась швейцарская компания LzLabs. В 2016 году она представила платформу, которая позволяла выполнять традиционные рабочие нагрузки мейнфреймов, написанные на Cobol или PL/1, на стандартных x86-серверах под управлением Linux как локально, так и в облаке. Впоследствии компания добавила поддержку контейнеров. У LzLabs есть успешные проекты — так, Swisscom перенесла на облачный вариант SDM «все критически важные бизнес-приложения» без перекомпилирования. IBM утверждает, что LzLabs, используя транслятор CPU-инструкций, нарушила два патента на решения, воплощенные в этих инструкциях. Ещё два нарушения связаны с повышением эффективности эмуляции и трансляции. Последний, пятый патент, о нарушении которого сообщила IBM, касается автоматический замены вызываемых приложений на их аналоги для x86-платформ. В своём иске IBM добивается судебного запрета на использование LzLabs интеллектуальной собственности и коммерческих секретов IBM. У IBM есть собственная платформа для разработки, тестирования, демонстрации и изучения приложений мейнфреймов IBM Z Development and Test Environment (ZD&T) на x86-системах, в том числе облачных. А недавно компания представила сервис Wazi aaS для IBM Cloud. В обоих случаях IBM прямо запрещает использовать эти решения для выполнения любых реальных нагрузок, в особенности критически важных. |

|