Материалы по тегу: схд

|

11.02.2026 [16:48], Владимир Мироненко

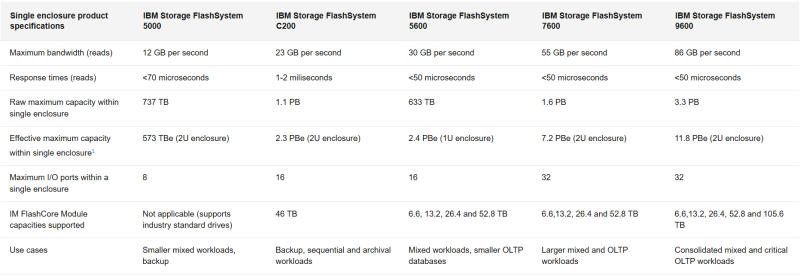

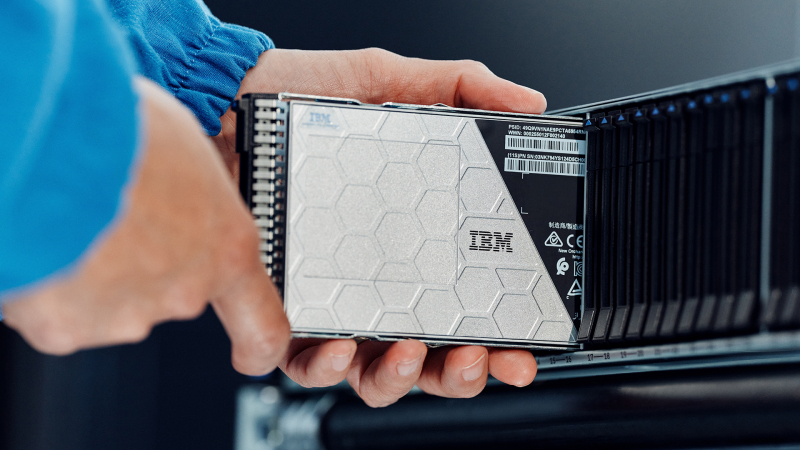

All-Flash СХД IBM FlashSystem 5600, 7600 и 9600 получили автономное ИИ-управлениеIBM представила системы хранения данных FlashSystem класса All-Flash следующего поколения 5600, 7600 и 9600, которые, как утверждается, обеспечивают до 40 % большую эффективность обработки данных, ёмкость и производительность по сравнению с предыдущим поколением. Компания назвала выход сразу трёх новых систем самым значительным обновлением FlashSystem за последние шесть лет. IBM сообщила, что расширяя существующие возможности FlashSystem с помощью агентного ИИ, она переосмысливает отказоустойчивость за счёт постоянной защиты, автономного анализа угроз и индивидуальных рекомендаций по восстановлению. Генеральный директор IBM Storage Сэм Вернер (Sam Werner) описывает новую FlashSystem как постоянно доступный интеллектуальный слой, использующий автономных ИИ-агентов для повышения производительности, безопасности и снижения затрат. Он отметил, что IBM позиционирует этот релиз как шаг к созданию СХД, которая будет служить стратегическим партнёром по ИИ для ИТ-руководителей, а не статическим хранилищем, требующим постоянного ручного контроля. FlashSystems — это классические двухконтроллерные массивы, работающие под управлением ОС SAN Volume Controller и поддерживающие блочное хранение данных. В новых системах установлен флеш-накопитель пятого поколения FlashCore Module ёмкостью до 105,6 Тбайт, разработанный для обеспечения аппаратного ускорения обнаружения программ-вымогателей в реальном времени, сокращения объёма данных, аналитики и управления, с расширенной телеметрией и стабильно низкой задержкой. Система FlashSystem 5600 ориентирована на организации, которым требуются функции корпоративного класса в компактном форм-факторе. Заявлена эффективная ёмкостью до 2,5 Пбайт, пропускная способность до 30 Гбайт/с и производительность до 2,6 млн IOPS (чтение 4K-блоками) в одном 1U-шасси. Узел включает два 12-ядерных Intel Xeon и 256 или 512 Гбайт RAM. Общее количество IO-портов не превышает 16: 10/25/40/100GbE с поддержкой iSCSI и NVMe/TCP или FC32/64 с NVMe/FC (такие же опции и у старших моделей). Система разработана для развёртывания в условиях ограниченного пространства, таких как периферийные узлы, удалённые офисы и небольшие ЦОД. IBM FlashSystem 7600 предназначена для высокопроизводительных масштабируемых сред с растущими рабочими нагрузками, обеспечивает до 7,2 Пбайт эффективной ёмкости в одной системе форм-фактора 2U, 55 Гбайт/с и до 4,3 млн IOPS. 7600 предназначена для работы с большими виртуализированными средами, аналитическими платформами и консолидированными приложениями, требующими большей ёмкости и более быстрого отклика. Узел содержит два 16-ядерных AMD EPYC и 768 Гбайт или 1,5 Тбайт RAM. IBM FlashSystem 9600 создана для критически важных операций, требующих экстремальной производительности и максимальной масштабируемости, обеспечивает до 11,8 Пбайт эффективной ёмкости в одной системе форм-фактора 2U, до 86 Гбайт/с и до 6,3 млн IOPS. Количество портов — до 32. Узлы включают два 48-ядерных AMD EPYC и 1,5 или 3 Тбайт RAM. Типичные сценарии использования системы включают основные банковские системы, ERP-платформы и приложения на основе ИИ, требующие скорости и расширенной безопасности. По данным компании, использование FlashSystem 9600 позволяет снизить эксплуатационные расходы на 57 % за счёт ИИ и консолидации по сравнению с предыдущим поколением. IBM сообщила, что IBM FlashSystem уменьшает требуемый объём хранилища на 30–75 % в зависимости от модели за счёт оптимизированного размещения и консолидации по сравнению с предыдущим поколением. У FlashSystem 7600 и 9600 есть интерактивные светодиодные панели, позволяющие отслеживать состояние системы. IBM также представила FlashSystem.ai, новый набор интеллектуальных сервисов обработки данных на основе ИИ, предназначенных для управления, мониторинга, диагностики и решения проблем на всём пути передачи данных. FlashSystem.ai обеспечивает бесперебойную работу в режиме самообслуживания, автоматизируя ручные и подверженные ошибкам задачи. Благодаря модели, обученной на десятках миллиардов точек данных, собранных с помощью расширенной телеметрии и многолетнего опыта реального работы с данными, платформа может выполнять тысячи автоматизированных решений в день, которые ранее требовали человеческого контроля. Помимо автоматизации, IBM подчеркивает адаптивное поведение СХД. Функции агентного ИИ позволяют понимать шаблоны приложений в течение нескольких часов, объяснять свои рассуждения и учитывать отзывы администраторов для улучшения предложений с течением времени. В последних FlashSystem, по утверждению IBM, FlashSystem.ai может сократить время, затрачиваемое на документацию по аудиту и соответствию требованиям, вдвое благодаря объяснимым рассуждениям ИИ. Системы разработаны для проактивной настройки и интеллектуального размещения рабочих нагрузок, обеспечивая беспрепятственное перемещение данных между конфигурациями хранения, включая массивы сторонних производителей. IBM также утверждает, что ее новый метод обнаружения угроз, обученный на десятках миллиардов точек телеметрических данных, может снизить количество ложных срабатываний до менее 1 %. Компания также заявила, что платформа, используя FlashCore, может обеспечить обнаружение программ-вымогателей и оповещение с помощью ИИ менее чем за 60 с, а также выполнить автономные действия по восстановлению на аппаратном уровне.

10.02.2026 [13:16], Руслан Авдеев

Hitachi рассматривает продажу поставщика СХД Hitachi Vantara за $1,3 млрдЯпонский транснациональный конгломерат Hitachi намерен продать своё подразделение, предлагающее решения для хранения и анализа данных. Для Hitachi Vantara рассчитывают найти покупателя, готового выложить до ¥200 млрд ($1,3 млрд), сообщает Bloomberg. Компания уже наняла консультанта по продажам и передала материалы о бизнесе Hitachi Vantara заинтересованным сторонам, вероятным потенциальным покупателем называется какая-либо частная акционерная компания. По имеющимся данным, сама Hitachi намерена сосредоточиться на более маржинальном бизнесе, чем Hitachi Vantara, вроде инициатив, связанных с передачей энергии и цифровой трансформацией. Сегодня в сферу интересов Hitachi входит энергетика (атомные и иные системы генерации, а также системы передачи), транспорт (поезда и автомобильные платформы), промышленность (индустриальное оборудование), измерительные и аналитические системы, здравоохранение, системы для зданий — лифты и эскалаторы, а также многие бизнесы, связанные с цифровыми решениями. Конечно, попадает туда и бизнес, связанный с хранением и управлением данных, включая Hitachi Vantara.

Источник изображения: Hitachi Vantara Имеется два номинально независимых подразделения Hitachi Vantara — Hitachi Vantara Ltd. в Японии и Hitachi Vantara LLC в США. Выручка Hitachi в 2025 финансовом году включала ¥475 млрд от подразделения IT Products, рост составил 7 % год к году, к этим средствам относится и выручка, связанная с СХД. Показатель EBITDA подразделения IT Products составлял 4,4 %, против 14,8 % для «материнского» бизнеса Digital Systems and Services. По данным Westgrove Research, совокупная годовая выручка бизнеса Hitachi Vantara составила ¥300 млрд ($1,95 млрд). Корнями бизнес Hitachi Vantara уходит в 1989 год, когда Hitachi и EDS приобрели National Advanced Systems у National Semiconductor и назвали новый бизнес, связанный с хранением данных, Hitachi Data Systems (HDS). Hitachi выкупила EDS в 1999 году. В результате череды дальнейших изменений в 2017 году Hitachi организовала слияние HDS с купленной компанией Pentaho, занимавшейся бизнес-аналитикой и подразделением Hitachi Insight Group, занимавшимся преимущественно Интернетом вещей. В результате и появилась Hitachi Vantara. Её массивы хранения данных корпоративного уровня Virtual Storage Platform One (VSP One) имеют хорошую репутацию и ценятся за надёжность. Тем не менее, попытки закрепиться на рынках файловых NAS и объектных хранилищ особенным успехом не увенчались, так что компании не удалось пробиться дальше «второго эшелона». Кроме того, в значительной степени компания упустила возможность массовых поставок систем для ИИ, не сумев вовремя войти в число ключевых партнёров NVIDIA в нише систем хранения данных. Компании не удалось конвертировать свой опыт в сфере монолитных высокопроизводительных корпоративных хранилищ в успешные решения среднего уровня. Предпринимались попытки освоить рынок All-Flash хранилищ, компания даже разрабатывала собственное аппаратное обеспечение для него, но по мере развития массового производства SSD и ужесточения конкуренции, отстала от компаний уровня Dell EMC. Hitachi Consulting присоединилась к Hitachi Vantara в 2020 году. Результат оказался неудовлетворительным, и в 2023 году началась реорганизация в попытках оживить бизнес, в том числе путём найма новых топ-менеджеров. Для бренда VSP One были анонсированы новые продукты, связанные с хранением данных, анонсирована поддержка публичных облачных хранилищ. Как сообщает Blocks & Files, похоже, Hitachi Vantara продолжит обычные бизнес-операции. Слабость позиций компании некоторые эксперты оценивают как результат её подчинения японской Hitachi Ltd. — в результате старшие руководители «размыли» влияние потенциально более предприимчивых лидеров из Кремниевой долины в США. Такое отсутствие успехов в сфере хранения данных преследовало и другие японские конгломераты, включая коллег из Fujitsu и NEC.

08.02.2026 [15:03], Сергей Карасёв

До 1,4 Пбайт и 60 Гбайт/с в 1U: вышла All-Flash СХД TrueNAS R60Компания TrueNAS анонсировала высокопроизводительные СХД семейства R60, ориентированные на задачи ИИ и НРС, а также на приложения, связанные с анализом данных. Устройства типа All-Flash выполнены в форм-факторе 1U, а максимальная внутренняя вместимость может превышать 1 Пбайт. Дебютировали модификации TrueNAS R60-S и TrueNAS R60-P: первая оснащена неназванным процессором с 16 вычислительными ядрами (32 потока), вторая — с 32 (64 потока). Объём оперативной памяти DDR5-6400 составляет соответственно 64–128 Гбайт и 256 Гбайт. Во фронтальной части располагаются 12 отсеков для SFF-накопителей с интерфейсом PCIe 4.0 или PCIe 5.0 (NVMe); возможна горячая замена. Могут использоваться SSD вместимостью до 122 Тбайт. Таким образом, в максимальной конфигурации суммарная ёмкость достигает 1,46 Пбайт, а с учётом компрессии 2,5:1 эффективная ёмкость составляет до 3,6 Пбайт. Пропускная способность, как утверждается, составляет до 60 Гбайт/с. Обе модели допускают подключение до четырёх дисковых полок SAS, а старшая версия — двух полок NVMe. Общая вместимость может достигать 7 Пбайт. Системы хранения оснащаются одним или двумя сетевыми портами 400GbE и двумя или четырьмя портами 200/100/25GbE. Имеется также выделенный сетевой порт управления. Питание обеспечивают два блока с резервированием (сертификация 80 Plus Titanium). Типовое энергопотребление находится в пределах 350–600 Вт. Диапазон рабочих температур простирается от +10 до +35 °C. Габариты составляют 710 × 438 × 43,5 мм. Говорится о поддержке протоколов SMB v1/2/3, NFSv3 и v4, AFP, FTP, WebDAV, iSCSI, NVMe-oF (TCP, RDMA/RoCE) и S3, а также гипервизоров KVM, Citrix XenServer, Microsoft Hyper-V. Используется открытая файловая система OpenZFS, обеспечивающая высокую надёжность, защиту от повреждения данных, моментальные снимки и автоматическое восстановление в случае сбоев. Заявлена совместимость с облачными платформами iX-Storj, Amazon S3, BackBlaze B2 Cloud, Google Cloud и Microsoft Azure.

03.02.2026 [08:38], Владимир Мироненко

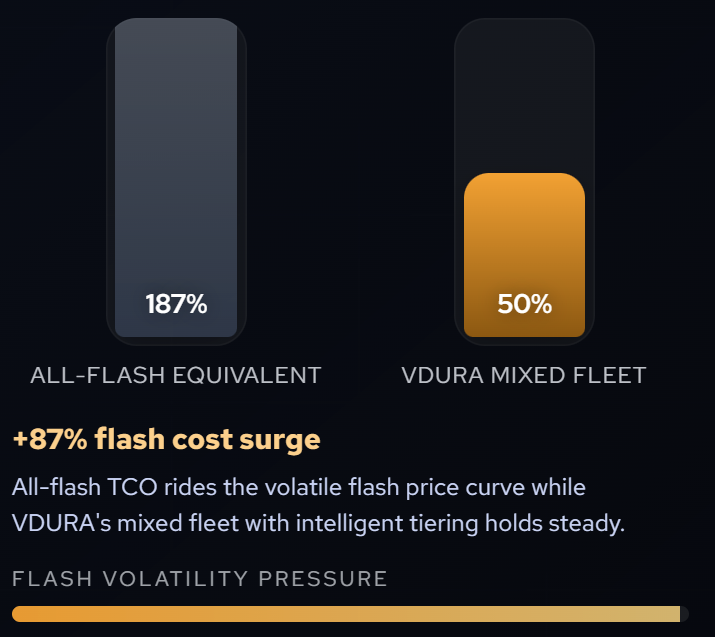

VDURA предложила программу Flash Relief Program для смягчения дефицита флеш-памятиVDURA, заявившая, что теперь SSD корпоративного класса уже в 16 раз дороже HDD аналогичной ёмкости, анонсировала программу Flash Relief Program, в рамках которой клиенты получат доступ к хранилищам, по ёмкости и быстродействию не уступающие массивам VAST Data и WEKA, но вполовину дешевле с точки зрения TCO. В условиях дефицита NAND-памяти цены на SSD выросли в два-три раза, а гибридная архитектура VDURA, использующая накопители разных типов, обеспечивает превосходную производительность и ёмкость при вдвое меньшей стоимости, заявила компания.

Источник изображения: VDURA Как сообщает VDURA, клиенту достаточно предоставить требования к конфигурации файлового хранилища VAST, WEKA или любой другой высокопроизводительной All-Flash СХД, включая требования по производительность (пропускная способность, IOPS, задержка) и требования к ёмкости (сырая, полезная, эффективная), а VDURA в течение 24 ч. предоставит конкурирующее предложение, которое:

VDURA называет следующие преимущества своего продукта:

Предложение VDURA заключается в том, что её гибридная параллельная ФС на основе SSD/HDD может компенсировать рост цен на SSD лучше, чем что-либо, предлагаемое производителями массивов All-Flash, отметил ресурс Blocks & Files. Если цены на SSD продолжат расти и не будет решена проблема дефицита, подобные заявления могут заставить потенциальных покупателей массивов All-Flash переключиться на гибридные системы СХД с автоматическим многоуровневым хранением данных. И даже использование б/у SSD, как предлагает VAST Data, вряд ли поможет в такой ситуации.

02.02.2026 [22:50], Владимир Мироненко

В 2025 году в России значительно выросли затраты на закупки серверов и СХД на фоне их удорожанияВ 2025 году российский рынок серверов и СХД вырос почти вдвое, составив 280 млрд руб. с учётом НДС (по данным YADRO), тогда как в 2024 году его объём составил 155 млрд руб. (по данным Fplus), сообщили «Ведомости». По оценкам экспертов, увеличение рынка большей частью связано с удорожанием серверов и их комплектующих. Как отметили в SNDGlobal, при росте совокупного бюджета более чем на 40 % число закупок сократилось, что говорит о повышении среднего чека на сервер или хранилище. Этого мнения придерживаются и в Fplus. По словам представителя Fplus, в реальности рост рынка в деньгах отражает лишь увеличение стоимости устройств, в то время как количество поставляемых серверов стало гораздо меньше. Одной из причин он назвал подорожание памяти, при этом в современных серверах на память может приходиться до двух третей себестоимости конечного оборудования. Также удорожание серверов в 2025 году связано с тем, что российские вендоры стали выпускать модели с дорогими иностранными GPU, добавили в ComNews Group, отметив, что на увеличение стоимости повлияло удорожание и других комплектующих — микросхем памяти или процессоров, от которых зависит примерно 30–50 % стоимости устройства. Ввиду того, что комплектующие импортные, к цене добавляется и довольно высокая стоимость логистики. Львиная доля рынка — около 55–60 % — пришлась на госзакупки по № 44-ФЗ и 223-ФЗ, уточнил представитель YADRO. По данным «Тендерплан», совокупная стоимость госзакупок серверов и хранилищ по № 44-ФЗ и 223-ФЗ за II полугодие 2025 года выросла год к году на 42 % на фоне сокращения количества госзакупок — с 5819 закупок на 51,6 млрд руб. во II полугодии 2024 года до 5308 закупок на 72,8 млрд руб. Большей частью закупали российскую технику, хотя было и иностранное оборудование. В некоторых случаях покупатель указывал конкретного вендора, оборудование которого он хотел бы приобрести. В таких закупках во II полугодии 2025 года продукция YADRO указывалась 100 раз против 74 годом ранее, уточнили в «Тендерплане». Общий объём этих закупок увеличился с 4,2 млрд до 7 млрд руб. В свою очередь, закупки серверов и СХД Depo выросли с 603 млн до 1,5 млрд руб., в то время как общее количество закупок – с 81 до 98. Закупки оборудования «Аквариуса» увеличились с 2,6 млрд до 3,1 млрд руб., а «Аэродиска» — снизилась с 1,9 млрд до 886,2 млн руб. На фоне роста закупок отечественного оборудования снизилась доля импортного. По данным «Тендерплана», во II полугодии 2024 года оборудование Huawei упоминалось в 70 закупках на сумму 745,6 млн руб., а во втором полугодии 2025 года — в 60 закупках на 888,7 млн руб. Закупки техники IBM сократились во II полугодии 2025 года относительно того же периода 2024 года с 1,2 млрд до 638,9 млн руб. Закупки оборудования Hitachi остались на уровне 66,9 млн руб. И лишь закупки оборудования Lenovo показали рост, причём значительный — с 776,3 млн руб. в 2024 году до 1,2 млрд руб. в 2025 году.

02.02.2026 [11:13], Сергей Карасёв

Hitachi Vantara: устаревшая инфраструктура данных оборачивается $108 млрд неэффективных инвестиций в ИИИсследование, проведённое компанией Hitachi Vantara, говорит о том, что устаревшая инфраструктура хранения и обработки данных оказывает негативное влияние на реализацию ИИ-проектов. В частности, по этой причине неэффективными в глобальном масштабе оказываются до $108 млрд инвестиций в ИИ-сфере в год. Инфраструктурные недостатки мешают 58 % организаций в США и Канаде извлечь выгоду из использования ИИ. В опросе приняли участие более 1200 руководителей высшего звена, включая глав IT-подразделений, из 15 стран, в том числе 307 респондентов из США и Канады. Около 84 % этих предприятий заявили о слишком быстром повышении сложности их инфраструктуры данных, что мешает управлению. Более половины — 57 % — опрошенных утверждают, что это затрудняет выявление утечек информации. А 59 % опасаются, что критическая потеря данных будет катастрофической для их компании. Как показало исследование, 98 % организаций используют, тестируют или оценивают ИИ, однако возможности предприятий в плане масштабирования таких проектов и получения выгоды от них значительно различается. В США и Канаде 42 % компаний считаются зрелыми в плане работы с данными. Вместе с тем 58 % организаций сталкиваются с различными трудностями, включая структурные недостатки и сложности с автоматизацией. Примерно 84 % респондентов, чьи компании обладают высоким уровнем зрелости в области работы с данными, сообщили об измеримой рентабельности инвестиций в ИИ по сравнению с 48 % предприятий, отстающих в соответствующей области. Одним из ключевых факторов успеха при реализации ИИ-проектов является качество данных: об этом заявили 59 % респондентов. Среди организаций с развитой инфраструктурой данных 59 % говорят, что ИИ имеет решающее значение для их бизнеса, против всего 18 % среди компаний с более слабой базой. О внедрении средств автоматизации в таких группах предприятий сообщили соответственно 65 % и 27 % опрошенных, о наличии отказоустойчивой архитектуры — 82 % и 19 %.

30.01.2026 [10:54], Владимир Мироненко

Спасите наши SSD: VAST Data запустила программу VAST Amplify для повышения эффективности использования имеющихся накопителейВ ответ на растущий дефицит флеш-памяти компания VAST Data, специализирующаяся на инфраструктуре для ИИ, представила программу VAST Amplify, разработанную для того, чтобы помочь организациям увеличить эффективную ёмкость имеющихся у них SSD. Взаимодействие компании с клиентом в рамках VAST Amplify проходит в несколько этапов. Сначала производится исследование инфраструктуры, в ходе которого VAST анализирует всю среду хранения данных клиента, чтобы выявить участки недоиспользуемых SSD, фрагментации между разрозненными системами и связанные с устаревшей архитектурой потери, которые снижают эффективную ёмкость. Затем следует быстрая квалификация платформы — процесс быстрой сертификации существующих серверов и SSD клиента для использования в экосистеме VAST, позволяющий обойти зависимость от новых окон распределения оборудования. После этого с помощью восстановления и интеграции мощностей перепрофилированное оборудование объединяется в единое унифицированное пространство имён на базе ОС VAST AI. Это преобразует фрагментированную, привязанную к серверам флеш-память в глобально доступный пул высокопроизводительного хранилища, где мощность может динамически распределяться для любого приложения, устраняя ограничения, связанные с серверными границами или устаревшими архитектурами. Защита данных осуществляется на уровне платформы с использованием высокоэффективного кодирования с исправлением ошибок, а не традиционных методов, требующих интенсивной репликации и потребляющих в два-три раза больше «сырого» места. Это увеличивает полезную ёмкость при сохранении отказоустойчивости в масштабе. Как сообщается, программа обеспечивает шестикратное увеличение эффективной ёмкости, благодаря использованию базовой архитектуры VAST Data — Disaggregated Shared Everything (DASE) — и набору передовых программных технологий. В отличие от традиционных систем, которые выполняют редукцию данных в изолированных узлах или томах, подход VAST является глобальным и всеобъемлющим. Одним из ключевых элементов является непрерывная глобальная редукция на основе сходства. Эта технология ищет и устраняет повторяющиеся паттерны данных по всему кластеру хранения, а не только в одном файле, наборе данных или томе. Это позволяет существенно увеличить эффективную ёмкость при фиксированном объёме флеш-памяти, особенно в ИИ-средах, где наборы обучающих данных могут содержать огромное количество похожей или дублирующейся информации. Большую роль играет архитектура записи, оптимизированная для SCM (Storage Class Memory). Все входящие данные сначала записываются в сверхбыстрый SCM-буфер, что позволяет системе «поглощать» случайные и «импульсные» записи, а затем интеллектуально организовывать и записывать данные на базовые SSD большими последовательными блоками, что снижает коэффициент усиления записи, повышает износостойкость и срок службы флеш-накопителей, поддерживая при этом низкую задержку без необходимости использования дорогостоящего оборудования с избыточным резервированием. Благодаря сочетанию этих методов, операционная система VAST AI OS позволяет значительно увеличить эффективную ёмкость при фиксированном объёме физической флеш-памяти, говорит компания. Впрочем, Dell, крупный поставщик более традиционных СХД, не одобряет подход VAST Data, который фактически подразумевает использование б/у SSD.

25.01.2026 [14:36], Сергей Карасёв

Пир во время чумы: ExaGrid представила 17-Пбайт All-Flash СХД для резервного копированияКомпания ExaGrid анонсировала новые системы хранения типа All-Flash, предназначенные для резервного копирования больших объёмов информации. Устройства, как утверждает производитель, обеспечивают высокий уровень безопасности, включая «воздушный зазор». В серию вошли четыре модели — EX90-SSD, EX135-SSD, EX270-SSD и EX540-SSD. Все они выполнены в форм-факторе 2U. «Сырая» вместимость составляет соответственно 131, 184, 369 и 737 Тбайт, полезная ёмкость — 108, 161, 323 и 645 Тбайт. Новинки могут масштабироваться до 32 устройств в одной системе, что позволяет формировать платформы резервного копирования общим объёмом до 17,3 Пбайт. По заявлениям ExaGrid, на сегодняшний день это самый высокий показатель для решений такого класса.

Источник изображения: ExaGrid Системы ExaGrid имеют двухуровневую архитектуру. Это, в частности, зона приёма (Landing Zone), куда поступают необработанные данные: восстановление отсюда осуществляется максимально быстро. Второй уровень — зона хранения (Repository Zone), недоступная для сети: этот слой использует дедупликацию, из-за чего время восстановления увеличивается. Устройства построены на фирменном софте ExaGrid 8. Говорится о совместимости с большим количеством приложений и утилит резервного копирования, включая Veeam, Commvault, Rubrik, NetBackup, Cohesity, Oracle RMAN Direct и пр. Среди ключевых возможностей упомянуты средства автоматического обнаружения угроз и защиты (выявляют аномалии, уведомляют о рисках и обеспечивают восстановление информации), неизменяемые объекты данных, функция отложенного удаления, различные варианты аварийного восстановления. Реализована блокировка времени хранения данных на основе искусственного интеллекта для восстановления после атак программ-вымогателей.

21.01.2026 [13:49], Руслан Авдеев

SSD для корпоративных клиентов теперь в 16 раз дороже, чем HDDПоставщик СХД для HPC и ИИ ЦОД — компания VDURA заявила, что ценовая пропасть между SSD и HDD корпоративного уровня расширяется, поскольку цены на твердотельные накопители растут значительно быстрее, чем на жёсткие диски, сообщает Blocks & Files. Новая информация, в частности, должна положить конец рассуждениям о том, что SDD окончательно вытеснят HDD, о чём так мечтает Pure Storage, по крайней мере, до тех пор, пока цены на NAND-память значительно не упадут. VDURA полагает, что критические изменения рынка особенно отразятся на ИИ, HPC и других средах с интенсивным использованием данных, где требования к производительности памяти не изменятся даже по мере роста цен. Компания ежеквартально публикует т.н. Flash Volatility Index (FVI) и Storage Economics Optimizer Tool для мониторинга изменений цен на SSD и HDD и помогает клиентам хотя бы отчасти компенсировать стремительный рост цен на твердотельные накопители. По данным VDURA, со II квартала 2025 года по I квартал 2026 цена 30-Тбайт TLC SSD выросла на 257 %, с $3062 до $10 950, а цены на HDD за тот же период выросли на 35 %, что расширило ценовой разрыв. Так, разница в цене TLC SSD и HDD выросла с 6,2 раза во II квартале 2025 года до 16,4 раза в I квартале 2026-го, а в случае QLC SSD — в 14,2 раза. В результате значительно выросли риски для All-Flash архитектур. Утверждаются, что отправленные несколько месяцев назад коммерческие предложения теперь требуют полного пересмотра бюджетов. The Flash Volatility Index помогает отследить, как изменения в цепочке поставок флеш-накопителей ведут к изменению цен на реальном розничном рынке и как это сравнимо с рынком HDD. Storage Economics Optimizer Tool позволяет клиентам моделировать общую стоимость системы с учётом различных архитектур хранения, целевых показателей производительности и др. VDURA использовала Storage Economics Optimizer Tool для оценки воздействия волатильности цен флеш-накопителей для распространённых архитектур хранилищ на 25 Пбайт, обеспечивающих скорость передачи данных 1 Тбайт/с. По данным на II квартал 2025 года, хранилище, использовавшее исключительно SSD, предполагало годовые затраты в размере $8,50 млн. К I кварталу 2026 года та же конфигурация подорожала до $24,54 млн, рост составил 189 %, в основном из-за роста цен на SSD. При этом утверждается, что архитектуры, комбинирующие использование SSD и HDD, позволяют значительно снизить рост цен и эффект от возможного неожиданного скачка цен на рынке твердотельных накопителей, с сохранением необходимых уровней производительности. В докладе FVI отражается усугубляющееся ценовое давление по всем уровнями инфраструктурного стека. Со II квартала 2025 года по I квартал 2026 года цены на оперативную память (DRAM) взлетели на 205 %, рост обусловлен высоким спросом на системы на основе ИИ-ускорителей, требующие больших объёмов памяти. Высокоскоростные сетевые компоненты столкнулись с похожими ограничениями, что дополнительно сказывается на цене систем. Особенно это затратно для вариантов с большим количеством узлов. Согласно данным из доклада FVI, многолетние договоры о покупке компонентов гиперскейлерами фактически заблокировали значительную часть мощностей для производства SSD до конца 2026 г. В то же время крупномасштабные инфраструктурные ИИ-проекты продолжают «поглощать» оставшиеся поставки. По оценкам экспертов, ценовое давление может сохраниться и в 2027 году и позже. Как заявляют в VDURA, после десятилетия относительно стабильного ценообразования на NAND-память, правила изменились. Лидерам рынка инфраструктуры требуются реальные данные о том, что происходит и планировать деятельность в соответствии с существующими трендами.

21.01.2026 [13:03], Сергей Карасёв

Dell представила All-Flash СХД PowerStore 5200Q для QLC SSDКомпания Dell расширила ассортимент СХД серии PowerStore, анонсировав модель 5200Q типа All-Flash. Новинка позволяет сформировать интеллектуальное хранилище, обеспечивающее ускорение работы с блочными, файловыми и виртуальными томами. Устройство выполнено на аппаратной платформе Intel. Применены два контроллера, функционирующие в режиме «активный — активный». В общей сложности задействованы четыре неназванных процессора Xeon с 96 вычислительными ядрами, работающими на частоте 2,2 ГГц. Объём оперативной памяти составляет 1152 Гбайт. СХД имеет типоразмер 2U. Во фронтальной части расположены 25 отсеков для SFF-накопителей NVMe. Могут применяться SSD на основе чипов памяти QLC вместимостью 15,36 и 30,72 Тбайт. Питание обеспечивают два блока с резервированием. В общей сложности могут быть использованы до 24 сетевых Front-end-портов в следующей конфигурации: 16 × FC16/32, 24 × 10GbE, 24 × 10/25GbE или 8 × 100GbE. Секция Back-end включает порты 100GbE QSFP. Кроме того, предусмотрен выделенный сетевой порт управления 1GbE. Говорится о поддержке протоколов FC, NVMe/FC, iSCSI, NVMe/TCP, NFSv3/4/4.1/4.2; CIFS SMB 2/3.0/3.02/3.1.1, FTP и SFTP. В связке с СХД могут функционировать до трёх модулей расширения формата 2U, рассчитанных на 24 накопителя SFF (NVMe) каждый. Таким образом, в общей сложности система с учётом устройств расширения может содержать до 93 накопителей SFF и четыре изделия NVRAM. В составе кластера количество SSD может достигать 372 штук при суммарной вместимости 23,6 Пбайт с учётом компрессии. В качестве программной платформы применяется PowerStore OS. |

|