Материалы по тегу: периферийные вычисления

|

21.05.2026 [14:55], Руслан Авдеев

Armada привлекла $230 млн на расширение производства модульных ИИ ЦОДArmada Inc., поставляющая контейнерные дата-центры и ПО для спутниковых интернет-технологий, привлекла $230 млн инвестиций, повысив оценку капитализации до $2 млрд, сообщает Silicon Angle. Ведущими инвесторами выступили BlackRock, Overmatch и 8090 Industries. Также в раунде приняли участие другие компании, в т.ч. крупный поставщик промышленного оборудования Johnson Controls, заключивший с Armada сделку о промышленном партнёрстве. Armada предлагает серию портативных ЦОД Galleon. Самый компактный вариант Beacon размером всего с чемодан, самый большой обеспечивает вычислительную мощность в несколько мегаватт. ЦОД поставляются в защищённых контейнерах, способных выдержать высокие температуры, удары и прочие внешние воздействия. Встроенные в корпус датчики позволяют своевременно выявлять попытки взлома. Прочность таких ЦОД позволяет работать даже в нетипичных условиях. По словам Armada, дата-центры можно вводить в эксплуатацию за несколько дней, поскольку им не нужна специальная энергетическая инфраструктура. Johnson Controls тоже выпускает модульные ЦОД и имеет подразделение Silent-Aire для производства систем воздушного охлаждения серверных. Недавно компания также приобрела купила разработчика СЖО Alloy Enterprises. Johnson Controls поможет Armada построить производство площадью 37 тыс. м2 для выпуска модульных дата-центров. Уже летом компании рассчитывают начать производство, первоначально приоритете будет отдаваться самому крупному варианту ЦОД Armada — Leviathan.

Источник изображения: Armada Компания также предлагает маркетплейс, позволяя предустановить сторонние ИИ-системы на оборудование Galleon, а платформа Bridge позволяет монетизировать ИИ-инфраструктуру, сдавая вычислительные мощности в аренду. Сервис Atlas позволяет клиентам приобретать спутниковые терминалы Starlink за «кредиты» Microsoft Azure, управлять ими и отслеживать использование интернета. Наконец, ПО Drones добавляет функциональность, позволяющую управлять БПЛА. Armada заявляет, что ПО позволяет собирать телеметрию состояния компонентов беспилотников и отслеживать их полёт, а встроенный ИИ-ассистент ускоряет выполнение некоторых задач, вроде составления графиков техобслуживания.

15.05.2026 [10:57], Сергей Карасёв

Мини-ПК DX-AIPlayer получил ИИ-ускоритель DX-M1 с производительностью 25 ТопсЮжнокорейский стартап Deepx, по сообщению ресурса CNX Software, выпустил компьютер DX-AIPlayer небольшого форм-фактора, предназначенный для решения ИИ-задач на периферии. В устройстве соседствуют процессор Intel поколения Alder Lake-N и фирменный ускоритель DX-M1. Новинка заключена в корпус с габаритами 95 × 95 × 55 мм, а масса составляет около 450 г. Установлен чип Intel Processor N97 с четырьмя ядрами (без многопоточности), работающими на частоте до 3,6 ГГц (TDP — 12 Вт). Объём оперативной памяти LPDDR5 составляет 8 Гбайт с возможностью расширения до 16 Гбайт. Вместимость флеш-накопителя eMMC — 64 или 128 Гбайт. Упомянутый ускоритель Deepx DX-M1 выполнен в виде модуля M.2 2280 M-Key с интерфейсом PCIe 3.0 x4. Он располагает 4 Гбайт памяти LPDDR5 и чипом QSPI NAND на 1 Гбит, а TDP составляет 5 Вт. Заявленная ИИ-производительность достигает 25 TOPS в режиме INT8. В оснащение мини-компьютера входит двухпортовый 1GbE-контроллер; опционально может быть добавлен комбинированный адаптер Wi-Fi/Bluetooth (M.2 2230 E-key). Есть интерфейсы HDMI 2.0b и DisplayPort 1.2 для вывода изображения, три порта USB 3.1 Type-A, два гнезда RJ45 для сетевых кабелей, два последовательных порта (RS-232/422/485), а также 3,5-мм аудиогнёзда. Питание (12 В) подаётся через DC-разъём. Возможен монтаж на стену или монитор посредством крепления VESA. Диапазон рабочих температур — от 0 до +60 °C. Говорится о поддержке ОС Windows 10/11, Ubuntu (20.04/22.04/24.04 LTS) и Yocto Project (v5.1), а также популярных фреймворков, включая PyTorch, TensorFlow, ONNX, Keras и Ultralytics YOLO. Цена составляет $995 за версию с 8 Гбайт ОЗУ.

14.05.2026 [10:56], Сергей Карасёв

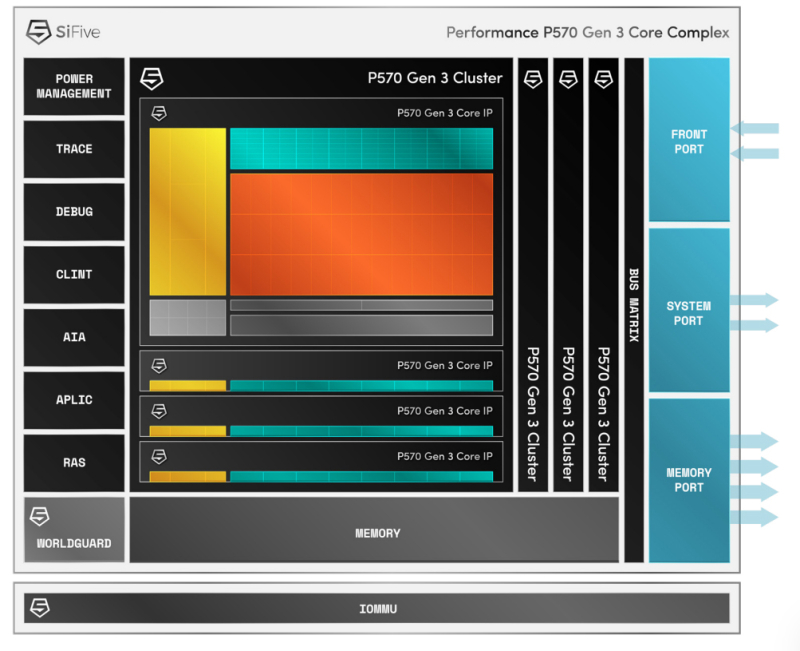

SiFive представила RISC-V-ядра Performance P570 Gen 3 для IoT-приложенийКомпания SiFive анонсировала производительные процессорные ядра Performance P570 третьего поколения (Gen 3) с архитектурой RISC-V. Они ориентированы на требовательные периферийные ИИ-приложения, потребительские и коммерческие решения интернета вещей (IoT) и пр. Новые ядра используют 64-бит архитектуру RISC-V с поддержкой внеочередного исполнения инструкций. Допускаются конфигурации, насчитывающие до четырёх ядер в кластере. При этом возможно использование до четырёх кластеров, что в сумме даёт до 16 вычислительных ядер. Используется общий кеш L3 на уровне кластера и опциональный общий кеш L2. Для Performance P570 Gen 3 заявлена поддержка широкого спектра типов данных: INT8, INT16, INT32, INT64, FP16, FP32, FP64 и BFloat16. Заявлена полная совместимость с профилем RVA23, который стандартизирует набор инструкций ISA. Реализованы такие функции, как векторные операции, инструкции с плавающей запятой и атомарные инструкции, которые востребованы в сферах НРС и ИИ. Добавлены расширения для повышения производительности и улучшения безопасности, включая Smepmp, Zvkng, Zvksg, Zicfilp, Zicfiss, Zfbfmin, Zvfbfmin, Zvfbfwma и Zvdot4a8i. Упомянута возможность работы с современными ОС, включая Android, Ubuntu 26.04 LTS и платформы Red Hat. В тесте Geekbench 6 ядра Performance P570 Gen 3 демонстрируют примерно вдвое более высокую производительность в расчёте на 1 ГГц по сравнению с изделиями P550. При выполнении определённых ИИ-задач, таких как распознавание объектов, достигается 21-кратный прирост быстродействия благодаря 128-битному векторному конвейеру VLEN. Если сравнивать с ядрами P470 Gen2, то у P570 выигрыш в производительности составляет 30 % и 350 %. В традиционных CPU-нагрузках, по данным SpecInt 2006/2017, ядра P570 показывают прирост быстродействия на 7–13 % по сравнению с P550 при сопоставимых значениях с P470. Кроме того, обеспечивается повышение энергетической эффективности. У ядер Performance P570 Gen 3 динамическое энергопотребление (мВт/ГГц) снижено на 13 % и 5 % по сравнению с P550 и P470 соответственно, а потери мощности (мВт) уменьшены на 51 % и 5 %.

12.05.2026 [16:33], Руслан Авдеев

Космический DevSecOps: Red Hat и Voyager Technologies успешно протестировали микро-ЦОД на борту МКС

linux

red hat

red hat enterprise linux

software

гибридное облако

ии

контейнеризация

космос

микро-цод

мкс

периферийные вычисления

Red Hat и Voyager Technologies объявили об успешном развёртывании в космическом микро-ЦОД LEOcloud Space Edge IaaS на борту МКС программных платформы RHEL Linux 10.1 и образа Red Hat Universal Base Image (UBI). Проект предназначен для развития орбитальных ЦОД и периферийных вычислений в космосе. Предлагаемое решение позволяет запускать контейнеризированные и связанные с ИИ нагрузки на орбите, ближе к источнику получаемых в космосе данных. Использование версии Red Hat Enterprise Linux на аппаратной площадке Space Edge Micro Datacenter позволяет снизить задержки и операционные издержки, в то же время обеспечивая более проактивную защиту периферийных сред, говорит компания. По словам Red Hat, космос стал «новым фронтиром» для гибридных облаков, на котором успех зависит от наличия надёжной, доверенной облачной инфраструктуры, где бы ни генерировались данные. Появление орбитальных ЦОД (ODC) требует открытых инноваций и чрезвычайно высокой отказоустойчивости. Взаимодействие компаний направлено на решение уникальных для космических сред проблем: оптимизацию работы систем при дефиците электроэнергии и аппаратных ресурсов, обработку данных при задержках и перебоях связи, предоставление Linux корпоративного уровня. Интеграция соответствующих задач с наземными DevSecOps-практиками даст возможность Red Hat и Voyager помочь различным организациям расширять свои гибридные облака с повышением стабильности и операционной надёжности.

Источник изображения: NASA/unsplash.com Сегодня компании закладывают основу для новой эры вычислений в космосе, где облачные возможности будут распространяться от земной поверхности к низким околоземным орбитам, на Луну и т.д. Соответствующий подход позволит переносить DevSecOps-практики, стратегии контейнеризации и проактивные механизмы безопасности в передовые операционные среды. Компании выделили несколько ключевых технологических особенностей платформы:

Voyager расширяет DevSecOps-практики в космос благодаря использованию «движка» для запуска контейнеров Podman и Ansible Automation Platform для автоматизации задач, с контейнеризированными приложениями, работающими от земли до орбиты и инструментами, оптимизированными с помощью ИИ. В сентябре 2025 года сообщалось, что прототип орбитального ЦОД Axiom Space и Red Hat для экспериментов с периферийными вычислениями прибыл на МКС, а в октябре того же года основатель Amazon Джефф Безос (Jeff Bezos) пророчил эпоху космических ЦОД гигаваттного масштаба. Этой весной SpaceX подала заявку на вывод в космос миллиона спутников-ЦОД, а у Amazon, раскритиковавшей инициативу. Похоже, имеются собственные планы на этот счёт.

01.05.2026 [14:07], Сергей Карасёв

HPE представила серверы ProLiant Compute EL220/EL240 Gen12 для ИИ-задач на периферии

amd

epyc

gpu

granite rapids

hardware

hpe

intel

sierra forest

sorano

xeon

периферийные вычисления

сервер

HPE анонсировала серверы ProLiant Compute EL220 и EL240 Gen12 для приложений ИИ и критически важных рабочих нагрузок на периферии. Устройства выполнены на основе шасси ProLiant Compute EL2000, которое спроектировано специально для эксплуатации в суровых условиях. Системы на базе EL2000 могут использоваться при температурах от -40 до +55 °C и влажности до 95 %. Говорится об устойчивости к воздействию сильных вибраций, которые могут наблюдаться, например, на борту самолётов или наземной техники. Шасси допускает установку двух серверов ProLiant Compute EL220 Gen12 типоразмера 1U или одного сервера ProLiant Compute EL240 Gen12 в форм-факторе 2U. Эти устройства выполнены на процессорах Intel Xeon 6700 (Sierra Forest-SP/Granite Rapids-SP), которые могут насчитывать до 144 вычислительных ядер. Объём оперативной памяти DDR5 достигает 2 Тбайт. Возможен монтаж двух SSD формата М.2 (NVMe) и четырёх накопителей EDSFF. Модификация ProLiant Compute EL240 Gen12 также может быть укомплектована двумя GPU-ускорителями одинарной ширины или одной картой двойной ширины. Упомянуты средства управления iLO 7. В продажу новинки поступят позднее в текущем году. Кроме того, HPE представила обновлённую версию компактного edge-сервера ProLiant DL145 Gen11 на аппаратной платформе AMD. Это устройство переведено на процессоры EPYC 8005 Sorano, насчитывающие до 84 ядер. Поддерживается до 768 Гбайт DDR5. Система может быть оборудована двумя SFF-накопителями или шестью EDSFF-изделиями. Могут быть задействованы до трёх GPU одинарной ширины или один ускоритель двойной ширины. Сервер уже доступен для заказа.

25.04.2026 [11:15], Руслан Авдеев

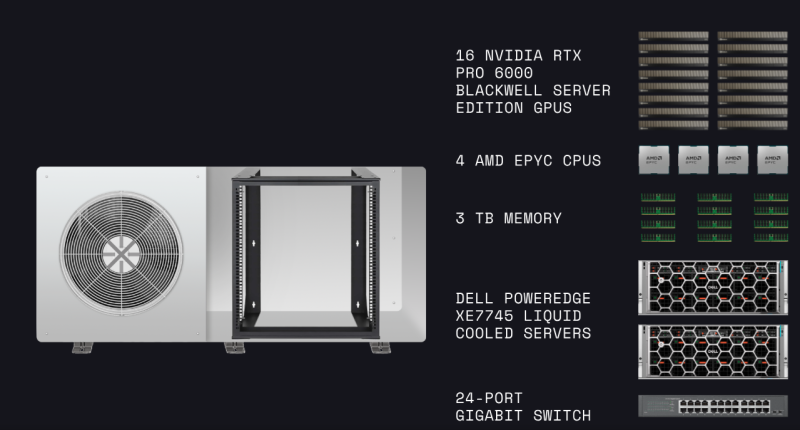

Электрощит с ИИ-сервером: SPAN анонсировала «распределённый ЦОД» XFRAЗанимающаяся выпуском умных распределительных электрощитов компания SPAN представила решение XFRA, позиционирующееся, как «распределённый дата-центр». Предполагается использование свободных мощностей в жилых домах и коммерческой недвижимости для ИИ-вычислений, сообщает Datacenter Dynamics. Каждый из вычислительных узлов оснастят двумя серверами Dell Poweredge XE7745 с СЖО — всего четыре процессора AMD EPYC, 3 Тбайт RAM и 16 ускорителей NVIDIA RTX Pro 6000 Blackwell. Для управления разработана собственная платформа оркестрации XFRA Cloud. SPAN будет использовать функции управления питанием в своих распределительных щитах для отдачи вычислительным узлам свободных энергомощностей, не используемых в данный момент владельцами объектов. SPAN подчёркивает, что XFRA не станет заменой полноценным ЦОД, но дополнит их, ускоряя рост вычислительных мощностей на периферийных участках электросети. Внедрение XFRA силами американского девелопера PulteGroup стартует в 2026 году. По имеющимся данным, уже сформировано портфолио проектов, позволяющее выйти на гигаваттный масштаб в 2027 году.

Источник изображения: SPAN PulteGroup заявила, что XFRA представляет собой решение, позволяющее снизить затраты на строительство. Строительство домов с щитами SPAN, системой XFRA и резервными аккумуляторами не просто снизит расходы на эксплуатацию жилья, но и позволит использовать энергетическую инфраструктуру объектов в интересах всей энергосистемы. SPAN входит в лоббистскую группу Utilize, созданную в марте 2025 года. Последняя выступает за «более умное, быстрое и доступное» использование имеющейся в США сетевой инфраструктуры. В число участников также входят Google, Tesla и производитель климатического оборудования — компания Carrier.

Источник изображения: SPAN Бизнес уже активно использует серверы в домах и коммерческих помещениях, но, в первую очередь, в несколько иных целях. Так, British Gas заключила соглашение с Heata, в рамках которого в Великобритании будет тестироваться облачная платформа с серверами в жилых домах. Каждый сервер подключен к системе домашнего отопления, аккумулирующей тепло в ходе работы сервера. Британская коммунальная UK Power Networks (UKPN) в рамках программы SHIELD (Smart Heat and Intelligent Energy in Low-income Districts) начала устанавливать в домах микро-ЦОД на базе Raspberry Pi — для отопления домохозяйств малоимущих и оплаты их коммунальных услуг.

18.04.2026 [15:04], Сергей Карасёв

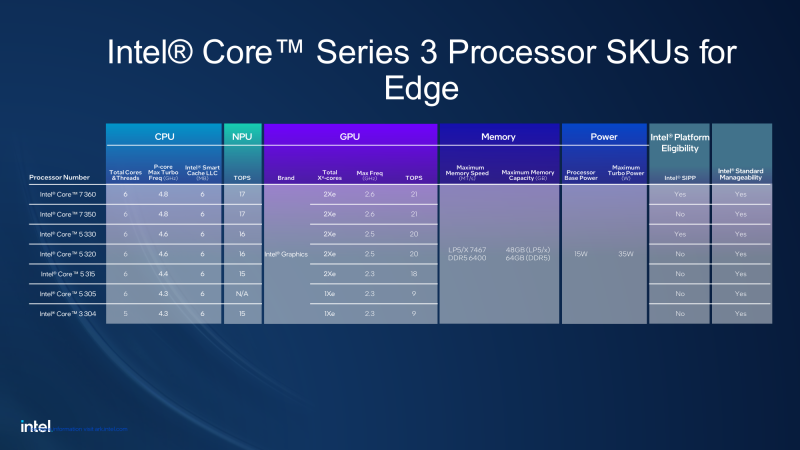

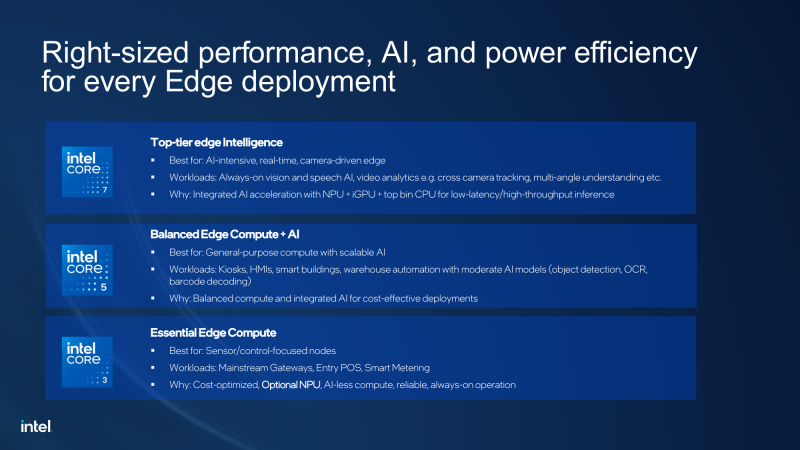

Intel представила процессоры Core Series 3 Wildcat Lake для периферийных устройствКорпорация Intel анонсировала процессоры Core Series 3 семейства Wildcat Lake, предназначенные для периферийного оборудования. Среди ключевых сфер применения названы индустриальная робототехника, оборудование для энергетической, транспортной и медицинской отраслей, решения для умного города и ретейла и пр. Чипы производятся в США по техпроцессу Intel 18A. Конфигурация включает до шести вычислительных ядер (2P+4LPE) без поддержки многопоточности с максимальной тактовой частотой в турбо-режиме до 4,8 ГГц. Объём кеша Intel Smart Cache LLC у всех изделий новой серии составляет 6 Мбайт. Базовый показатель TDP равен 15 Вт, максимальный — 35 Вт. В состав процессоров (кроме модели Intel Core 5 305) входит нейропроцессорный движок (NPU) с производительностью от 15 до 17 TOPS. Кроме того, используются одно или два графических ядра Intel Xe с частотой от 2,3 до 2,6 ГГц (в зависимости от модификации) и быстродействием от 9 до 21 TOPS. Таким образом, суммарная производительность чипов на операциях ИИ достигает почти 40 TOPS. Изделия Core Series 3 могут работать с памятью LPDDR5Х-7467 объёмом до 48 Гбайт или DDR5-6400 объёмом до 64 Гбайт. Для платформы заявлена поддержка шести линий PCIe 4.0 (две можно отдать PCIe-свитчу Microchip PCI 1008, чтобы получить шесть пар PCIe 3.0), двух интерфейсов Thunderbolt 4, а также Wi-Fi 7 R2 и Bluetooth 6. Разработчик заявляет, что по сравнению с изделиями NVIDIA Jetson Orin Nano топовый процессор семейства Wildcat Lake — Intel Core 7 350 — обеспечивает 1,5-кратный прирост производительности на задачах обнаружения объектов и 1,9-кратный прирост при классификации изображений. А на операциях видеоаналитики достигается 2,2-кратное преимущество.

Устройства на процессорах Core Series 3 планируют вывести на рынок такие компании, как Posiflex, AAEON и Advantech. Intel гарантирует доступность новых чипов в течение 10 лет. Заявлена поддержка TSN, Intel TCC, лёгкое профилирование под нагрузки/окружение, удалённое управление посредством Intel Standard Manageability и т.п.

14.04.2026 [23:00], Владимир Мироненко

Sophia Space обкатает софт на ИИ-спутниках Kepler перед запуском собственных космических ЦОДКанадская компания Kepler Communications, развернувшая в январе вычислительный комплекс из около 40 модулей NVIDIA Jetson Orin для периферийных систем на борту 10 действующих спутников, связанных между собой лазерными каналами связи, объявила о новом партнёре — Sophia Space. Сообщается, что этот стартап будет тестировать ПО для своего уникального орбитального компьютера с помощью спутниковой группировки Kepler. Kepler не планирует заниматься космическими ЦОД, но готова предлагать инфраструктуру для космических приложений, сообщила генеральный директор Мина Митри (Mina Mitry) изданию TechCrunch. По её словам, компания хочет стать промежуточным звеном, предоставляющим сетевые сервисы для других спутников в космосе, а также для летательных аппаратов, в том числе беспилотных, в воздушном пространстве Земли. В свою очередь, Sophia разрабатывает модульные космические компьютеры TILE Edge с пассивным охлаждением, которые позволят решить одну из ключевых проблем крупных ЦОД на орбите: предотвращение перегрева мощных процессоров без необходимости создания и запуска тяжёлых и дорогостоящих систем активного охлаждения. В рамках партнёрства Sophia развернёт свою собственную ОС на спутниках Kepler, объединив шесть GPU на двух космических аппаратах. Проверка работоспособности ПО на орбите станет ключевым этапом снижения рисков для Sophia перед первым запланированным запуском спутника в конце 2027 года. Для Kepler, уже имеющей 18 клиентов, это партнёрство станет дополнительным доказательством полезности её сети. В настоящее время она передаёт и обрабатывает данные, загружаемые с Земли или собираемые размещённым на собственных космических аппаратах оборудованием. Но по мере развития сектора компания рассчитывает начать подключение спутников других компаний для предоставления сетевых и вычислительных услуг. Именно в обработке данных там, где их собирают, для более быстрого реагирования, в частности, в военной области, орбитальные ЦОД докажут свою ценность. Эта концепция отличает Sophia и Kepler от таких аэрокосмических компаний, как SpaceX и Blue Origin, или стартапов, таких как Starcloud и Aetherflux, которые привлекают значительный капитал для создания крупномасштабных орбитальных ЦОД с «земными» чипами. «Поскольку мы считаем, что это скорее инференс, чем обучение, нам нужно больше распределённых GPU, — сказала Митри в интервью TechCrunch. — Если чип потребляет киловатты энергии, но работает только 10 % всего времени, то это не продуктивно. В нашем случае наши GPU используются без простоев». Глава Sophia Роб ДеМилло (Rob DeMillo) отметил, что с учётом того, что некоторые регионы в США уже ограничивают строительство ЦОД, развёртывание их на орбите становится всё более привлекательной альтернативой.

14.04.2026 [11:11], Сергей Карасёв

Supermicro выпустила компактные серверы на базе AMD EPYC 4005 для ИИ-задач на периферииКомпания Supermicro анонсировала компактные и энергоэффективные серверы AS-E300-14GR, AS-1116R-FN4 и AS-3015TR-i4 на аппаратной платформе AMD EPYC 4005 (Grado). Устройства предназначены для решения различных задач на периферии: это могут быть нагрузки общего назначения, ИИ-инференс и пр. Модель AS-E300-14GR выполнена в форм-факторе mini-1U с размерами 43 × 264,8 × 225,8 мм. Допускается установка одного процессора EPYC 4005/4004 в исполнении Socket AM5 (LGA-1718) с показателем TDP до 65 Вт. Доступны четыре слота для модулей оперативной памяти DDR5-5600 суммарным объёмом до 192 Гбайт. Могут быть размещены один SFF-накопитель с интерфейсом SATA, а также по одному SSD типоразмера M.2 2280 и M.2 22110 (оба с интерфейсом PCIe 5.0 x4). Упомянут один слот PCIe 5.0 x16 для низкопрофильных карт расширения. В оснащение входят четыре сетевых порта 1GbE (Intel I350-AM4) и выделенный сетевой порт управления 1GbE (ASPEED AST2600). Сервер получил два порта USB 3.1 Type-A, по одному порту USB 3.0 Type-A и USB 3.0 Type-C, разъёмы HDMI 2.1 и Mini-DP. Применено воздушное охлаждение.

Источник изображений: Supermicro Устройство AS-1116R-FN4, в свою очередь, получило корпус 1U небольшой глубины с габаритами 43 × 437 × 249 мм. Этот сервер также поддерживает один чип в исполнении Socket AM5 (LGA-1718) и до 192 Гбайт памяти DDR5-5600. В зависимости от модификации могут монтироваться два SFF-накопителя или один LFF-диск. Кроме того, есть слоты для SSD форматов M.2 2280 и M.2 22110 (PCIe 5.0 x4), а также разъём PCIe 5.0 x16. Упомянуты порт USB 3.1 Type-C, два коннектора USB 3.1 Type-A, порт USB 3.0 Type-A, интерфейсы HDMI 2.1 и Mini-DP. Сервер получил четыре сетевых порта 1GbE (Intel I350-AM4) и выделенный порт управления 1GbE (ASPEED AST2600).  Характеристики модели AS-3015TR-i4 полностью не раскрываются. Известно, что она выполнена в корпусе башенного типа объёмом около 9 л. Возможна установка двухслотового GPU-ускорителя (например, NVIDIA RTX PRO 2000 Blackwell), тонкого оптического привода и LFF-накопителя.

08.04.2026 [12:19], Сергей Карасёв

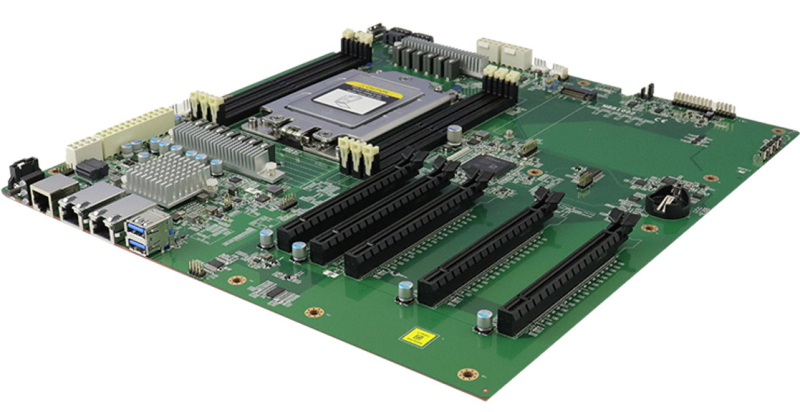

Плата iBase MBB1002 с поддержкой AMD EPYC Embedded 8004 рассчитана на периферийные ИИ-системыКомпания iBase Technology анонсировала материнскую плату MBB1002 типоразмера eATX, предназначенную для построения периферийных систем с функциями ИИ. Новинка выполнена на платформе AMD EPYC Embedded 8004 (Siena), которая дебютировала в конце 2024 года. Плата допускает установку процессора в исполнении AMD SP6 (LGA 4844). Доступны шесть слотов RDIMM для модулей оперативной памяти DDR5-3600/4000/4400/4800 суммарным объёмом до 576 Гбайт с поддержкой ECC (в конфигурации 6 × 96 Гбайт). Предусмотрены четыре порта SATA-3 для накопителей, разъём М.2 2280 для SSD с интерфейсом PCIe 5.0 и два коннектора MCIO (Mini Cool Edge IO) x4. Новинка располагает пятью слотами PCIe 5.0 x16 для карт расширения. Реализованы два сетевых порта 10GbE (контроллер Intel XC710-AT2). За безопасность отвечает чип TPM 2.0. Есть четыре 4-контактных разъёма для подключения вентиляторов охлаждения (один для CPU и три системных). Размеры материнской платы составляют 304 × 244 мм. Интерфейсный блок содержит два порта USB 3.0, два гнезда RJ45 для сетевых кабелей и последовательный порт (RS232 на базе коннектора RJ45). Через внутренние разъёмы могут быть задействованы два порта USB 2.0. Диапазон рабочих температур простирается от 0 до +60 °C. Модель iBase MBB1002 подходит для решения задач в области автоматизации, интеллектуального производства, промышленного интернета вещей, вычислений на периферии, аналитики данных в реальном времени и пр. |

|